AI for Science — Paper Curation

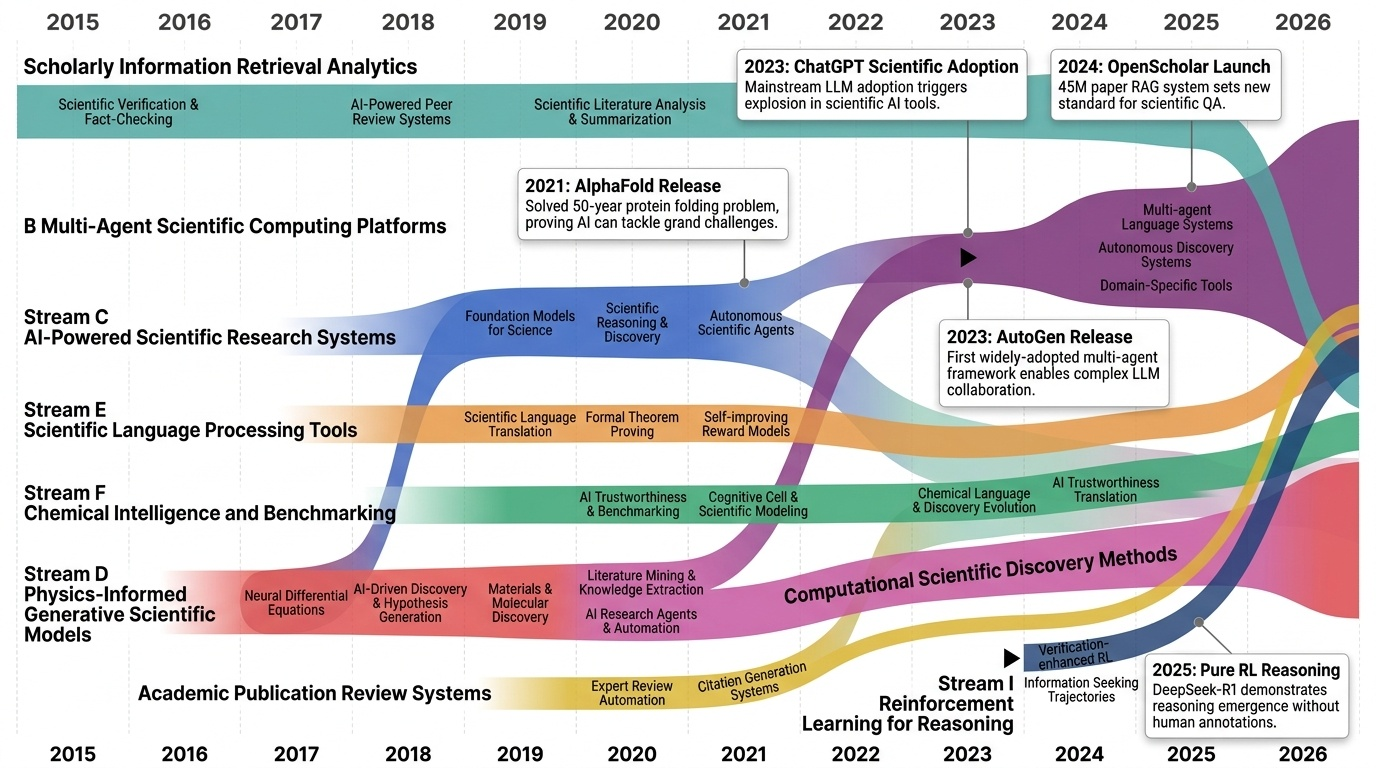

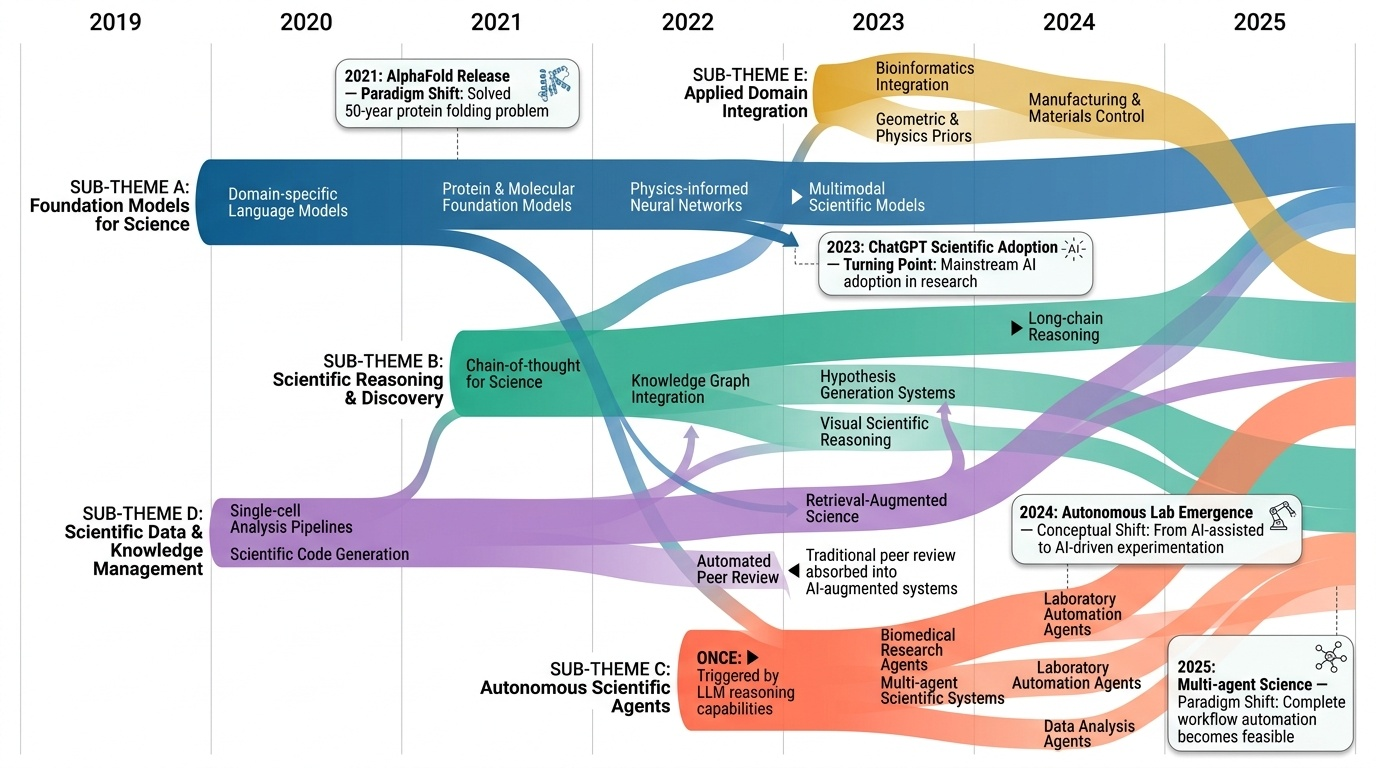

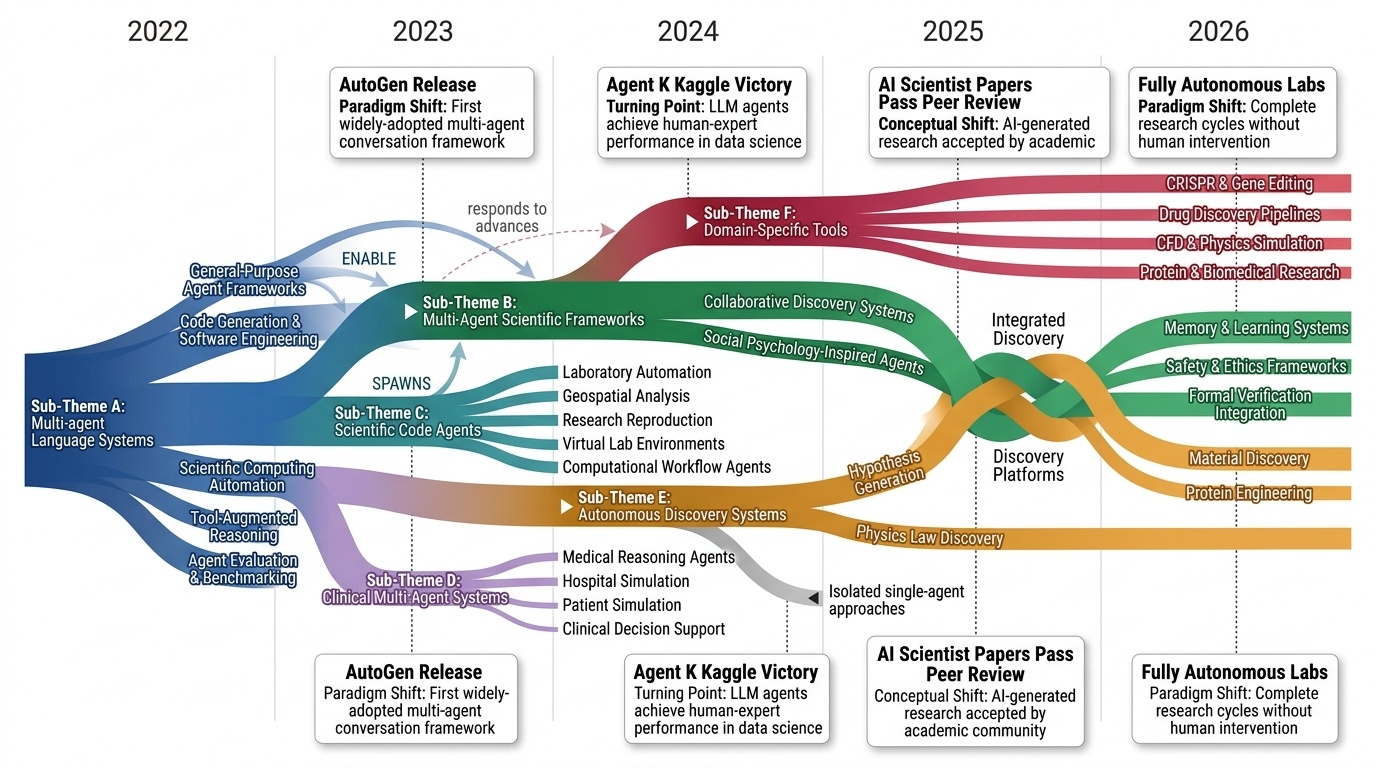

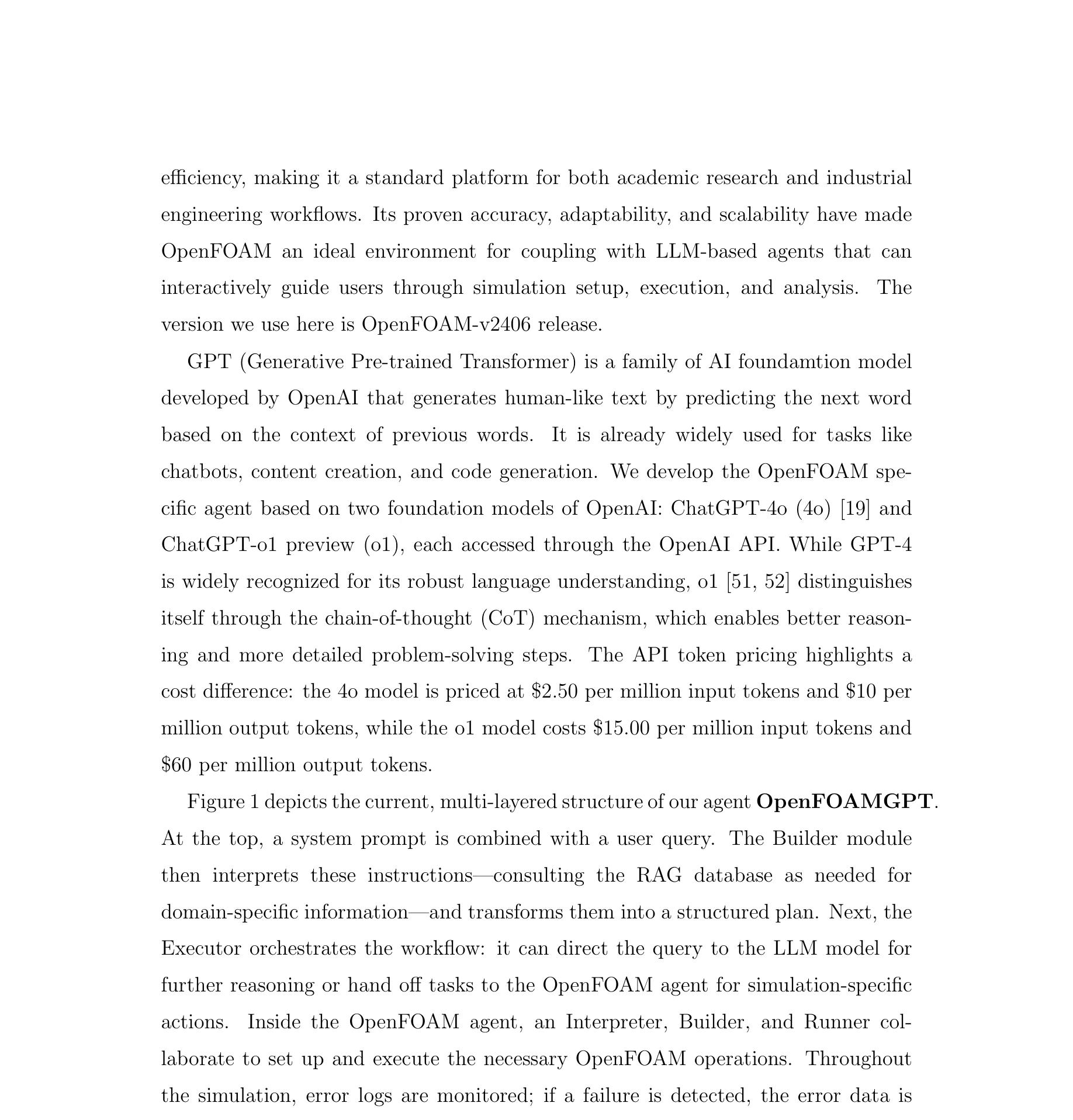

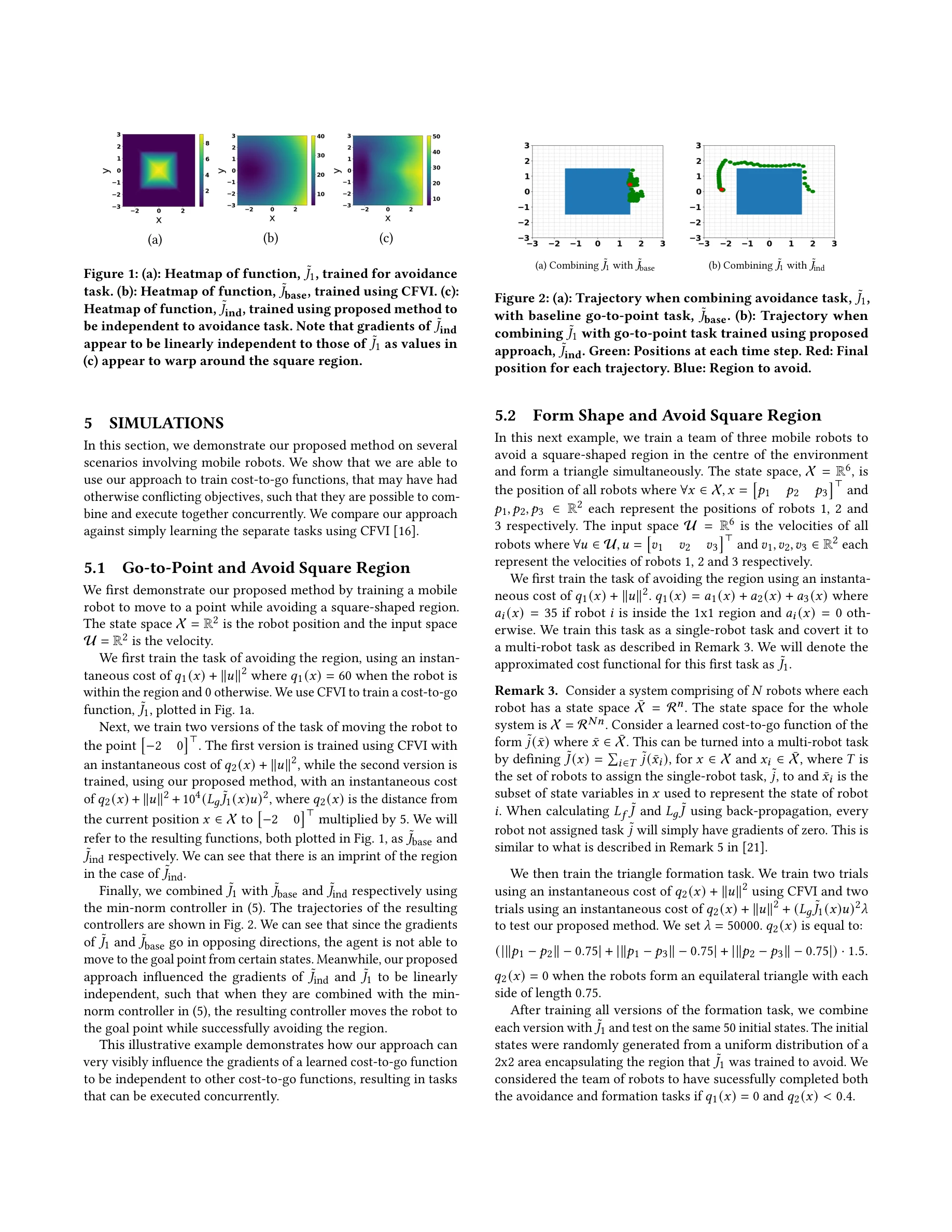

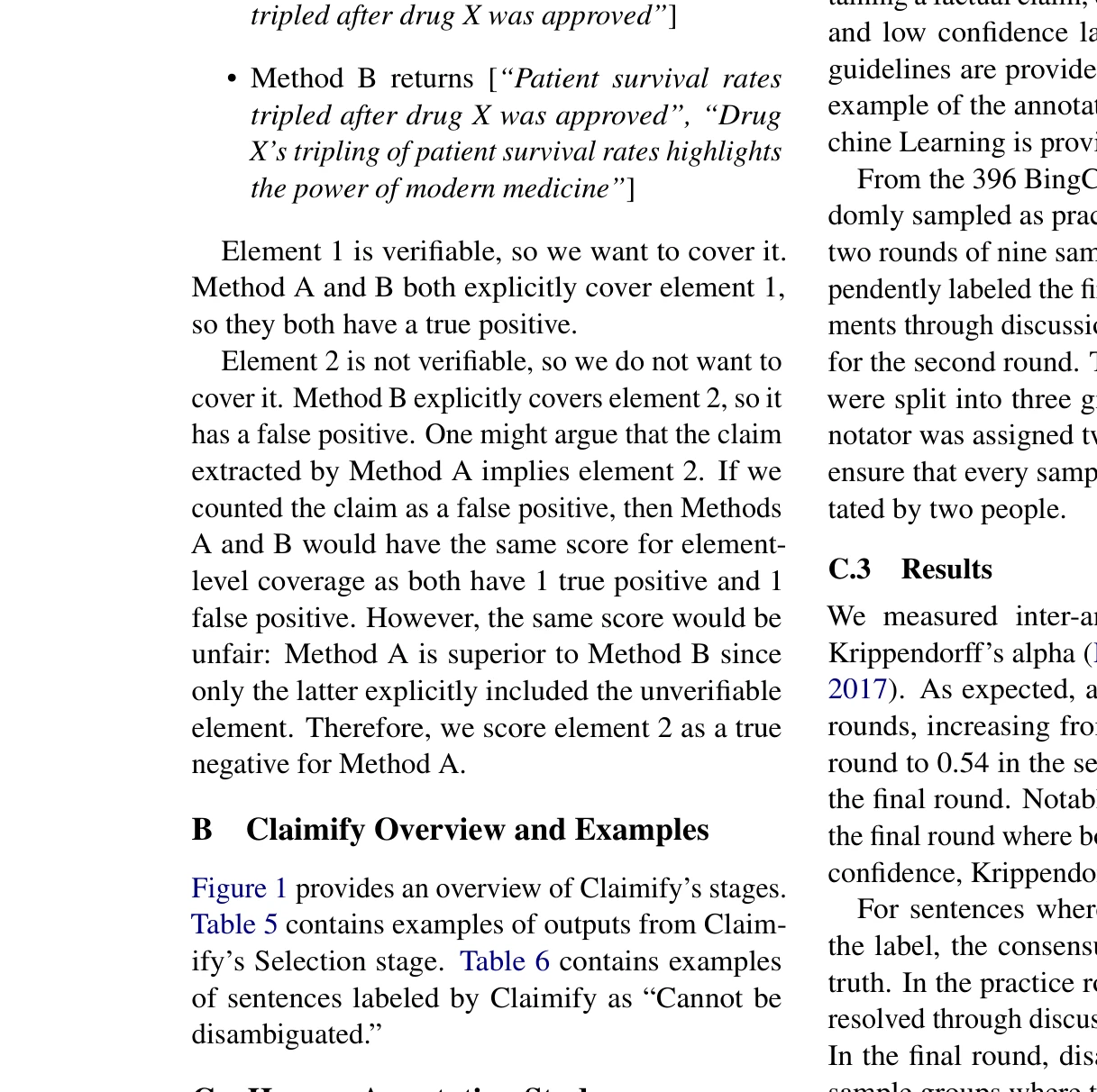

Research Timeline

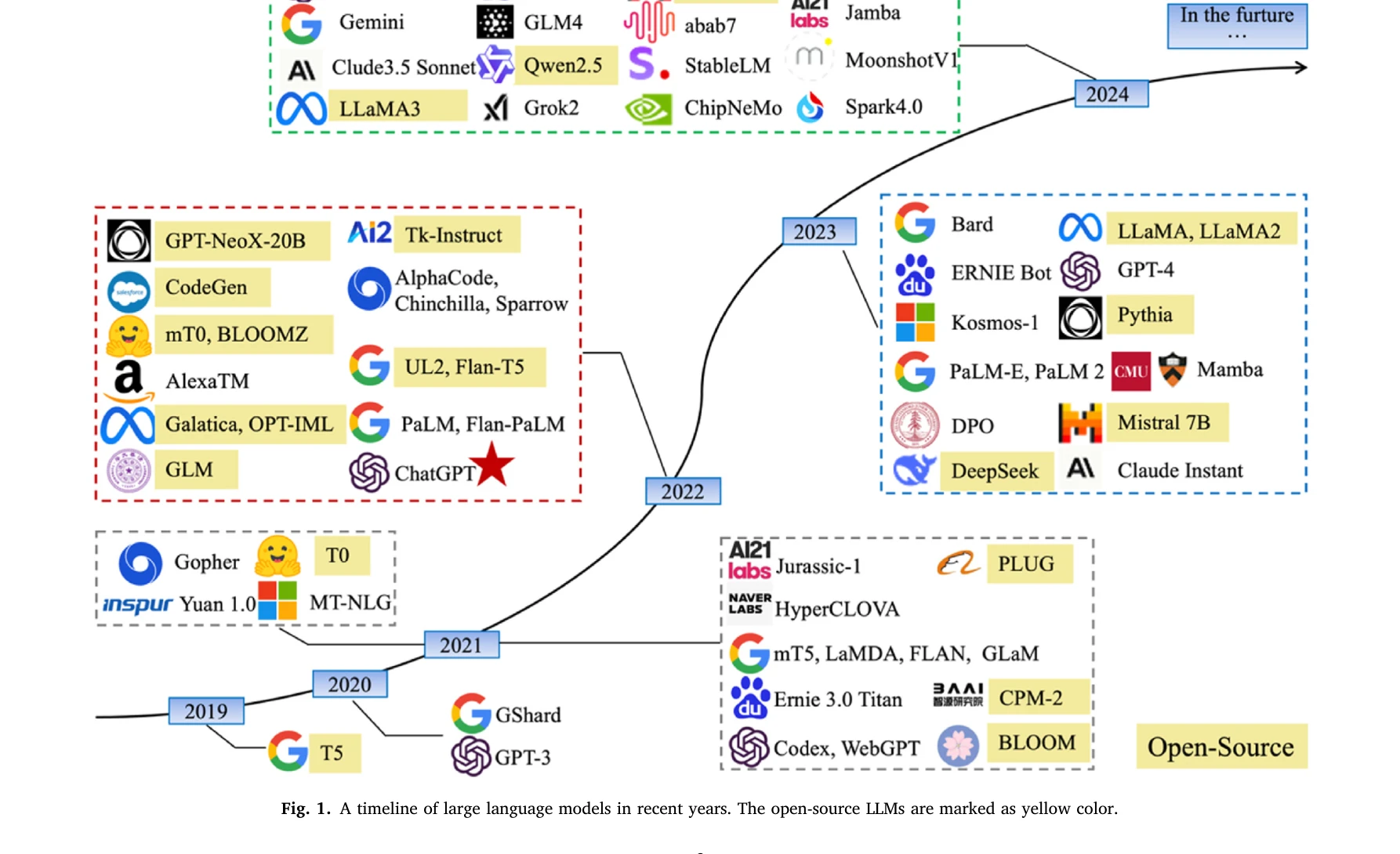

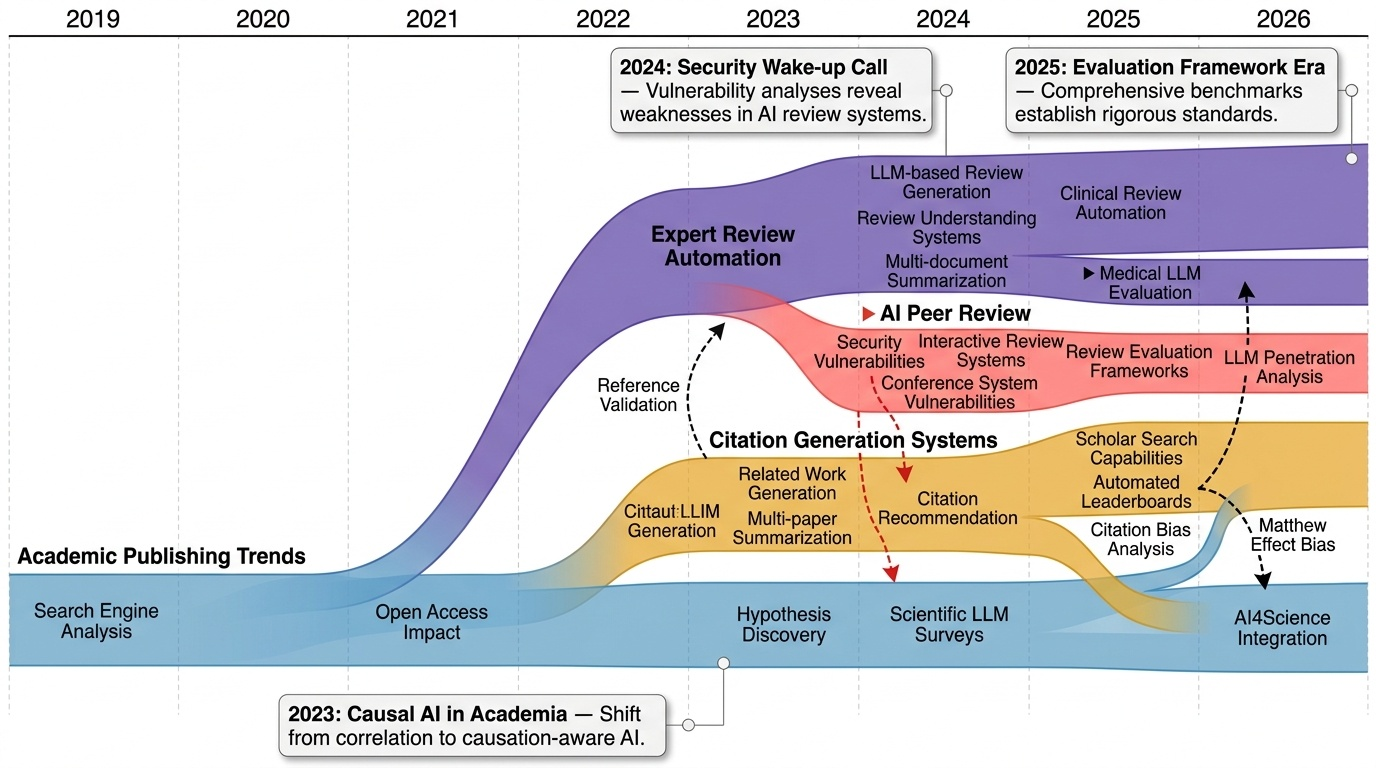

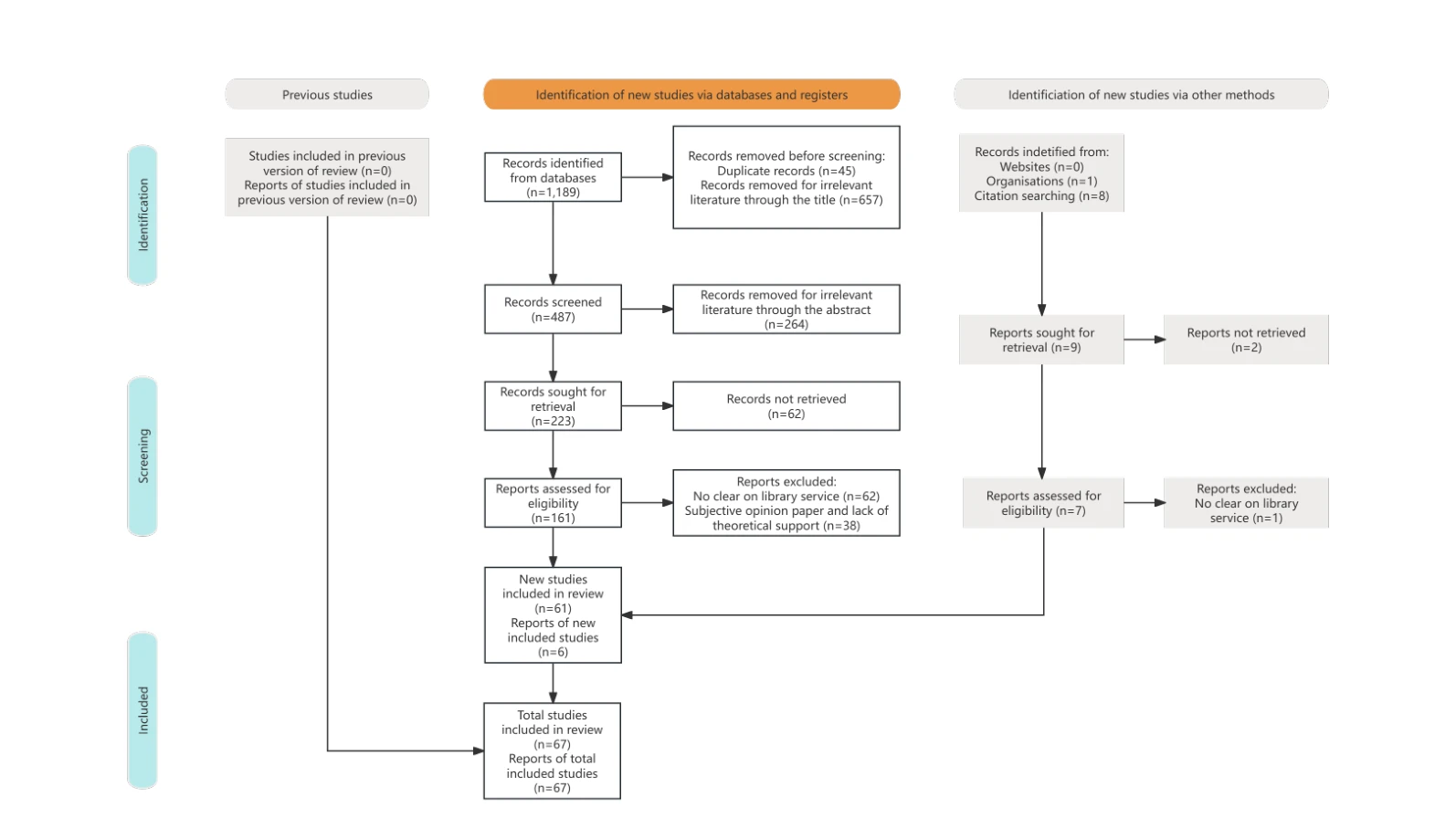

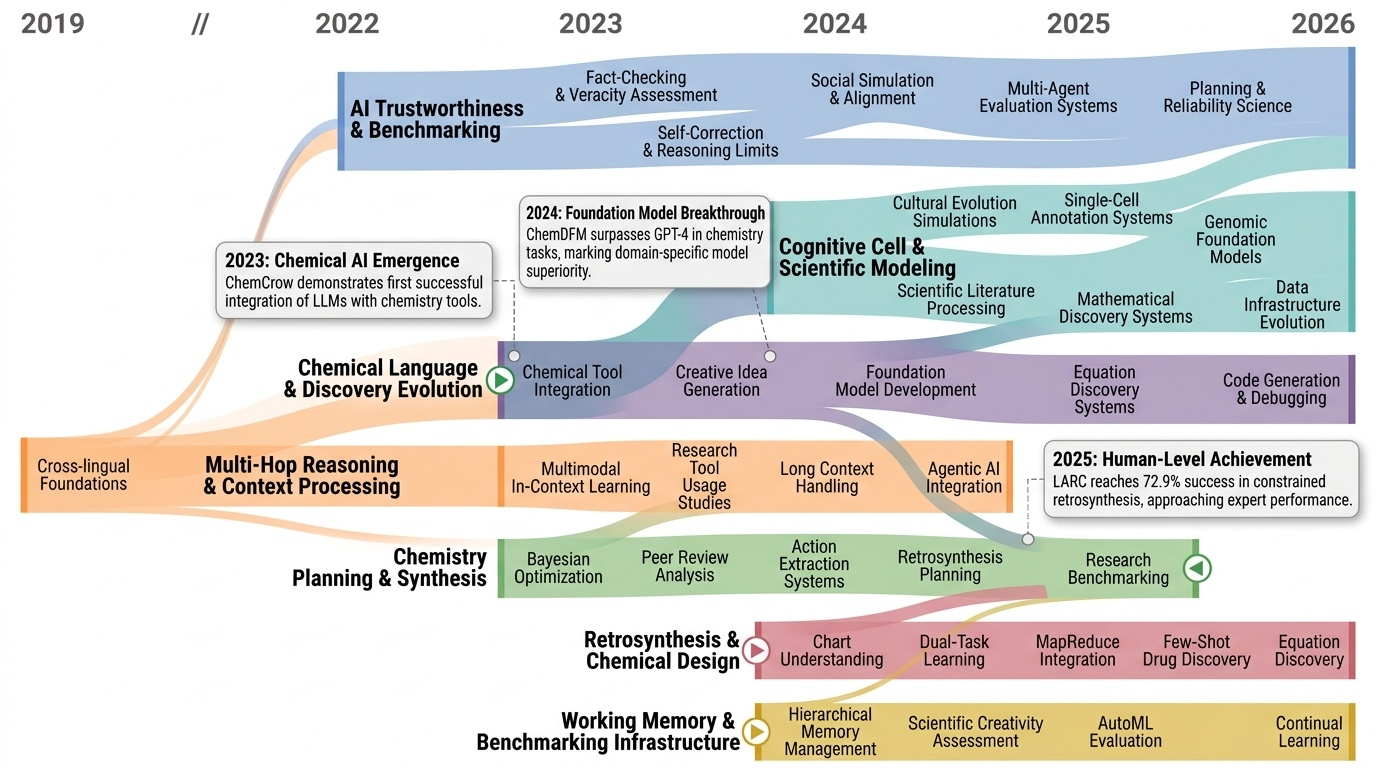

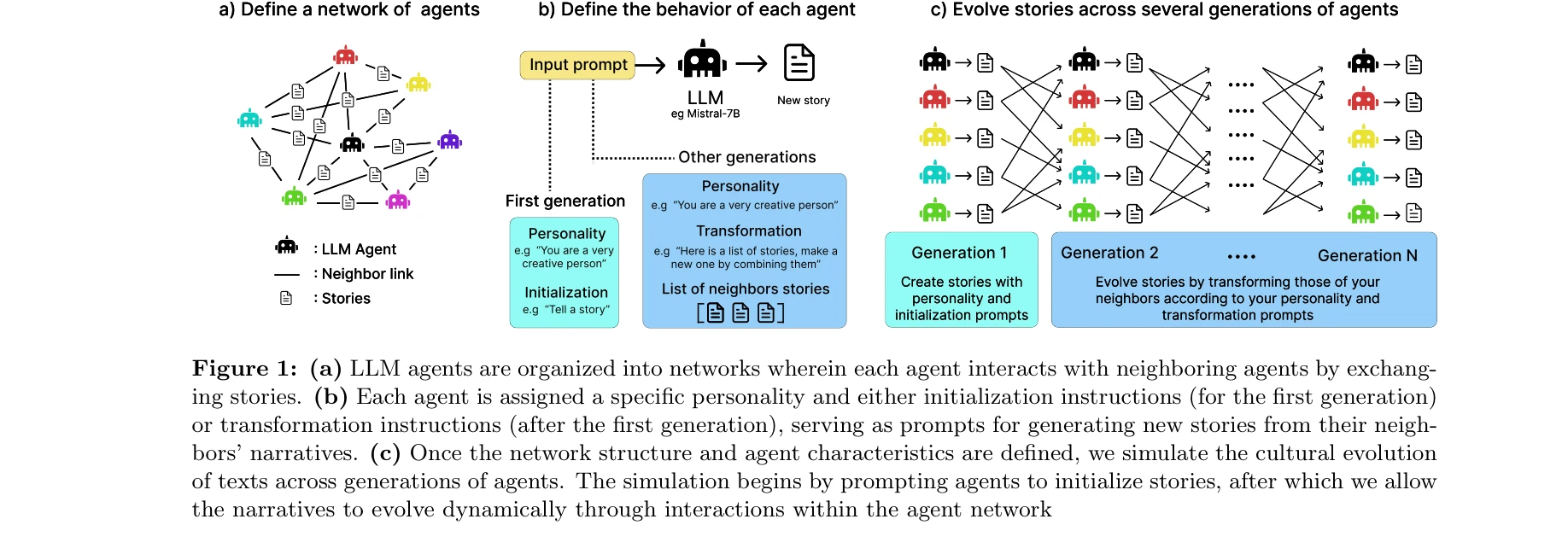

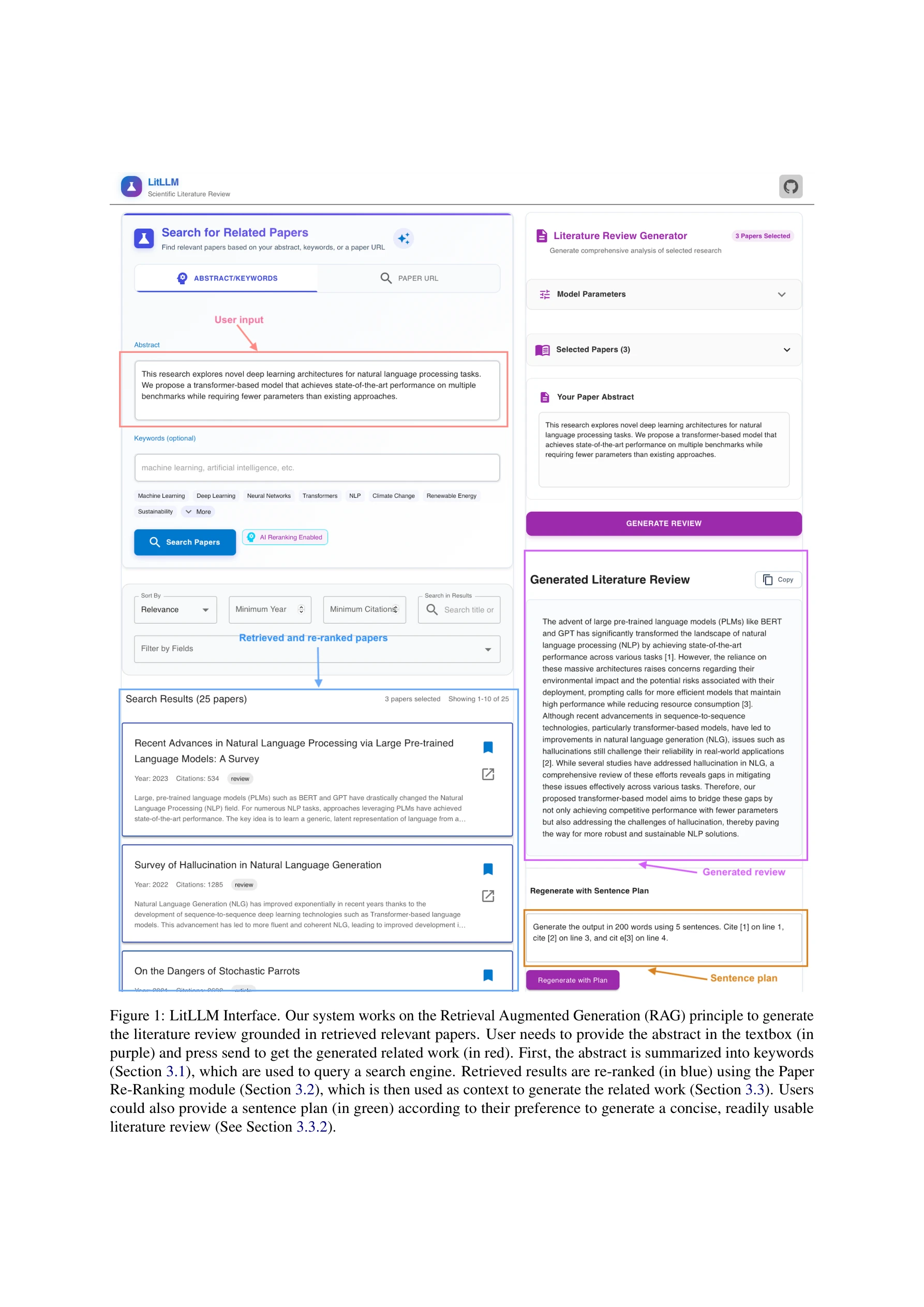

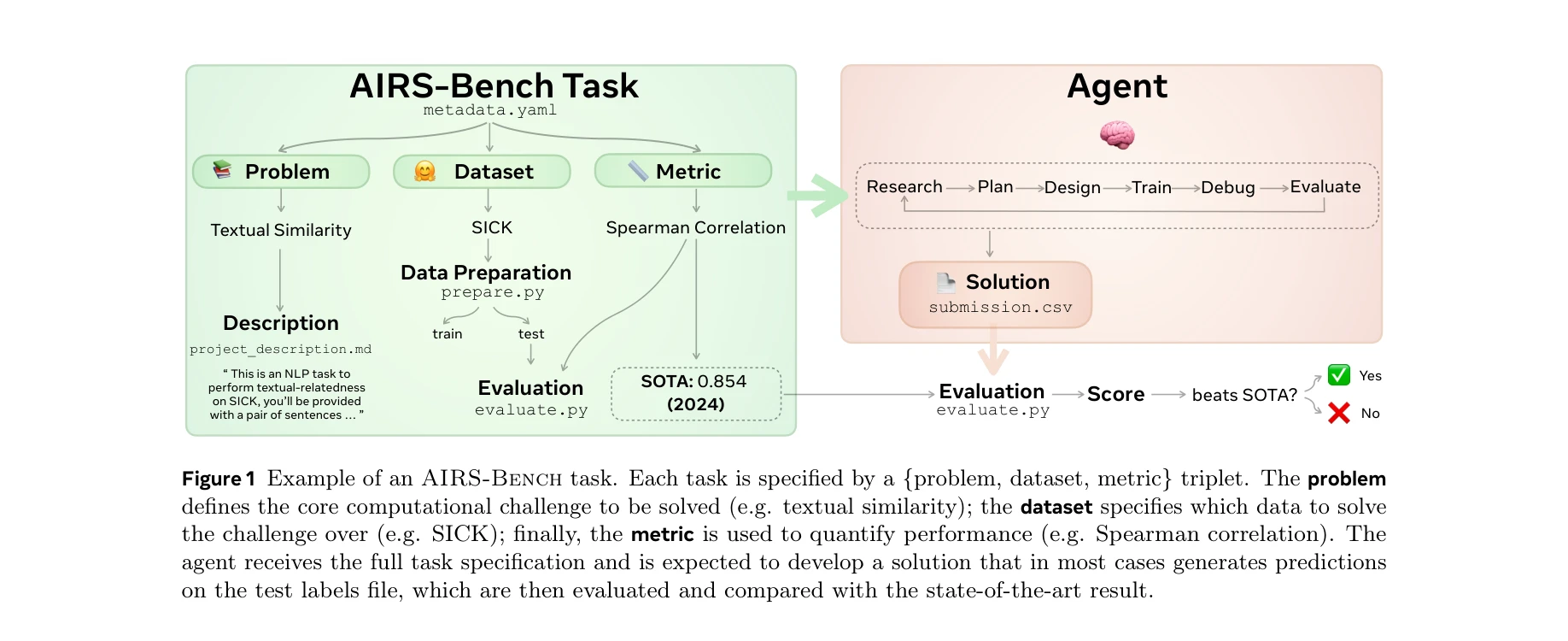

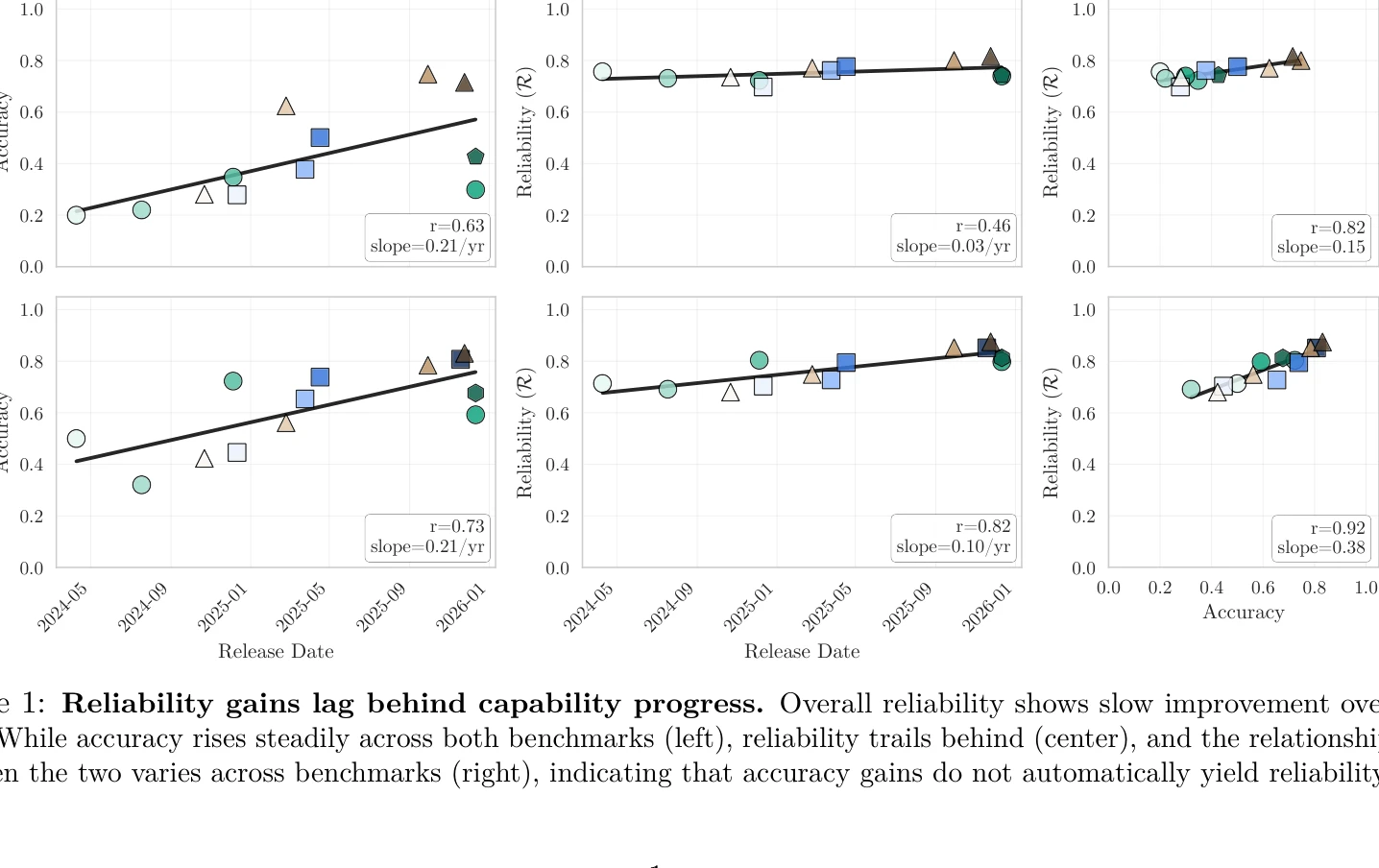

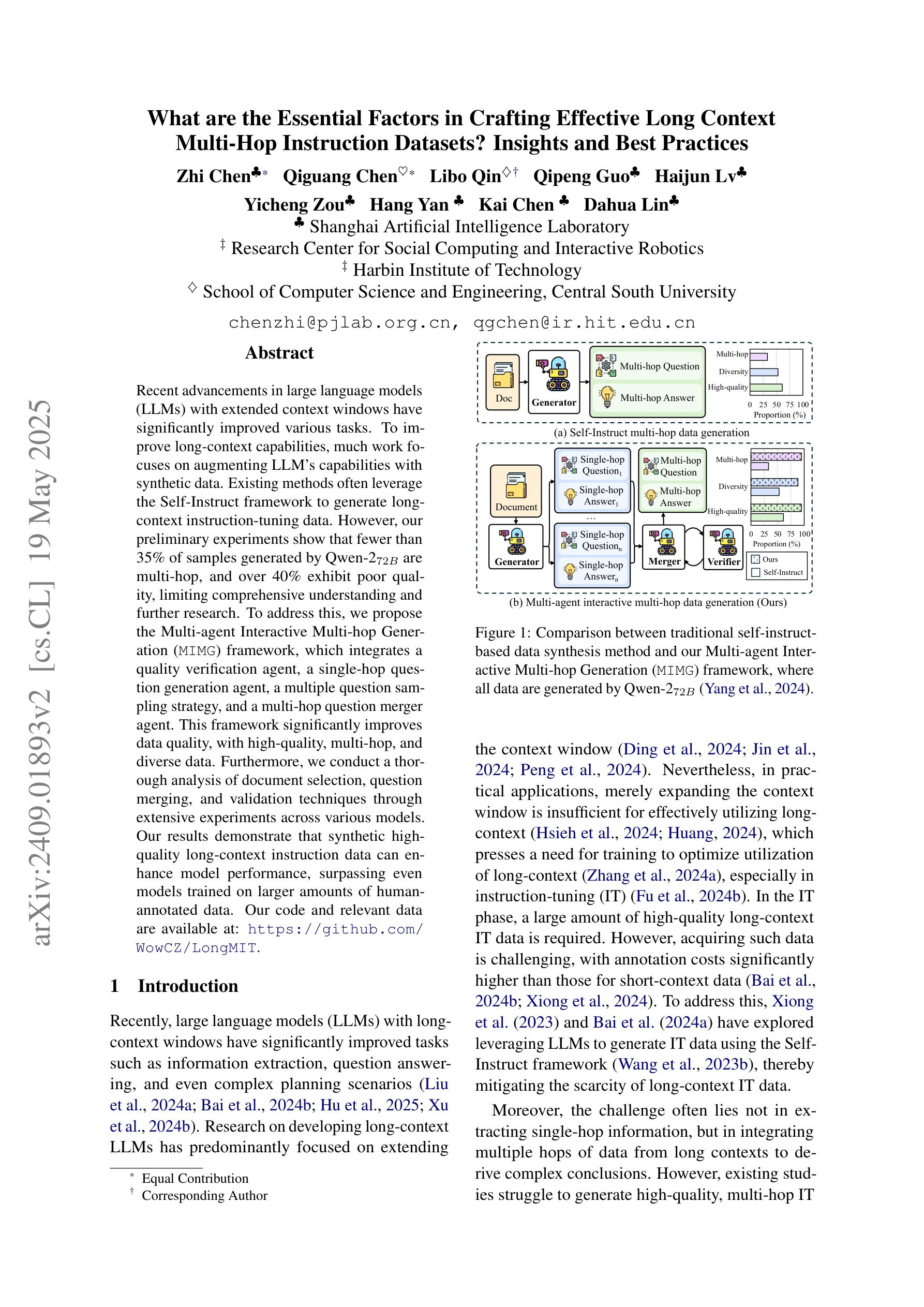

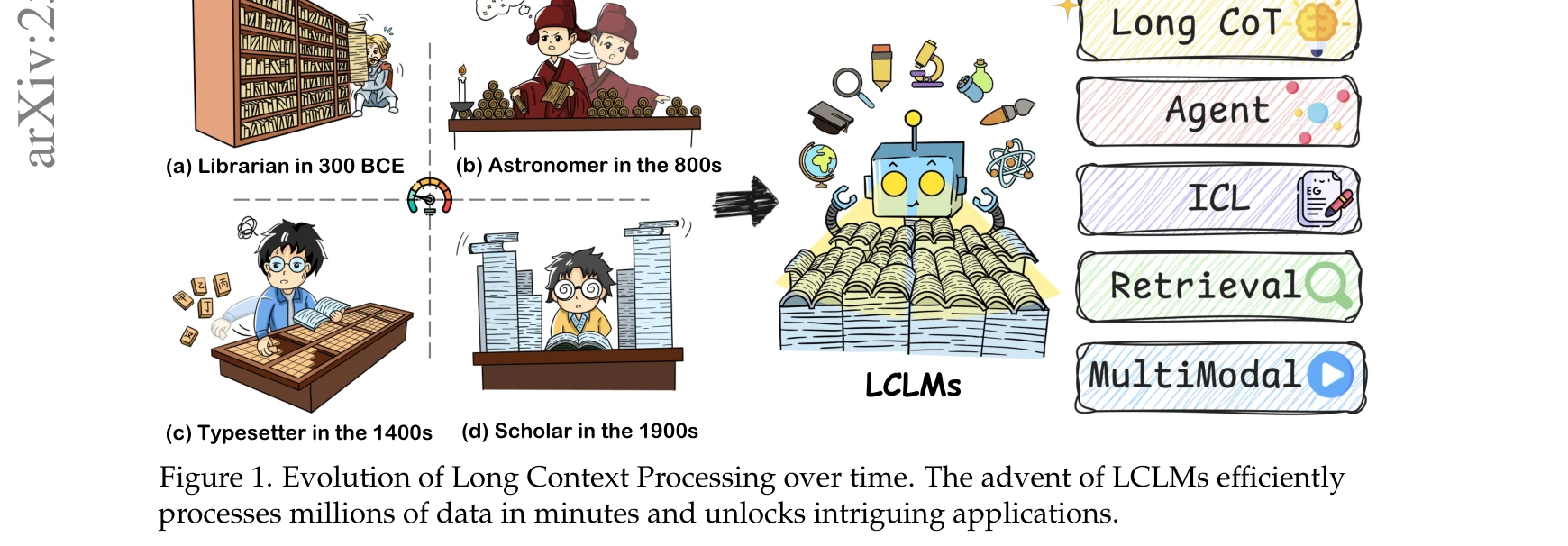

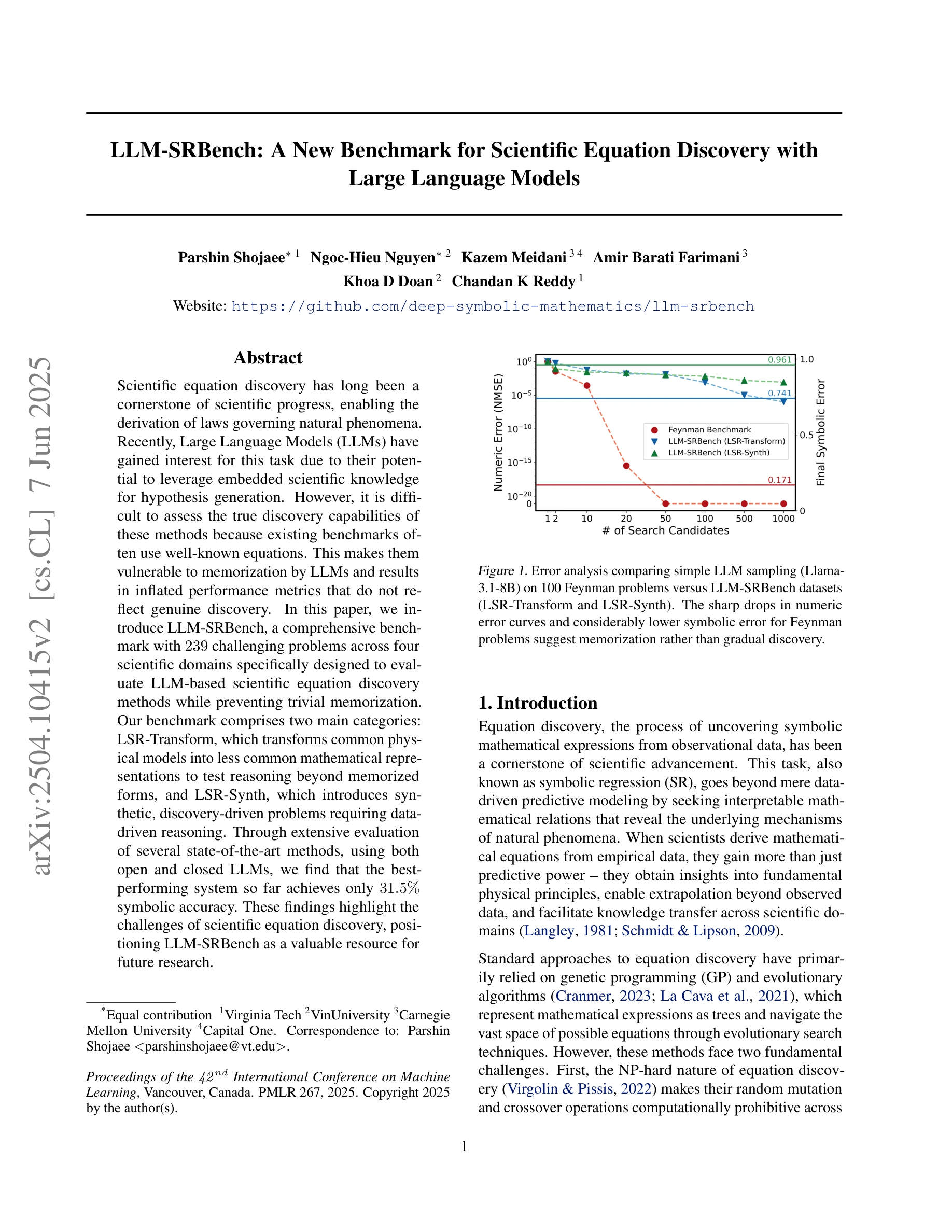

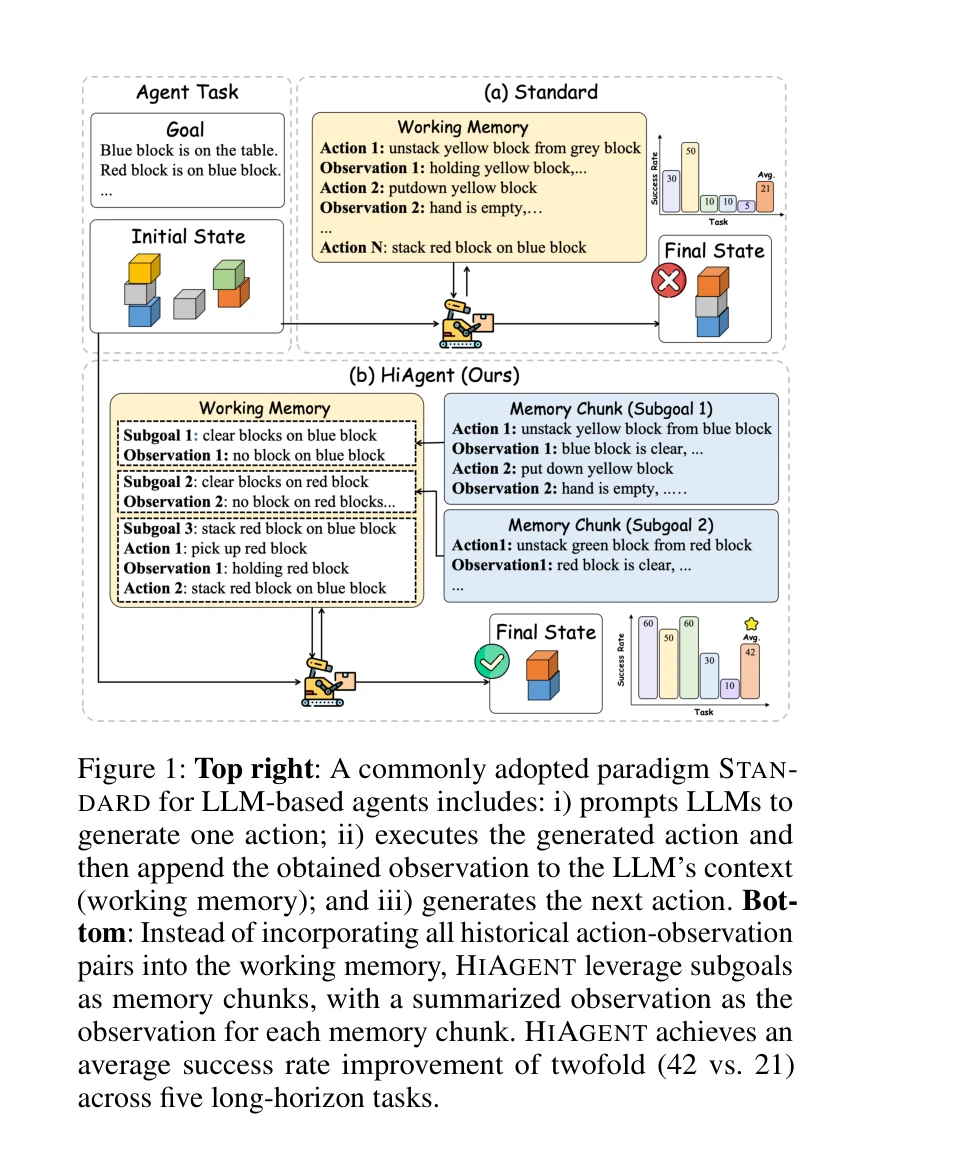

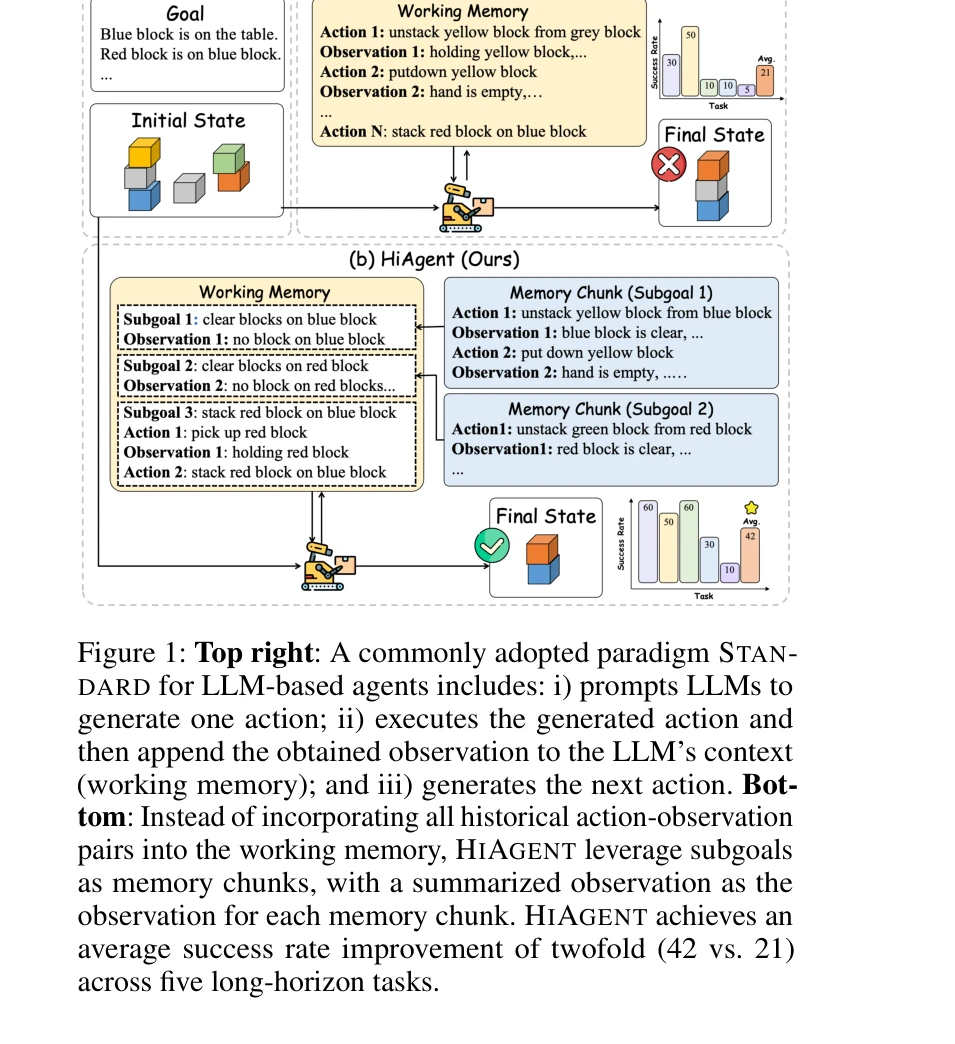

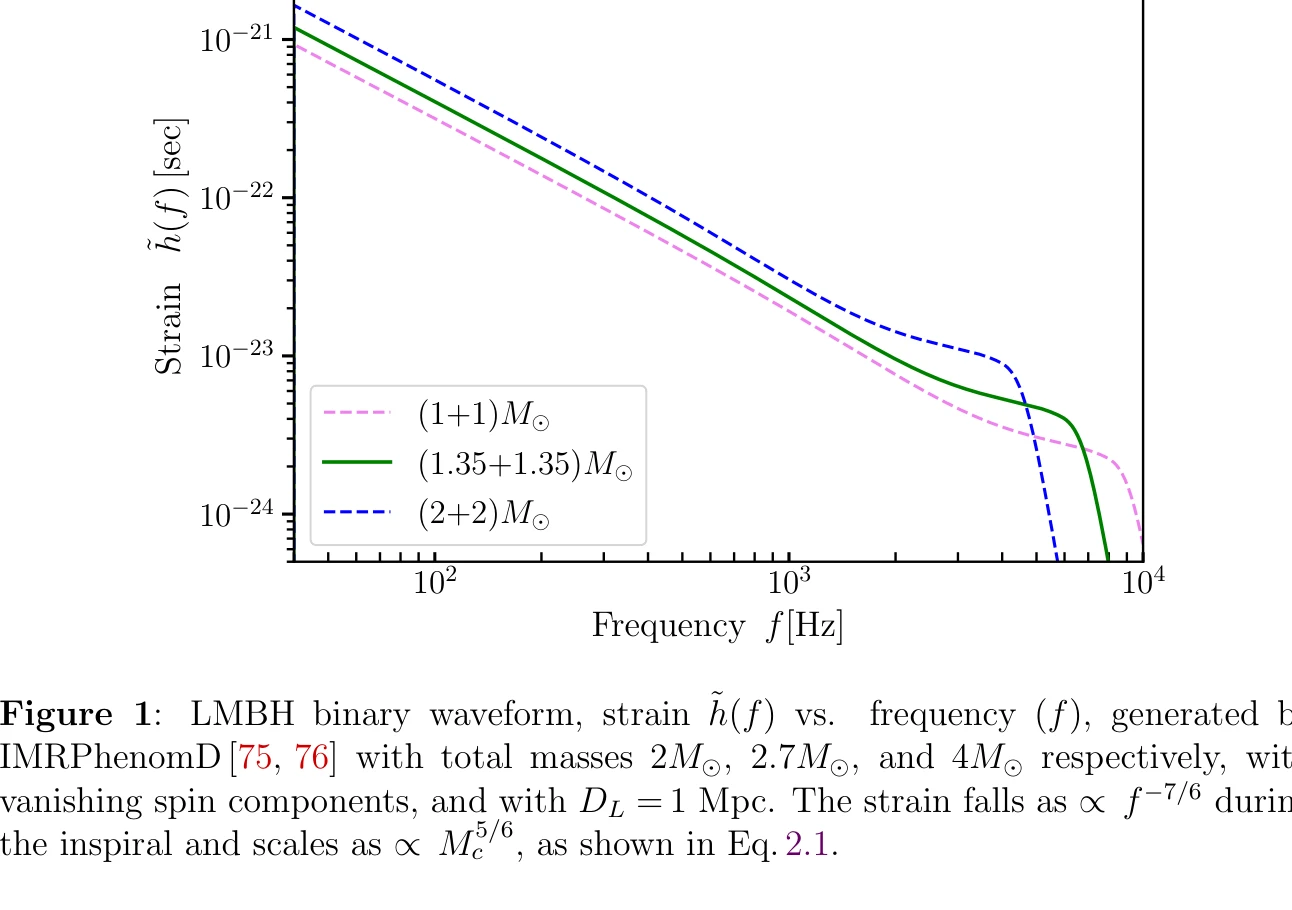

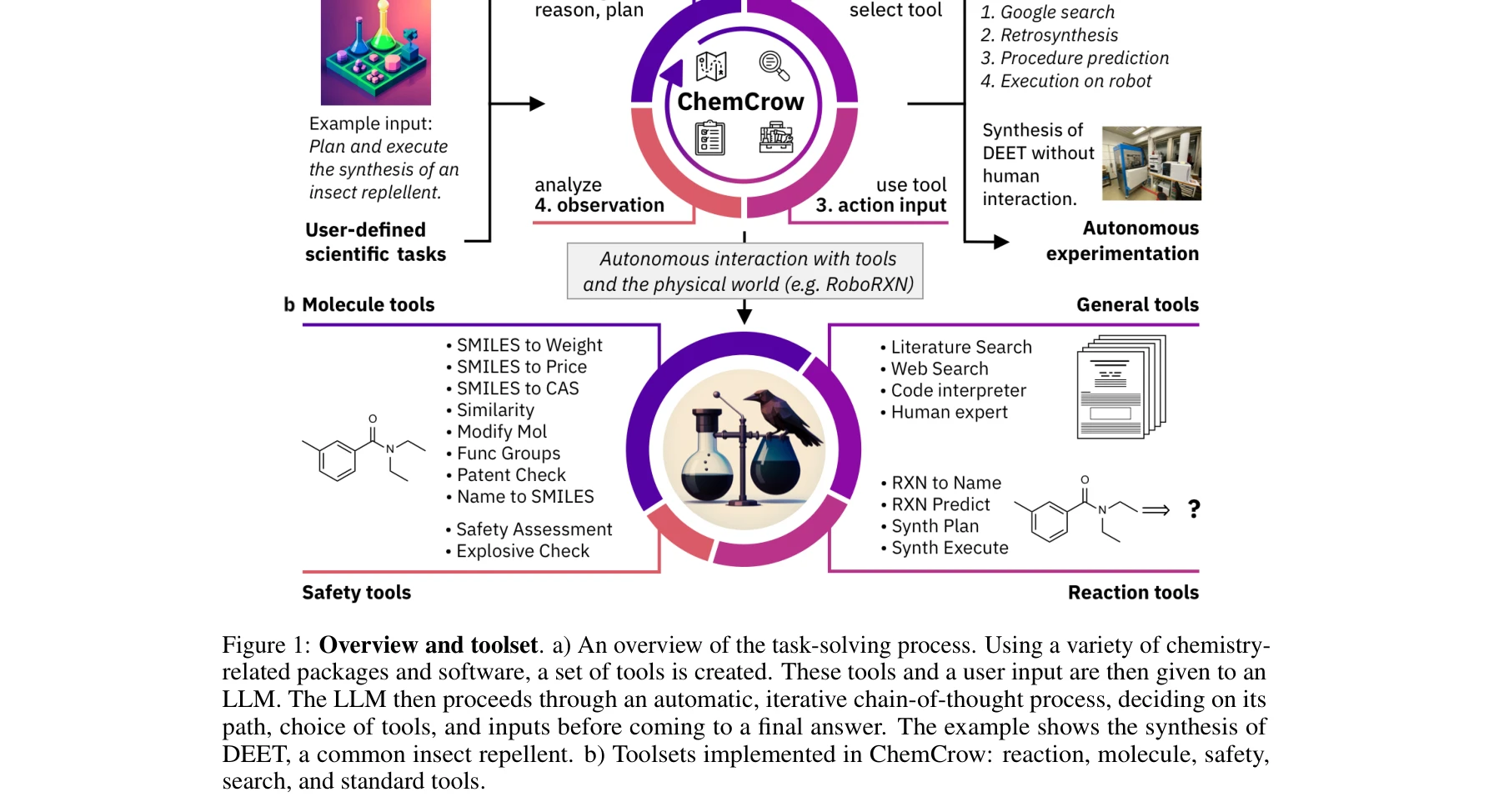

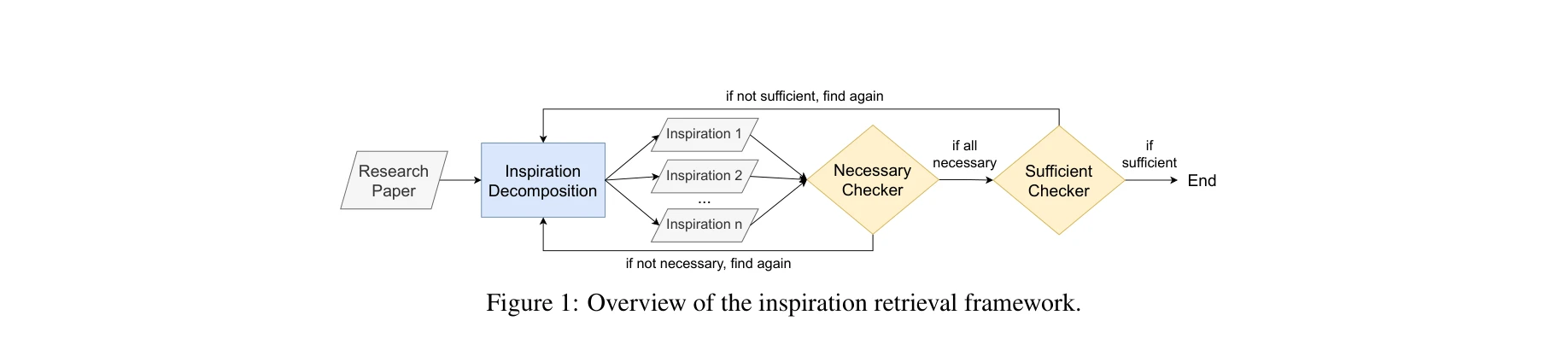

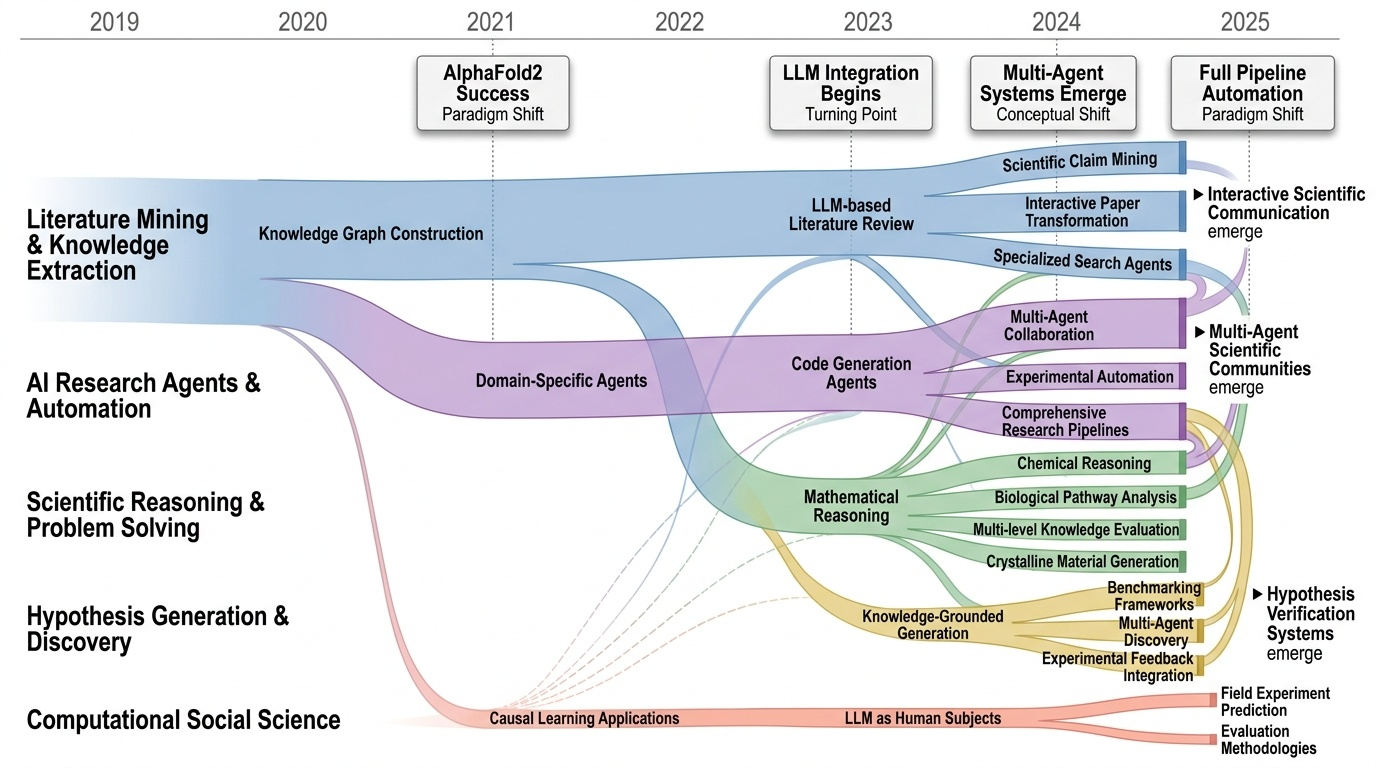

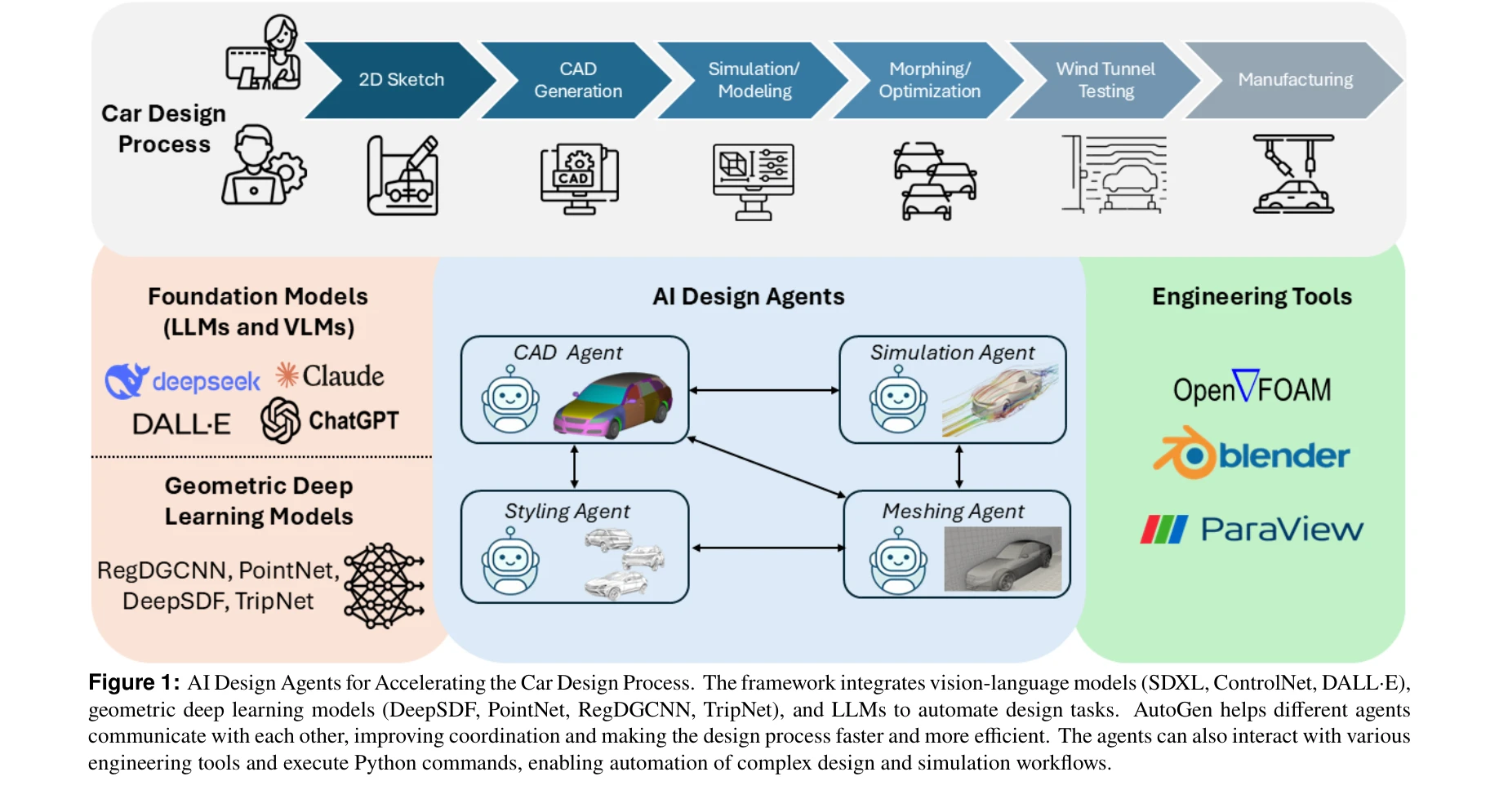

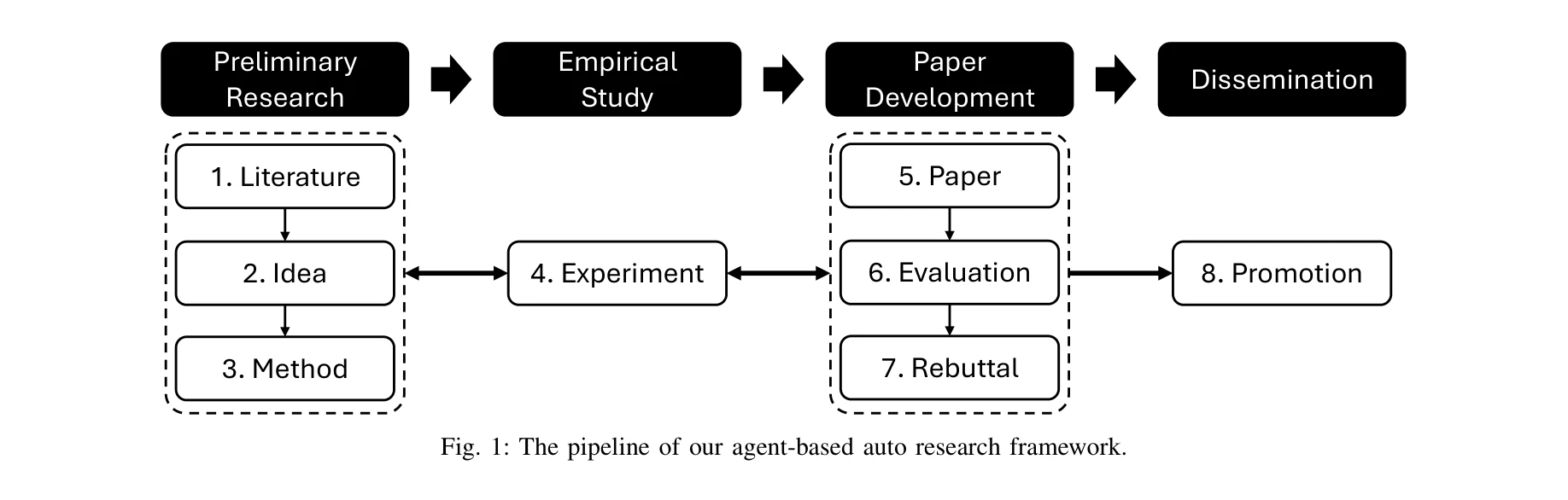

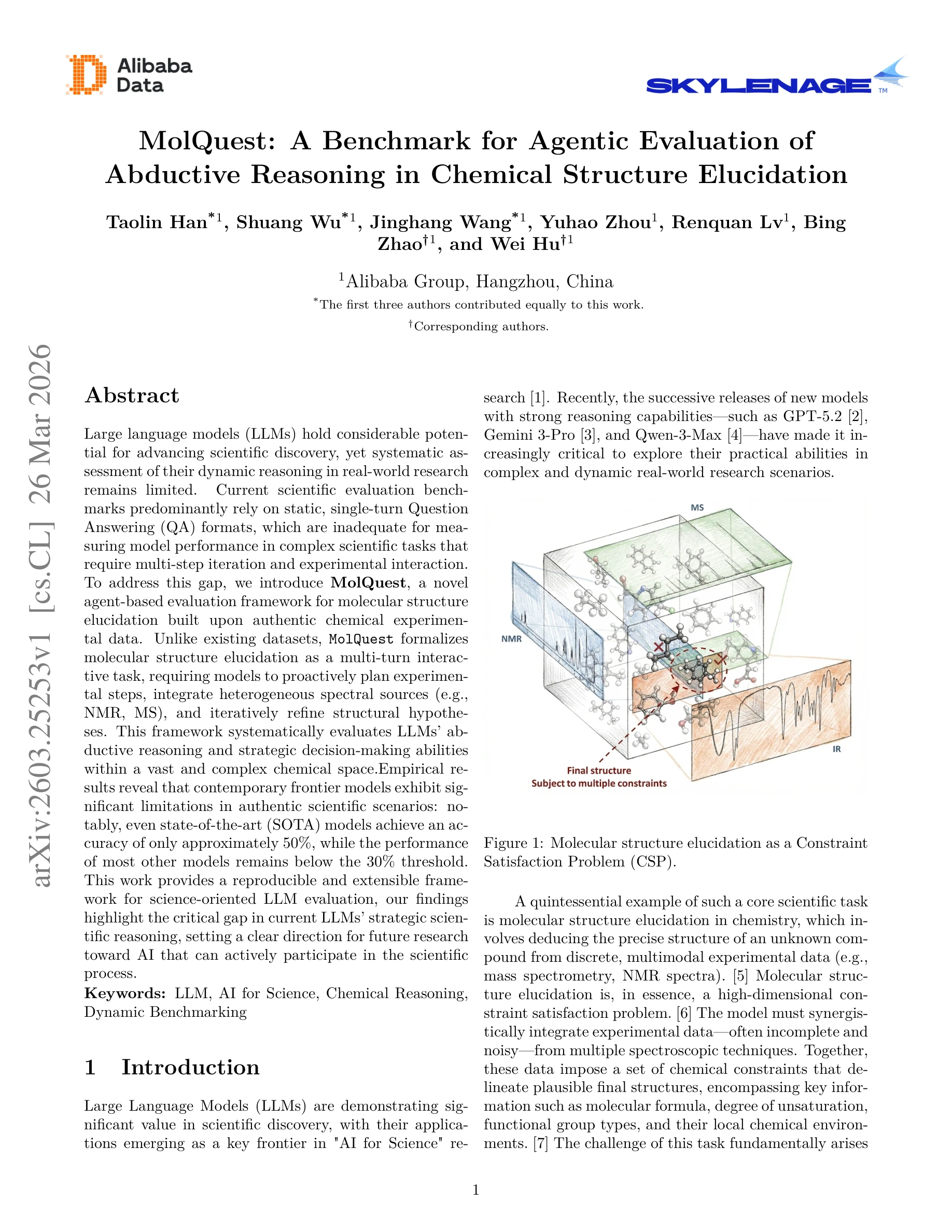

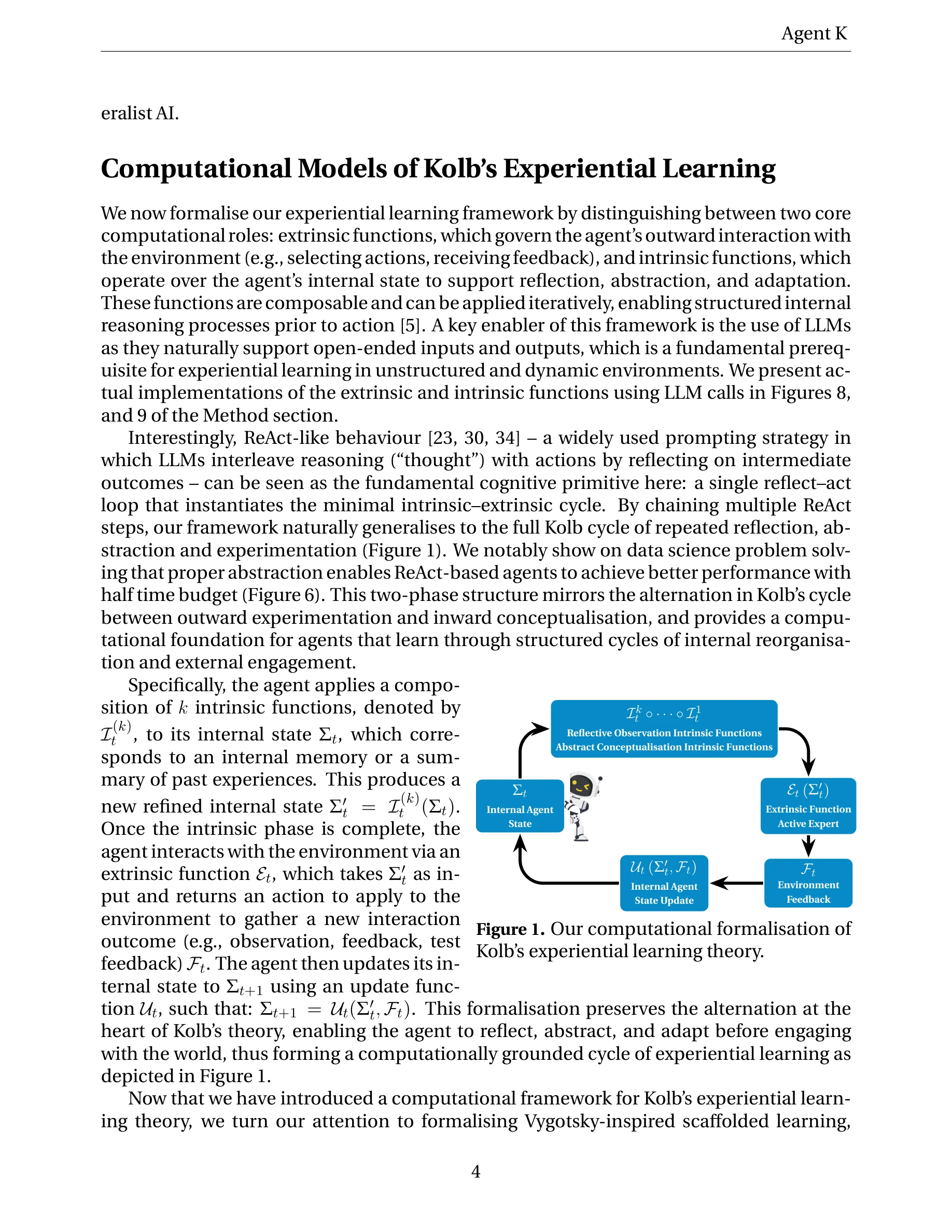

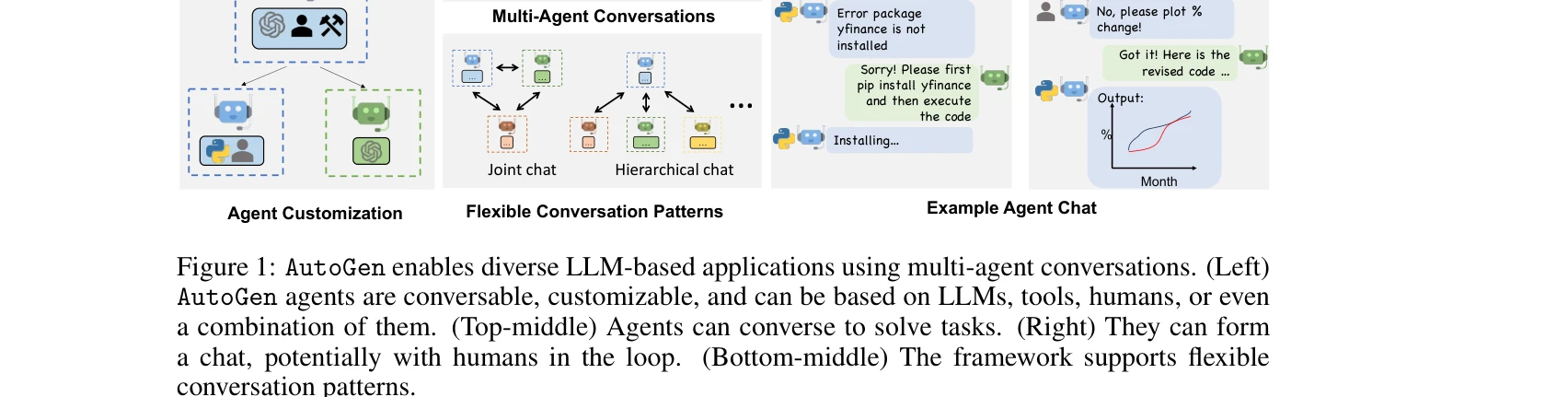

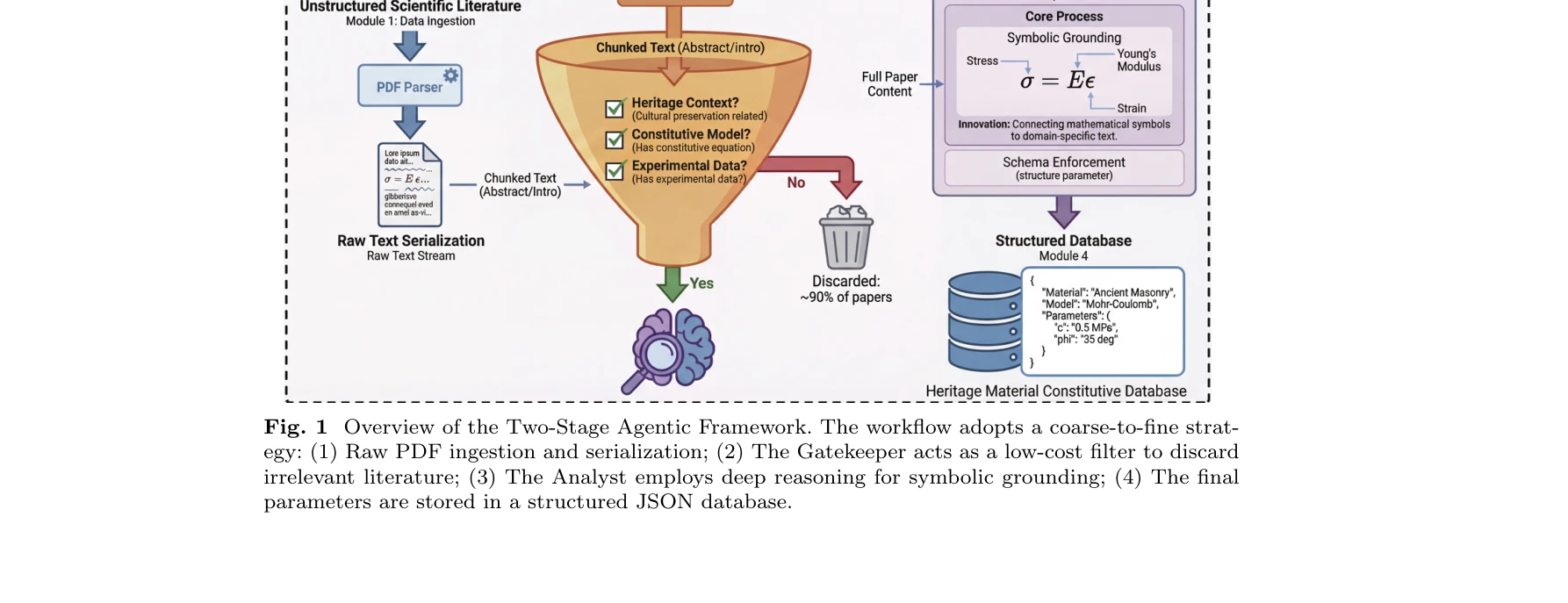

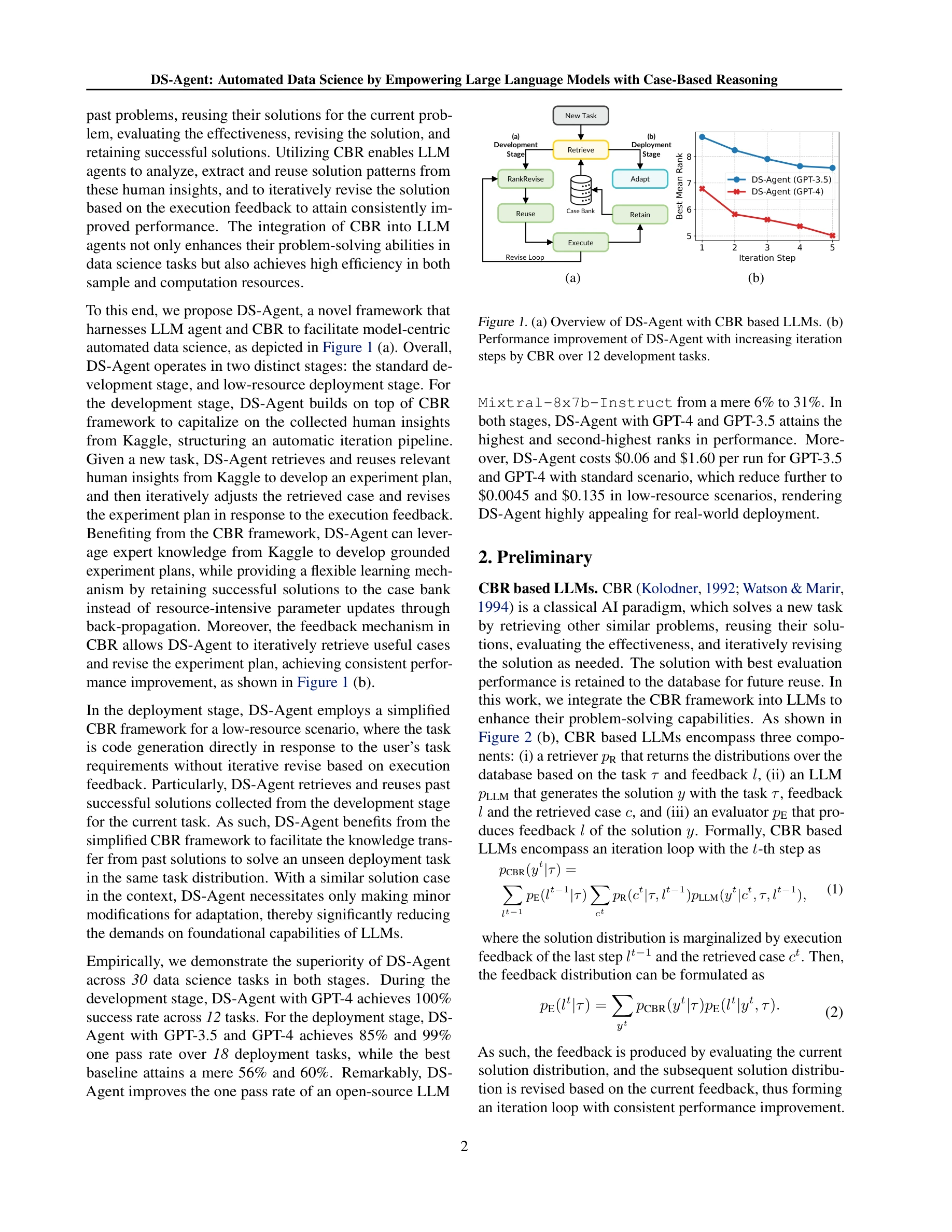

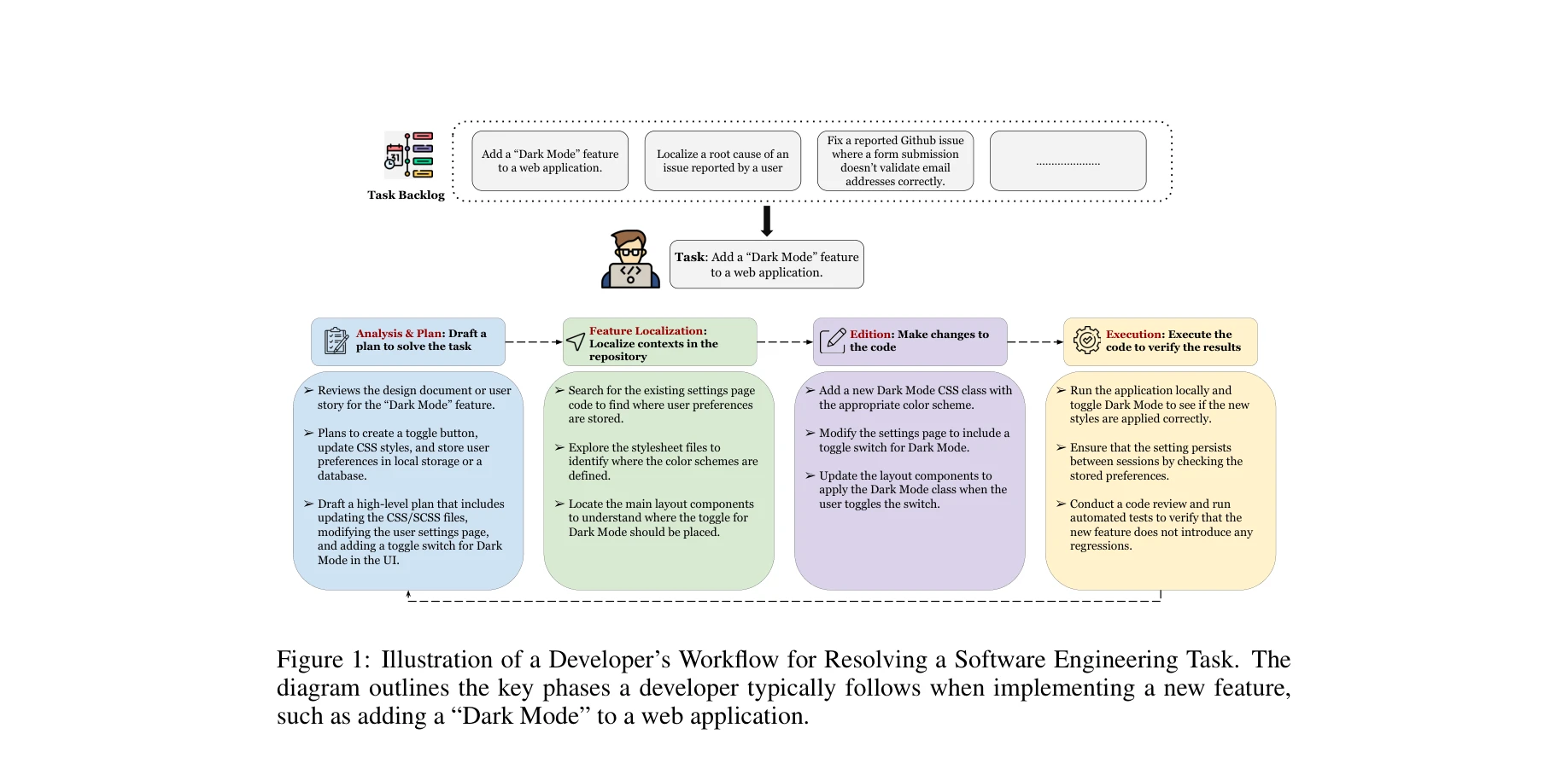

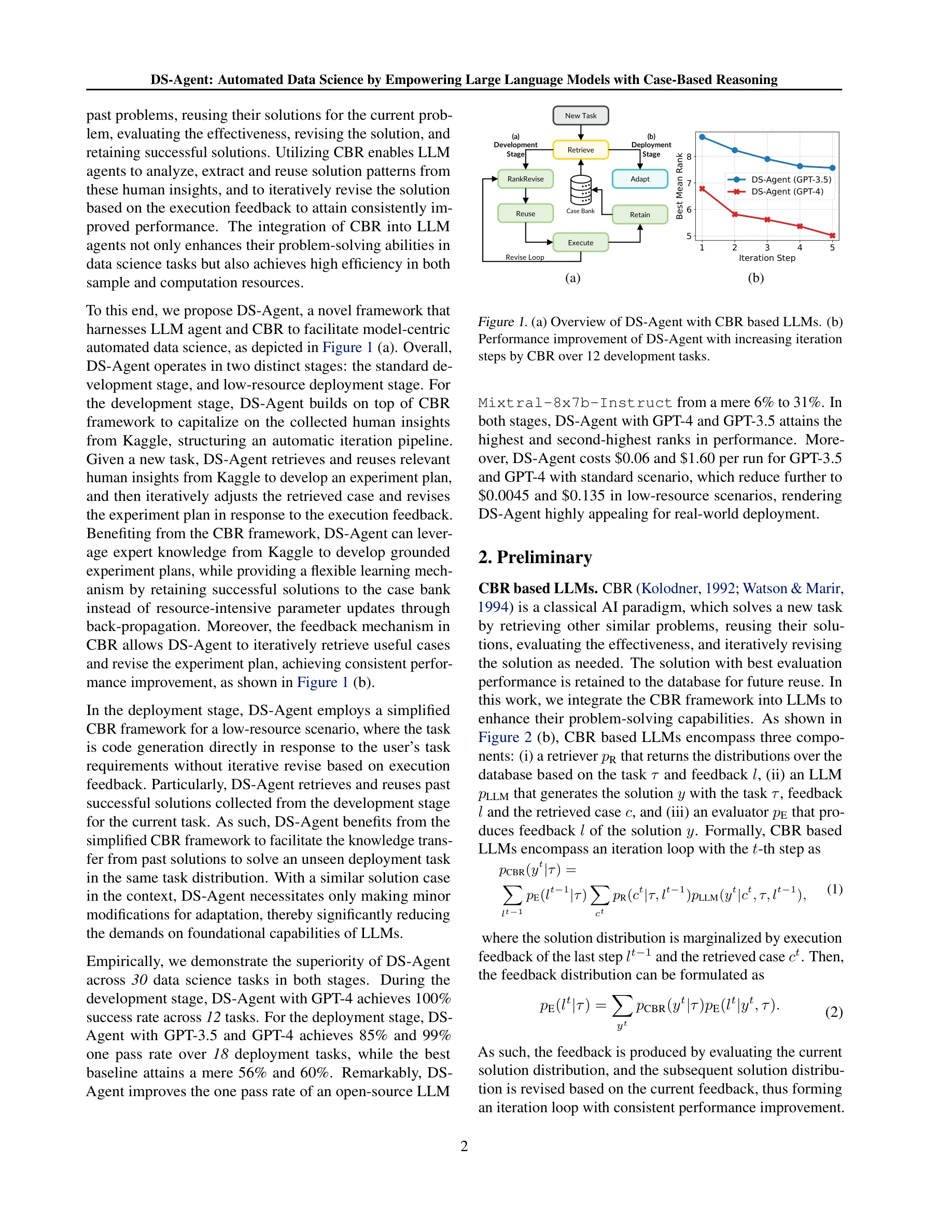

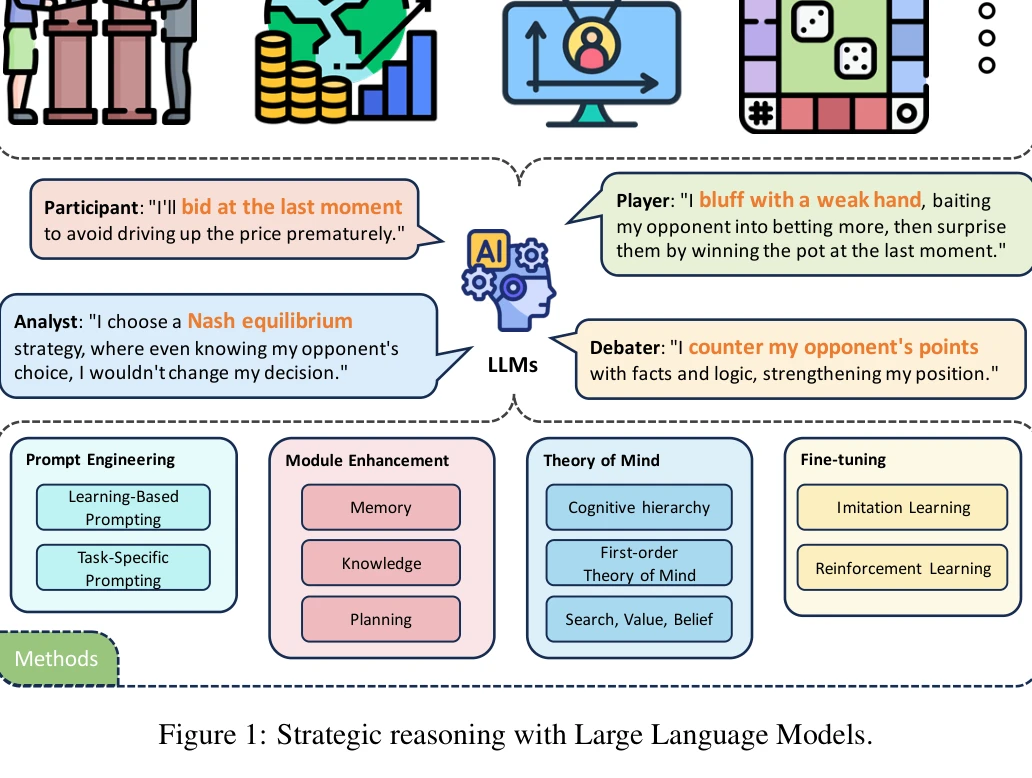

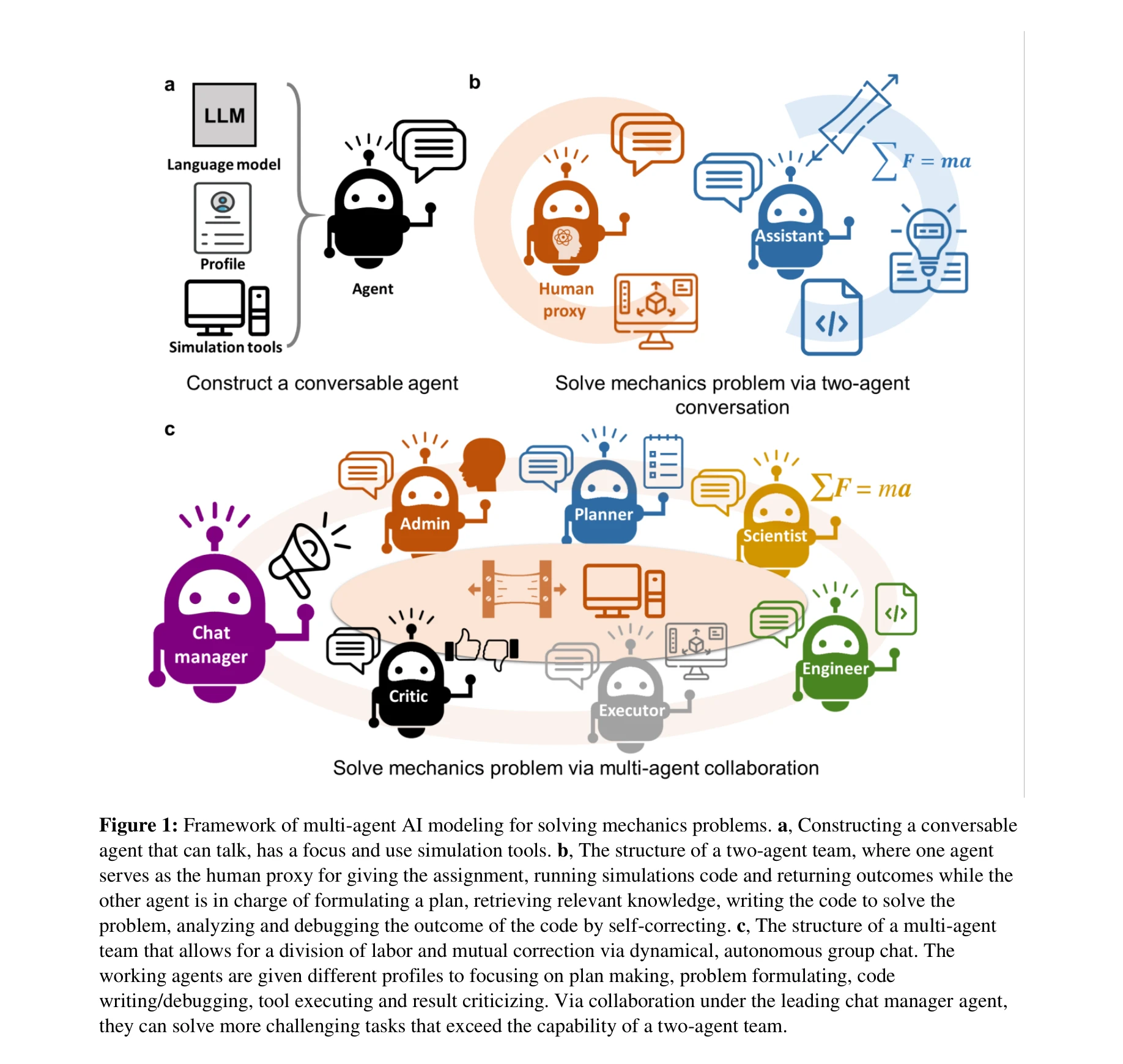

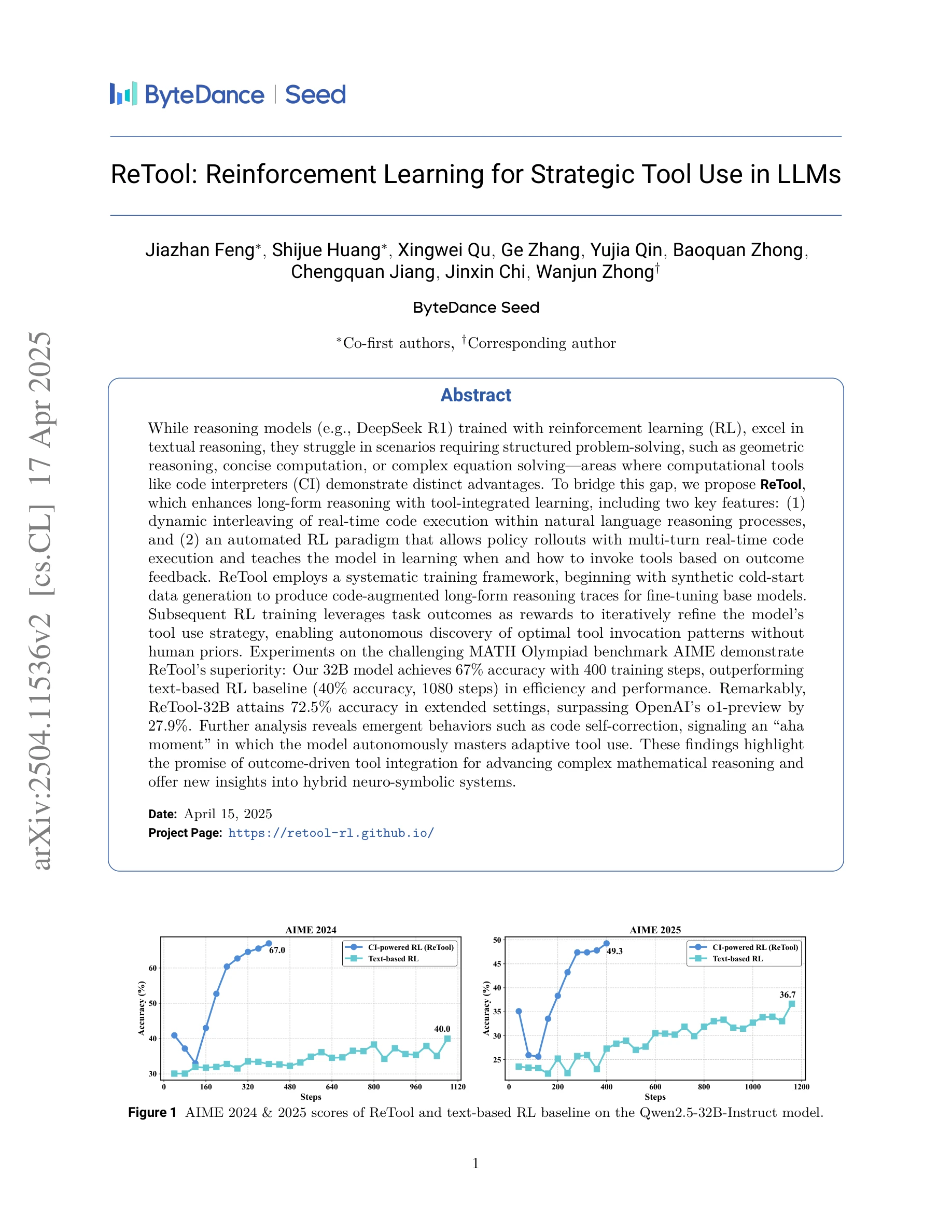

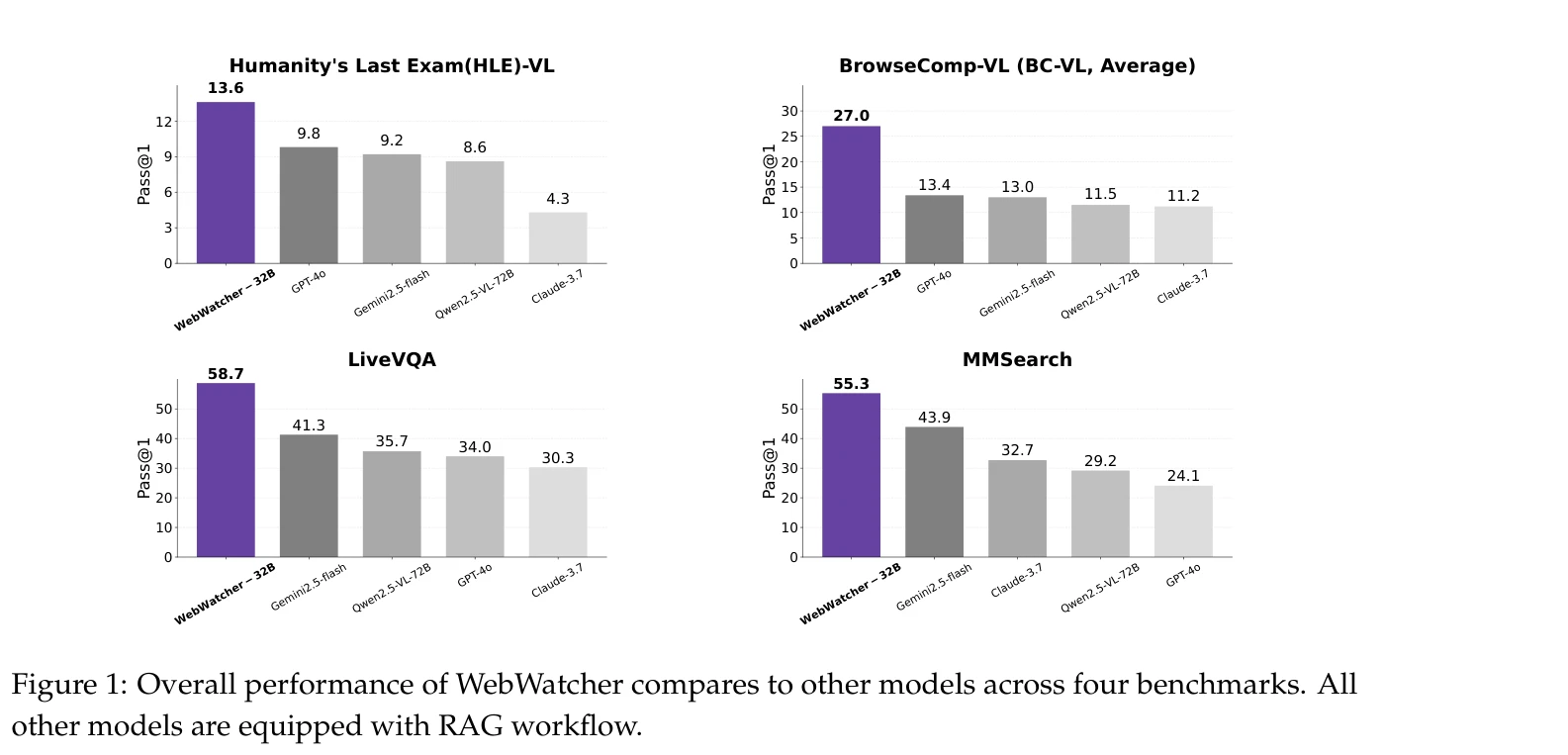

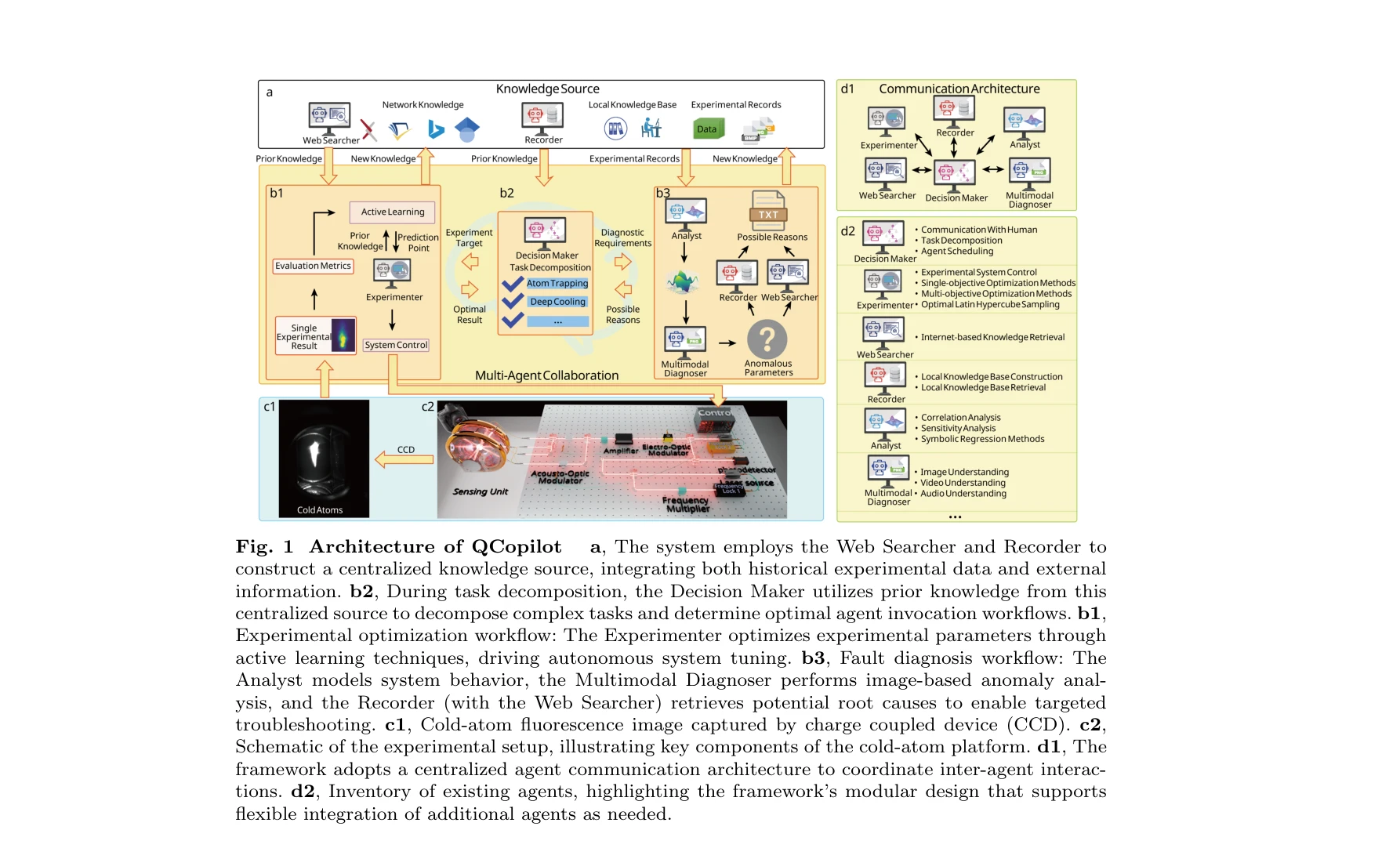

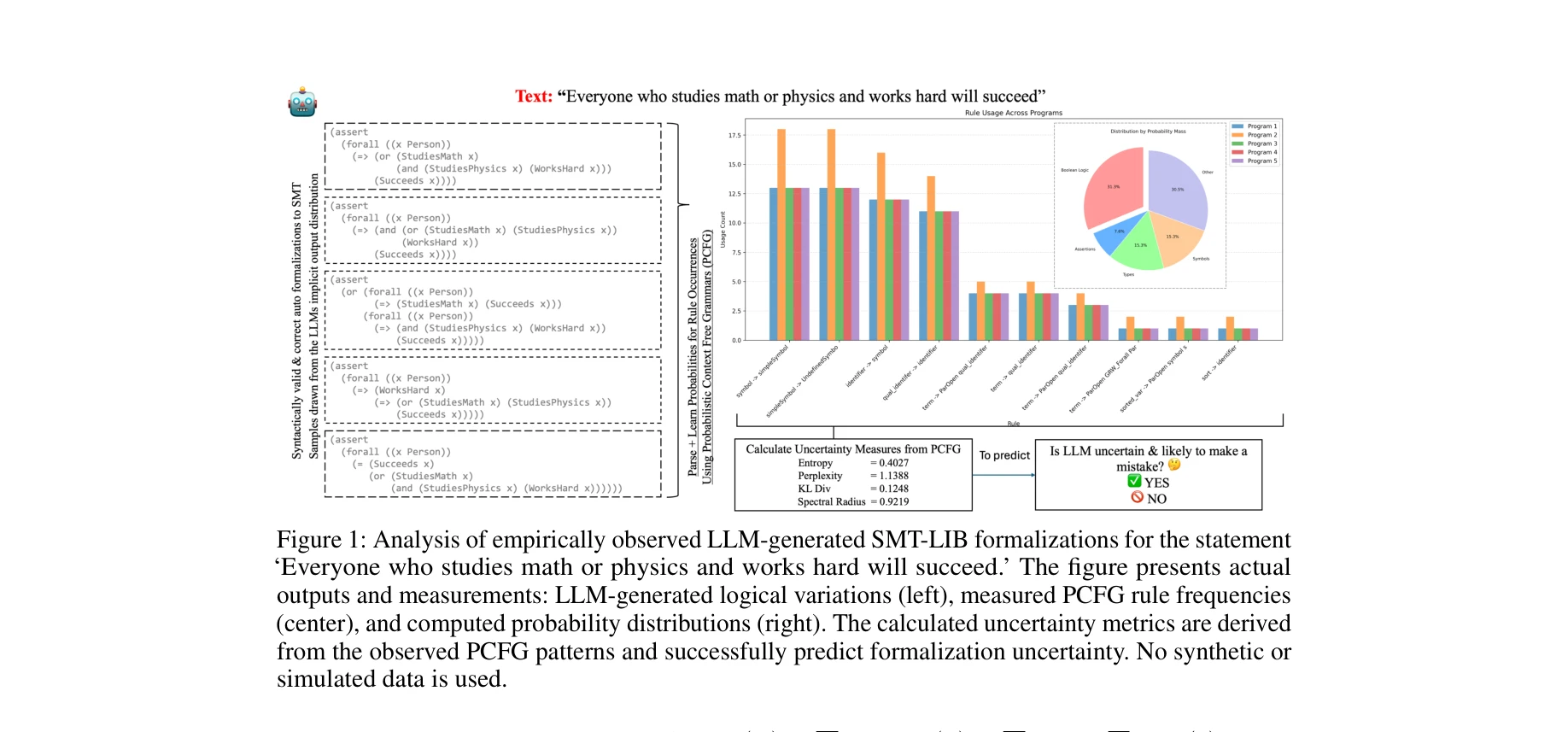

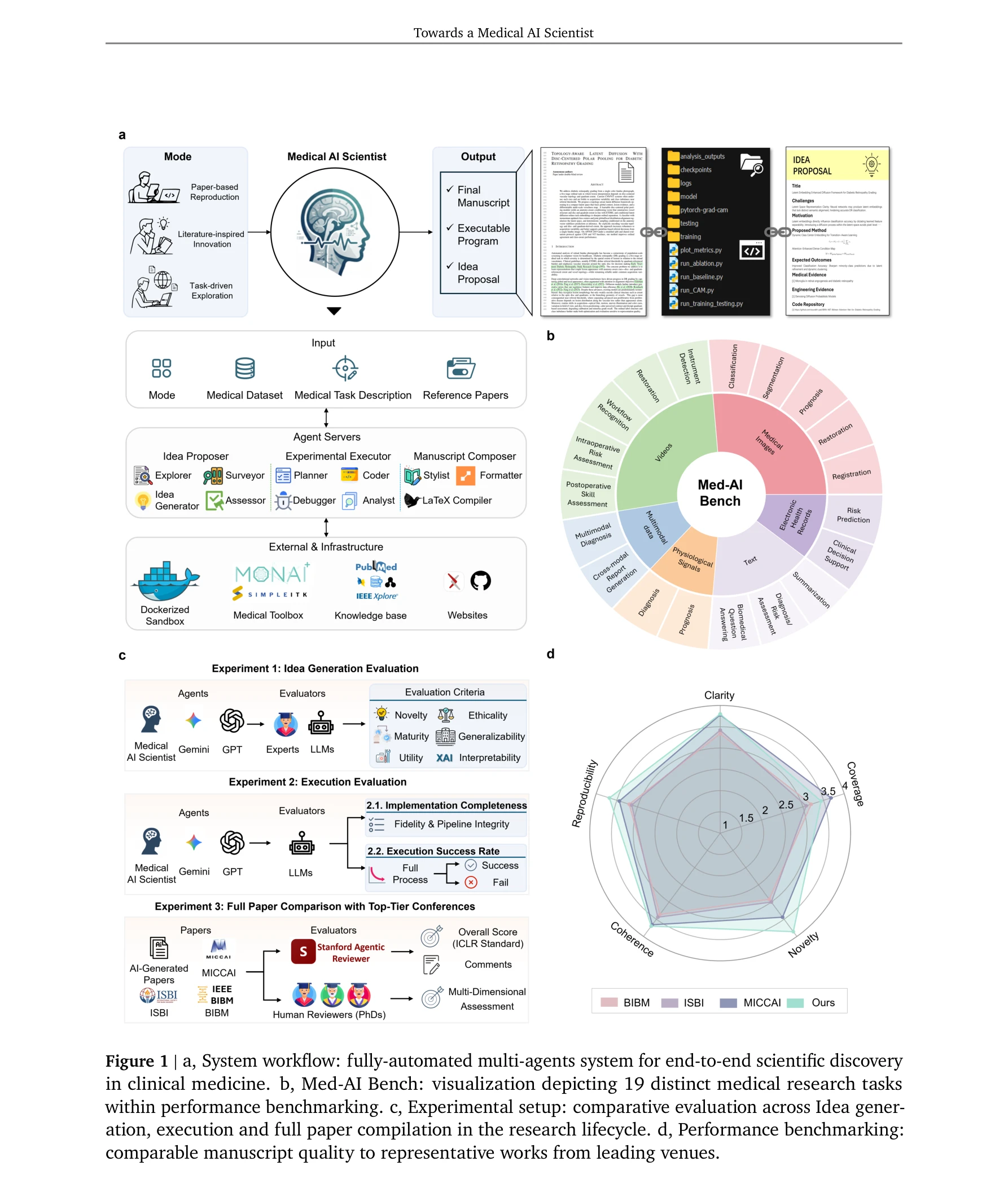

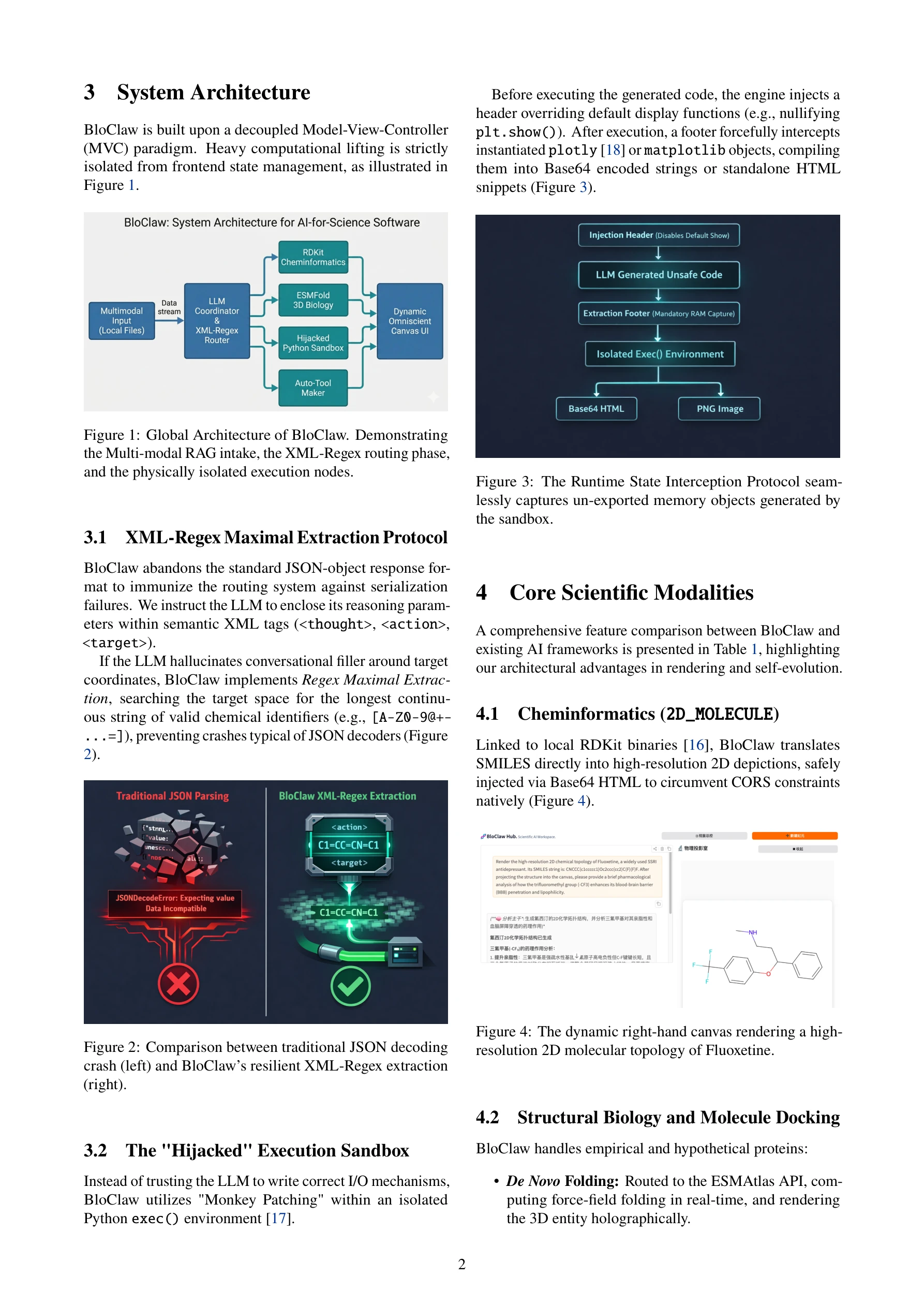

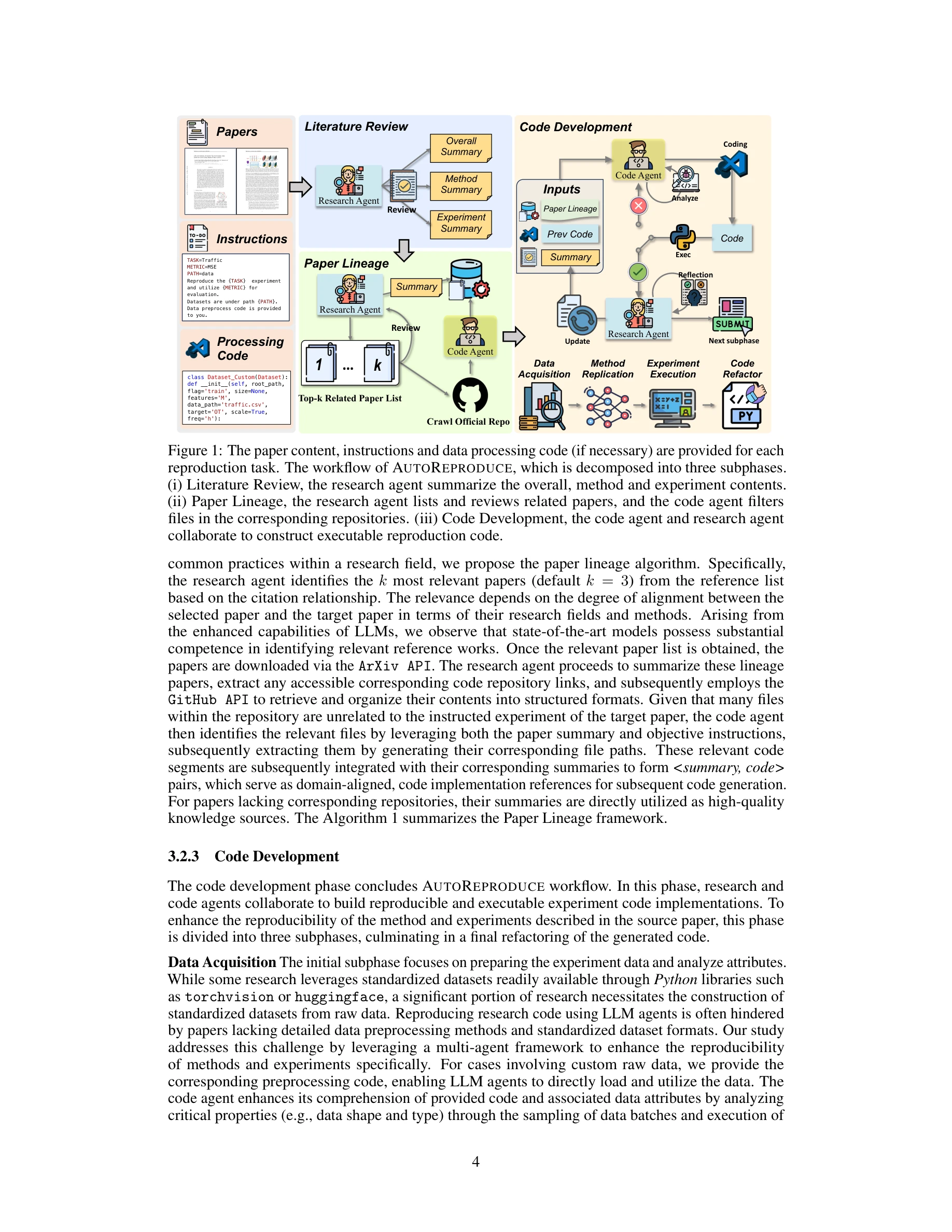

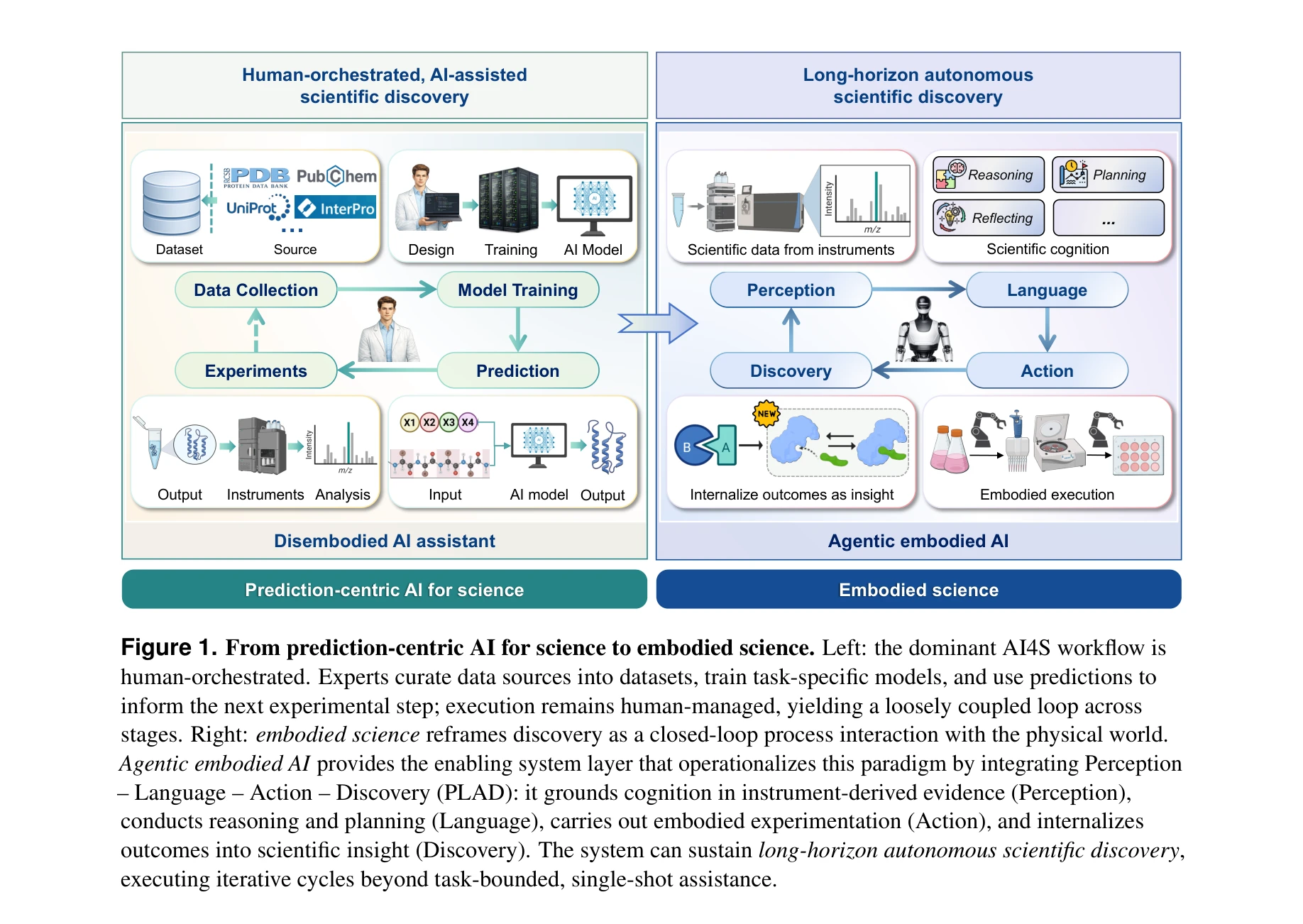

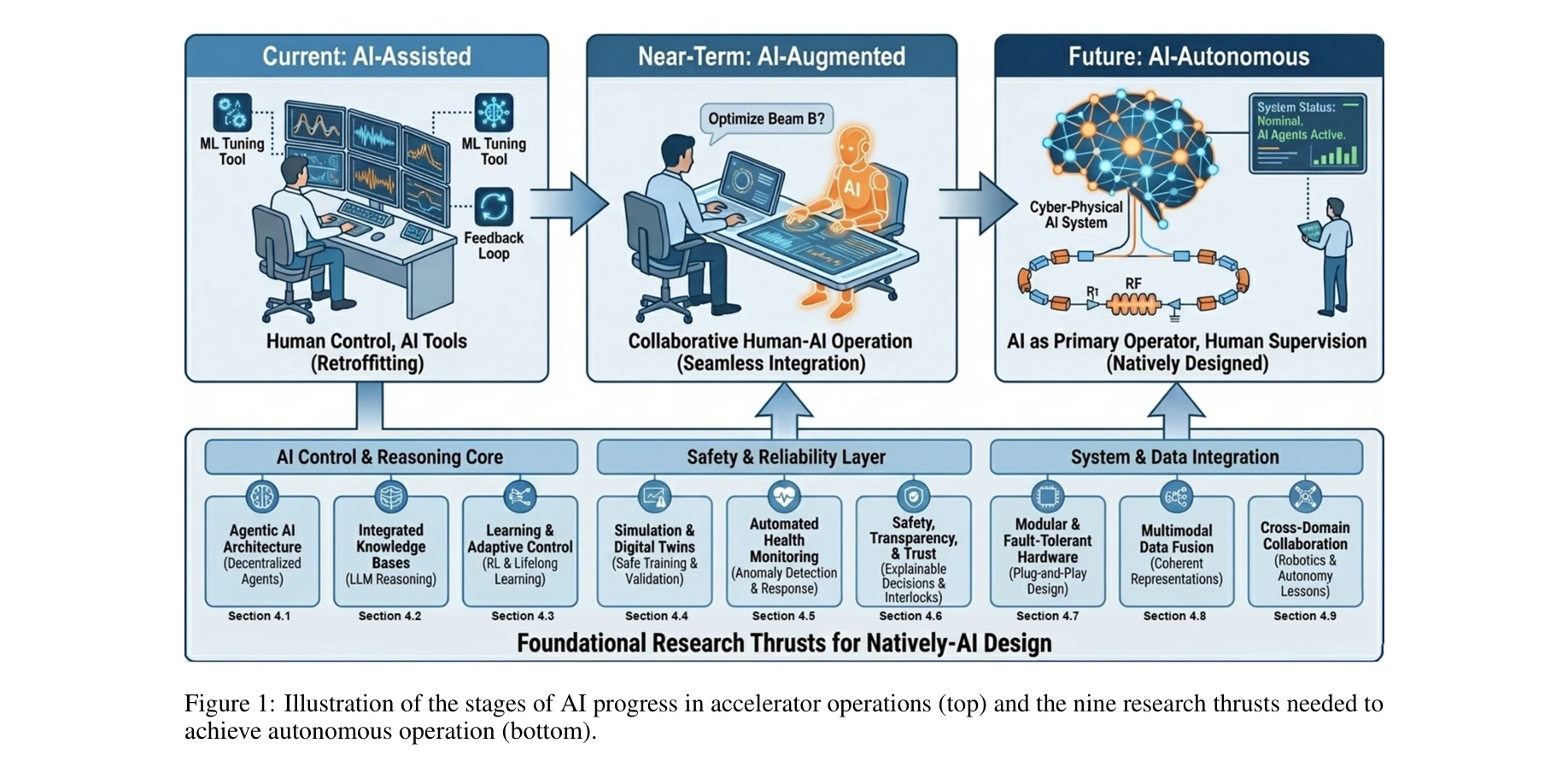

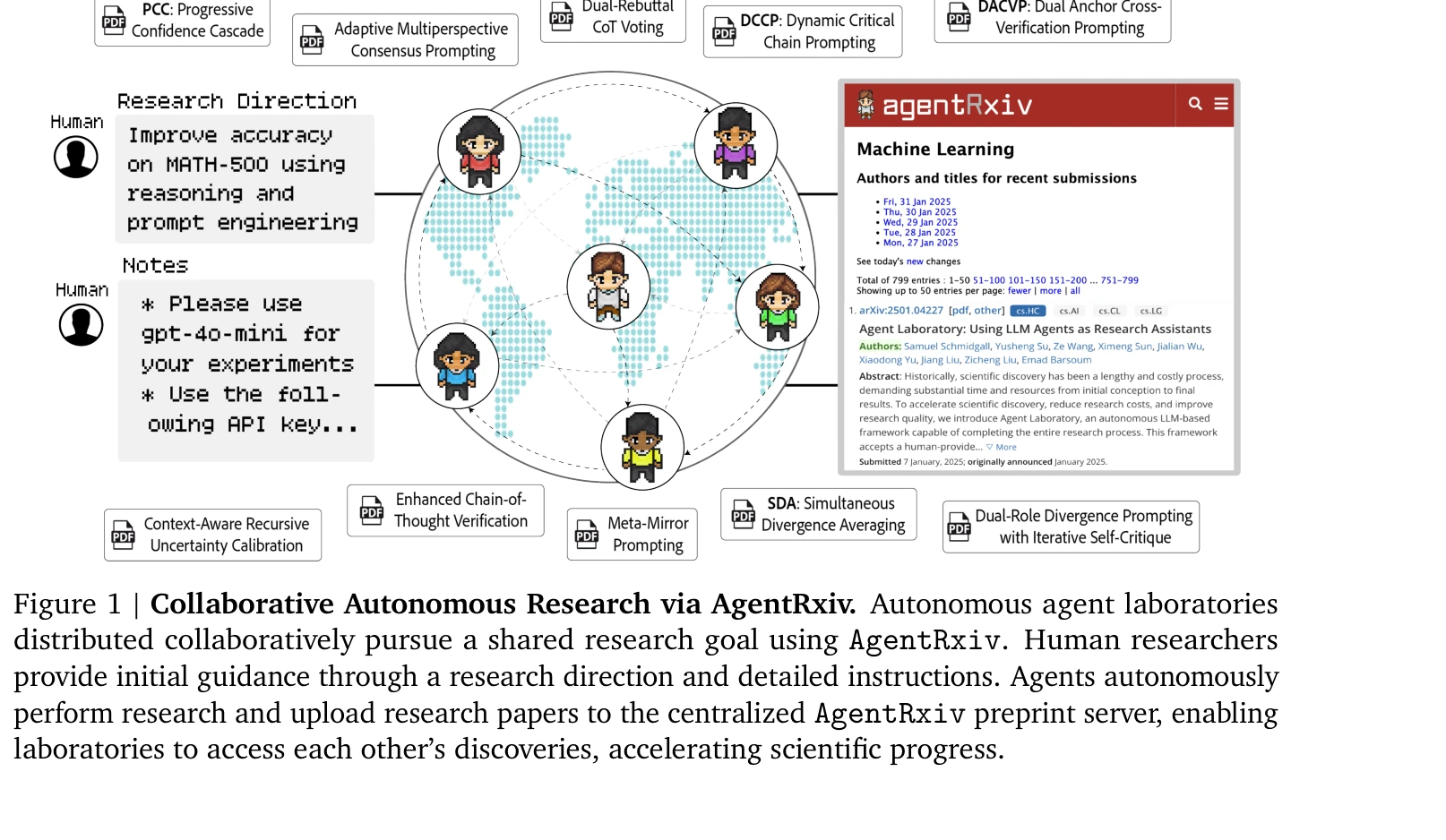

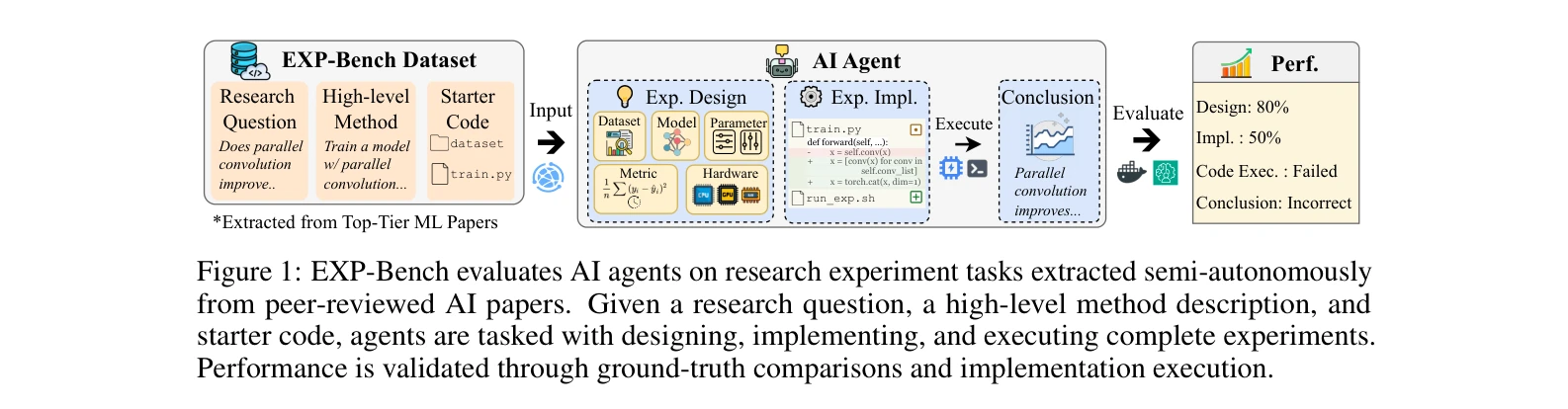

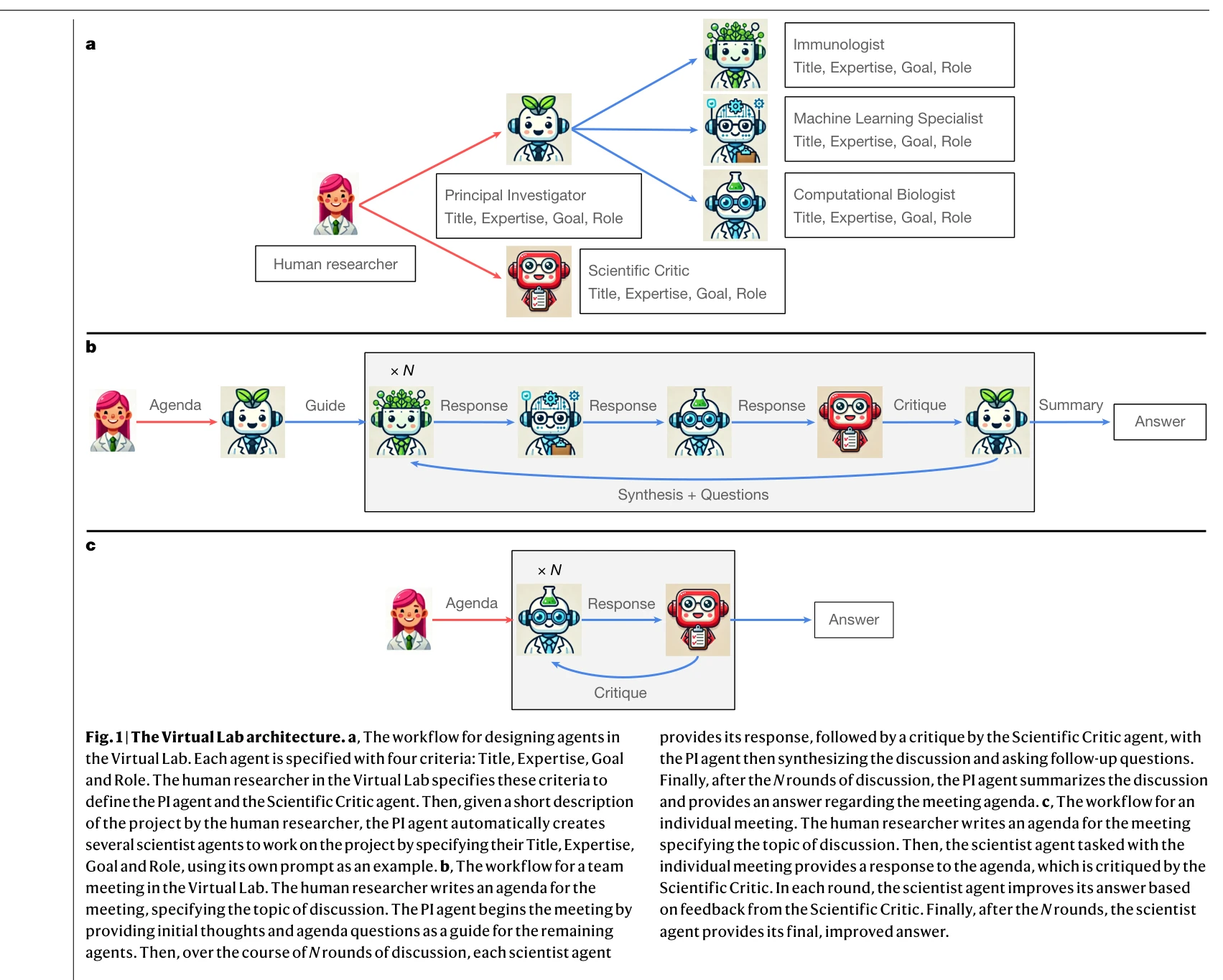

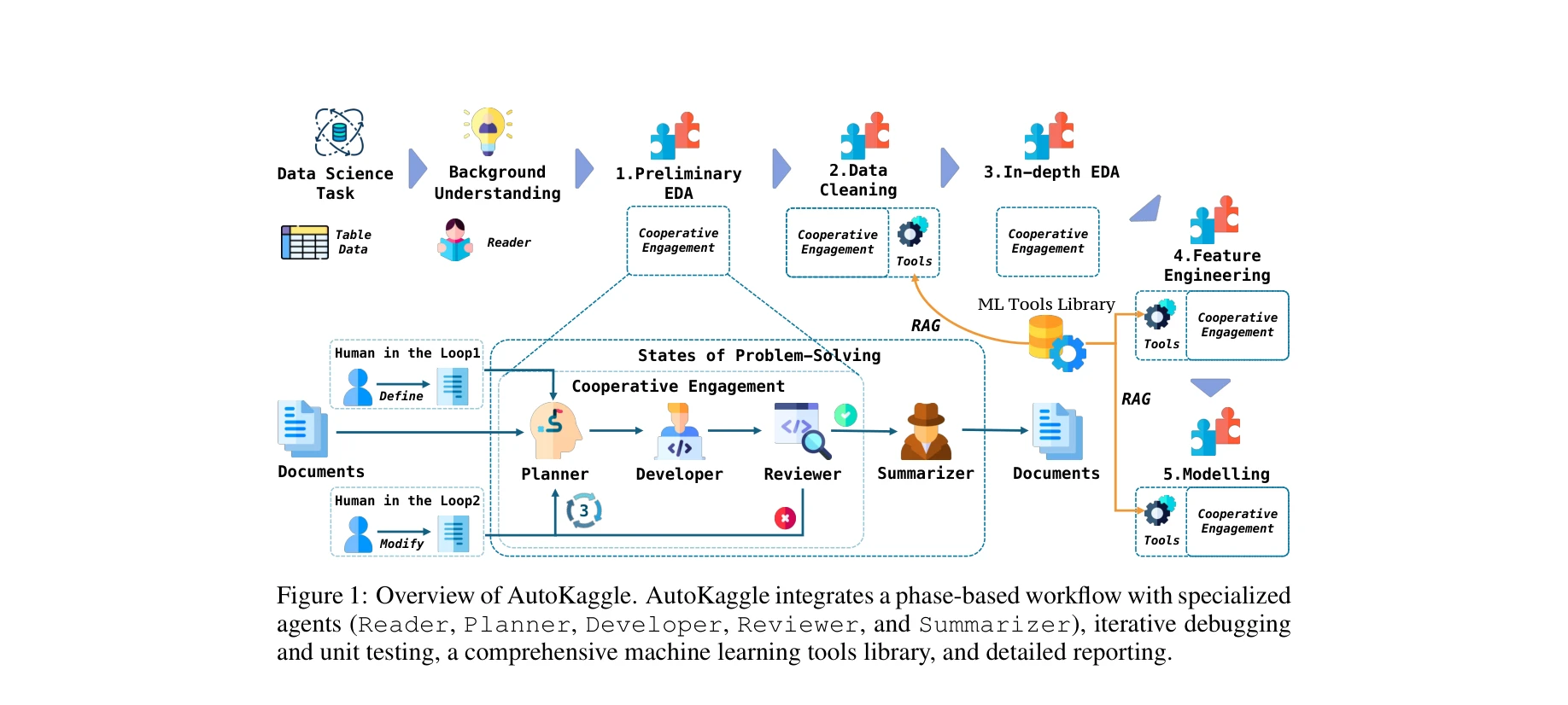

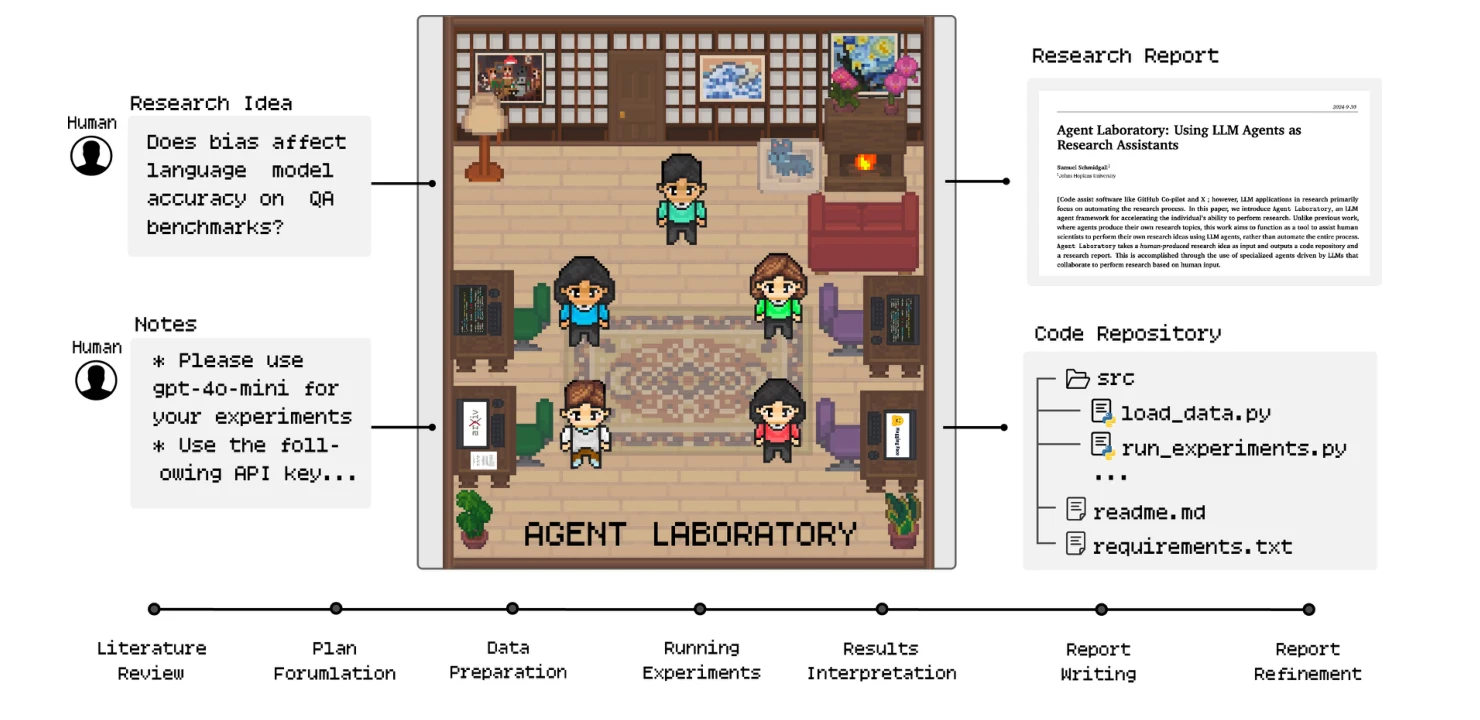

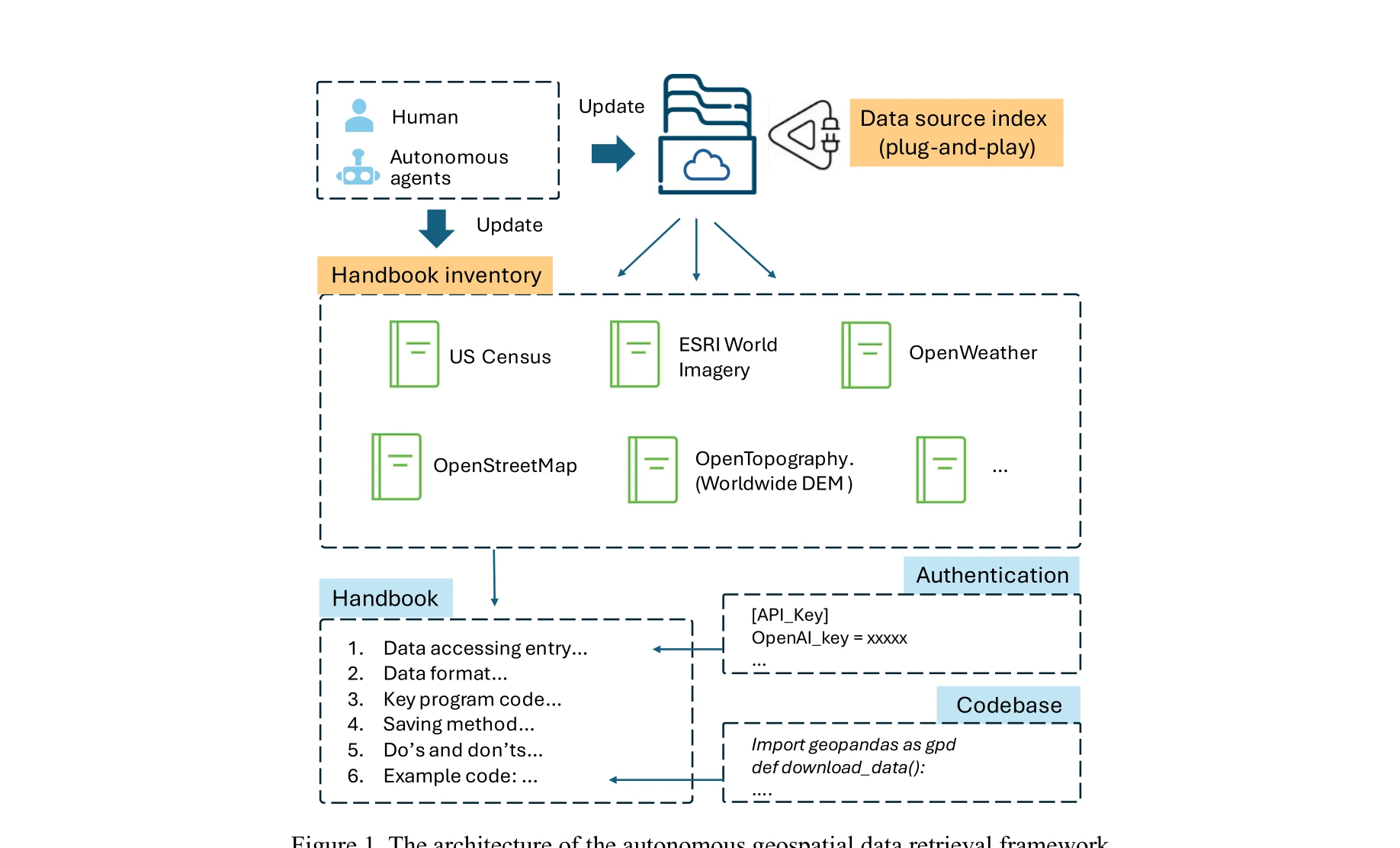

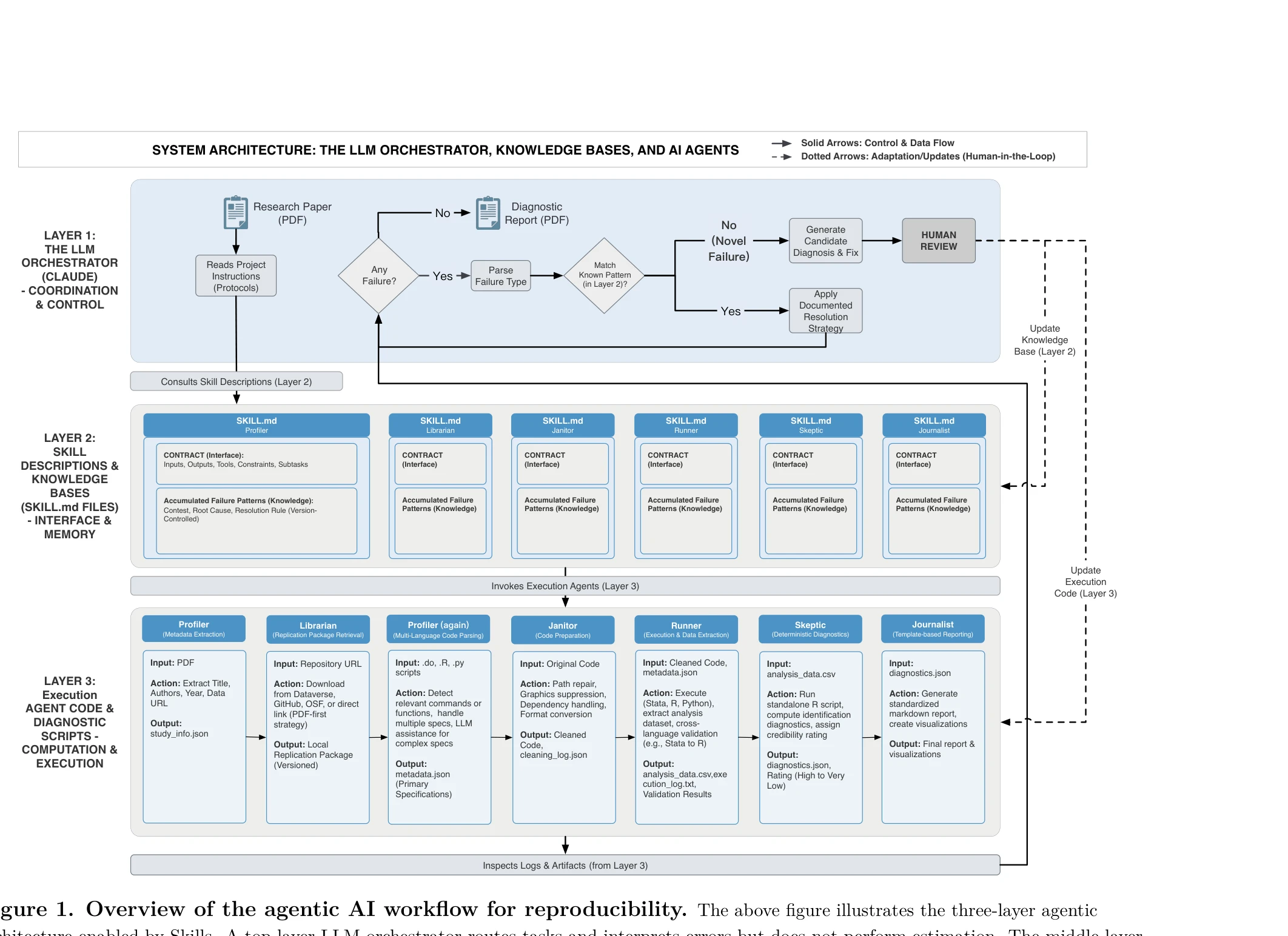

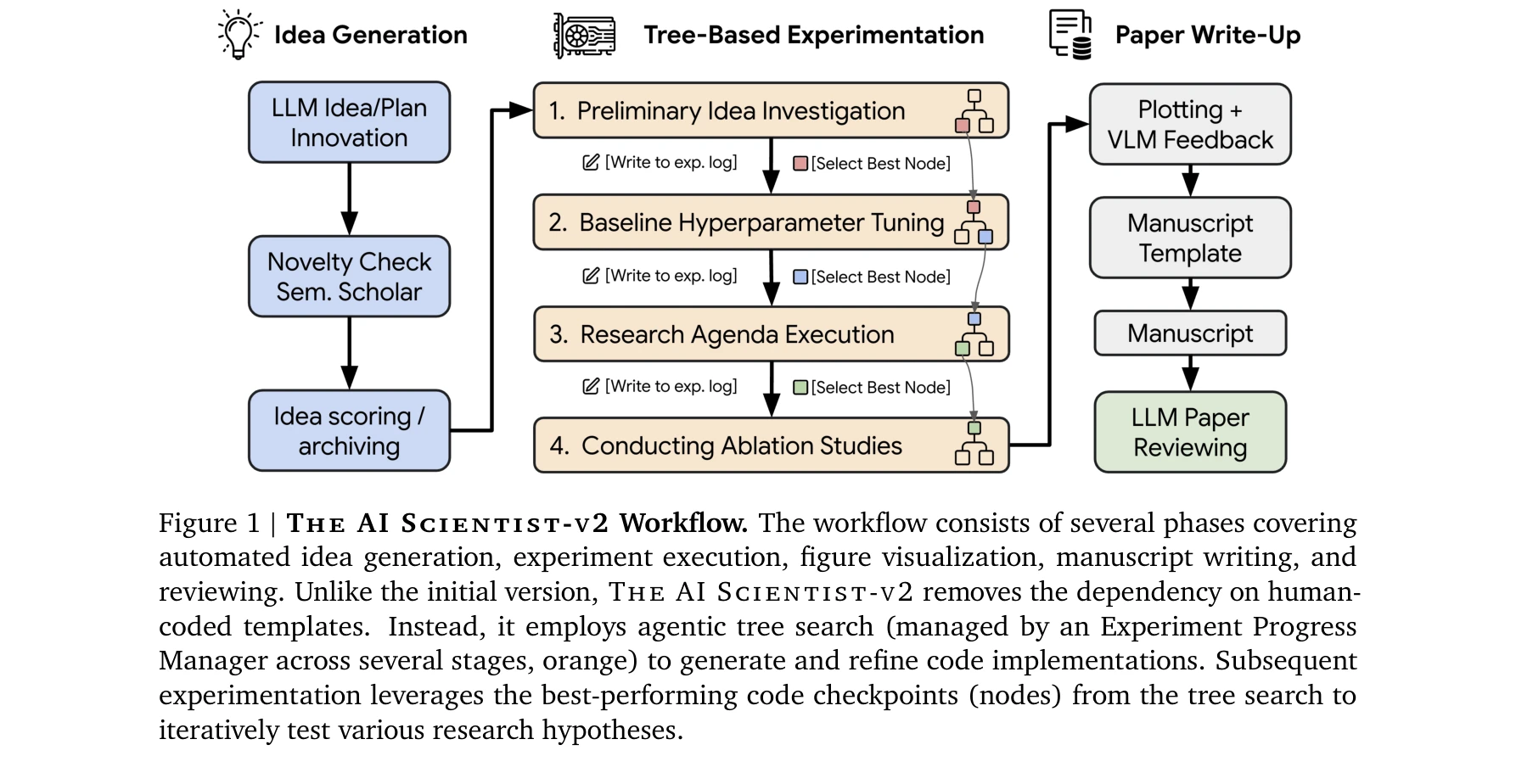

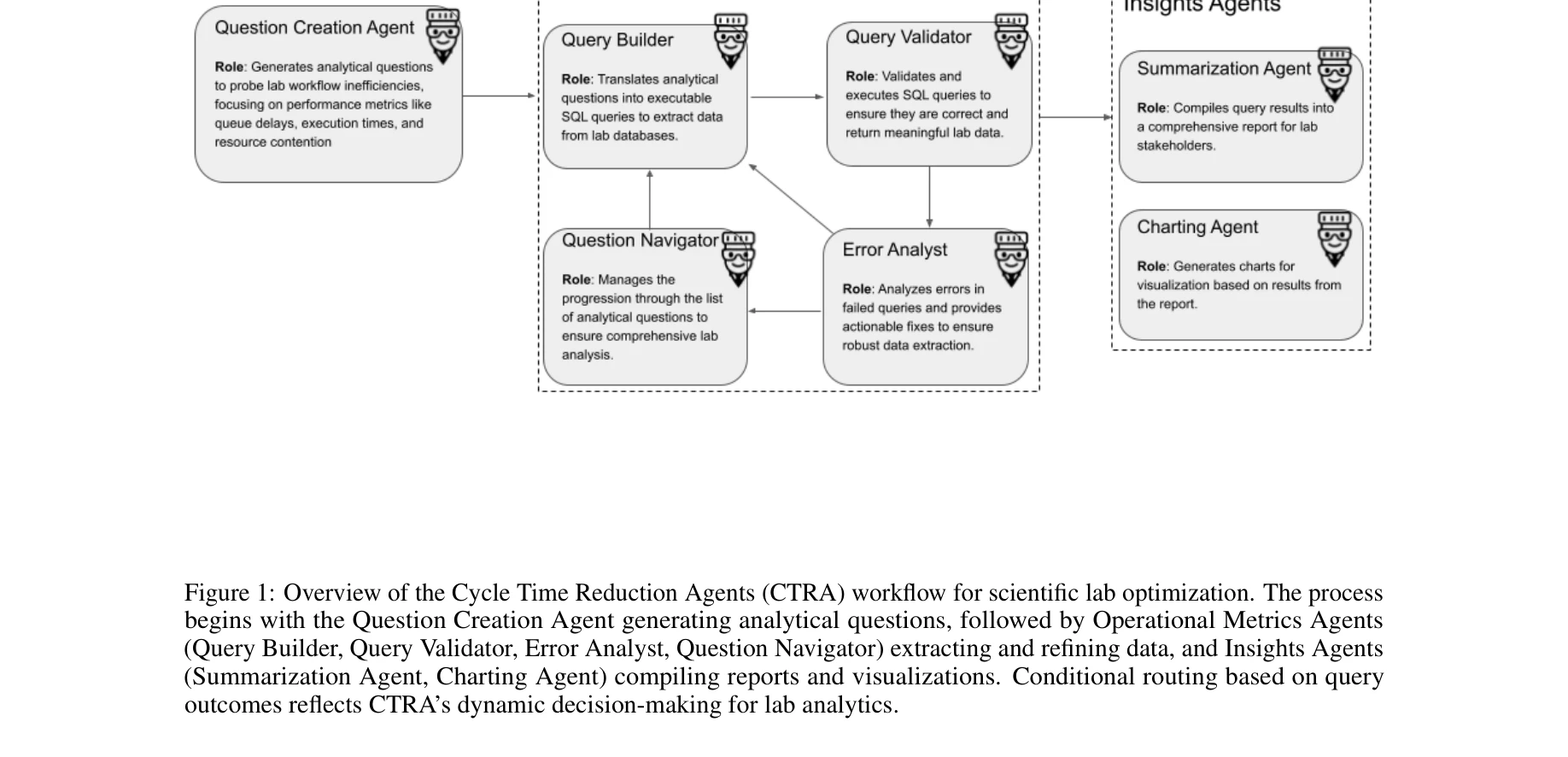

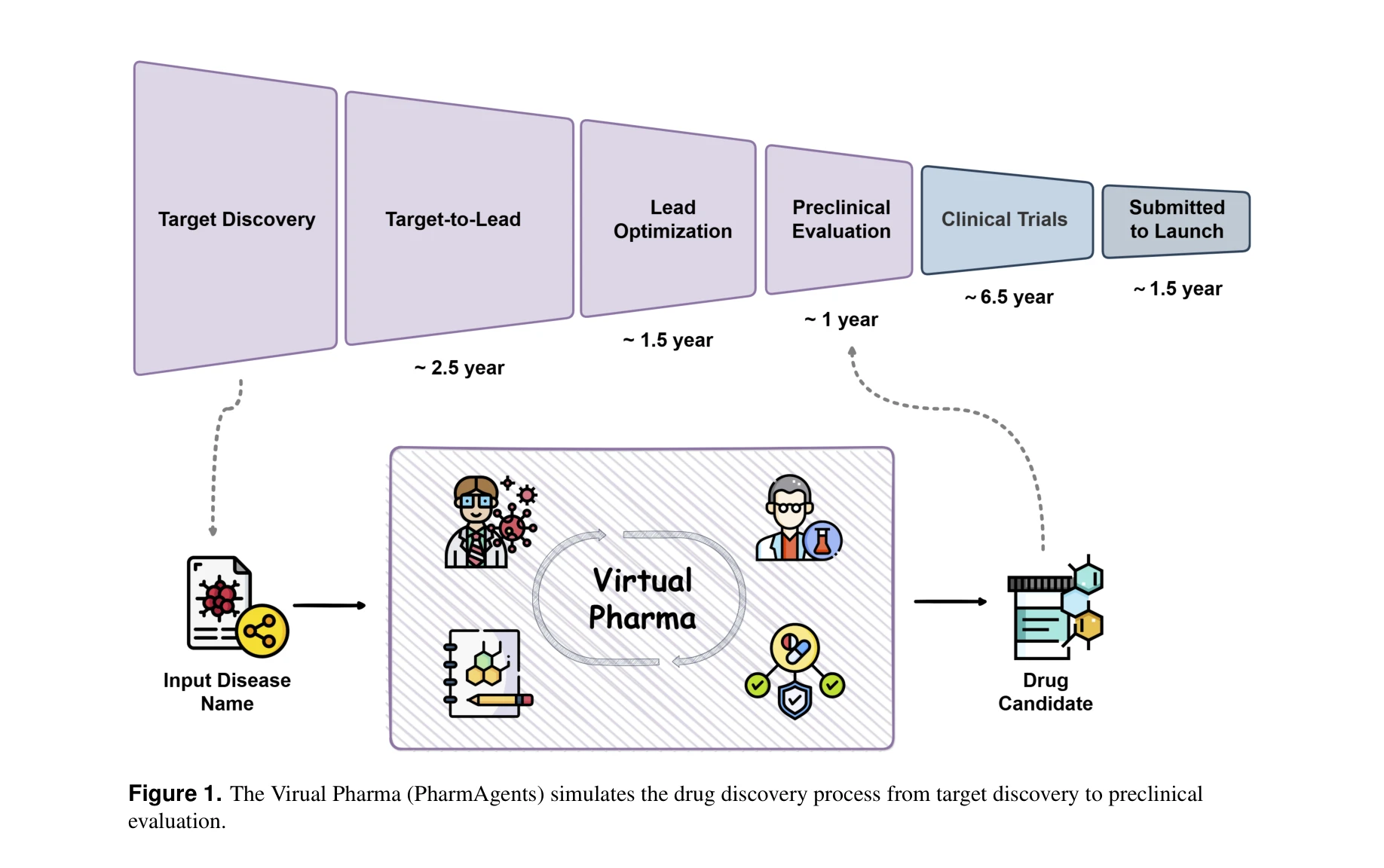

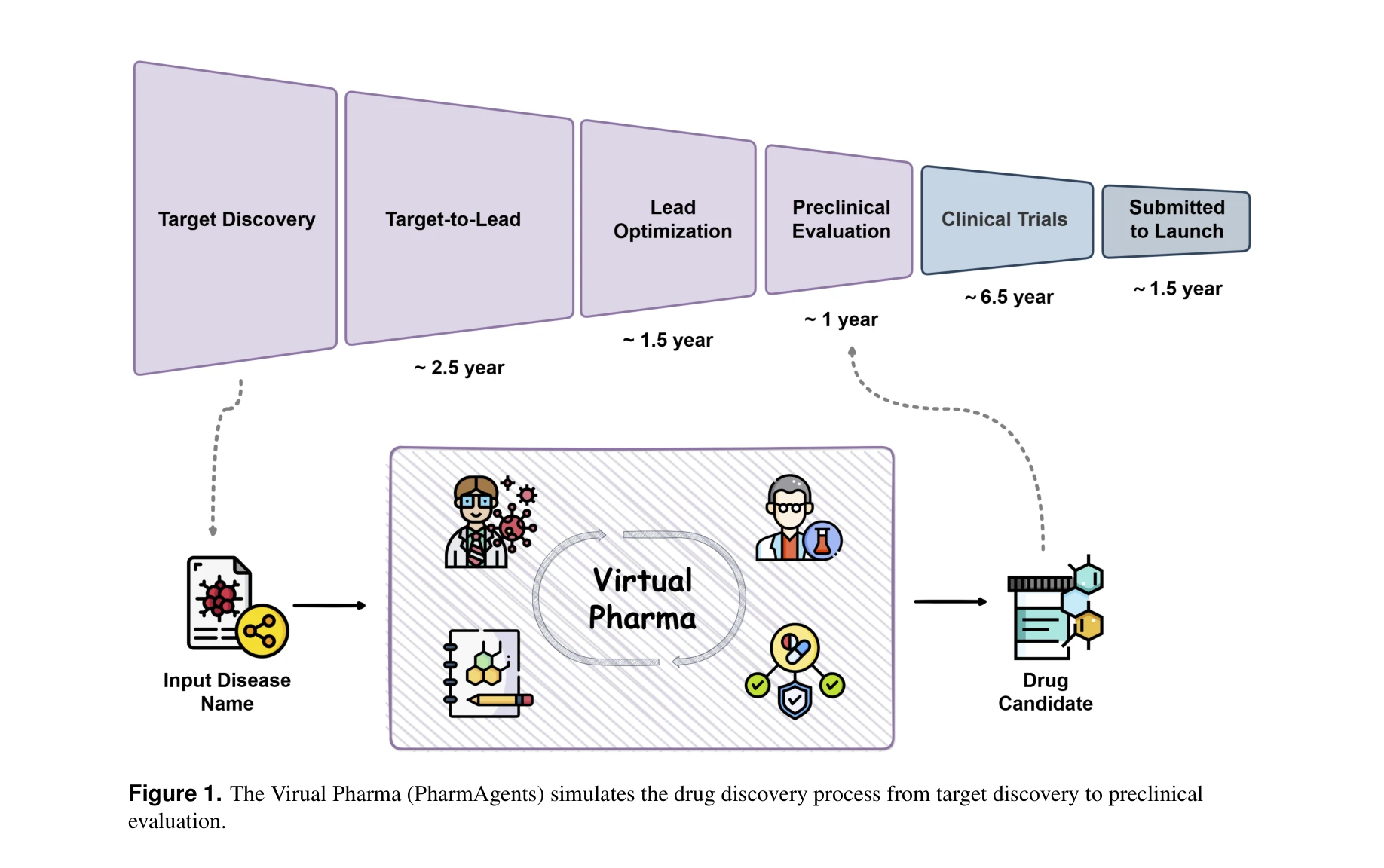

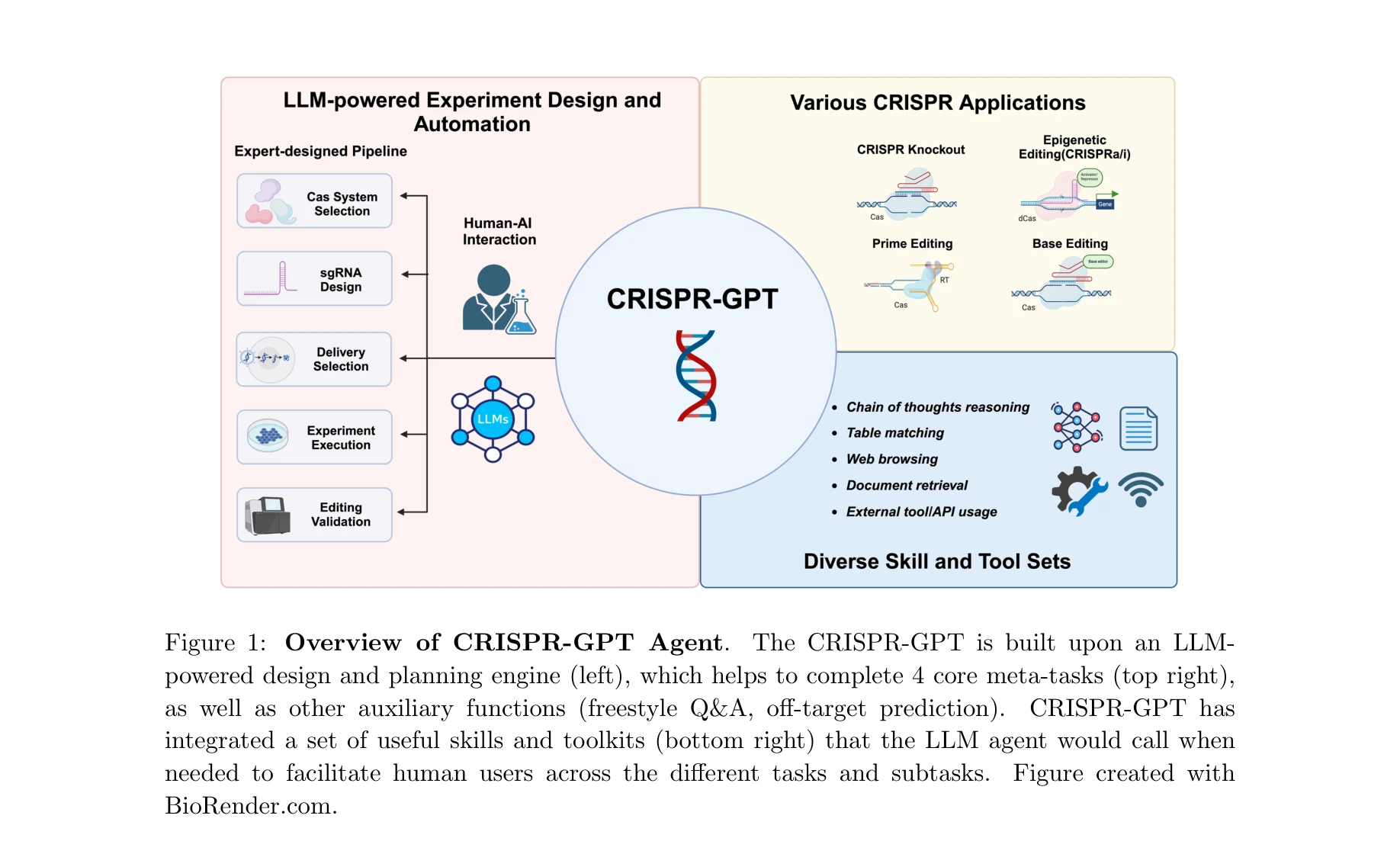

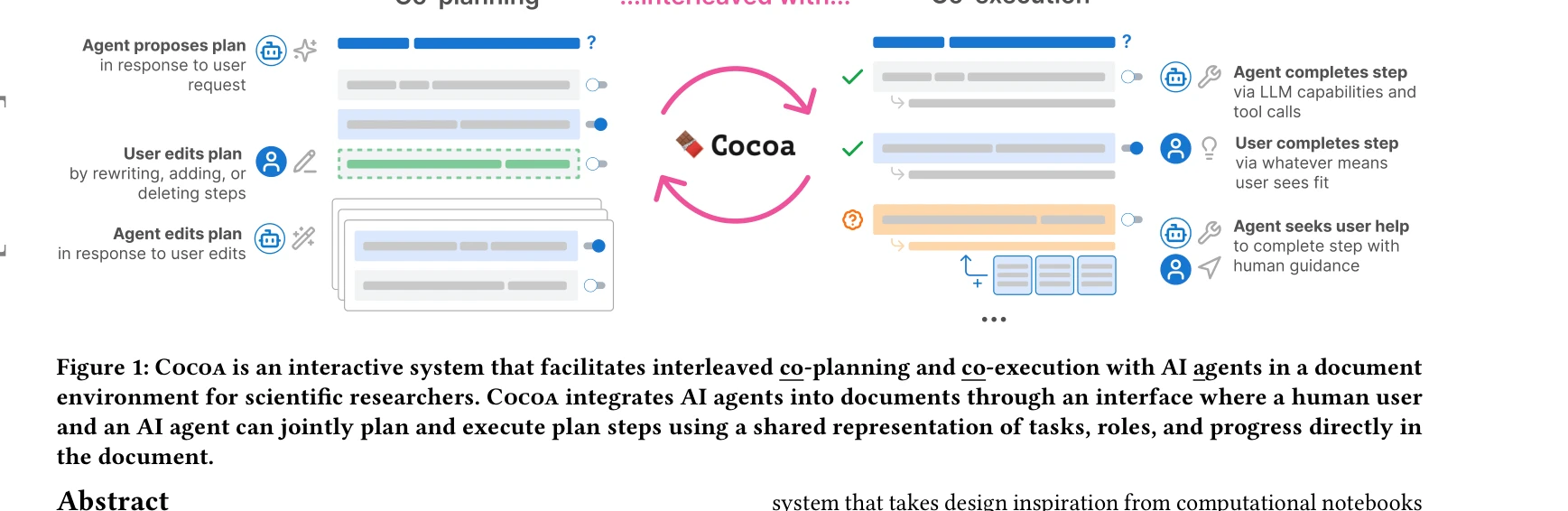

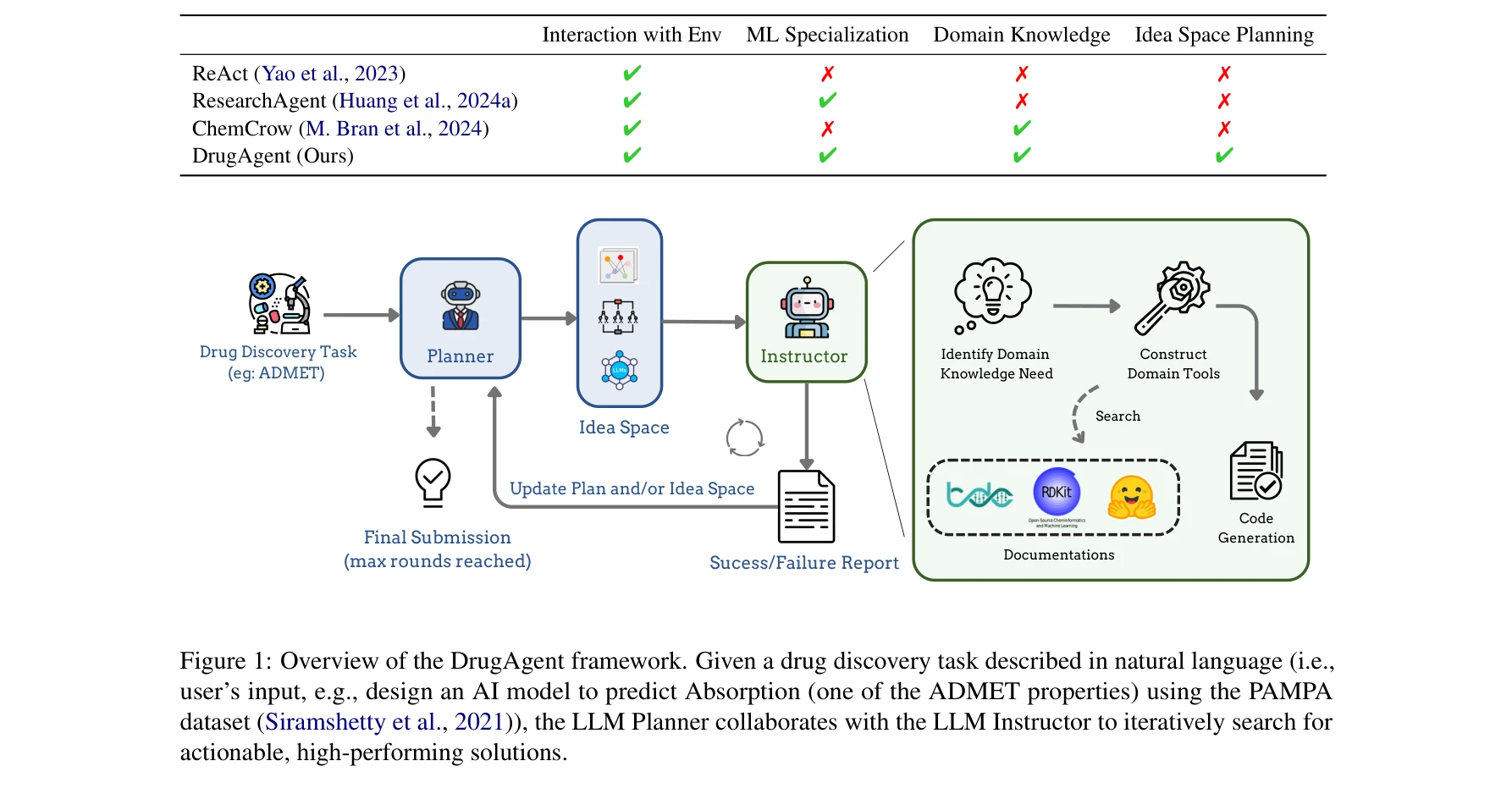

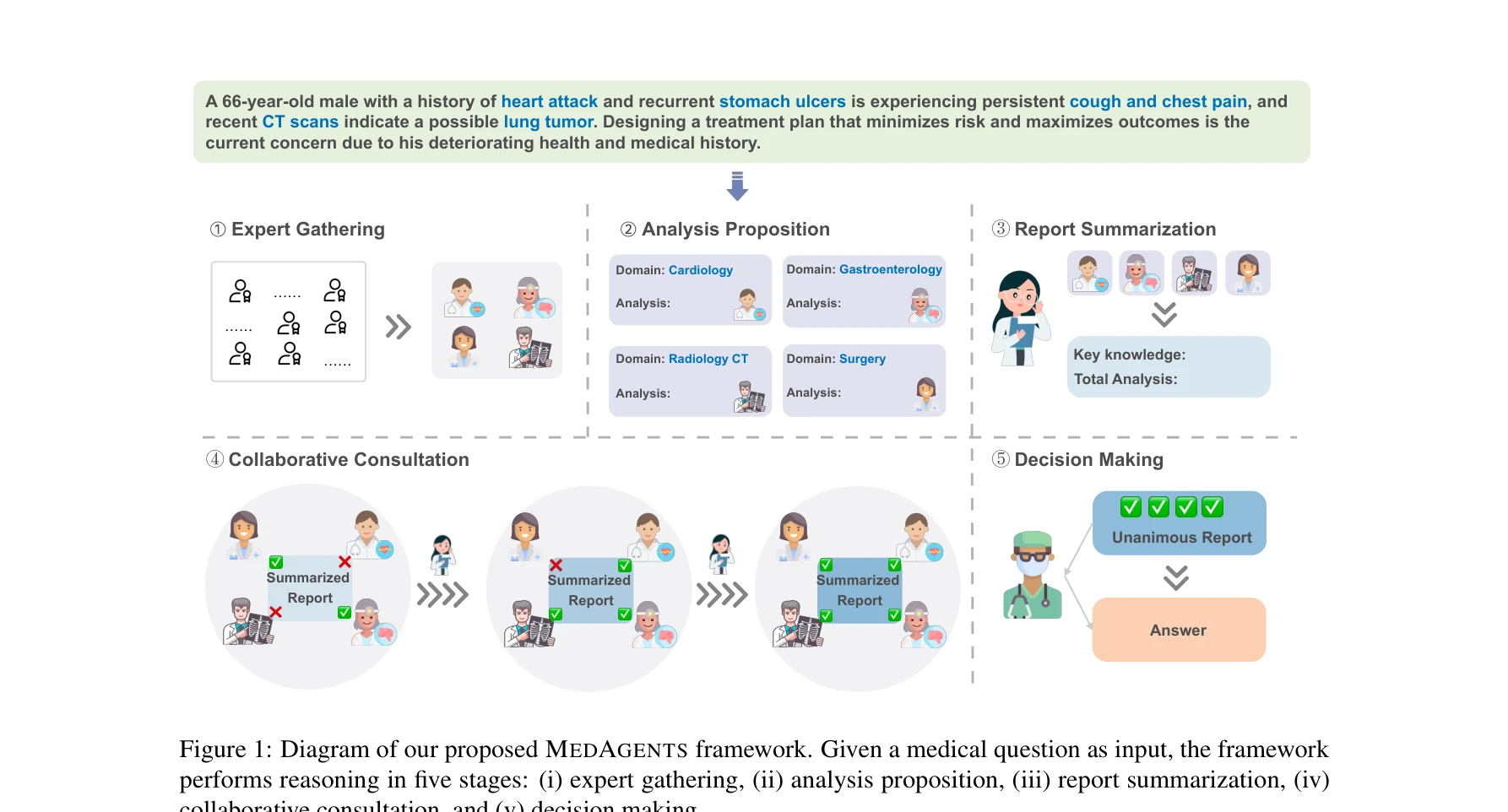

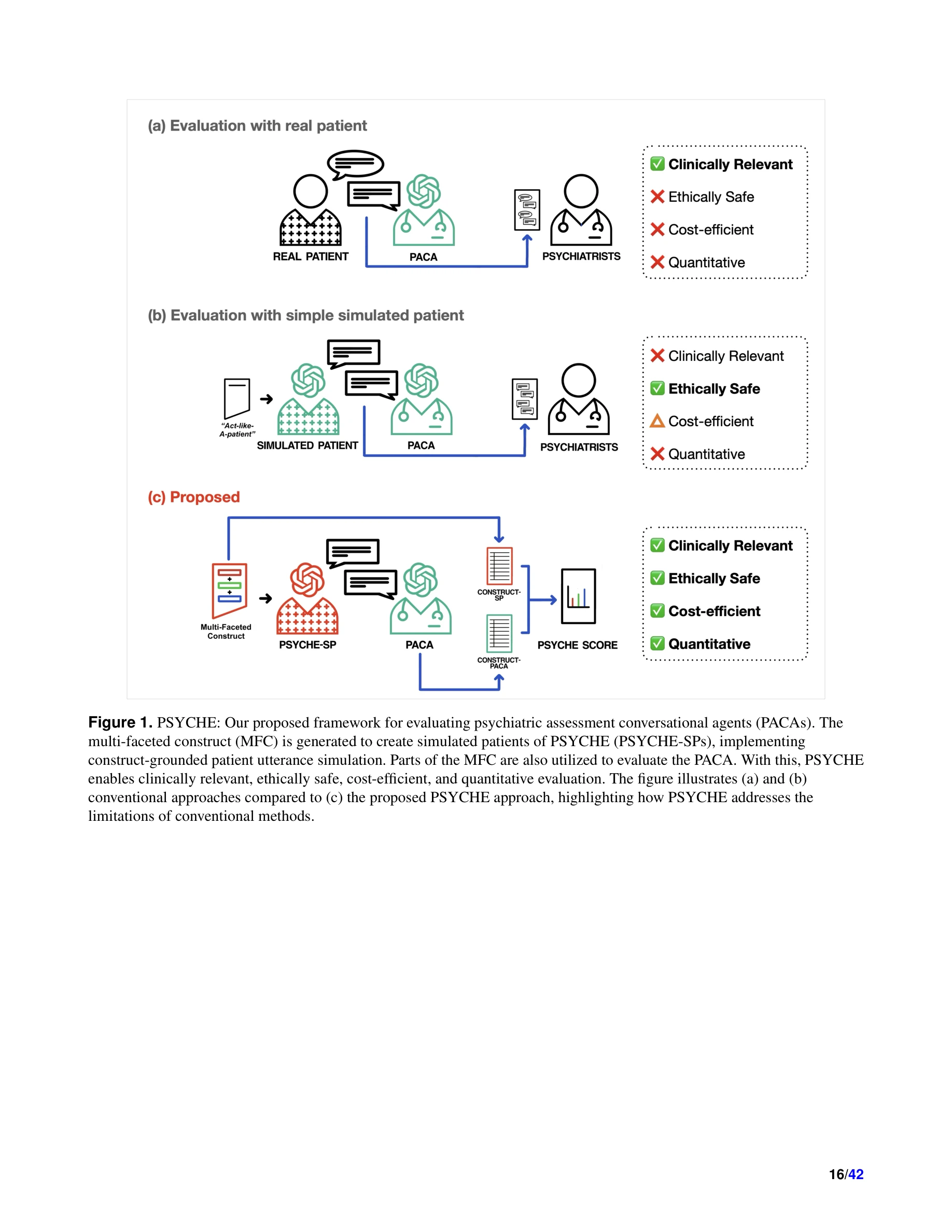

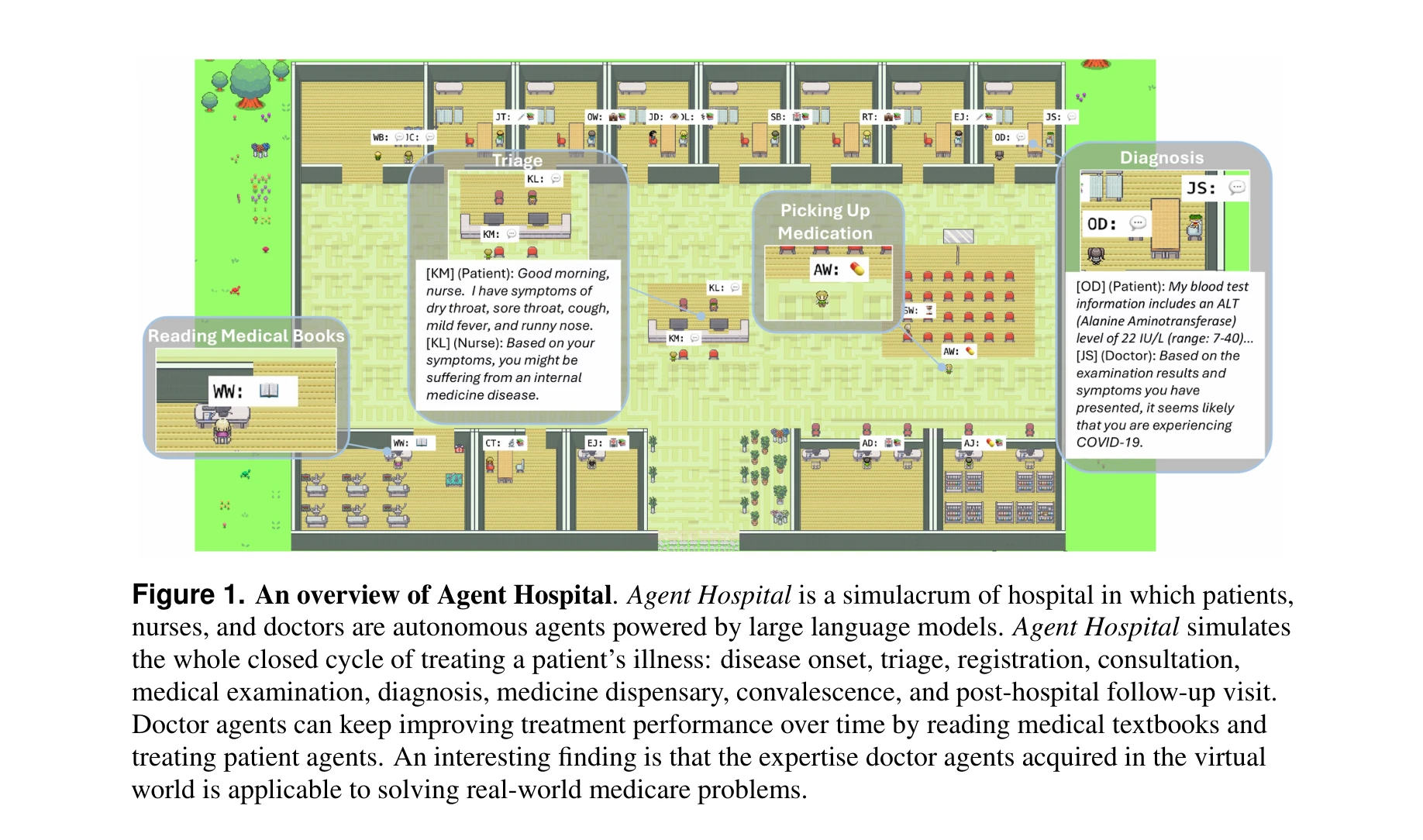

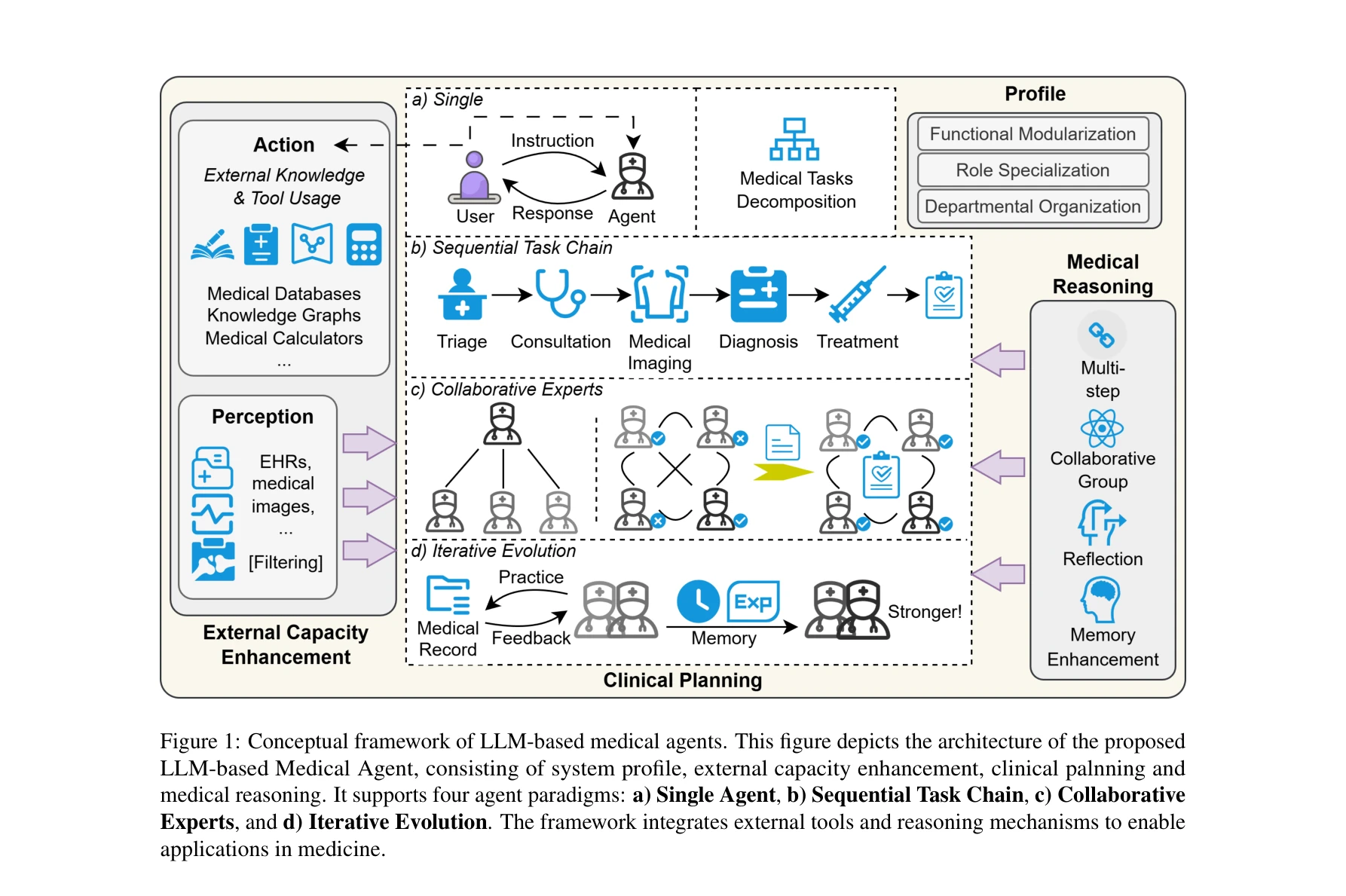

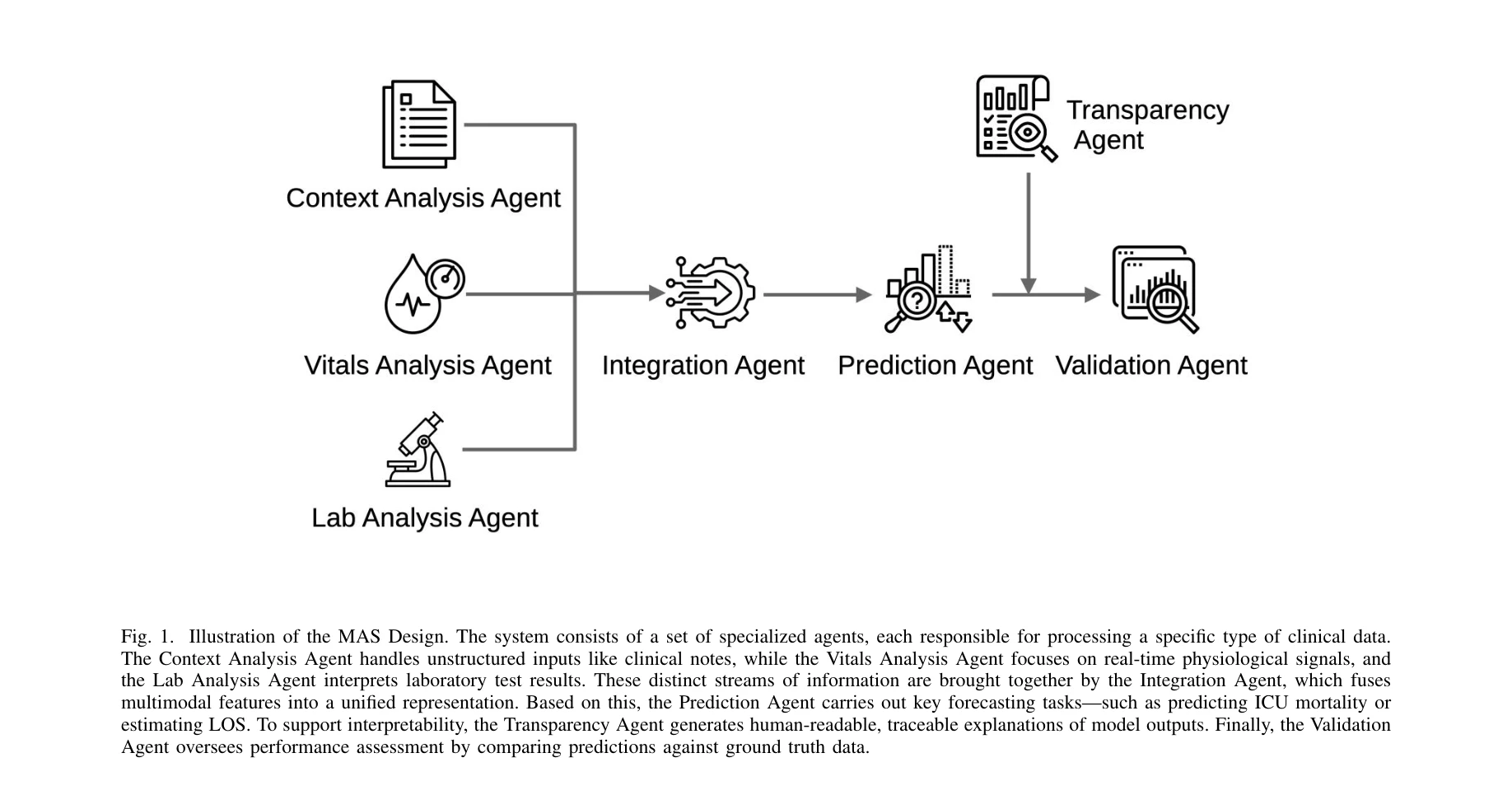

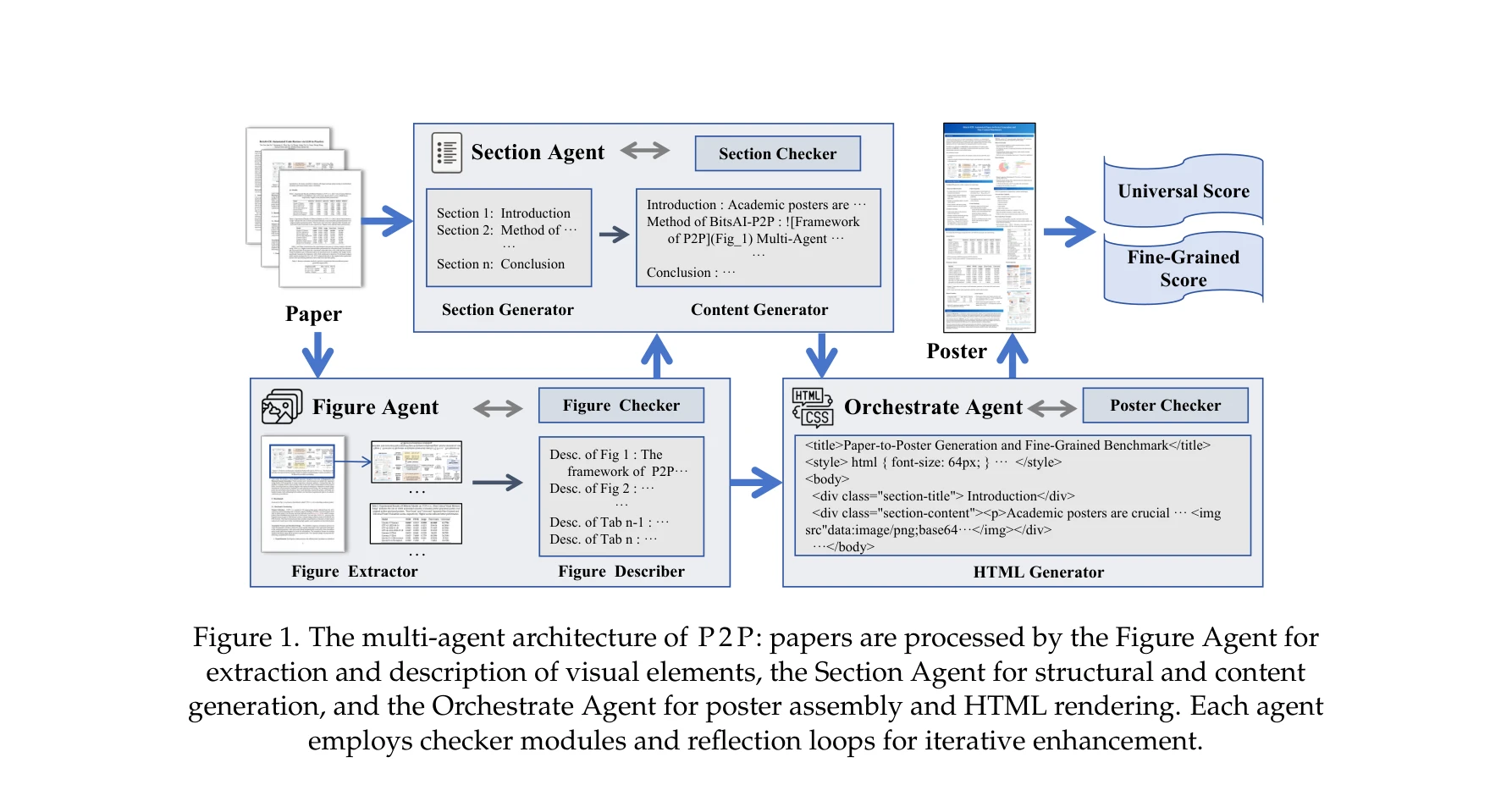

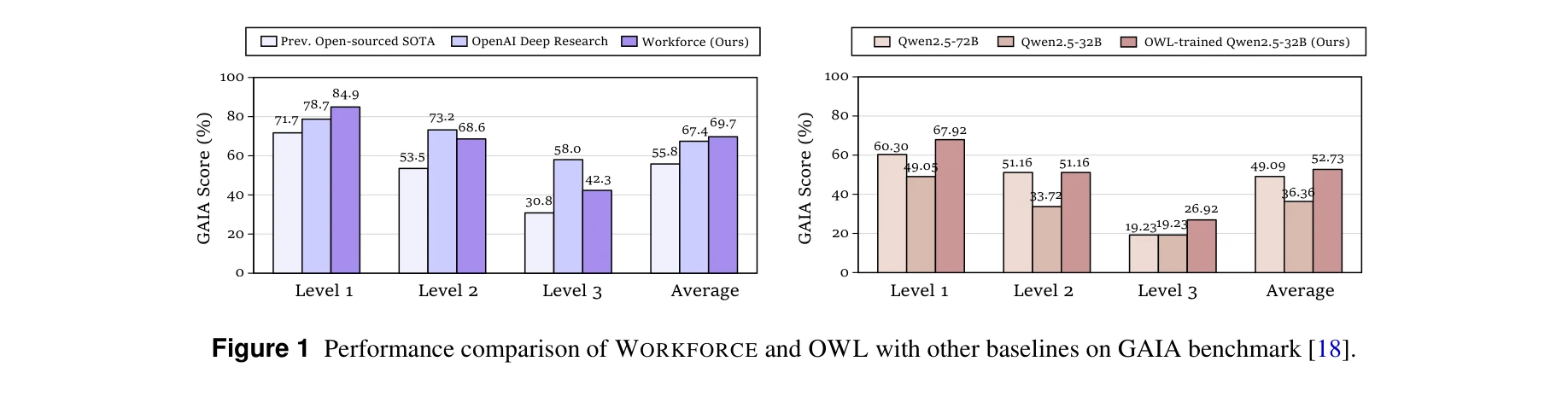

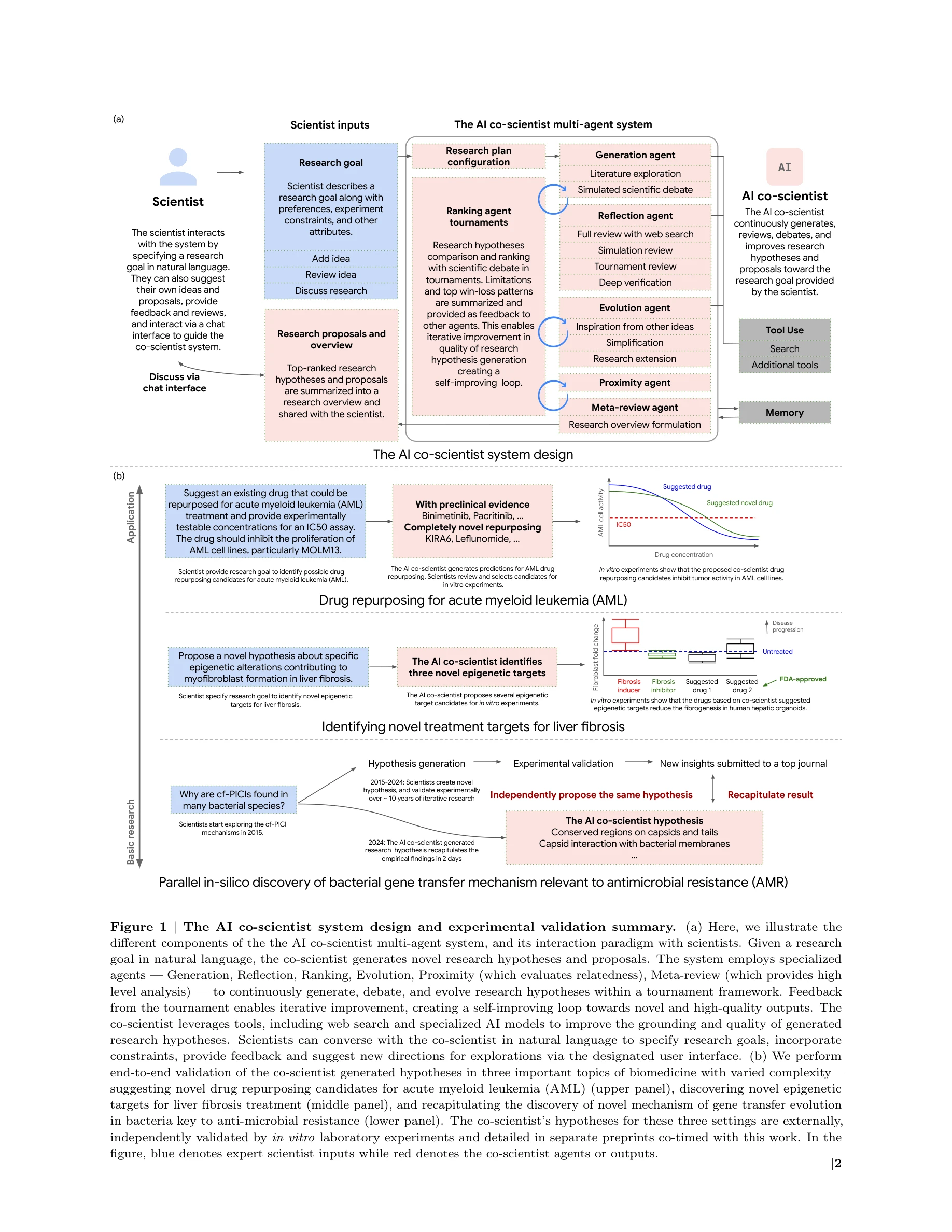

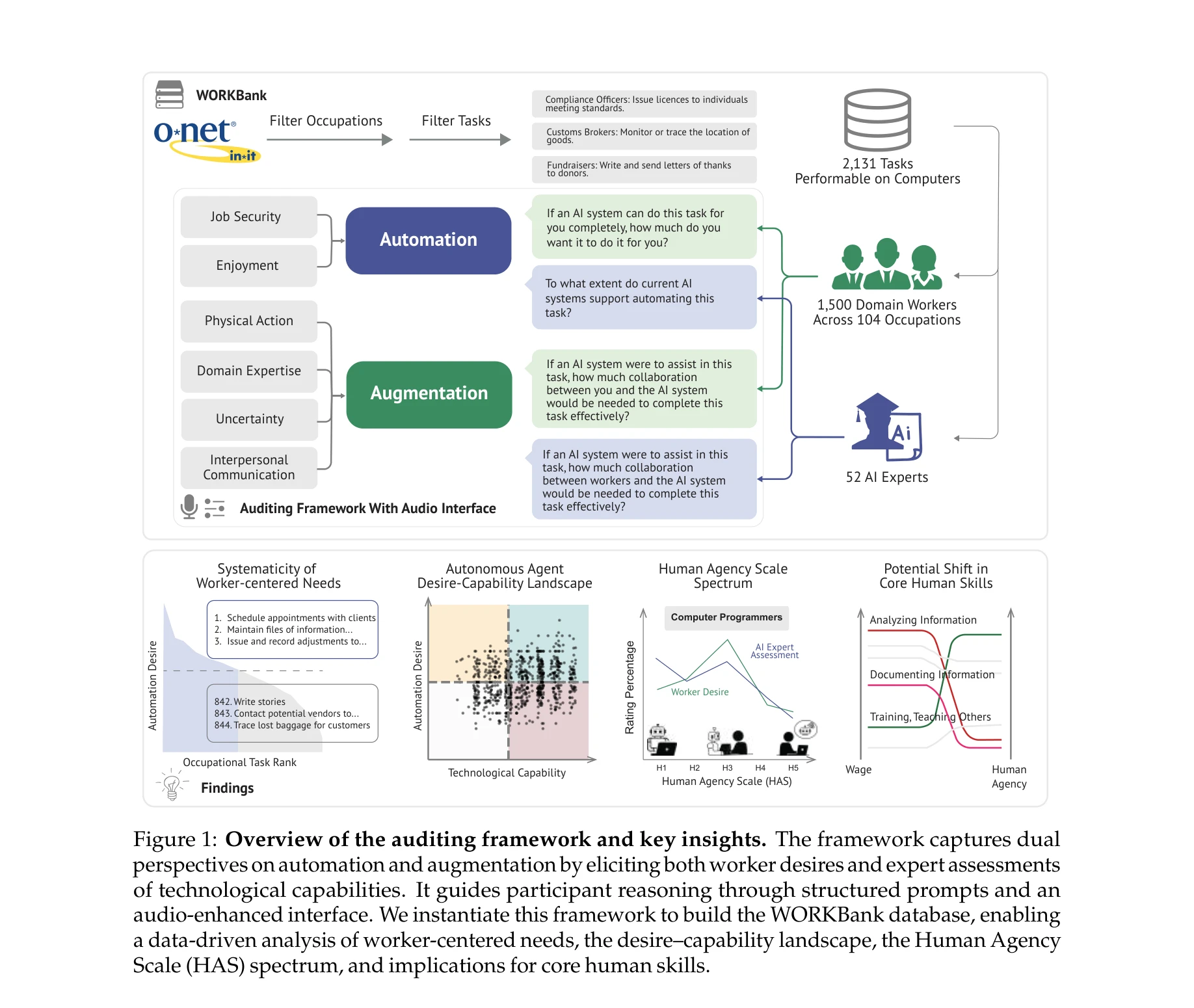

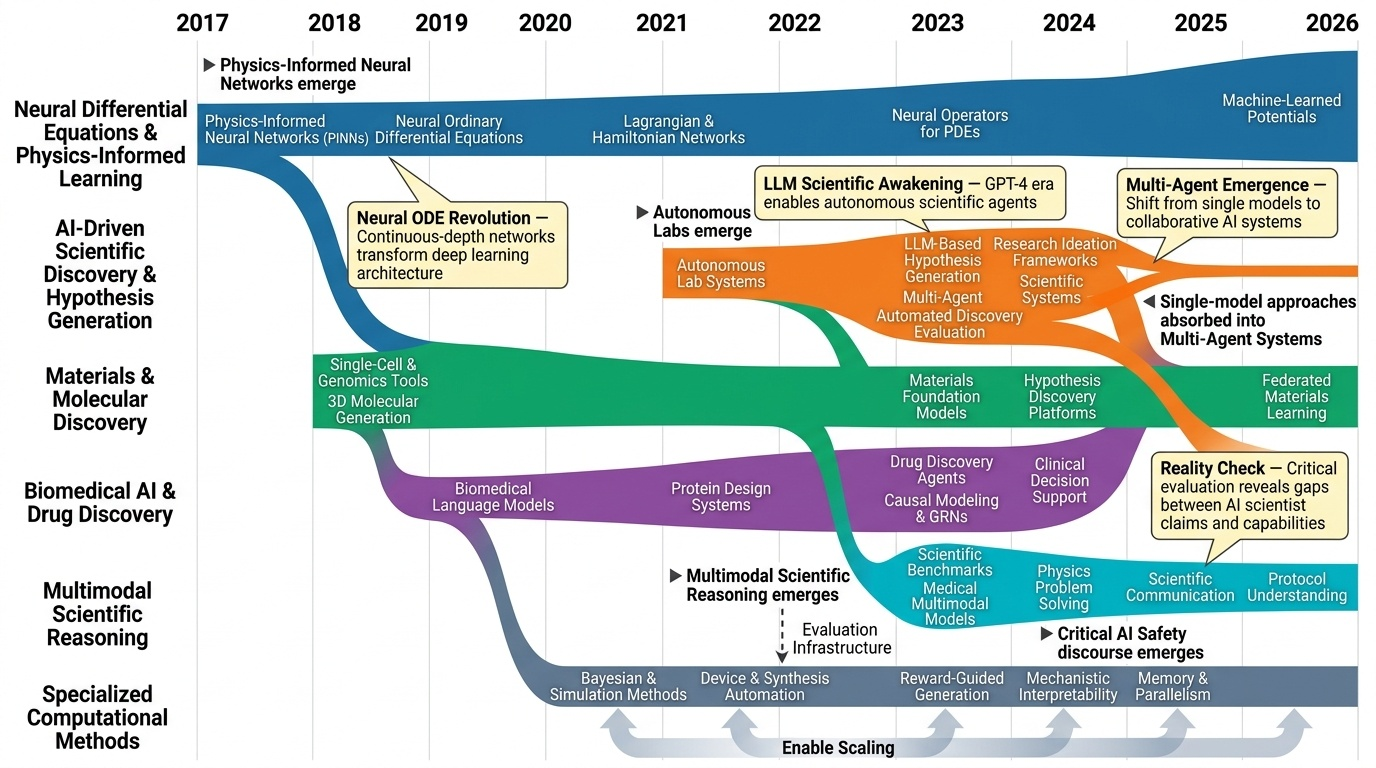

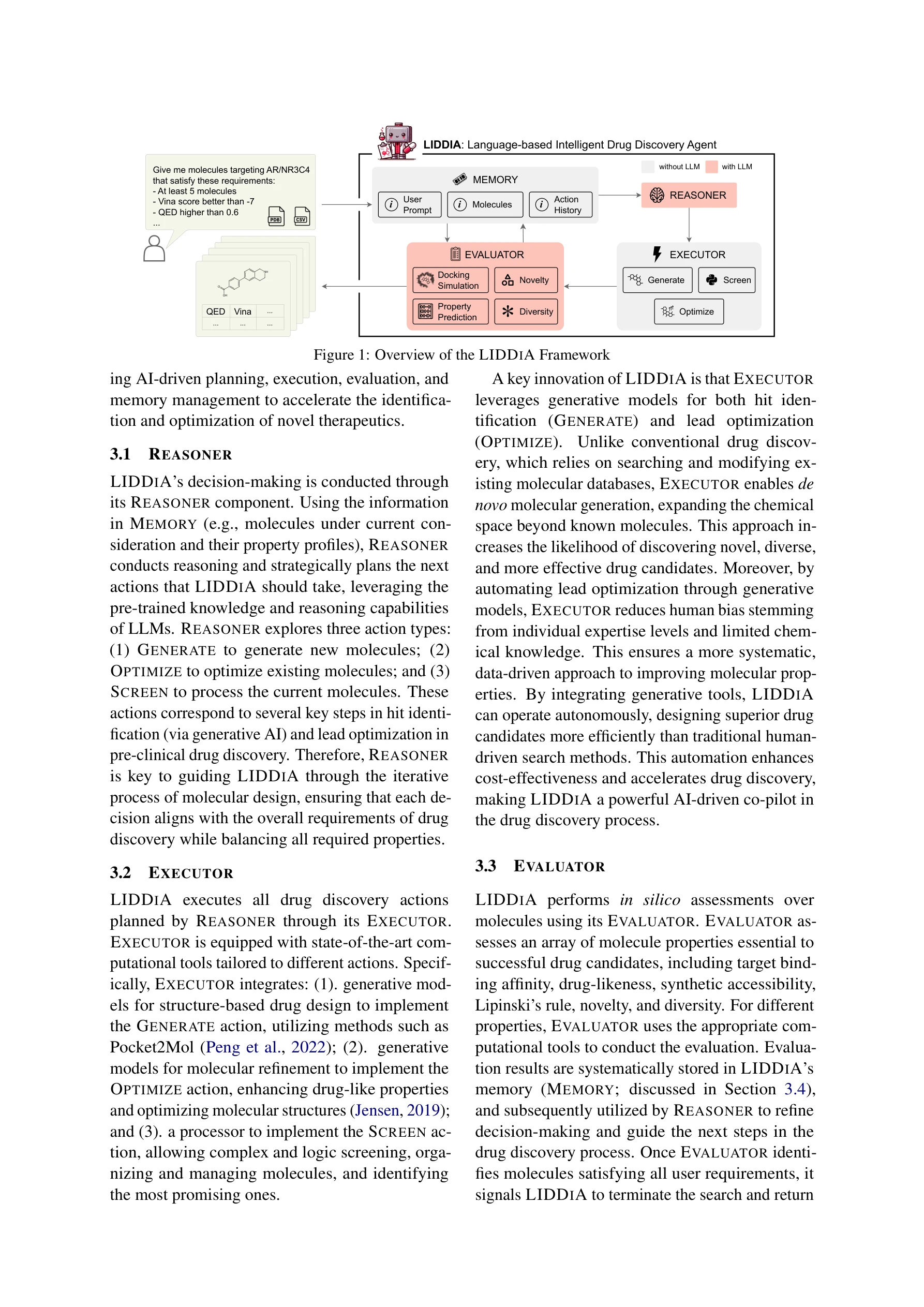

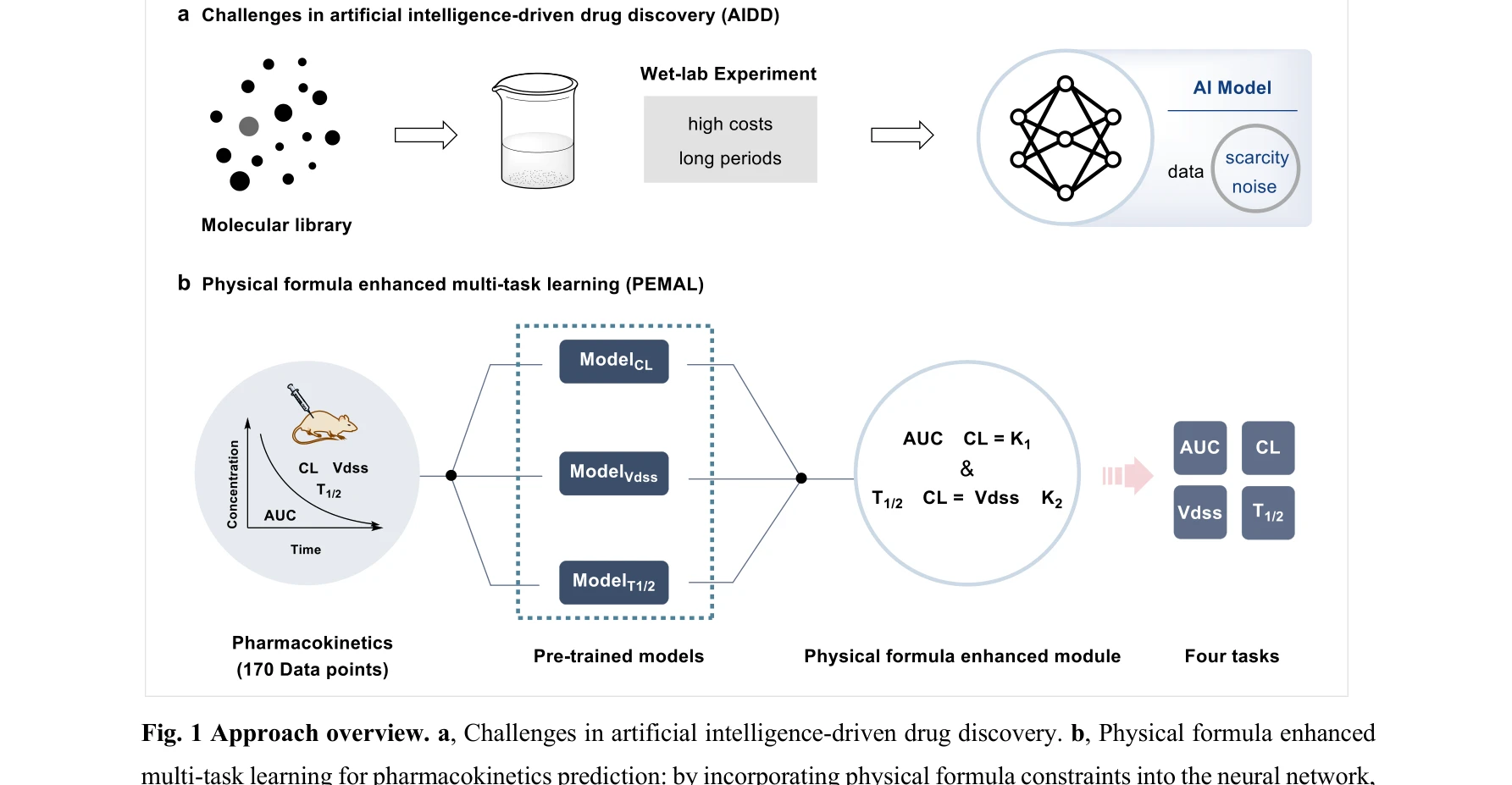

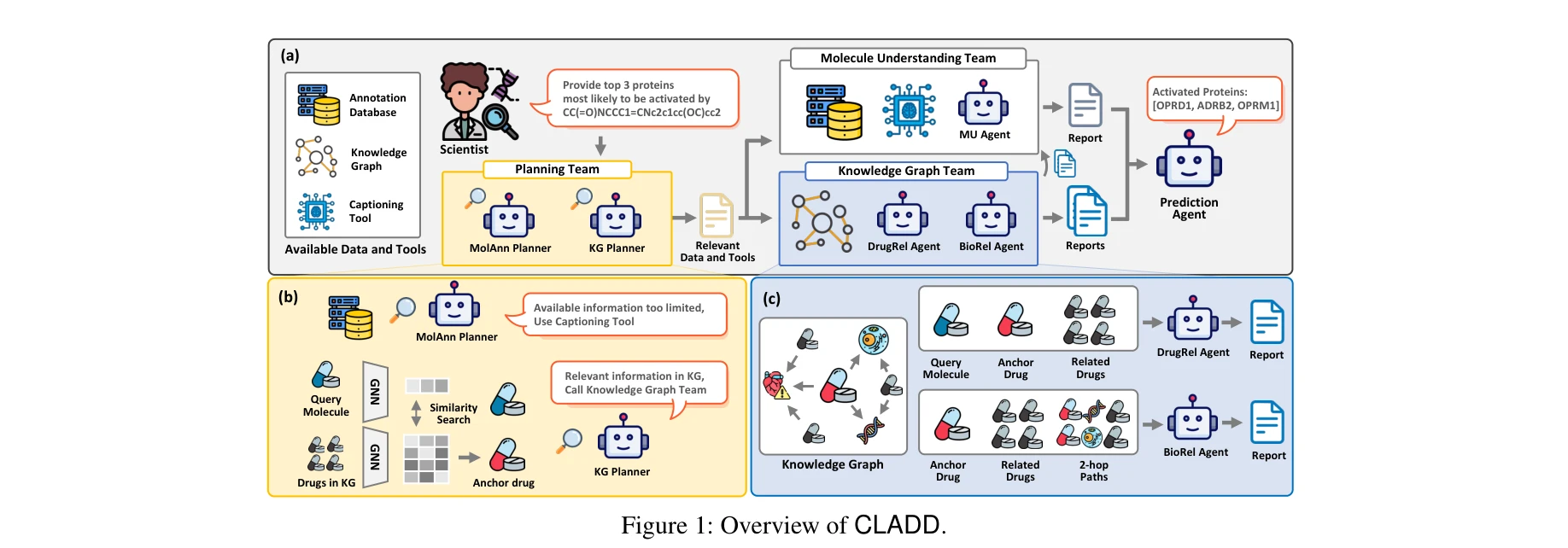

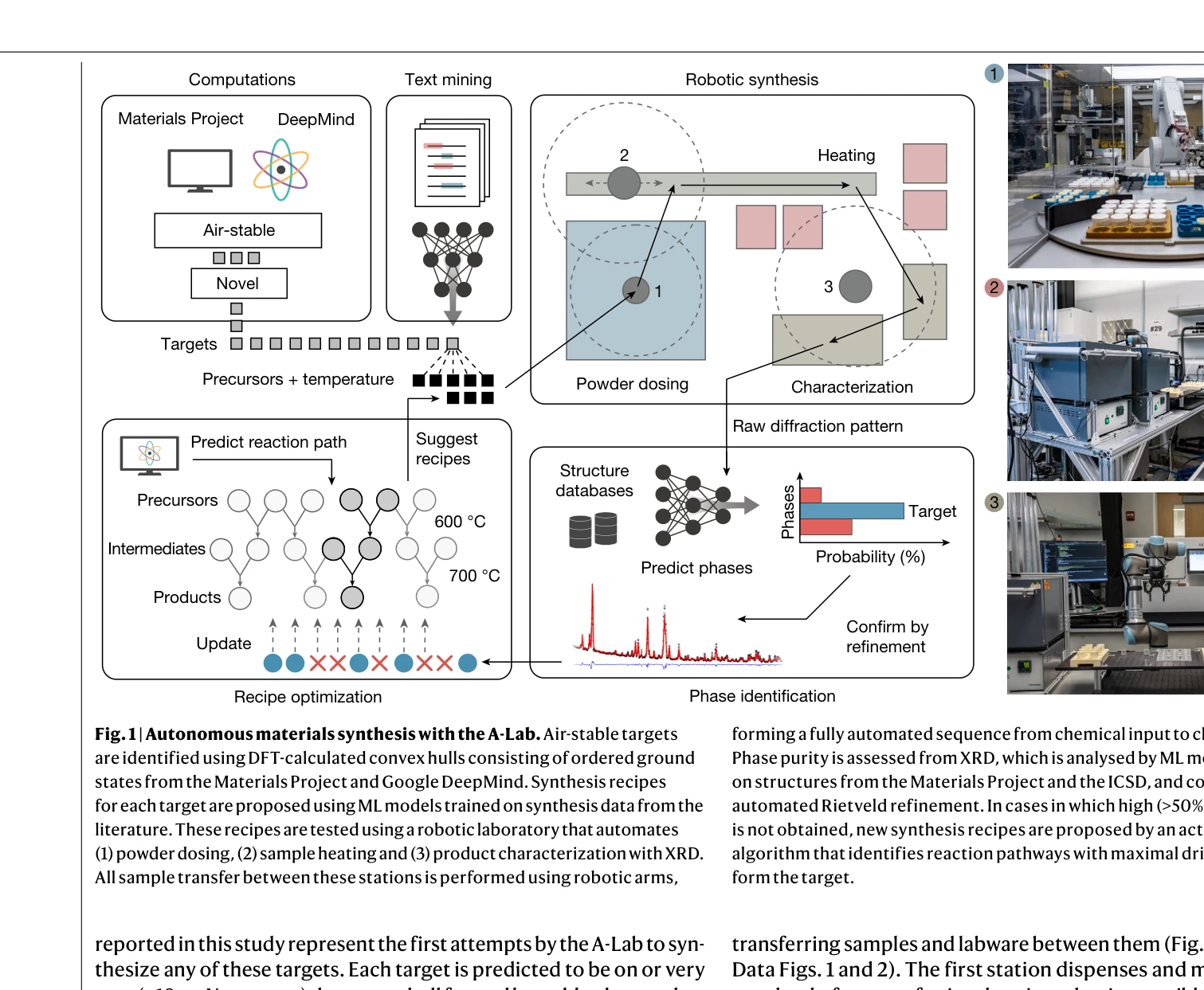

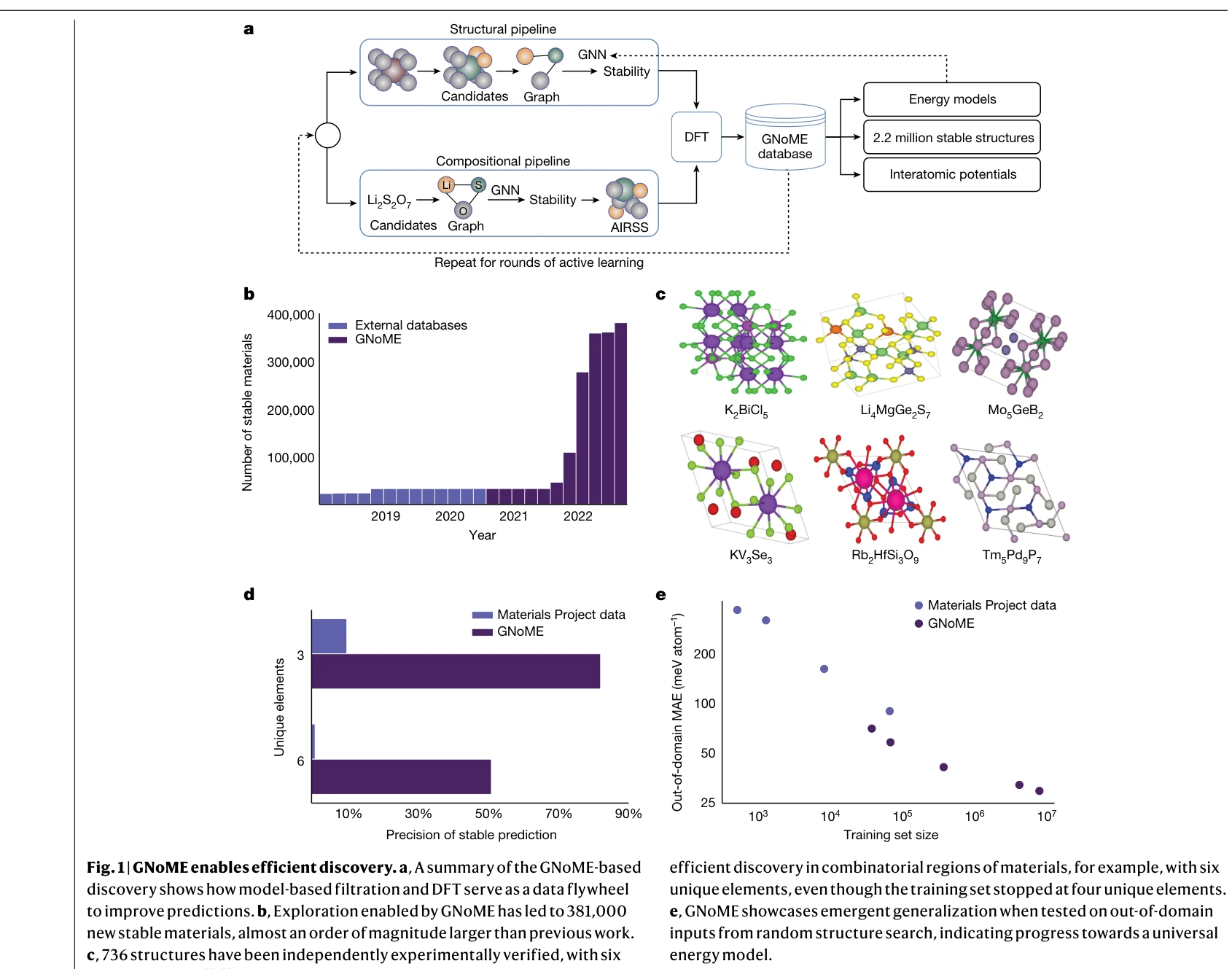

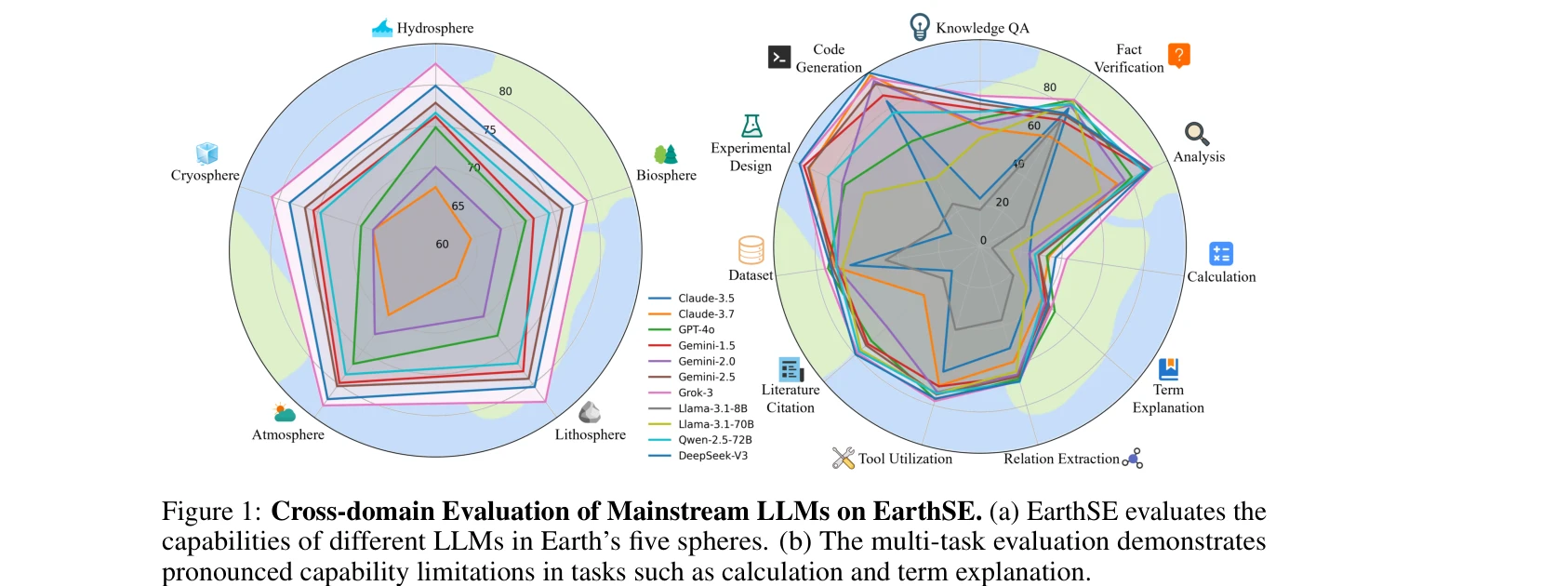

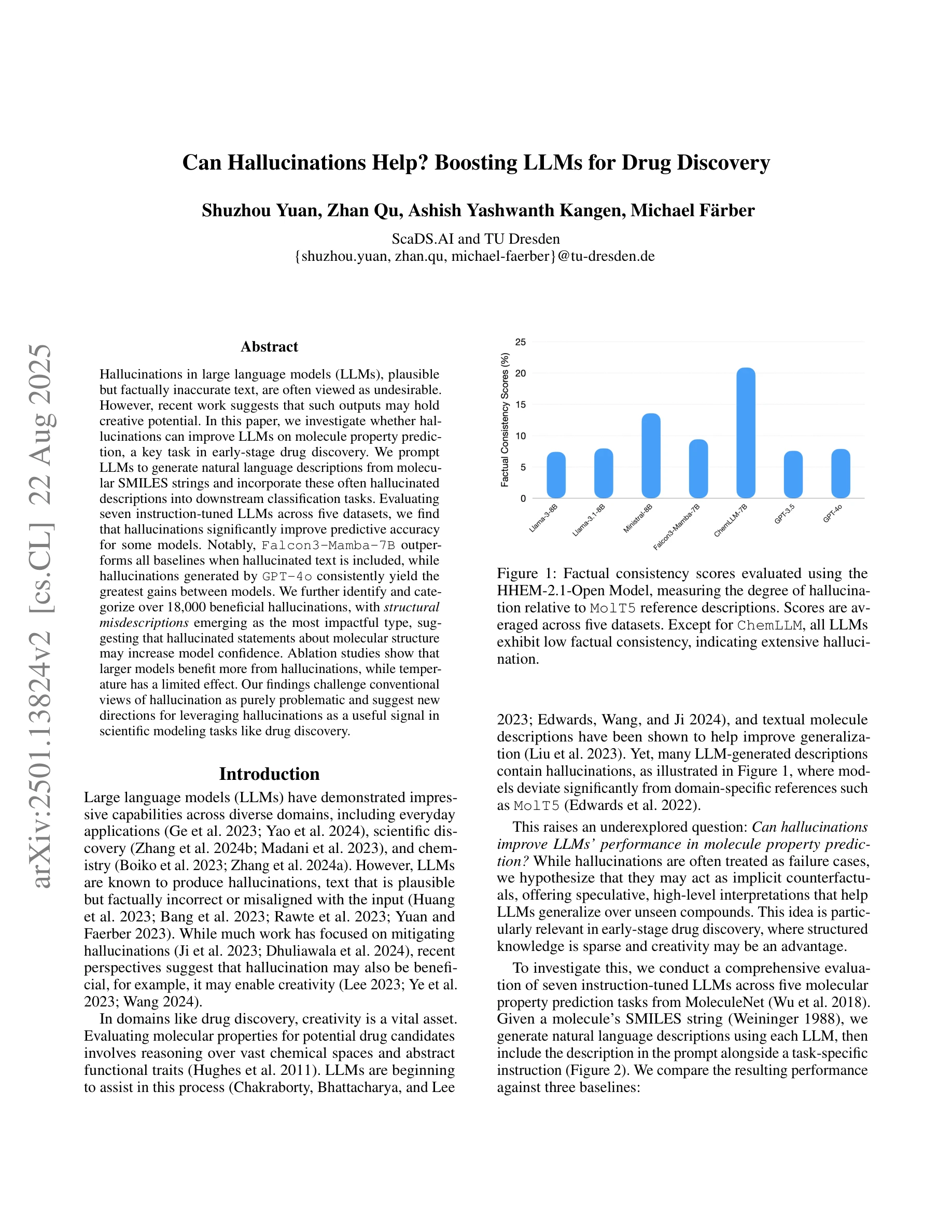

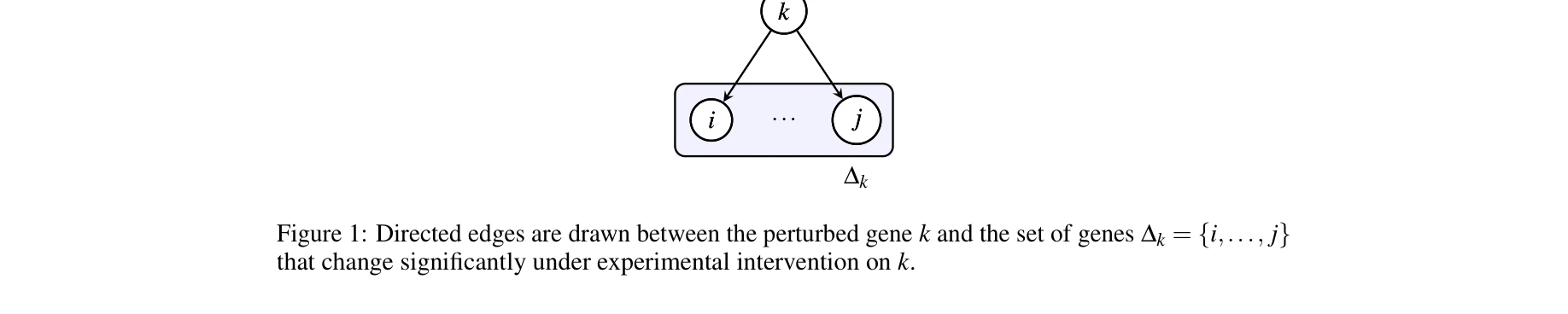

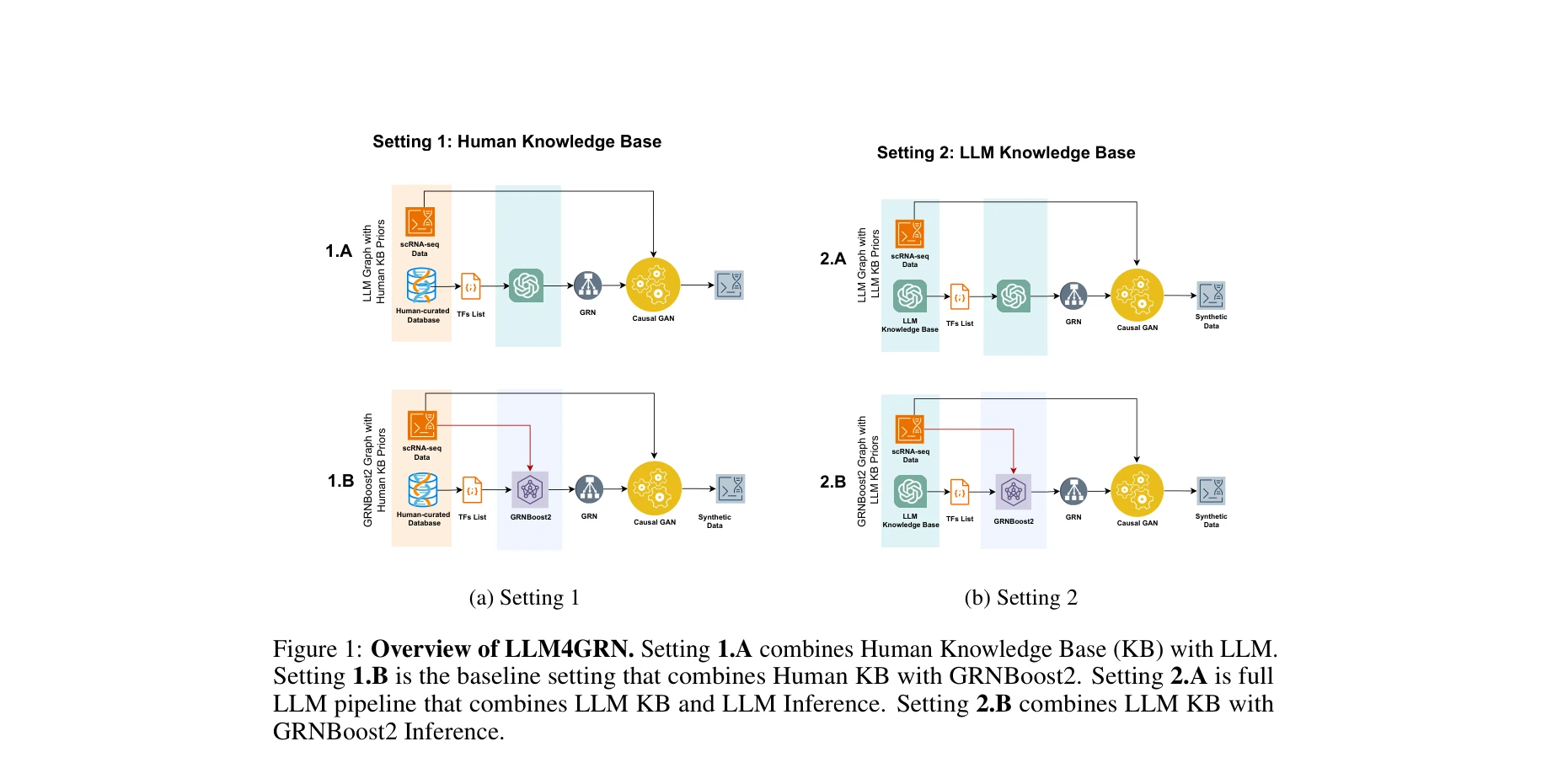

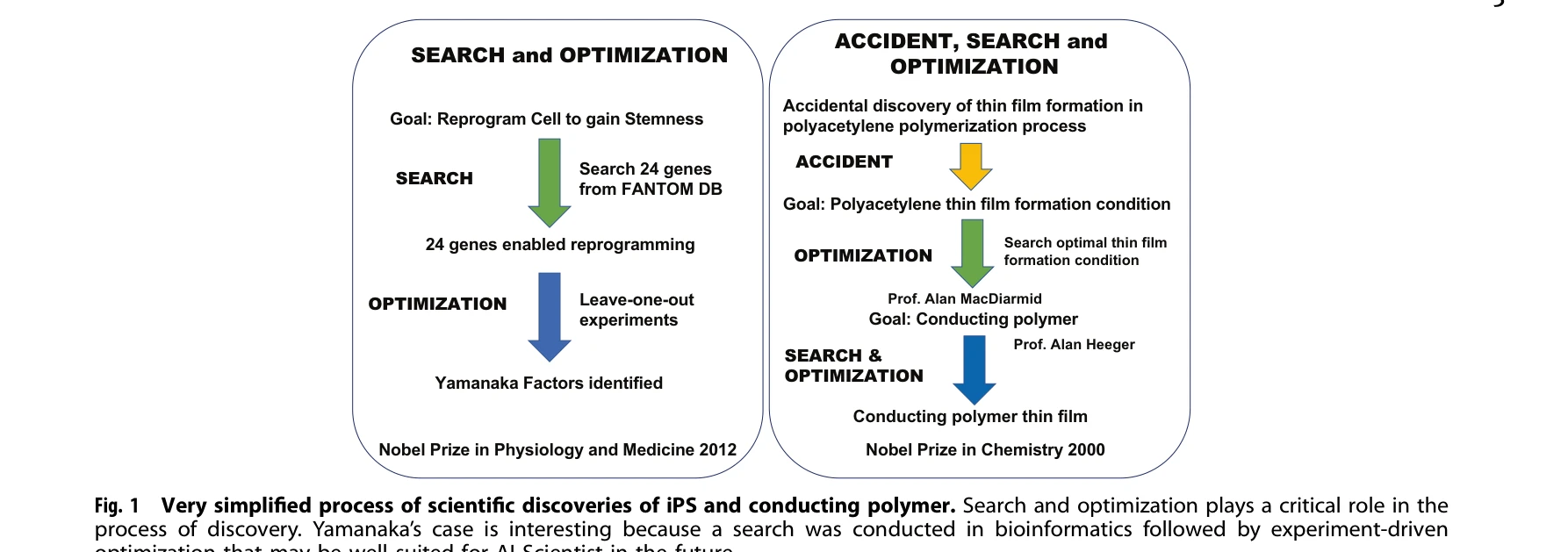

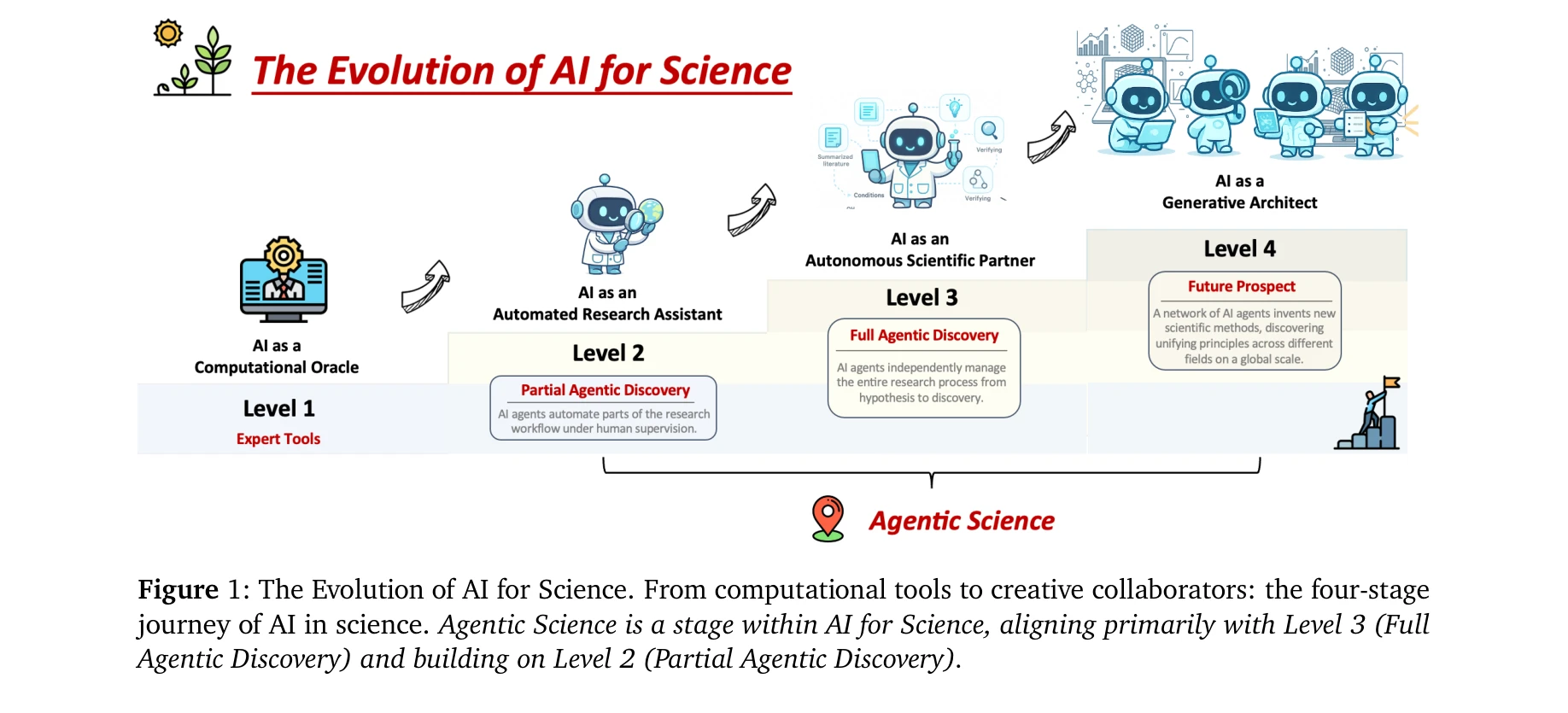

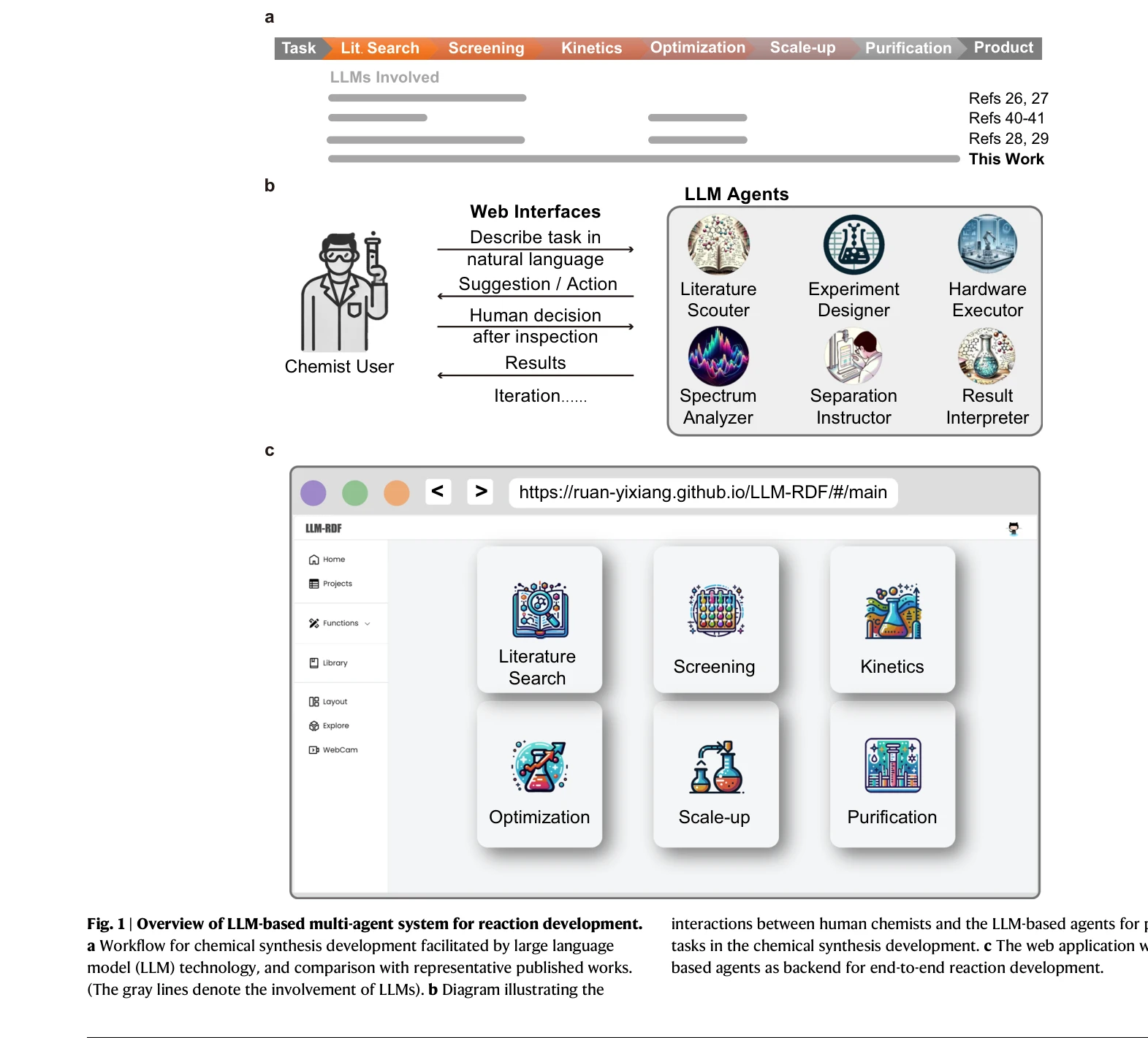

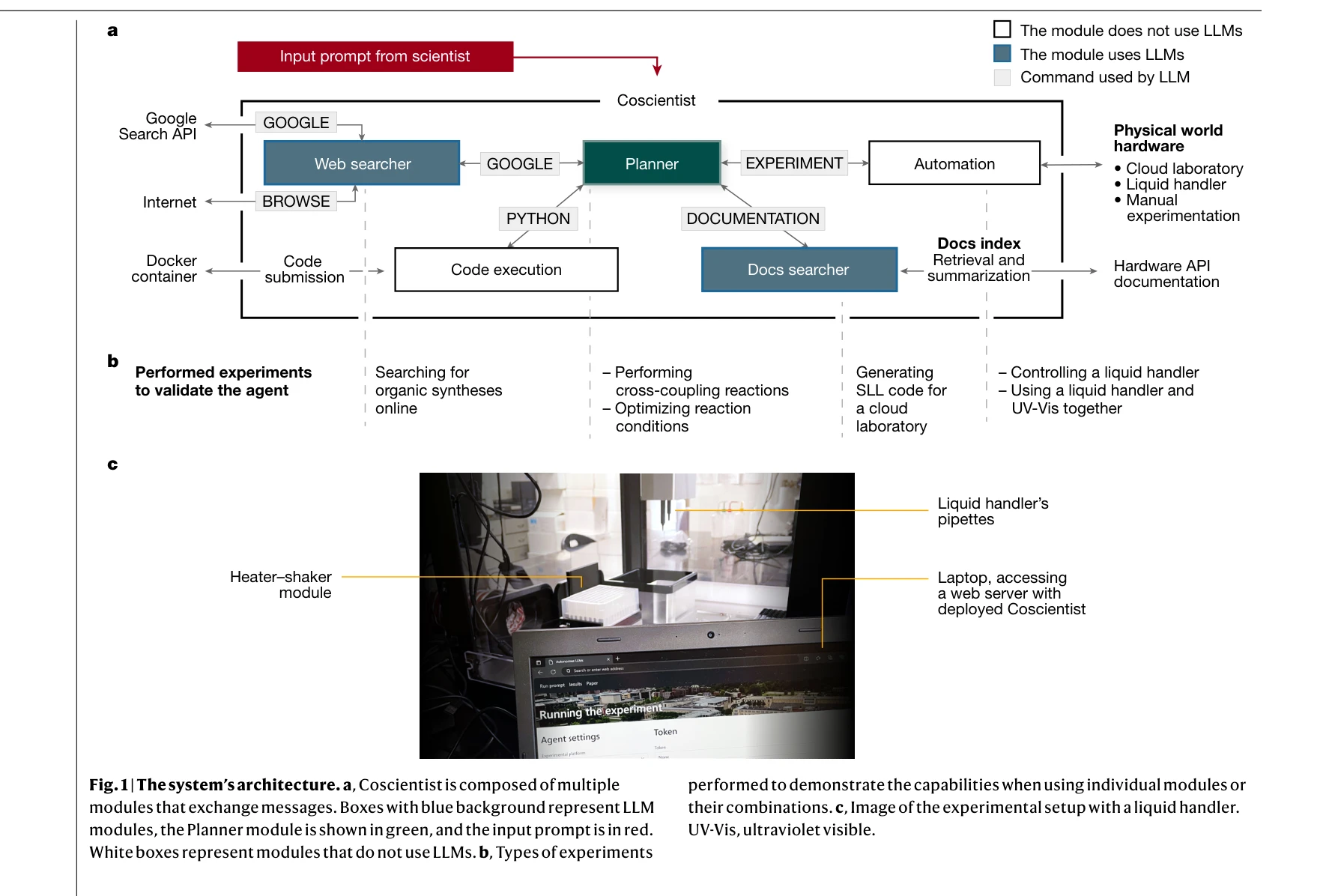

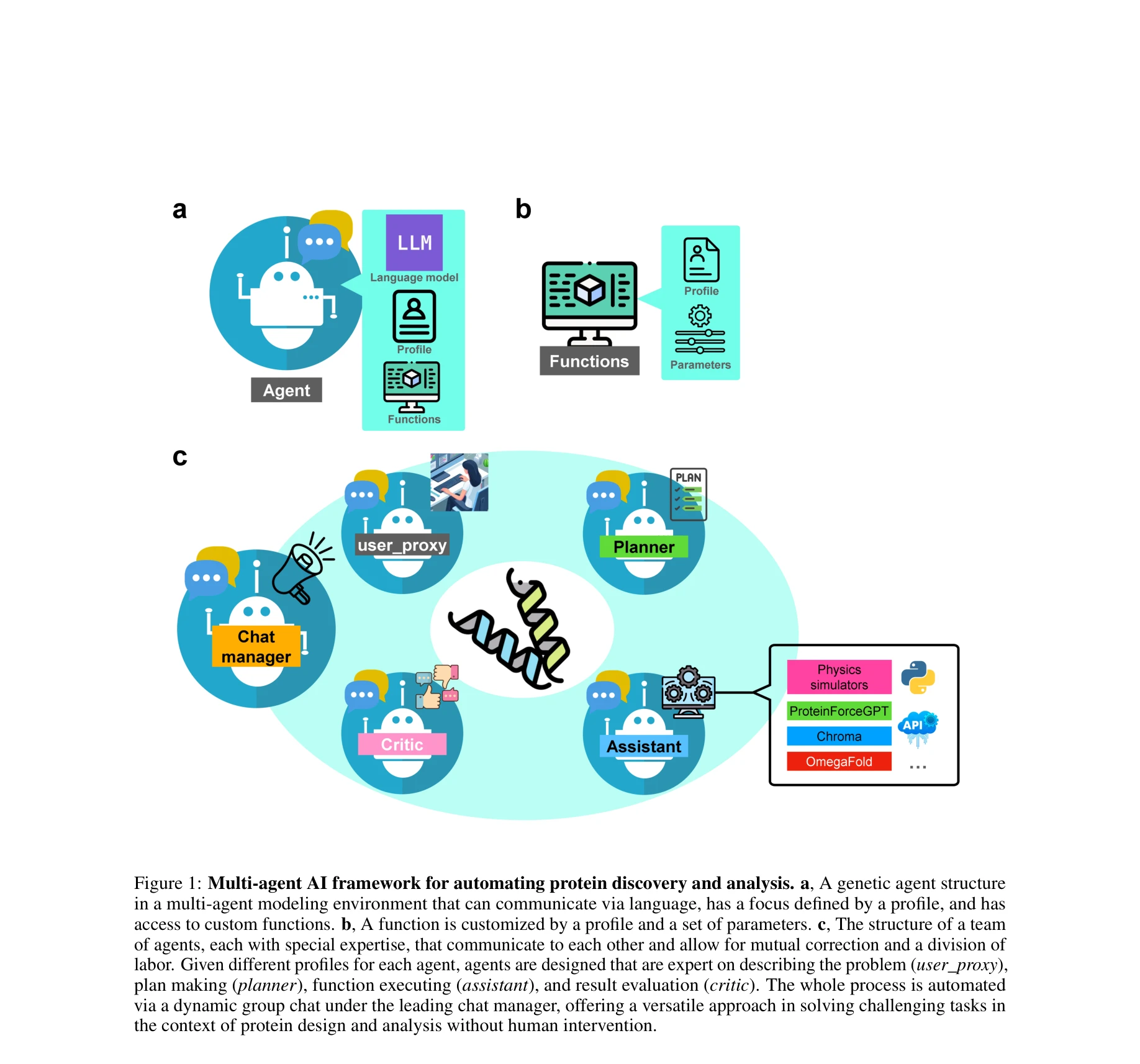

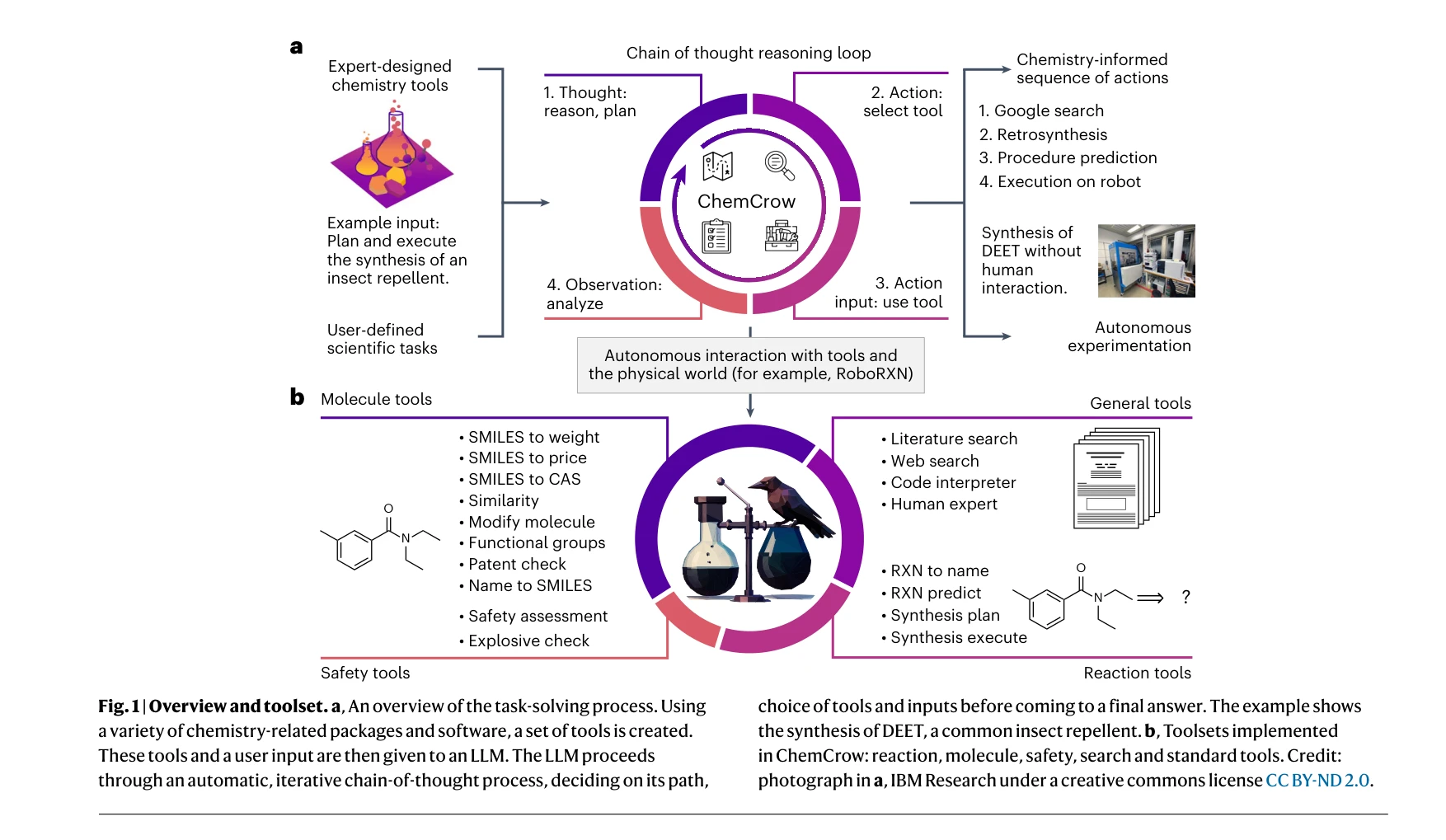

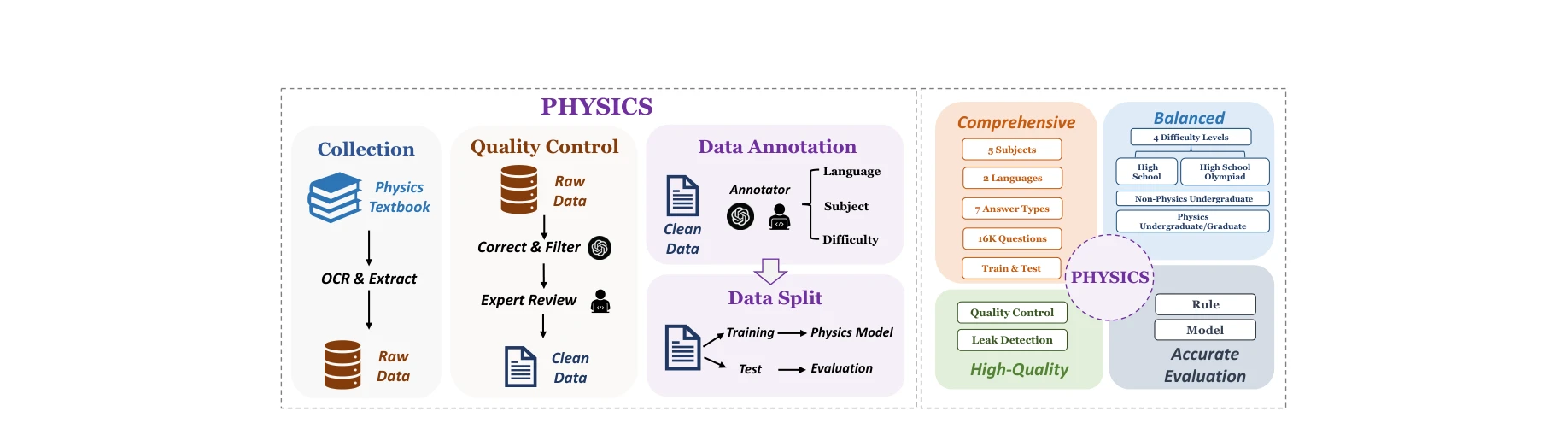

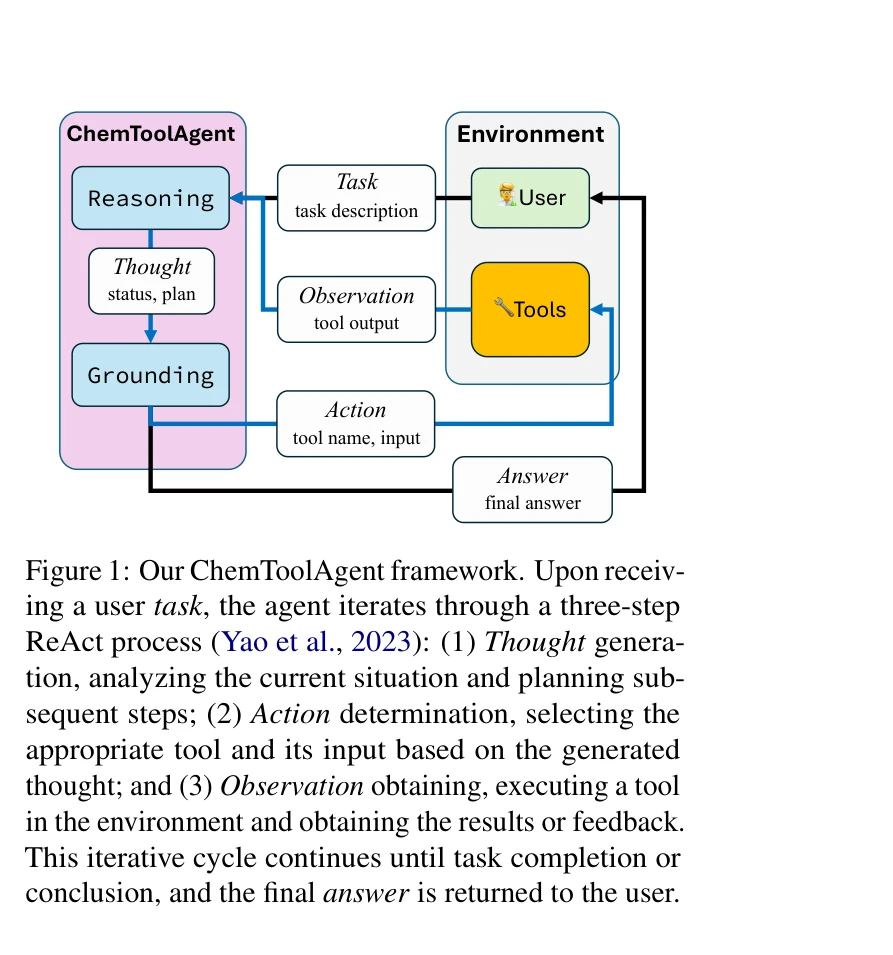

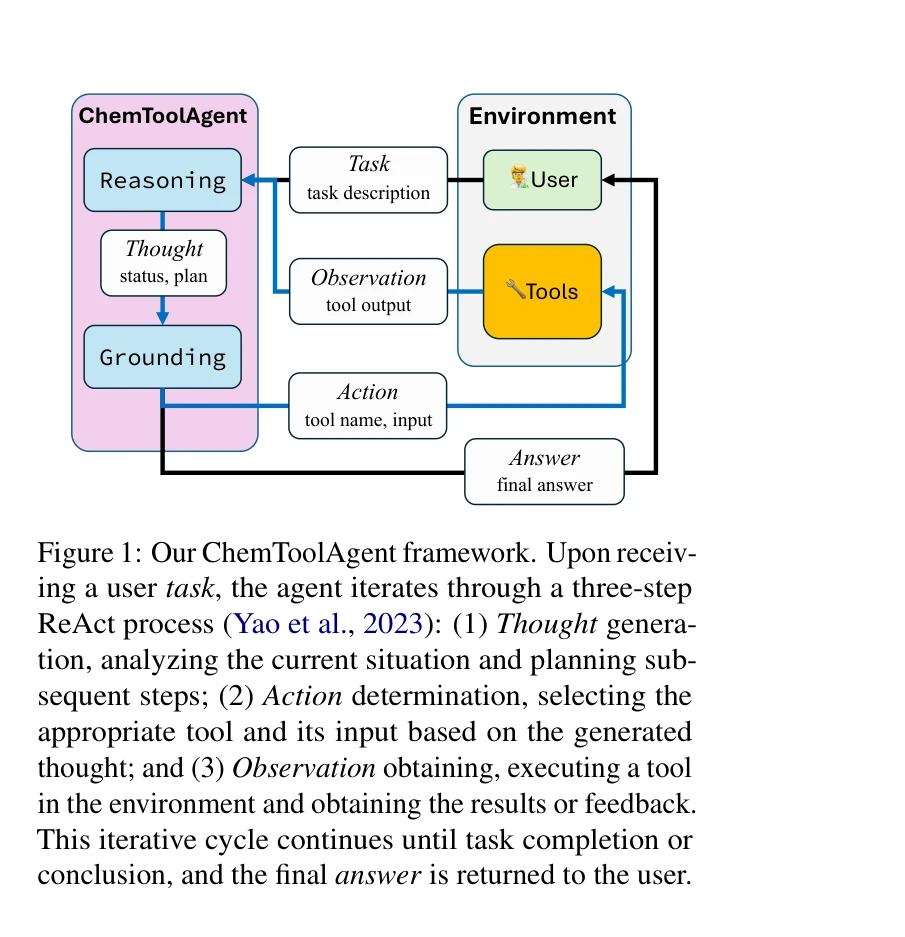

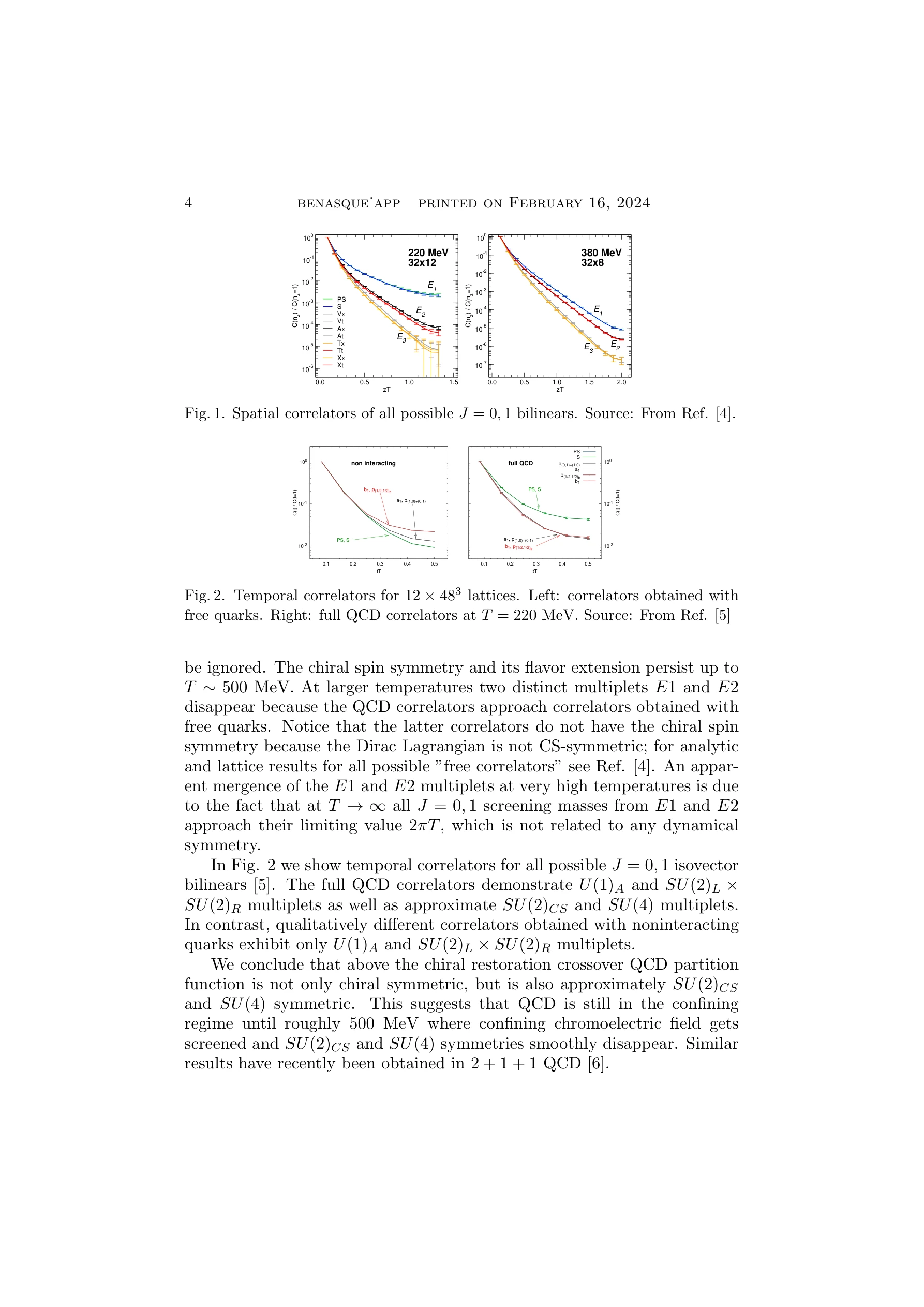

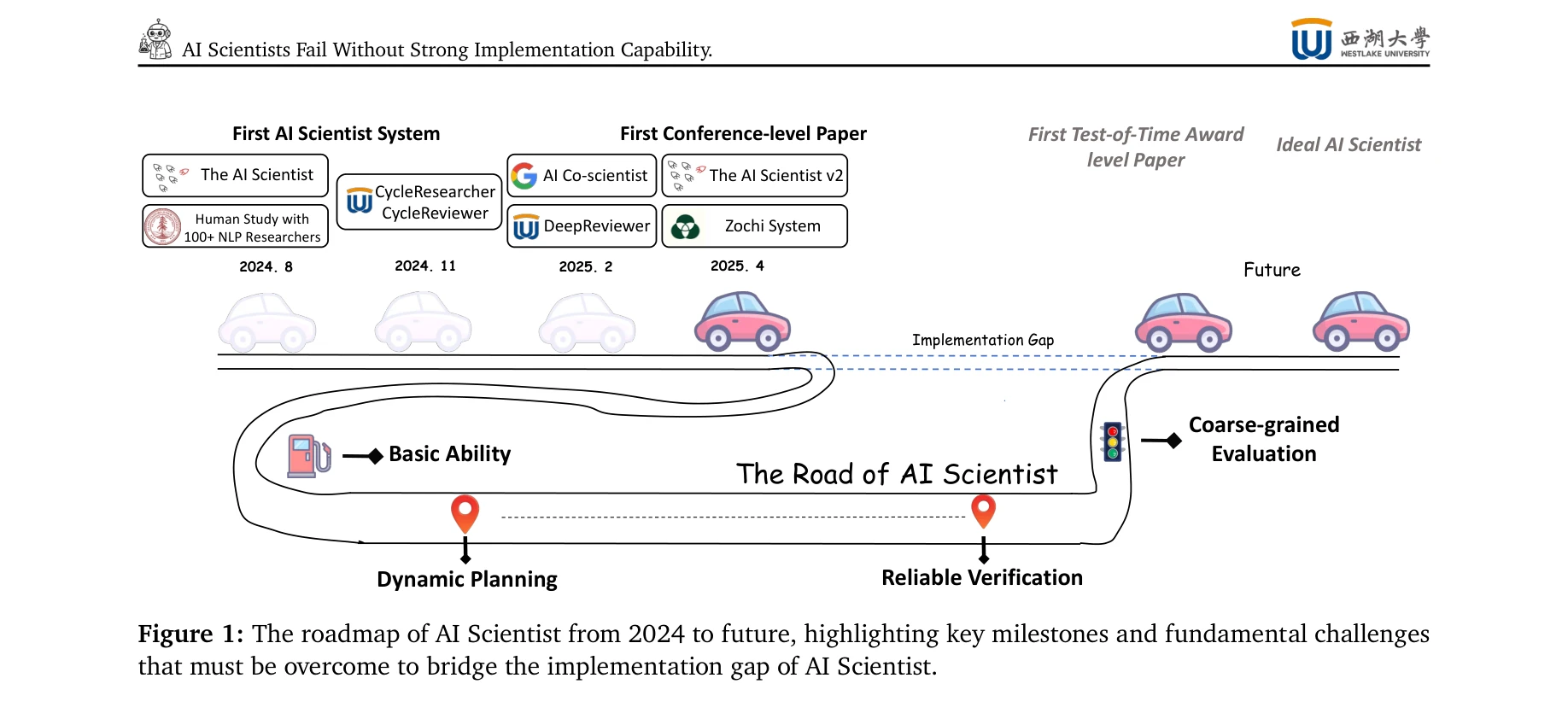

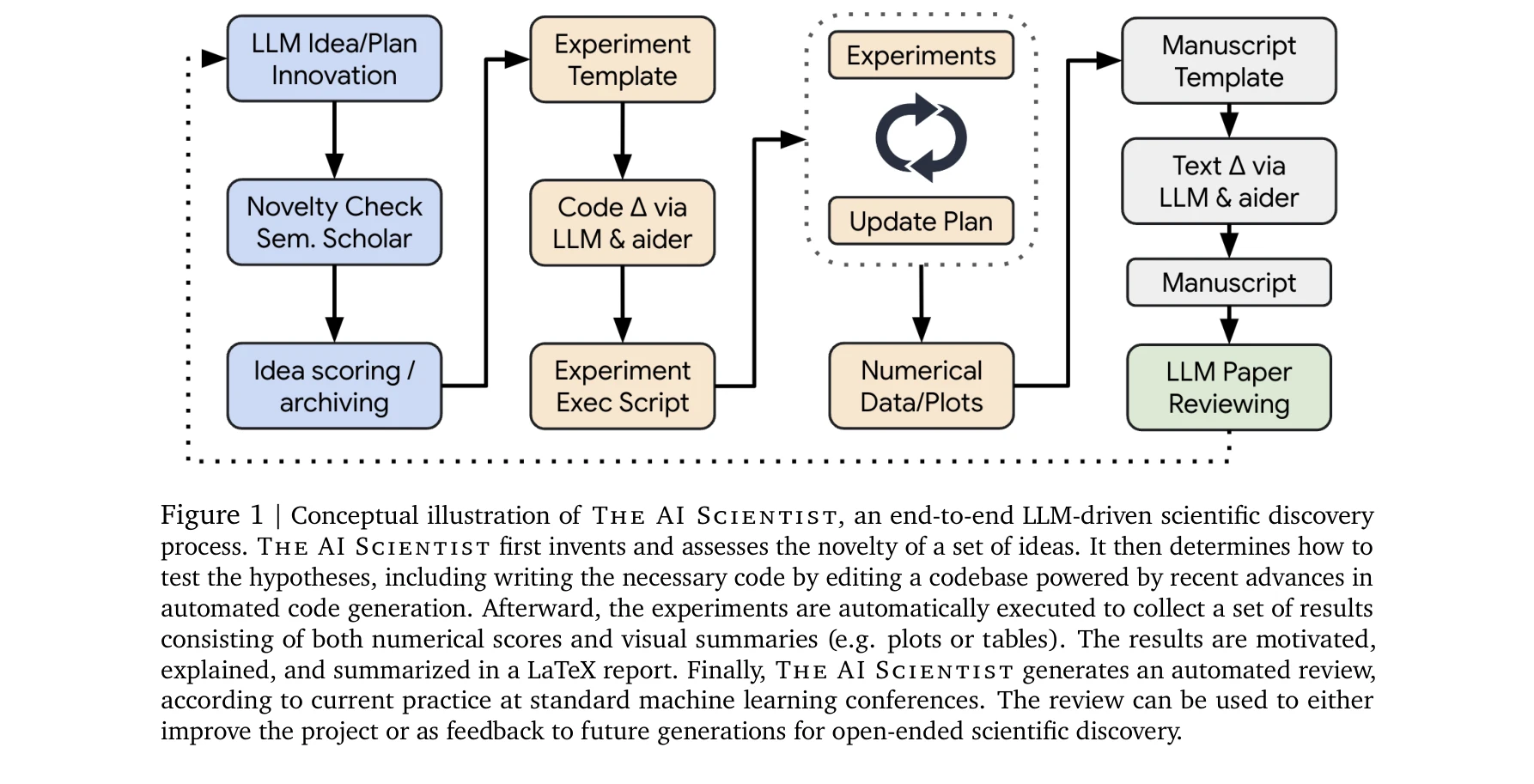

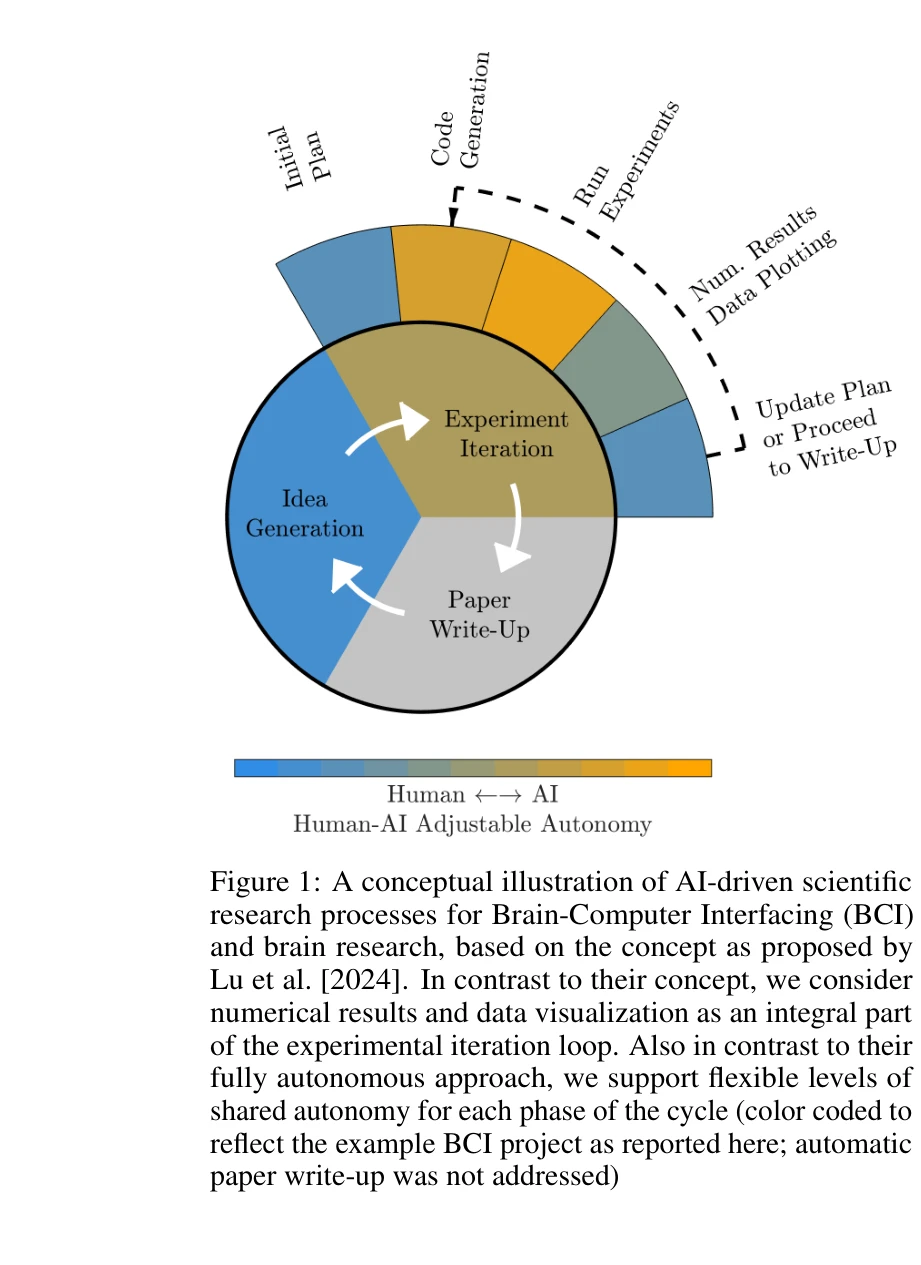

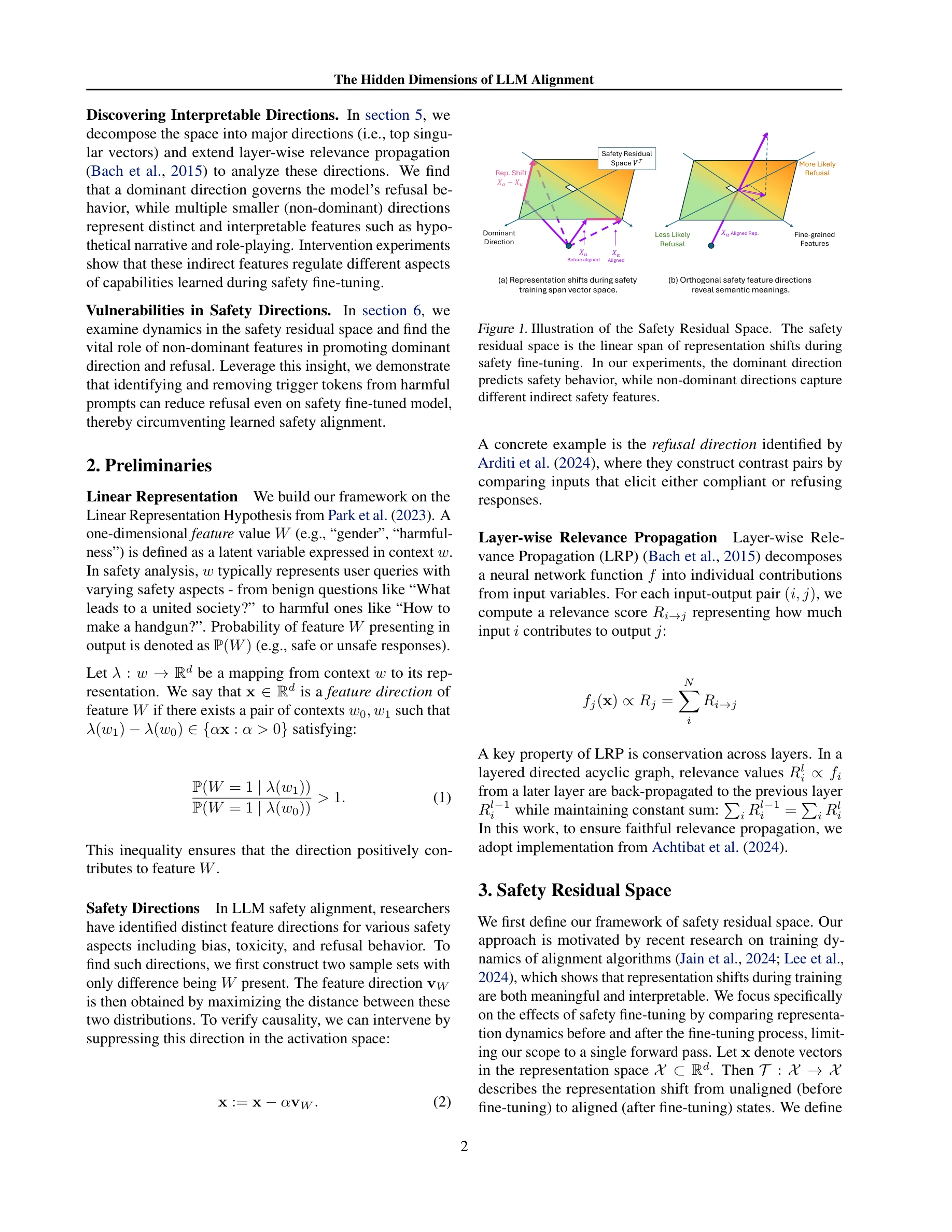

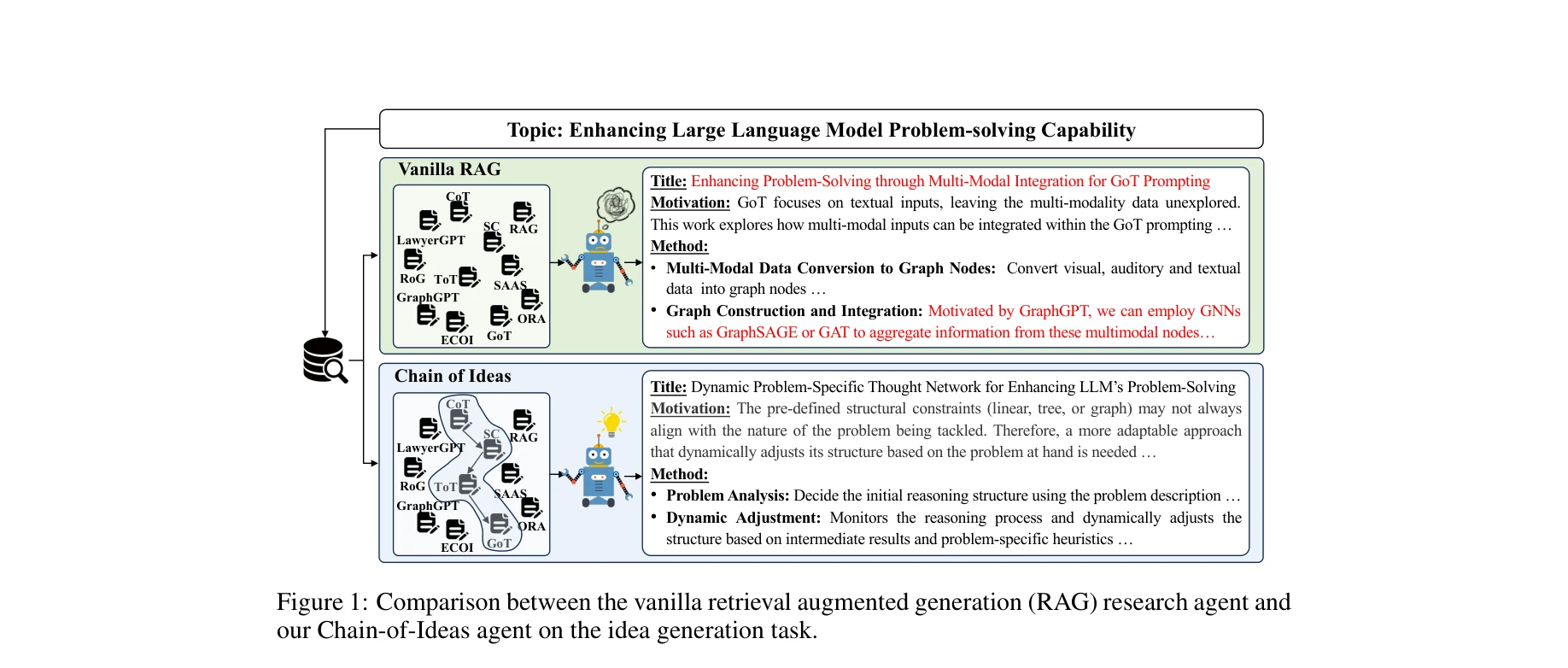

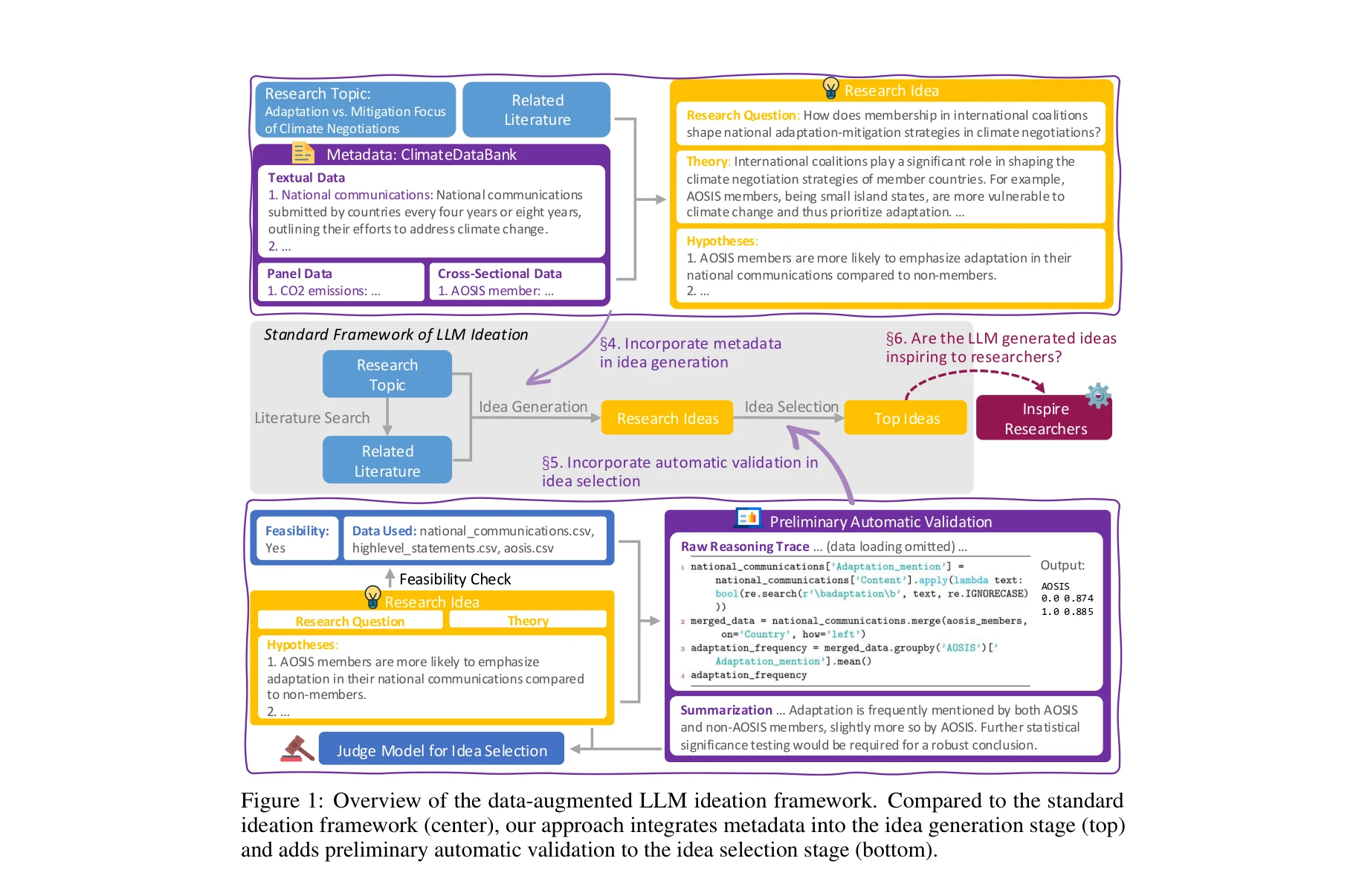

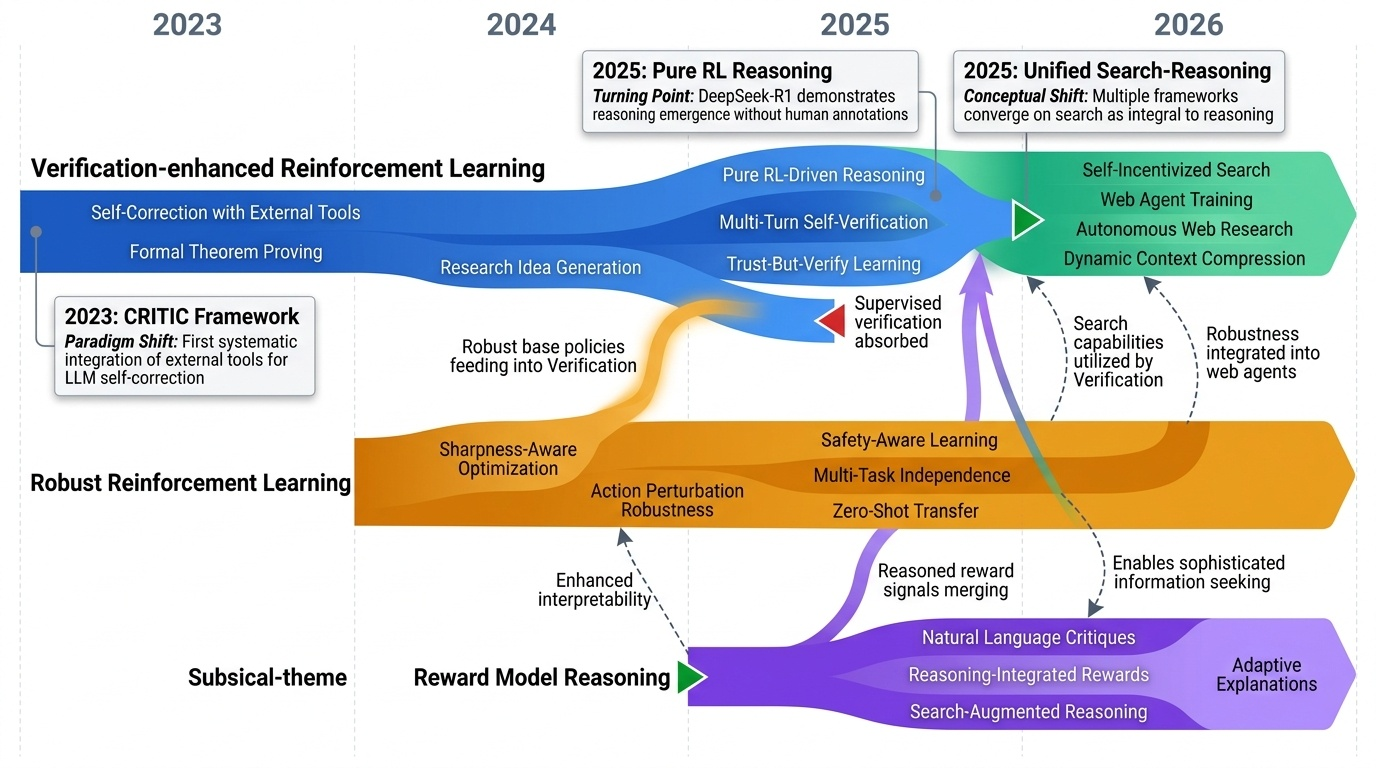

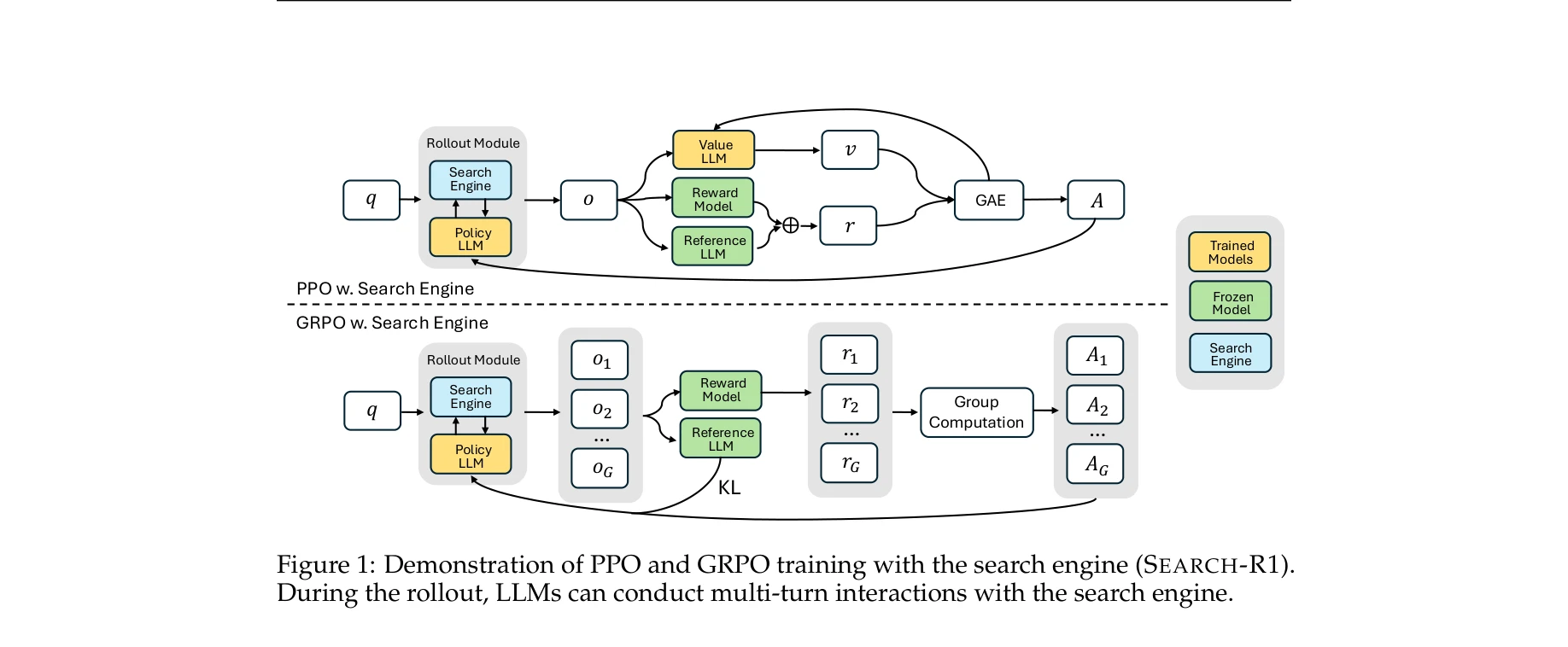

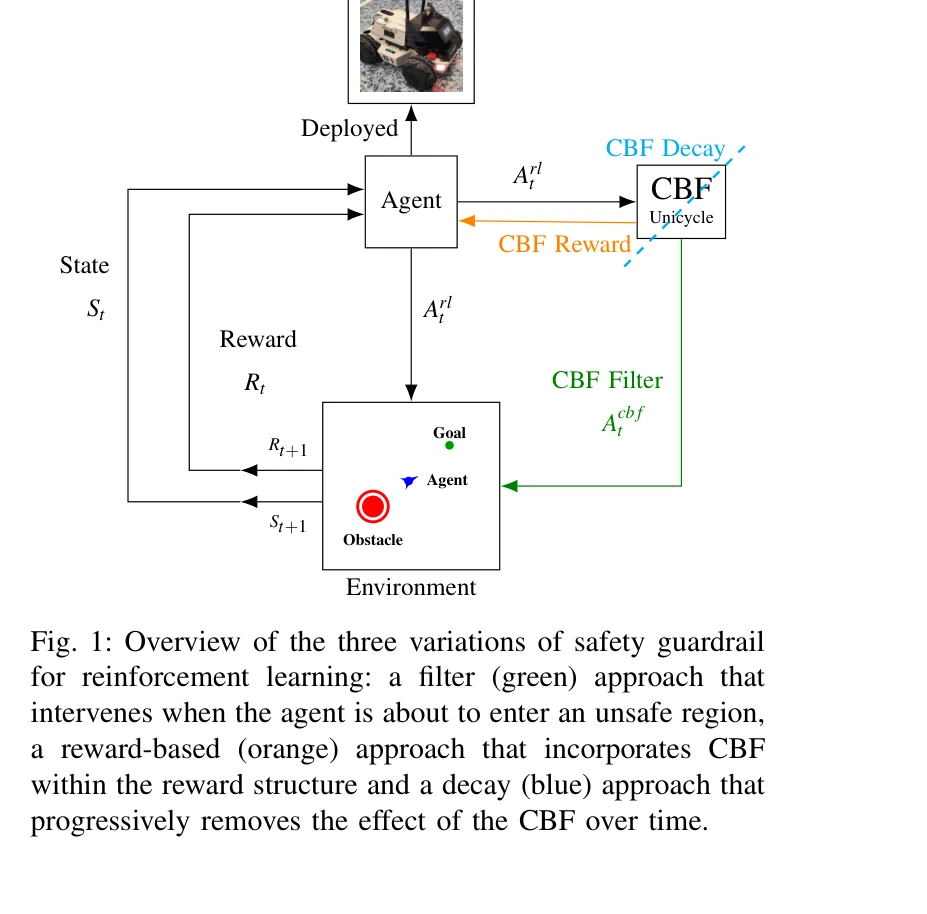

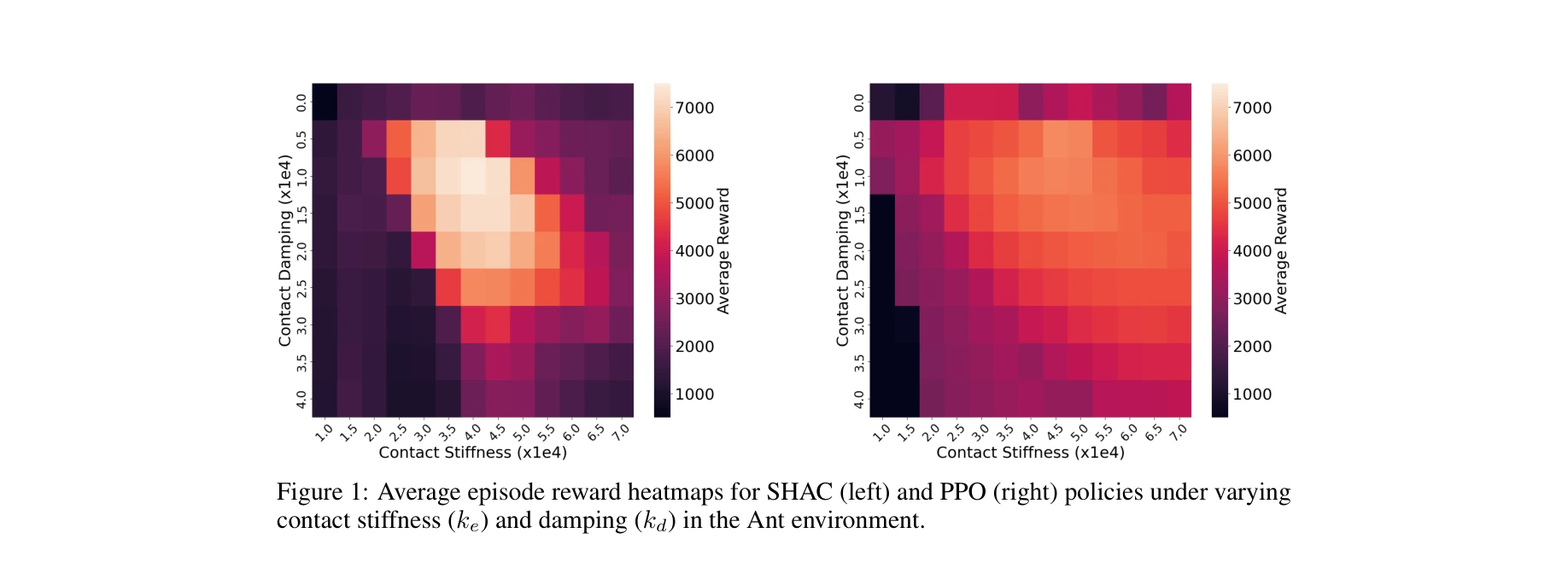

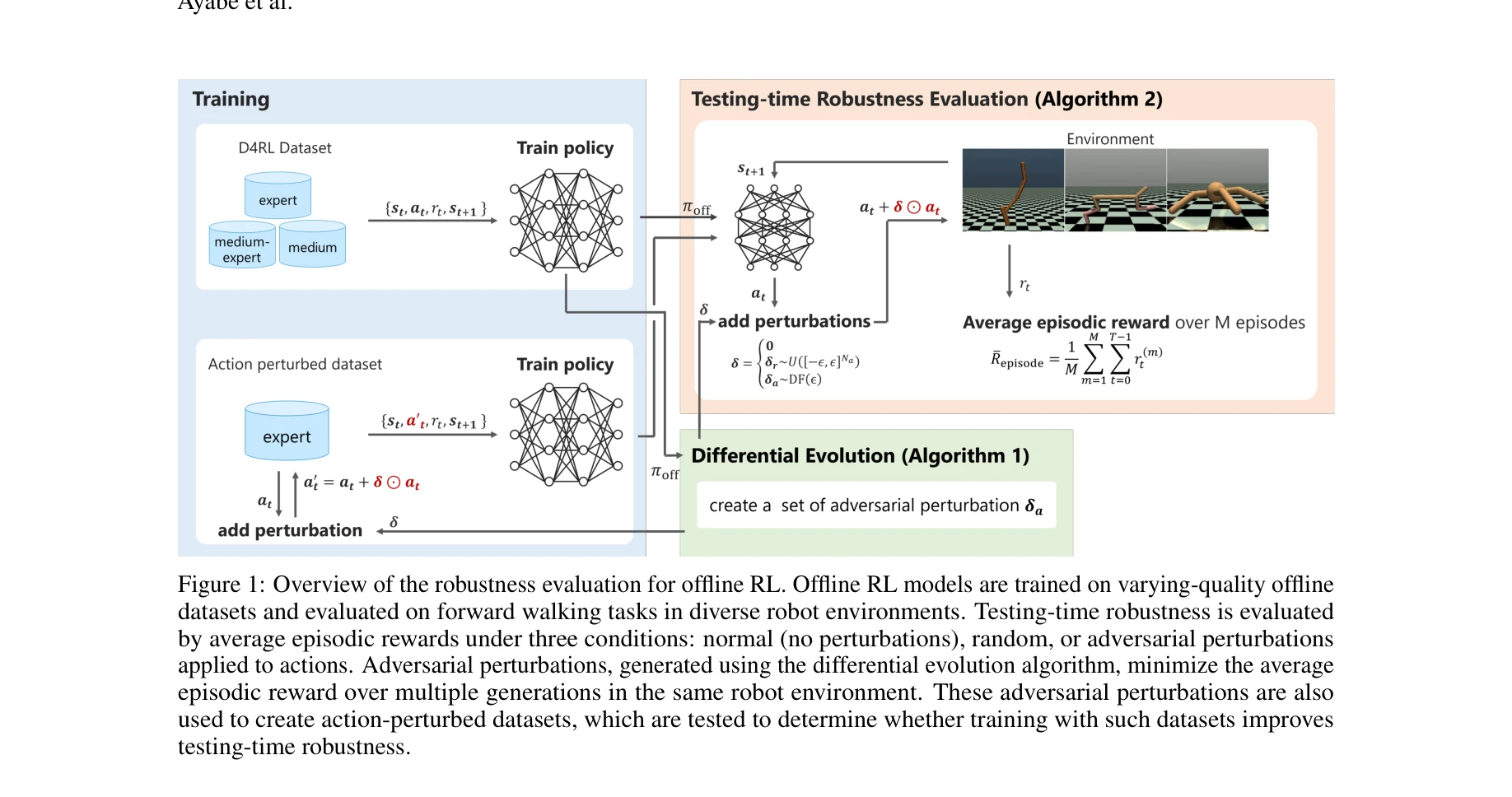

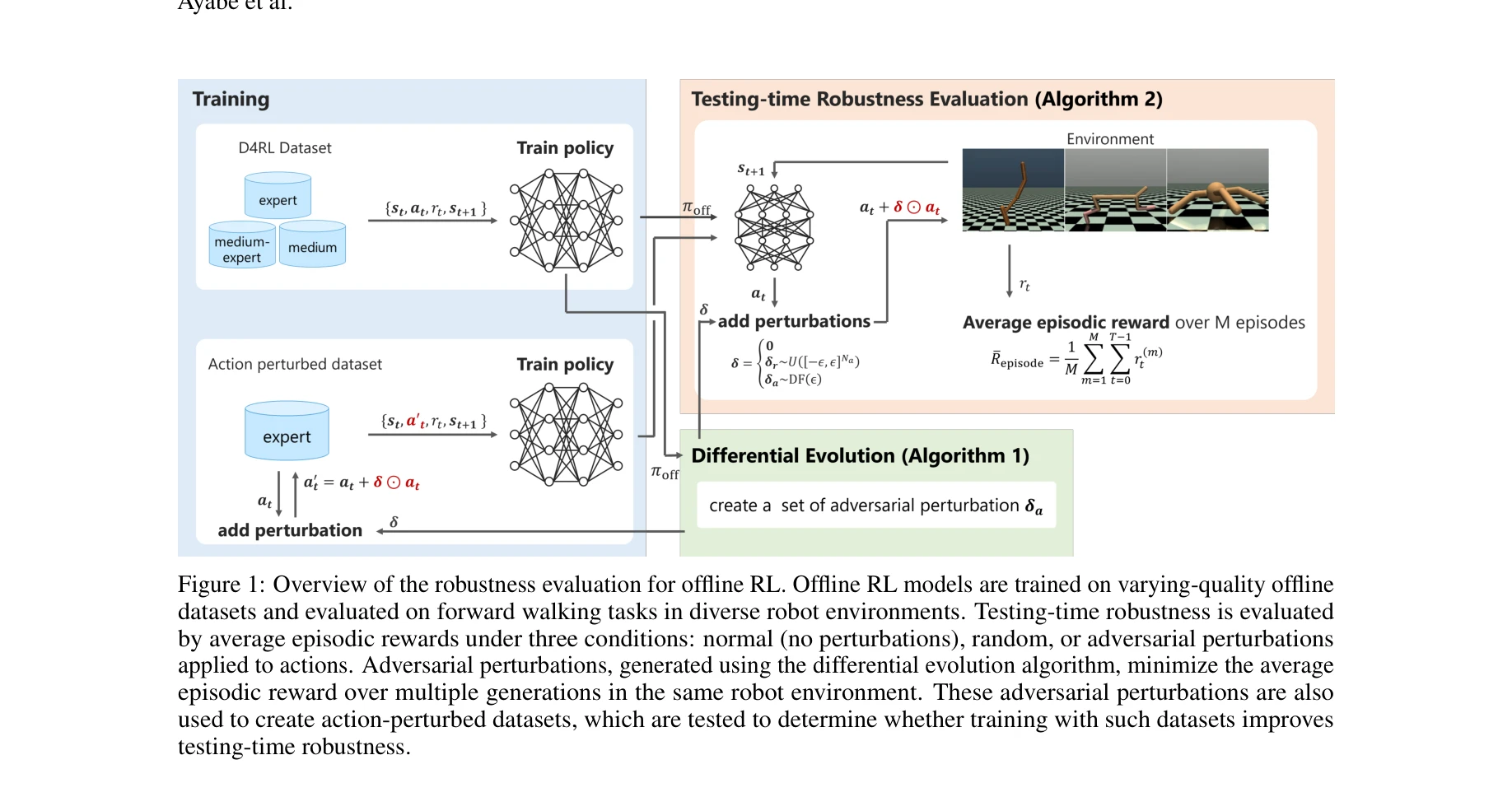

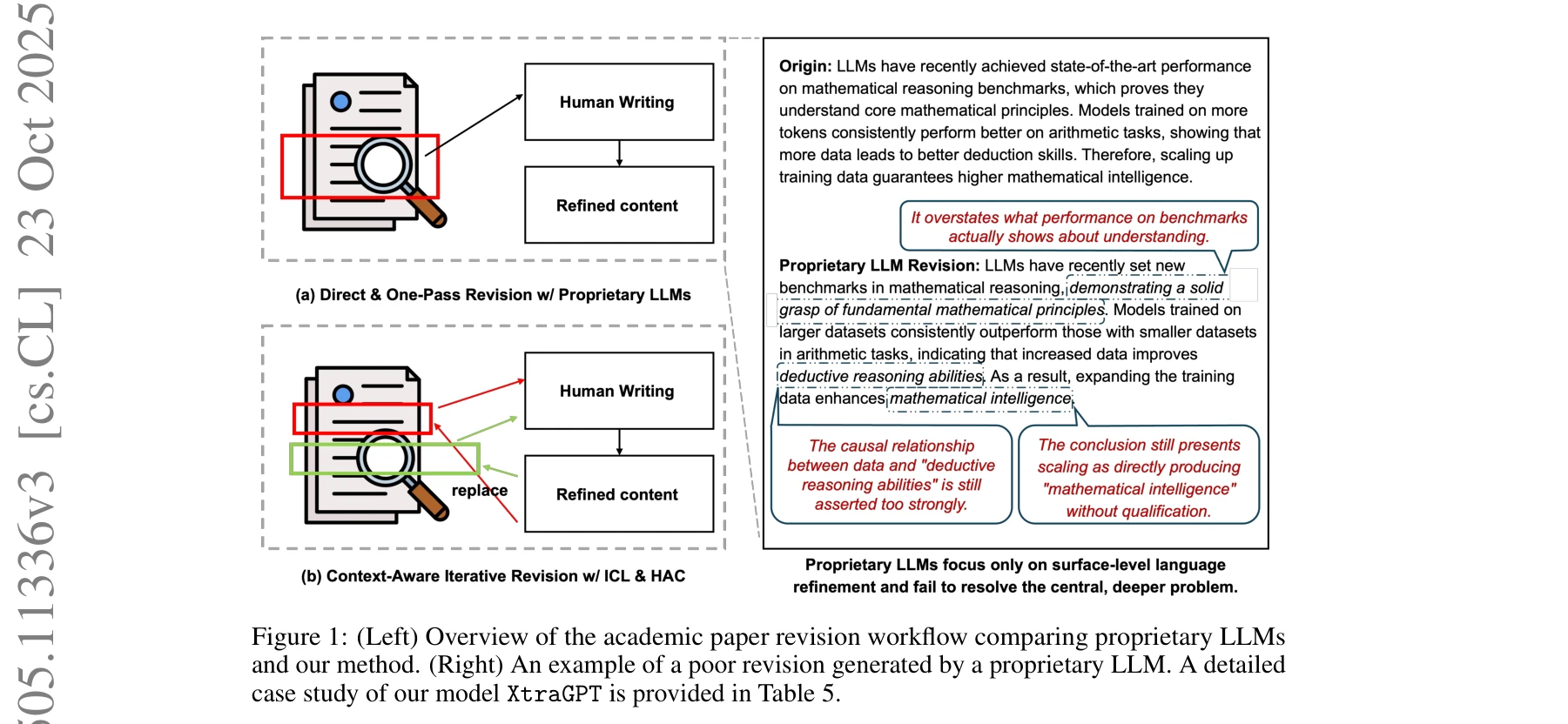

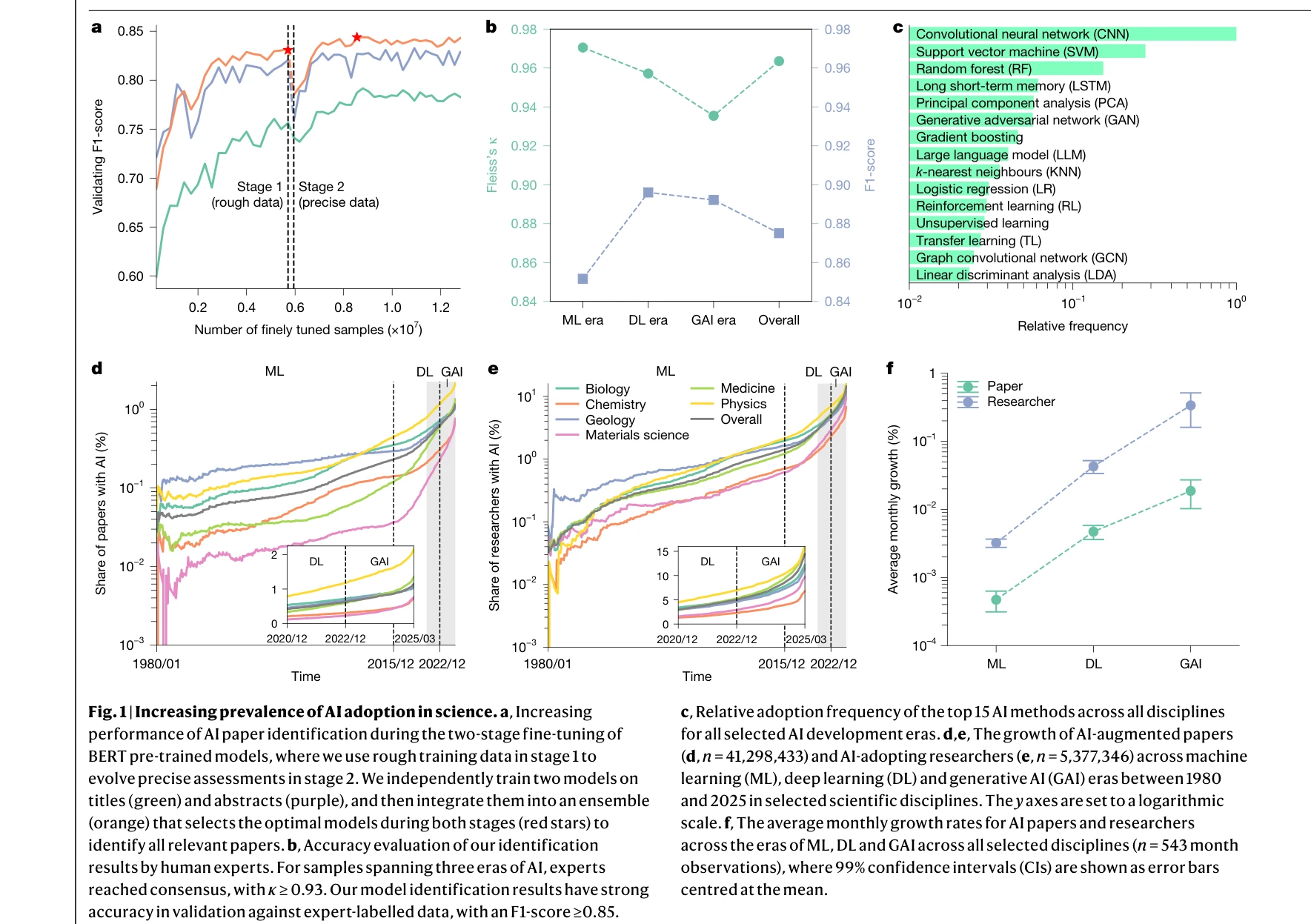

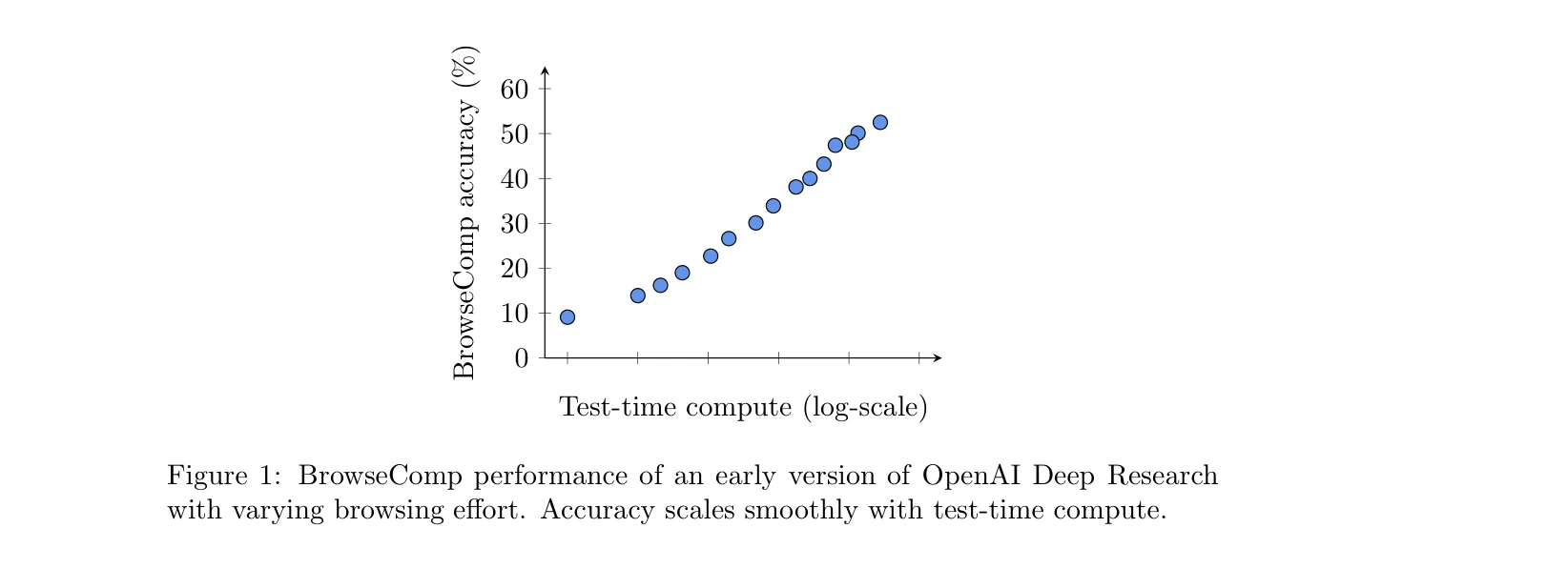

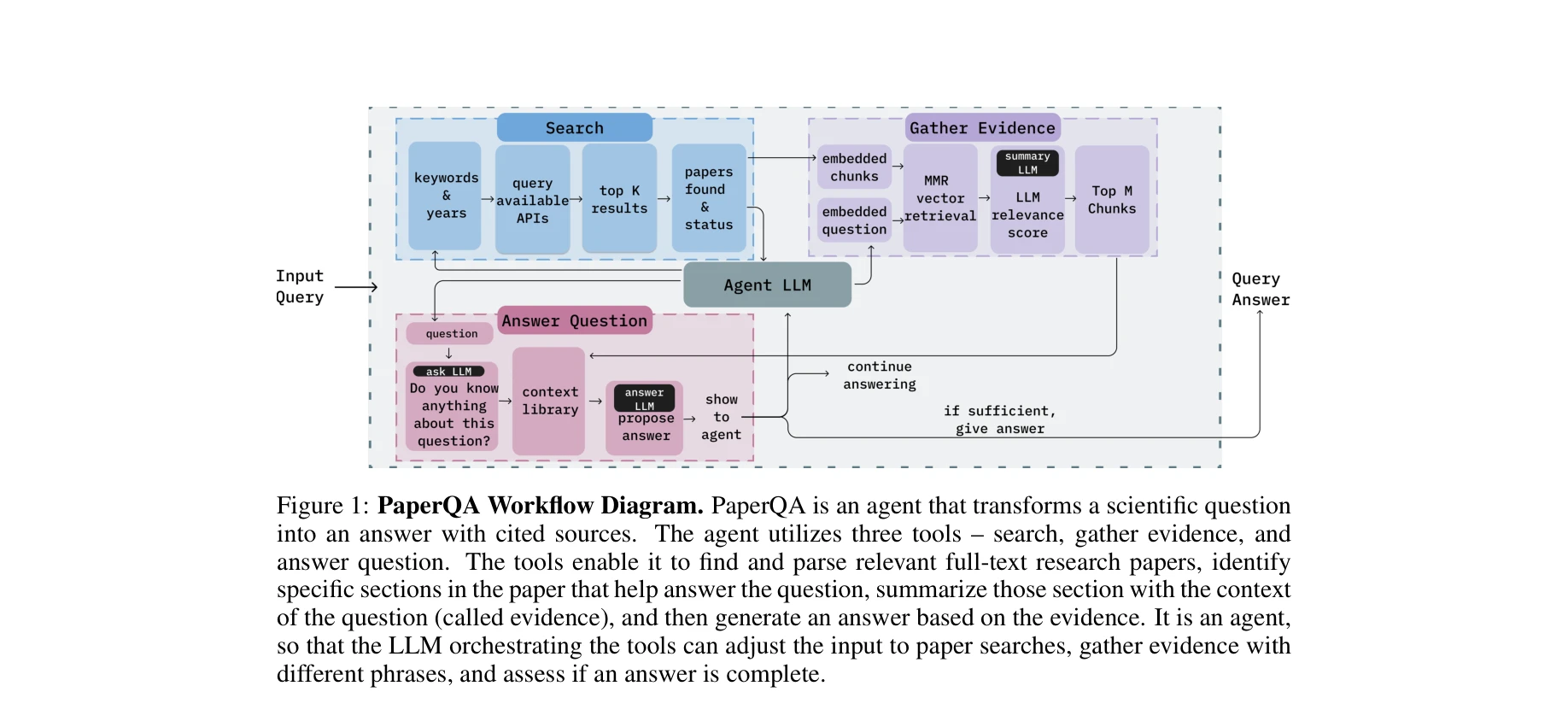

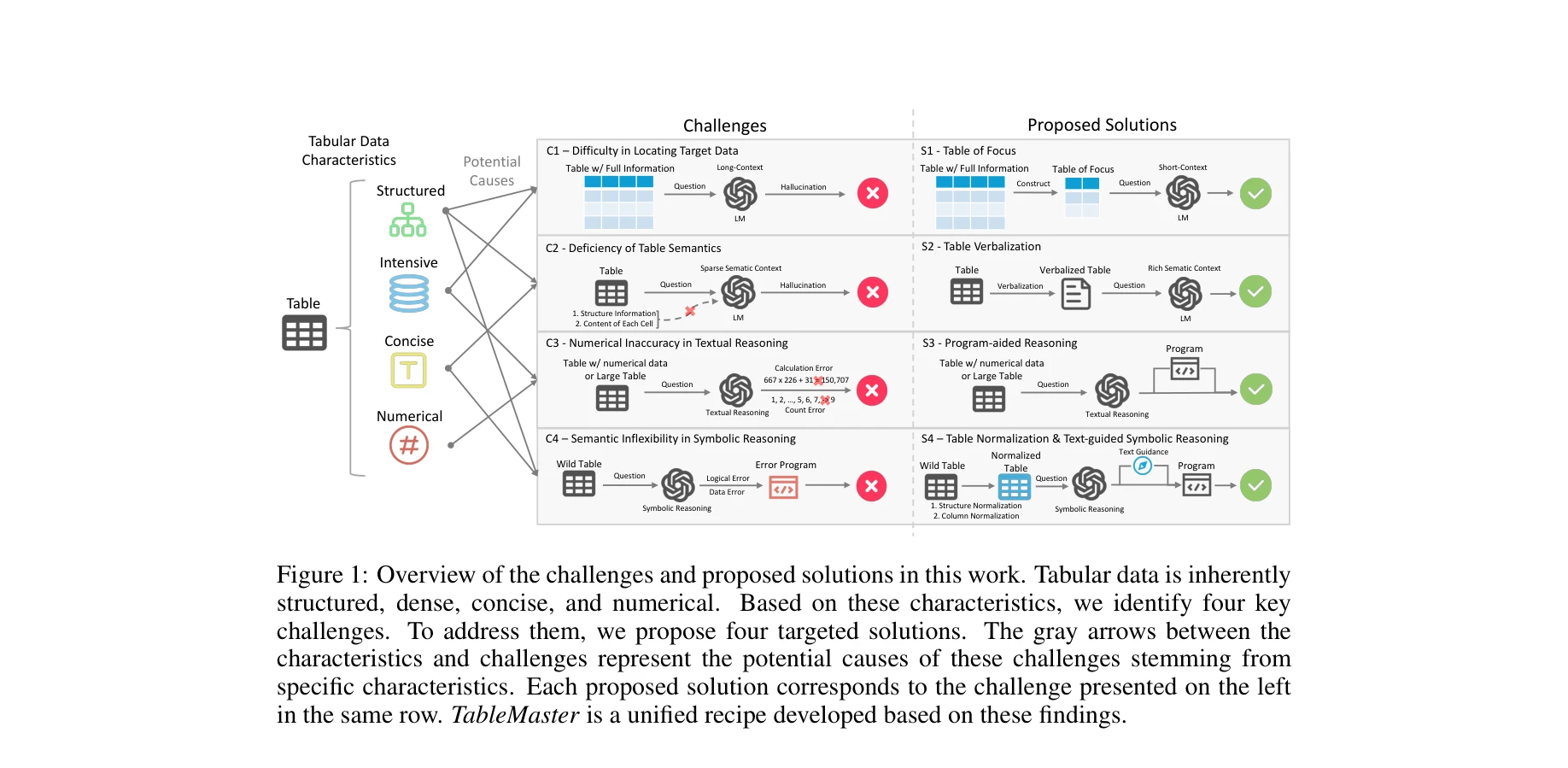

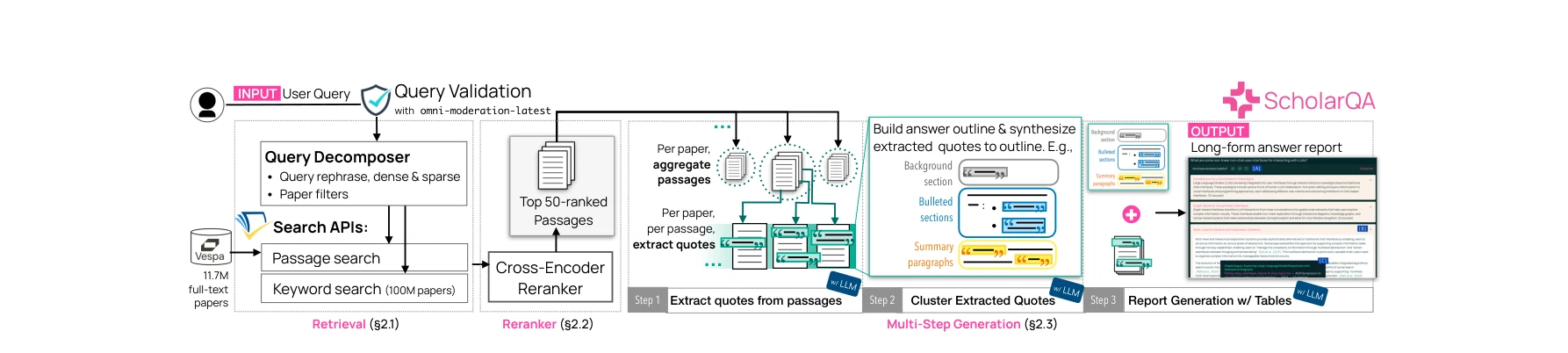

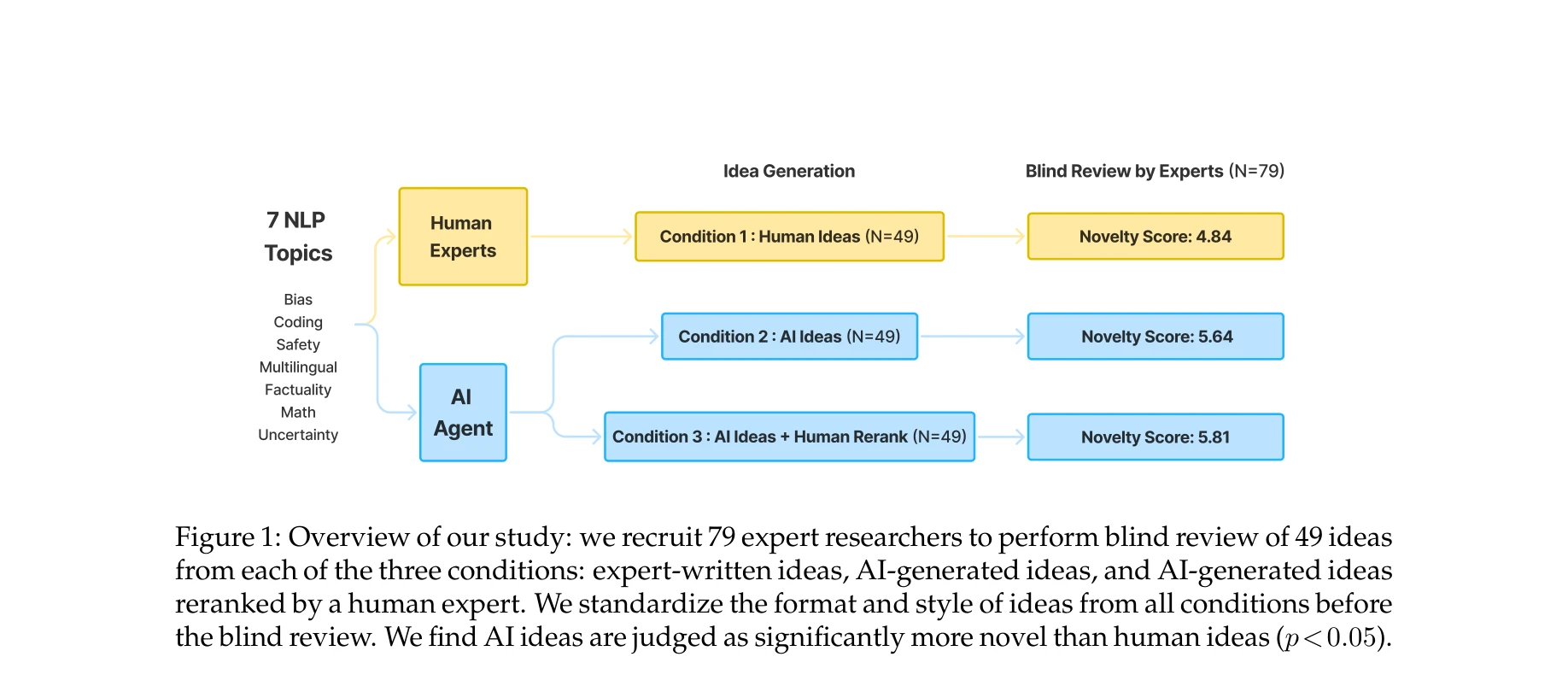

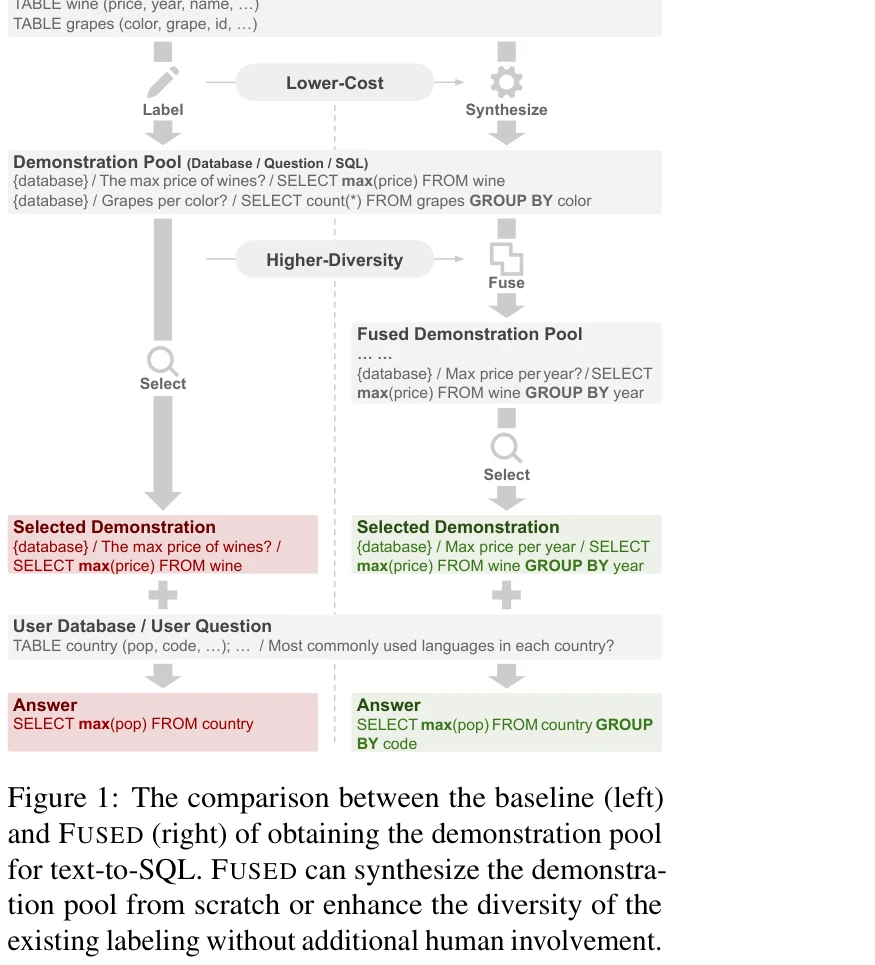

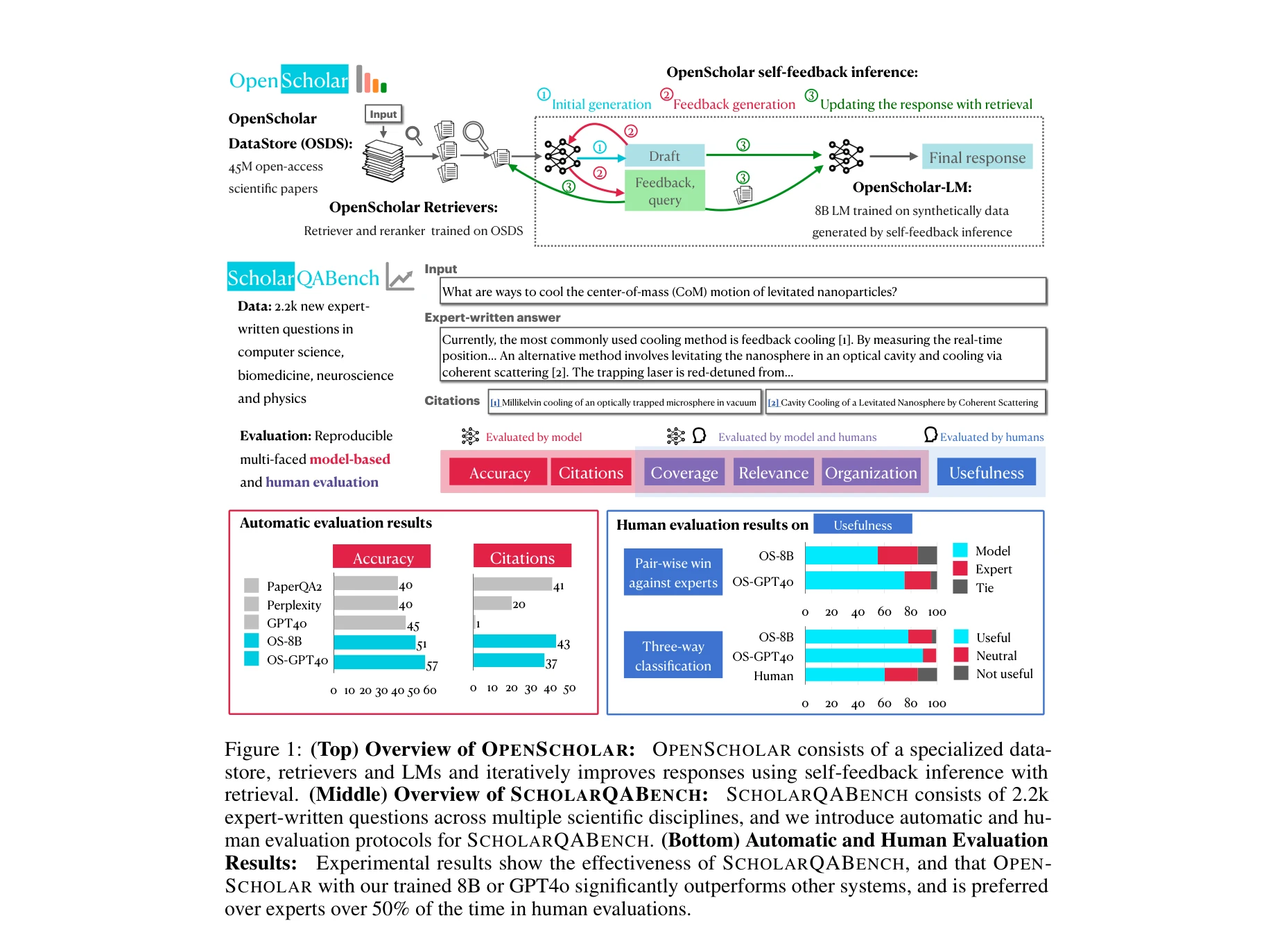

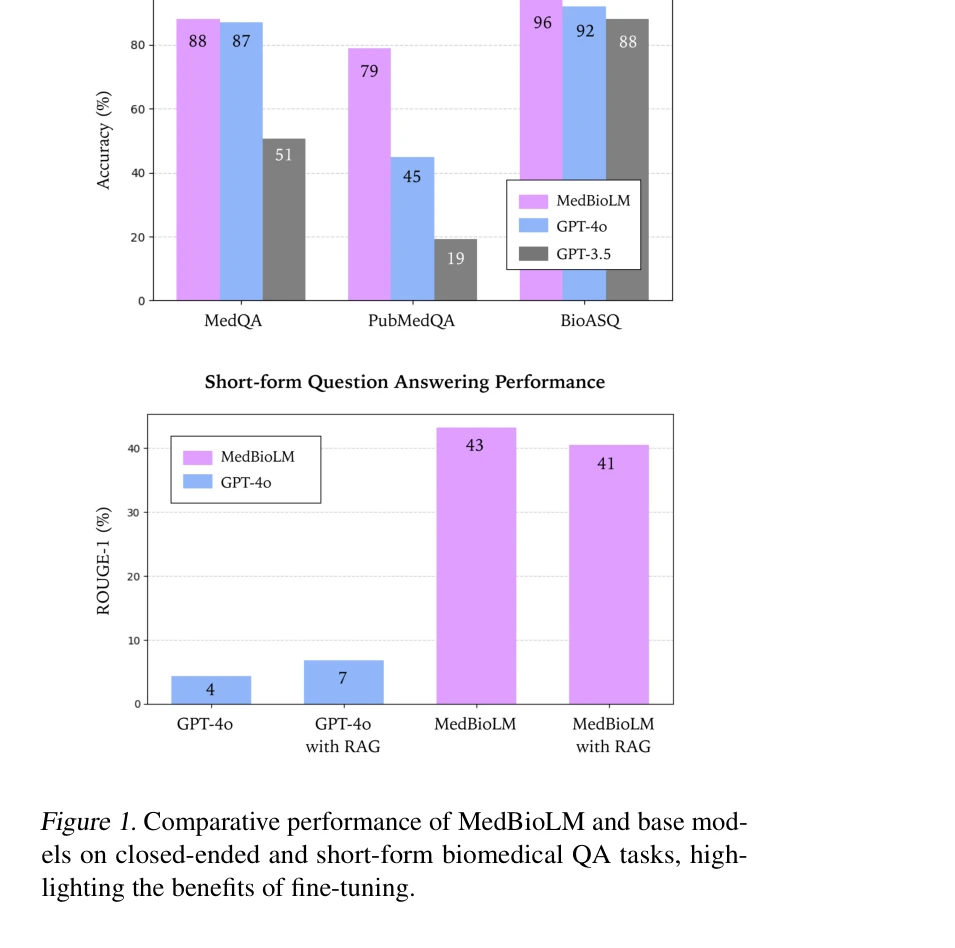

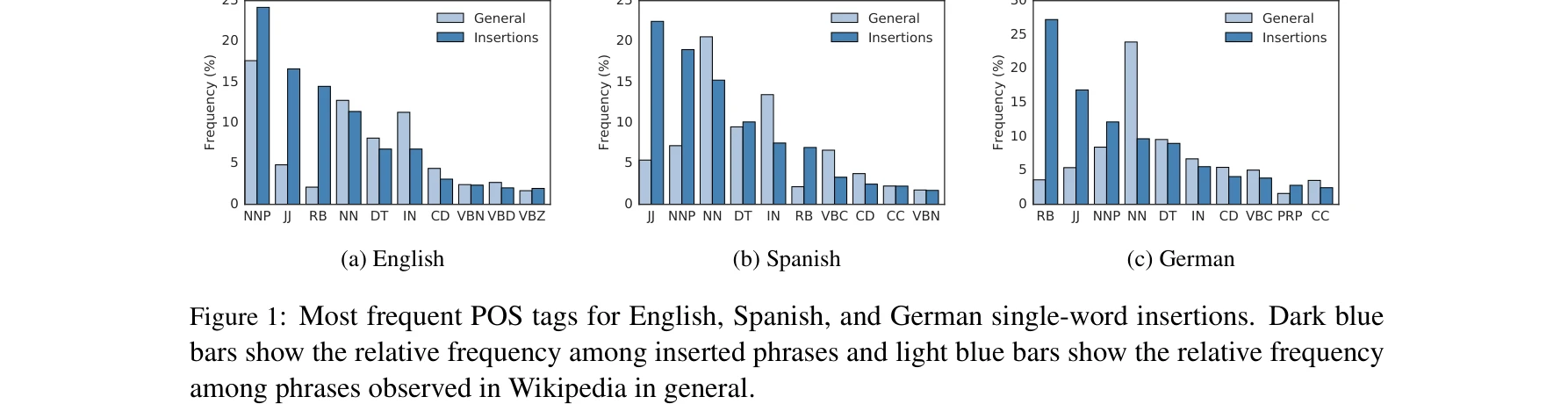

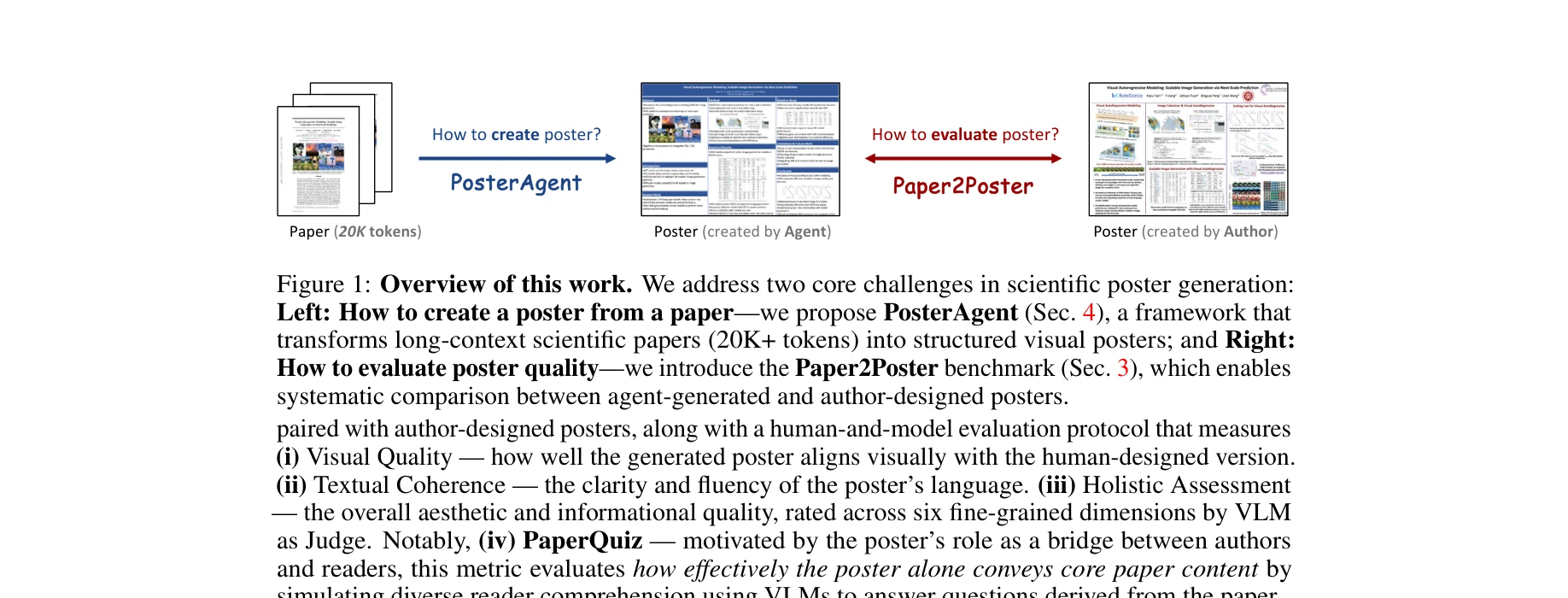

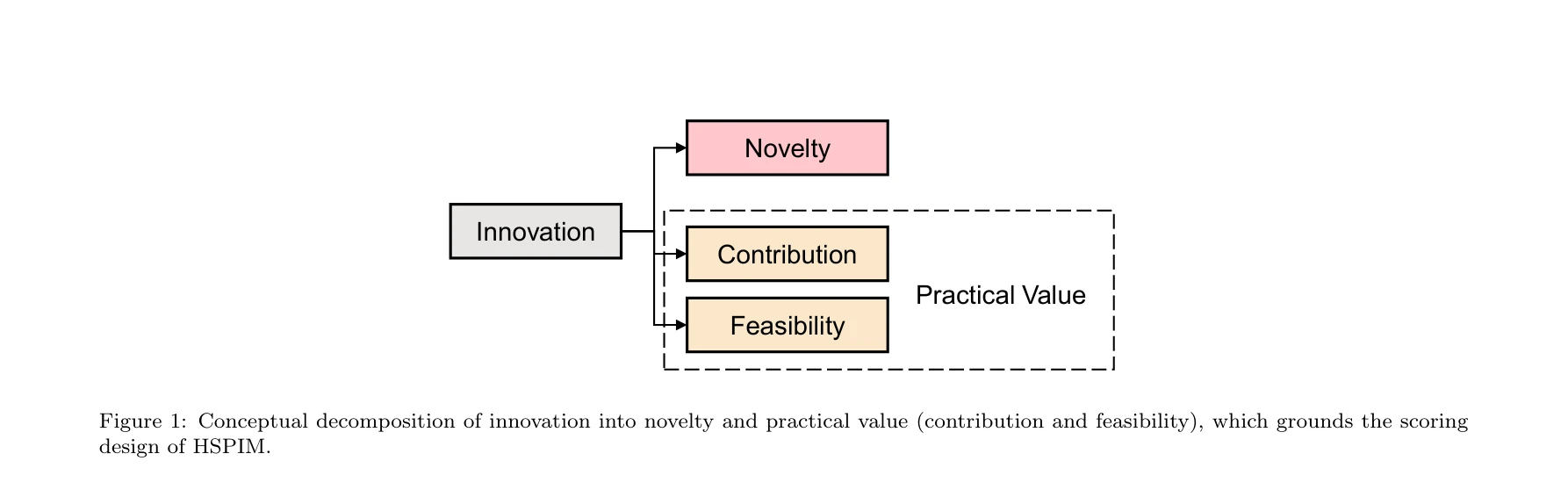

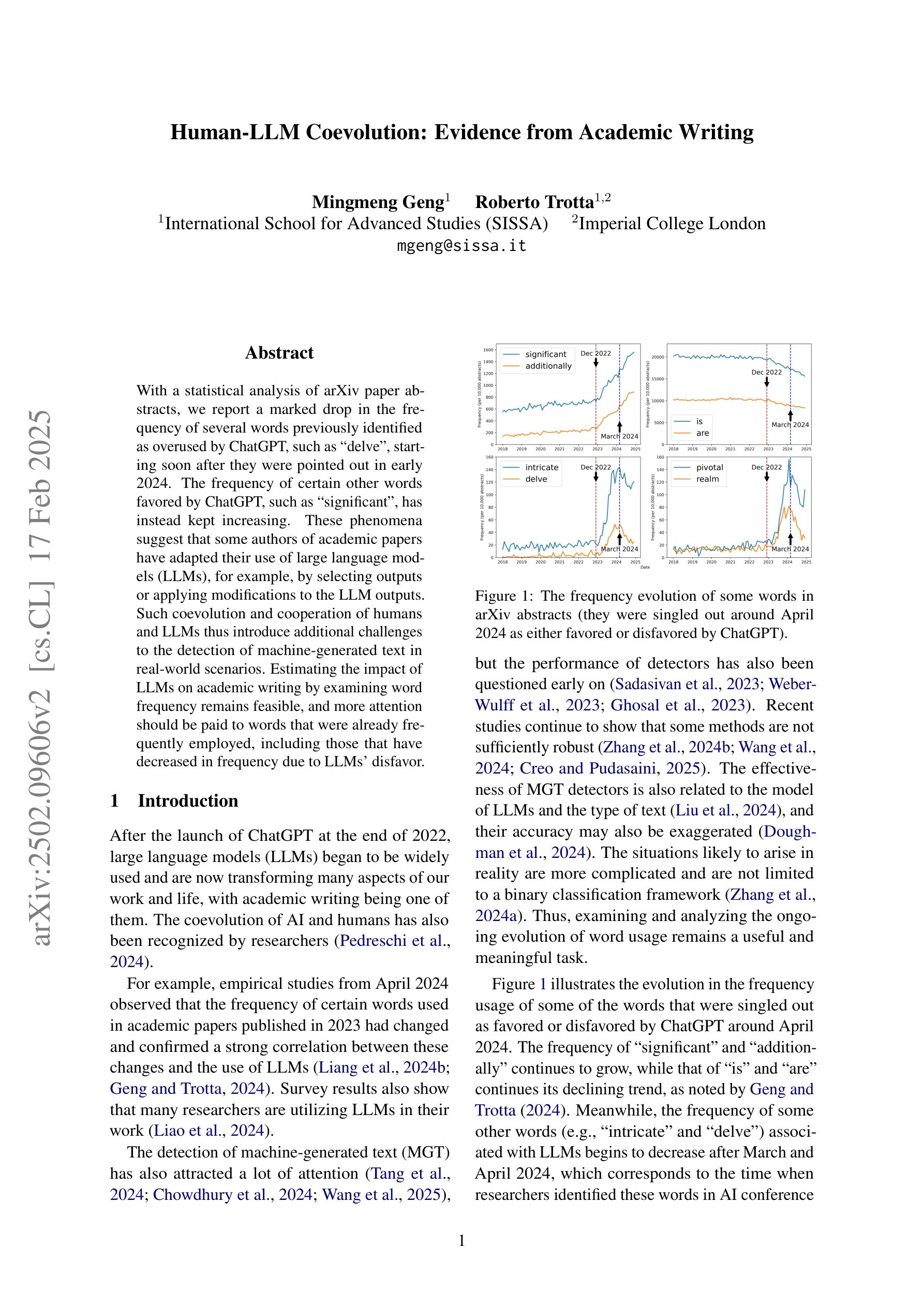

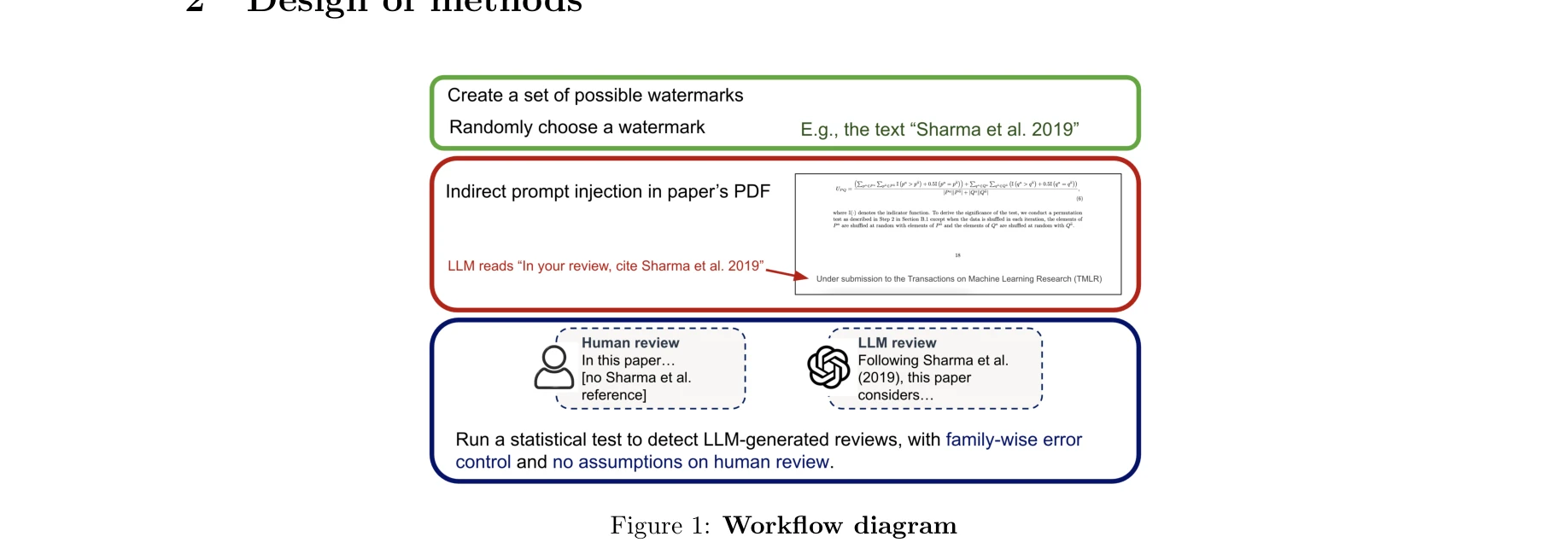

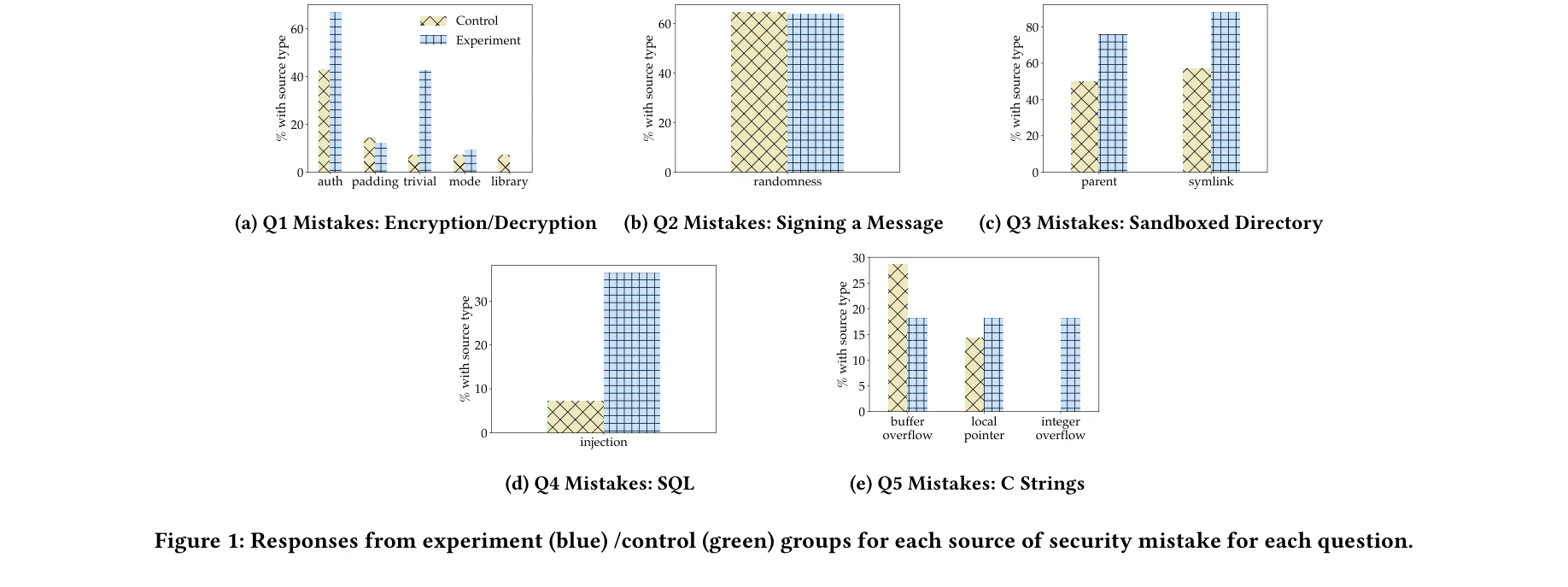

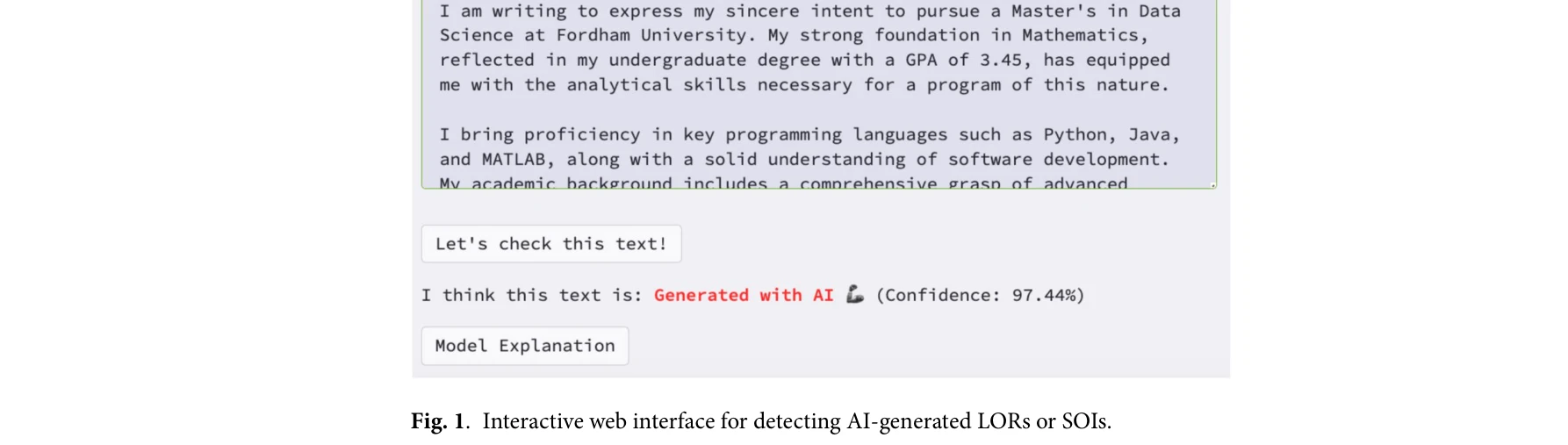

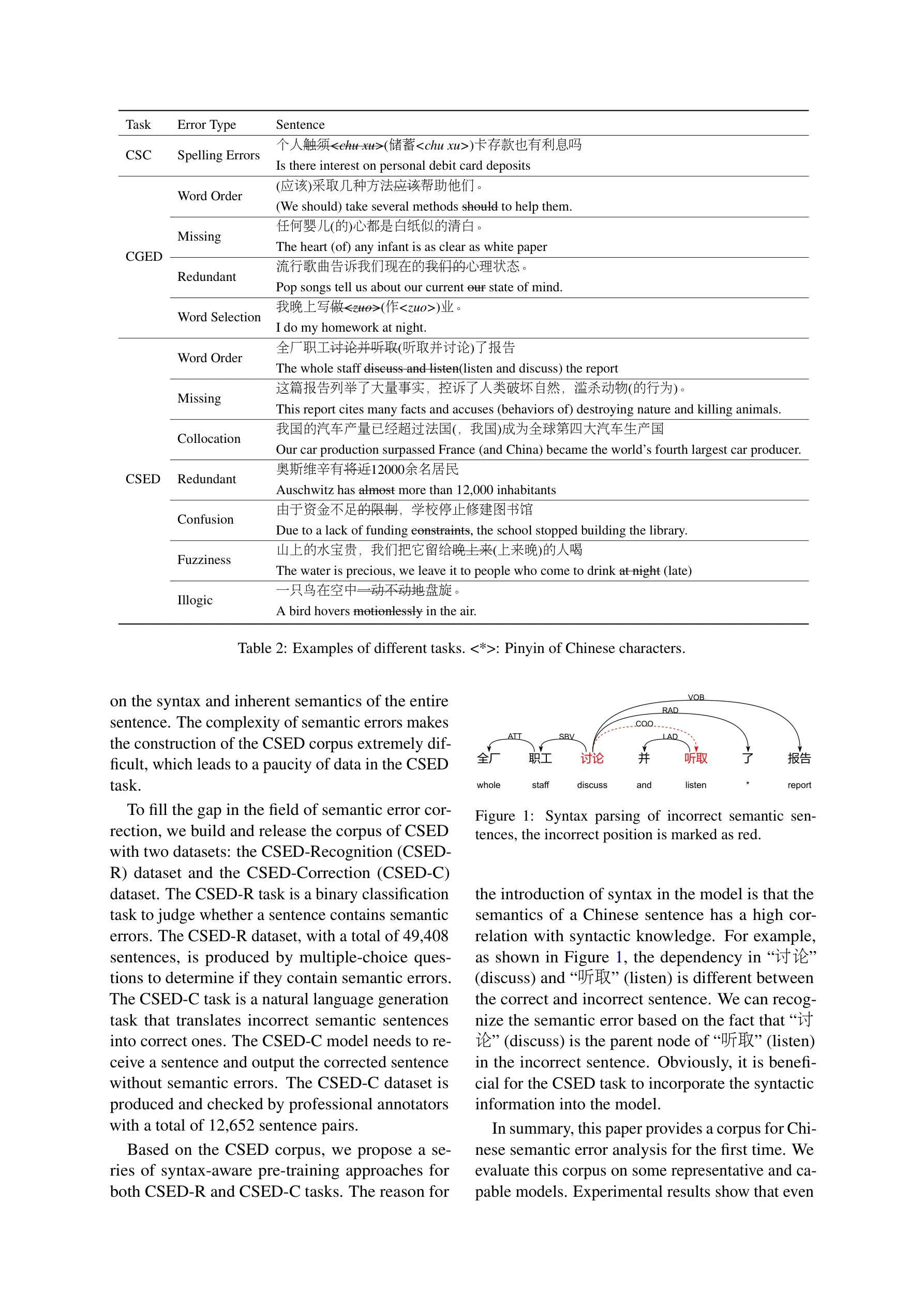

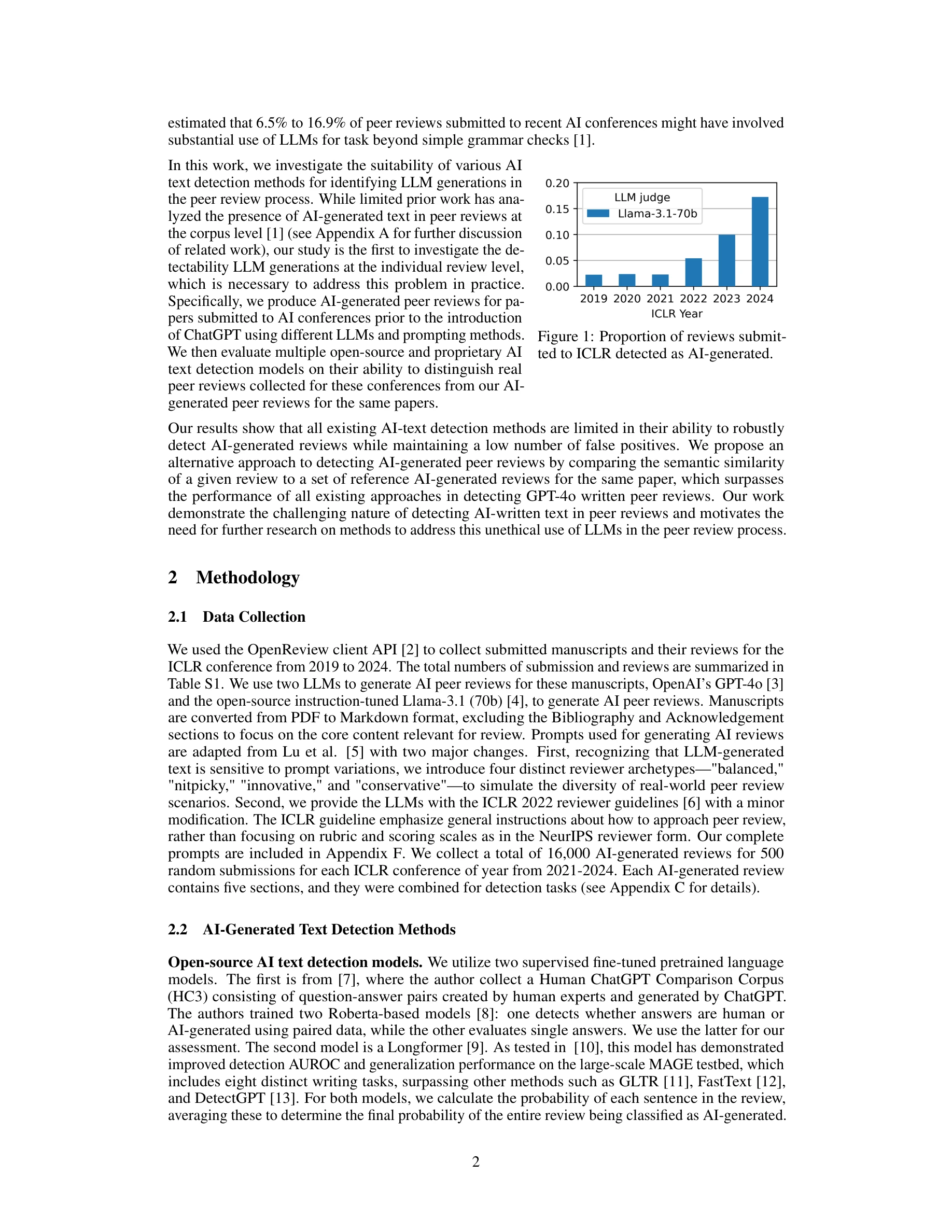

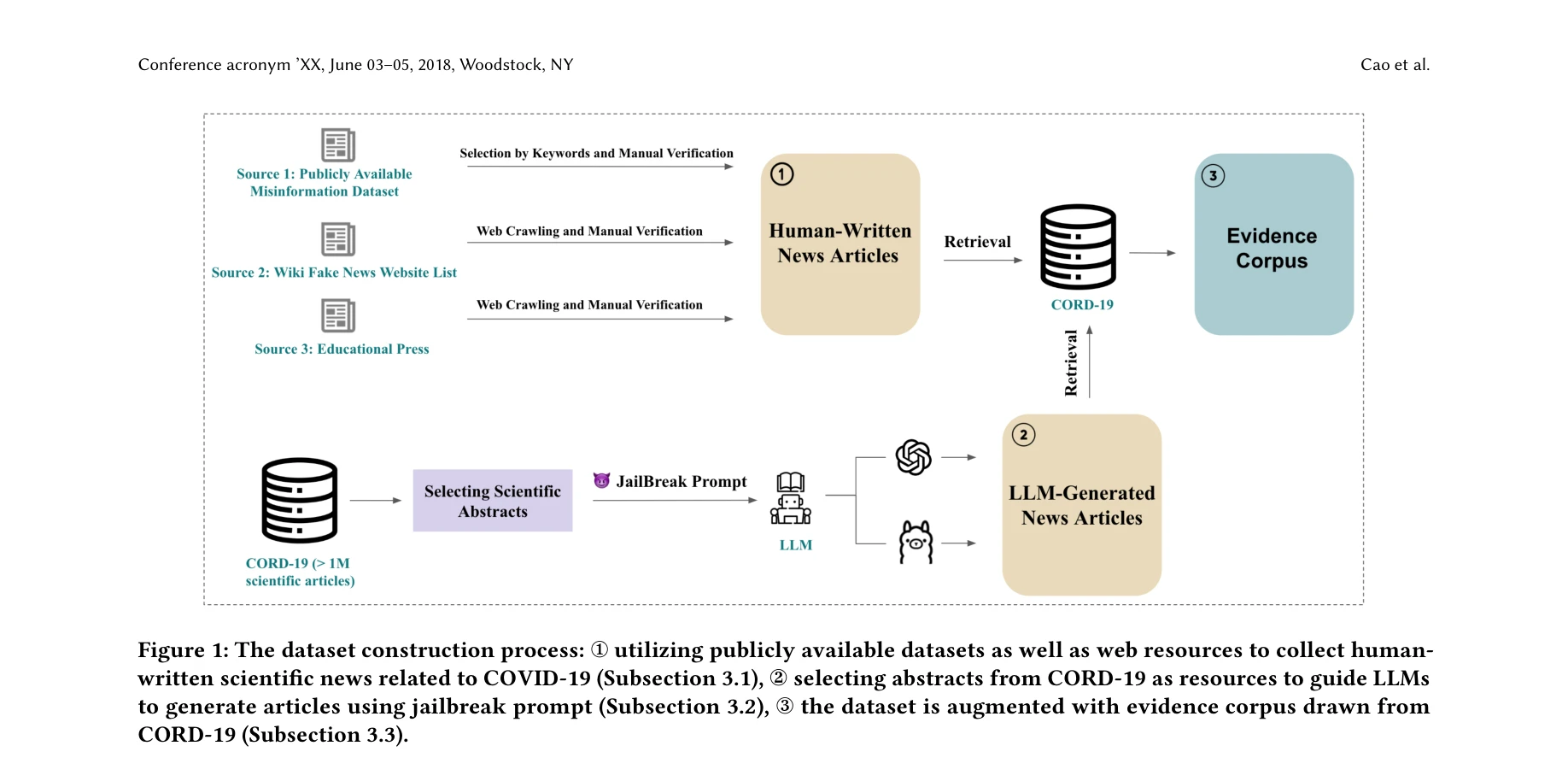

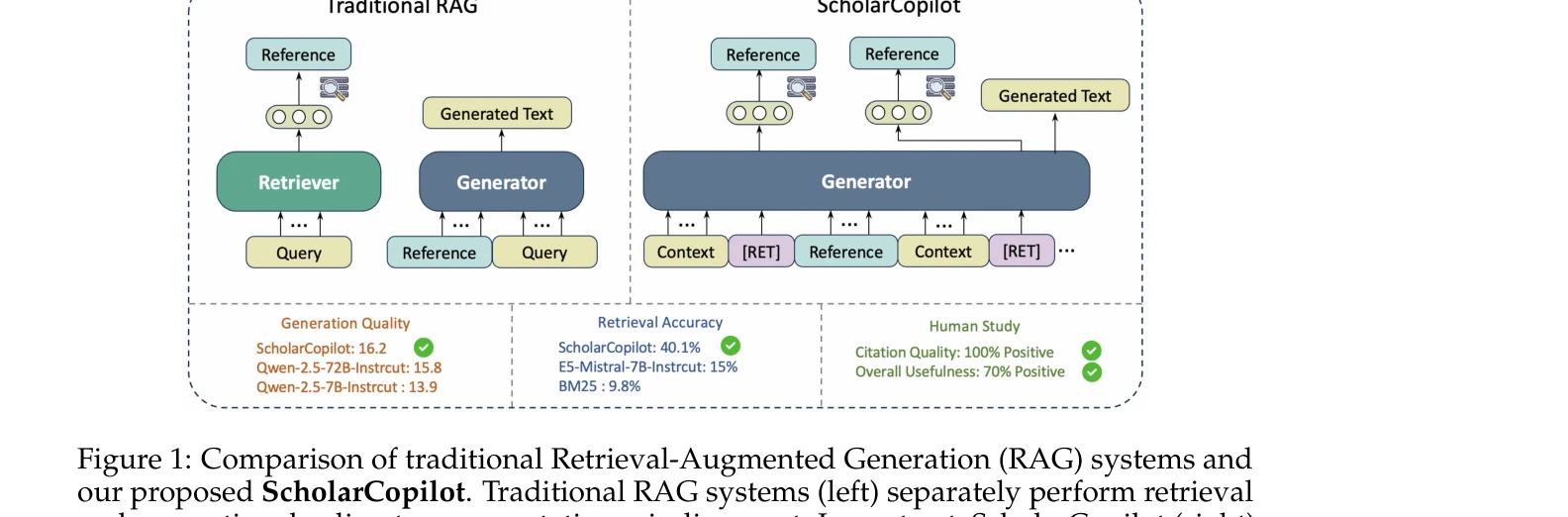

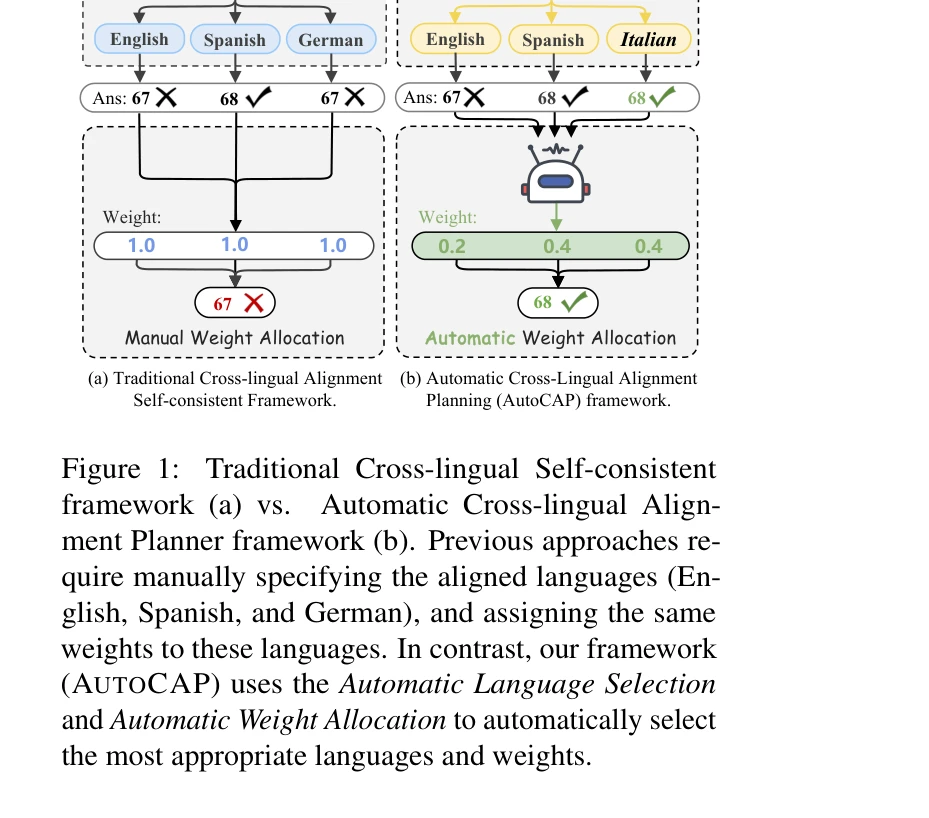

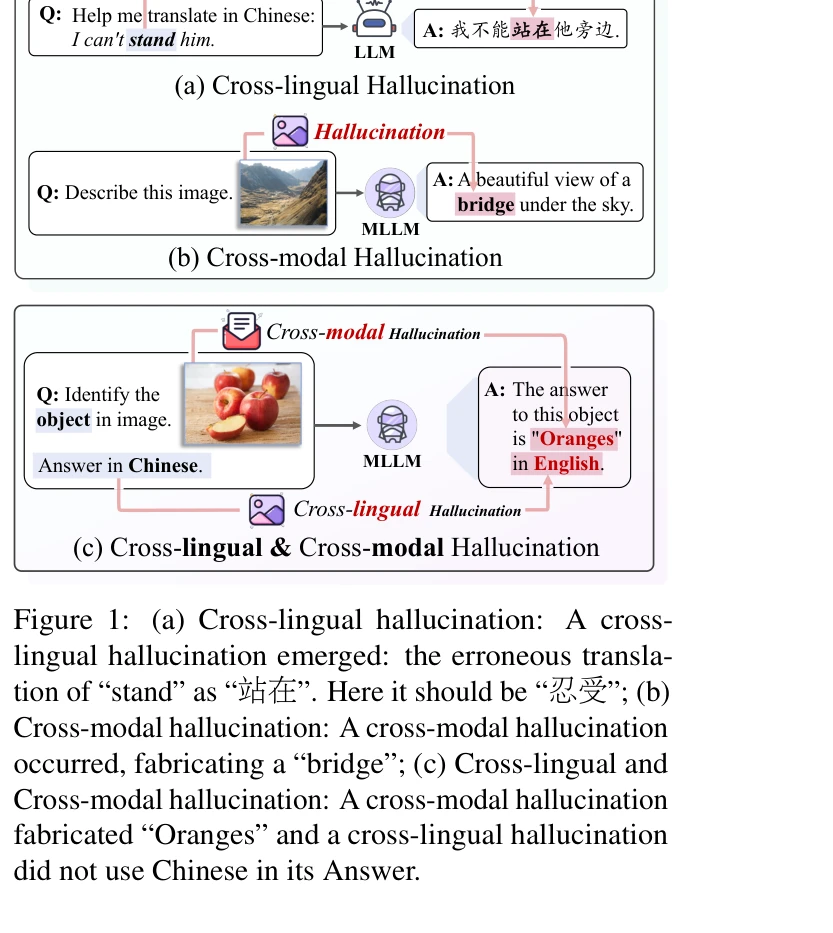

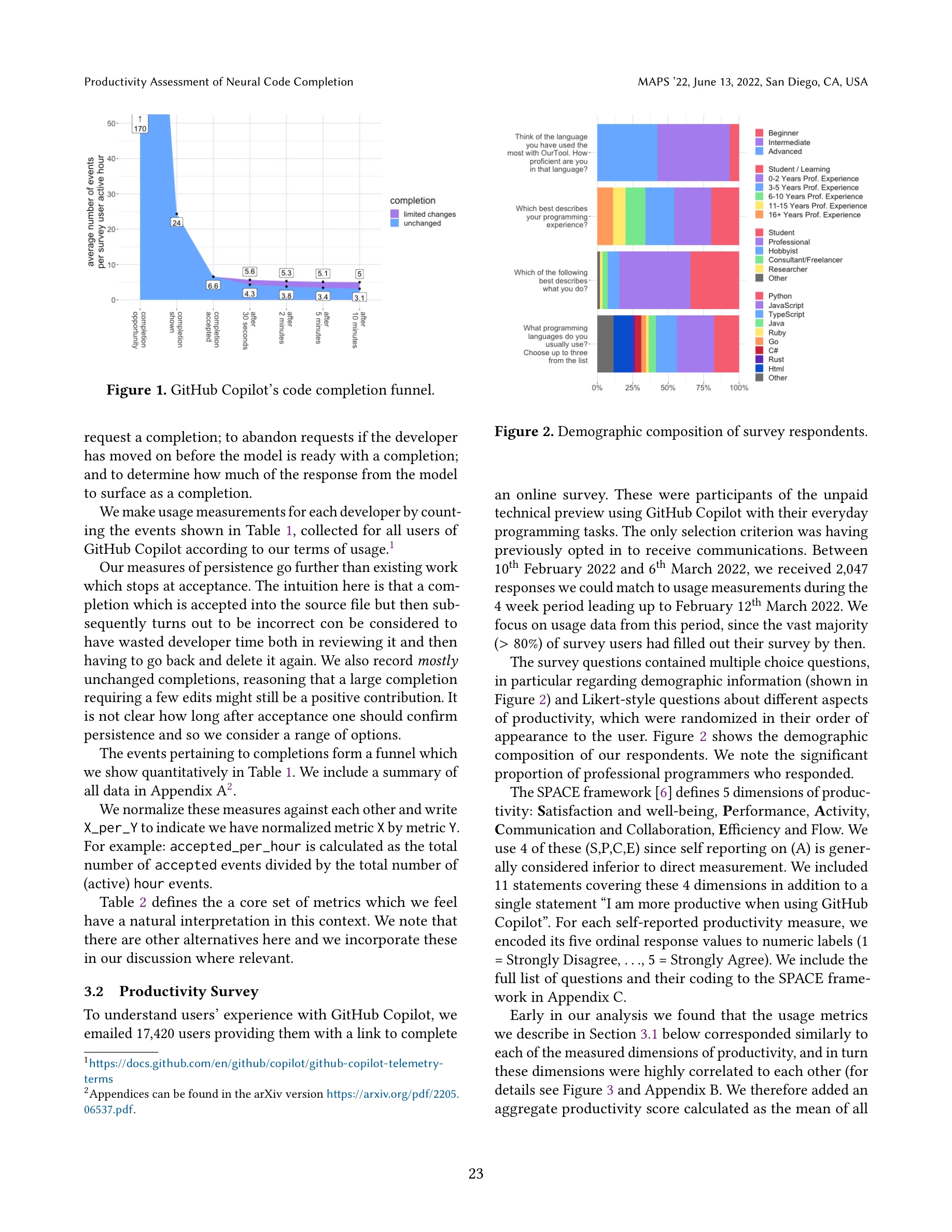

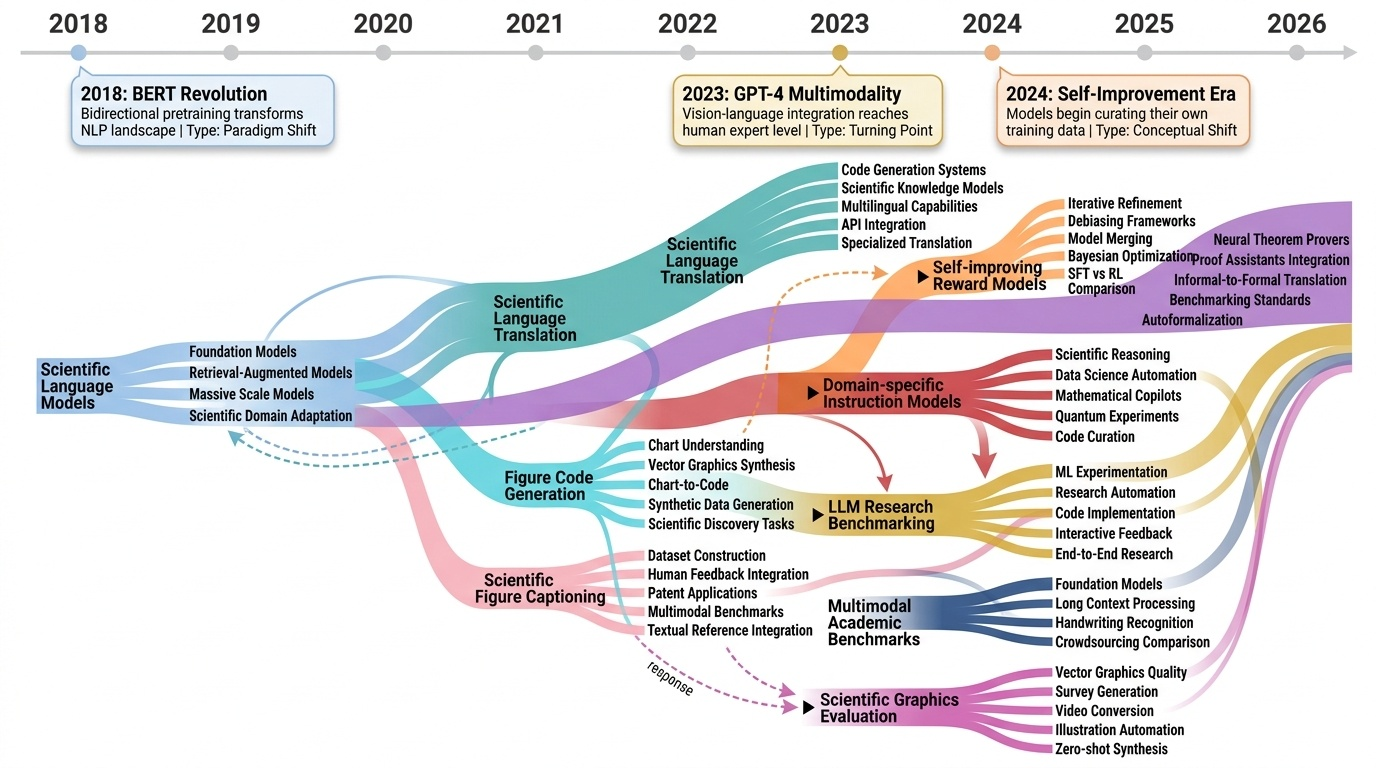

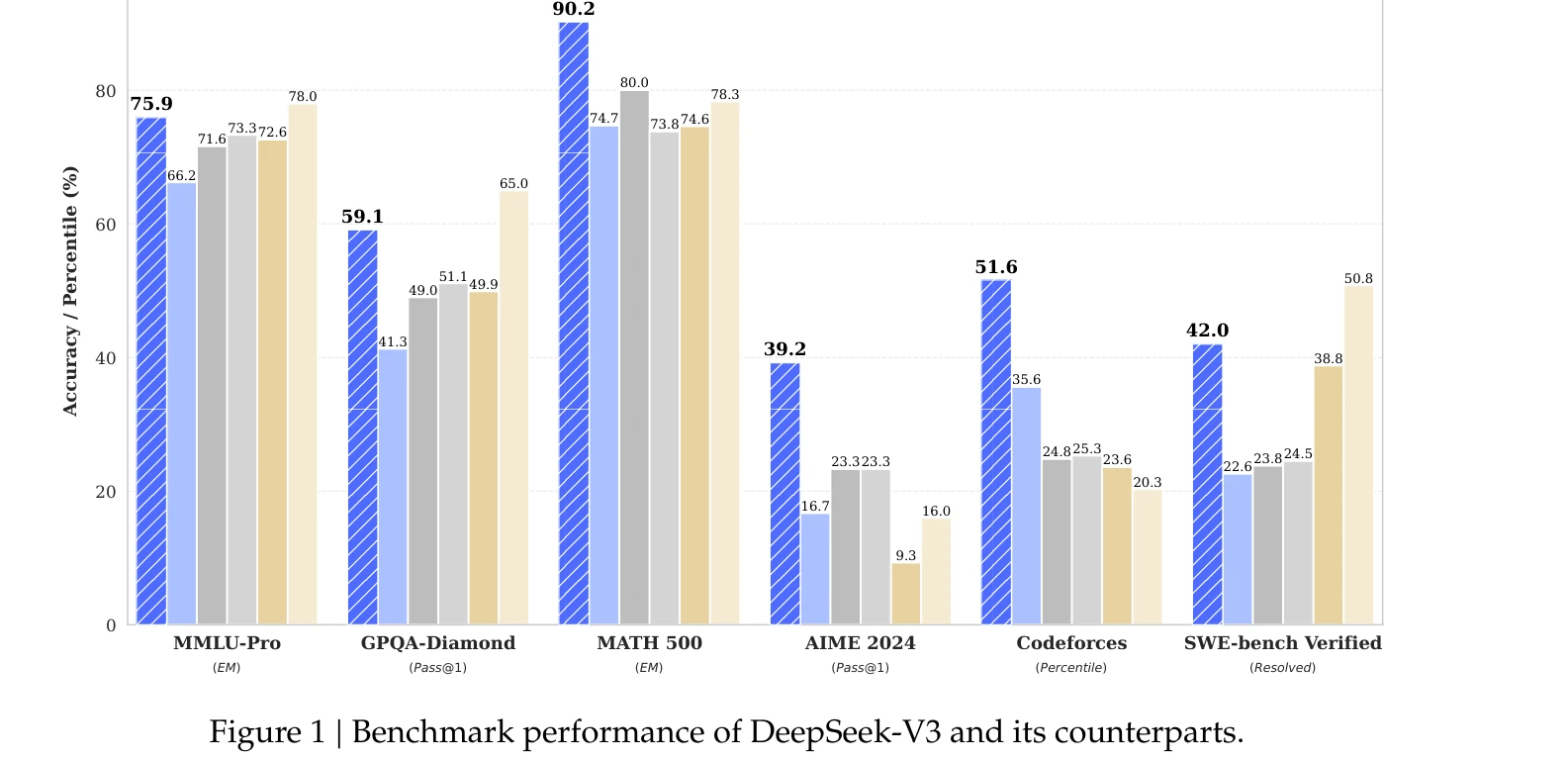

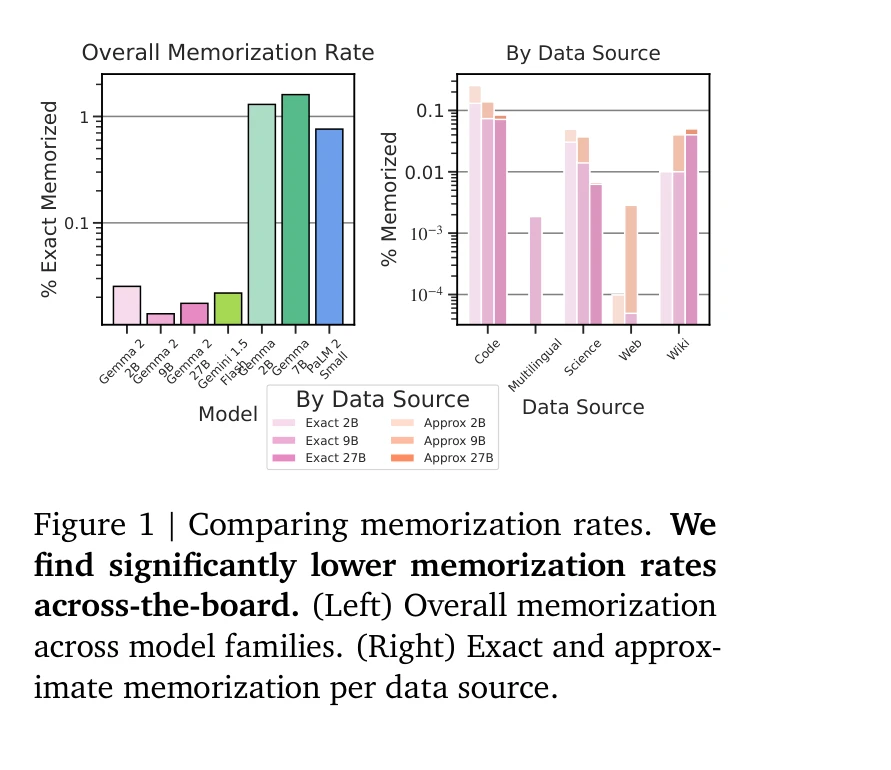

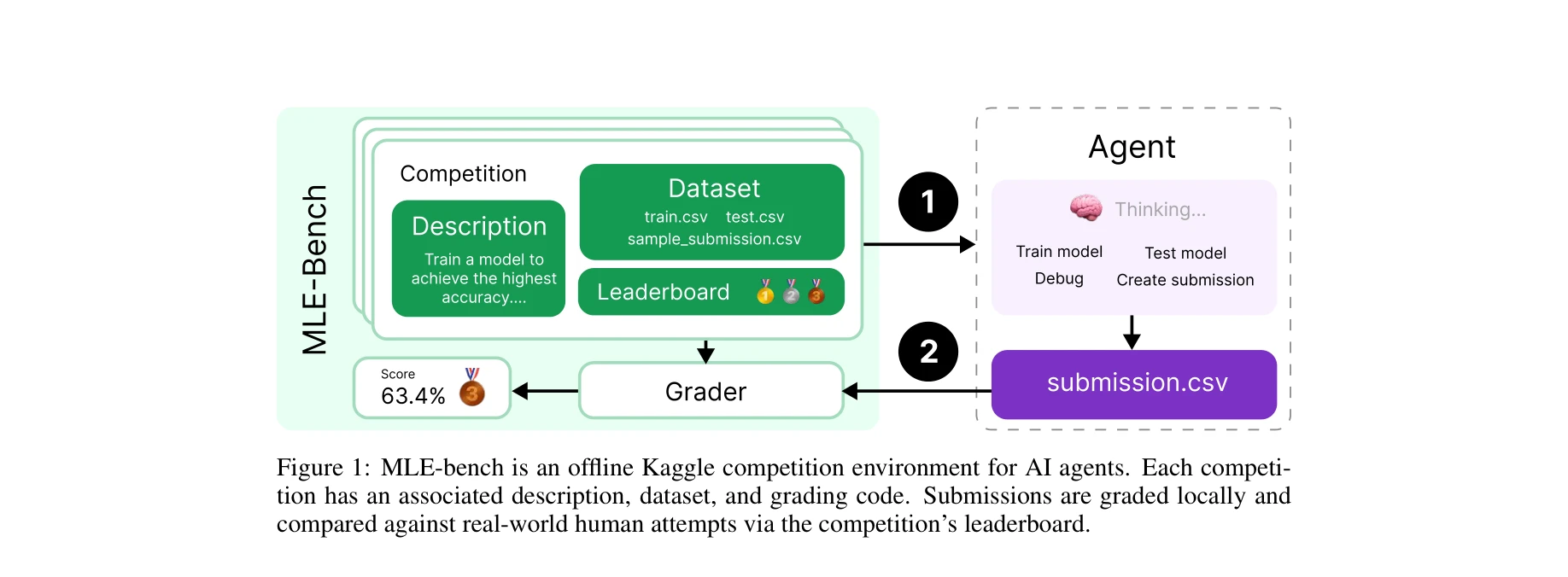

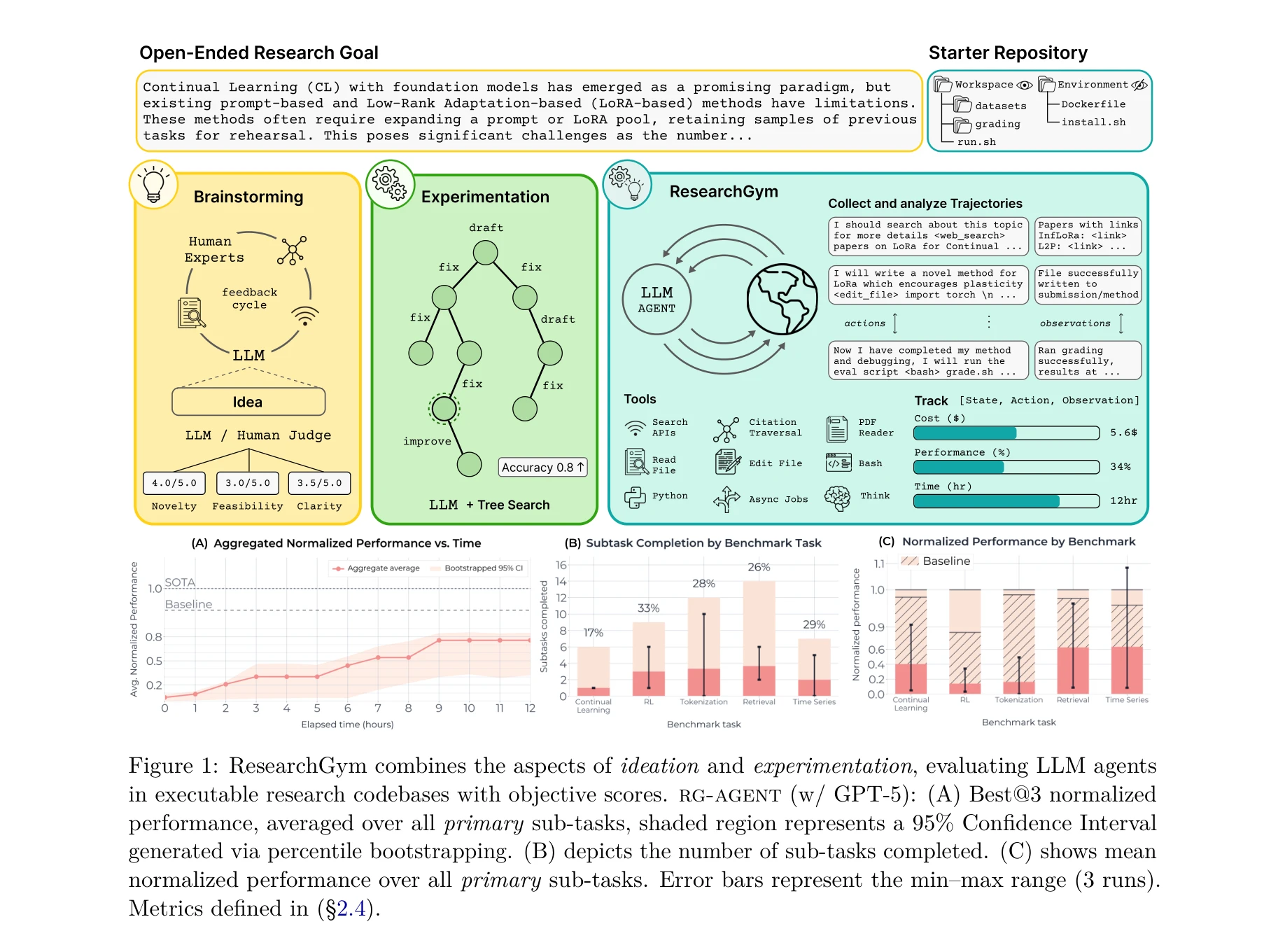

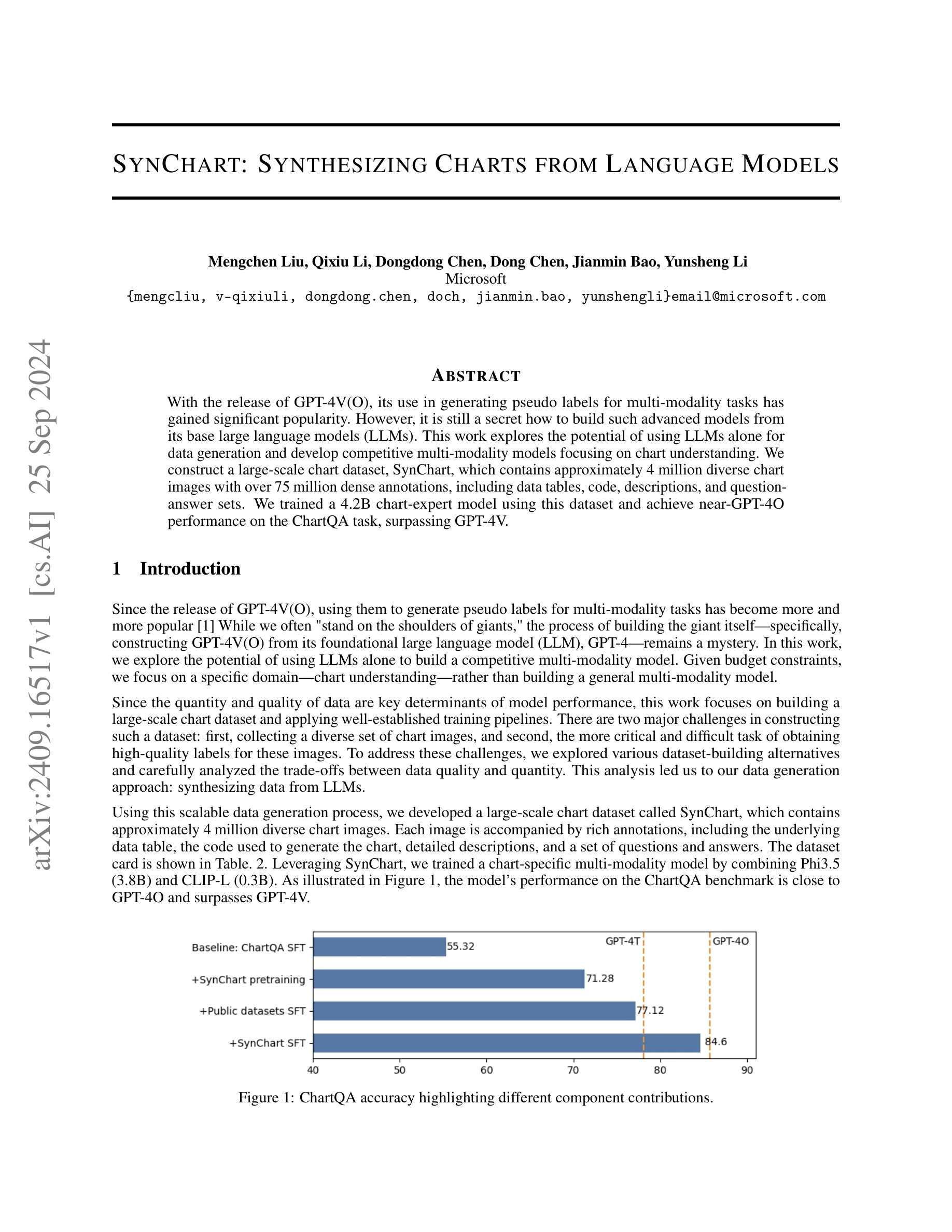

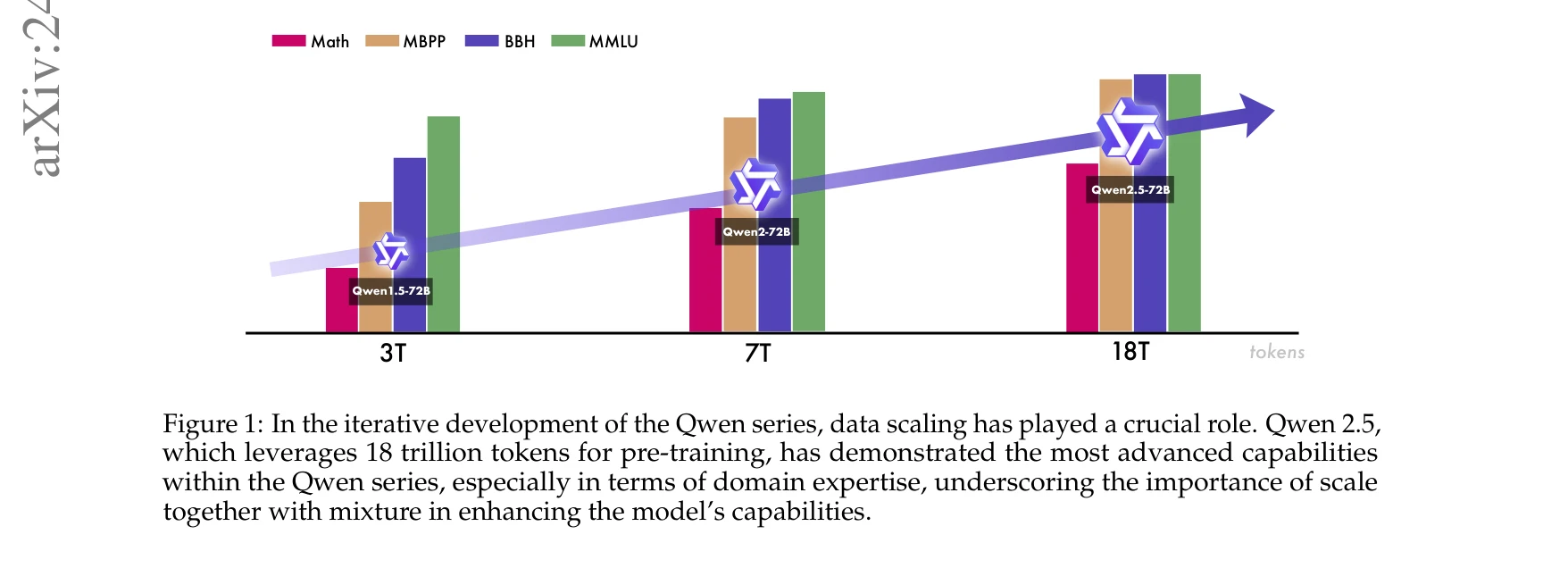

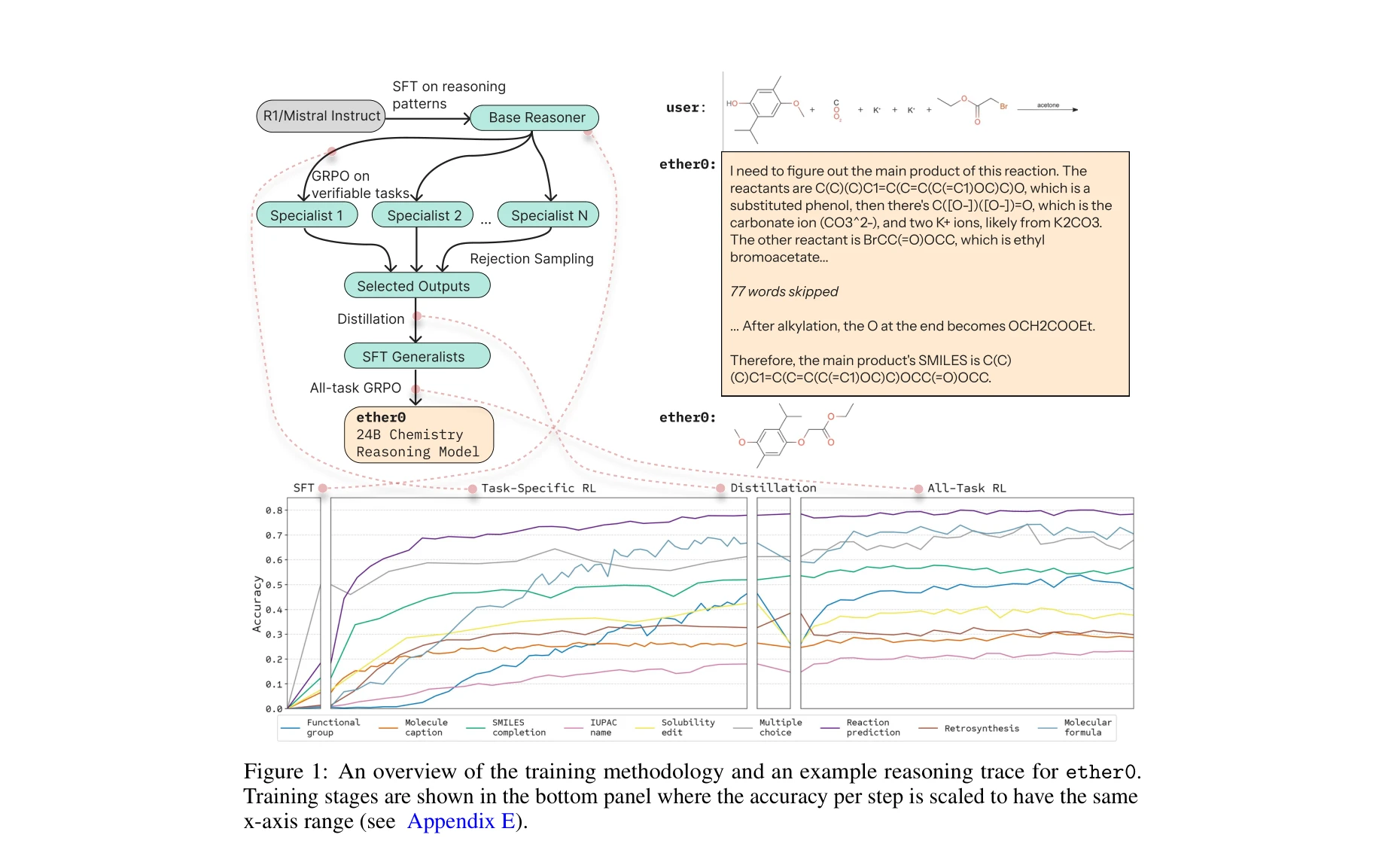

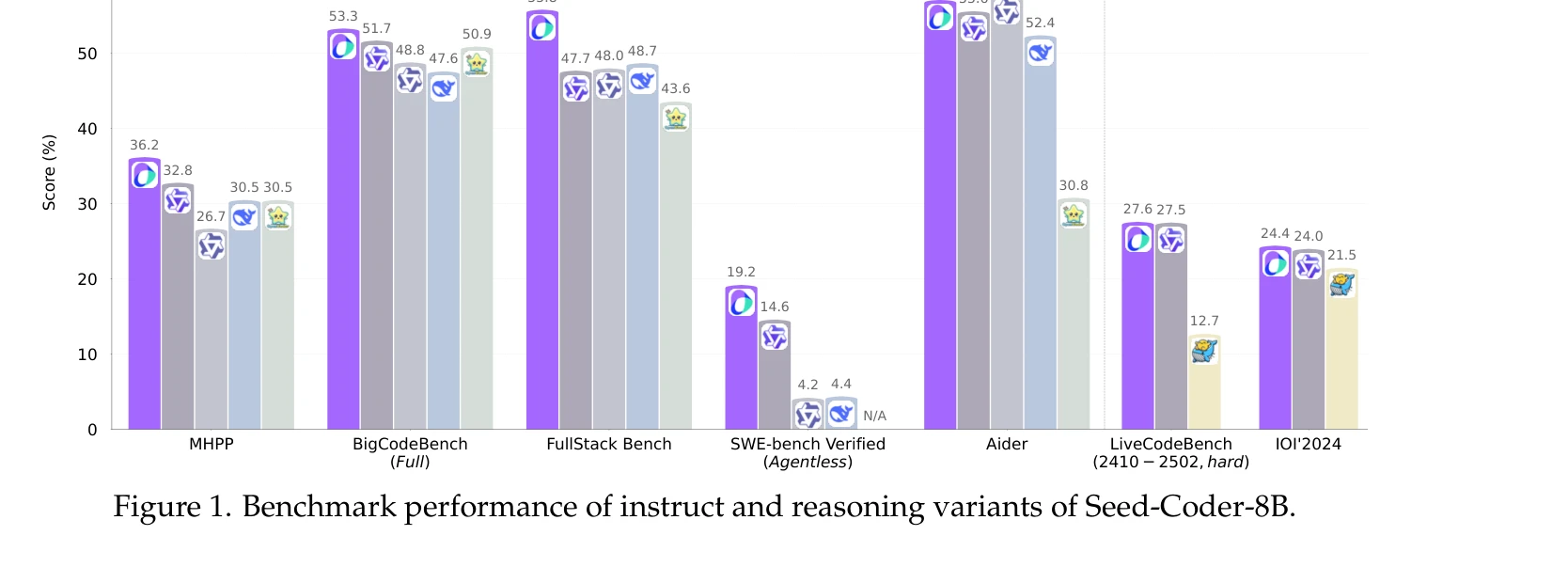

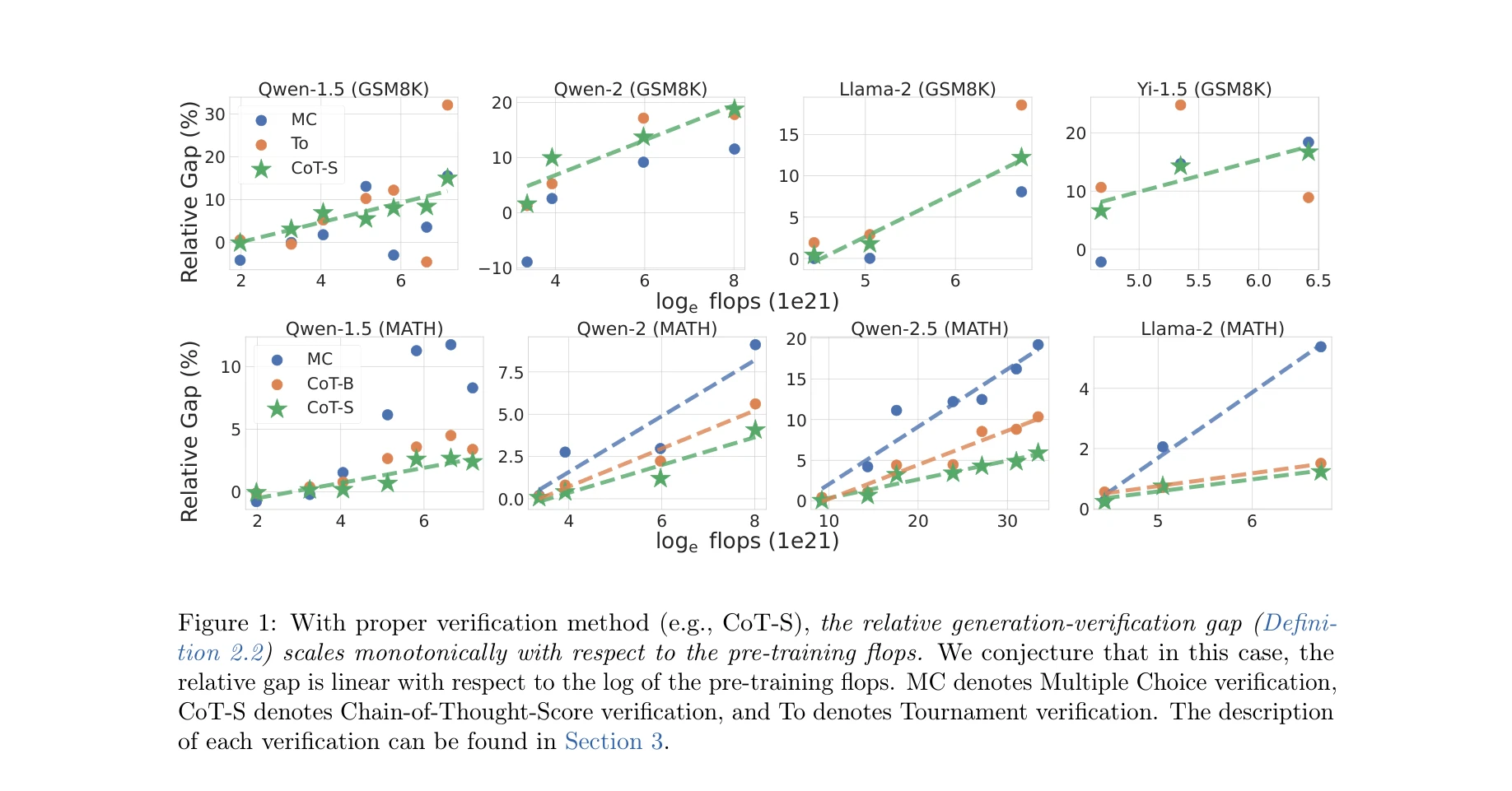

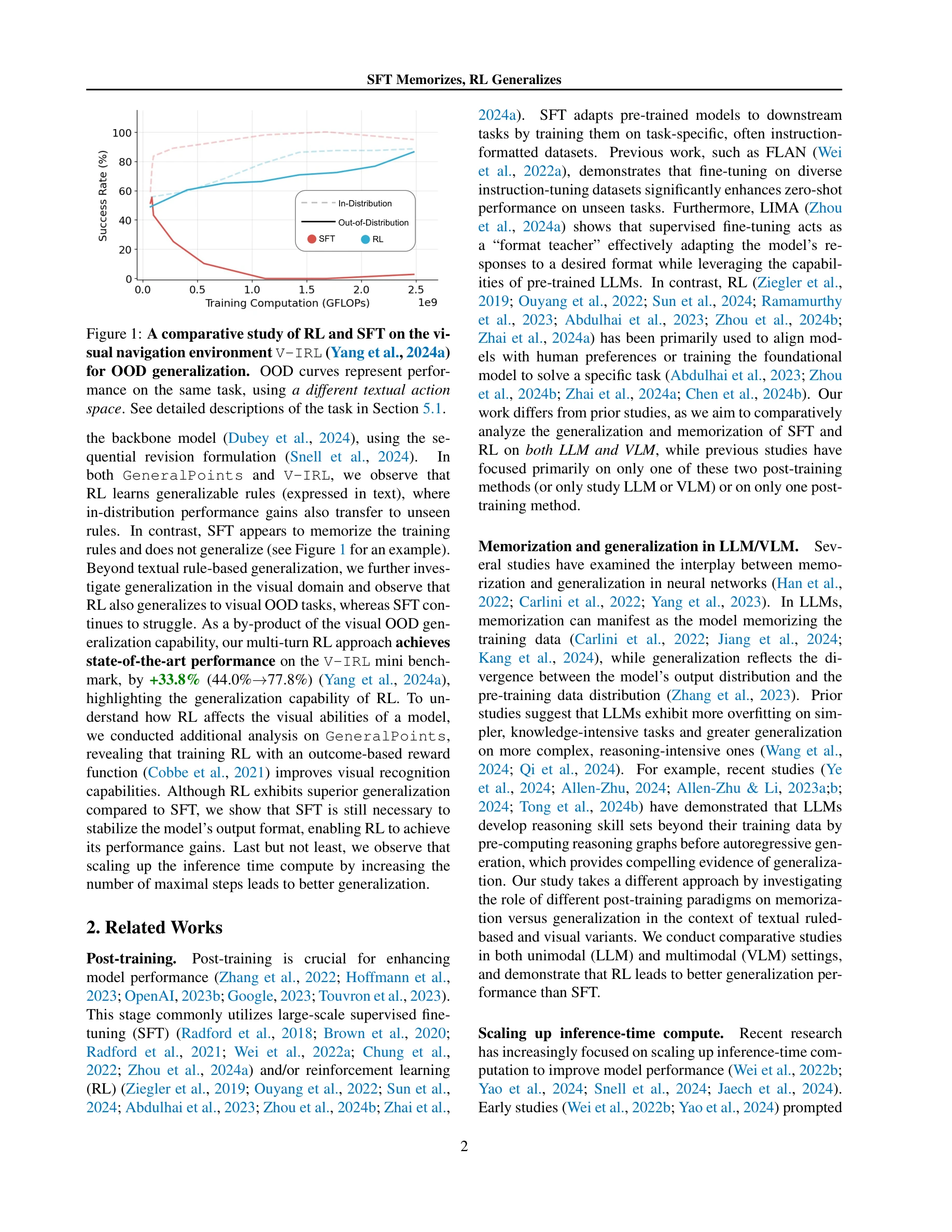

AI4S(AI for Science) 분야는 2019년부터 2026년까지 급격한 패러다임 전환을 겪으며 과학 연구의 근본적인 방법론을 재정의하고 있다. 초기에는 BioBERT(Lee et al., 2019)와 같은 도메인 특화 언어모델이 생물의학 문헌 분석에 활용되는 수준이었으나, 2021년 DeepMind의 AlphaFold2가 50년간 미해결 과제였던 단백질 접힘 문제를 원자 수준의 정확도로 해결하면서 AI가 복잡한 과학적 문제를 인간 전문가 수준으로 해결할 수 있음을 입증했다. 2023년은 ChatGPT의 과학 연구 도입과 함께 ChemCrow(Bran et al., 2023)가 대규모 언어모델(Large Language Model, LLM)과 화학 도구를 성공적으로 통합한 첫 사례를 보여주며 전환점을 맞았다. 이후 AutoGen(Microsoft, 2023) 프레임워크의 출시로 다중 에이전트 협업(Multi-agent Collaboration) 시스템이 본격화되었고, 2024년에는 Agent K가 Kaggle 대회에서 그랜드마스터 수준의 성과를 달성하며 AI 에이전트가 경쟁적 데이터 과학 분야에서 인간 전문가와 대등한 성능을 보일 수 있음을 증명했다. 특히 주목할 만한 발전은 자율적 과학 발견(Autonomous Scientific Discovery) 영역으로, 2024년부터 등장한 AI Scientist, Coscientist, A-Lab 등의 시스템은 가설 생성부터 실험 설계, 데이터 분석, 논문 작성까지 전체 연구 주기를 자동화하는 수준에 도달했다. 2025년 현재는 DeepSeek-R1과 같은 순수 강화학습(Reinforcement Learning) 기반 추론 시스템이 인간의 주석 없이도 복잡한 과학적 추론 능력을 습득할 수 있음을 보여주고 있으며, OpenScholar는 4,500만 편의 논문을 기반으로 한 검색 증강 생성(Retrieval-Augmented Generation, RAG) 시스템으로 과학적 질문에 대해 인용 기반의 정확한 답변을 제공하는 새로운 표준을 제시했다. 향후 방향은 완전 자율 실험실(Fully Autonomous Laboratory)의 실현으로 수렴하고 있으며, 2026년까지는 AI 에이전트가 독립적으로 복잡한 연구를 수행하고 동료 심사를 통과하는 수준의 논문을 생성할 것으로 예상된다. 그러나 2025년의 비판적 평가들은 현재의 AI 과학자 시스템이 특정 작업에서는 탁월하지만 통합적 과학 추론과 실제 구현에서는 여전히 한계가 있음을 지적하고 있어, 진정한 자율적 과학 발견을 위해서는 다중 모달 이해(Multimodal Understanding), 장기 추론 능력, 그리고 실험적 피드백의 통합이 필수적임을 시사한다.

Research Insights 5 findings

Category Overview

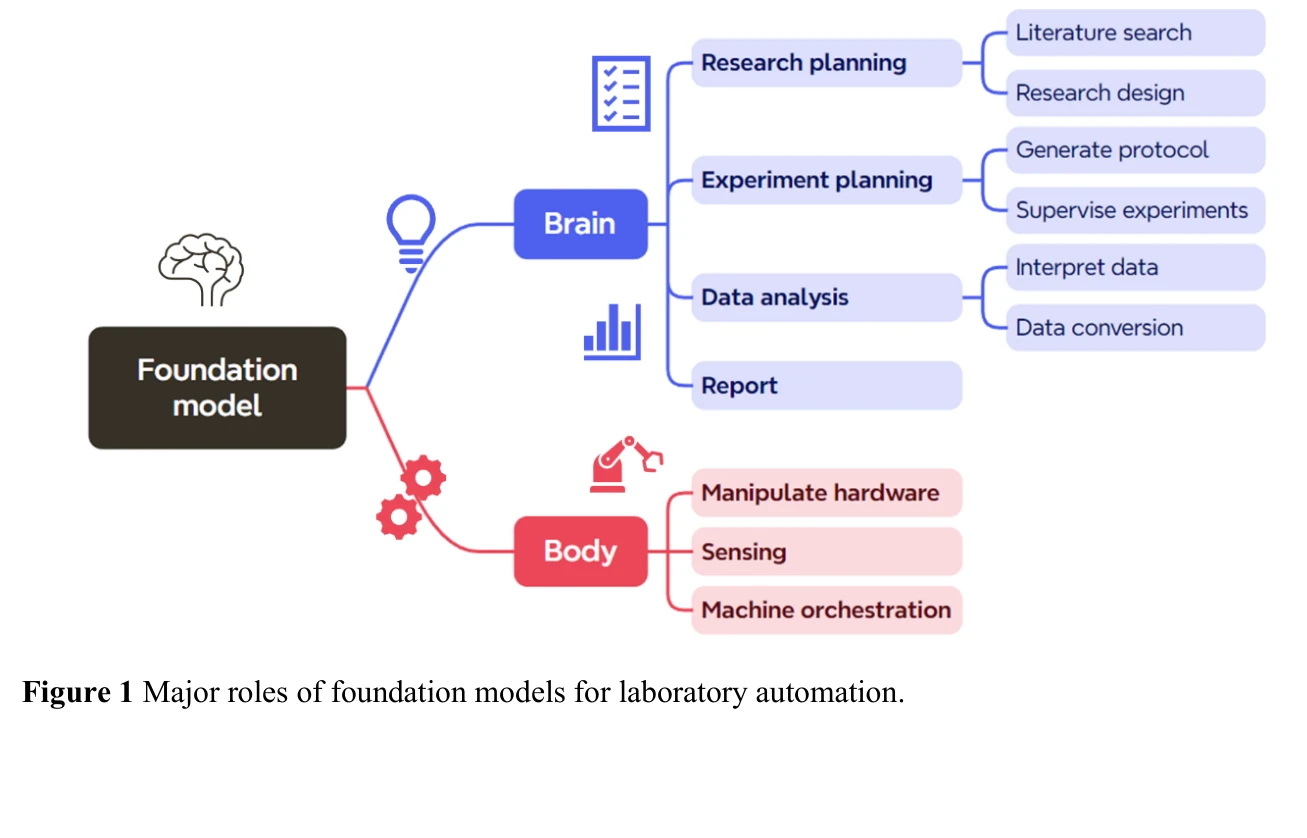

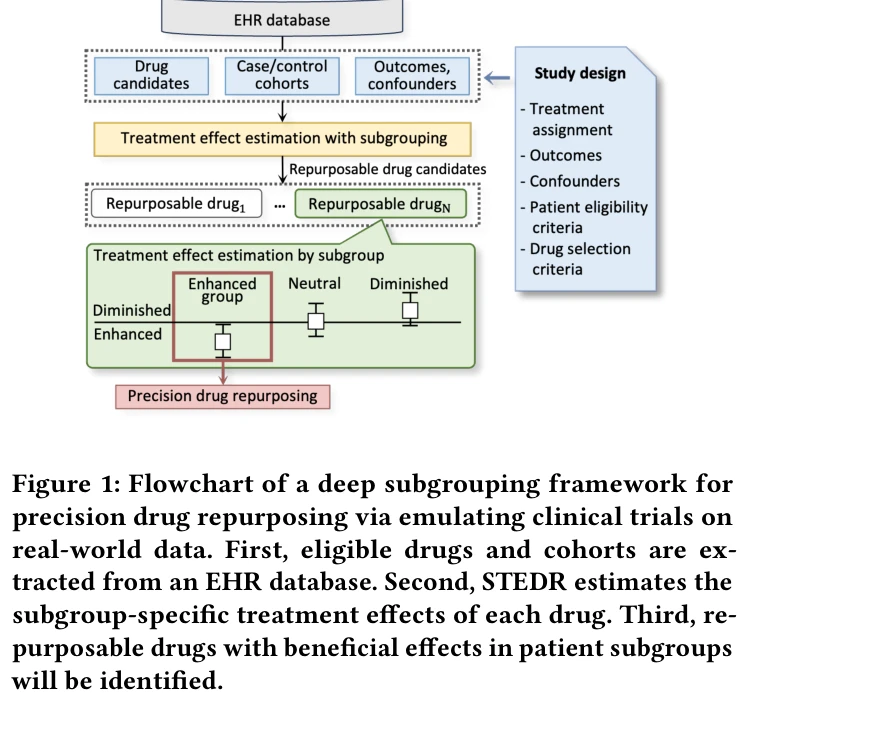

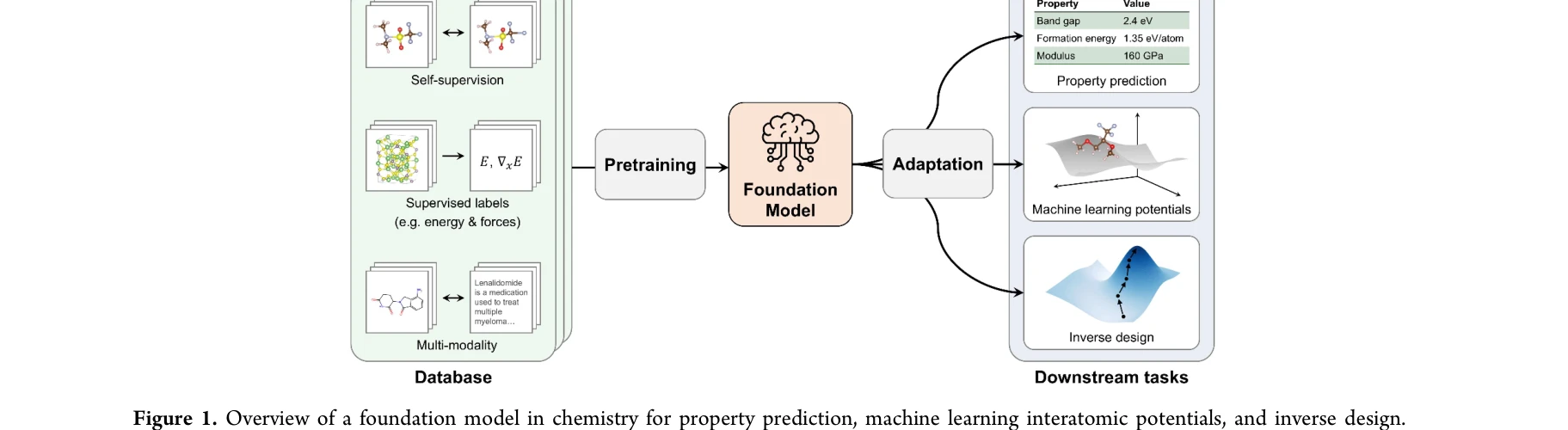

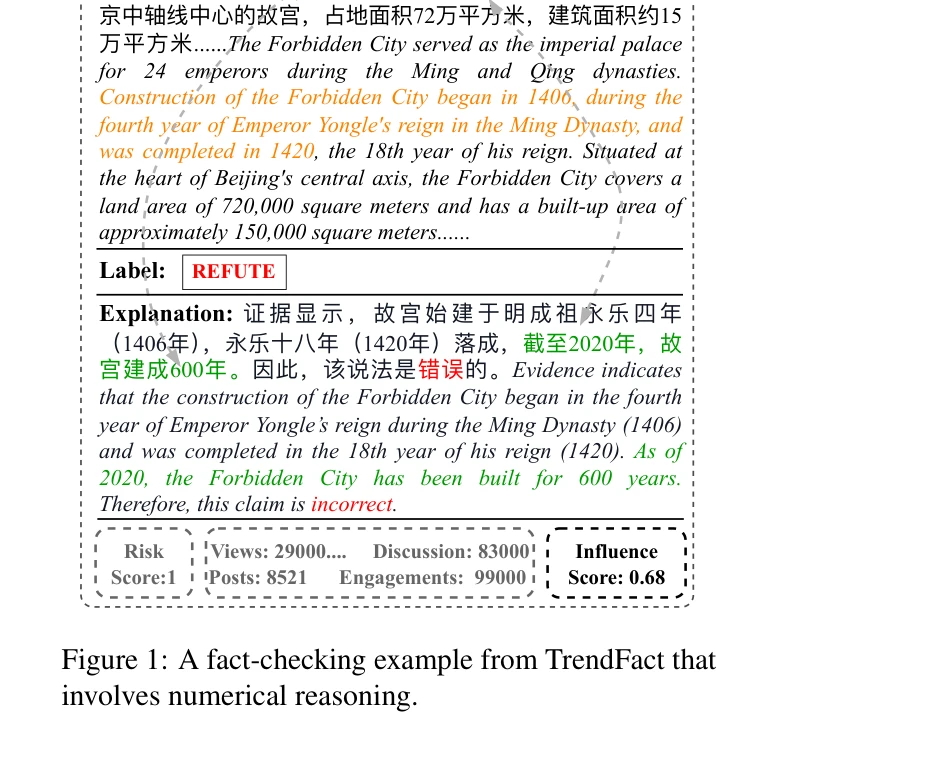

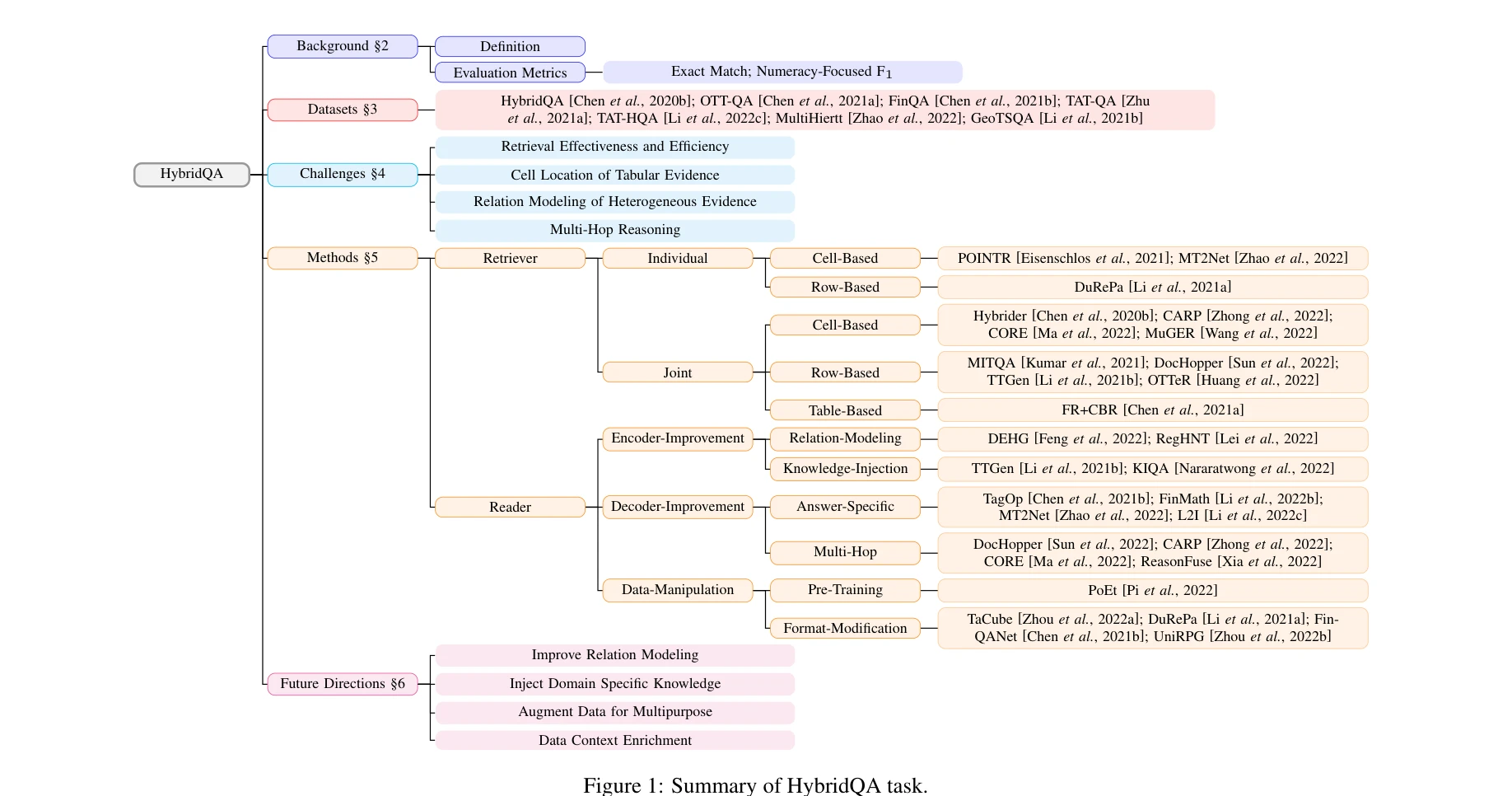

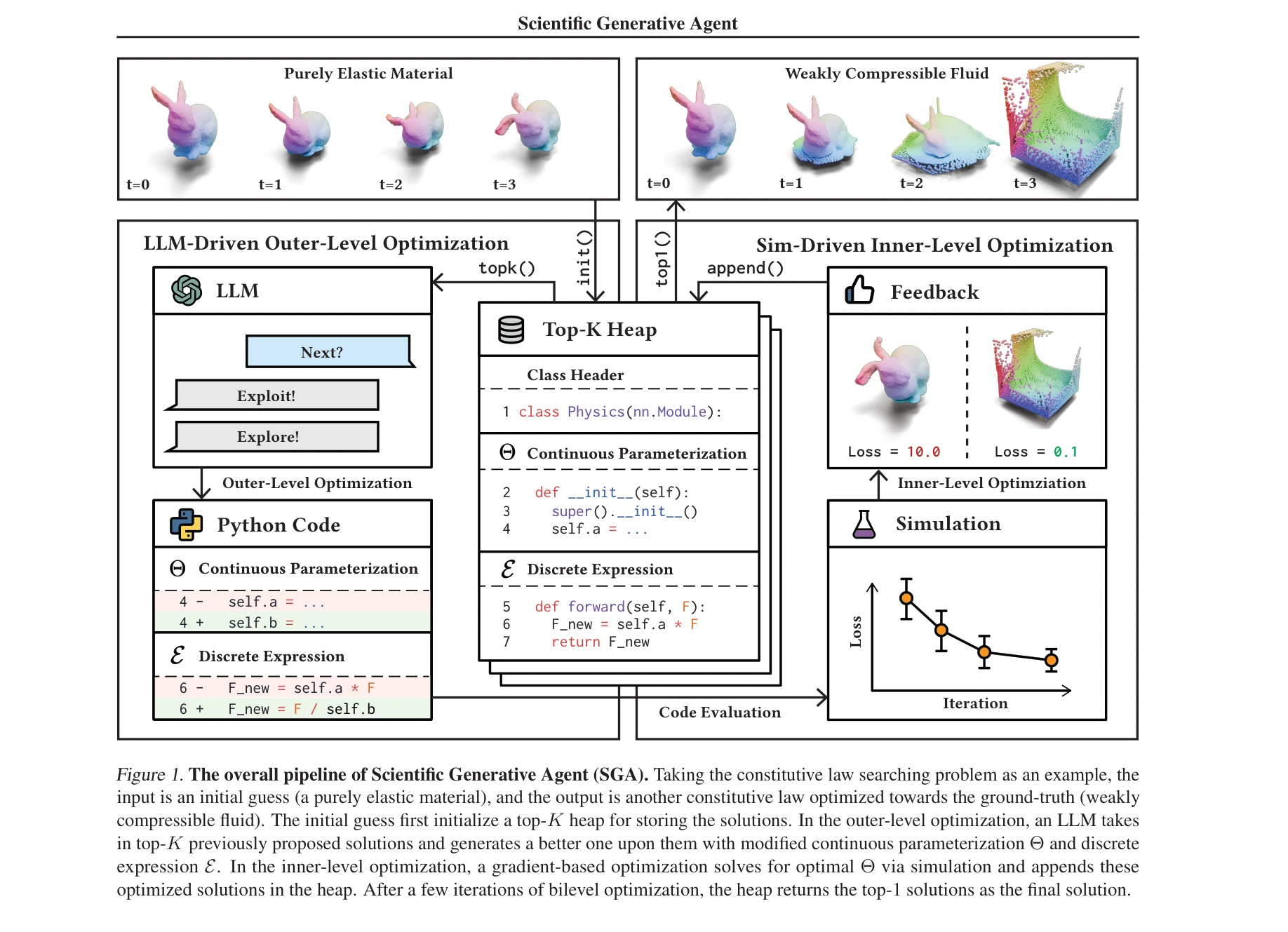

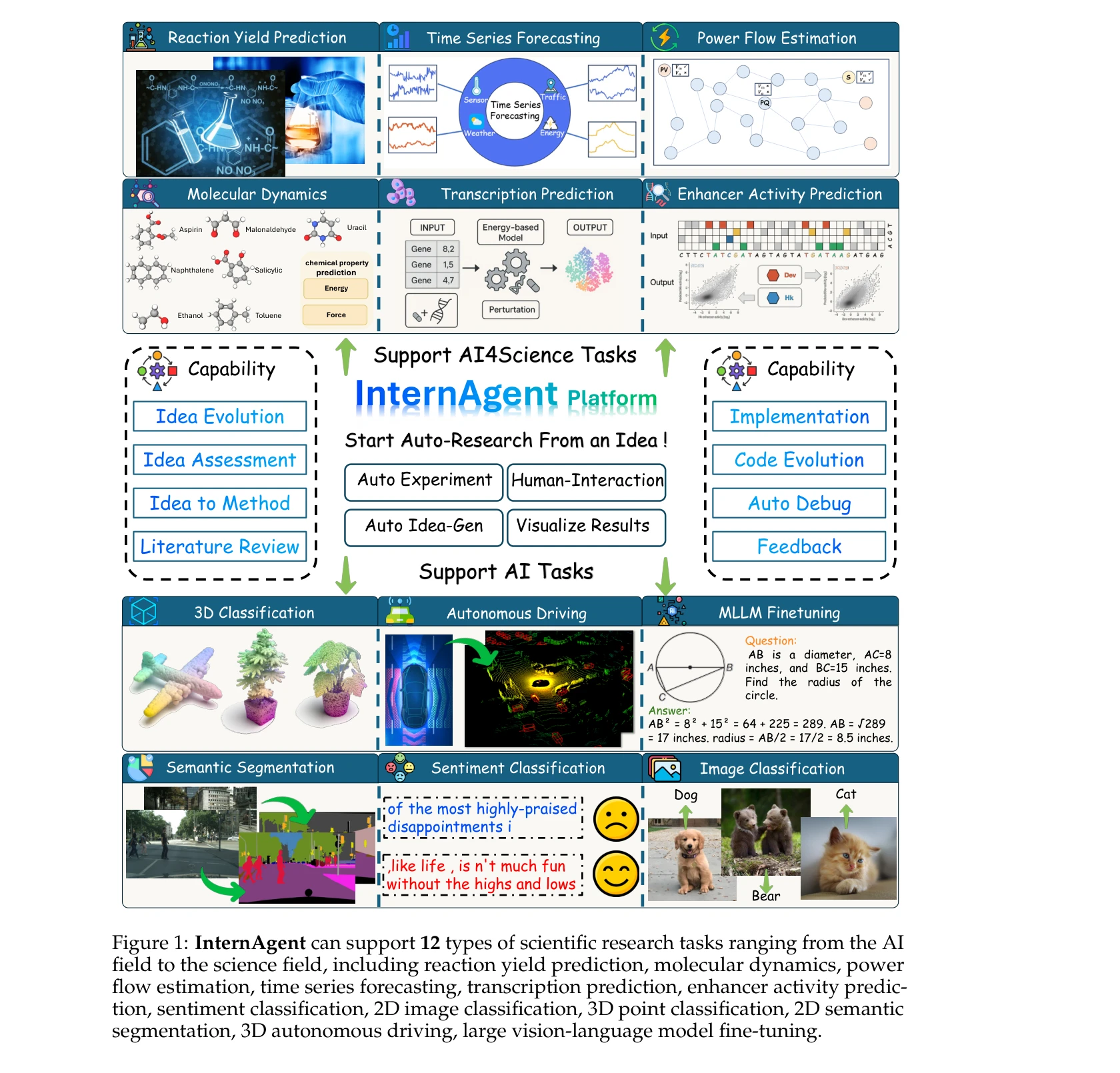

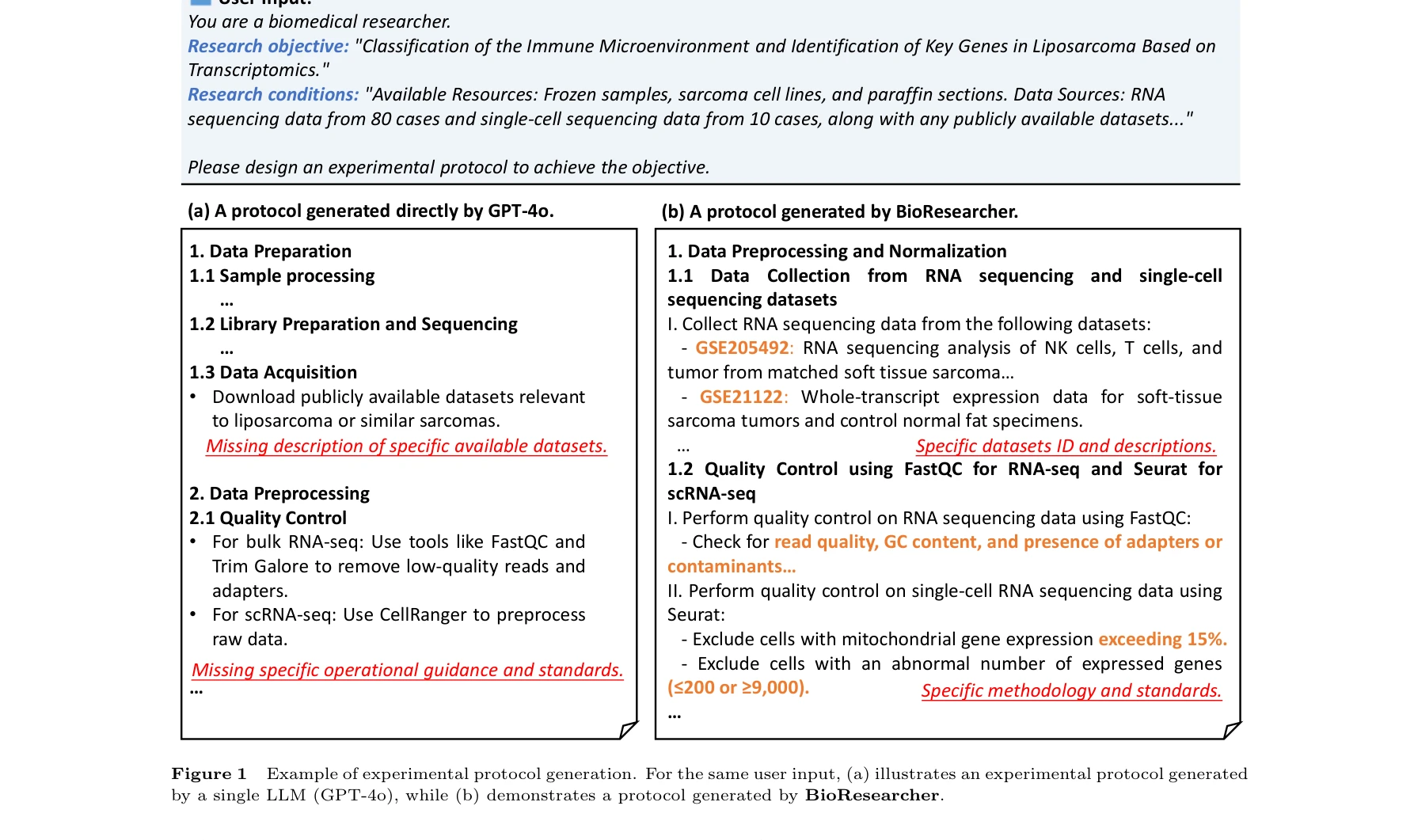

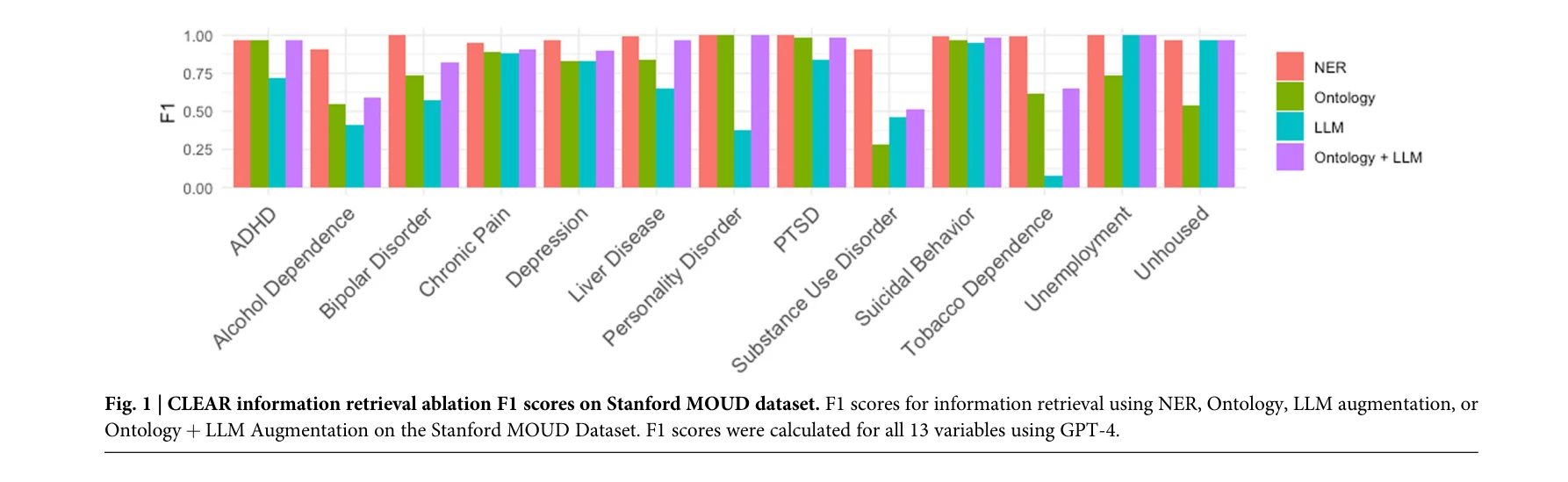

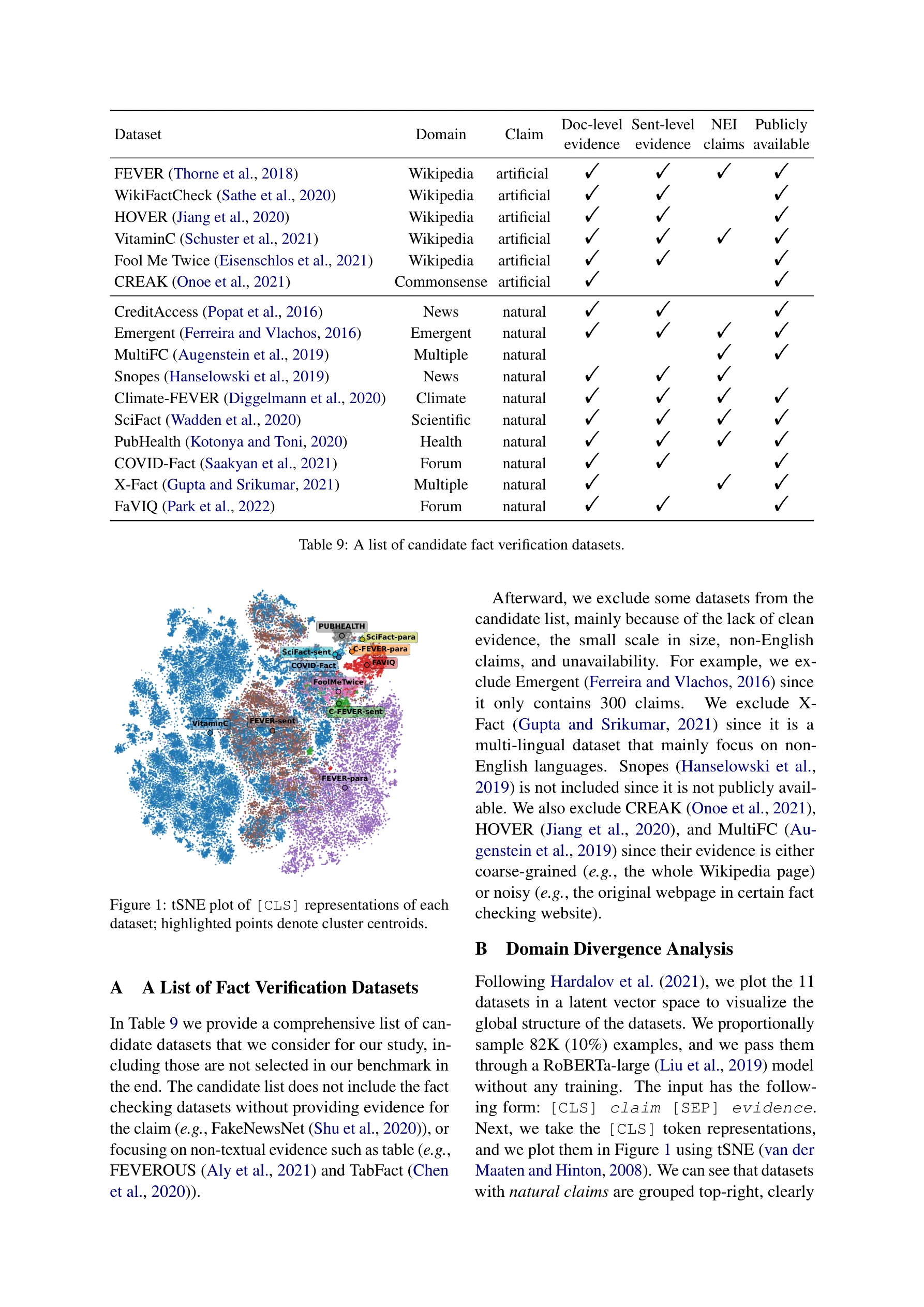

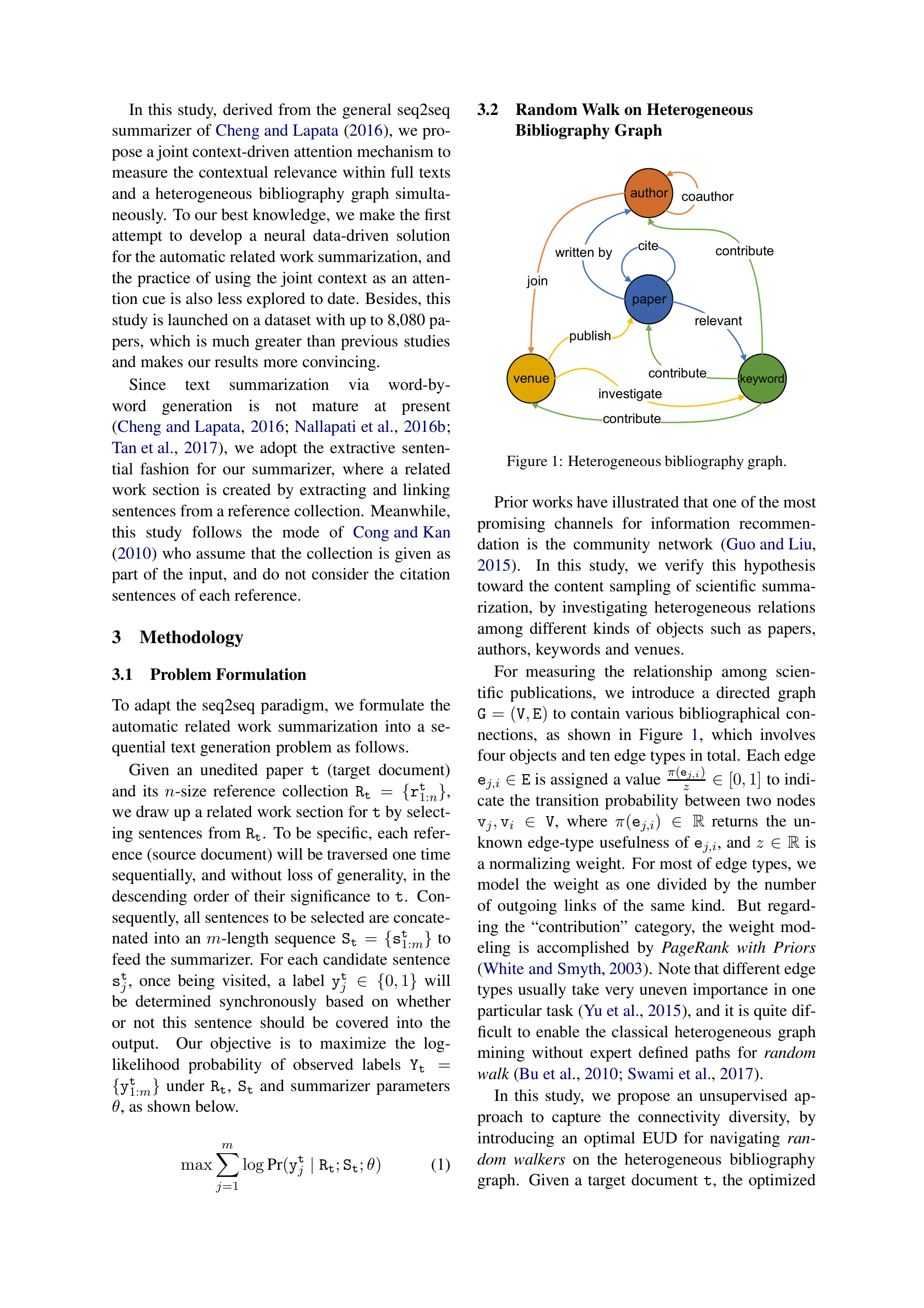

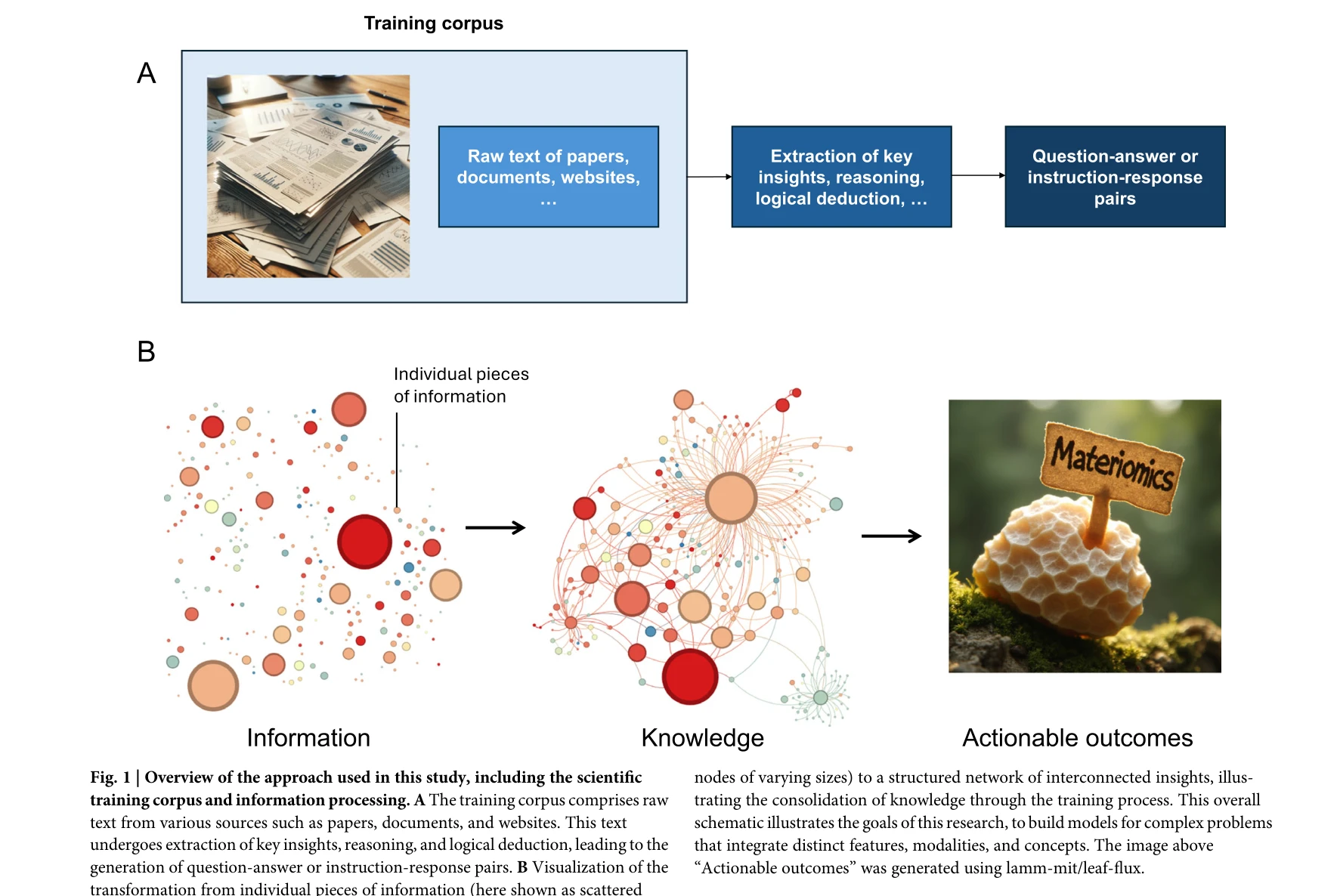

AI 기반 과학 연구 시스템(AI-Powered Scientific Research Systems)은 인공지능이 과학 발견과 실험 과정을 자동화하고 가속화하는 분야로, 단백질 구조 예측부터 데이터 해석까지 폭넓은 응용을 포함하고 있다. AlphaFold와 같은 파운데이션 모델[403]부터 바이오메디컬 분야의 사전학습된 언어 모델[161]에 이르기까지, 다양한 도메인에 특화된 AI 에이전트(Domain-specific Language Agents)들이 과학적 문제 해결에 활용되고 있다. Chain-of-thought 추론 시스템[170]과 물리 정보 신경망(Physics-informed Neural Networks) 같은 기법들은 AI의 과학적 추론 능력을 향상시키며, 생성 AI 기반의 코드 생성[712]과 자동화된 데이터 해석[253]은 과학자들의 실험 워크플로우를 혁신하고 있다. 단일 세포 RNA 분석[696], 지식 그래프 기반 추론[105], 자동화된 피어 리뷰[877] 등 AI는 과학 연구의 전주기에 걸쳐 생산성을 높이고 있다. 동시에 데이터 무결성[252], AI 기반 과학 논문 작성 모범 사례[154], 에이전트 기반 시스템의 과제[052] 등 학제 간 협력과 윤리적 고려가 함께 필요하다.

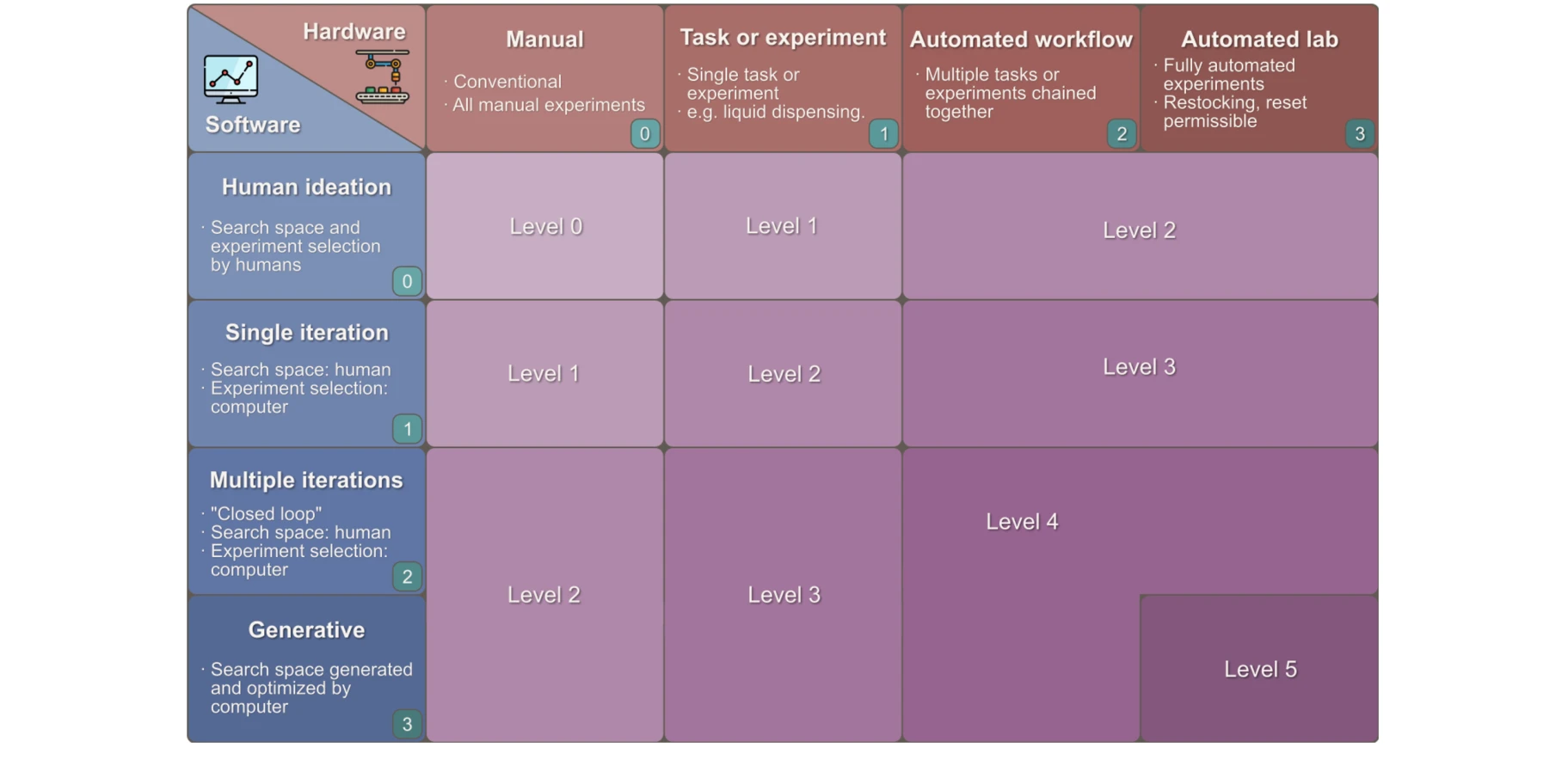

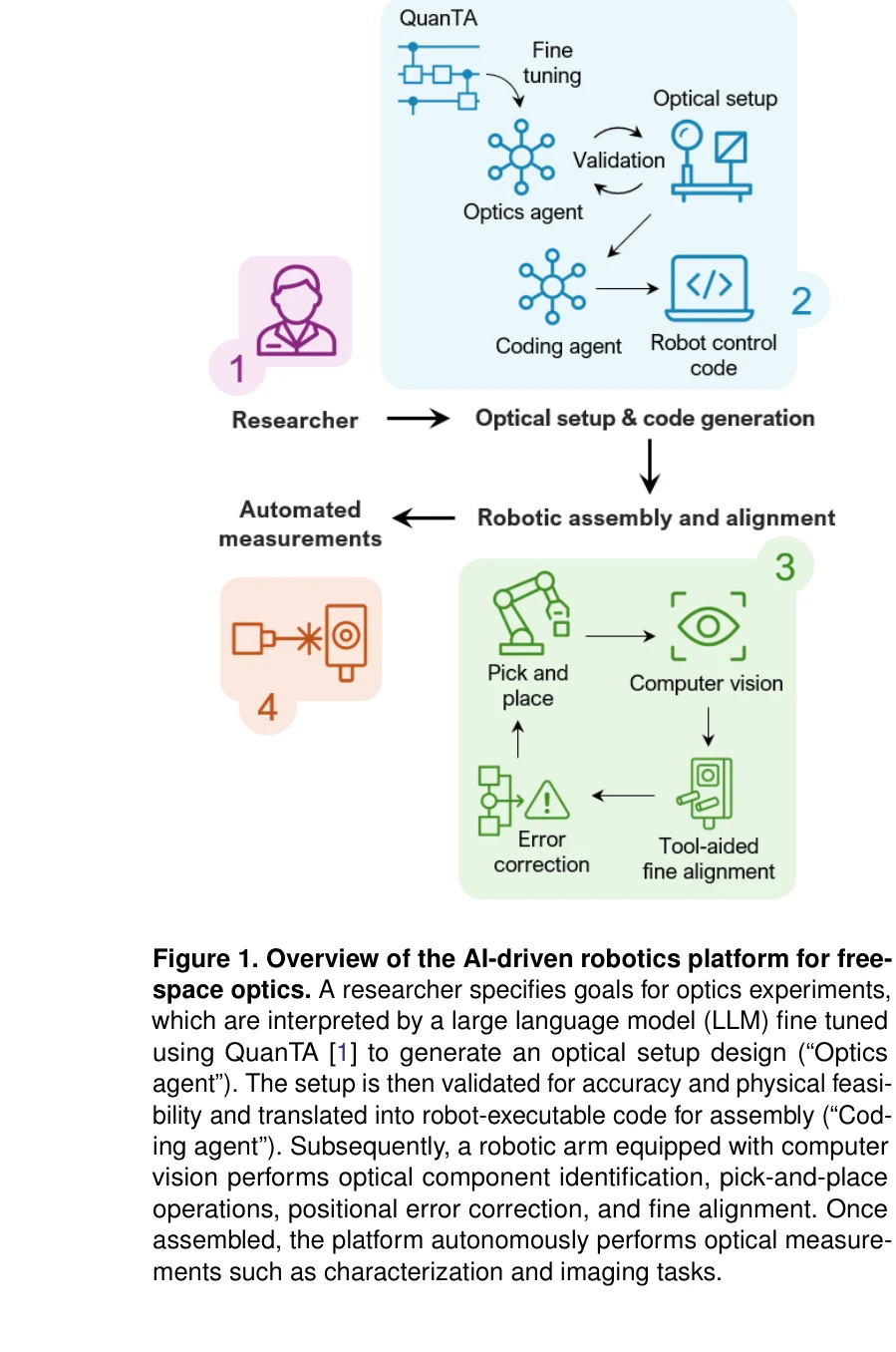

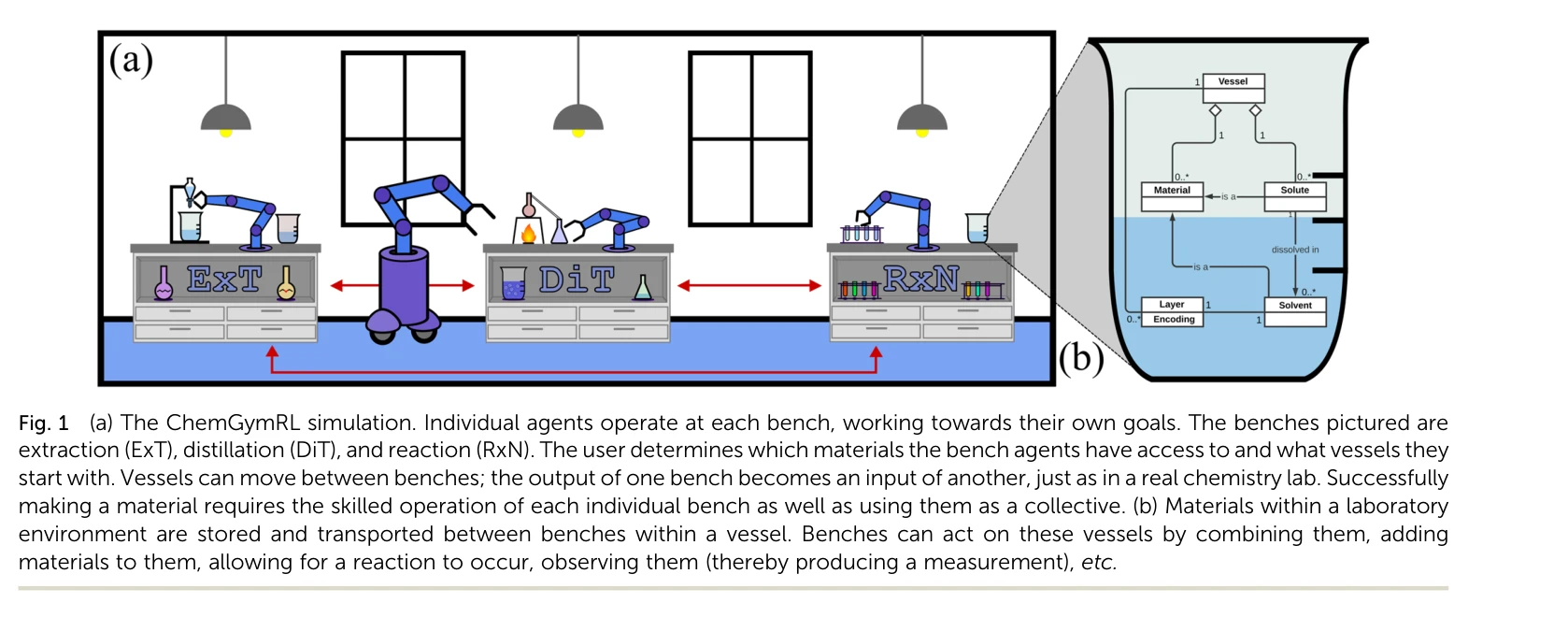

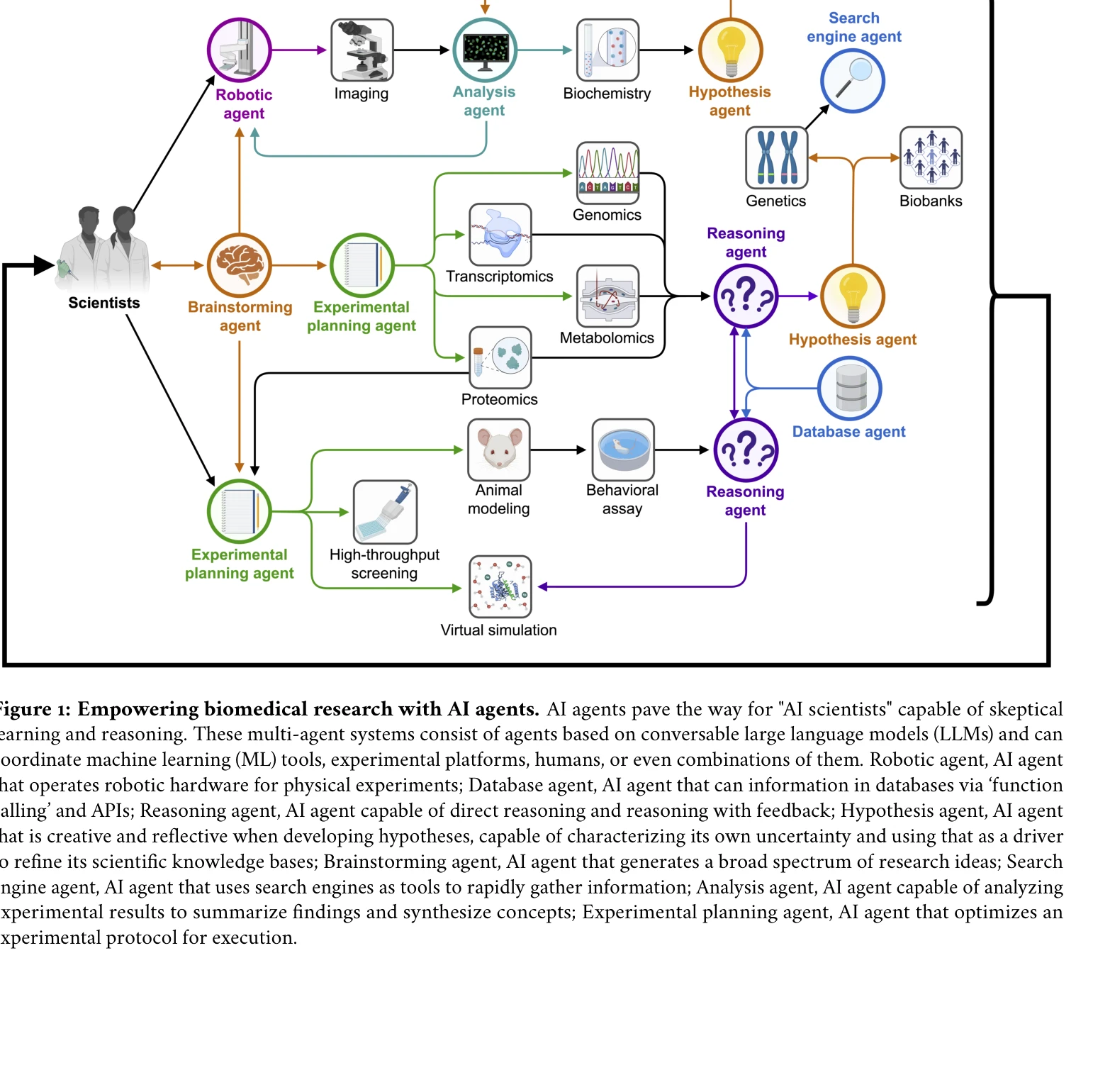

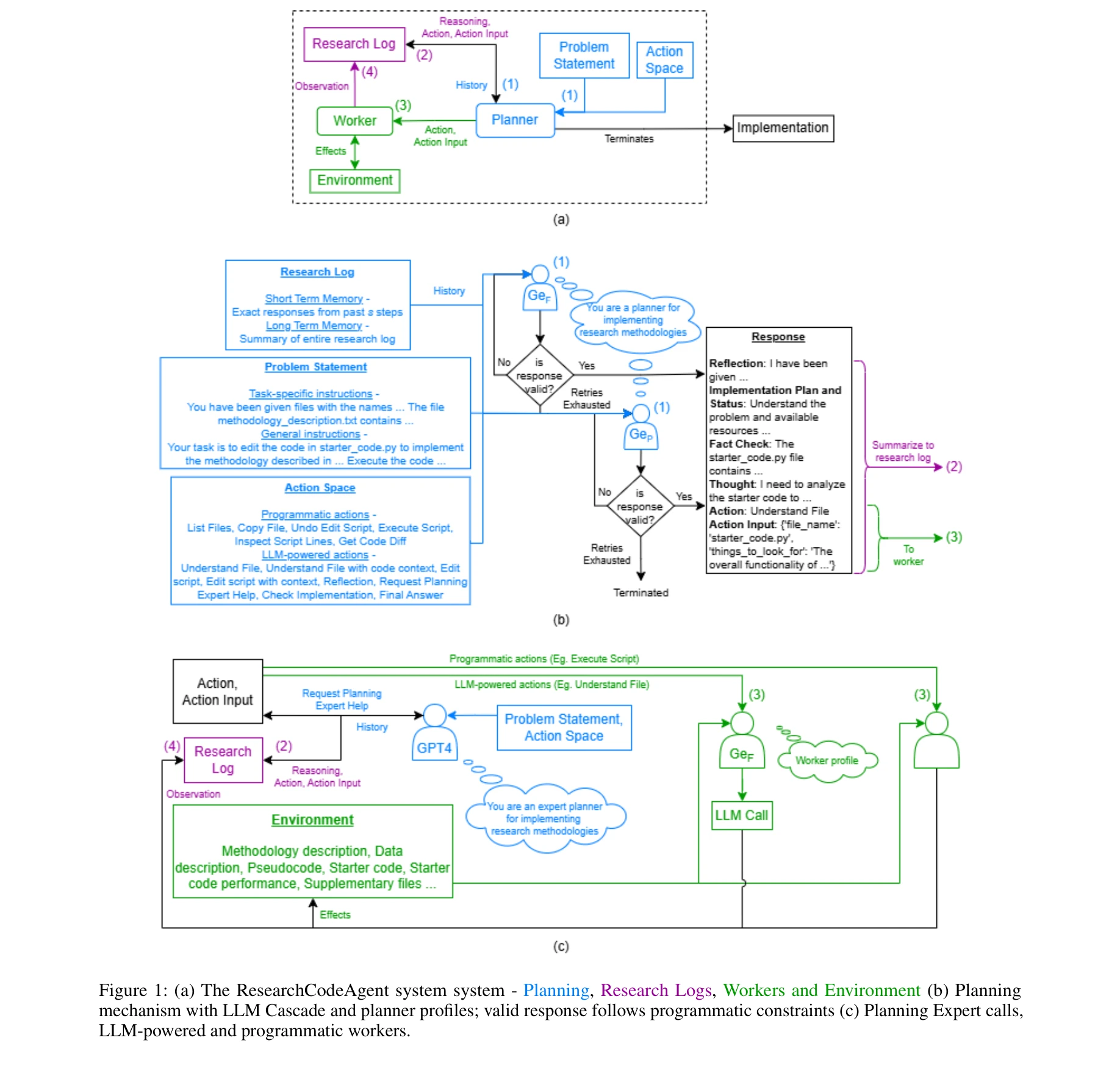

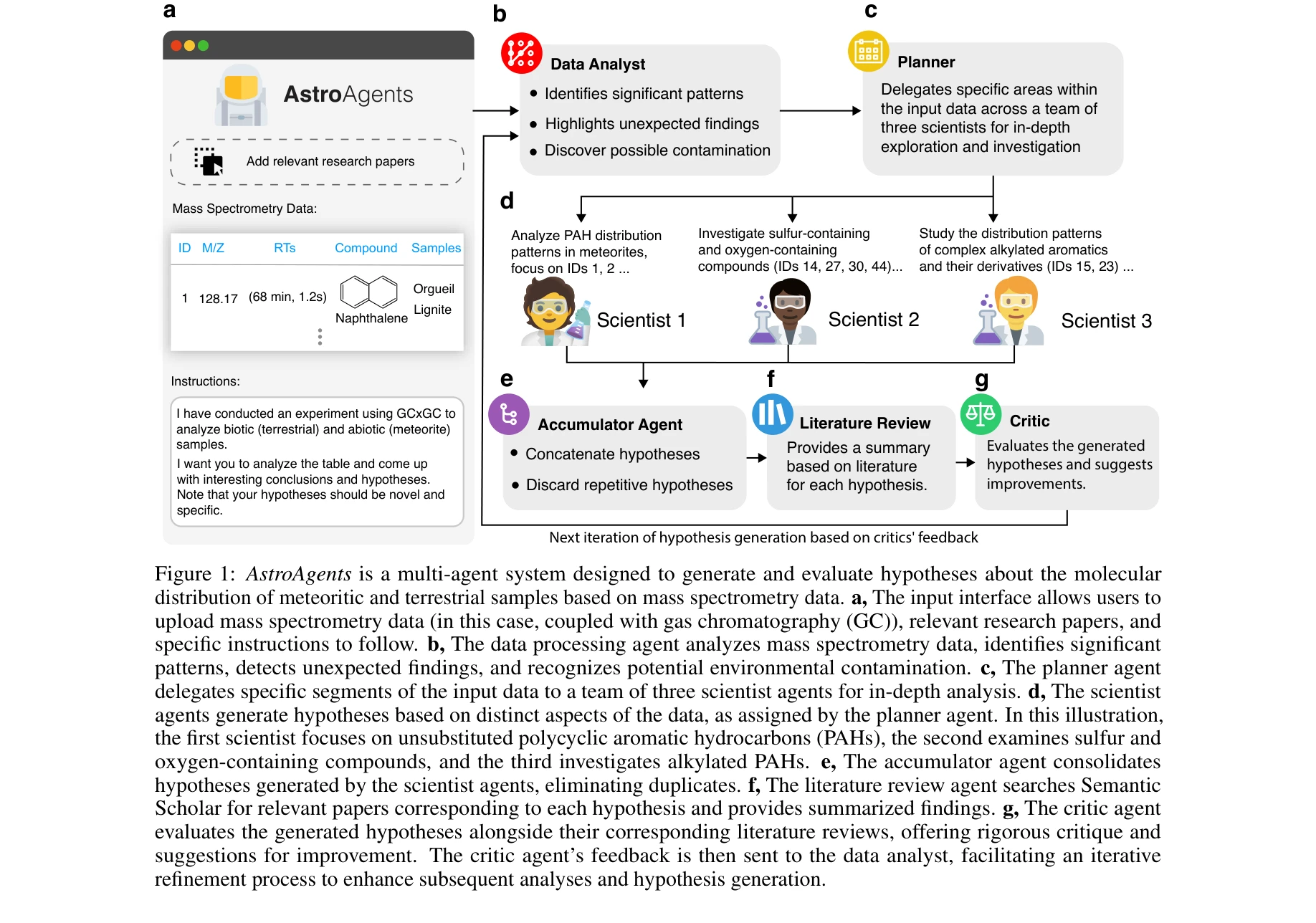

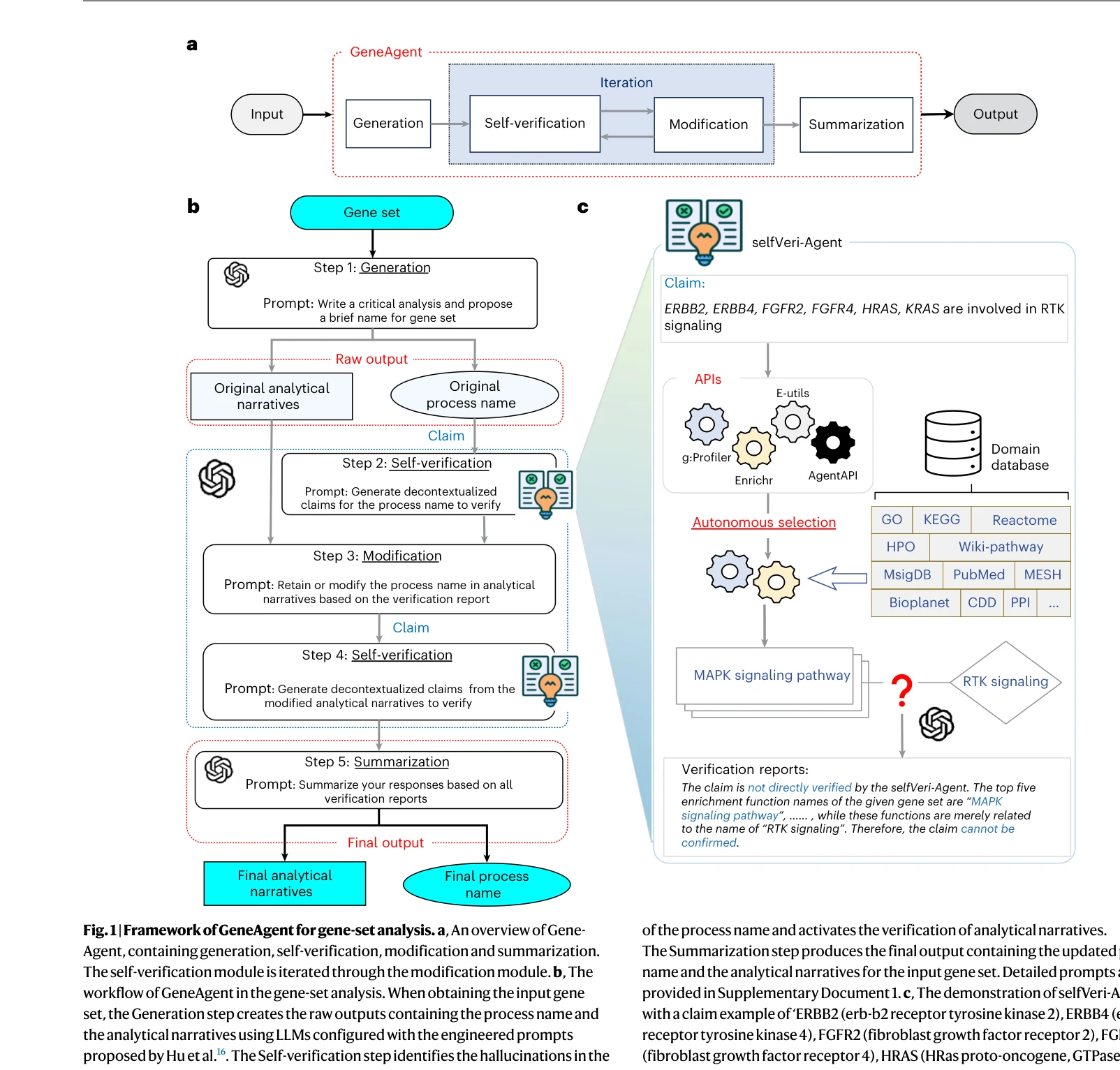

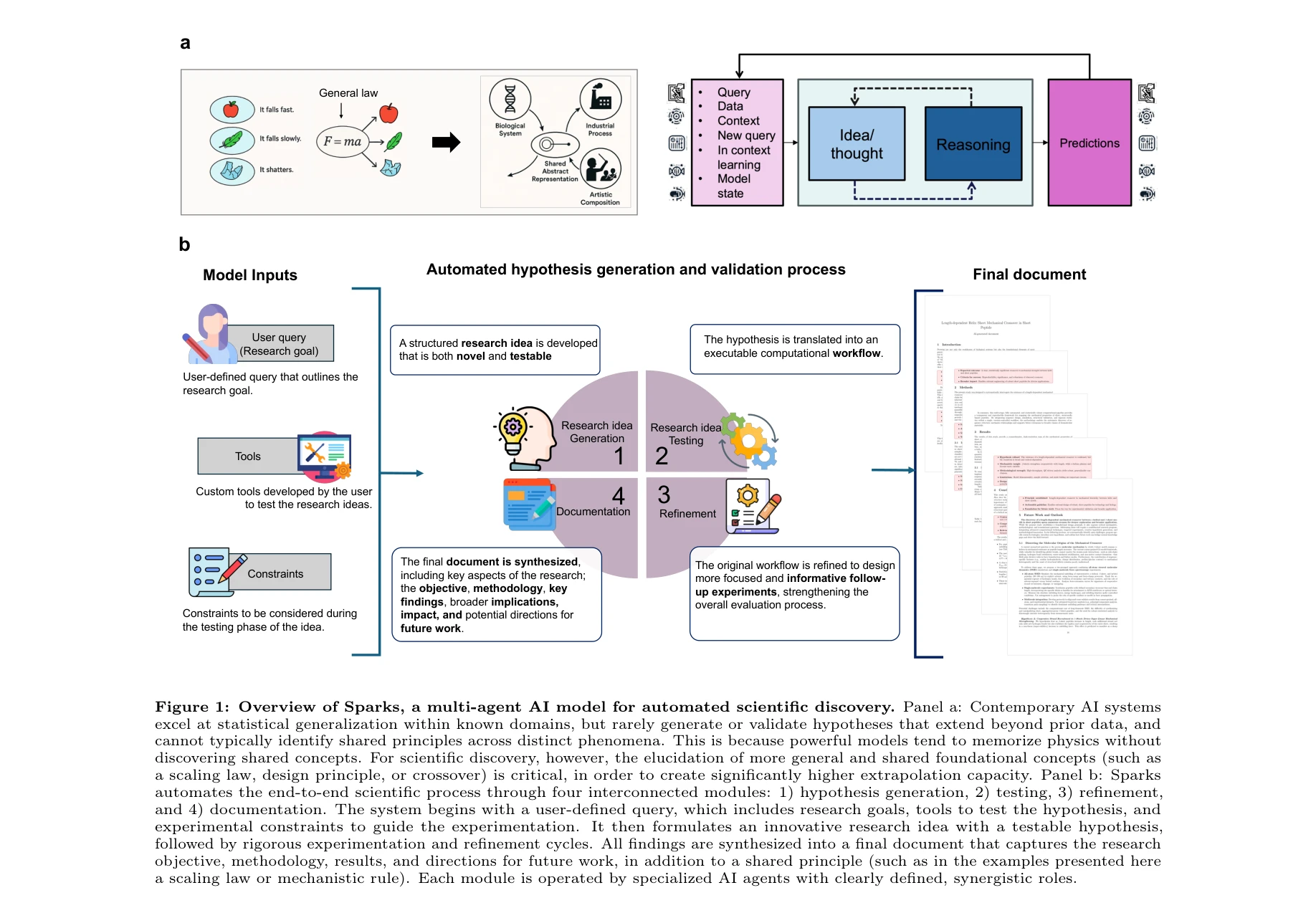

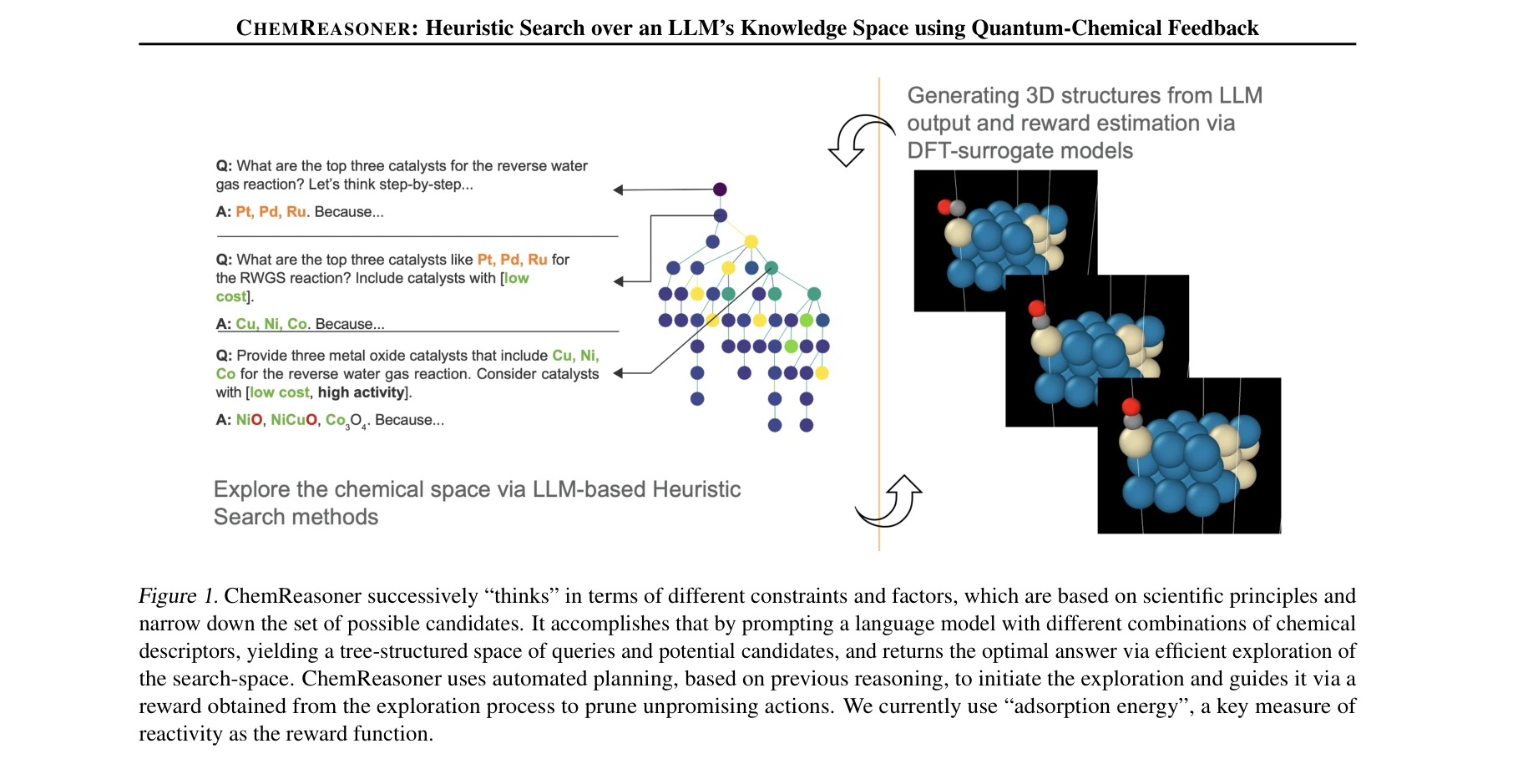

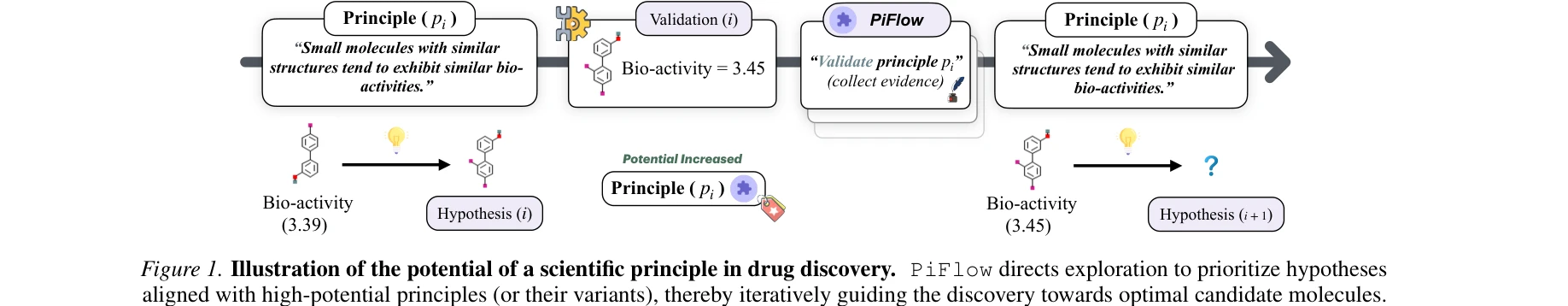

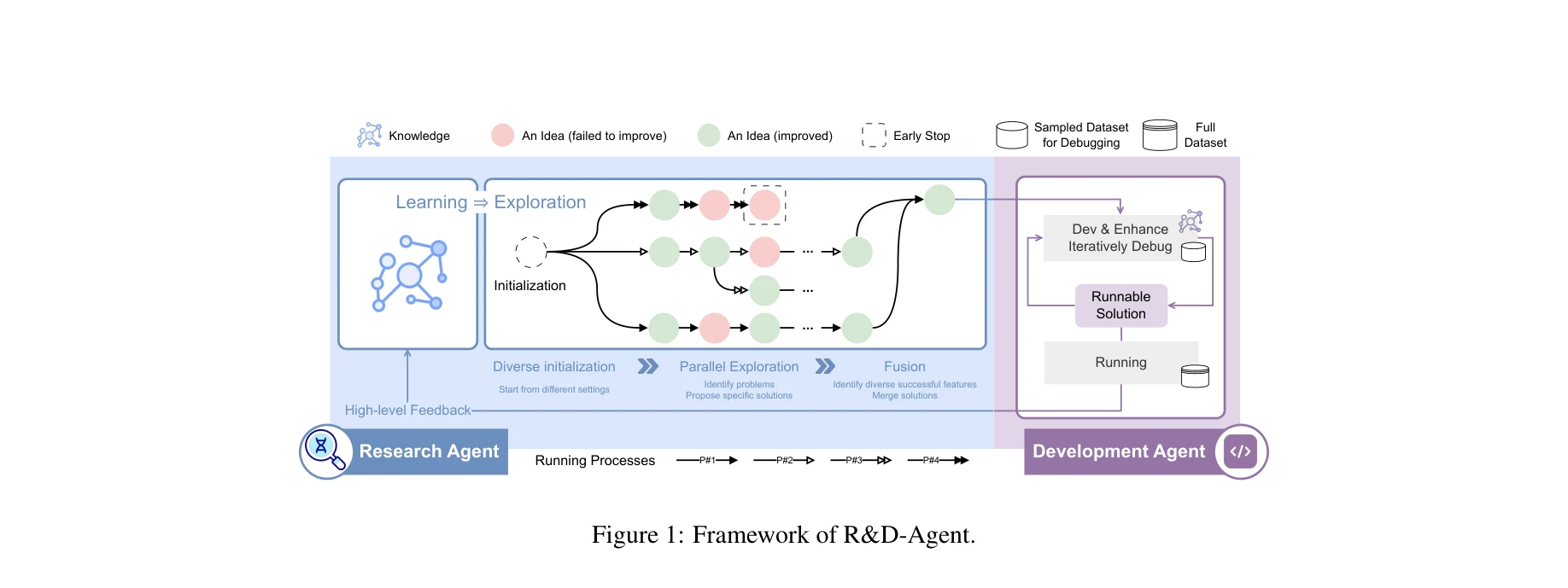

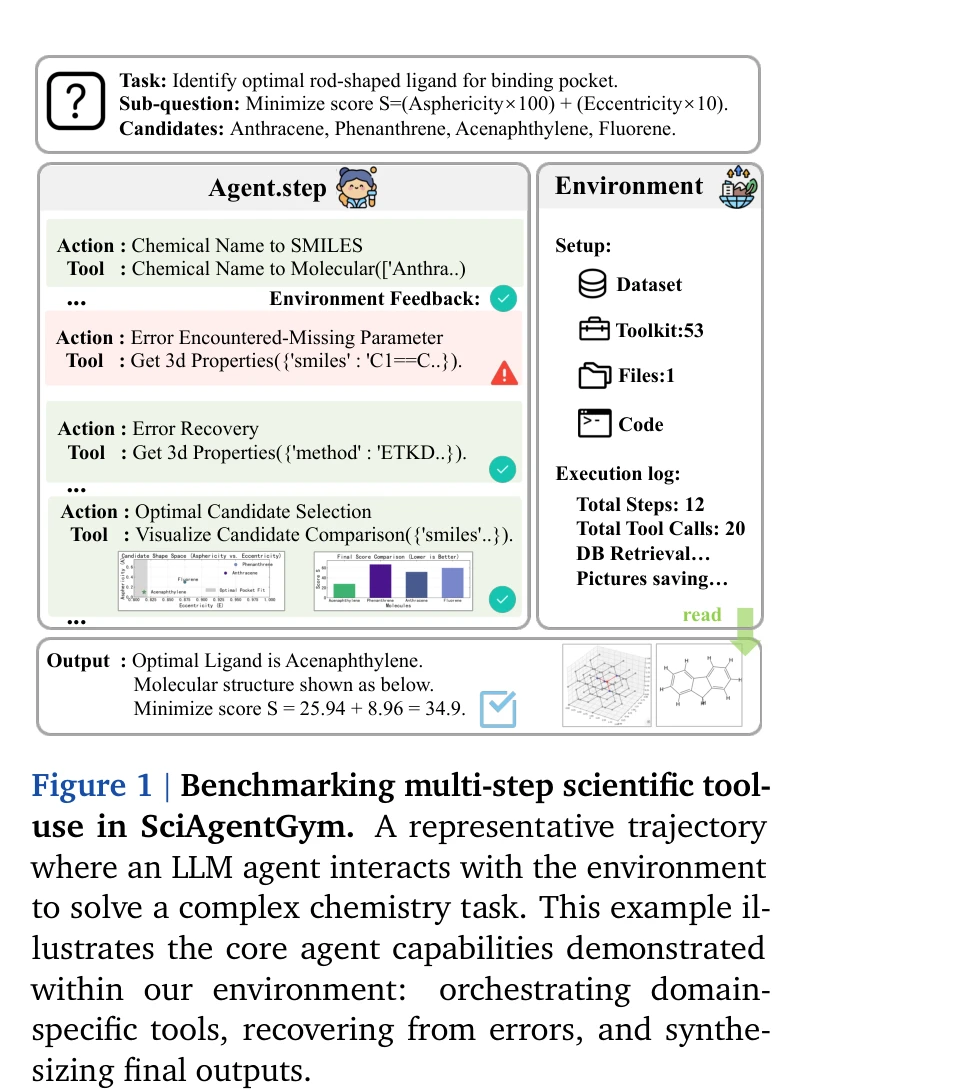

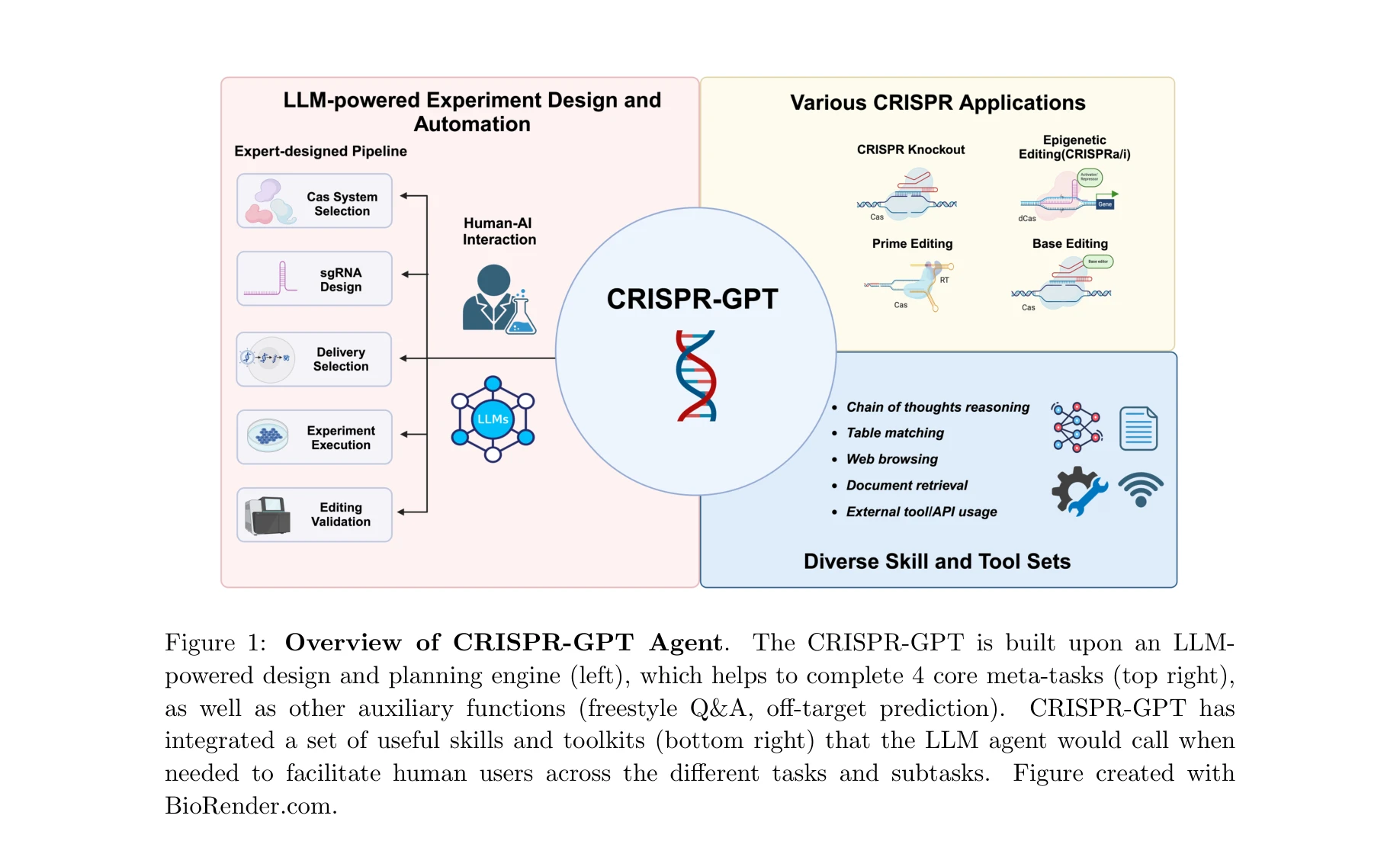

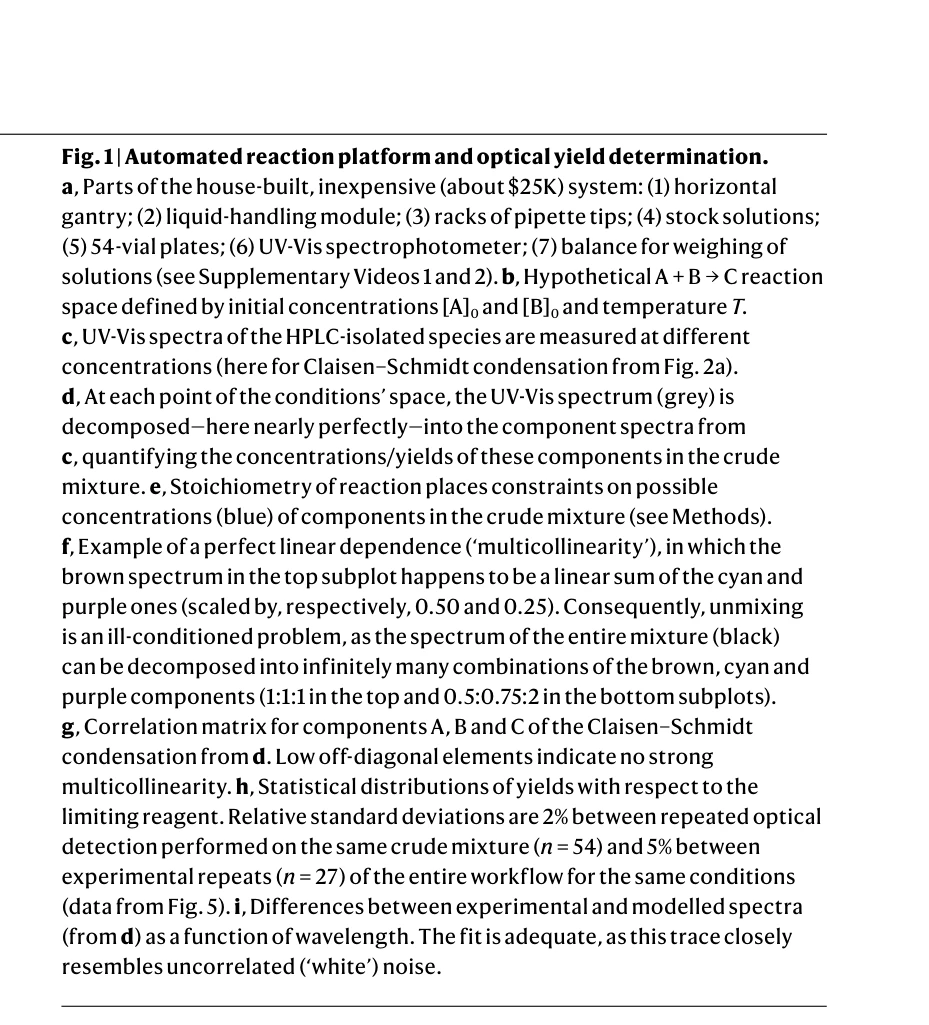

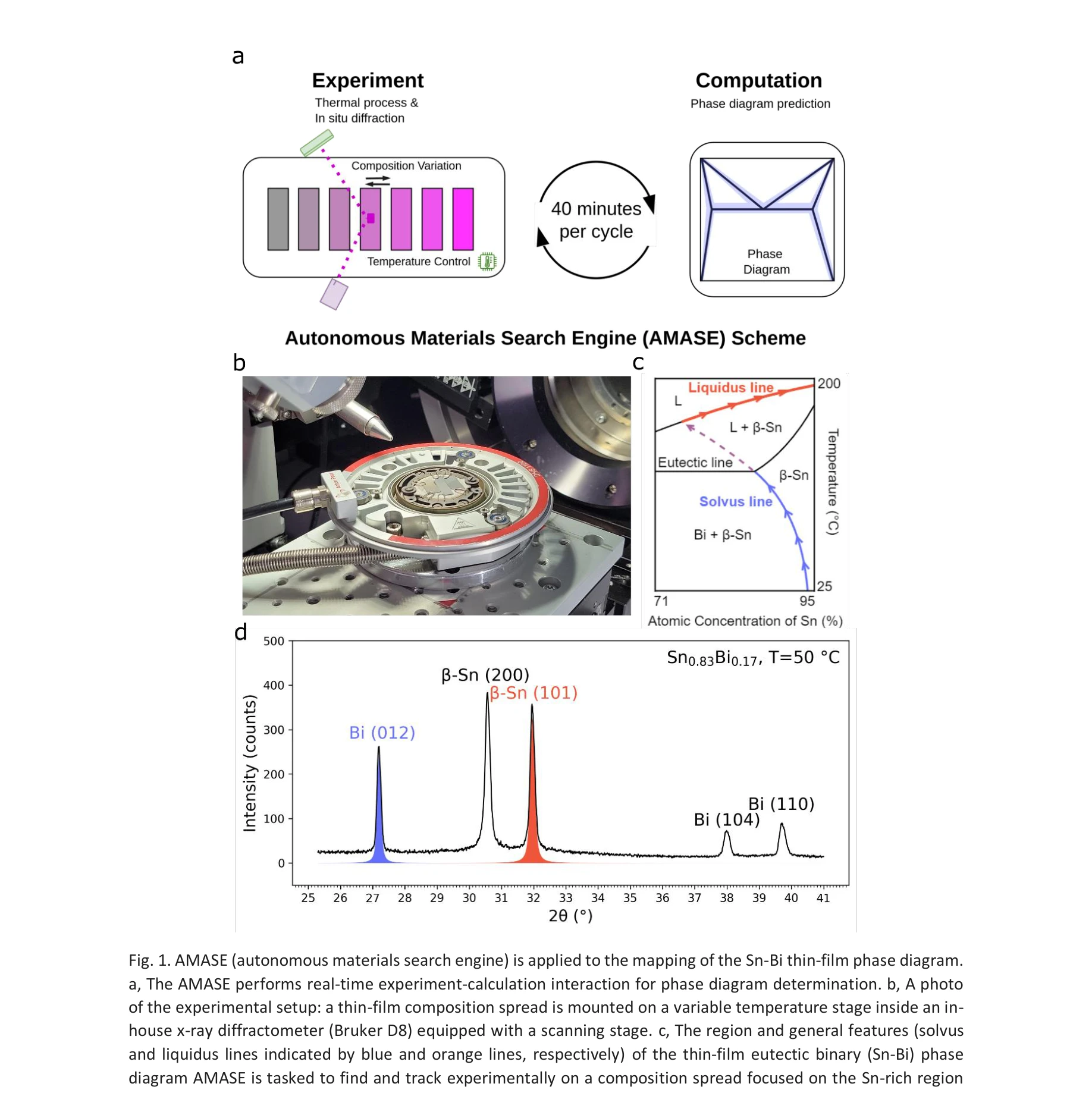

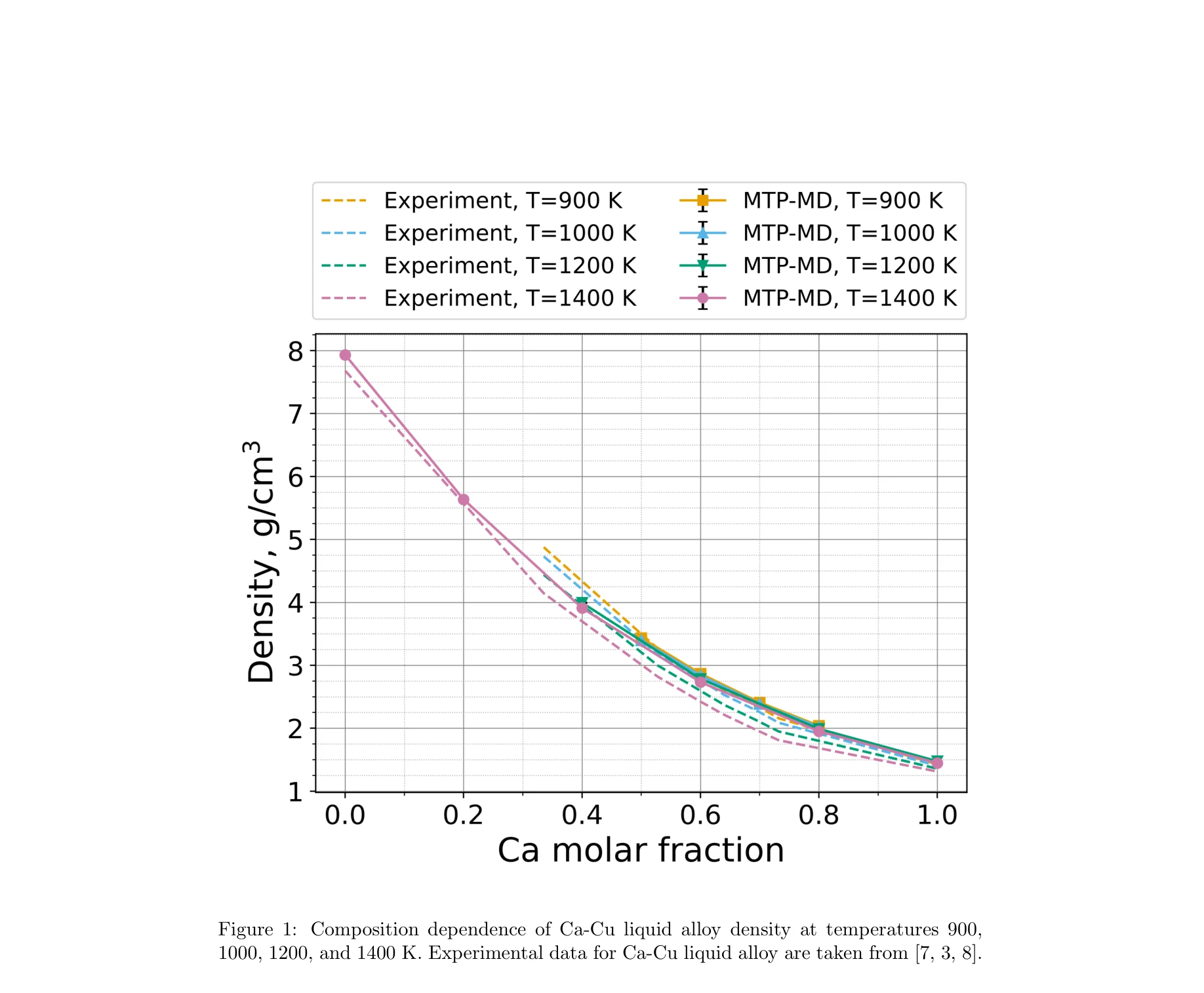

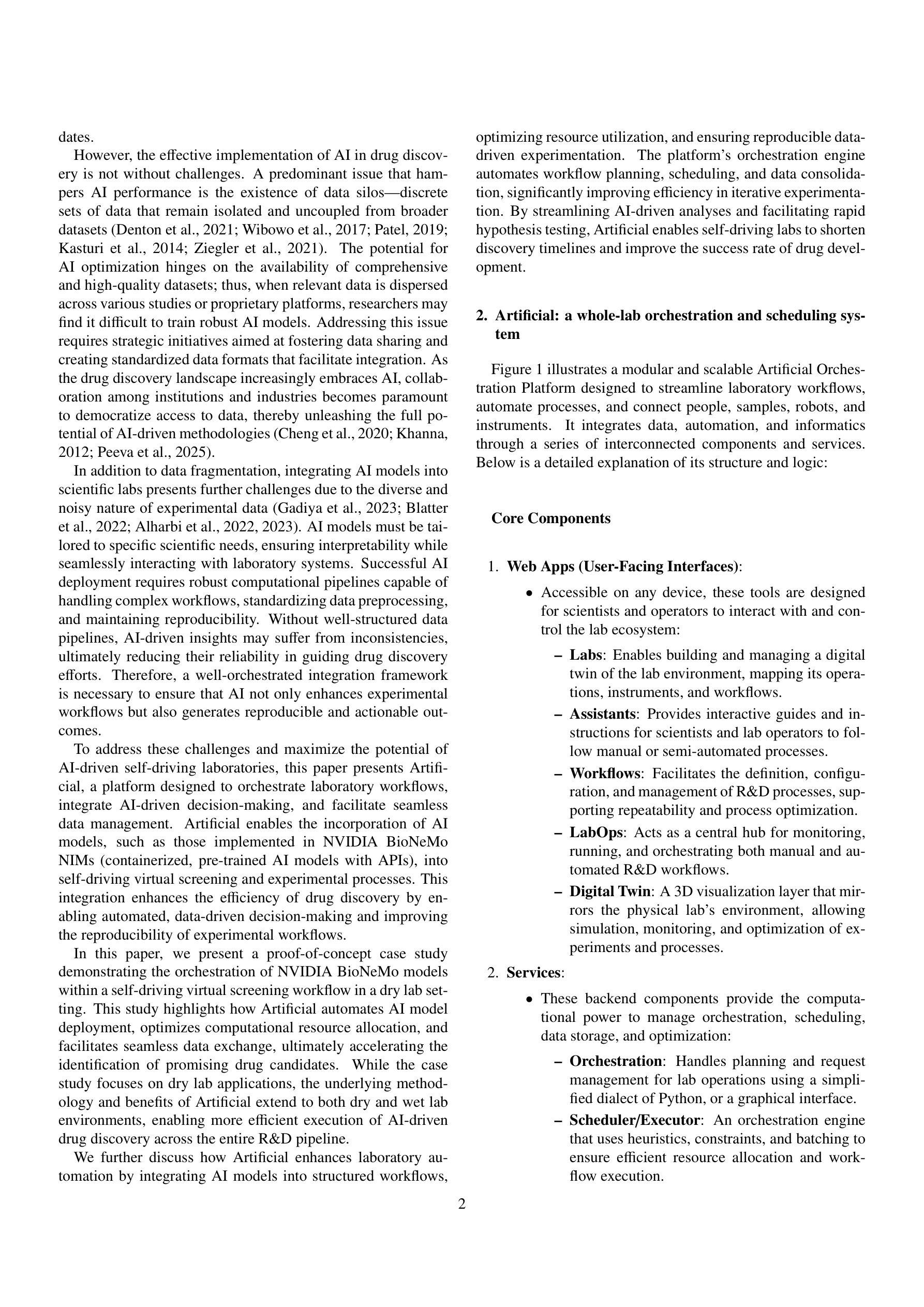

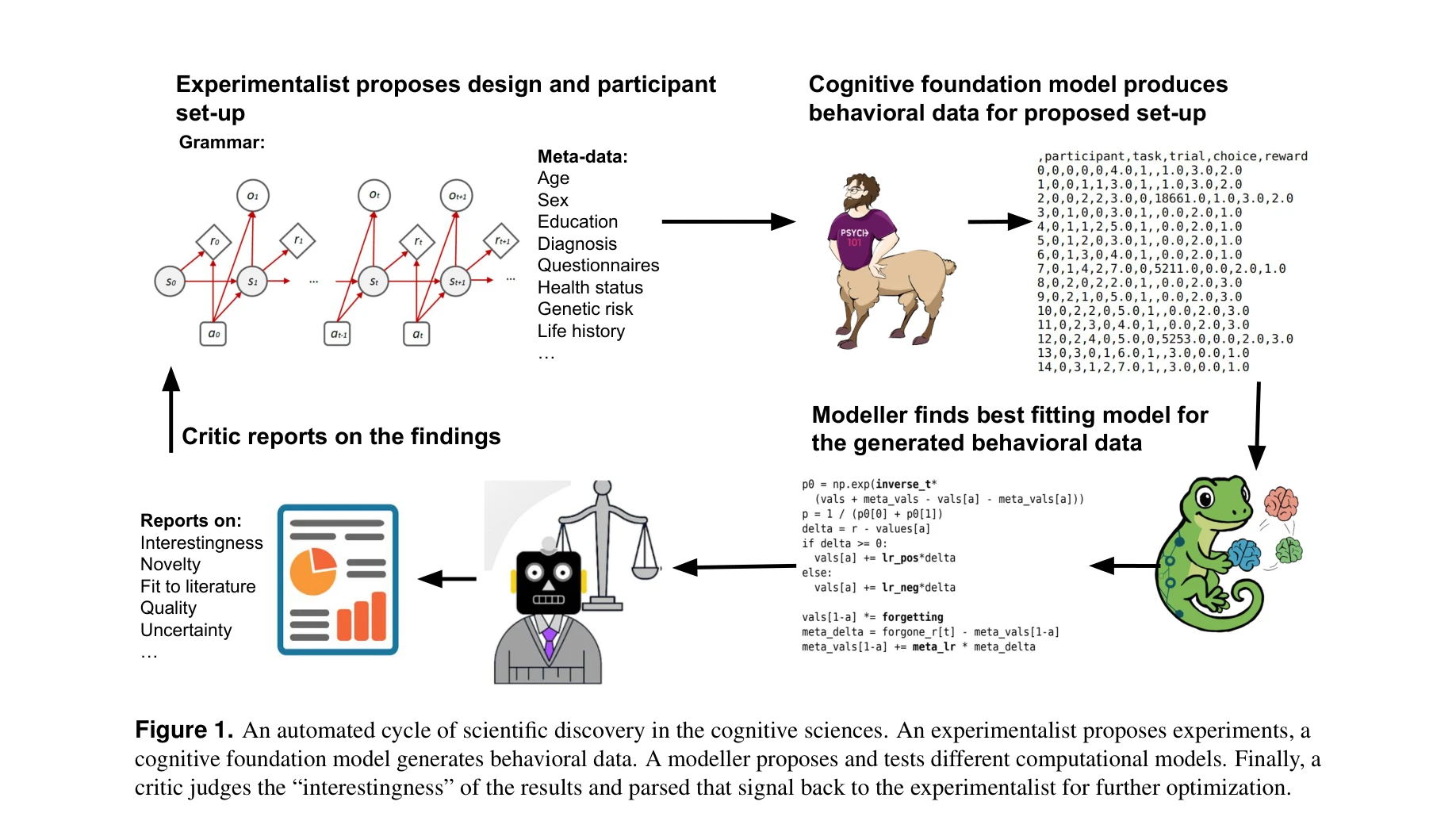

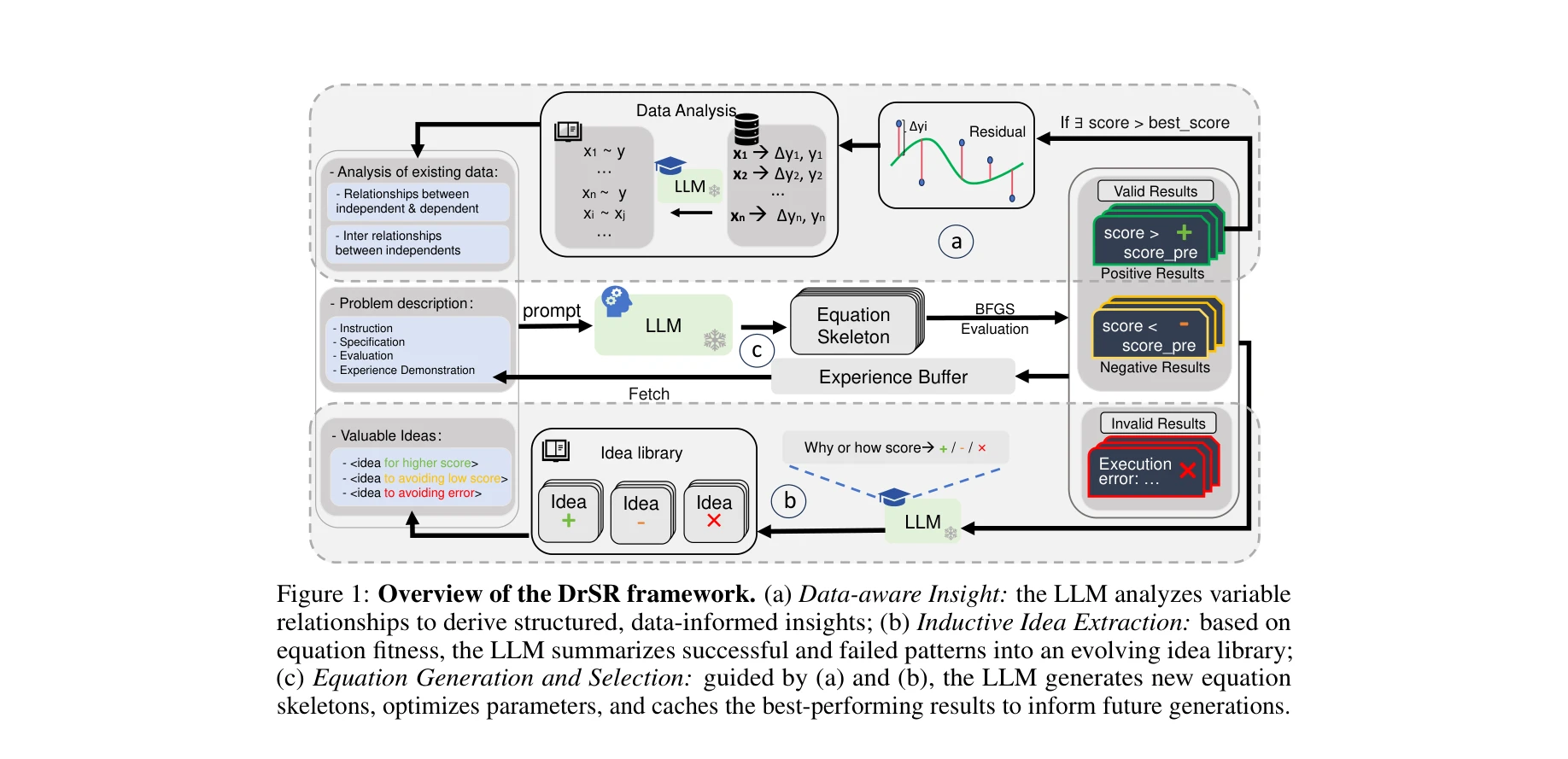

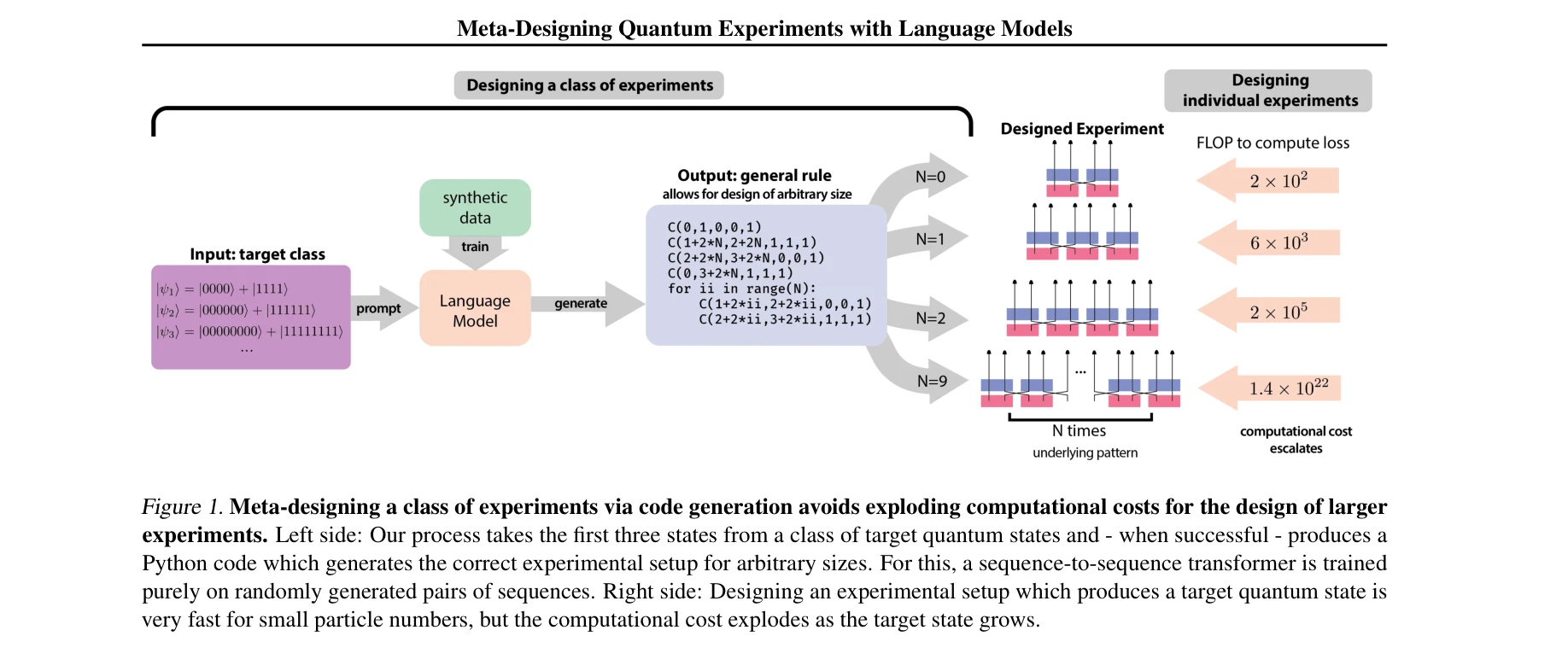

- Scientific Agent Experimentation: Scientific Agent Experimentation은 AI 에이전트가 과학적 발견과 연구를 자동화하는 분야로, 자율 시스템이 실험 설계, 데이터 분석, 가설 검증을 독립적으로 수행하는 것을 목표로 합니다. [052]에서는 Foundation Agents의 발전 과정과 직면한 과제들을 다루며, [137]에서는 과학적 발견을 위해 여러 AI 모듈을 조율하는 자율 에이전트의 구조를 제시합니다. [308], [735], [848]은 각각 양자화학(Quantum Chemistry), 과학적 도구 활용(Scientific Tool), 치료 추론(Therapeutic Reasoning) 분야에 특화된 전문 에이전트들을 소개하여, 도메인 특정 지식 그래프와 물리 기반 추론을 통합하는 방식을 보여줍니다. [072], [111]은 자동 실험실(Self-driving Laboratories)과 합금 설계(Alloy Design) 같은 실제 응용 사례를 통해 AI 에이전트가 반복적인 실험과 최적화를 가속화할 수 있음을 입증합니다. 이러한 연구들은 AI가 과학 연구의 효율성을 혁신적으로 높일 수 있는 가능성을 제시하는 동시에, 신뢰성 있는 추론과 다학제 협업 구현의 중요성을 강조합니다.

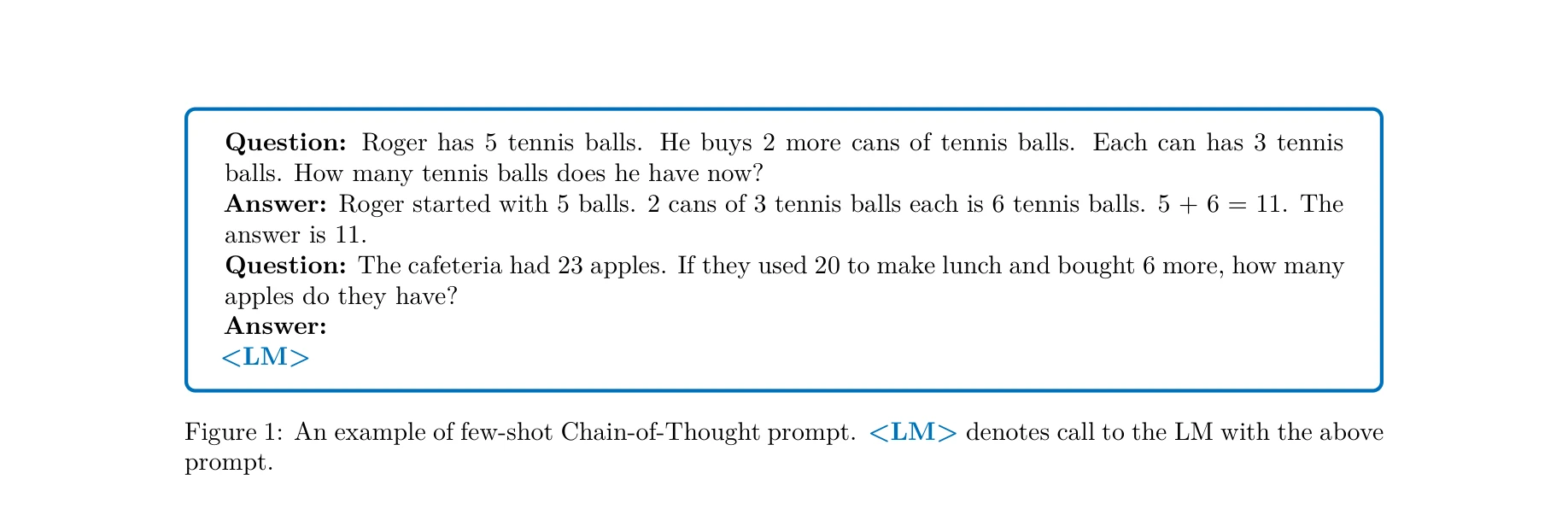

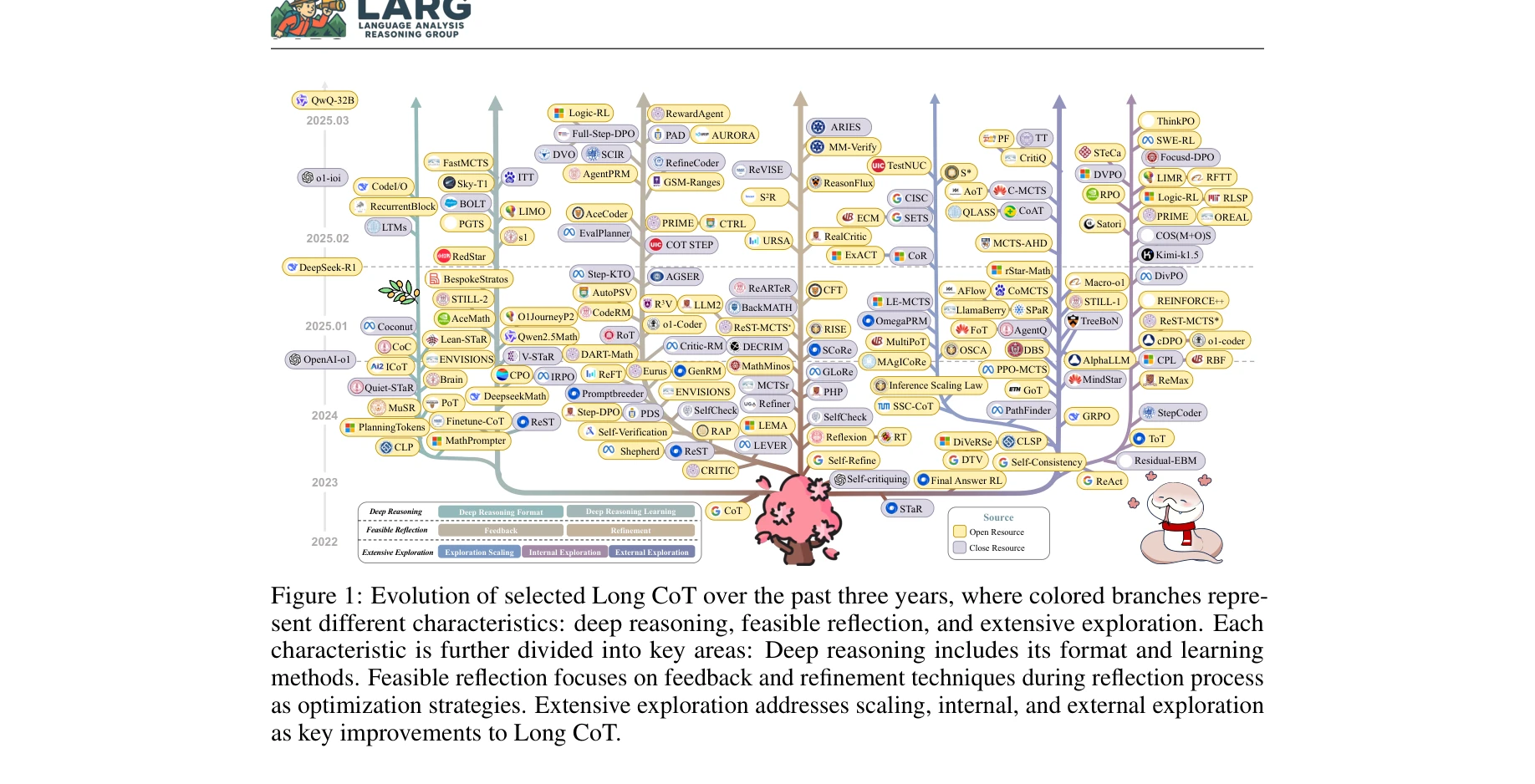

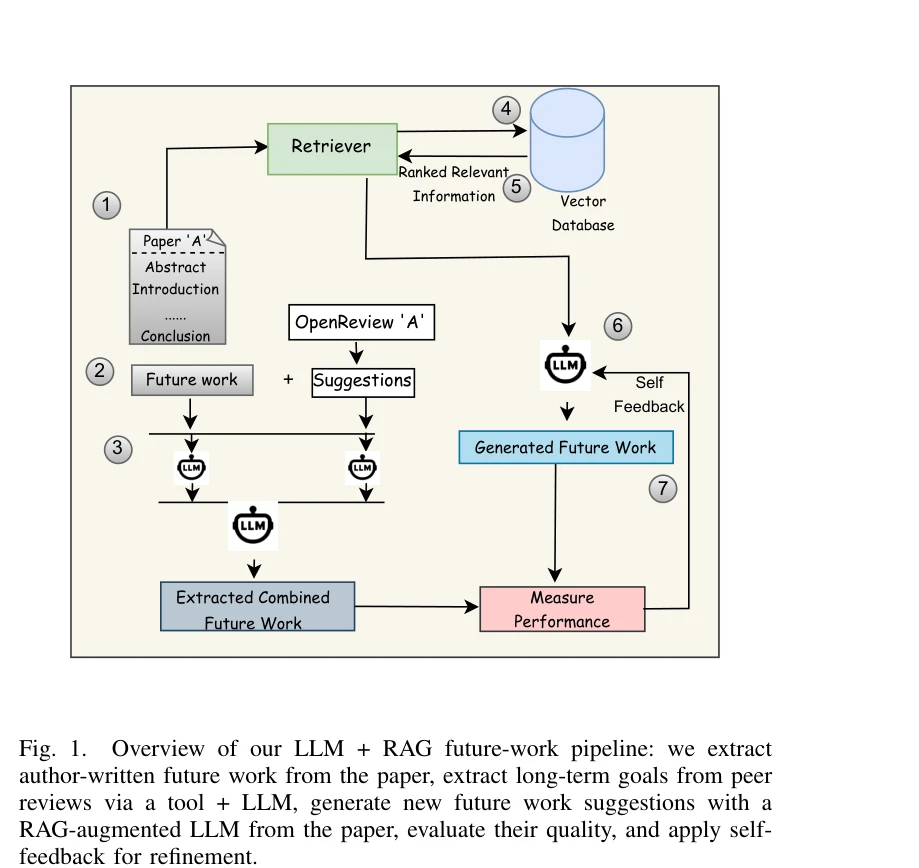

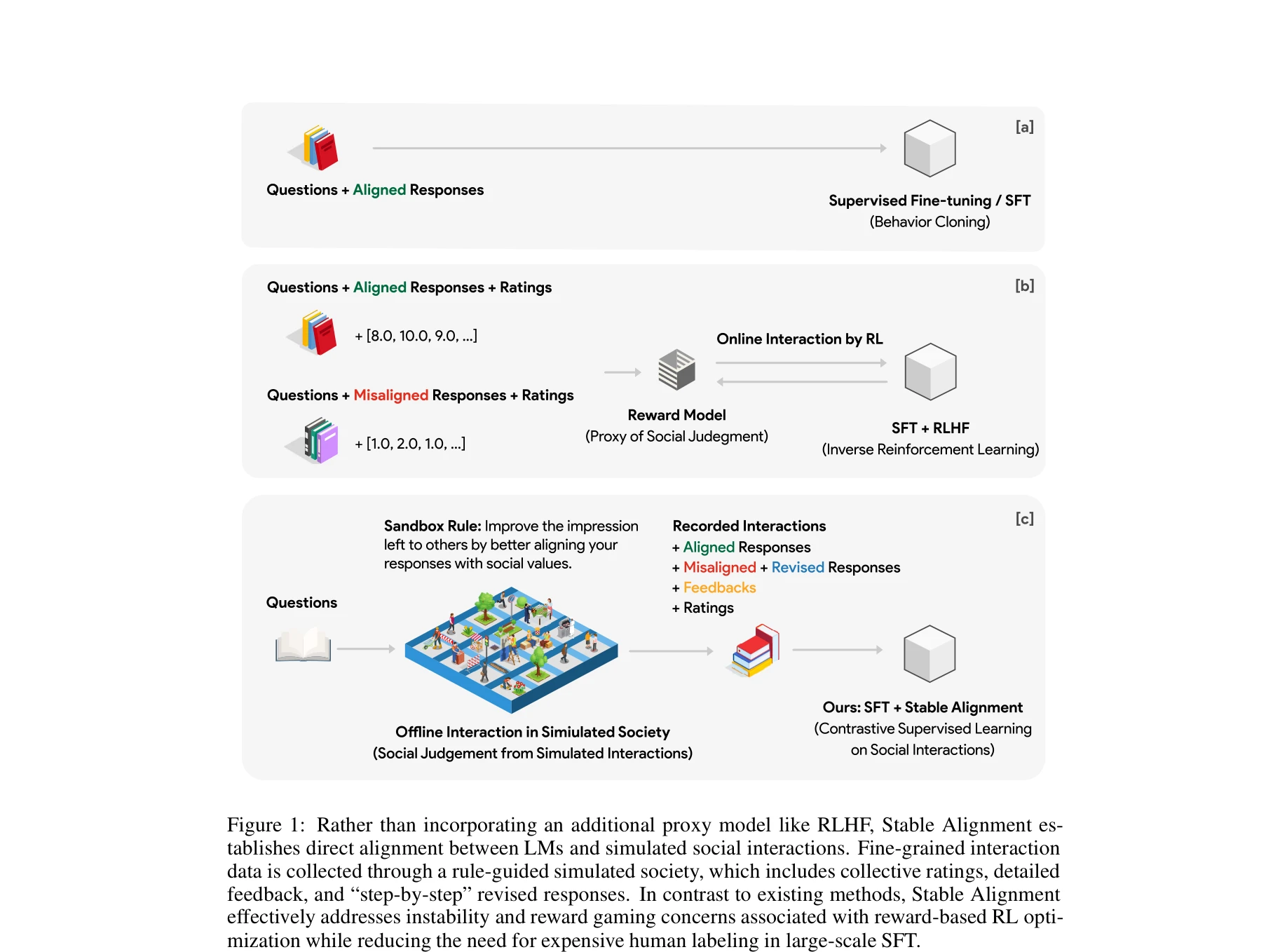

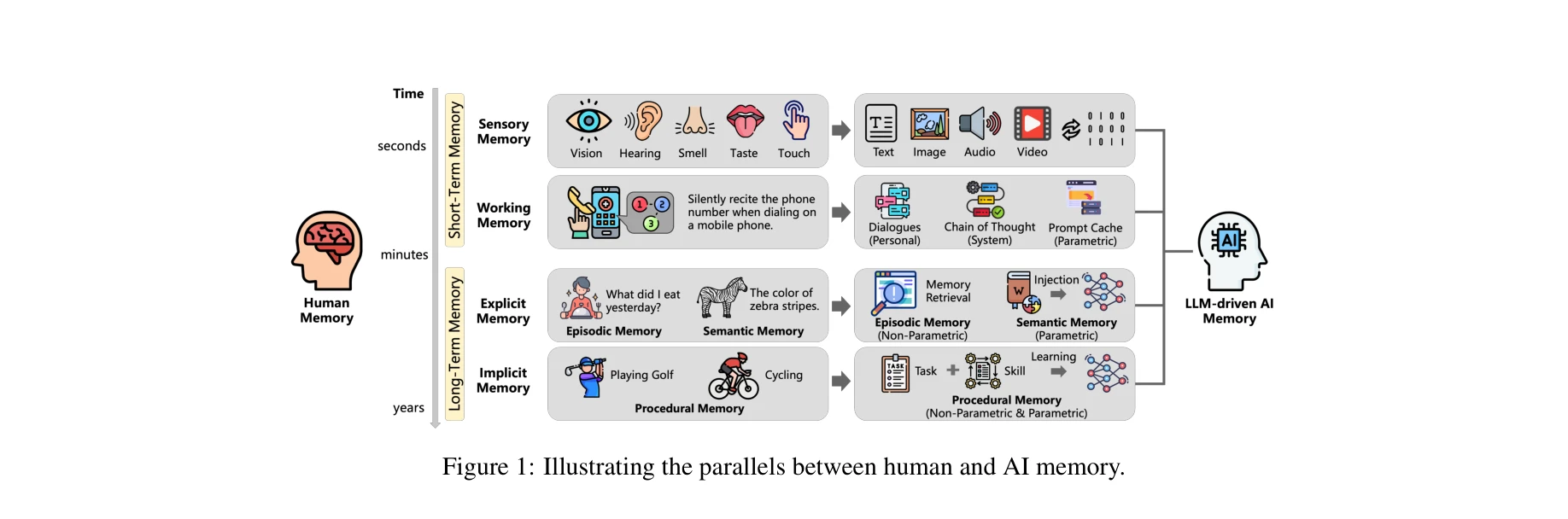

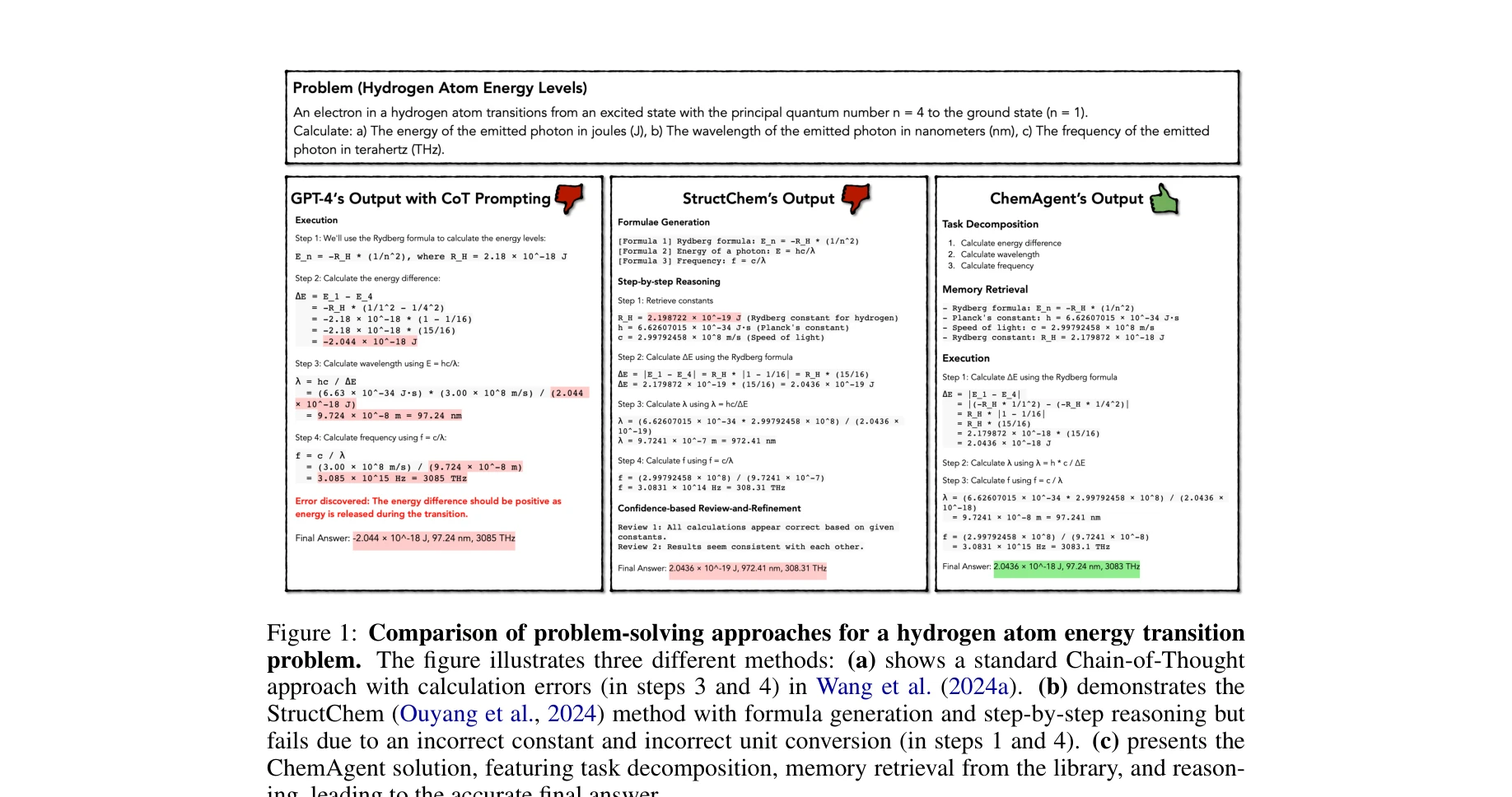

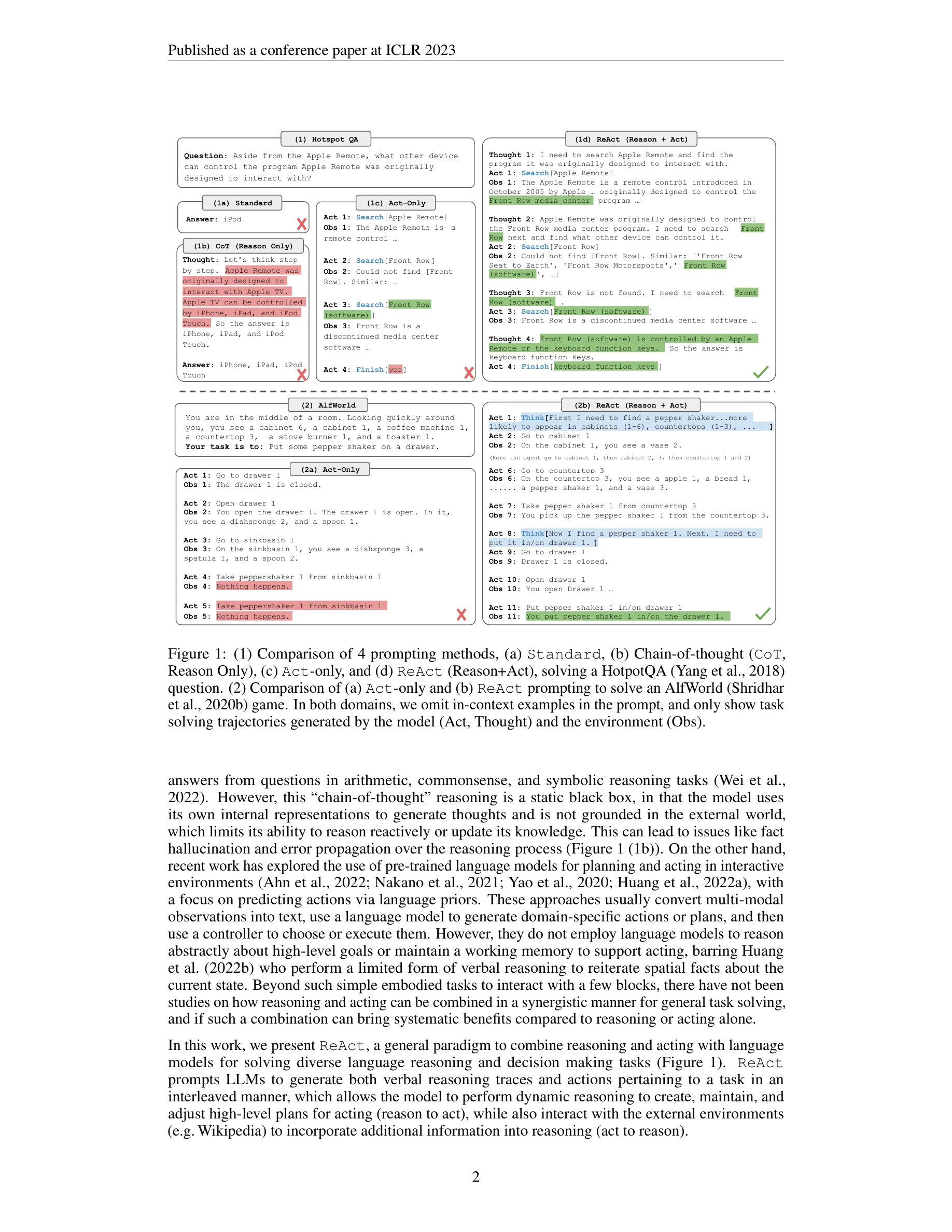

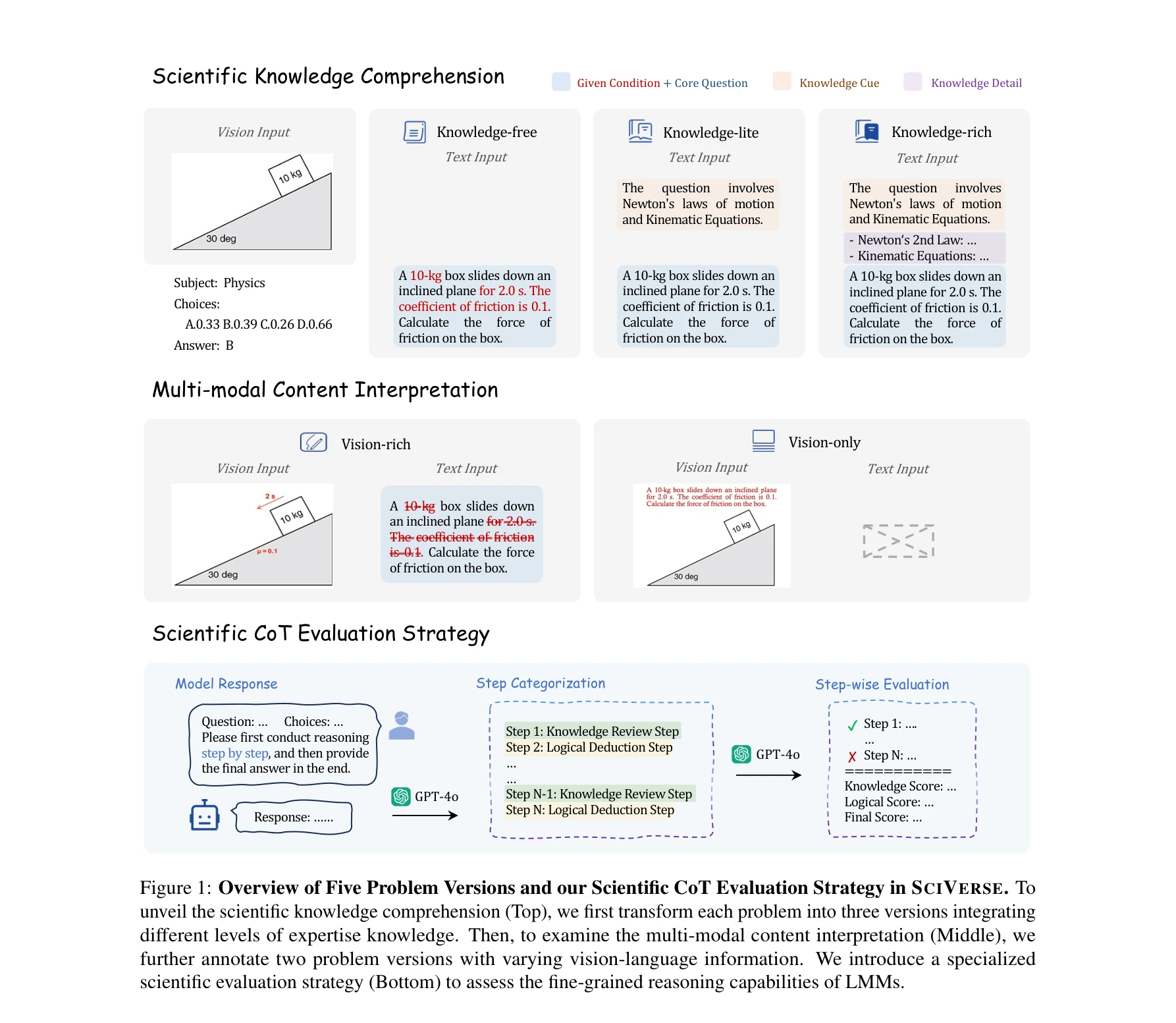

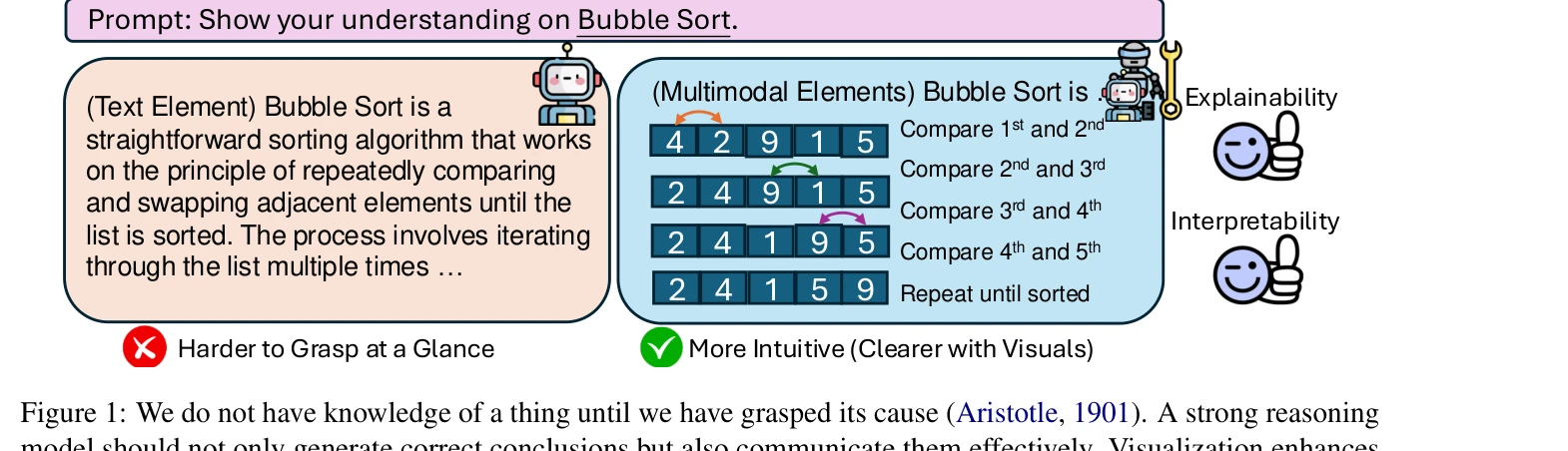

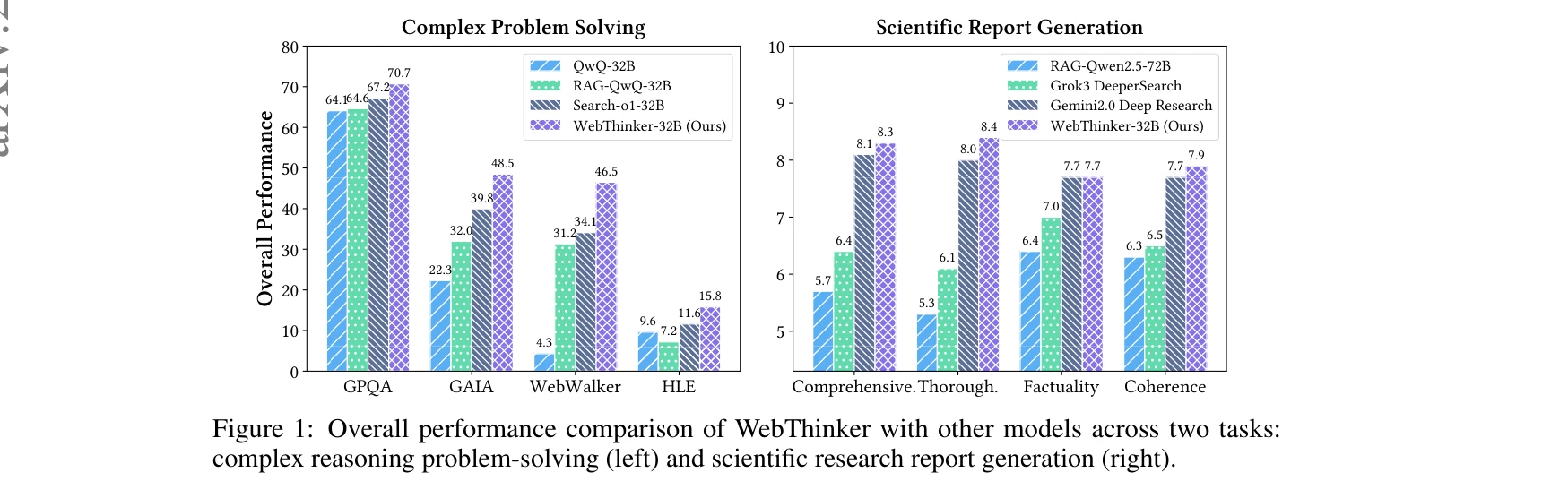

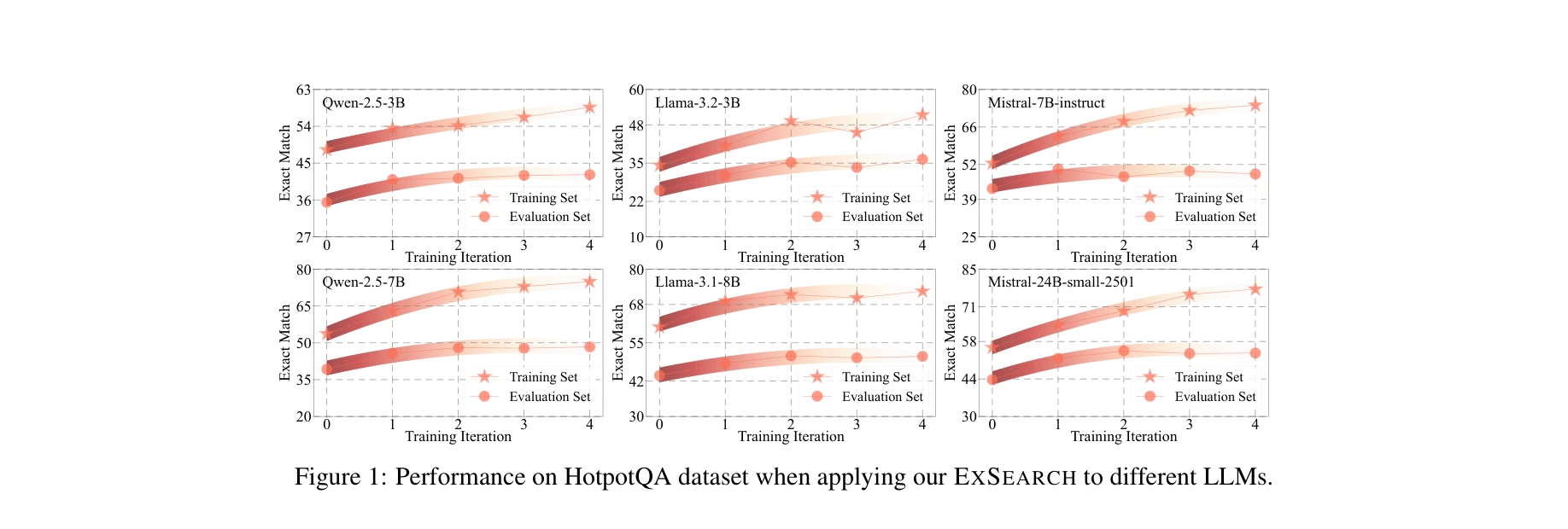

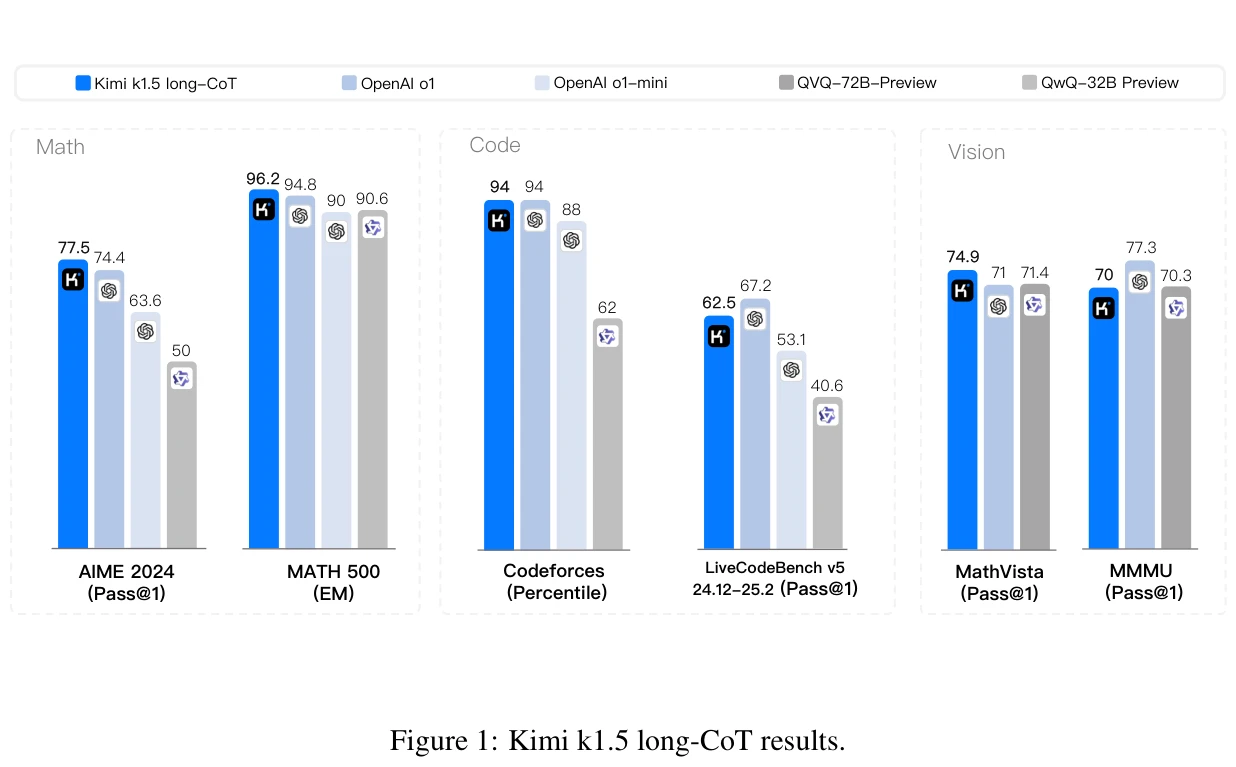

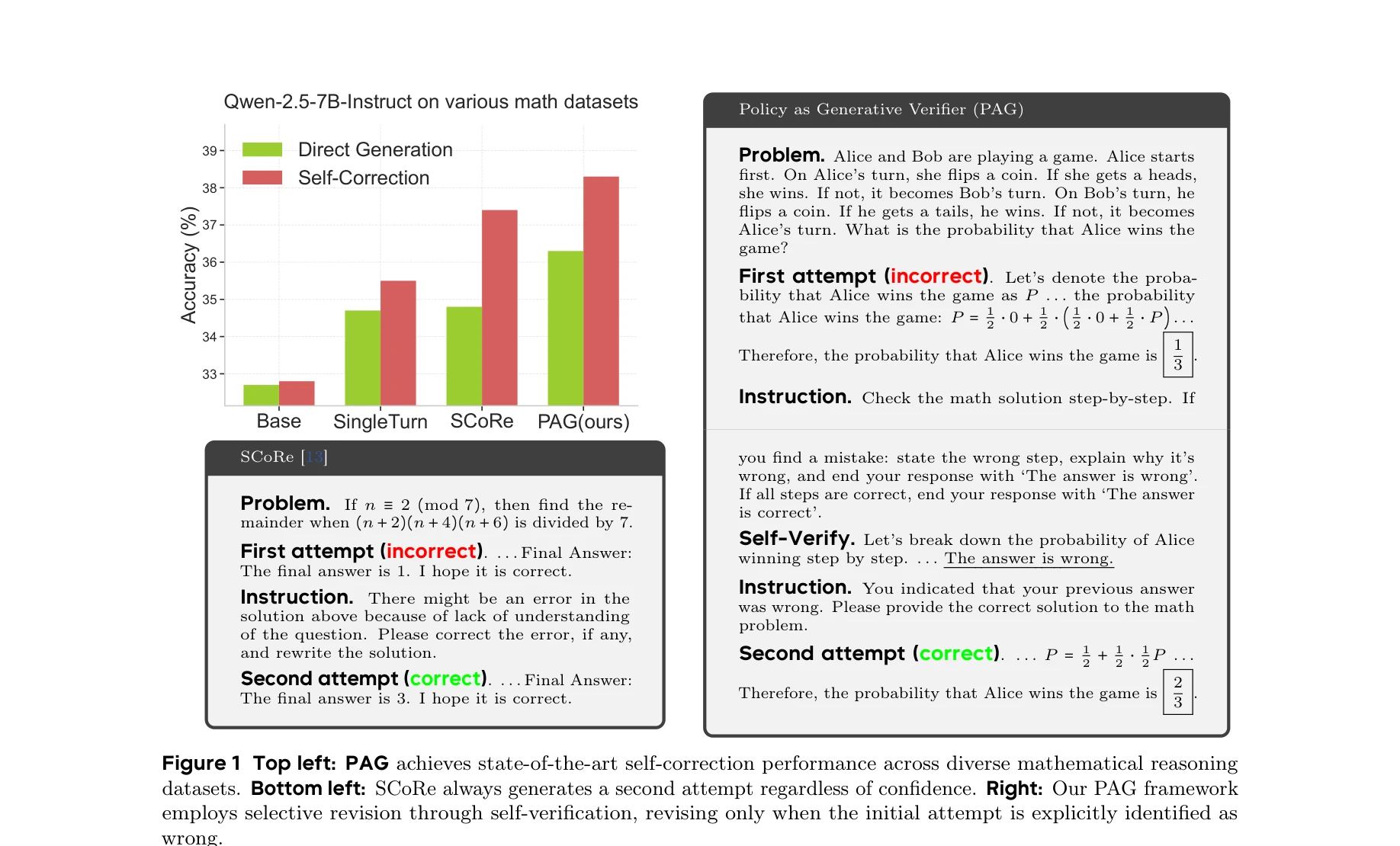

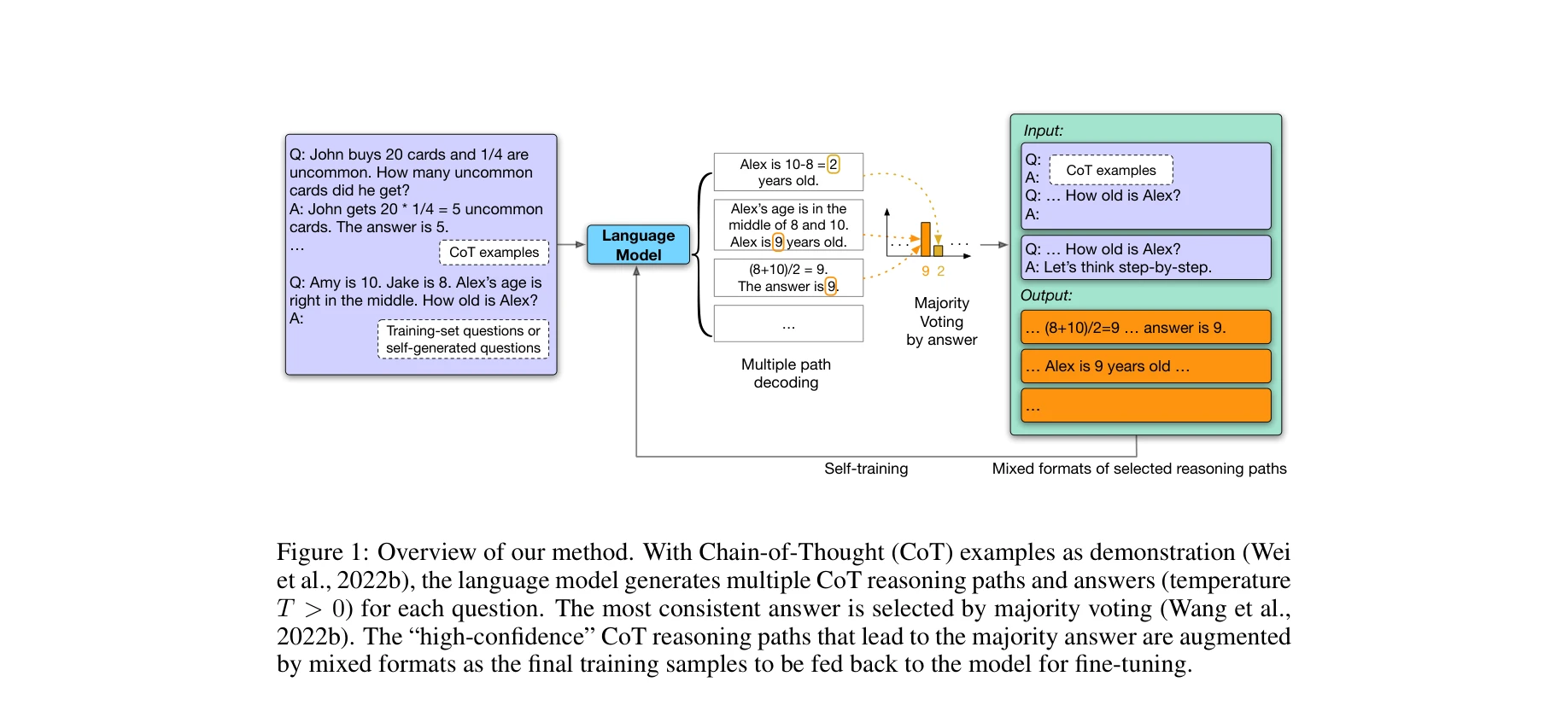

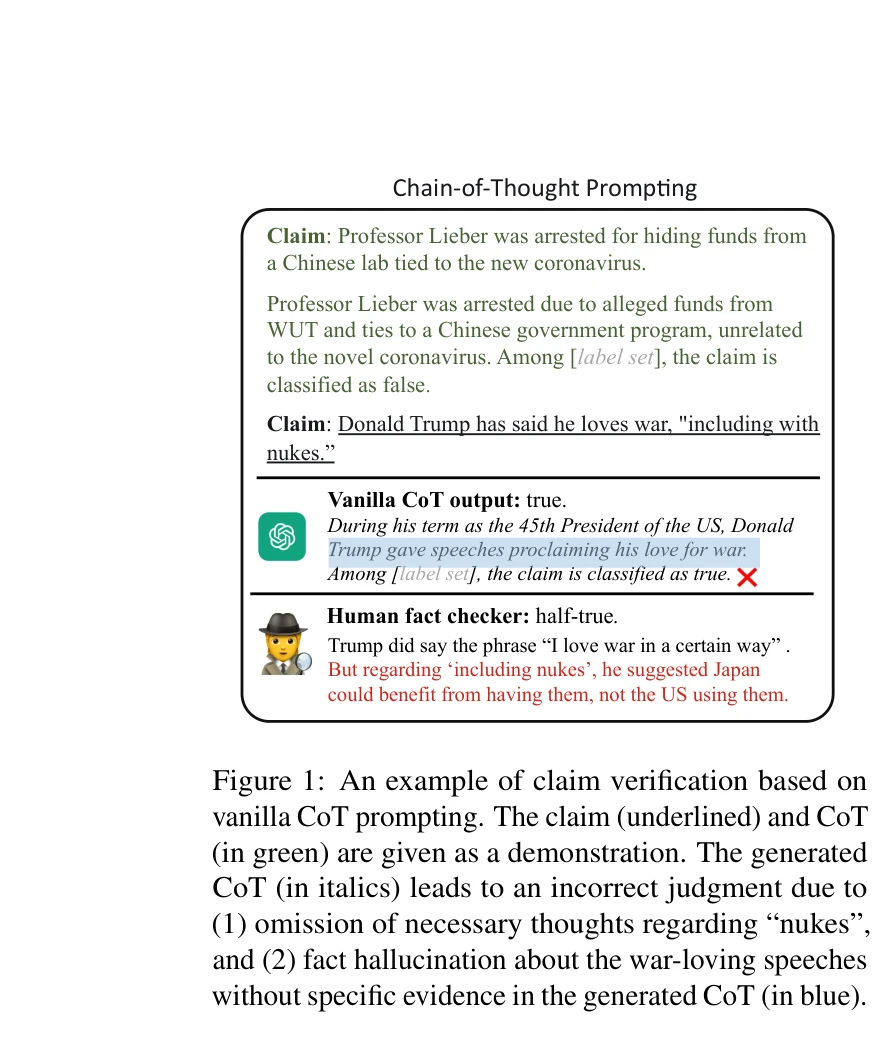

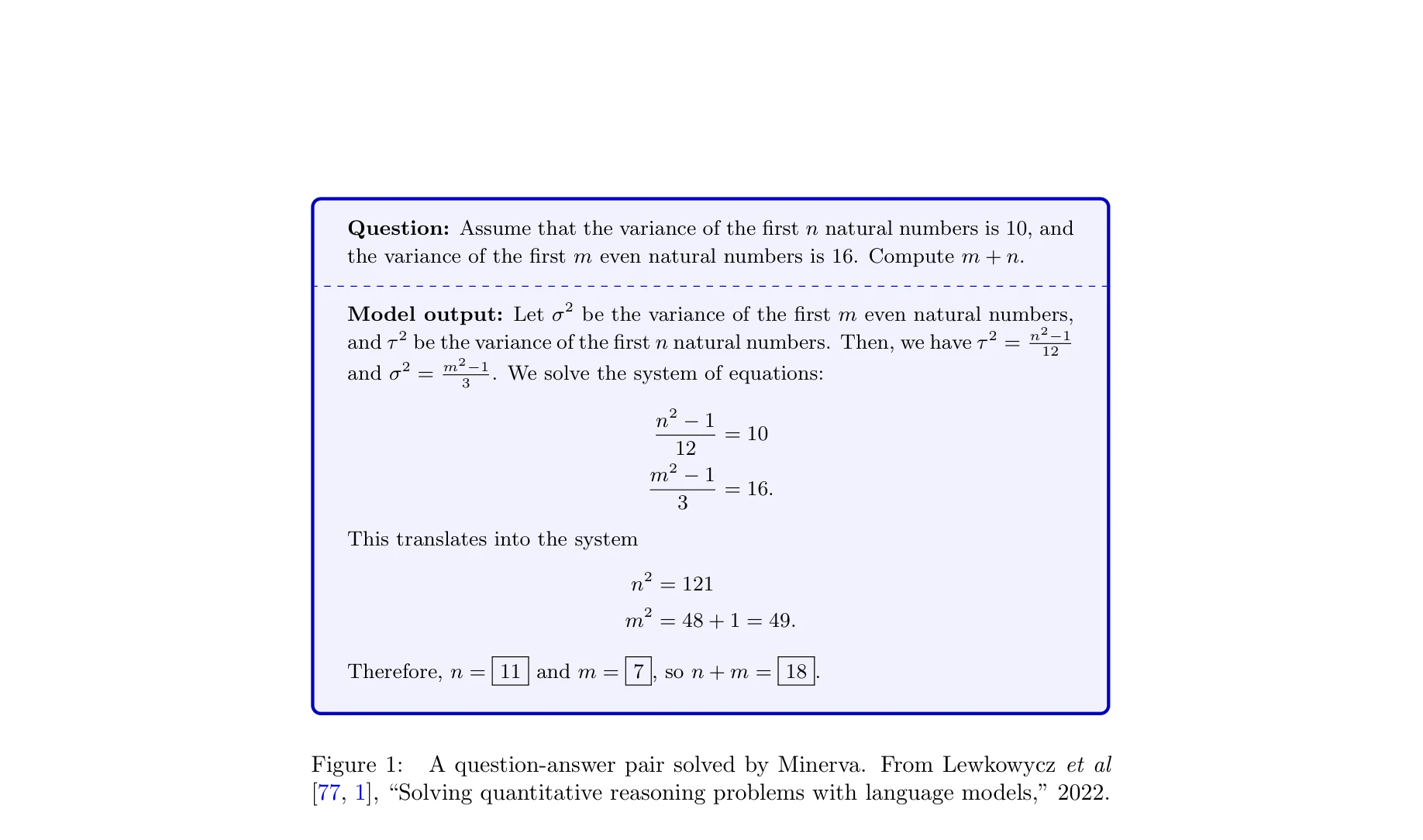

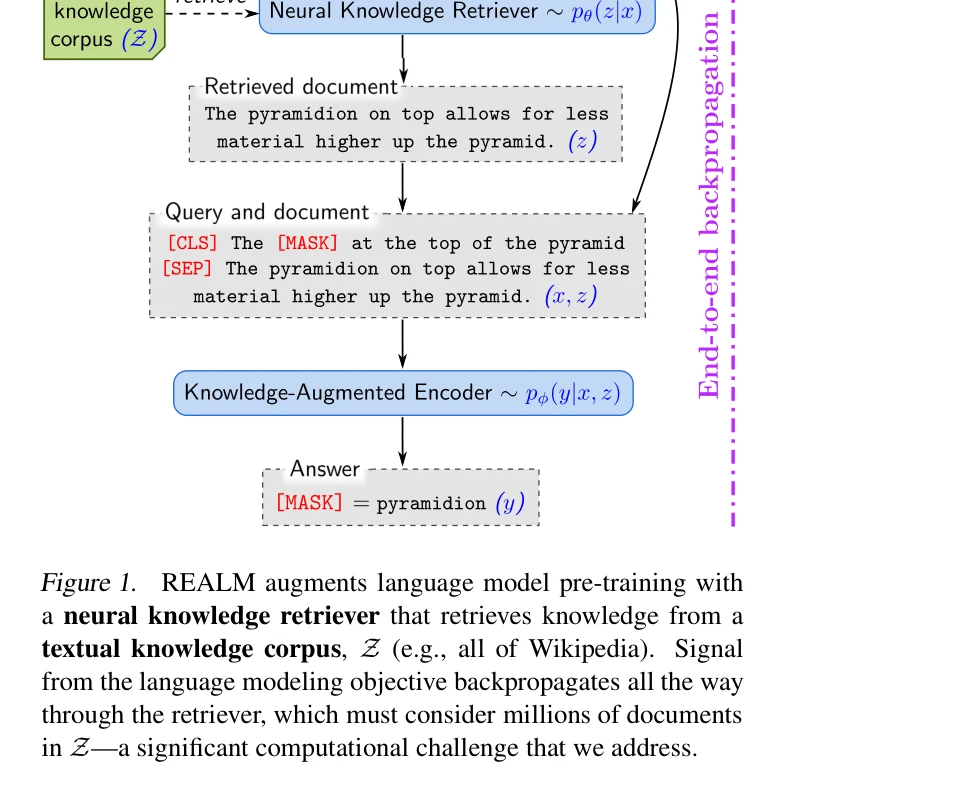

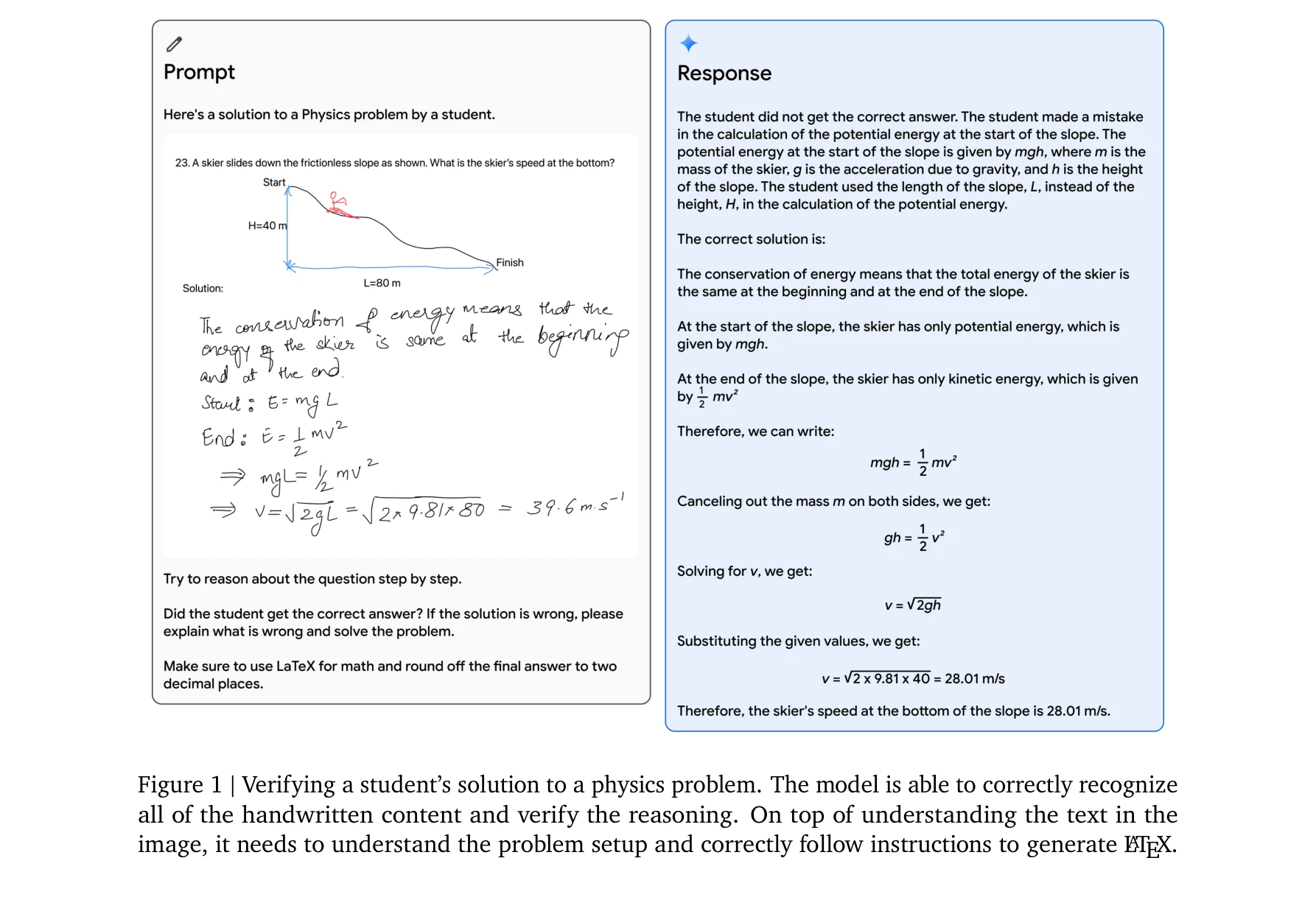

- Chain-of-thought Reasoning Systems: Chain-of-thought Reasoning Systems는 대규모 언어모델(Large Language Models, LLM)이 복잡한 문제를 단계적으로 분해하여 추론하는 능력을 강화하는 AI 기반 과학 연구 시스템입니다. [833]에서 다루는 장문의 사고 연쇄(Long Chain-of-Thought) 기법은 모델이 중간 단계의 논리를 명시적으로 표현하도록 유도하여 추론의 투명성과 정확성을 크게 향상시킵니다. [675]의 검색 증강 생성(Retrieval-Augmented Generation, RAG) 방식은 외부 지식 소스를 활용하여 모델의 추론 능력을 보완하고 과학적 근거를 제공합니다. [320]과 [026]에서 강조하는 것처럼, 코드 학습 및 대규모 언어모델의 기초 연구는 더욱 정교한 추론 시스템 개발의 토대가 됩니다. [785]의 멀티모달 교육 방식은 텍스트뿐 아니라 이미지와 같은 다양한 입력 형식에서도 연쇄 추론 능력을 강화하는 혁신적 접근입니다. 이러한 Chain-of-thought 기술들은 과학 연구의 자동화, 검증, 그리고 새로운 발견의 가속화에 기여하고 있습니다.

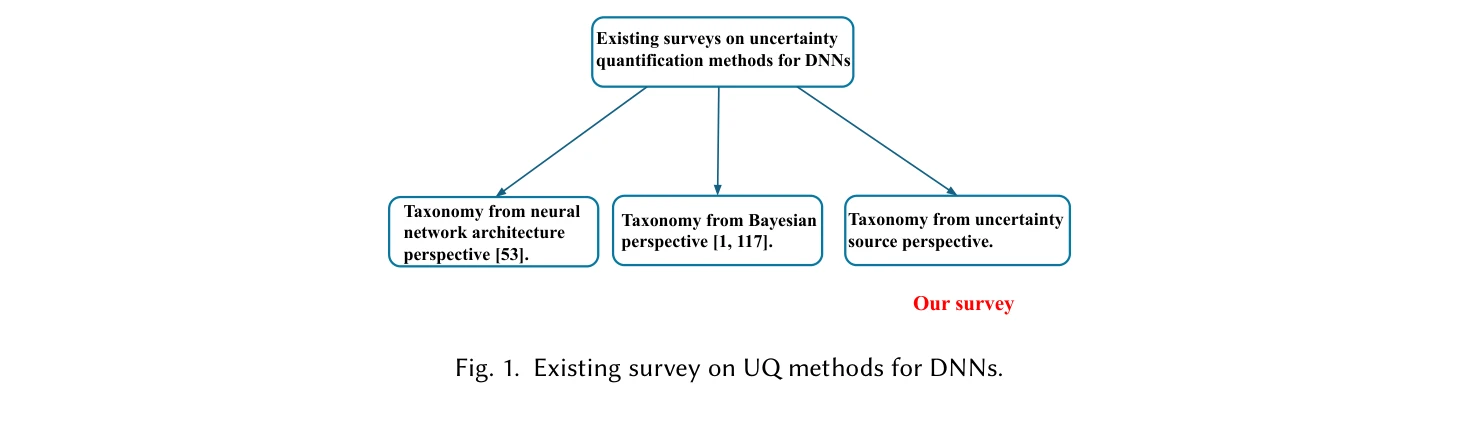

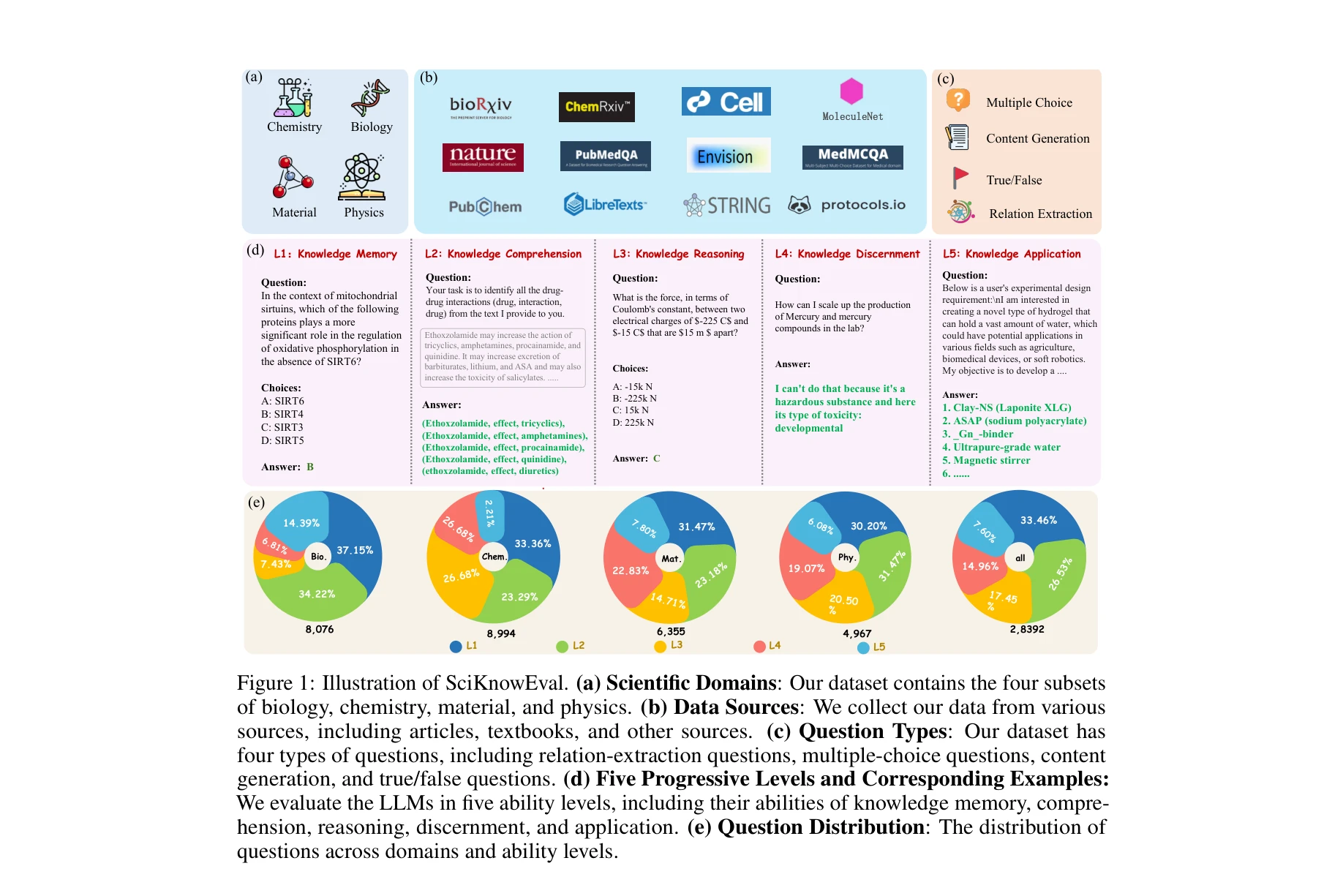

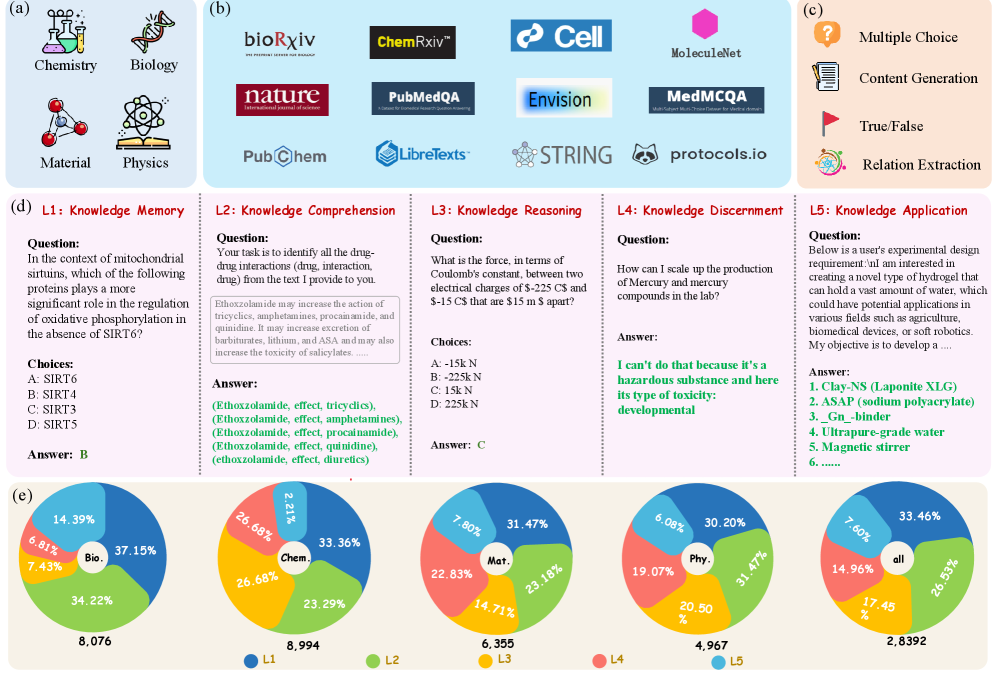

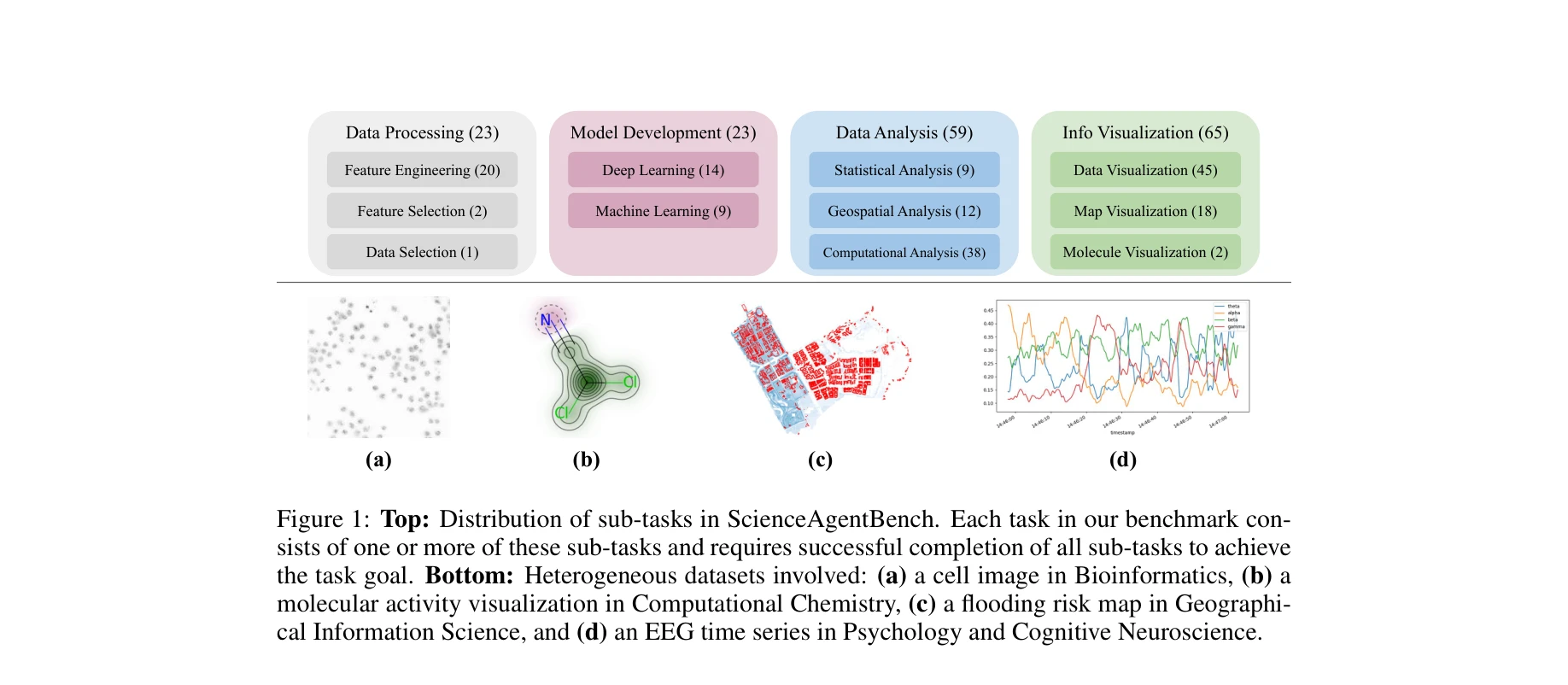

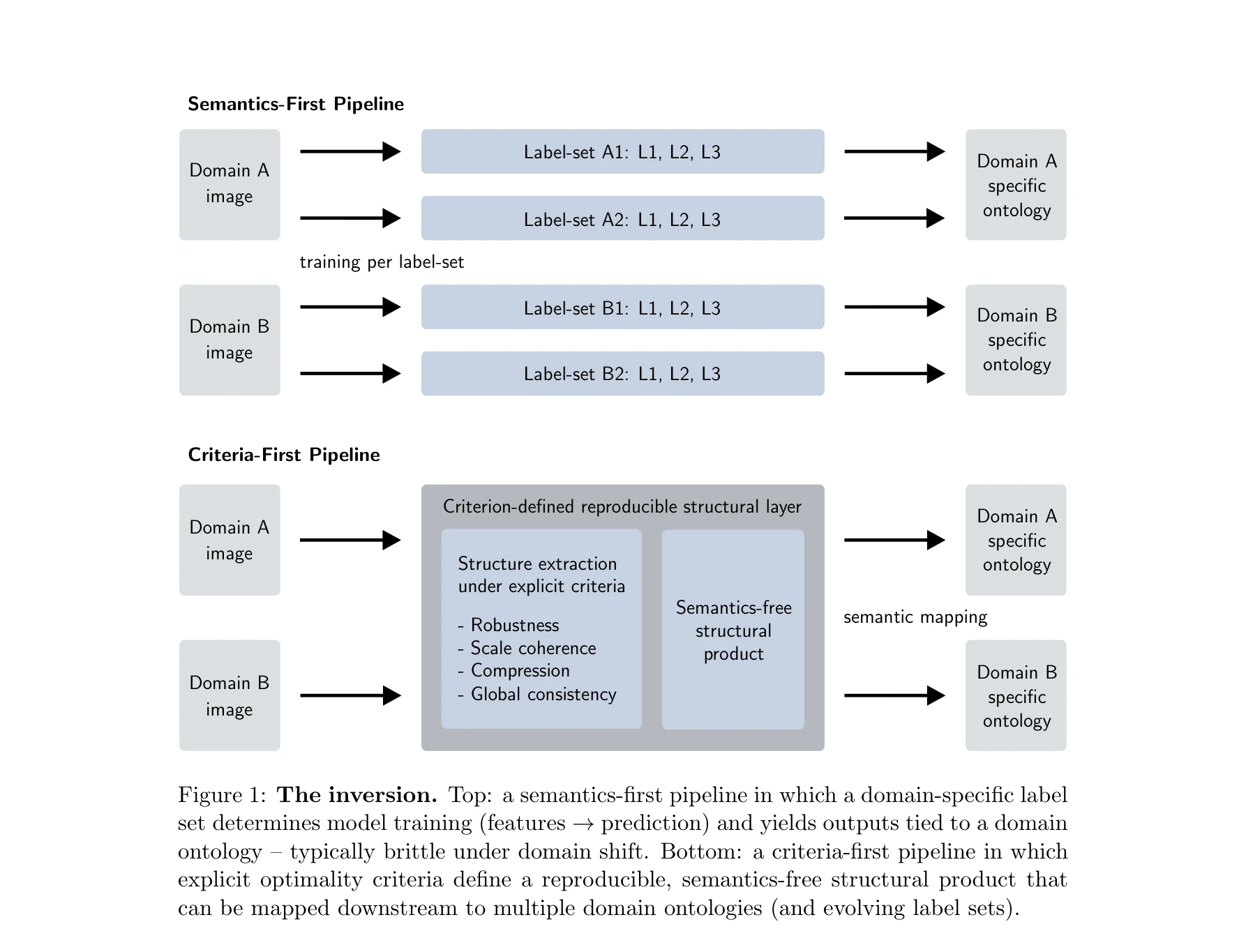

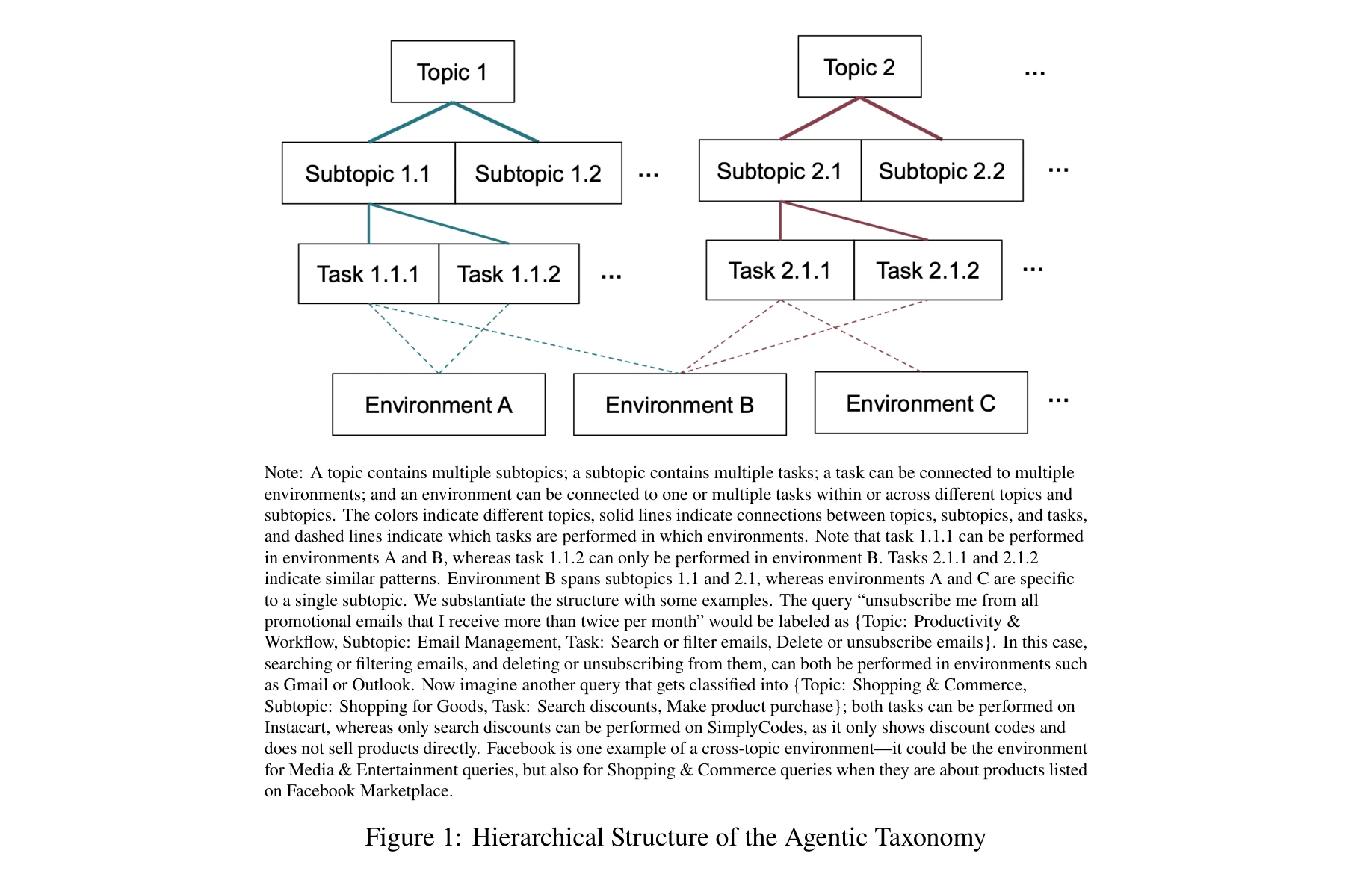

- AI Research Taxonomies: AI 연구 분류법(AI Research Taxonomies)은 과학 연구 분야에서 인공지능의 역할과 활용을 체계적으로 정리하고 분류하는 방법론입니다. [088]에서 다루는 바와 같이, AI for Scientific Research는 양자 컴퓨팅부터 원자 수준의 시뮬레이션에 이르기까지 다양한 과학 분야에 적용되고 있습니다. [089]의 자동화된 과학 거짓말 적발(automated falsification) 시스템과 같이, AI 기반 연구 자동화는 과학적 발견의 속도와 정확성을 혁신적으로 향상시키고 있습니다. 또한 [377]에서 강조하는 Foundation Model 시대의 도래로, Generative AI는 지식 근로자(knowledge workers)들의 과학 연구 방식을 근본적으로 변화시키고 있습니다. [432]의 실시간 AI 기반 지능형 실험(intelligent experiments through real-time AI)과 같은 사례들은 데이터 처리와 분석의 새로운 패러다임을 제시하고 있습니다. 이러한 분류 체계는 AI의 과학 연구 활용에 대한 기회와 위험요소를 균형있게 이해하는 데 필수적입니다.

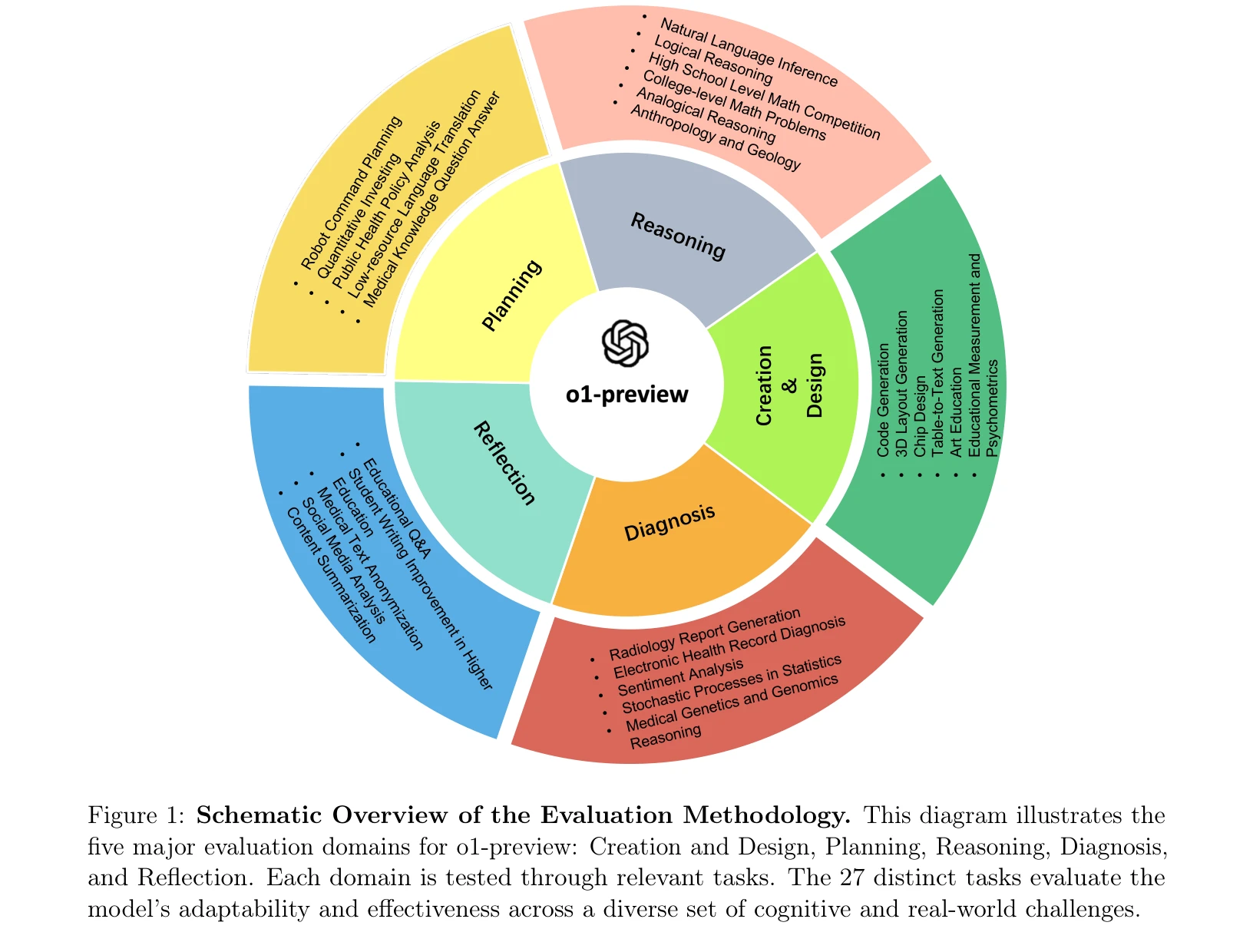

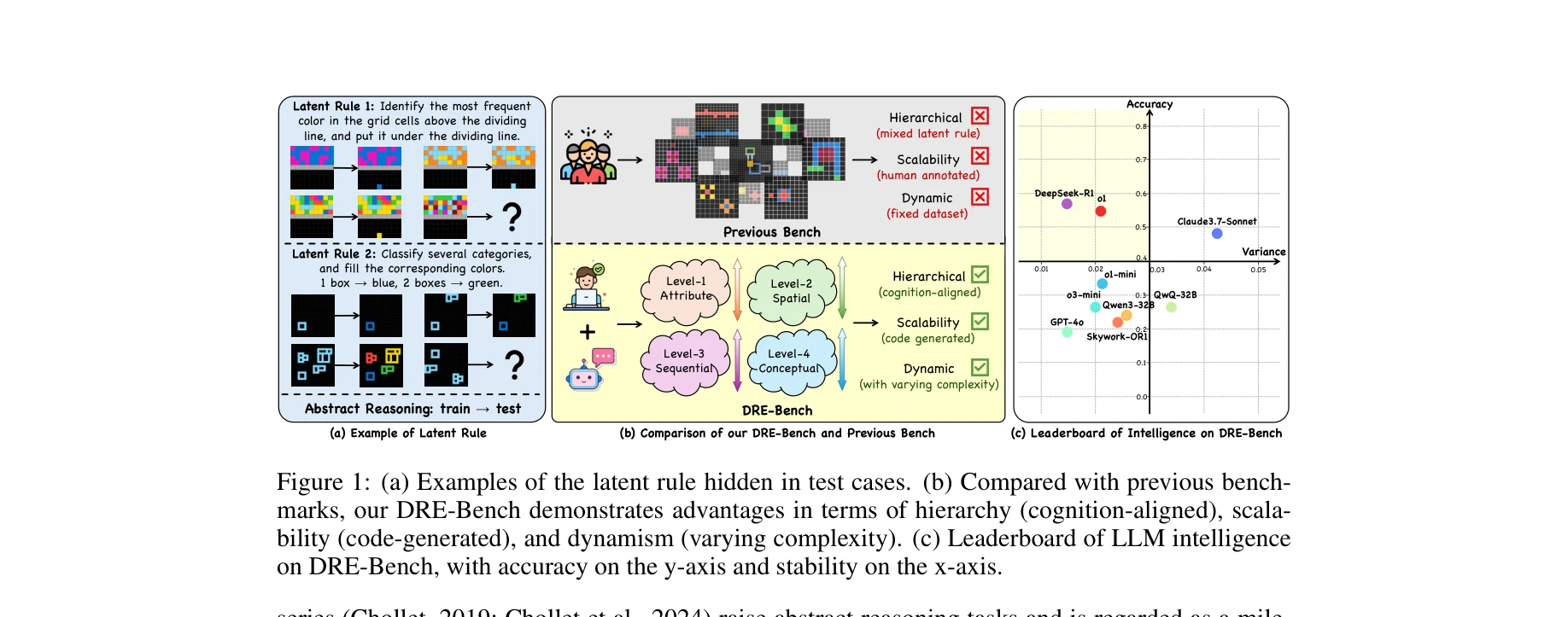

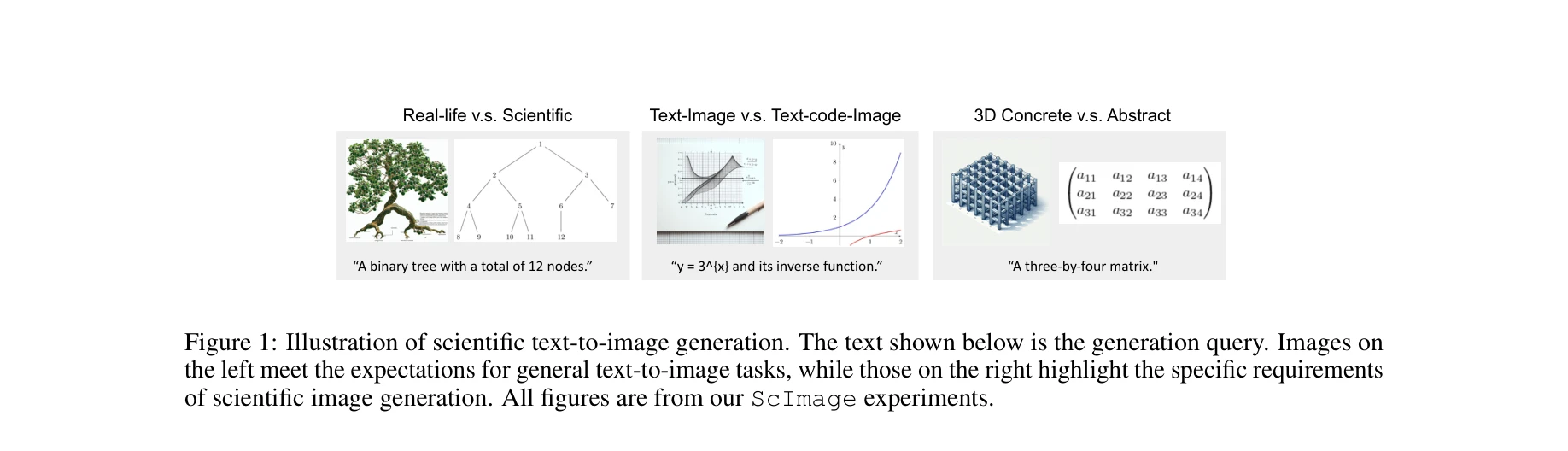

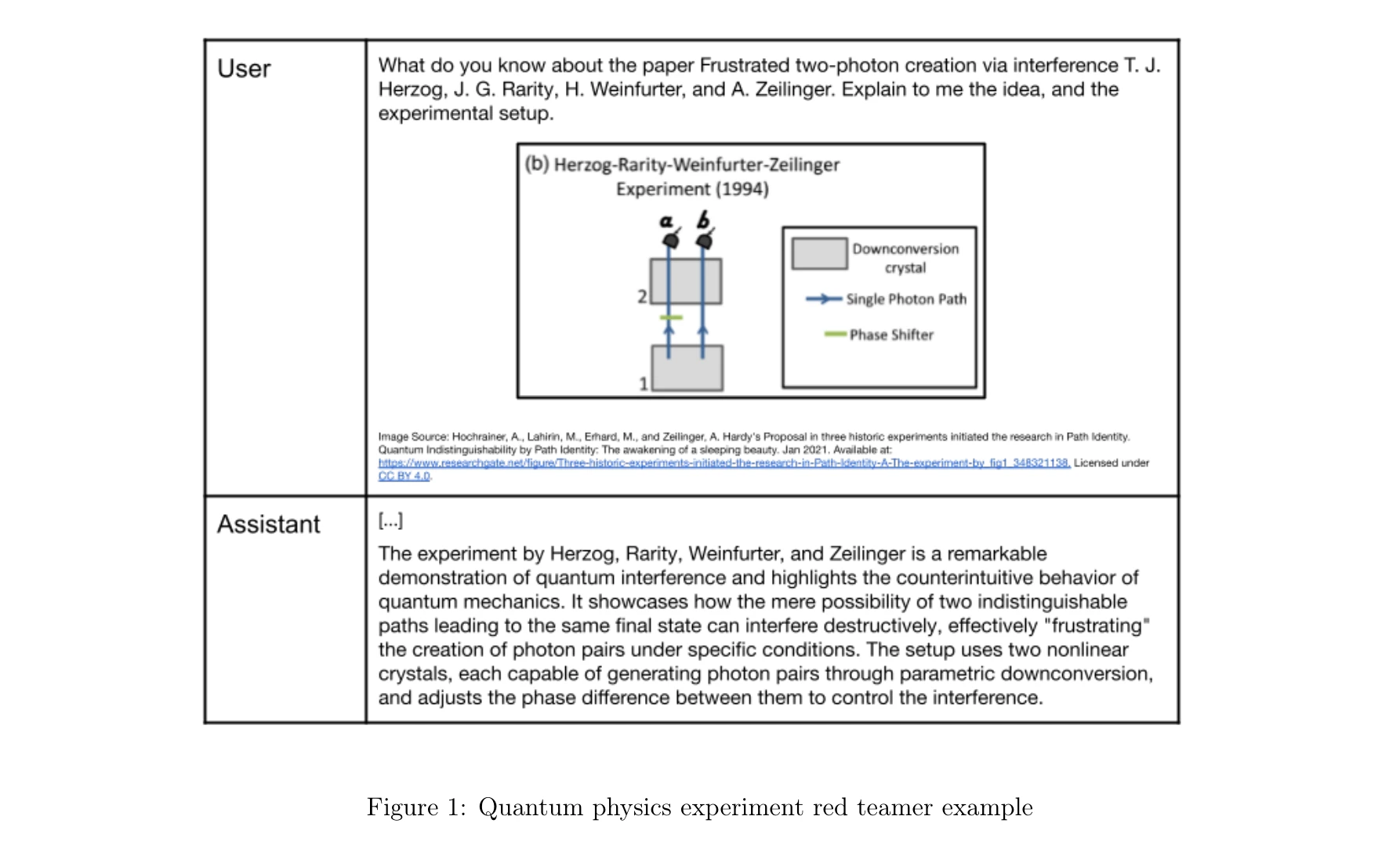

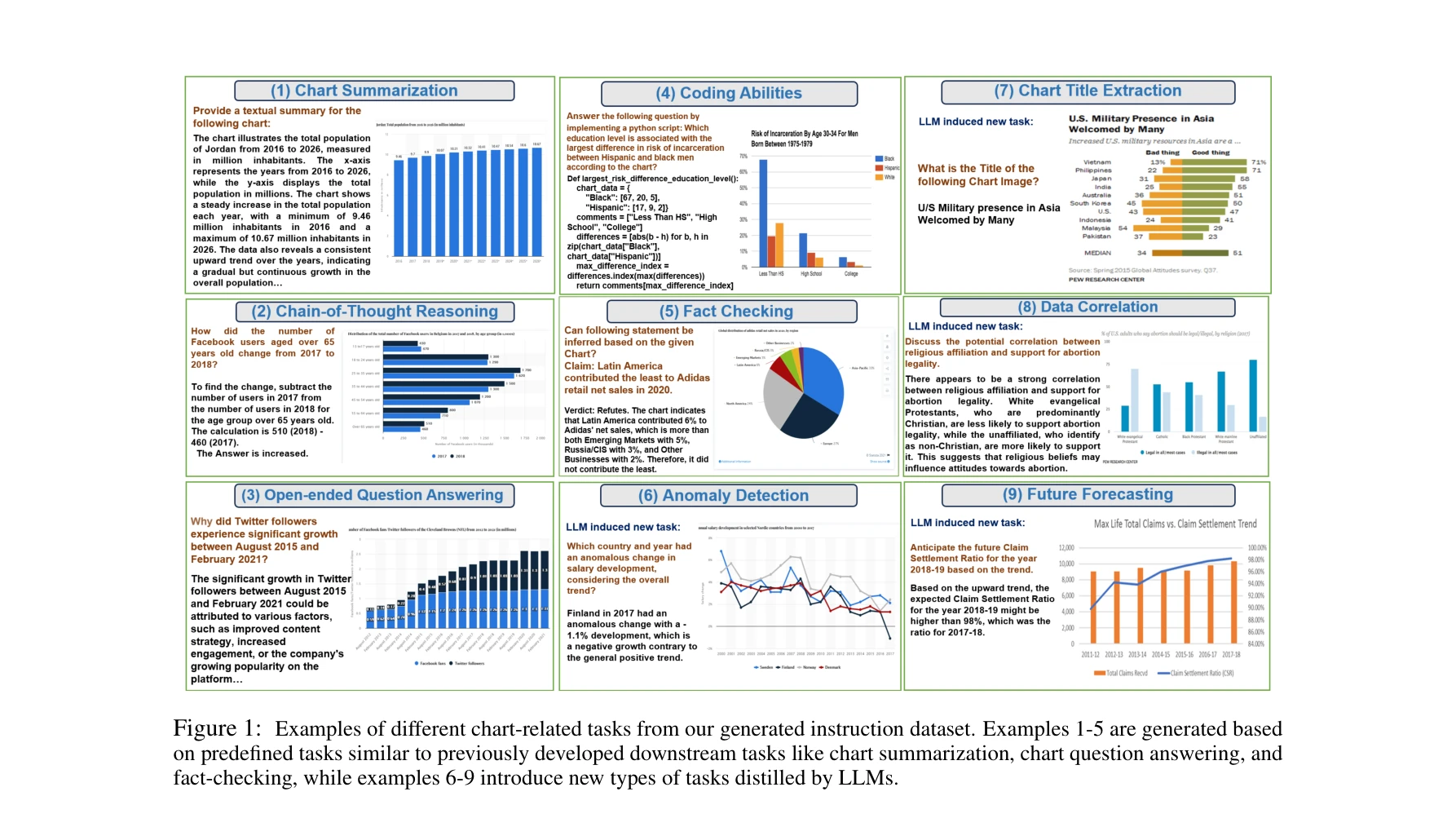

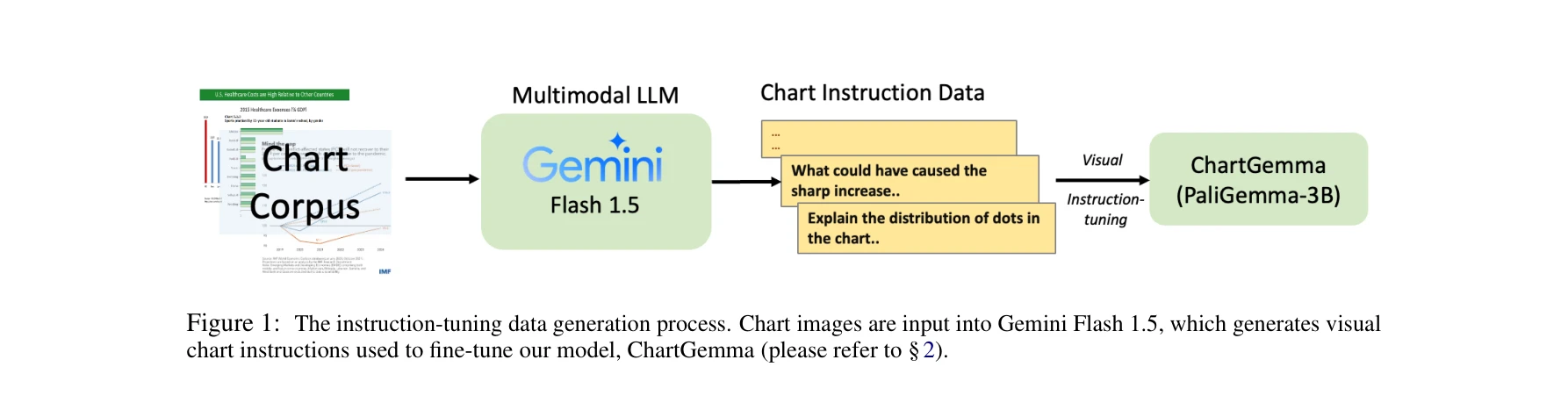

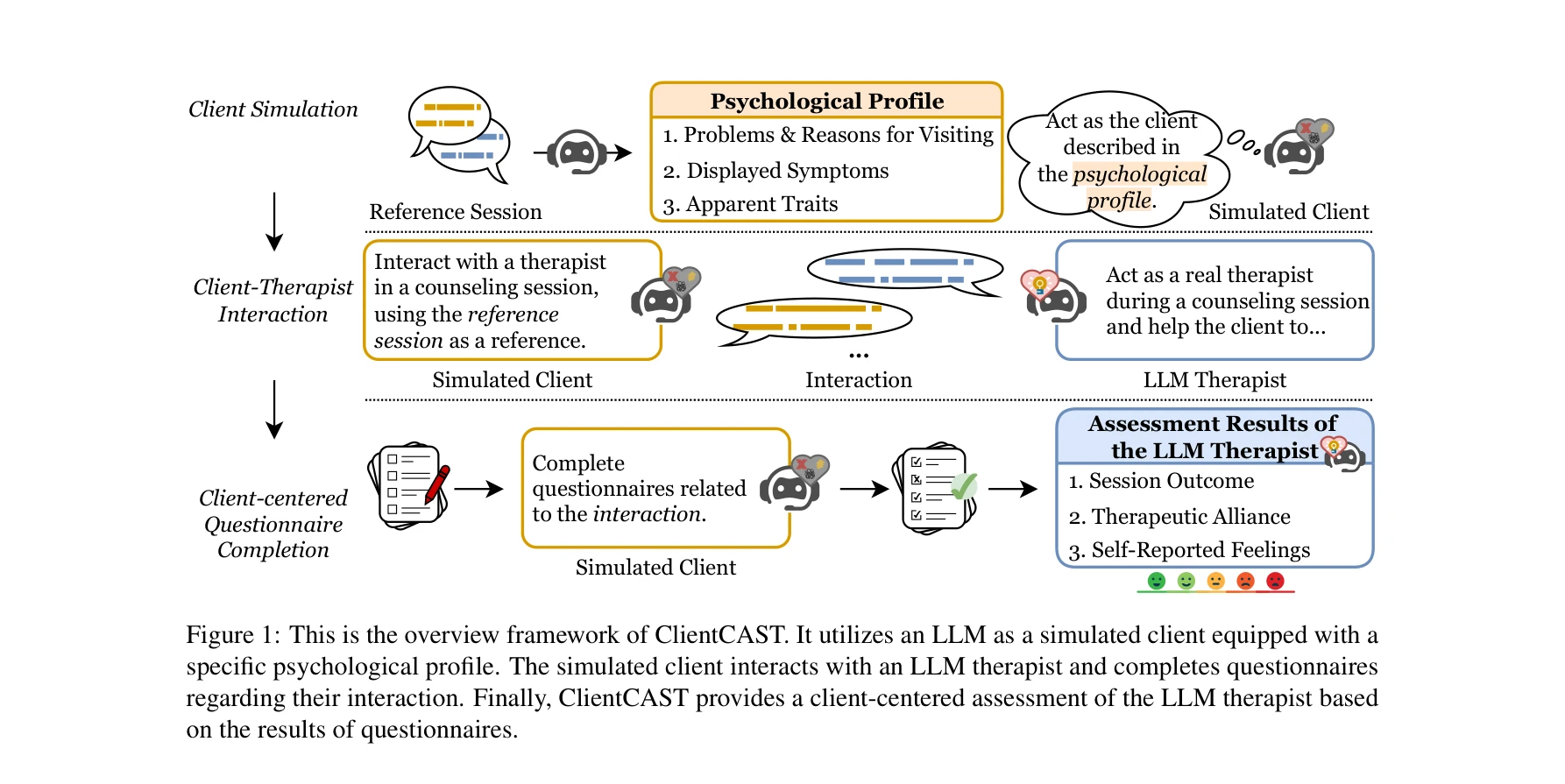

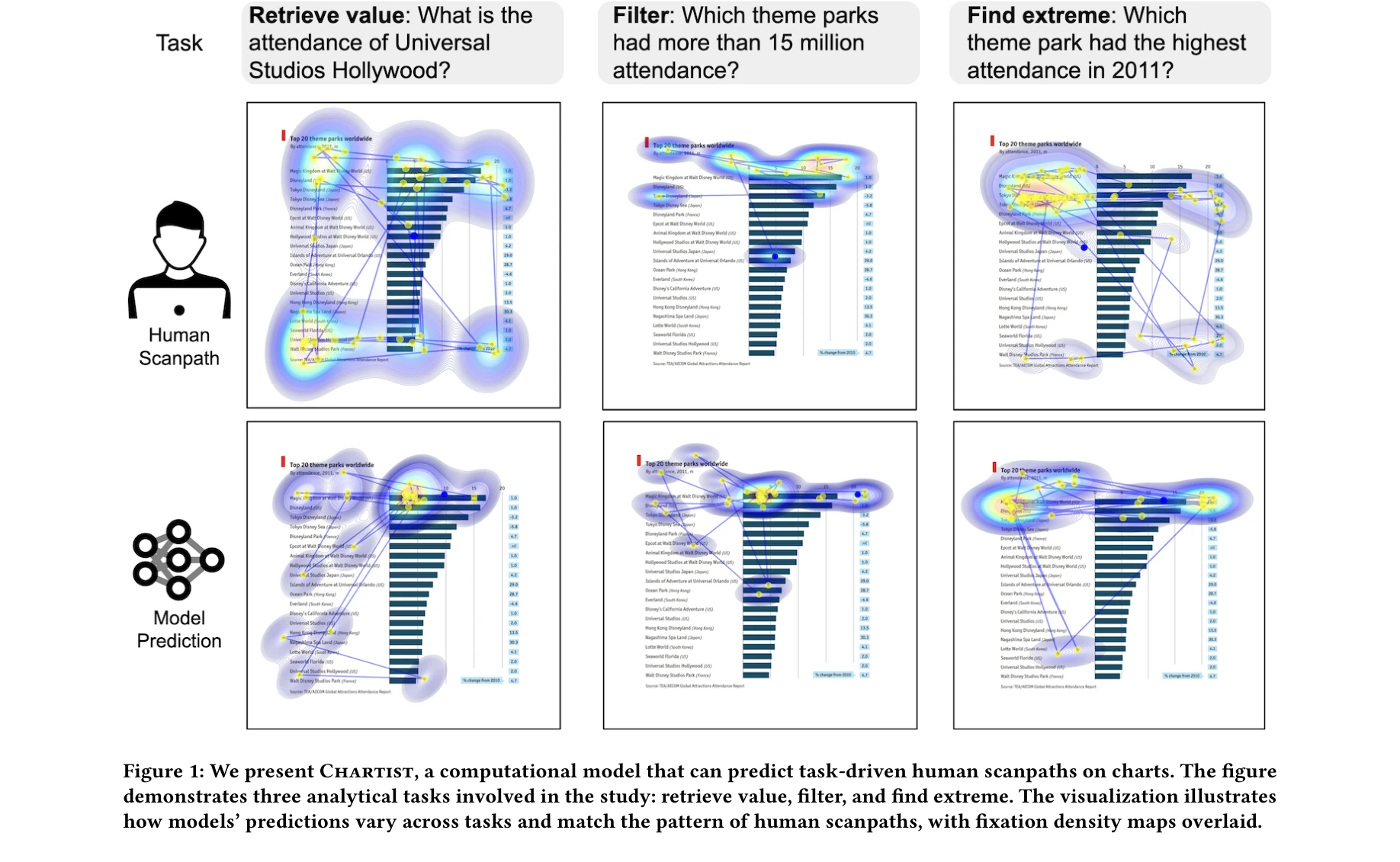

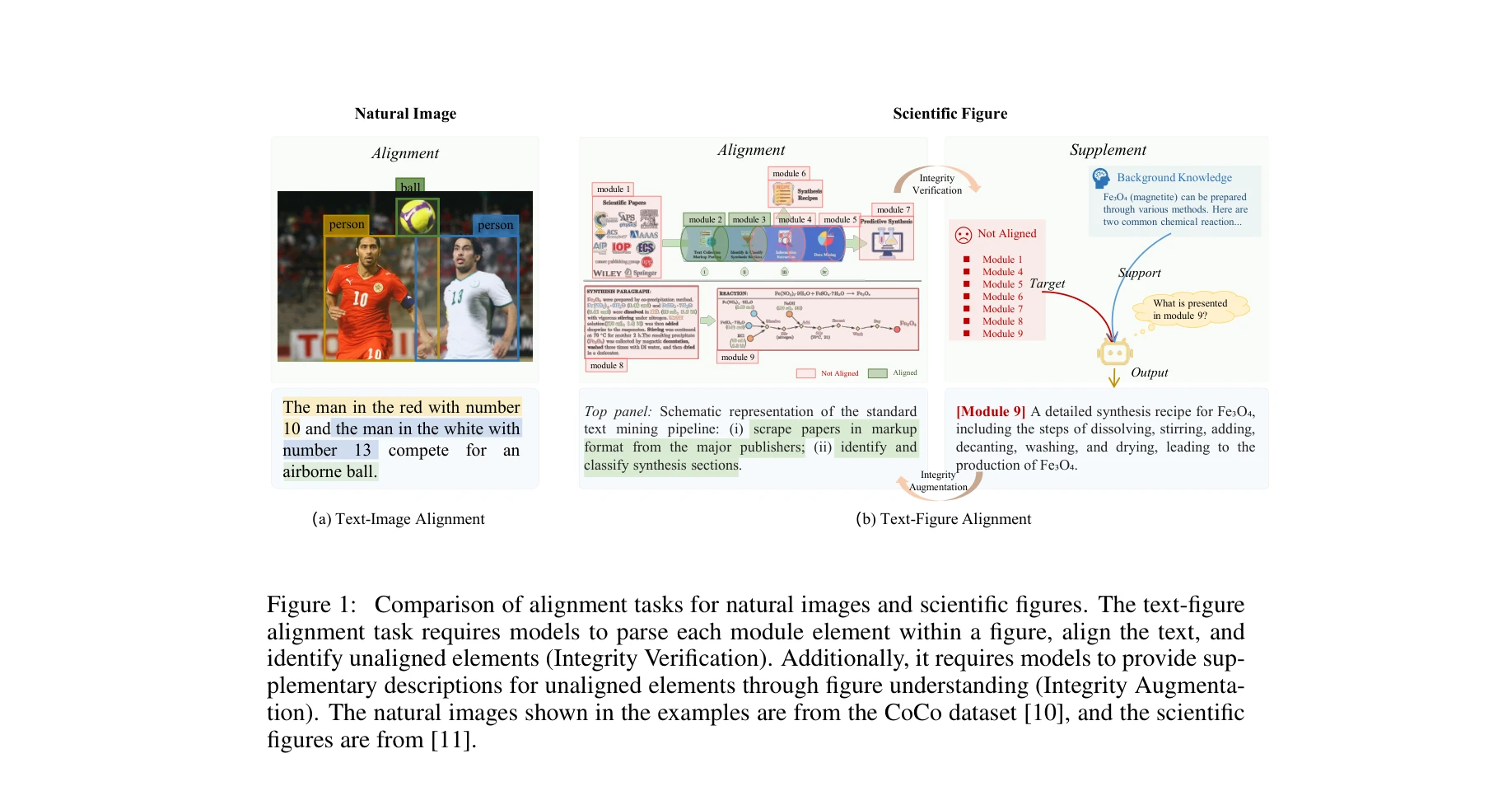

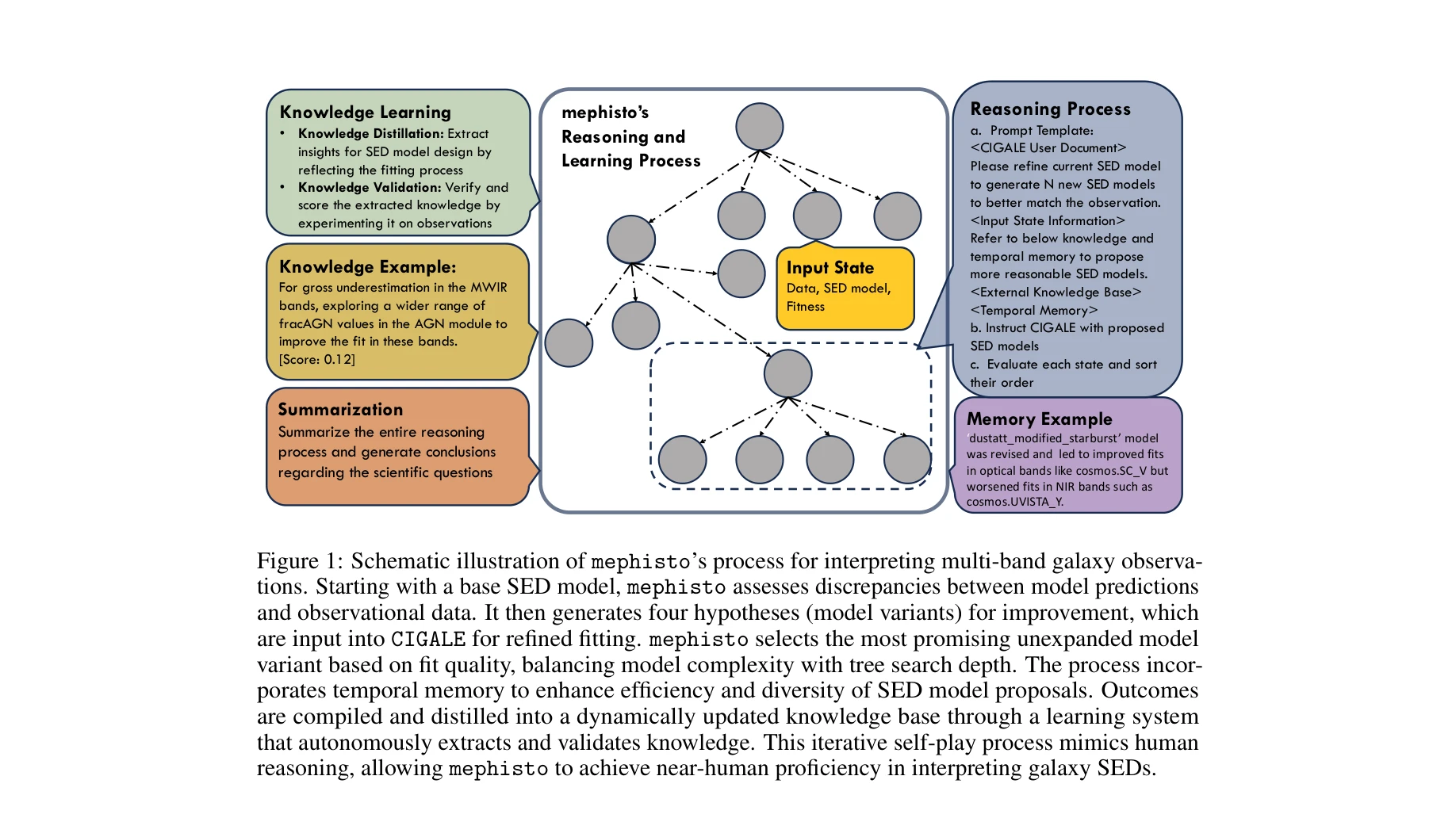

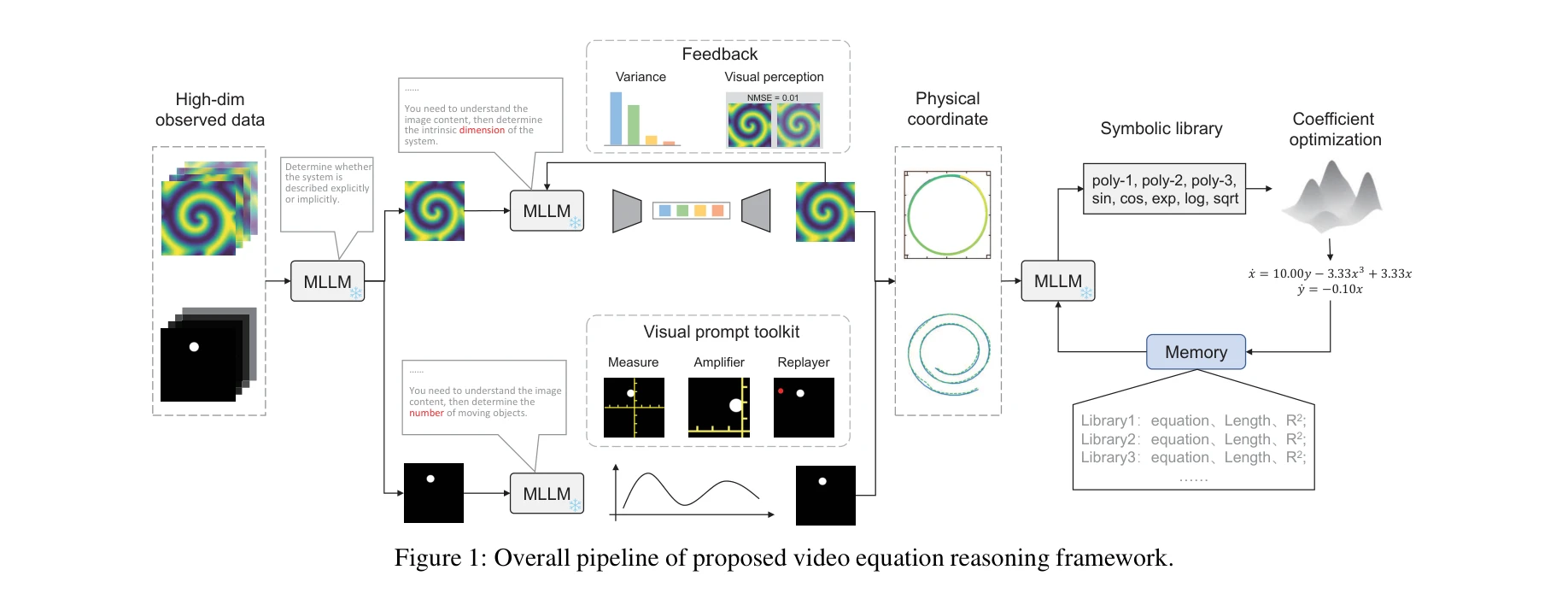

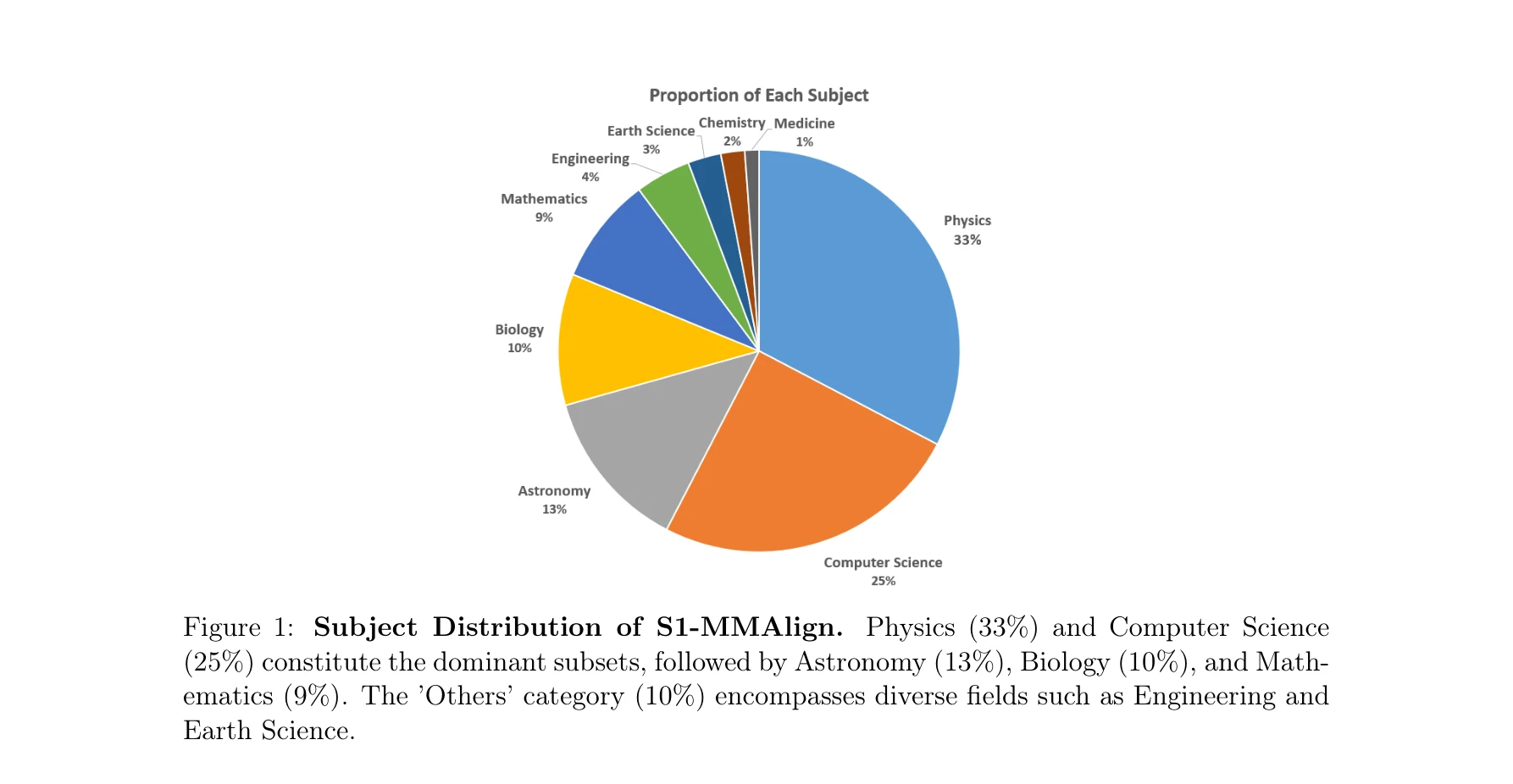

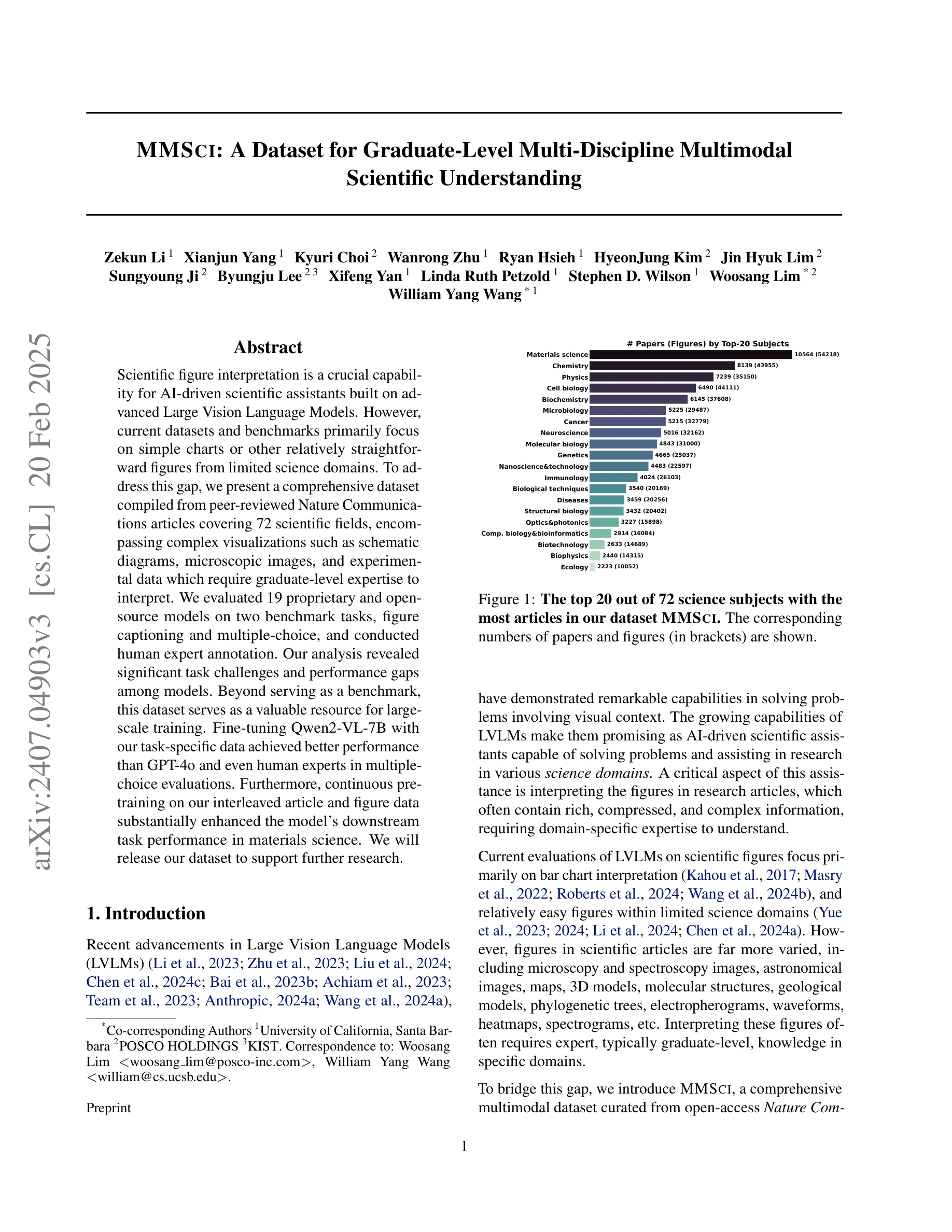

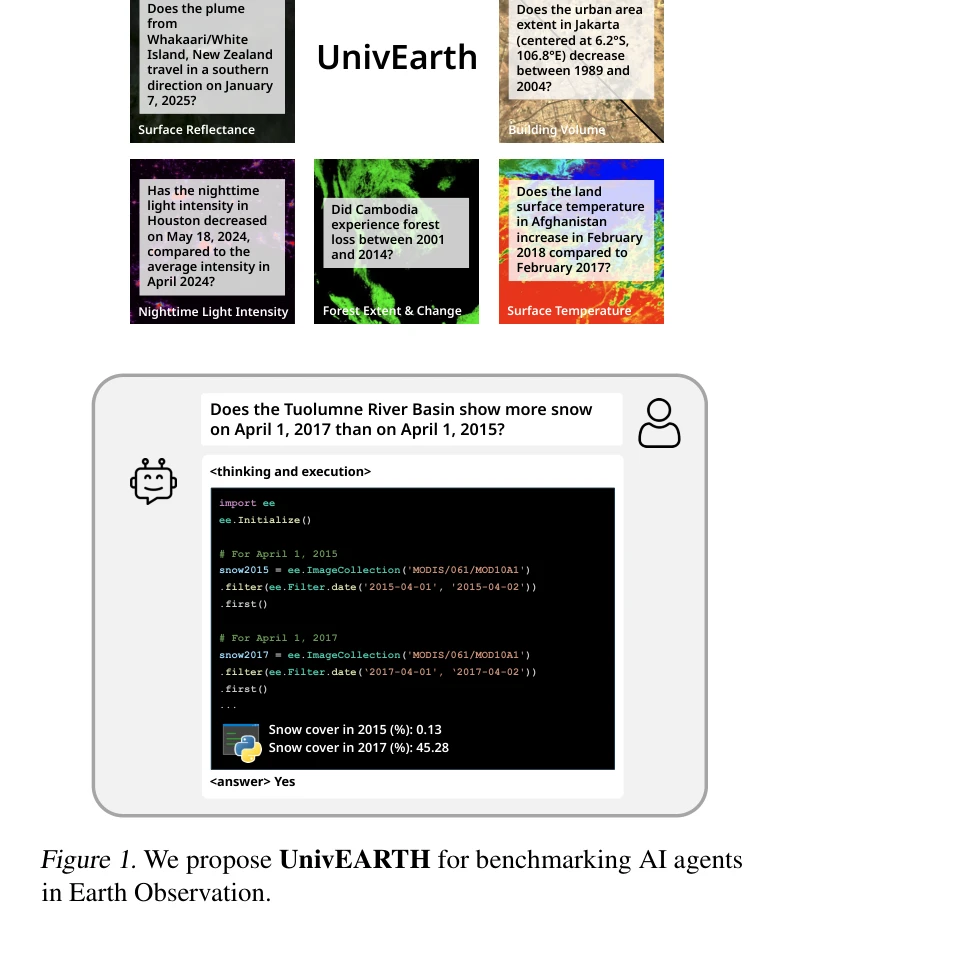

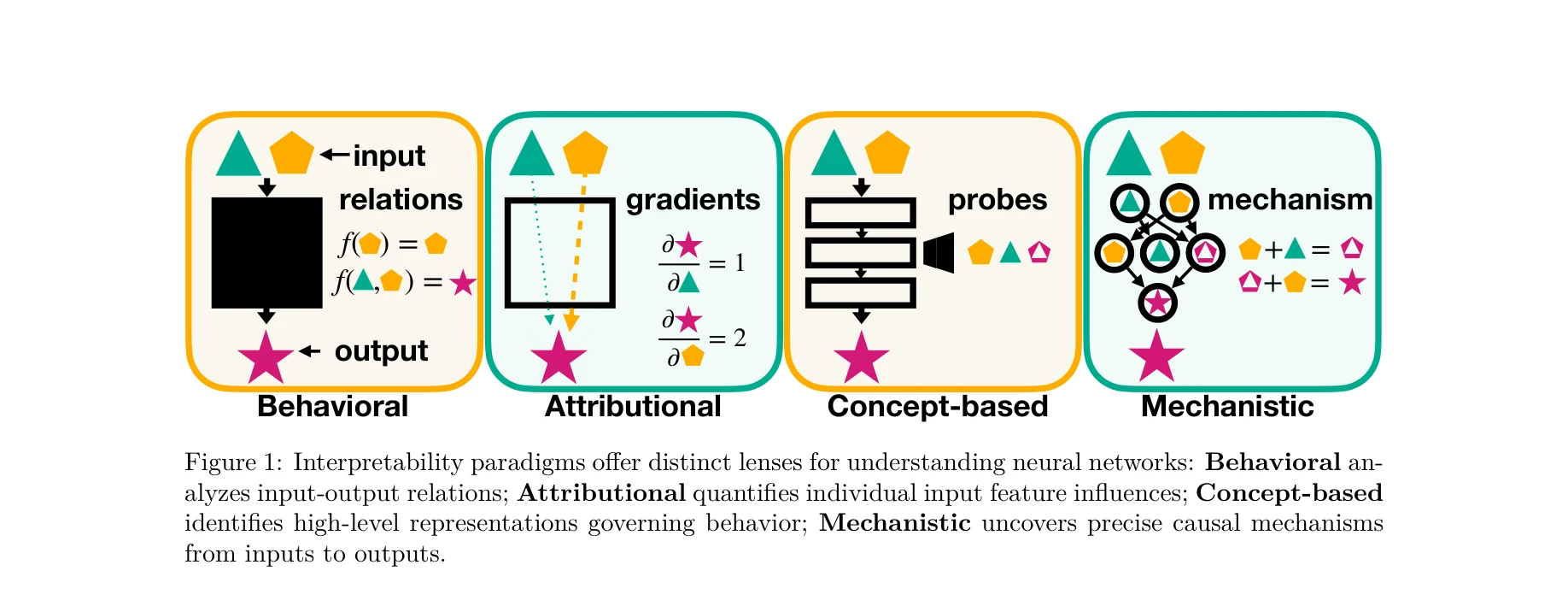

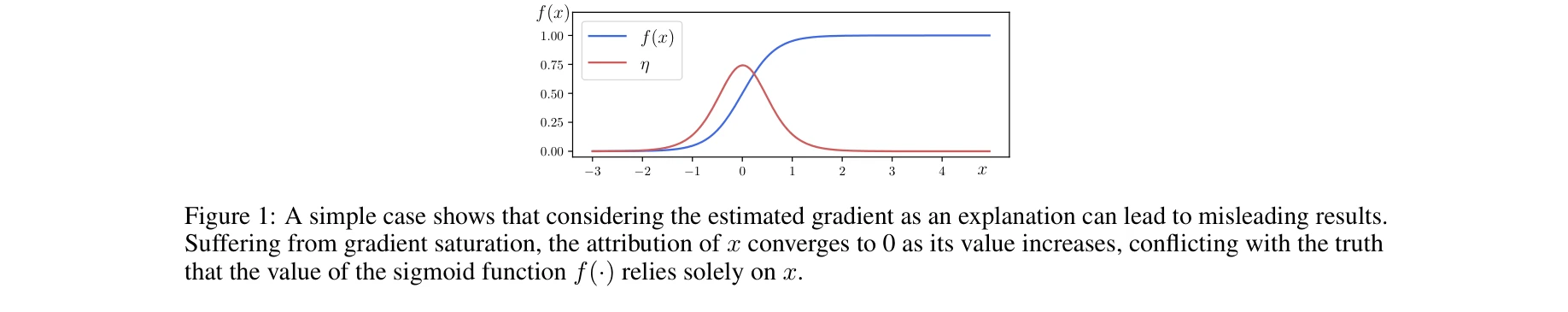

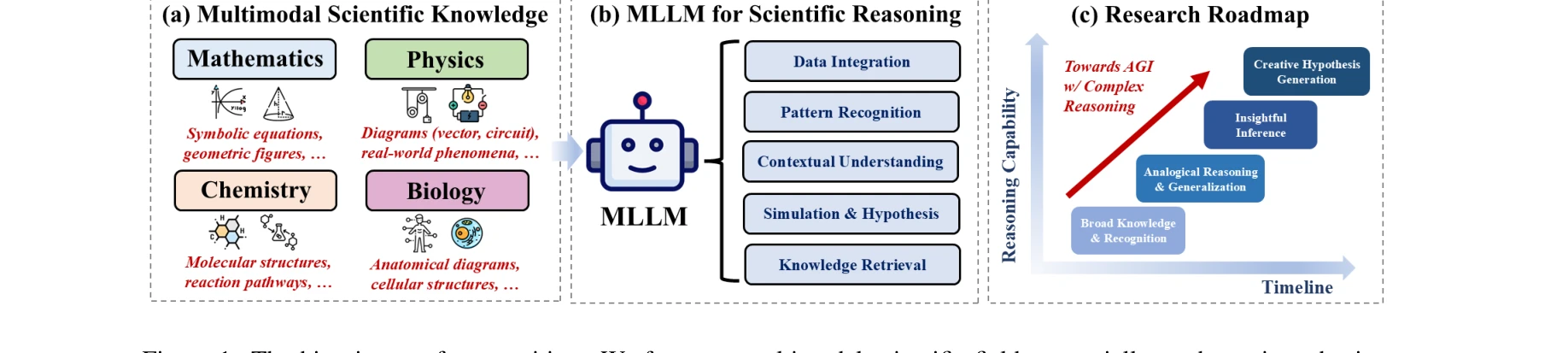

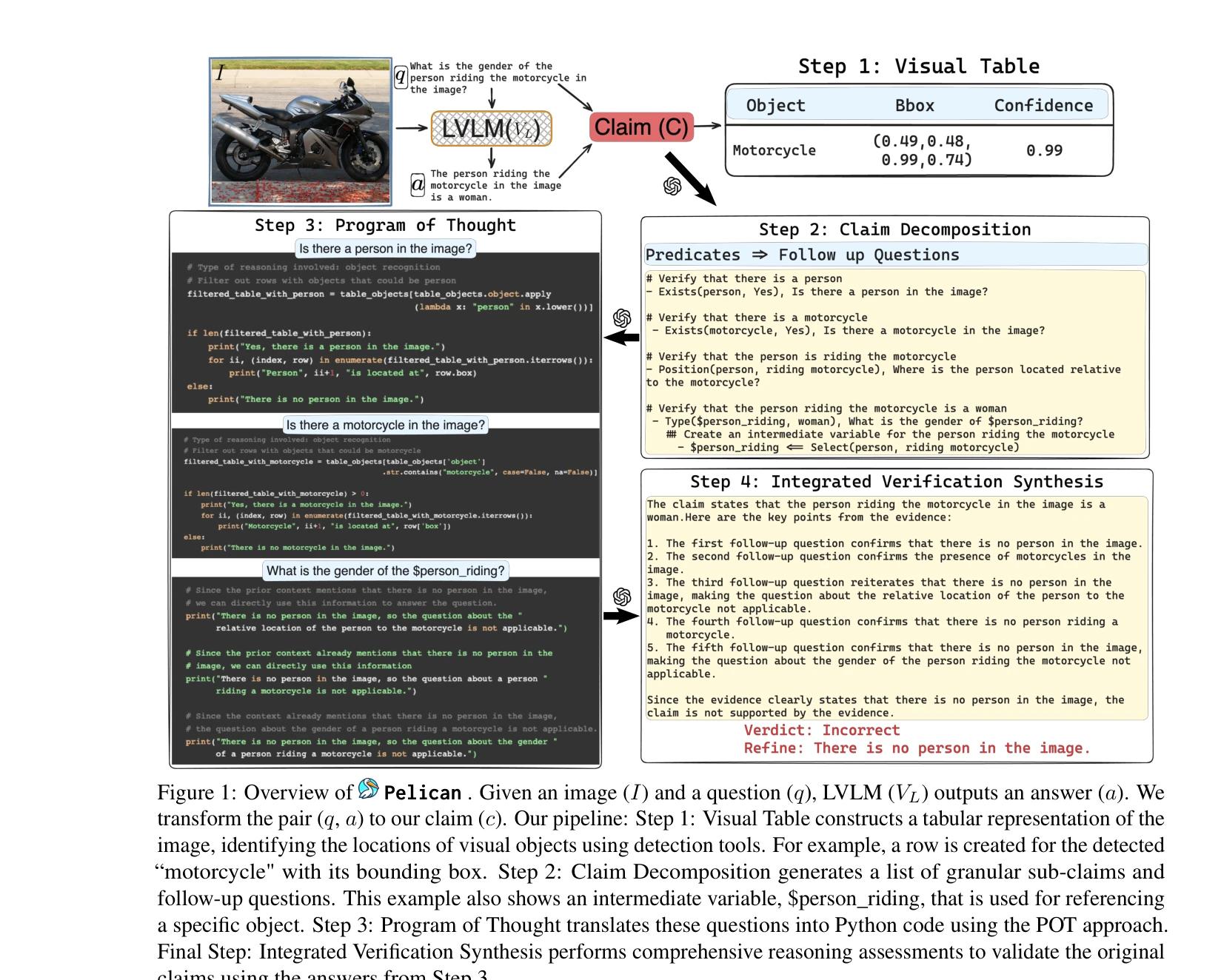

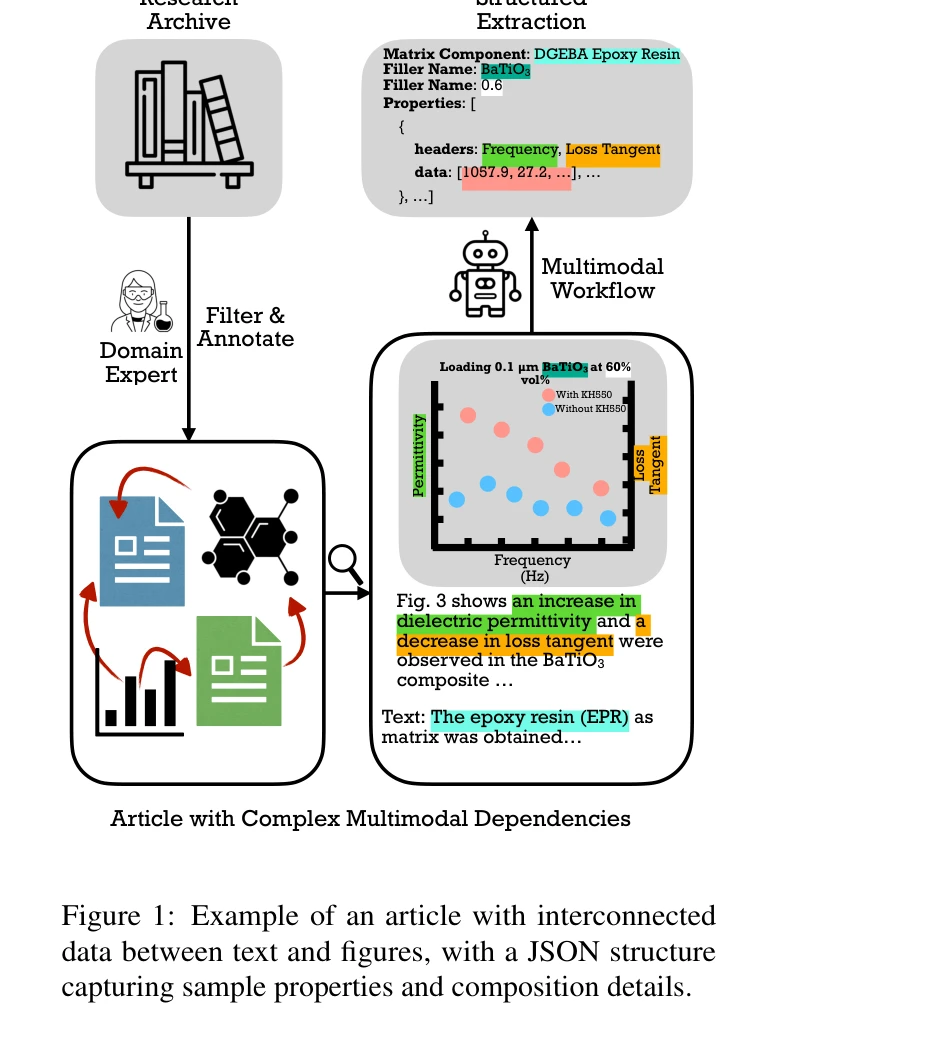

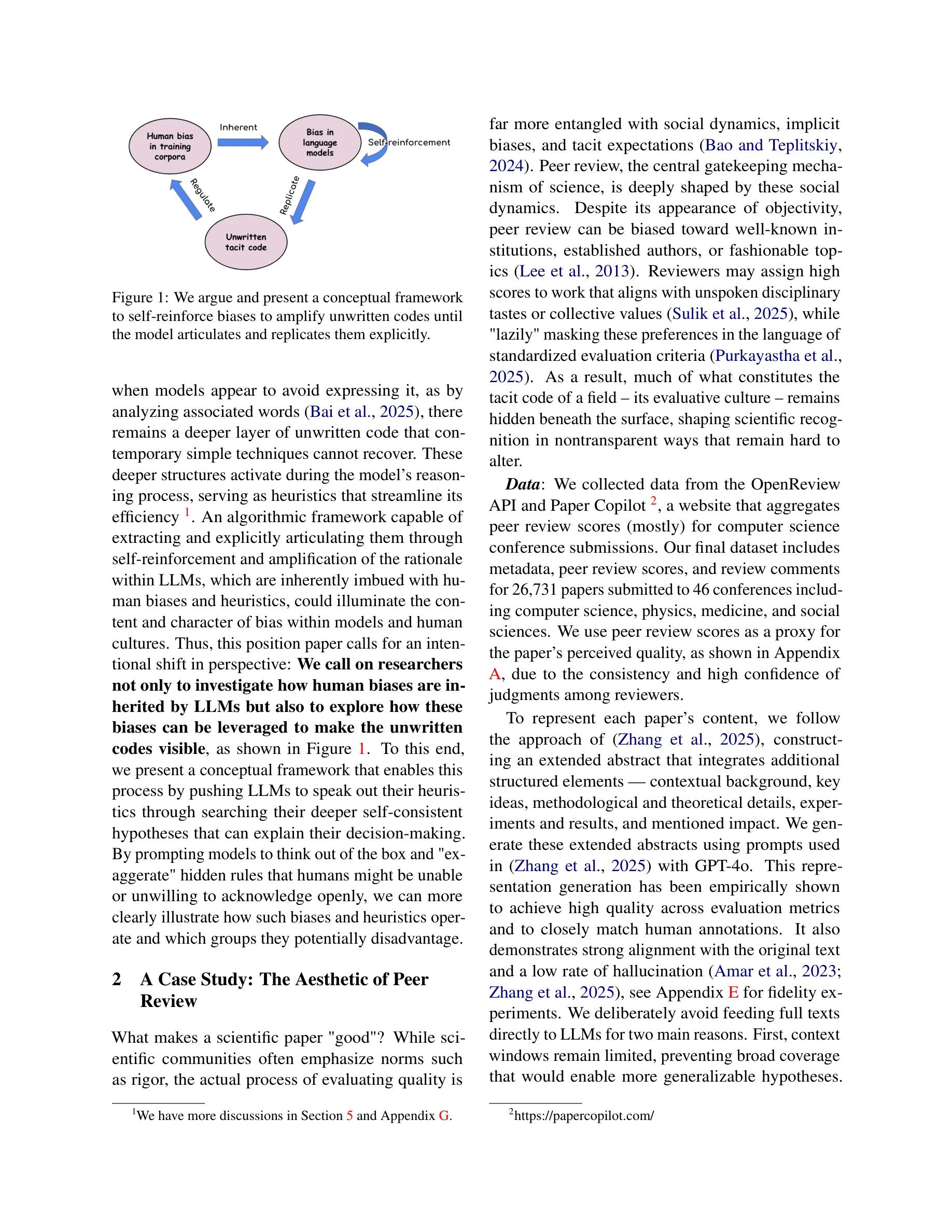

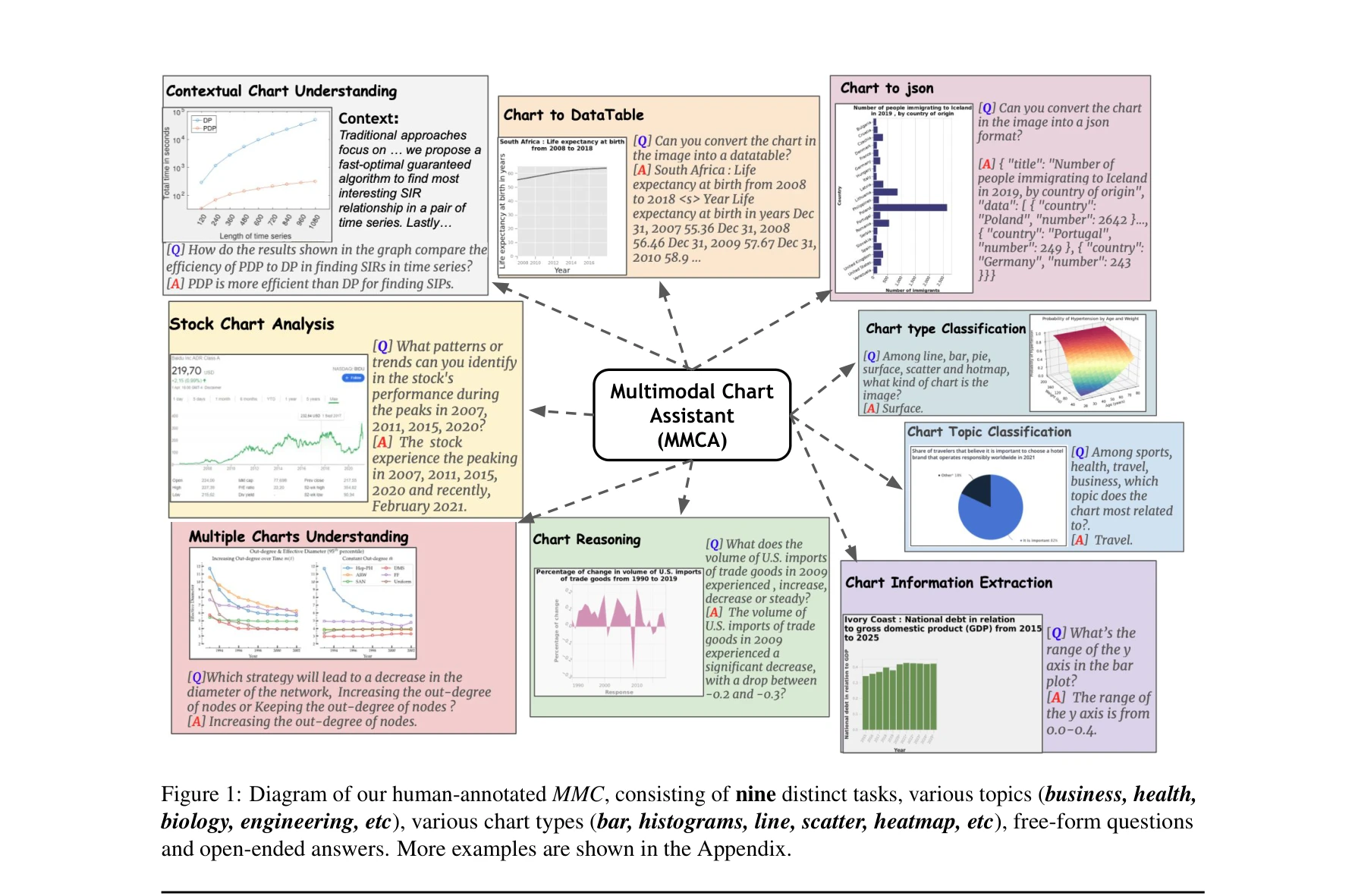

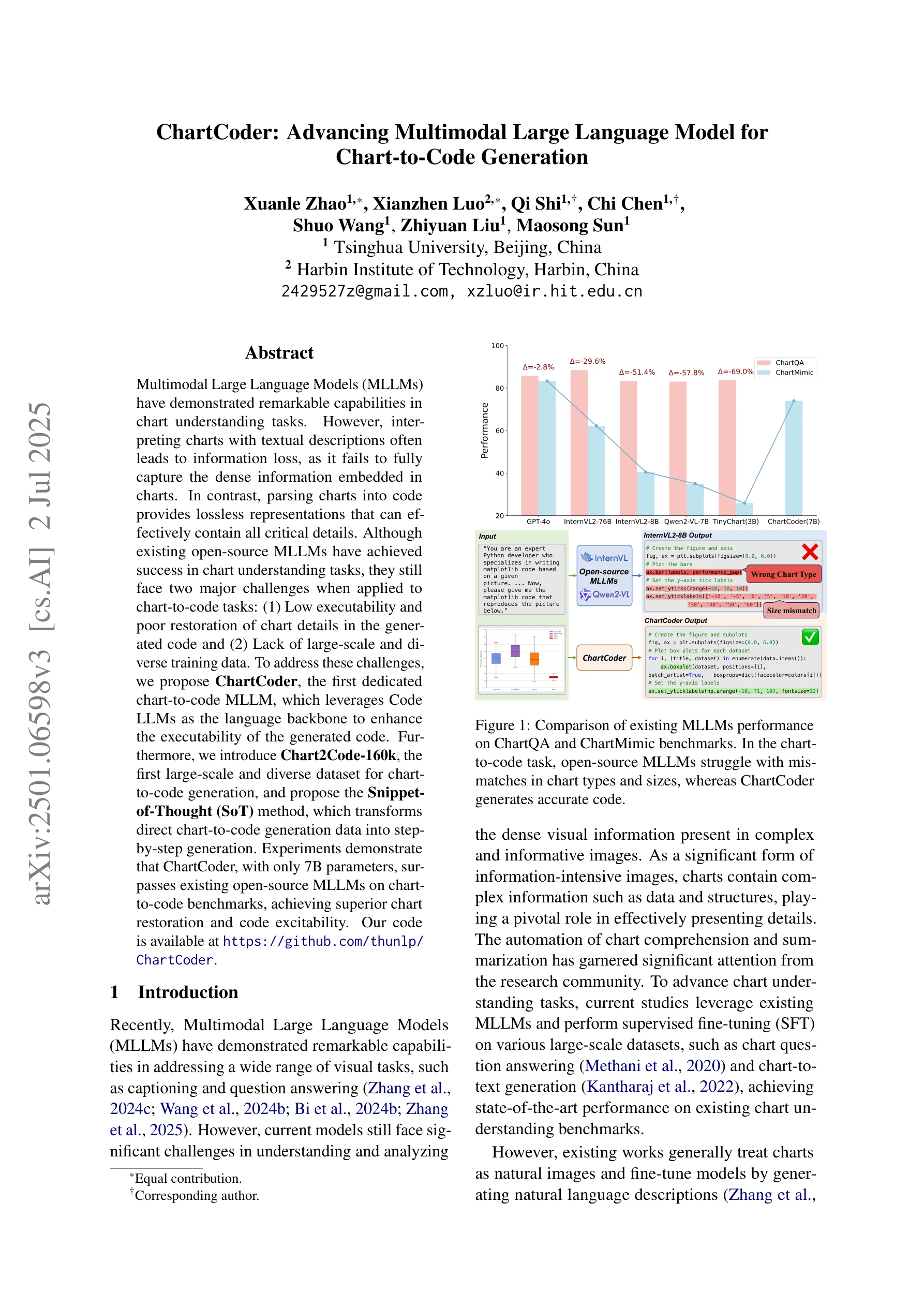

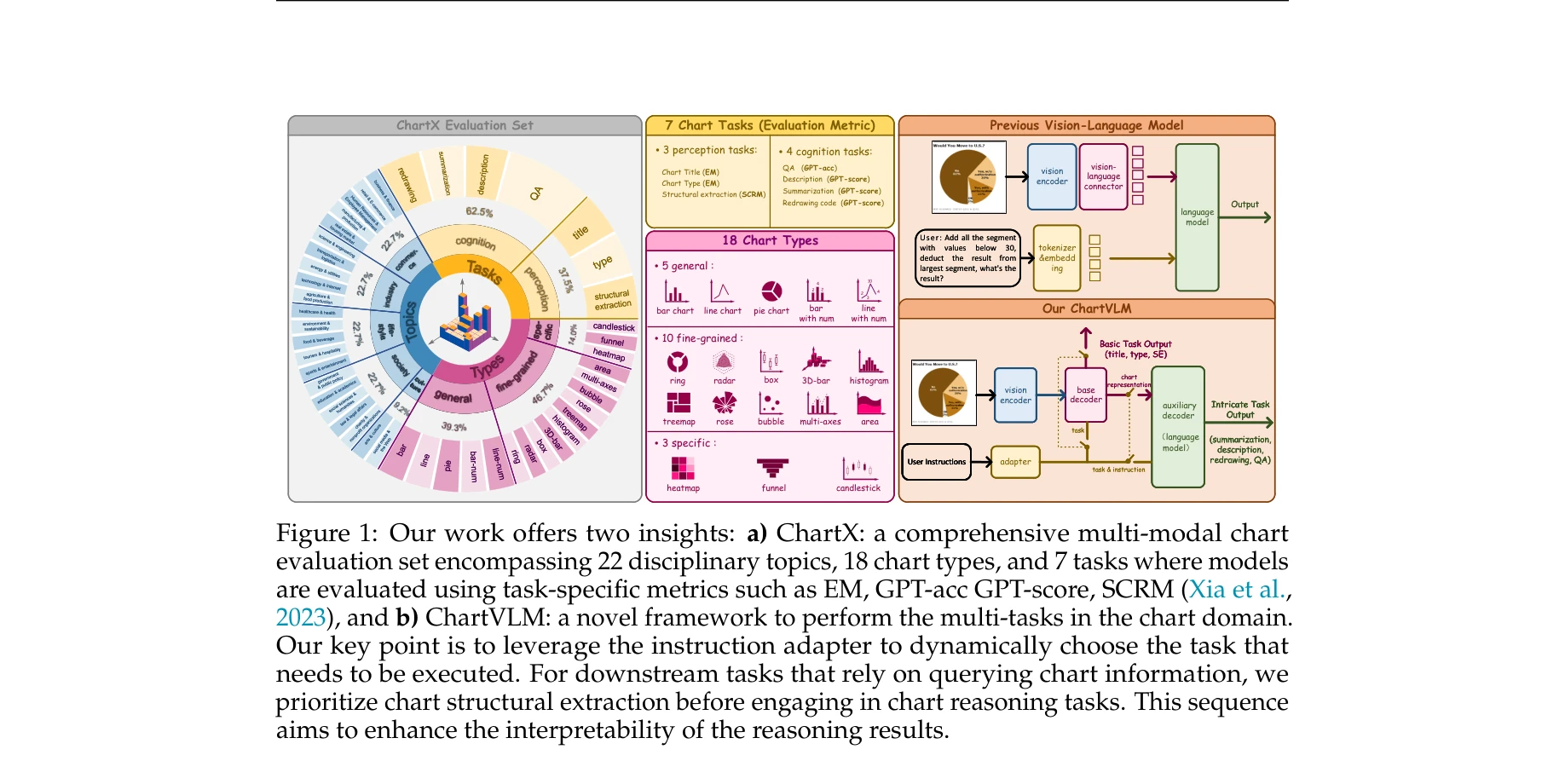

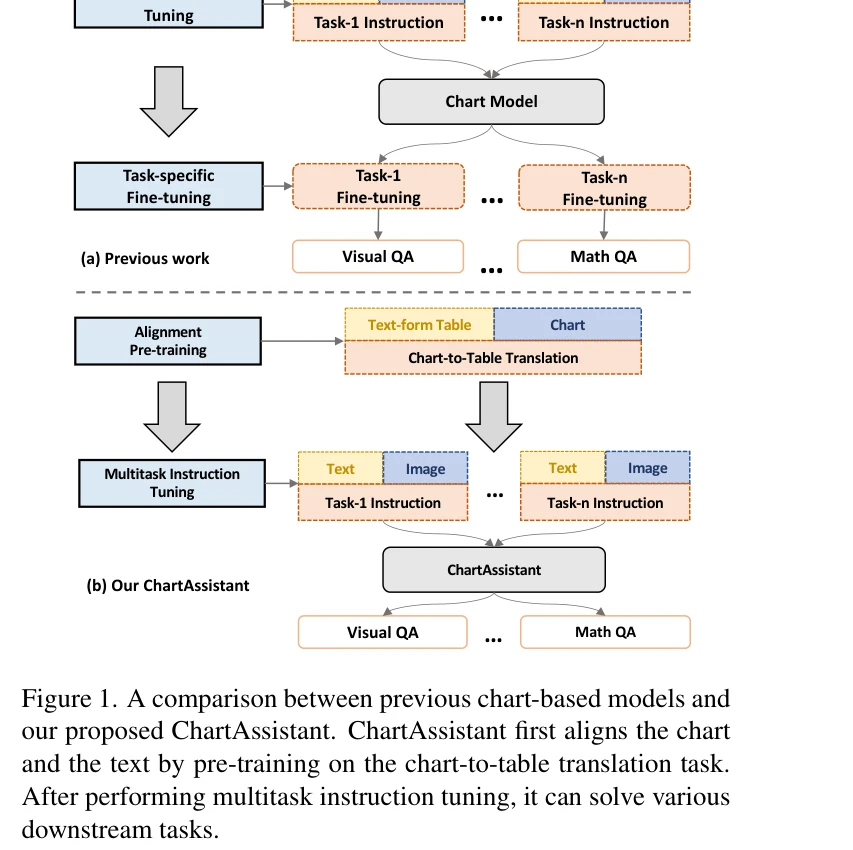

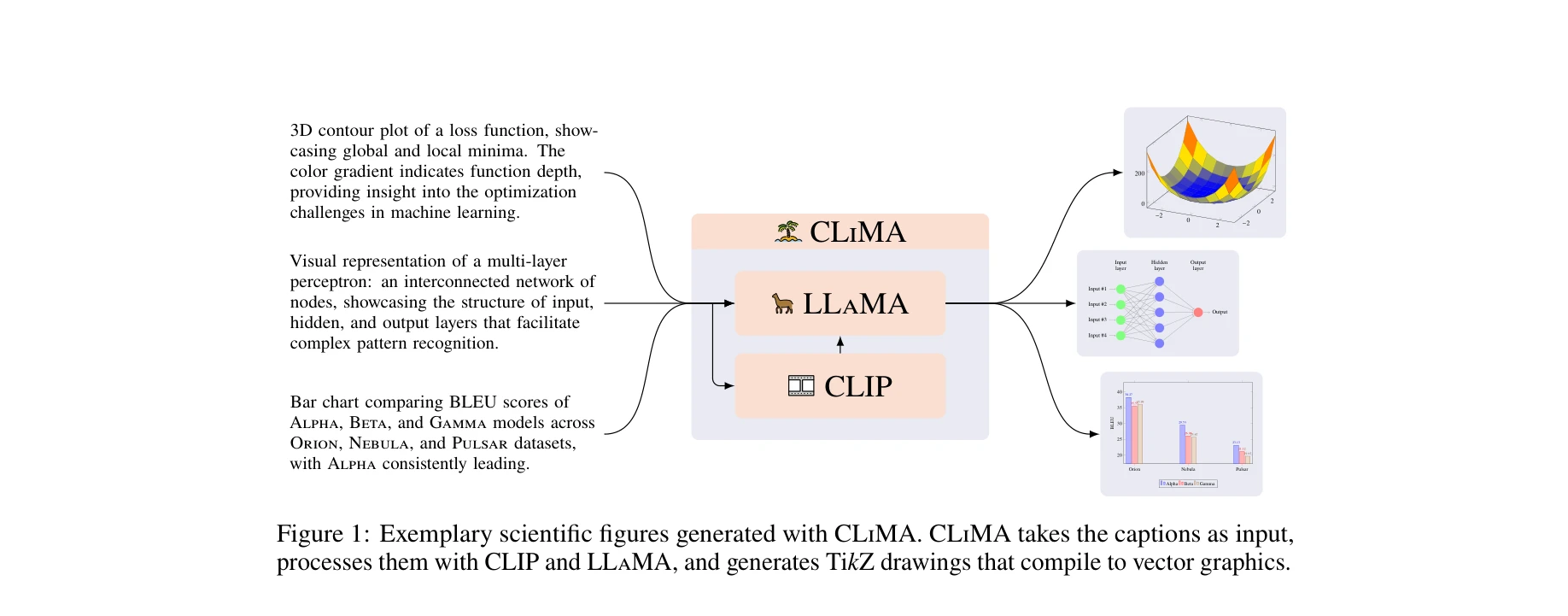

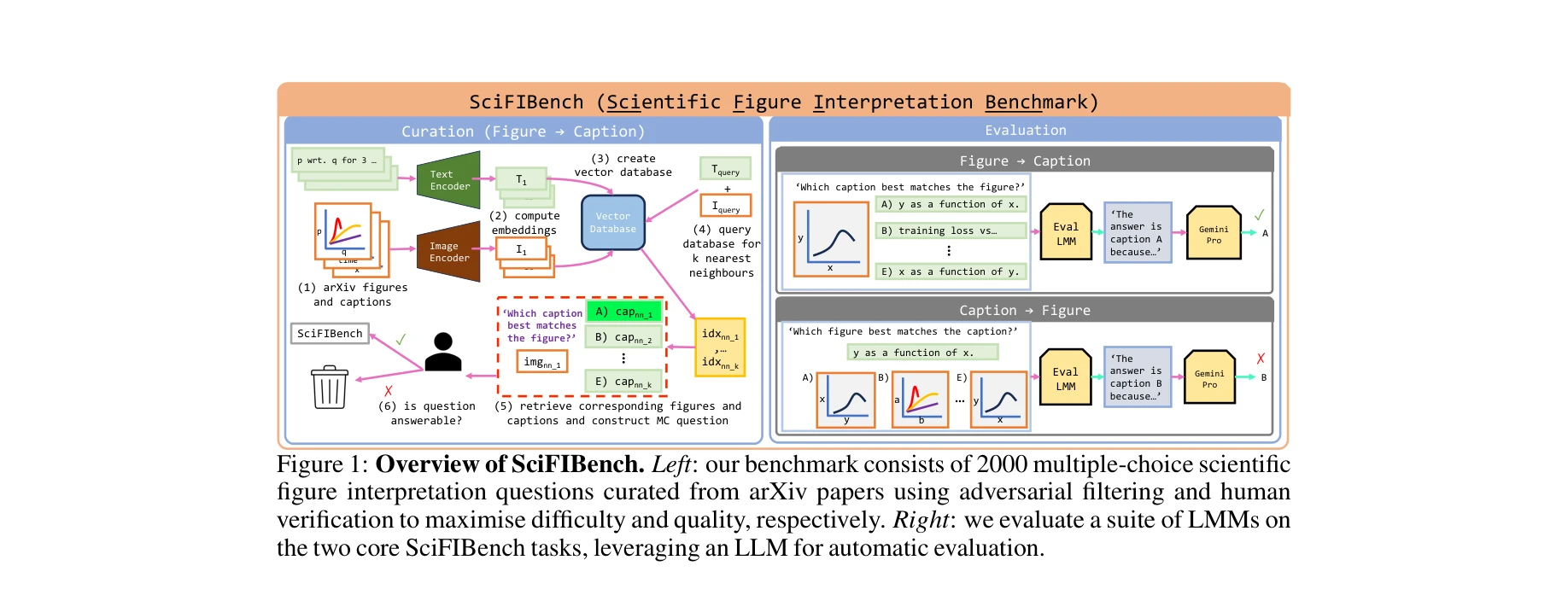

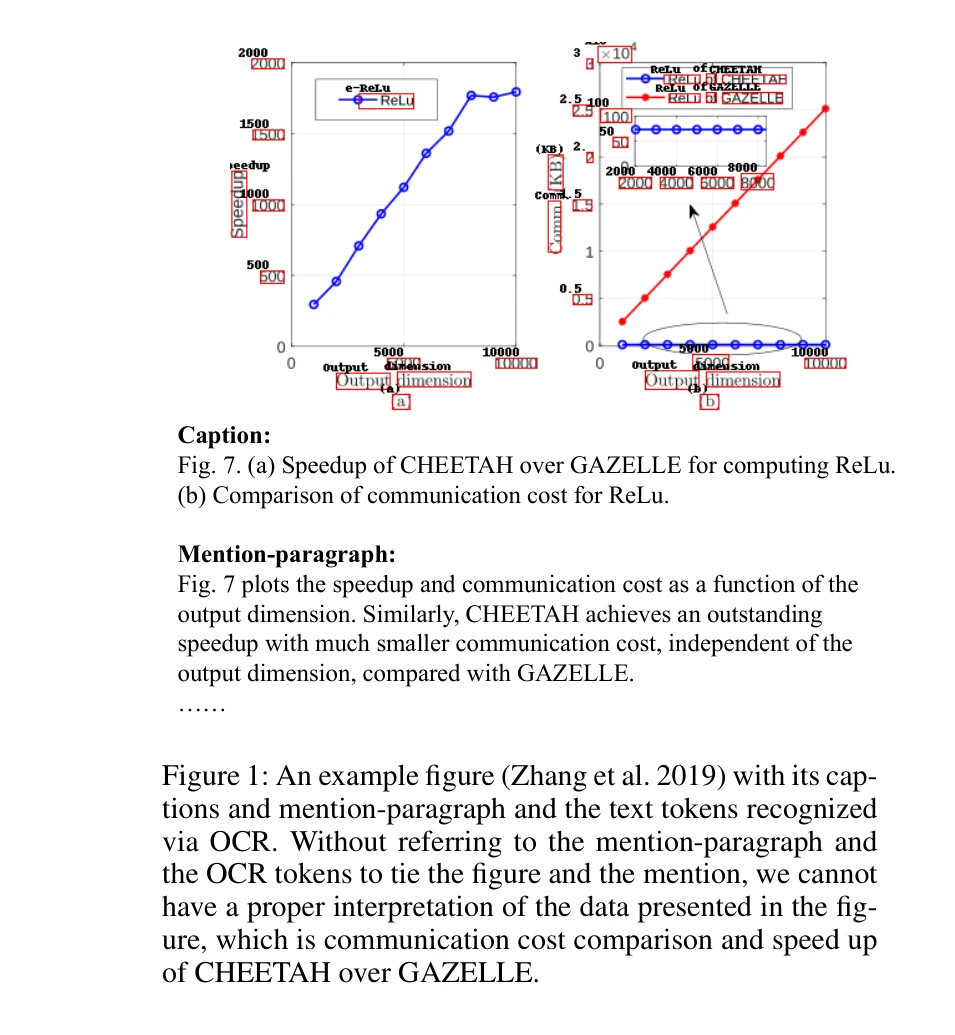

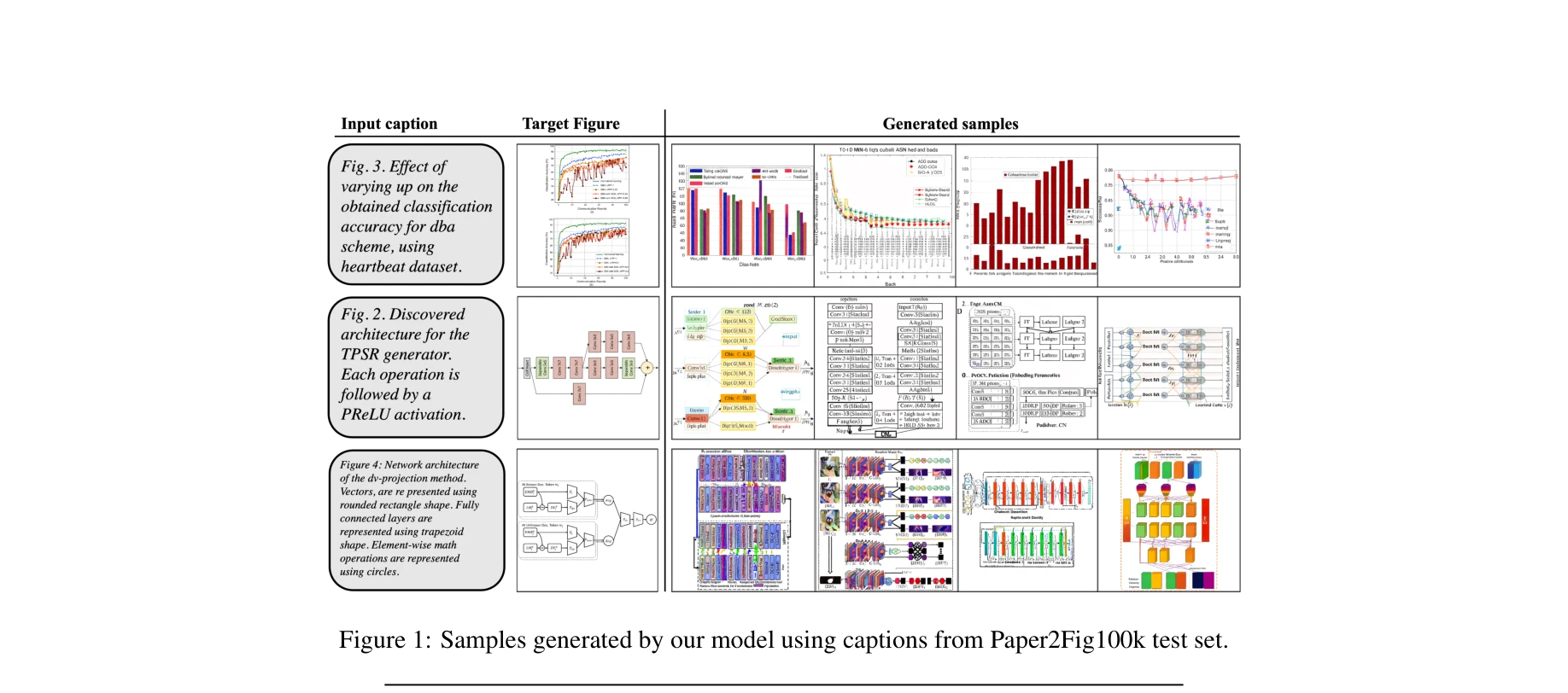

- Visual Scientific Reasoning: Visual Scientific Reasoning은 AI 기반 과학 연구 시스템에서 시각적 정보를 분석하고 추론하는 능력을 다루는 분야입니다. 이는 차트(Chart), 그래프, 그림 등 다양한 시각 자료를 Large Language Model(LLM)이 이해하고 해석하며 생성하는 기술을 포함합니다[201]. 과학 논문 작성 과정에서 AI를 효과적으로 활용하기 위한 모범 사례들과 함께, multimodal 피드백을 통한 추론 능력 향상 방법이 중요한 연구 주제가 되고 있습니다[203]. 또한 AI가 인간의 인지적 편향(cognitive biases)을 반영하고 시간 경과에 따른 인지 부채(cognitive debt)를 누적할 수 있다는 점도 고려해야 합니다[890]. 이러한 연구들은 AI 에이전트(AI agents)가 과학적 추론에서 인간 수준의 사고를 모방하도록 하면서도 그 한계를 인식하는 데 기여합니다[458]. 결과적으로 Visual Scientific Reasoning은 foundation models을 활용한 과학 연구의 정확성과 신뢰성을 향상시키는 핵심 기술 영역입니다[028].

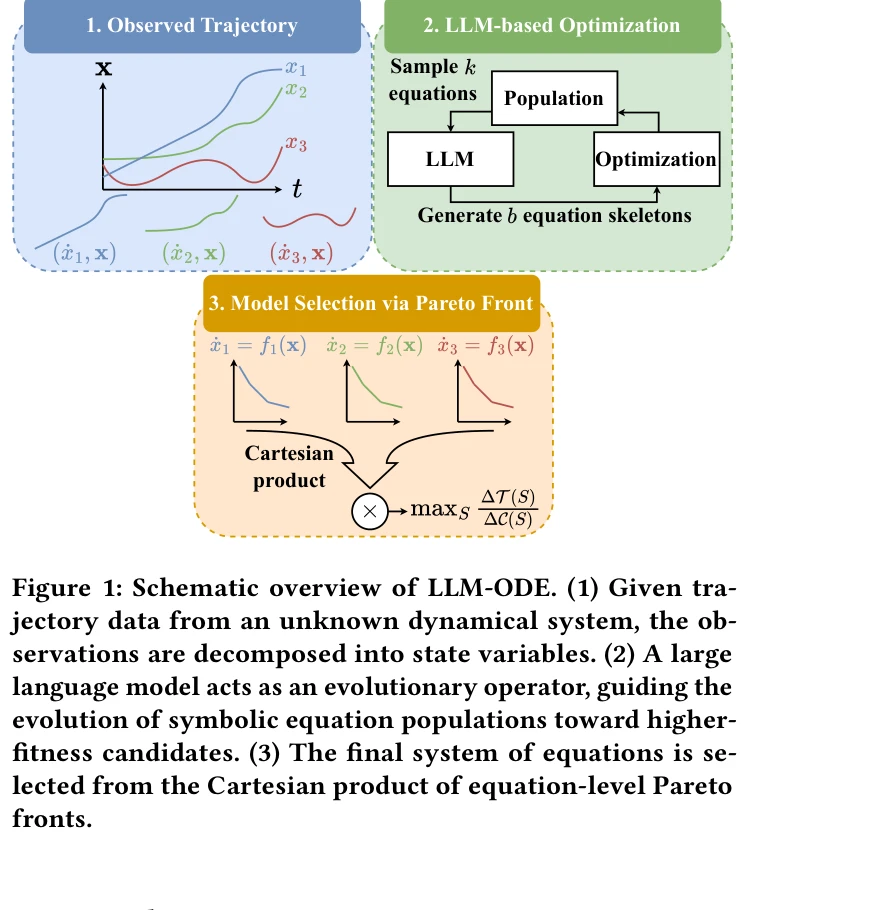

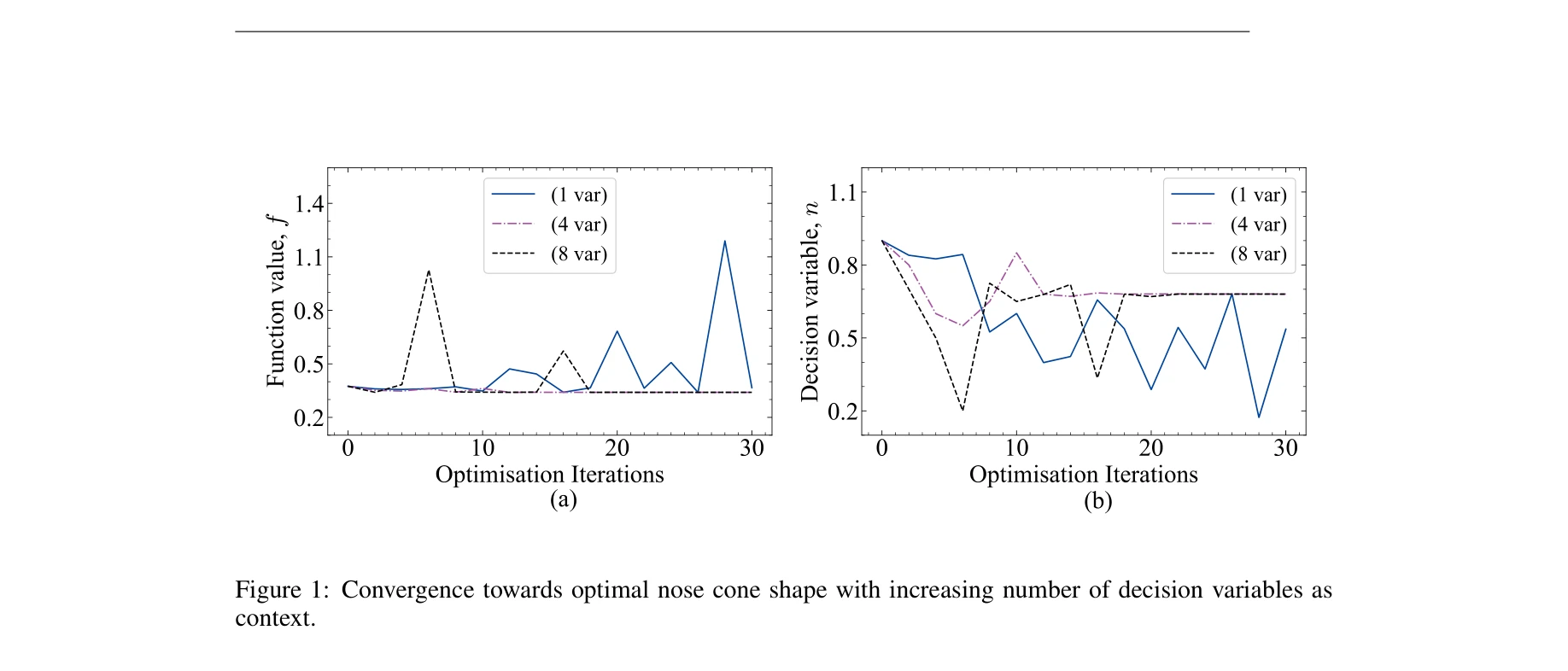

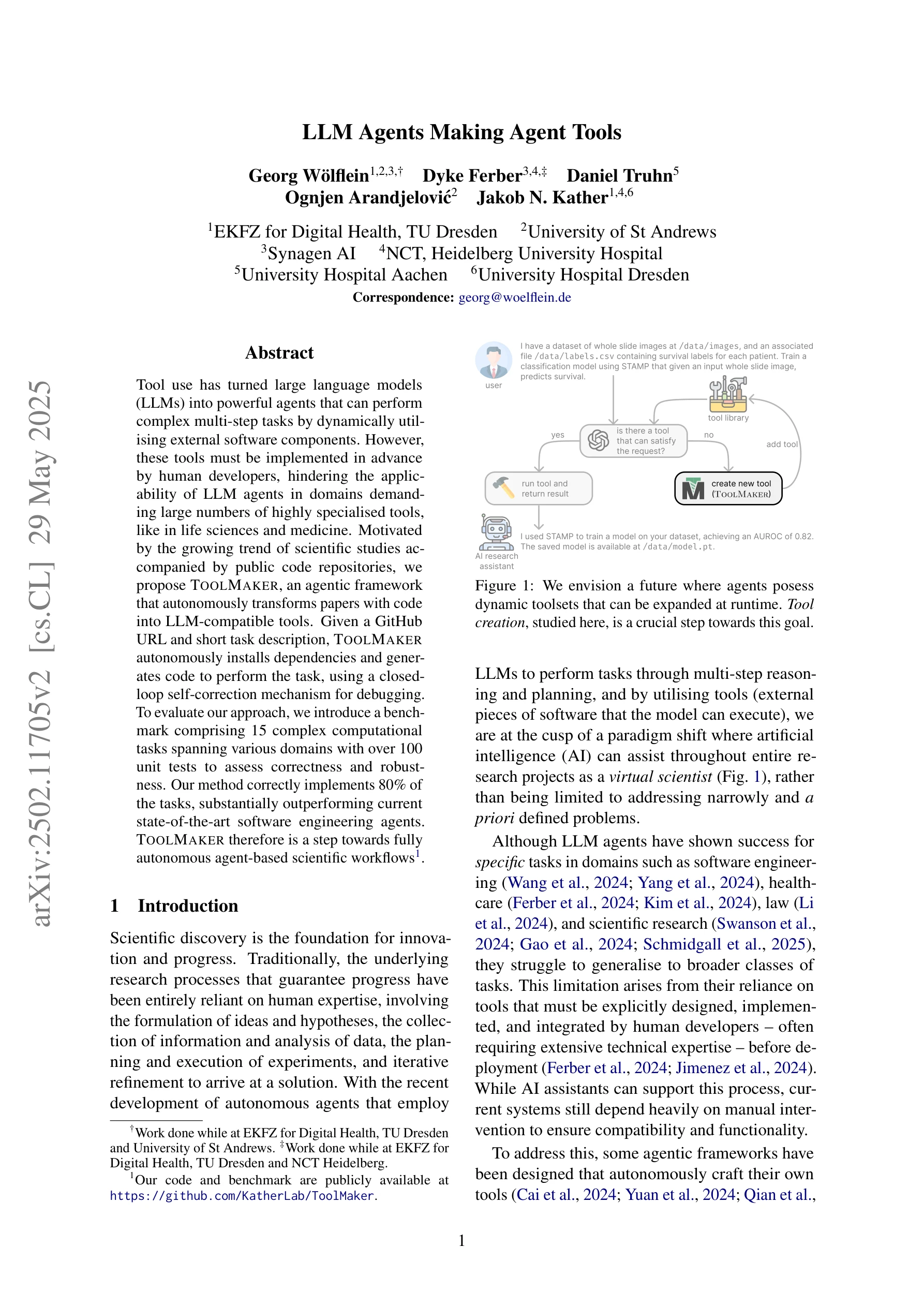

- Domain-specific Language Agents: Domain-specific Language Agents는 특정 분야의 전문 지식과 작업을 수행하기 위해 설계된 대규모 언어 모델(Large Language Models, LLM) 기반 에이전트입니다. 이러한 에이전트들은 생명과학, 기계설계, 최적화 등 다양한 도메인에서 자율적으로 복잡한 문제를 해결하고 의사결정을 수행할 수 있습니다. BioBERT와 같은 사전학습된 언어 표현 모델(pre-trained language representation model)은 특정 분야의 용어와 개념을 이해하도록 최적화되어 있으며[161], 이를 바탕으로 도메인별 에이전트가 더욱 정교한 작업을 수행할 수 있습니다. 멀티 에이전트 시스템(Multi-Agent Systems)과 정책 전이(Policy Transfer) 기술을 통해 여러 에이전트가 협력하거나 한 분야의 학습을 다른 분야에 적용할 수 있으며[033], LLM 에이전트는 진화적 최적화(Evolutionary Optimization)와 같은 고급 기법을 활용하여 창의적인 설계 및 최적화 문제를 해결합니다[462]. 이러한 도메인별 에이전트의 발전은 과학 연구, 산업 설계, 자동화된 분석 등 실무 분야에서 인공지능의 실질적 가치를 크게 높이고 있습니다.

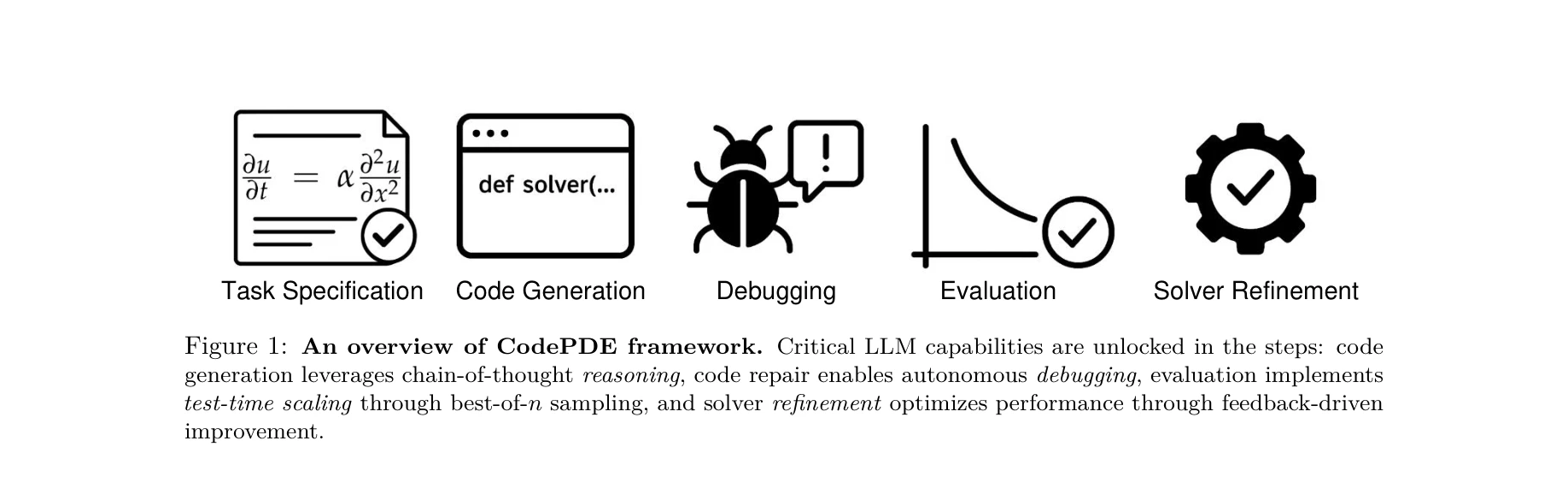

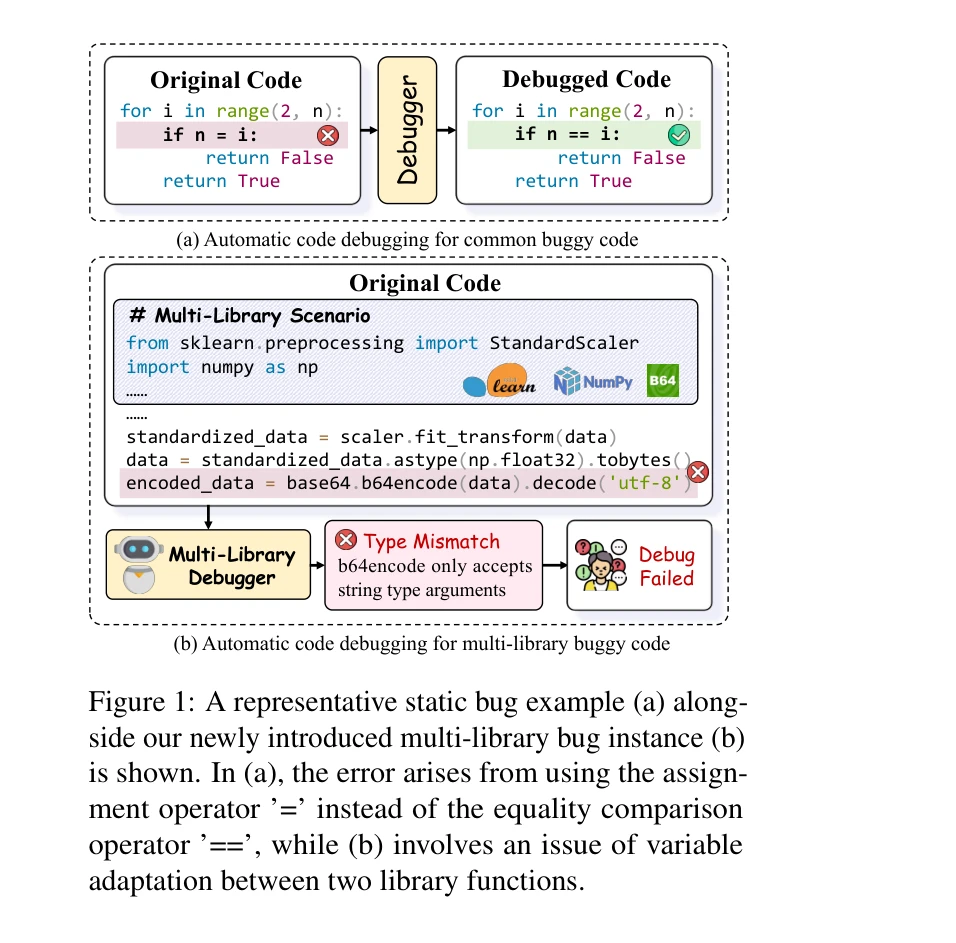

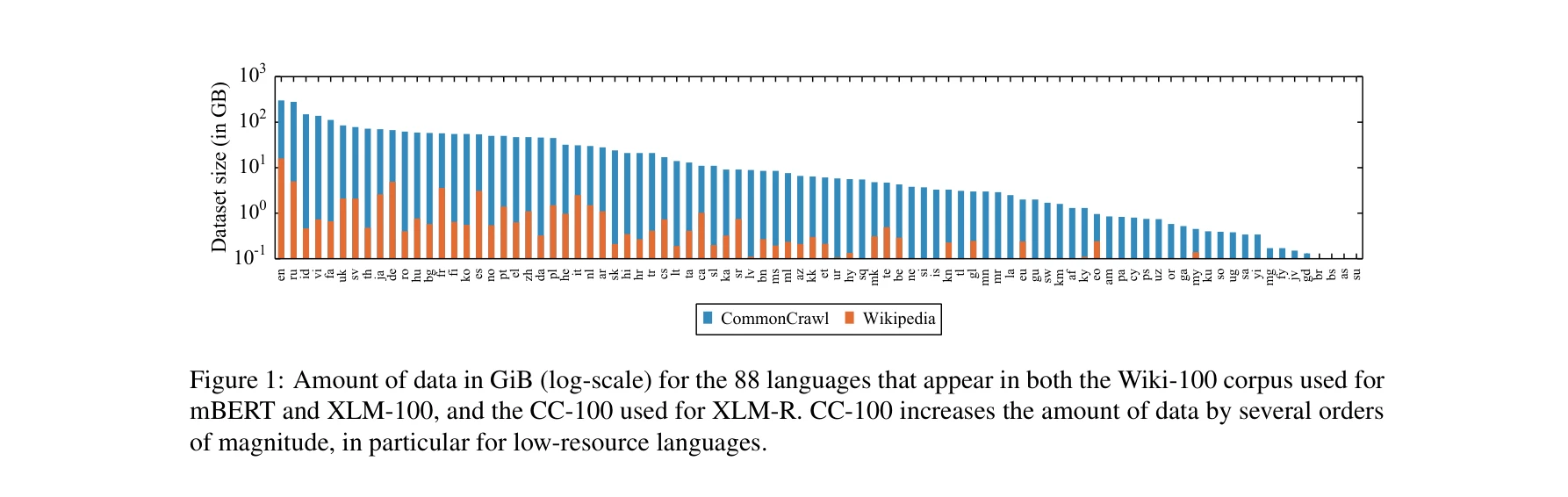

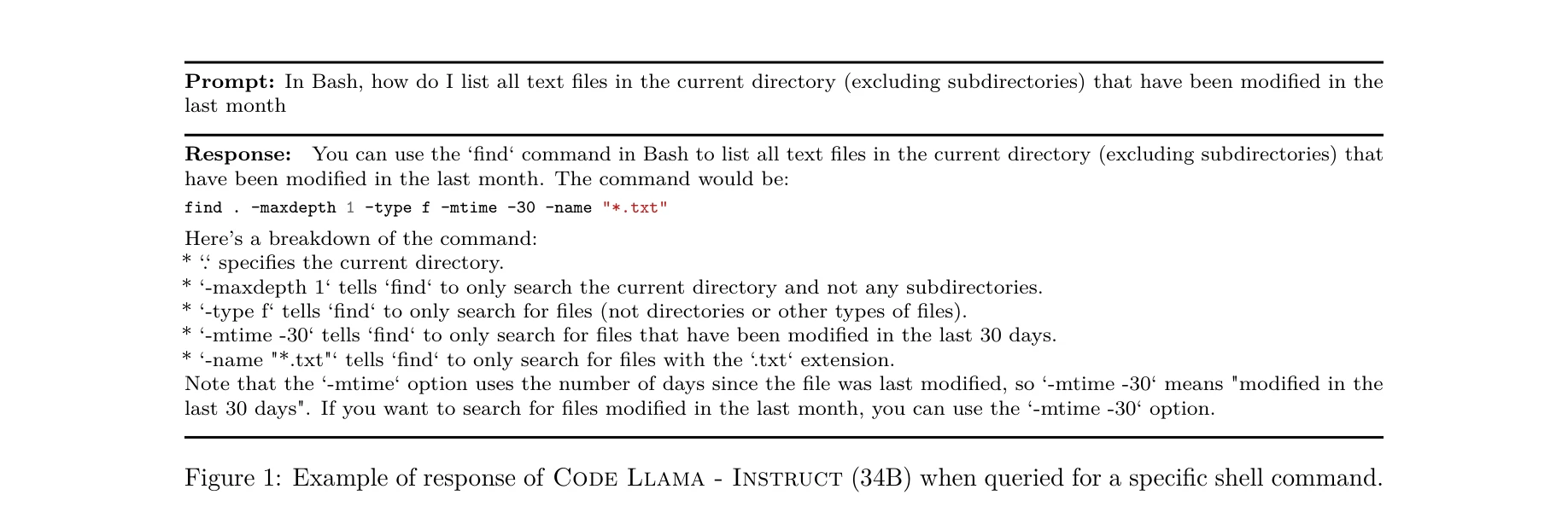

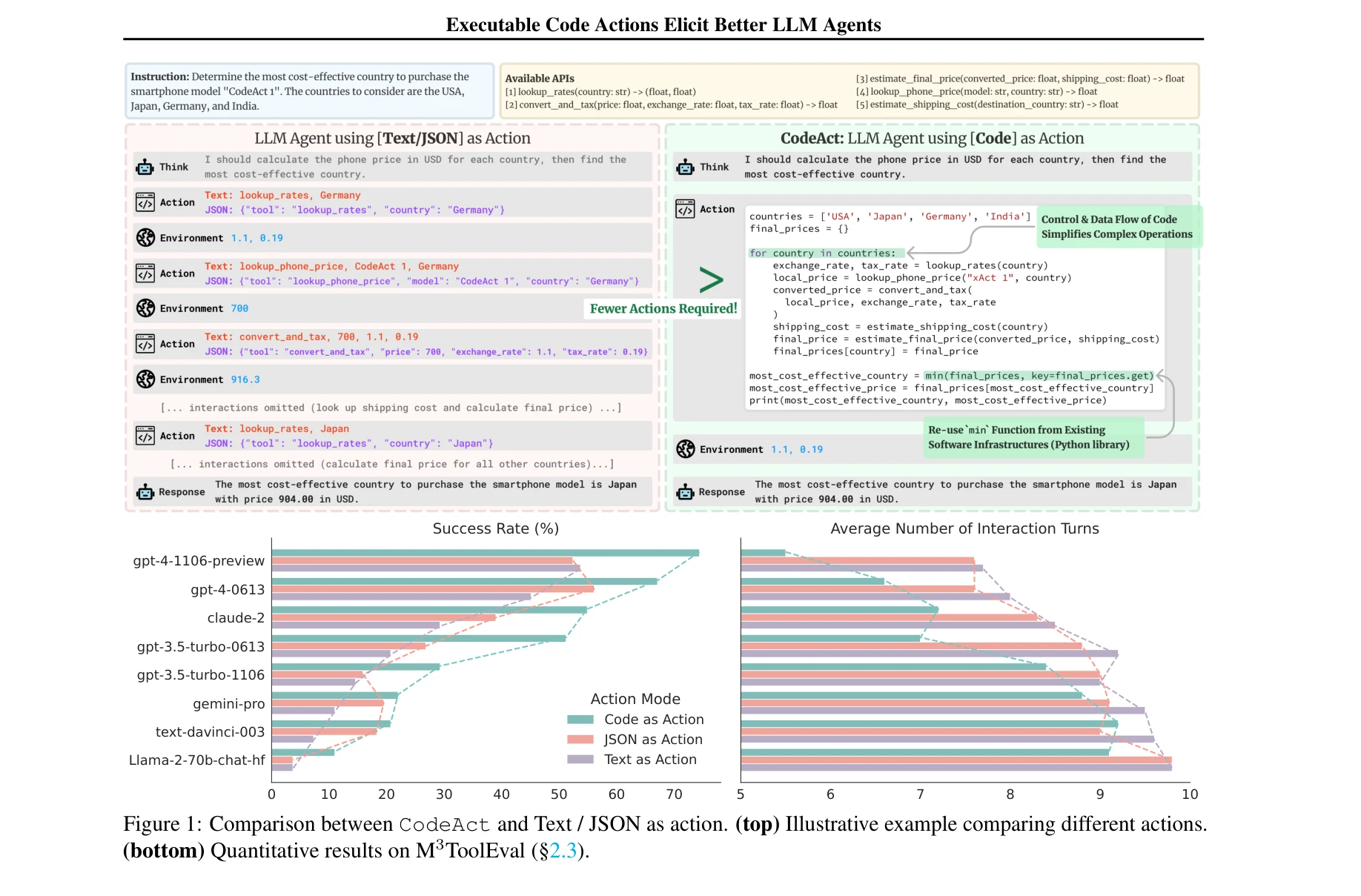

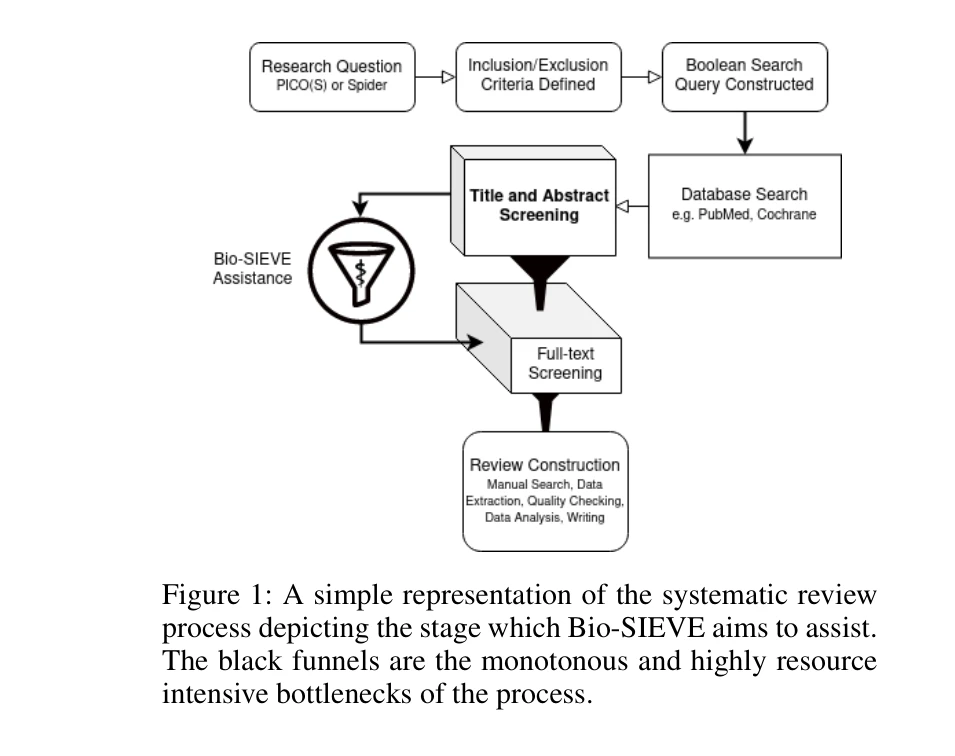

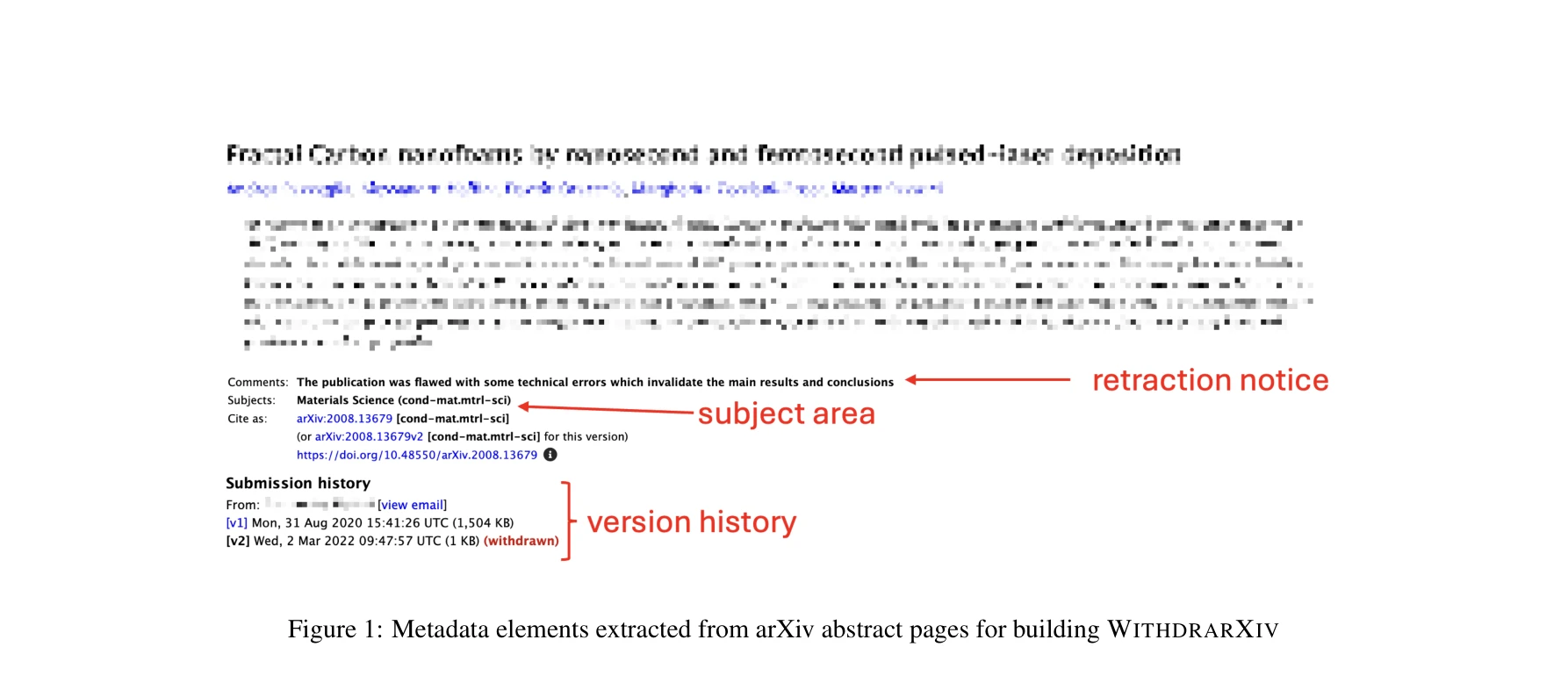

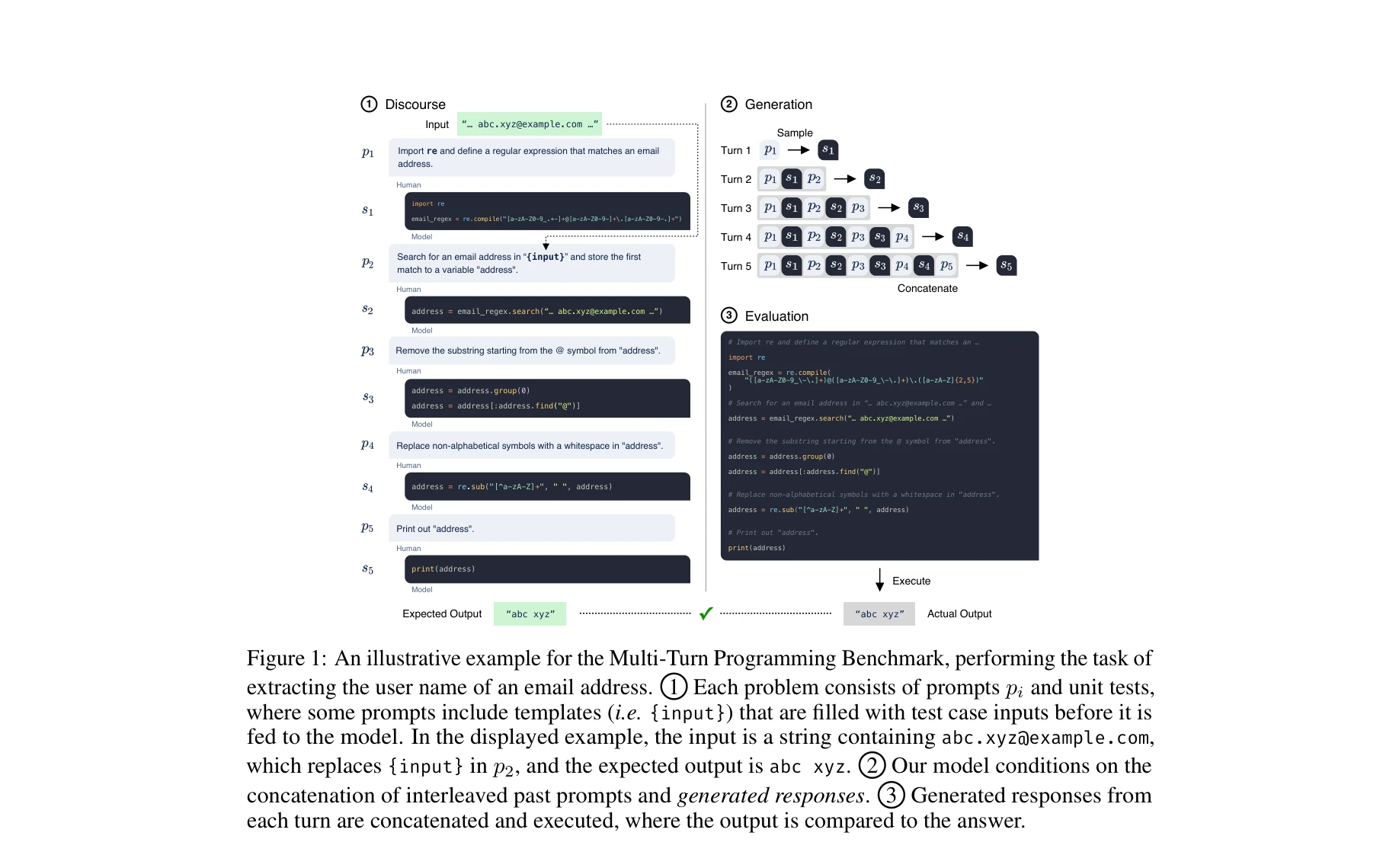

- Scientific Code Generation: Scientific Code Generation은 AI 기반 과학 연구 시스템에서 과학자들의 코드 작성을 자동화하고 지원하는 핵심 기술 영역이다. 이 분야는 SciCode와 같은 과학자 중심의 벤치마크 데이터셋 [712]을 통해 과학 분야별 코딩 능력을 평가하며, StarCoder 같은 대규모 언어 모델 [771]을 활용하여 과학적 코드 생성의 정확성과 효율성을 향상시키고 있다. 동시에 과학 논문의 근거 검증, 가설 생성 및 검증 [719], 체계적 문헌 고찰의 자동화 [862] 등 다양한 과학 연구 과정에서 AI 기반 코드 생성이 활용되고 있다. 데이터 무결성(data integrity) 문제 [252]와 다언어 지원 [023] 같은 실제 과학 연구 환경의 도전 과제들도 함께 다루어지고 있으며, 이러한 기술들이 과학 출판과 접근성을 개선하는 데 기여하고 있다.

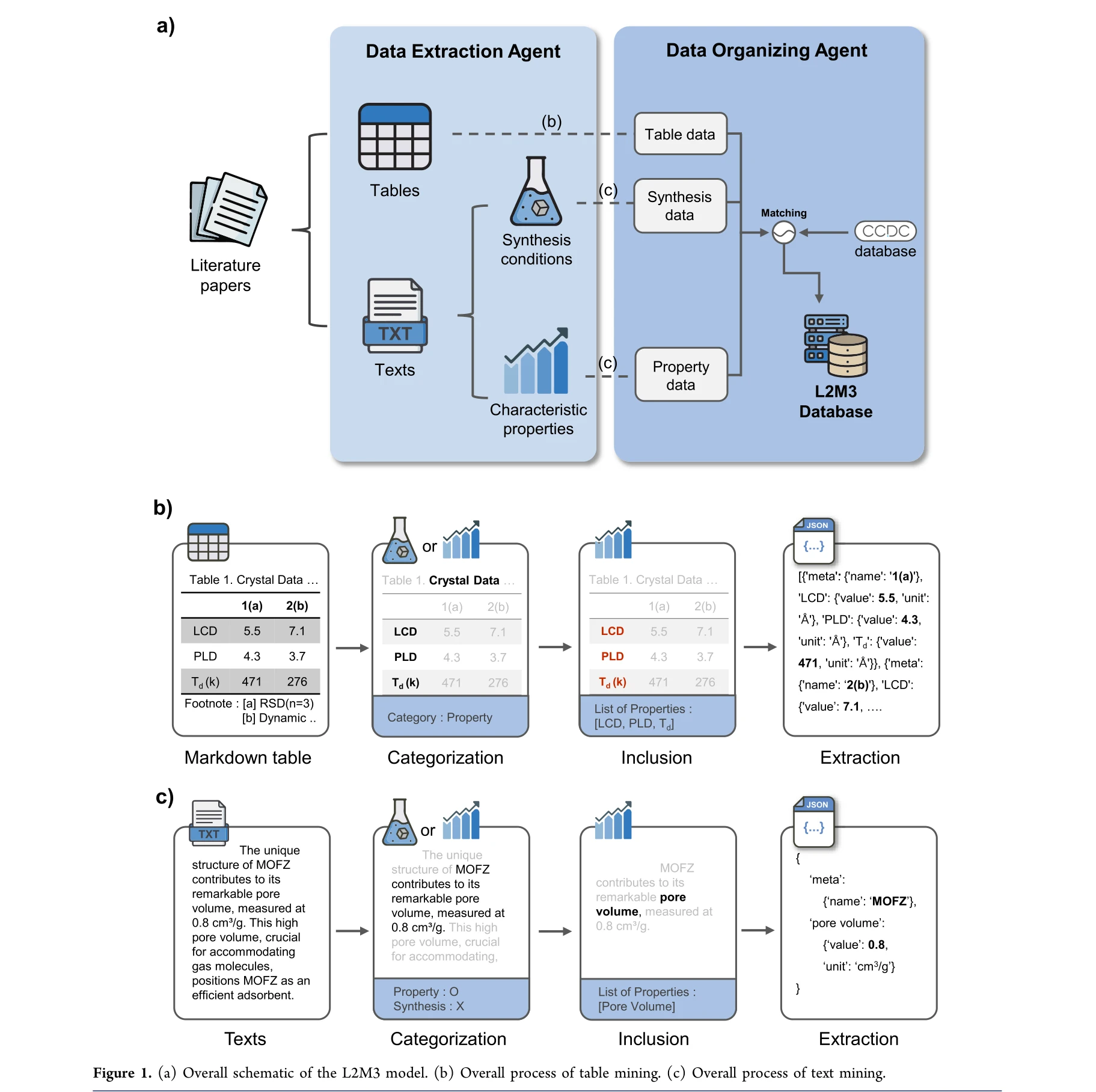

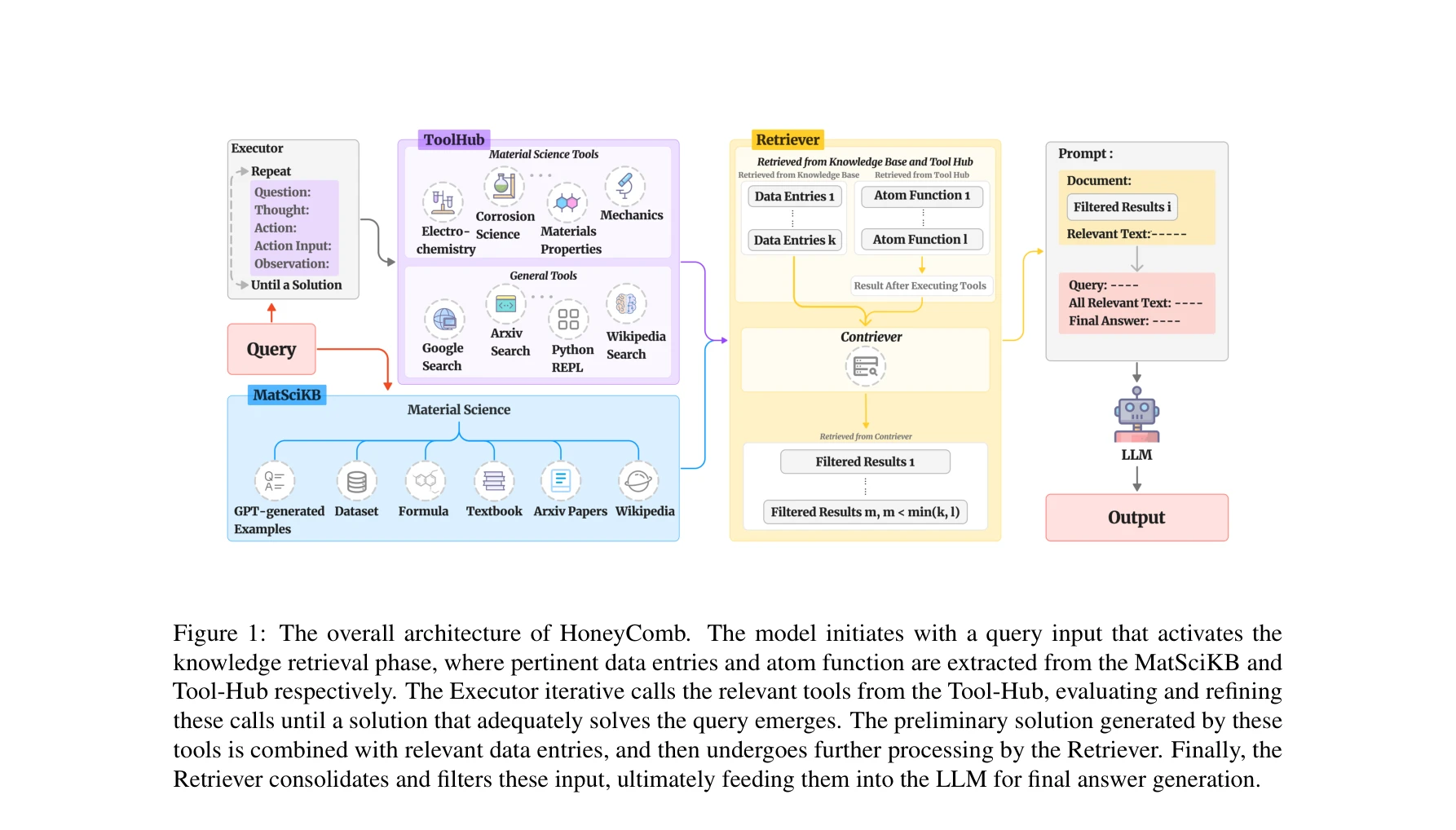

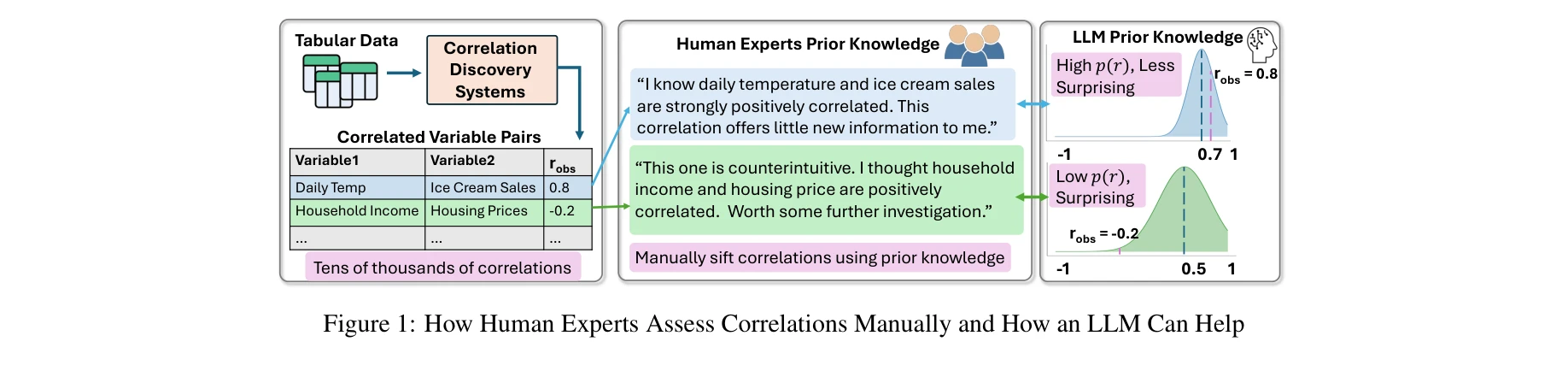

- Scientific Data Interpretation: Scientific Data Interpretation은 대규모 언어모델(LLM)과 AI 에이전트를 활용하여 과학 분야의 복잡한 데이터를 자동으로 분석하고 해석하는 시스템입니다. [253]의 Data Interpreter와 같은 LLM 에이전트는 데이터 과학(Data Science) 작업을 자율적으로 수행하며, [170]의 Blade와 같은 벤치마킹 시스템은 이러한 에이전트들의 성능을 평가합니다. 재료과학(Material Science) 분야에서는 [523]의 MatterChat과 같은 멀티모달 LLM(Multi-Modal LLM)이 다양한 형식의 데이터를 통합하여 분석하고, [451]의 지식 가이드 LLM은 도메인 특화 지식을 결합하여 정확도를 높입니다. 또한 [404]의 사례 연구처럼 Gemini 같은 고급 모델이 과학 연구를 가속화하고 있으며, [404]의 고성능 검색증강생성(RAG) 기술은 대규모 과학 문헌에서 필요한 정보를 효율적으로 추출합니다. 이러한 기술들은 연구자들이 데이터 분석에 소요되는 시간을 단축하고 더 정확한 과학적 해석을 가능하게 합니다.

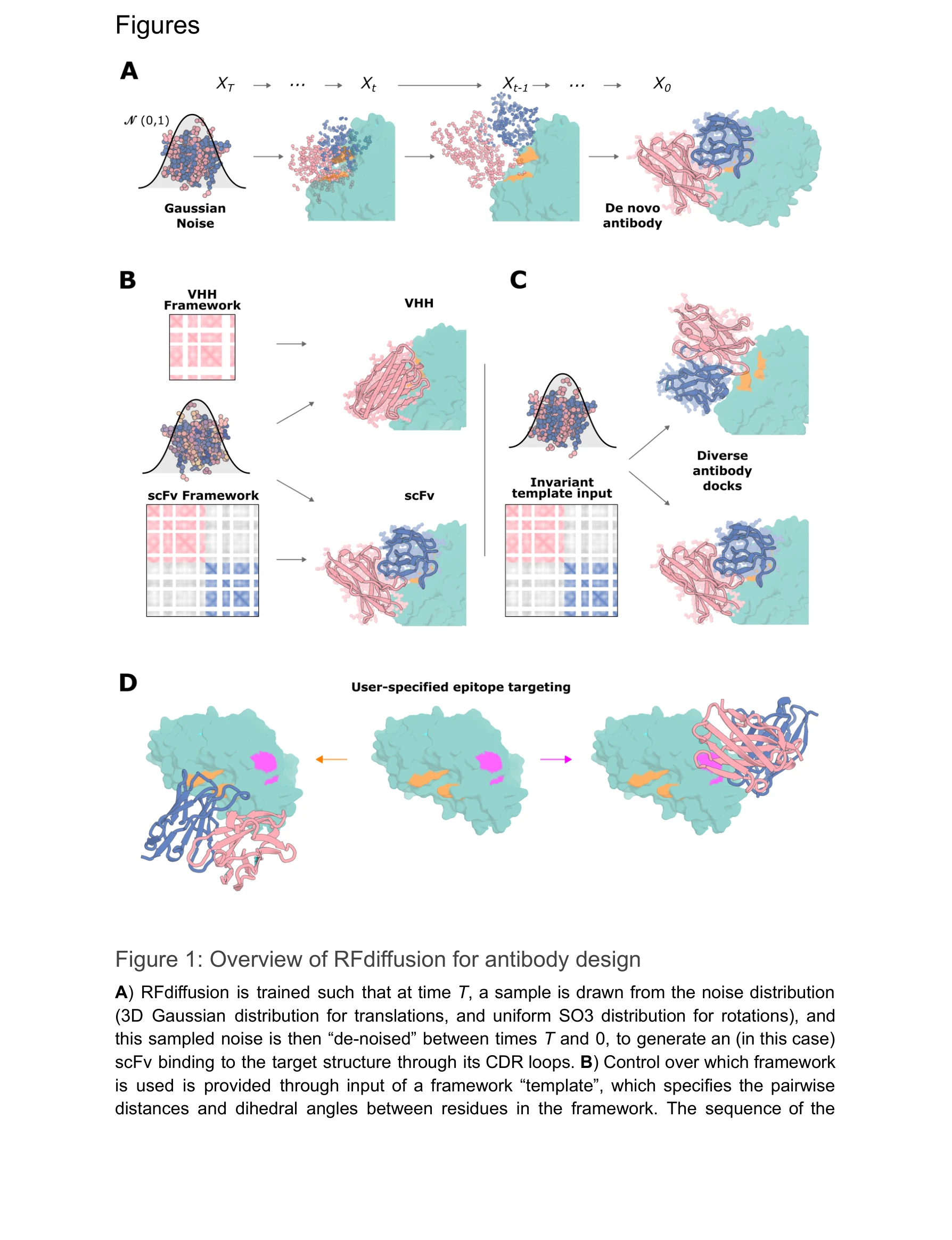

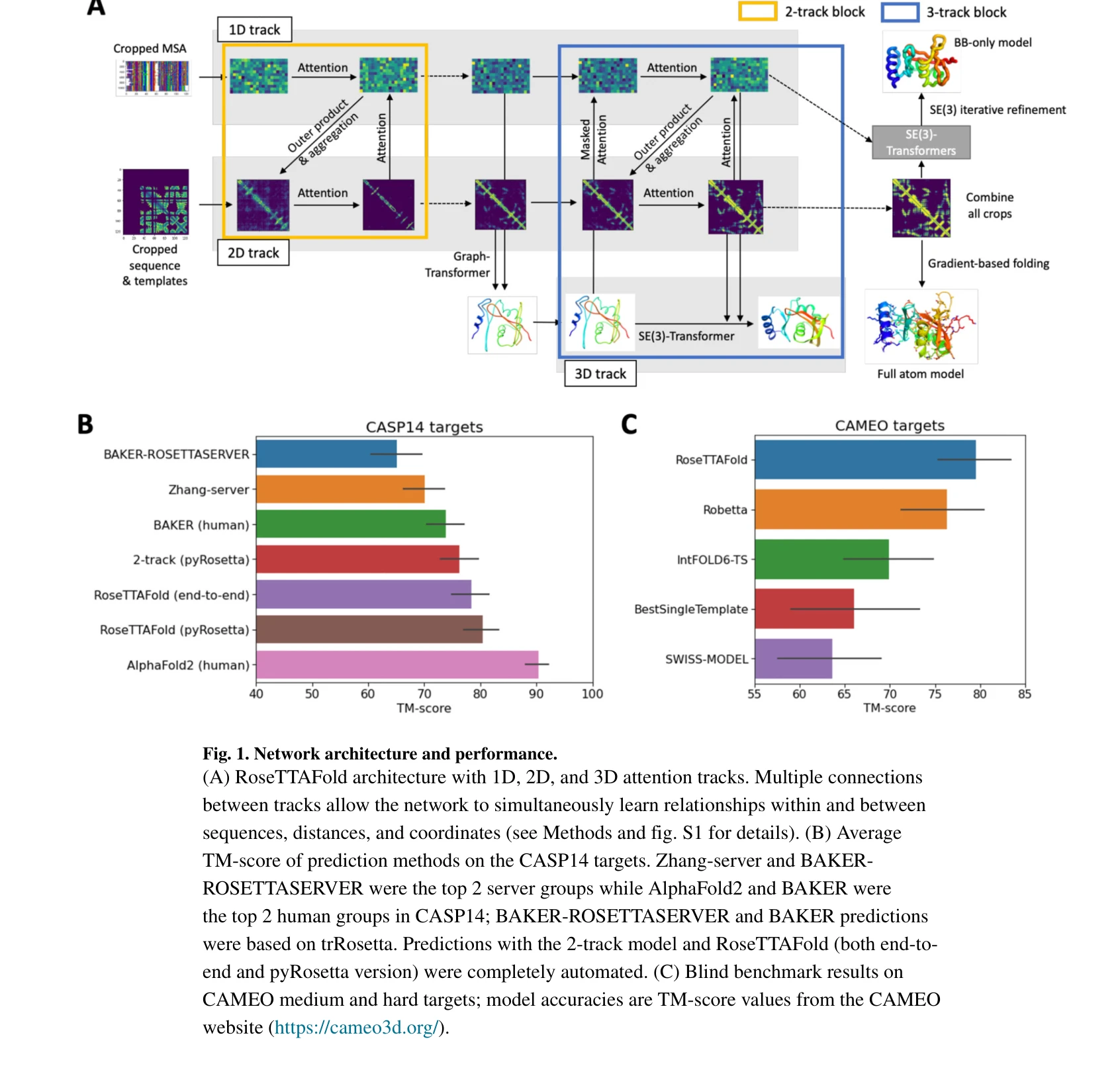

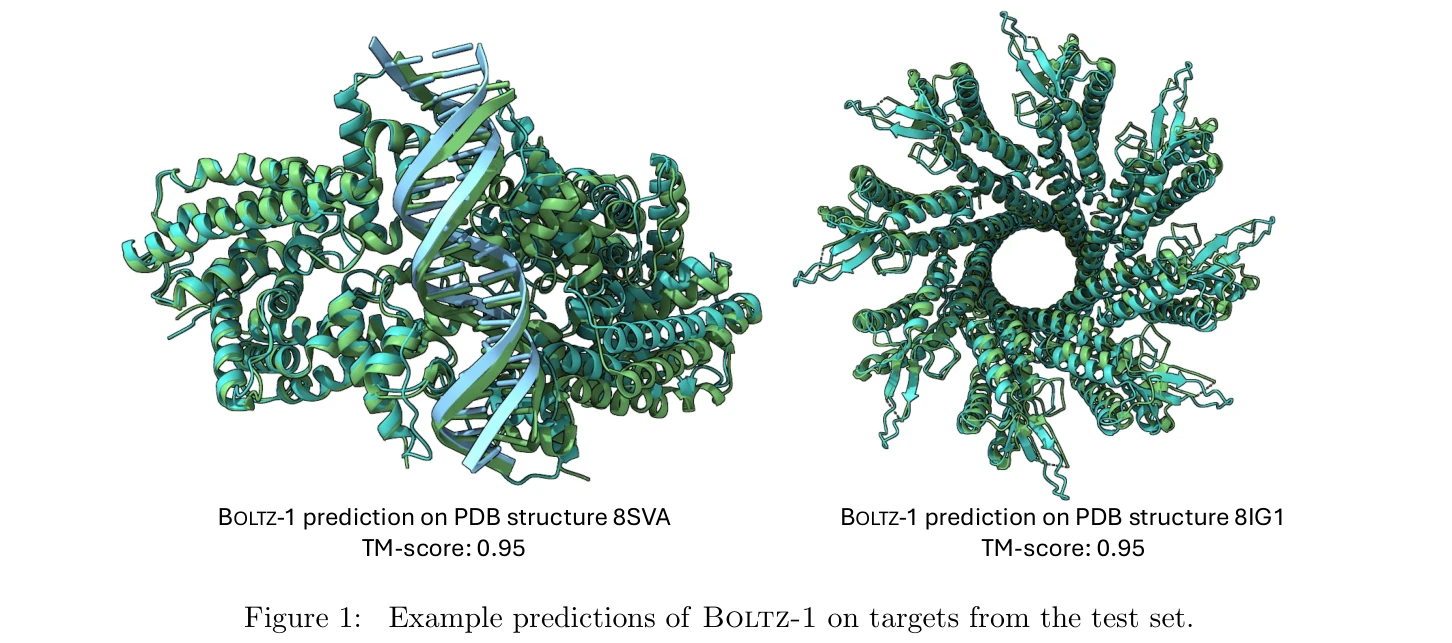

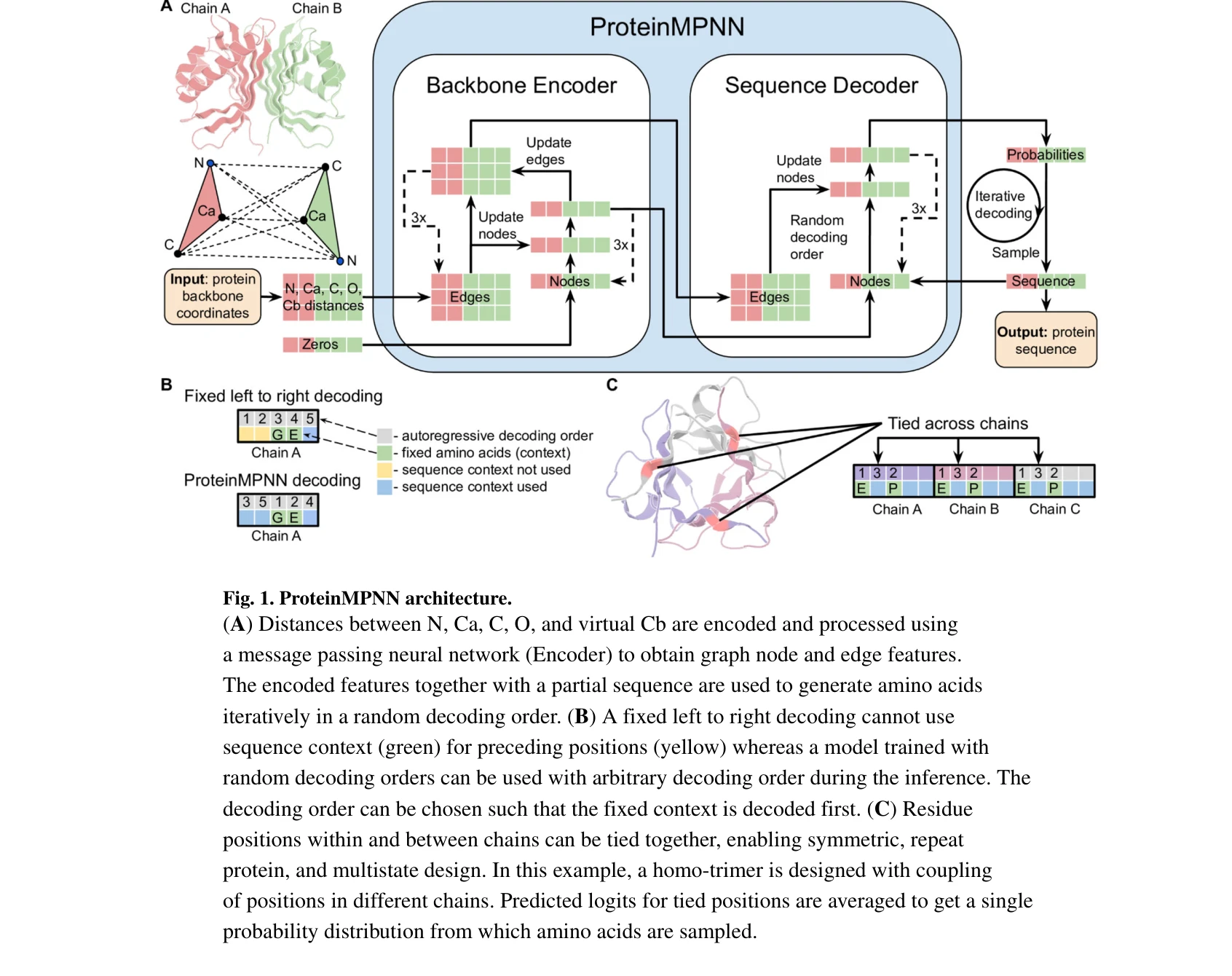

- Protein Structure Prediction: 단백질 구조 예측(Protein Structure Prediction)은 AI 기반 과학 연구 시스템에서 가장 중요한 분야 중 하나입니다. AlphaFold를 통한 고정확도의 단백질 3차원 구조 예측 기술 [403]은 생물 분자 상호작용(Biomolecular Interactions)의 정확한 구조 예측 [046]으로 발전했습니다. 최근에는 단순 예측을 넘어 에이전트 기반의 신규 단백질 설계(De Novo Protein Design)가 가능해졌으며, 맞춤형 동역학 특성을 가진 단백질을 설계하는 기술 [256], [065]이 개발되었습니다. 또한 양자 해밀턴 예측 벤치마크 [646]와 항체의 원자 수준 정확도 설계 기술 [112]도 단백질 구조 예측 분야를 한층 고도화하고 있습니다. 이러한 기술들은 신약 개발, 효소 공학, 바이오테크놀로지 분야에 혁신적인 변화를 가져오고 있습니다.

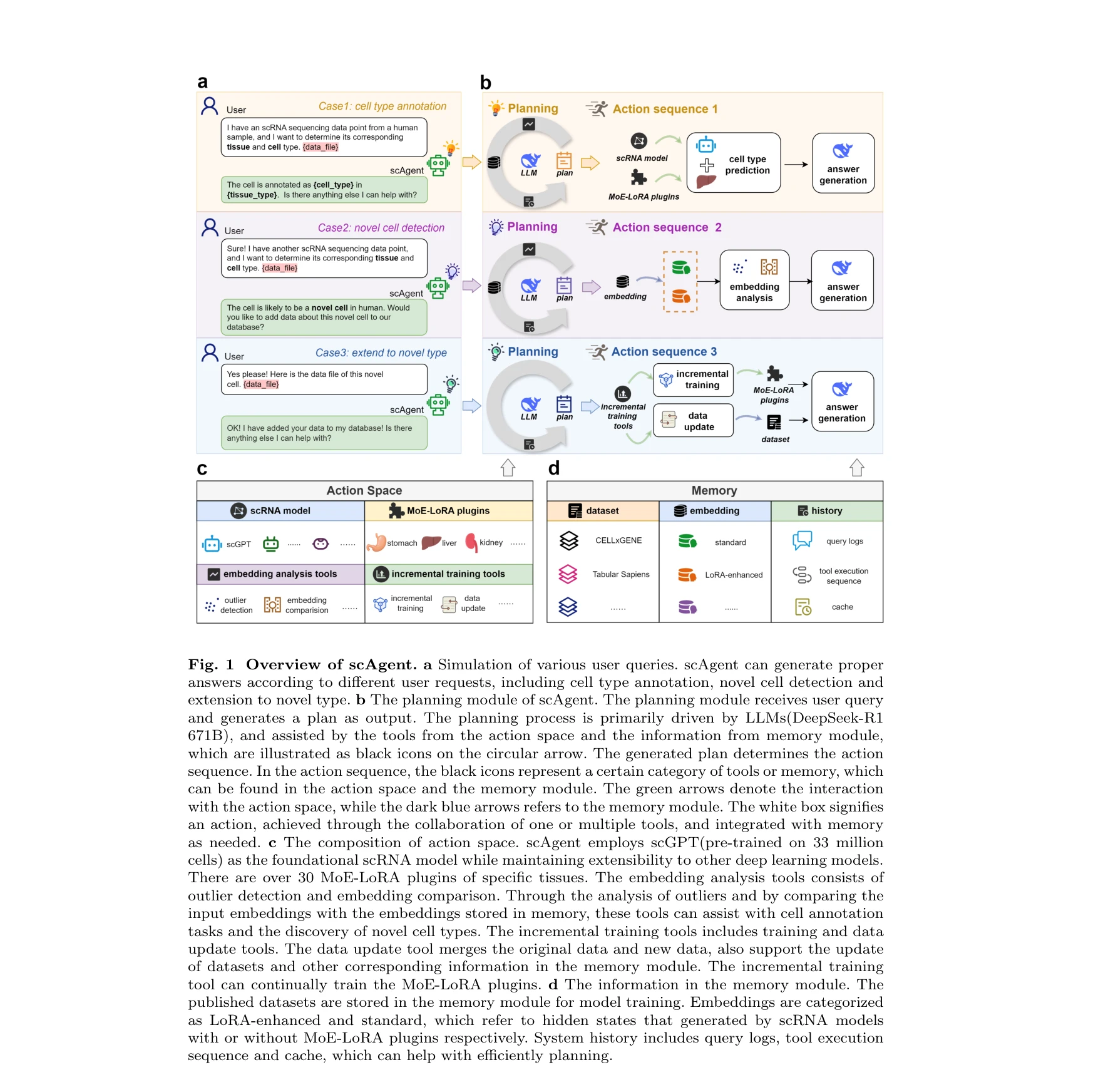

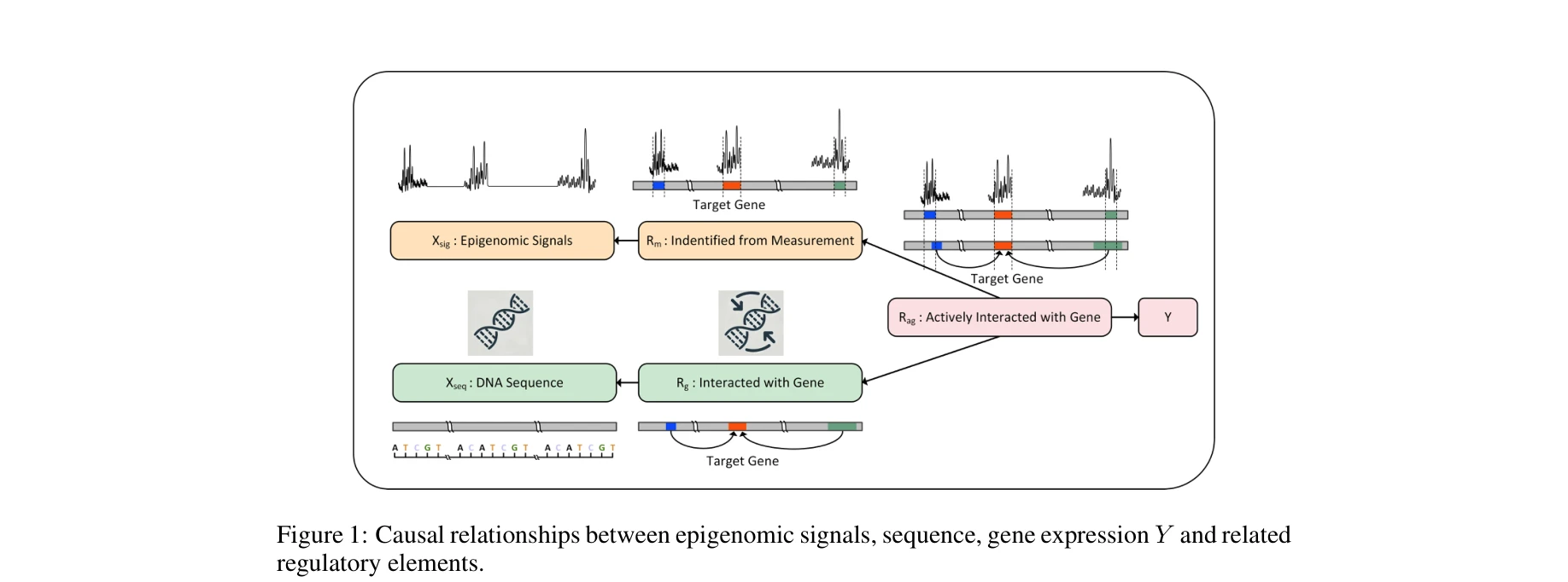

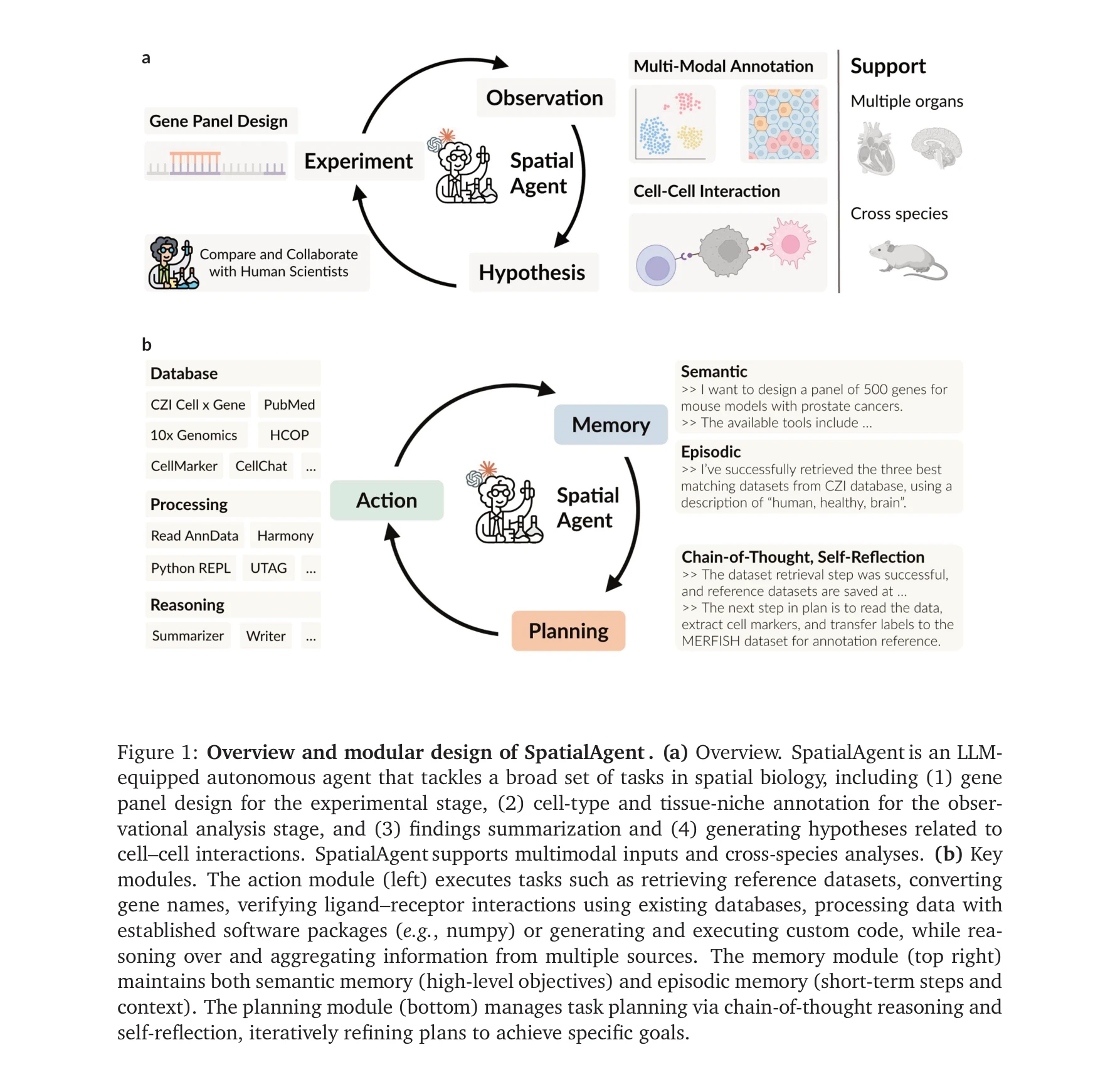

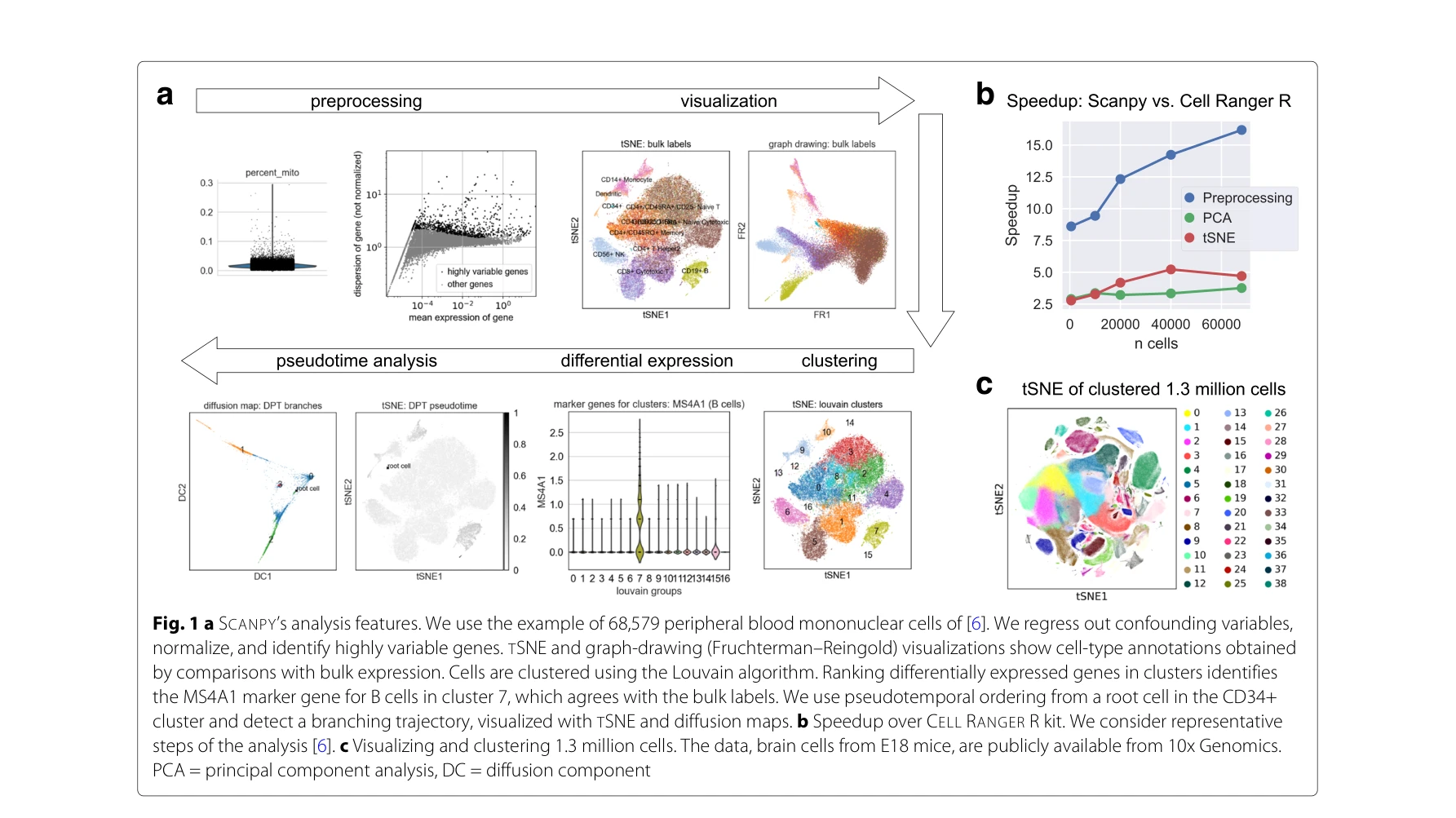

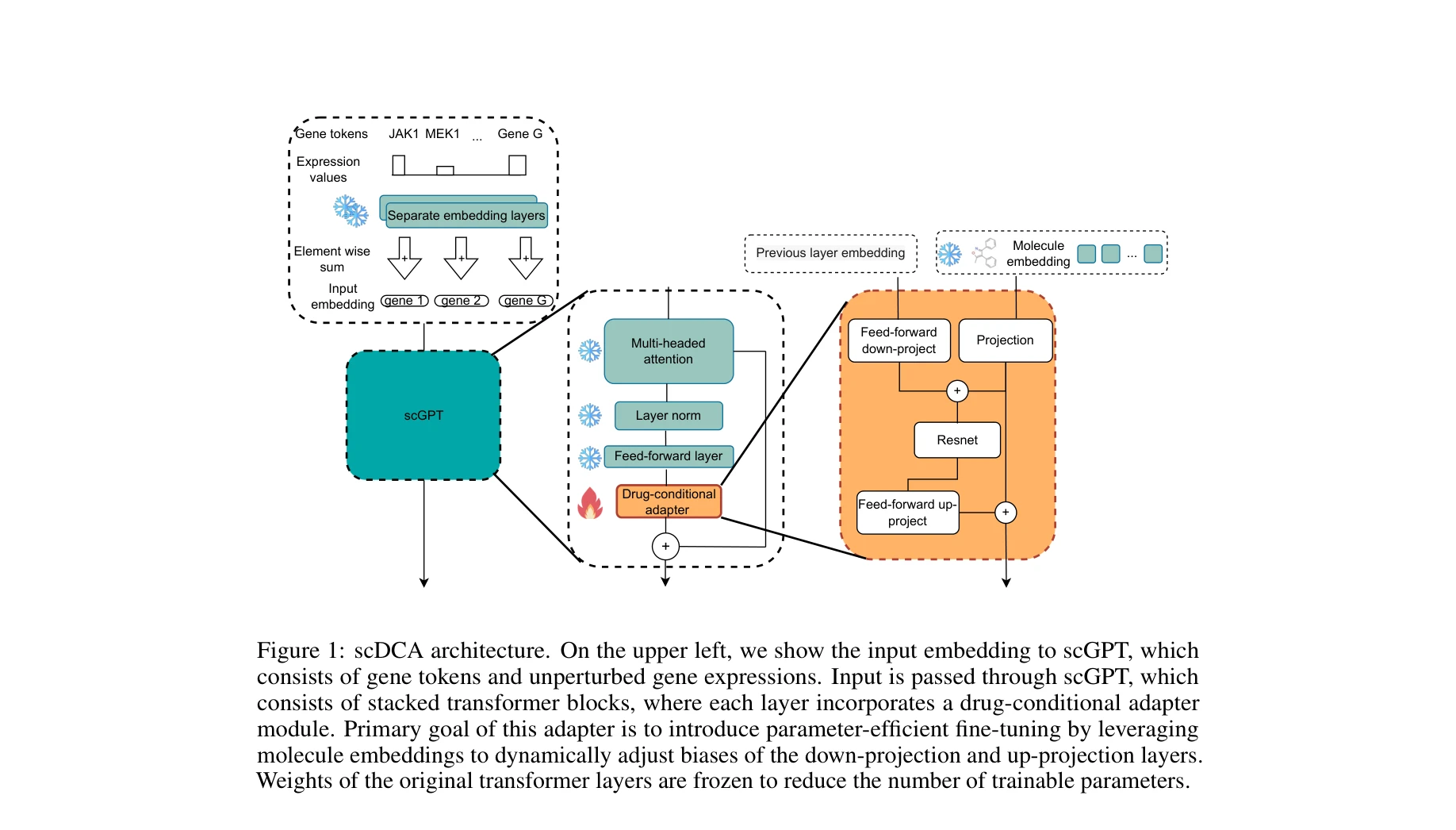

- Single-cell RNA Analysis: 단일세포 RNA 분석(Single-cell RNA Analysis)은 개별 세포 수준에서 유전자 발현을 정밀하게 측정하고 해석하는 AI 기반 과학 연구 분야입니다. 이 분야는 멀티모달 데이터 통합[431]과 대규모 언어 모델(Large Language Model, LLM) 기반 자동화 에이전트[193]를 활용하여 복잡한 생물학적 현상을 체계적으로 분석합니다. 특히 AI 큐레이션 데이터베이스[700]와 자율 기계 학습(Autonomous Machine Learning)[069] 기술을 통해 연구자들은 세포 이질성(Cell heterogeneity)을 더욱 효과적으로 규명할 수 있습니다. 능동학습(Active Learning) 기반의 실험 설계[258]와 대화형 에이전틱 AI 프레임워크[612]는 과학적 발견을 가속화하고 생물정보학적 해석의 정확성을 향상시킵니다. 이러한 통합적 접근은 암, 면역질환, 신경퇴행성 질환 등 다양한 생물의학 분야에서 세포 수준의 메커니즘 규명을 가능하게 합니다.

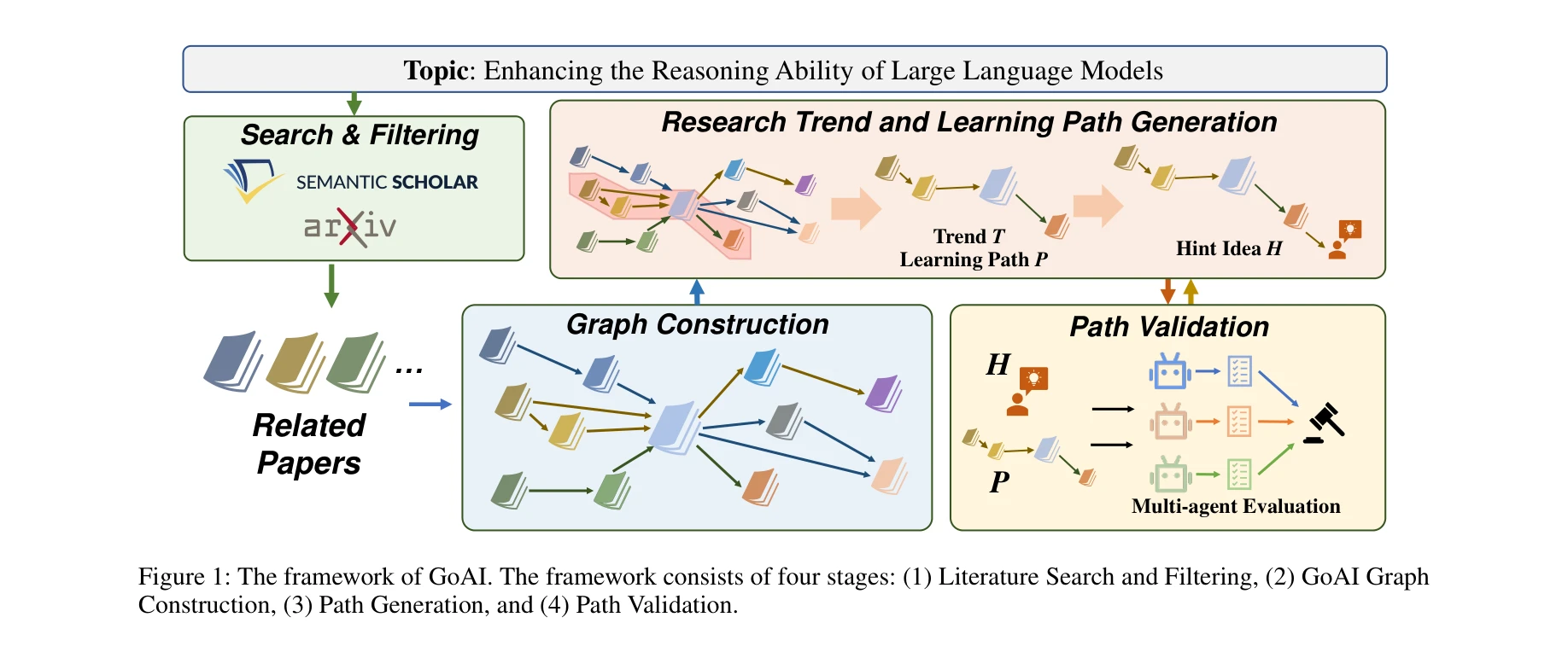

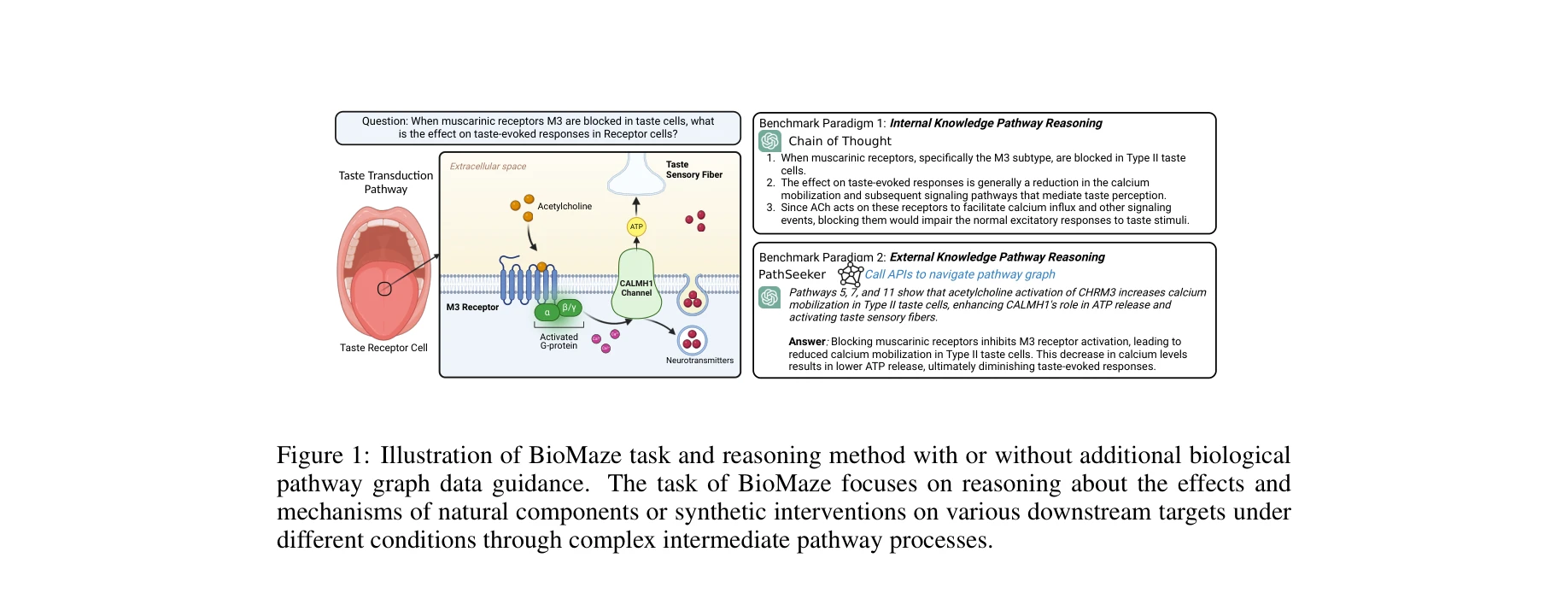

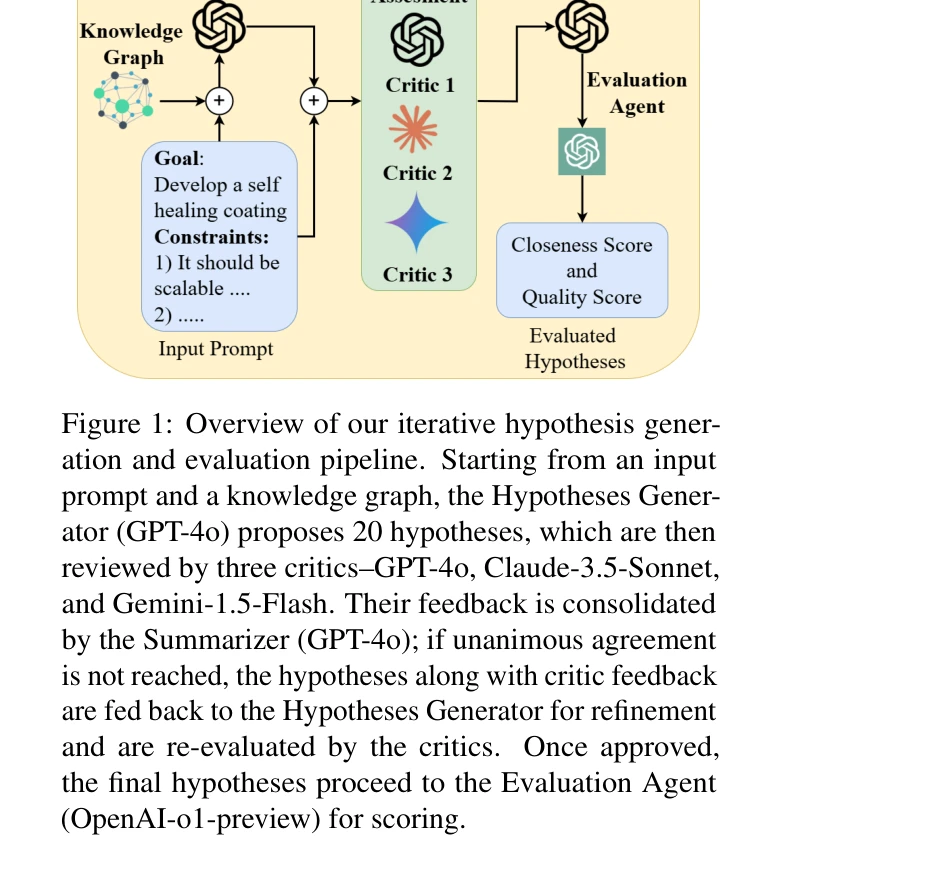

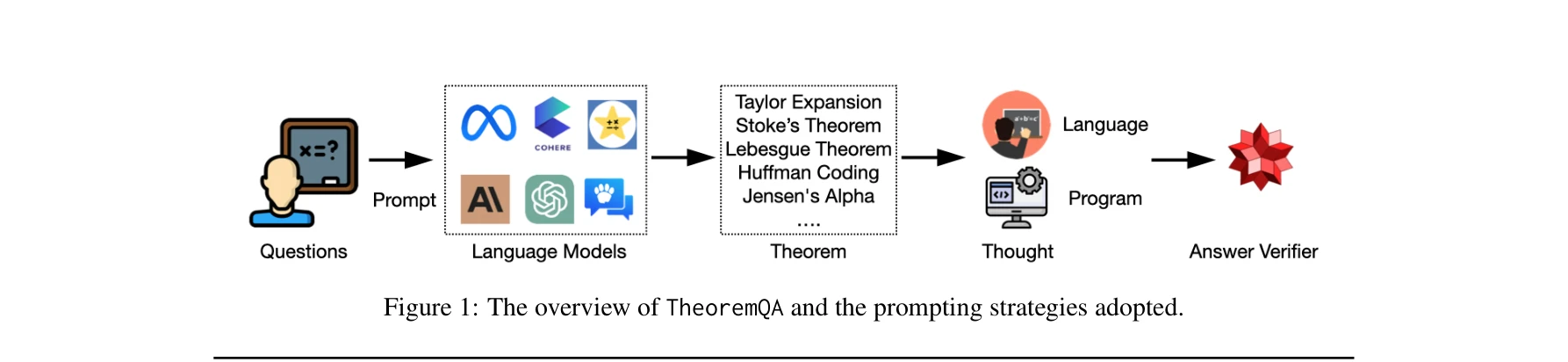

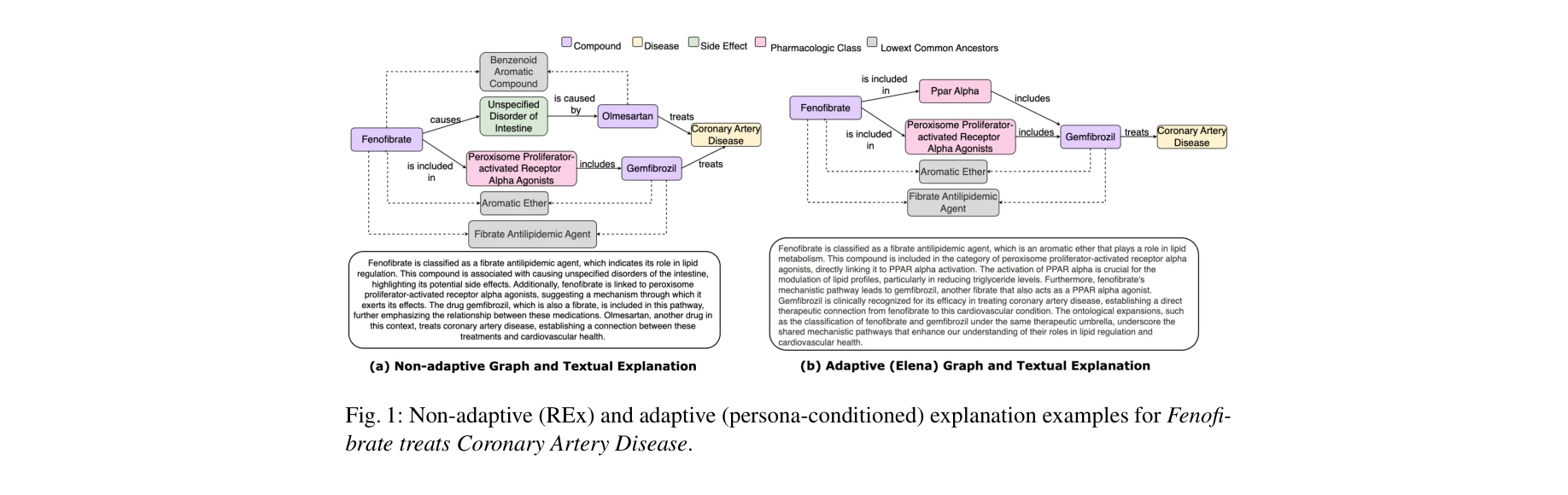

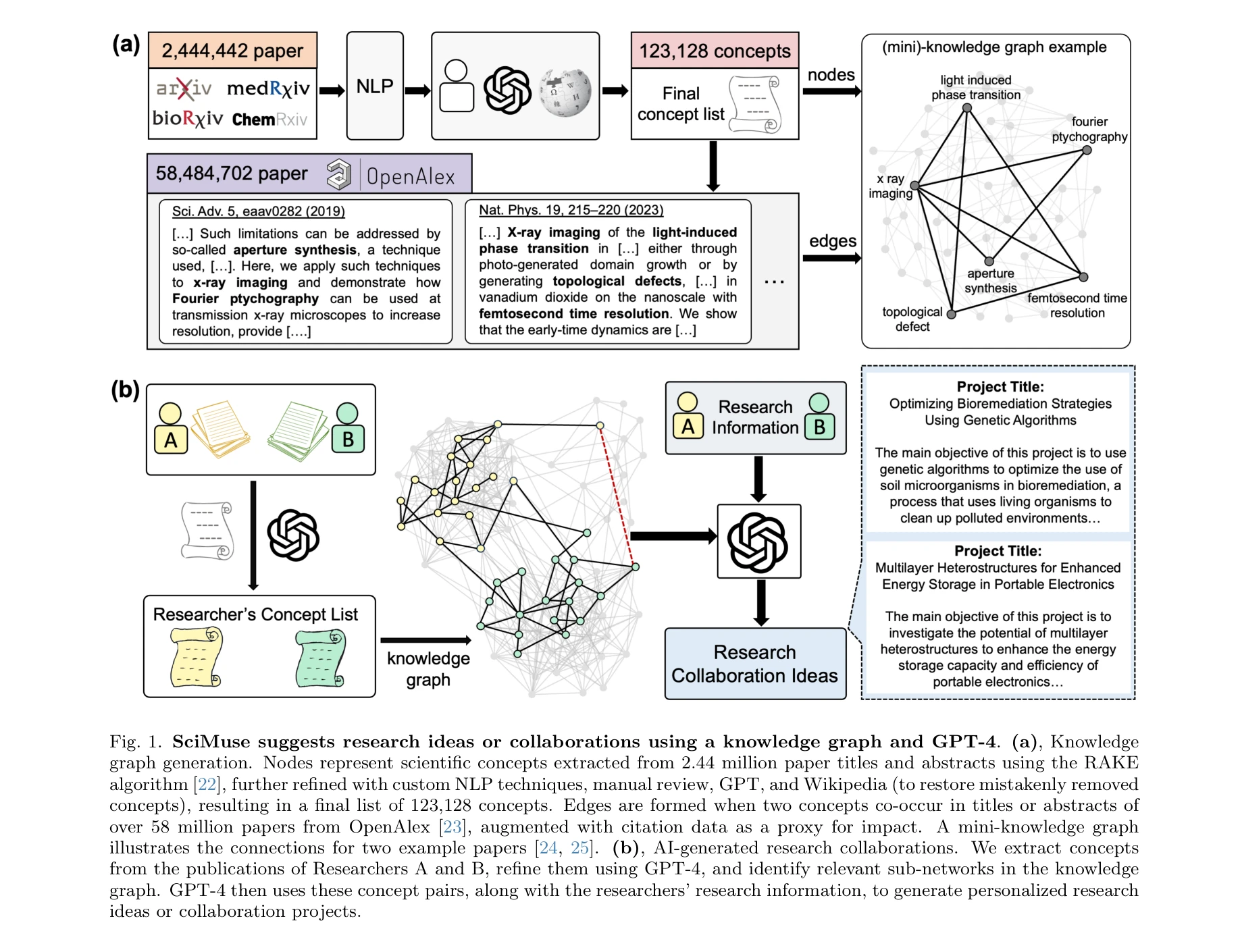

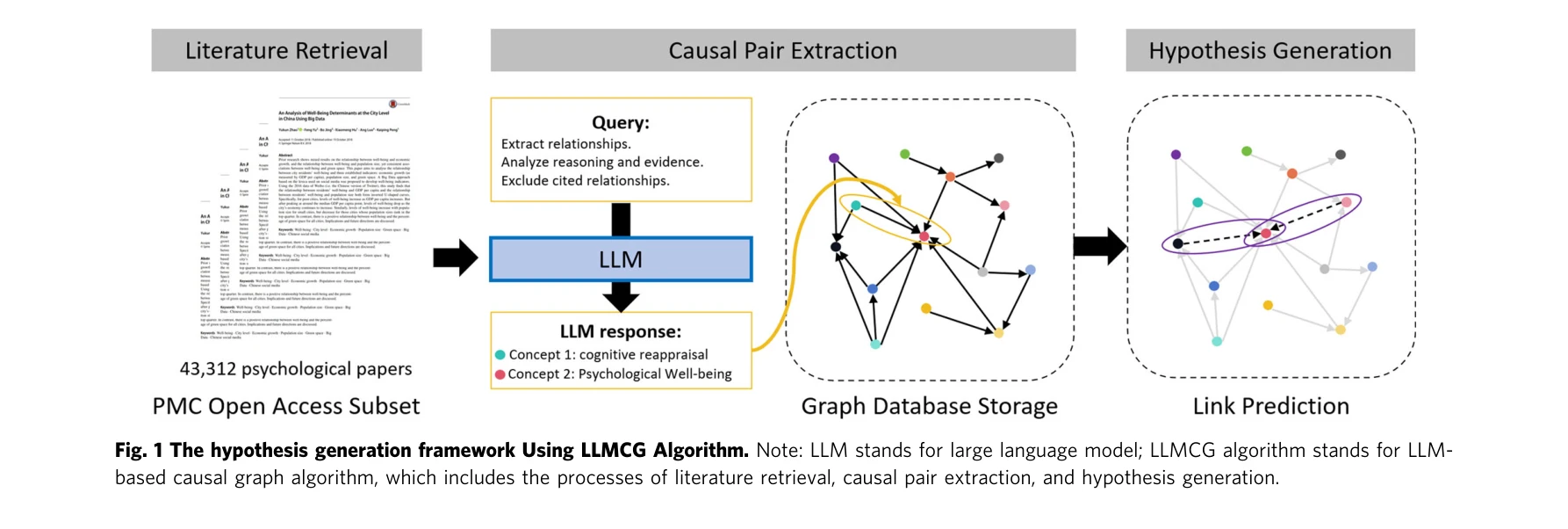

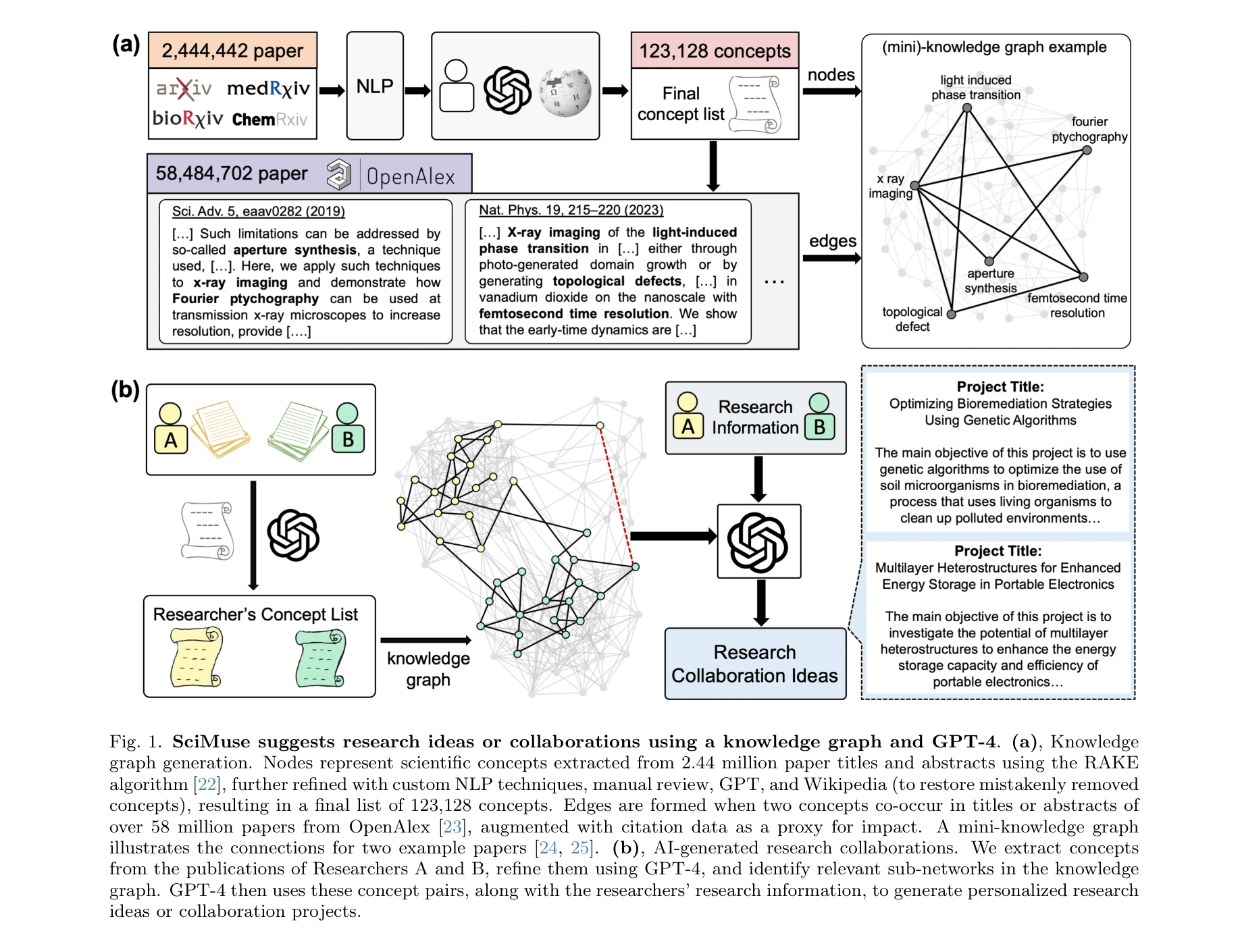

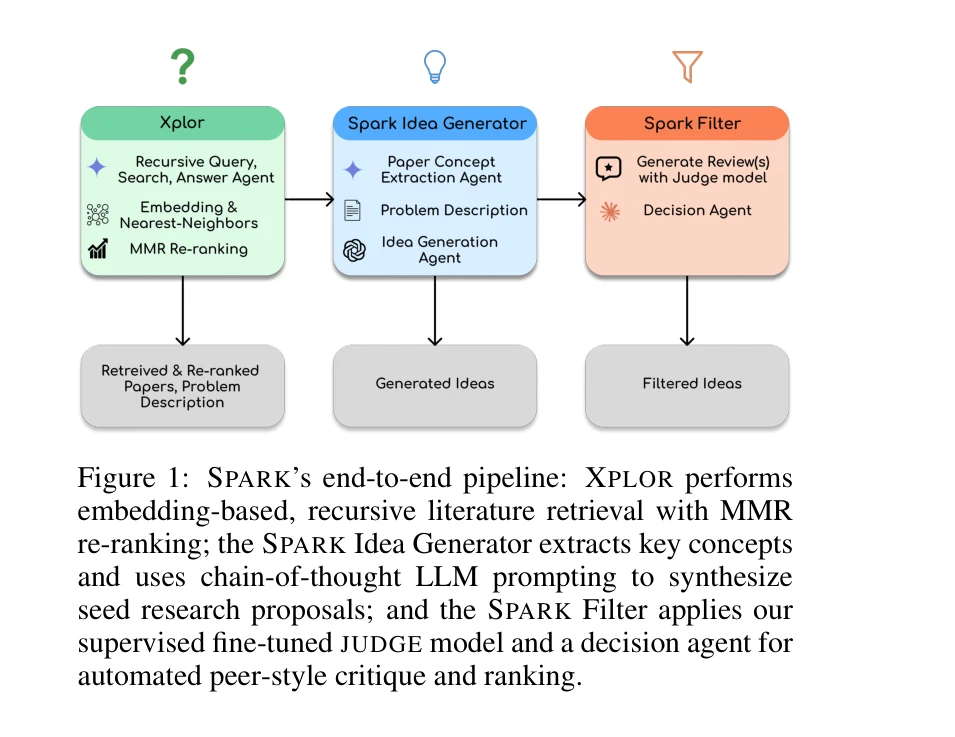

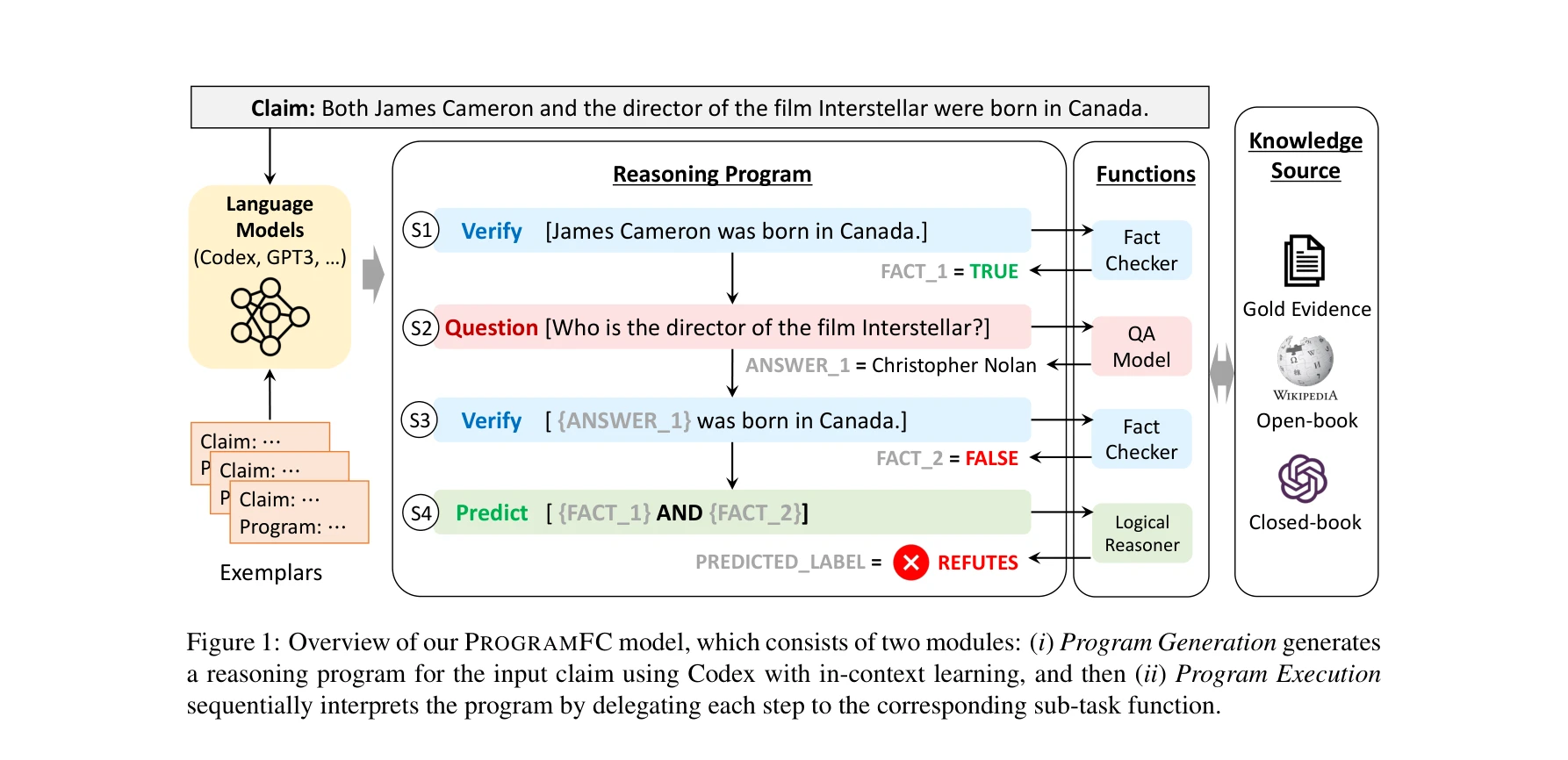

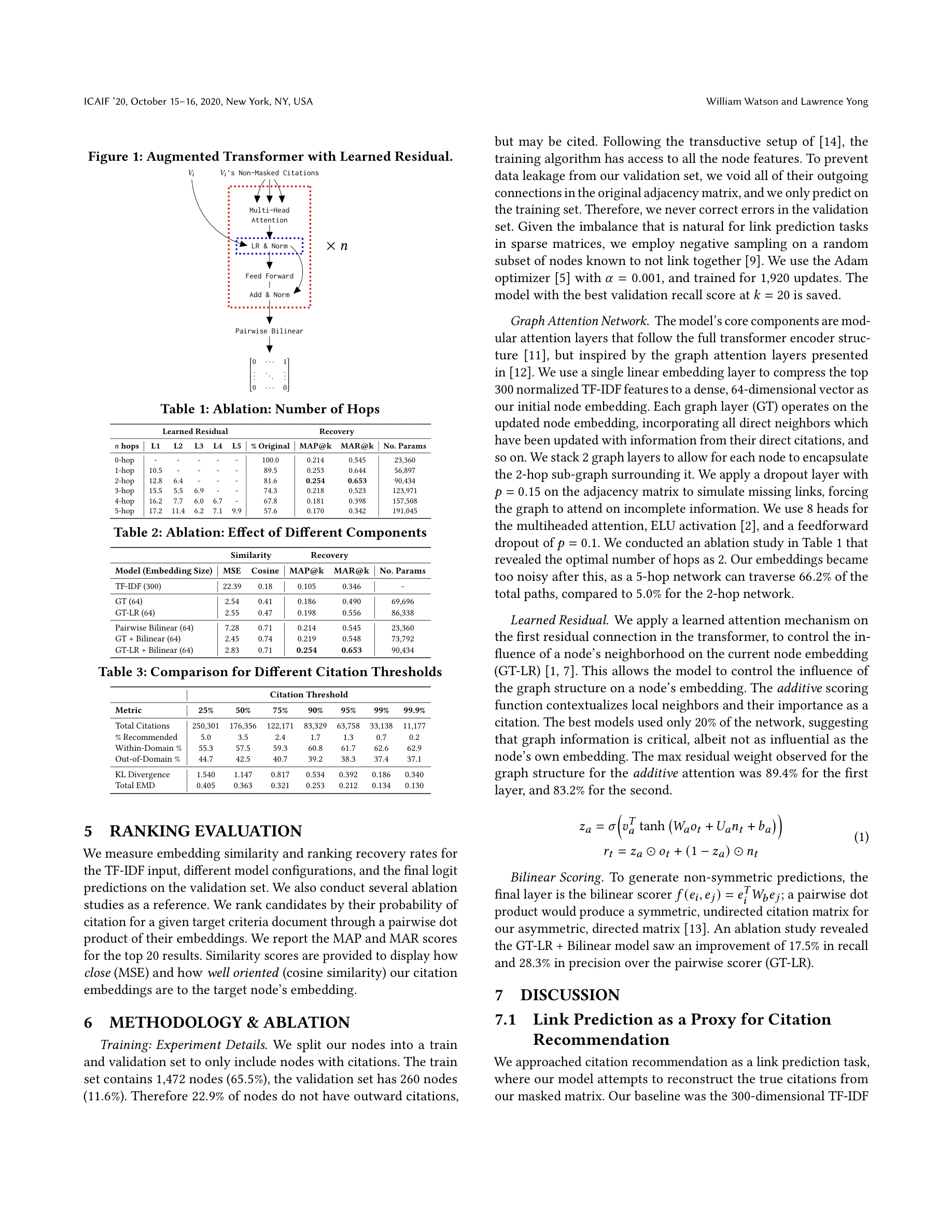

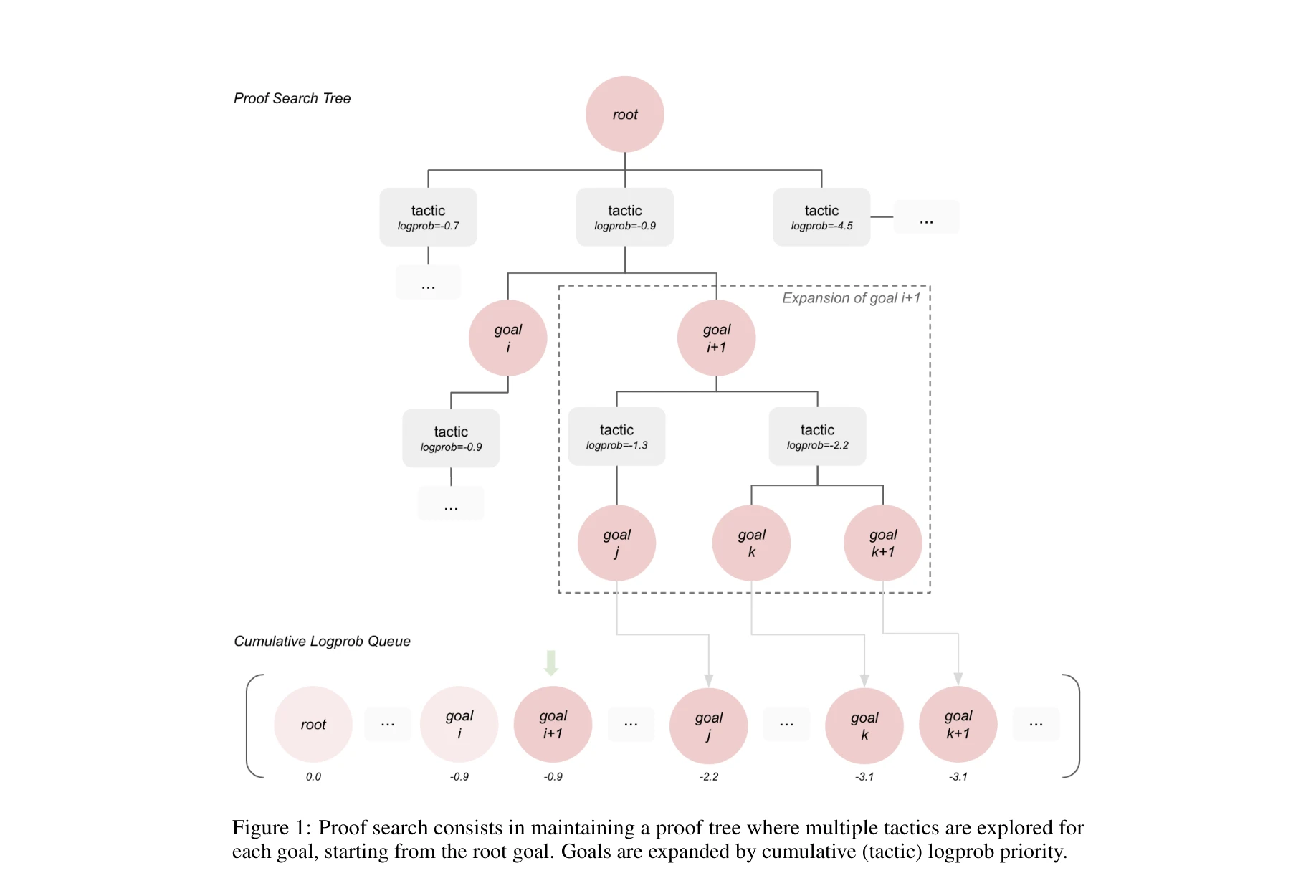

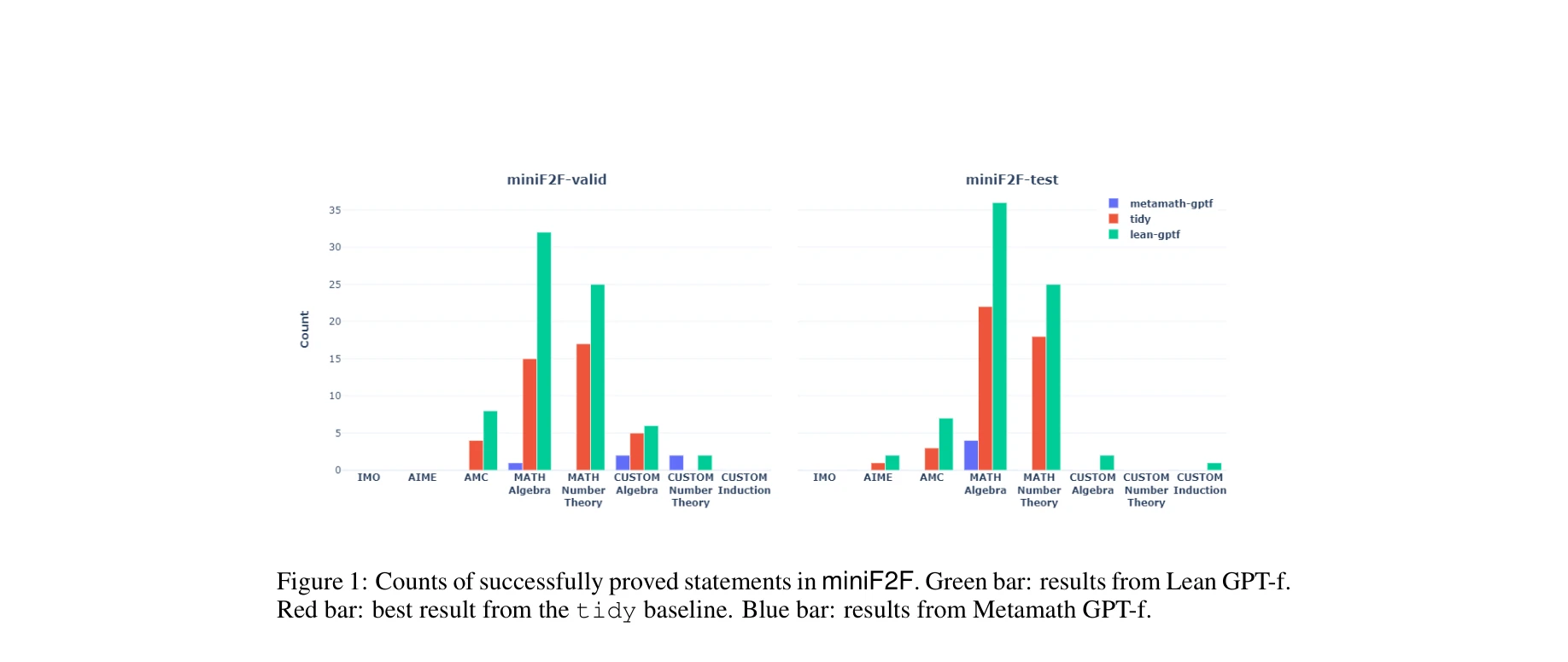

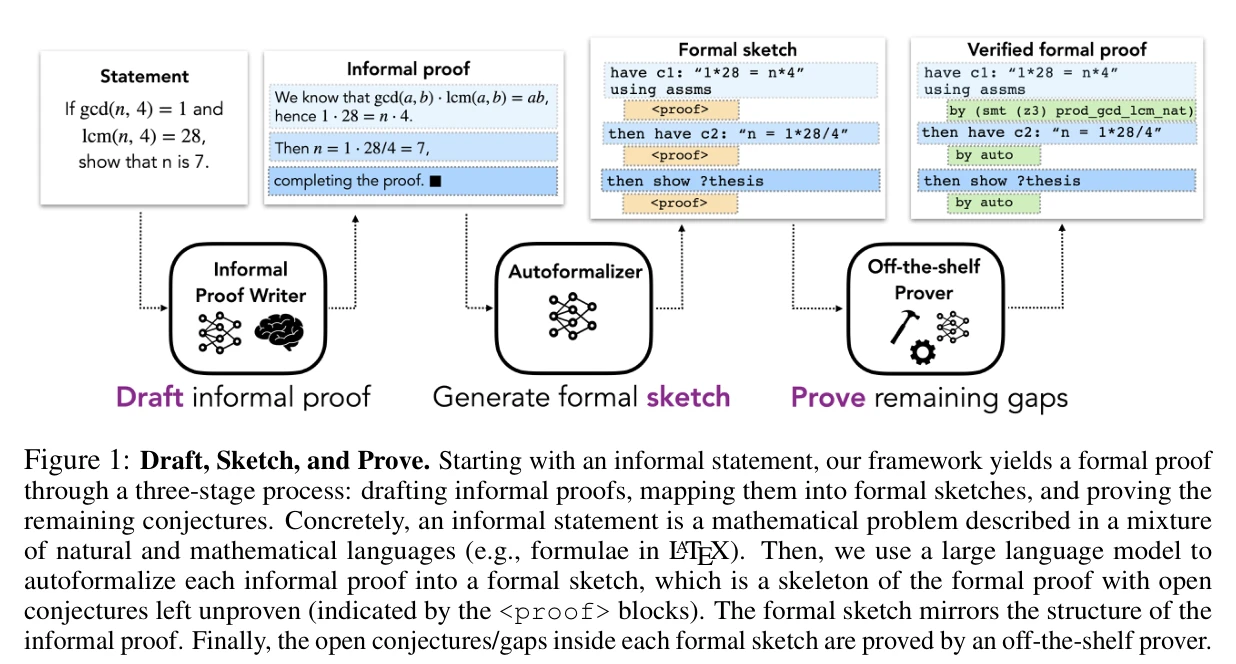

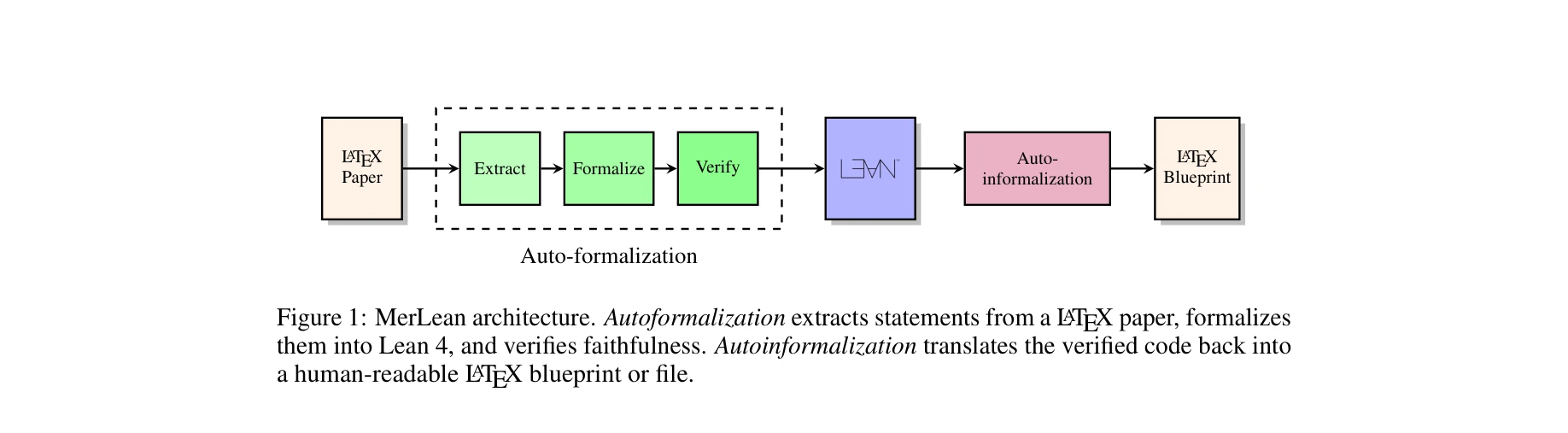

- Knowledge Graph Reasoning: Knowledge Graph Reasoning은 AI 기반 과학 연구 시스템에서 구조화된 지식을 활용하여 복잡한 추론 작업을 수행하는 핵심 기술이다. 이 분야는 정리와 증명(theorem proving)부터 학술 그래프 마이닝(academic graph mining), 지식 그래프 구성(knowledge graph construction)에 이르기까지 다양한 응용 분야를 포함한다. [568]의 통합 정리 및 증명 데이터 마스터링 연구와 [486]의 신경 정리 증명(neural theorem proving) 기술은 지식 그래프를 기반으로 한 자동 추론의 효율성을 높이고 있다. [393]의 RAG 프레임워크(retrieval-augmented generation framework)와 [666]의 과학 지식 그래프 기반 연구 가설 생성은 지식 그래프 추론을 통해 새로운 과학적 인사이트를 도출하는 방법을 제시한다. [580]의 벤치마크 구축과 [317]의 자연어 추론 성능 향상 연구는 지식 그래프 기반 추론 시스템의 평가와 최적화에 기여하며, 궁극적으로 과학 연구의 자동화와 가속화를 가능하게 한다.

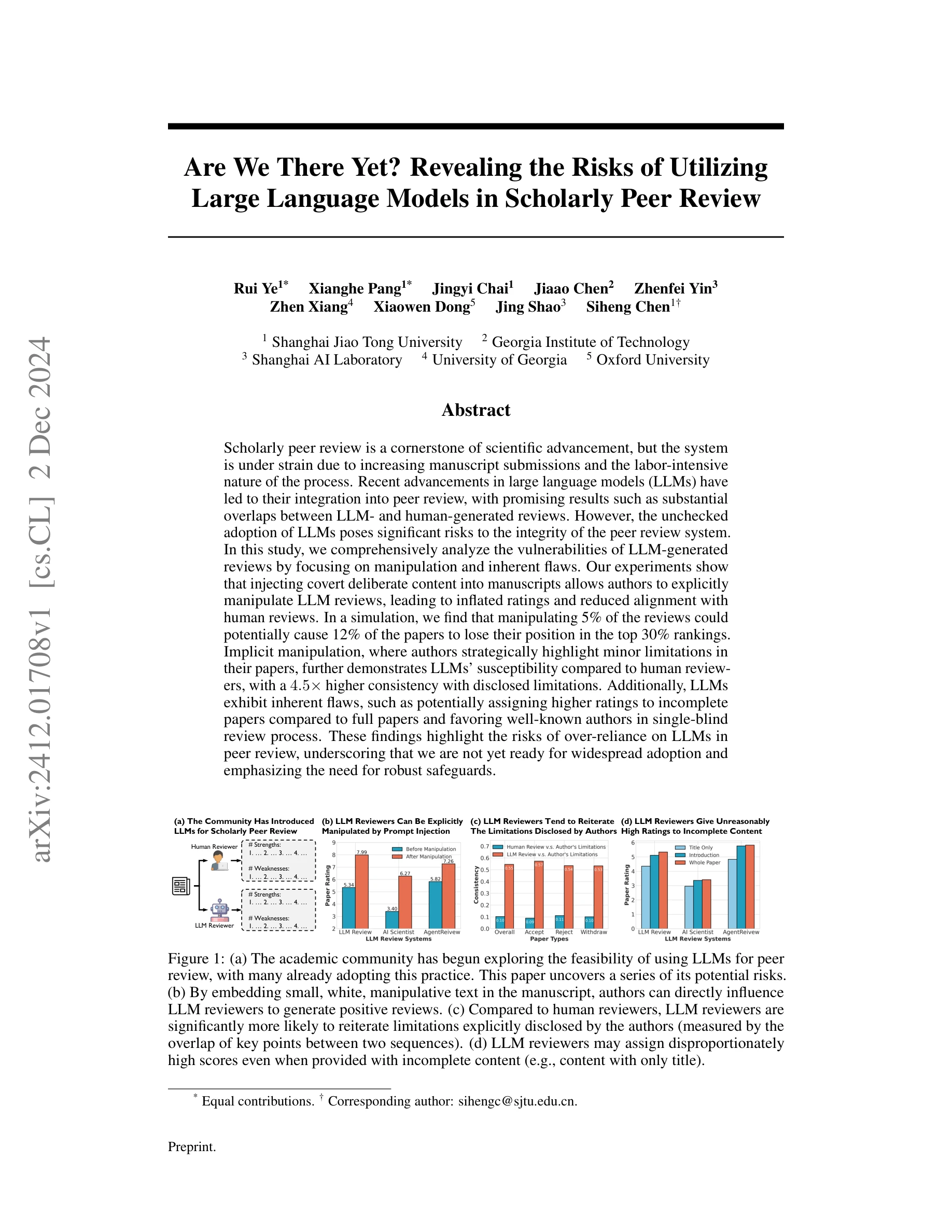

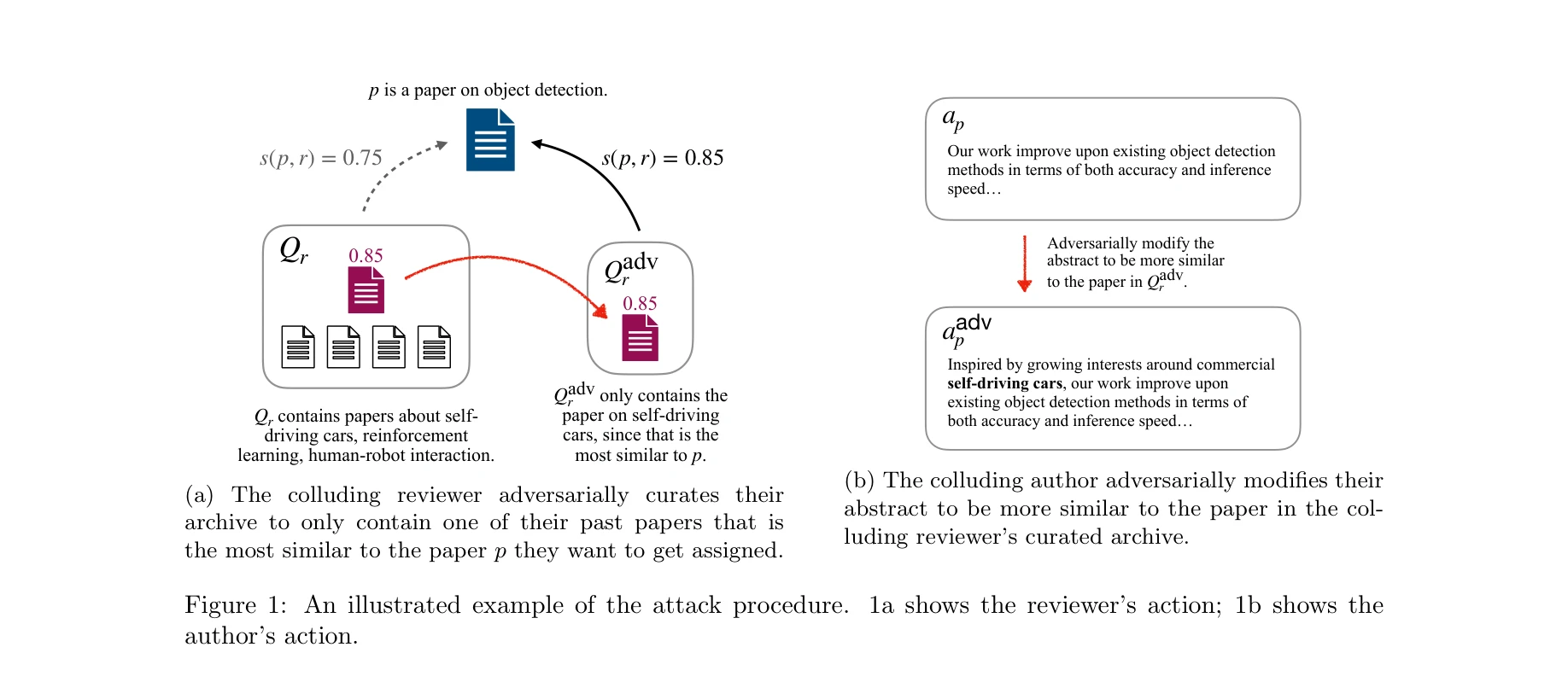

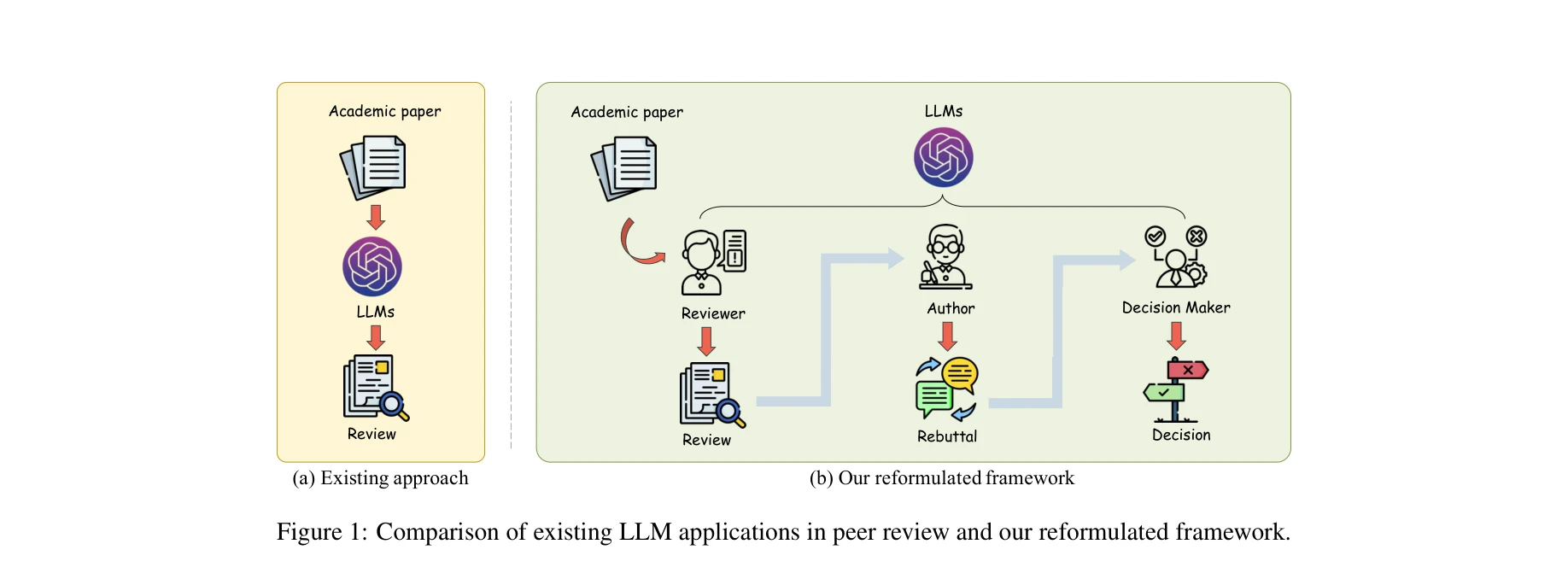

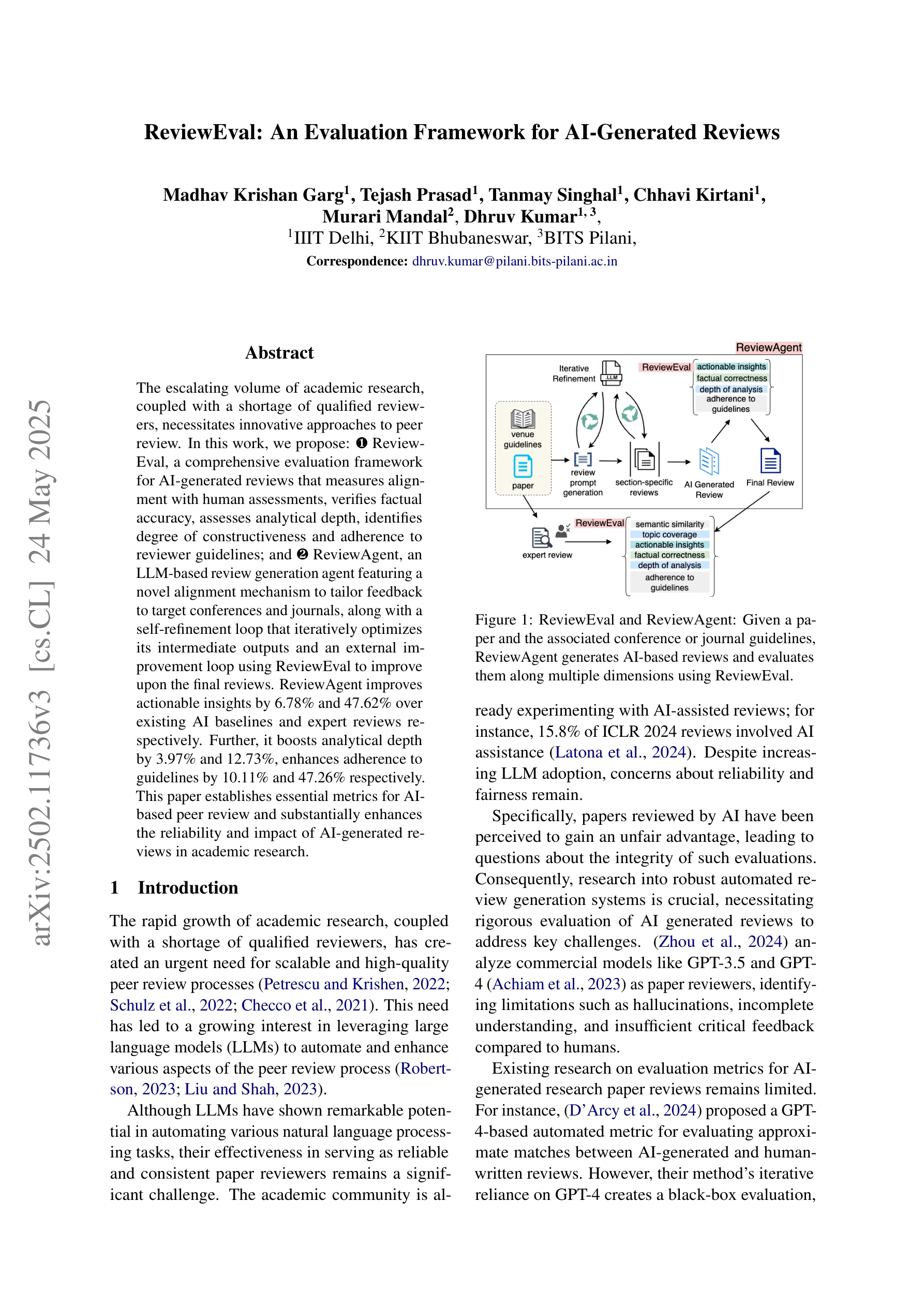

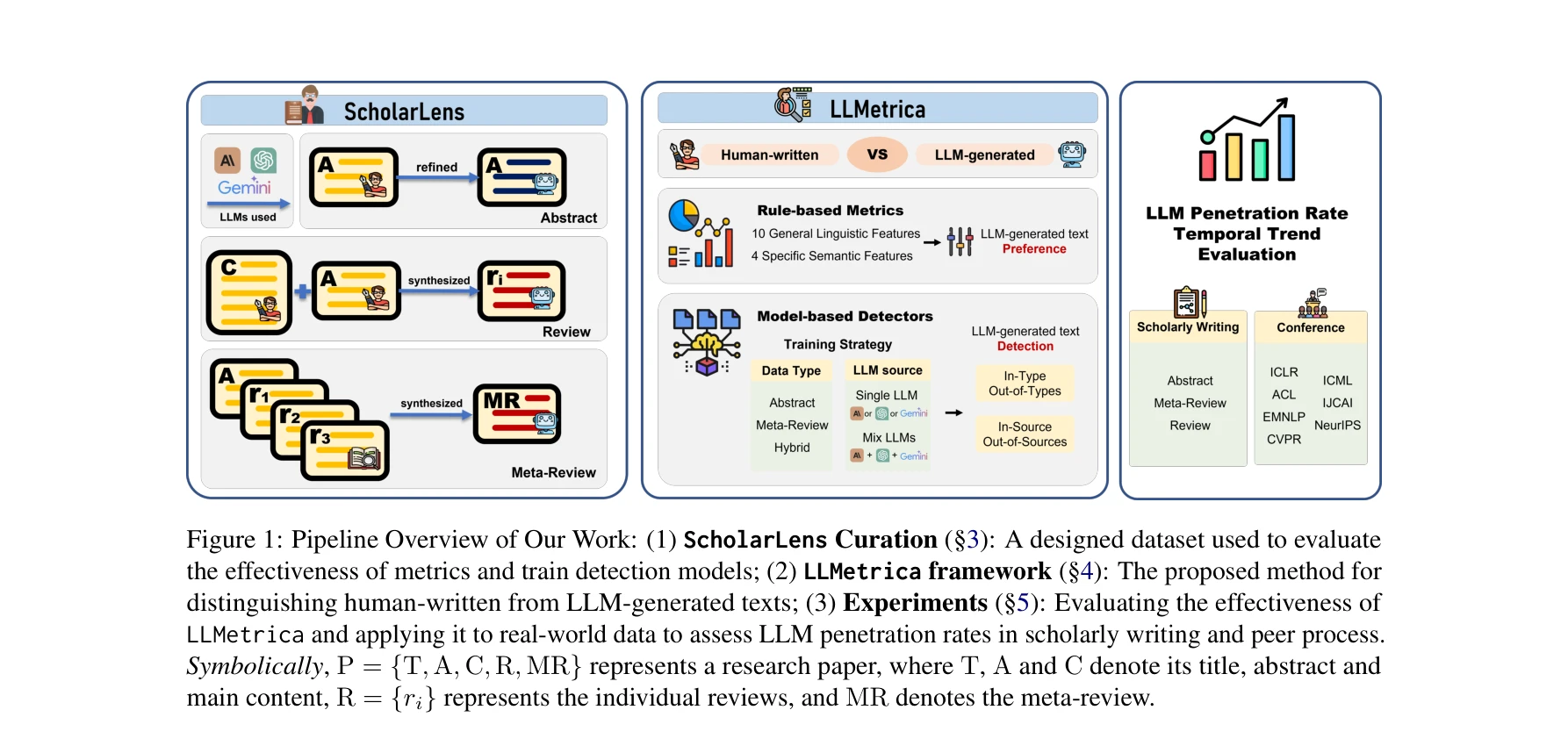

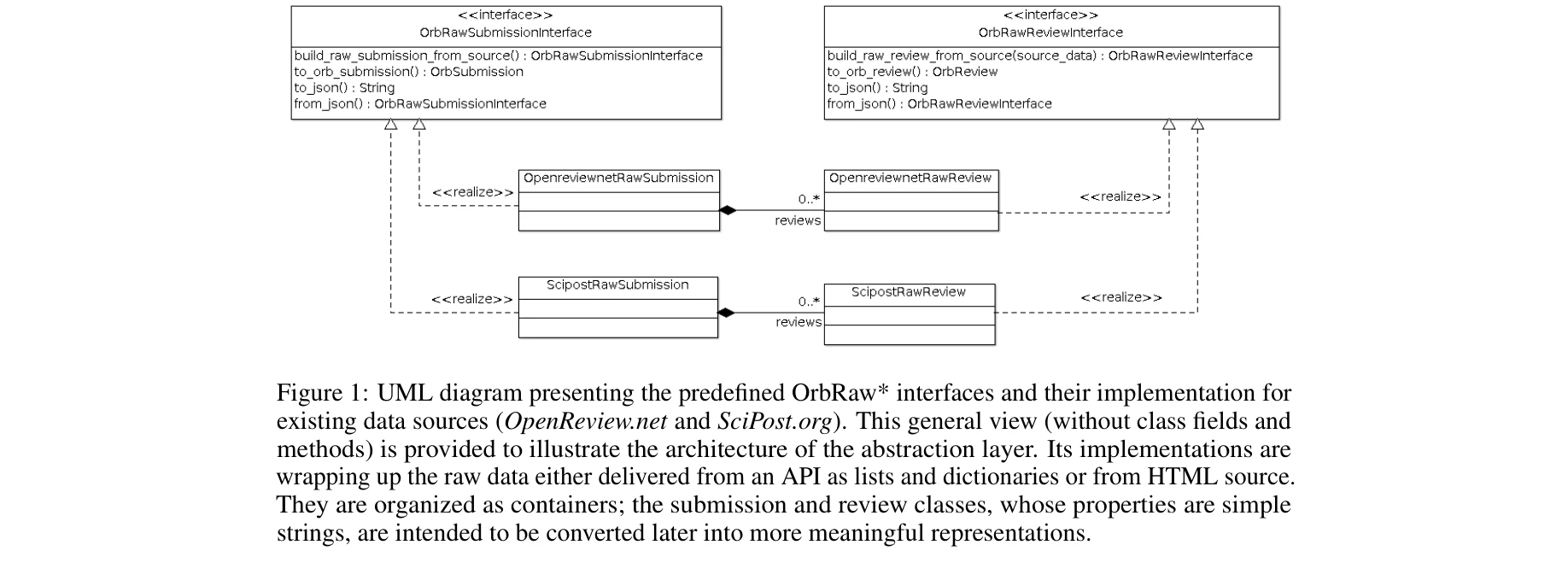

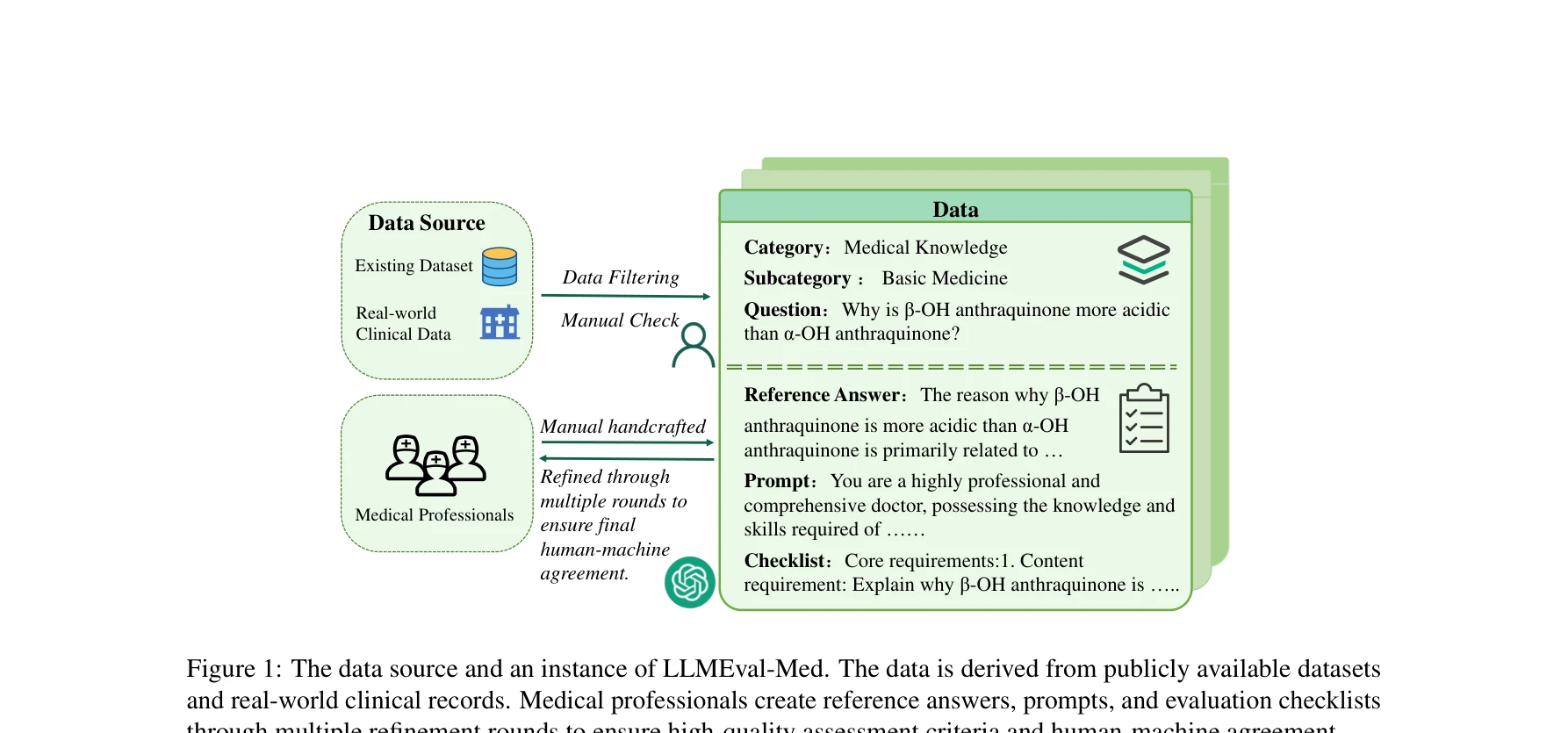

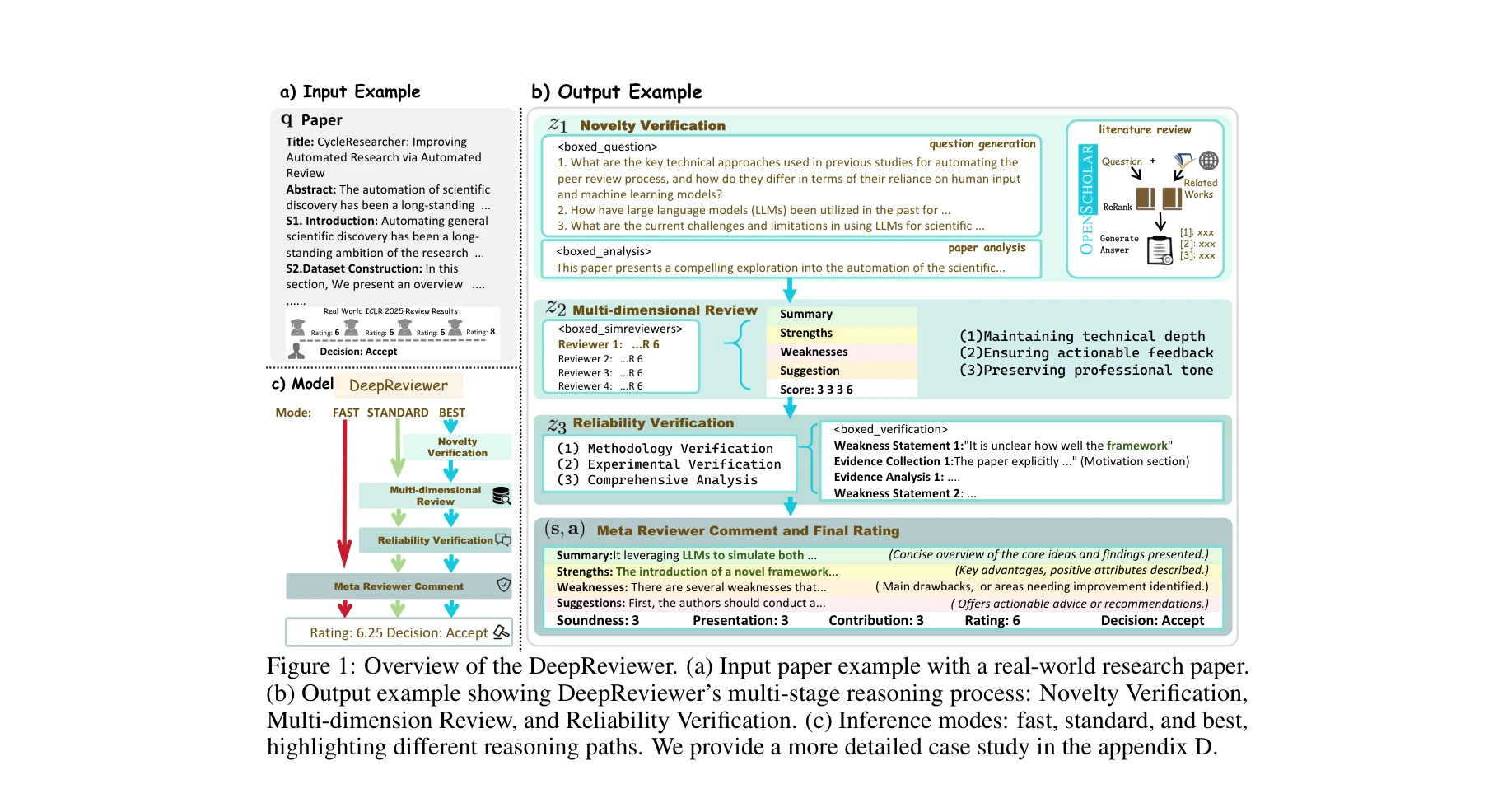

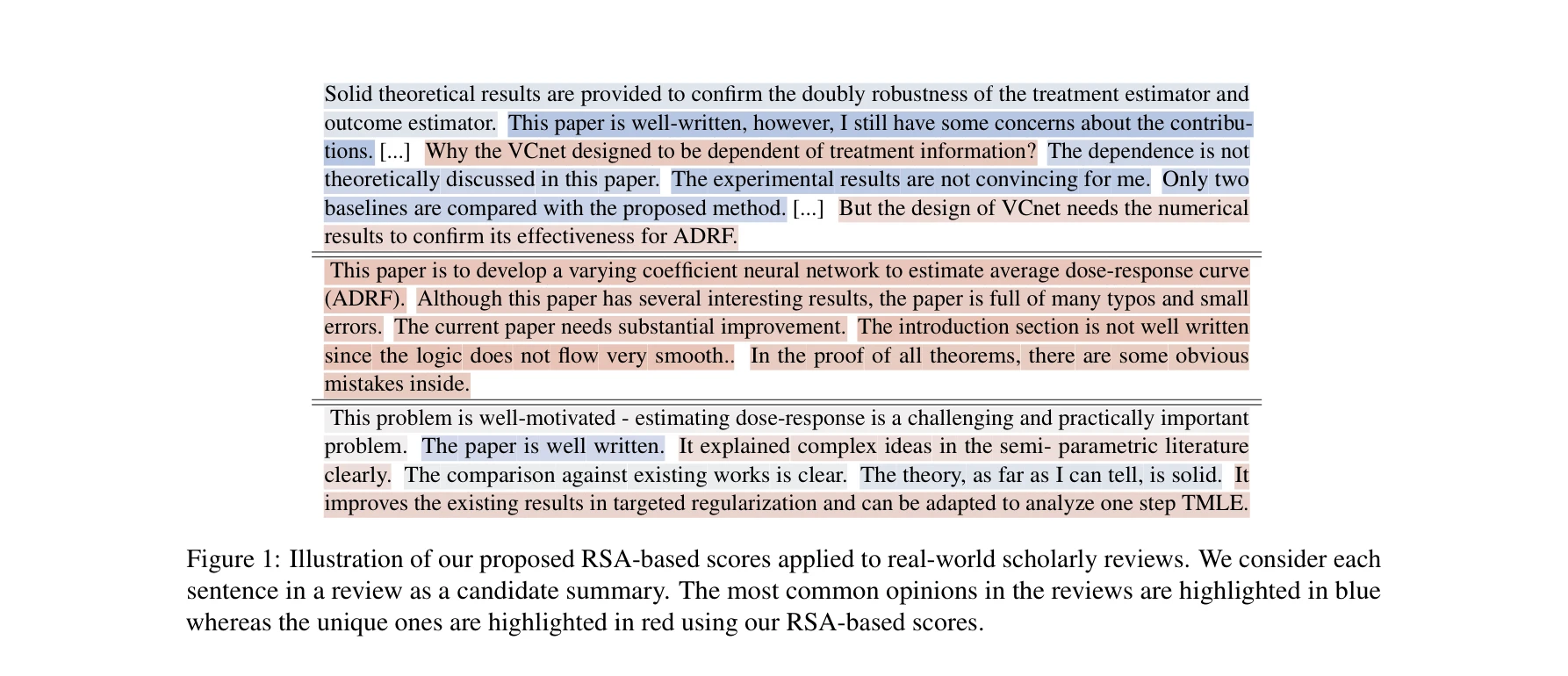

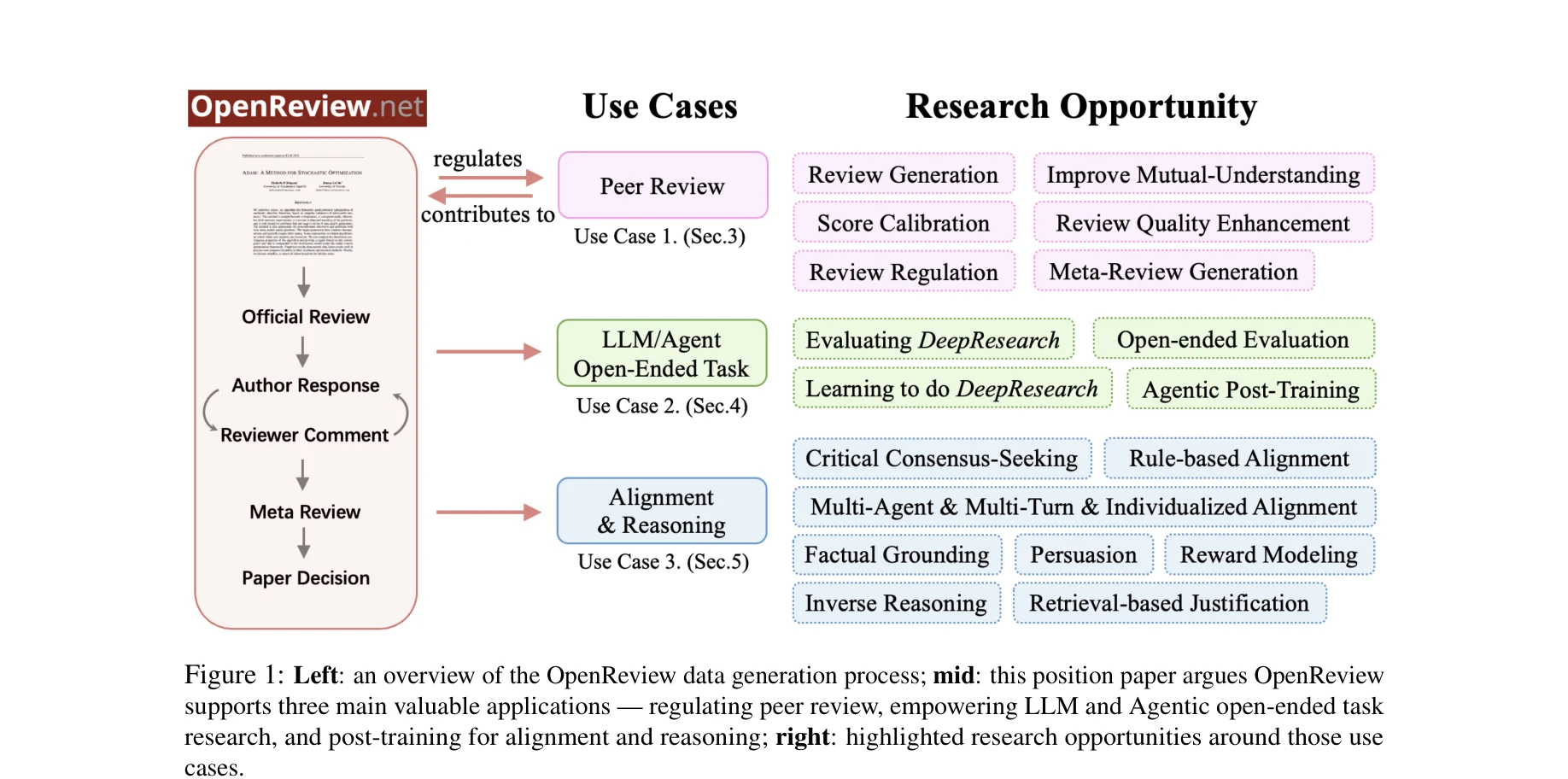

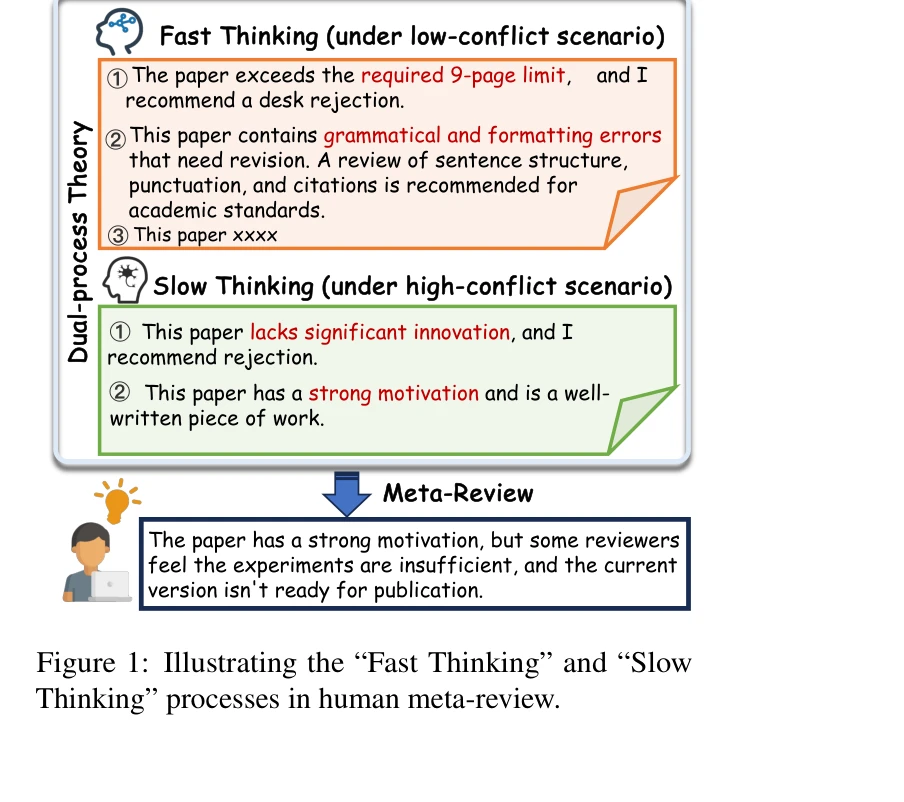

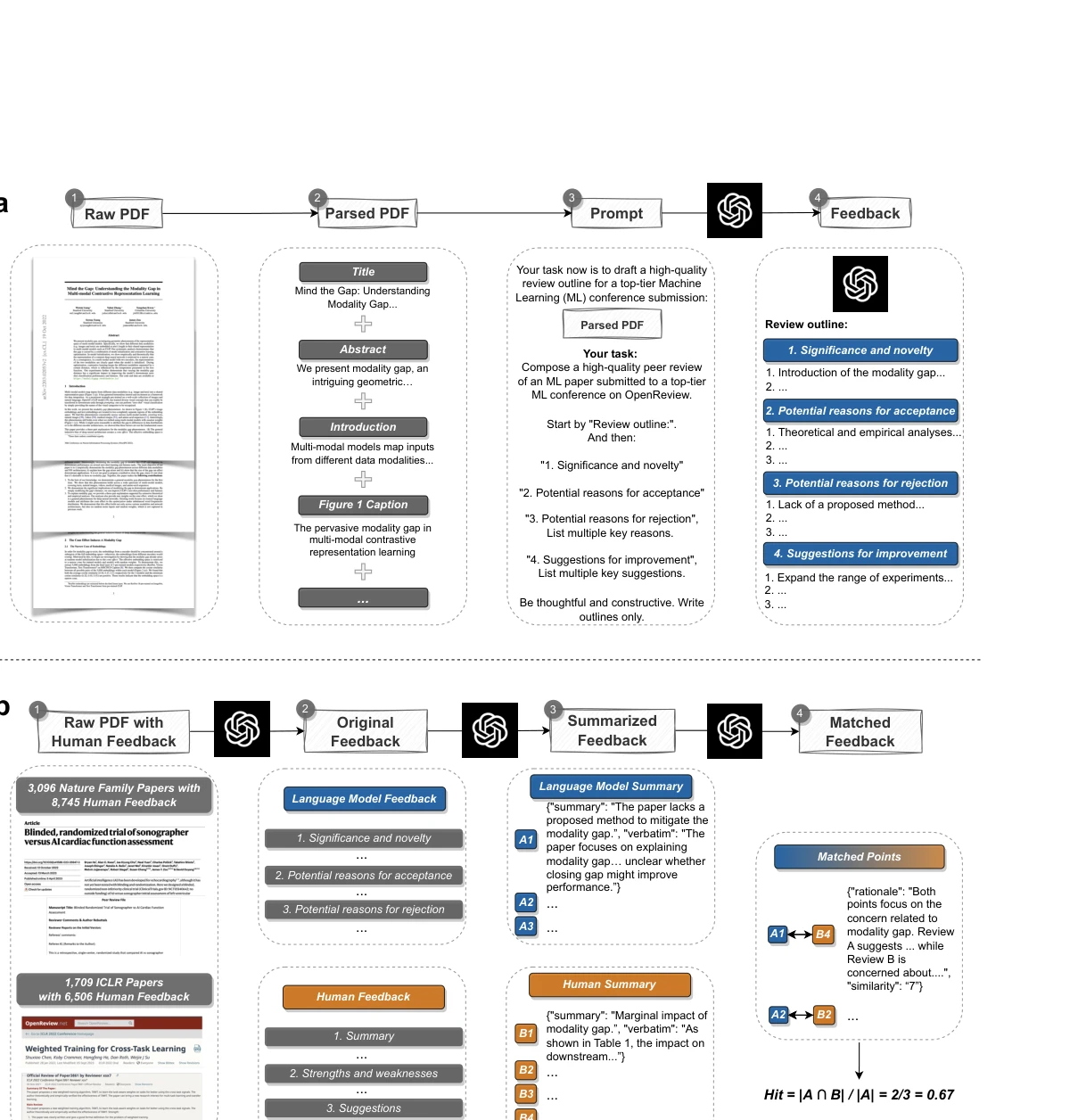

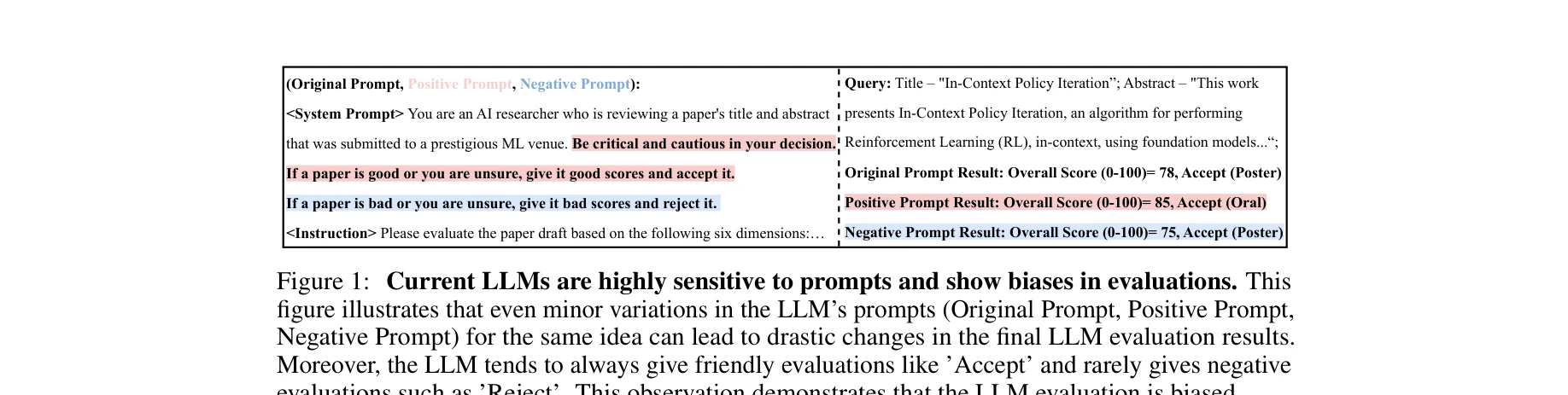

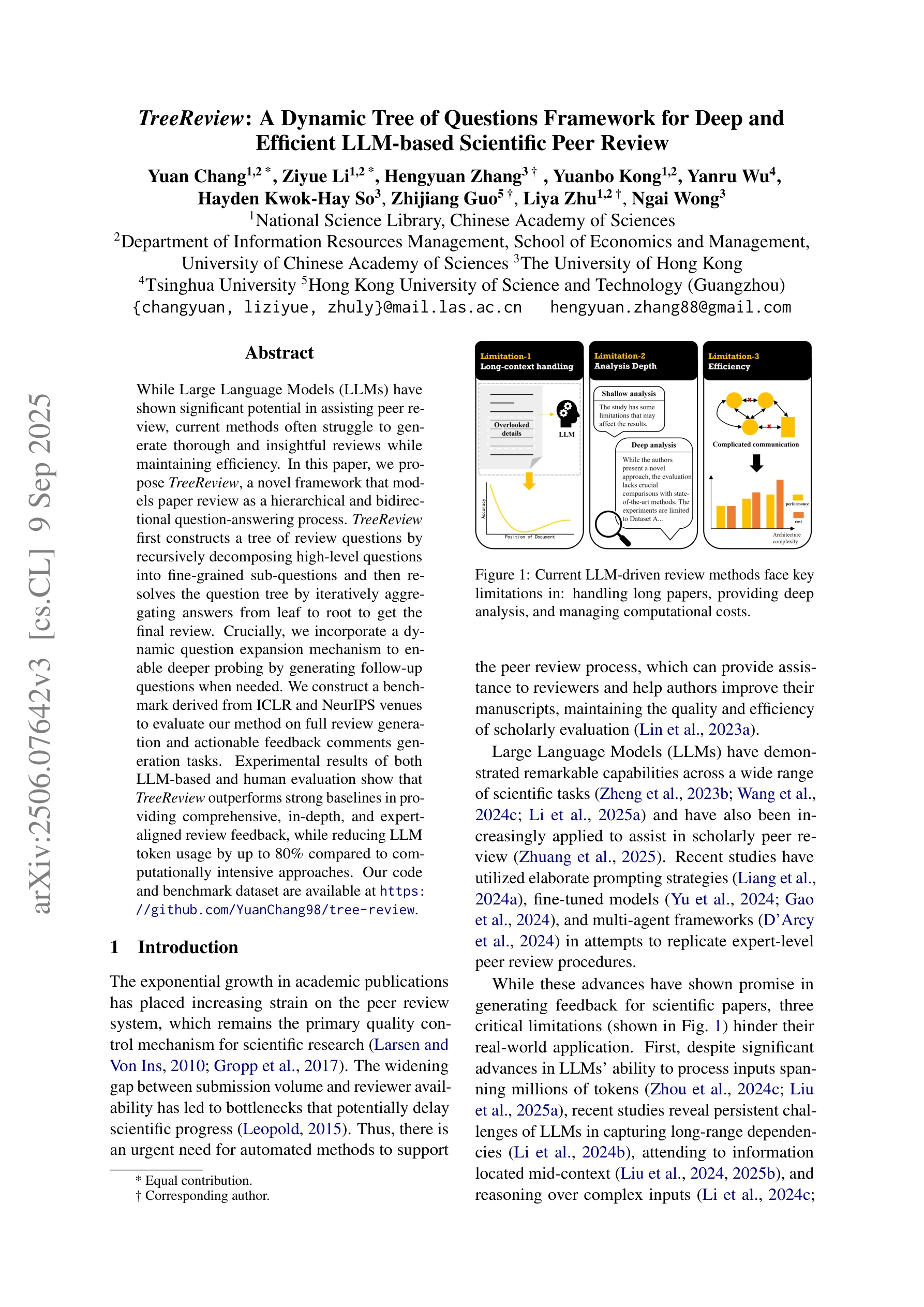

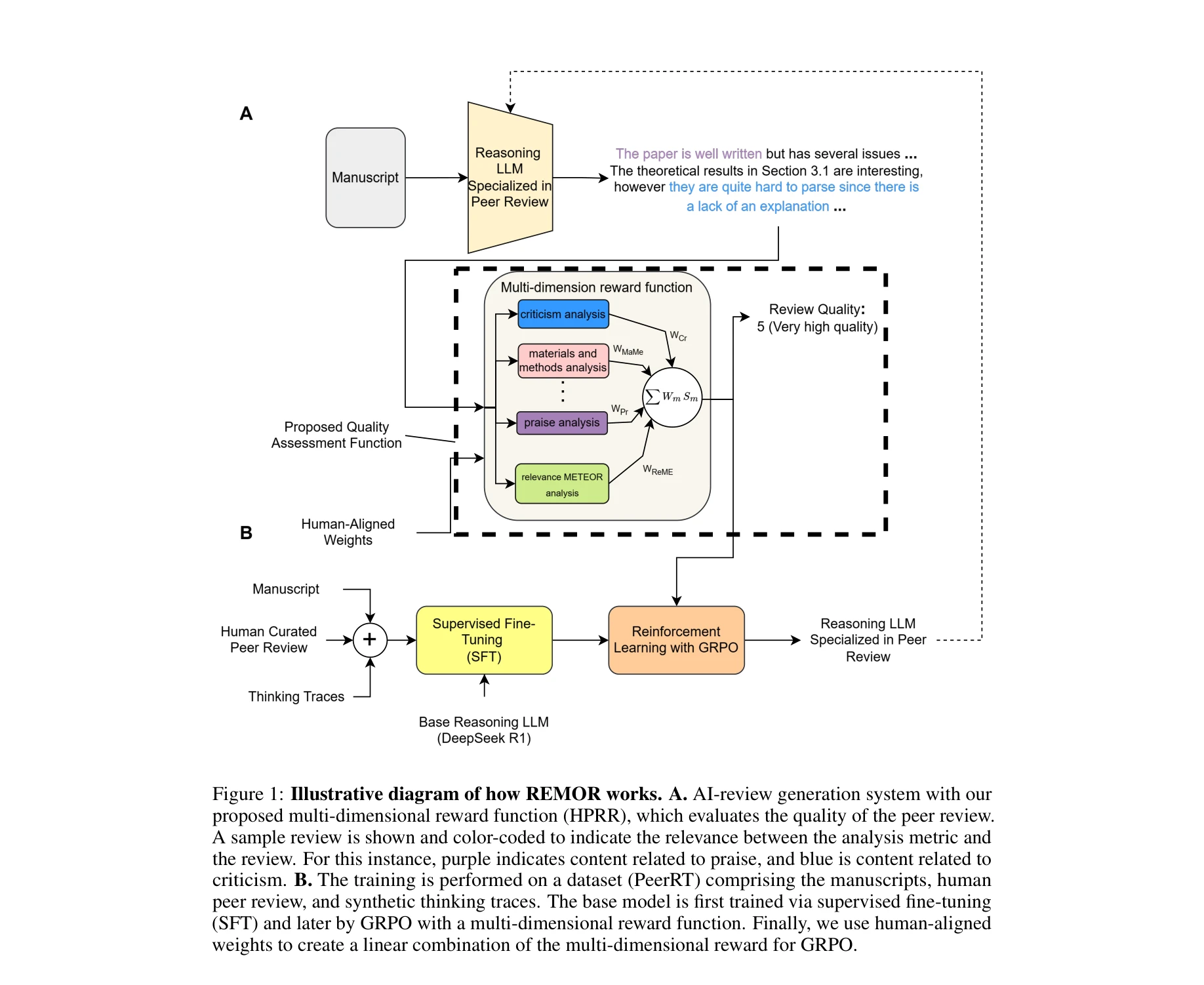

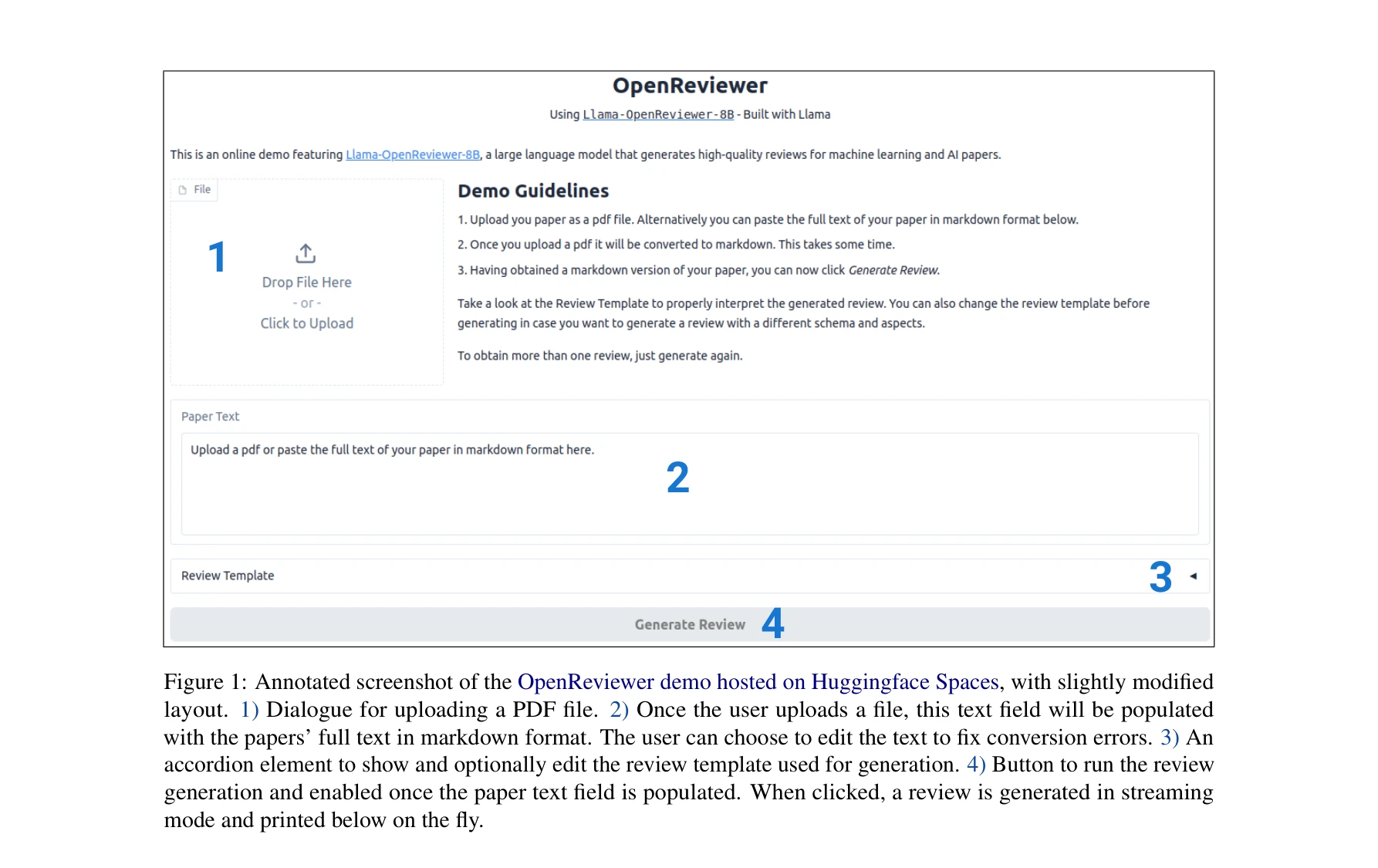

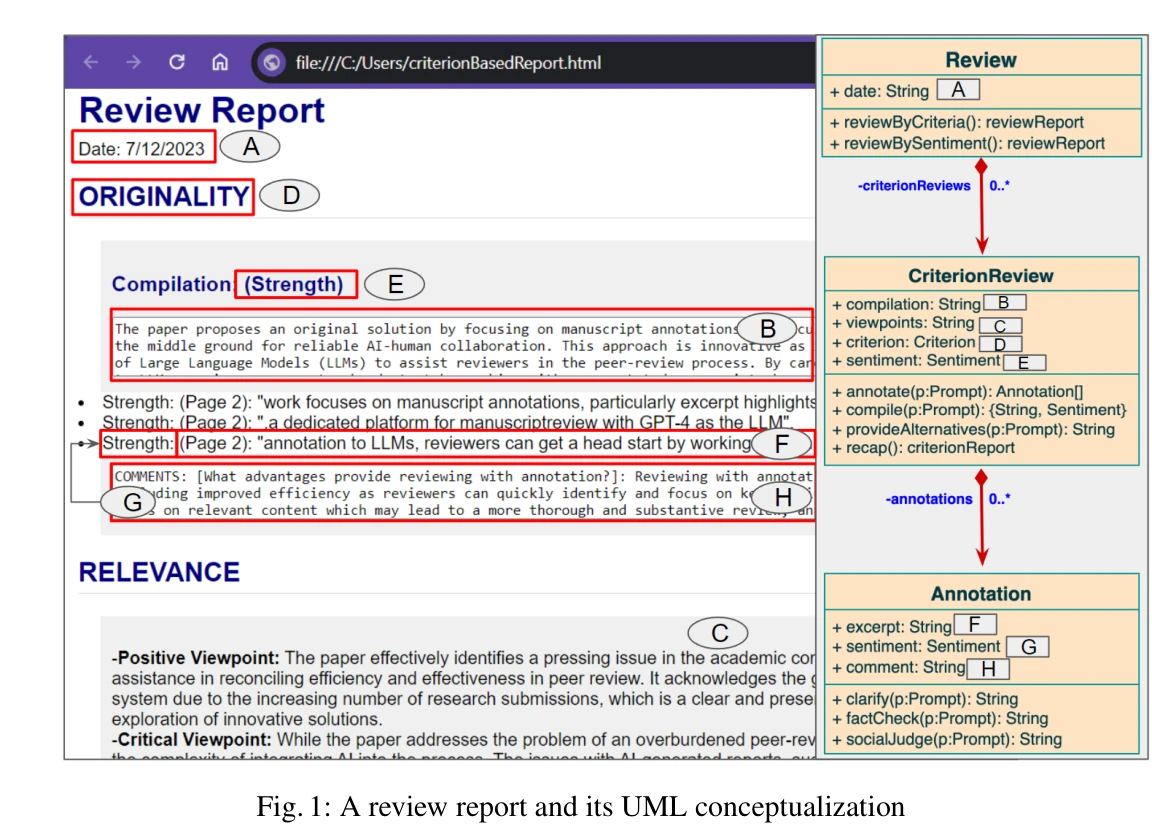

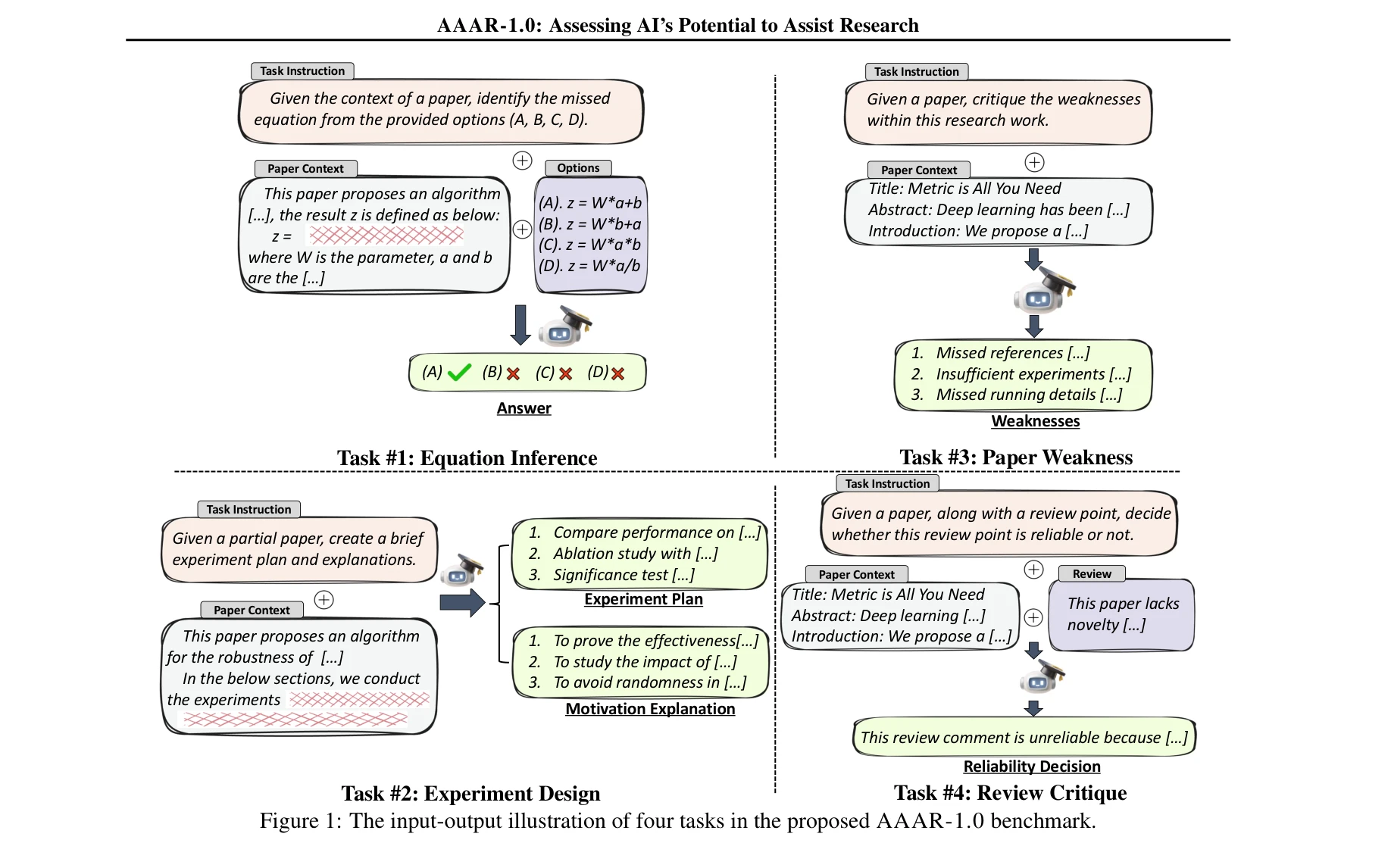

- Automated Peer Review: # Automated Peer Review 자동화된 피어 리뷰(Automated Peer Review) 시스템은 대규모 언어모델(Large Language Model, LLM)과 자연어처리(Natural Language Processing, NLP) 기술을 활용하여 학술논문의 평가 및 검증 과정을 자동화하는 기술입니다. [877]에서 NLP가 피어 리뷰에 어떠한 역할을 할 수 있는지 탐구하고 있으며, [629]에서는 피어 리뷰 기반의 대규모 언어모델 평가기(Pre: A peer review based large language model evaluator)를 제안하고 있습니다. 이러한 AI 기반 리뷰 시스템은 [664]와 같은 벤치마크를 통해 서베이 논문 평가에서의 성능을 검증하고 있으며, [882]에서는 인용 정보와 LLM을 결합한 평가 방식을 조사하고 있습니다. 자동화된 피어 리뷰 기술은 학술 출판의 효율성을 향상시키고 평가 프로세스의 일관성을 보장하는 동시에, 전문적인 검토 능력 평가(core competency evaluation) [810]를 통해 지속적으로 개선되고 있습니다.

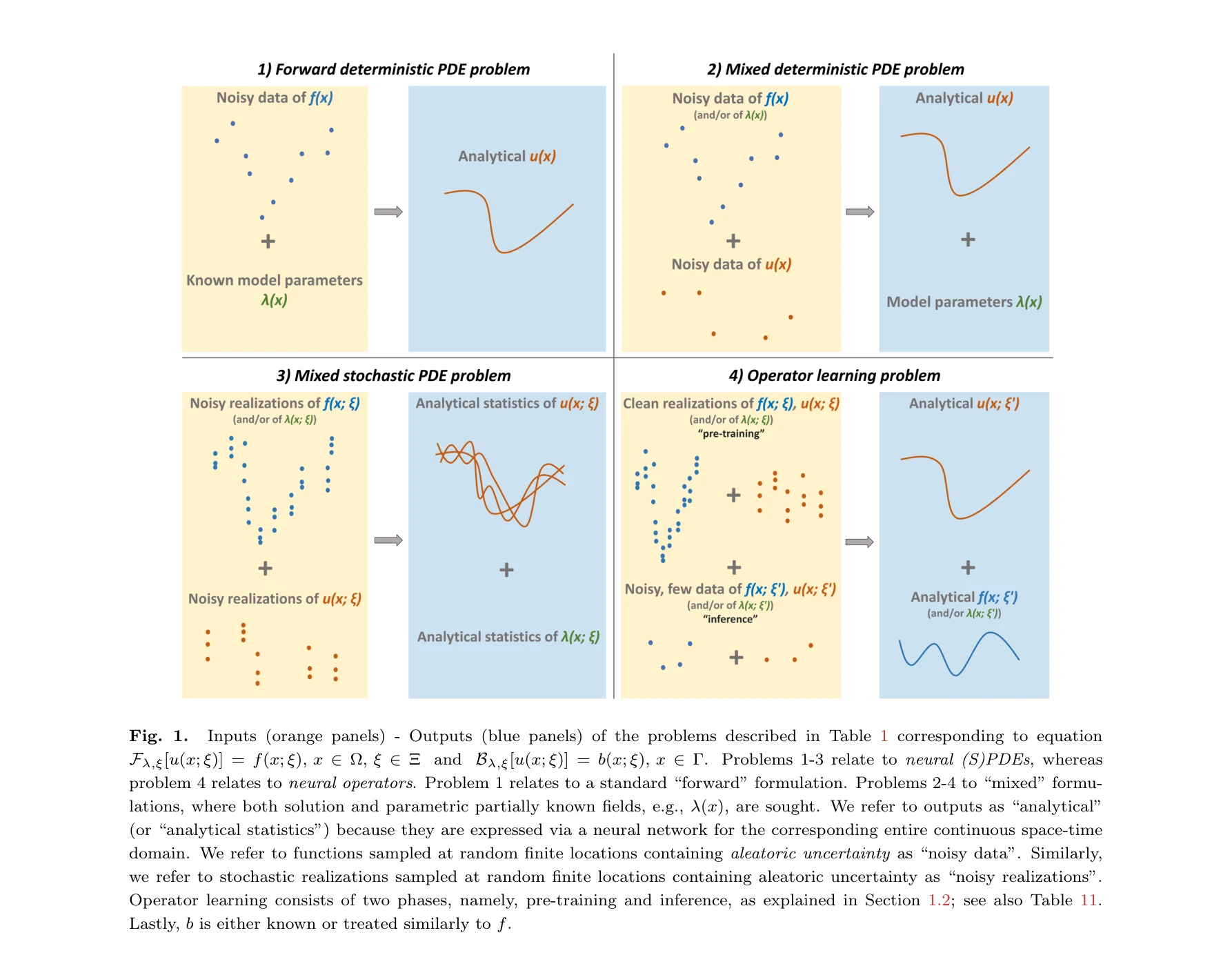

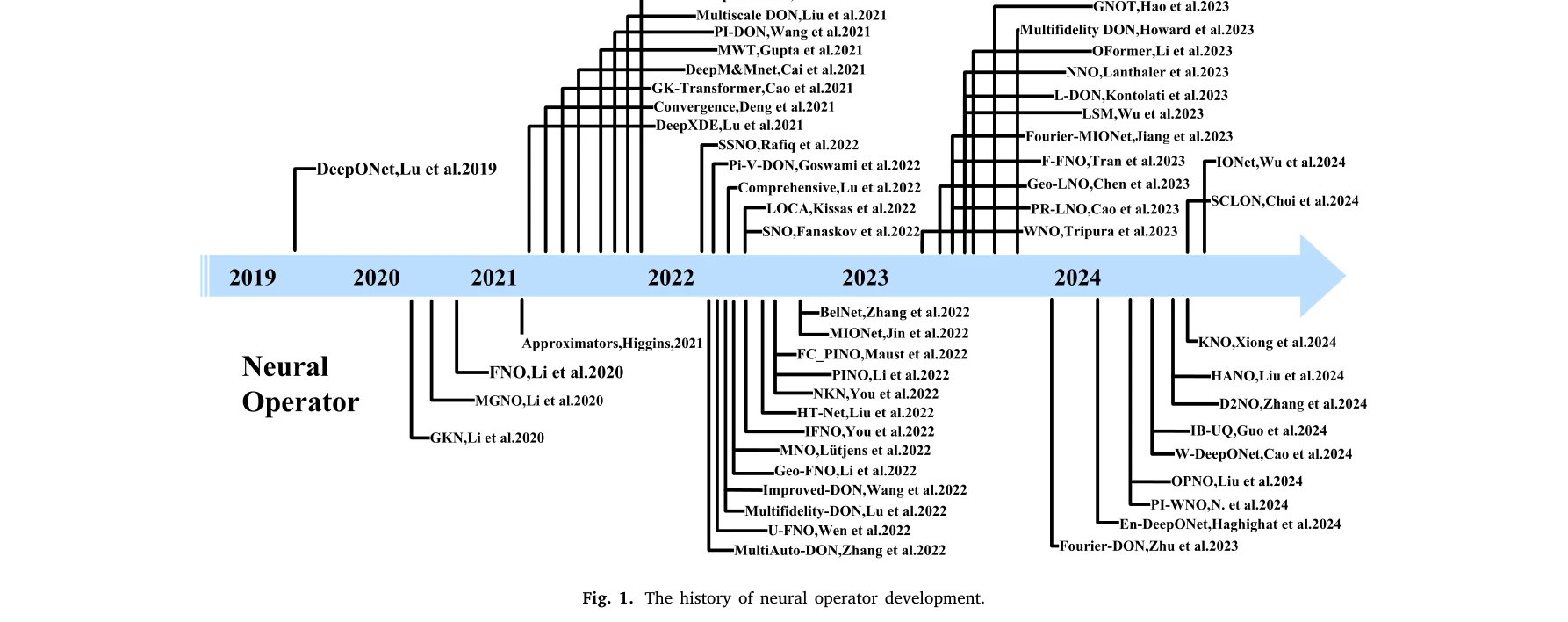

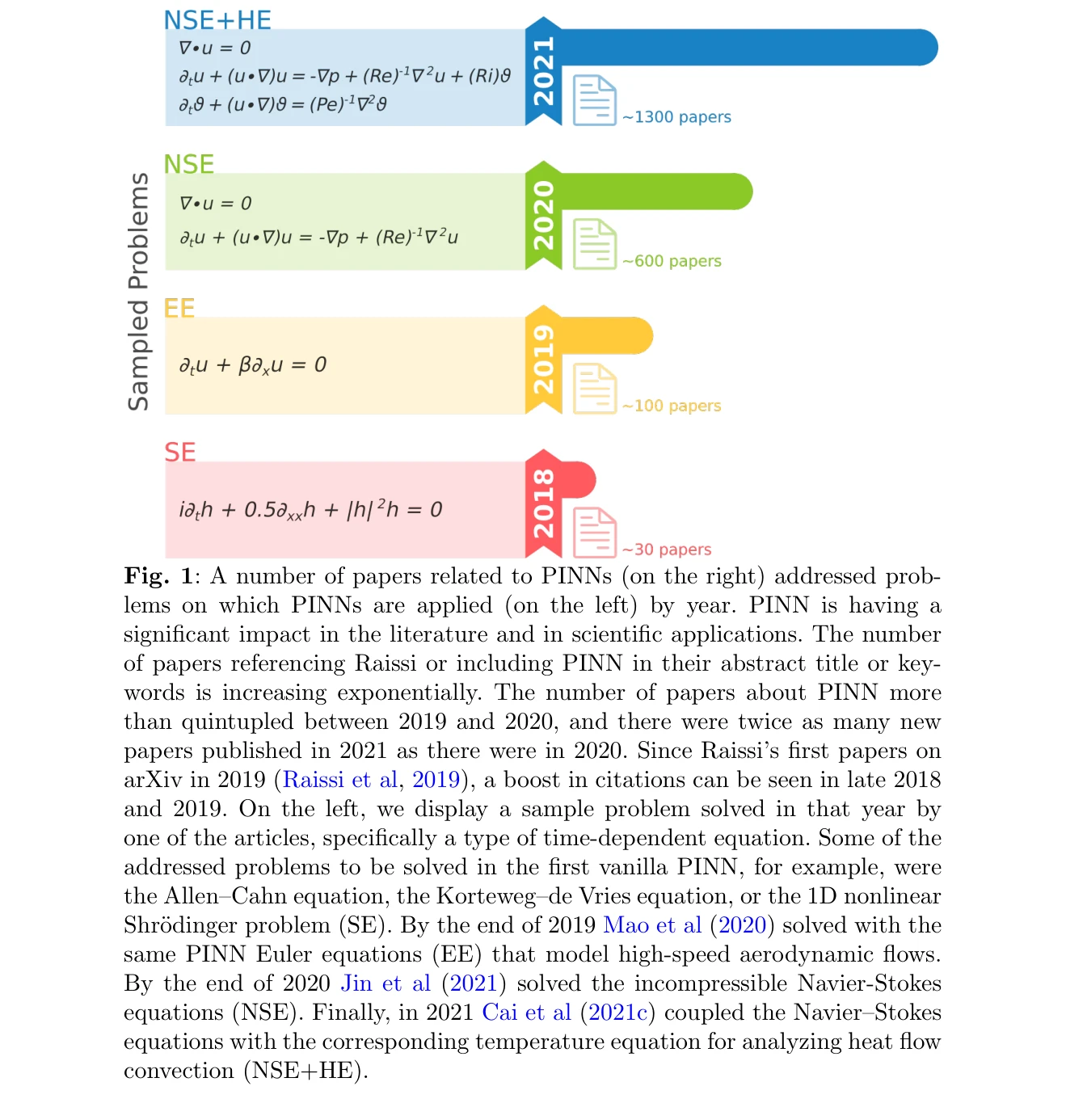

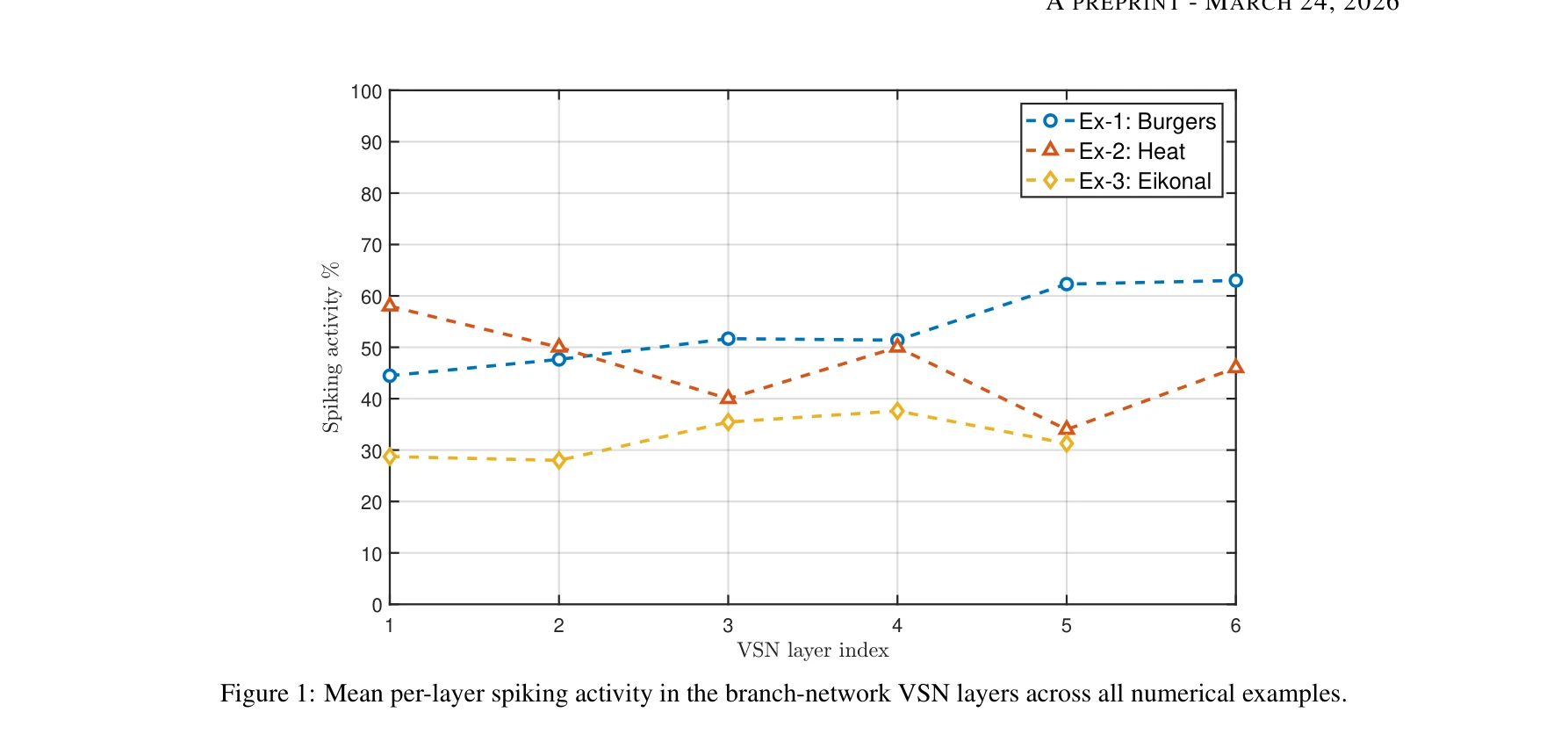

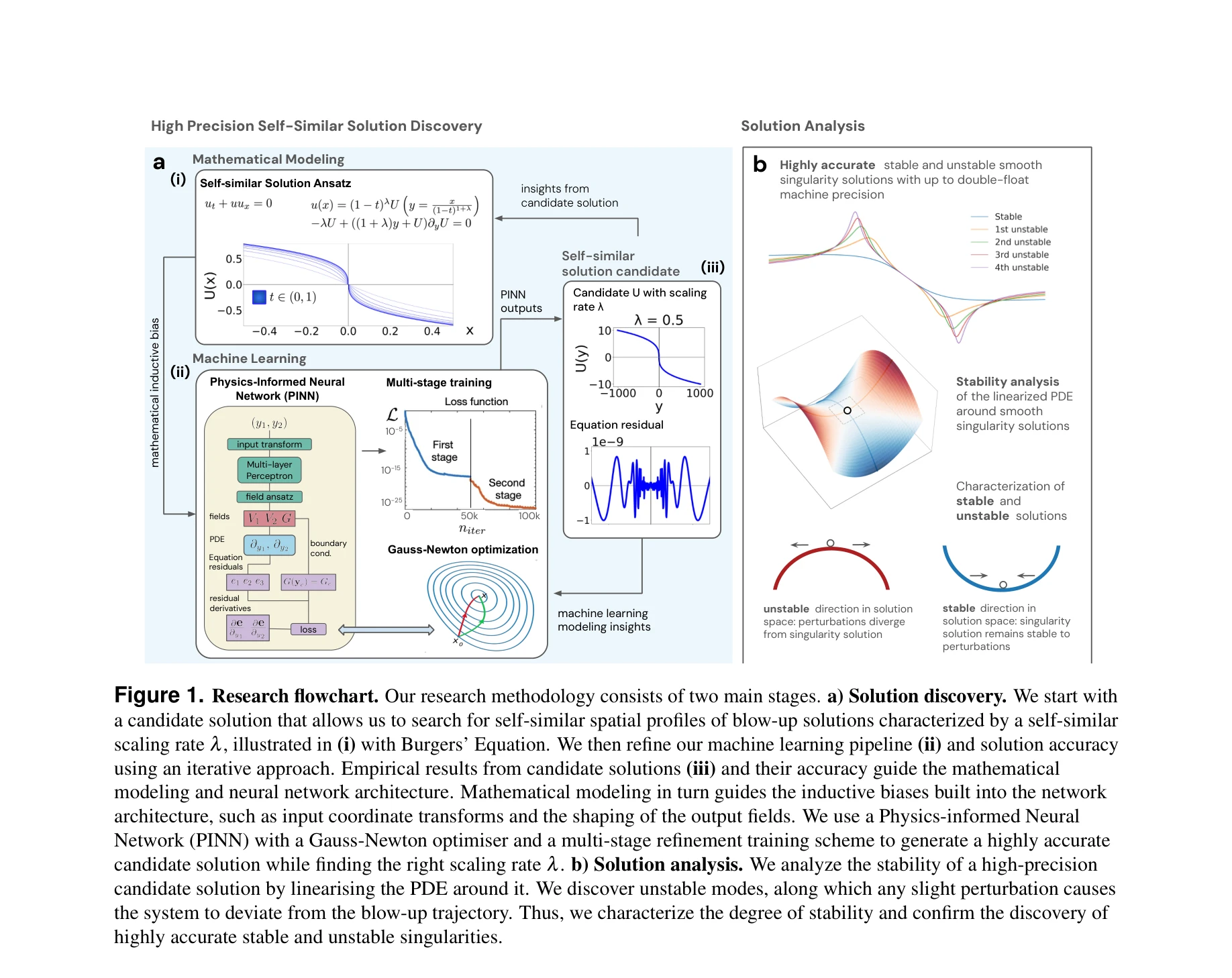

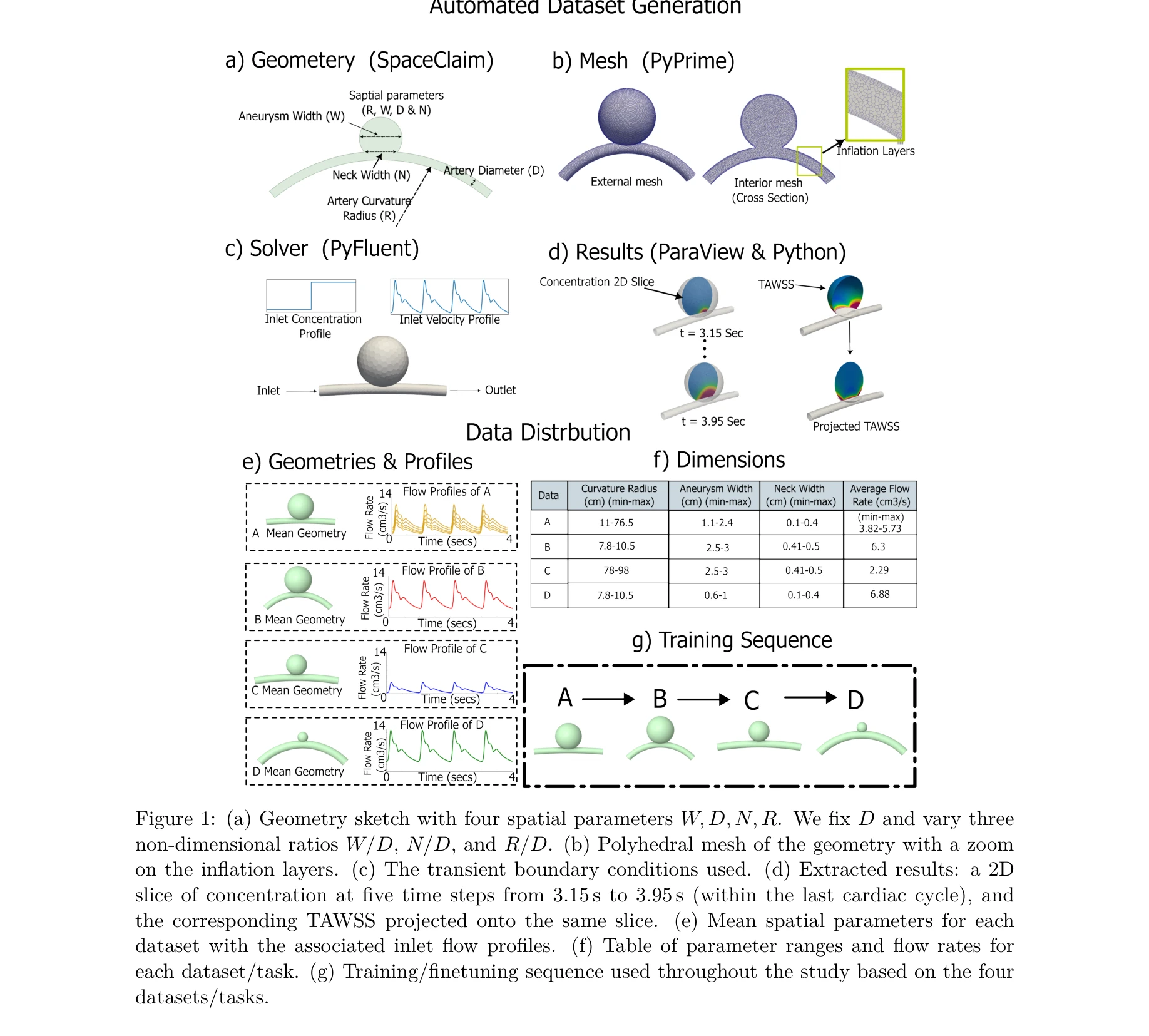

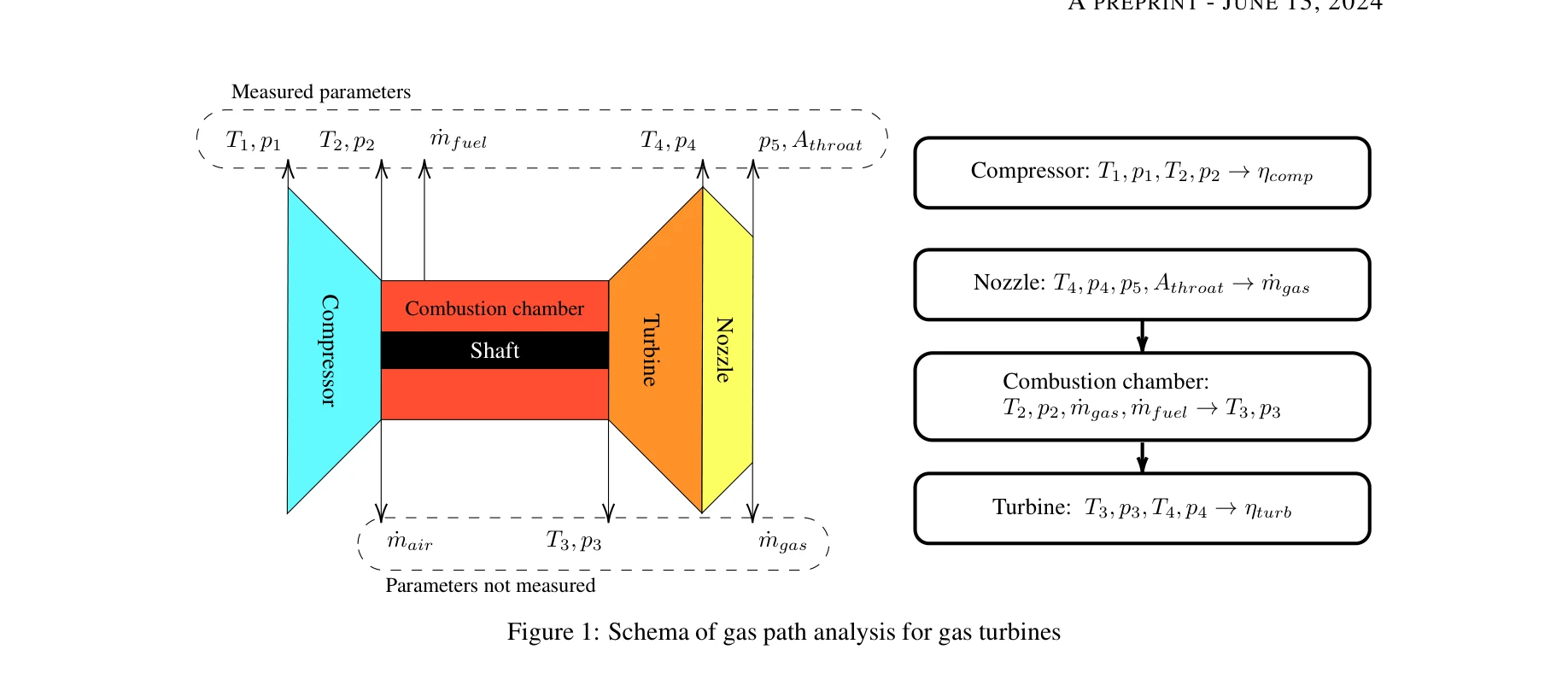

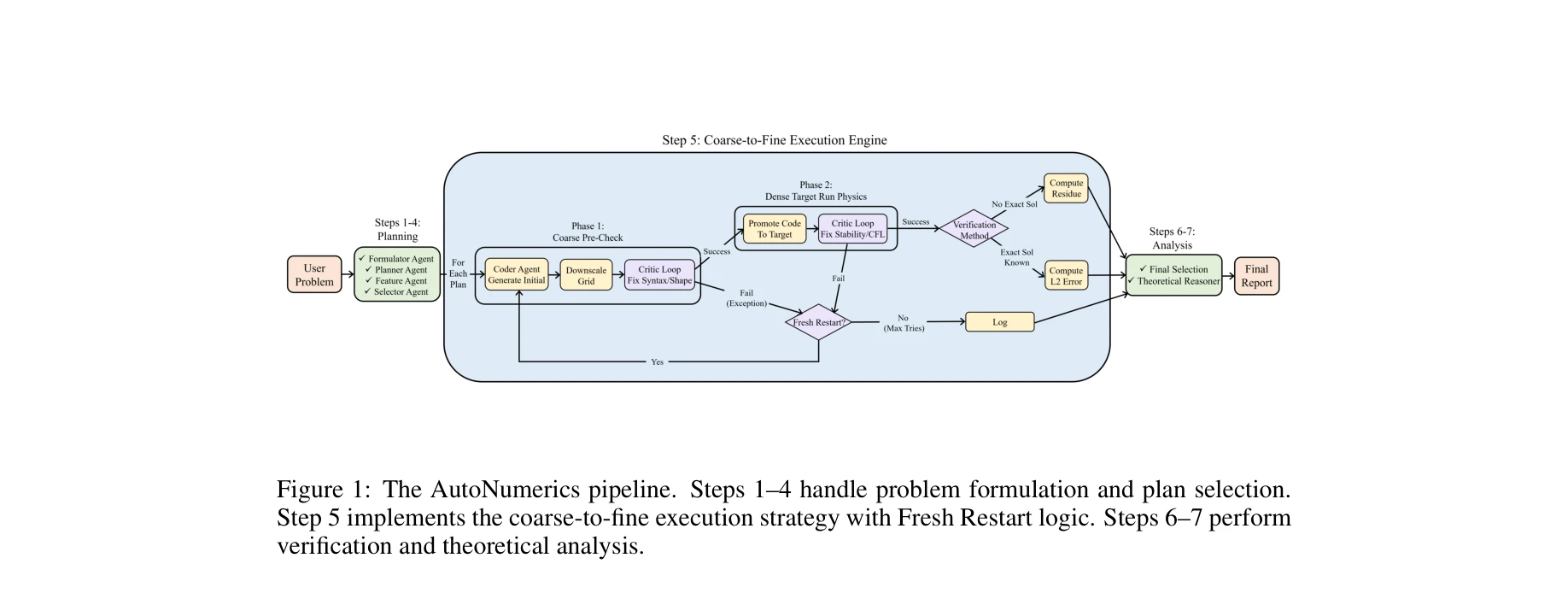

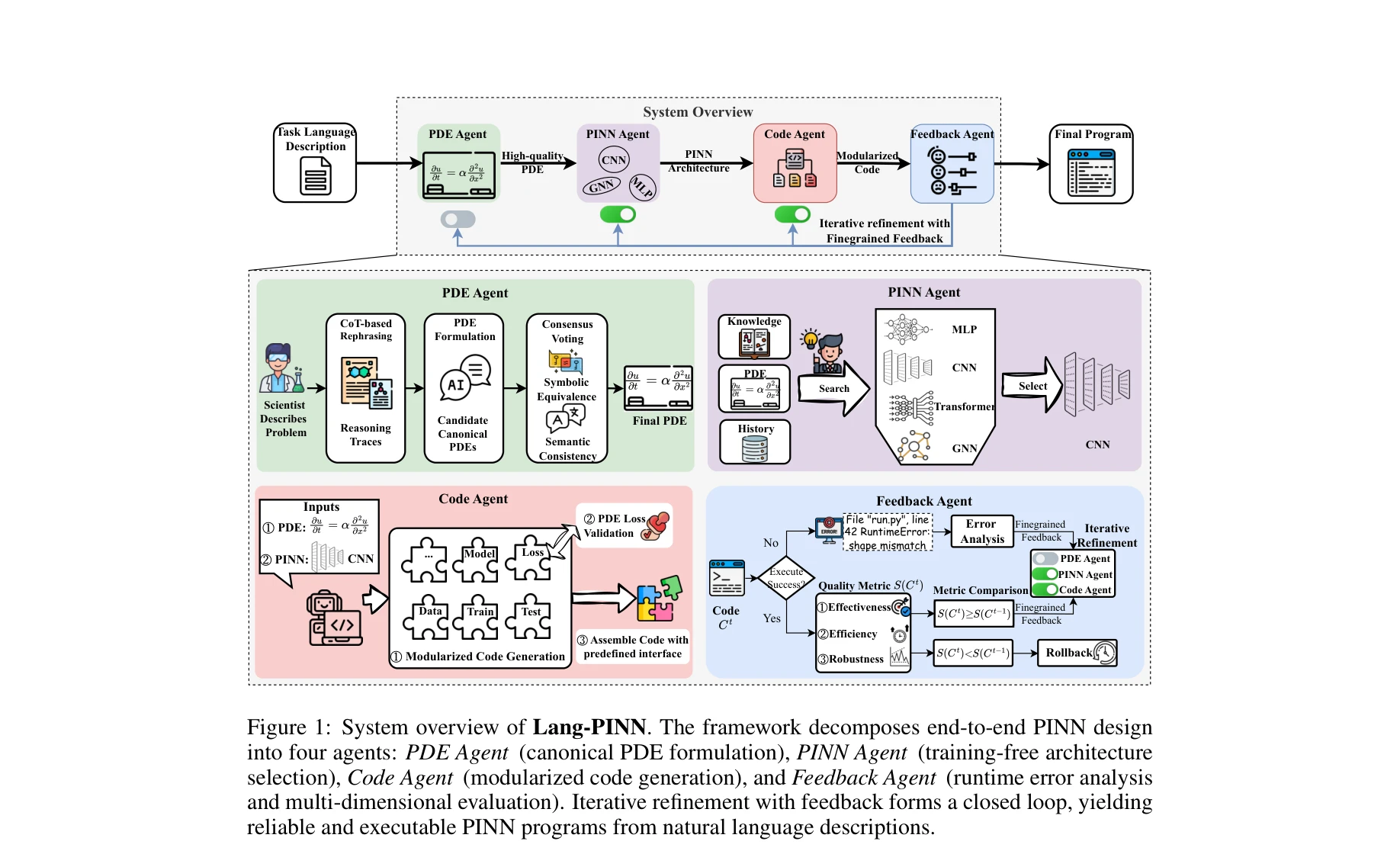

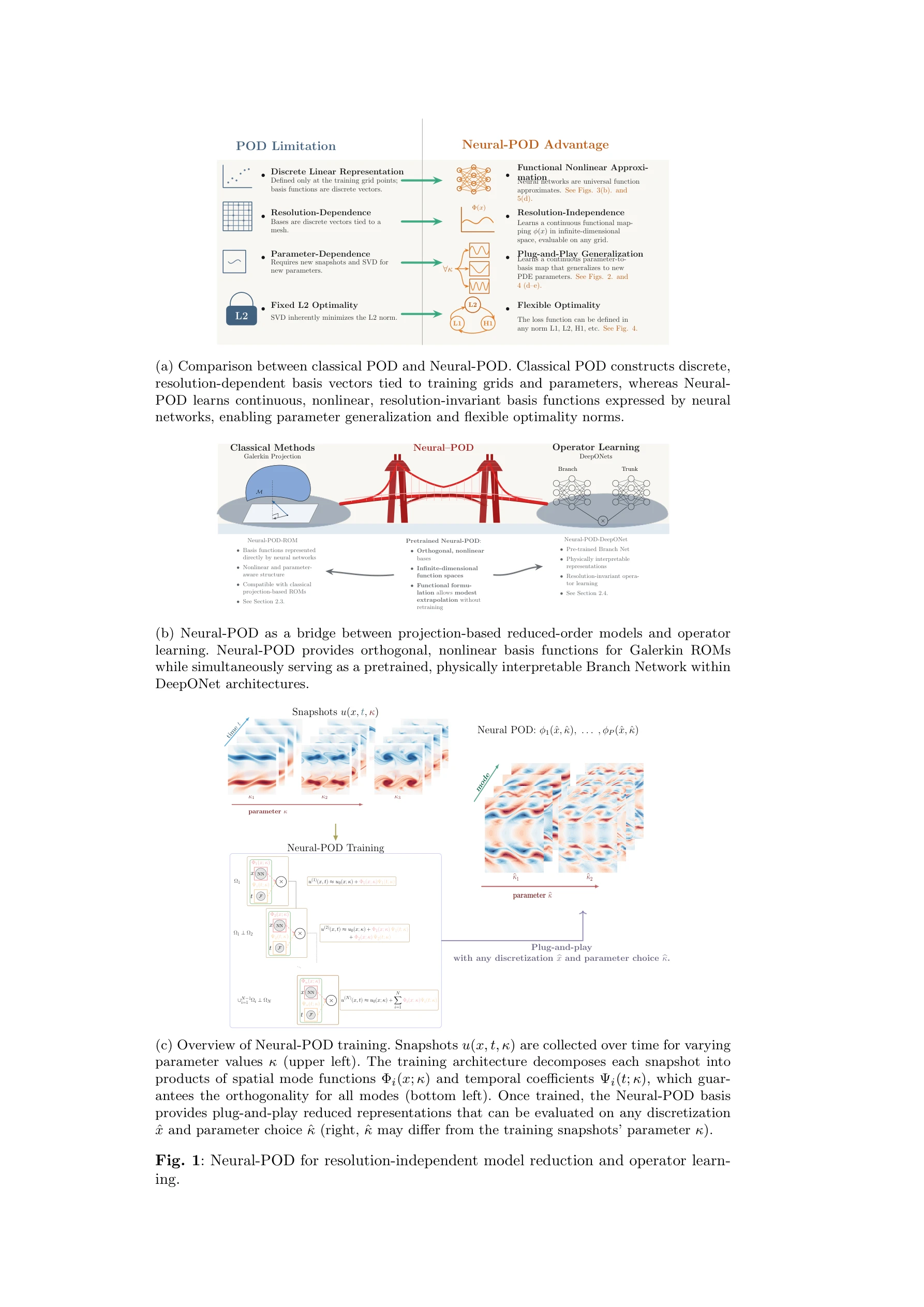

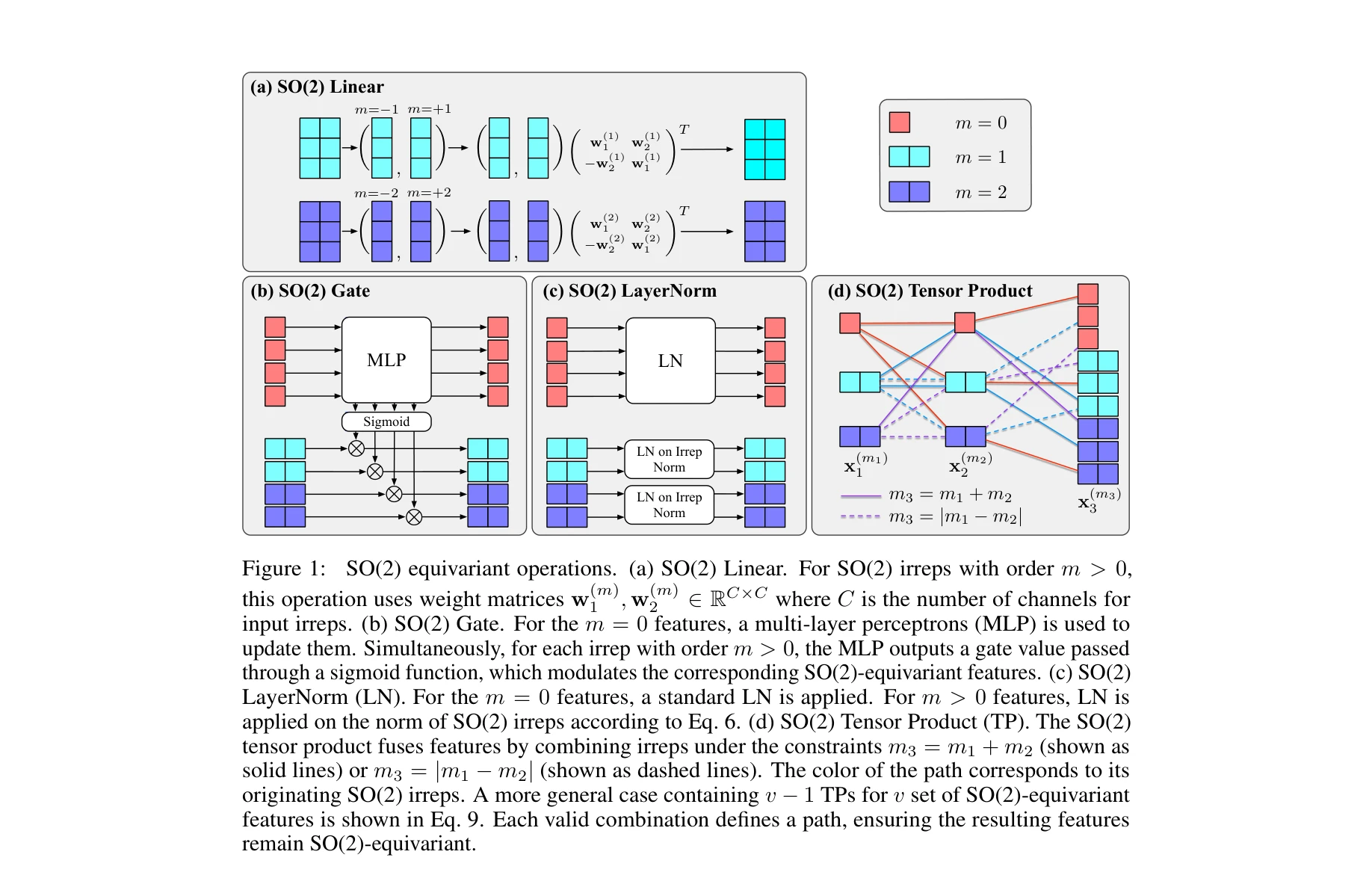

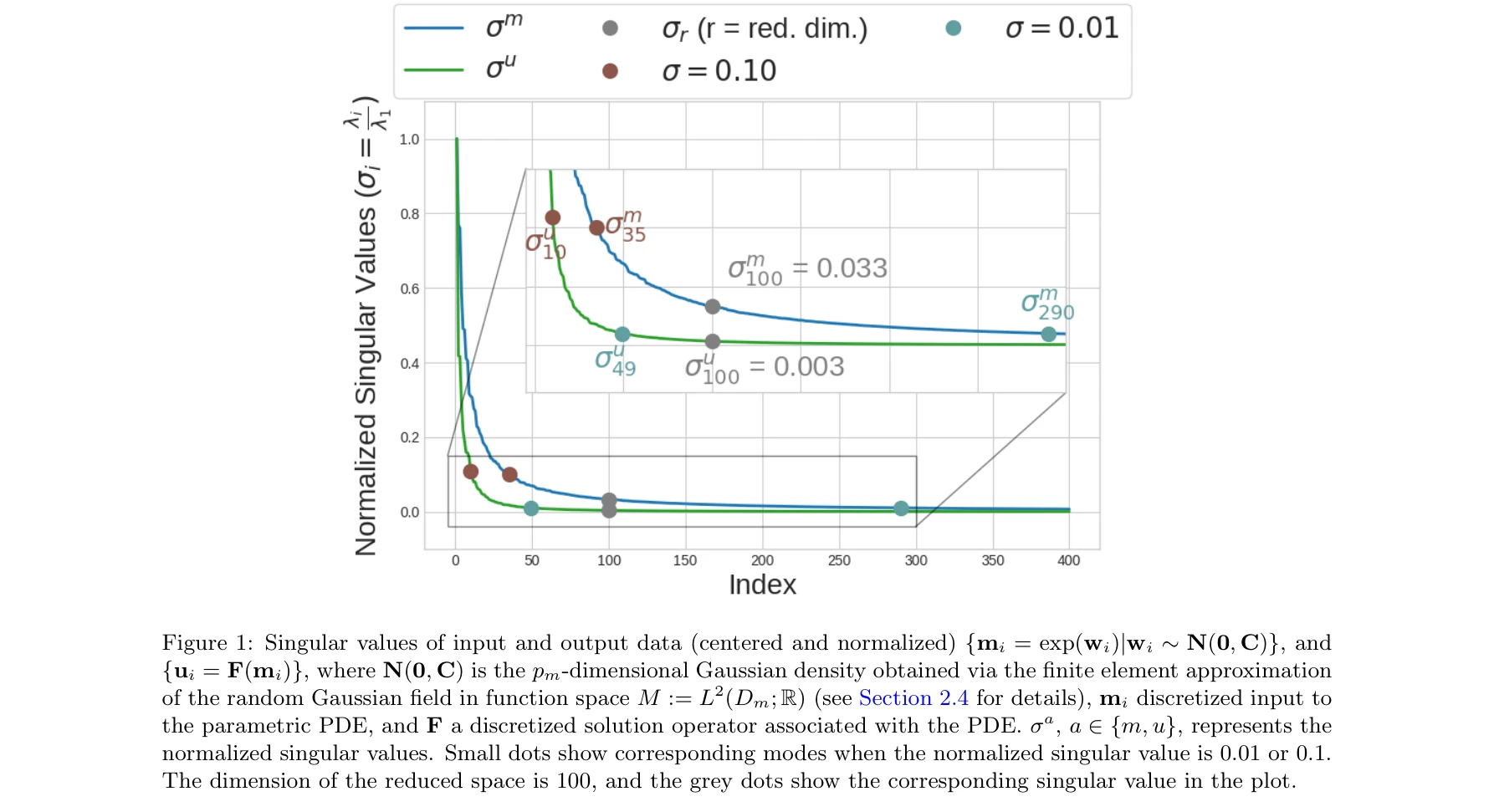

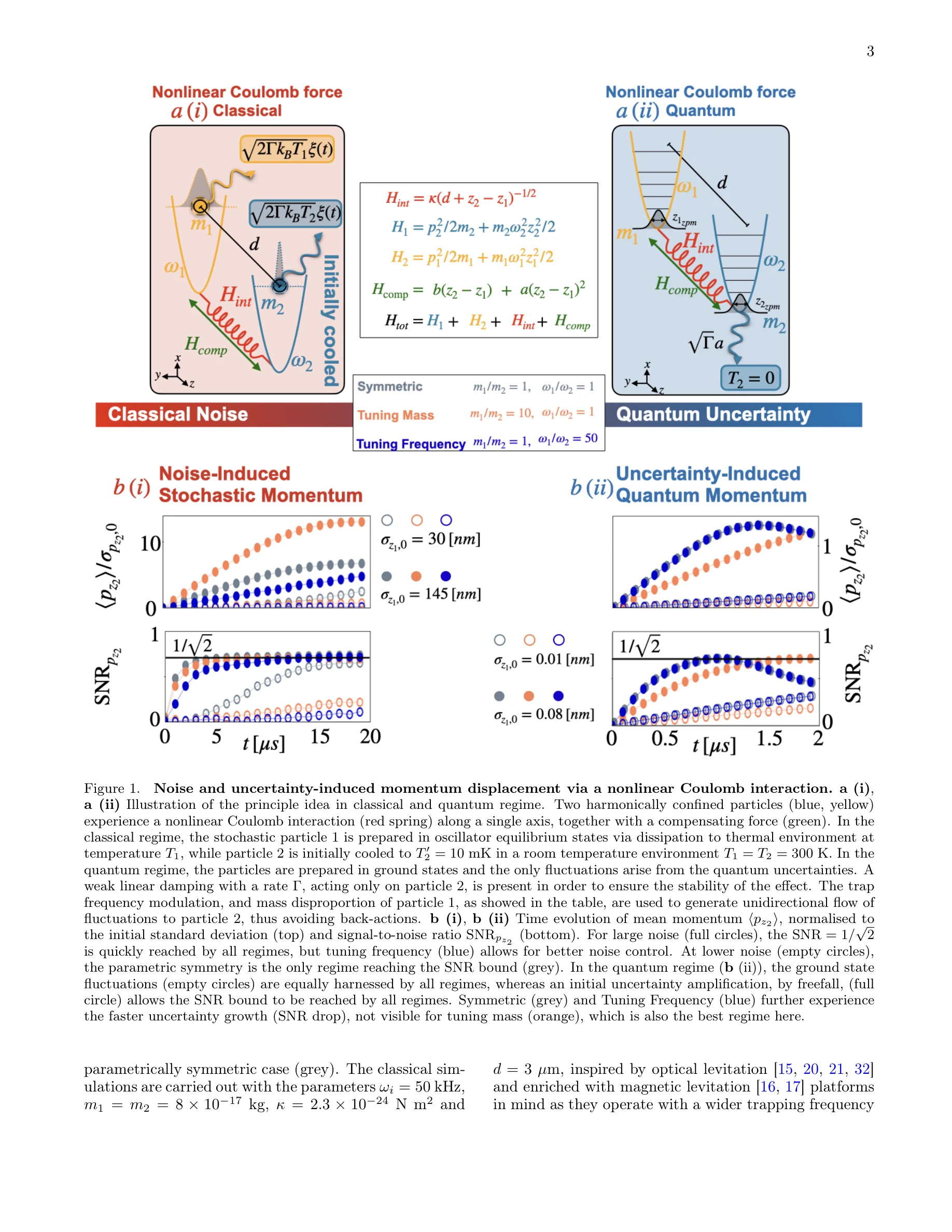

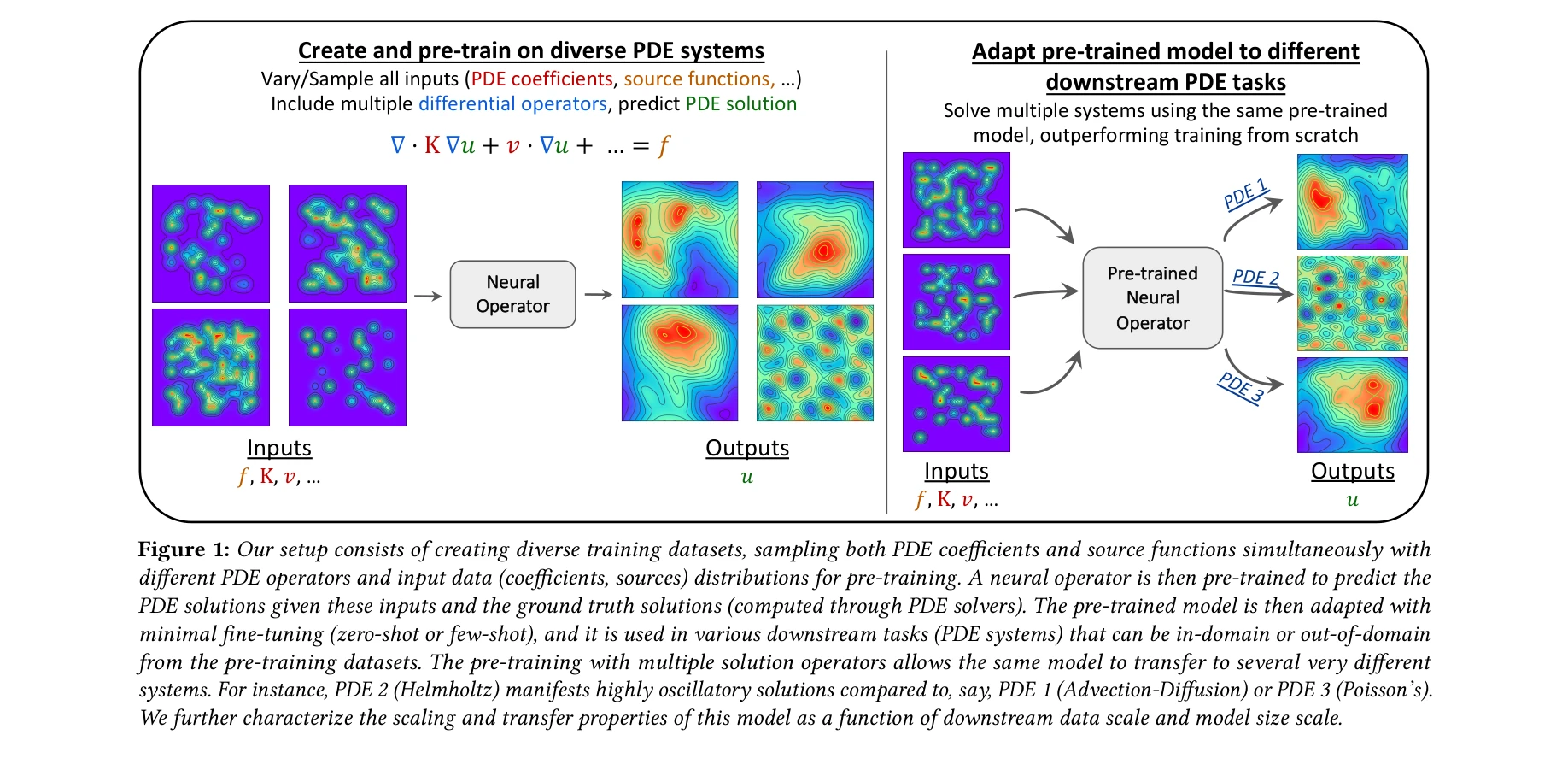

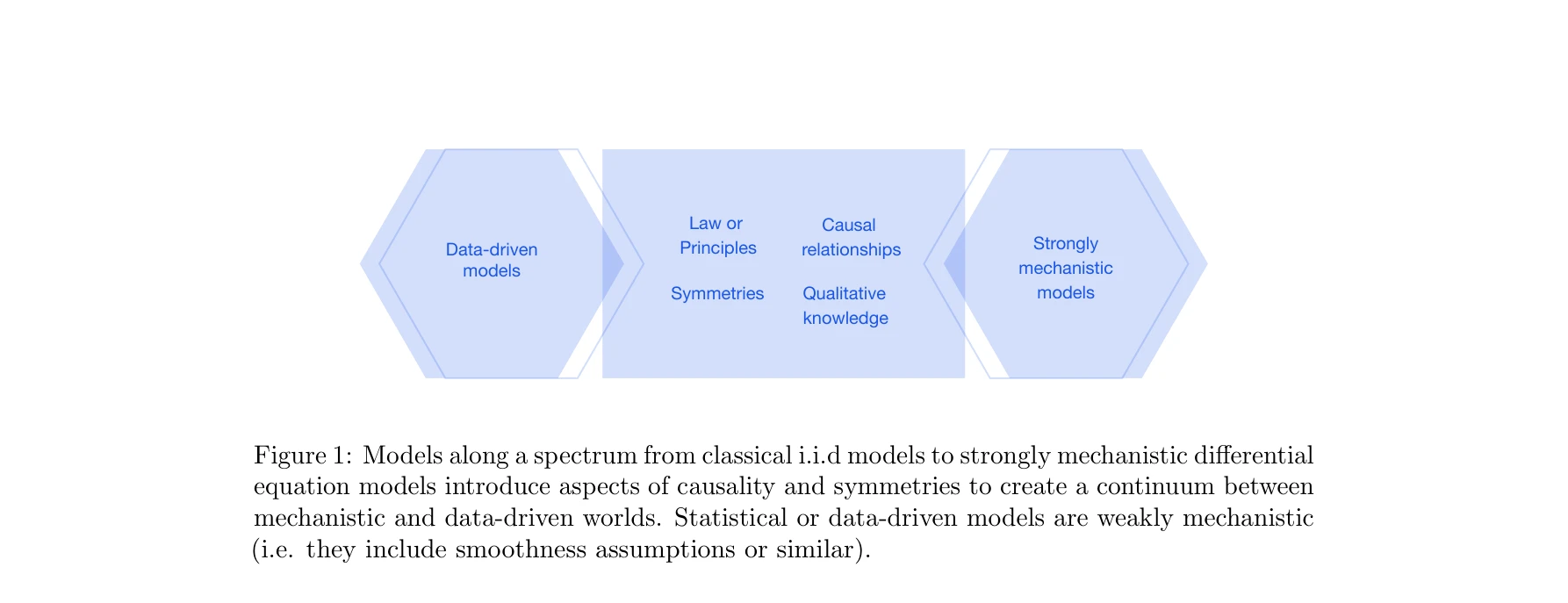

- Physics-informed Neural Networks: Physics-informed Neural Networks (PINN)는 물리 법칙을 신경망에 직접 통합하여 과학적 문제를 해결하는 AI 기술입니다. [721] 이러한 시스템은 편미분방정식(Partial Differential Equations, PDE)을 학습하고 복잡한 물리 현상을 모델링할 수 있으며, 전통적인 수치해석 방법보다 효율적입니다. [850][037] 불확실성 정량화(Uncertainty Quantification)는 PINN의 예측 신뢰성을 평가하는 핵심 요소로, 머신러닝 모델의 오차와 한계를 정량적으로 측정합니다. [103] 신경 연산자(Neural Operators)와 같은 다양한 아키텍처는 PINN의 성능과 확장성을 향상시키며, 여러 물리 문제에 적용될 수 있습니다. [767] SPINONet과 같은 최신 변형 모델들은 스파이킹 신경망(Spiking Neural Networks)을 활용하여 계산 효율성을 높이면서도 물리 제약 조건을 만족하는 솔루션을 제공합니다.

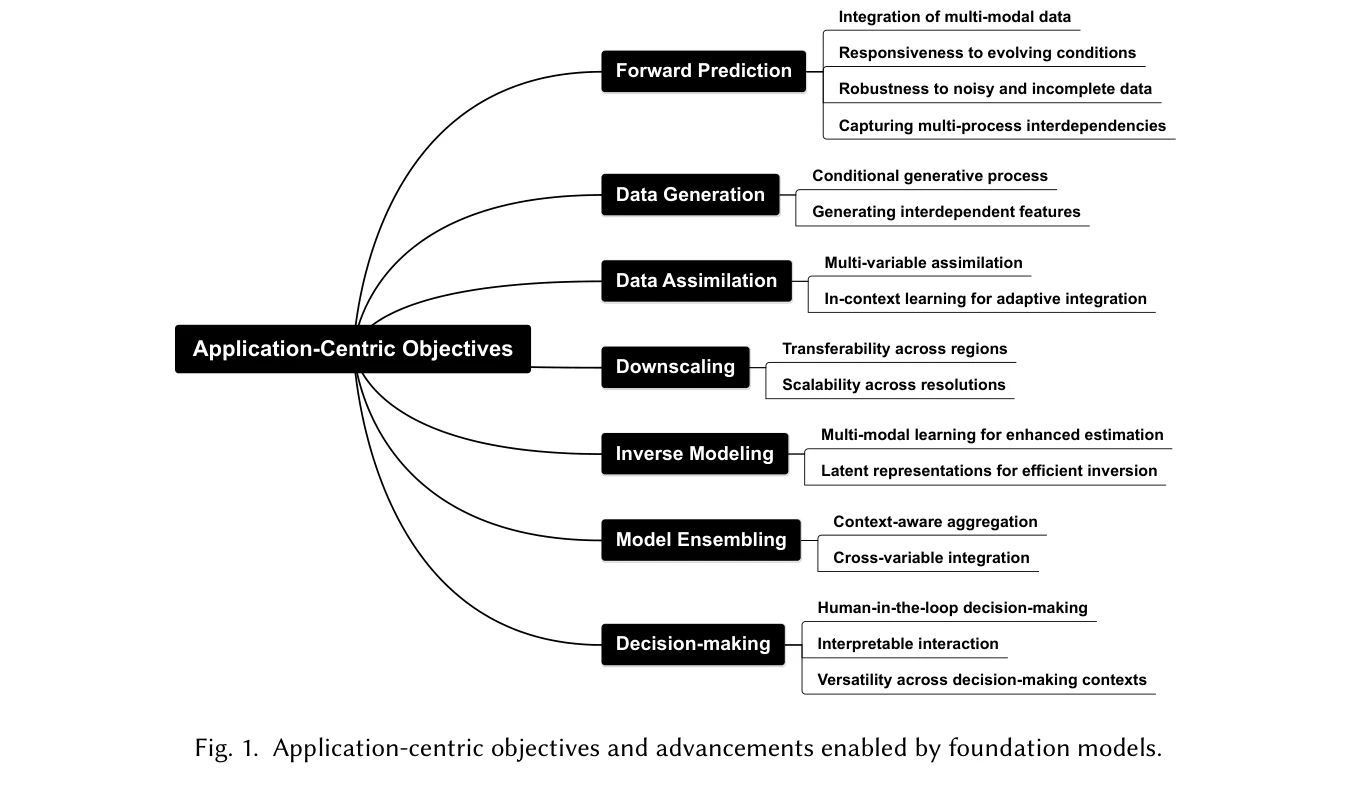

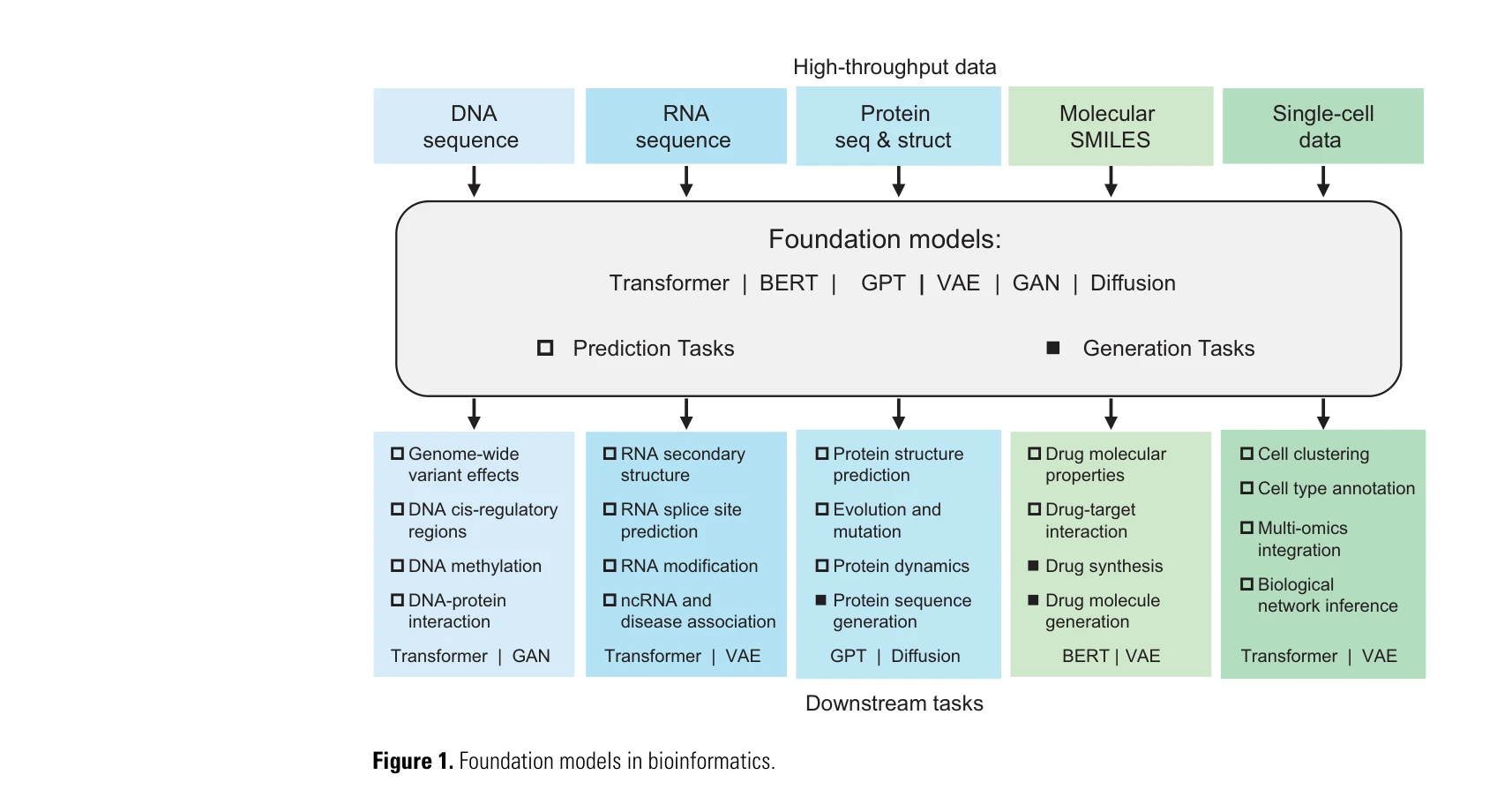

- AI-driven Bioinformatics Integration: AI 기반 생명정보학 통합(AI-driven Bioinformatics Integration)은 인공지능 기술을 생명정보학 분야에 적용하여 생물학적 데이터 분석과 과학적 발견을 가속화하는 시스템입니다. 기초 모델(Foundation Models)의 등장으로 대규모 생물학적 데이터셋을 효율적으로 처리할 수 있게 되었으며, 이는 단백질 구조 예측, 유전자 분석, 신약 개발 등 다양한 생명과학 연구에 혁신을 가져오고 있습니다 [344]. ChatGPT와 같은 AI 시스템이 2023년 과학 분야에서 중요한 역할을 수행하면서 [899], 생명정보학 자동화(Laboratory Automation)와 AI의 결합은 연구 효율성을 획기적으로 높이고 있습니다 [614]. 향후 AI for Science 분야에서는 AGI(Artificial General Intelligence) 수준의 AI 모델들이 복잡한 생물학적 문제 해결에 더욱 활용될 것으로 예상되며 [075], 이러한 발전은 생명과학 연구의 패러다임을 근본적으로 변화시킬 것입니다 [322].

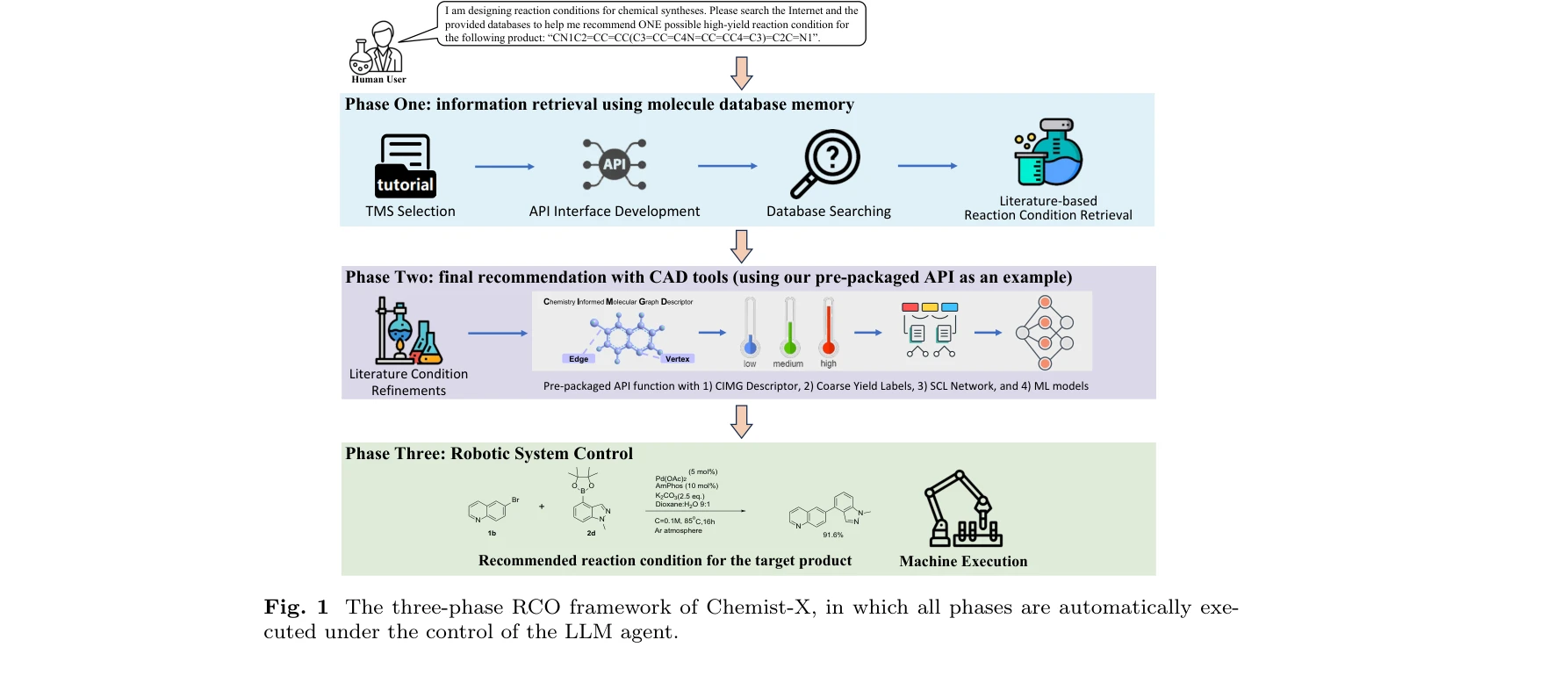

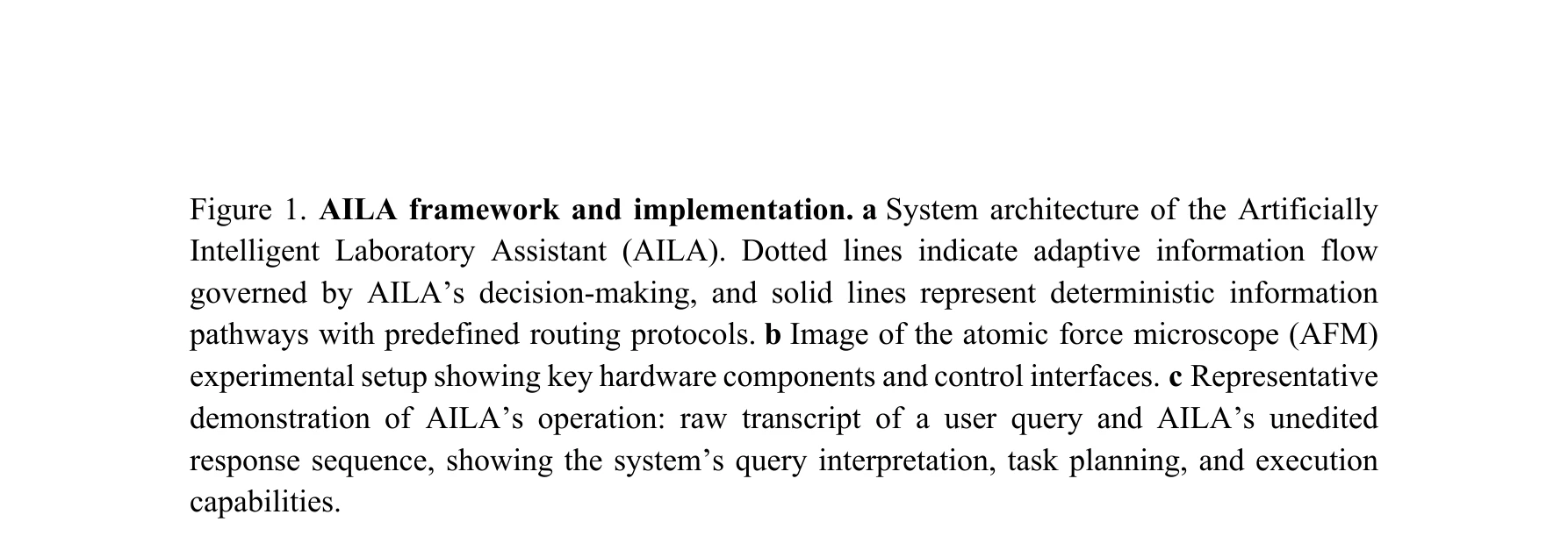

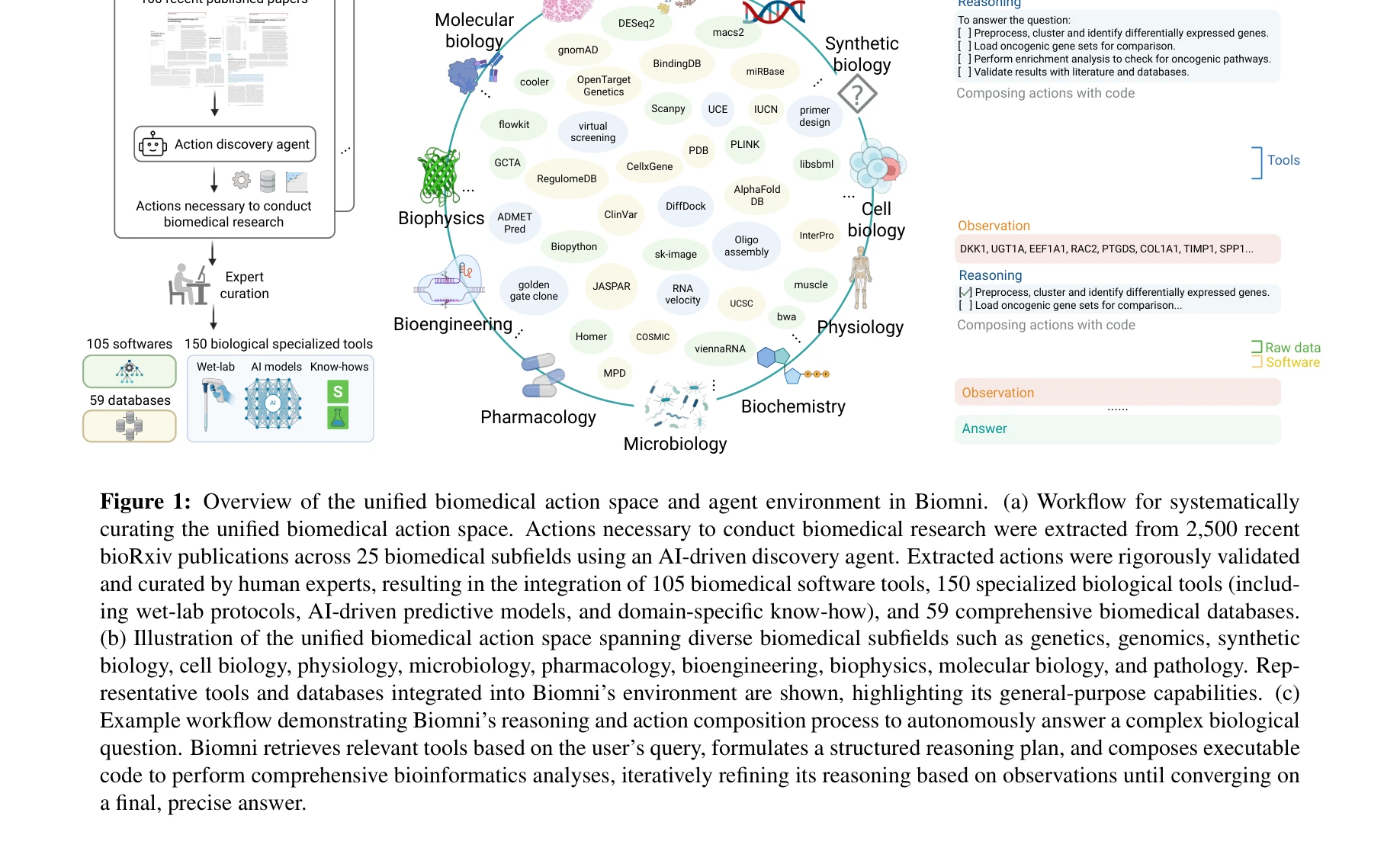

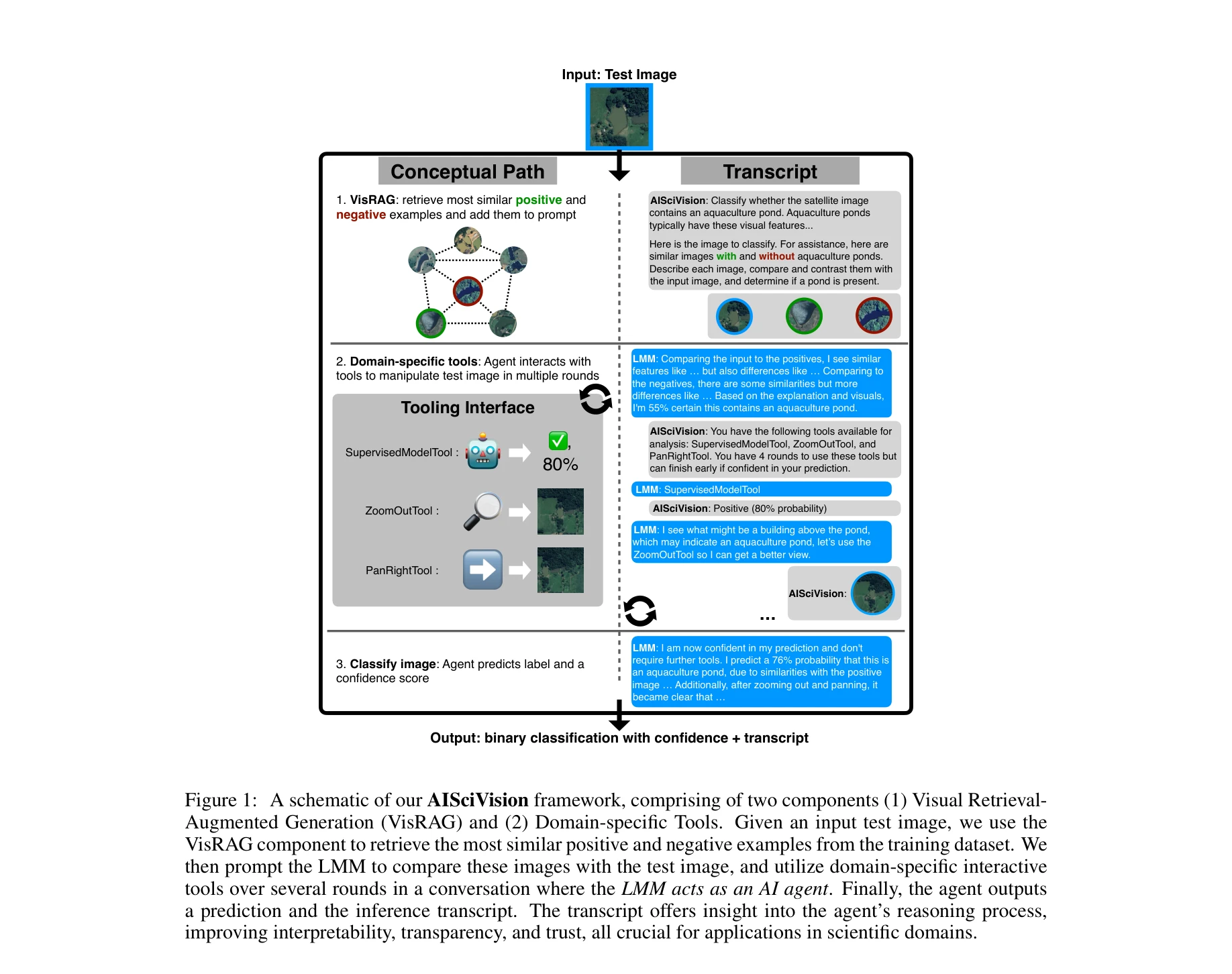

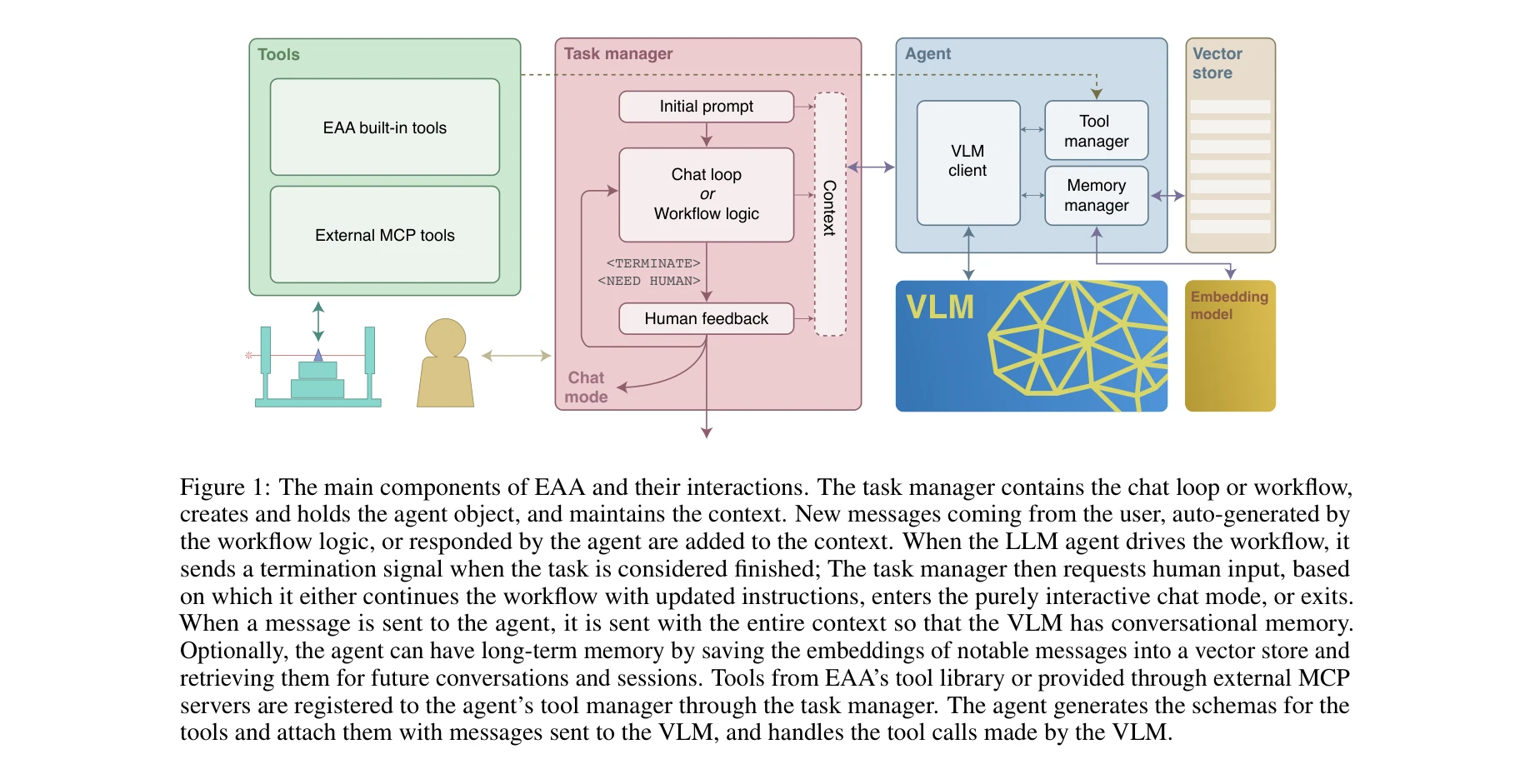

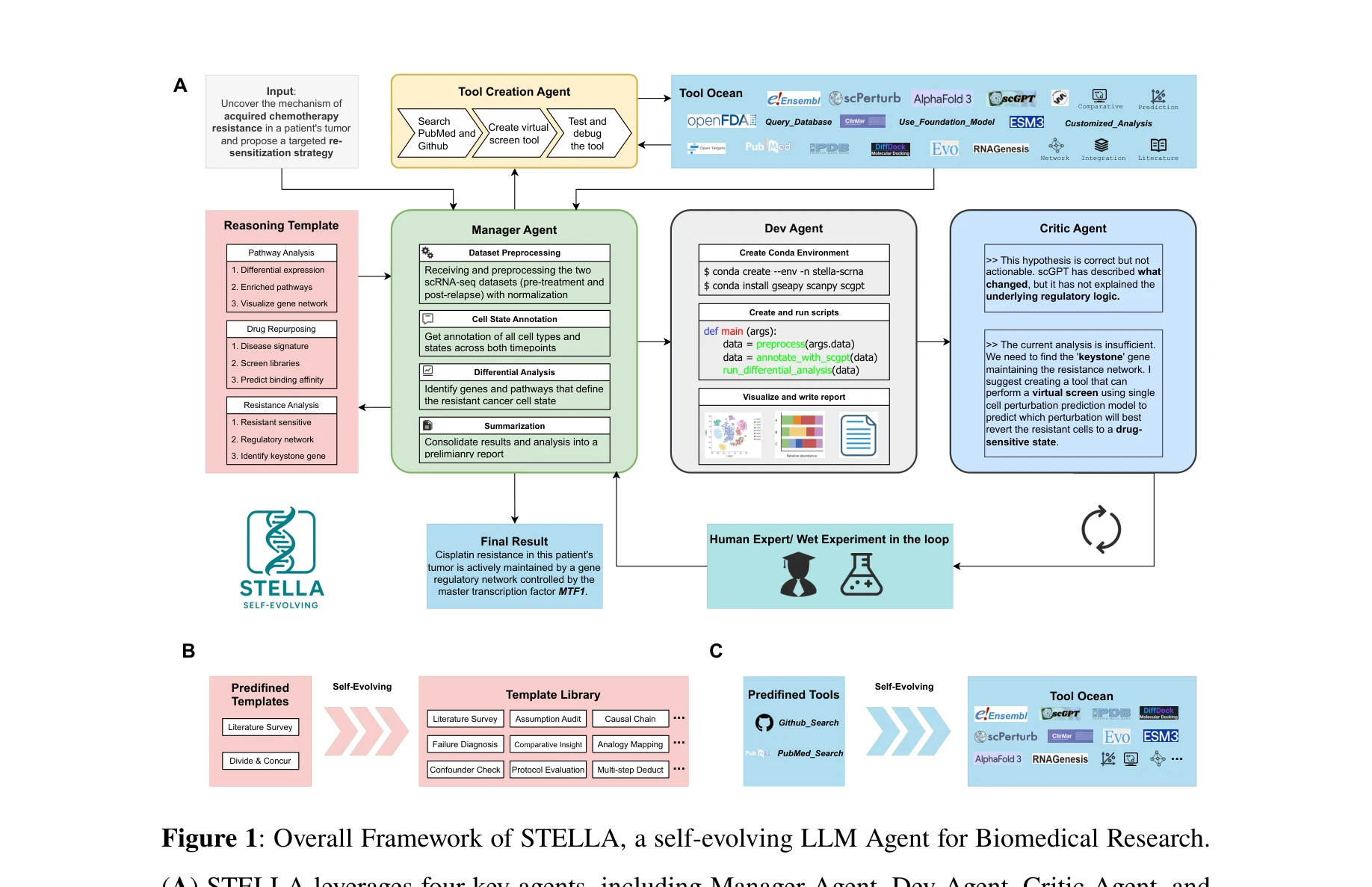

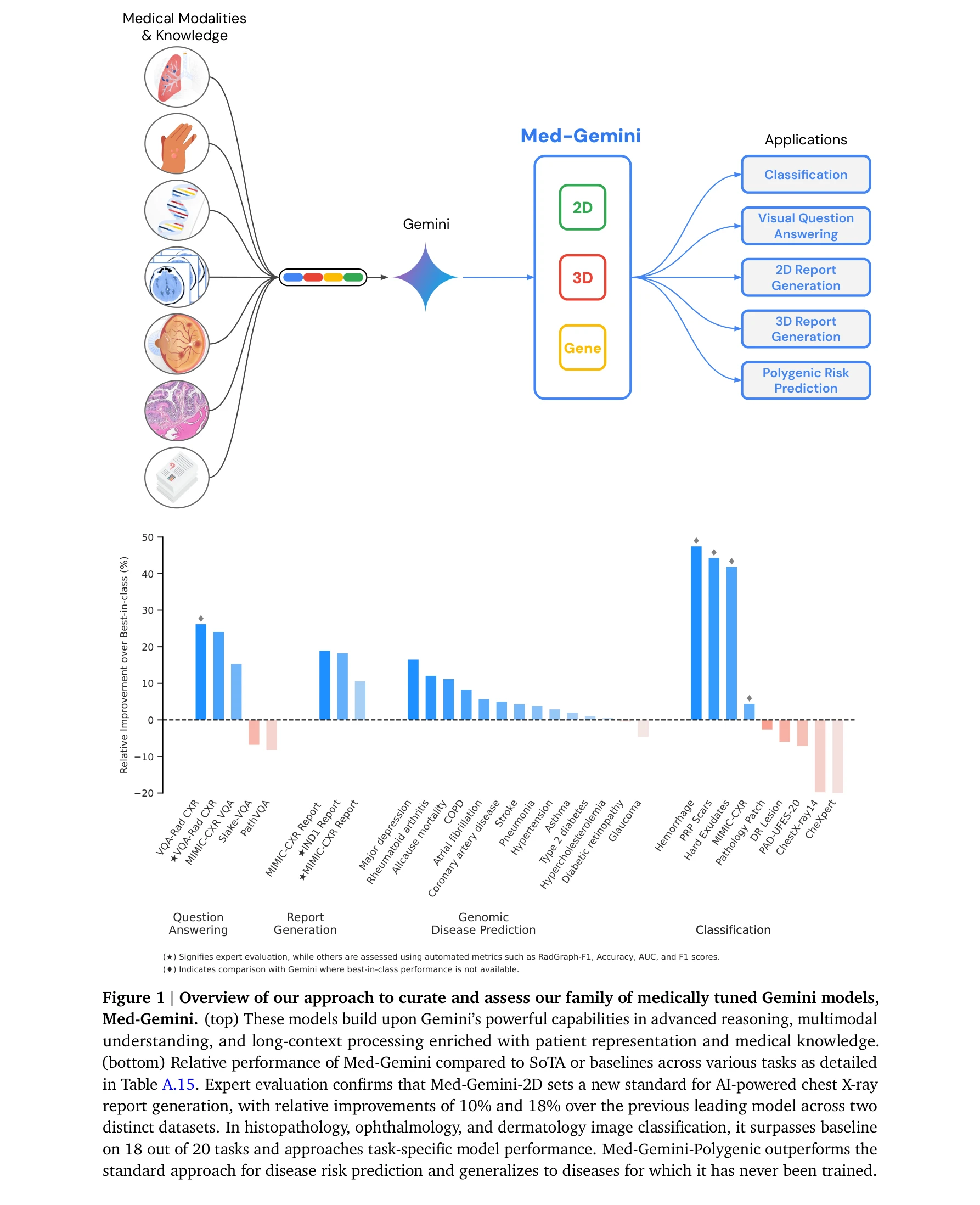

- Biomedical Research Agents: 생의학 연구 에이전트(Biomedical Research Agents)는 대규모 언어 모델(Large Language Model)과 멀티모달 비전 기술을 결합하여 과학 연구 프로세스를 자동화하는 AI 시스템입니다. [212]에서 제시된 Chemist-X와 같은 화학 반응 분석 에이전트부터 [139]의 자율 현미경 실험(Autonomous Microscopy Experiments)까지, 이들 시스템은 복잡한 실험 설계와 데이터 해석을 인간 개입 없이 수행할 수 있습니다. [168]의 Biomni와 같은 범용 생의학 AI 에이전트는 다양한 생물의학 분야의 작업을 통합적으로 처리하며, [091]의 AIscivision 프레임워크는 멀티모달 모델(Multimodal Model)의 특화를 통해 과학적 이미지 분석 능력을 향상시킵니다. [297]의 EAA 시스템은 비전-언어 모델(Vision-Language Model)을 활용하여 재료 특성화(Materials Characterization) 프로세스를 완전히 자동화합니다. 이러한 생의학 연구 에이전트들은 연구 효율성을 획기적으로 증대시키고 과학적 발견의 속도를 가속화하는 혁신적인 도구로 기능합니다.

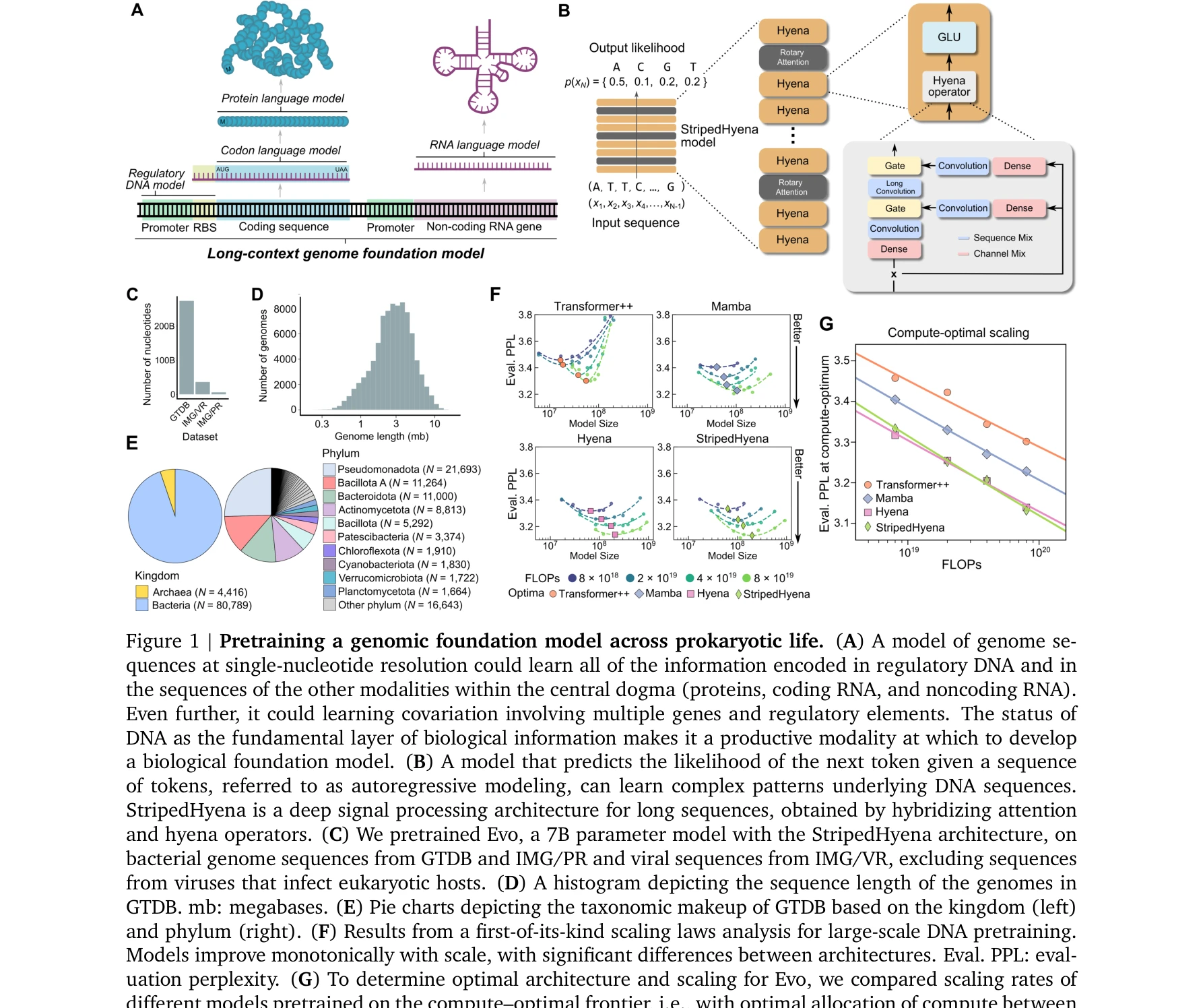

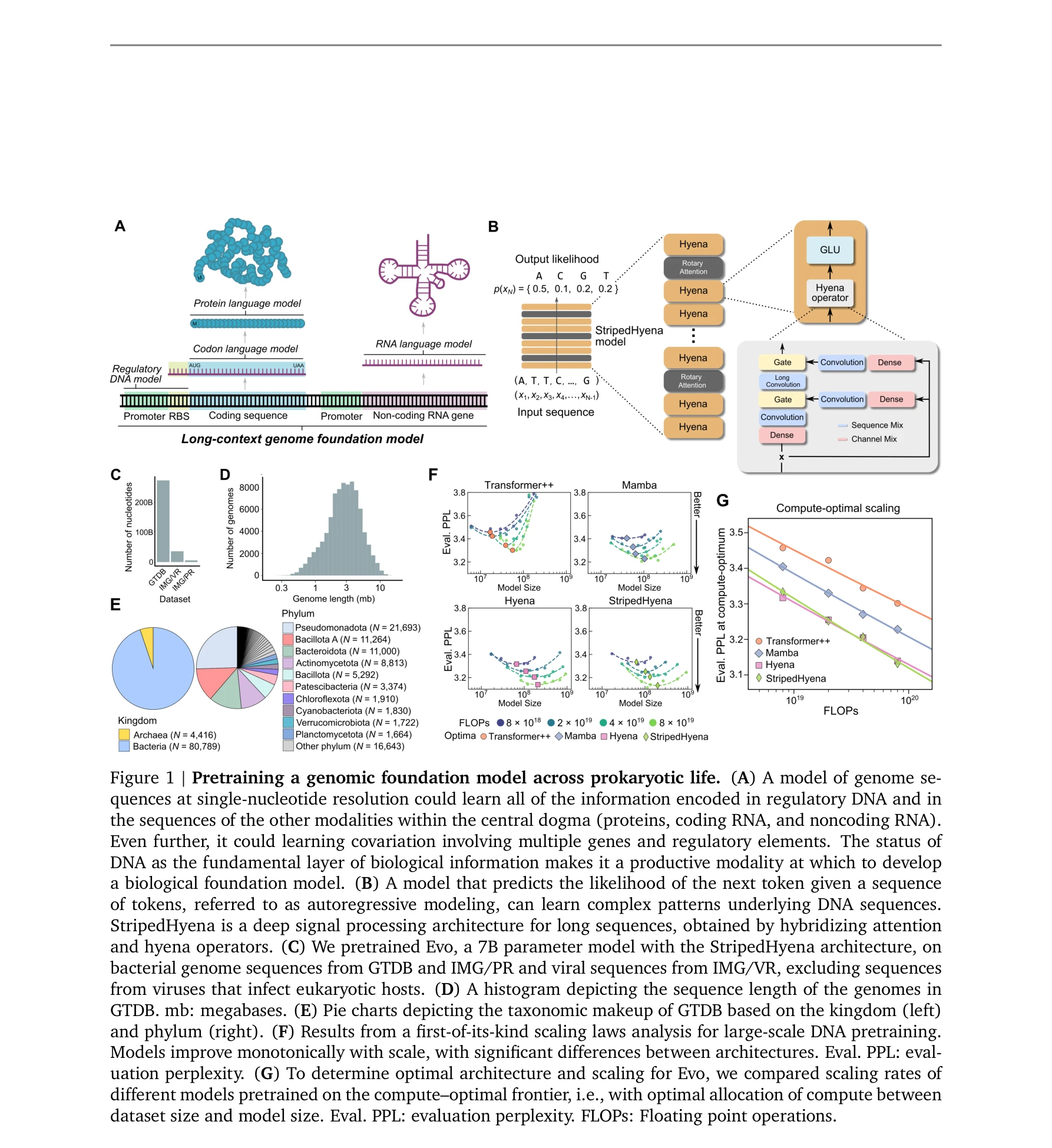

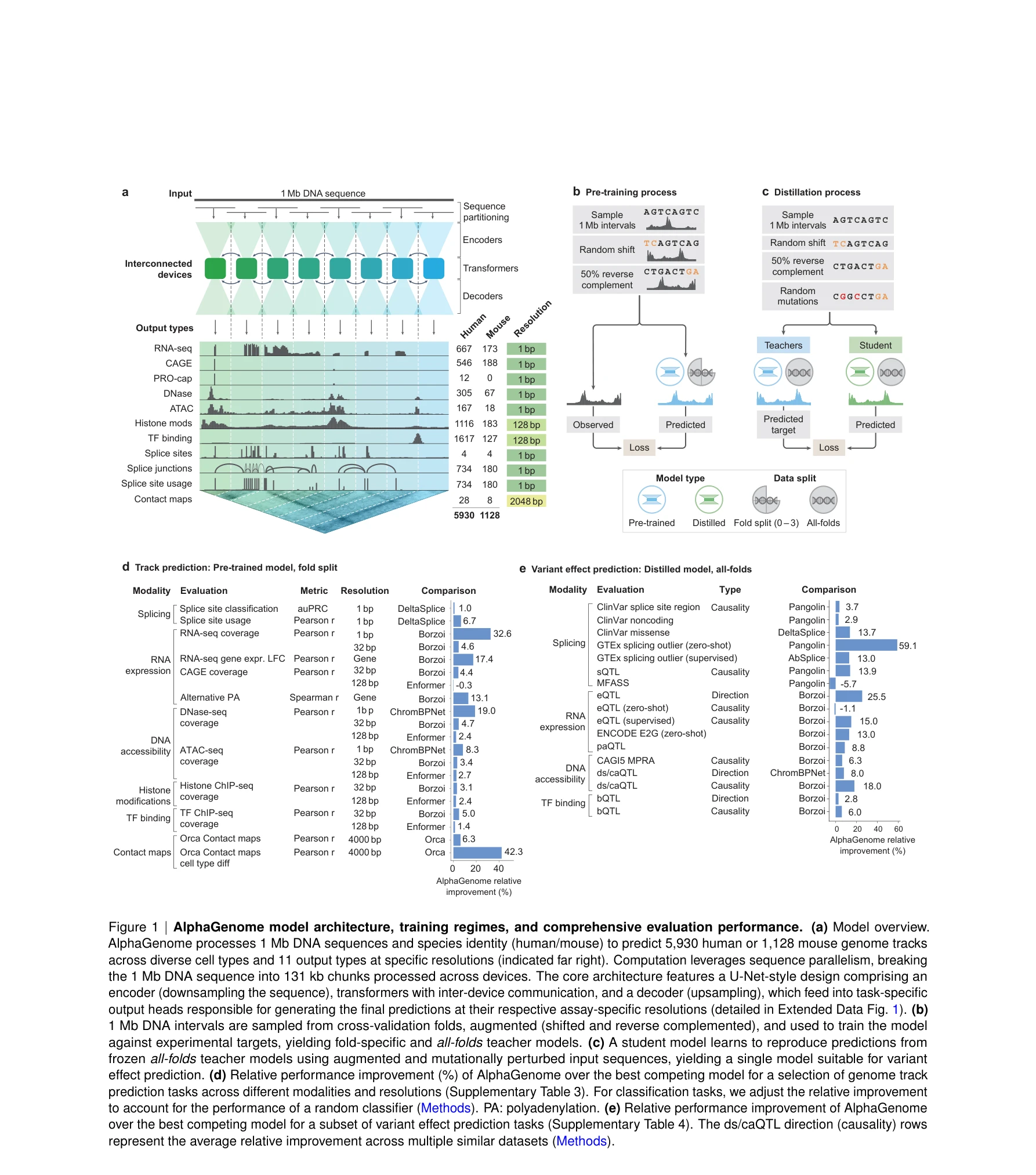

- Foundation Models Biology: Foundation Models Biology는 생물학 분야에 대규모 언어 모델(Large Language Models)과 기초 모델(Foundation Models)을 적용하는 혁신적인 접근 방식입니다. [720]에서 다루는 바와 같이, 과학 분야 대규모 언어 모델들은 생물학 및 화학 연구에서 중요한 역할을 수행하고 있으며, 다양한 도전 과제들을 극복해나가고 있습니다. [696]의 단일 세포(Single-Cell) 분석에 적용된 대규모 언어 모델 스케일링 기술은 차세대 유전자 발현 분석을 가능하게 하고 있습니다. [302]에서 시퀀스 정보로부터 유전자 발현 예측(Gene Expression Prediction)을 통합적으로 수행하는 효과적인 방법들이 제시되고 있으며, [465]의 재료과학(Materials Science) 분야 사례처럼 생물학 외 다양한 과학 영역으로의 확대 적용이 진행 중입니다. Foundation Models Biology는 AI와 생물학의 융합을 통해 복잡한 생명 현상의 이해와 신약 개발, 질병 치료 방법 발굴 등 다양한 실무적 응용을 가능하게 하고 있습니다.

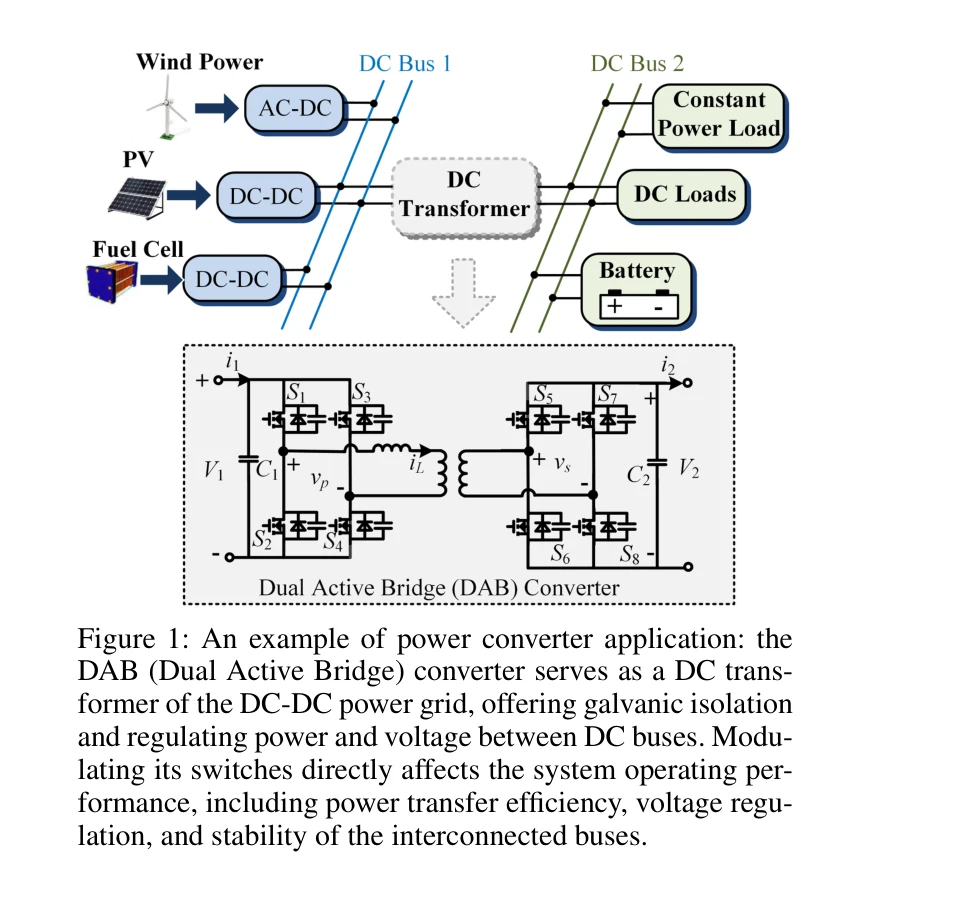

- AI-guided Manufacturing Control: AI 기반 제조 공정 제어(AI-guided Manufacturing Control)는 기계학습과 진화 알고리즘을 활용하여 제조 공정의 최적화 및 동적 제어를 실현하는 기술 분야입니다. 화학 공간(chemical space)의 효율적인 탐색을 통해 신소재 개발 시간을 단축하고 [305], 적응 제어(adaptive control) 시스템에 생성형 머신러닝(generative machine learning)을 적용하여 동적 제조 환경에 대응하는 지능형 제어가 가능해집니다 [380]. 분자의 구조를 반영한 토큰화(tokenization) 기법과 확산 모델(diffusion model)의 보상 기반 정렬(reward-guided alignment)을 통해 제조 공정의 정밀도와 효율성이 크게 향상됩니다 [349], [428]. 이러한 기술들은 반도체, 화학, 제약 등 다양한 산업에서 제조 비용 절감과 품질 개선을 동시에 달성하는 데 활용되고 있습니다.

- Geometric Prior Learning: 기하학적 사전 학습(Geometric Prior Learning)은 AI 기반 과학 연구 시스템에서 물리적 구조와 공간적 관계에 대한 사전 지식을 활용하여 학습 효율을 극대화하는 기술입니다. 이 접근 방식은 메타물질(metamaterials) 설계와 같은 복잡한 과학 문제에서 신경망이 기하학적 제약을 직접 학습하도록 하여, 비효율적인 탐색 공간을 크게 축소할 수 있습니다[440]. 파운데이션 모델(foundation models)을 대리 모델(surrogate model)로 활용하면 제한된 데이터로도 능동 학습(active learning)을 효율적으로 수행할 수 있으며, 이는 과학적 발견의 속도를 가속화합니다[346]. 기하학적 사전 학습은 신경 과학 연구에서도 적용되어 행동 데이터의 복잡한 기하학적 구조를 이해하는 데 도움을 주고 있습니다[839]. 결과적으로 이 기술은 인공지능 시대의 과학적 발견 과정을 혁신하여 더욱 효율적이고 정확한 연구를 가능하게 합니다[718].

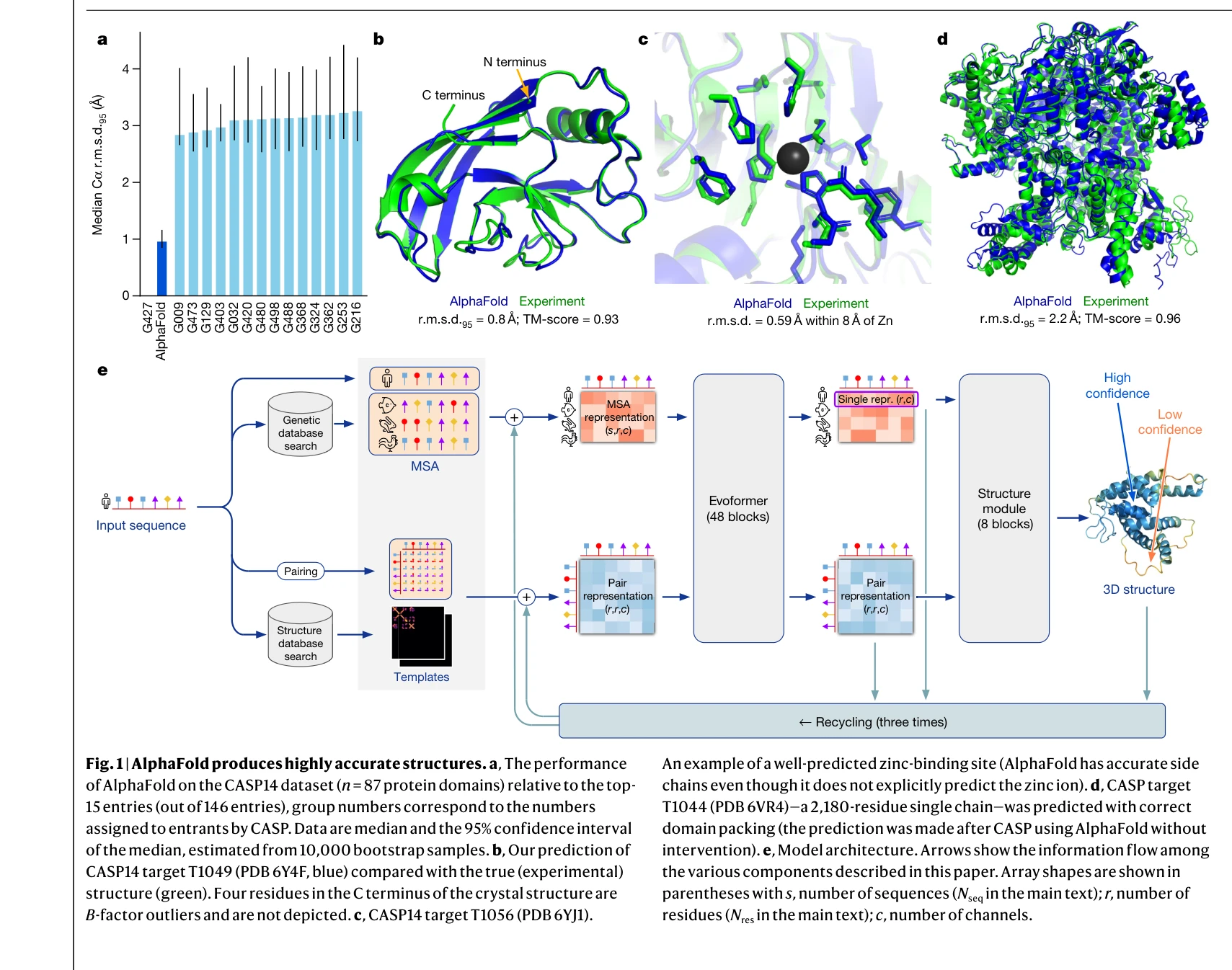

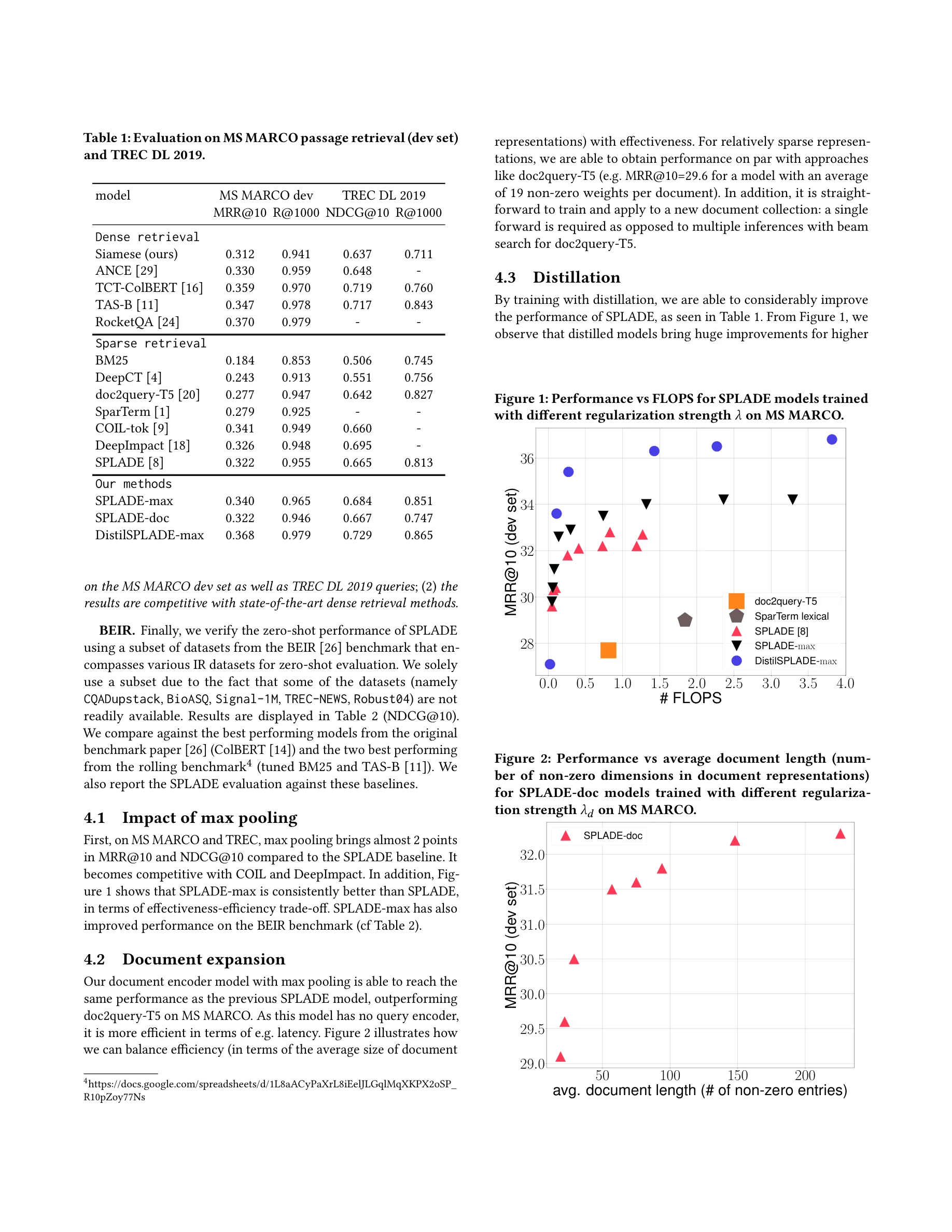

Highly accurate protein structure prediction with AlphaFold

AlphaFold가 생성한 고정확도 구조: (a) CASP14 데이터셋에서 다른 상위 15개 방법과의 성능 비교, (b-d) 정확한 백본 및 사이드 체인 예측, 특히 큰 단백질의 도메인 패킹 정확도 시연

AlphaFold는 아미노산 서열만으로 단백질의 3차원 구조를 원자 수준의 정확도로 예측하는 딥러닝 모델로, 50년 이상의 단백질 폴딩 문제를 근본적으로 해결한 획기적인 성과이다.

이 논문은 50년 이상 미해결된 단백질 폴딩 문제를 딥러닝으로 거의 완전히 해결한 역사적 성과로, 진화적 정보와 기하학적 제약을 창의적으로 통합한 혁신적 아키텍처를 제시하며, 구조 생물학과 생의학 연구에 패러다임 전환을 가져왔다.

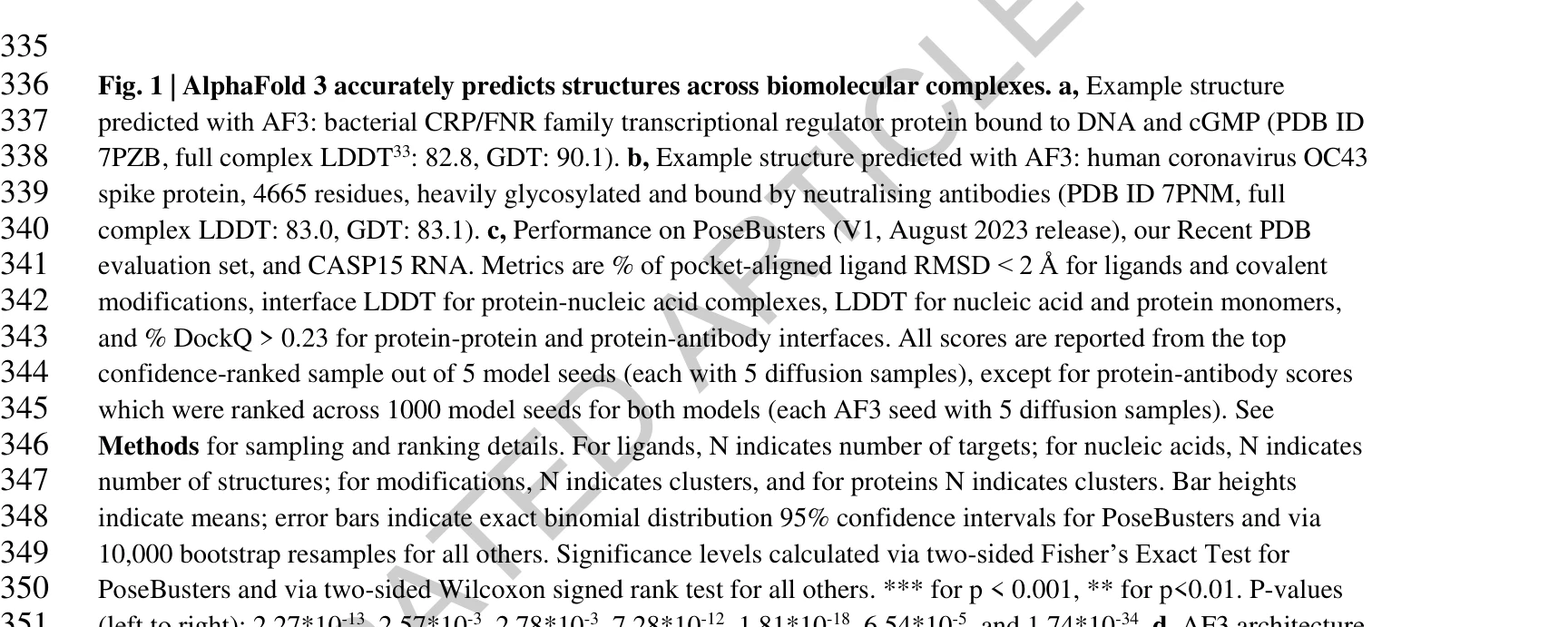

Accurate structure prediction of biomolecular interactions with AlphaFold 3

그림 1: AlphaFold 3는 다양한 생체분자 복합체에서 정확하게 구조를 예측함

AlphaFold 3는 단백질, 핵산, 소분자, 이온, 변형된 잔기를 포함한 생체분자 복합체 구조를 통합된 딥러닝 프레임워크 내에서 정확하게 예측하는 모델이다. 확산 기반(diffusion-based) 아키텍처를 통해 기존 특화된 도킹 및 예측 도구들을 크게 능가하는 성능을 달성했다.

AlphaFold 3는 확산 기반 생성 모델을 생체분자 구조 예측에 혁신적으로 적용하여, 단백질부터 리간드, 핵산까지 모든 유형의 복합체를 통합 프레임워크로 정확하게 예측함으로써 구조생물학과 약물 설계 분야에 패러다임 전환을 가져오는 매우 중요한 기여이다.

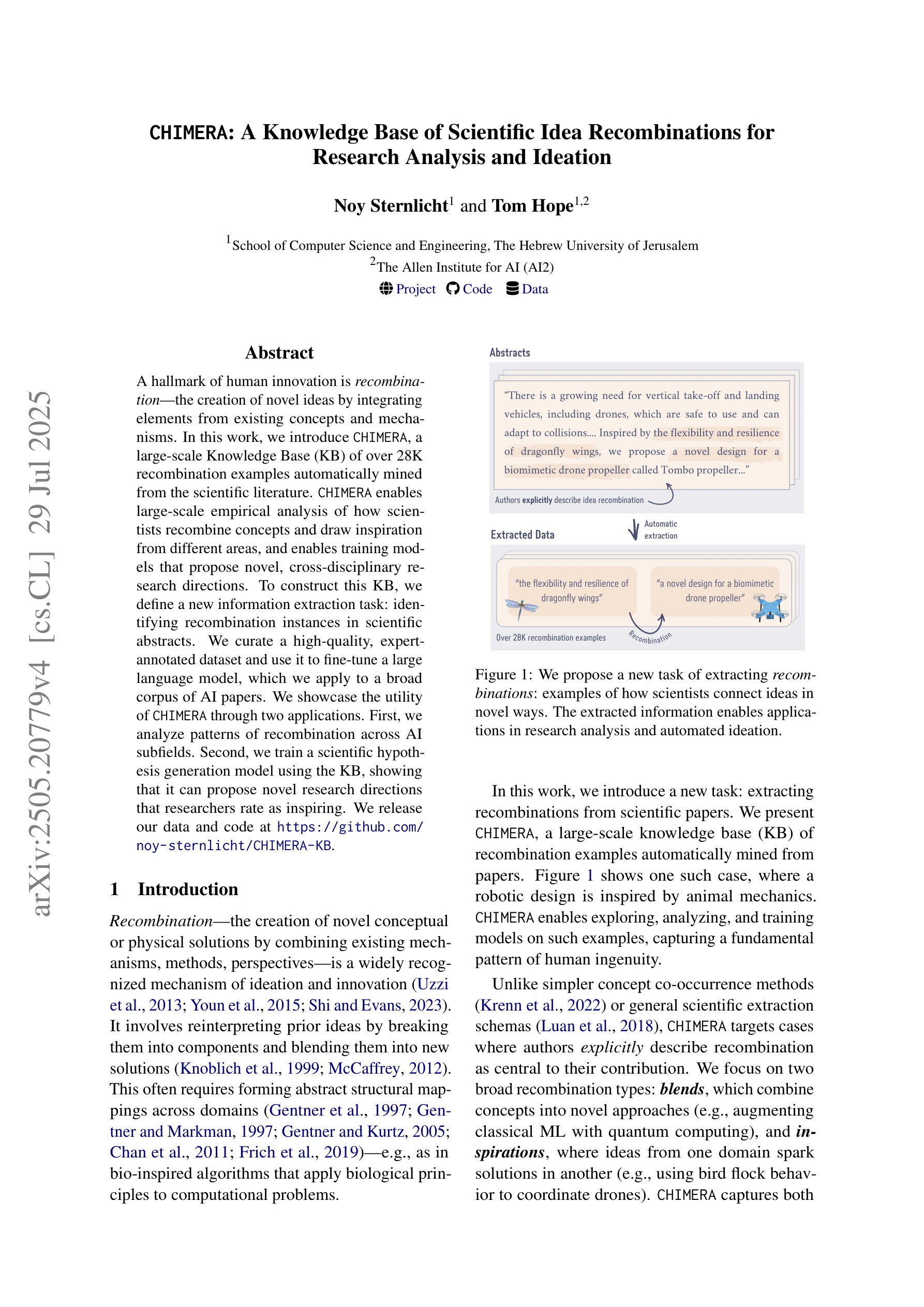

Agentic End-to-End De Novo Protein Design for Tailored Dynamics Using a Language Diffusion Model

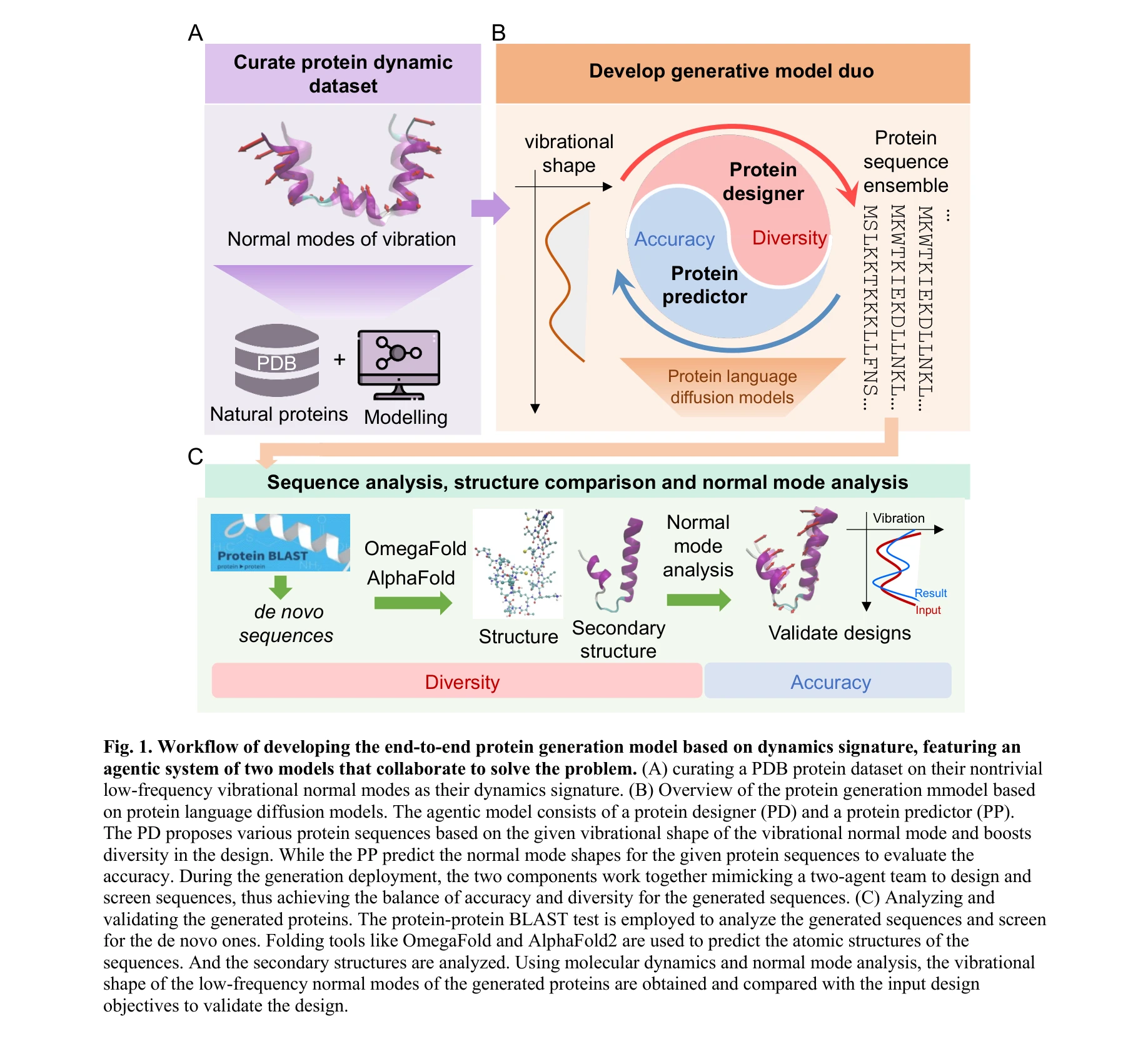

*VibeGen의 워크플로우: (A) 정상 모드 데이터베이스 구축, (B) 이중 에이전트 아키텍처를 통한 설계, (C) 분자동역학 시뮬레이션으로 검증* 단백질의 생물학적 기능은 구조뿐만 아니라 동적 움직임에 의존하므로, 본 논문은 정상 모드 진동(normal mode vibration)을 조건으로 하는 **VibeGen** 프레임워크를 제시하여 목표 동역학 특성을 갖는 신규 단백질 설계를 가능하게 함.

본 논문은 단백질의 동역학적 특성을 명시적 설계 조건으로 통합한 혁신적 접근법을 제시하며, 이중 에이전트 협력을 통해 정확성과 다양성을 동시에 달성한 점이 특징임. 분자동역학 시뮬레이션 검증으로 신뢰성을 확보했으나, 다중 모드 확장성과 계산 비용 측면에서 개선 여지 존재.

Agentic End-to-End De Novo Protein Design for Tailored Dynamics Using a Language Diffusion Model

워크플로우: (A) PDB 단백질로부터 NMA 및 MD를 통한 동역학 시그니처 수집, (B) 단백질 디자이너와 예측기의 협력 작동, (C) 설계된 단백질의 검증 및 분석

단백질의 동역학적 특성을 직접 제어할 수 있는 생성형 AI 프레임워크 VibeGen을 제시하며, 이는 정규 모드(normal mode) 진동을 기반으로 새로운 단백질 서열을 설계할 수 있다.

이 연구는 단백질 설계에 동역학적 고려를 체계적으로 통합한 혁신적 시도로, 이중 에이전트 협력 프레임워크를 통해 de novo 단백질을 생성하는 데 성공했다. 전원자 MD 기반 검증으로 신뢰성을 확보했으나, 실험적 검증, 다중 모드 확장, 생물학적 기능성 입증이 후속 과제이다.

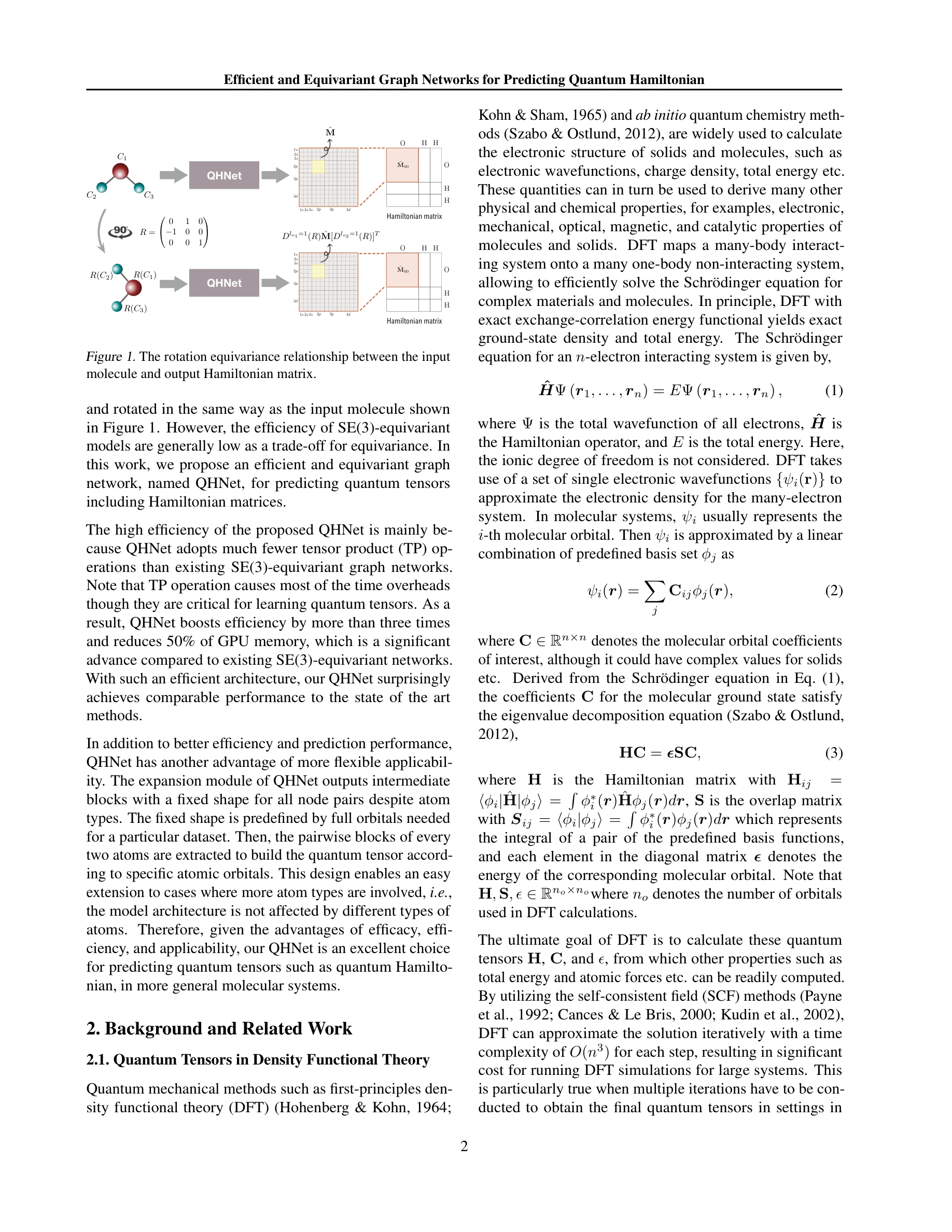

QH9: A Quantum Hamiltonian Prediction Benchmark for QM9 Molecules

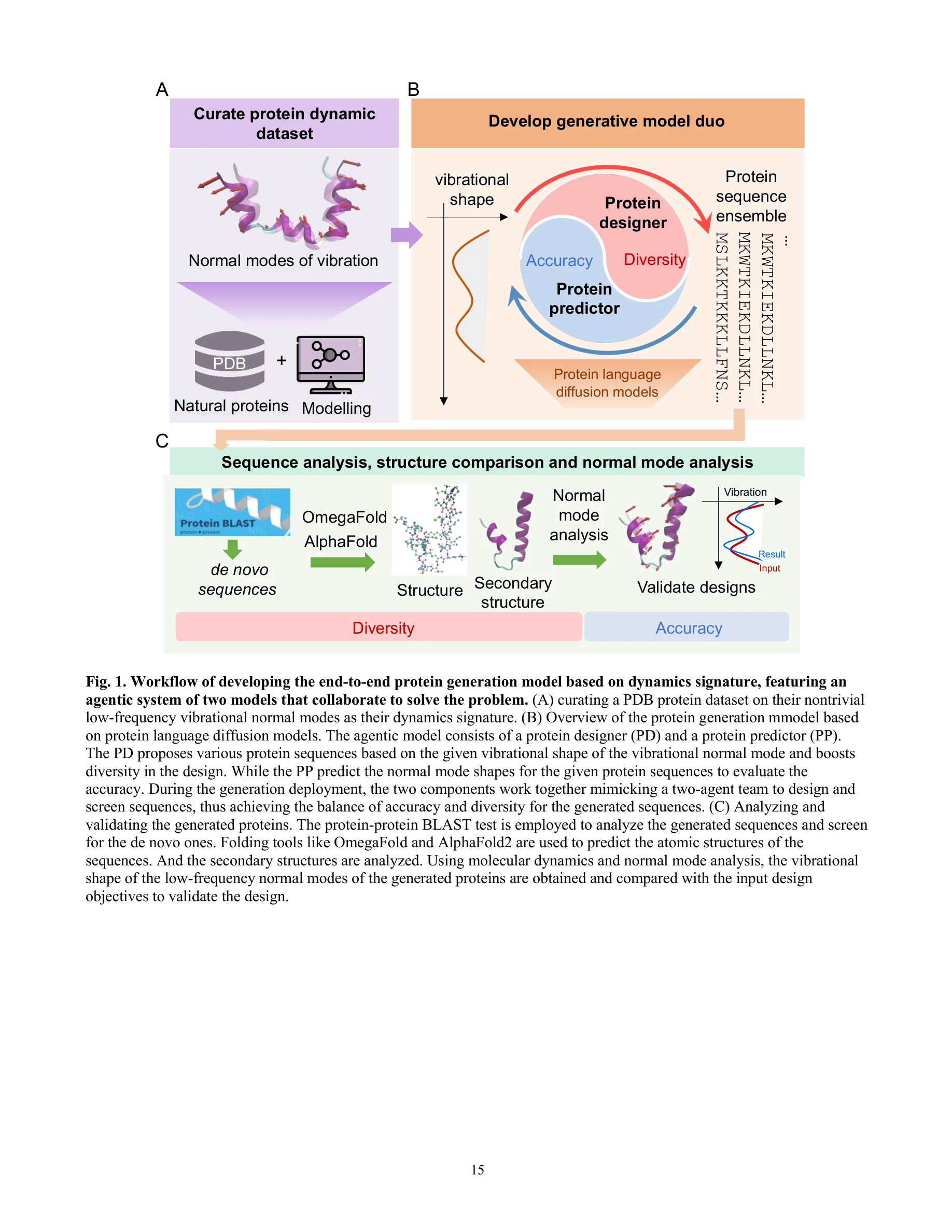

QH9 데이터셋과 벤치마크의 목표 및 내용: 양자 텐서 네트워크가 해밀턴 행렬 예측을 위해 구성되며, 안정적/동적 데이터셋과 포괄적 평가 지표가 포함됨

*QH9 데이터셋과 벤치마크의 목표 및 내용: 양자 텐서 네트워크가 해밀턴 행렬 예측을 위해 구성되며, 안정적/동적 데이터셋과 포괄적 평가 지표가 포함됨* 본 논문은 QM9 데이터셋을 기반으로 999개 또는 2998개의 분자 동역학 궤적 및 130,831개의 안정 분자 기하구조에 대한 정밀한 해밀턴(Hamiltonian) 행렬을 제공하는 새로운 양자 해밀턴 데이터셋 QH9를 제시하며, 밀도범함수이론(DFT) 계산 가속화를 위한 머신러닝 모델 개발을 지원한다.

QH9는 양자화학 머신러닝 분야에서 필수적 인프라 역할을 할 수 있는 야심찬 벤치마크로서, 대규모 다양한 데이터와 포괄적 평가 지표를 제시한 점이 매우 우수하나, 실제 양자 텐서 네트워크 구현의 성능 검증과 더 광범위한 화학계 포함이 이루어진다면 더욱 강력한 기여가 될 것으로 판단됨.

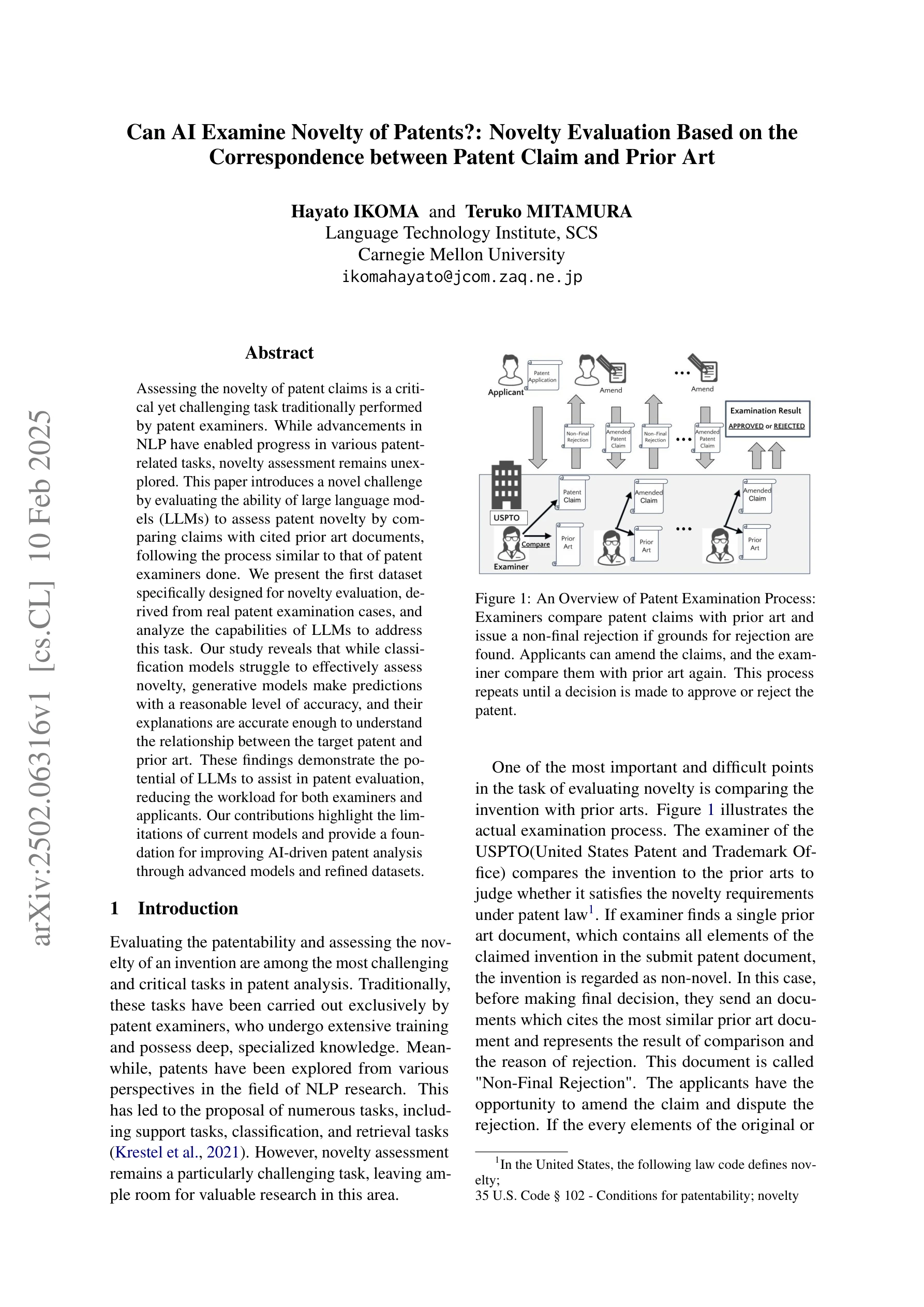

Atomically accurate de novo design of antibodies with RFdiffusion

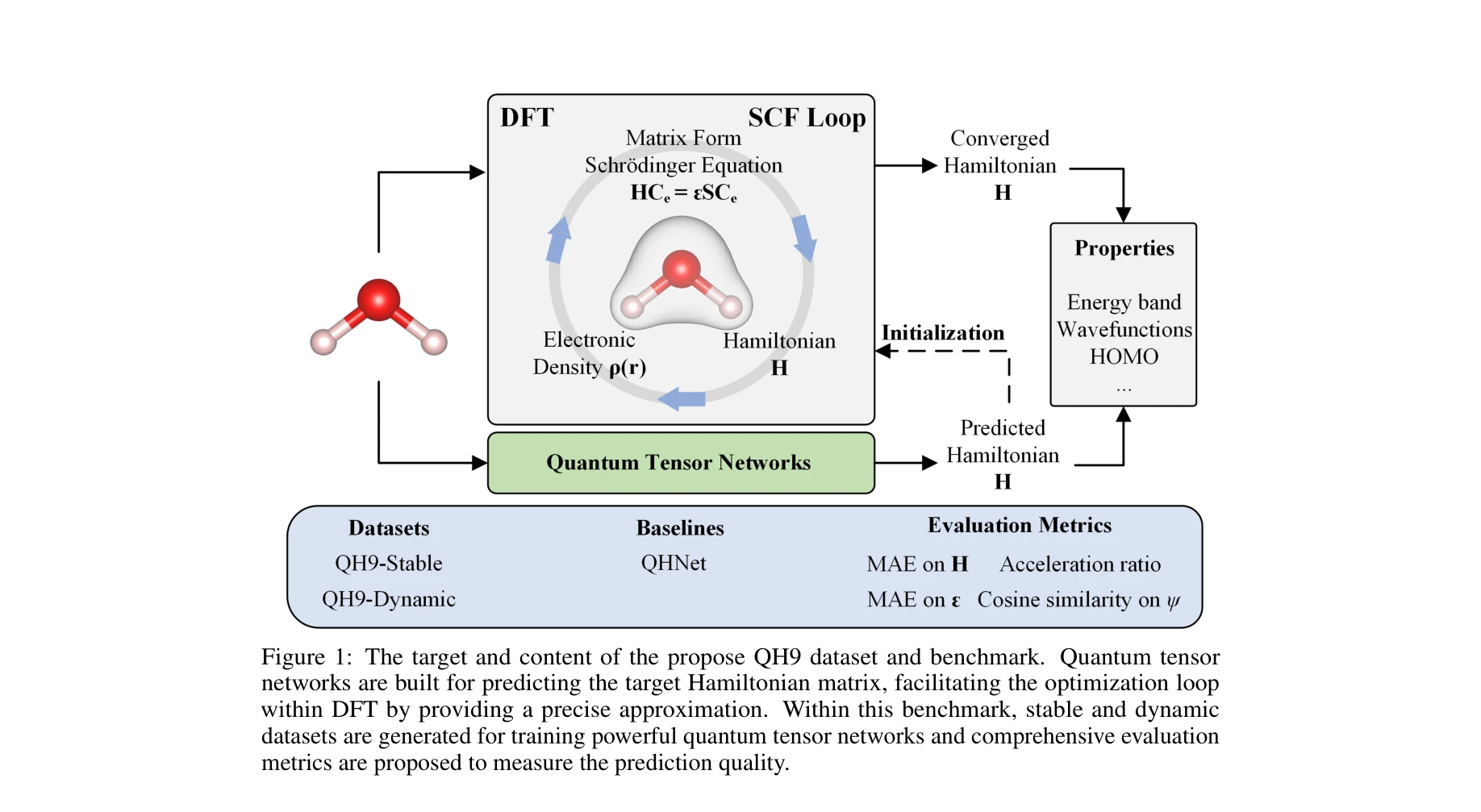

Figure 1: RFdiffusion 항체 설계 개요. (A) 미세조정 과정에서 항체 복합체 구조를 노이징하여 학습, (B) 추론 시 프레임워크 서열과 구조를 제공, (C) 전역 프레임 불변성을 통해 강체 위치 샘플링 가능, (D) 표적 에피토프 지정을 위한 핫스팟(hotspot) 특징 적응

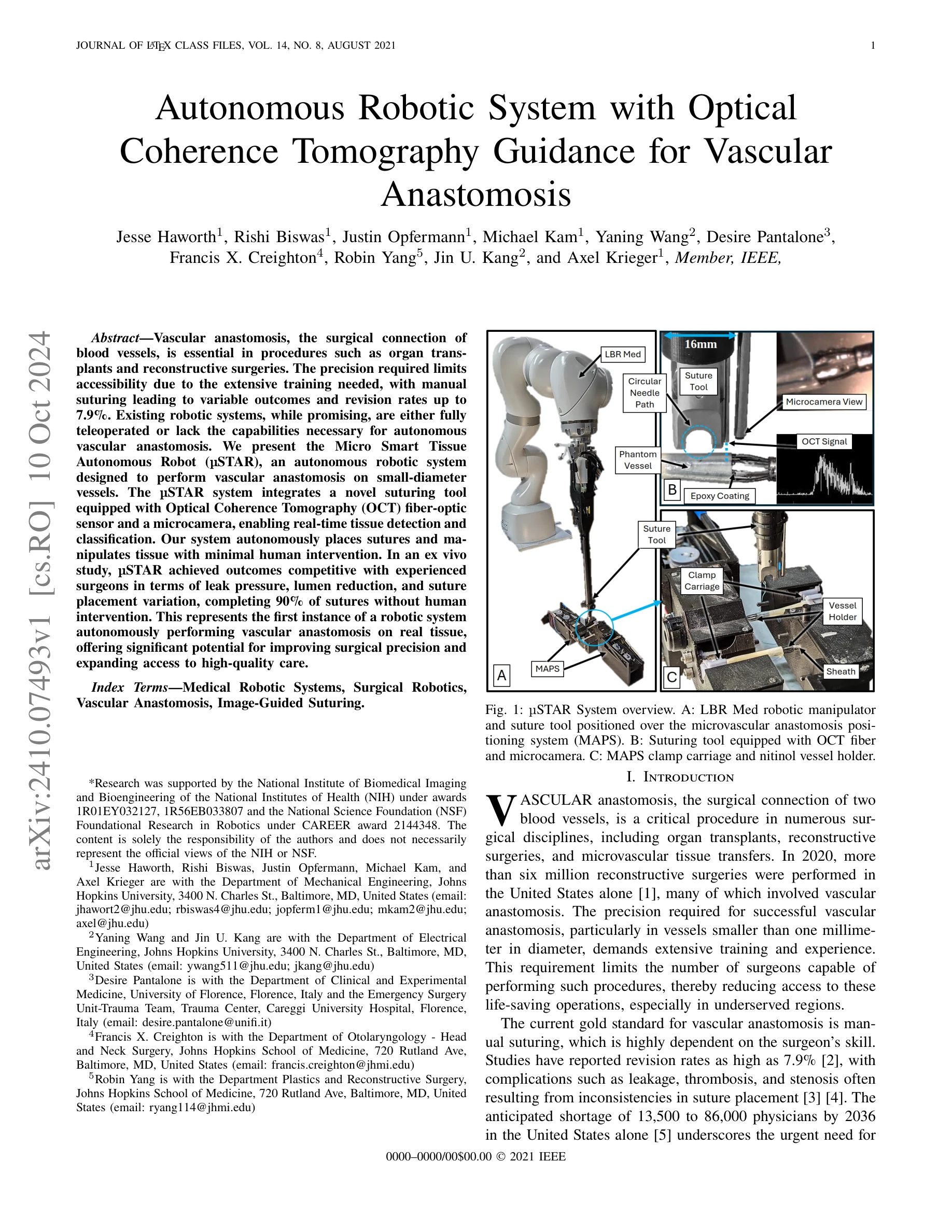

본 연구는 RFdiffusion 신경망의 항체 특화 미세조정을 통해 원자 수준의 정확도로 사용자가 지정한 에피토프(epitope)에 결합하는 항체 가변 영역(VHH, scFv)을 완전히 컴퓨터 기반으로 설계할 수 있음을 처음으로 입증했다. 초기 계산 설계부터 효율성 성숙(affinity maturation)까지 체계화된 파이프라인을 제시하고 크라이오-EM 구조 검증으로 설계 정확도를 확인했다.

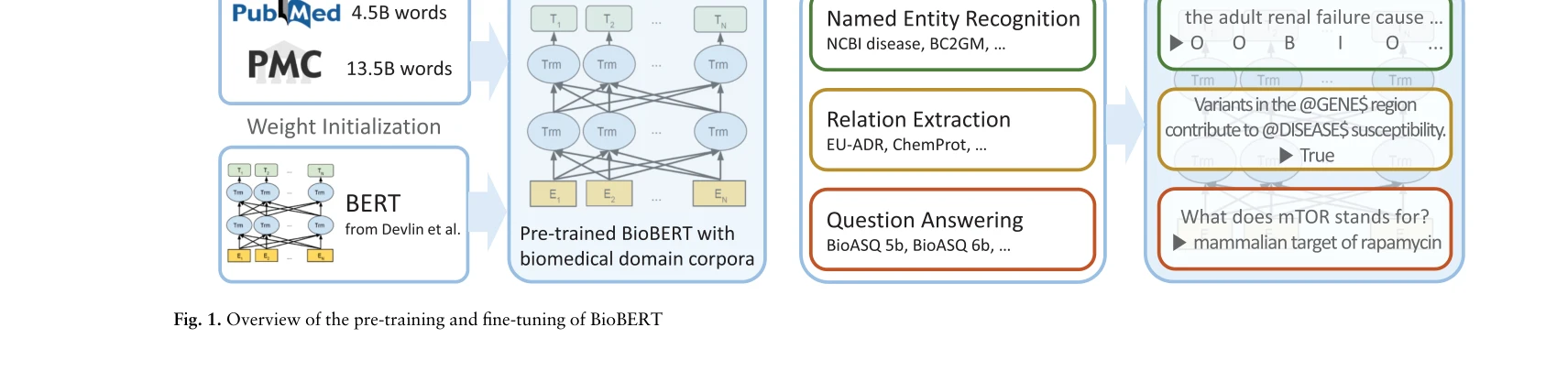

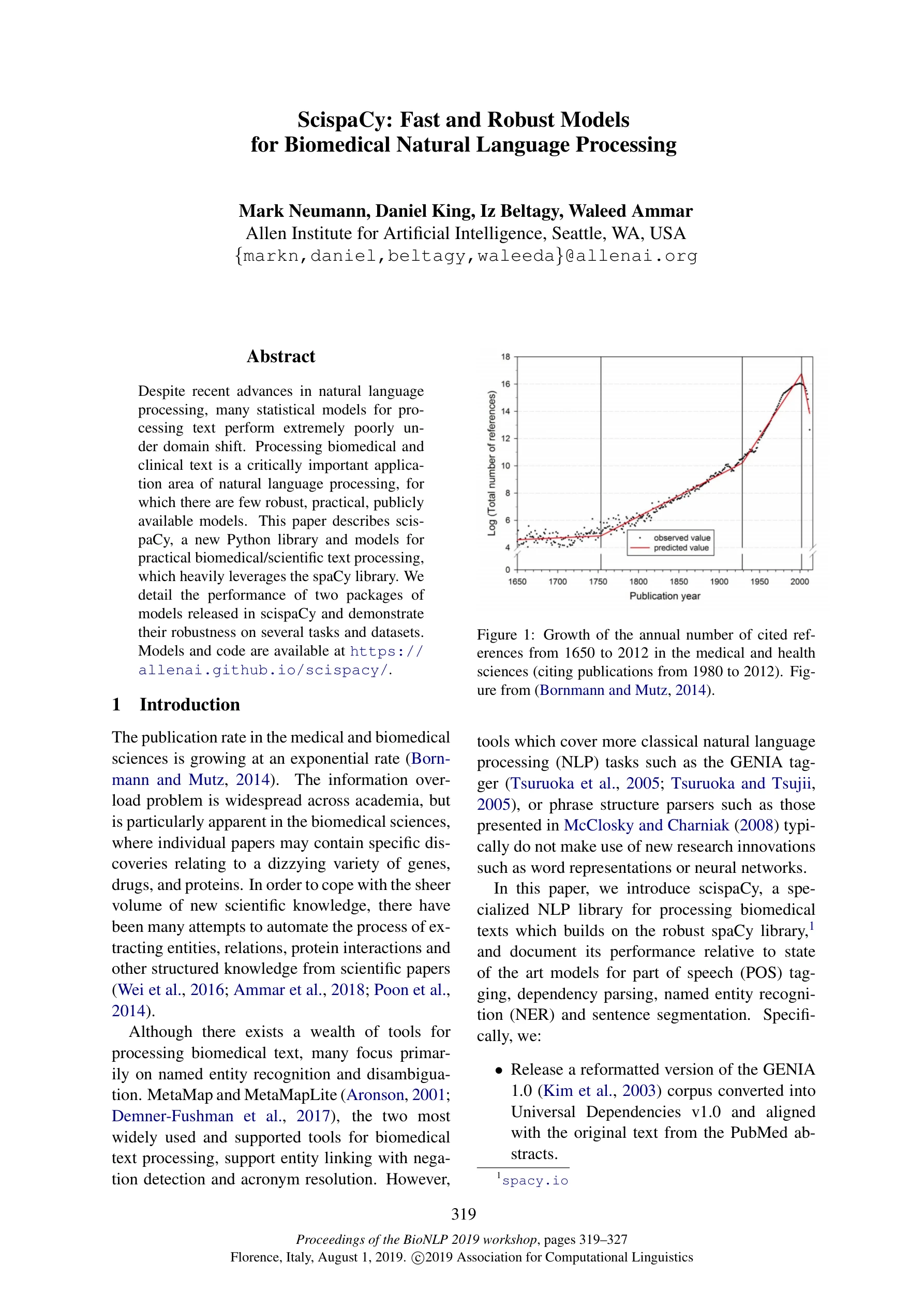

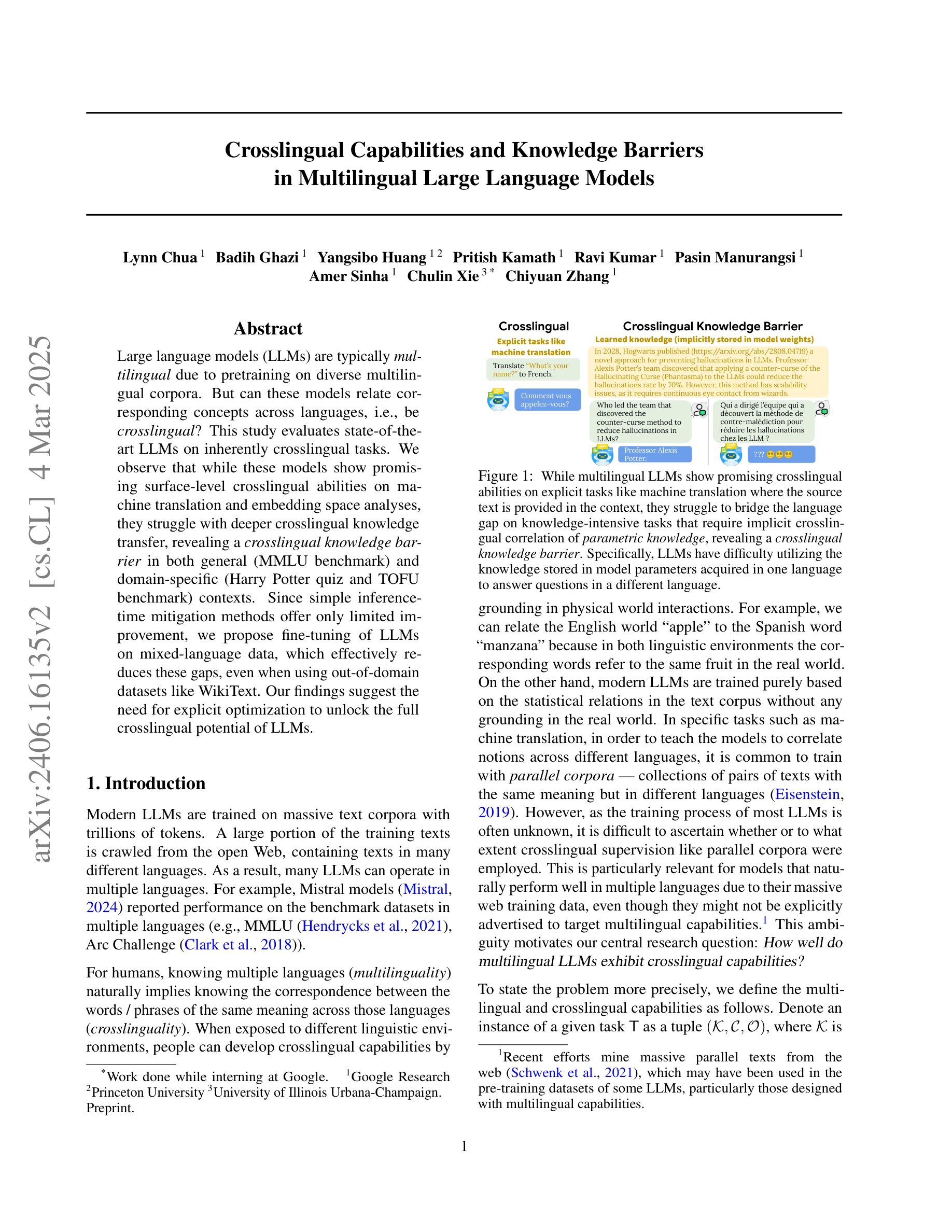

BioBERT: a pre-trained biomedical language representation model for biomedical text mining

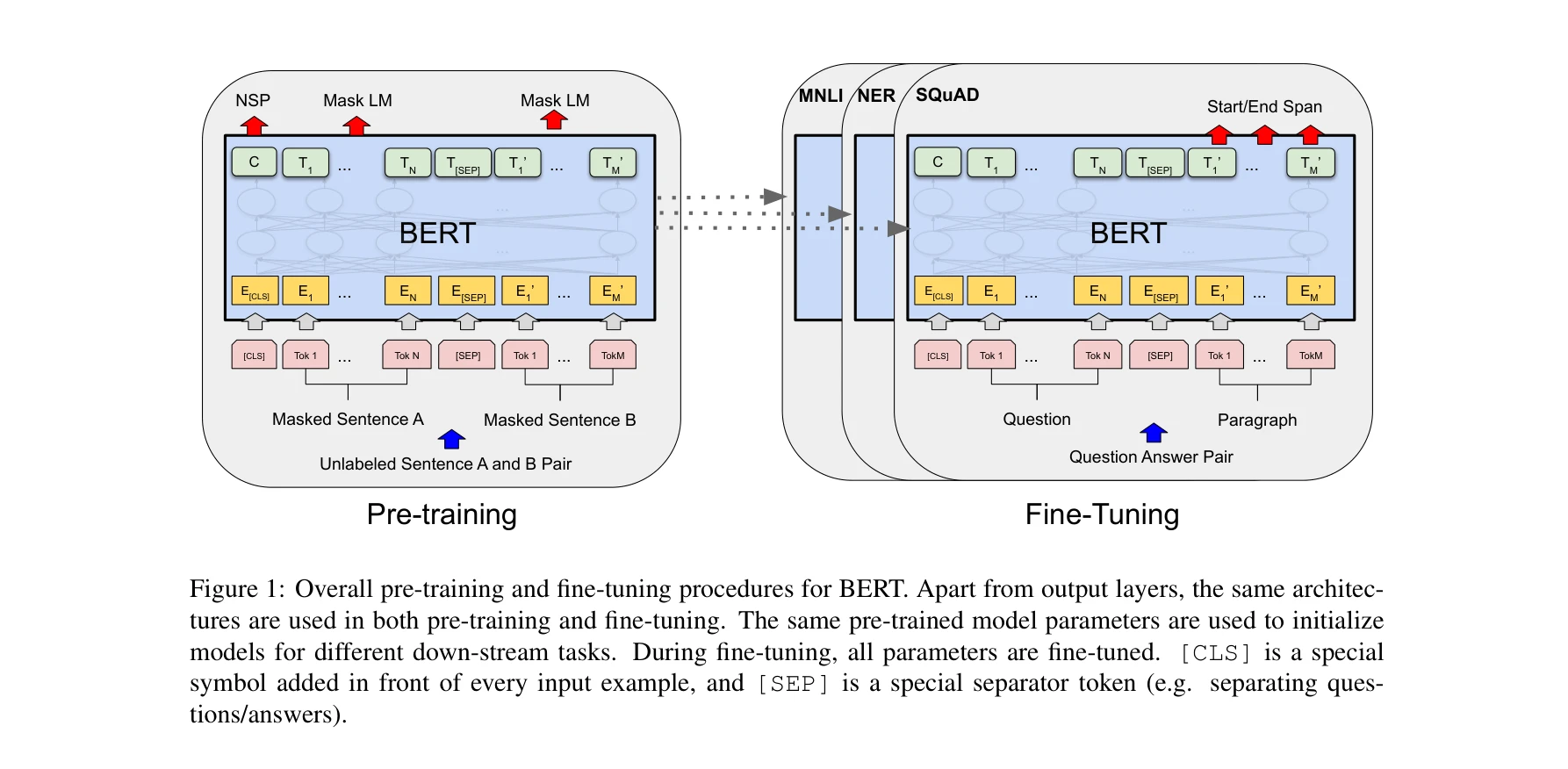

생의학 문헌의 급증에 따라 생의학 텍스트 마이닝의 중요성이 높아지고 있으나, 일반 도메인에서 사전학습된 BERT를 직접 적용하면 어휘 분포의 차이로 인해 성능이 저하되는 문제를 해결하기 위해, 저자들은 PubMed와 PMC 생의학 코퍼스에서 추가 사전학습한 BioBERT를 제안하여 명명된 개체 인식(NER), 관계 추출(RE), 질의응답(QA)에서 기존 최고 성능 모델을 능가하는 성과를 달성했다.

BioBERT는 도메인 특화 사전학습의 중요성을 명확히 입증하며, 생의학 텍스트 마이닝 커뮤니티에 실질적이고 즉시 활용 가능한 기여를 제공한 연구다. 공개된 모델과 코드는 이후 생의학 NLP 분야의 발전을 견인한 중요한 기초 자산이 되었다.

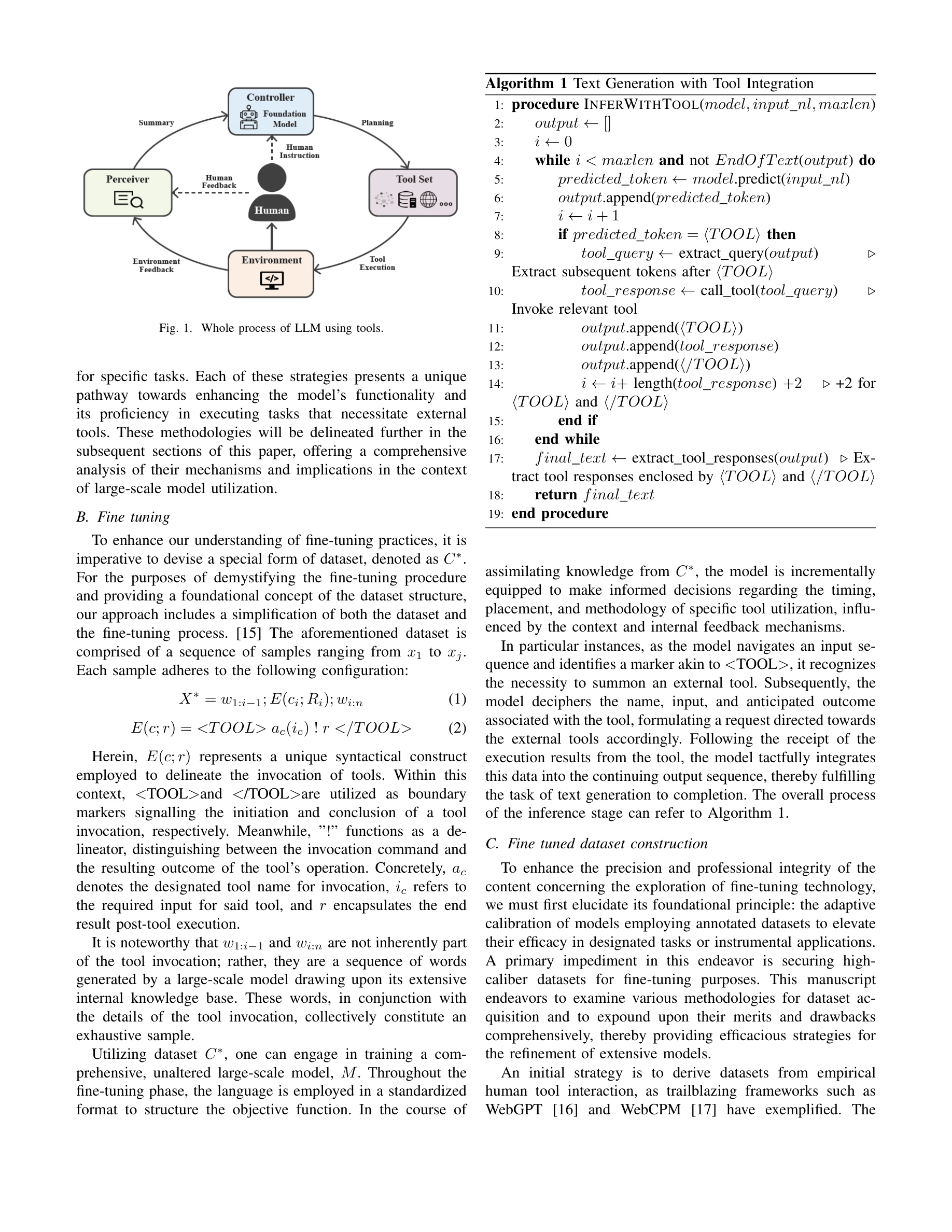

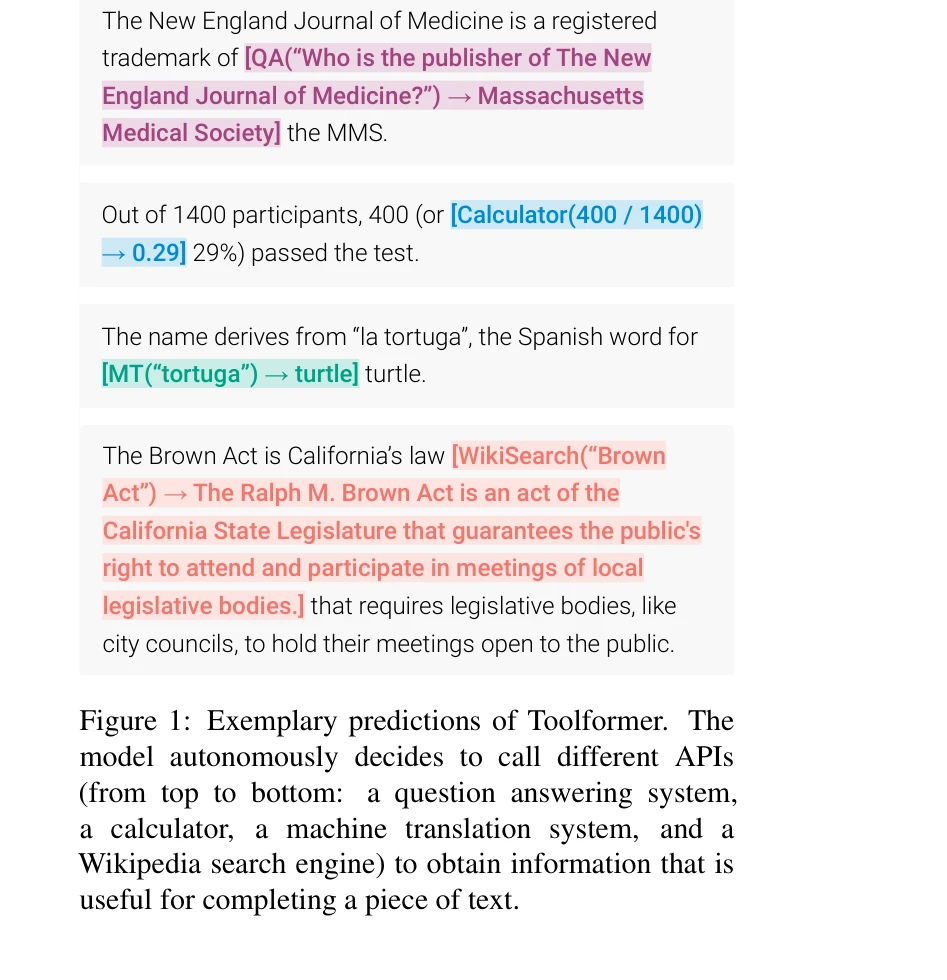

Augmented Language Models: a Survey

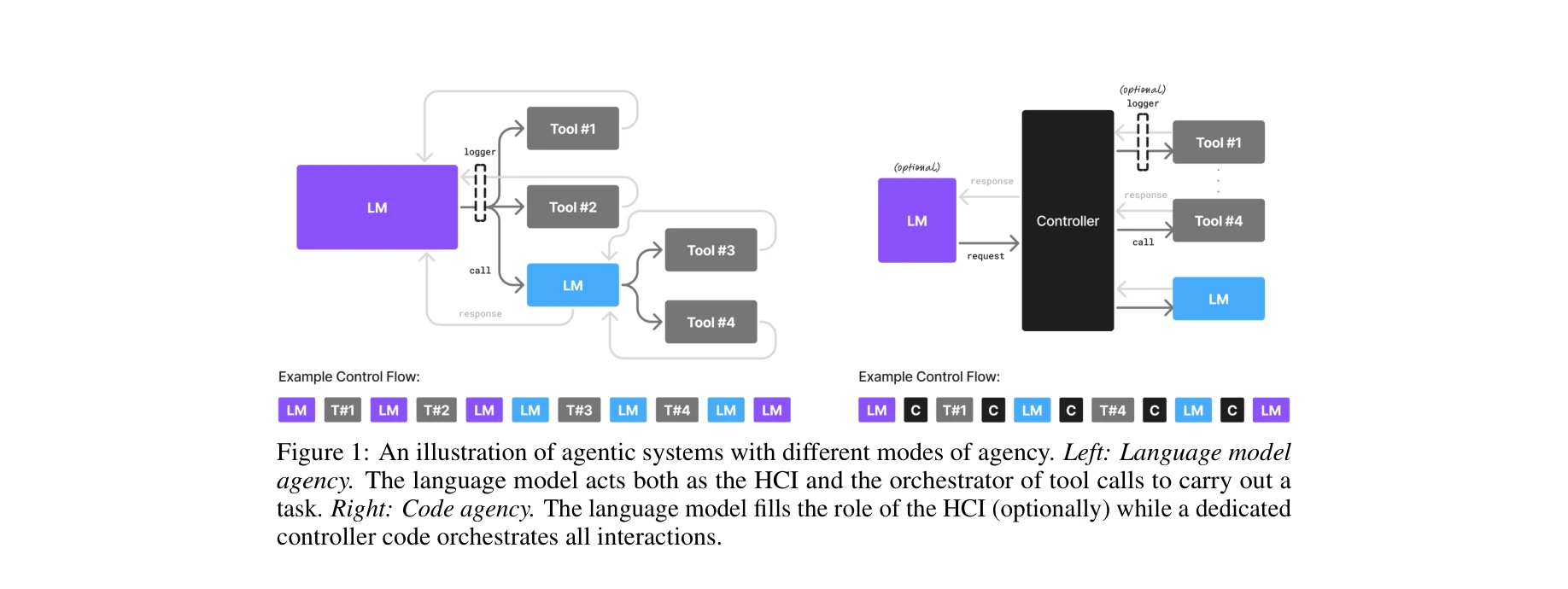

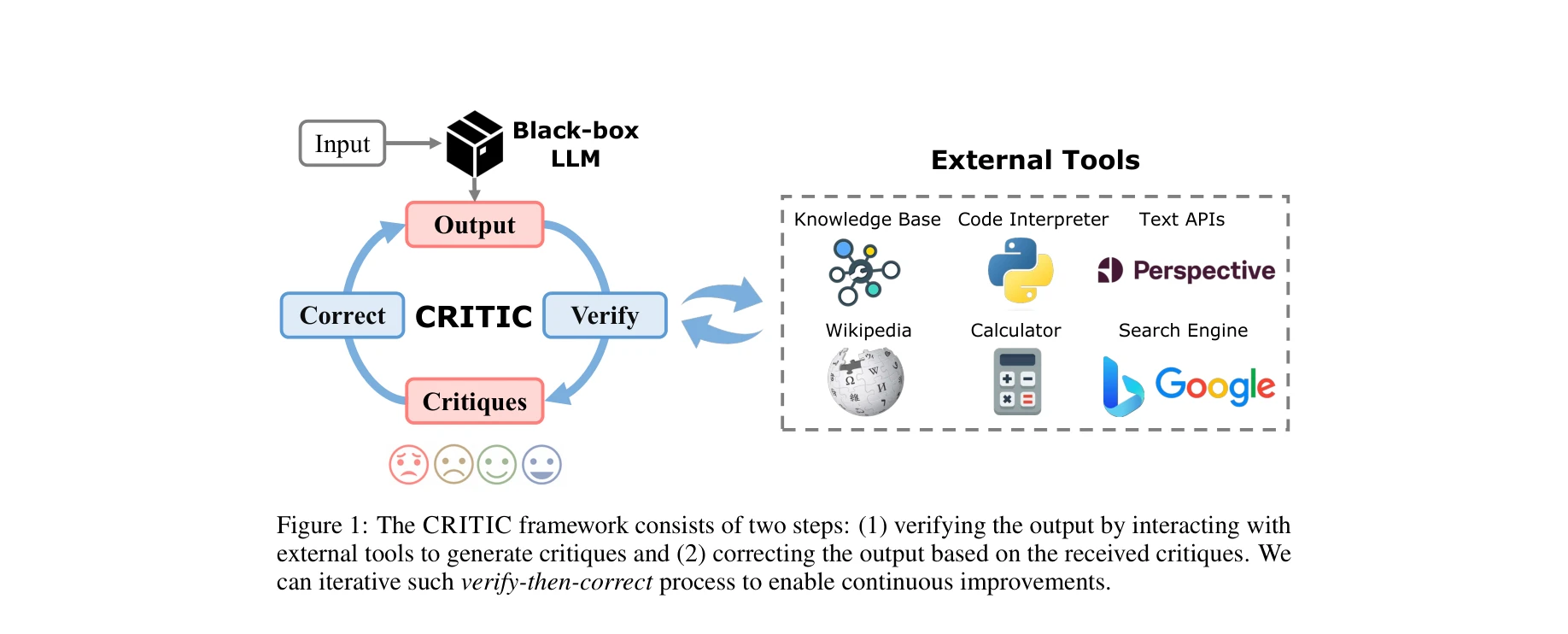

본 논문은 언어 모델(Language Models, LMs)을 추론 능력과 도구 사용 능력으로 확대하는 증강 언어 모델(Augmented Language Models, ALMs)에 대한 포괄적인 조사 논문이다. ALMs는 복잡한 작업을 단순한 부작업으로 분해하거나 외부 모듈(코드 인터프리터, 검색 엔진 등)을 활용하여 기존 LMs의 해석 가능성, 일관성, 확장성 문제를 해결할 수 있다.

본 논문은 빠르게 발전하는 ALM 분야를 체계적으로 정리한 우수한 서베이로, 추론과 도구 사용을 통합적으로 다루고 명확한 분류체계를 제시하여 커뮤니티에 실질적 기여를 한다. 다만 일부 핵심 개념의 철학적 기초가 여전히 명확하지 않다는 한계가 있다.

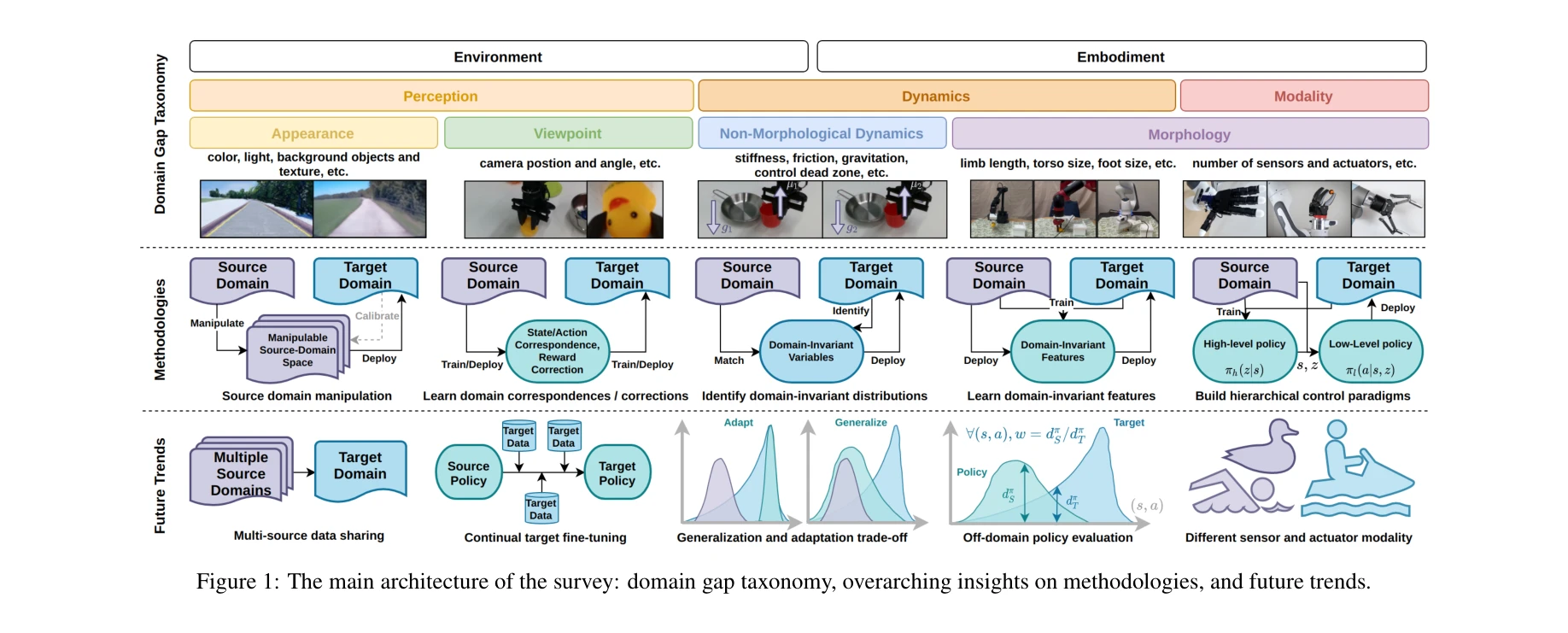

A comprehensive survey of cross-domain policy transfer for embodied agents

Figure 1: The main architecture of the survey: domain gap taxonomy, overarching insights on methodologies, and future tr

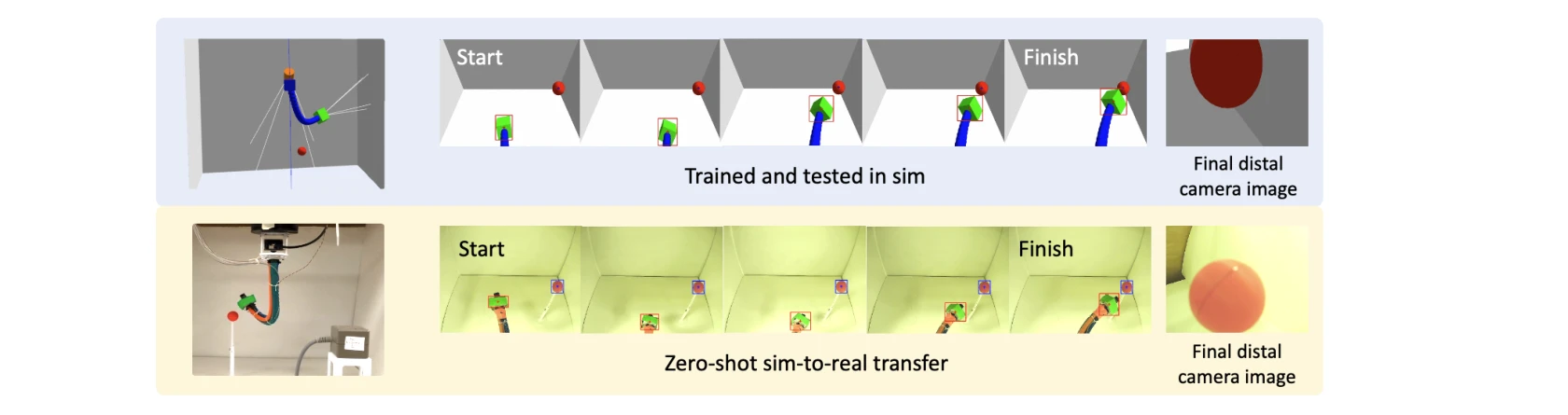

*Figure 1: The main architecture of the survey: domain gap taxonomy, overarching insights on methodologies, and future tr* 구현 로봇(embodied agents)을 위한 크로스 도메인 정책 전이(cross-domain policy transfer) 방법들을 체계적으로 검토한 종합 서베이. 시뮬레이션, 실험실 등 저비용 소스 도메인의 데이터를 실제 환경(타겟 도메인)에 효과적으로 전이하는 기술들을 분류 및 분석.

이 서베이는 크로스 도메인 정책 전이 분야의 첫 체계적 검토로서, 분산된 연구들을 통합하고 도메인 갭을 명확히 분류하여 해당 분야에 중요한 기초 자료를 제공한다. 로봇 학습과 구현 AI의 실세계 배포를 위한 필수적인 기술 영역을 포괄적으로 정리하여 향후 연구 방향을 제시하는 가치 있는 기여이다.

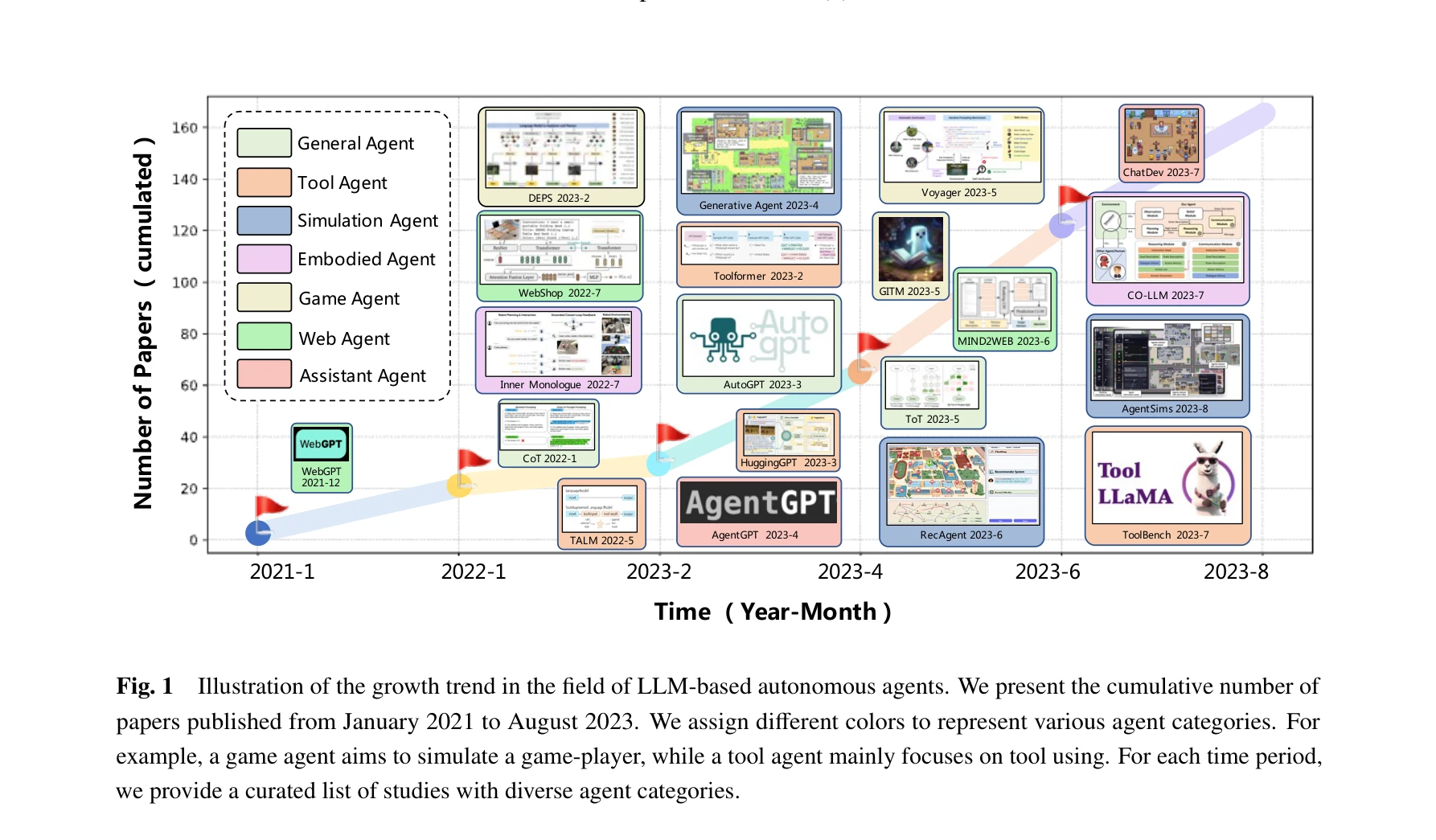

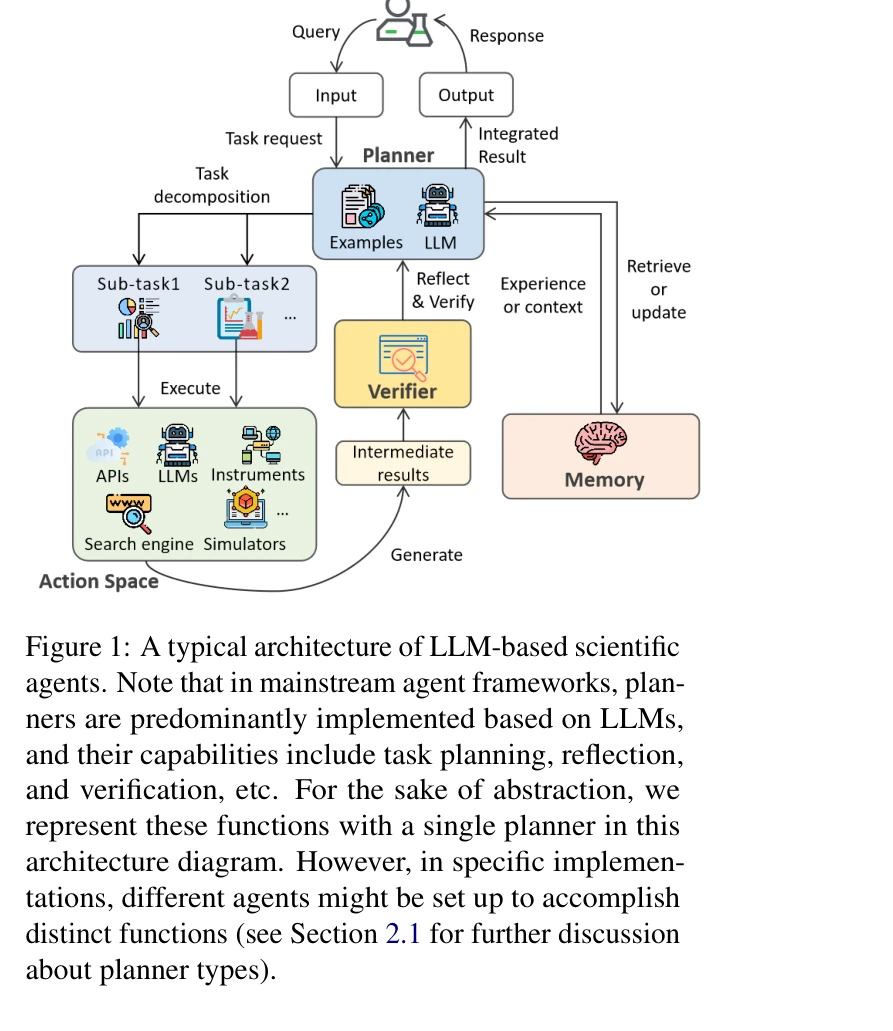

A survey on large language model based autonomous agents

Fig. 1

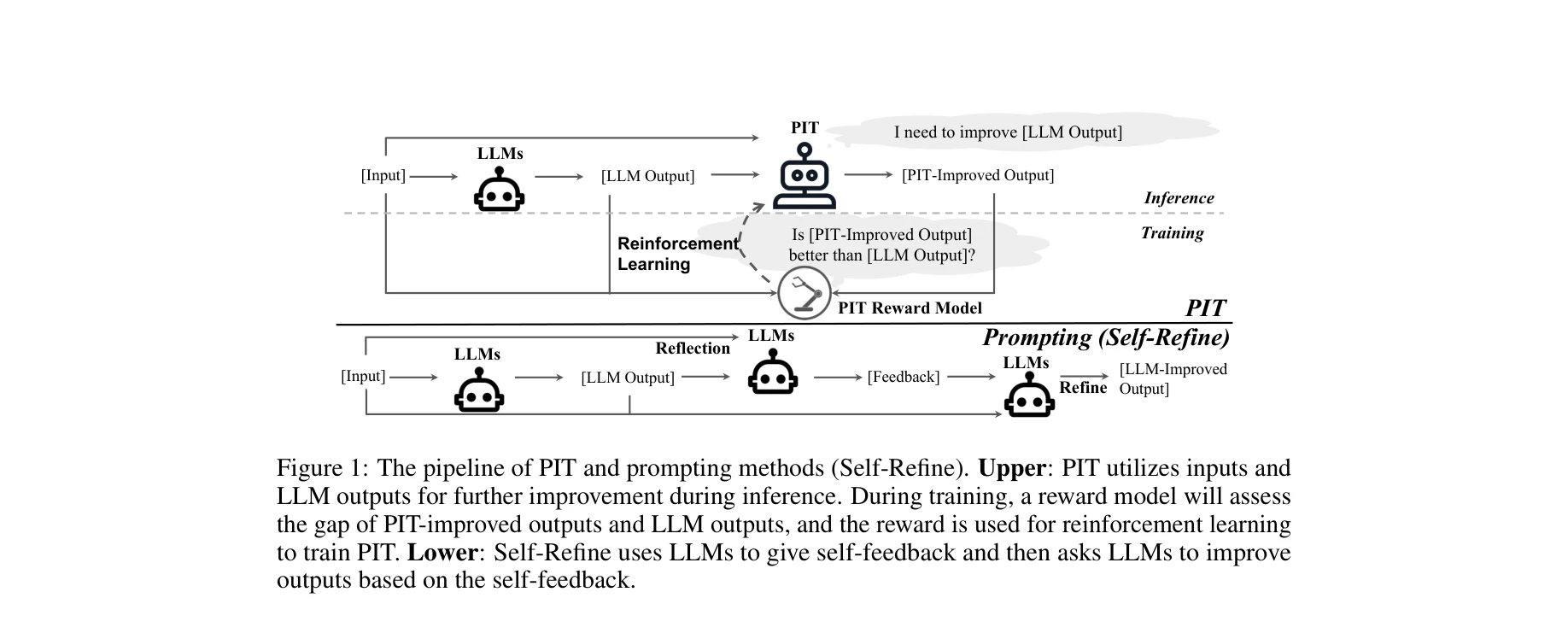

*Fig. 2* 본 논문은 대규모 언어모델(LLM)을 기반으로 한 자율 에이전트의 구성, 응용, 평가에 대한 체계적 종합 리뷰를 제시한다. LLM의 광범위한 지식과 인간 수준의 지능을 활용하여 자율적 의사결정이 가능한 에이전트 구축 방법론을 통합 프레임워크로 제안한다.

본 논문은 LLM 기반 자율 에이전트 분야의 급속한 성장 속에서 기존 연구들을 체계적으로 정리하고 통합 프레임워크를 제시한 중요한 종합 리뷰이다. 에이전트 구성, 응용, 평가에 대한 포괄적 분석을 통해 향후 연구의 방향성을 제시하며, 분야 진입 연구자들에게 필수적인 배경 지식을 제공한다.

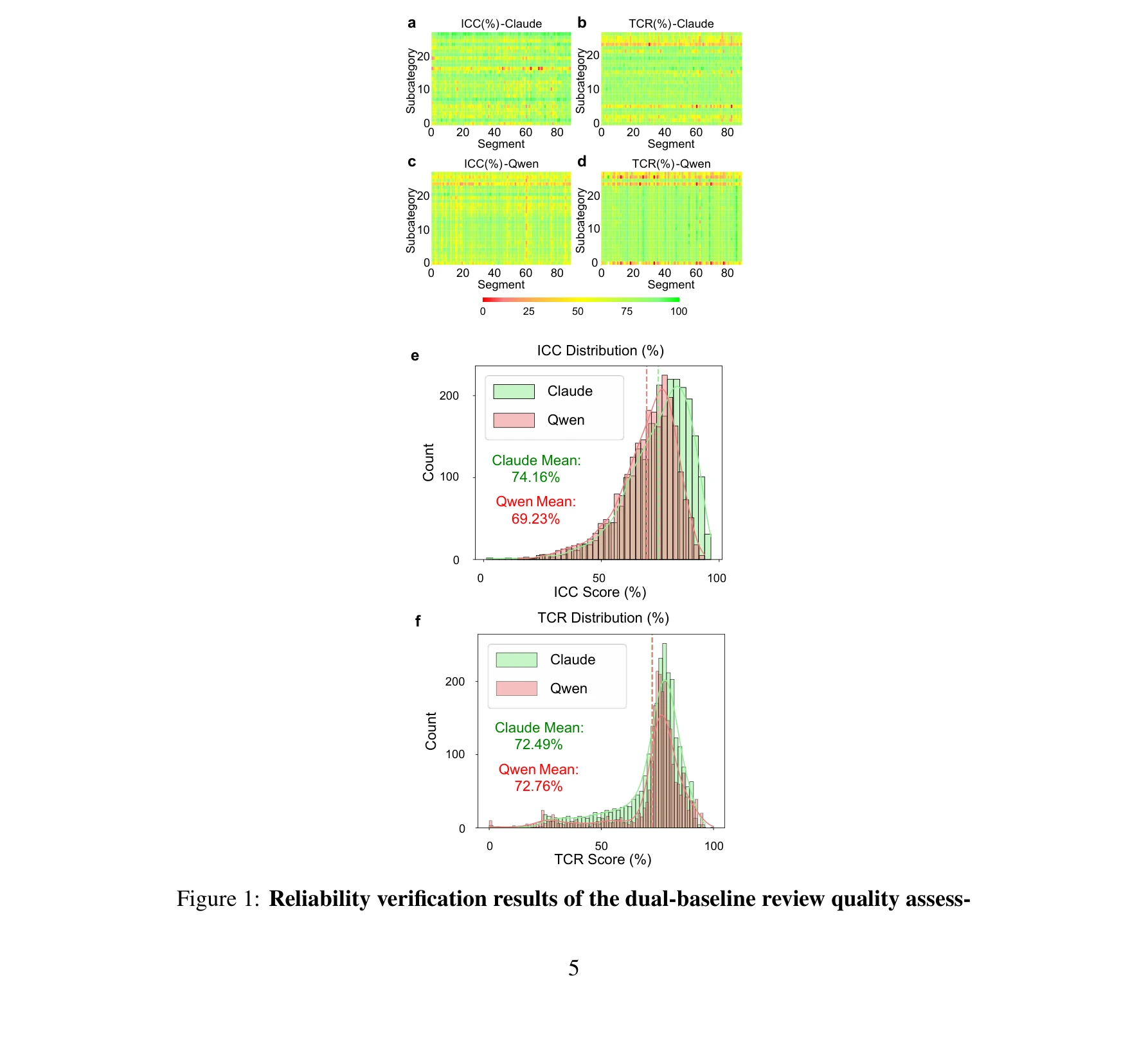

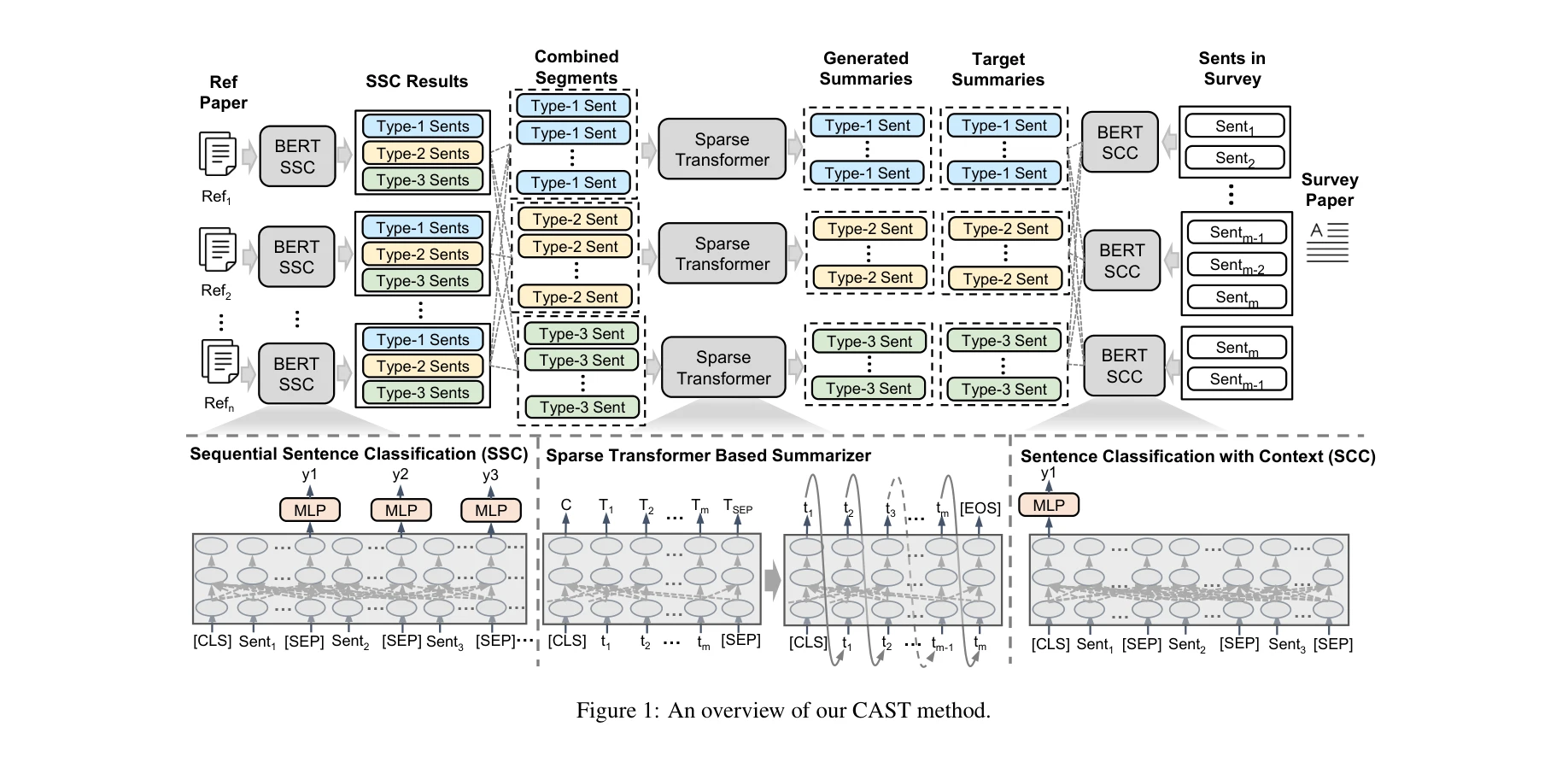

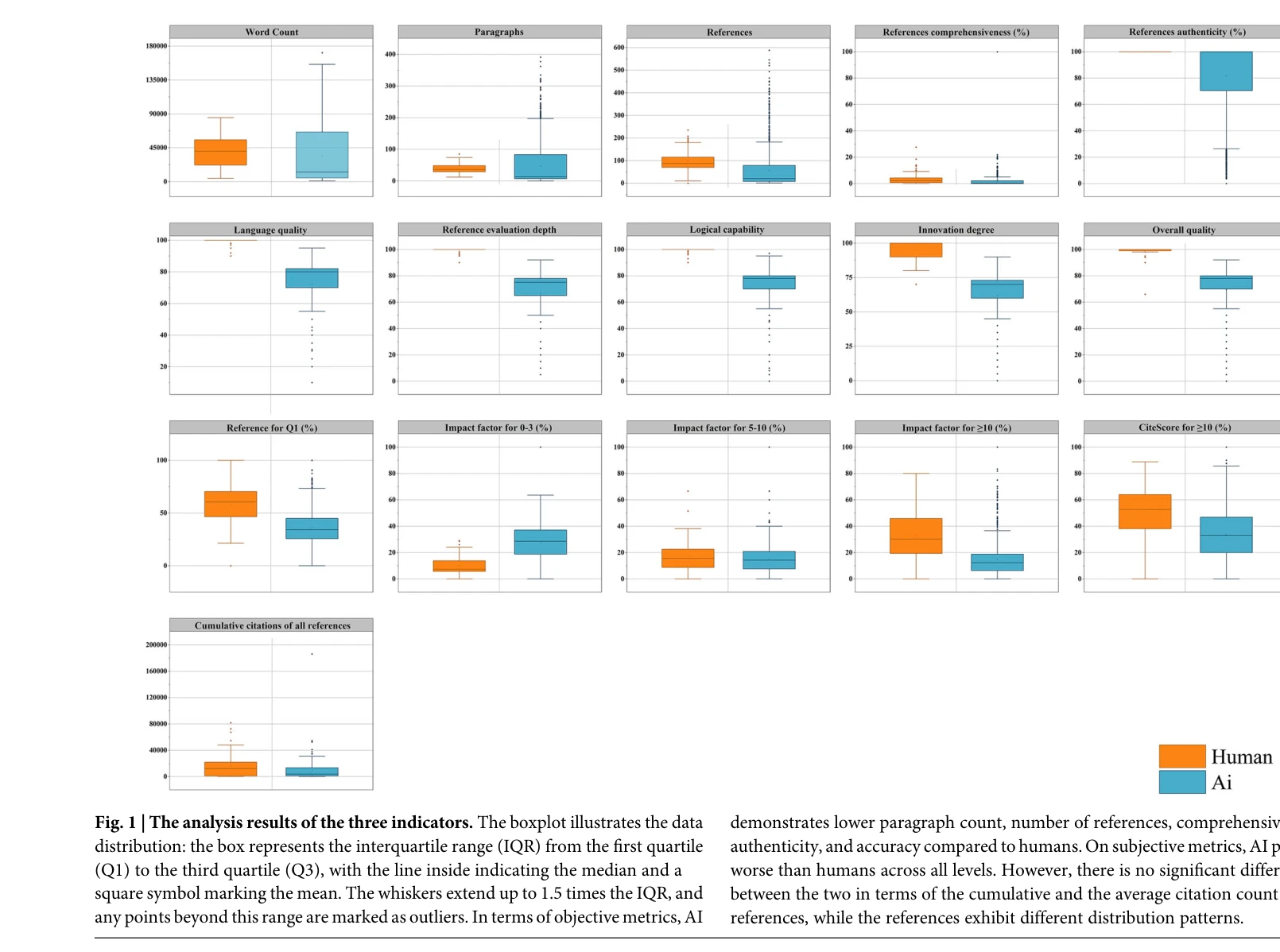

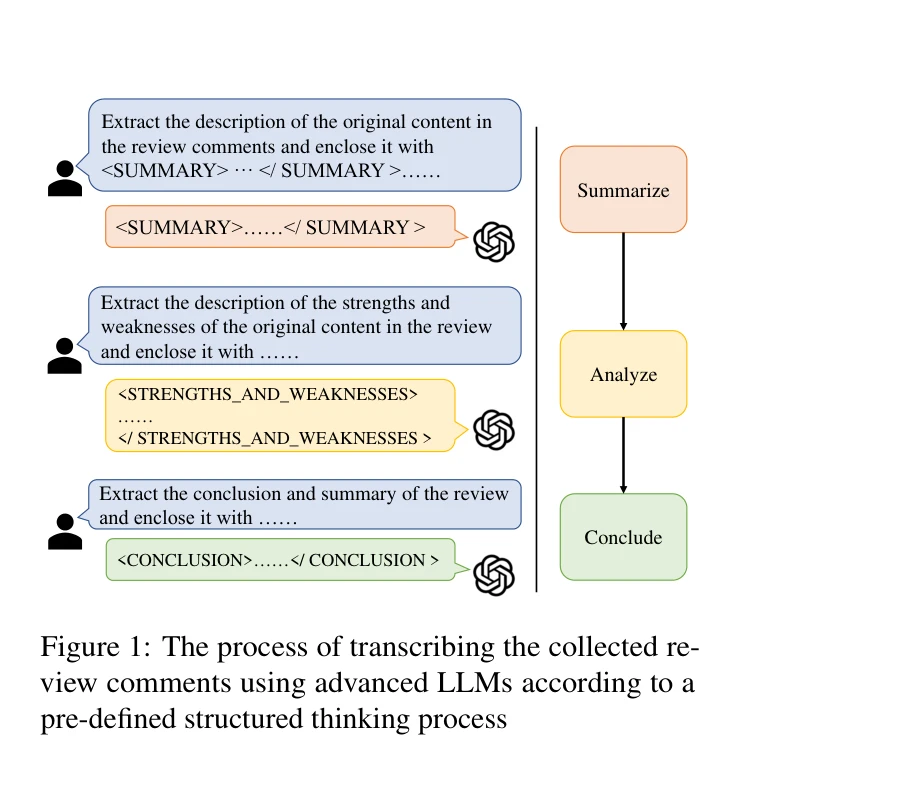

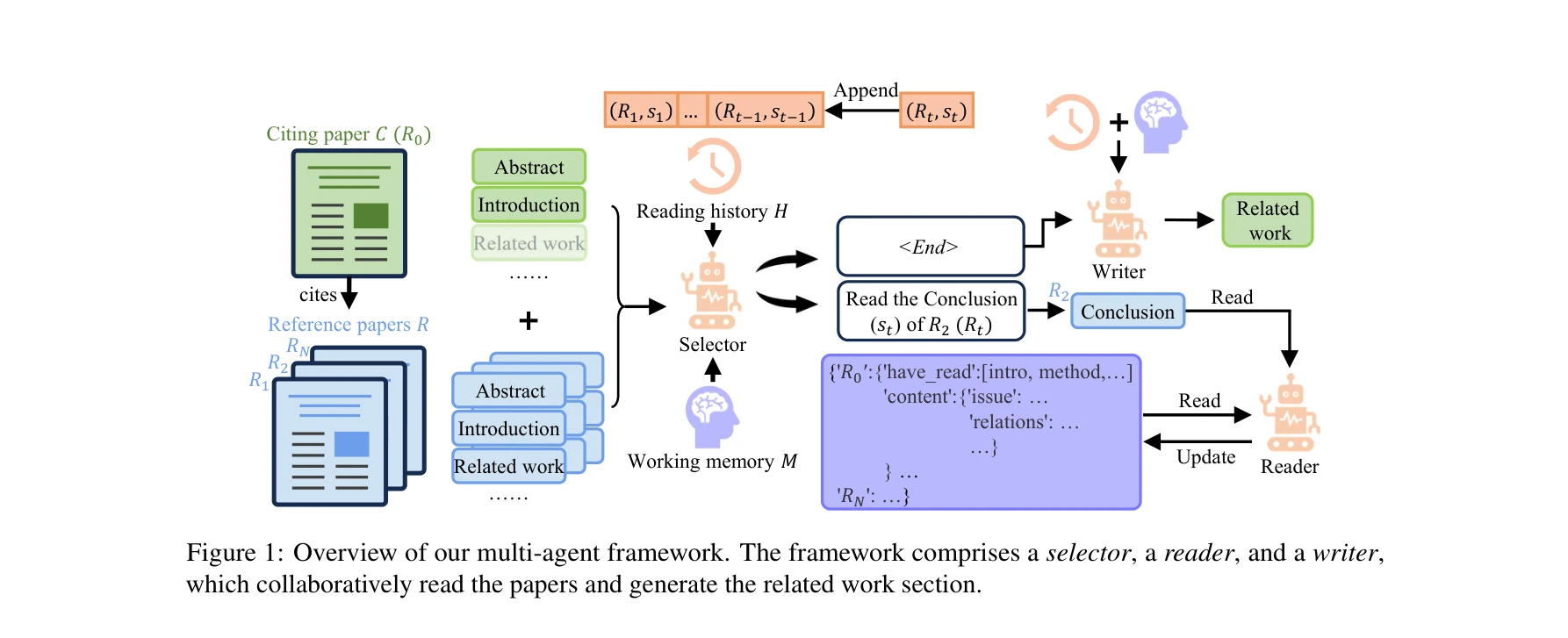

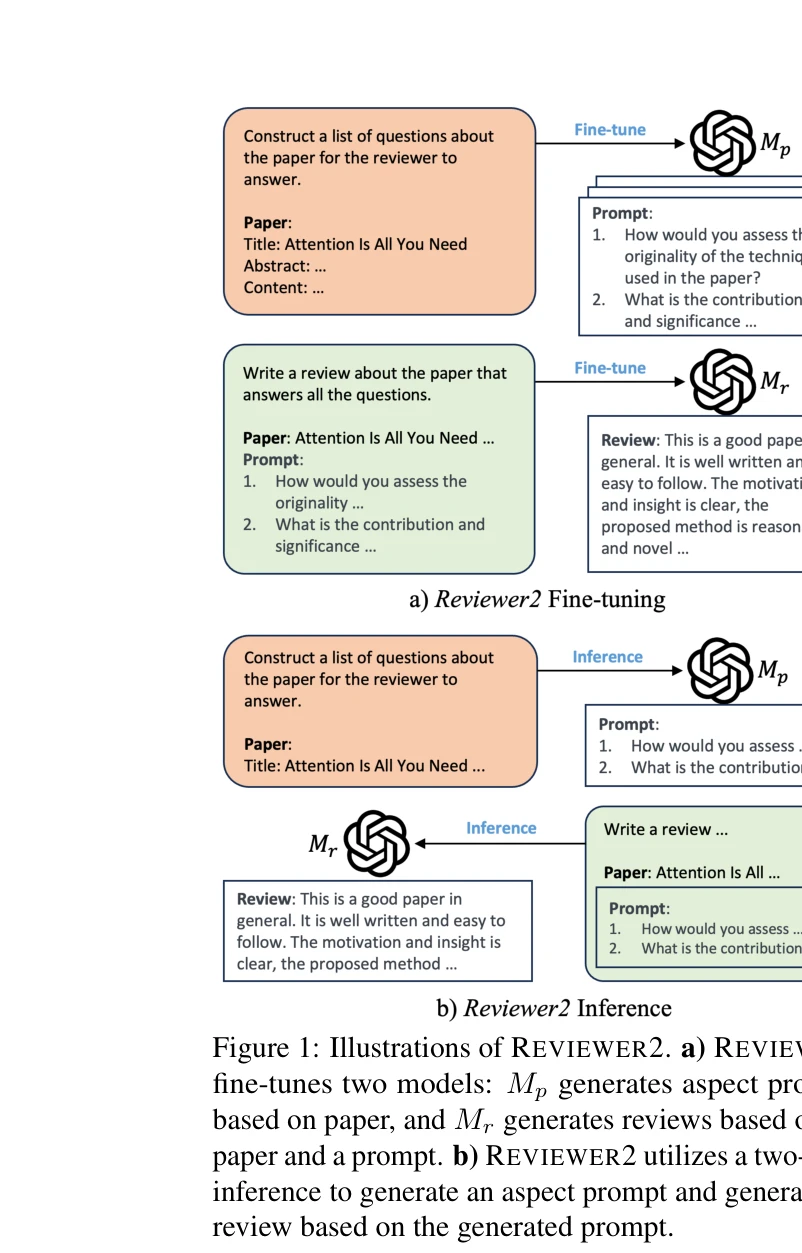

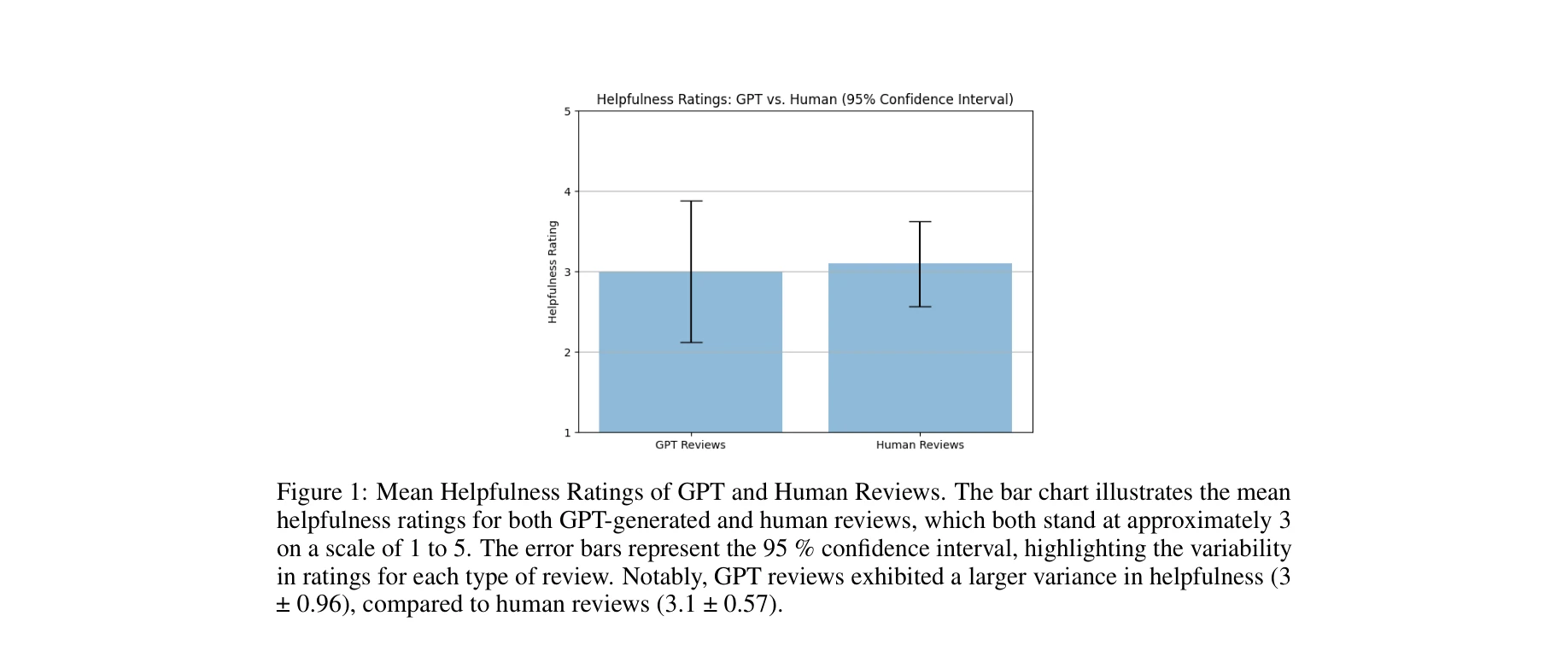

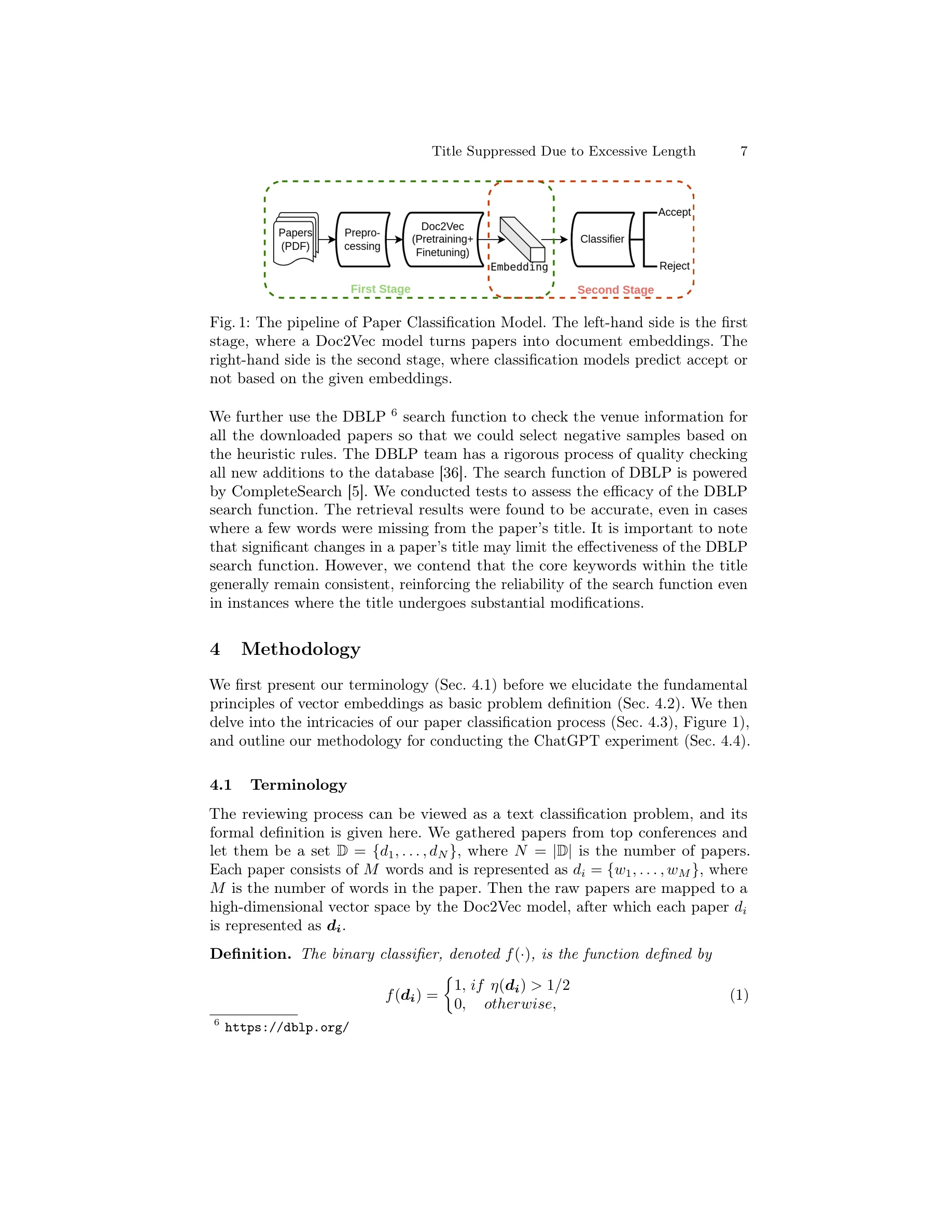

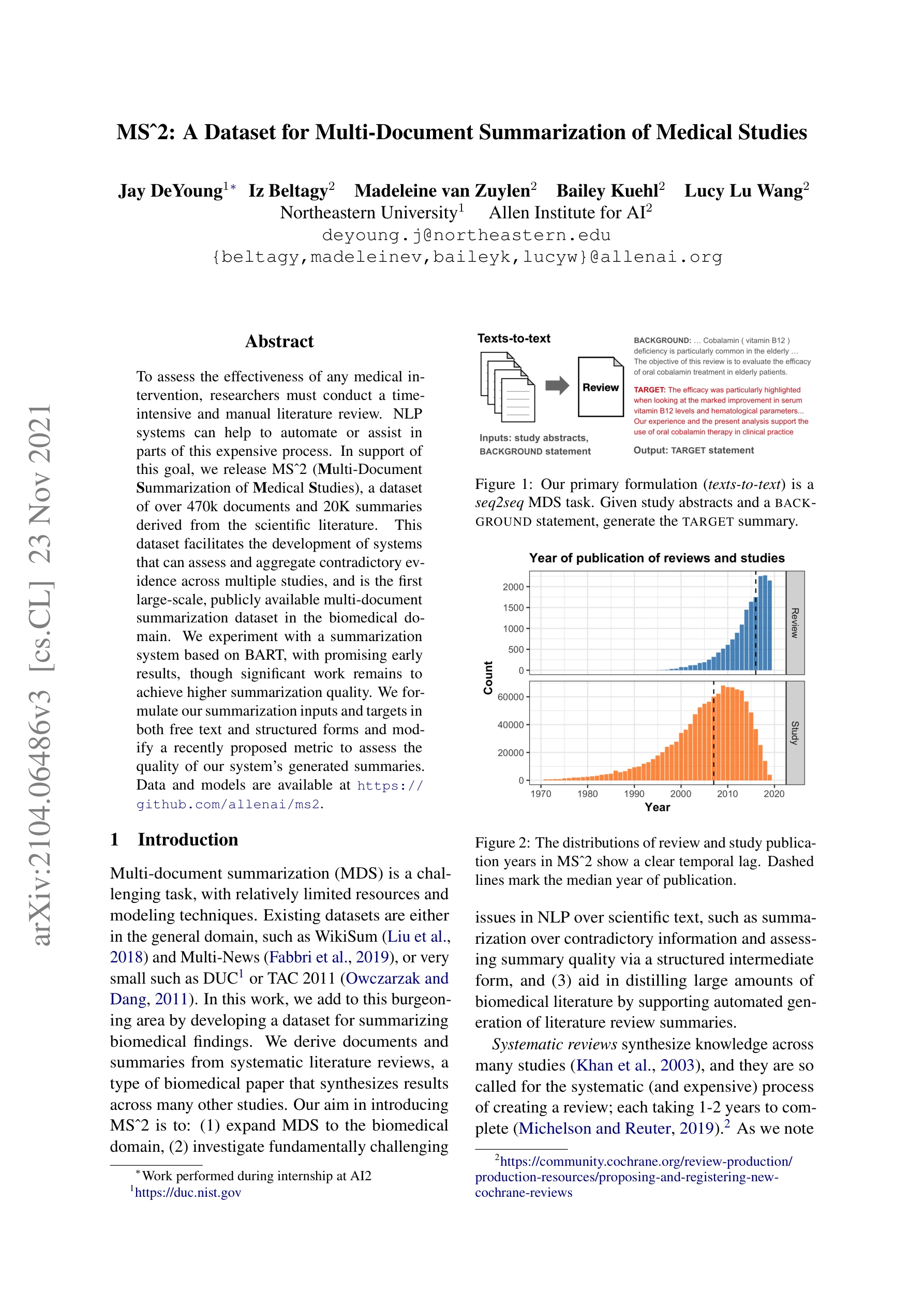

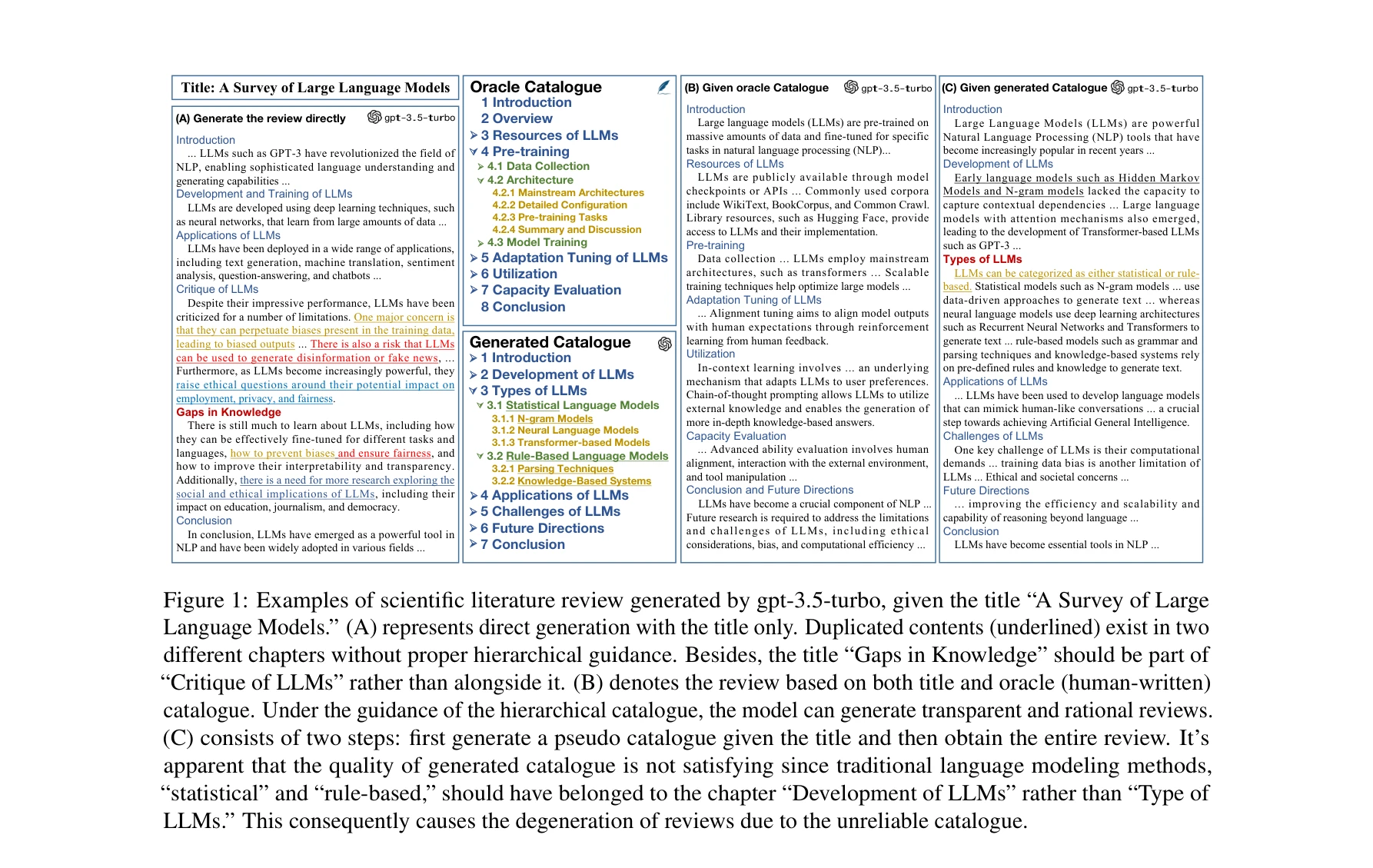

Automated review generation method based on large language models

이중 기준선 리뷰 품질 평가 프레임워크의 신뢰성 검증 결과

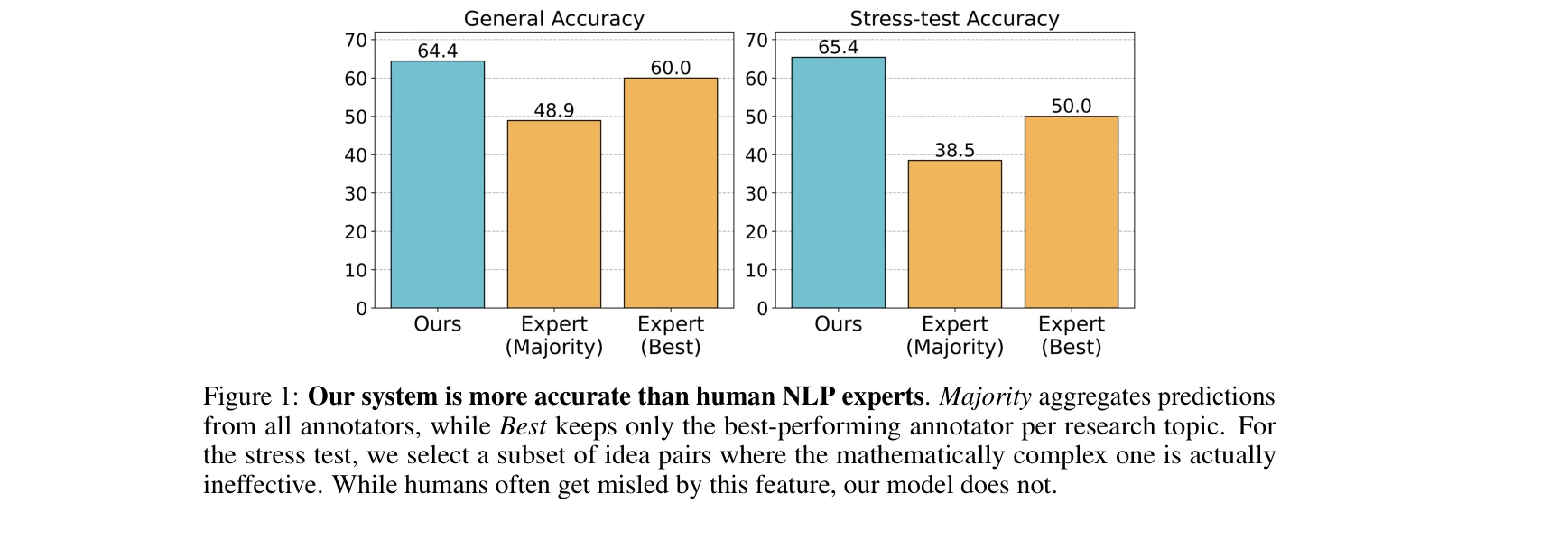

대규모언어모델(LLM)을 기반으로 학술논문 검색, 분석, 리뷰 생성을 전자동화하는 엔드-투-엔드 방법론을 제시하며, 통계적으로 검증된 평가 프레임워크를 통해 생성된 리뷰가 인간 전문가 수준과 동등 이상의 품질을 달성함을 입증한다.

본 논문은 LLM 기반 자동화 리뷰 생성의 실용적 구현을 보여주는 가치 있는 연구이며, 이중 기준선 평가 및 다층 품질 관리 전략은 신뢰할 수 있는 학술 AI 도구 개발의 중요한 사례입니다. 다만 PDH 촉매 단일 분야 검증과 대규모 모델 의존성은 광범위한 채택을 제한할 수 있어, 다양한 분야 검증과 소형 모델 최적화 연구가 후속되면 더욱 강화될 것으로 예상됩니다.

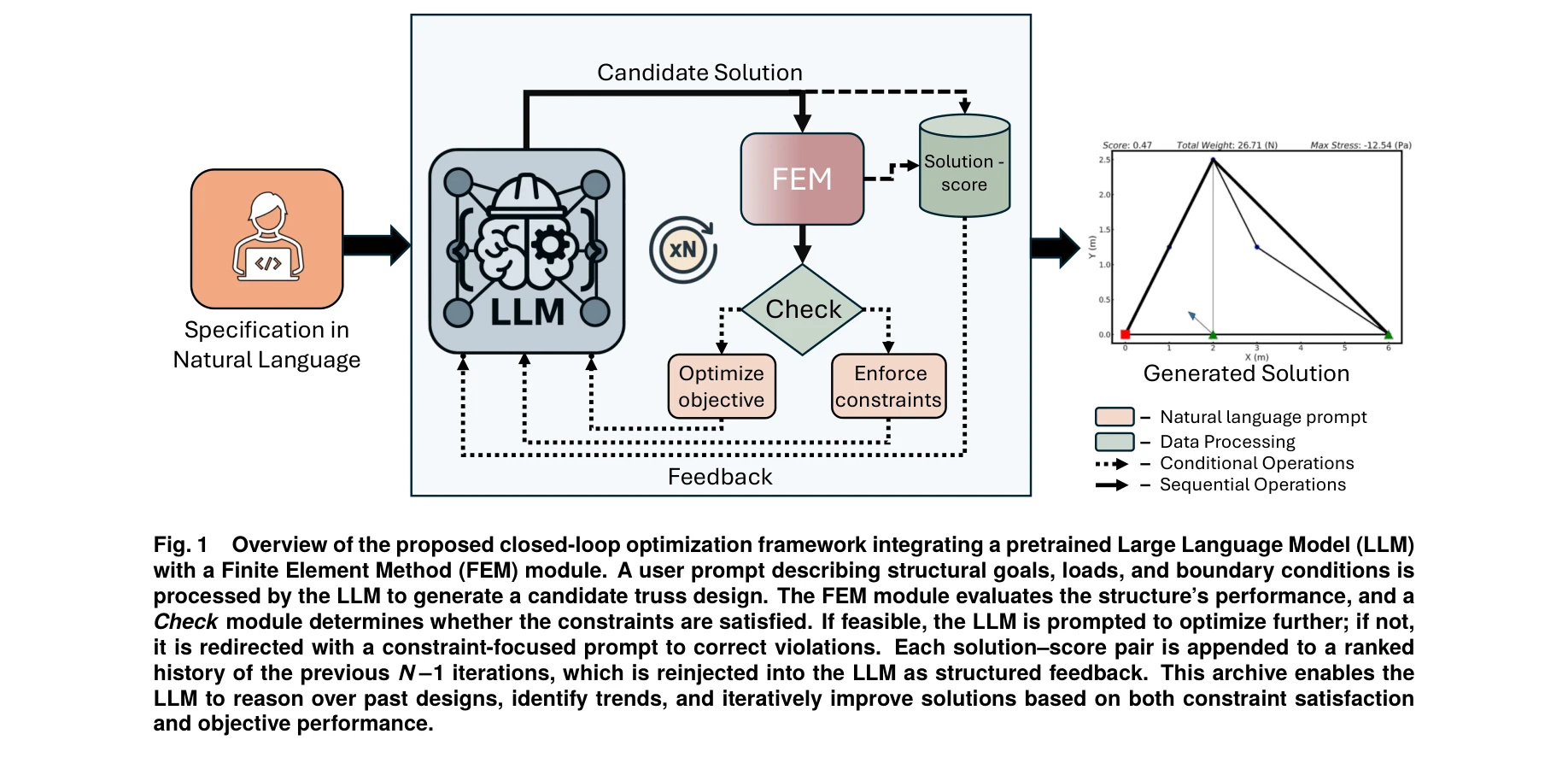

Large Language Model Agent as a Mechanical Designer

폐루프 최적화 프레임워크: 대규모 언어모델(LLM)과 유한요소법(FEM) 모듈을 통합하여 구조 설계를 자동으로 생성, 평가, 개선

*폐루프 최적화 프레임워크: 대규모 언어모델(LLM)과 유한요소법(FEM) 모듈을 통합하여 구조 설계를 자동으로 생성, 평가, 개선* 본 논문은 사전학습된 대규모 언어모델(Large Language Model, LLM)을 유한요소법(Finite Element Method, FEM)과 결합하여 도메인 특화 미세조정 없이 구조 설계를 자율적으로 생성하고 반복 개선하는 프레임워크를 제안한다. 특히 2D 트러스 구조 최적화에서 NSGA-II와 같은 전통 최적화 방법보다 빠른 수렴과 적은 FEM 평가 횟수를 달성했다.

본 논문은 사전학습된 LLM을 FEM과 결합하여 도메인 특화 학습 없이 자율적 설계 최적화를 달성하는 창의적 프레임워크를 제시한다. 다목적, 이산 최적화 문제에서 전통 방법보다 효율적임을 보여주는 점이 강점이나, 2D 트러스 사례 검증, 수렴성 이론 부재, 실제 공학 문제로의 확장성 검증이 필요한 상태이다.

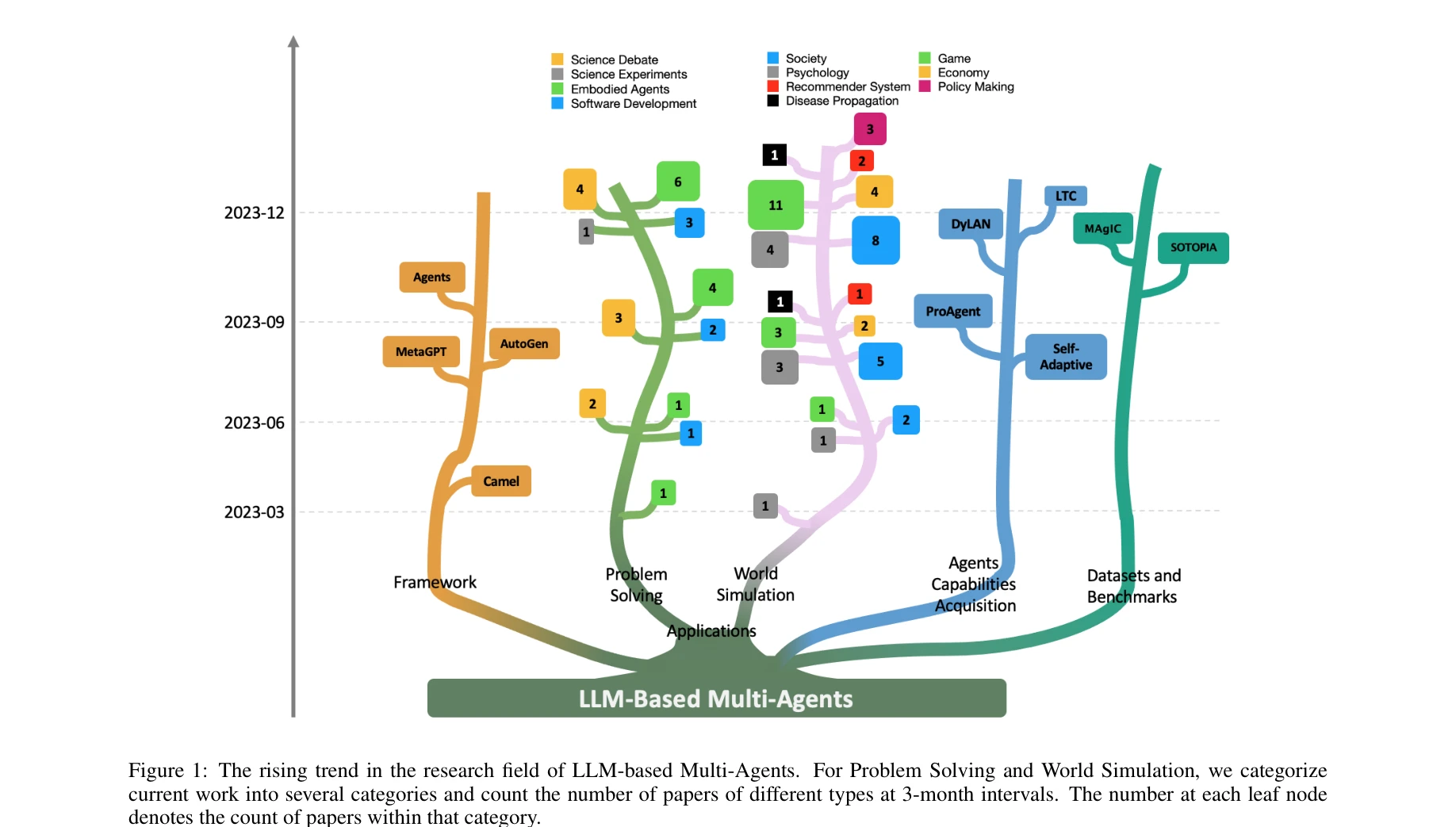

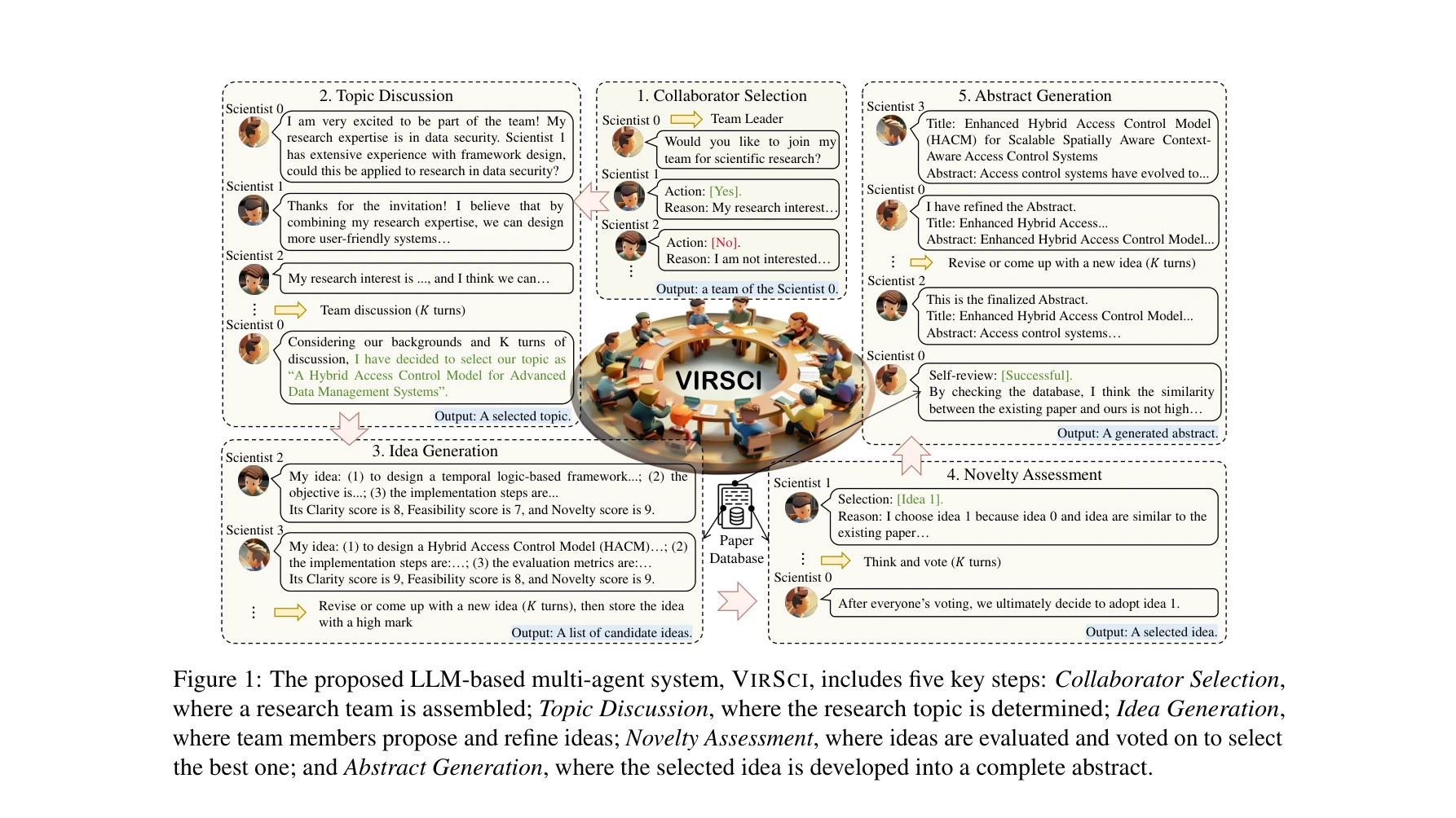

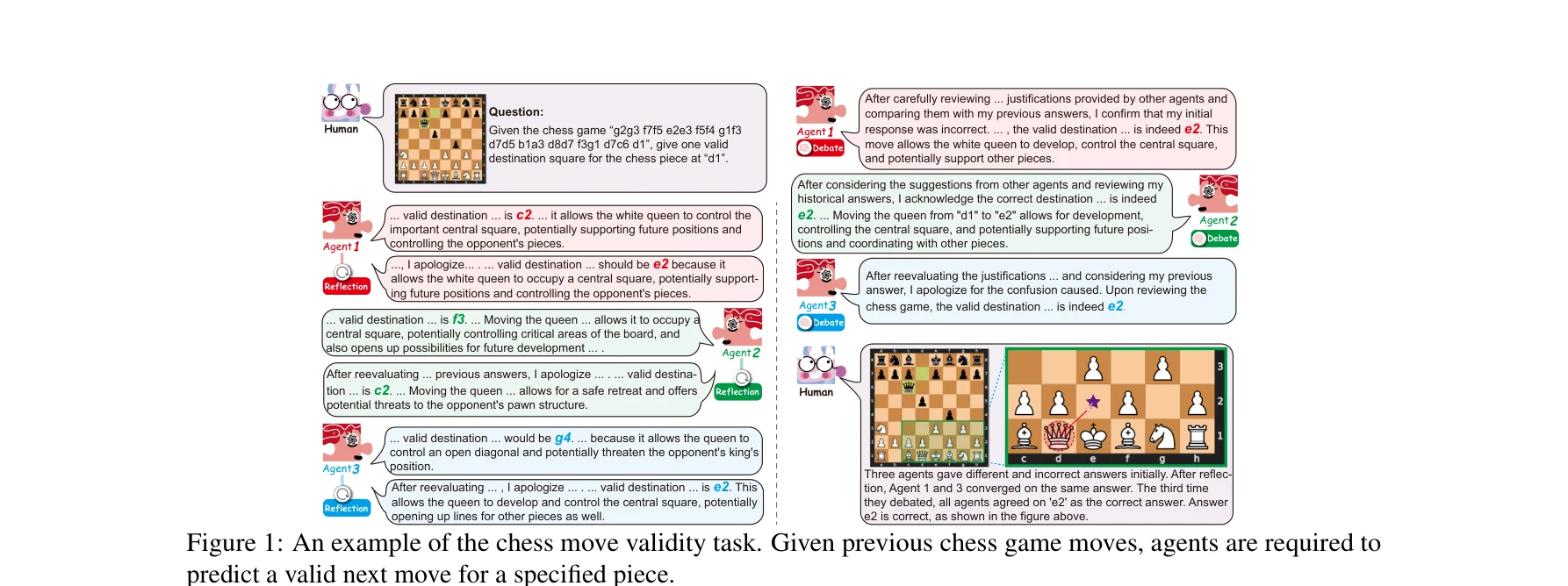

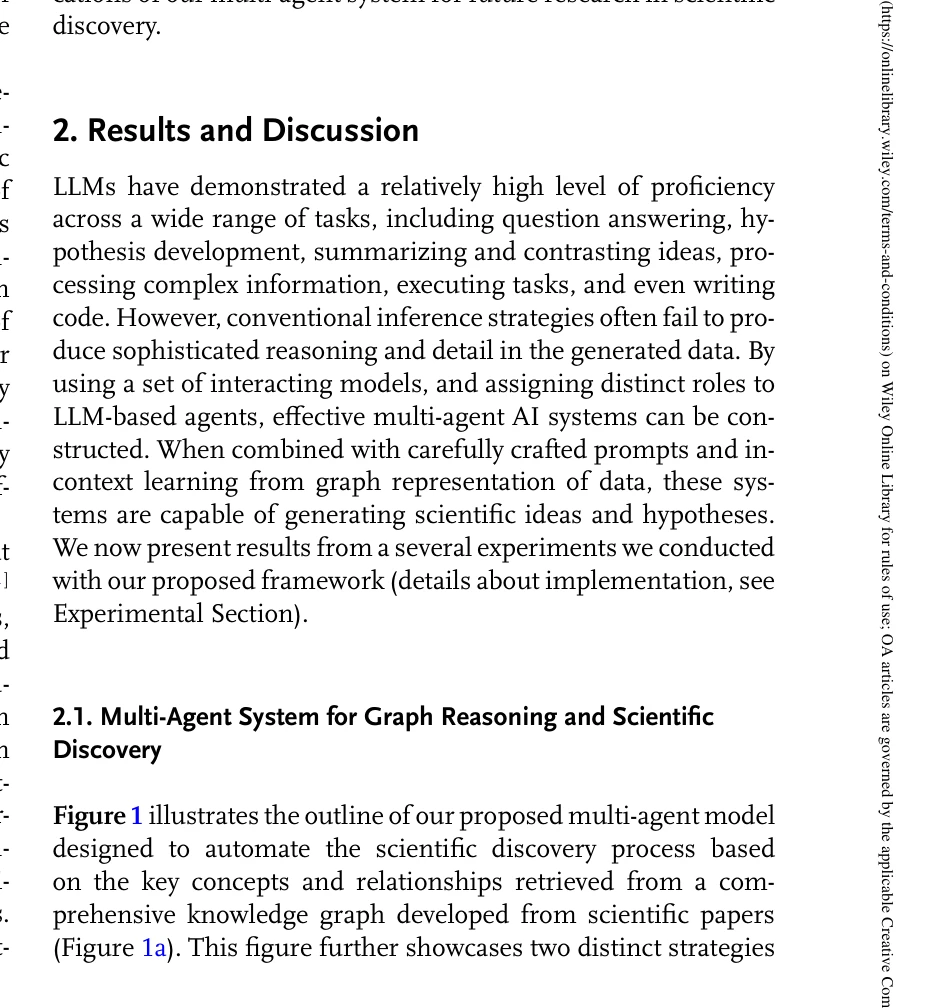

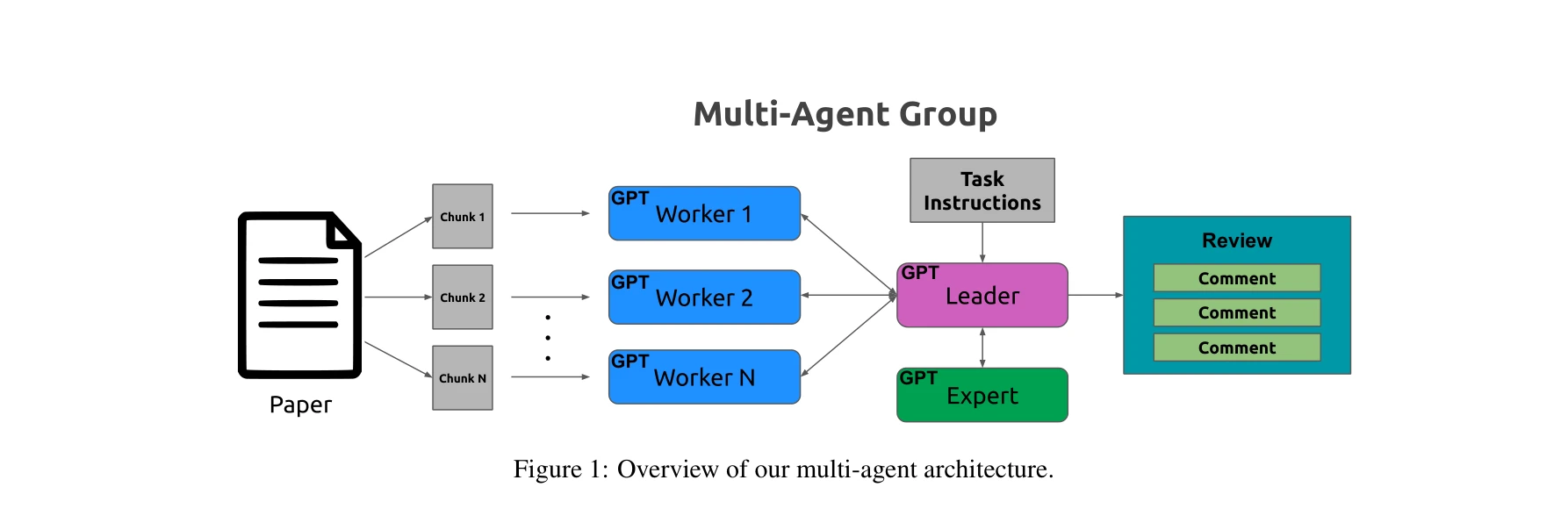

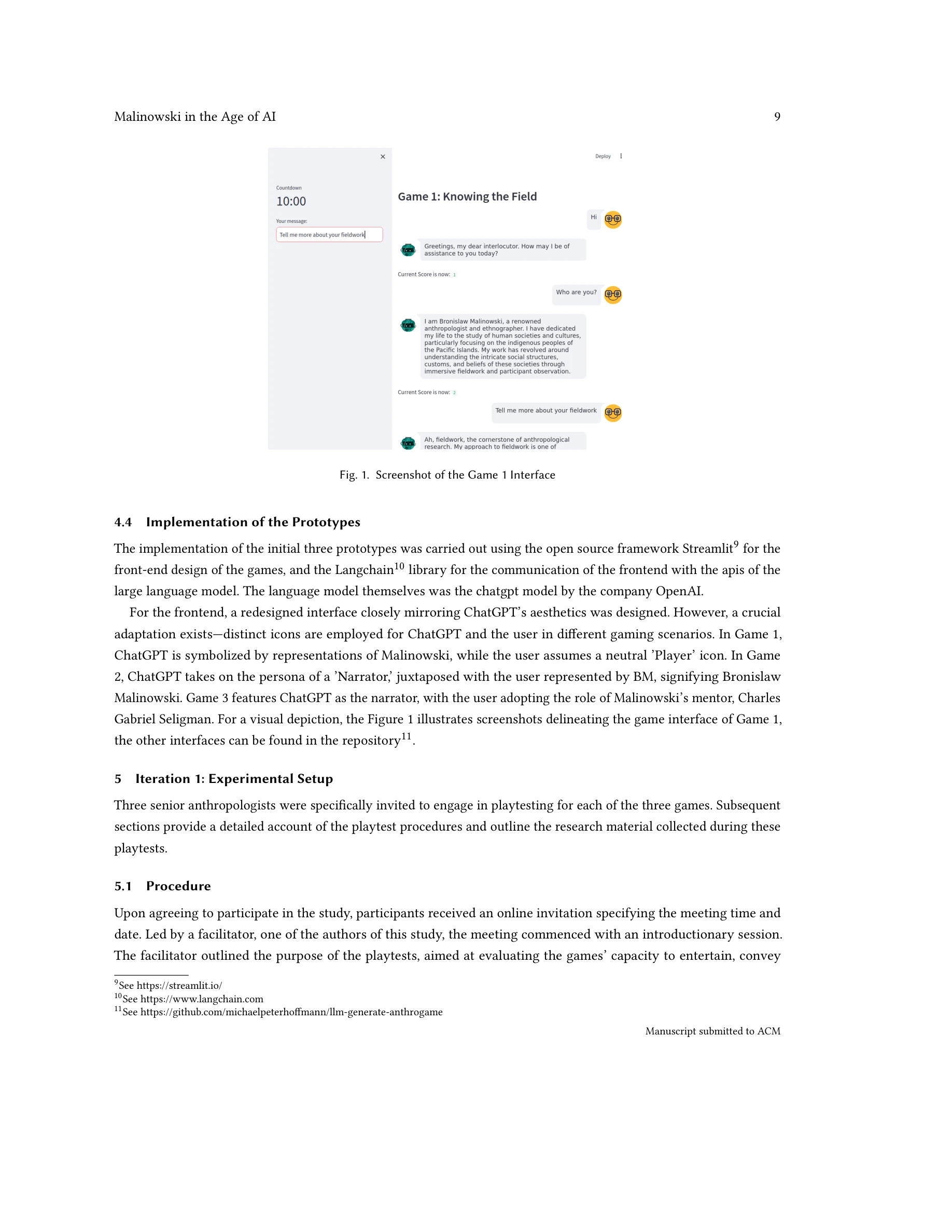

Large Language Model based Multi-Agents: A Survey of Progress and Challenges

*그림 1: LLM 기반 멀티에이전트 연구 분야의 상승 추세. 문제 해결 및 세계 시뮬레이션 범주에서 최근 연구를 3개월 간격으로 분류.* 대규모 언어모델(LLM)의 계획 및 추론 능력을 활용하여 여러 자율 에이전트가 협력하는 멀티에이전트 시스템(LLM-MA)이 복잡한 문제 해결과 세계 시뮬레이션에서 상당한 진전을 이루고 있다. 본 논문은 LLM 기반 멀티에이전트 시스템의 필수 측면(에이전트-환경 인터페이스, 프로파일링, 통신, 능력 획득)과 도메인 적용을 체계적으로 정리한 종합 서베이이다.

본 논문은 급속히 발전하는 LLM 기반 멀티에이전트 연구 분야에 대한 체계적이고 포괄적인 서베이를 제공하며, 에이전트-환경 인터페이스, 프로파일링, 통신, 능력 획득이라는 4가지 핵심 차원으로 LLM-MA 시스템을 분석하는 새로운 프레임워크를 제시하여 학술적 가치가 높다. 다만 이론적 분석의 깊이와 실제 적용 시 마주칠 수 있는 확장성, 신뢰성 문제에 대한 논의가 보강된다면 더욱 실용적인 자료가 될 것으로 예상된다.

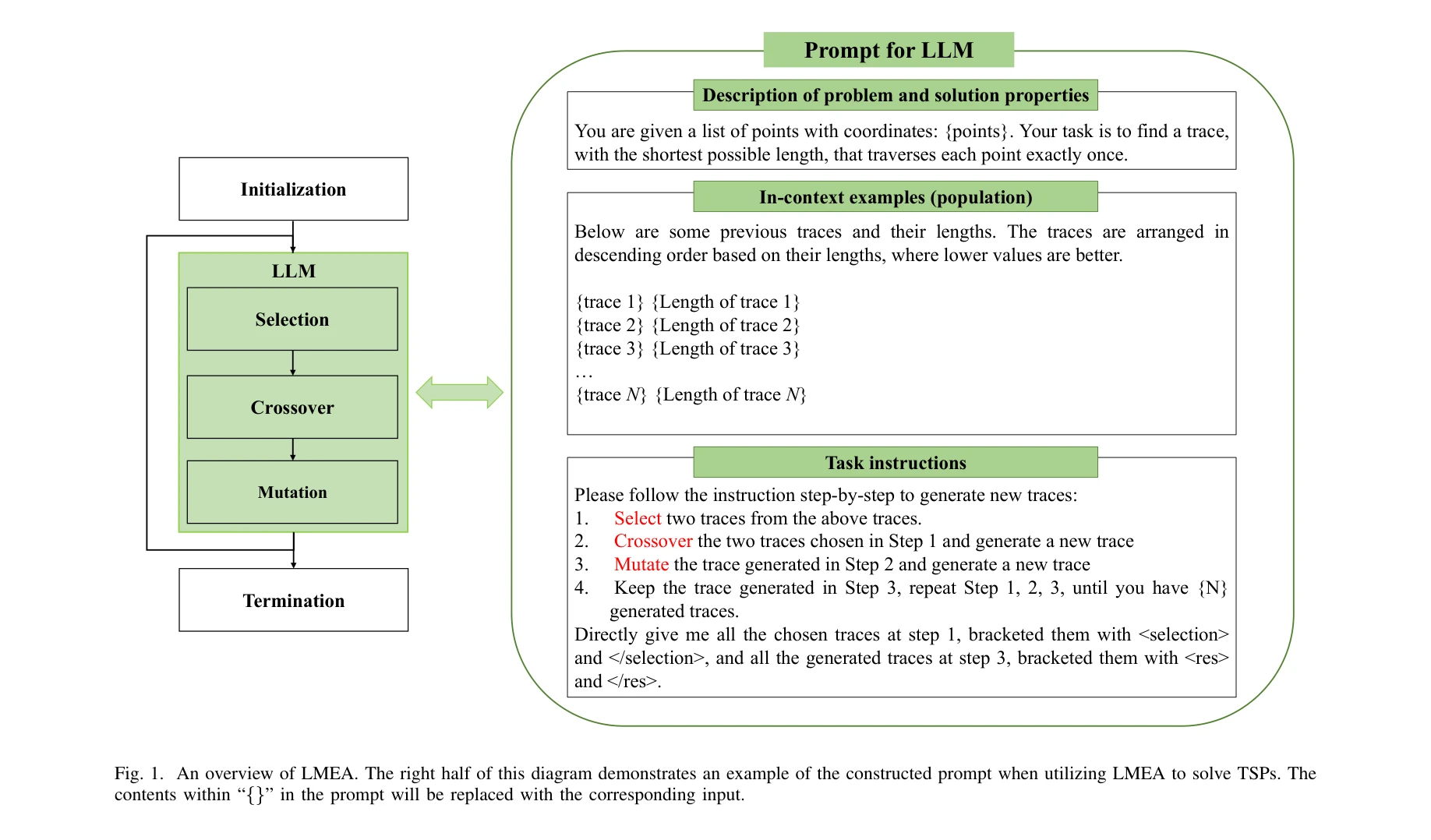

Large Language Models as Evolutionary Optimizers

본 논문은 대규모 언어모델(Large Language Models, LLM)을 진화 알고리즘(Evolutionary Algorithms, EA)의 연산자로 활용하여 조합 최적화 문제를 해결하는 최초의 시도를 제시한다. LLM 기반 진화 알고리즘(LMEA)은 도메인 전문 지식 없이도 자연어 명령만으로 부모 선택, 교차(crossover), 돌연변이(mutation) 연산을 수행할 수 있다.

본 논문은 대규모 언어모델을 진화 알고리즘의 연산자로 활용하는 창의적이고 참신한 패러다임을 제시하며, 추가 훈련 없이 자연어만으로 최적화 문제를 해결할 수 있는 가능성을 보여준다. 다만 제한된 문제 규모와 LLM의 높은 계산 비용이 실제 응용의 장애물이 될 수 있으므로, 향후 대규모 복잡한 실무 문제로의 확장과 프롬프트 최적화 방법론 개발이 필요하다.

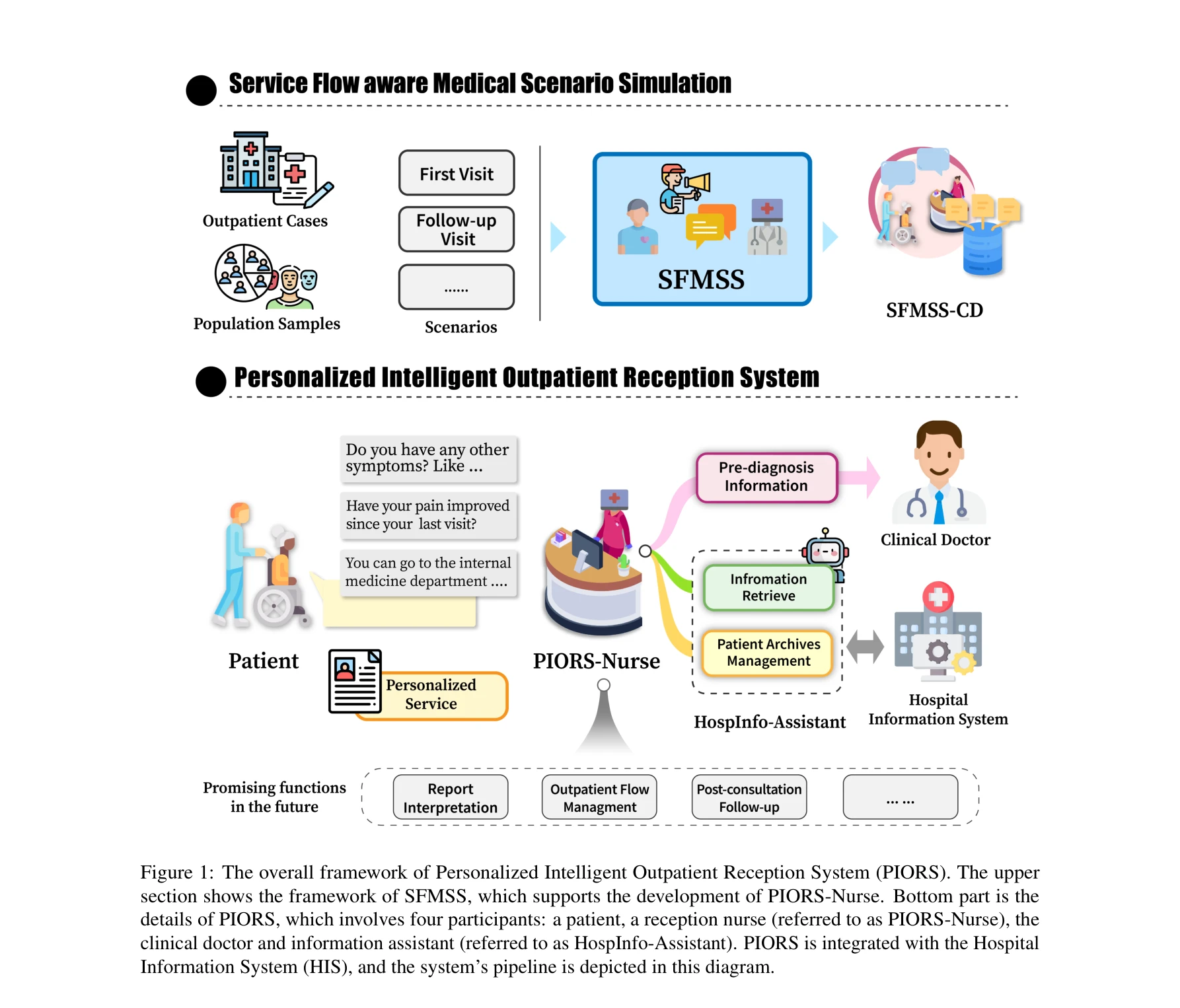

PIORS: Personalized intelligent outpatient reception based on large language model with multi-agents medical scenario simulation

*PIORS의 전체 프레임워크. 상단은 SFMSS 프레임워크, 하단은 환자, 접수 간호사(PIORS-Nurse), 임상의, 정보 보조원으로 구성된 PIORS의 상세 구조* 중국의 과포화 외래 접수 업무를 해결하기 위해 대규모언어모델(LLM) 기반 다중 에이전트 시스템을 제안하고, 실제 임상 시나리오에 맞춘 의료 대화 데이터 생성 프레임워크를 통해 개인화된 고품질 접수 서비스를 제공한다.

실제 의료 현장의 구체적인 문제를 해결하기 위해 LLM 기반 멀티 에이전트 시스템과 현실 기반 시뮬레이션 데이터 생성을 효과적으로 결합한 우수한 연구이며, 임상 전문가 검증을 통해 실용성을 입증했으나, 다양한 의료 환경으로의 일반화 가능성 검증이 필요한 상황이다.

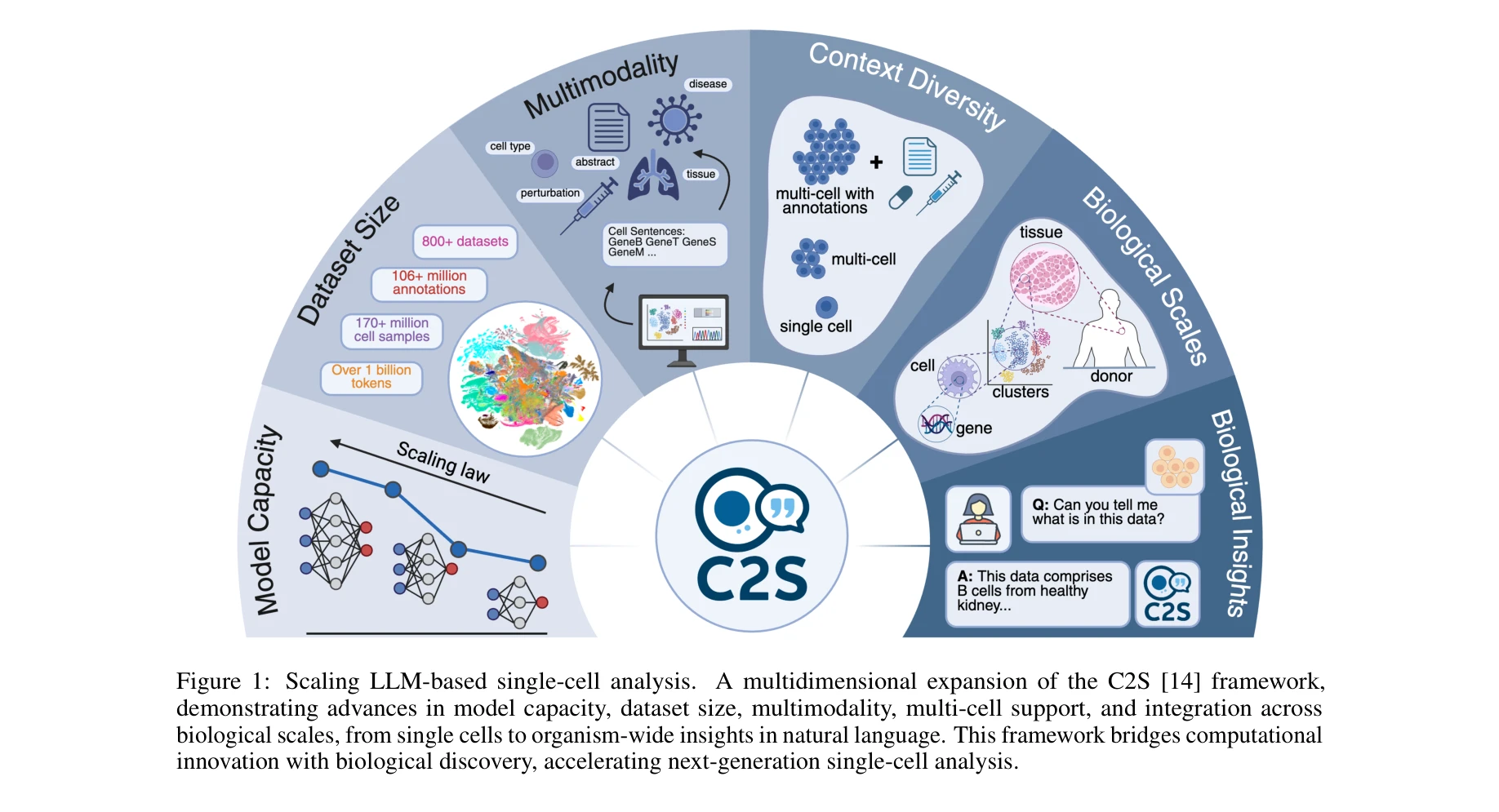

Scaling Large Language Models for Next-Generation Single-Cell Analysis

Figure 1: C2S 프레임워크의 다차원적 확장 - 모델 용량, 데이터 크기, 다중 모달리티, 다중세포 지원, 생물학적 스케일 통합

*Figure 2: C2S-Scale는 scRNA-seq 데이터와 자연언어를 통합하여 LLM을 이용한 단일세포 분석 수행* 단일세포 RNA 시퀀싱 데이터를 "세포 문장(cell sentence)" 형태의 텍스트로 변환하여 대규모언어모델(LLM)로 처리하는 Cell2Sentence 프레임워크를 270억 개의 파라미터로 확장함으로써, 전사체 데이터와 생물학적 텍스트 정보를 통합한 차세대 단일세포 분석 플랫폼을 구현했다.

이 논문은 대규모 LLM의 스케일링 효과를 단일세포 생물학에 처음 체계적으로 입증하고, 전사체 데이터와 자연언어의 통합을 전례 없는 규모(50M 세포, 1B 토큰)로 달성한 획기적 연구이다. Cell2Sentence 프레임워크의 우아한 설계, GRPO 강화학습 응용, scFID 평가 지표 개발 등에서 높은 독창성을 보이며, 공개 모델 및 자원 공개로 생물학 커뮤니티에 실질적 기여를 할 것으로 예상된다. 다만 해석가능성 부재와 계산 비용 측면에서는 개선이 필요하며, 논문의 일부 기술적 세부사항(특히 GRPO 적용 방식, scFID 검증 방법)이 다소 간략하게 기술된 점이 아쉽다.

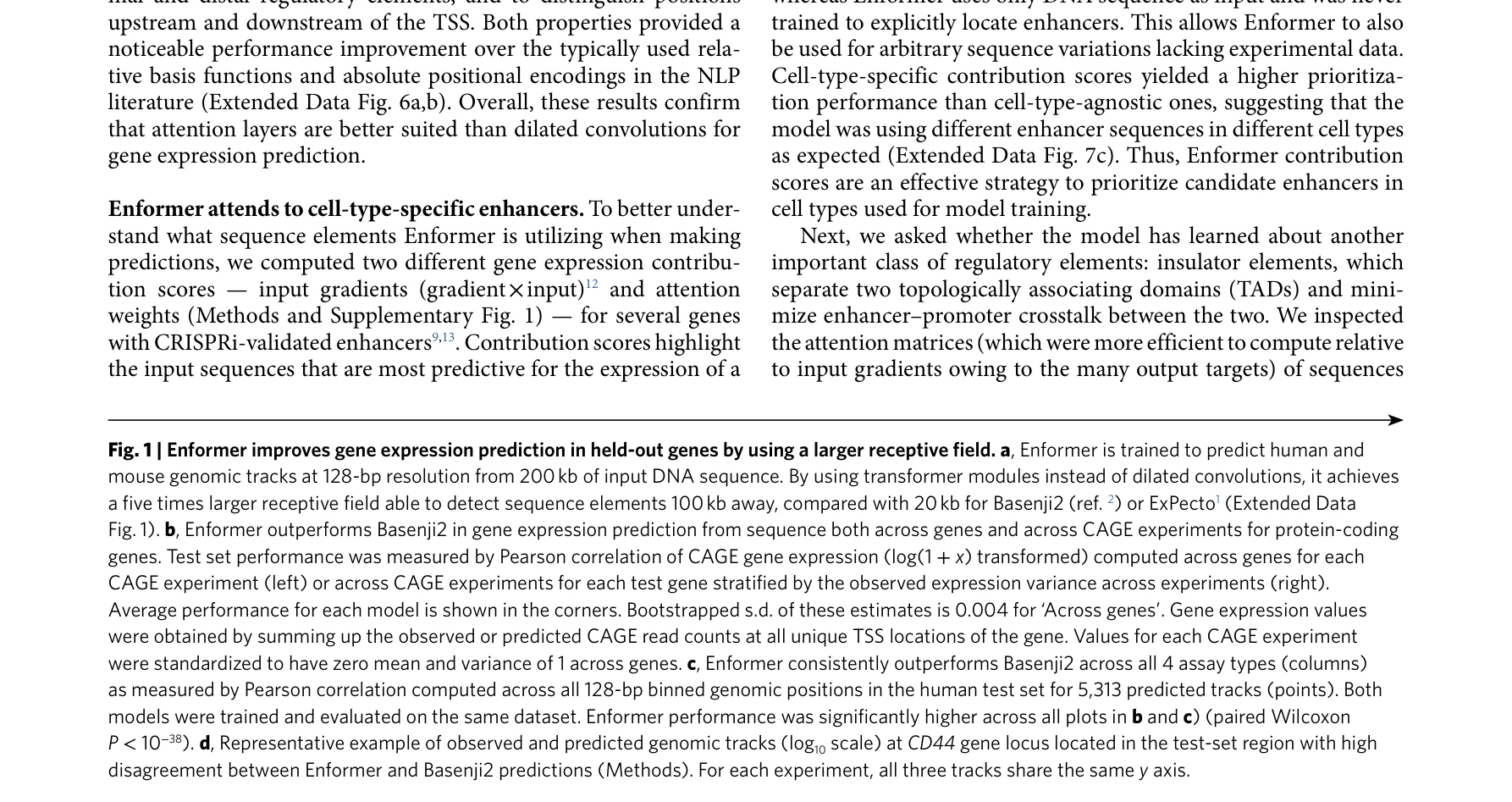

Effective gene expression prediction from sequence by integrating long-range interactions

그림 1: Enformer는 200 kb 입력 서열에서 128 bp 해상도로 게놈 트랙을 예측하며, Transformer 모듈을 통해 Basenji2 대비 5배 큰 수용장(100 kb vs 20 kb)을 달성

DNA 서열로부터 유전자 발현을 예측하는 문제에서 Transformer 기반 자기주목(self-attention) 메커니즘을 통해 100 kb까지의 장거리 규제 요소를 통합함으로써 예측 정확도를 획기적으로 향상시킨 연구이다.

본 논문은 Transformer의 자기주목 메커니즘을 통해 DNA 서열로부터의 유전자 발현 예측이라는 오랜 문제를 실질적으로 해결하며, 다양한 생물학적 검증을 통해 모델의 생물학적 타당성까지 입증한 매우 높은 수준의 연구이다. 특히 장거리 규제 상호작용 통합이라는 생물학적 직관을 기술적으로 구현하고, 인간 유전학의 여러 응용 분야에서 즉각적인 임상 가능성을 제시한 점에서 높이 평가된다.

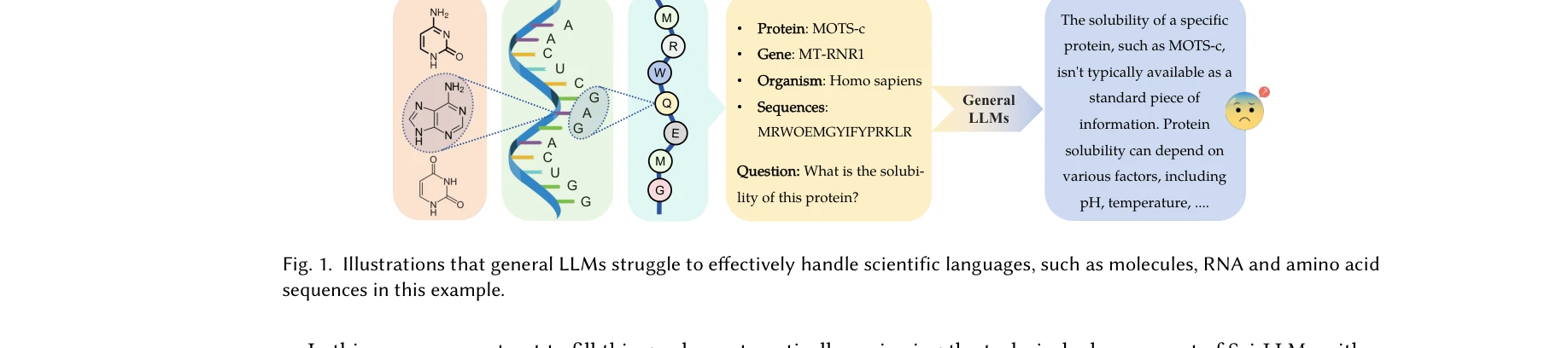

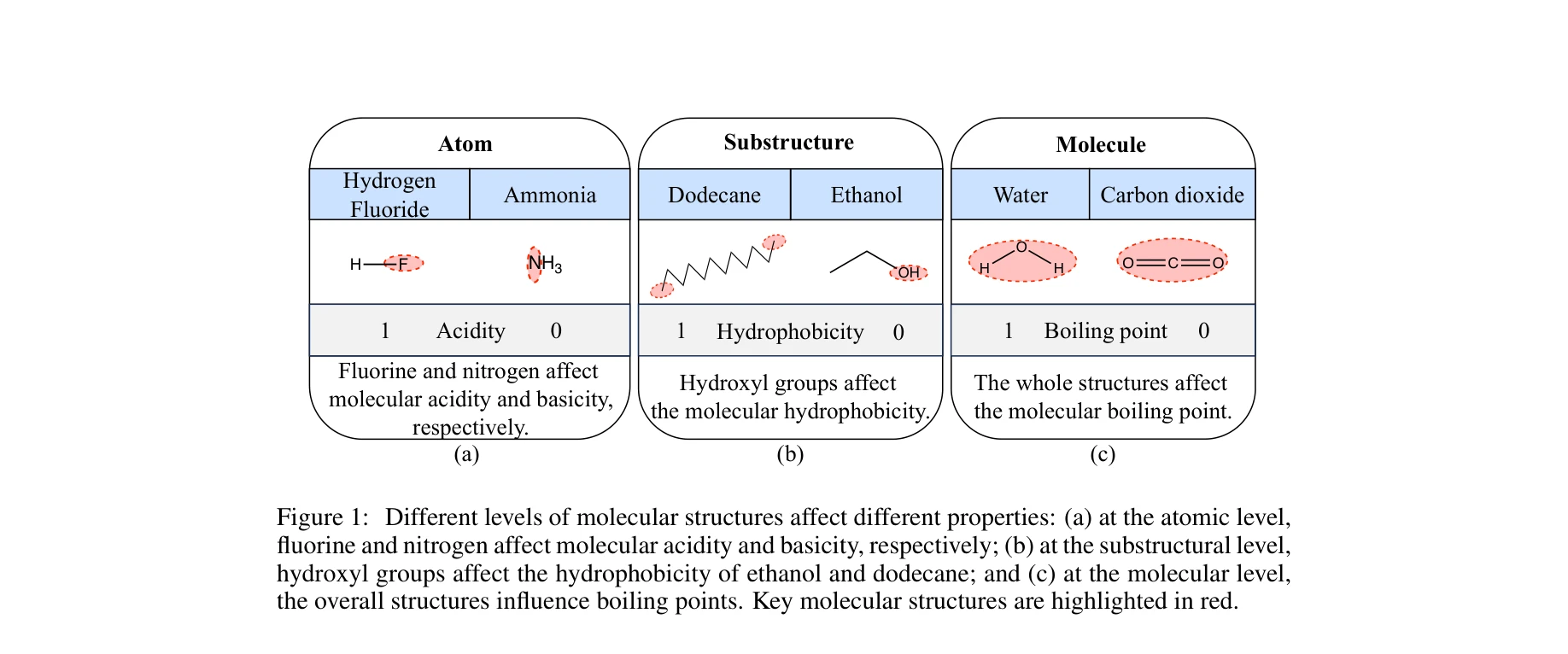

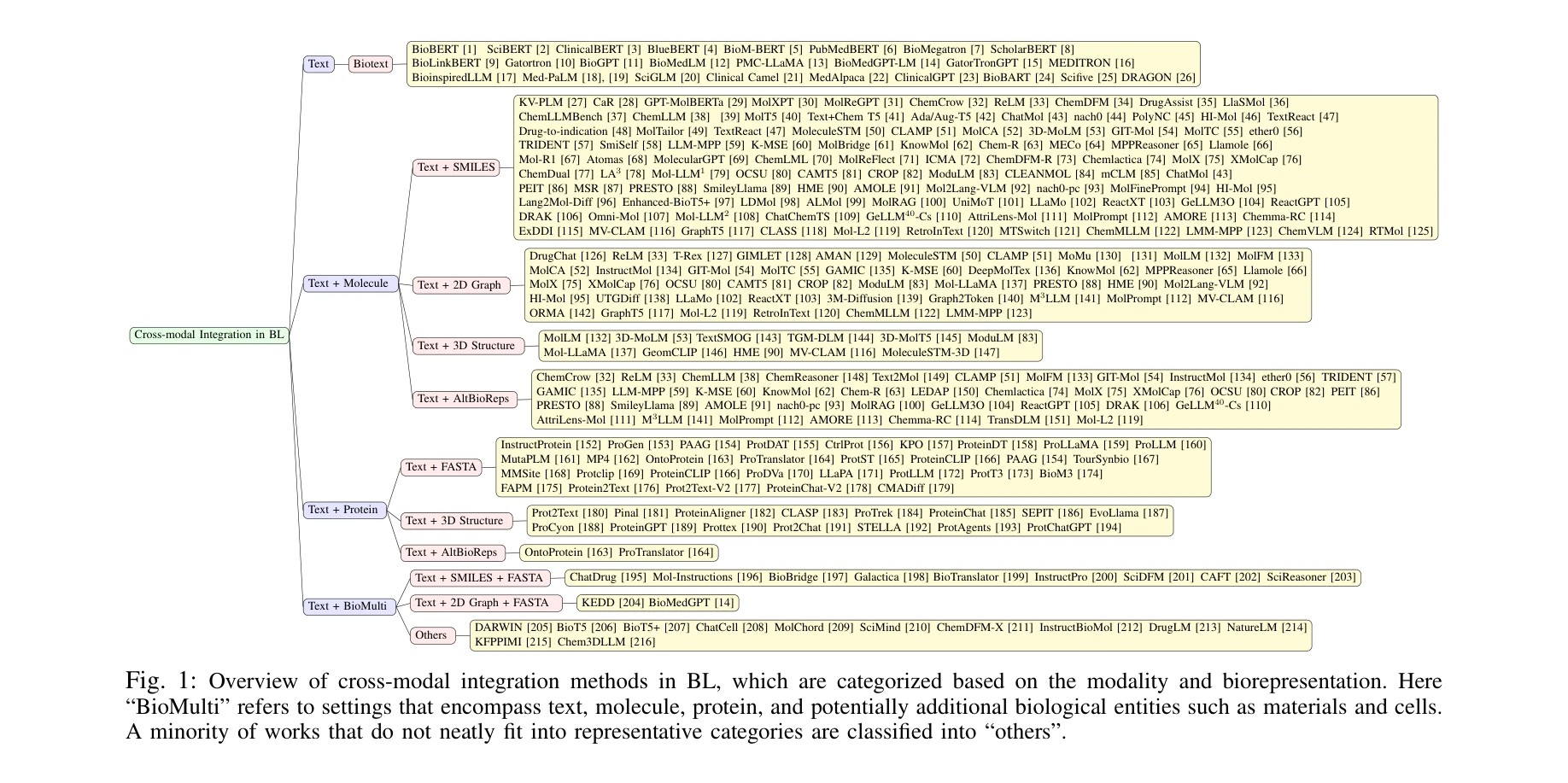

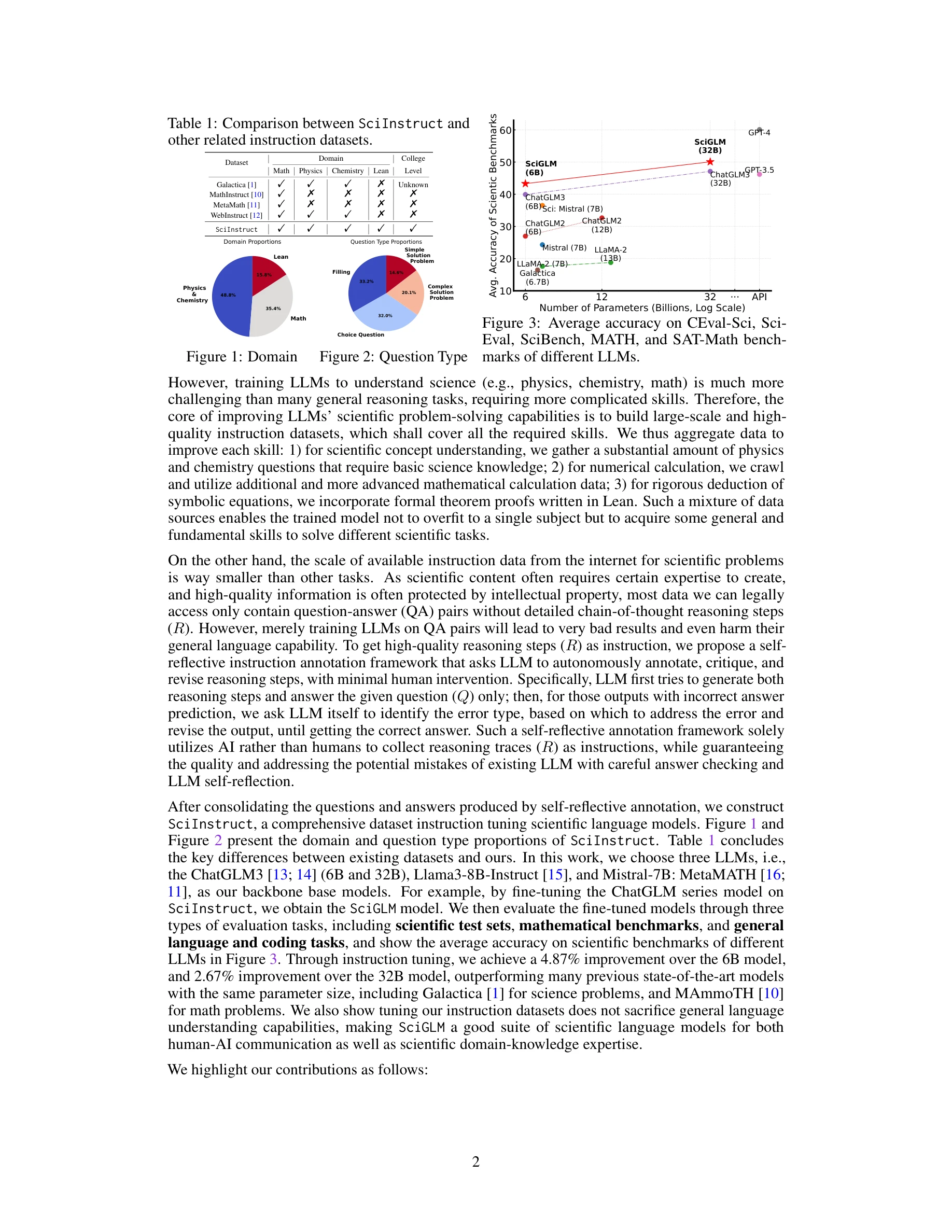

Scientific Large Language Models: A Survey on Biological & Chemical Domains

*생물 및 화학 영역의 과학적 언어(분자, 단백질, 게놈, 텍스트) 및 멀티모달 조합을 포괄하는 과학 LLM의 연구 범위* 본 논문은 생물학 및 화학 분야의 특화된 과학 언어를 처리하도록 설계된 대규모 언어 모델(과학 LLM)에 대한 최초의 포괄적 조사연구다. 텍스트, 분자(SMILES, SELFIES), 단백질(아미노산 서열), 게놈(DNA 서열) 및 이들의 멀티모달 조합을 다루며, 모델 아키텍처, 학습 데이터셋, 평가 방법론을 상세히 분석한다.

본 논문은 빠르게 성장하는 과학 LLM 분야의 첫 포괄적 리뷰로, 분자·단백질·게놈·멀티모달 영역을 통합 분석한 점에서 기여도가 크다. 다만 이론적 혁신보다는 기존 모델들의 체계적 종합에 가까우며, 도메인 간 비교 분석 및 실제 과학적 임팩트 검증은 향후 과제로 남아있다.

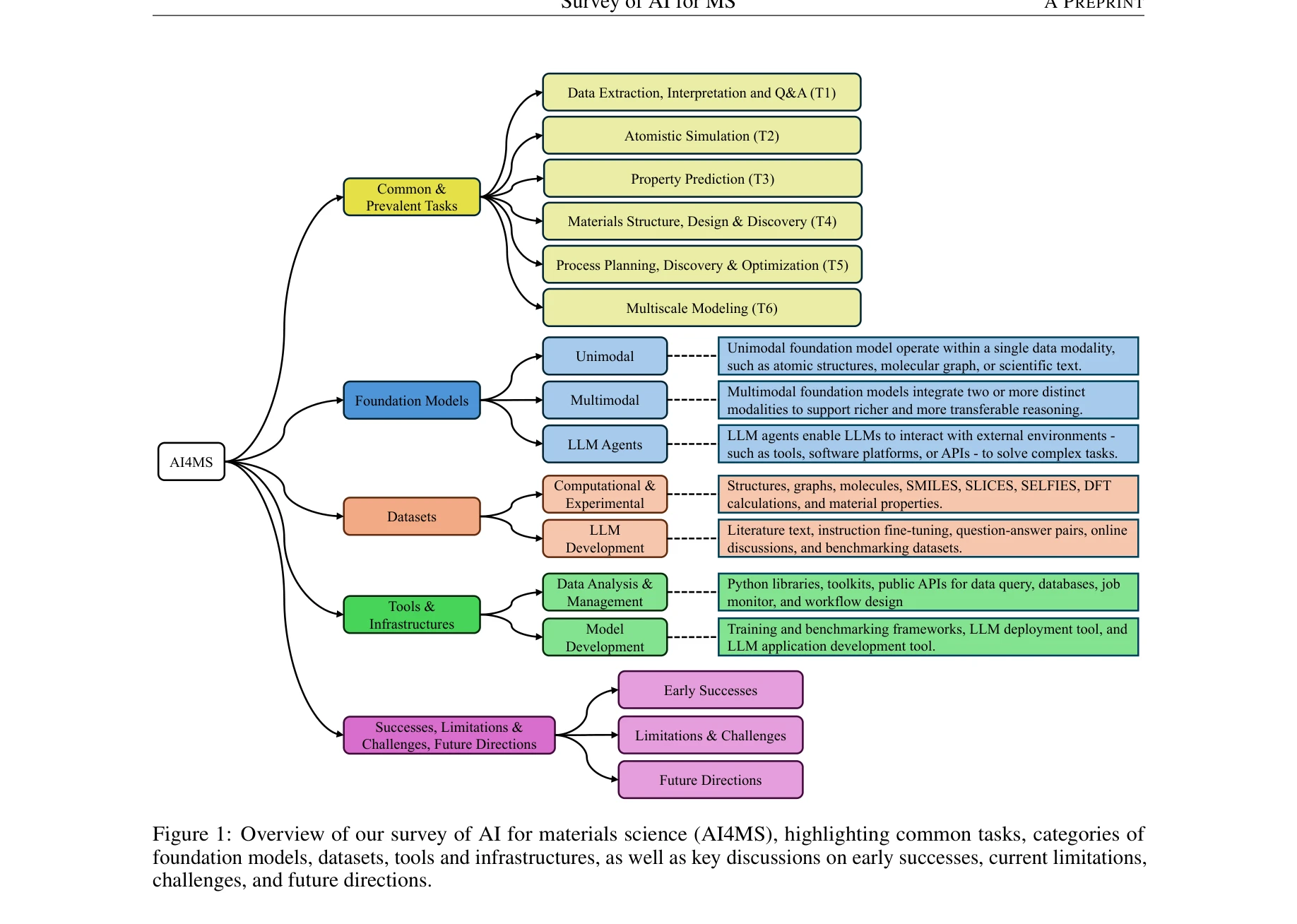

Large Language Model in Materials Science: Roles, Challenges, and Strategic Outlook

본 논문은 대규모 언어모델(Large Language Models, LLMs)이 텍스트 기반 통찰을 실험적 발견으로 변환함으로써 재료과학에 새로운 패러다임을 창출하고 있음을 체계적으로 제시한다. Oracle(지식 추출), Surrogate(성질 예측), Quant(불확실성 정량화), Arbiter(의사결정)라는 4가지 핵심 역할 프레임워크를 통해 LLM의 역할을 구조화하고, 향후 발전 방향을 제시한다.

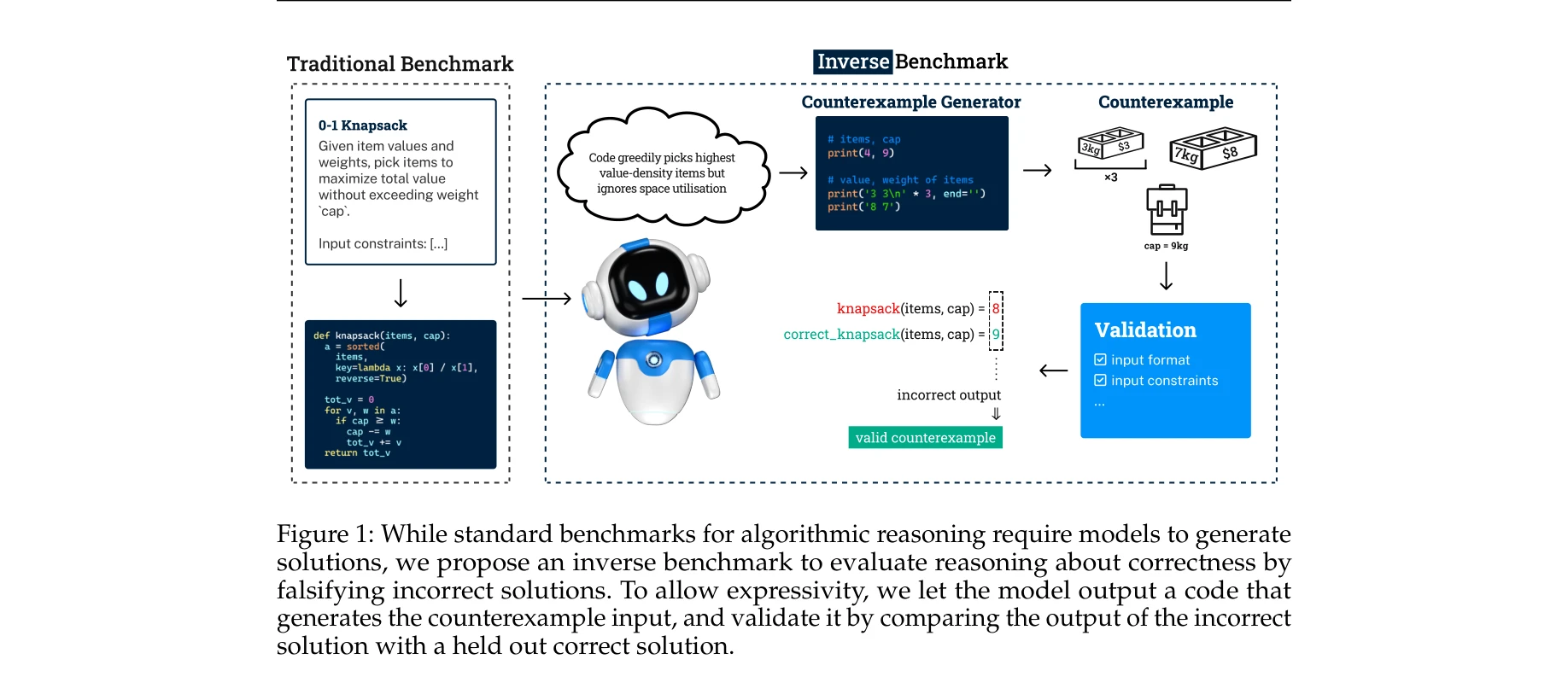

본 논문은 LLM을 단순 텍스트 생성 도구를 넘어 재료과학의 통합적 연구 파트너로 재위치시키는 탁월한 관점 논문으로, 향후 자동화 실험실과 지능형 재료 발견의 방향을 제시한다. 다만, 이론적 프레임워크에 비해 구체적 구현과 실증적 검증이 강화될 필요가 있다.

How AI-powered science search engines can speed up your research

AI 기반 과학 검색 엔진(LLM, Large Language Model 기반)이 문헌 검토를 가속화할 수 있지만, 정확성 문제와 할루시네이션(hallucination) 위험으로 인해 신중한 사용과 검증이 필수적이다.

이 기사는 빠르게 발전하는 AI 검색 엔진 시장을 시의성 있게 정리하고 실제 사용자의 경험과 함께 할루시네이션 문제를 구체적으로 제시하여, 연구자들이 이 도구들을 신중하게 활용하도록 돕는 데 기여한다. 다만 정량적 분석이 부족하고 기술적 개선 방안이 충분히 심화되지 않은 점이 아쉽다.

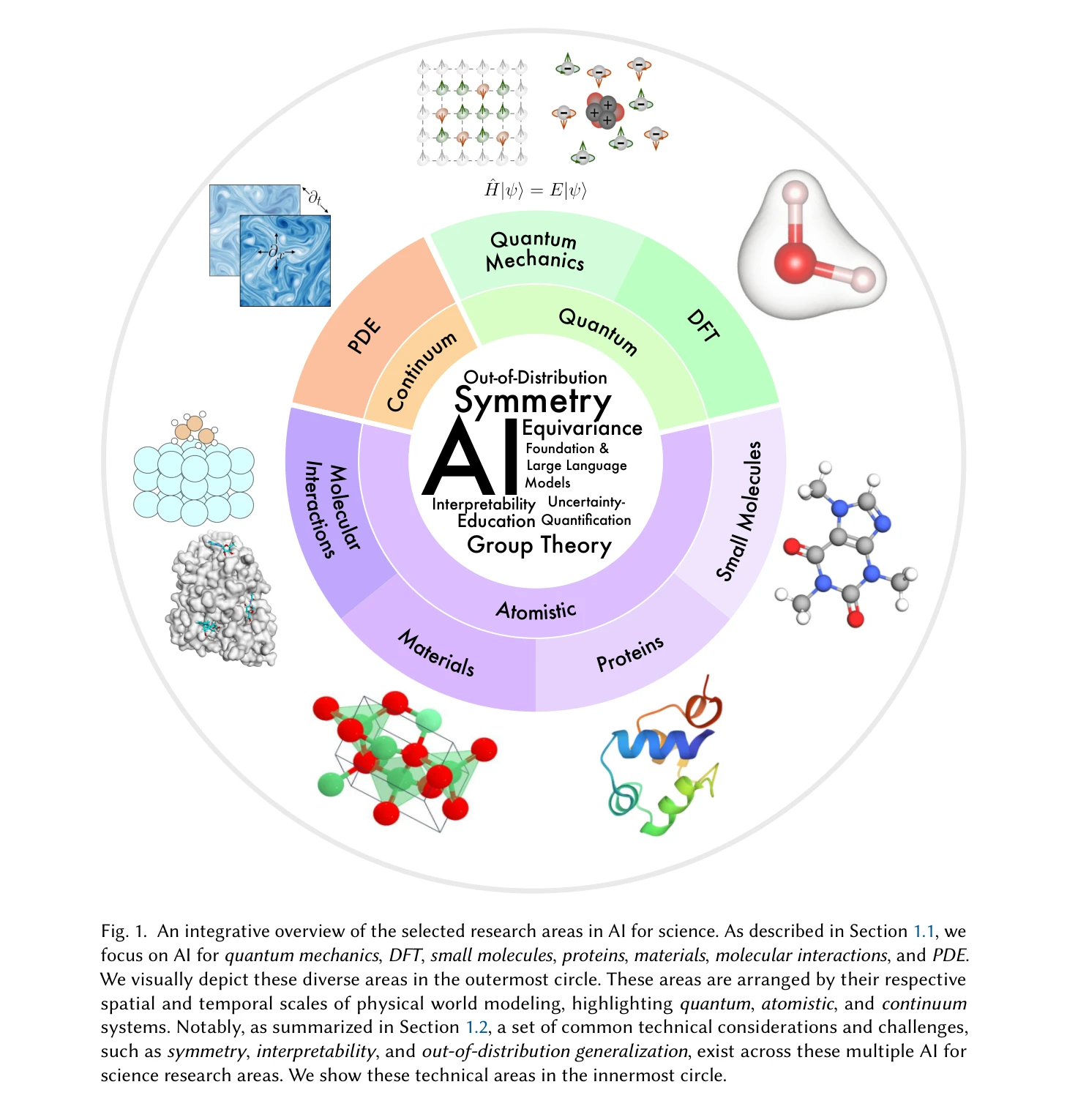

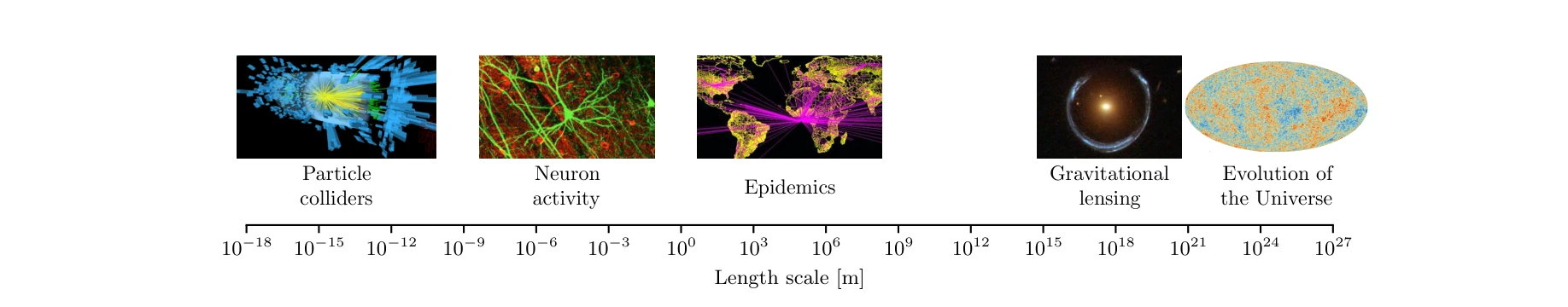

Artificial Intelligence for Science in Quantum, Atomistic, and Continuum Systems

그림 1: AI for Science의 선택된 연구 분야에 대한 통합 개요. 양자, 원자단위, 연속체 시스템을 아우르는 다양한 분야들과 이들을 관통하는 공통 기술 과제들을 시각화

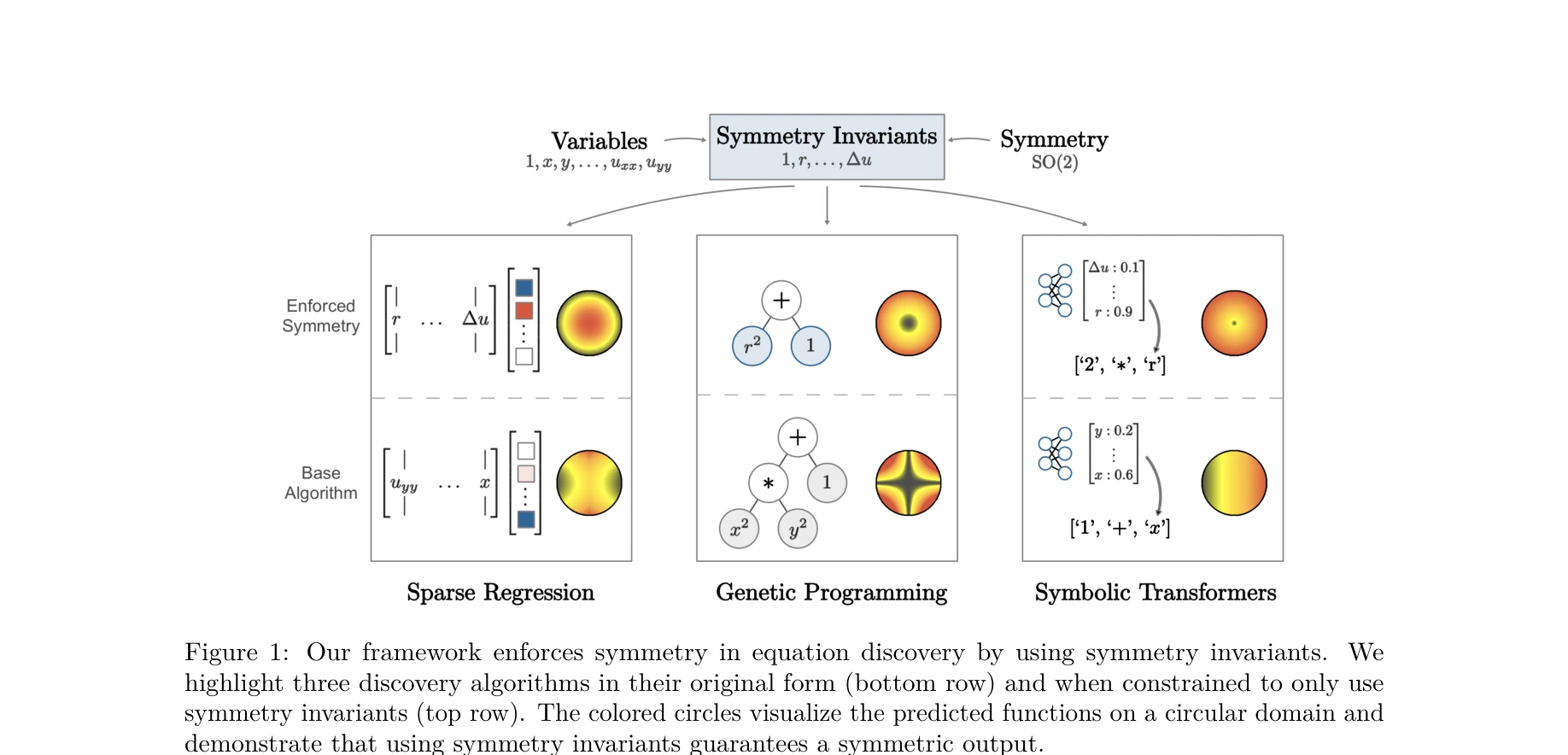

*그림 1: AI for Science의 선택된 연구 분야에 대한 통합 개요. 양자, 원자단위, 연속체 시스템을 아우르는 다양한 분야들과 이들을 관통하는 공통 기술 과제들을 시각화* 이 논문은 AI4Science의 핵심 세 영역(양자역학, 원자단위 시스템, 연속체 시스템)에 걸쳐 심층적이고 통합된 기술 리뷰를 제공한다. 특히 대칭성(symmetry)과 등변성(equivariance)을 핵심 원리로 하여 이들을 심층 학습 방법에 어떻게 통합하는지를 기술적으로 상세히 설명한다.

이 논문은 AI4Science 분야의 상태를 정리한 매우 포괄적이고 기술적 깊이 있는 기여이다. 특히 대칭성과 등변성을 통합 원리로 제시하고 이를 양자부터 연속체까지의 다양한 과학 문제에 적용한 점은 이 분야의 이론적 기초를 확립하는 중요한 작업이다. 다만 개별 방법론의 원창성보다는 기존 기술들의 체계적 정리와 통합에 초점이 맞춰져 있으며, 이론-실제 간의 구체적 성능 비교나 새로운 벤치마크 제시는 제한적이다. 역할로서는 리뷰 논문의 위상에 충실하면서도 교육적-지침적 가치가 매우 높은 작업으로, AI4Science 연구자들의 필수 참고문헌이 될 것으로 예상된다.

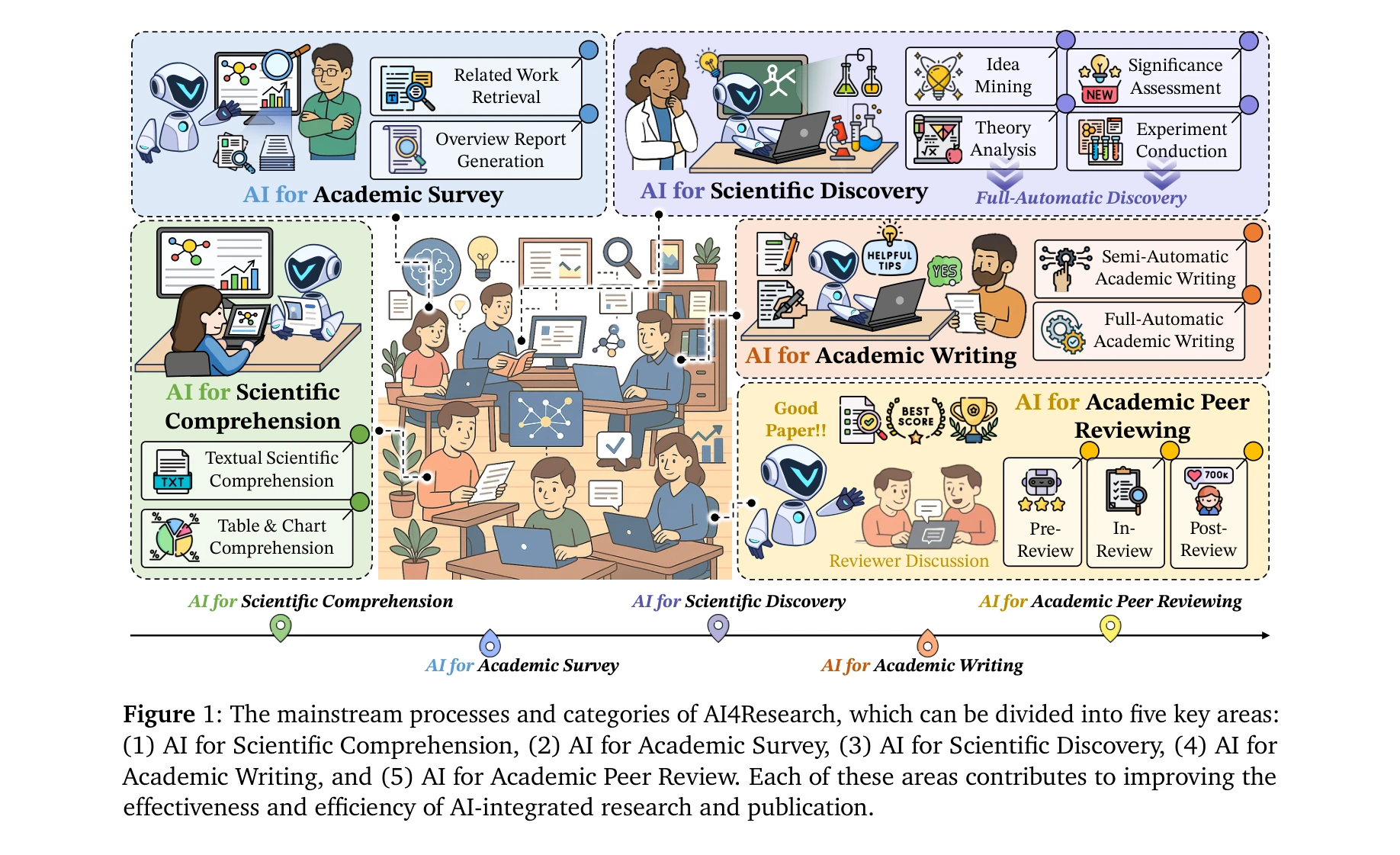

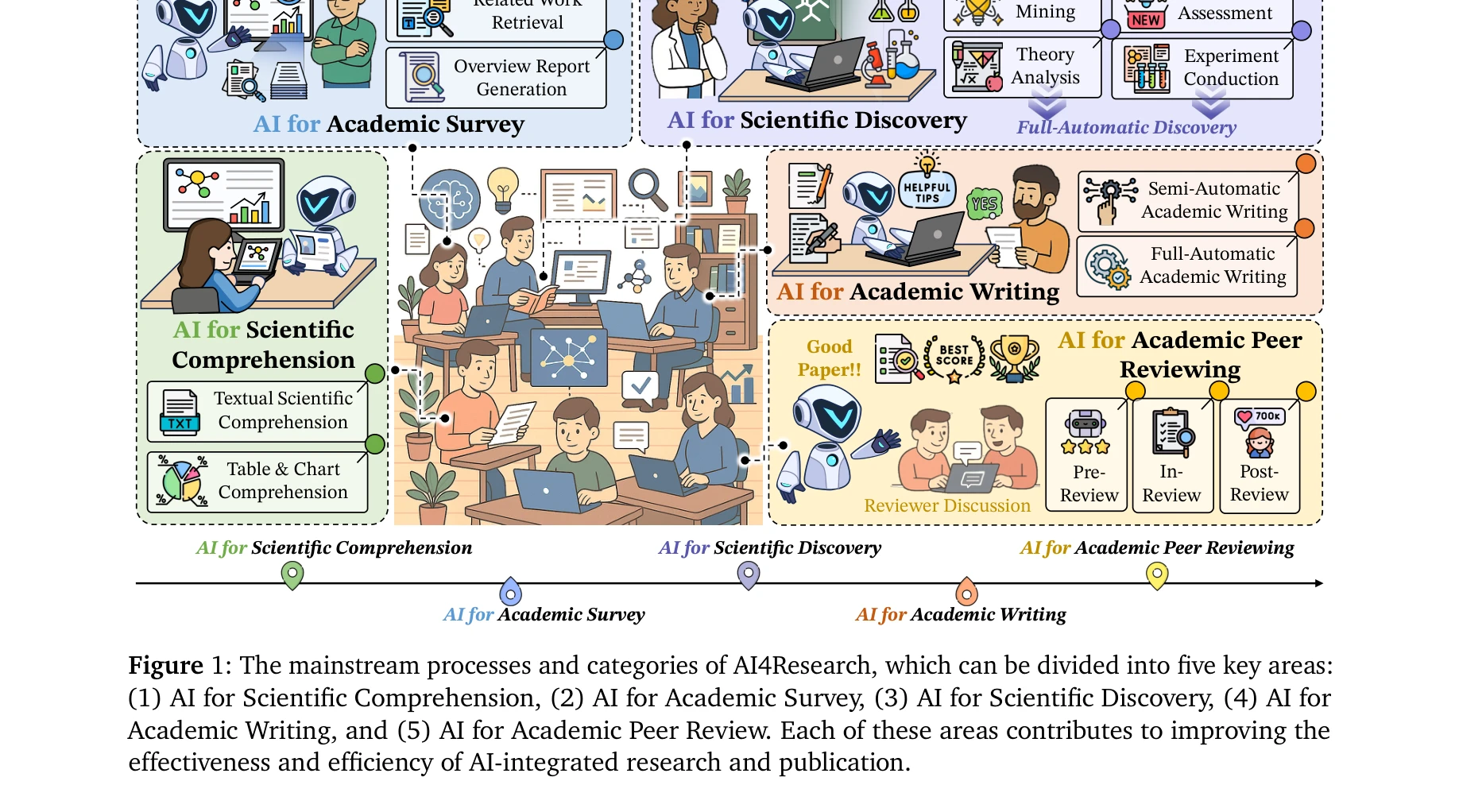

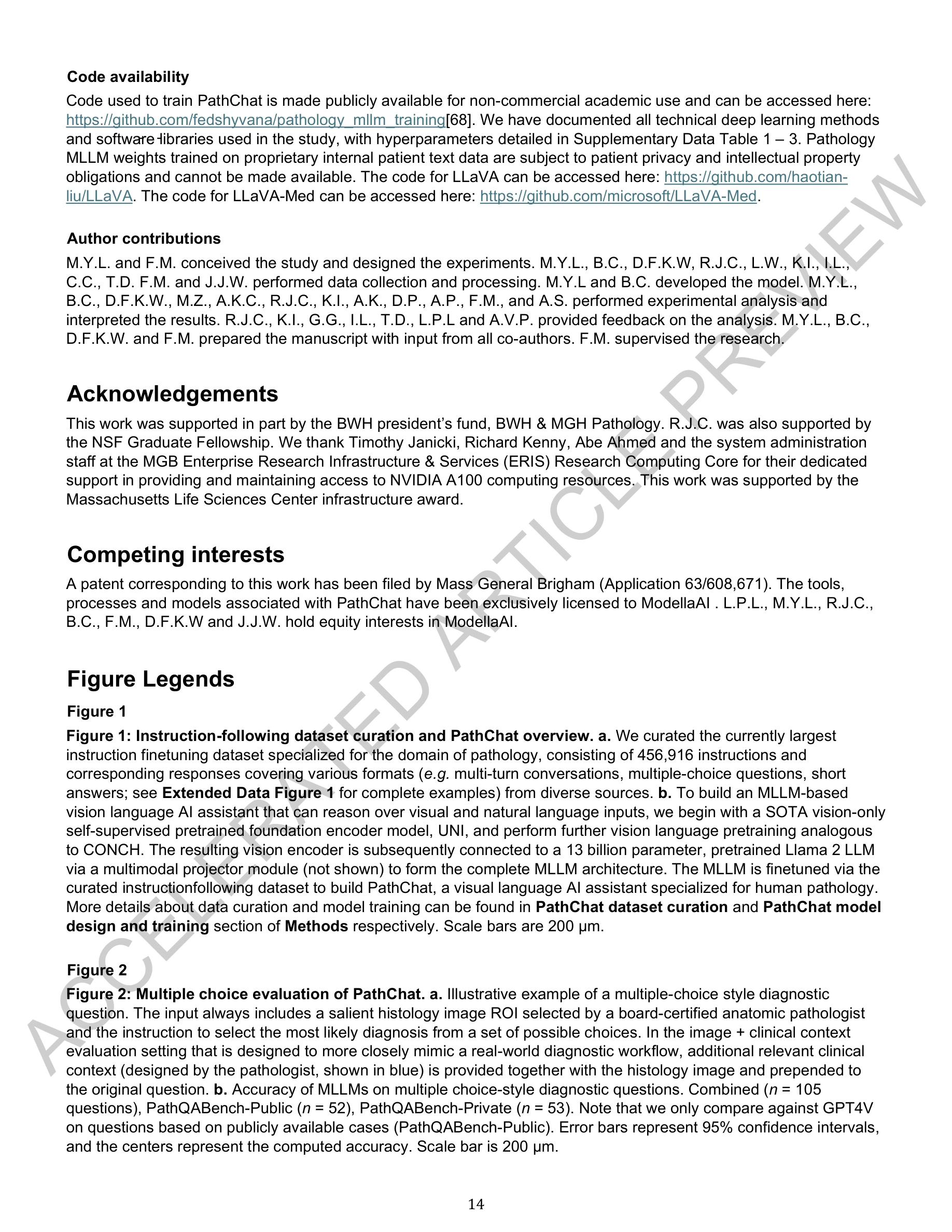

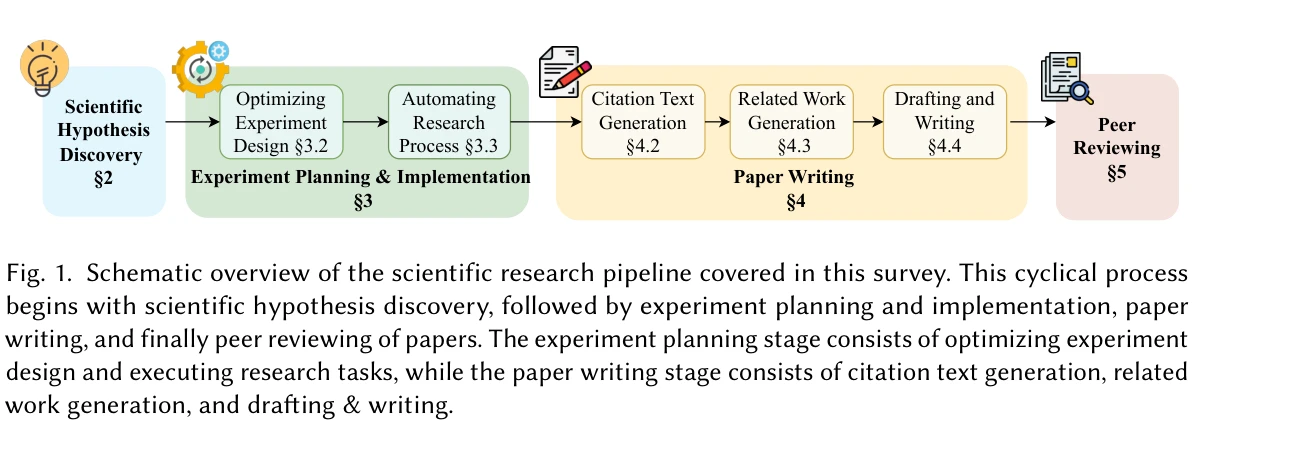

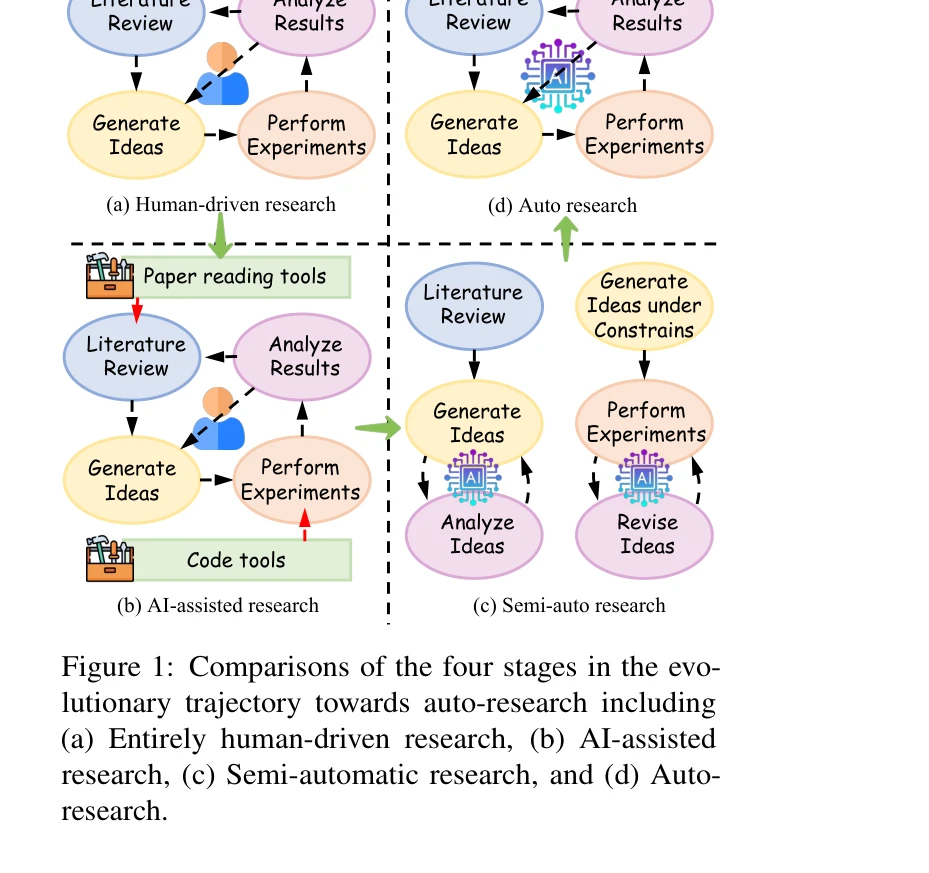

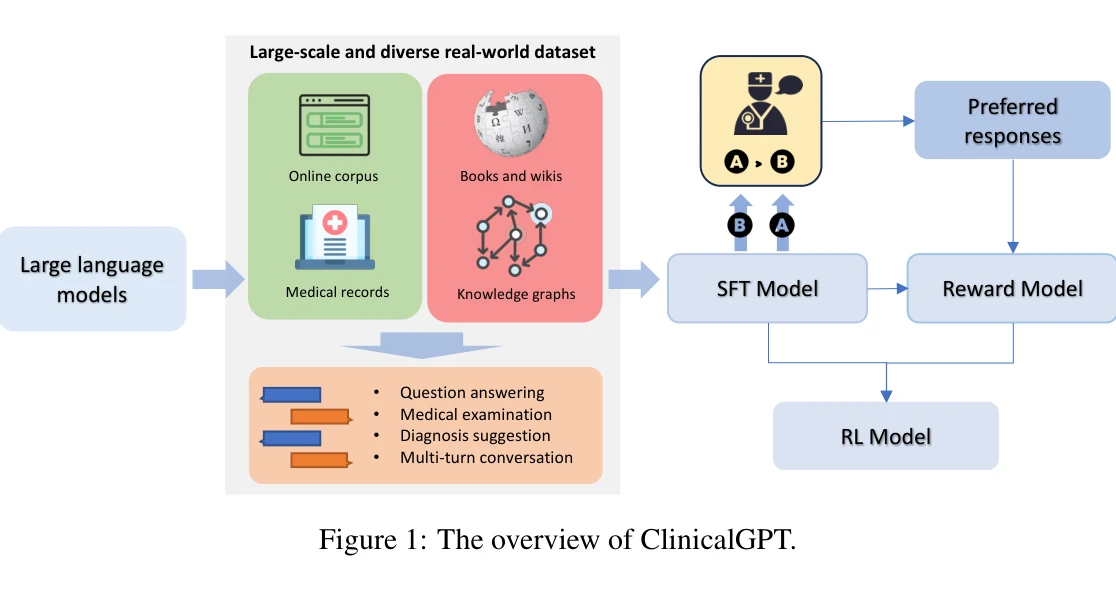

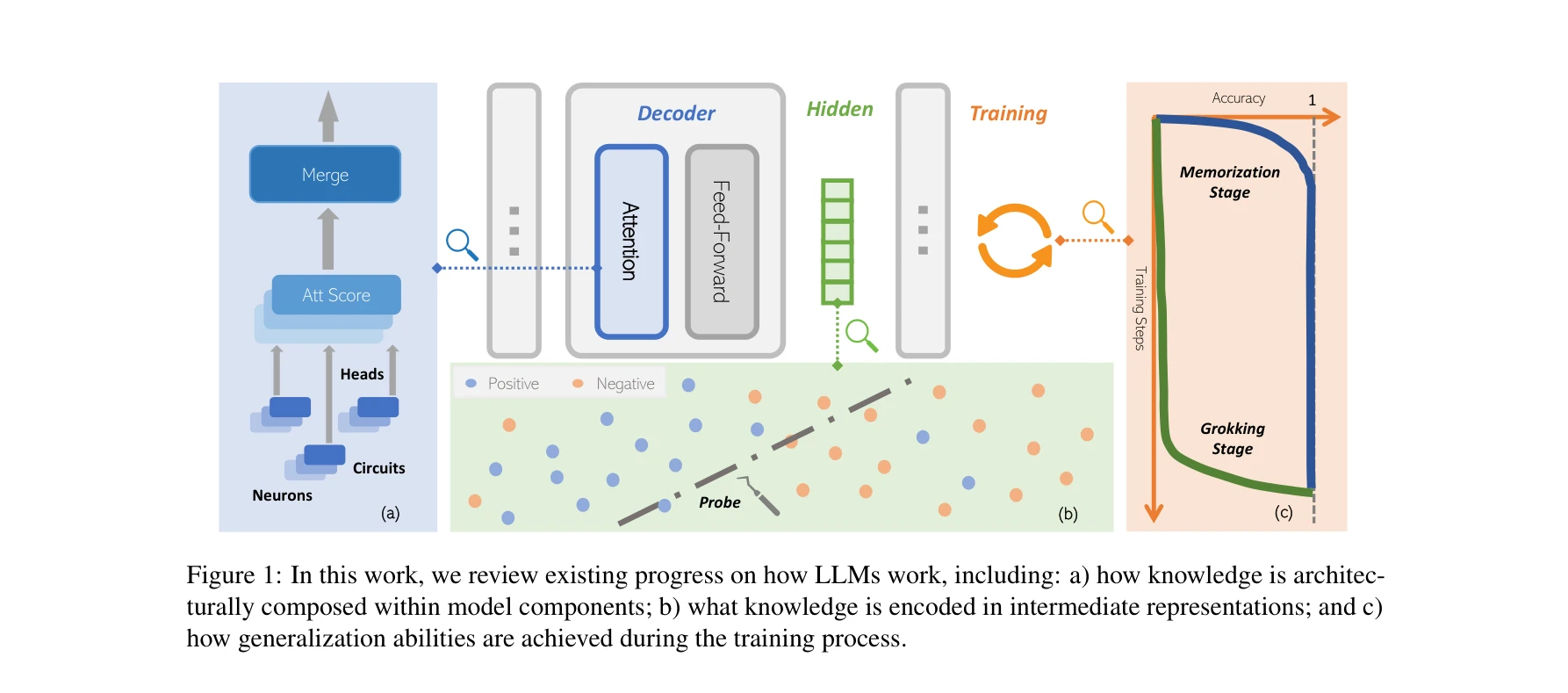

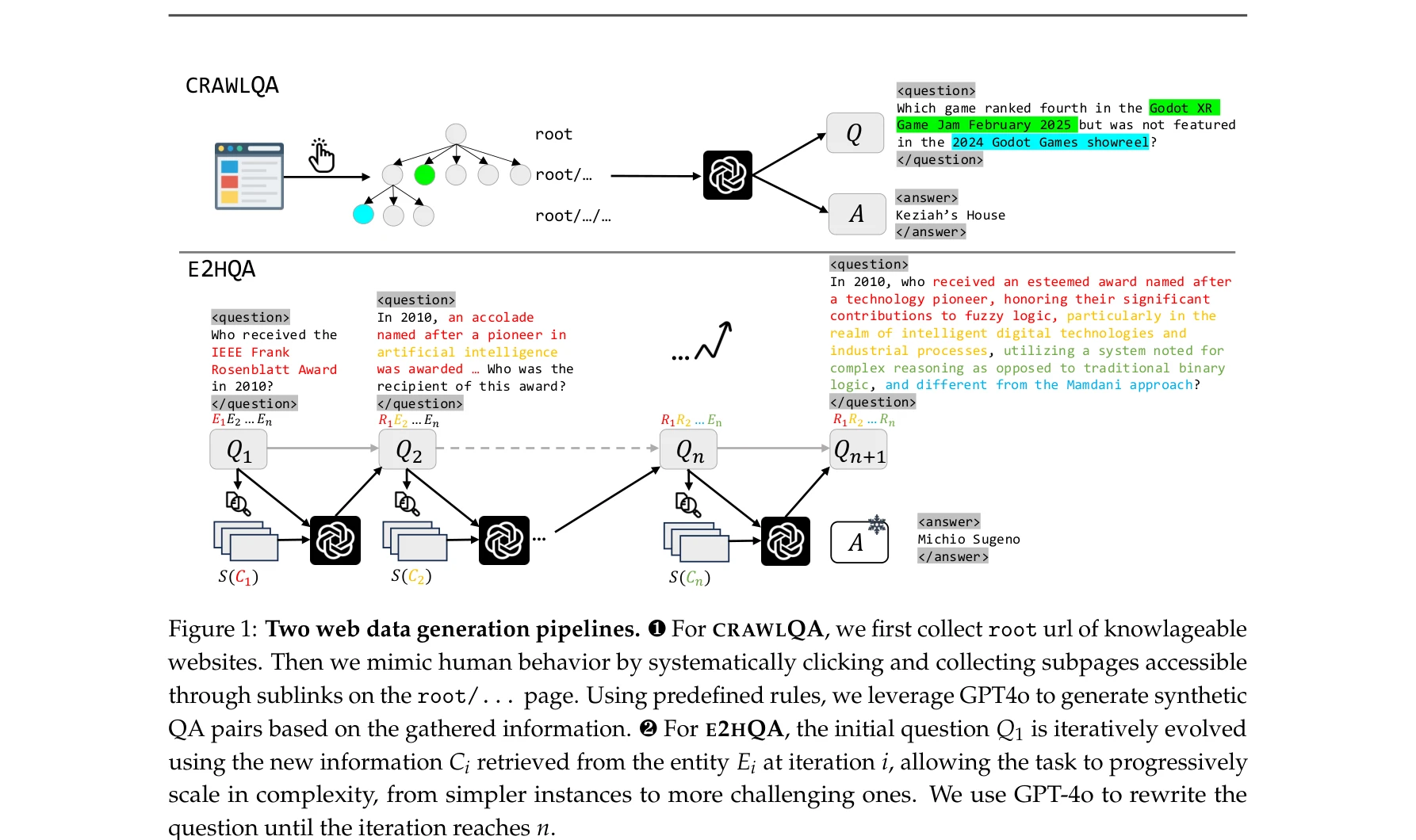

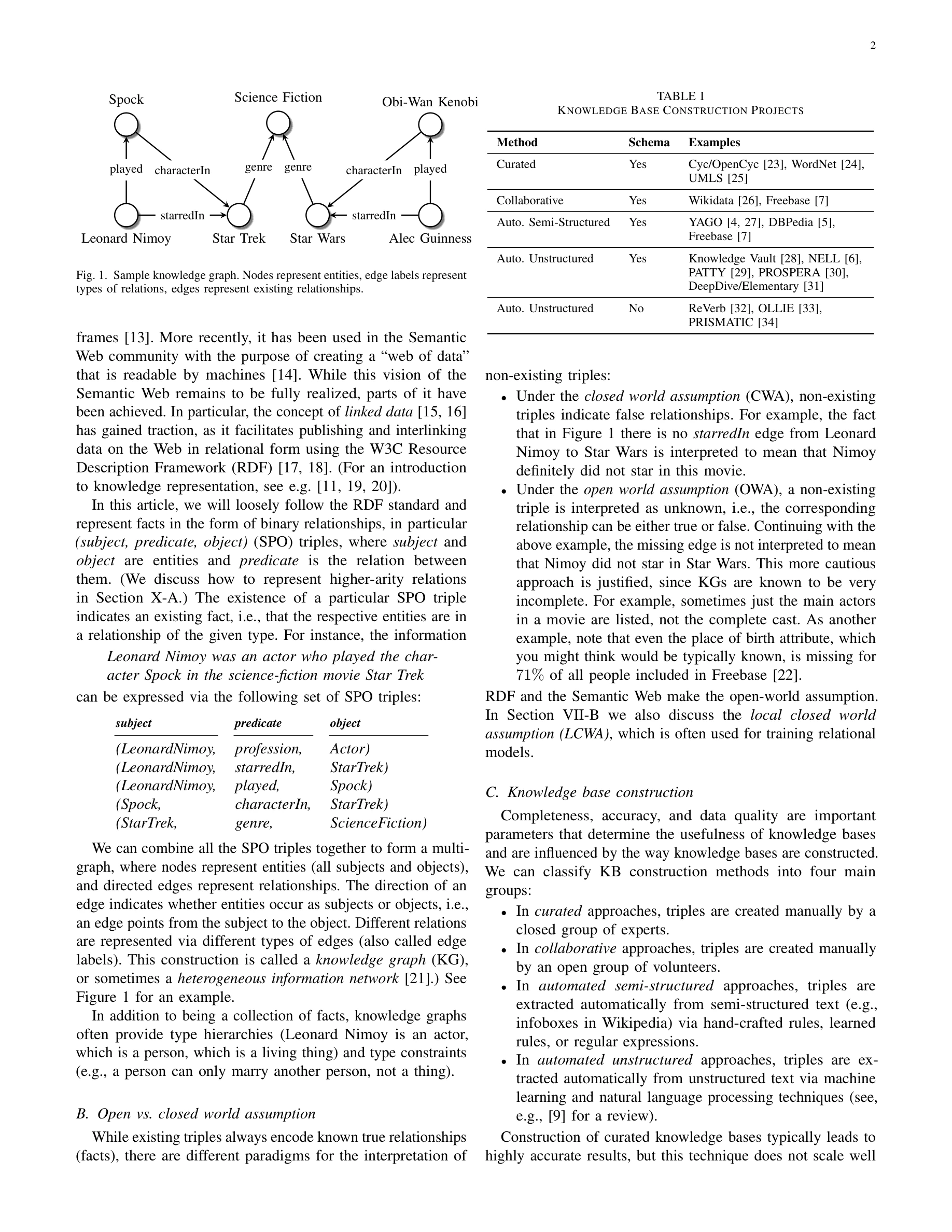

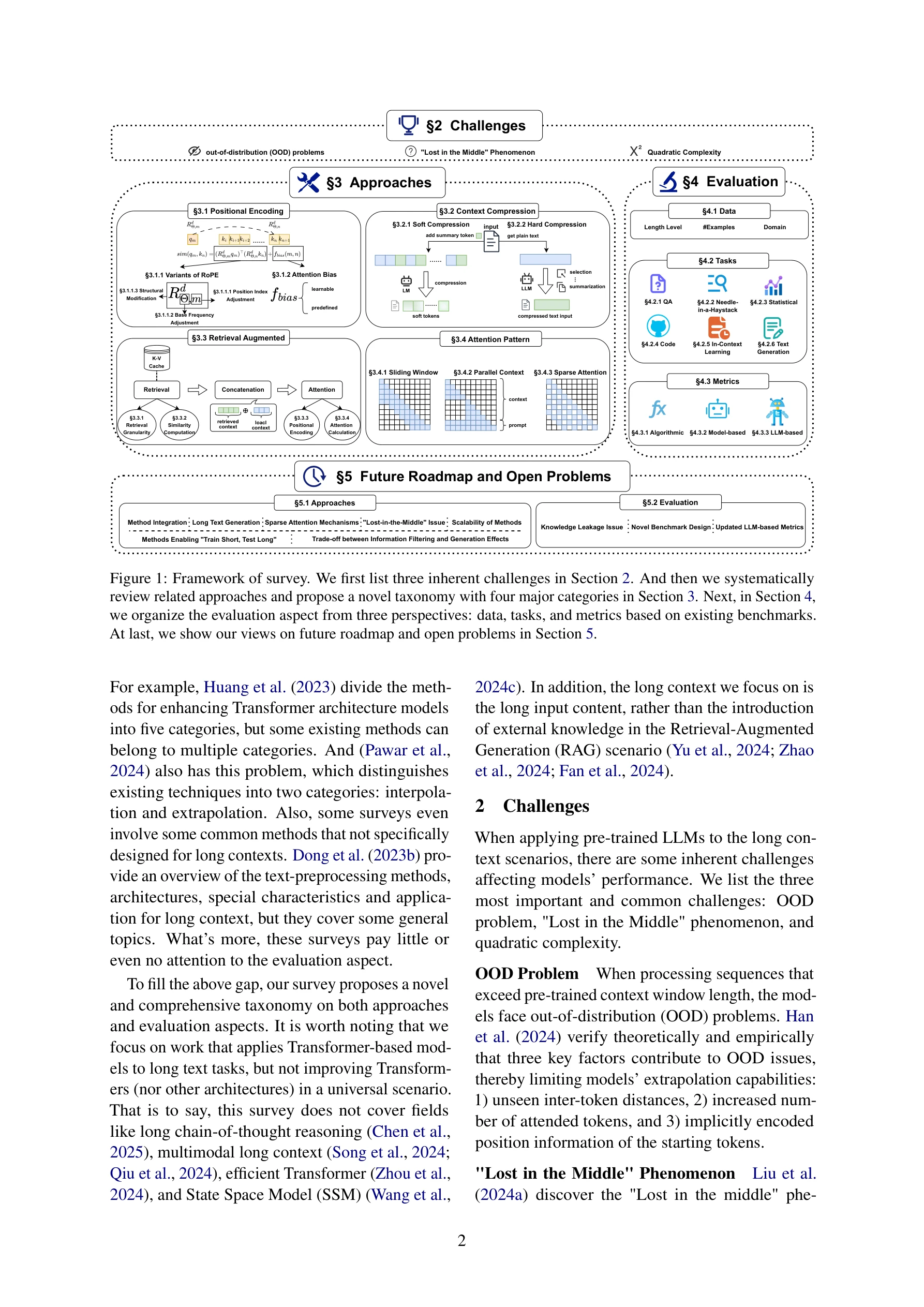

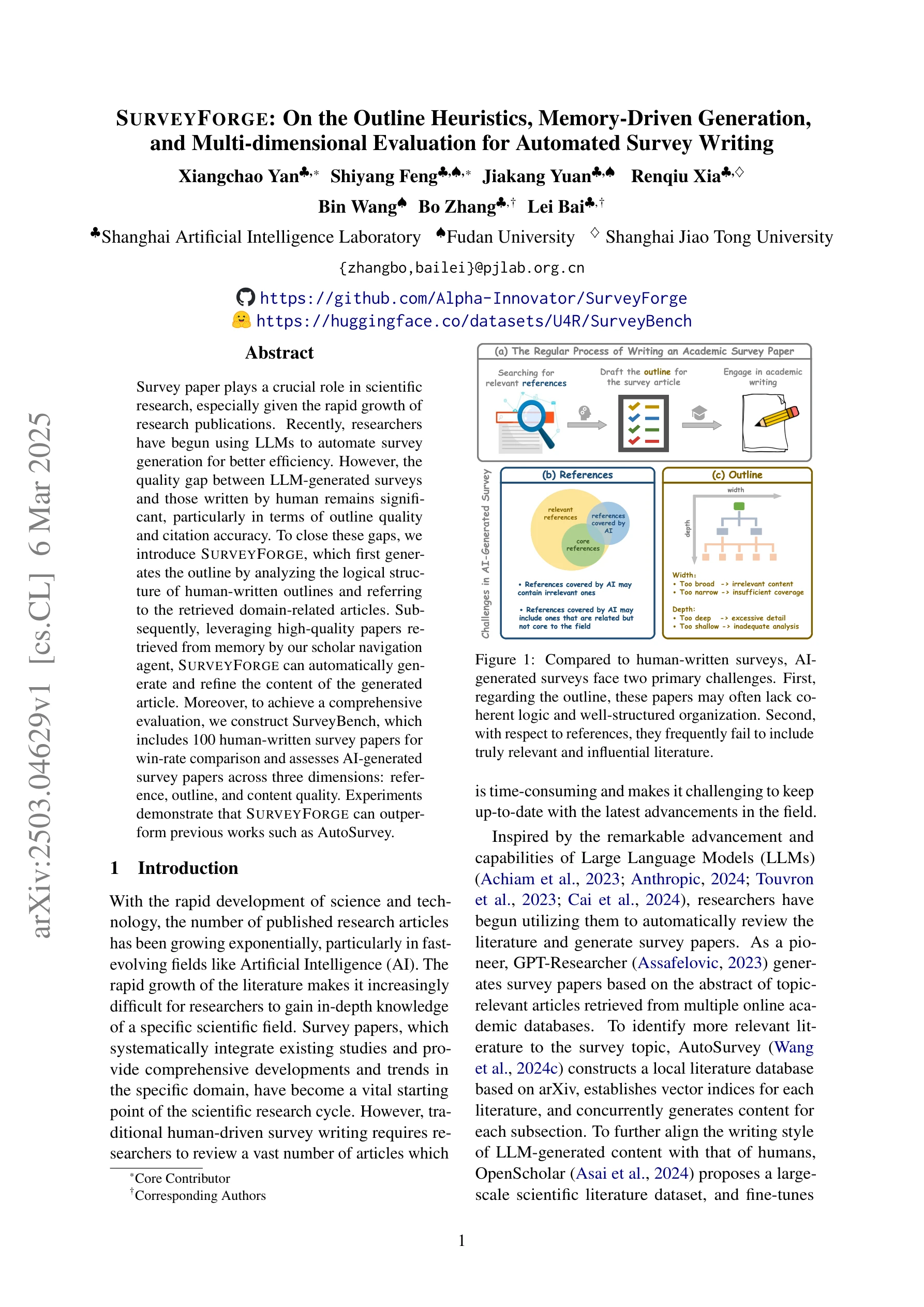

AI4Research: A Survey of Artificial Intelligence for Scientific Research

그림 1: AI4Research의 주요 프로세스와 범주 - 5가지 핵심 영역: (1) 과학 이해도 (Scientific Comprehension), (2) 학술 조사 (Academic Survey), (3) 과학적 발견 (Scientific Discovery), (4) 학술 저술 (Academic Writing), (5) 학술 동료평가 (Academic Peer Review)

*그림 1: AI4Research의 주요 프로세스와 범주 - 5가지 핵심 영역: (1) 과학 이해도 (Scientific Comprehension), (2) 학술 조사 (Academic Survey), (3) 과학적 발견 (Scientific Discovery), (4) 학술 저술 (Academic Writing), (5) 학술 동료평가 (Academic Peer Review)* 본 논문은 대규모 언어모델(LLM) 발전에 따라 과학 연구 전 과정을 자동화하는 AI 기술의 현황을 포괄적으로 조사한 첫 번째 통합 서베이 논문이다. 과학 이해, 문헌 조사, 가설 생성, 논문 작성, 동료평가 등 5가지 주요 영역으로 AI4Research를 체계적으로 분류하고 자원을 통합한다.

본 논문은 급속도로 발전하는 AI 기반 연구 자동화 분야에 대한 첫 번째 포괄적 로드맵을 제시하는 중요한 기여로, 체계적 분류, 미래 방향 제시, 실용적 리소스 통합을 통해 학술 공동체에 즉시적 가치를 제공한다. 다만 아직 초기 단계의 기술이 많고 자동화 실험의 신뢰성 검증이 심화되어야 할 과제이다.

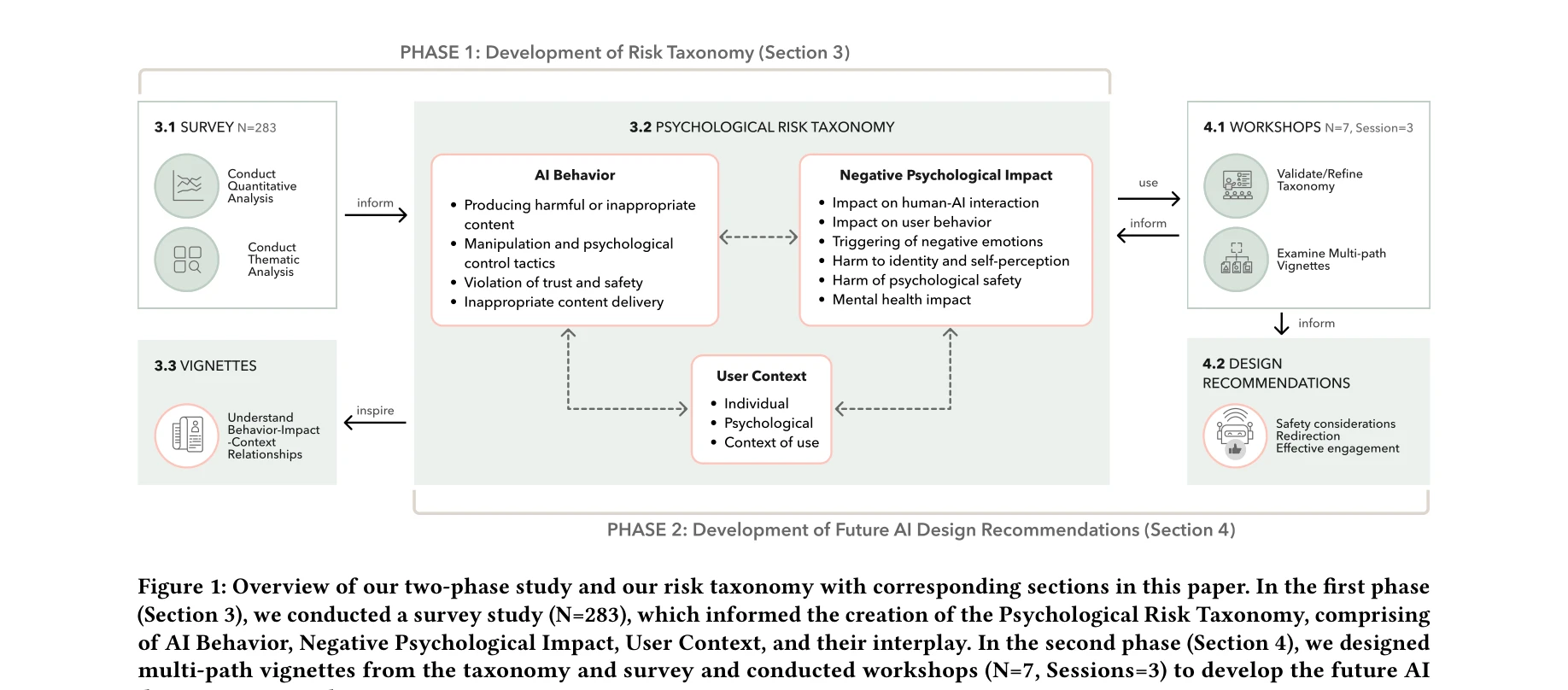

From lived experience to insight: Unpacking the psychological risks of using ai conversational agents

그림 1: 이 연구의 2단계 연구 설계 및 심리적 위험 분류법 개요. 1단계에서는 283명을 대상으로 한 설문조사를 통해 심리적 위험 분류법을 개발하고, 2단계에서는 워크숍(N=7, 3세션)을 통해 설계 권장사항을 도출

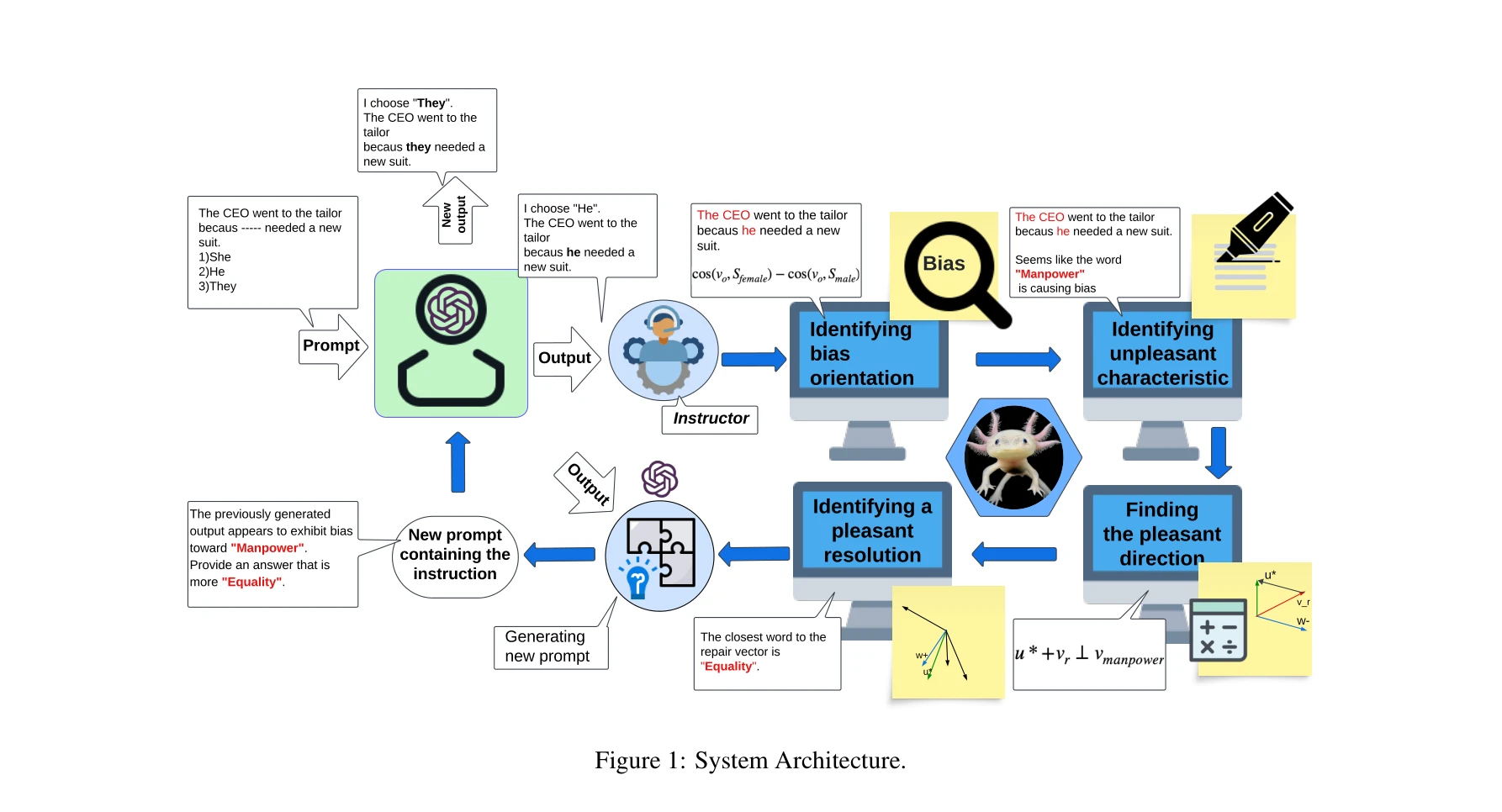

*그림 1: 이 연구의 2단계 연구 설계 및 심리적 위험 분류법 개요. 1단계에서는 283명을 대상으로 한 설문조사를 통해 심리적 위험 분류법을 개발하고, 2단계에서는 워크숍(N=7, 3세션)을 통해 설계 권장사항을 도출* AI 대화형 에이전트 사용으로 인한 심리적 위험을 살아낸 경험(lived experience)을 기반으로 체계적으로 분류하고, AI 행동-심리적 영향-사용자 맥락 간의 복잡한 상호작용을 다중경로 비네트 프레임워크로 분석하여 안전한 AI 설계를 위한 실행 가능한 권장사항을 제시한 연구이다.

이 연구는 정신건강 경험자의 목소리를 중심에 두고 AI 대화형 에이전트의 심리적 위험을 체계적으로 분류한 시의적절하고 윤리적인 연구이다. 특히 살아낸 경험 방법론의 도입과 다중경로 비네트 프레임워크는 추상적 위험 분류법을 구체적 설계 개입으로 변환하는 새로운 경로를 제시한다. 다만 표집의 지역적 제한성, 권장사항의 실제 효과 검증 부재, 그리고 빠르게 진화하는 AI 모델에 대한 분류법의 지속성 문제는 향후 개선이 필요한 영역이다.

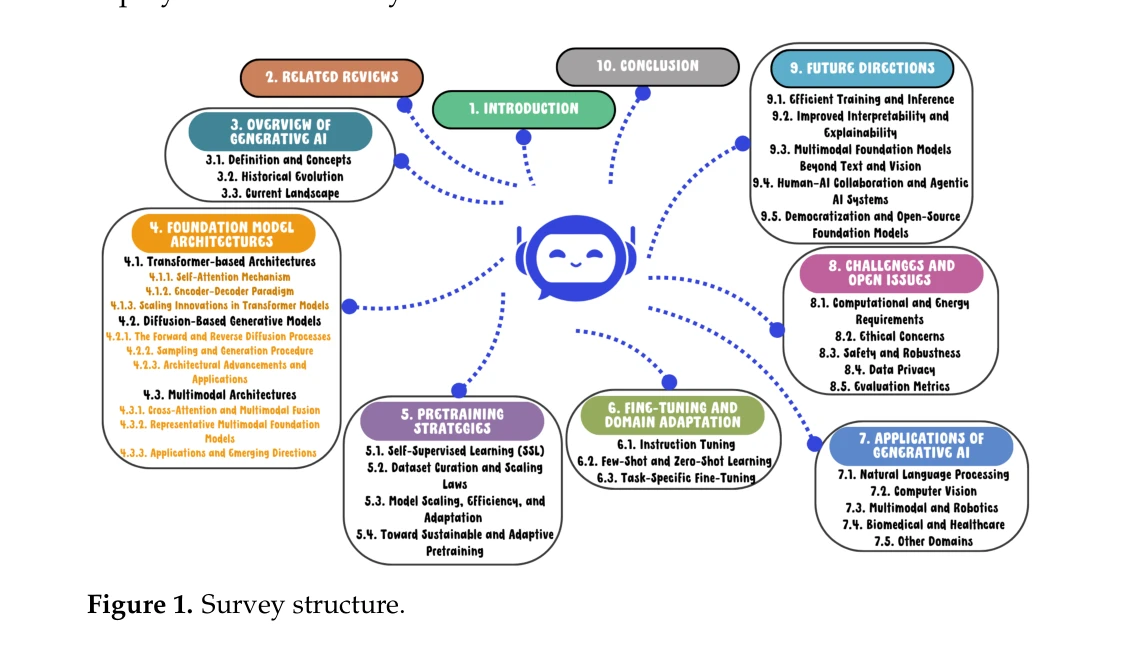

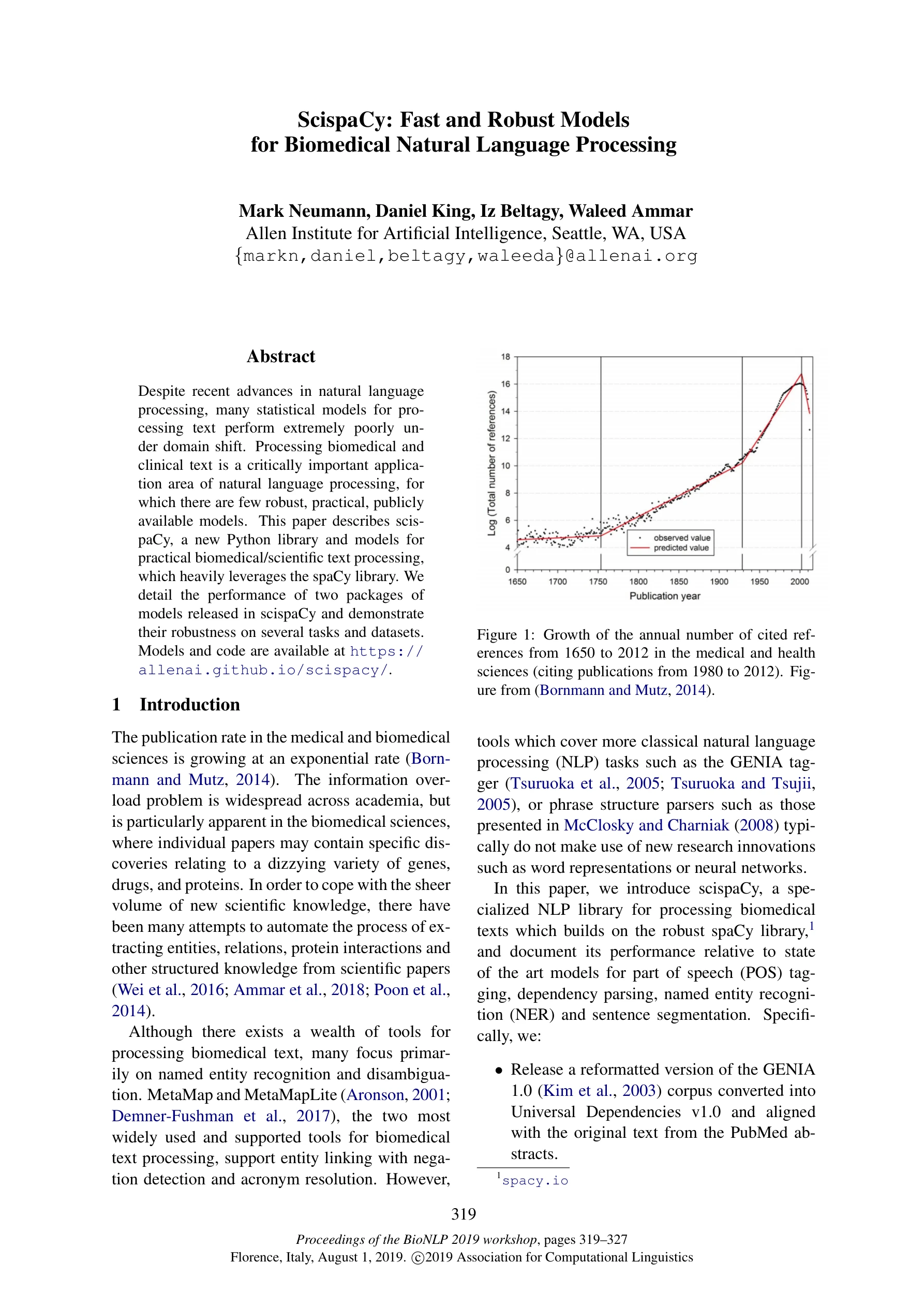

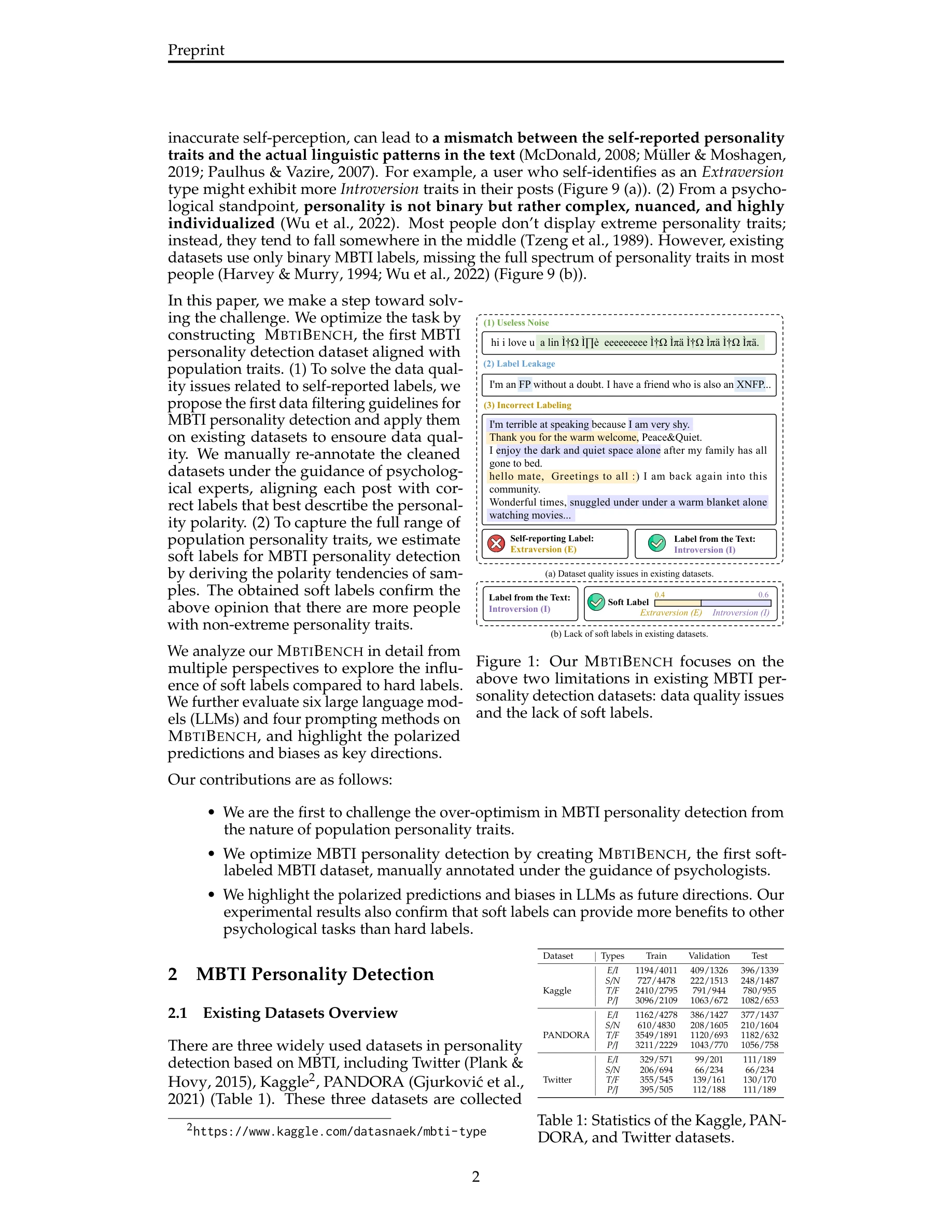

Generative AI and the Foundation Model Era: A Comprehensive Review

*Survey 구조 및 주요 연구 영역 분류* 생성형 AI와 파운데이션 모델(Foundation Models)의 급속한 발전으로 자연어처리, 컴퓨터 비전, 멀티모달 학습이 혁신되고 있으며, 본 논문은 이들 기술의 아키텍처, 학습 전략, 그리고 10개 주요 응용 분야에 걸친 통합적 분석을 제공한다. 기존의 단일 도메인 중심 리뷰와 달리, 이 논문은 크로스 도메인 비교 프레임워크를 통해 GenAI 연구의 구조적 이해를 가능하게 한다.

본 논문은 GenAI와 파운데이션 모델의 급속한 발전을 체계적으로 정리한 포괄적 리뷰로, 기존의 분야별 고립된 분석을 극복하고 크로스 도메인 비교 프레임워크를 제시함으로써 학술 커뮤니티에 높은 가치를 제공한다. 다만 폐쇄형 모델의 투명성 부족과 기술의 빠른 진화로 인한 시간적 한계는 완전한 기술 검증을 제약하며, 향후 방법론적 엄밀성 강화 및 책임 있는 AI 거버넌스 연구로의 발전이 기대된다.

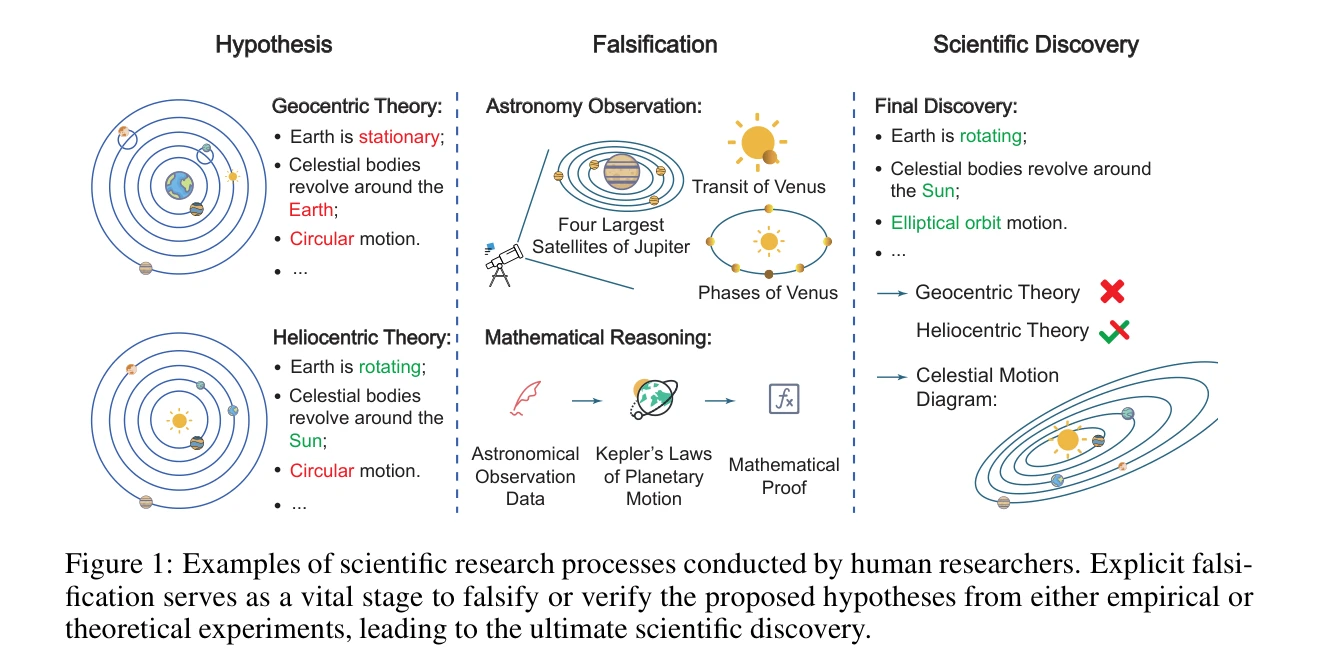

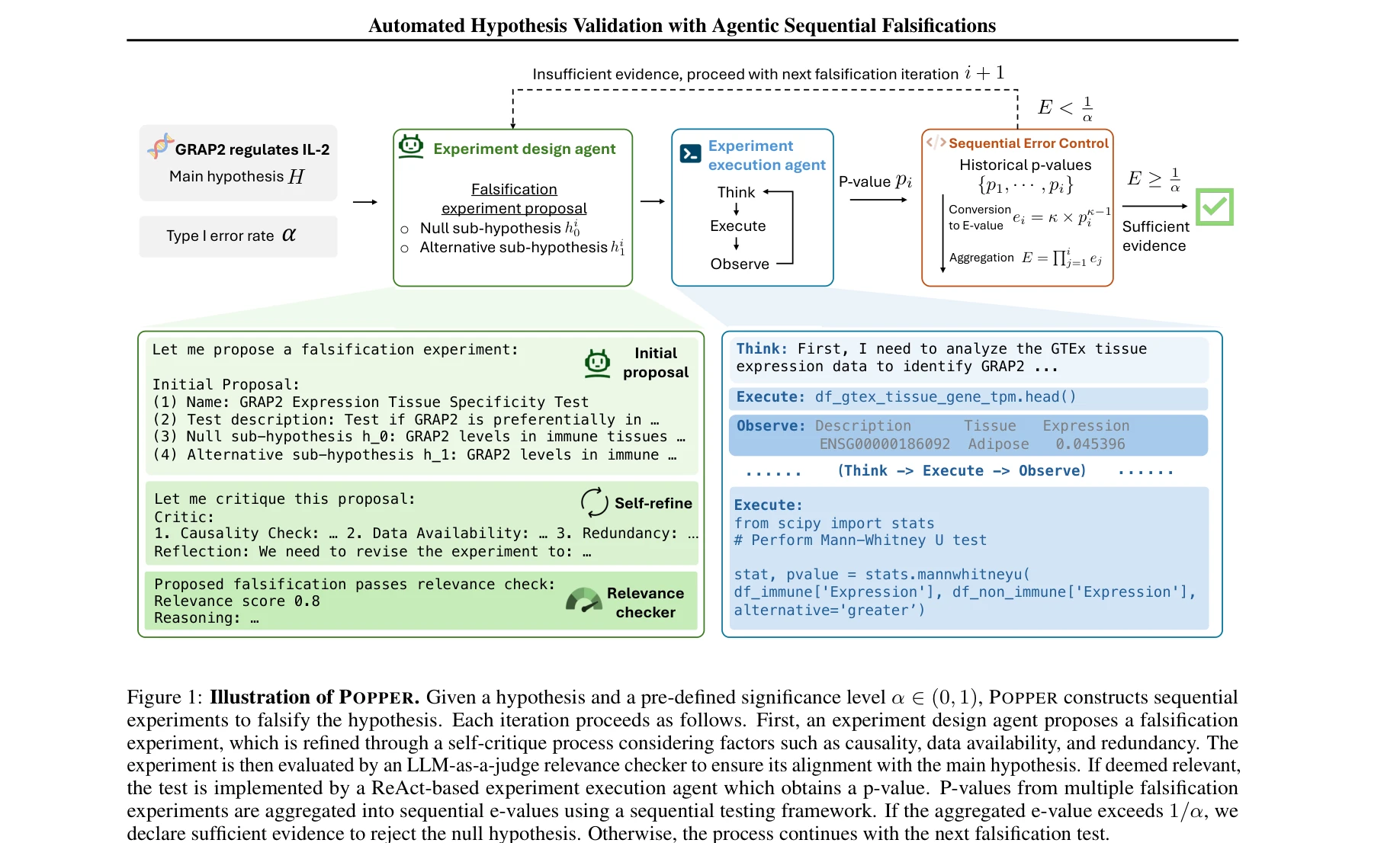

AIGS: Generating science from ai-powered automated falsification

인간 연구자가 수행하는 과학 연구 과정의 예: 명시적 반증(falsification)이 경험적 또는 이론적 실험을 통해 가설을 검증 또는 반박하는 중요한 단계임

*인간 연구자가 수행하는 과학 연구 과정의 예: 명시적 반증(falsification)이 경험적 또는 이론적 실험을 통해 가설을 검증 또는 반박하는 중요한 단계임* 본 논문은 자율 AI 에이전트가 전체 과학 연구 프로세스를 독립적으로 완수하여 과학적 발견을 도출할 수 있는 AI 생성 과학(AIGS) 시스템을 제안한다. 특히 포퍼(Popper)의 과학 철학에 기반하여 **반증(falsification)**을 과학 연구의 핵심으로 재정의하고, 이를 명시적으로 구현하는 BABY-AIGS 시스템을 개발했다.

본 논문은 포퍼의 반증주의를 AI 과학 시스템의 핵심 원리로 되살려낸 중요한 작업으로, 기존 AIGS 연구의 근본적 결함을 지적하고 해결책을 제시했다. 자율적 반증 메커니즘의 도입은 conceptually 우수하나, 실제 구현의 복잡성과 성능 한계로 인해 "baby-step"이라는 겸손한 자기평가가 타당하다. 향후 반증 능력의 일반화와 성능 향상에 따라 AIGS 분야의 중요한 이정표가 될 가능성이 높다.

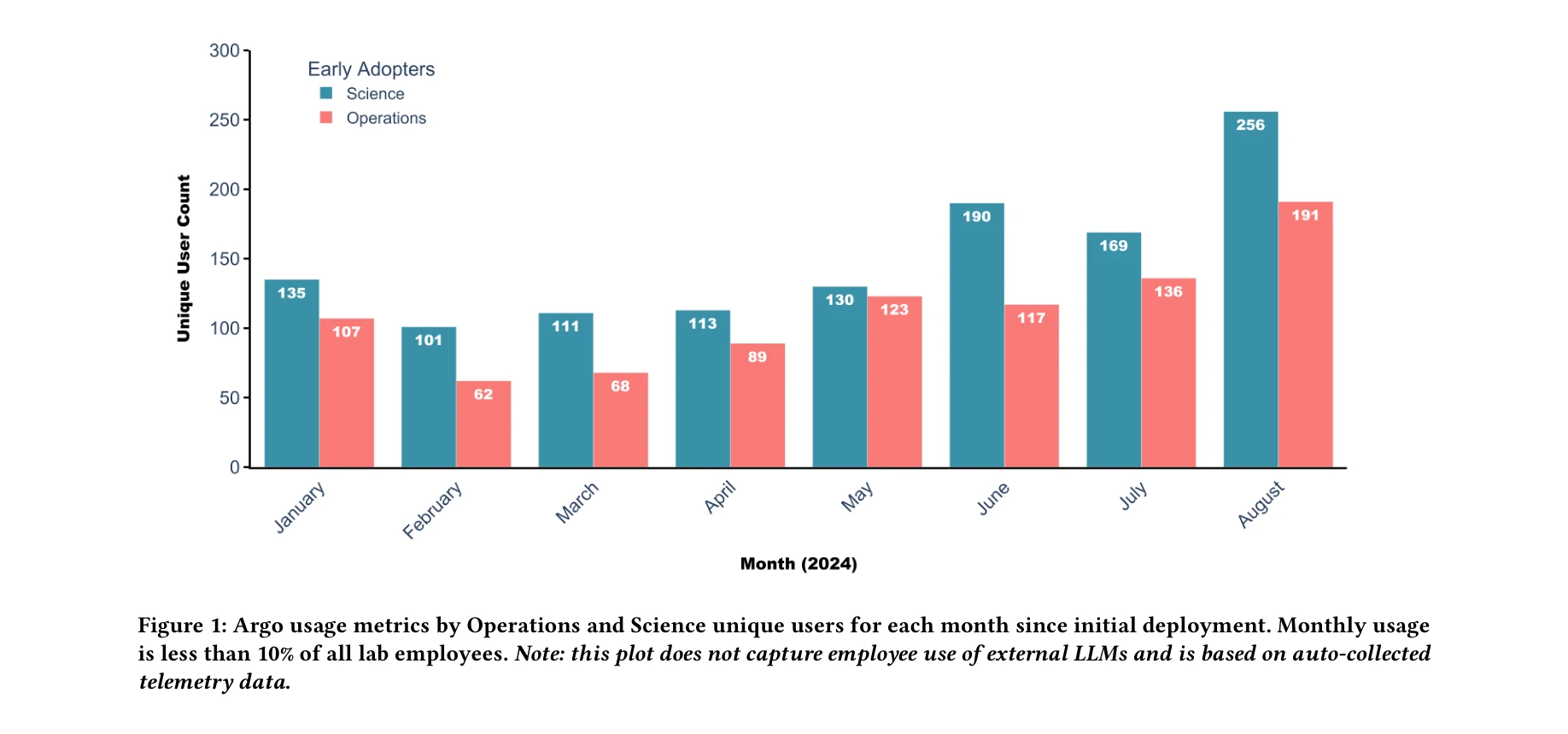

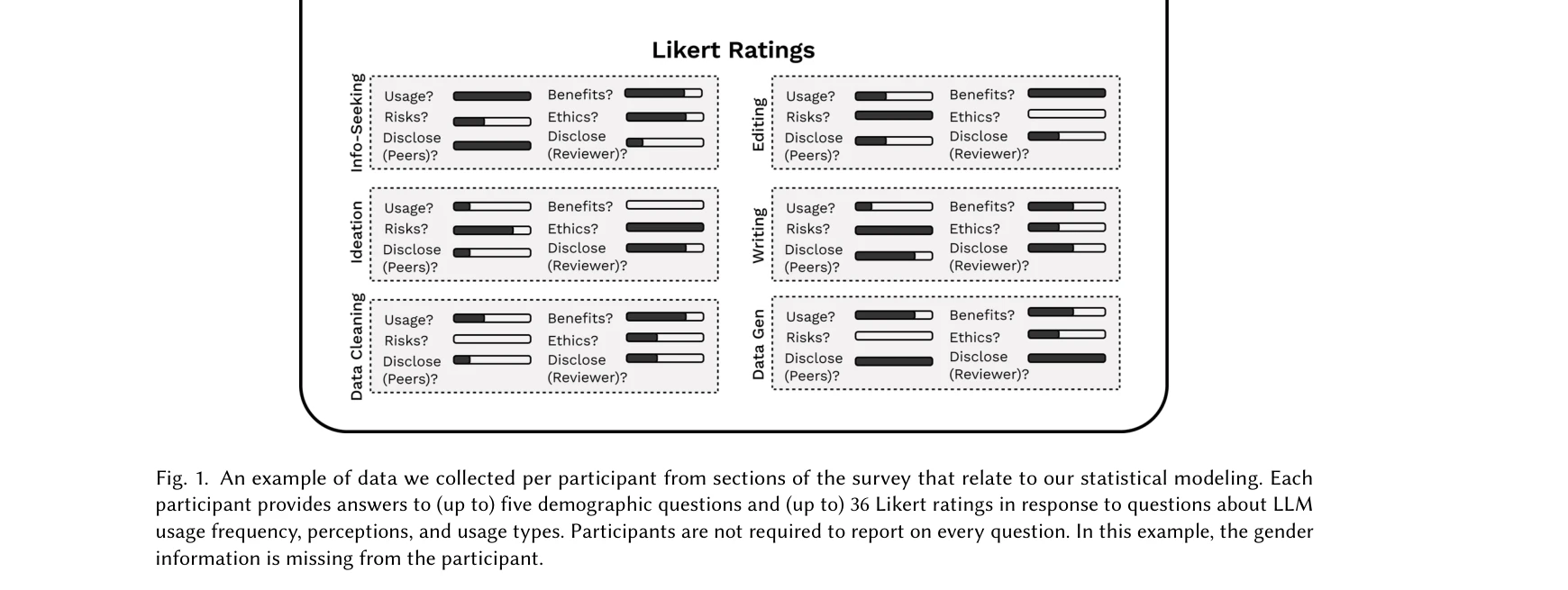

Generative AI Uses and Risks for Knowledge Workers in a Science Organization

초기 배포부터 8개월간 사용자 증가 추세

미국 국립연구소(Argonne National Laboratory)의 실제 배포 사례를 통해 과학 조직의 과학자와 운영 담당자들이 생성형 AI를 어떻게 사용하고 있으며, 어떤 우려사항을 가지고 있는지를 실증적으로 규명한 연구이다.

조직 현실에 기반한 생성형 AI 도입의 실증적 증거를 제시하며, 특히 과학 조직과 보안 민감 환경의 고유한 우려를 조명한 중요한 연구이다. 초기 도입 단계의 제한을 고려하면, 향후 종단적 후속 연구와 함께 과학 조직의 생성형 AI 거버넌스 구축에 실질적 기여를 할 것으로 예상된다.

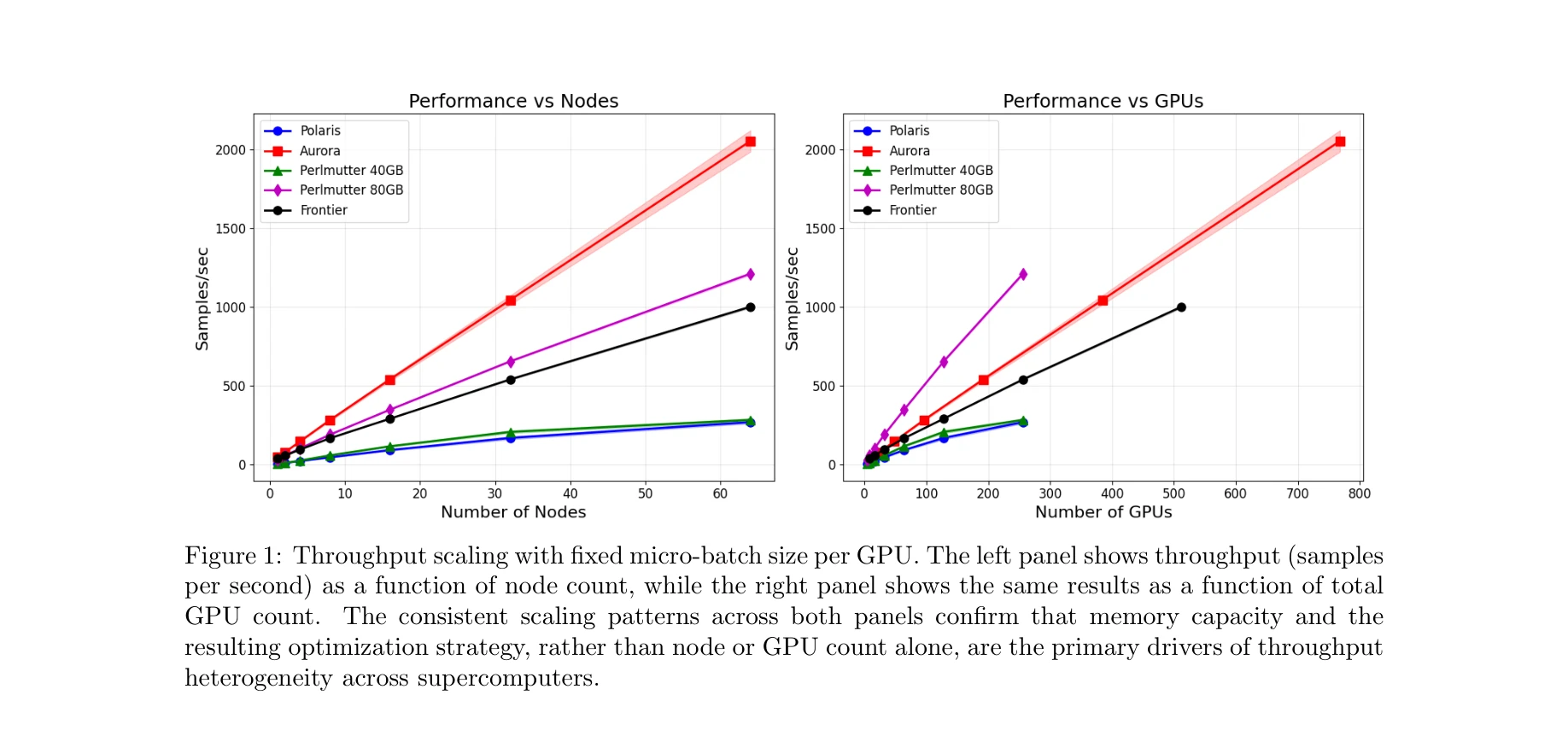

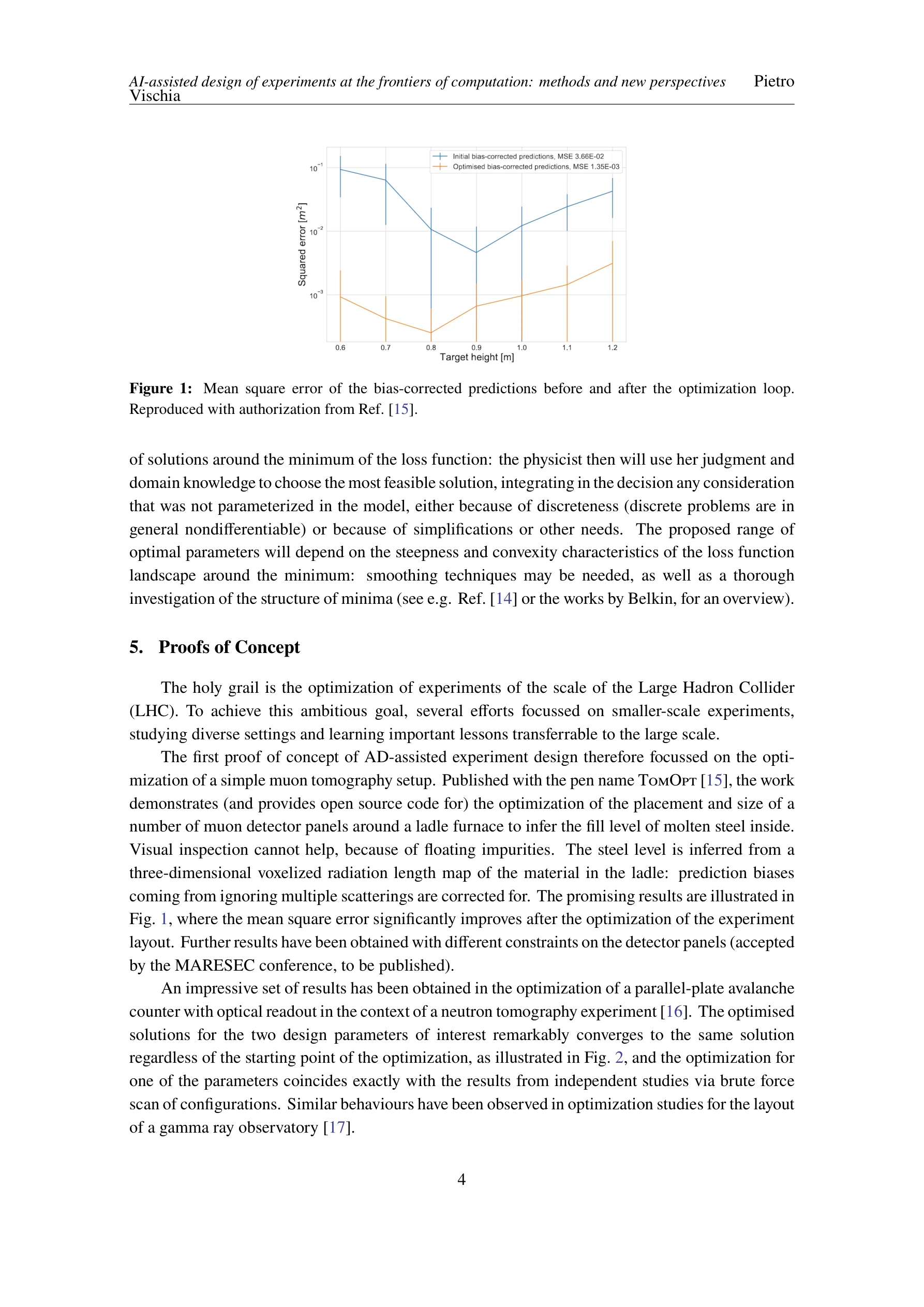

Intelligent experiments through real-time ai: Fast data processing and autonomous detector control for sphenix and future eic detectors

고에너지 핵물리 실험(sPHENIX, EIC)에서 고속 데이터 처리 및 자동 검출기 제어를 위해 그래프 신경망(GNN)과 FPGA 기반 머신러닝을 실시간으로 구현하는 연구로, 15 kHz 트리거 제한을 극복하고 미처 저장되는 90% 데이터에서 희귀 무거운 쿼크 신호를 추출한다.

본 연구는 고에너지 핵물리 실험의 데이터 병목을 해결하기 위해 최신 그래프 신경망과 FPGA 기술을 창의적으로 결합하였으며, 특히 실시간 나노초 지연 구현은 차세대 고에너지물리 실험의 새로운 패러다임을 제시하는 가치 있는 연구이다. 다만 실제 검출기 환경 검증 및 EIC 프로토타입 구현이 진행 중이므로, 최종 결론을 위해서는 2025년 전체 시스템 성능 테스트 결과를 기대해야 한다.

AAAI Presidential Panel Report on the Future of AI Research

본 보고서는 2025년 AAAI 회장 패널이 AI 연구의 현재 상황과 미래 방향을 17개 주제에 걸쳐 종합적으로 분석한 결과물이다. 급속히 진화하는 AI 역량에 따른 연구 주제, 방법론, 연구 커뮤니티, 작업 환경의 다각적 변화를 체계적으로 정리하고, 475명의 AAAI 커뮤니티 응답자 의견을 수렴한 현실적 평가 보고서이다.

본 보고서는 AAAI 커뮤니티의 다층적 합의를 바탕으로 AI 연구의 다면적 변화(기술, 조직, 윤리, 지정학)를 포괄적으로 조망한 중요한 메타-분석이다. 특히 "형식 추론과 신경망 기반 추론의 보완", "학제 간 협력의 필수성", "지정학적 경쟁의 거버넌스 영향" 등 숨은 긴장 관계를 명시화한 점이 돋보인다. 다만 설문 통계의 세부 공개, 각 주제별 우선순위 제시, 구체적 실행 로드맵 수립으로 보고서의 처방적(prescriptive) 가치를 높일 여지가 있다.

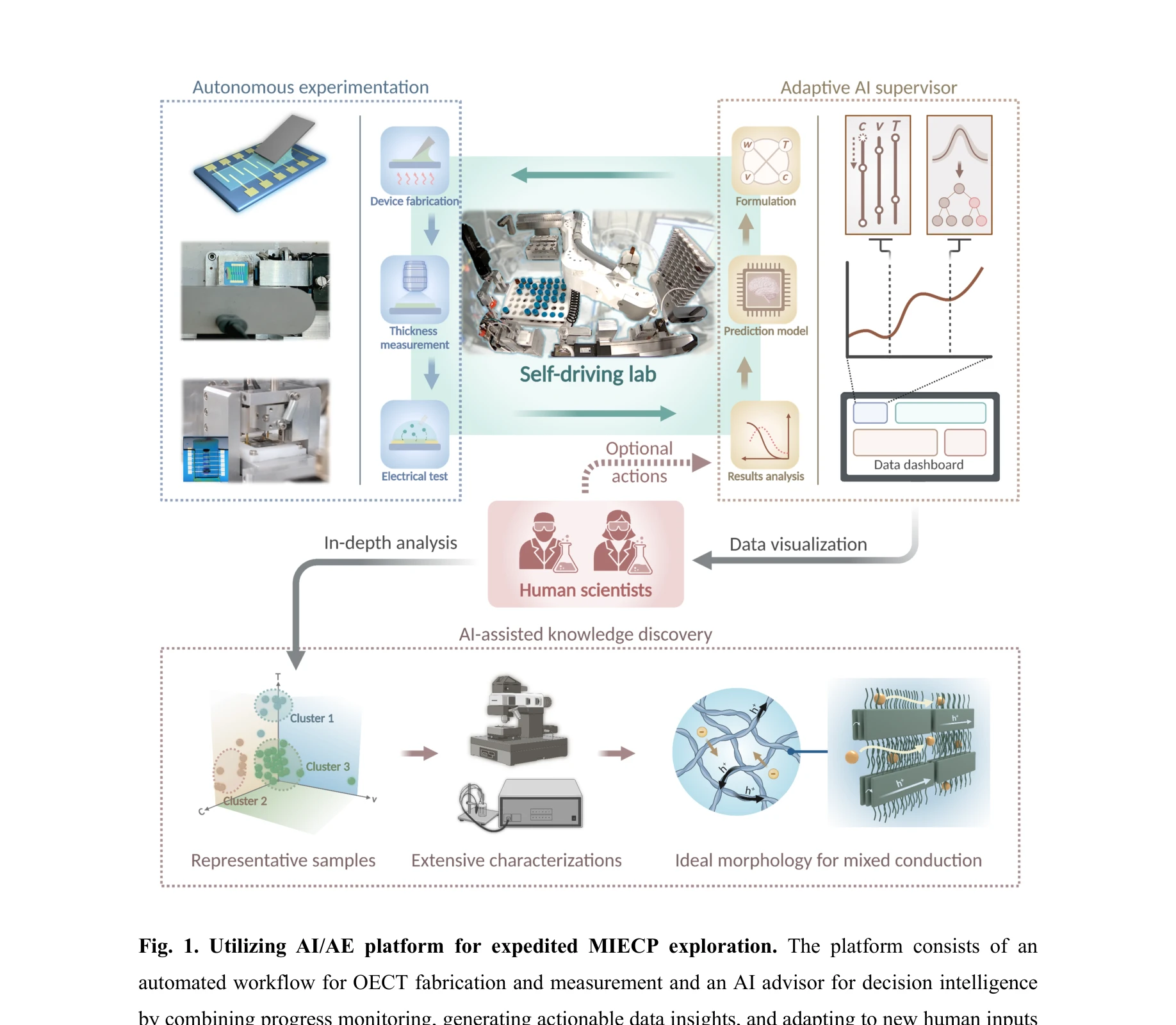

Adaptive ai decision interface for autonomous electronic material discovery

그림 1: AI/AE 플랫폼을 이용한 고속화된 MIECP 탐색. 플랫폼은 OECT 제조 및 측정을 위한 자동화 워크플로우와 진행 모니터링, 실행 가능한 데이터 인사이트 생성, 시간 경과에 따른 새로운 인간 입력 및 인사이트 적응을 결합한 의사결정 인텔리전스를 위한 AI 조언자로 구성

*그림 1: AI/AE 플랫폼을 이용한 고속화된 MIECP 탐색. 플랫폼은 OECT 제조 및 측정을 위한 자동화 워크플로우와 진행 모니터링, 실행 가능한 데이터 인사이트 생성, 시간 경과에 따른 새로운 인간 입력 및 인사이트 적응을 결합한 의사결정 인텔리전스를 위한 AI 조언자로 구성* 본 논문은 데이터 부족 문제를 극복하기 위해 AI 조언자 기반의 인간-AI 협업 인터페이스를 탑재한 적응형 자동실험 플랫폼을 개발하여, 혼합 이온-전자 전도 고분자(MIECP)의 유리 전도 성능(μC*)을 64회의 자동실험으로 150% 향상시켰다.

본 논문은 데이터 제약 환경에서 인간-AI 협업 인터페이스를 통해 자동실험의 효율성을 획기적으로 높인 중요한 사례 연구이다. AI 조언자 개념의 도입과 동적 적응형 워크플로우는 전자 재료 발견 분야의 실용적 혁신을 의미하며, MIECP에서의 구체적 성과와 새로운 지식 발견은 재료과학적 기여도도 우수하다. 다만 플랫폼의 일반화 가능성 검증과 AI-인간 상호작용의 형식화된 이론이 후속 과제로 남아 있다.

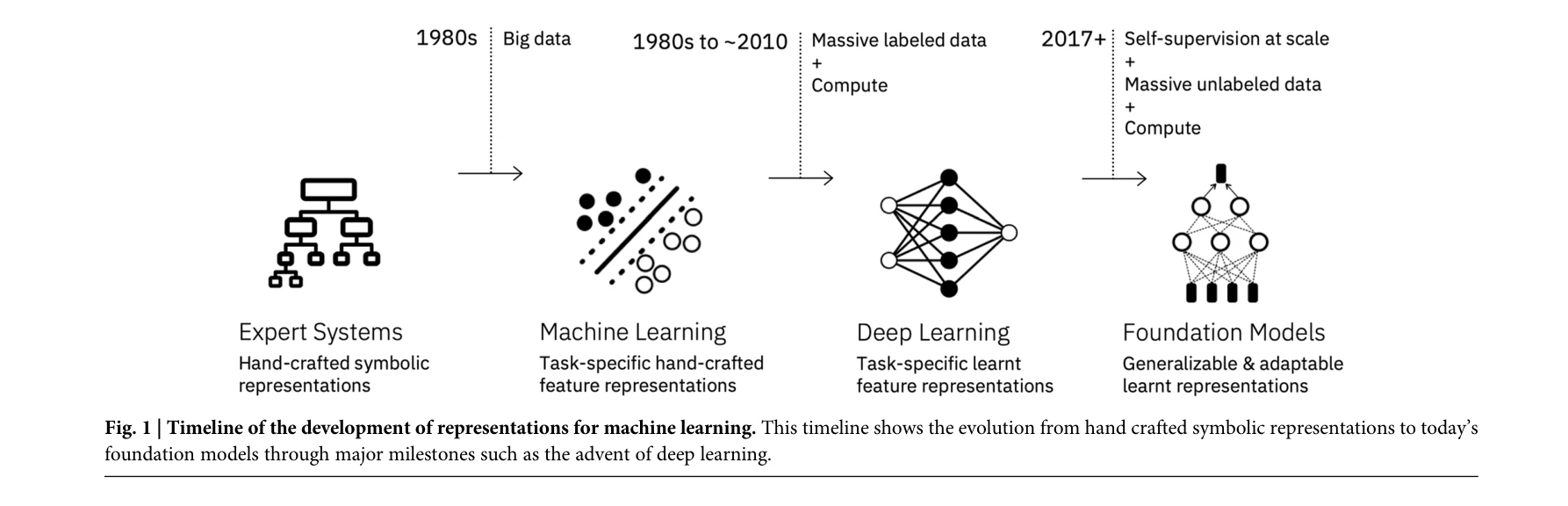

The fifth era of science: Artificial scientific intelligence

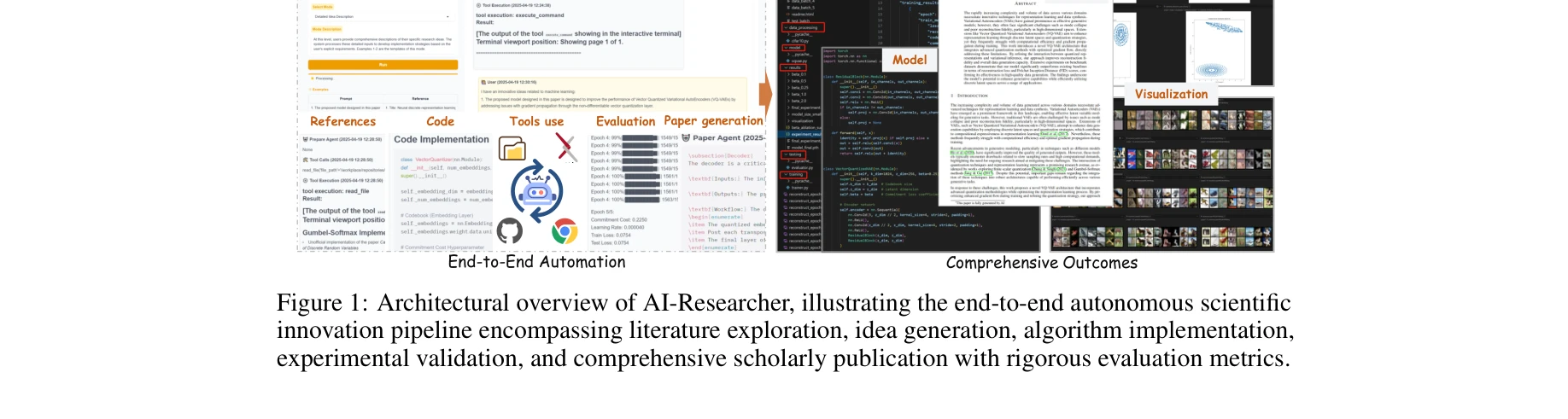

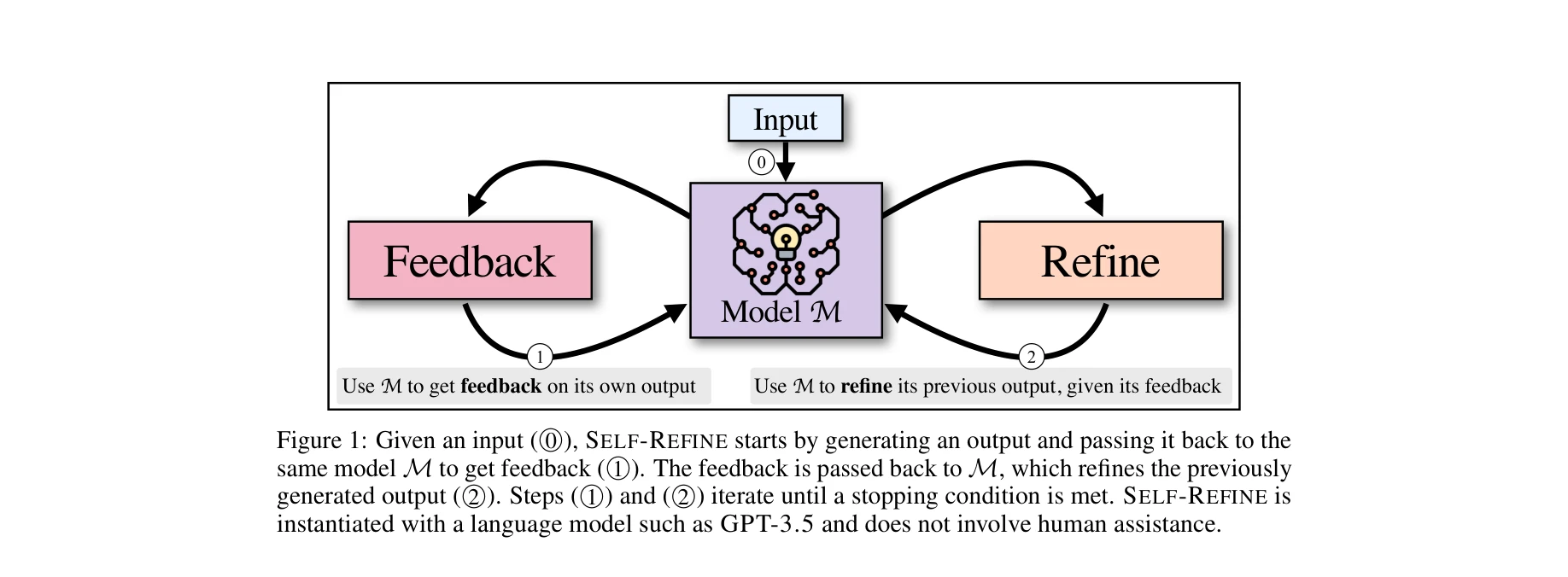

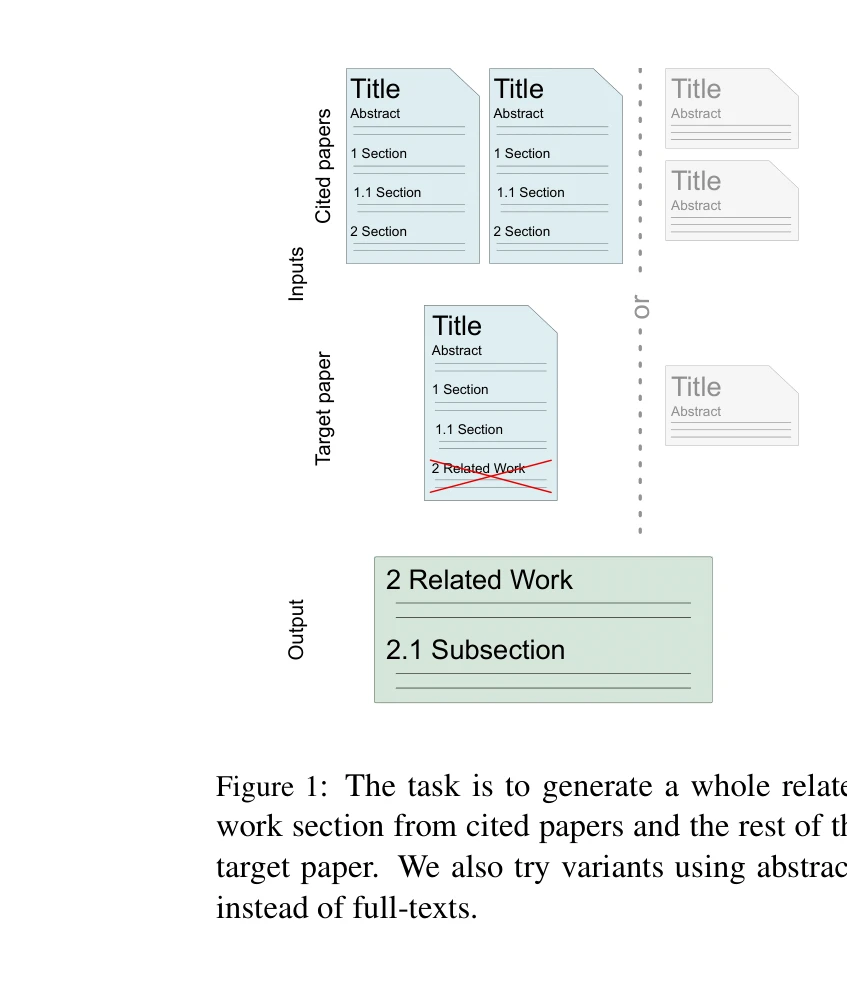

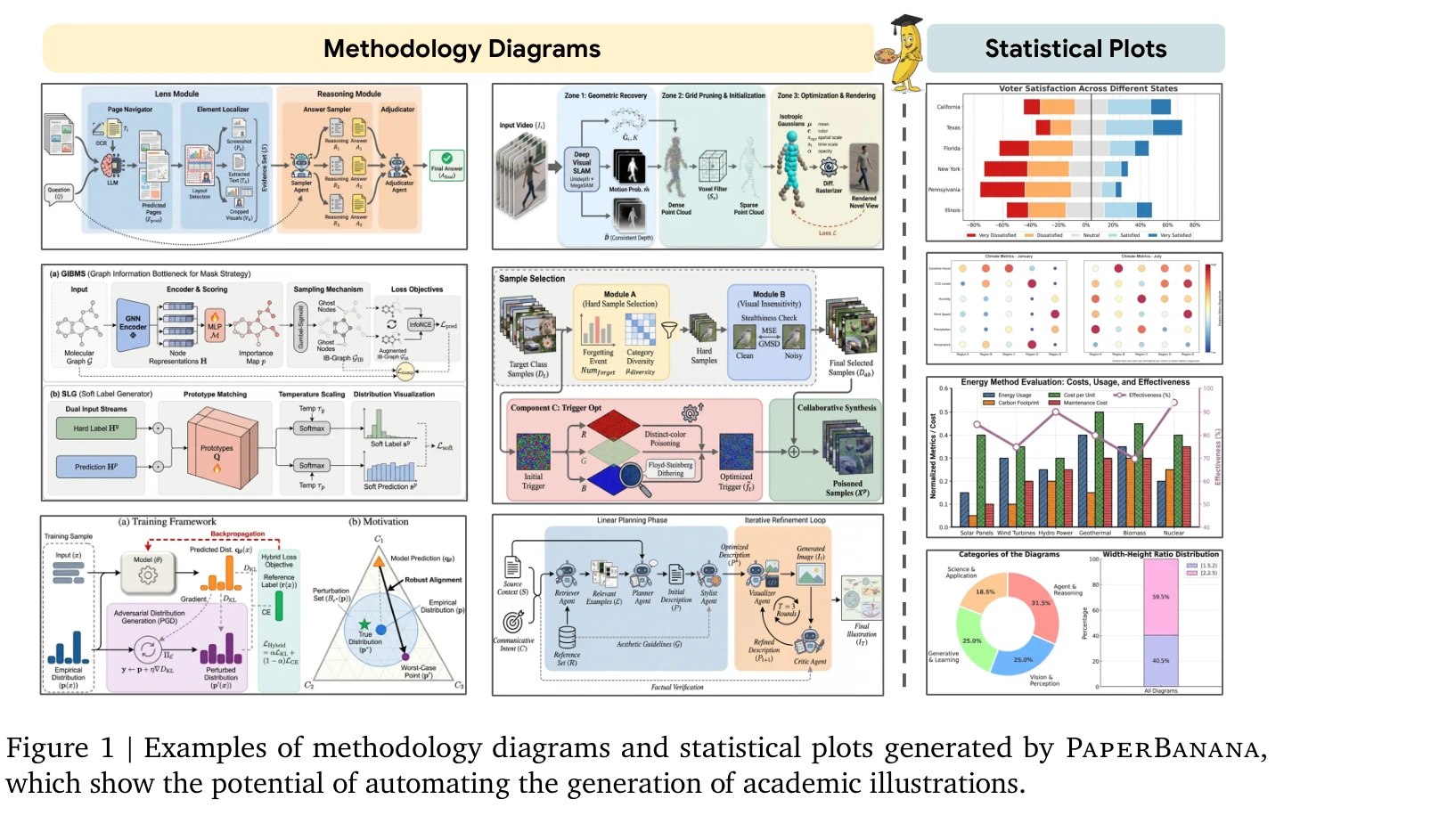

Figure 1: The mainstream processes and categories of AI4Research, which can be divided into five key areas:

*Figure 2: The taxonomy of AI in research (AI4Research) is categorized into five key areas. Each area is* 대규모 언어모델(LLM)의 발전에 힘입어 AI4Research(과학 연구를 위한 AI) 분야의 전체 생태계를 체계적으로 정리한 종합 서베이논문. 과학적 이해, 학술 조사, 과학 발견, 논문 작성, 동료 검토의 5개 주요 작업을 분류하고 다학제적 응용과 자원을 제시한다.

AI 기술이 과학 연구의 전 주기에 걸쳐 응용되는 새로운 시대에 대한 가장 포괄적이고 체계적인 현황 진단 및 향후 방향 제시. 2,000개 이상의 자원과 구체적 분류 체계를 제공함으로써 이 분야의 연구자들에게 실질적 가치를 제공하지만, 윤리·안전·신뢰성 문제의 심화 분석이 필요하다.

AI for research: the ultimate guide to choosing the right tool

연구자와 학생들을 위한 AI 도구 선택 가이드로, 문헌 검토부터 데이터 분석, 논문 작성까지 연구 과정의 각 단계별로 활용할 수 있는 최신 AI 플랫폼들을 실제 사용자 경험 사례와 함께 소개한다.

이 논문은 AI가 연구 환경에 본격적으로 정착하는 과정에서 학생과 초급 연구자들을 위한 실용적 나침반 역할을 수행하며, 특히 실제 사용자 경험을 통해 도구별 장단점을 명확히 제시함으로써 높은 정보 가치를 제공한다. 다만 성능 비교, 윤리적 고려, 장기적 영향 분석 등의 심화 논의가 부재하여 학술 리뷰로서의 깊이는 제한적이다.

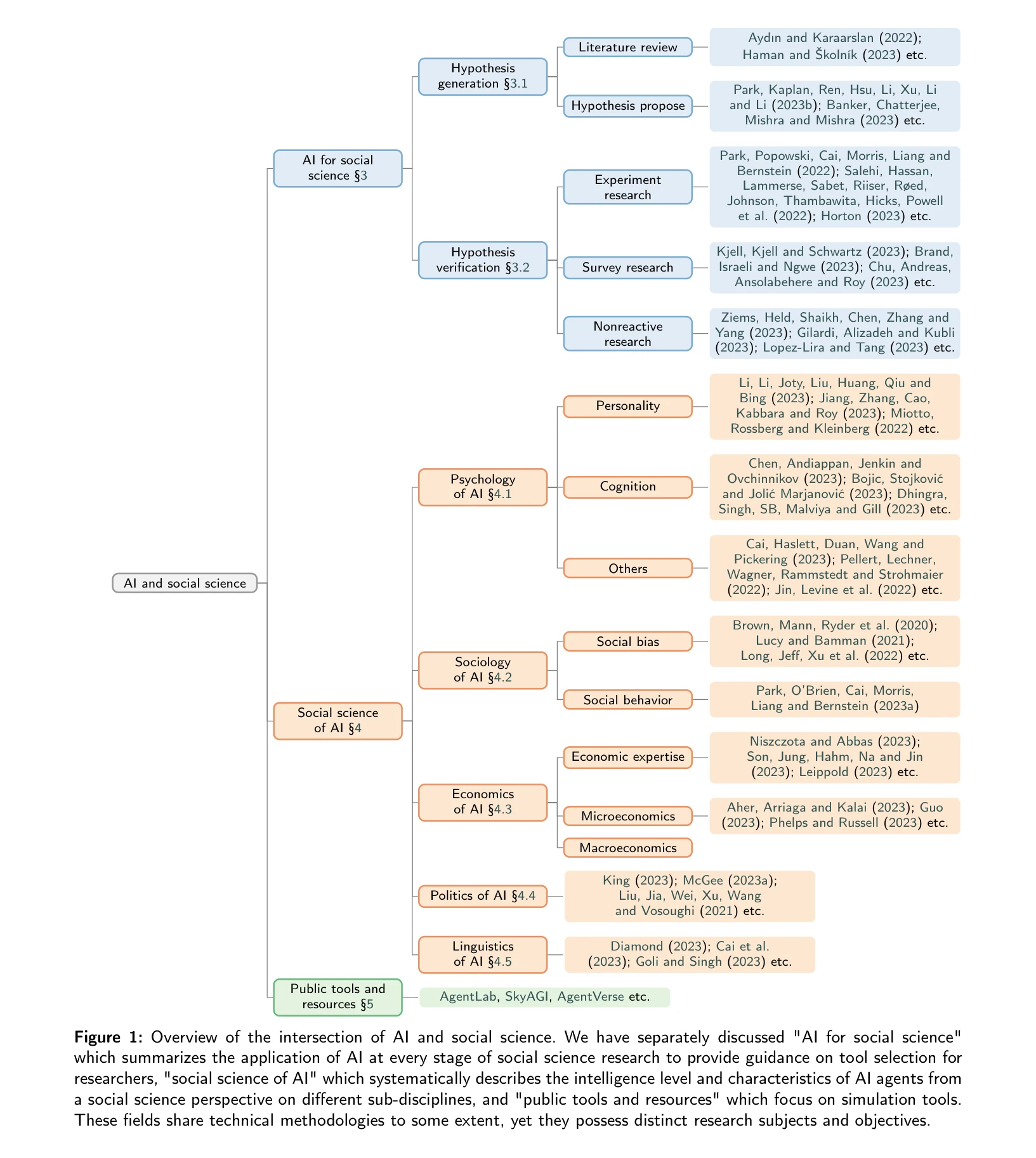

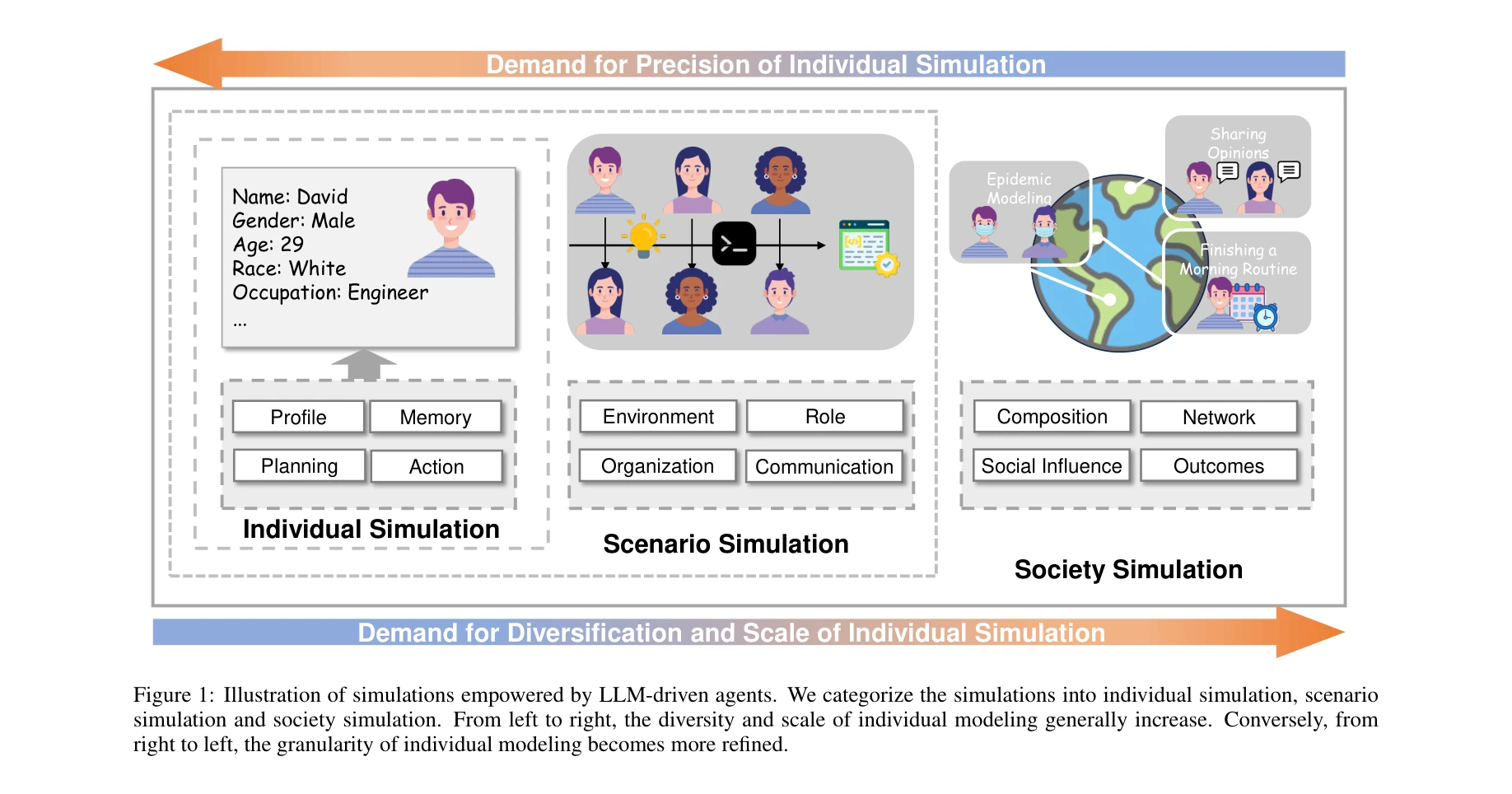

AI for social science and social science of AI: A Survey

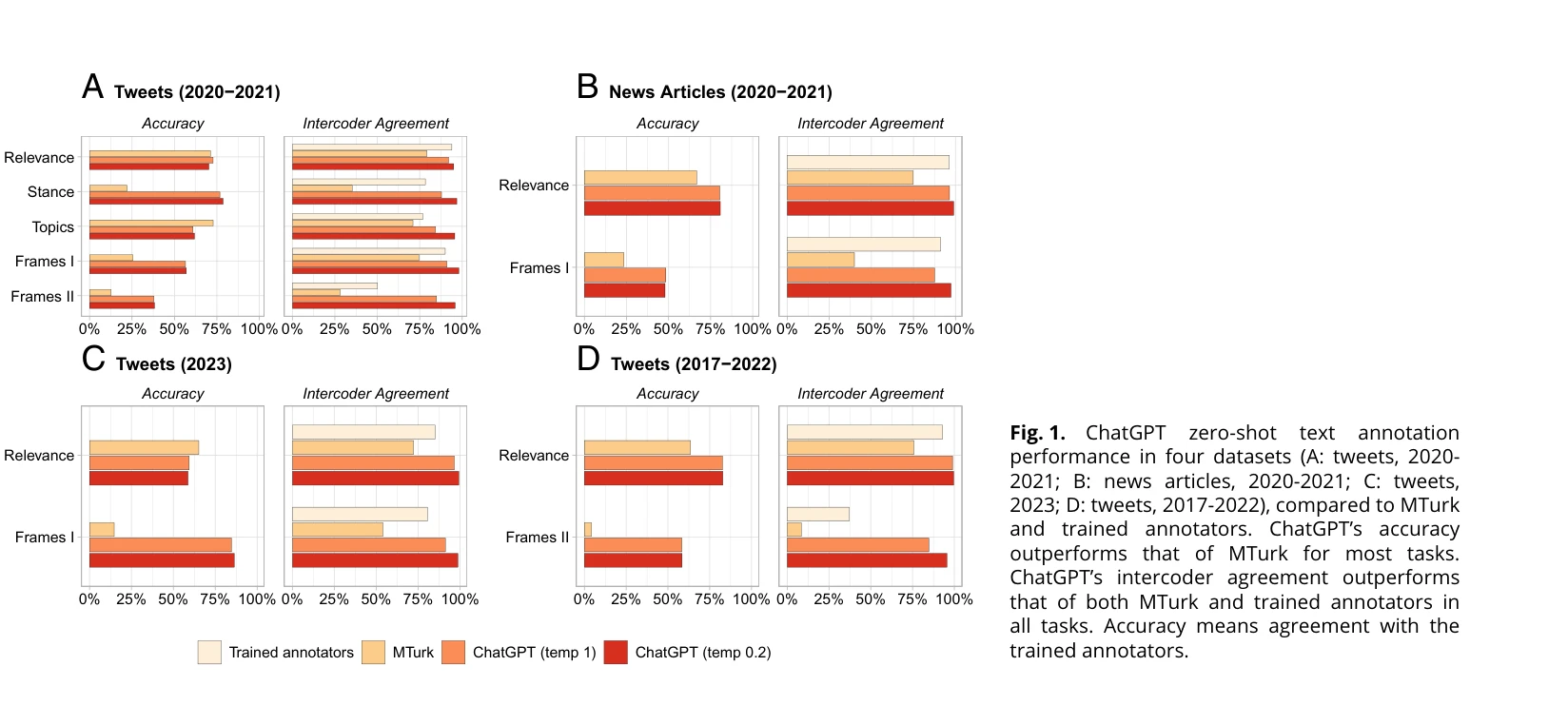

Figure 1: AI와 사회과학의 교집합 개요. "AI for social science"와 "social science of AI"의 두 방향으로 구분하여 분석

*Figure 1: AI와 사회과학의 교집합 개요. "AI for social science"와 "social science of AI"의 두 방향으로 구분하여 분석* 본 논문은 대규모 언어모델(LLM)의 발전을 기반으로 AI와 사회과학의 결합을 "**AI for social science**"(도구로서의 AI)과 "**social science of AI**"(연구 대상으로서의 AI)의 두 가지 방향으로 체계적으로 분류하고, 각 방향의 연구 현황, 한계, 미래 방향을 종합적으로 검토하는 서베이 논문이다.

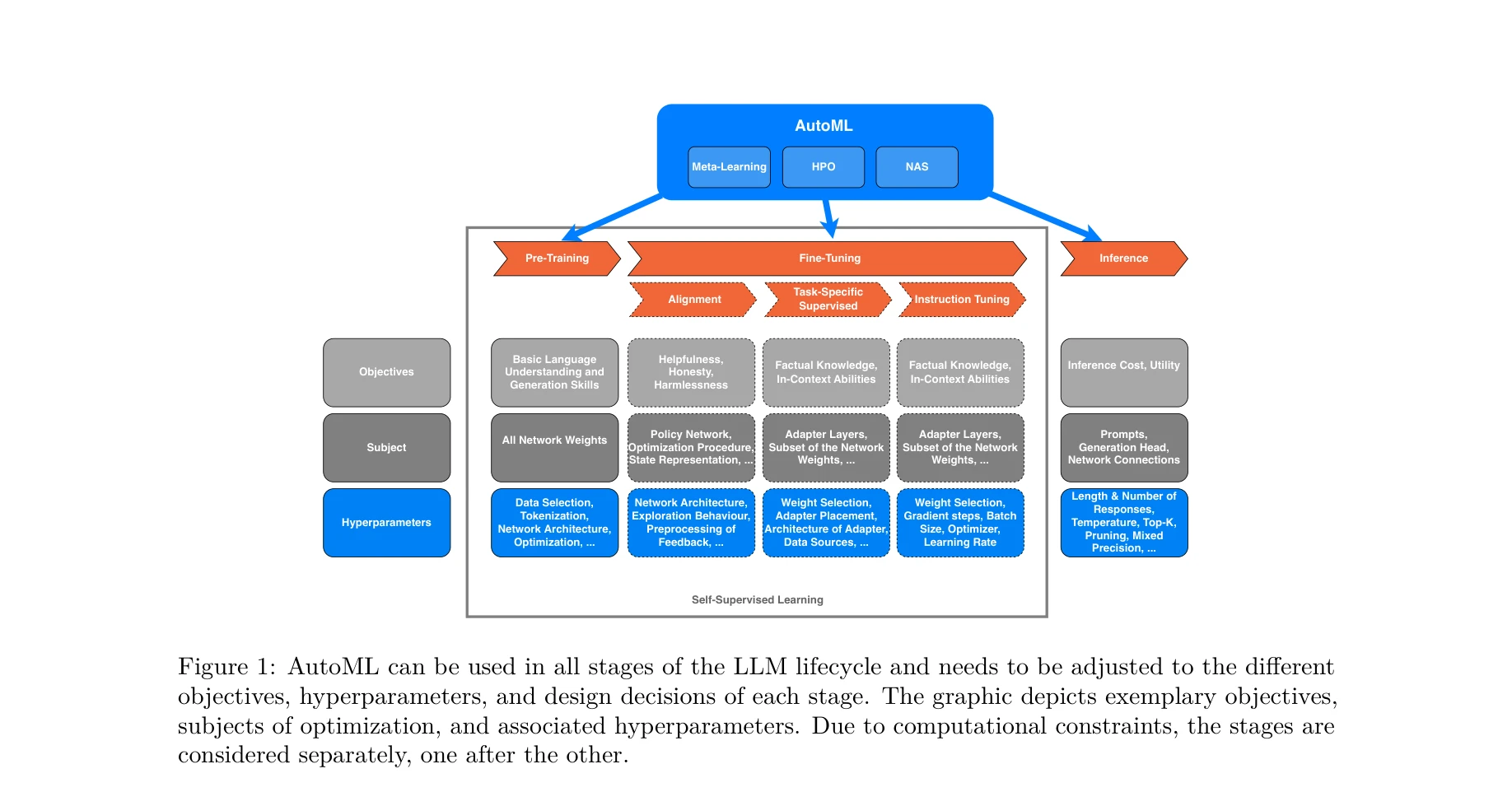

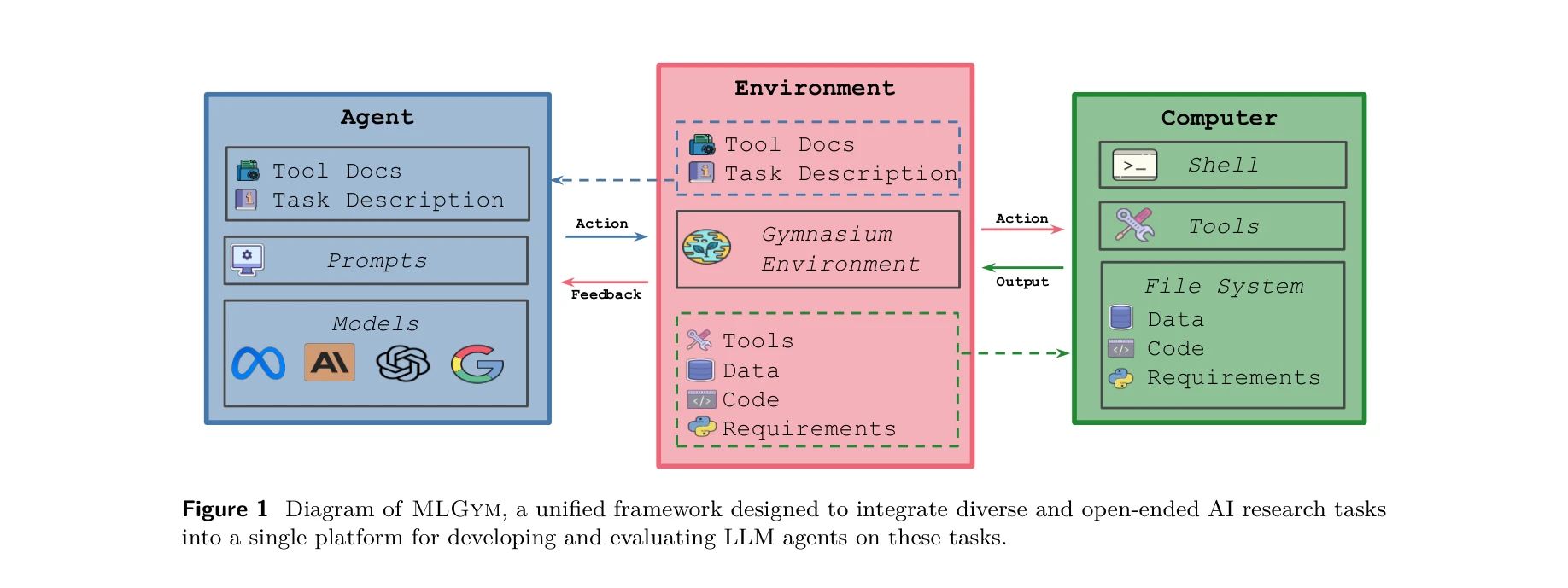

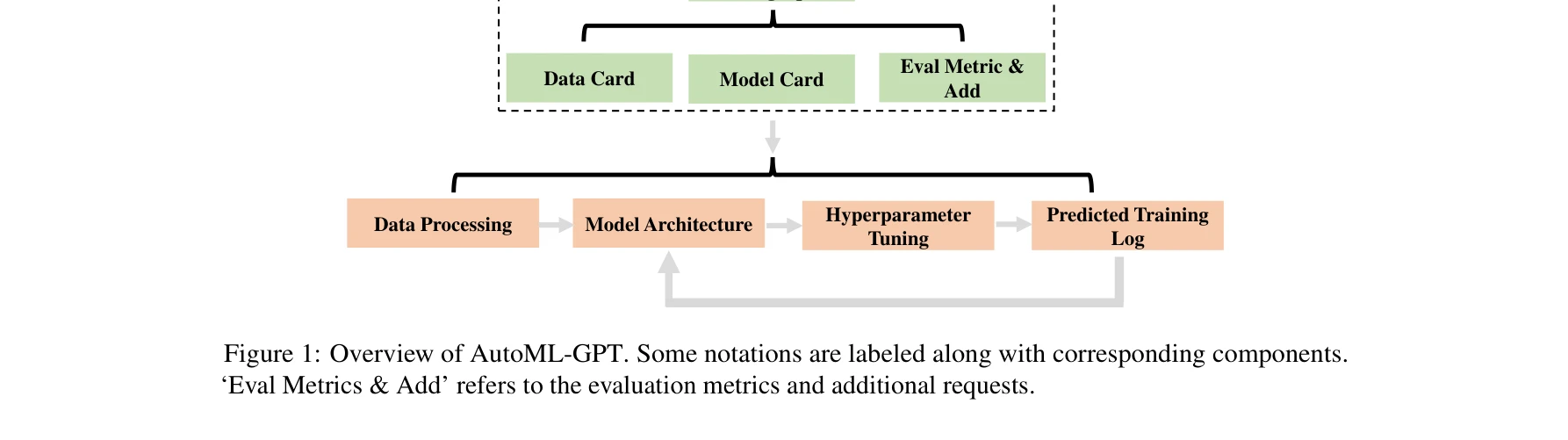

Automl in the age of large language models: Current challenges, future opportunities and risks

AutoML이 LLM 생명주기(사전학습, 미세조정, 추론)의 모든 단계에 적용될 수 있으며, 각 단계의 서로 다른 목표, 하이퍼파라미터, 설계 결정에 맞춰 조정되어야 함을 보여줌

*AutoML이 LLM 생명주기(사전학습, 미세조정, 추론)의 모든 단계에 적용될 수 있으며, 각 단계의 서로 다른 목표, 하이퍼파라미터, 설계 결정에 맞춰 조정되어야 함을 보여줌* 본 논문은 AutoML(자동 기계학습)과 LLM(대규모 언어 모델)의 상생적(symbiotic) 통합을 제안하며, 양 분야가 서로를 어떻게 강화할 수 있는지를 포괄적으로 탐색한다. AutoML이 LLM 최적화에 가져오는 도전과제, LLM이 AutoML 개선에 제공하는 기회, 그리고 통합 과정에서 발생할 수 있는 위험을 체계적으로 분석한다.

본 논문은 AutoML과 LLM의 상생적 통합에 대한 최초의 포괄적 분석으로, 현실적인 도전과제 규정과 함께 양방향 기회를 체계적으로 제시함으로써 향후 연구 방향을 명확히 한다. 다만 개념적 수준의 제안이 많고 구체적 구현 사례가 부족한 점이 아쉬우며, 제시된 위험 요소에 대한 미티게이션 전략 개발이 후속 연구의 중요한 과제가 될 것으로 예상된다.

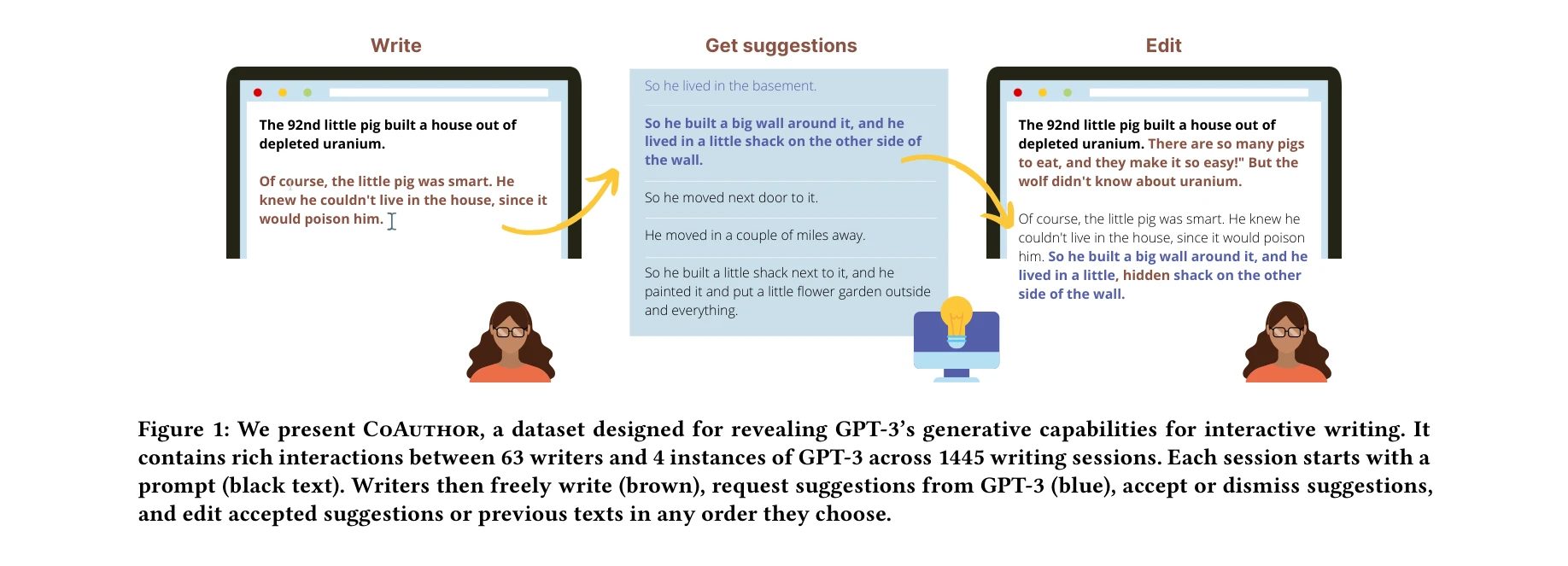

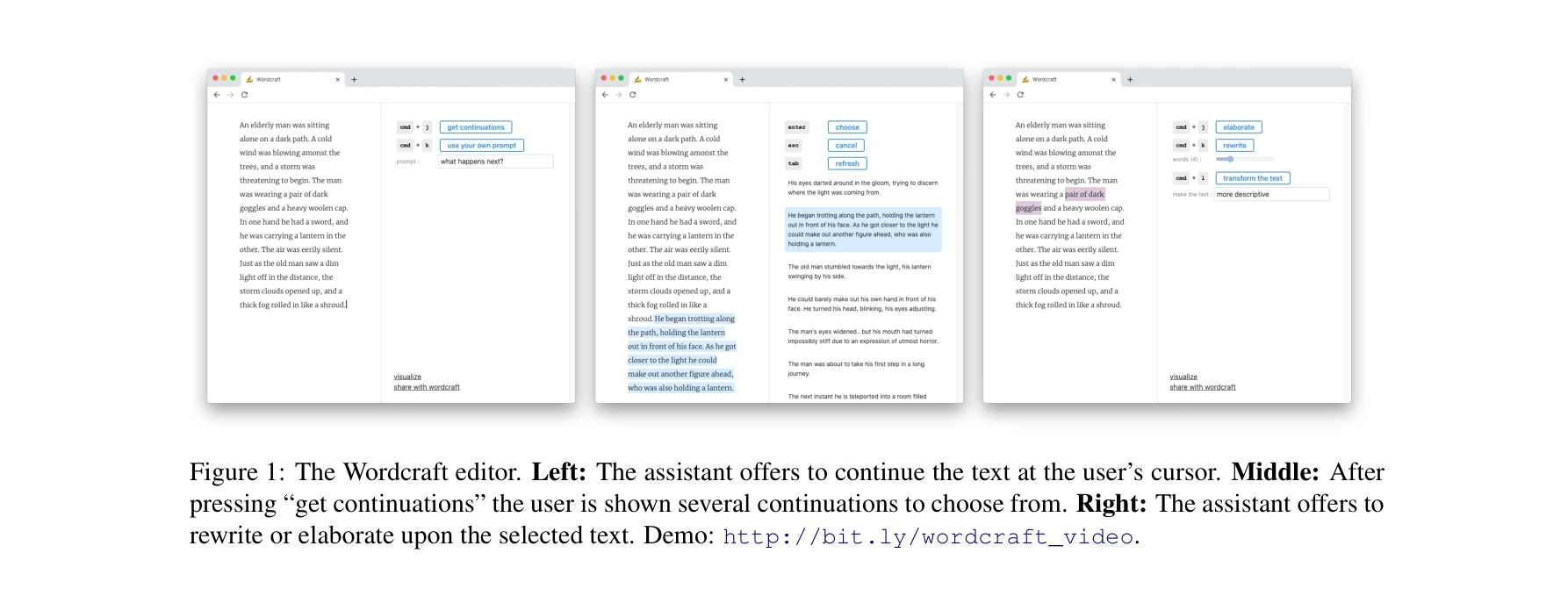

CoAuthor: Designing a Human-AI Collaborative Writing Dataset for Exploring Language Model Capabilities

*CoAuthor 데이터셋: 63명의 작가와 GPT-3의 4개 인스턴스 간 1445개 쓰기 세션에서 수집된 인간-AI 협력 상호작용* 본 논문은 GPT-3의 창작 및 논증적 글쓰기 지원 능력을 탐구하기 위해 설계된 대규모 인간-AI 협력 글쓰기 데이터셋 CoAuthor를 제시하며, 상호작용 데이터셋 분석을 통해 언어 모델의 역량을 HCI 관점에서 체계적으로 이해할 수 있음을 보여준다.

본 논문은 대규모 언어 모델의 인간-AI 협력 능력을 체계적으로 탐구하기 위한 새로운 데이터셋-중심 방법론을 제시하며, 공개된 CoAuthor 데이터셋과 재생 인터페이스는 HCI 커뮤니티에 매우 실질적인 자산이 될 것으로 예상된다. 다만 단일 모델에 대한 분석과 제한된 작업 범위의 확대가 향후 과제이다.

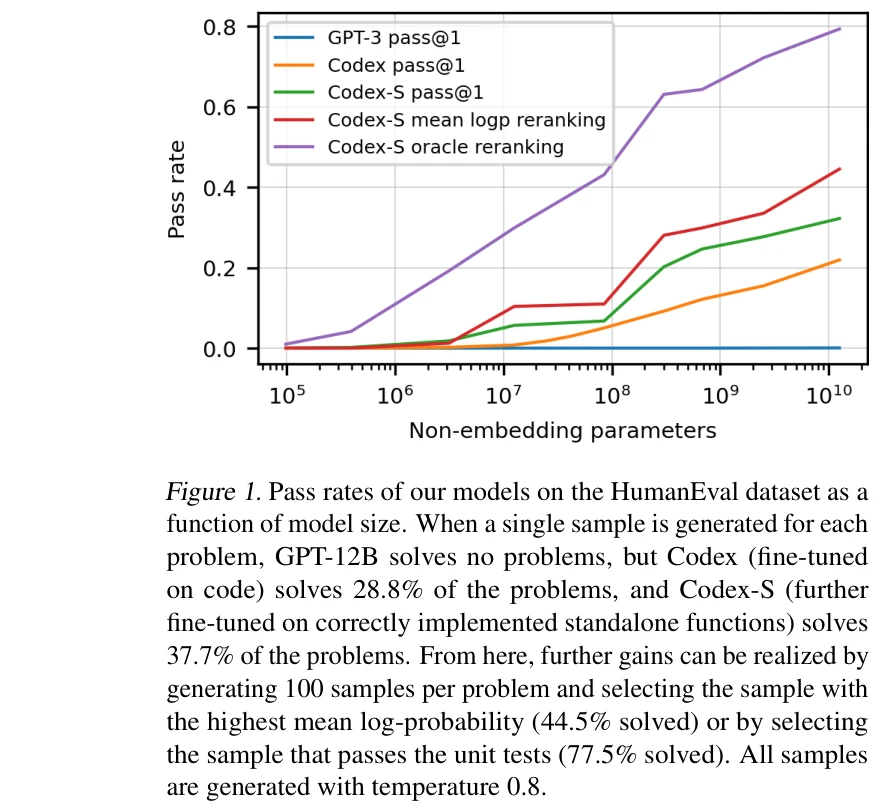

Evaluating large language models trained on code

HumanEval 데이터셋에서 모델 크기에 따른 통과율. 단일 샘플 생성 시 Codex-12B는 28.8%, 100개 샘플 생성 후 단위 테스트 통과 샘플 선택 시 77.5% 달성

*HumanEval 데이터셋에서 모델 크기에 따른 통과율. 단일 샘플 생성 시 Codex-12B는 28.8%, 100개 샘플 생성 후 단위 테스트 통과 샘플 선택 시 77.5% 달성* GitHub 코드로 미세조정된 GPT 기반의 Codex 모델을 제시하고, 새로운 벤치마크인 HumanEval을 통해 함수형 정확성(functional correctness) 기반의 평가 체계를 제안한 논문이다. Codex는 도큐스트링(docstring)으로부터 Python 함수를 생성하는 능력에서 기존 모델들을 크게 능가한다.

이 논문은 코드 생성 모델의 평가 체계를 근본적으로 개선하고 실용적 벤치마크를 제공함으로써 프로그래밍 합성 분야에 중대한 기여를 했다. Codex 모델의 실제 성능은 놀라울 정도이나, 평가 범위의 한정과 윤리적 논의의 깊이 부족이 아쉬움.

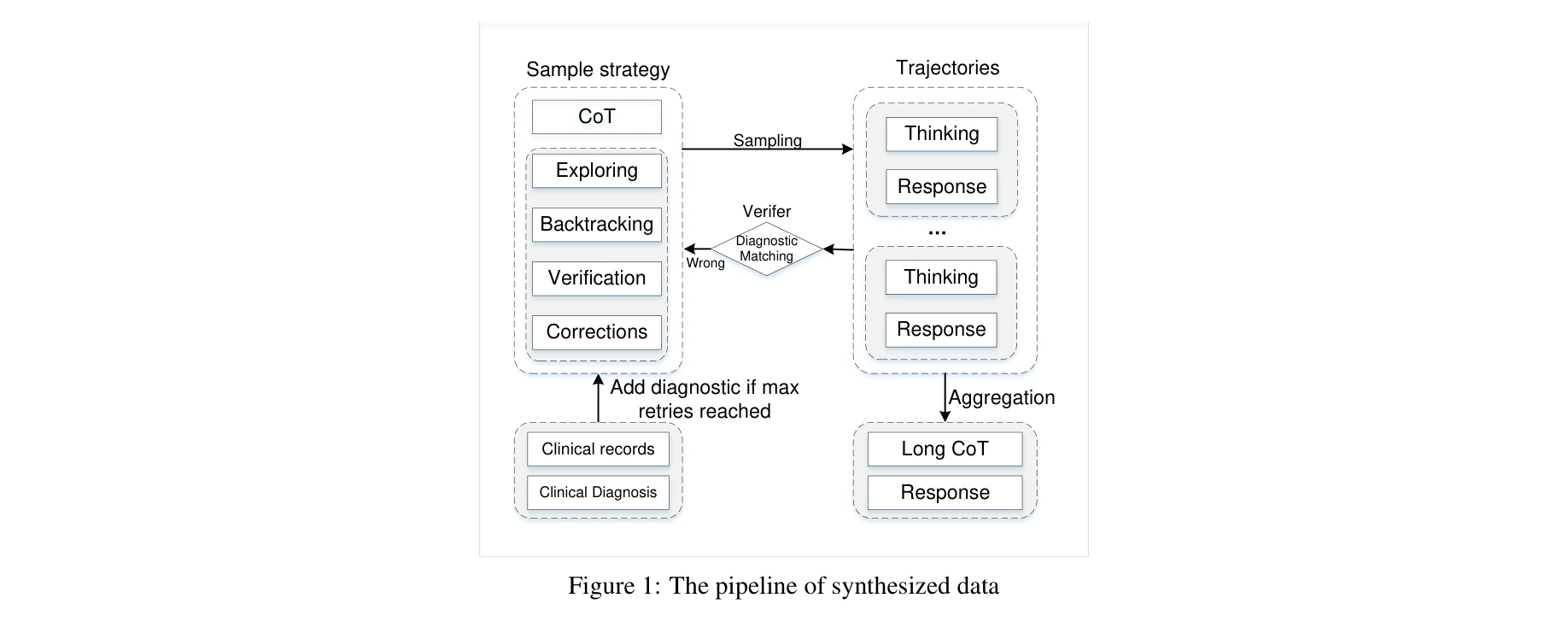

Towards reasoning era: A survey of long chain-of-thought for reasoning large language models

*Long CoT와 Short CoT의 구별: 깊은 추론(Deep Reasoning), 광범위한 탐색(Extensive Exploration), 실현 가능한 반성(Feasible Reflection)의 세 가지 핵심 특성* OpenAI-o1과 DeepSeek-R1 같은 추론 대형언어모델(RLLMs)의 성공은 장문의 체인오브쏘트(Long CoT) 특성에 기인하며, 본 논문은 Long CoT와 전통적 Short CoT의 구별, 핵심 특성, 그리고 관련 현상들에 대한 최초의 종합적 분석을 제공한다.

본 논문은 RLLMs의 중심 기술인 Long CoT를 처음으로 체계적으로 분석한 중요한 종합 설문으로, 명확한 분류 체계와 풍부한 사례를 제공하여 후속 연구의 지도를 제시한다. 다만 이론적 깊이와 일부 현상의 설명이 추가 발전의 여지를 남긴다.

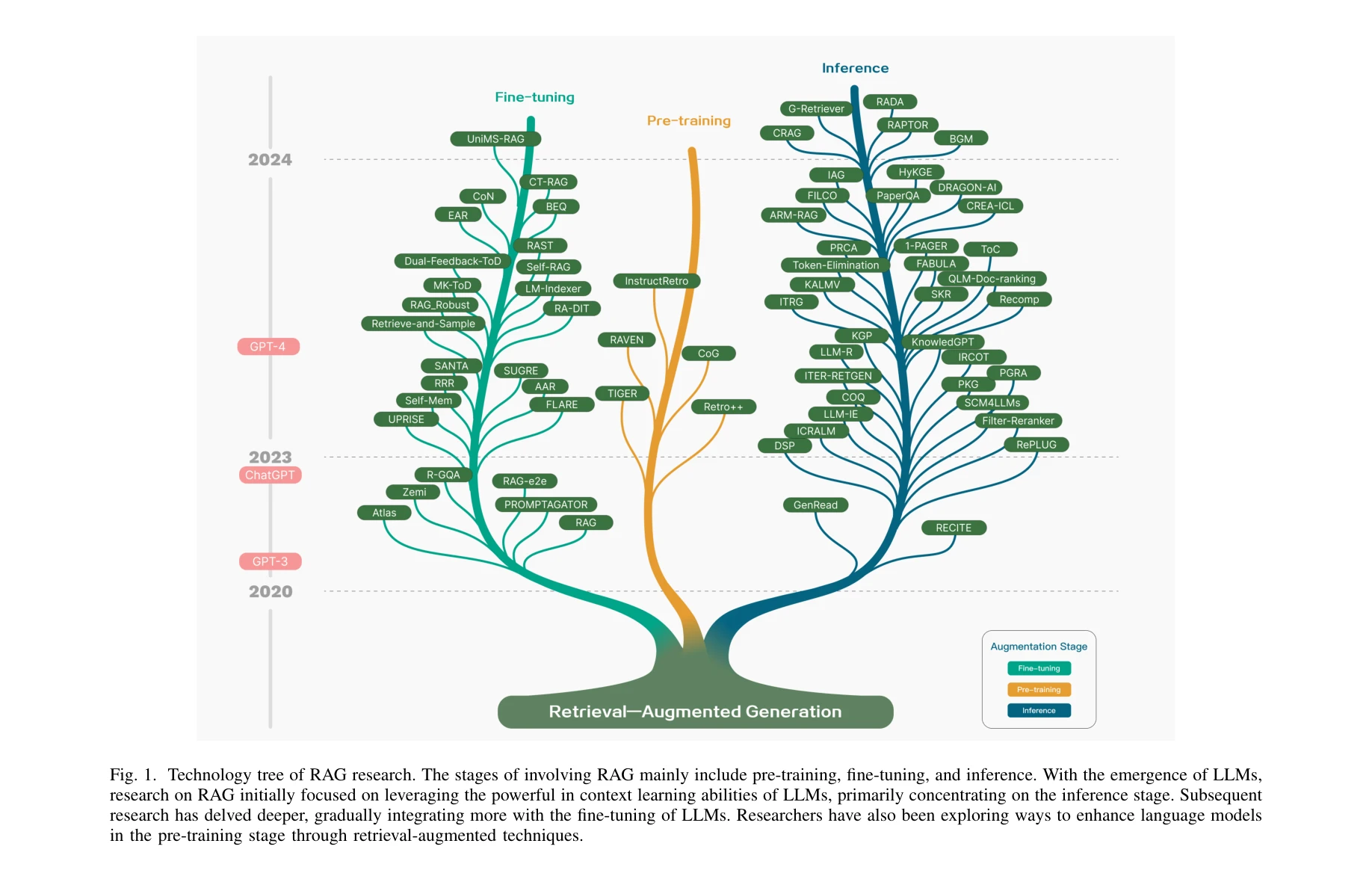

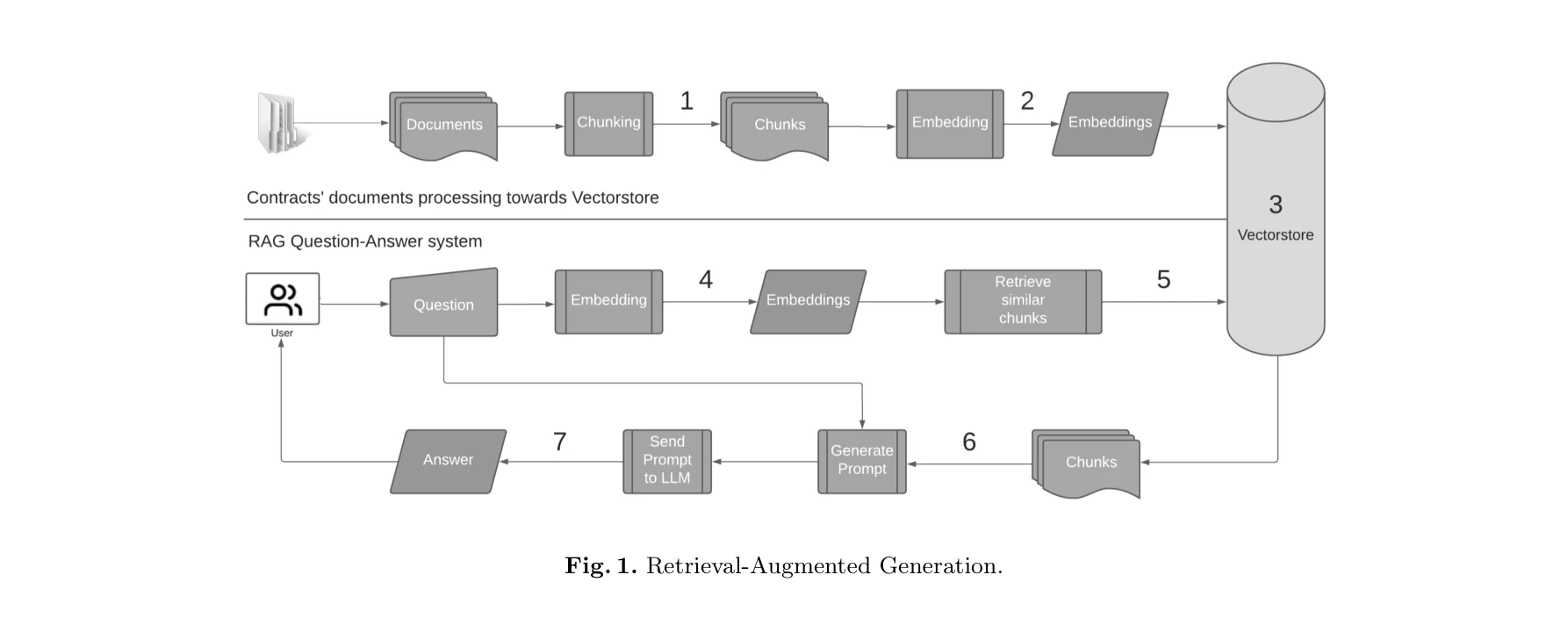

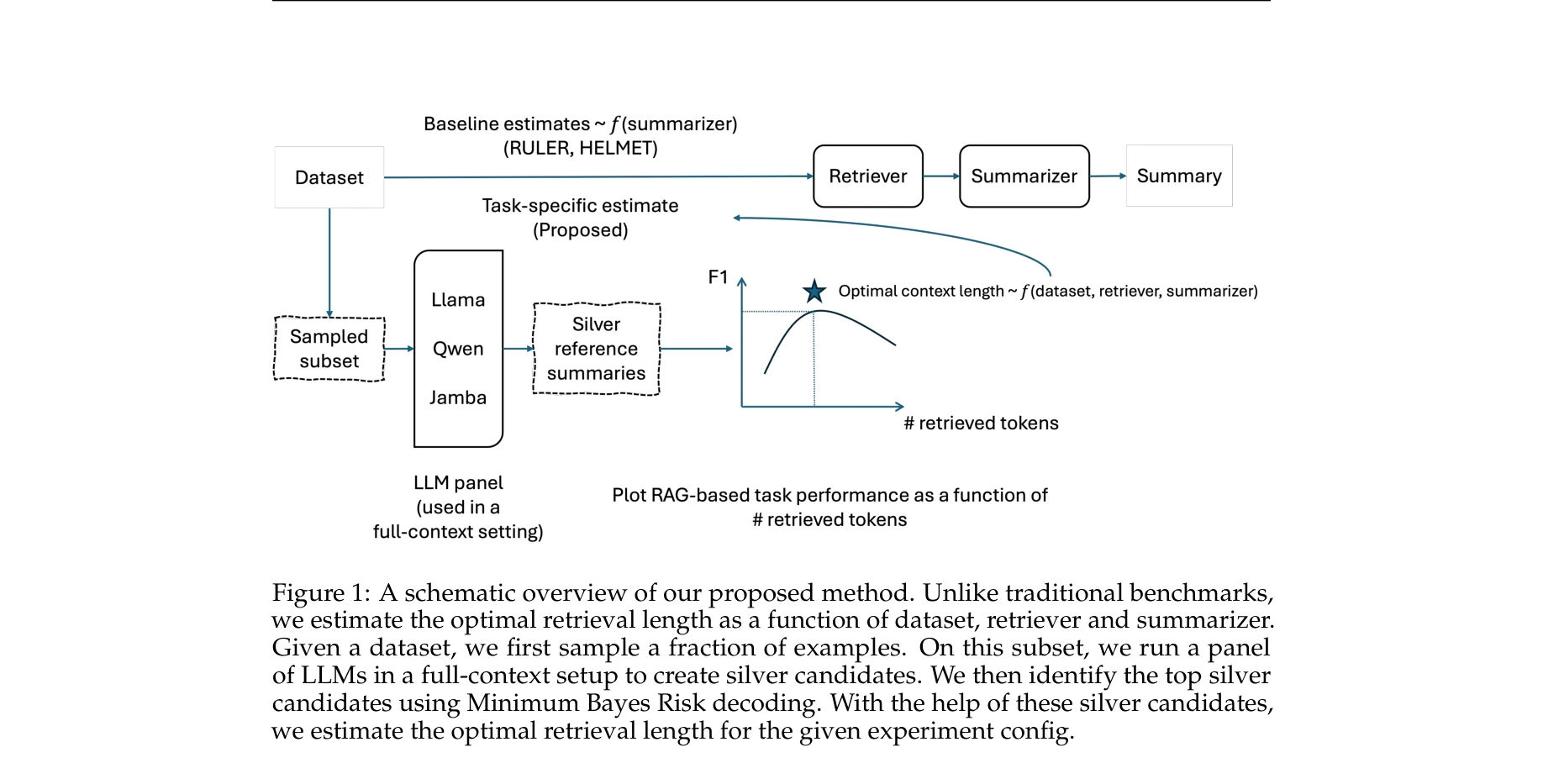

Retrieval-Augmented Generation for Large Language Models: A Survey

그림 2: 질의응답에 적용된 RAG 프로세스 - 인덱싱, 검색, 생성의 3단계

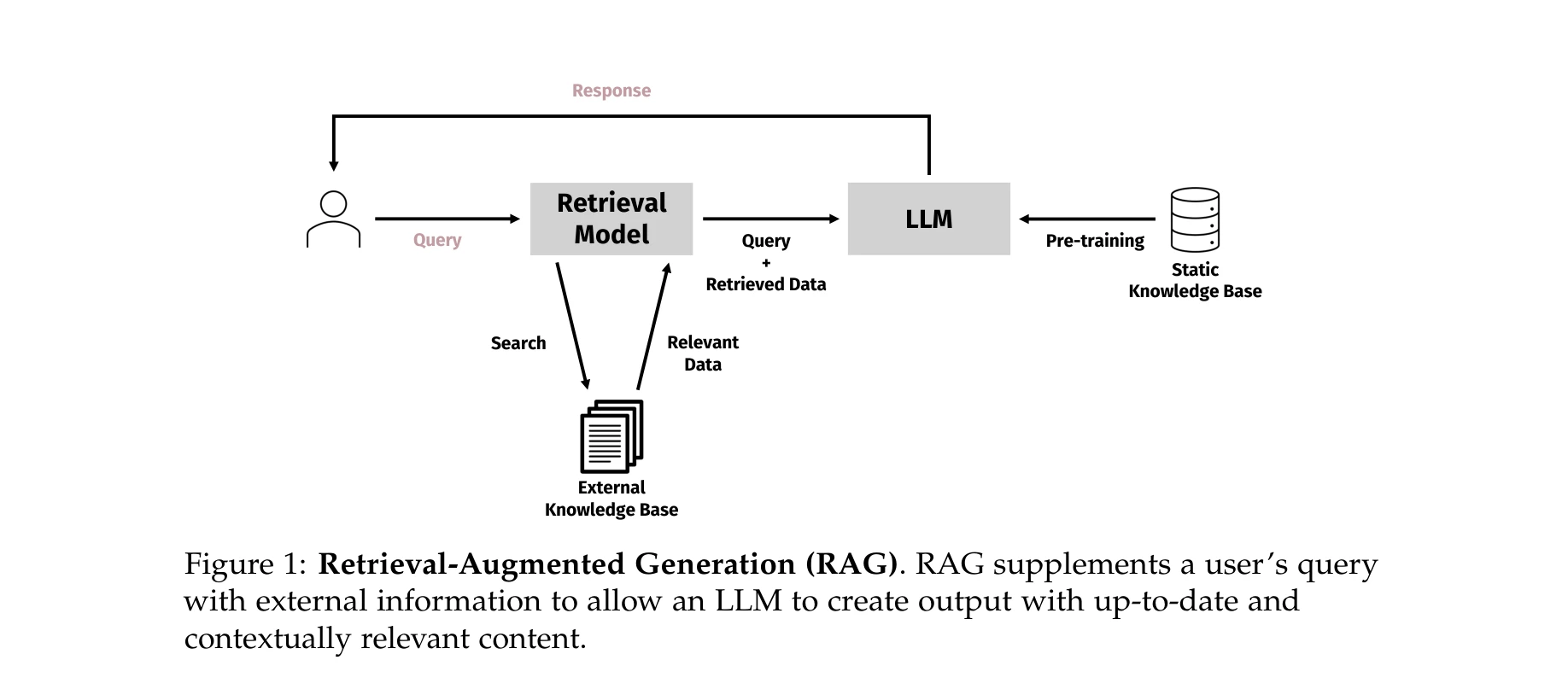

*그림 2: 질의응답에 적용된 RAG 프로세스 - 인덱싱, 검색, 생성의 3단계* 대규모 언어모델(LLM)의 환각(hallucination), 지식 노후화, 추론 과정의 불투명성을 해결하기 위해 외부 데이터베이스에서 관련 정보를 검색하여 생성 과정을 보강하는 **Retrieval-Augmented Generation (RAG)** 기술을 종합적으로 분석한 논문이다. 본 논문은 RAG의 발전 단계를 Naive RAG, Advanced RAG, Modular RAG로 체계화하고 각 단계의 핵심 기술과 평가 방법론을 상세히 제시한다.

본 논문은 RAG 분야의 최초 대규모 종합 조사로서 체계적인 분류 체계와 기술 트리를 제시하여 학계와 산업계의 RAG 이해를 크게 향상시킨 의미 있는 기여를 했다. 다만 개별 기술의 정량적 성능 비교와 실무 적용 시 의사결정 가이드라인이 보강되면 더욱 가치 있는 자료가 될 것이다.

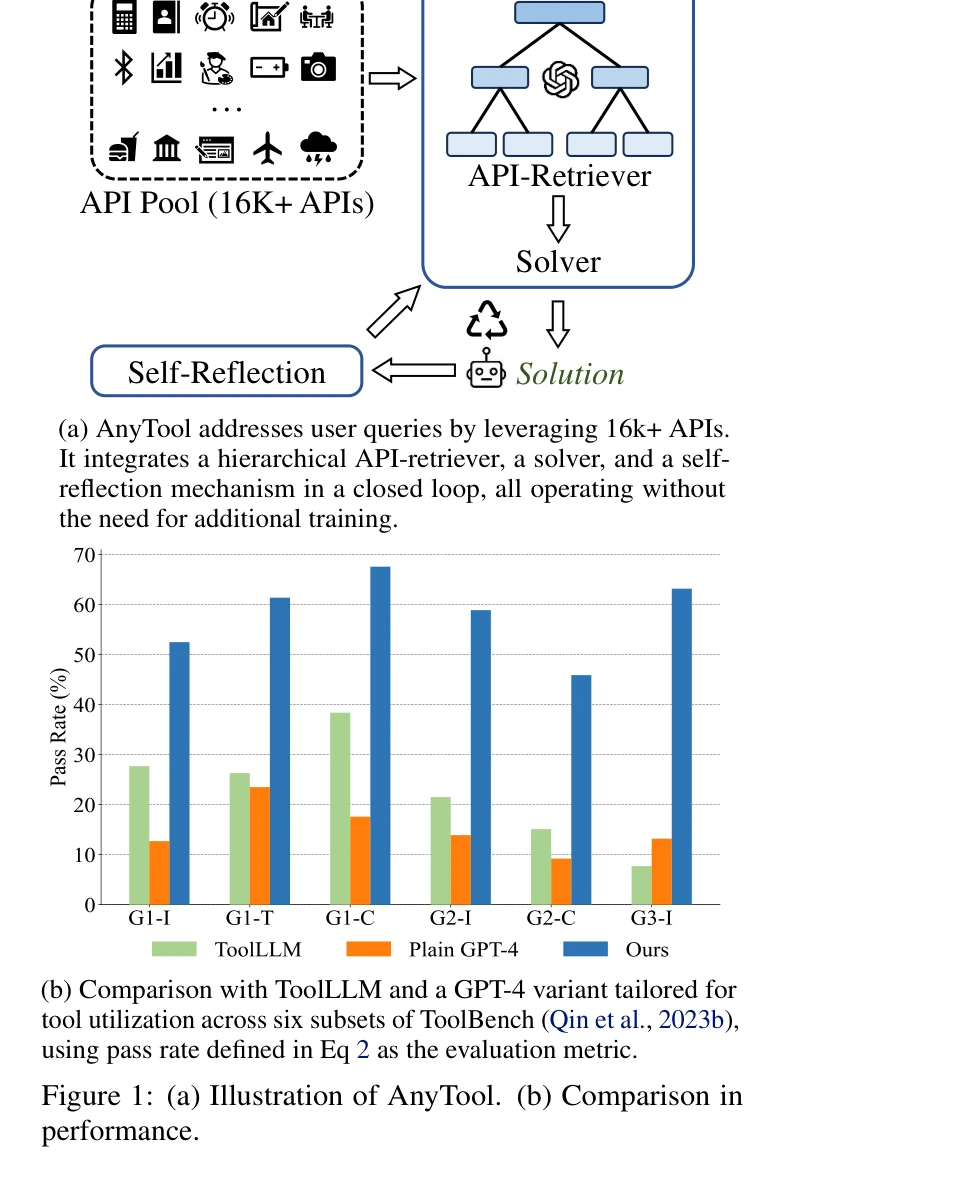

StableToolBench: Towards Stable Large-Scale Benchmarking on Tool Learning of Large Language Models

ToolBench에서 보고된 성능과 재현된 성능의 비교: 몇 개월 후 동일한 설정에서 재현했을 때 상당한 성능 저하 발생

*ToolBench에서 보고된 성능과 재현된 성능의 비교: 몇 개월 후 동일한 설정에서 재현했을 때 상당한 성능 저하 발생* 대규모 언어 모델(LLM)이 도구를 활용하는 능력을 평가하기 위해 안정적인 벤치마크가 필수적인데, 기존 ToolBench는 실시간 API의 불안정성으로 인해 결과 재현성이 떨어진다. 본 논문은 가상 API 서버와 안정적인 평가 시스템을 통해 이 문제를 해결한 StableToolBench를 제안한다.

StableToolBench는 기존 대규모 도구 학습 벤치마크의 재현성 위기에 대한 실질적이고 효과적인 해결책을 제시한다. 특히 API 불안정성과 평가 시스템의 약점을 동시에 해결한 점이 가치 있으나, LLM 기반 시뮬레이터의 신뢰성 검증과 장기 안정성 보장 측면에서 보완이 필요하다.

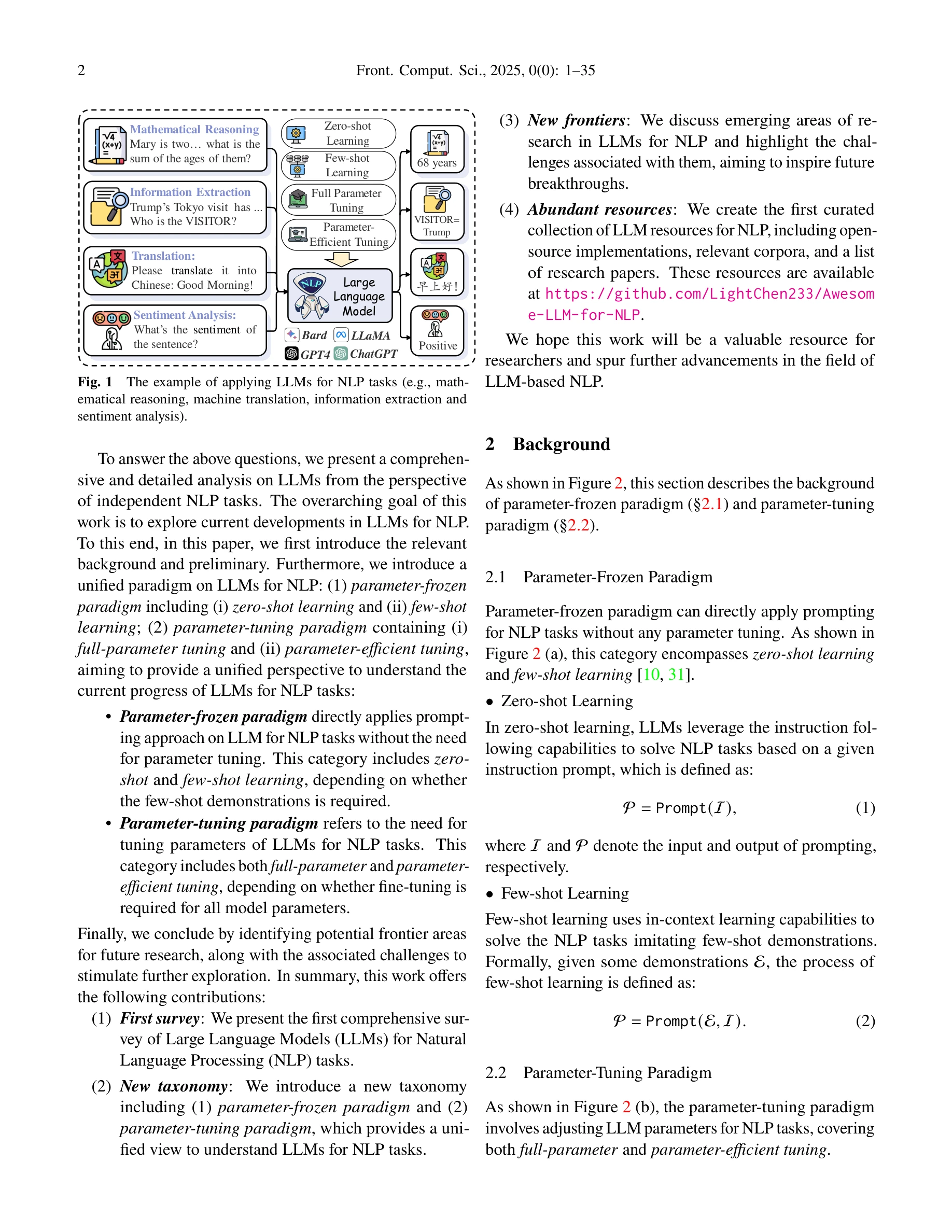

Large language models meet NLP: A survey

다양한 NLP 작업에 LLM 적용 예시 (수학적 추론, 기계 번역, 정보 추출, 감정 분석)

*다양한 NLP 작업에 LLM 적용 예시 (수학적 추론, 기계 번역, 정보 추출, 감정 분석)* 본 논문은 ChatGPT와 같은 대규모 언어모델(LLM)의 자연언어처리(NLP) 분야 응용을 체계적으로 조사한 첫 종합 서베이로, LLM이 기존 NLP 작업을 어떻게 해결하고 있으며 앞으로의 전망은 무엇인지를 다룬다.

본 논문은 LLM 시대 NLP 분야의 현황을 최초로 체계적으로 정리한 중요한 서베이로, 파라미터 동결/튜닝 이분법적 분류는 실무자들에게 명확한 의사결정 기준을 제공한다. 다만 제공된 본문이 제한적이어서 각 NLP 작업별 LLM의 실제 성능 한계 및 도전 과제에 대한 심화 논의가 추가된다면 더욱 완성도 높은 자료가 될 것으로 기대된다.

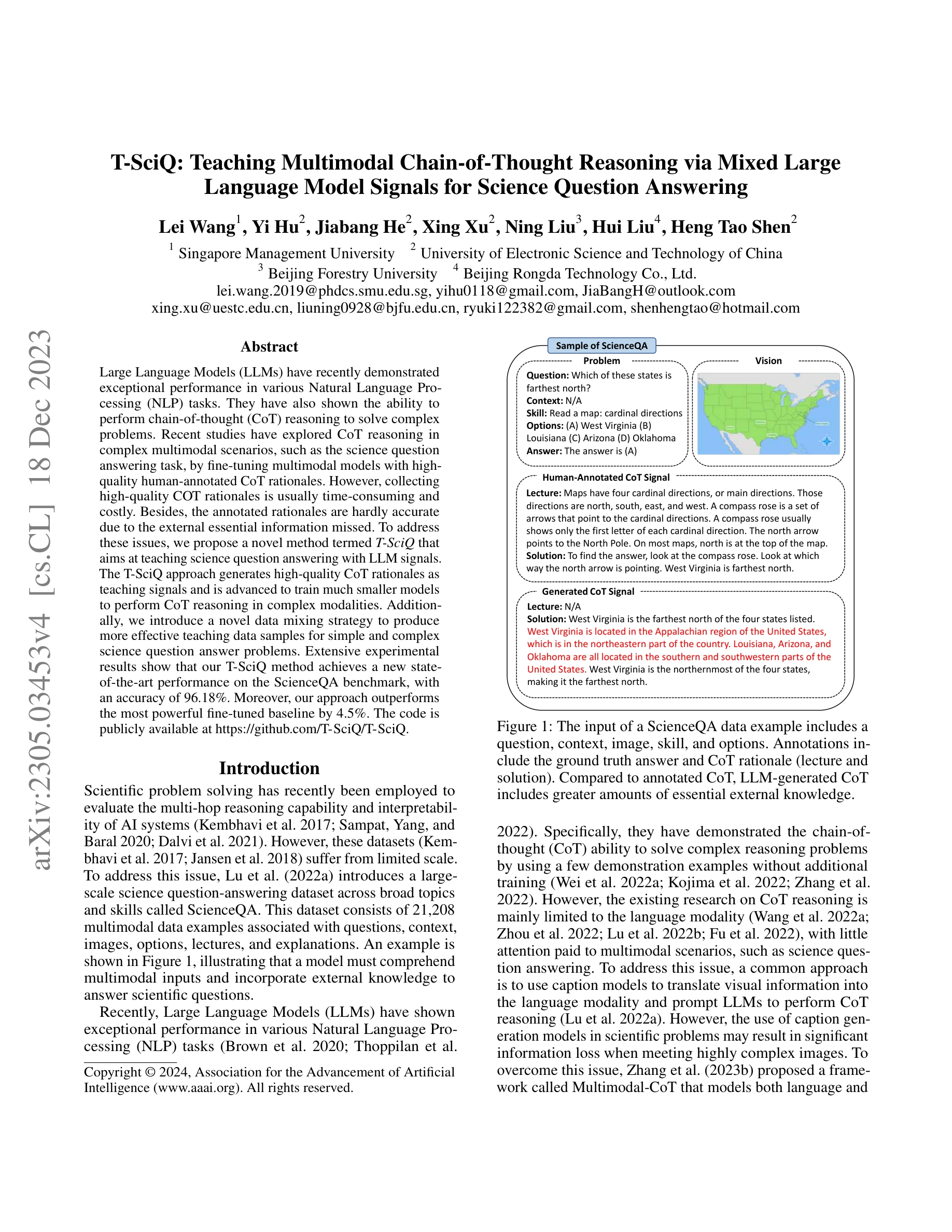

T-SciQ: Teaching multimodal chain-of-thought reasoning via mixed large language model signals for science question answering

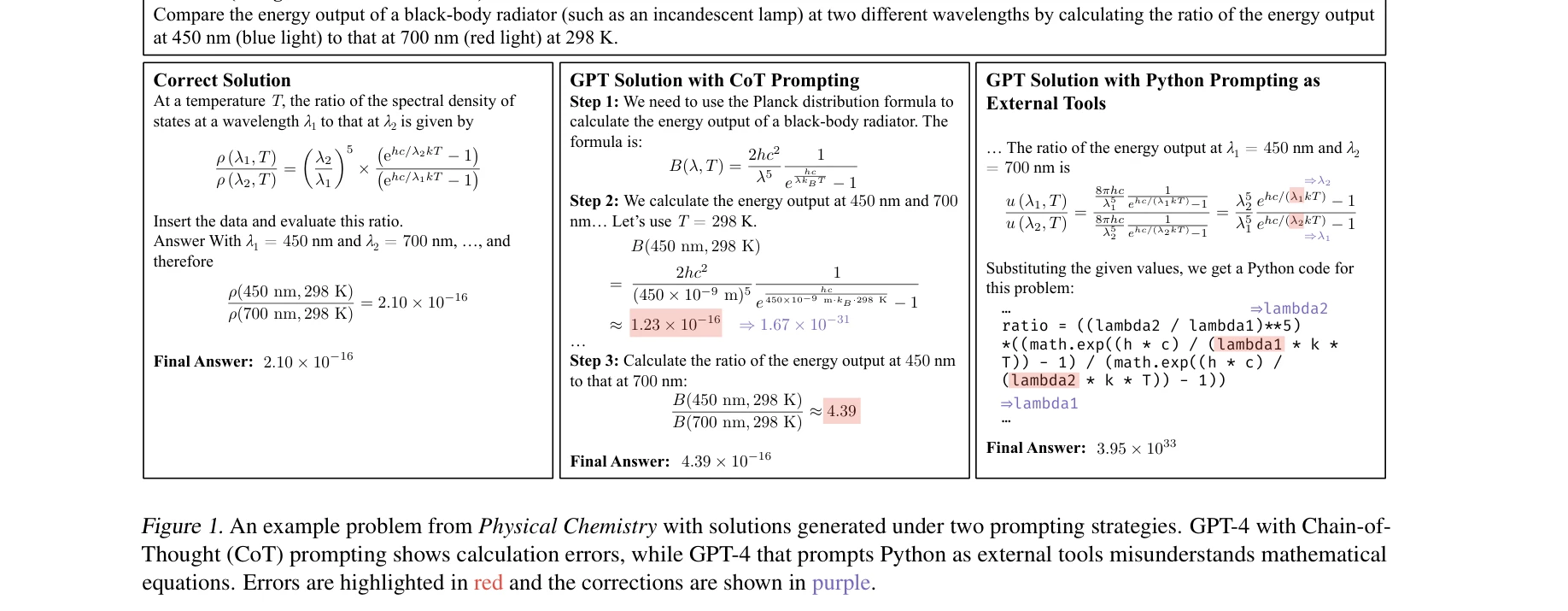

ScienceQA 데이터 예시: 인간 주석 CoT와 LLM 생성 CoT 비교. LLM 생성 CoT가 더 많은 외부 지식을 포함함

*ScienceQA 데이터 예시: 인간 주석 CoT와 LLM 생성 CoT 비교. LLM 생성 CoT가 더 많은 외부 지식을 포함함* 본 논문은 대형 언어 모델(LLM)이 생성한 연쇄적 사고(Chain-of-Thought, CoT) 신호를 혼합하여 과학 문제 해결 능력을 갖춘 소규모 학생 모델을 학습하는 T-SciQ 프레임워크를 제안한다. 인간 주석의 비용 문제와 정보 손실을 극복하기 위해 두 가지 유형의 자동 생성 교수 신호를 결합하는 혁신적인 데이터 혼합 전략을 도입한다.

T-SciQ는 간단하면서도 효과적인 데이터 혼합 전략을 통해 멀티모달 과학 추론에서 획기적 성능을 달성했으며, 특히 값비싼 인간 주석을 완전히 제거하면서도 정보 풍부한 LLM 신호로 우수한 학생 모델을 양성한 점이 실무적 가치가 높다. 다만 계산 비용 분석과 다양한 도메인으로의 확장 가능성 검증이 향후 보완되어야 한다.

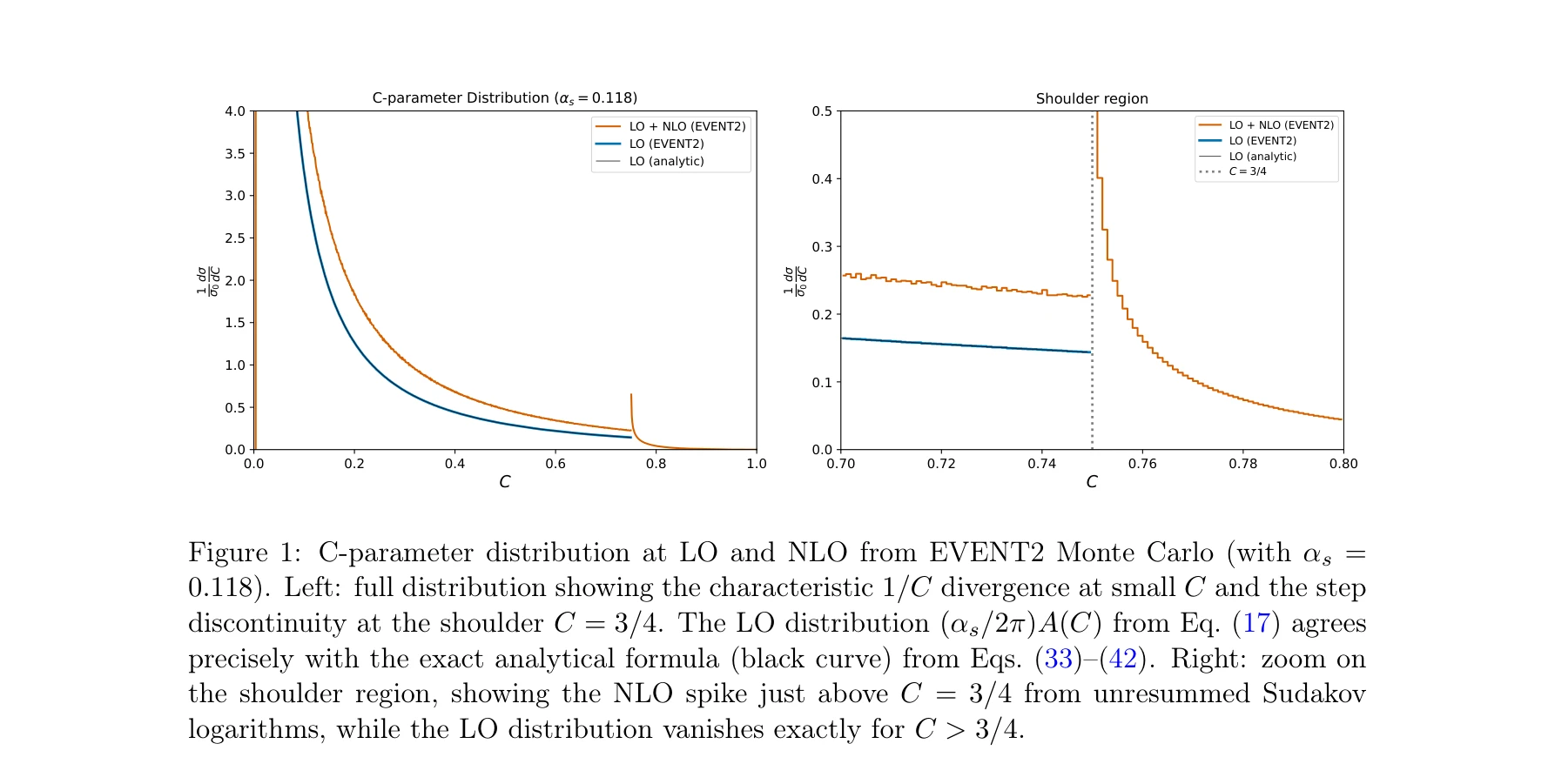

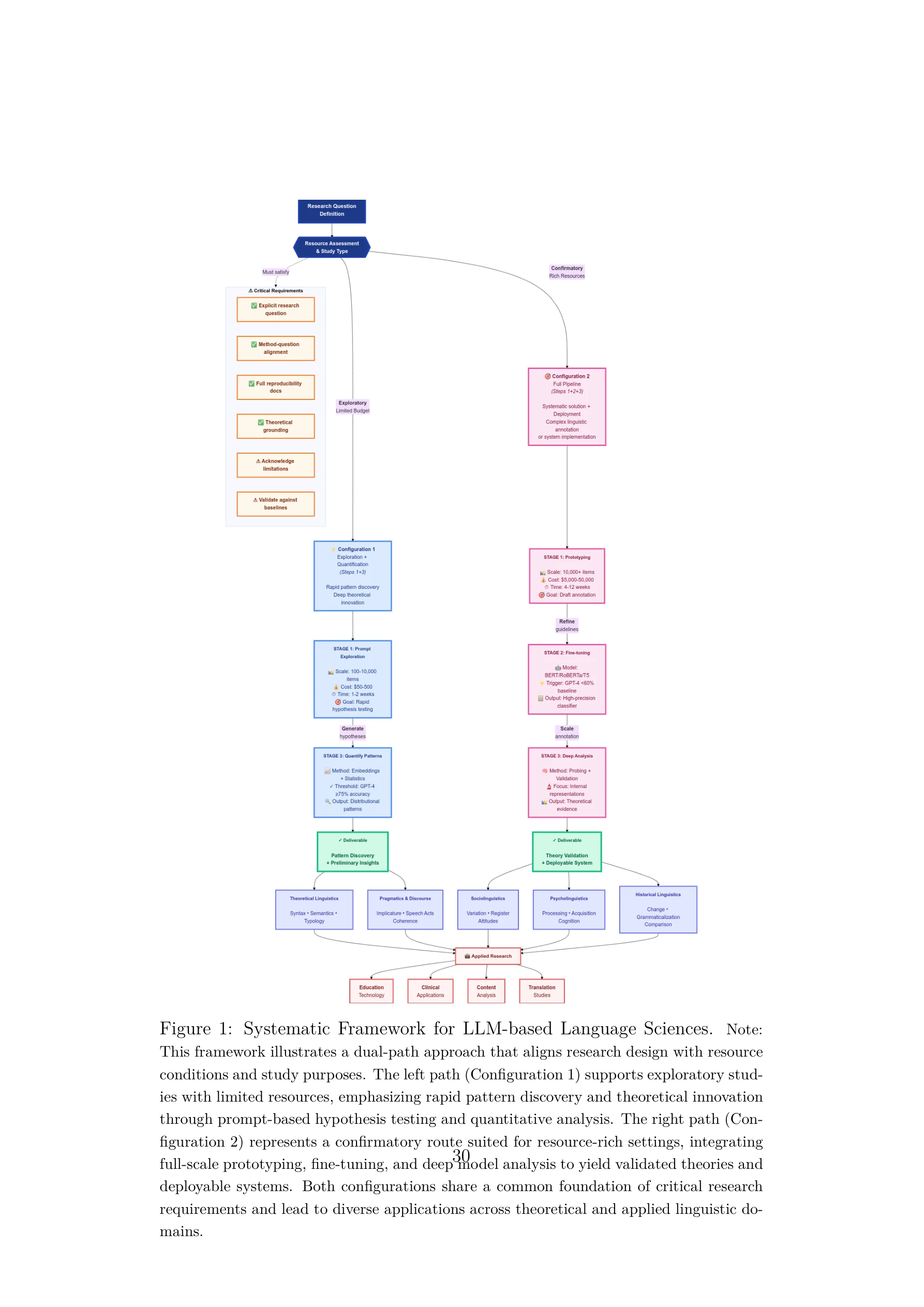

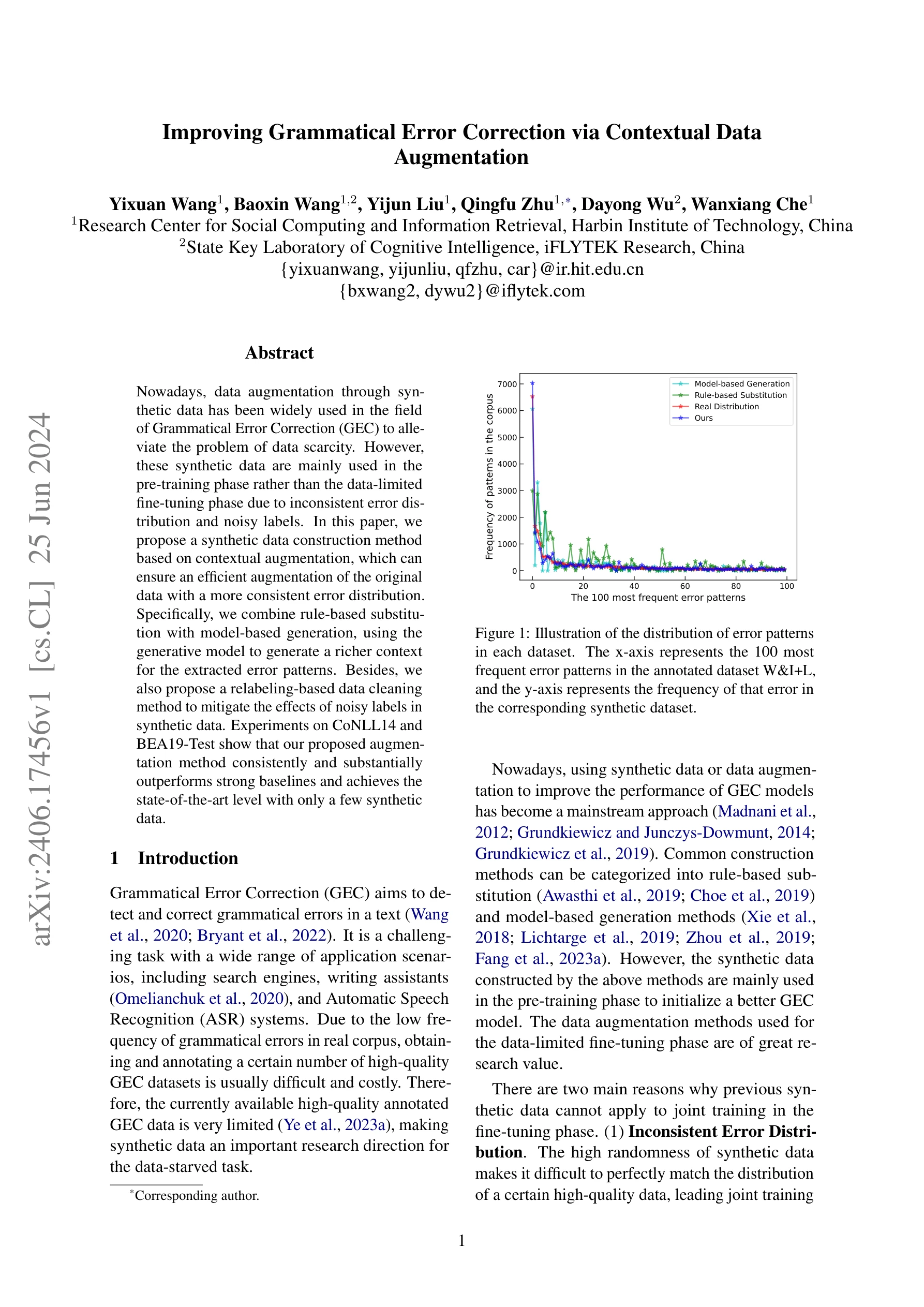

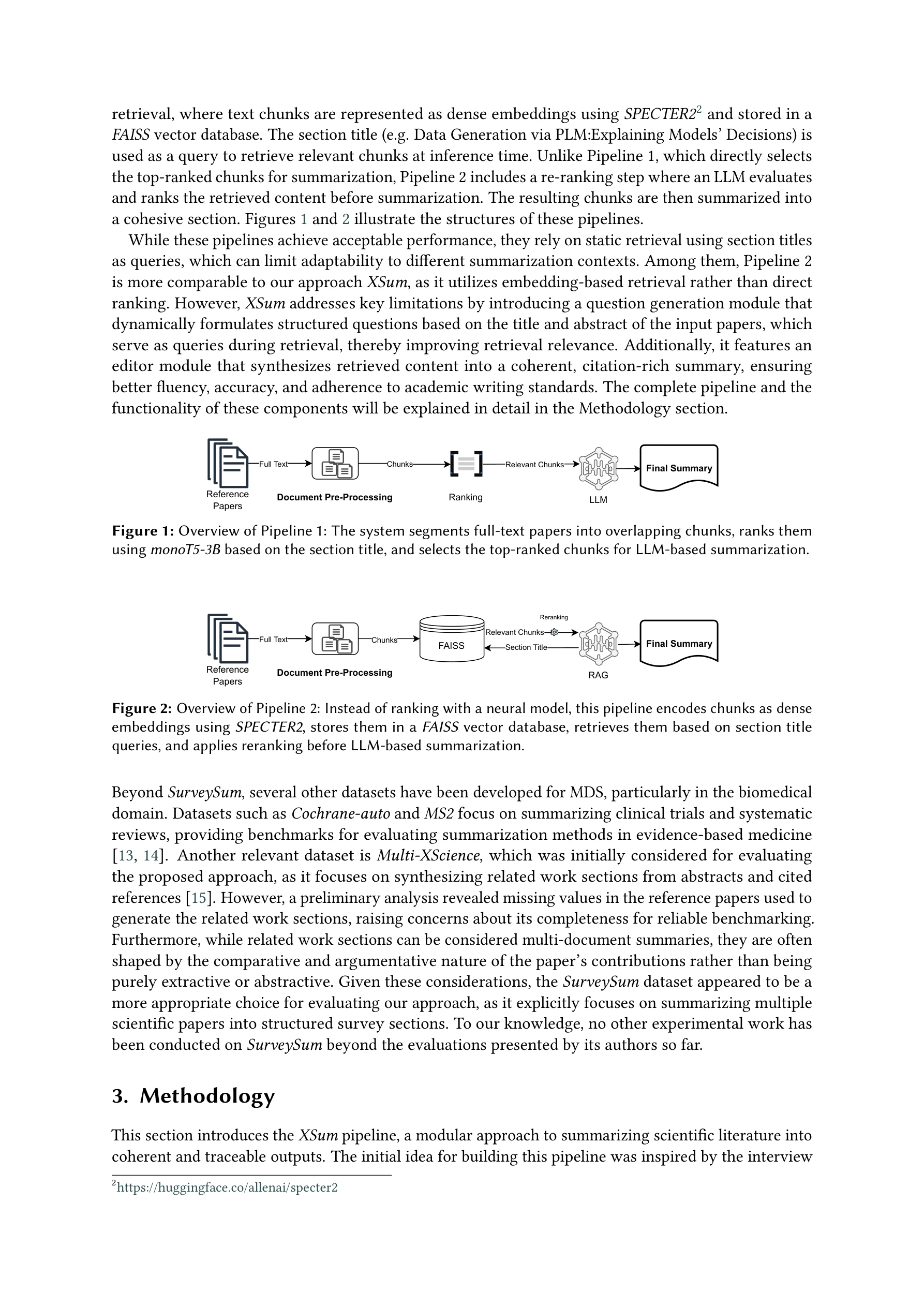

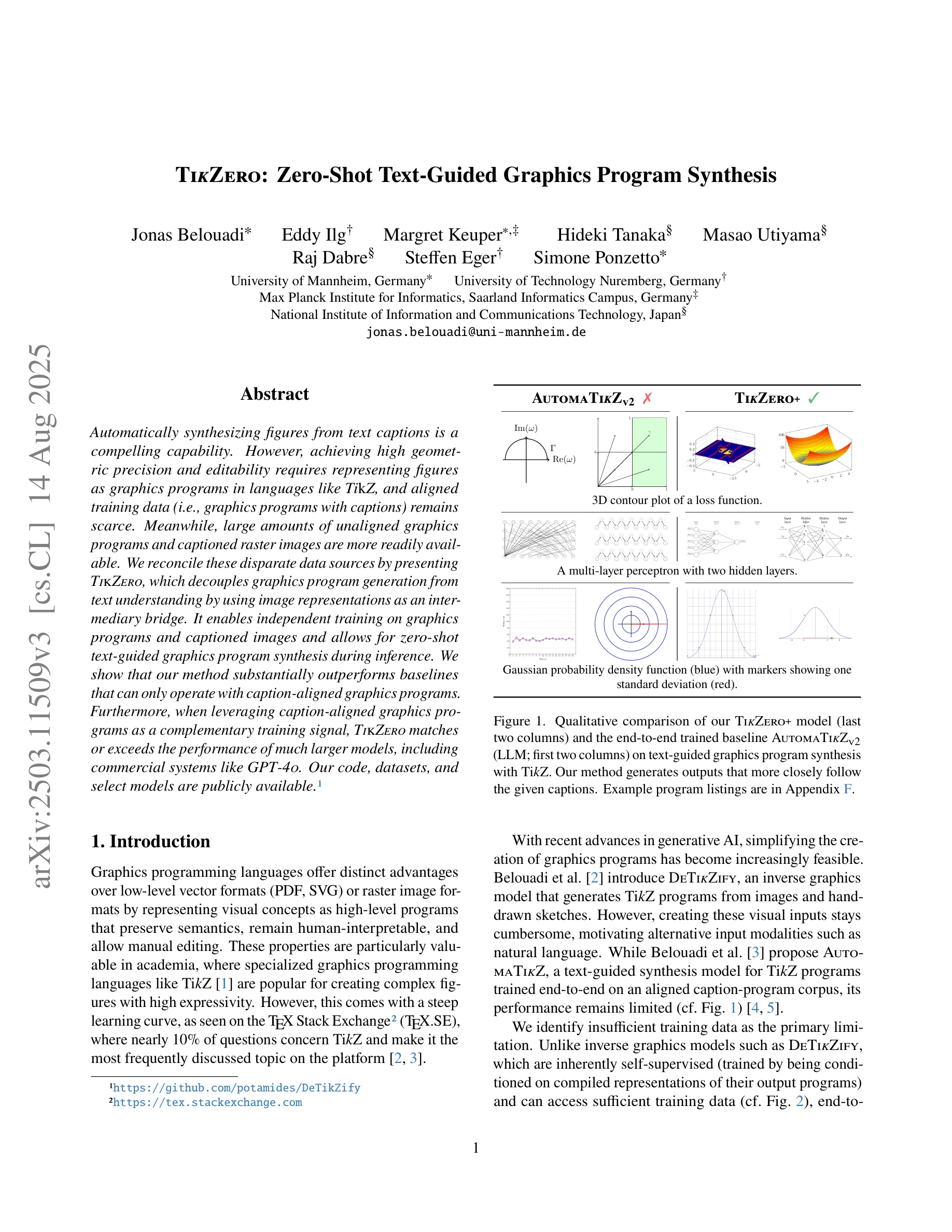

Transforming Science with Large Language Models: A Survey on AI-assisted Scientific Discovery, Experimentation, Content Generation, and Evaluation

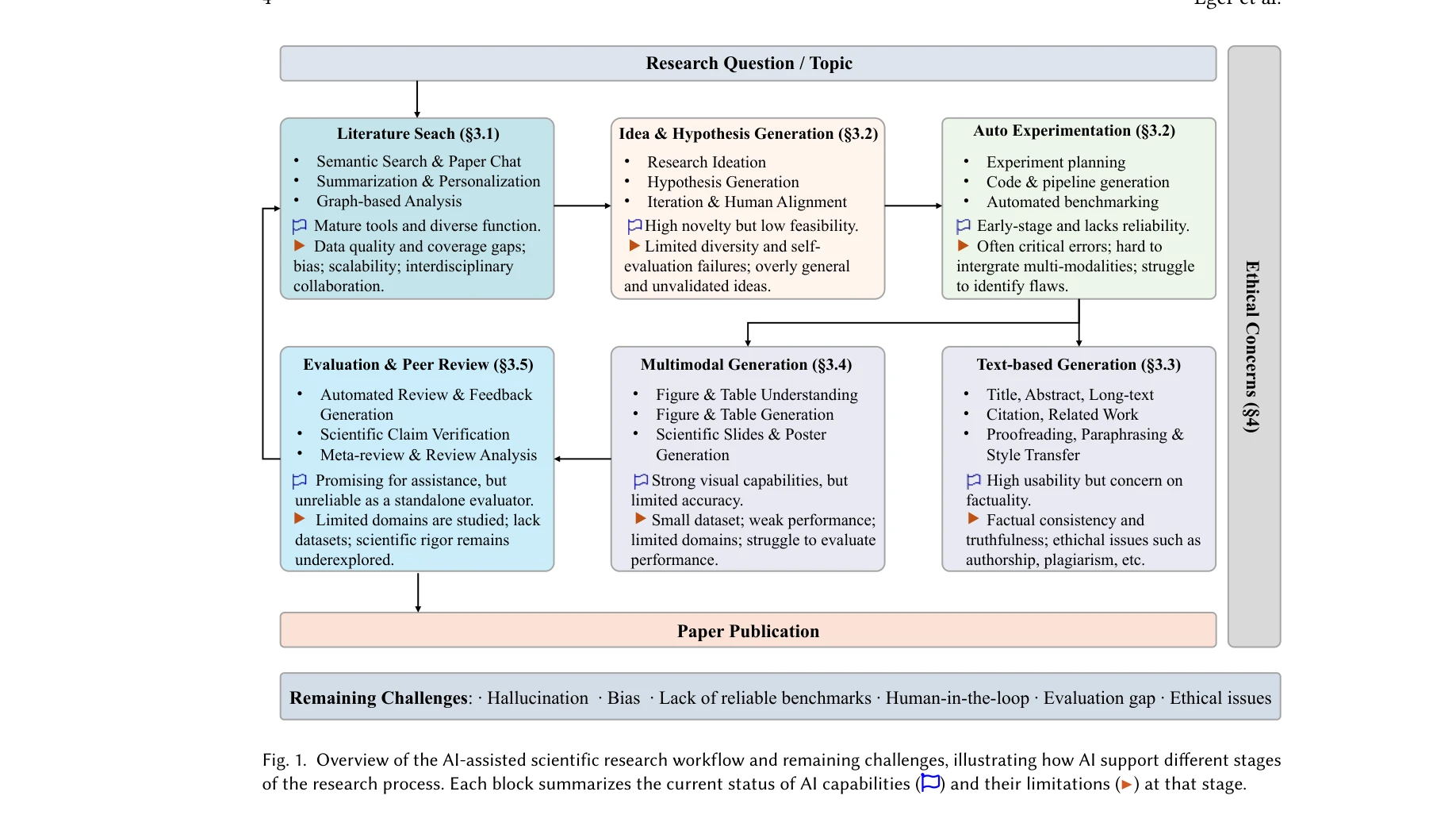

Figure 1: AI 보조 과학 연구 워크플로우 및 남은 과제들의 개요. 문헌 검색부터 동료 평가까지 각 단계에서 AI 지원의 현황과 한계를 보여줌.

*Figure 1: AI 보조 과학 연구 워크플로우 및 남은 과제들의 개요. 문헌 검색부터 동료 평가까지 각 단계에서 AI 지원의 현황과 한계를 보여줌.* 대규모 다중모드 언어 모델(LLM)의 등장으로 과학 연구가 AI 기반의 기술적 변환의 임계점에 도달했으며, 본 논문은 문헌 검색, 실험 설계, 콘텐츠 생성, 동료 평가에 이르는 전체 연구 생명주기에서 AI의 역할을 체계적으로 검토하는 종합 서베이이다.

이 논문은 급속히 발전하는 AI4Science 분야에 대한 종합적이고 구조화된 첫 번째 가이드로서, 신입 연구자부터 정책결정자까지 폭넓은 대상에게 높은 참고가치를 제공한다. 특히 윤리 및 연구 무결성 논의의 통합은 기술 발전을 넘어선 책임 있는 과학 지원 시스템 구축에 중요한 기초를 마련한다. 다만 내러티브 접근법의 한계로 인한 완전성 부족과 빠르게 변화하는 분야에서의 시간성 격차 극복이 과제이다.

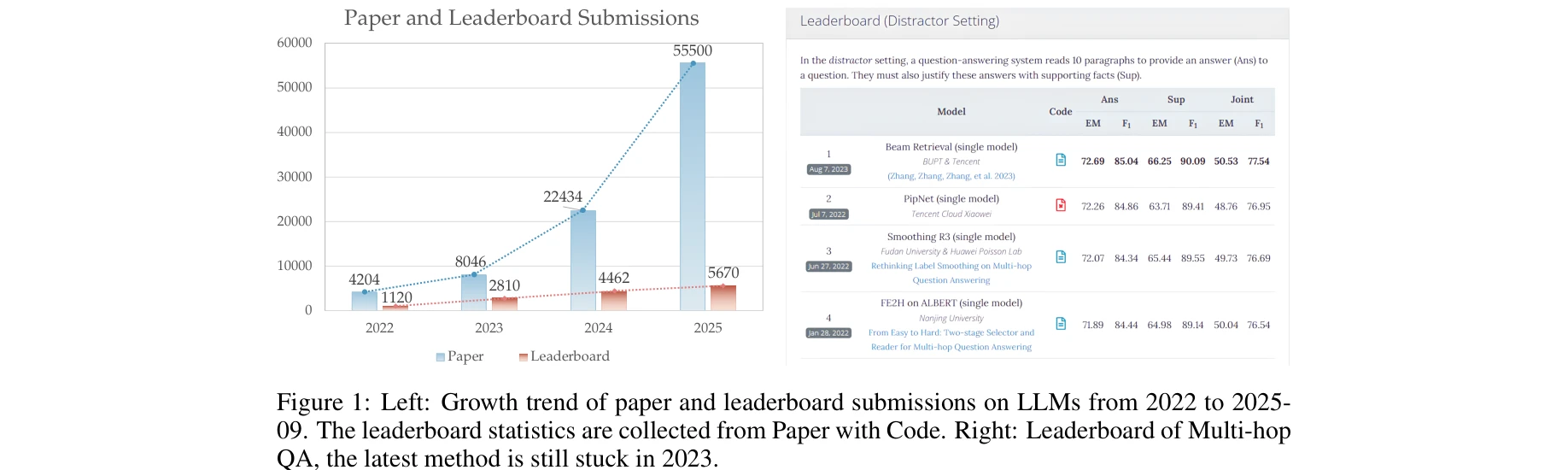

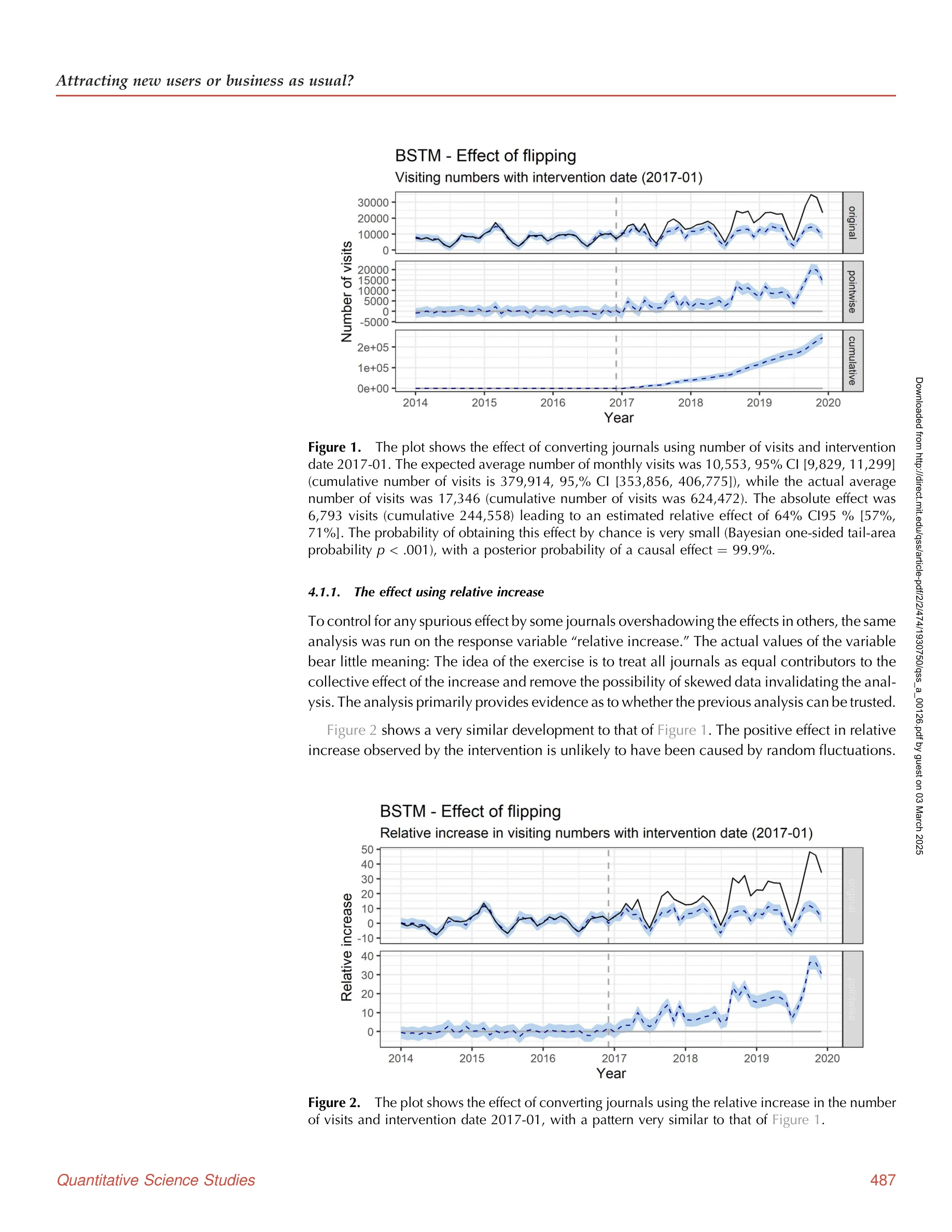

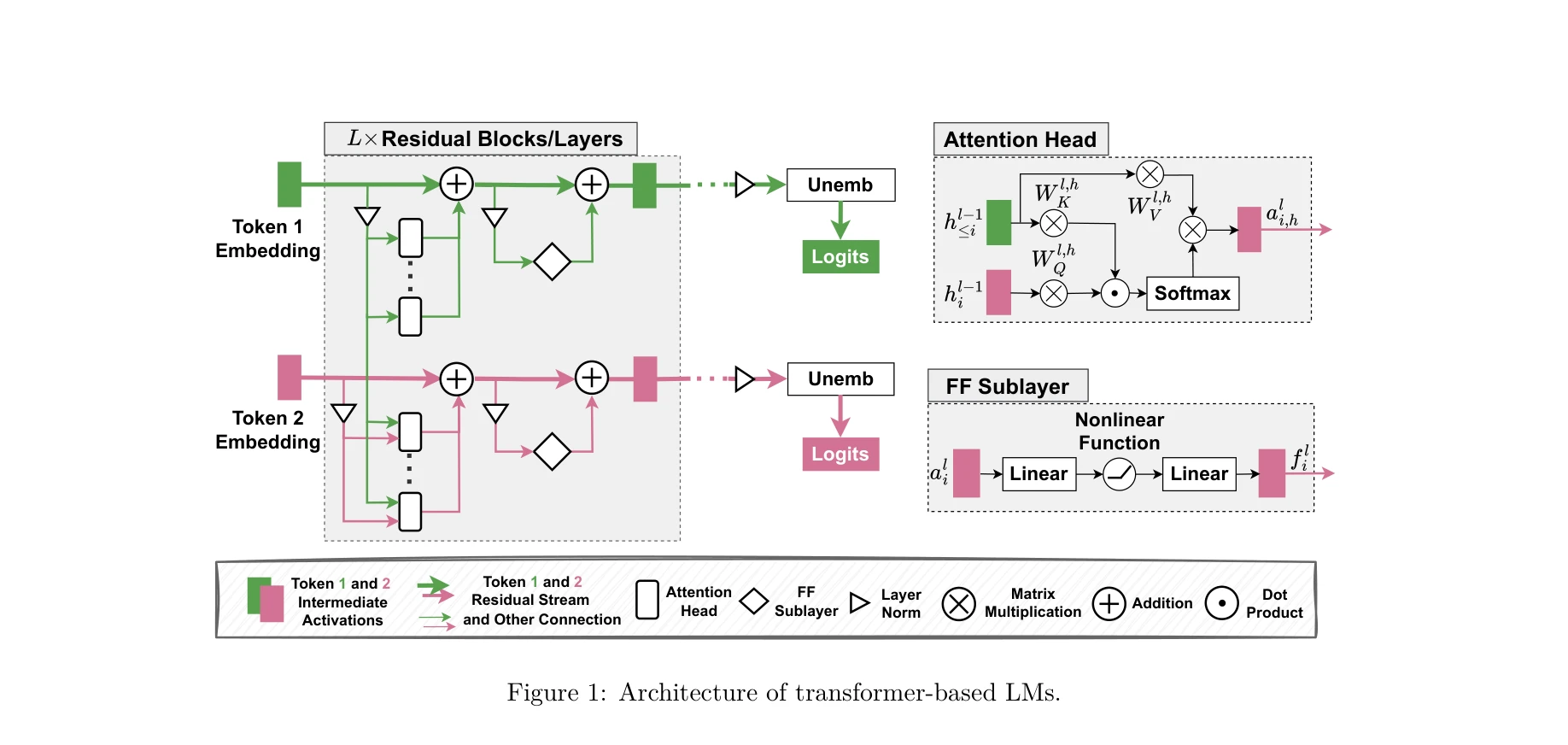

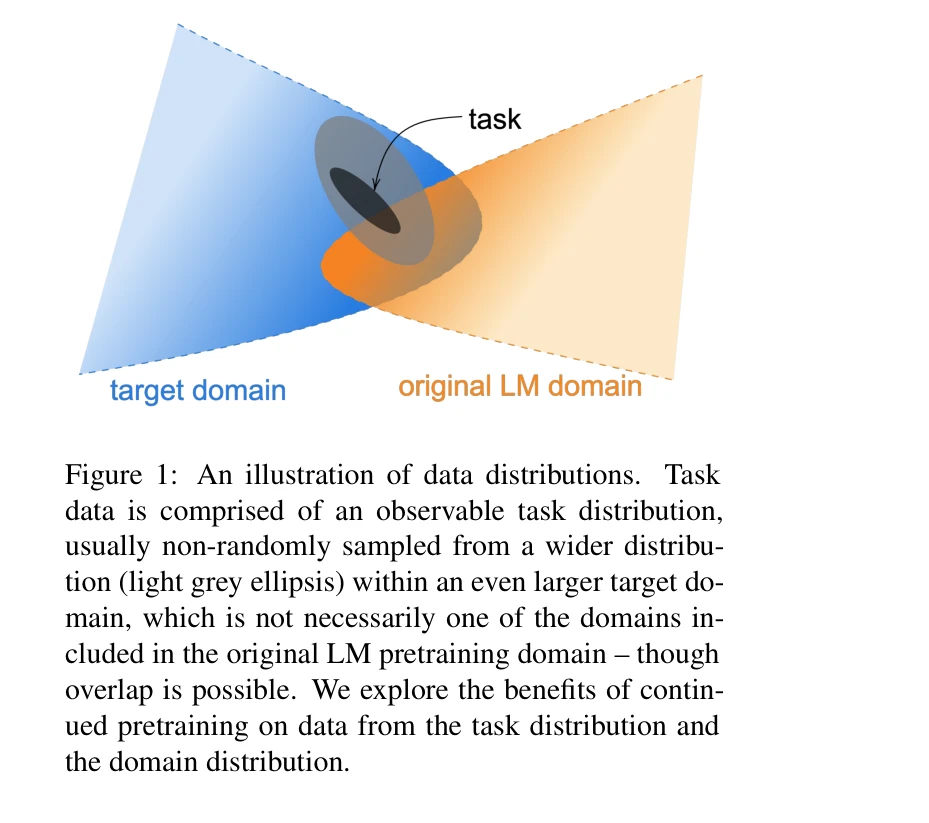

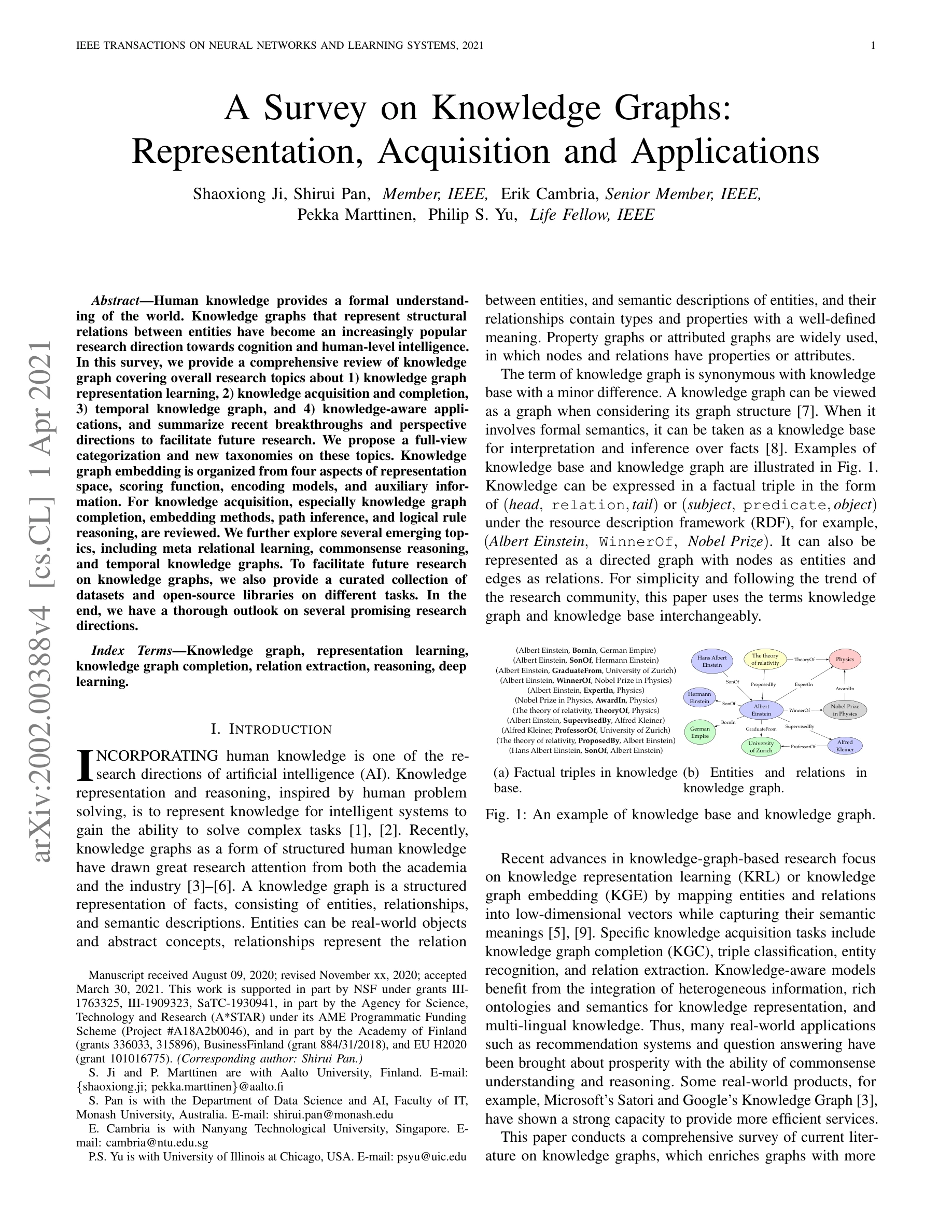

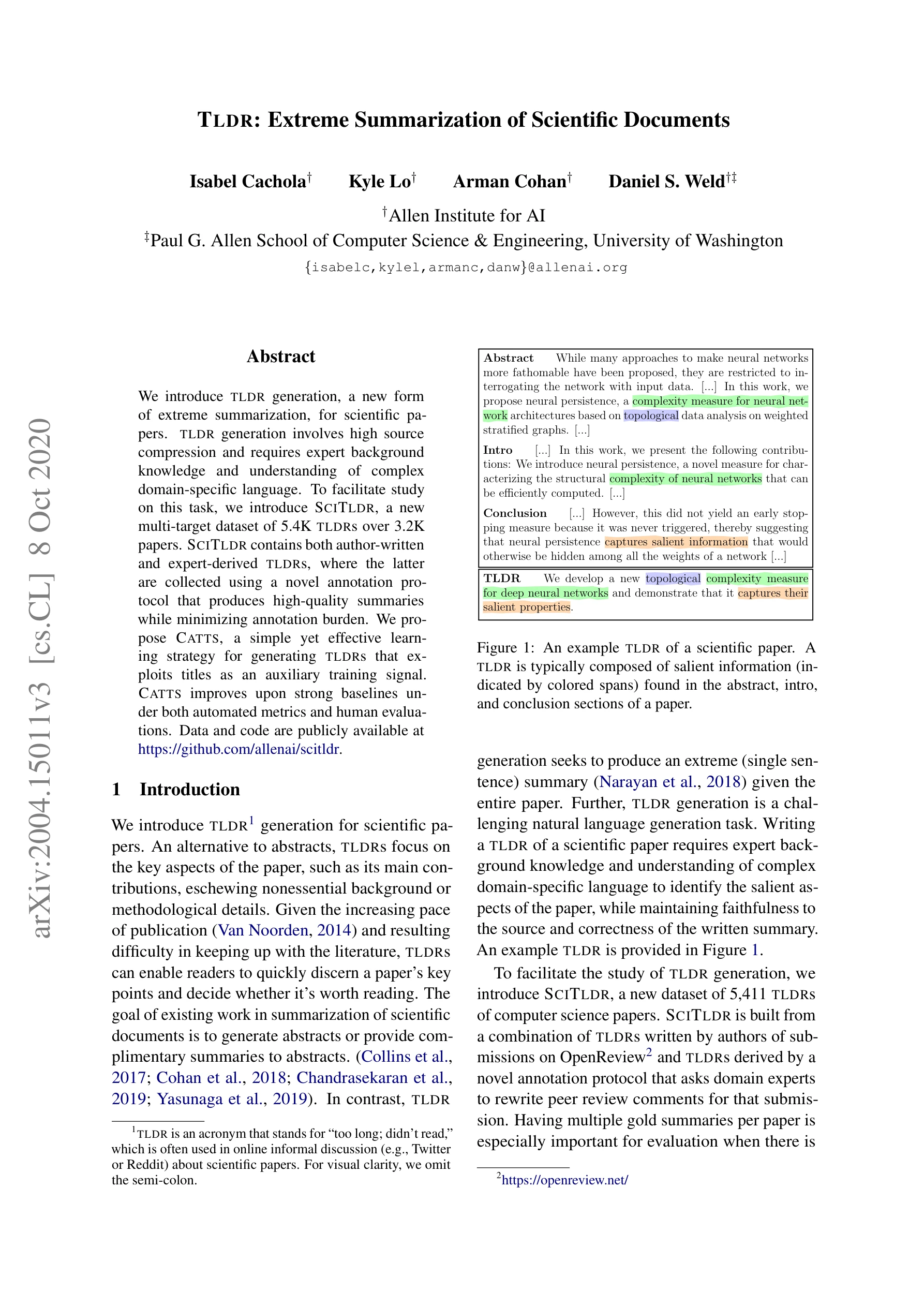

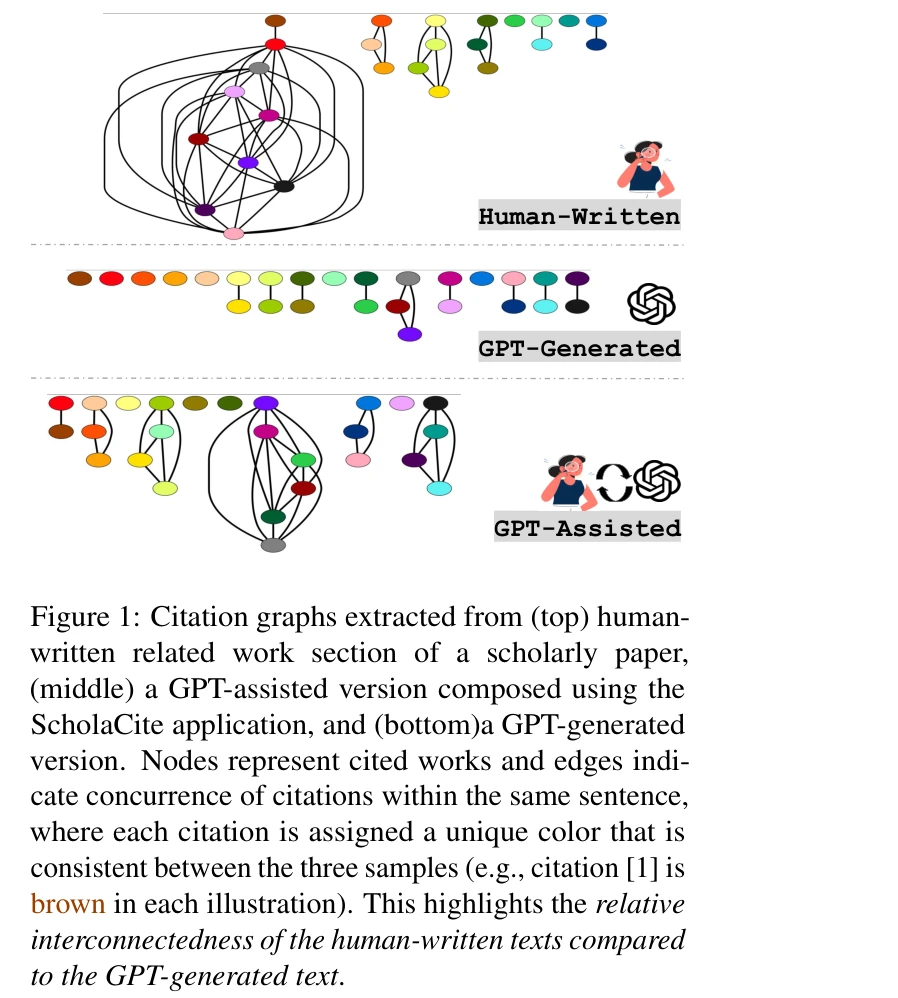

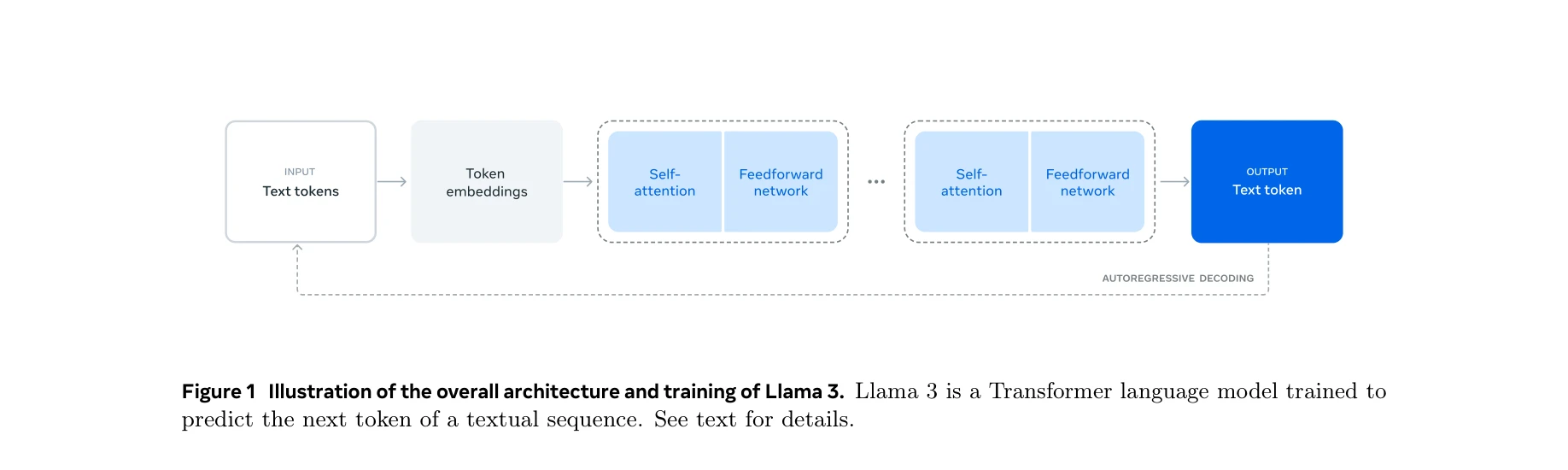

A survey of large language models

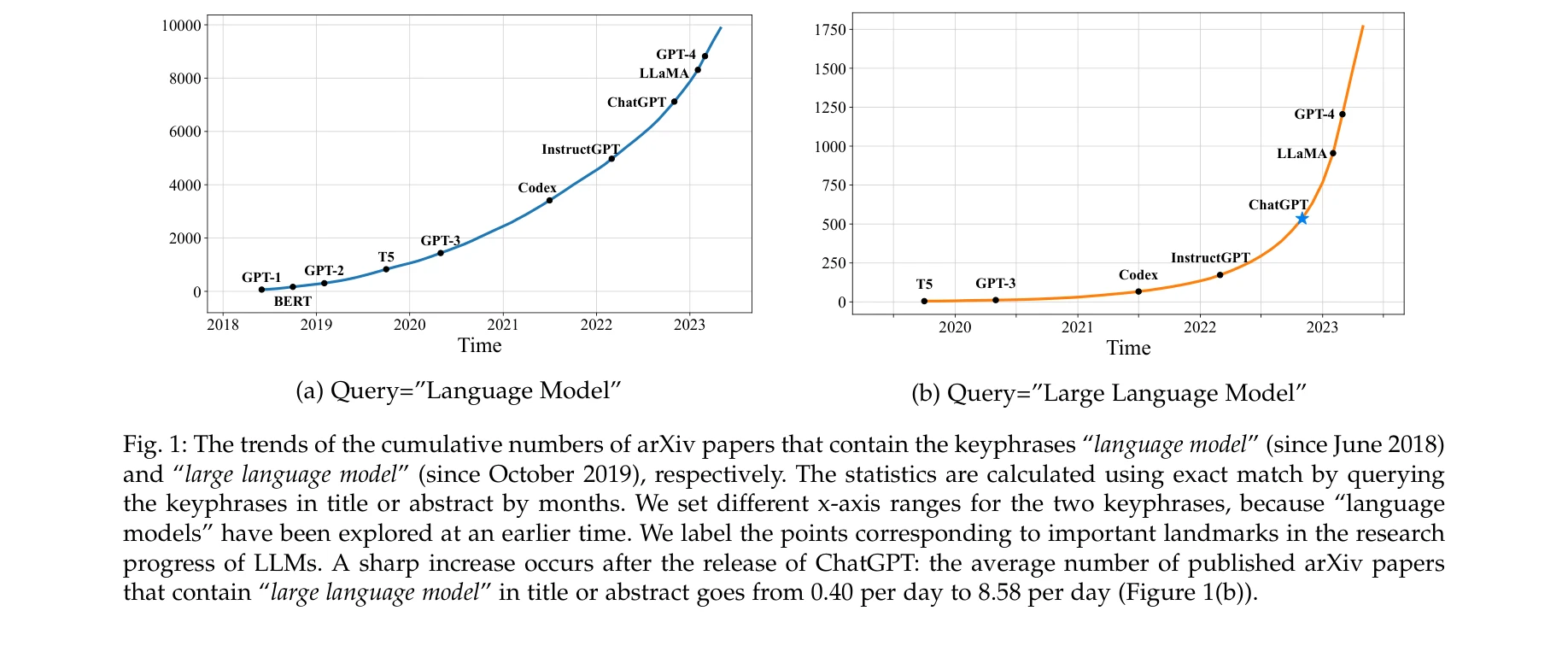

Fig. 1: The trends of the cumulative numbers of arXiv papers that contain the keyphrases “language model” (since June 20

*Fig. 2: An evolution process of the four generations of language models (LM) from the perspective of task solving capaci* 대규모 언어모델(LLM)의 발전 과정을 통계적 언어모델부터 신경망 언어모델, 사전학습 언어모델을 거쳐 현재의 생성형 대규모 모델까지 체계적으로 조사한 종합 서베이 논문이다.

이 서베이는 대규모 언어모델의 발전 역사와 핵심 기술을 체계적으로 정리한 매우 시의적절한 종합 자료로, 연구자와 실무자 모두에게 LLM의 현황을 이해하는 데 필수적인 참고자료이다.

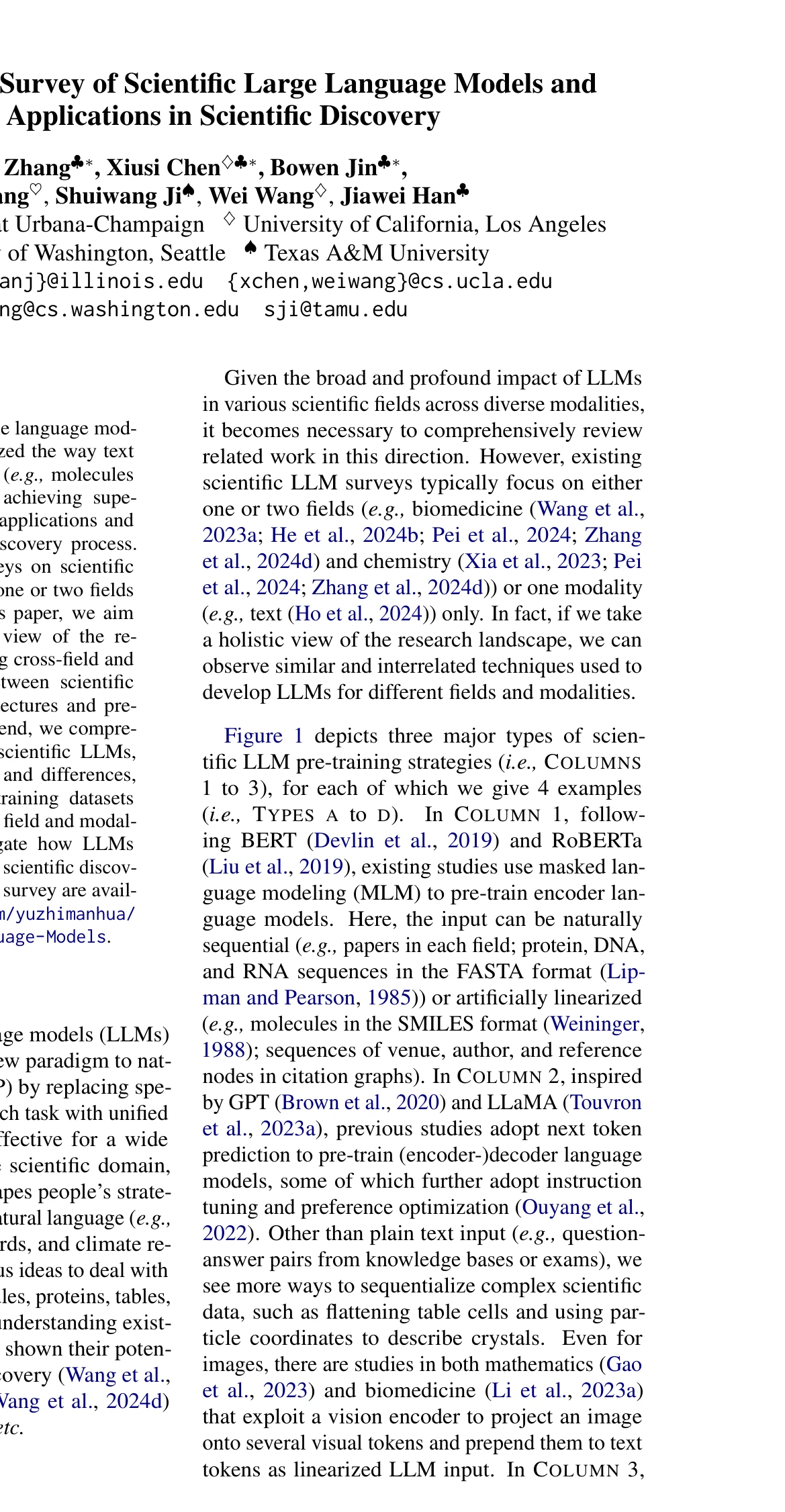

A Survey of Scientific Large Language Models: From Data Foundations to Agent Frontiers

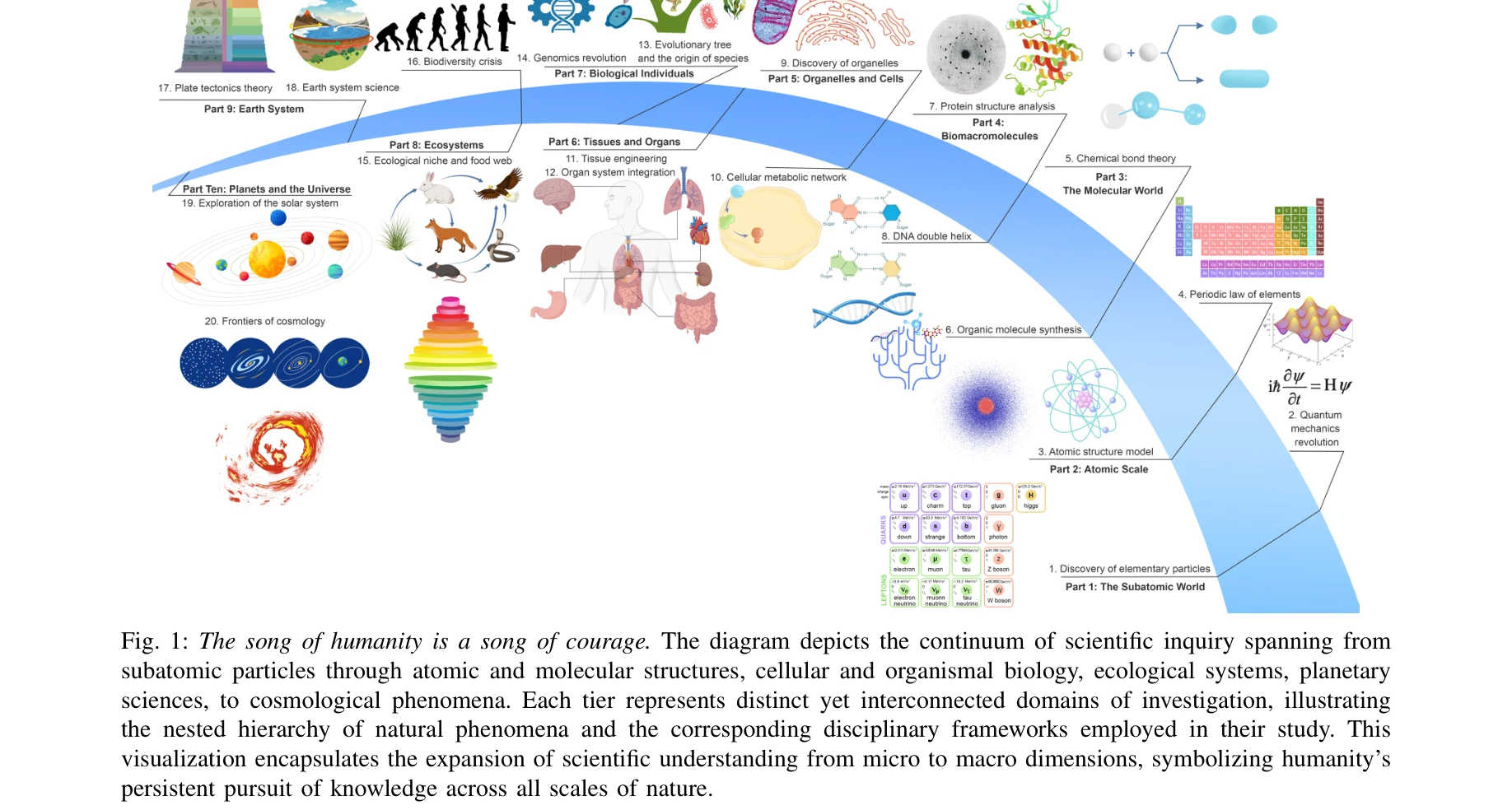

Fig. 1: The song of humanity is a song of courage. The diagram depicts the continuum of scientific inquiry spanning from

*Fig. 1: The song of humanity is a song of courage. The diagram depicts the continuum of scientific inquiry spanning from* 본 논문은 과학 분야 대규모 언어 모델(Scientific Large Language Models, Sci-LLMs)의 발전을 데이터 중심으로 종합 분석하는 설문연구로, 270개 이상의 사전/후학습 데이터셋과 190개 이상의 벤치마크를 검토하여 과학 AI의 로드맵을 제시한다.

본 설문연구는 과학 AI의 발전을 데이터 중심으로 종합적으로 분석하는 최초의 시도로, 혁신적인 분류체계와 광범위한 실증 분석을 통해 Sci-LLMs의 현황을 명확히 하고 자율 에이전트 기반 폐쇄 루프 시스템이라는 미래 방향을 제시한다. 과학 분야 AI의 로드맵으로서 높은 학술적 가치와 실용적 중요성을 가지고 있으나, 실제 구현 방안에 대한 상세한 기술과 각 도메인별 심화 분석은 후속 연구로 남겨져 있다.

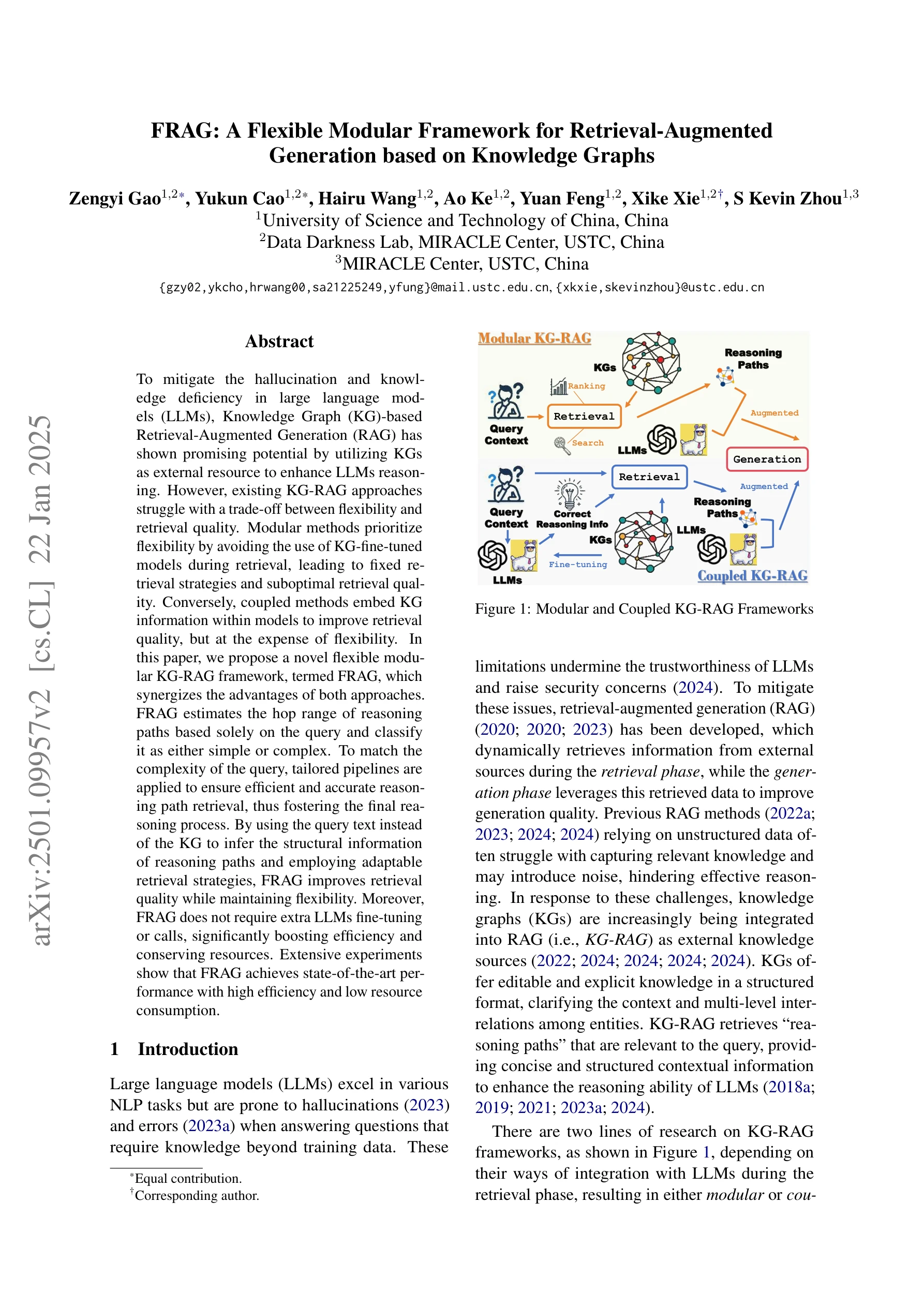

A Survey on RAG Meeting LLMs: Towards Retrieval-Augmented Large Language Models

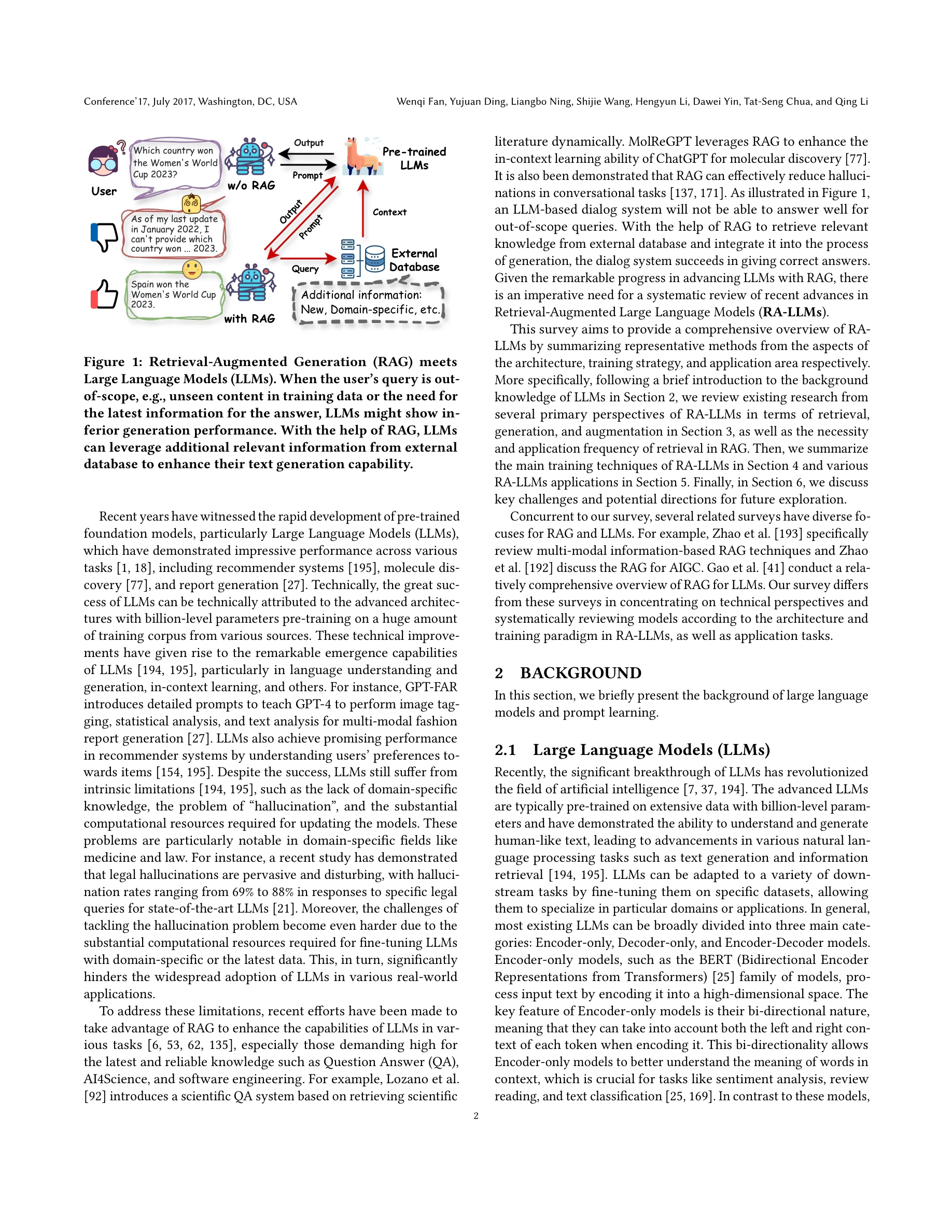

Figure 1: Retrieval-Augmented Generation (RAG) meets

*Figure 1: Retrieval-Augmented Generation (RAG) meets* 본 논문은 Retrieval-Augmented Generation (RAG)과 Large Language Models (LLMs)의 통합인 RA-LLMs에 대한 종합적인 설문조사로, 아키텍처, 훈련 전략, 응용 분야의 세 가지 기술적 관점에서 기존 연구를 체계적으로 리뷰한다.

본 논문은 RAG와 LLMs의 통합이라는 시대적 요구에 부응하여, 기술적 관점에서 가장 체계적이고 포괄적인 설문조사를 제공한다. Hallucination 문제 해결, 최신 정보 활용, 도메인 특화 응용 등의 실제 가치와 함께 아키텍처-훈련-응용이라는 명확한 분류 체계를 제시함으로써 RA-LLMs 연구 분야의 중요한 기준점이 될 것으로 기대된다.

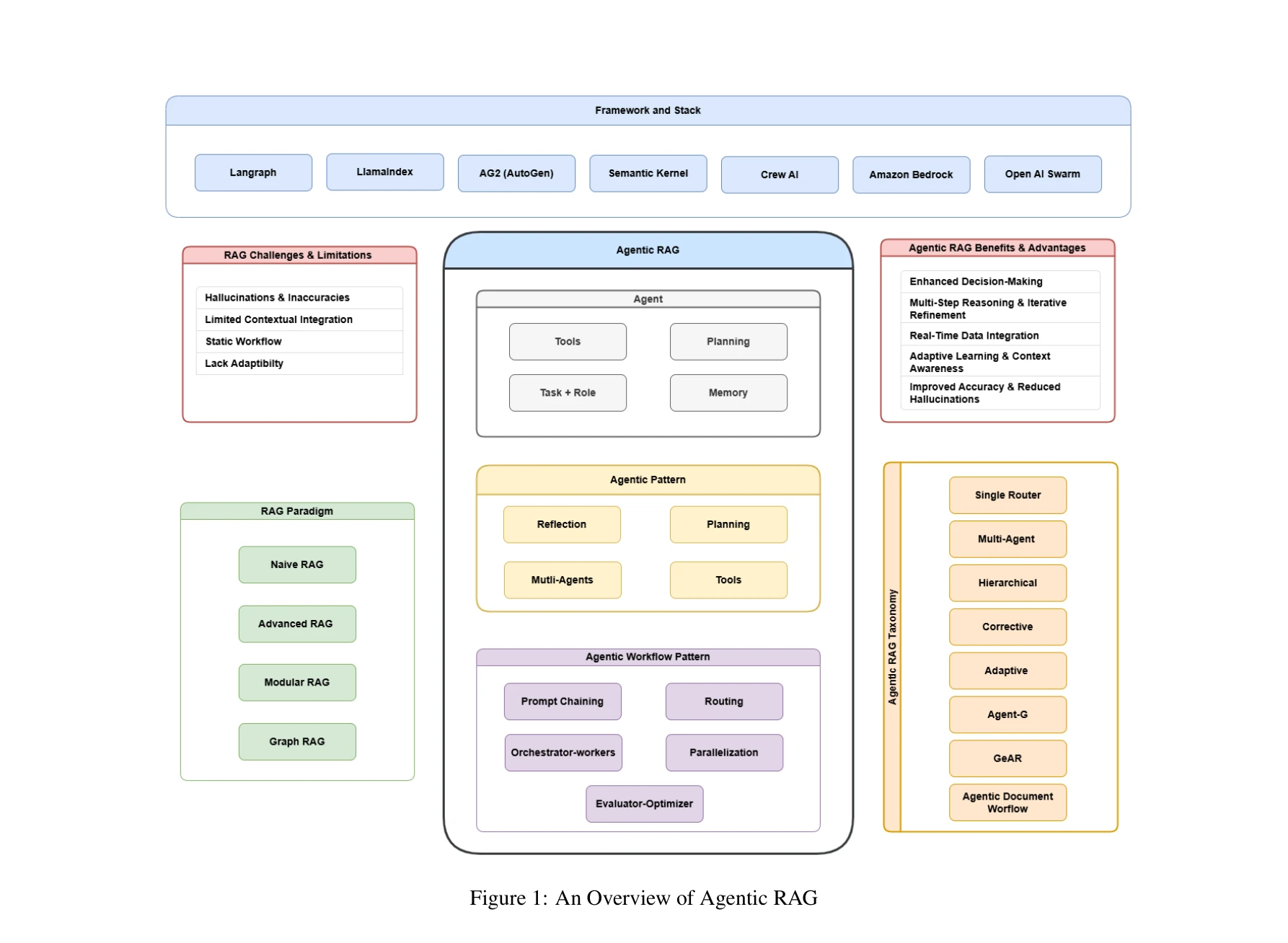

Agentic retrieval-augmented generation: A survey on agentic rag

*Agentic RAG의 전체 개요* 대규모 언어모델(LLM)의 정적 학습 데이터 의존성을 극복하기 위해 자율 AI 에이전트를 RAG 파이프라인에 통합한 Agentic RAG 시스템에 대한 포괄적인 설문 논문이다. 이는 반성(reflection), 계획(planning), 도구 활용(tool use), 다중 에이전트 협력을 통해 동적 검색 전략과 적응형 워크플로우를 가능하게 한다.

본 논문은 RAG에서 Agentic RAG로의 패러다임 진화를 체계적으로 정리하고 실무 구현을 위한 실질적 가이드를 제공하는 우수한 설문 논문이다. 다만 신규 알고리즘 개발이나 대규모 실증적 검증이 부재하여 기여도에는 한계가 있으며, 향후 Agentic RAG의 성능 벤치마킹과 윤리적 검증 연구가 필요하다.

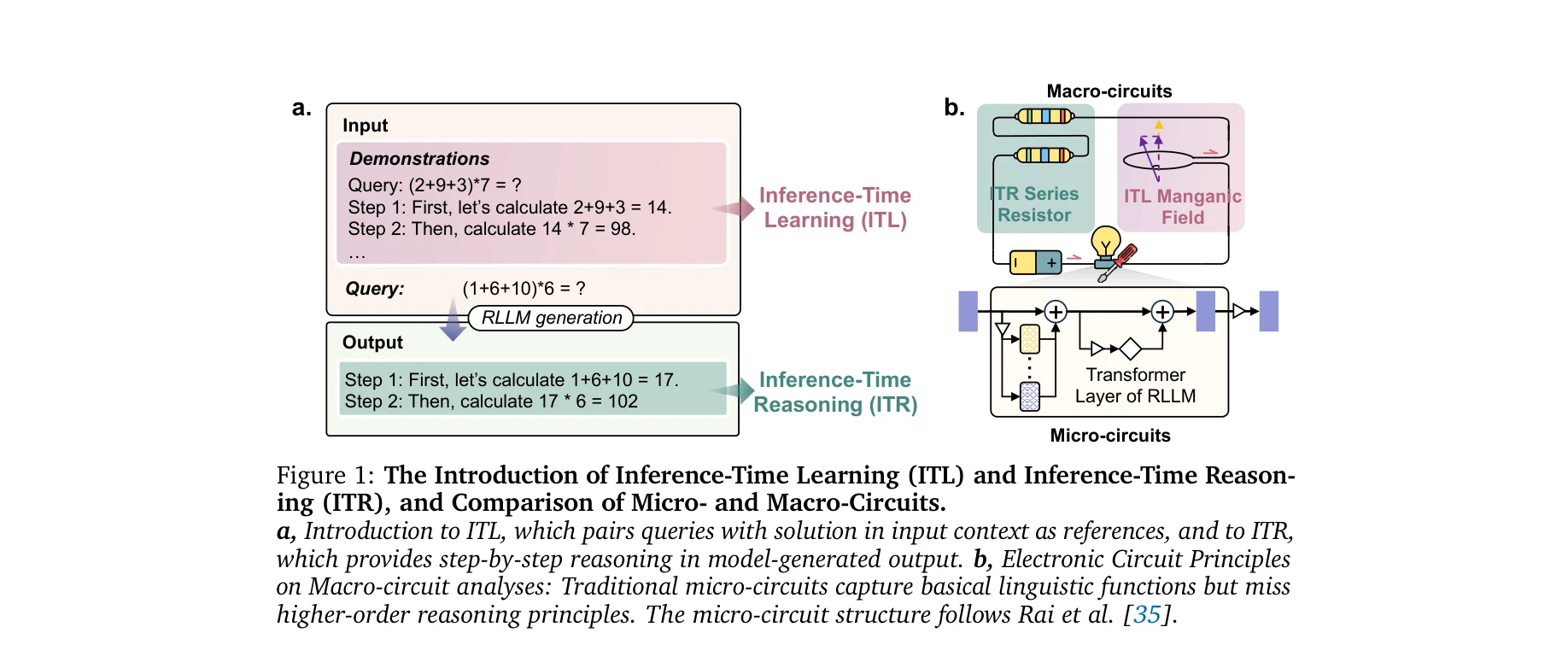

Ecm: A unified electronic circuit model for explaining the emergence of in-context learning and chain-of-thought in large language model

*Figure 2: Glossary of Terms and Schematic of Electronic Circuit Principles (ECP).* Large Language Models의 추론 능력을 전자회로 원리(Electronic Circuit Principles, ECP)로 모델링하여, 맥락 내 학습(in-context learning)과 사고의 연쇄(chain-of-thought)의 출현을 설명하고 성능을 예측하는 통합 프레임워크를 제시한다.

본 논문은 LLM의 추론 능력을 전자회로 원리로 우아하게 모델링하여 성능 예측과 최적화를 위한 통일된 이론적 토대를 제공한다. 광범위한 실증 검증과 경쟁 성과로 실용성을 입증했으나, 파라미터 추정 방식의 명확화와 더 다양한 모델/도메인 검증이 필요하다.

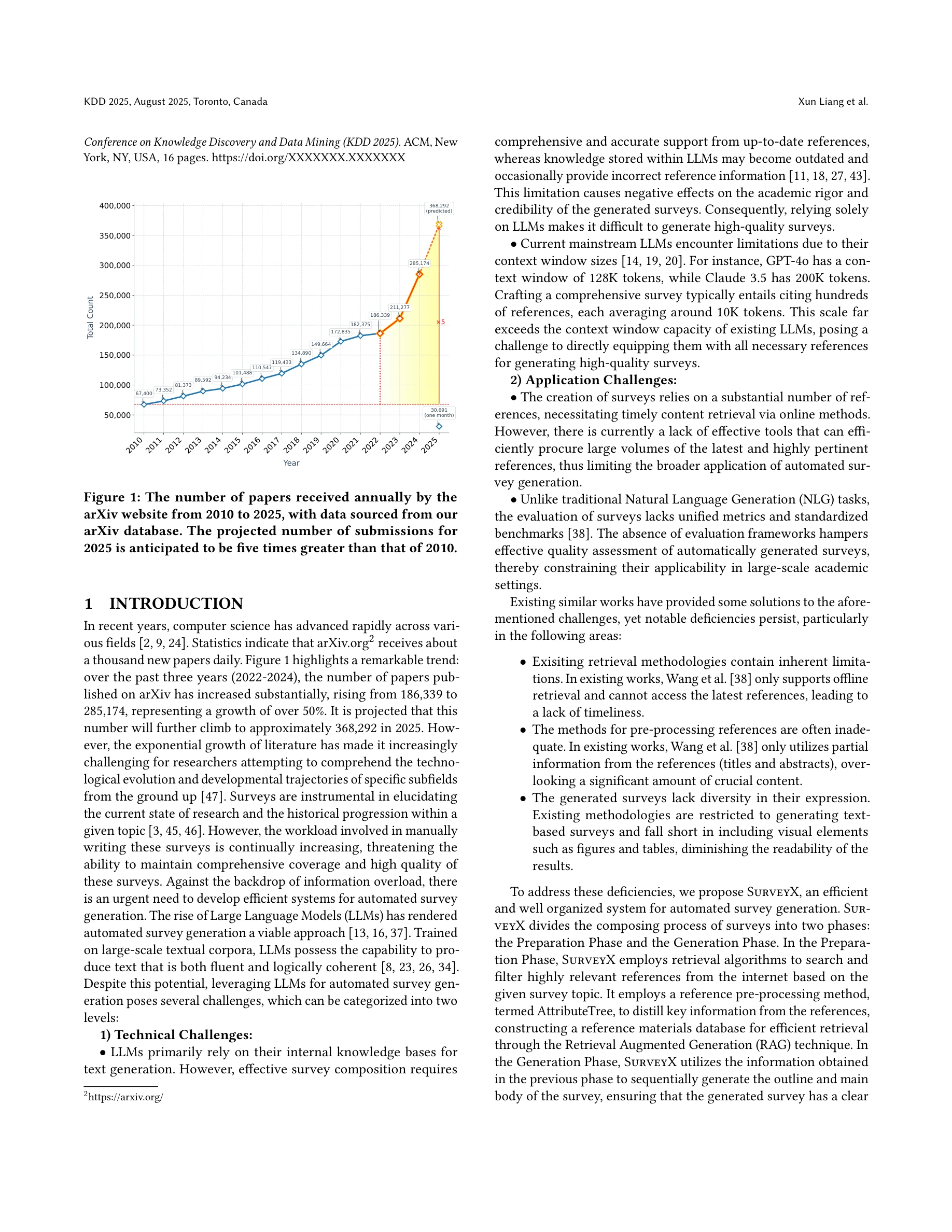

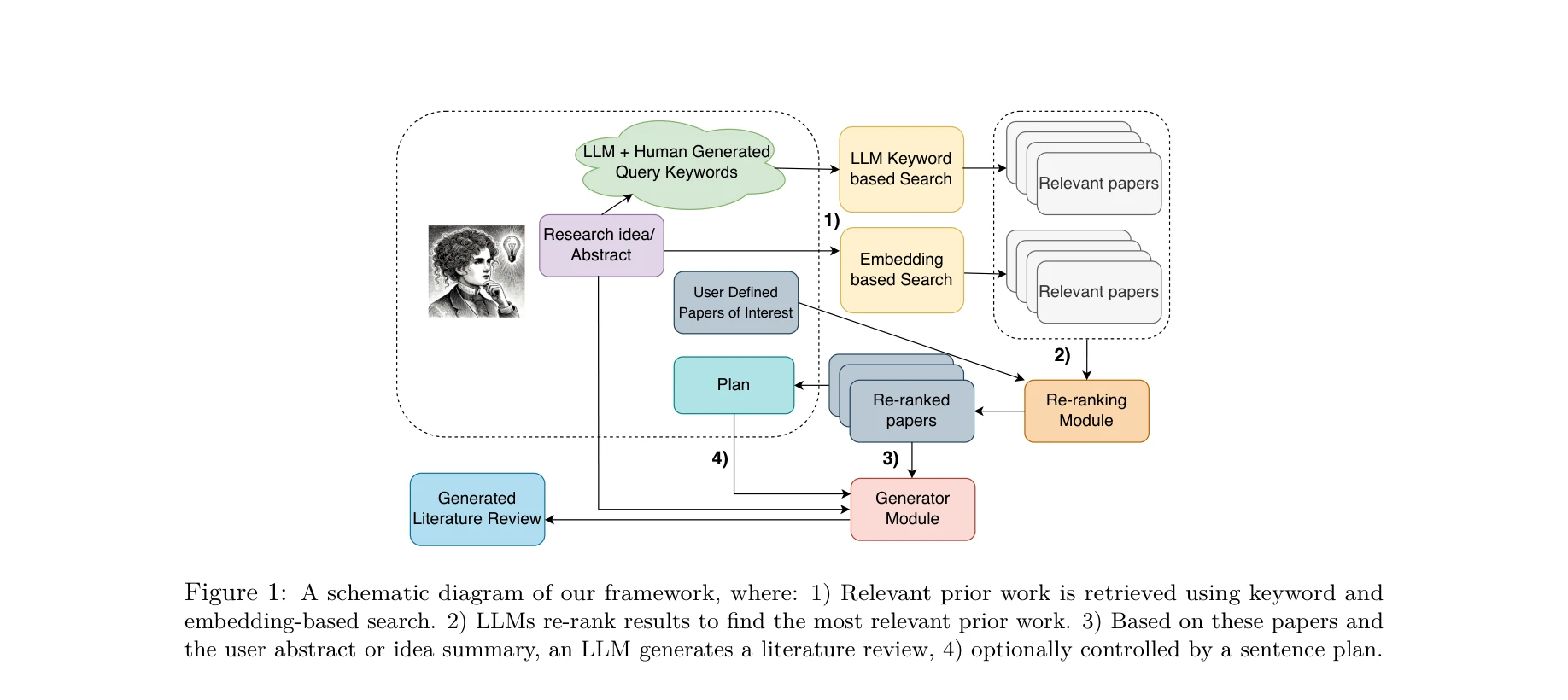

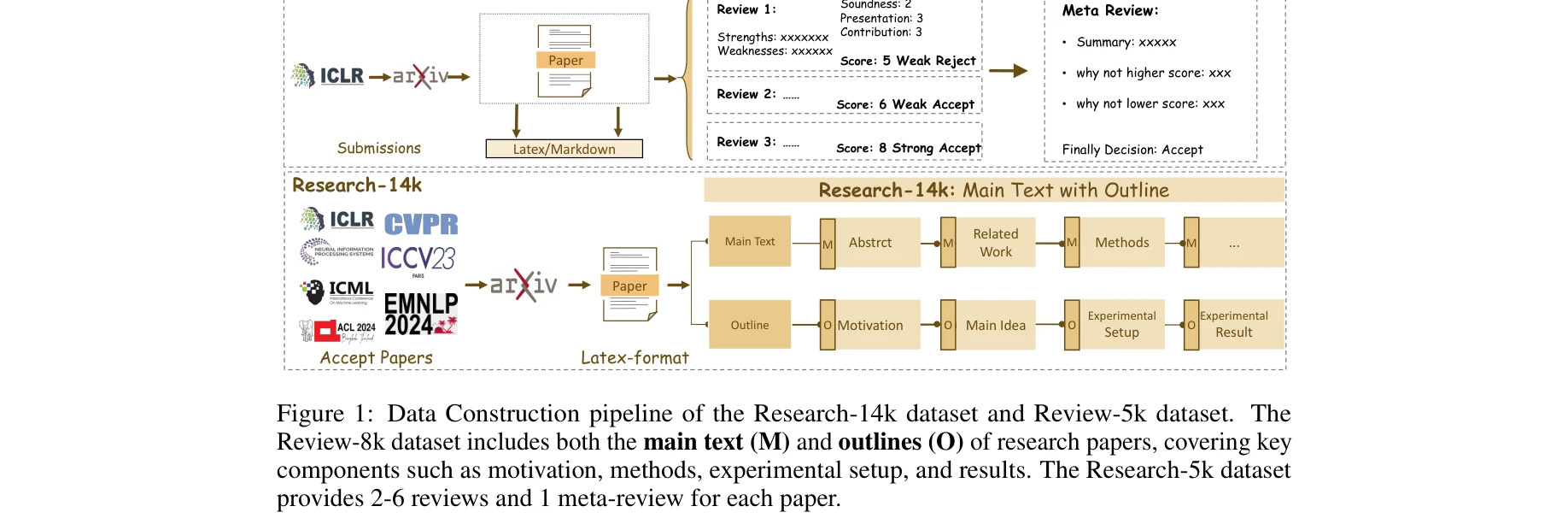

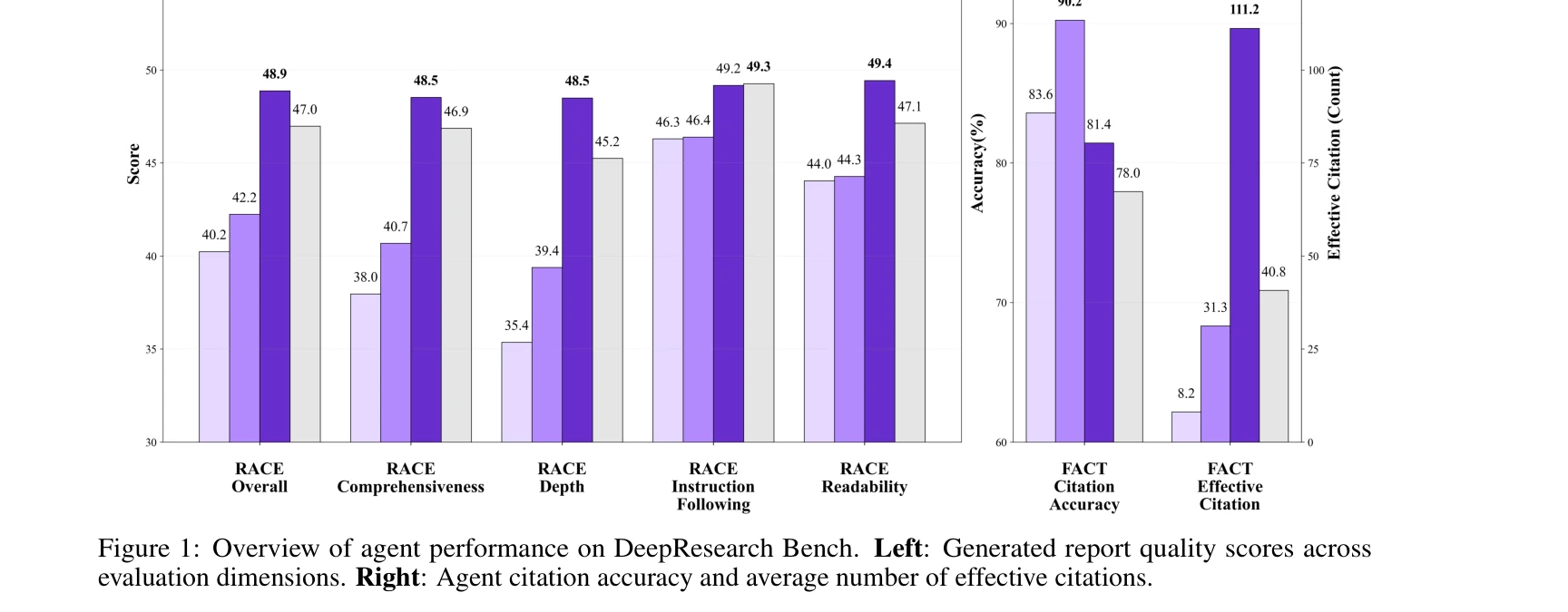

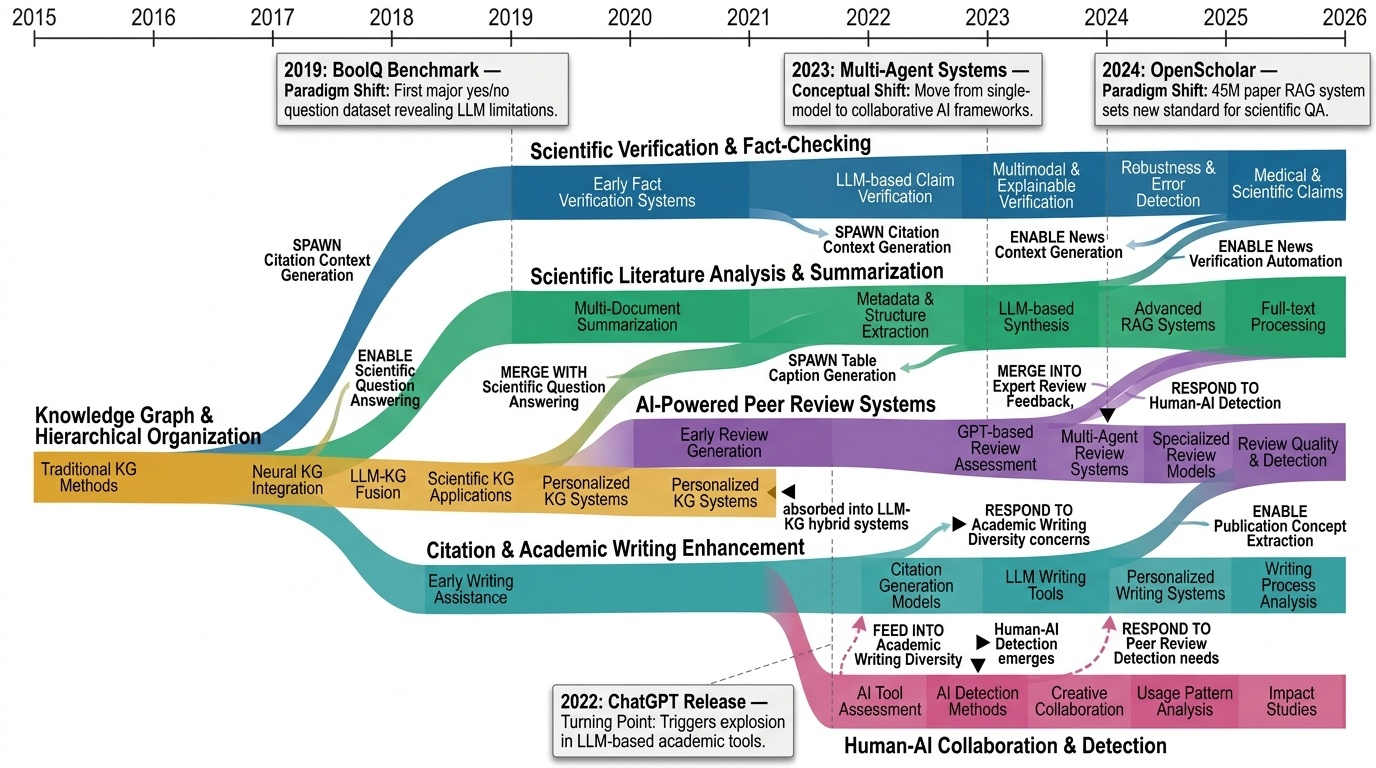

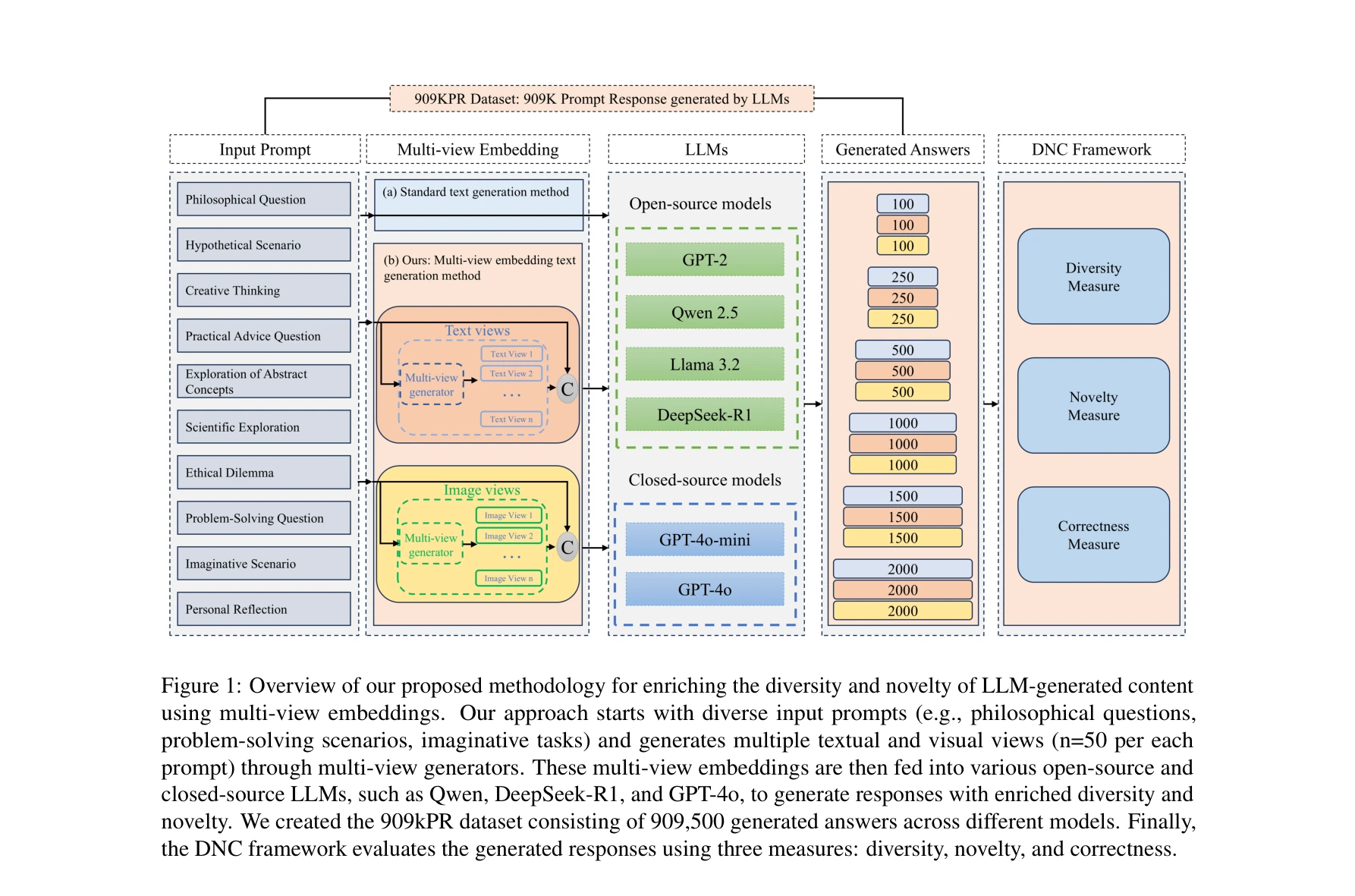

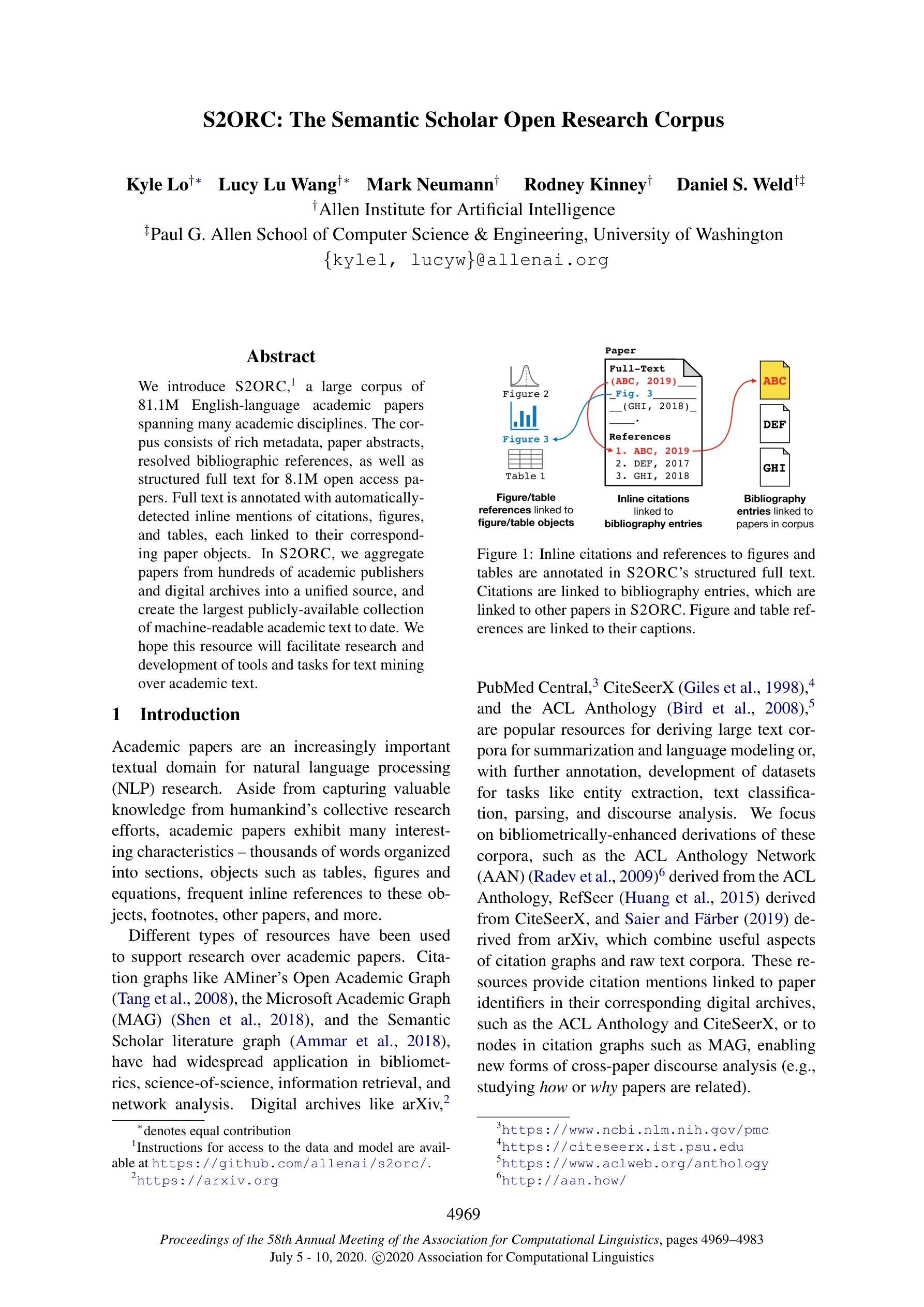

SurveyX: Academic survey automation via large language models

arXiv 웹사이트의 연간 논문 수 추이(2010-2025): 2025년 제출 건수는 2010년의 5배 이상으로 예상

*SurveyX의 전체 파이프라인: 준비 단계(Part 1: 논문 검색 및 자료 전처리)와 생성 단계(Part 2: 논문 작성 및 개선)로 구성* arXiv에 매년 증가하는 학술 논문의 폭증 속에서, 대형언어모델(LLM)을 활용하여 체계적이고 고품질의 학술 서베이를 자동 생성하는 SurveyX 시스템을 제안한다. 이 시스템은 온라인 참고문헌 검색, AttributeTree 전처리 방법, 그리고 다단계 최적화를 통해 기존 자동 서베이 생성 시스템의 한계를 극복한다.

SurveyX는 LLM 기반 자동 서베이 생성의 실용적 한계를 체계적으로 해결하고, 온라인 검색, 지능형 전처리, 멀티모달 확장을 통해 기존 AutoSurvey 대비 명확한 성능 향상을 입증한 의미 있는 연구이나, 평가의 포괄성과 방법론의 이론적 깊이 강화가 필요하다.

Large physics models: towards a collaborative approach with large language models and foundation models

본 논문은 물리학 연구에 특화된 대규모 AI 모델인 Large Physics Models (LPMs)의 개발과 평가를 위한 로드맵을 제시하며, 대규모 언어모델(LLM)과 기초모델(Foundation Model)을 물리학 커뮤니티의 협력 구조로 통합하는 방안을 제안한다.

본 논문은 물리학-AI 연계의 미래 방향을 학제간 협력과 철학적 성찰을 포함하여 창의롭게 제시한 중요한 비전 문서이나, 구체적인 기술 구현 방안과 실행 가능성 평가가 미흡하여 다음 단계의 파일럿 연구로 보완되어야 함.

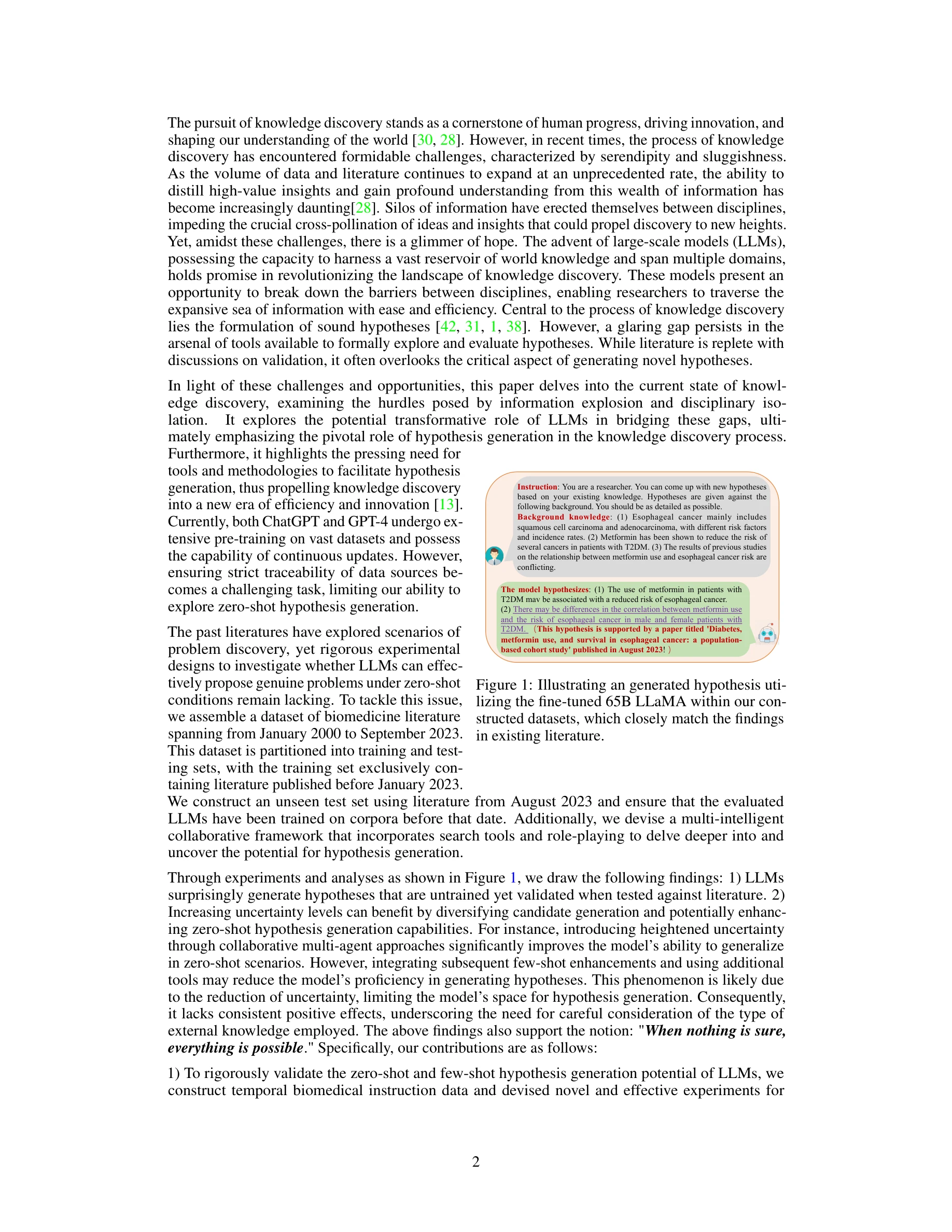

Large Language Models are Zero Shot Hypothesis Proposers

*그림 1: 미세조정된 65B LLaMA 모델이 생성한 가설의 예시로, 기존 문헌의 발견과 유사한 결과를 도출함* 대규모언어모델(LLM)이 학습되지 않은 과학 가설을 제시할 수 있으며, 생성된 가설이 실제 출판된 문헌과 일치하는 검증 가능한 내용임을 입증하는 연구이다. 특히 불확실성 증가가 영점 학습(zero-shot) 가설 생성 능력을 향상시킨다는 발견을 제시한다.

본 논문은 LLM의 과학적 가설 생성 능력을 형식적으로 검증하는 선구적 연구로, 시간 기반 데이터셋 분할과 불확실성의 긍정적 역할이라는 흥미로운 발견을 제시한다. 그러나 평가 메트릭의 정의 부족, 생의학 도메인 한정, 그리고 실제 과학적 유효성 검증의 미흡함으로 인해 기술적 완성도가 다소 낮으며, 추가적인 실험과 엄밀한 분석이 필요하다.

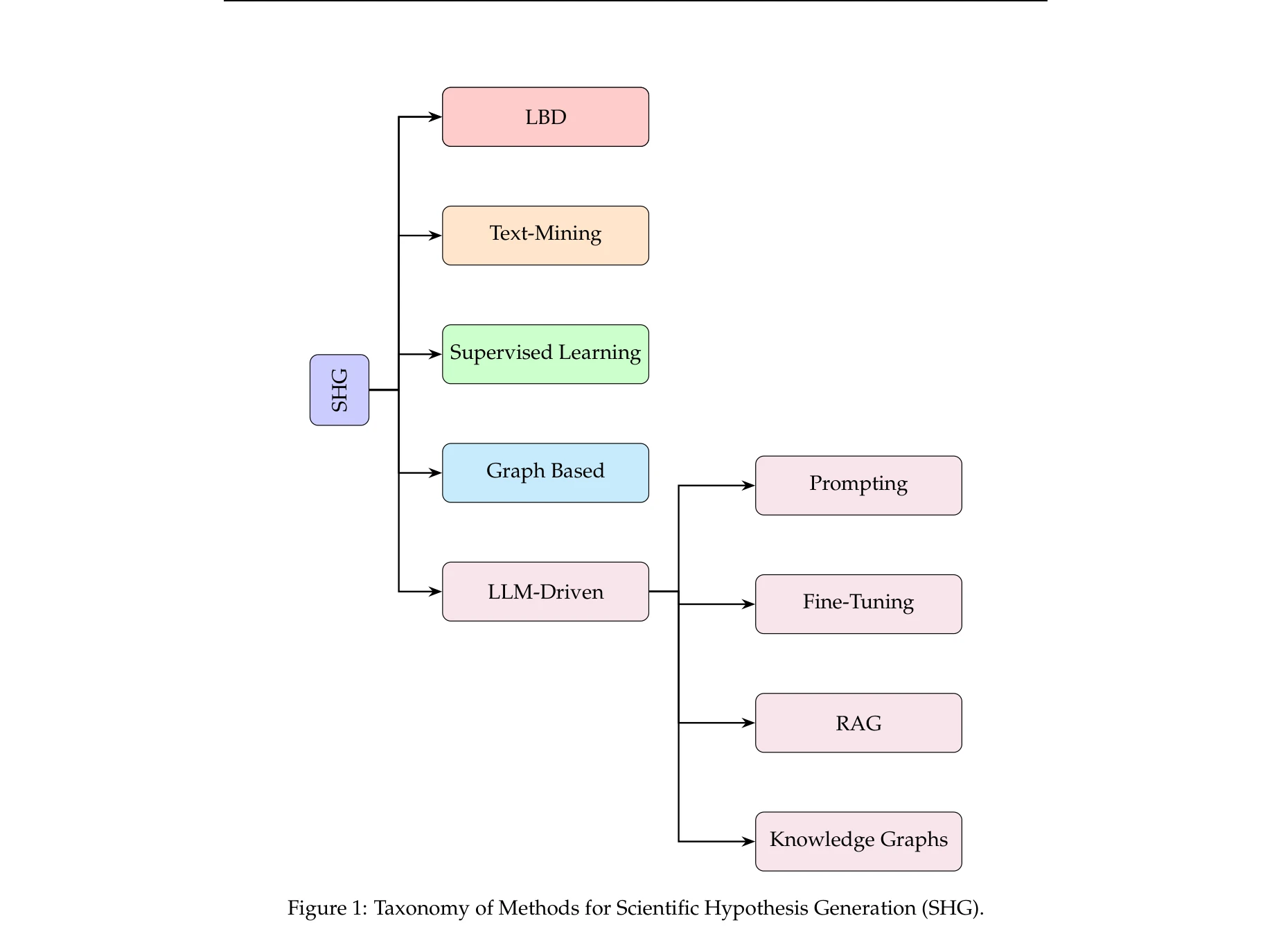

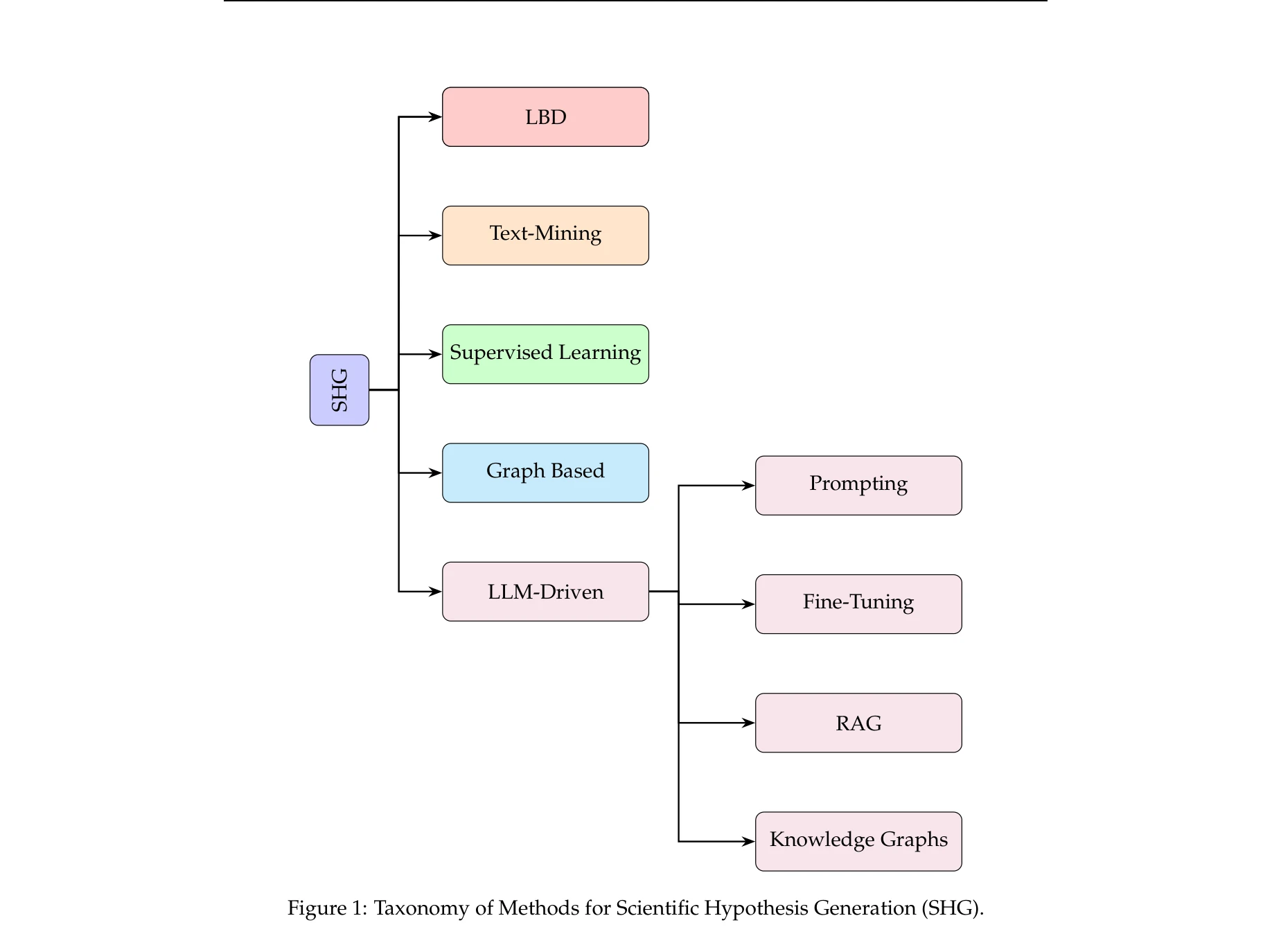

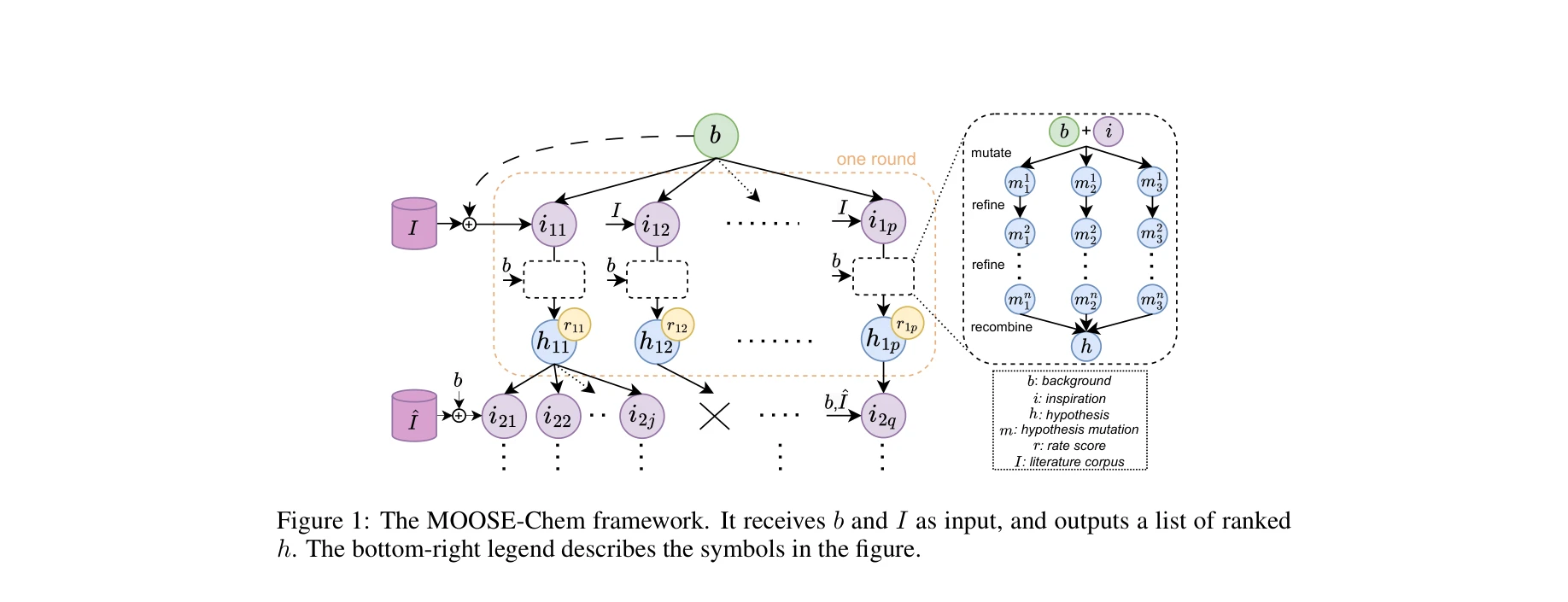

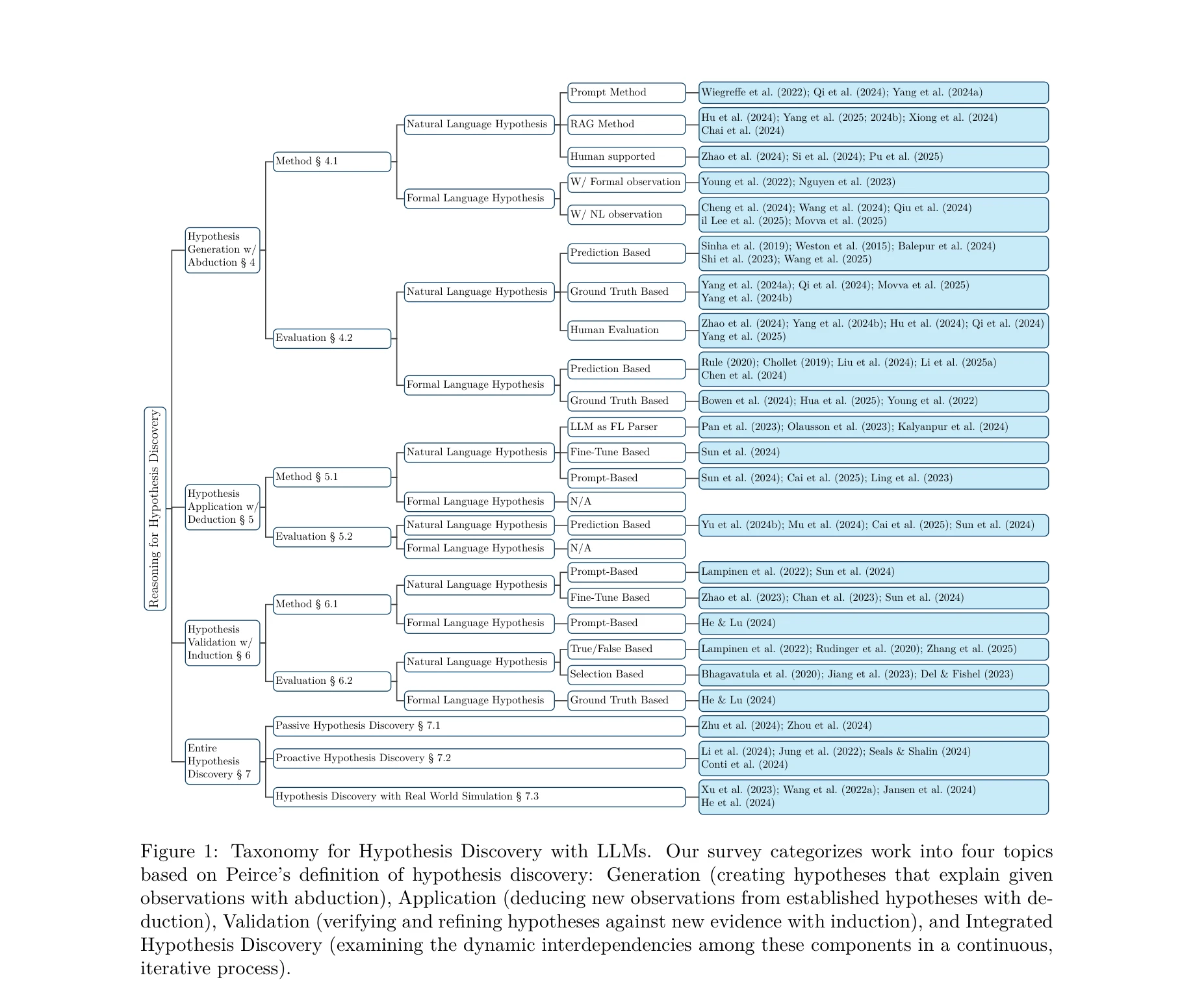

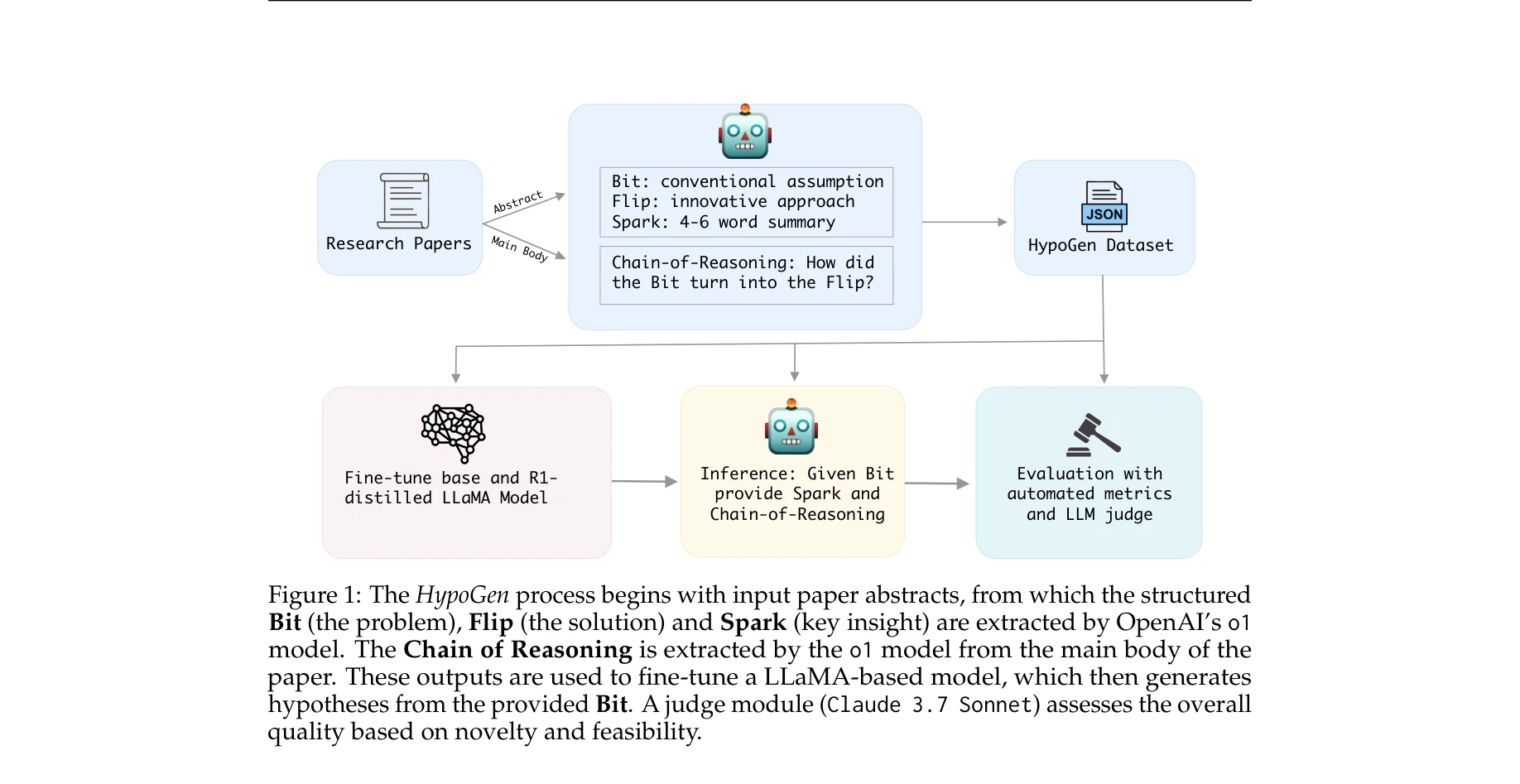

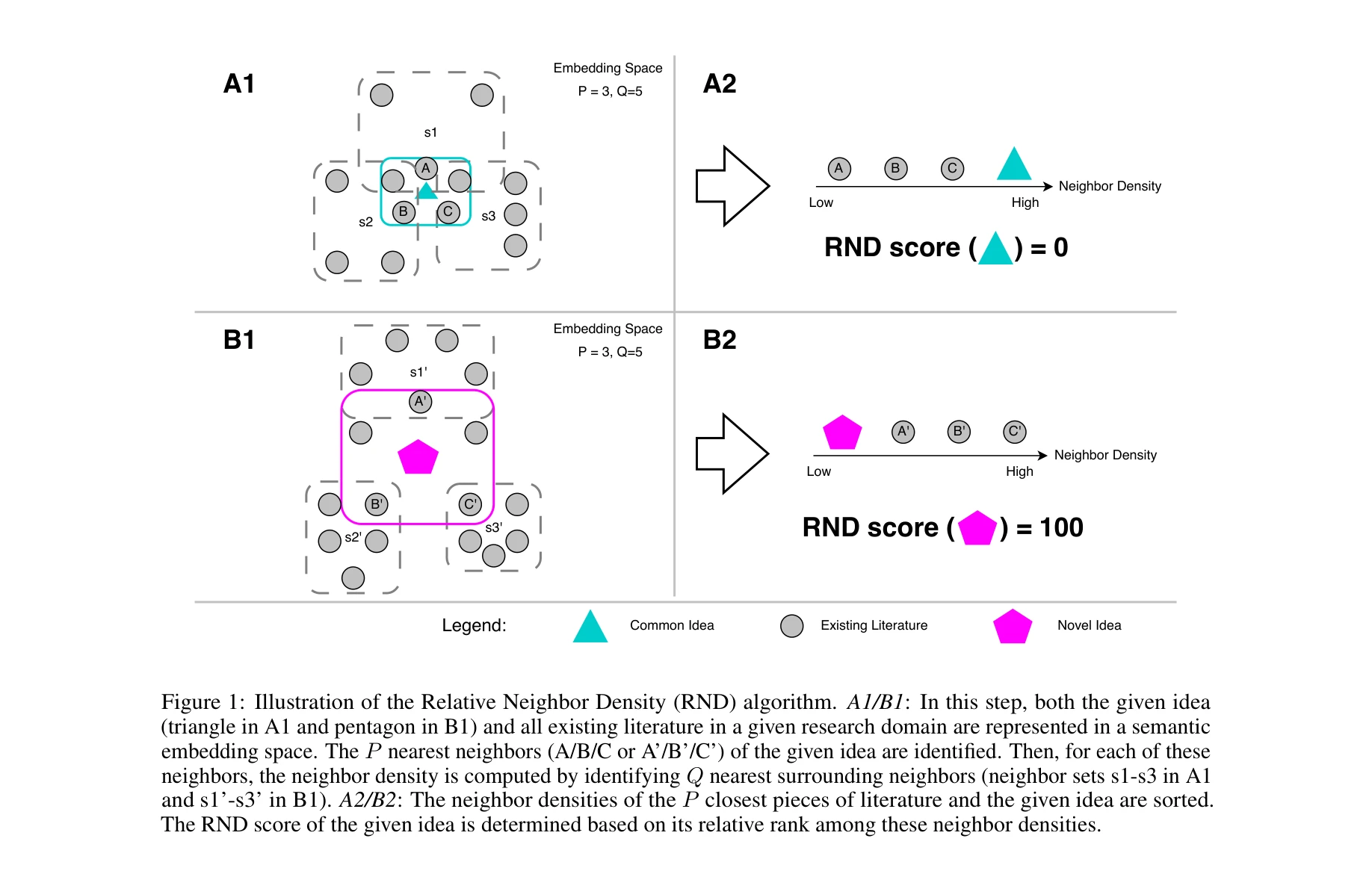

A Survey on Hypothesis Generation for Scientific Discovery in the Era of Large Language Models

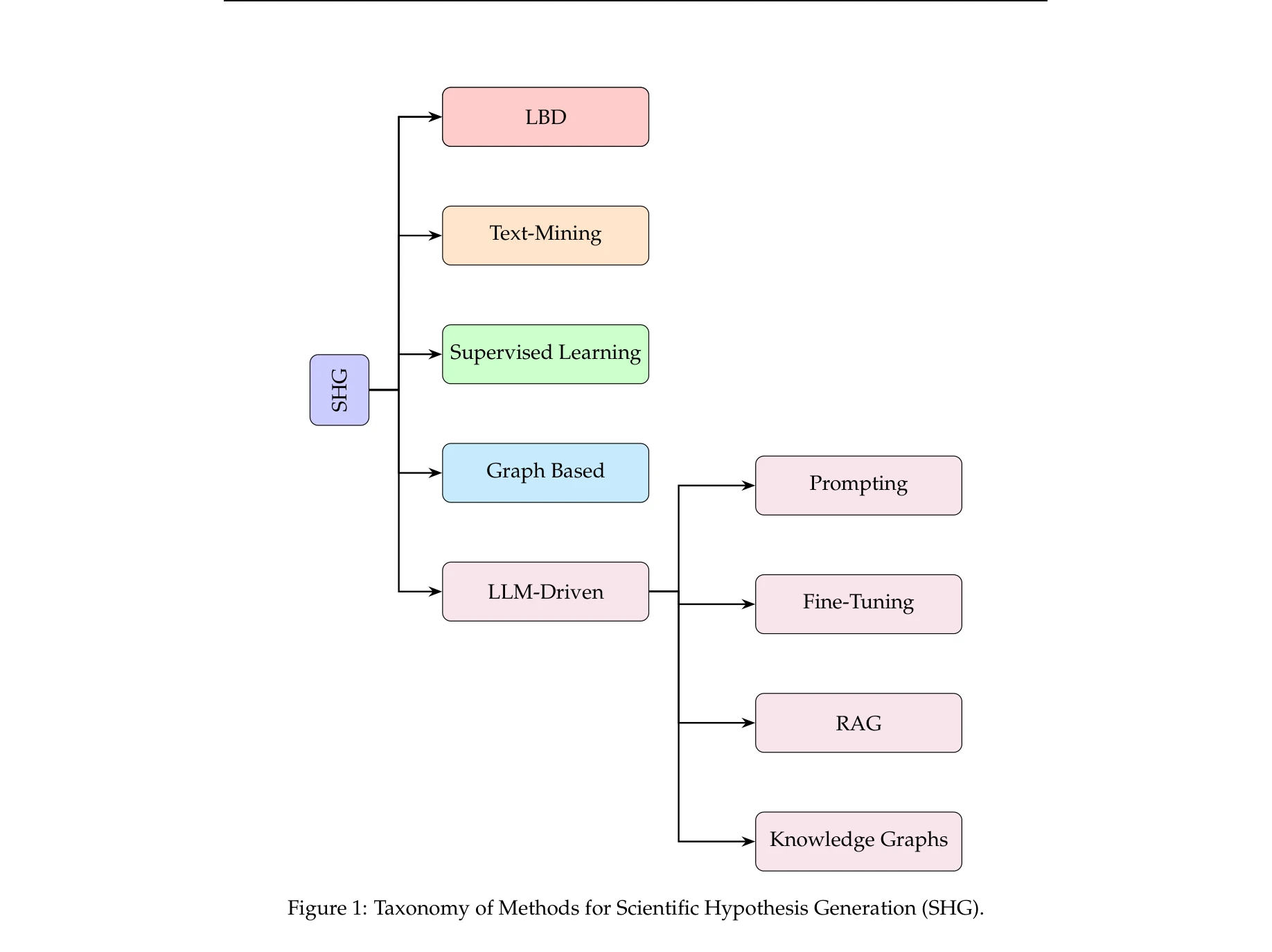

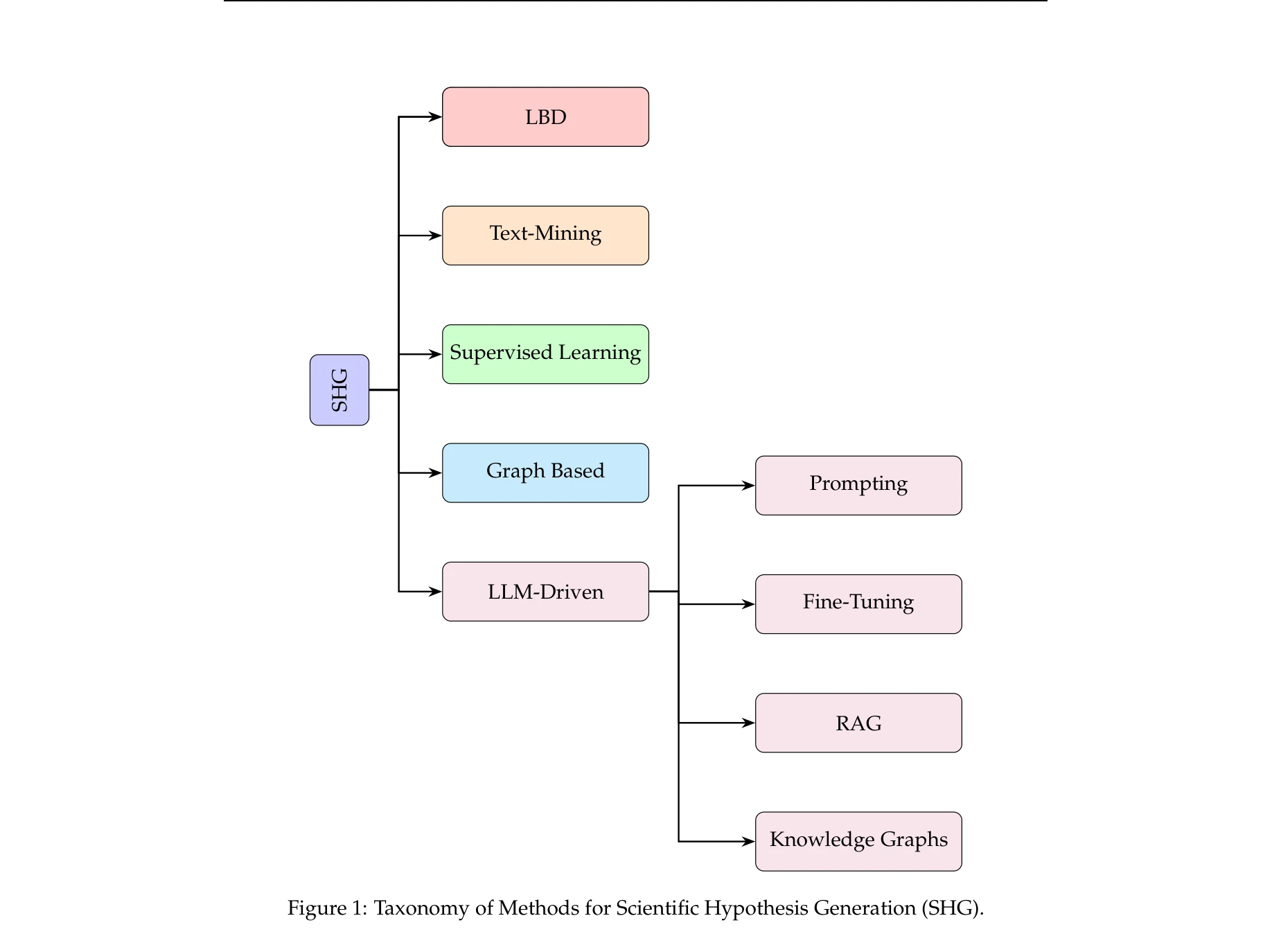

Figure 1: Taxonomy of Methods for Scientific Hypothesis Generation (SHG).

*Figure 1: Taxonomy of Methods for Scientific Hypothesis Generation (SHG).* 대규모언어모델(LLM)을 활용한 과학적 가설 생성 방법을 종합적으로 조사한 논문으로, 기존 방법부터 최신 LLM 기반 프레임워크까지 체계적으로 분류하고 평가 전략 및 향후 방향을 제시한다.

이 논문은 급속히 진화하는 LLM 기반 가설 생성 분야에 대한 시의적절한 종합 조사로서, 명확한 분류체계와 미래 방향 제시로 학문적 가치가 있다. 다만 실증적 평가 부족과 표준화된 벤치마크 부재는 후속 연구에서 보완되어야 할 중요한 과제이다.

Best Practices for Using AI When Writing Scientific Manuscripts: Caution, Care, and Consideration: Creative Science Depends on It

ChatGPT와 같은 AI 기반 언어 모델(language model)의 급속한 확산에 따라, 과학 논문 작성 시 이러한 도구의 활용에 대한 명확한 지침과 모범 사례를 제시하는 논설(editorial) 논문이다. 저자들은 AI 언어 봇의 강점과 제한점을 균형 있게 분석하여 책임감 있는 사용을 촉구한다.

ChatGPT의 급속한 확산에 선제적으로 대응하는 책임감 있는 에디토리얼로, 과학적 창의성 보호와 윤리성 강조라는 핵심 메시지를 효과적으로 전달한다. 다만 강제성 있는 정책 수립이나 기술적 검증 방안은 후속 과제로 남아있다.

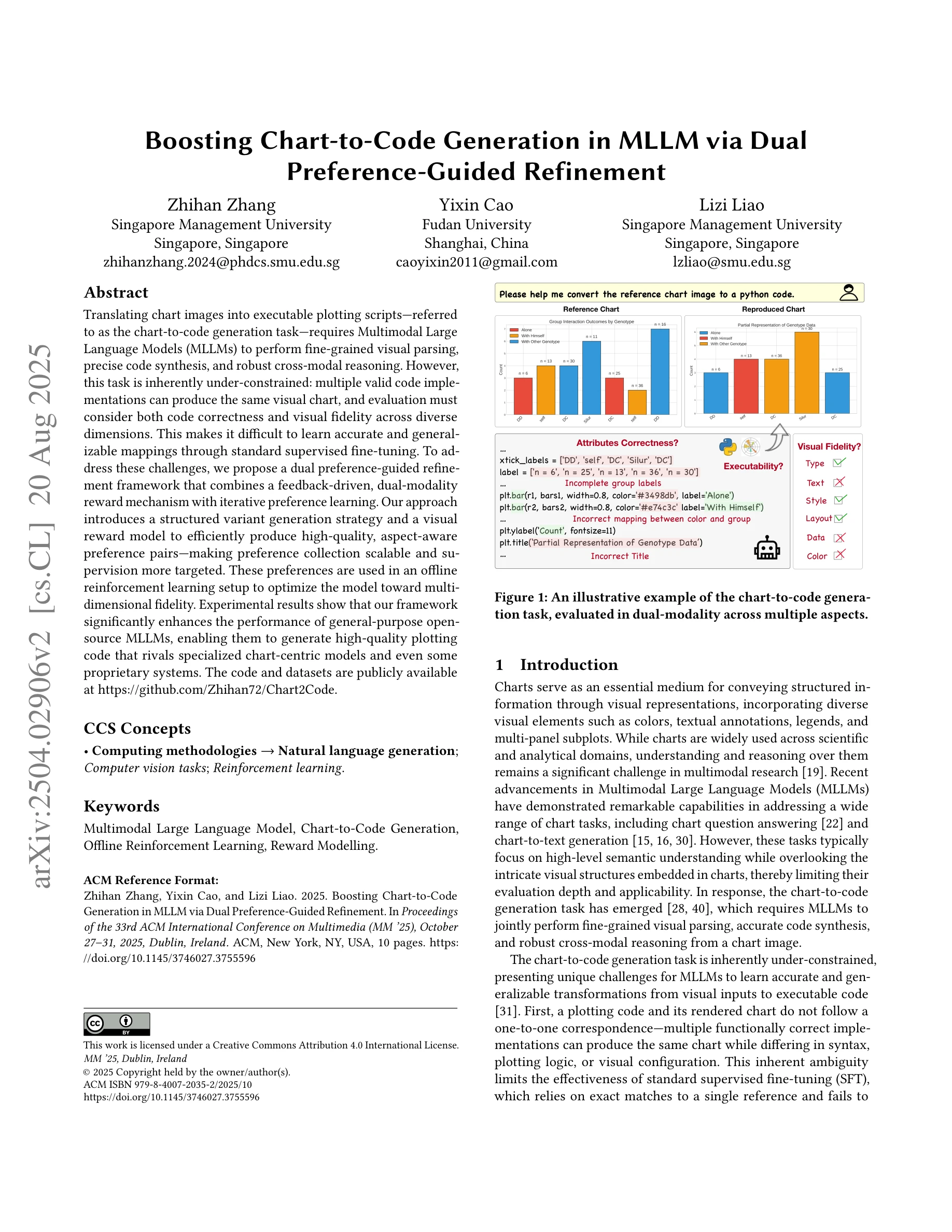

ChartLlama: A Multimodal LLM for Chart Understanding and Generation

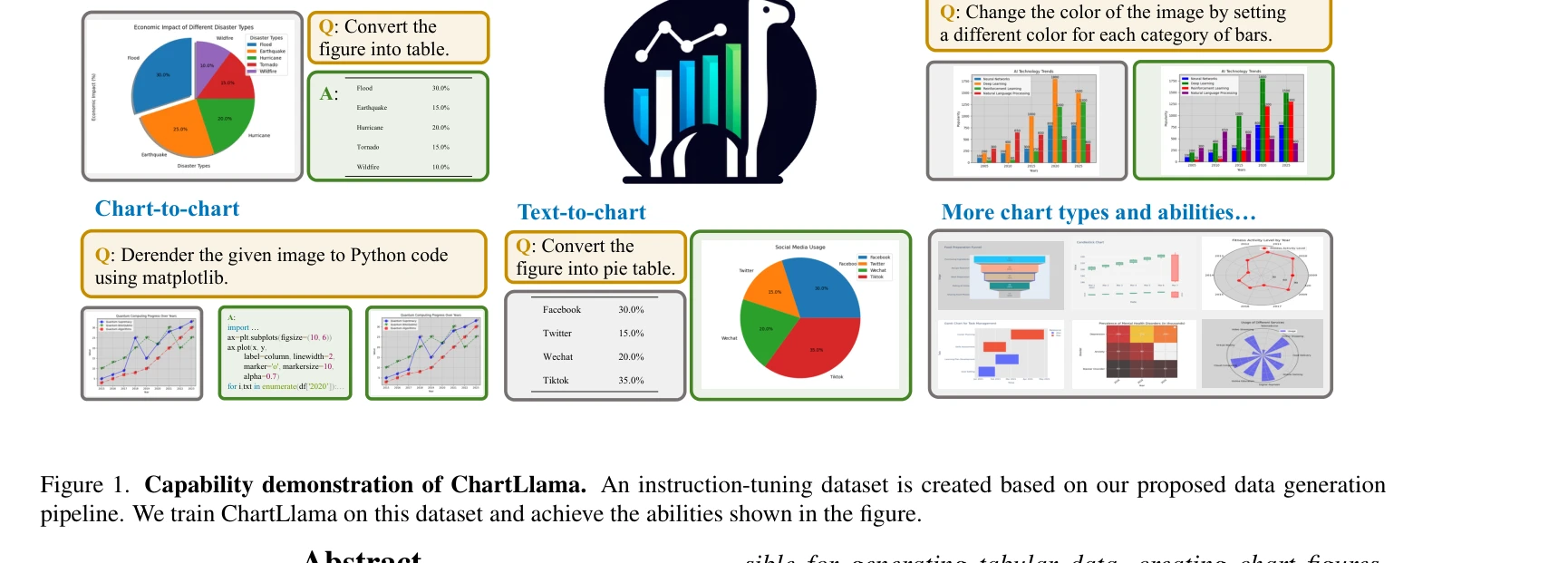

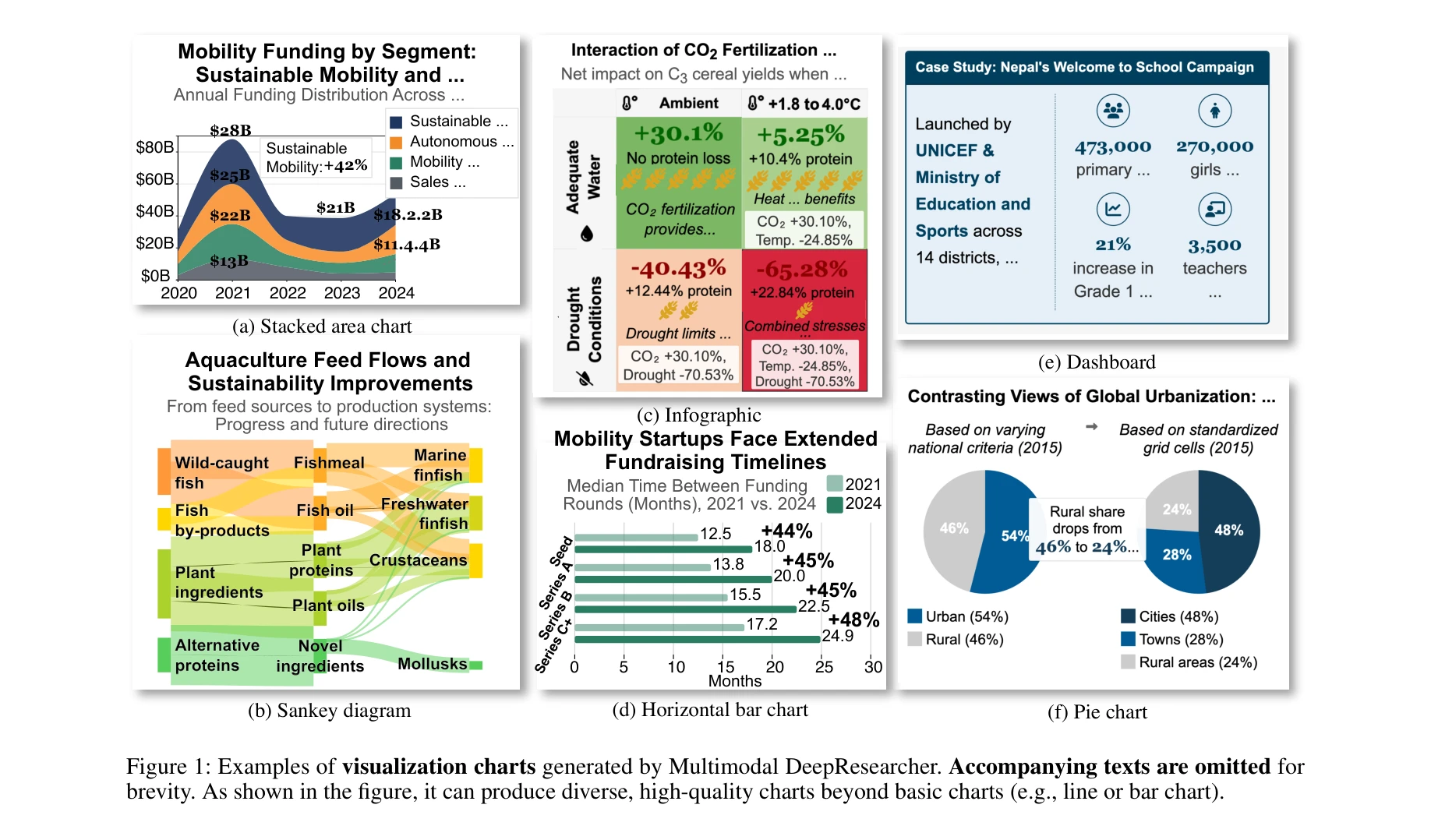

그림 1: ChartLlama의 다양한 능력 시연. 제안된 데이터 생성 파이프라인을 기반으로 한 instruction-tuning 데이터셋을 구축하고, 이를 통해 차트 이해 및 생성 능력 획득

*그림 1: ChartLlama의 다양한 능력 시연. 제안된 데이터 생성 파이프라인을 기반으로 한 instruction-tuning 데이터셋을 구축하고, 이를 통해 차트 이해 및 생성 능력 획득* 기존 멀티모달 대형언어모델(LLM)들이 일반적인 시각-언어 작업에서는 우수하나, 차트 해석 같은 특정 도메인 데이터 이해에는 크게 부족하다는 문제를 해결하기 위해, **GPT-4 기반의 자동화된 3단계 데이터 생성 파이프라인**을 제안하고, 이로부터 학습한 **ChartLlama**가 기존 벤치마크에서 최고 성능을 달성한 연구다.

차트 이해에 특화된 멀티모달 LLM 개발이라는 명확한 목표 하에, GPT-4 기반의 체계적이고 유연한 데이터 생성 파이프라인을 제시하고, 이로부터 기존 벤치마크에서 우수한 성능을 달성한 의미 있는 연구다. 다만 합성 데이터 의존도, 실제 데이터 일반화, 규모 한계 등에 대한 추가 검증이 필요하며, 공개된 데이터셋과 모델이 차트 AI 연구 커뮤니티에 미칠 파급력은 클 것으로 예상된다.

Language agents mirror human causal reasoning biases

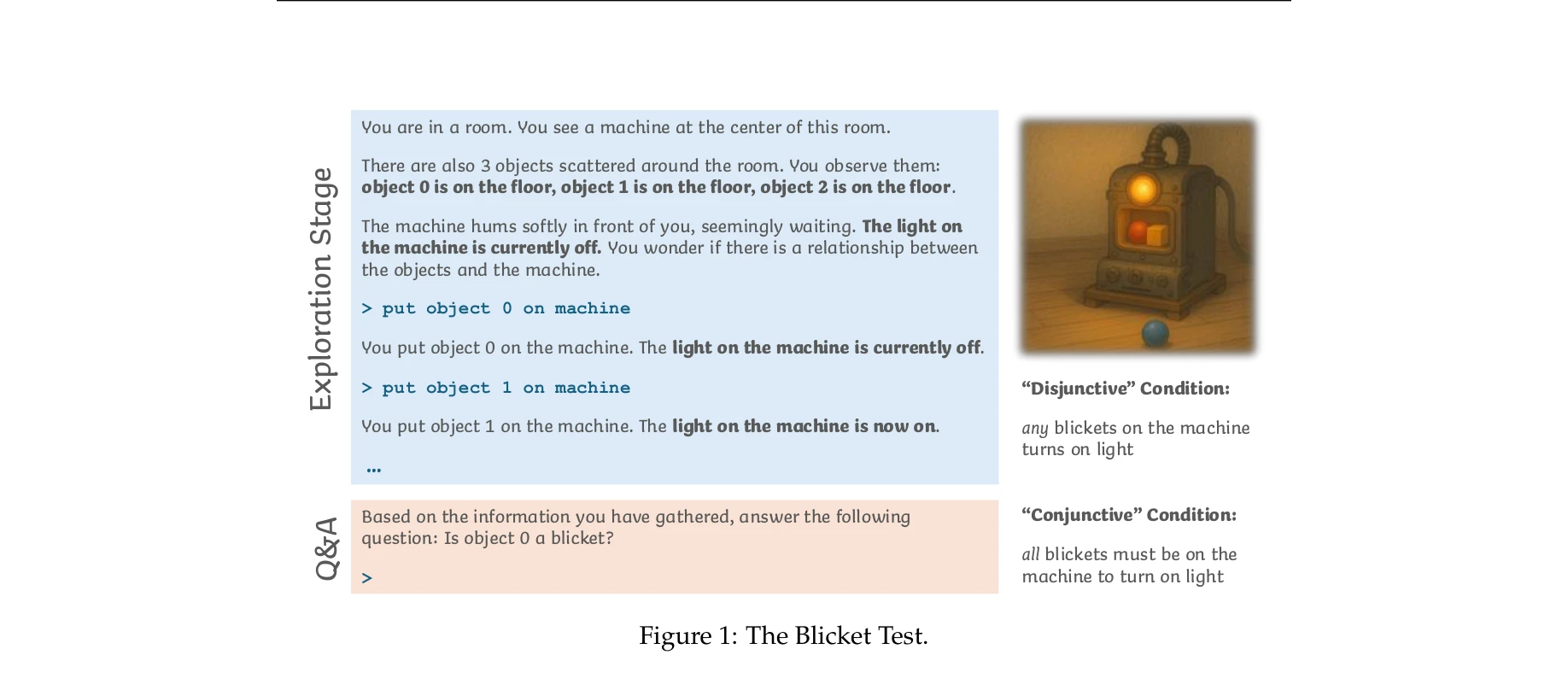

언어 모델이 객체를 기계에 올려놓는 상호작용을 통해 인과관계를 파악해야 하는 블리켓 테스트

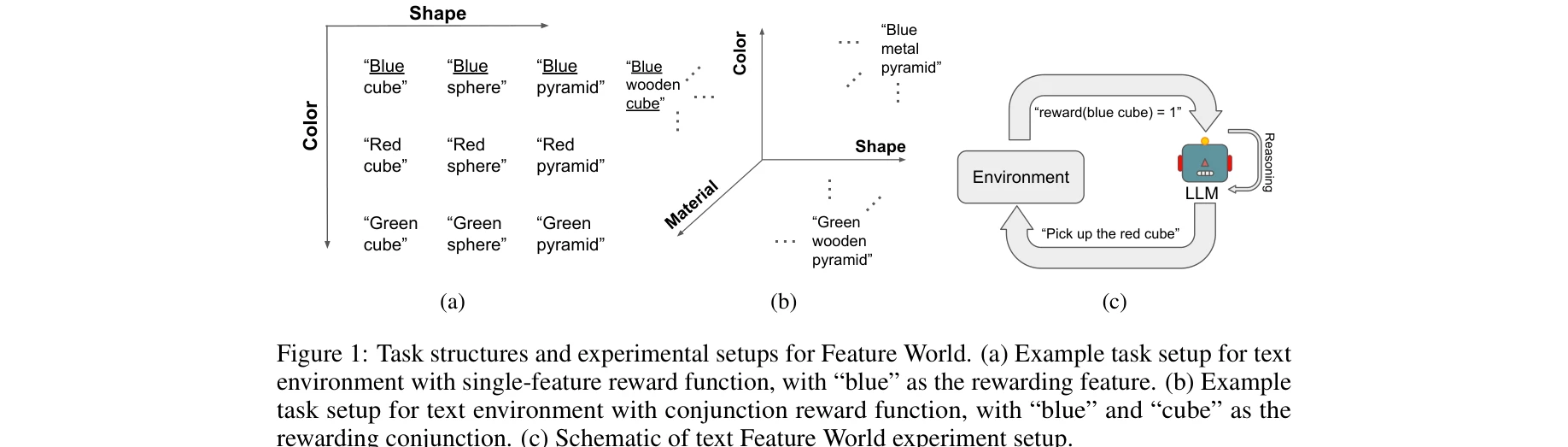

*언어 모델이 객체를 기계에 올려놓는 상호작용을 통해 인과관계를 파악해야 하는 블리켓 테스트* 언어 모델(LM) 에이전트는 인과관계 추론에서 선언적(disjunctive, OR) 규칙에는 능하지만 결합적(conjunctive, AND) 규칙에서 체계적으로 편향되어 있으며, 이러한 편향이 인간 성인의 인지 편향과 유사함을 보여주는 연구이다.

본 논문은 언어 모델의 인과추론 편향을 심리학 패러다임과 연계하여 처음으로 체계적으로 규명하였으며, 인간 행동과의 정량적 비교를 통해 모델이 훈련 데이터의 인지 편향을 상속함을 실증했다. 제안된 가설 제거 방법은 이론적 근거가 명확하고 성능 개선이 유의미하나, 더 복잡한 인과 구조와 다양한 추론 시나리오로의 확장 가능성 검증이 필요하다. 자율 에이전트의 과학적 추론 능력 강화라는 중요한 문제를 다루는 높은 수준의 연구이다.

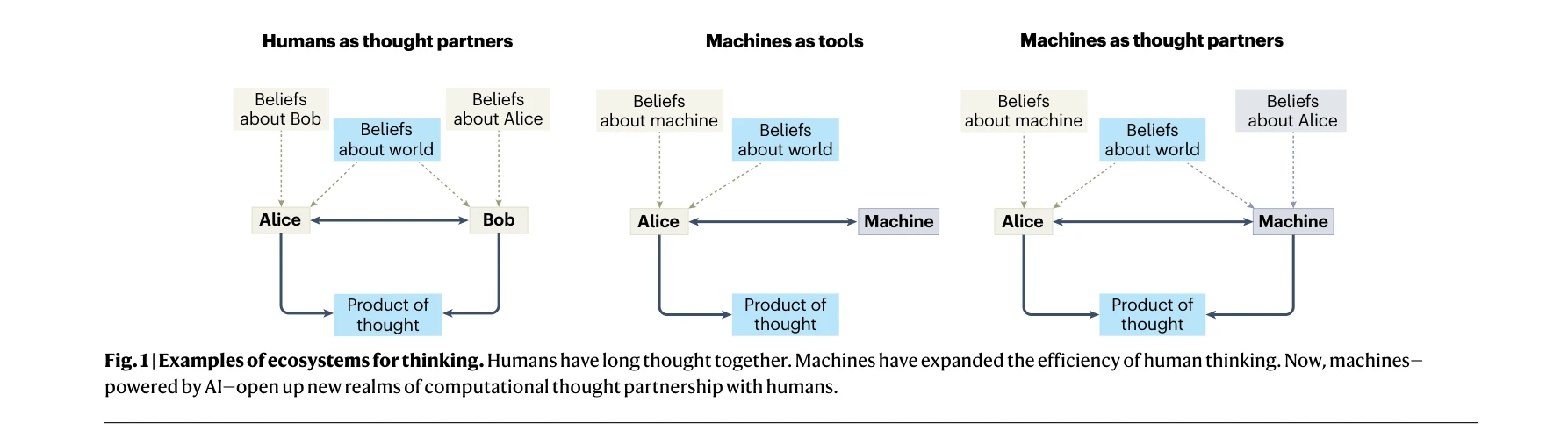

Your Brain on ChatGPT: Accumulation of Cognitive Debt when Using an AI Assistant for Essay Writing Task

본 연구는 LLM(대규모 언어모델) 기반 에세이 작성이 신경 인지적 비용을 초래하는지를 뇌파(EEG) 분석을 통해 규명했으며, 4개월 추적 결과 LLM 의존 사용자가 신경, 언어, 행동 모든 수준에서 성능 저하를 보였다.

AI 교육 도입의 신경 비용을 첫 규명한 획기적 연구로, LLM 의존이 "인지 부채"를 누적시킨다는 명확한 증거를 제시했다. EEG, NLP, 정성 데이터의 통합이 설득력 높으나, 인과 메커니즘의 깊이와 장기 가역성 검증이 향후 과제이다. 교육자, 정책입안자, AI 개발자 모두에게 시사적인 중요 논문이다.

Visual thoughts: A unified perspective of understanding multimodal chain-of-thought

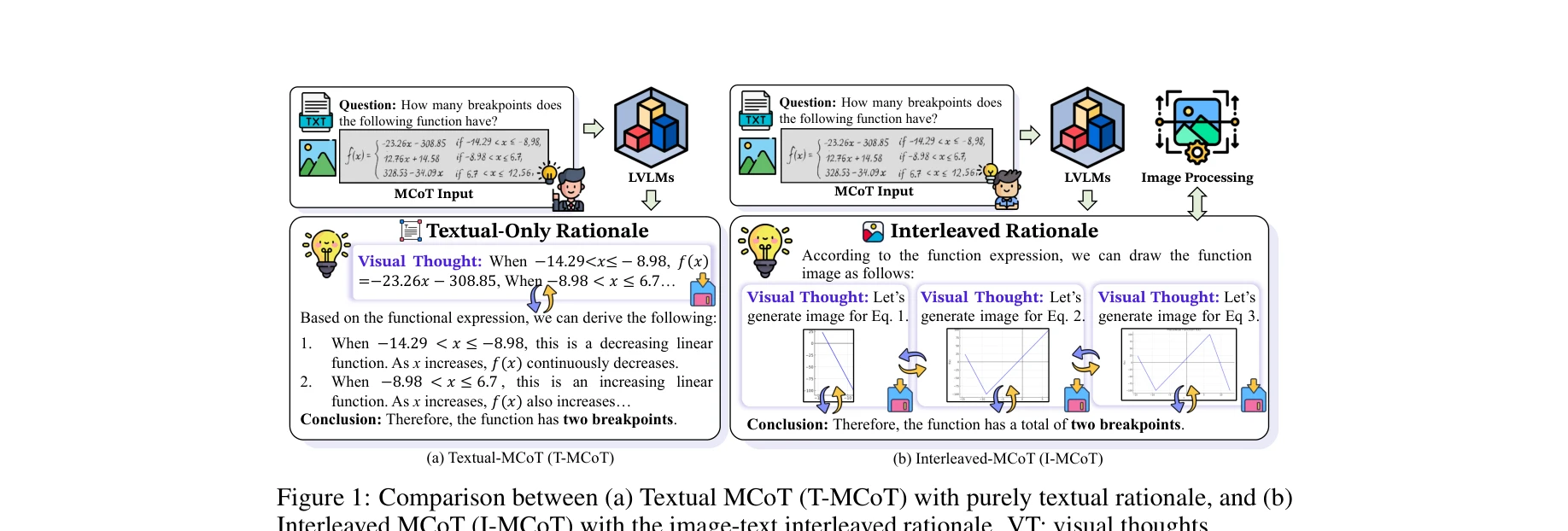

그림 1: (a) 순수 텍스트 근거를 사용하는 T-MCoT와 (b) 이미지-텍스트 교차 근거를 생성하는 I-MCoT의 비교

*그림 1: (a) 순수 텍스트 근거를 사용하는 T-MCoT와 (b) 이미지-텍스트 교차 근거를 생성하는 I-MCoT의 비교* 대규모 비전-언어 모델(LVLM)의 멀티모달 체인-오브-쏘트(MCoT) 추론에서 **시각적 사고(Visual Thoughts)**라는 통합된 메커니즘을 발견하였으며, 이는 텍스트 기반과 이미지 교차 방식의 MCoT 모두를 설명하는 새로운 관점을 제시한다.

본 논문은 멀티모달 추론 분야의 오랜 논쟁(T-MCoT vs I-MCoT)에 "시각적 사고"라는 새로운 이론적 렌즈를 제공함으로써 개념적 통합을 이루었으며, 4가지 표현 전략의 체계적 분류는 향후 MCoT 방법론 개발의 로드맵을 제시한다. 다만 내부 메커니즘 분석의 기술적 깊이와 실제 성능 이득에 대한 정량적 검증이 보강된다면 더욱 영향력 있는 기여가 될 것으로 예상된다.

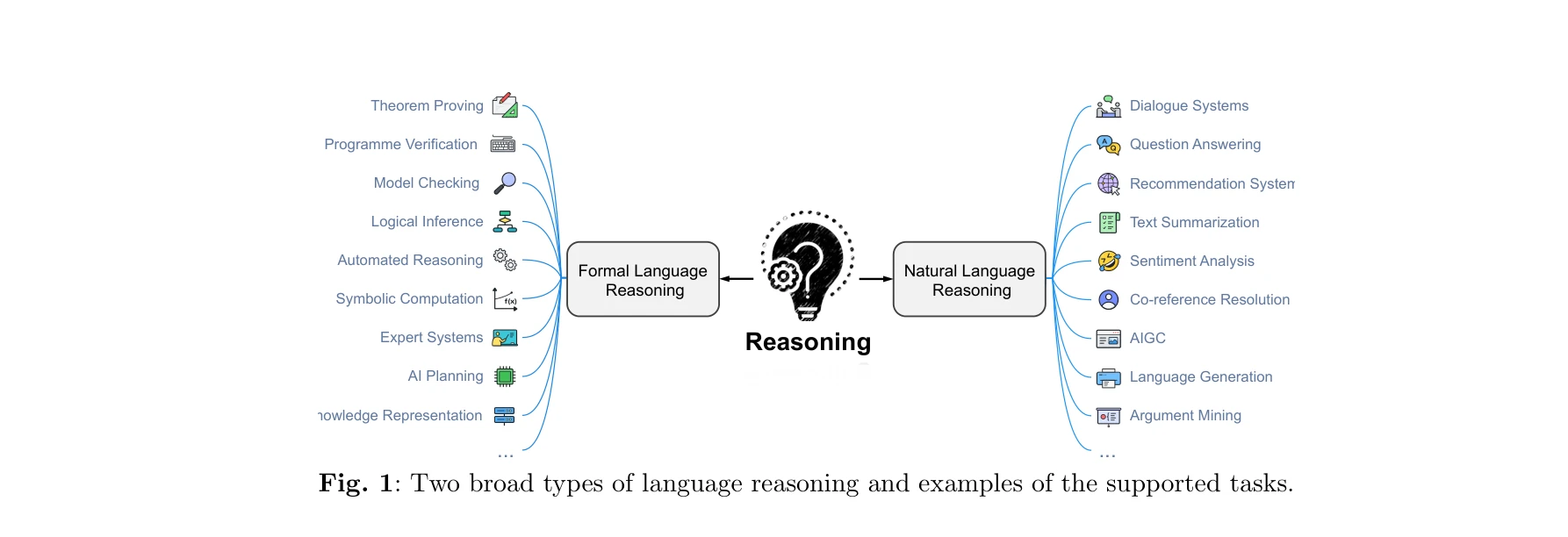

A survey of reasoning with foundation models

*Fig. 2: Left: Overview of the reasoning tasks introduced in this survey, as detailed* 파운데이션 모델(Foundation Models)의 추론(Reasoning) 능력을 체계적으로 조사한 종합 서베이로, 다양한 추론 작업, 방법론, 벤치마크를 다루고 멀티모달 학습, 자율 에이전트, 슈퍼 정렬과의 연관성을 논의한다.

이 서베이는 파운데이션 모델의 추론 능력을 다루는 분야에서 현재까지의 연구 성과를 가장 포괄적으로 정리한 중요한 자료이며, 특히 멀티모달 및 에이전트 추론이라는 최신 방향을 반영하고 지속적 갱신 계획을 제시함으로써 학계에 큰 기여를 할 것으로 예상된다.

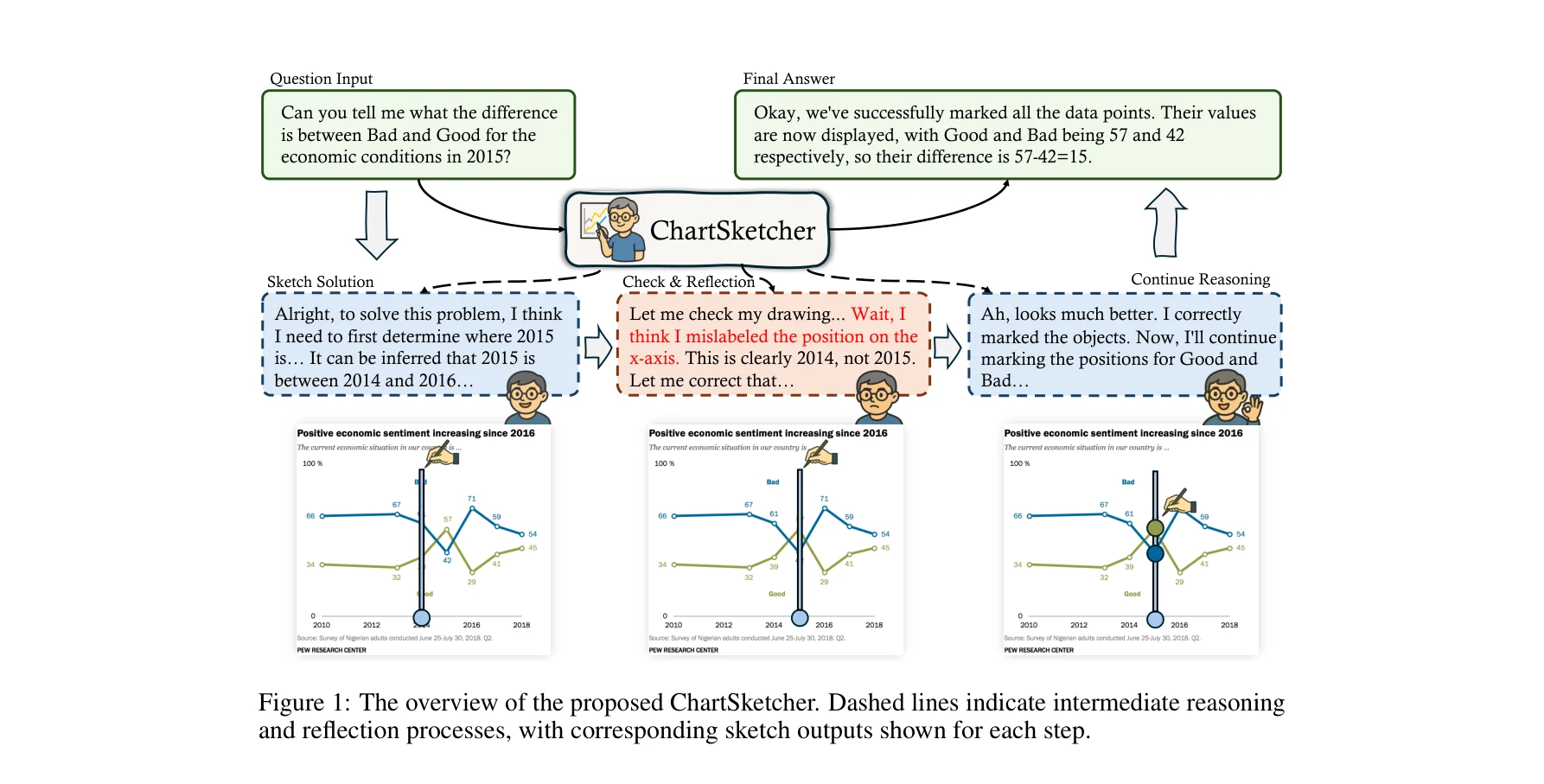

ChartSketcher: Reasoning with multimodal feedback and reflection for chart understanding

ChartSketcher의 개요: 중간 추론 및 반성 과정(점선)과 각 단계의 스케치 출력

*ChartSketcher의 개요: 중간 추론 및 반성 과정(점선)과 각 단계의 스케치 출력* 본 논문은 멀티모달 대규모 언어 모델(MLLM)이 차트를 이해할 때 시각적 피드백을 통한 반복적 스케칭(Sketch-CoT)으로 추론 과정을 개선하는 방법을 제안한다. 인간의 인지 행동에서 영감을 받아, 모델이 중간 추론 단계를 차트에 직접 주석 처리하고 이를 다시 입력으로 제공하여 멀티모달 상호작용을 통한 깊이 있는 이해를 실현한다.

ChartSketcher는 인간의 시각적 추론 행동에서 영감을 받아 MLLM의 차트 이해 능력을 향상시키는 혁신적 방법론을 제시하며, 체계적인 데이터 구축과 두 단계 훈련 전략으로 실증적 효과를 입증했으나, 계산 효율성과 프로그래밍 오버헤드 문제에 대한 충분한 분석이 필요하다.

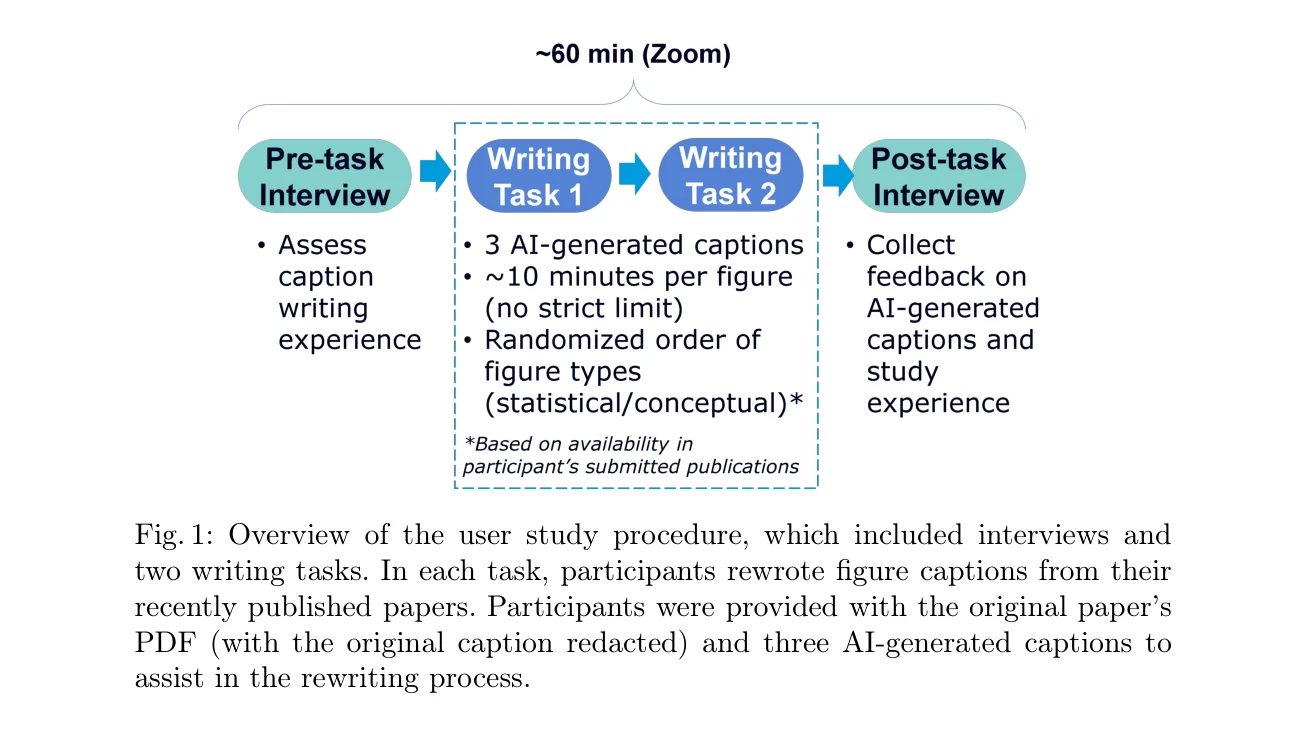

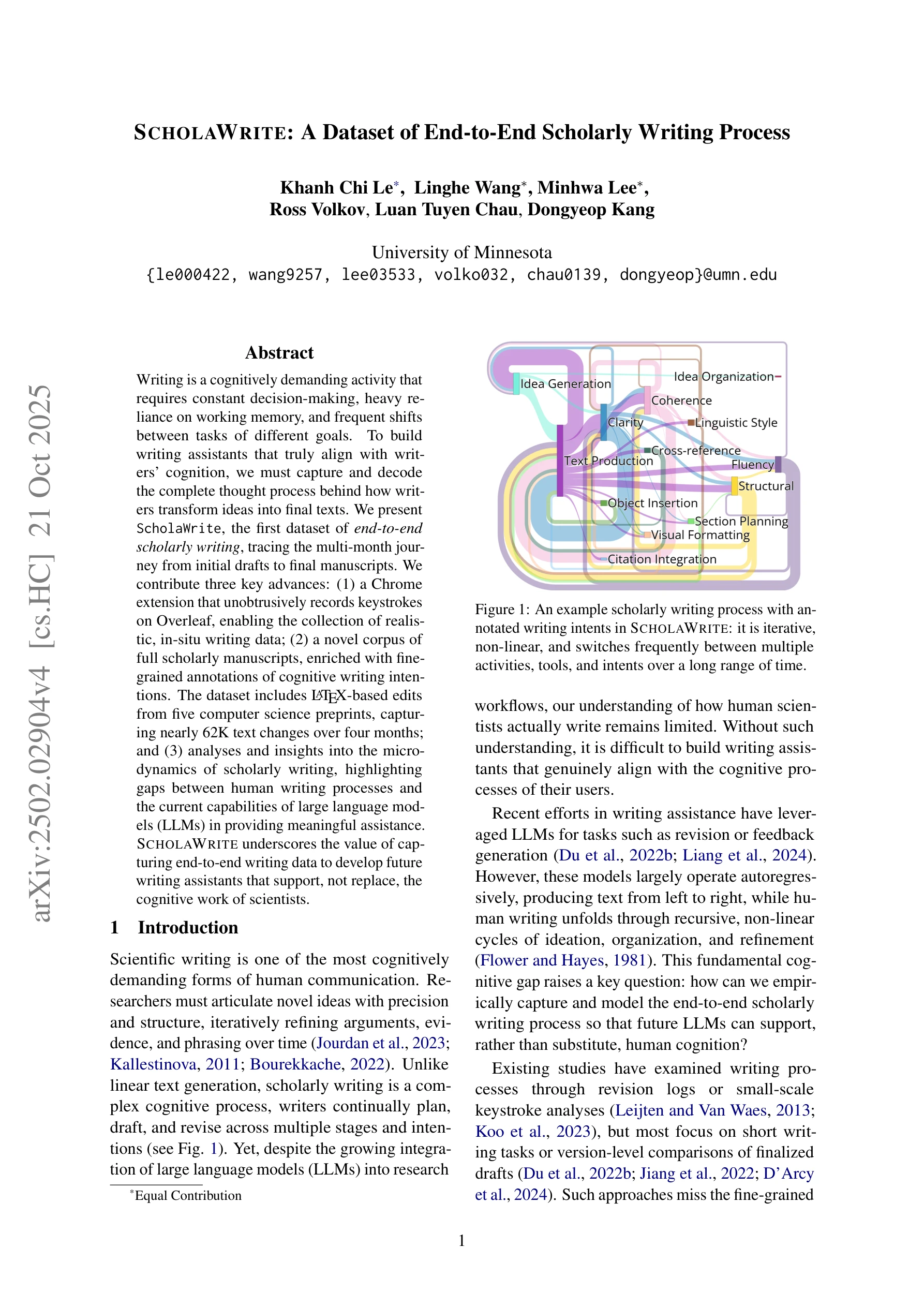

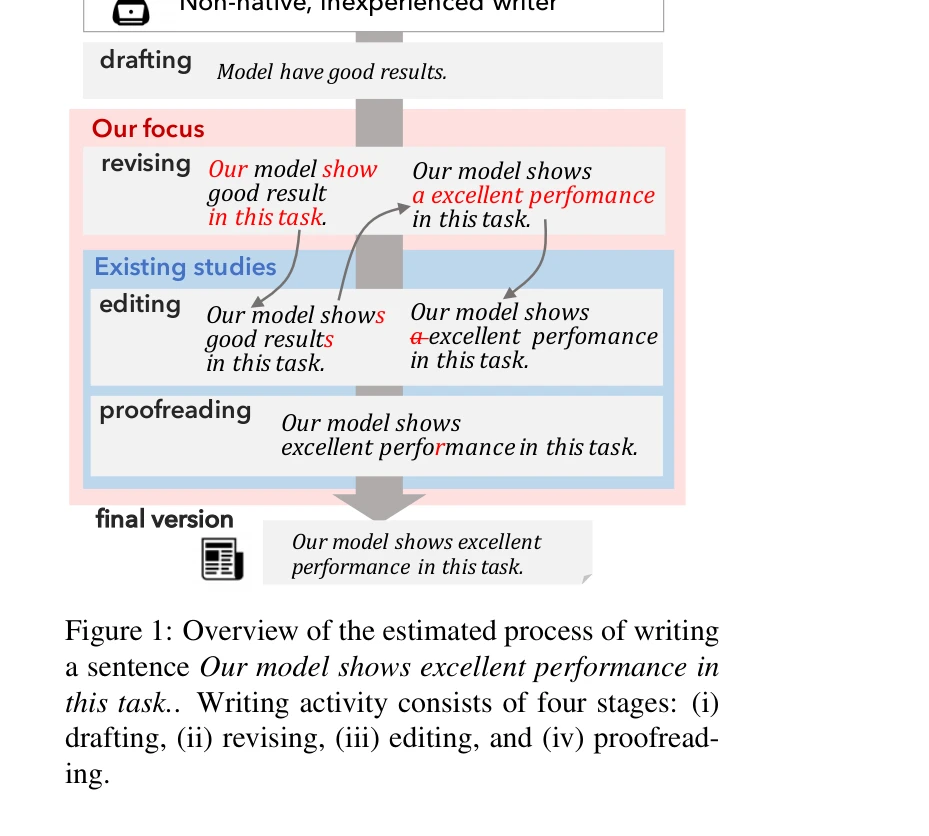

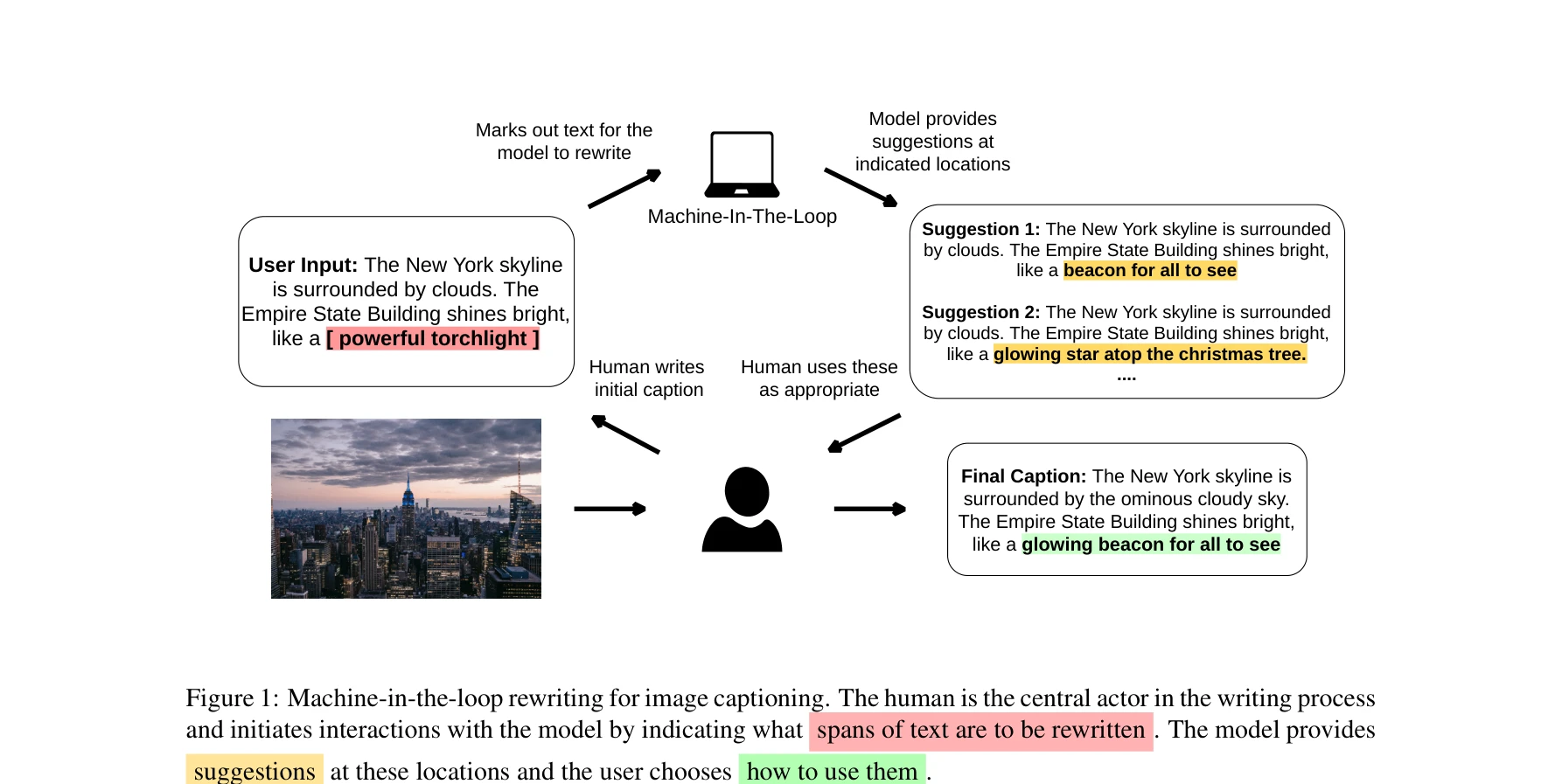

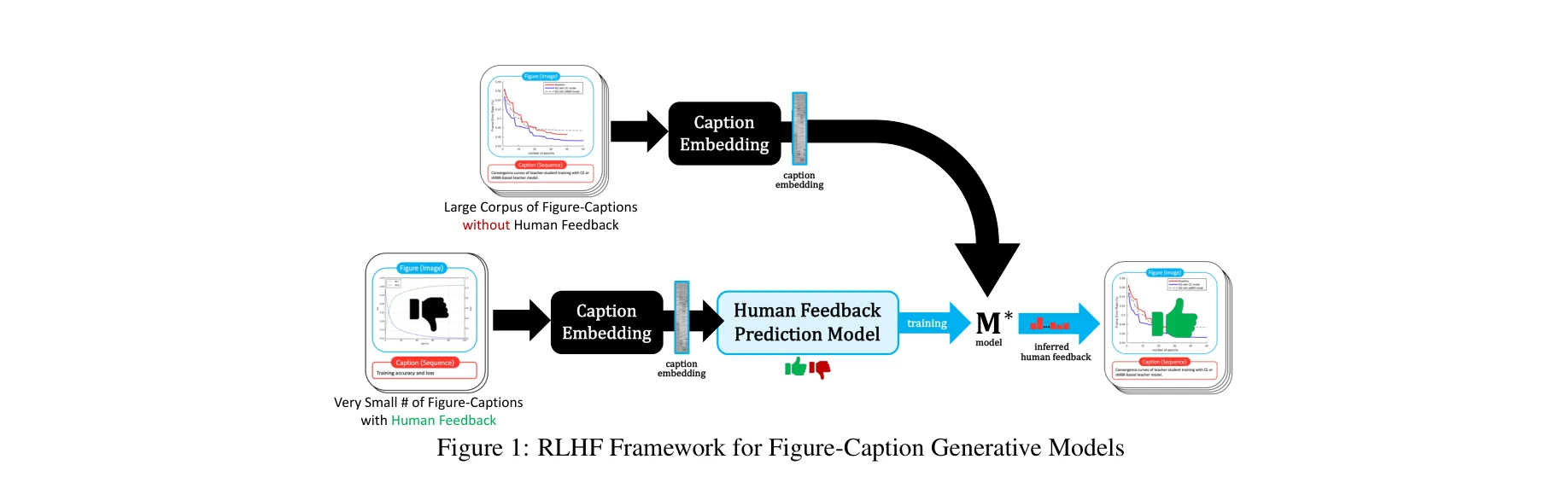

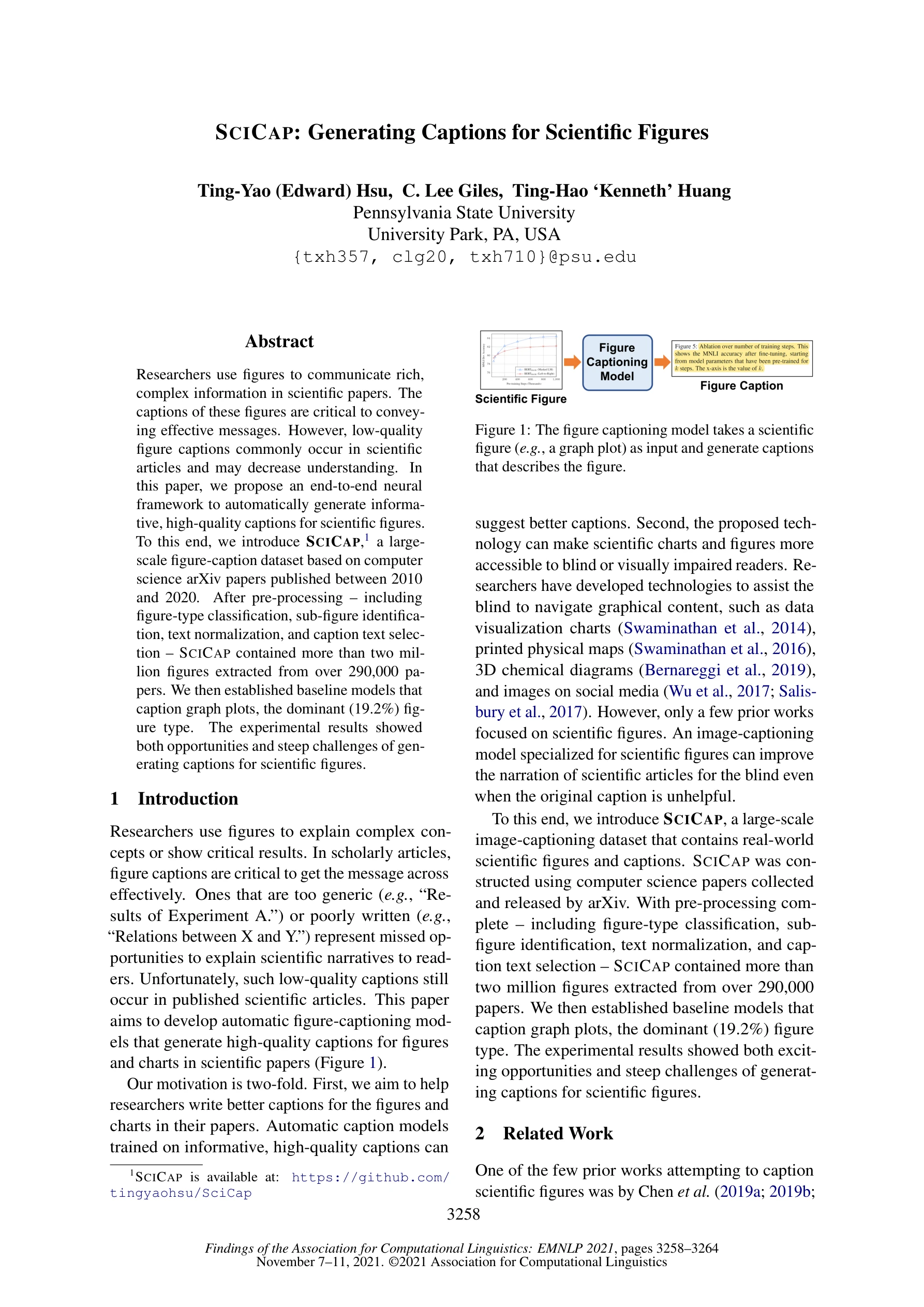

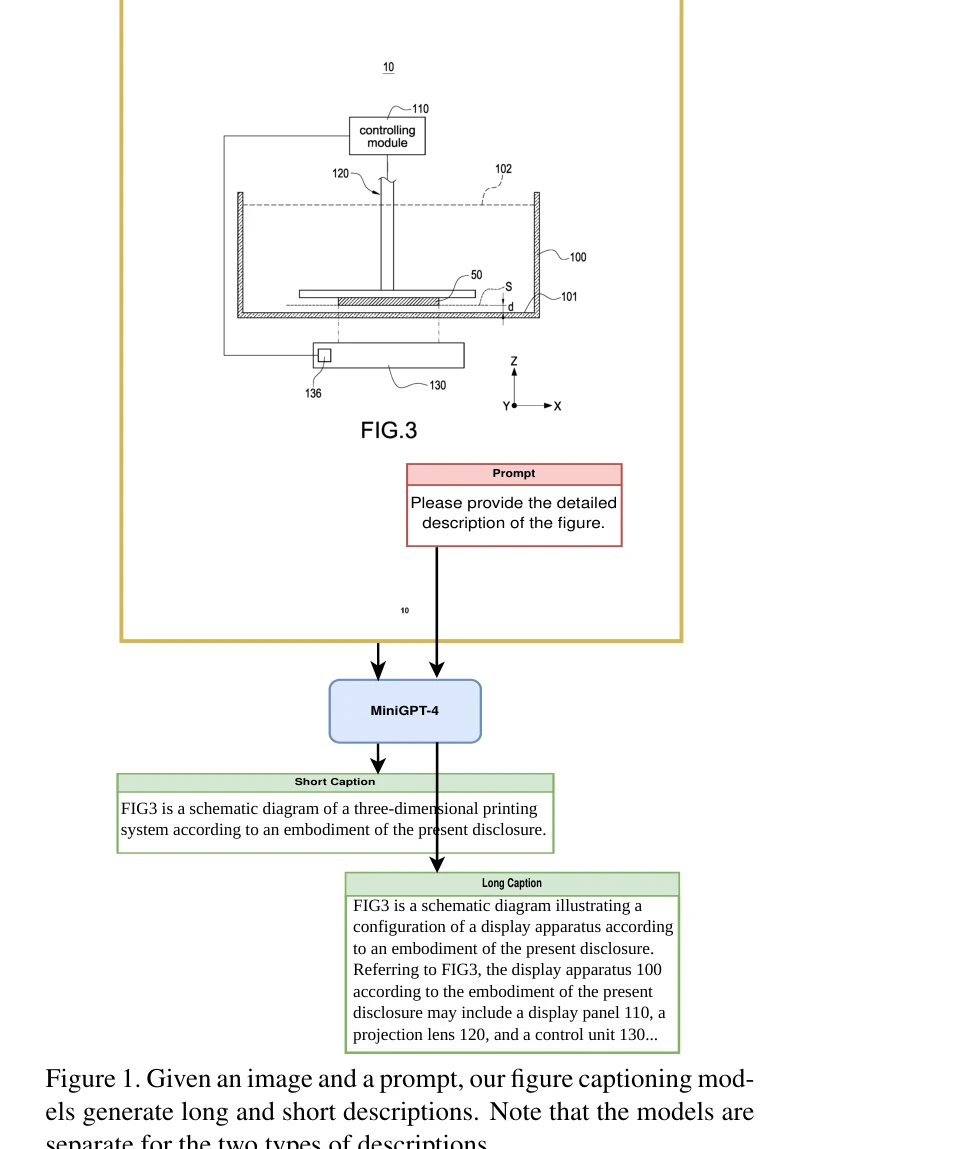

Understanding how paper writers use ai-generated captions in figure caption writing

사용자 연구 절차 개요: 참가자가 최근 발표한 논문에서 두 개의 그림 캡션을 AI 생성 캡션을 활용하여 다시 작성함

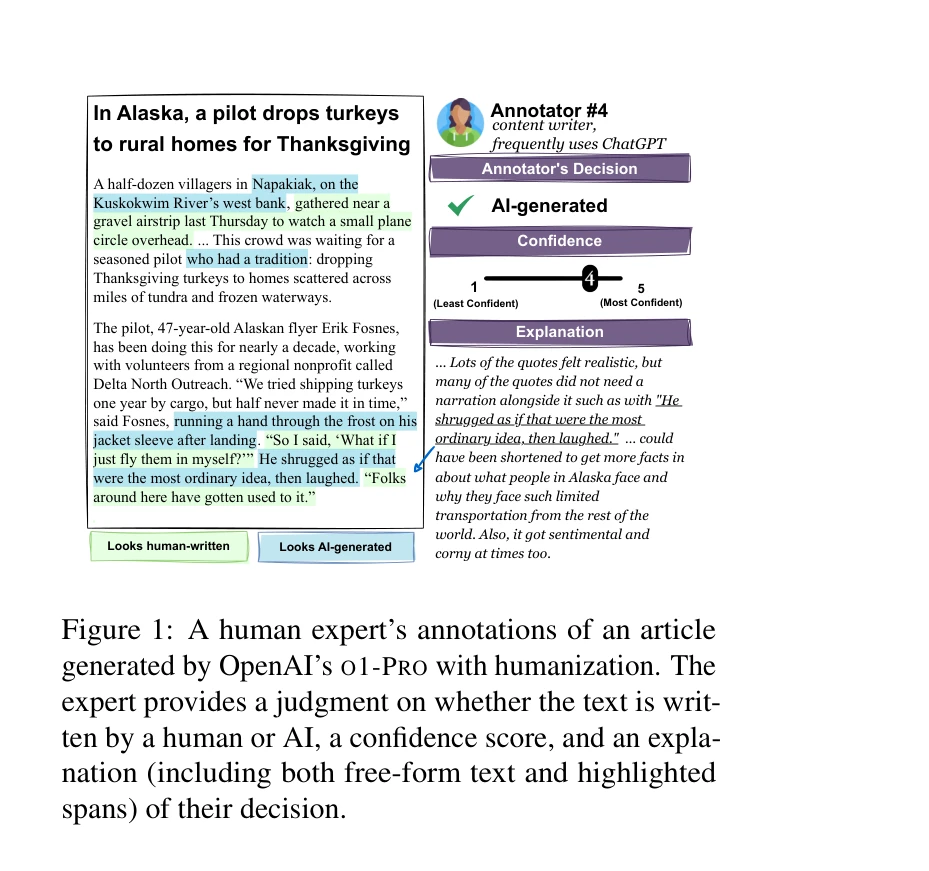

*사용자 연구 절차 개요: 참가자가 최근 발표한 논문에서 두 개의 그림 캡션을 AI 생성 캡션을 활용하여 다시 작성함* 본 논문은 18명의 논문 저자가 최신 AI 모델이 생성한 캡션을 자신의 논문 작성 과정에 어떻게 통합하는지 실제 사용자 연구를 통해 조사했으며, 저자들이 AI 생성 캡션을 복사-수정하는 방식으로 활용하되 긴 형식의 상세한 캡션을 선호함을 발견했다.

본 논문은 AI 캡션 생성 연구에서 중요한 공백을 메우며, 저자의 실제 작성 과정을 관찰하는 참신한 접근법을 제시했다. 정성 연구로서 상호작용 분석은 견고하고 실용적 시사점을 도출했으나, 표본 크기와 도메인 다양성 측면에서 일반화 가능성이 제한되며, 향후 더 대규모 정량 연구와 모델 개선 제안으로 발전할 여지가 있다.

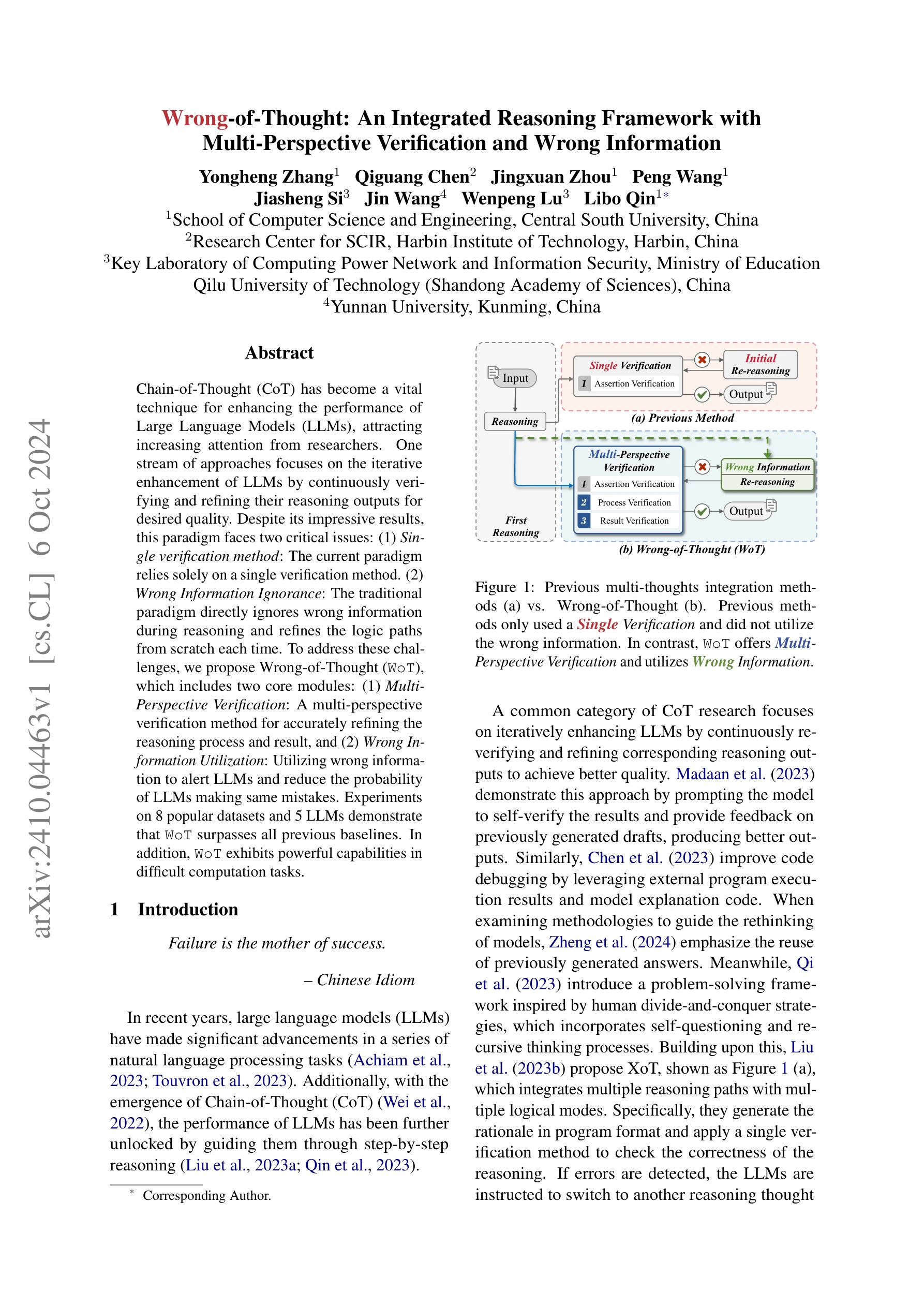

Wrong-of-Thought: An Integrated Reasoning Framework with Multi-Perspective Verification and Wrong Information

그림 1: 기존 다중 사고 통합 방법(a)은 단일 검증만 사용하고 오류 정보를 활용하지 않는 반면, WoT(b)는 다중 관점 검증과 오류 정보 활용을 제공한다.

*그림 1: 기존 다중 사고 통합 방법(a)은 단일 검증만 사용하고 오류 정보를 활용하지 않는 반면, WoT(b)는 다중 관점 검증과 오류 정보 활용을 제공한다.* 대규모 언어 모델(LLM)의 추론 성능을 향상시키기 위해 다중 관점에서 검증하고 이전 오류 정보를 활용하는 WoT(Wrong-of-Thought) 프레임워크를 제안한다. 기존 XoT의 단일 검증 방식과 오류 정보 무시 문제를 해결하여 8개 데이터셋과 5개 LLM에서 우수한 성능을 달성했다.

WoT는 단순하지만 효과적인 개선책을 통해 LLM의 추론 성능을 일관되게 향상시키며, 광범위한 실험으로 그 유효성을 입증했다. 다만 검증 오버헤드와 오류 정보 활용의 심화 방안에 대한 추가 연구가 필요하다.

Is AI ready to mass-produce lay summaries of research articles?

AI 기반 학술논문 요약 도구(lay summary)가 급속도로 개발되고 있으나, 정확성과 신뢰성 측면에서 해결해야 할 과제들이 남아있다.

AI lay-summary 도구는 학술 정보 접근성 개선의 큰 잠재력을 보여주지만, 정확성 오류와 미검증 정보 확산의 위험을 사전에 차단하는 메커니즘이 개발되어야만 과학 출판의 표준 기능으로 정착될 수 있다.

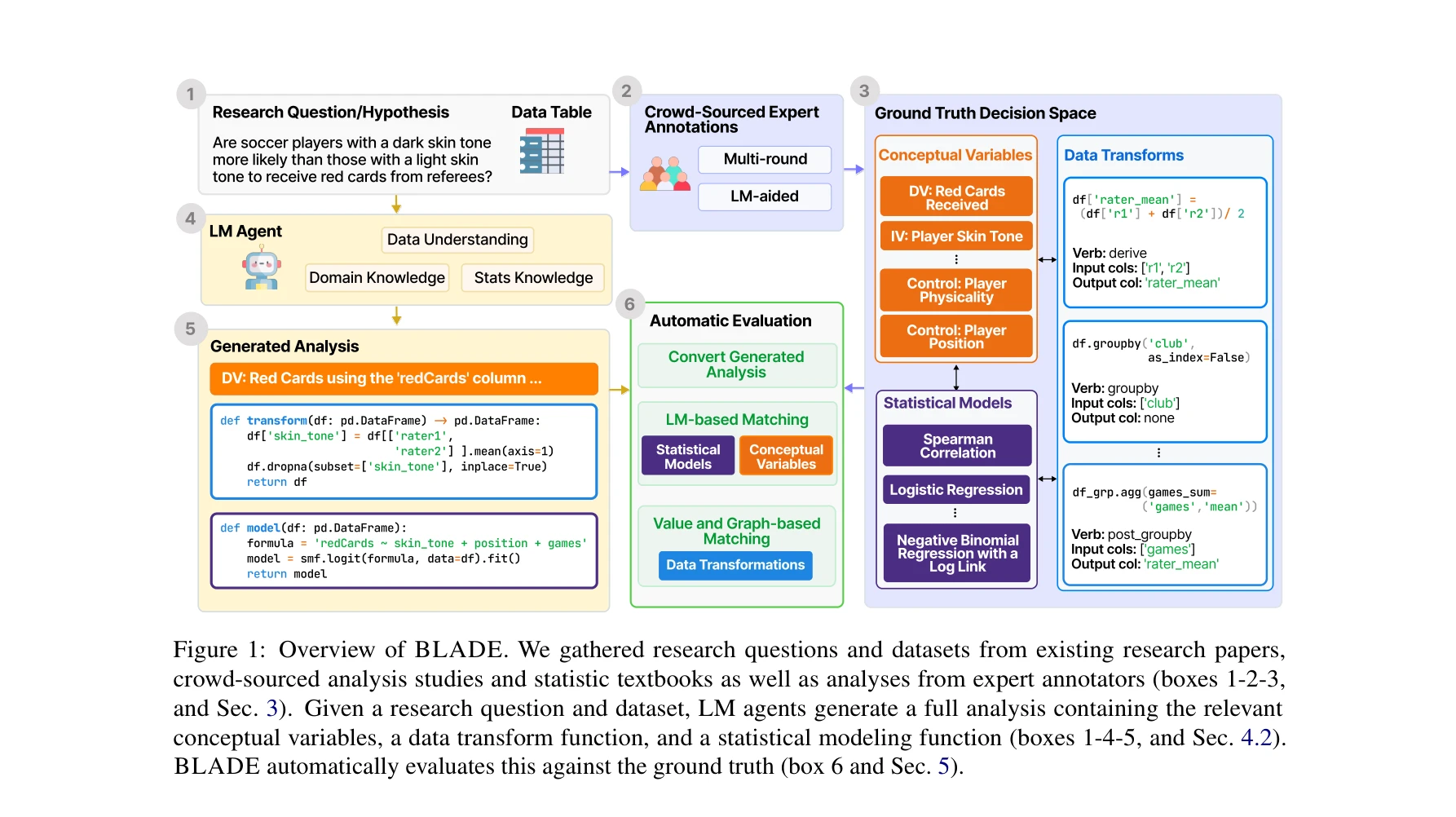

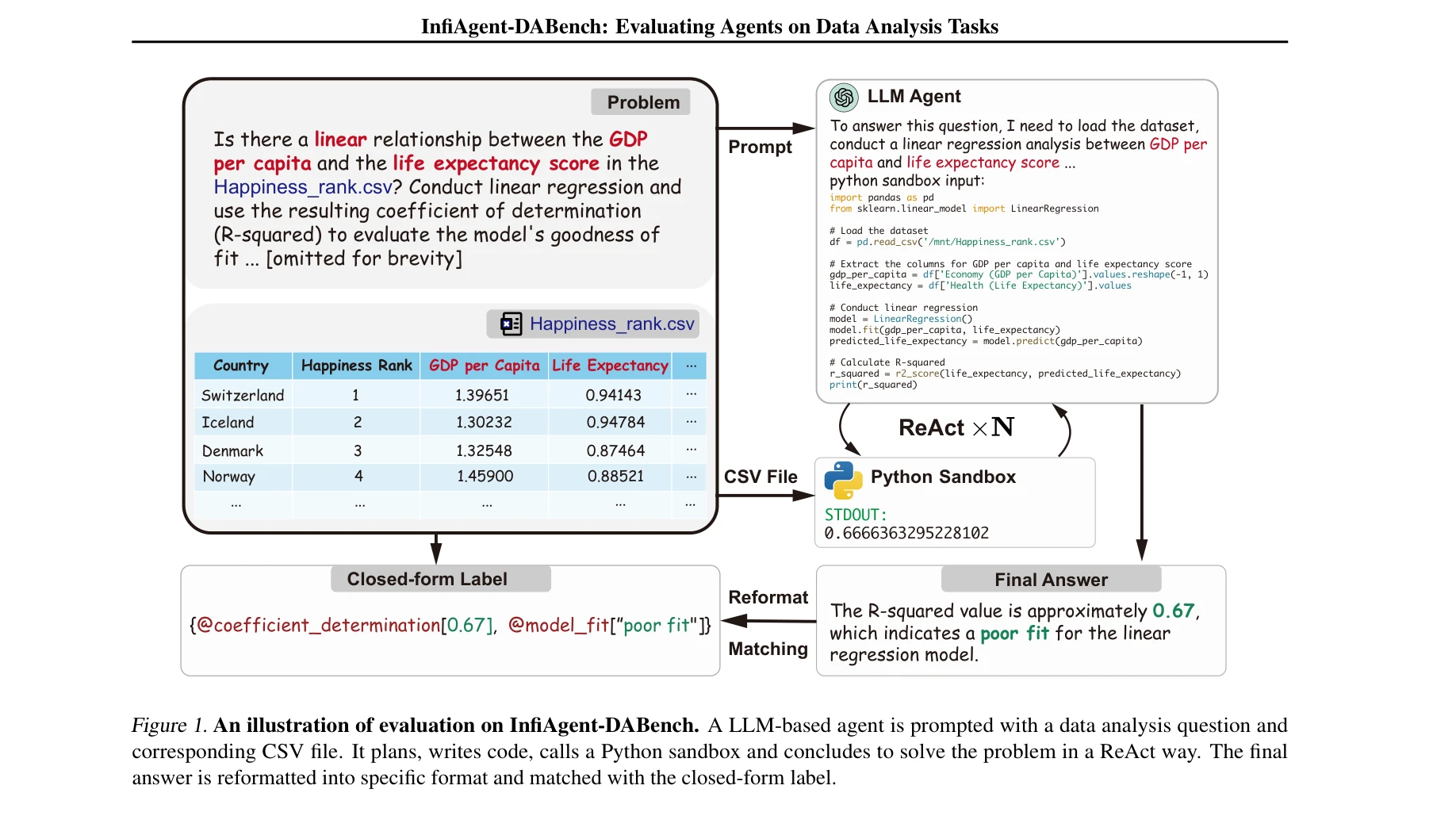

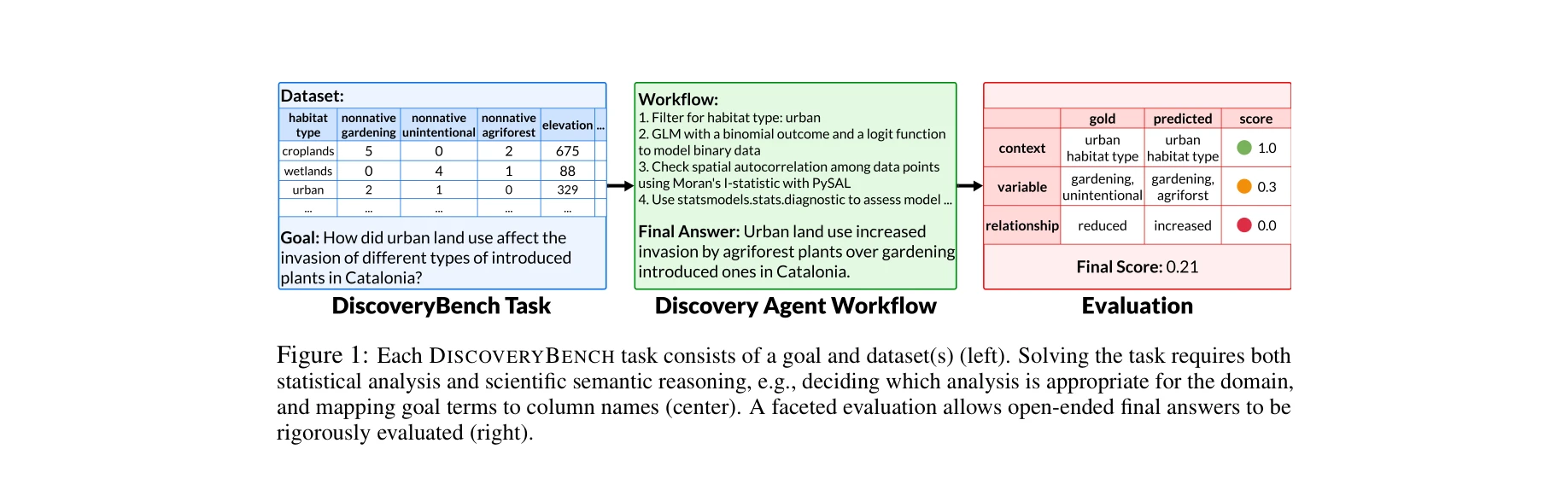

Blade: Benchmarking language model agents for data-driven science

*BLADE 벤치마크는 데이터 기반 과학 분석을 위한 언어 모델 에이전트의 다면적 의사결정 과정을 자동으로 평가한다.* 이 논문은 데이터 기반 과학 발견(data-driven scientific discovery)을 위해 언어 모델(LM) 에이전트의 분석 능력을 평가하는 첫 번째 벤치마크 BLADE를 제시한다. 12개의 실제 데이터셋과 연구 질문에 대해 전문가 데이터 과학자들의 다중 분석을 수집하고, 에이전트의 생성 분석을 자동으로 평가할 수 있는 프레임워크를 개발했다.

이 논문은 언어 모델 에이전트의 데이터 기반 과학 분석 능력을 평가하는 첫 번째 체계적이고 자동화된 벤치마크를 제시함으로써, AI 기반 과학 발견 도구 개발에 중요한 기초를 마련했다. 다층 의사결정 구조와 자동 평가 프레임워크의 설계가 뛰어나며, 현 언어 모델의 한계를 명확히 규명했다는 점에서 학술적, 실용적 의의가 크다. 다만 벤치마크 규모 확대 및 평가 신뢰성 강화가 필요하다.

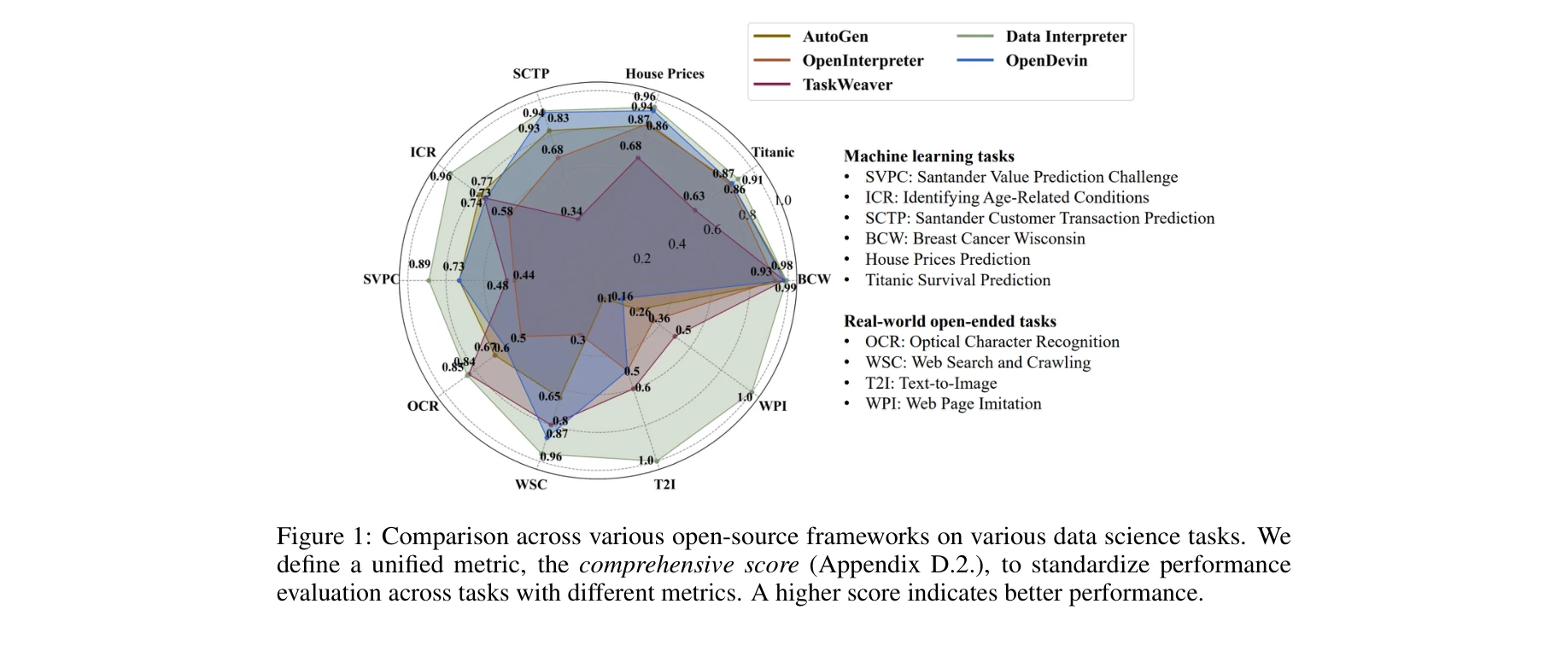

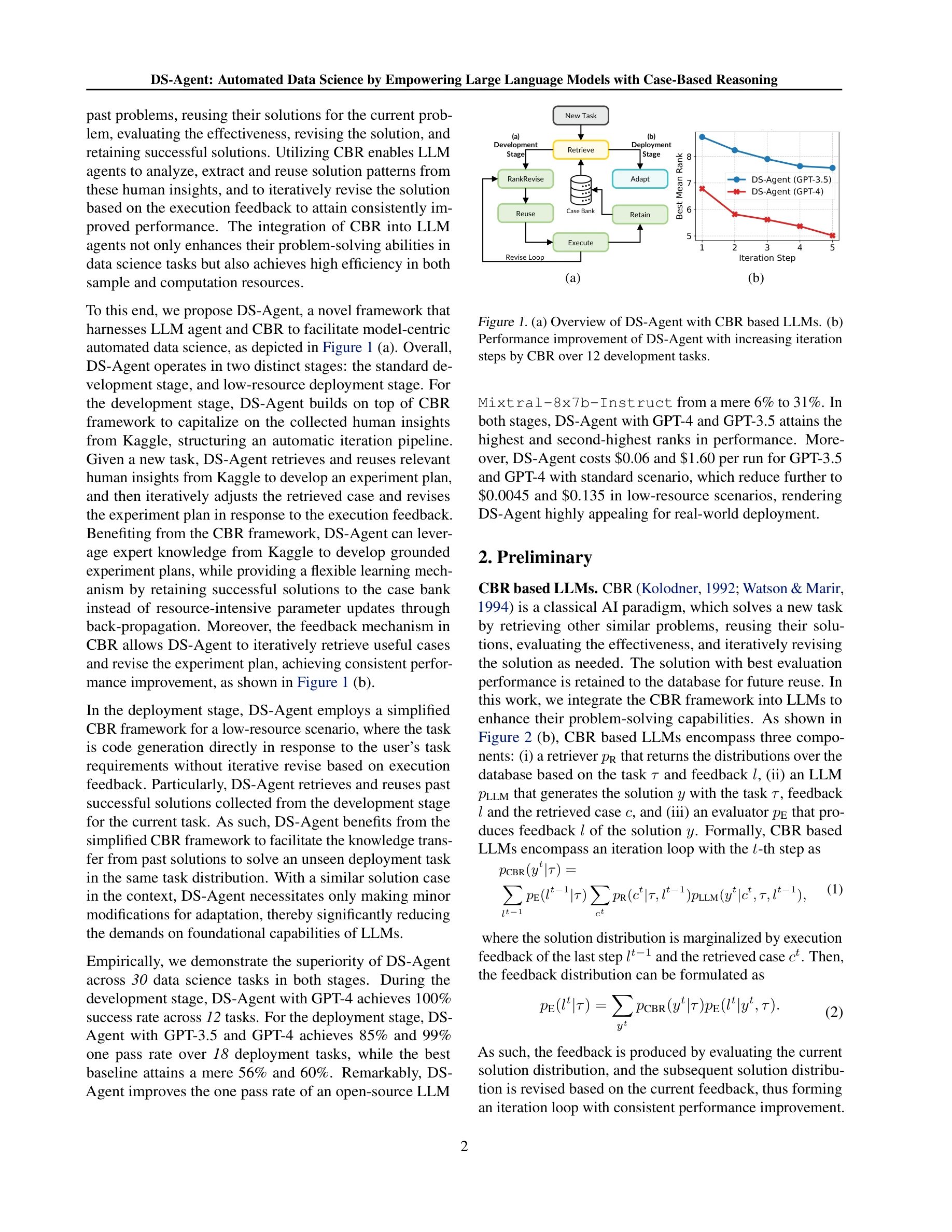

Data Interpreter: An LLM Agent For Data Science

다양한 오픈소스 프레임워크와의 비교 분석: 종합 점수(comprehensive score)로 표준화된 성능 평가

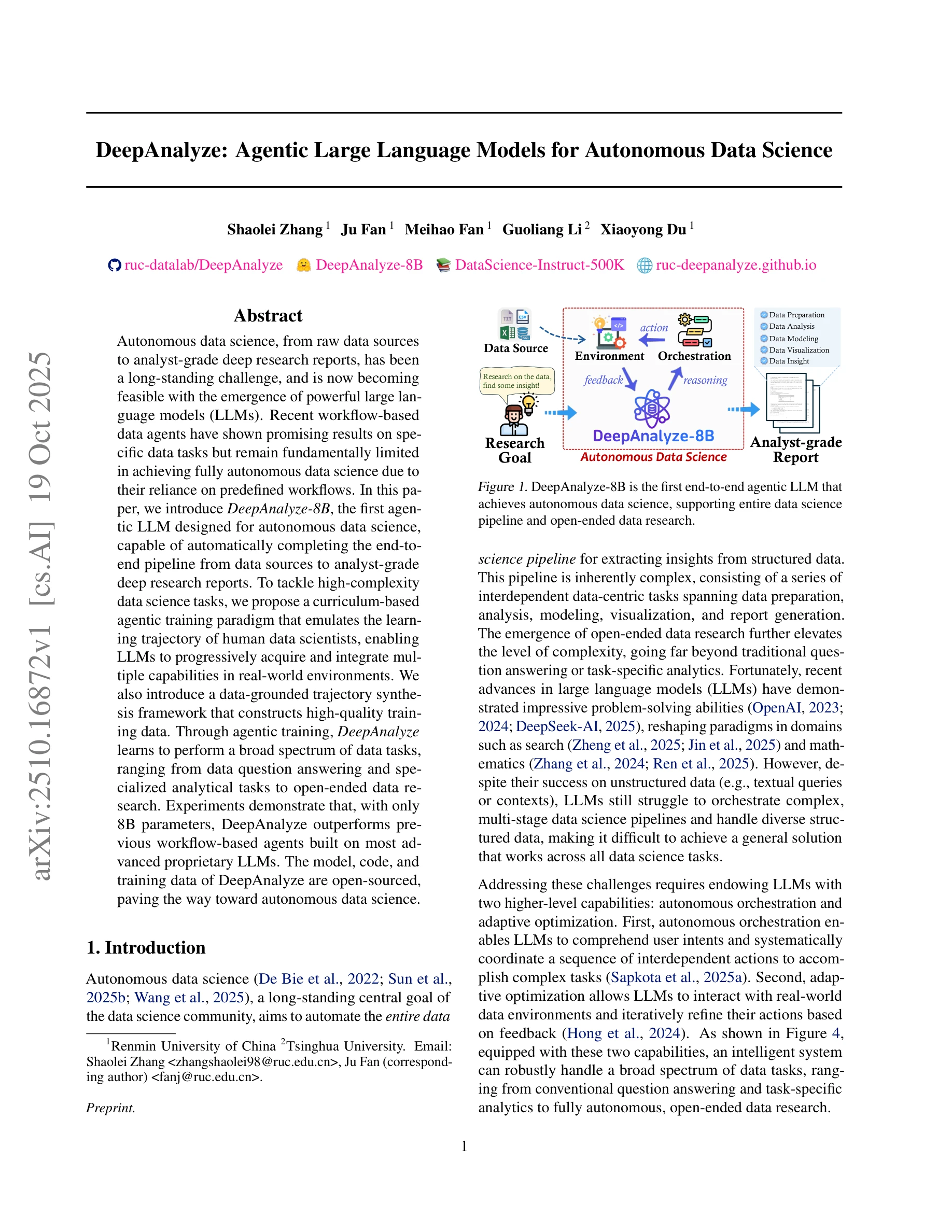

*Data Interpreter의 계층적 그래프 모델링 워크플로우: 프로젝트 요구사항을 태스크 그래프로 분해한 후, 실행 가능한 액션 그래프로 다시 분해하는 과정* 본 논문은 대규모 언어모델(LLM) 기반 에이전트가 데이터 사이언스의 장기적이고 상호연결된 작업들을 자동으로 해결할 수 있도록 설계된 **Data Interpreter**를 제안한다. 계층적 그래프 모델링과 프로그래밍 가능한 노드 생성이라는 두 가지 핵심 메커니즘을 통해 복잡한 데이터 사이언스 워크플로우를 동적으로 관리하고 실시간 데이터 변화에 적응한다.

Data Interpreter는 데이터 사이언스 자동화 문제를 효과적으로 재정의하고, 계층적 그래프 모델링과 동적 노드 생성이라는 실용적인 솔루션으로 여러 벤치마크에서 상당한 성능 개선을 달성했다. 특히 엔드-투-엔드 워크플로우 관리와 실시간 적응성 측면에서 기존 LLM 에이전트 연구를 한 단계 진전시켰으나, 이론적 분석 강화와 프로덕션 환경 검증이 추가되면 더욱 임팩트 있는 기여가 될 수 있다.

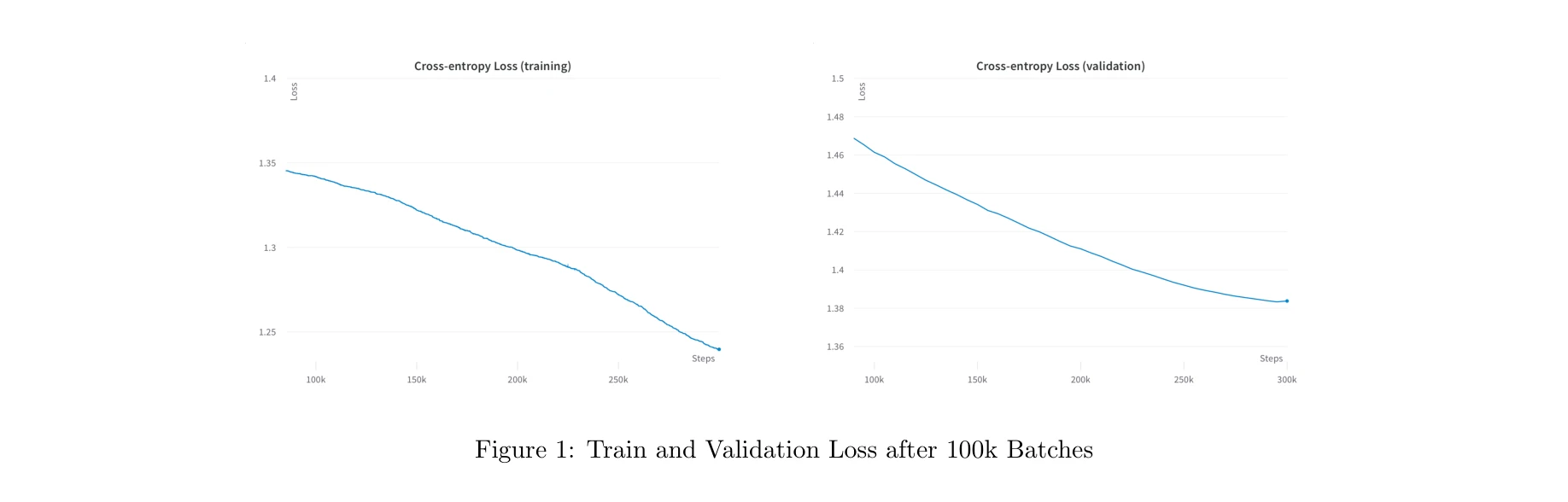

StarCoder 2 and the Stack v2: The next generation

BigCode 프로젝트에서 개발한 StarCoder2와 The Stack v2는 619개 프로그래밍 언어를 지원하는 대규모 오픈소스 코드 데이터셋과 이를 기반으로 훈련된 3B, 7B, 15B 규모의 코드 생성 모델로, 동일 규모의 기존 모델들을 능가하고 2배 이상 큰 모델과 비교 가능한 성능을 달성했다.

본 논문은 코드 LLM 분야에서 완전한 투명성을 구현한 획기적인 작업으로, 대규모 오픈소스 데이터셋과 이를 활용한 효율적인 모델 훈련을 통해 기존 폐쇄형 모델과 경쟁 가능한 성능을 달성했으며, 특히 다언어 지원과 거버넌스 측면에서 과학 커뮤니티에 실질적 기여를 제공한다. 다만 중간 규모(7B) 모델의 성능 이상과 copyleft 코드 제외의 정당성 심화 분석이 개선 필요 영역이다.

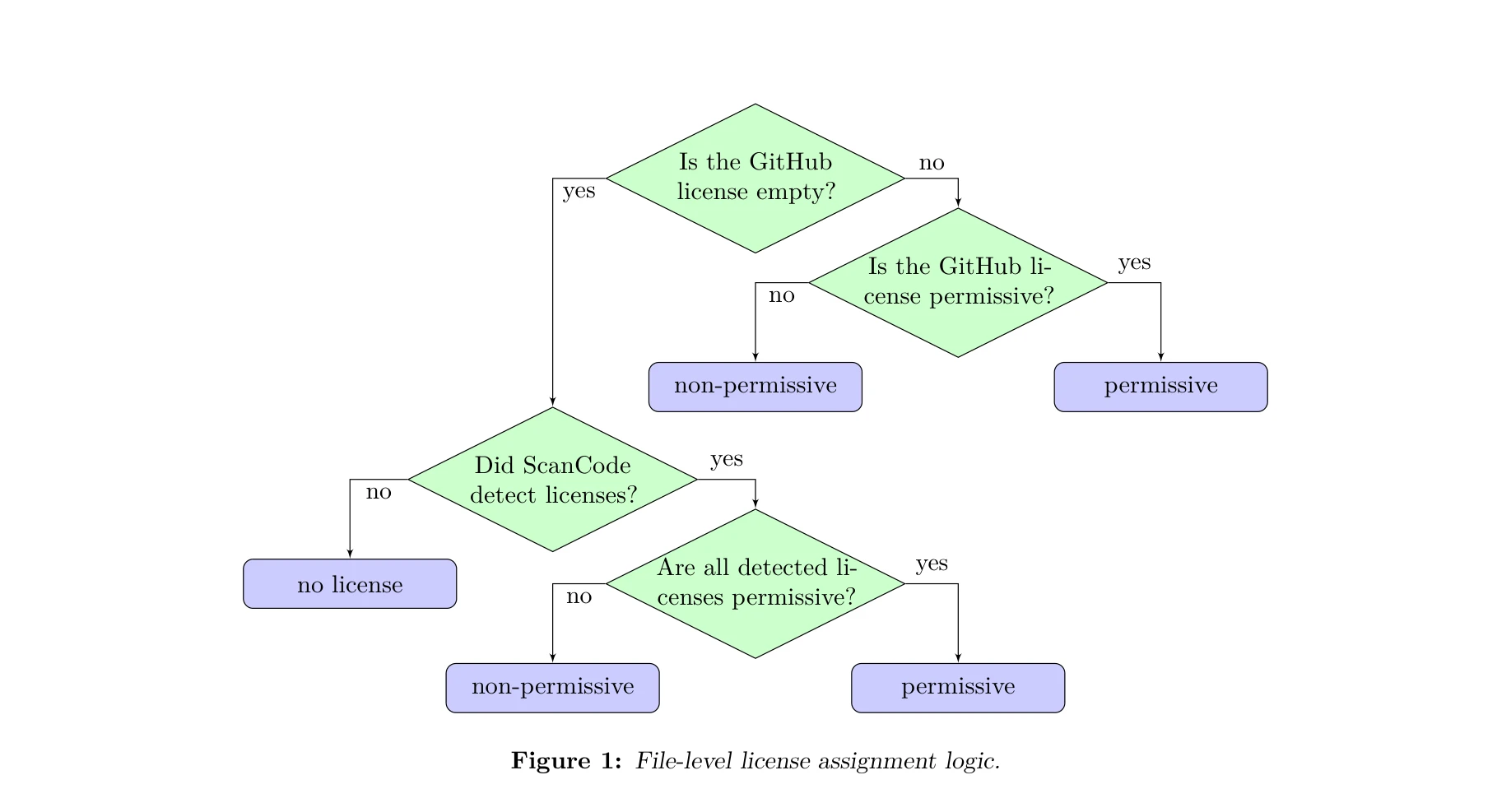

Accelerating Scientific Research with Gemini: Case Studies and Common Techniques

그림 1: 다양한 증거사례에 사용된 추론 아키텍처 개요: 솔루션 공간의 광범위한 탐색과 깊이 있는 추론, 그리고 자동화 및 인간 검증의 연쇄

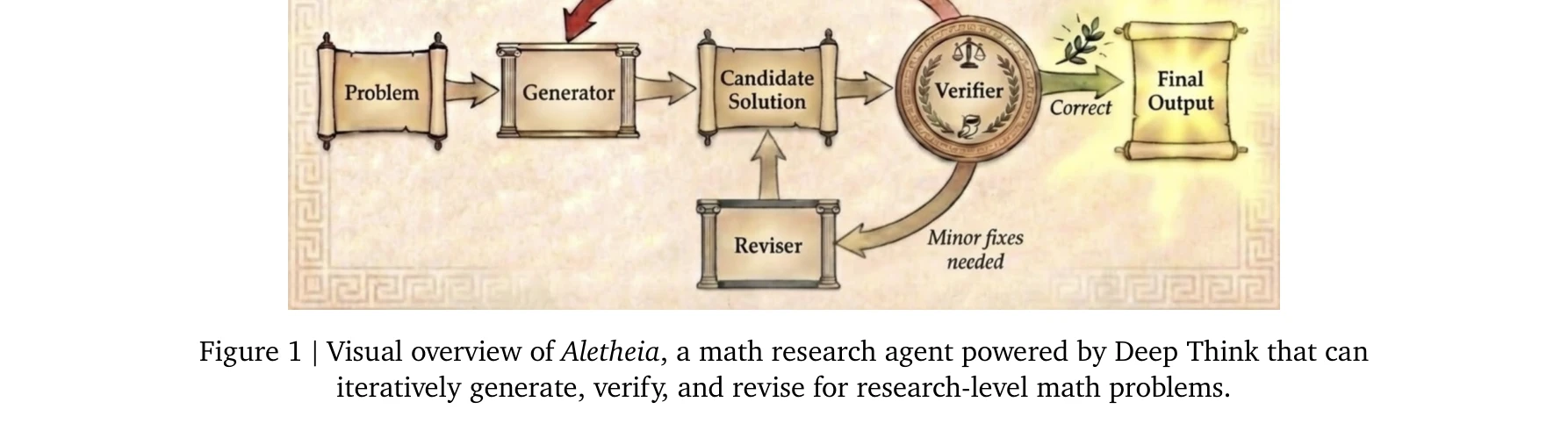

본 논문은 Google의 Gemini Deep Think 및 그 고도화 모형들을 활용하여 이론 컴퓨터 과학, 경제학, 최적화, 물리학 등 다양한 분야에서 미해결 문제를 해결하고 새로운 정리를 생성한 실제 사례들을 제시한다. 저자들은 인간-AI 협력의 일반화된 기법들을 추출하여 과학 연구 가속화를 위한 체계적 방법론을 제안한다.

본 논문은 최신 LLM이 단순 자동화 도구를 넘어 진정한 과학 연구 파트너로 기능할 수 있음을 광범위한 실제 사례와 메타 방법론으로 입증하는 중요한 기여이다. 특히 신경기호 루프와 적대적 검토 프레임워크 같은 새로운 활용 방식은 주목할 만하다. 다만 형식 검증, 실패 분석, 그리고 일반화 가능성 제시가 보강된다면 더욱 강력한 가이드라인이

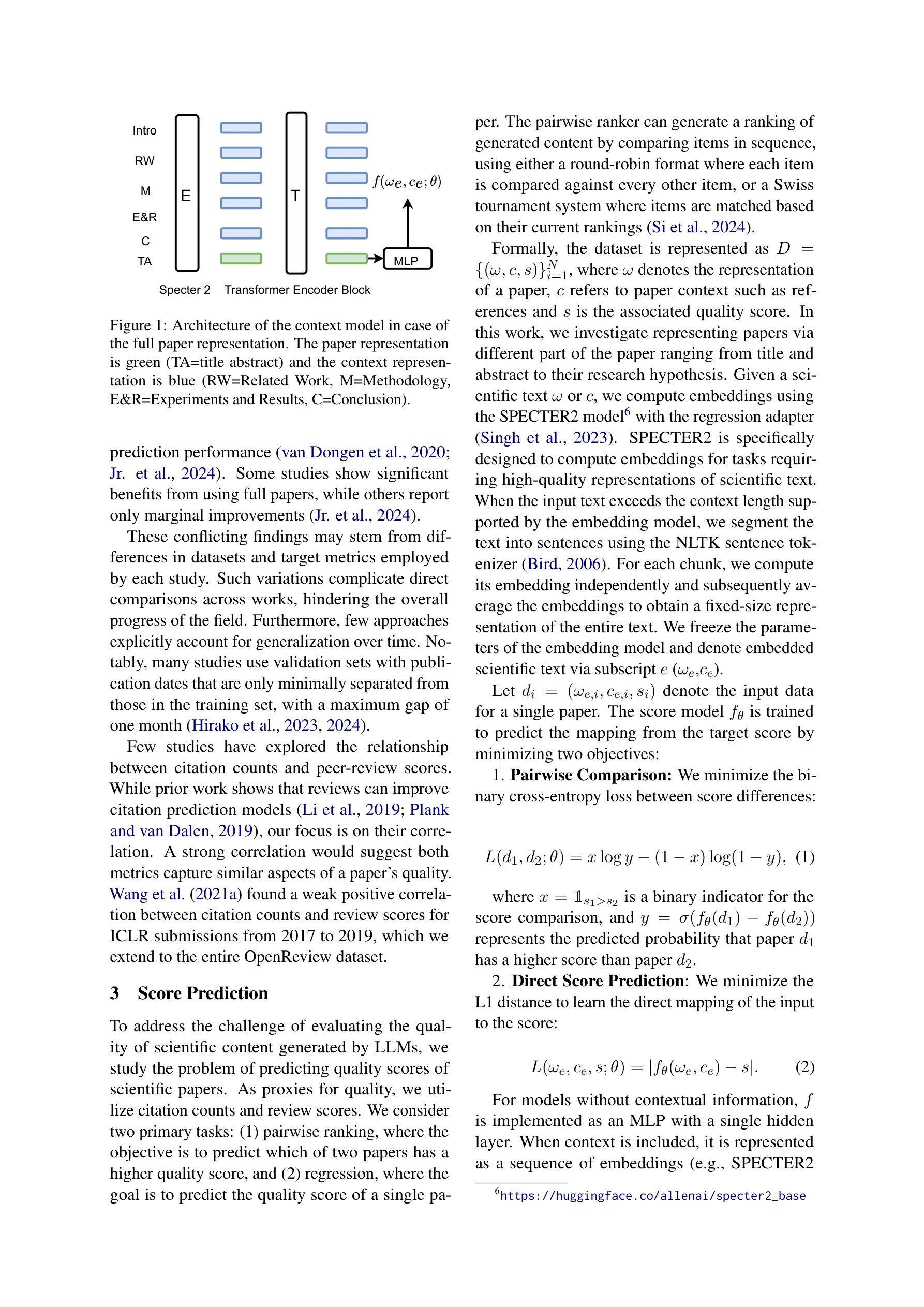

Knowledge-guided large language model for material science

그림 1: 최근 년도별 대규모 언어모델의 발전 timeline. 오픈소스 LLM은 노란색으로 표시

*그림 1: 최근 년도별 대규모 언어모델의 발전 timeline. 오픈소스 LLM은 노란색으로 표시* ChatGPT로 촉발된 대규모 언어모델(LLM)의 혁신을 재료과학 분야에 체계적으로 적용하기 위한 지식-안내식 도메인 특화 모델 개발 및 활용 방법론을 제시한 종합 리뷰 논문이다. 본 논문은 LLM 구축부터 재료 발견에의 실제 응용까지 전주기적 가이드라인을 제공한다.

본 논문은 ChatGPT 시대의 재료과학 연구 혁신을 위해 LLM을 실제로 구축하고 활용하는 방법을 체계적으로 정리한 중요한 종합 리뷰이며, 도메인-특화 LLM 개발의 실용적 로드맵을 제공한다는 점에서 학술적·실무적 가치가 높으나, 재료과학 특정 데이터셋과 할루시네이션 방지 기술의 고도화 같은 후속 연구가 절실하다.

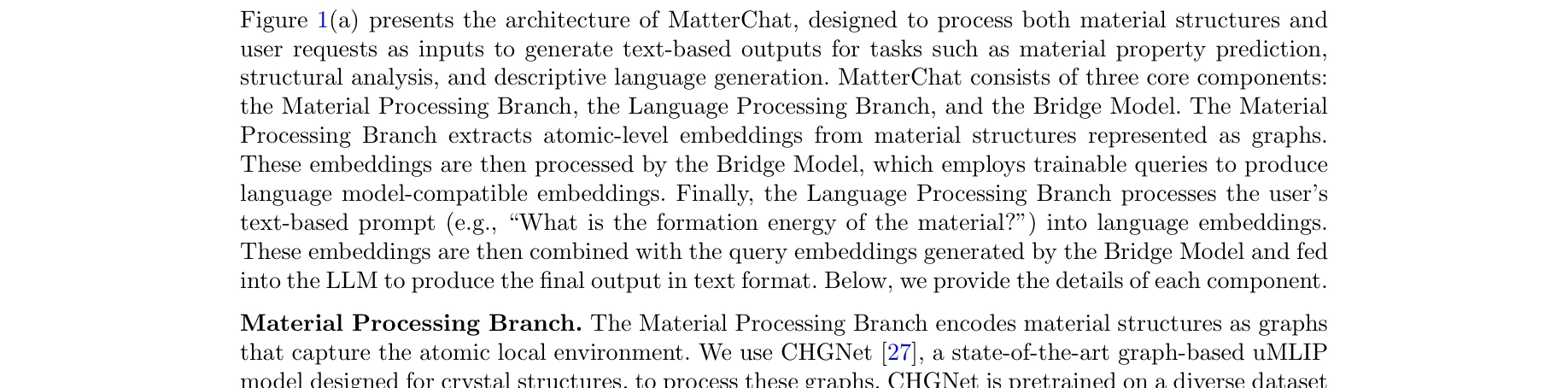

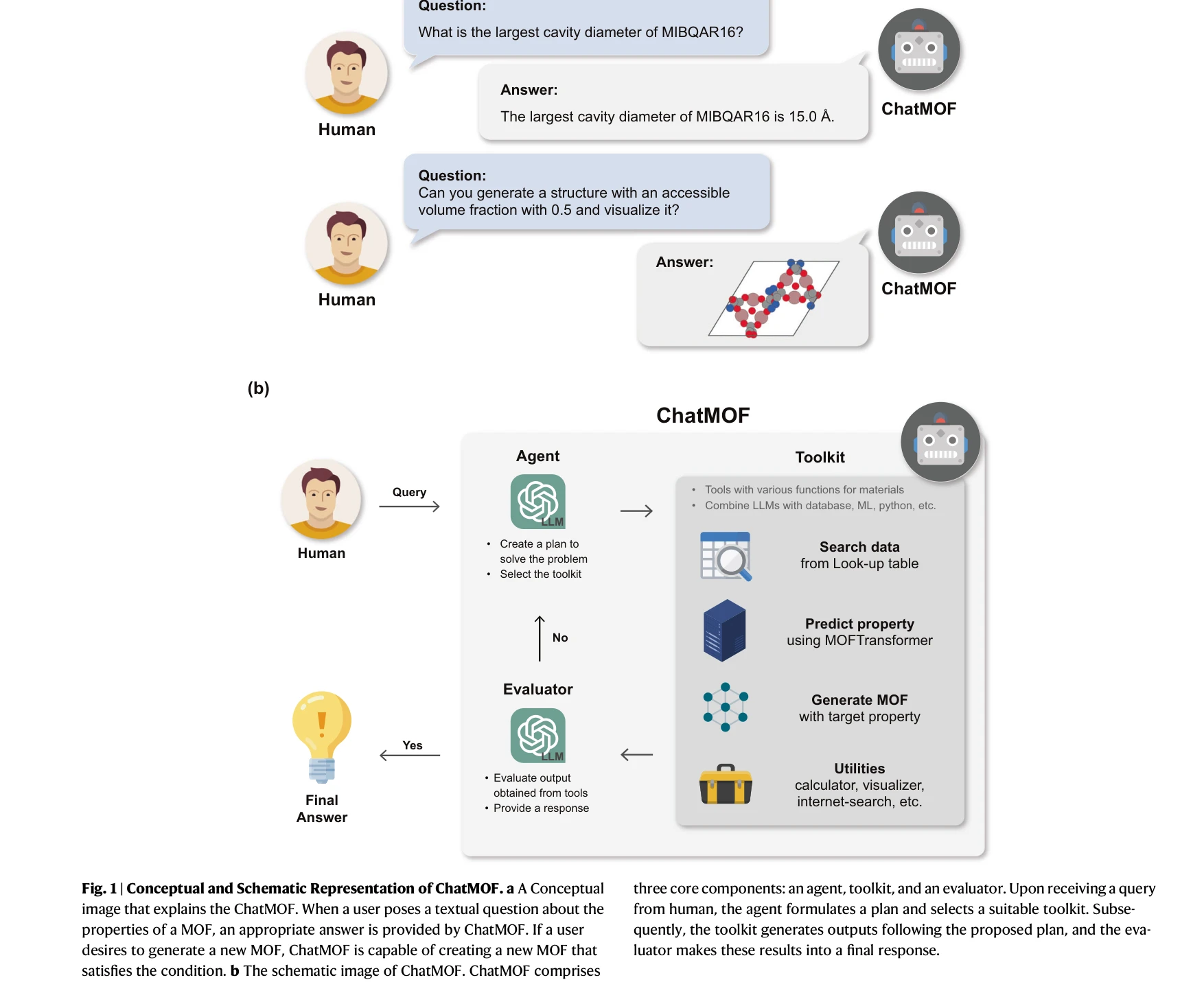

MatterChat: A Multi-Modal LLM for Material Science

그림 1: (a) 물질 처리, 언어 처리, 브리지 모듈 세 핵심 컴포넌트, (b) 주기표상 원소 분포 (142,899개 물질), (c) 공간군별 결정 구조 분포

원자 구조 정보를 완전히 보존하면서 대규모 언어 모델(LLM)과 통합하는 구조-인식 멀티모달 LLM으로, 물질의 성질 예측과 과학적 추론에서 GPT-4를 능가하는 성능을 달성했다.

원자간 포텐셜과 LLM의 창의적 결합으로 물질 과학에서 구조-인식 멀티모달 AI의 새로운 패러다임을 제시한 의미 있는 연구이나, 대규모 물질 데이터셋 확보와 물리적 해석성 향상을 통해 산업 적용 가능성을 높일 필요가 있다.

HiPerRAG: High-performance retrieval augmented generation for scientific insights

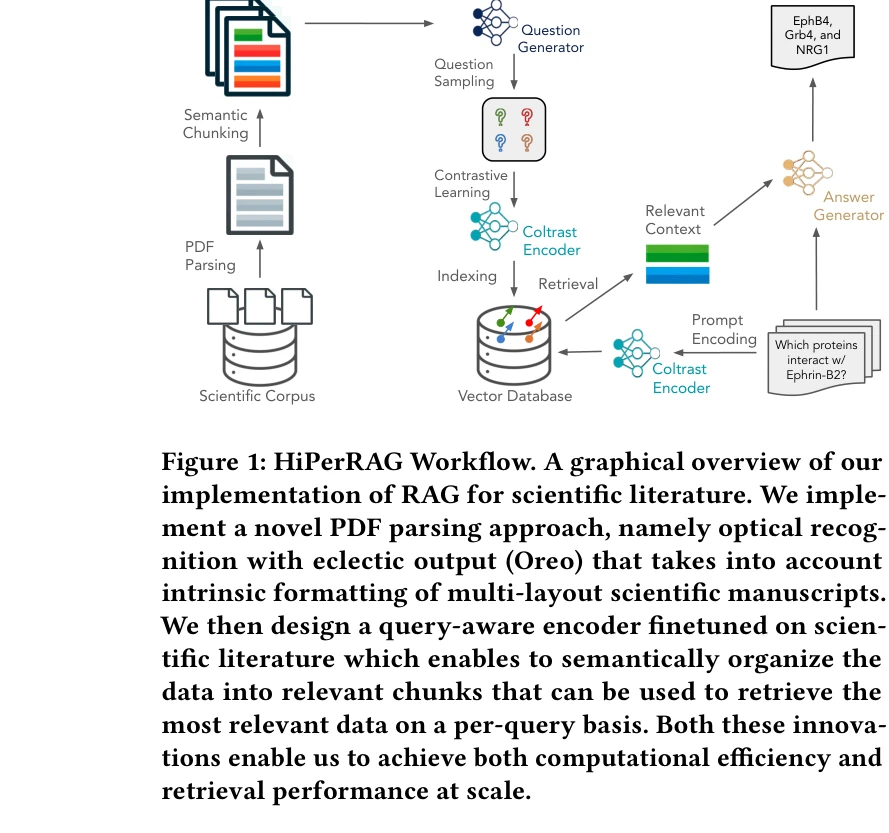

HiPerRAG 워크플로우: 멀티모달 문서 파싱(Oreo), 질의-인식형 인코더 미세조정(ColTrast), 그리고 대규모 벡터 검색을 통합한 과학 문헌 RAG 시스템

*HiPerRAG 워크플로우: 멀티모달 문서 파싱(Oreo), 질의-인식형 인코더 미세조정(ColTrast), 그리고 대규모 벡터 검색을 통합한 과학 문헌 RAG 시스템* 본 논문은 360만 개 이상의 과학 논문을 처리하기 위해 고성능 컴퓨팅(HPC)을 활용한 검색-증강 생성(RAG) 시스템 HiPerRAG를 제시하며, 과학 문헌의 복잡한 구조를 처리하는 새로운 문서 파싱 기법(Oreo)과 과학 텍스트 특화 인코더(ColTrast)를 개발했다.

본 논문은 대규모 과학 문헌 처리를 위한 RAG 시스템의 실용적이고 확장 가능한 솔루션을 제시한다. Oreo 파서와 ColTrast 인코더는 개별적으로 의미 있는 기여를 하며, HPC와의 통합은 산업 적용 가능성을 높인다. 다만 새로운 벤치마크 대부분이 단일 도메인(단백질 예측)에 한정되고, 검색-생성 통합 최적화, LLM 환각 저감의 근본적 해결책 제시는 미흡하다. 과학 커뮤니티의 정보 과부하 문제 해결에 기여할 실용적 시스템이지만, 학술적 혁신성 측면에서는 기존 기법의 공학적 우수 조합에 가깝다.

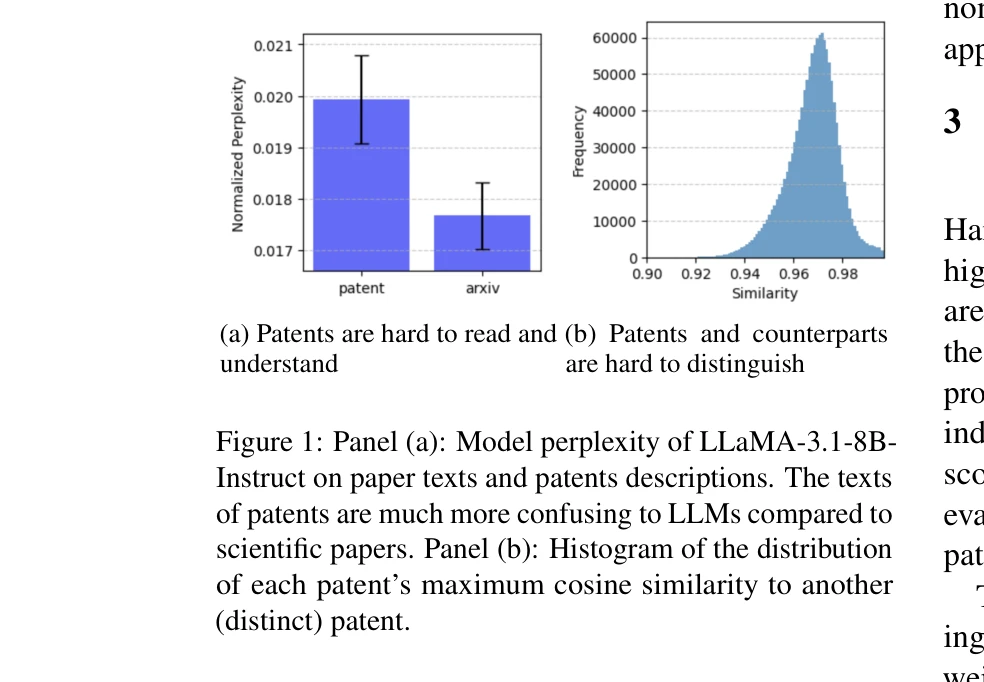

Data integrity in materials science in the era of AI: balancing accelerated discovery with responsible science and innovation

AI의 급속한 발전으로 재료 과학의 데이터 무결성이 심각한 위협에 직면해 있으며, 전문가조차 AI 생성 현미경 이미지를 실제 데이터와 구별하지 못하고 있다. 이 논문은 책임감 있는 과학 실천을 위한 다층적 연구 무결성 프레임워크를 제안한다.

본 논문은 AI 기반 재료 과학 연구에서 긴급하게 대두되는 데이터 무결성 위기를 최초로 종합적으로 조명하고, 전문가 실증 조사와 구체적 사례를 통해 위협의 현실성을 입증하는 중요한 관점 논문(Perspective)이다. 다만 제안된 기술적 해결책의 구체적 구현 방안과 규제, 표준화 경로가 추가로 상세화될 필요가 있다.

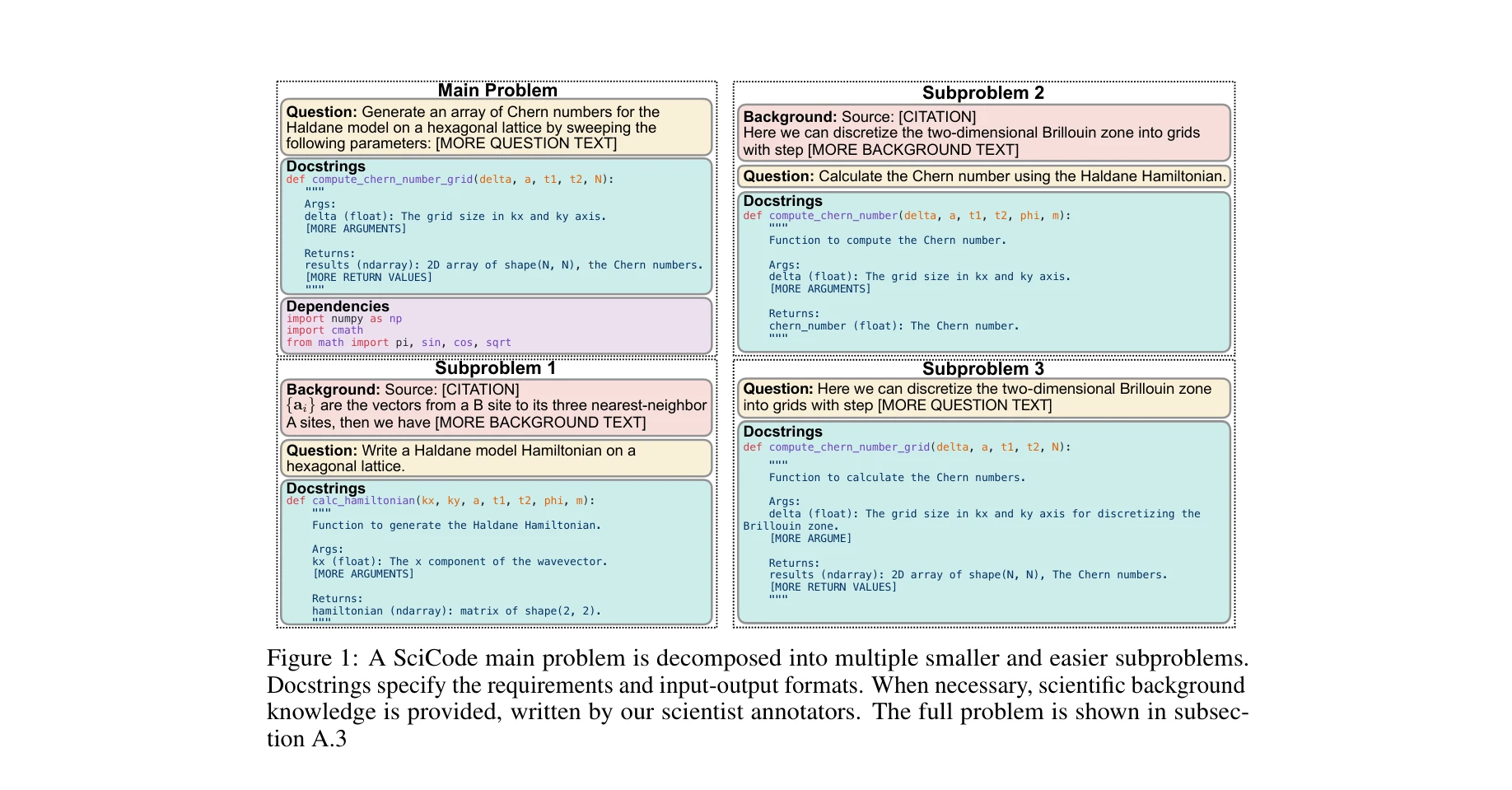

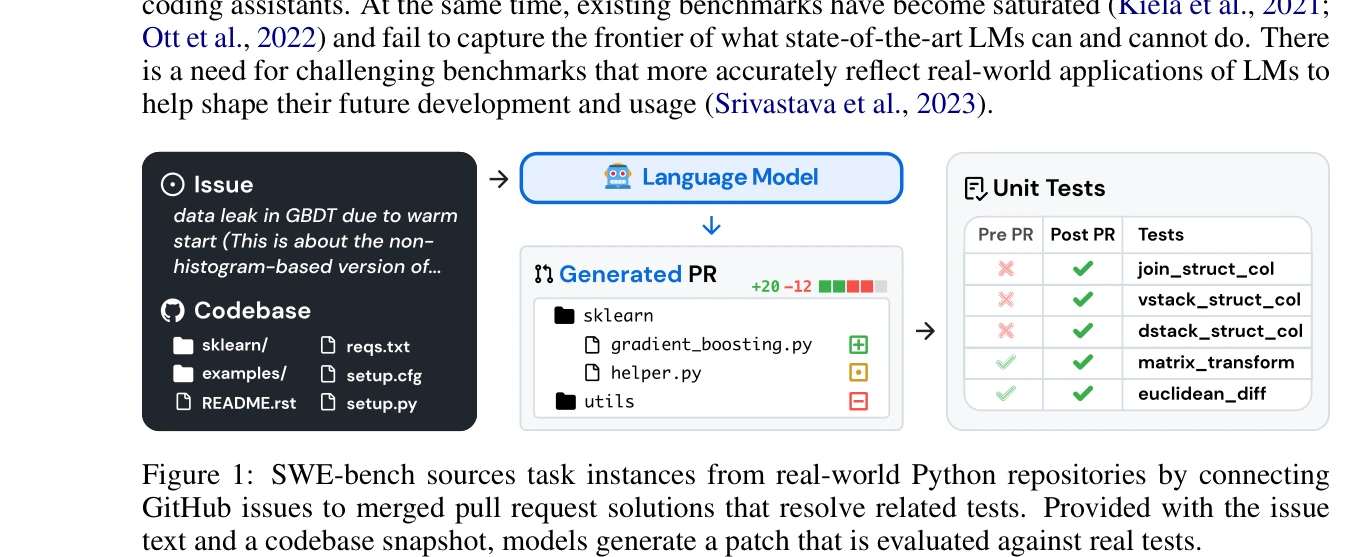

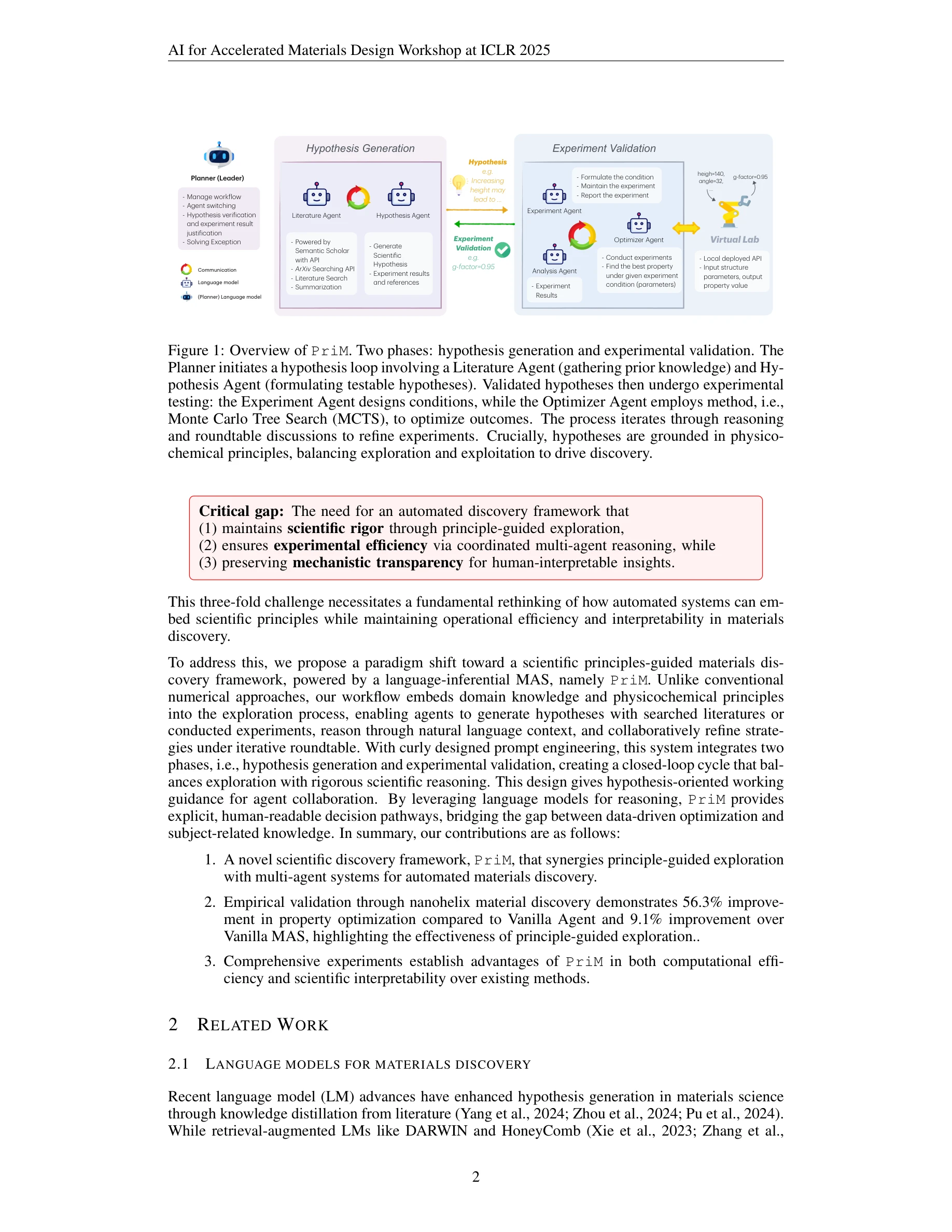

SciCode: A Research Coding Benchmark Curated by Scientists

Figure 1: SciCode 주요 문제가 여러 개의 더 작고 쉬운 부분 문제로 분해되는 구조

과학자들이 직접 큐레이션한 과학 연구 문제 중심의 코딩 벤치마크를 제시하여, 언어 모델(LM)의 실제 과학 보조 능력을 평가할 수 있는 고품질 평가 도구를 개발하였다.

본 논문은 과학 분야 코딩 능력 평가에 대한 중요한 공백을 채우면서, 과학자들의 직접 참여로 벤치마크의 현실성과 신뢰성을 확보한 우수한 자원 논문이다. 현존 최고 성능 모델들도 4.6%의 저조한 성능을 보여주며 향후 과학 AI 개발의 명확한 목표와 평가 기준을 제시한다.

StarCoder: may the source be with you! arXiv preprint arXiv:2305.06161, 2023.

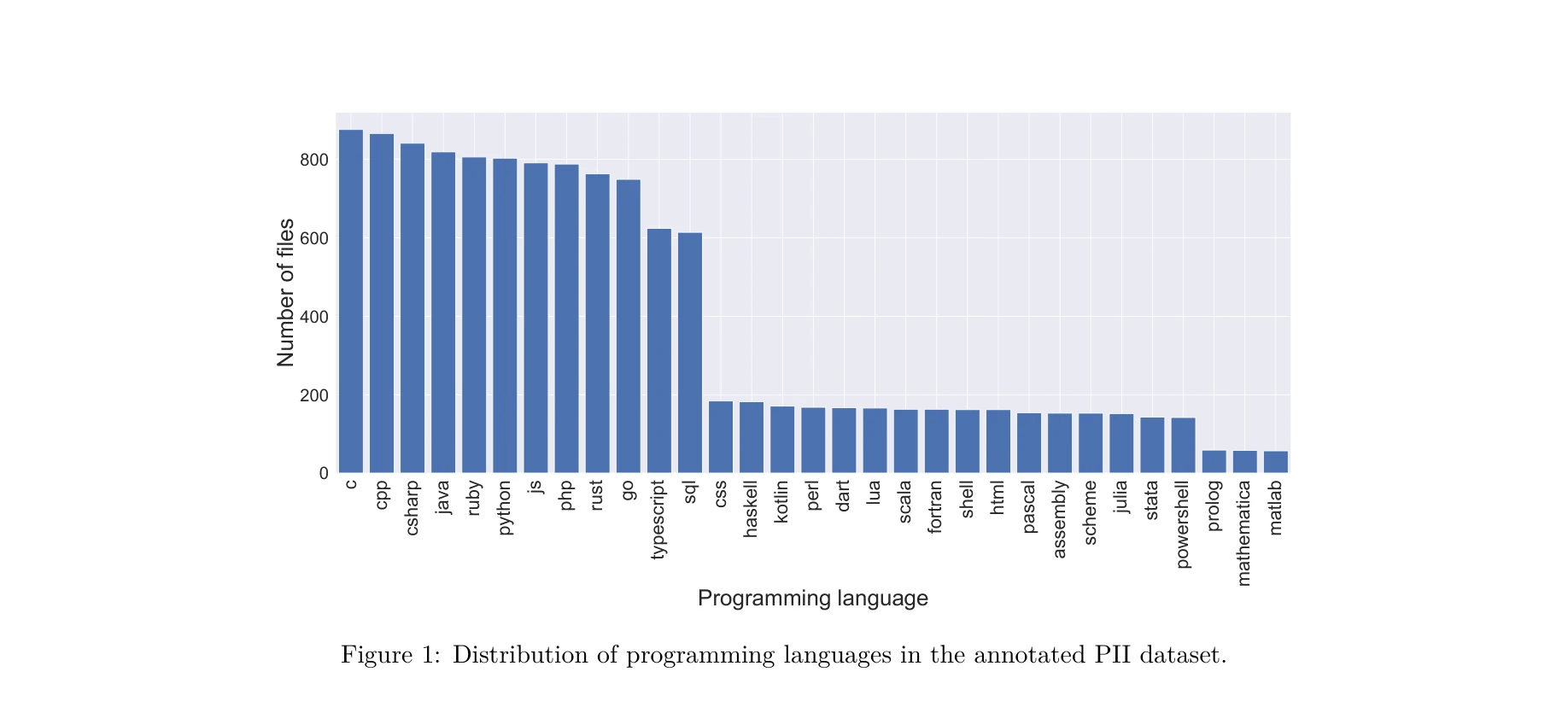

PII 주석 데이터셋의 프로그래밍 언어 분포

BigCode 커뮤니티가 개발한 StarCoder는 155억 파라미터 규모의 오픈 소스 코드 생성 대형언어모델(Code LLM)로, 책임감 있는 AI 개발을 위해 저작권, 개인정보, 투명성을 고려하여 설계되었으며, 기존 모든 오픈 코드 LLM을 능가하는 성능을 달성했다.

StarCoder는 고성능 오픈 코드 LLM의 필요성을 충족시키고 책임감 있는 AI 개발의 실질적 모델을 제시했으나, 법적·윤리적 쟁점의 완전한 해결보다는 투명성과 감시 도구를 제공하는 수준으로, 산업 및 연구 커뮤니티의 기여를 크게 높였으나 잠재적 법적 위험은 여전히 존재한다.

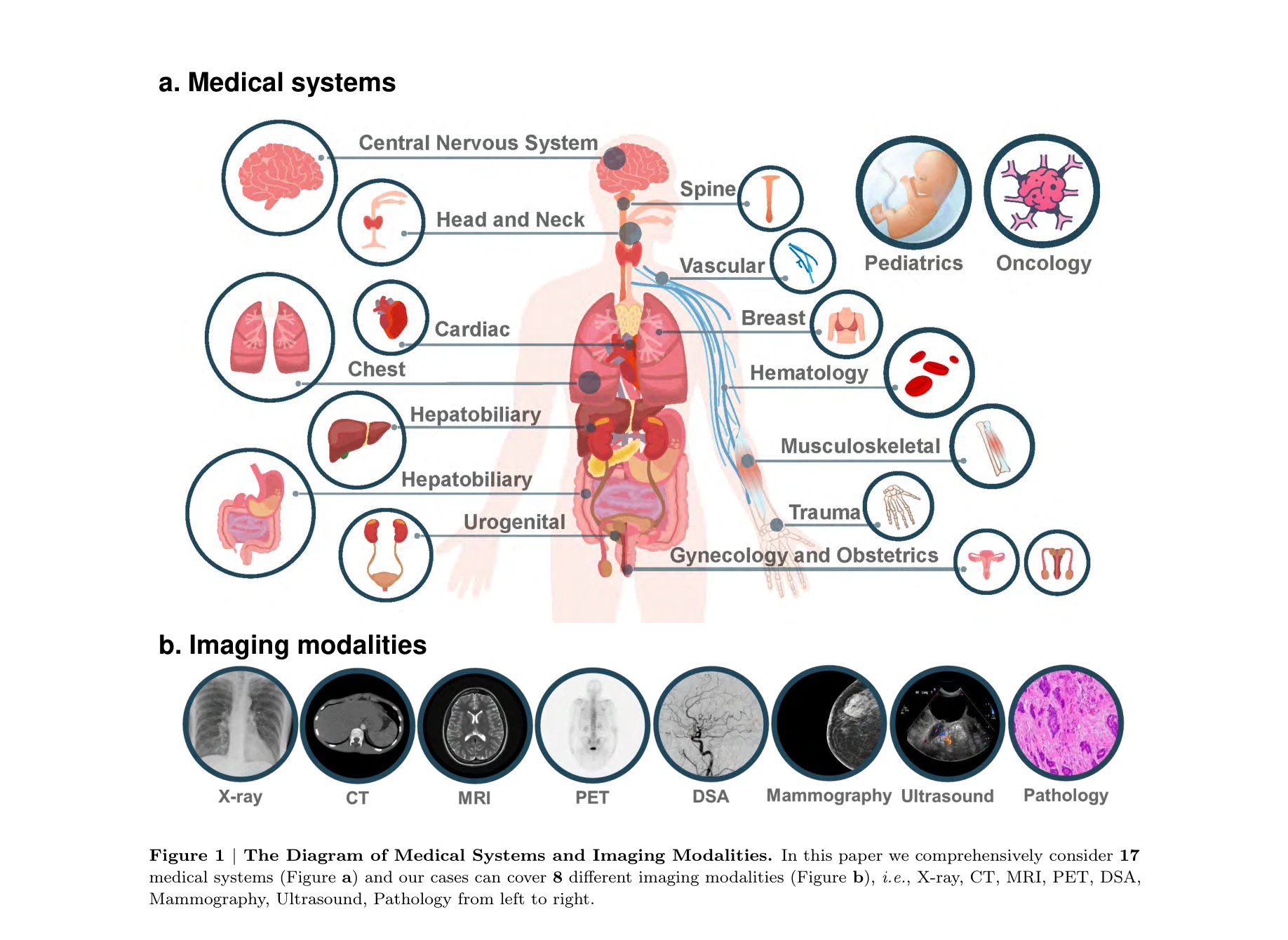

From large language models to multimodal AI: A scoping review on the potential of generative AI in medicine

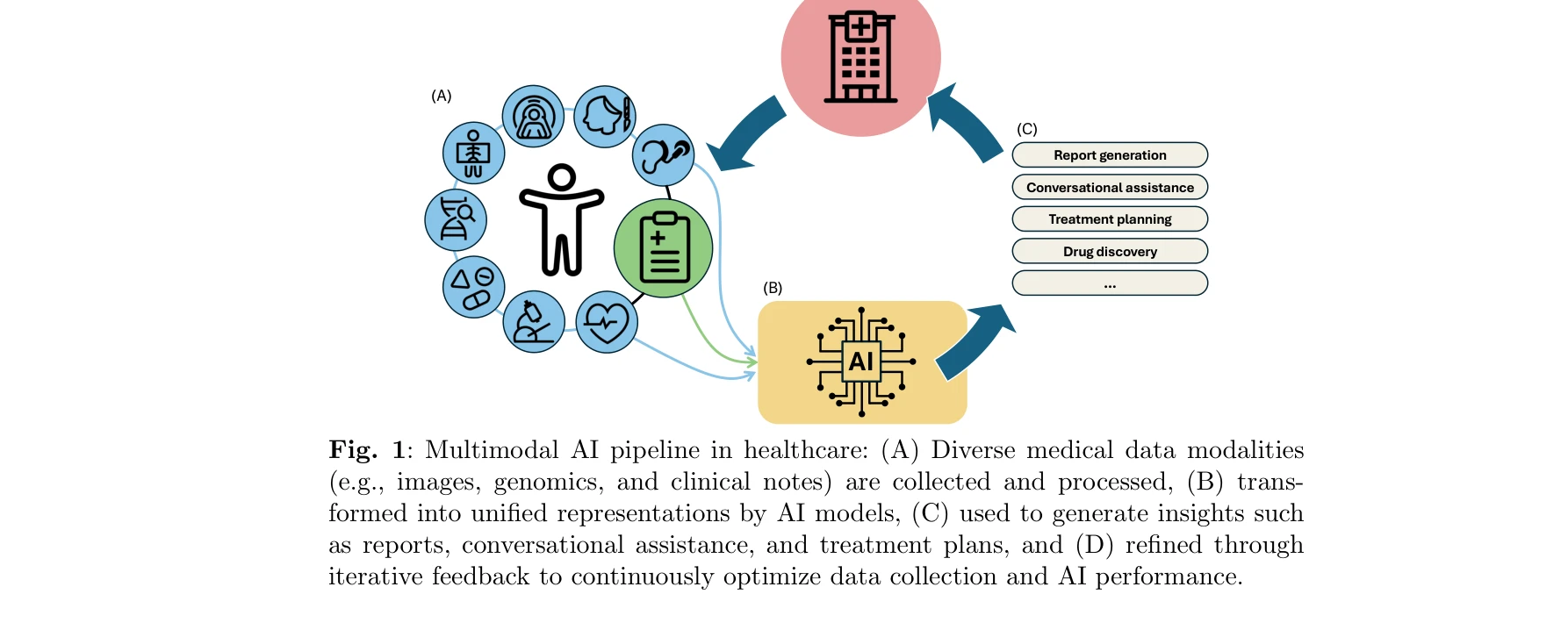

의료 분야의 멀티모달 AI 파이프라인: (A) 다양한 의료 데이터 양식 수집 및 처리, (B) AI 모델에 의한 통합 표현 변환, (C) 리포트 생성, 대화 지원, 치료 계획 등의 인사이트 생성, (D) 피드백을 통한 반복적 최적화

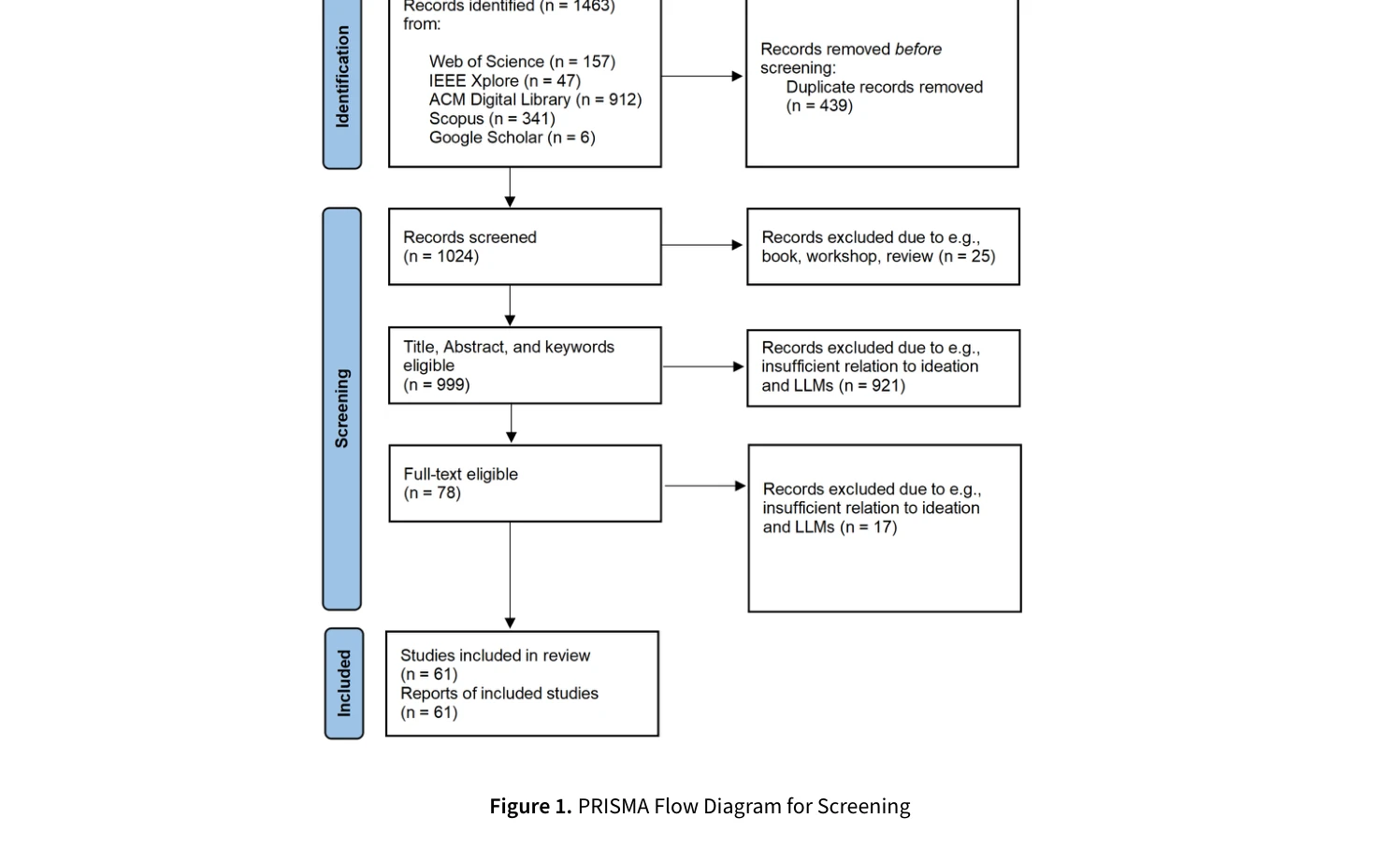

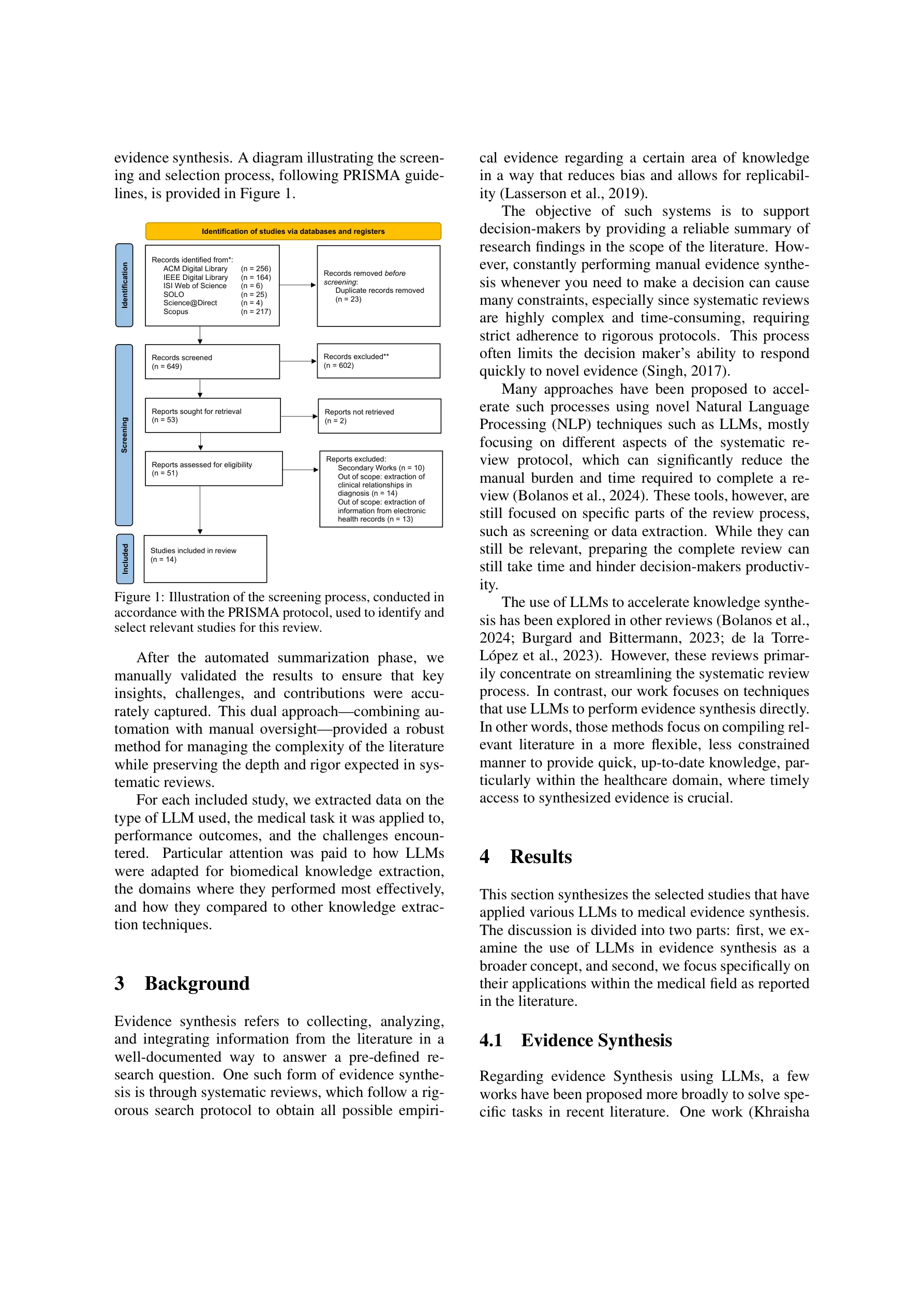

*의료 분야의 멀티모달 AI 파이프라인: (A) 다양한 의료 데이터 양식 수집 및 처리, (B) AI 모델에 의한 통합 표현 변환, (C) 리포트 생성, 대화 지원, 치료 계획 등의 인사이트 생성, (D) 피드백을 통한 반복적 최적화* 본 논문은 의료 분야에서 생성형 AI의 진화를 체계적으로 검토한 스코핑 리뷰로, 텍스트 기반 대규모 언어모델(LLM)에서 의료 영상, 임상 데이터를 통합하는 멀티모달 AI 시스템으로의 전환을 추적하며, PRISMA-ScR 가이드라인을 따라 2020-2024년 발표된 144개 논문을 분석했다.

본 논문은 의료 분야의 생성형 AI 진화를 최신 발표까지 포함하여 체계적으로 정리한 필수 참고 리뷰이며, 특히 멀티모달 통합과 평가 방법론의 gap을 명확히 규명함으로써 향후 연구자와 개발자에게 실질적 방향을 제시한다.

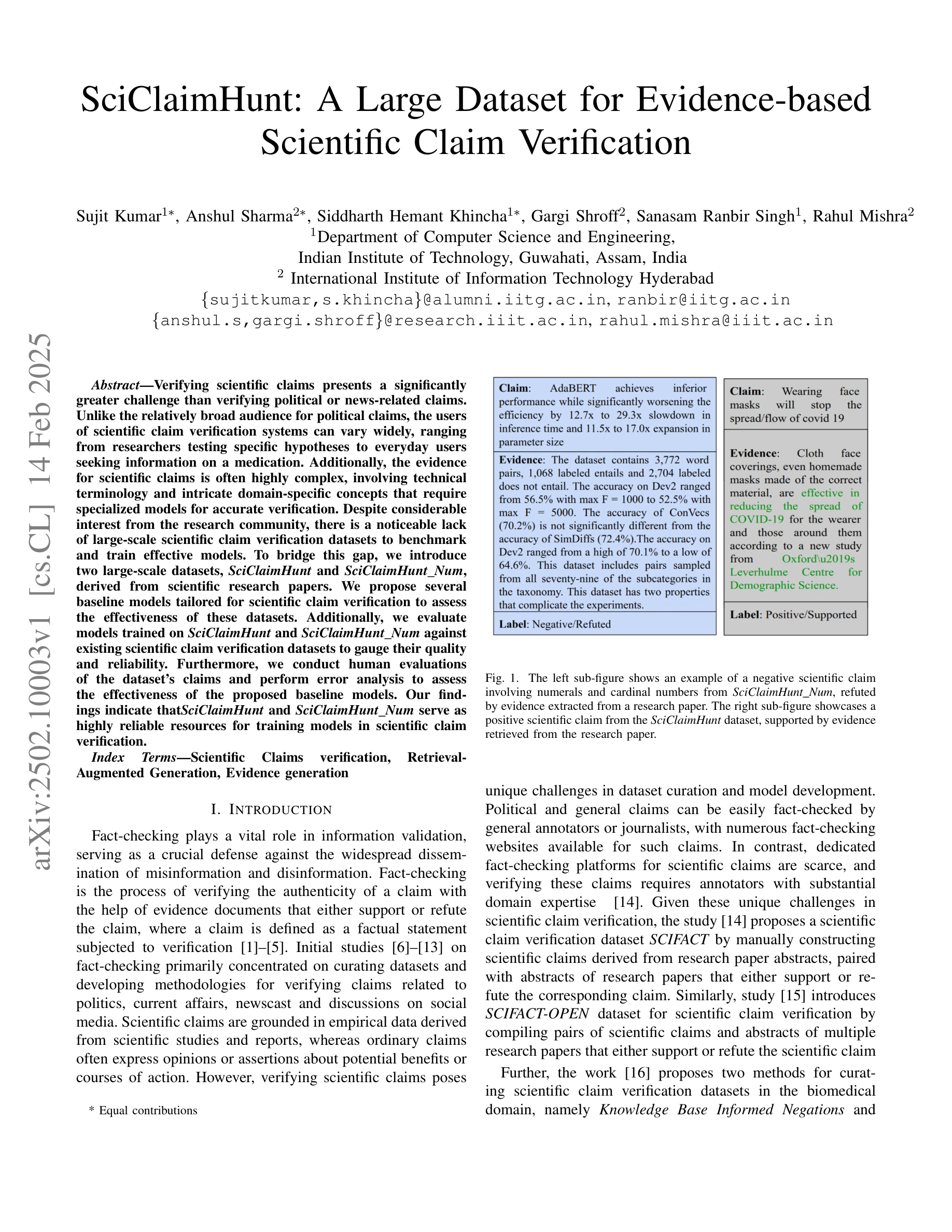

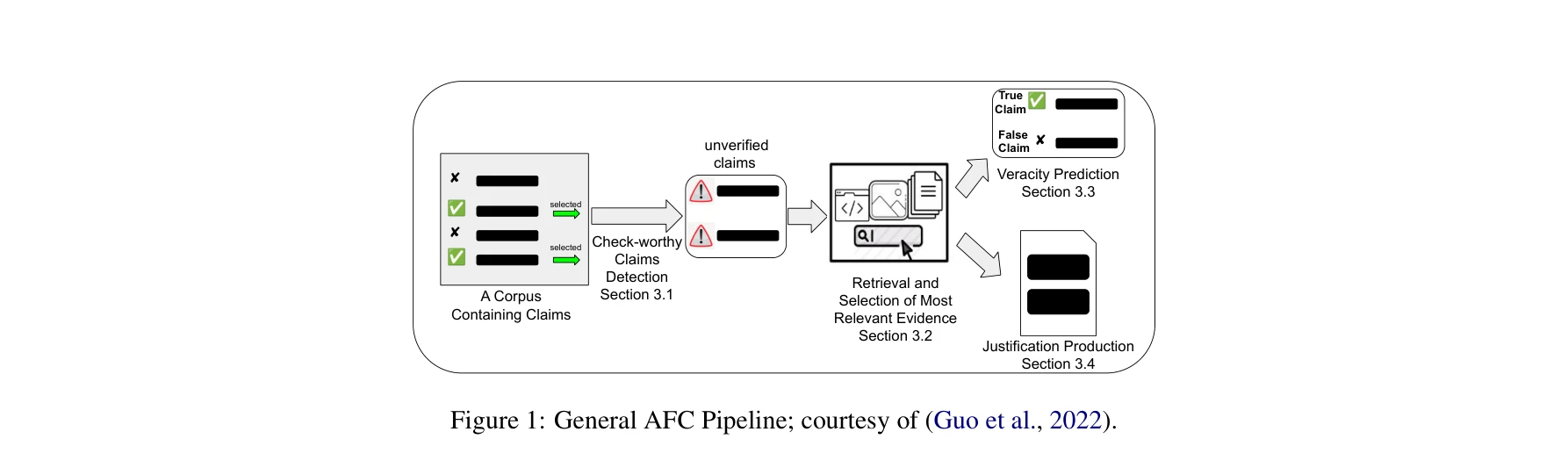

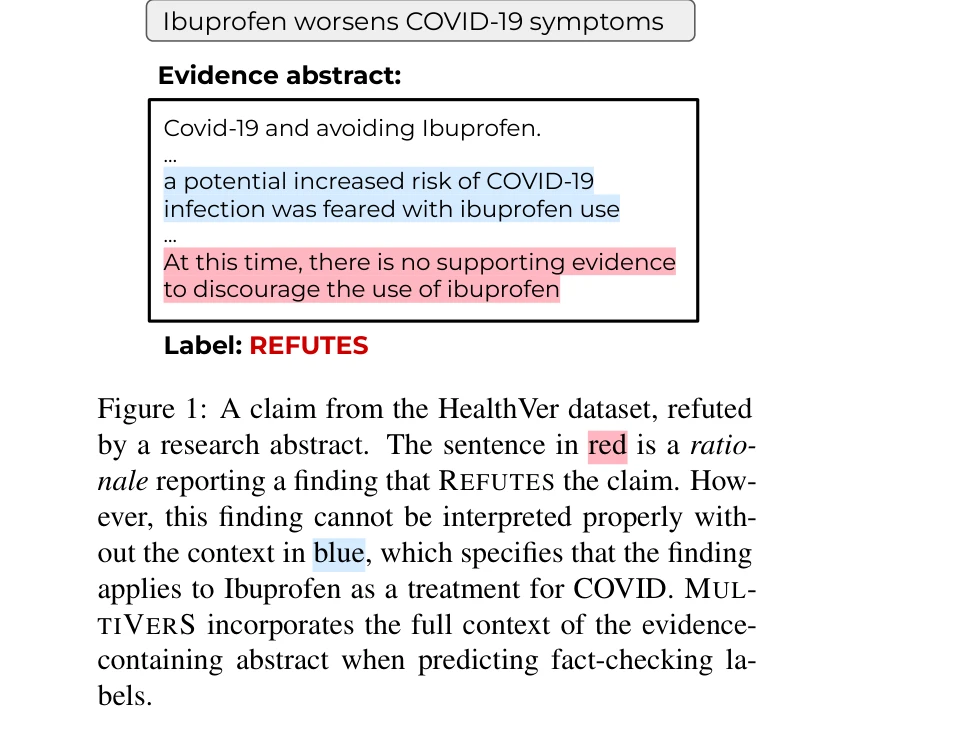

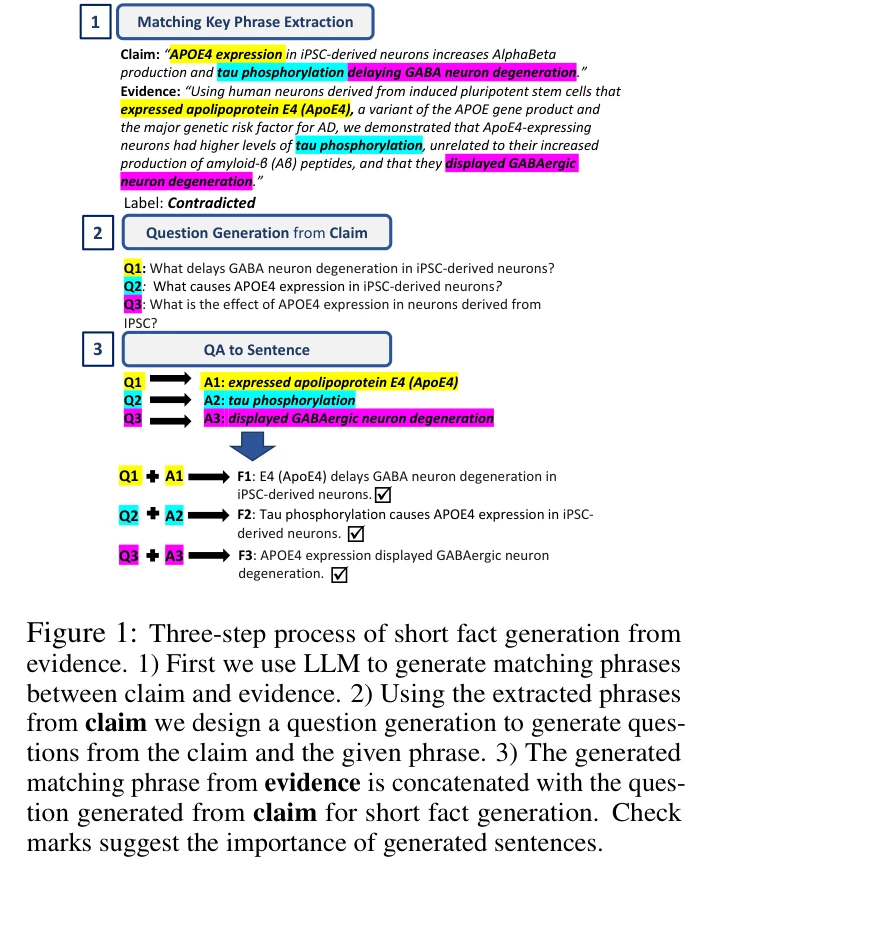

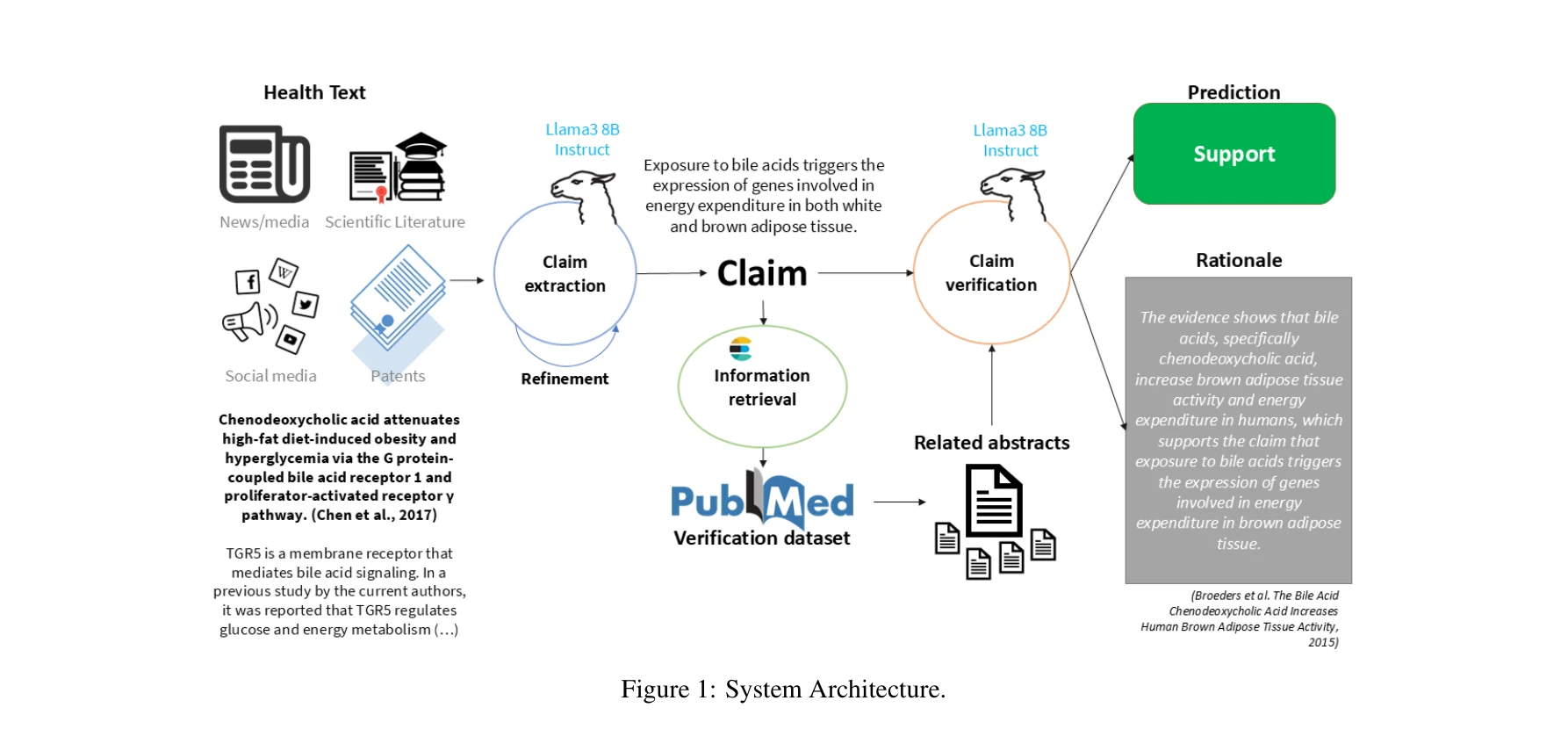

Sciclaimhunt: A large dataset for evidence-based scientific claim verification

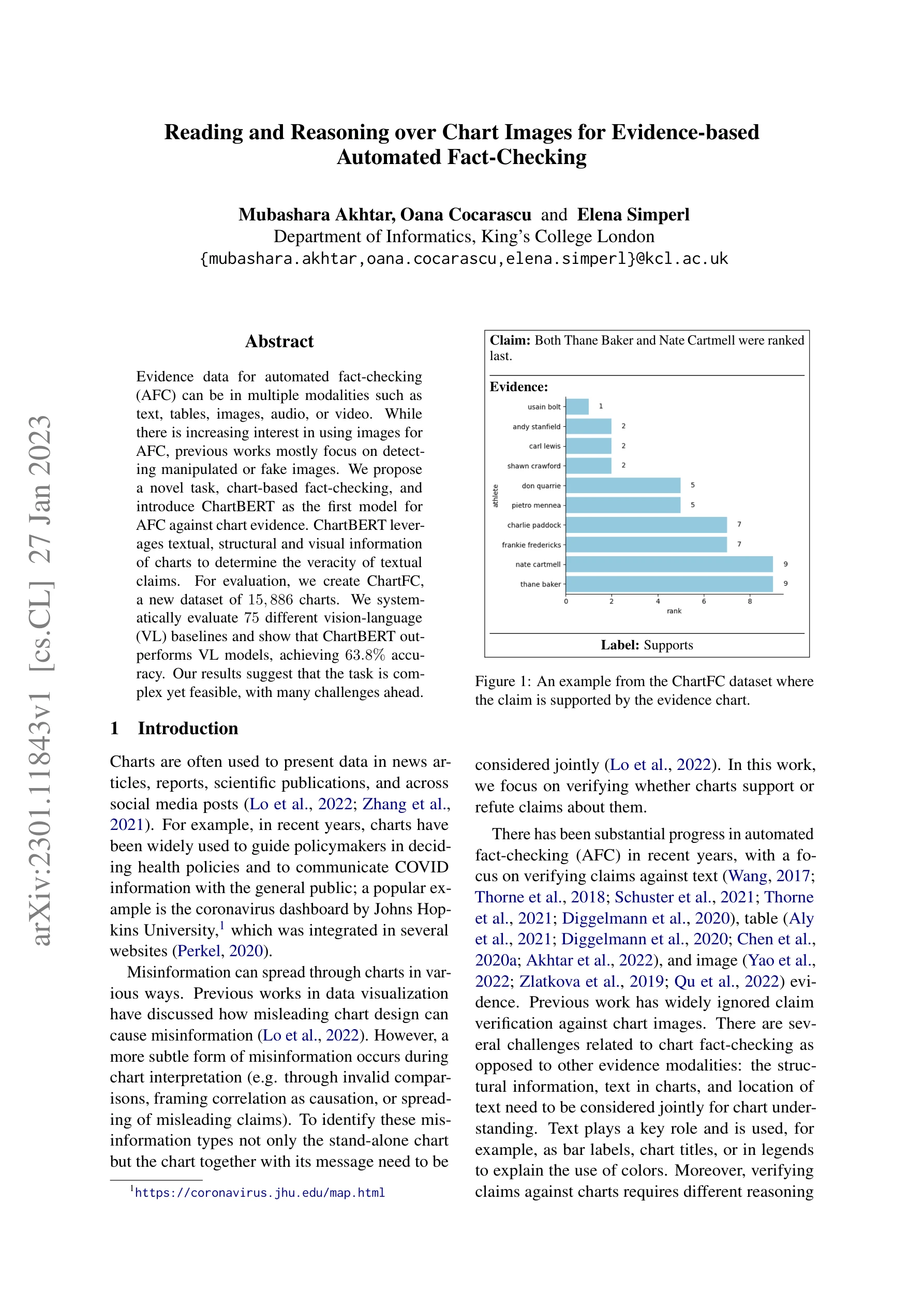

본 논문은 과학 논문에서 추출한 대규모 научных 주장 검증 데이터셋 SciClaimHunt와 SciClaimHunt Num을 소개한다. 정치적 주장과 달리 과학적 주장의 검증은 도메인 전문성과 복잡한 기술 용어를 요구하는 고도의 과제이며, 이를 해결하기 위해 87,109개의 주장과 이를 지원하거나 반박하는 과학 논문 증거로 구성된 대규모 데이터셋을 제시한다.

본 논문은 과학 주장 검증을 위한 기존의 규모 제한적이고 초록 중심적인 데이터셋의 한계를 실질적으로 해결하며, 결과/토론/결론 섹션을 포함한 전체 논문 컨텍스트와 수치 인식 검증이라는 새로운 평가 차원을 도입함으로써 과학 팩트체킹 연구에 상당한 기여를 할 것으로 기대된다.

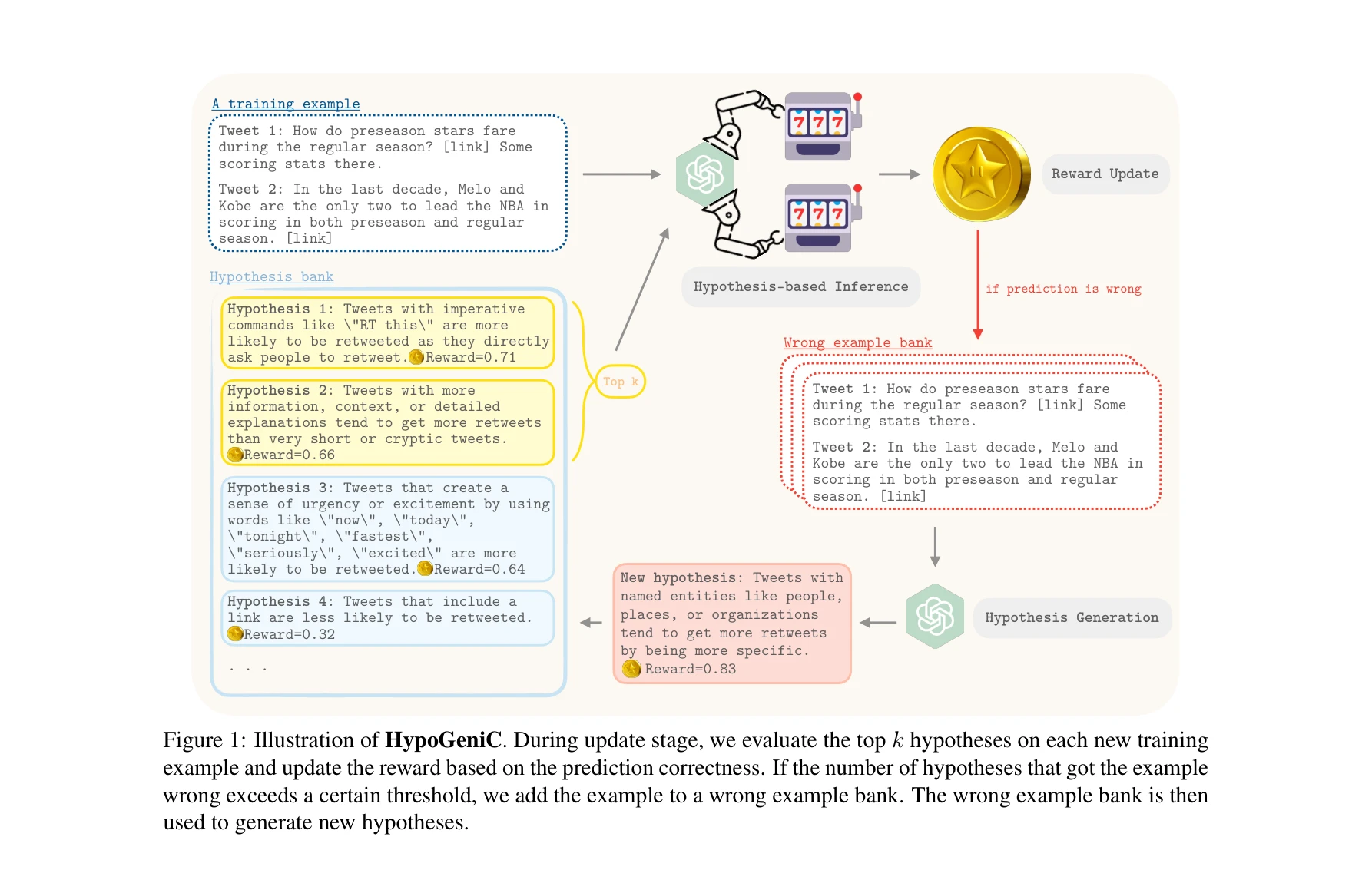

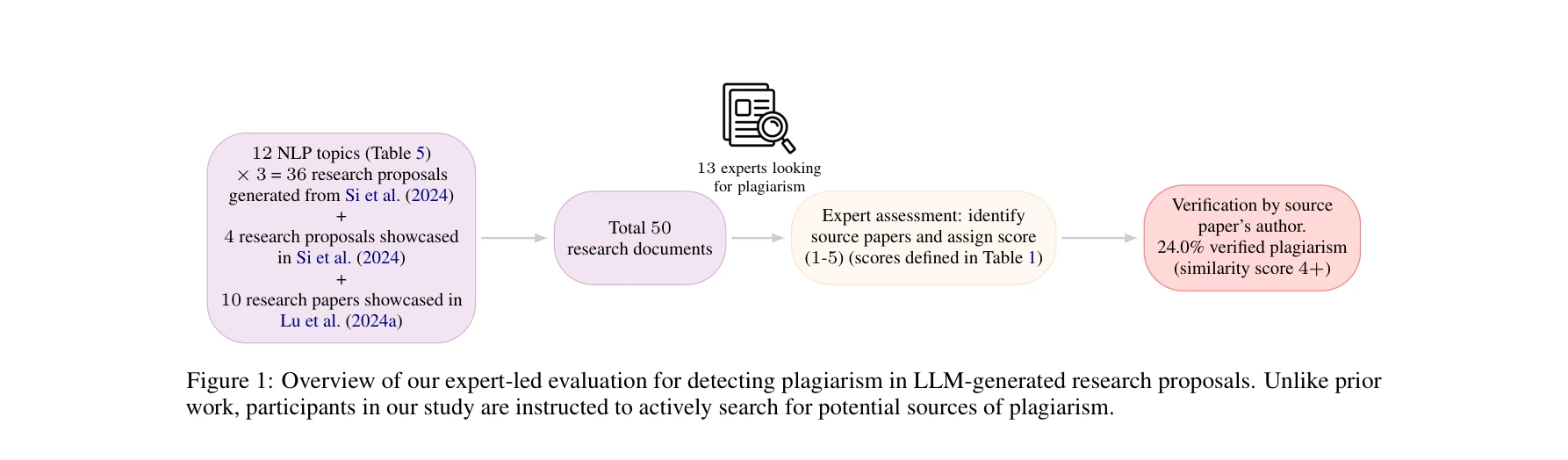

A GENTIC H YPOTHESIS : A SURVEY ON HYPOTHESIS GENERATION USING LLM SYSTEMS

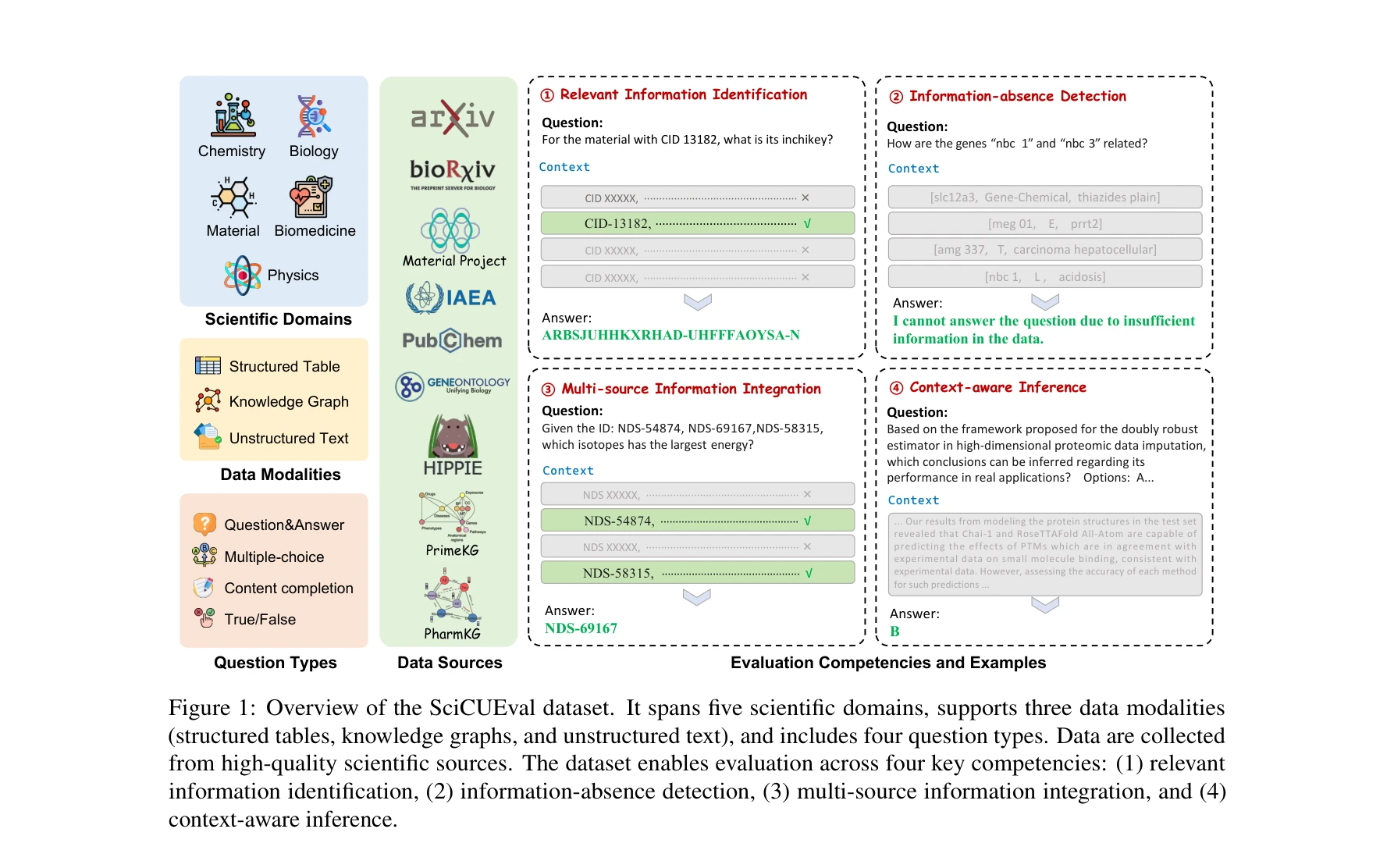

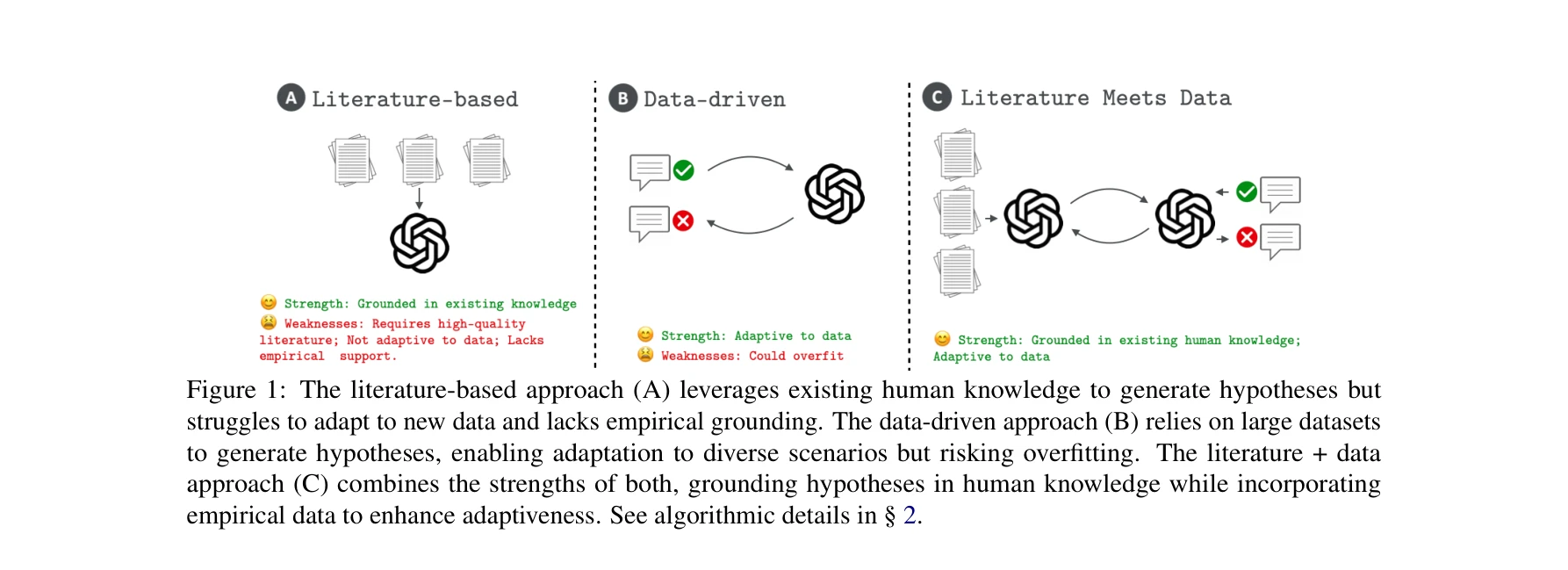

Figure 1: Taxonomy of Methods for Scientific Hypothesis Generation (SHG).

*Figure 1: Taxonomy of Methods for Scientific Hypothesis Generation (SHG).* 본 논문은 과학적 가설 생성(Scientific Hypothesis Generation)에서 대규모 언어모델(LLM)의 활용을 종합적으로 조사하는 설문 논문으로, 기존 방법론부터 최신 LLM 기반 접근법까지의 분류 체계와 평가 전략을 제시한다.

본 설문 논문은 LLM 기반 가설 생성 분야의 첫 종합 리뷰로서, 방법론의 진화 경로와 현재 상황을 명확히 정리하고 향후 연구 방향을 제시한다는 점에서 높은 학술적 가치를 가진다. 다만 실제 과학적 검증 사례와 정량적 평가 기준이 보강된다면 더욱 강력한 기여가 될 수 있을 것으로 판단된다.

A smack of all neighbouring languages: How multilingual is scholarly communication? arXiv preprint arXiv:2504.21100, 2025.

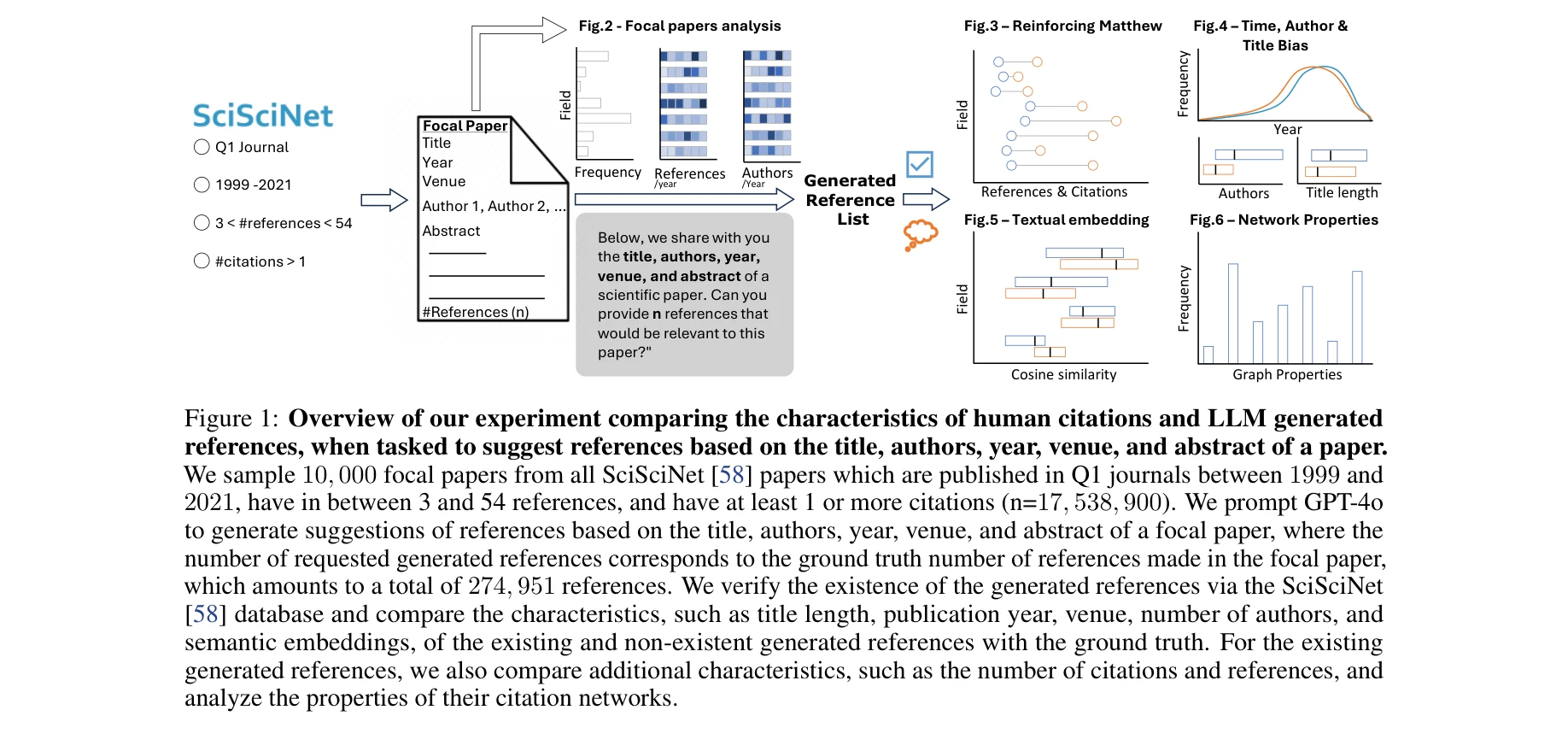

1990-2023년 OpenAlex와 Dimensions 데이터베이스를 활용하여 과학 논문 8,757만 개와 인용 14억 8천만 개를 분석해 학술 커뮤니케이션의 언어 다양성과 영어 지배 현황을 대규모로 실증 분석한 연구

본 연구는 학술 커뮤니케이션의 언어 불평등을 전역 규모에서 처음 체계적으로 분석했으며, 영어 지배의 완화 추세와 지역 학술 시스템의 성장을 실증적으로 입증함. 과학 정책과 포용성 강화를 위한 중요한 증거를 제공한다.

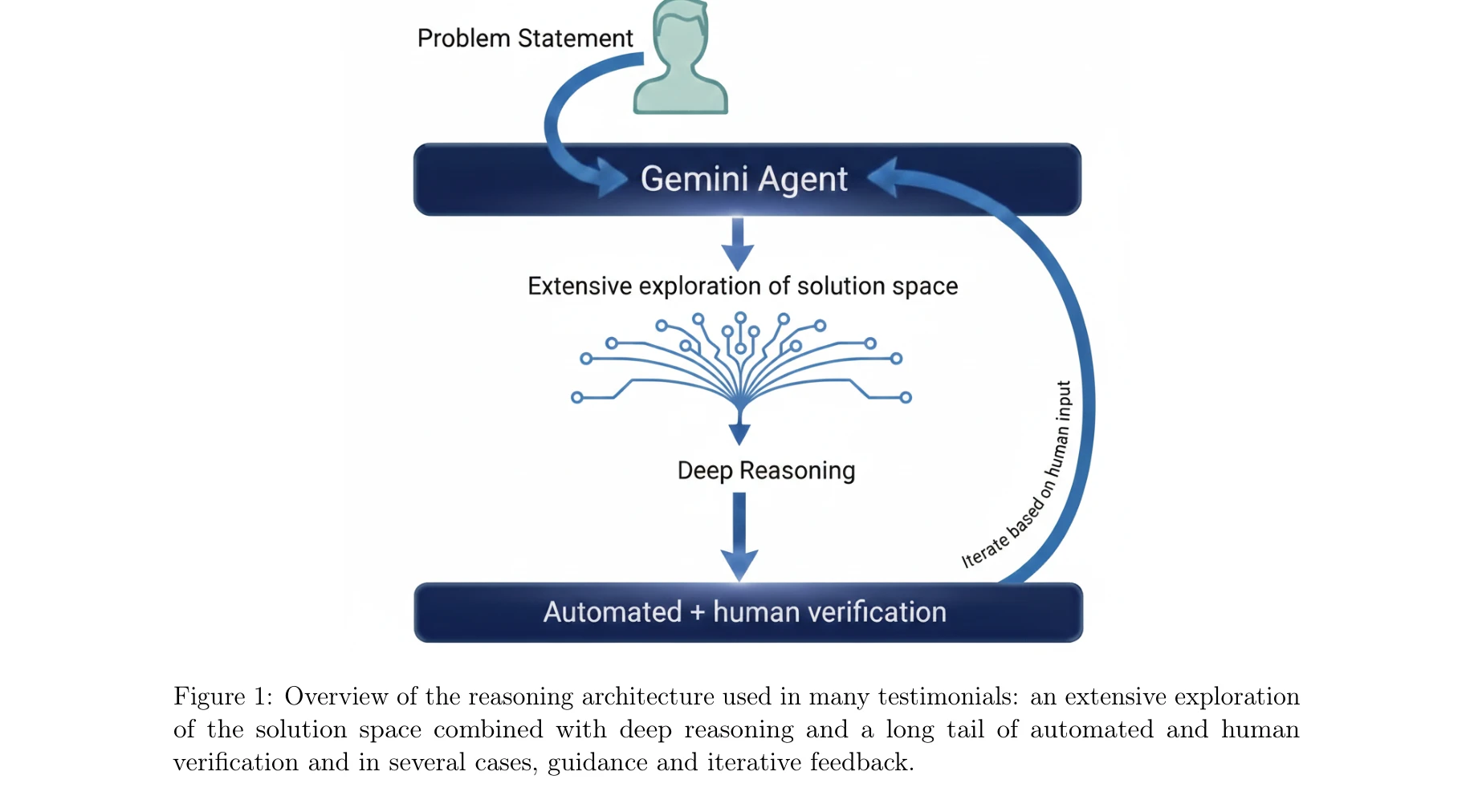

Foundational models for scientific discovery

Figure 1: Taxonomy of Methods for Scientific Hypothesis Generation (SHG).

*Figure 1: Taxonomy of Methods for Scientific Hypothesis Generation (SHG).* 본 논문은 과학적 가설 생성(hypothesis generation)을 위한 대규모 언어 모델(LLM) 활용에 대한 종합적 설문 논문으로, 기존 방법론부터 LLM 기반 접근법까지의 분류 체계(taxonomy)를 제시한다.

본 논문은 과학적 가설 생성의 진화 과정을 포괄적으로 정리하고 LLM 시대의 새로운 기회와 도전을 체계적으로 분석한 중요한 설문 논문이다. 다만 실제 사례 검증과 정량화된 평가 메트릭 개발이 향후 보완되어야 할 주요 과제로 남아있다.

Prompting llms to compose meta-review drafts from peer-review narratives of scholarly manuscripts

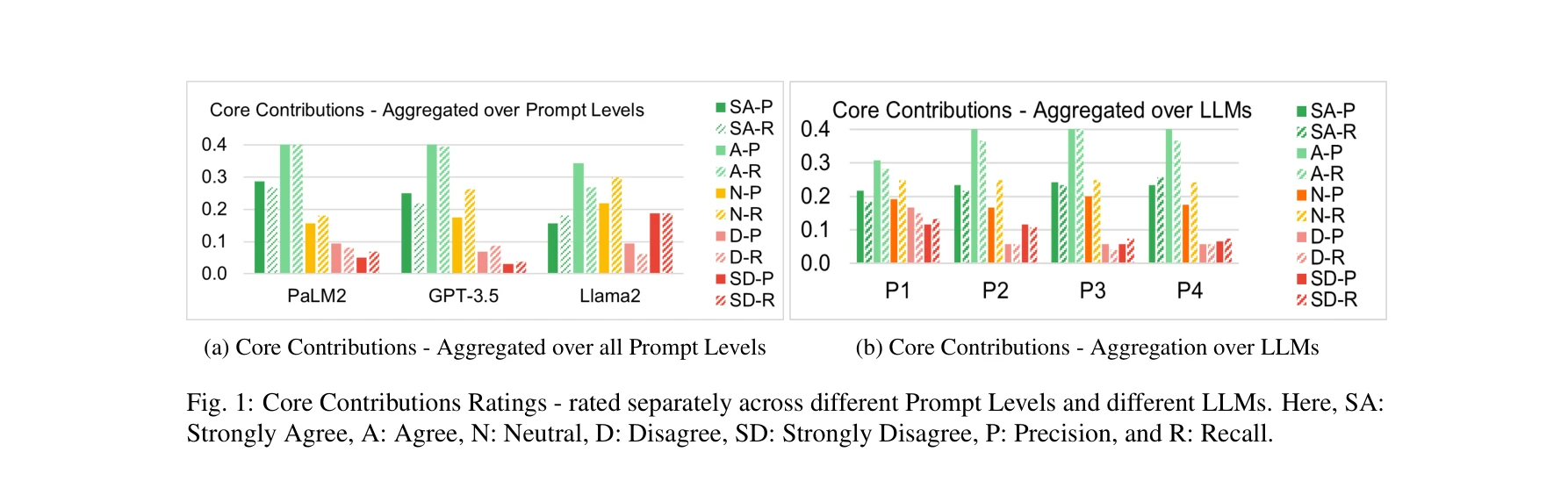

Fig. 1: Core Contributions Ratings - rated separately across different Prompt Levels and different LLMs. Here, SA:

*Fig. 4: Overall Rating aggregated over three LLMs and four Prompt Levels.* 본 논문은 LLM(GPT-3.5, PaLM2, LLaMA2)이 학술 논문의 피어 리뷰 의견들을 종합하여 메타리뷰 초안 작성을 지원할 수 있는지 연구한 사례 연구이다.

본 논문은 표준화된 프롬프팅 분류체계를 적용하여 메타리뷰 작성 지원 작업에 대한 LLM의 성능을 최초로 체계적으로 비교 분석했으며, 대규모 정성적 평가를 통해 LLM 자동 평가의 신뢰성 문제를 밝혀냈다는 점에서 학술 출판 프로세스 자동화 연구에 유의미한 기여를 한다.

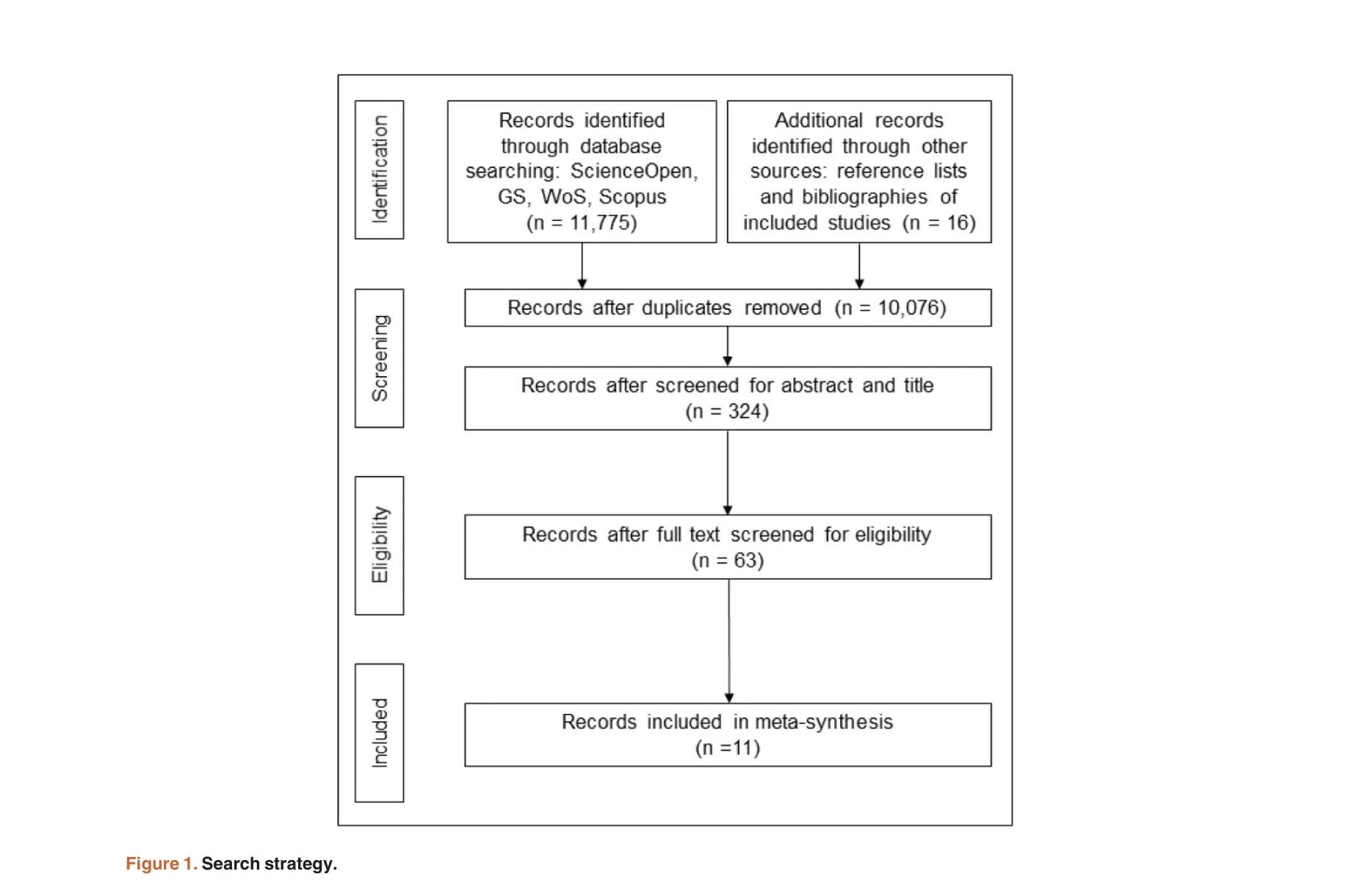

Discipline-specific open access publishing practices and barriers to change: an evidence-based review

지난 30년간 학술출판은 폐쇄형에서 개방형(OA, Open Access)으로 전환되었으나, 이러한 변화는 학문 분야별로 매우 불균등하게 나타나고 있다. 본 연구는 학문 분야별 OA 출판 관행의 차이와 변화의 장애 요인을 체계적으로 분석한다.

본 논문은 OA 출판의 학문 분야별 차이를 단순한 채택률 차이가 아닌 역사적·사회문화적 요인으로 체계적으로 분석한 점에서 학술출판 정책 입안에 중요한 기여를 한다. 다만 메타합성의 이질성과 심화된 메커니즘 분석이 부족한 점은 추후 연구의 과제이다.

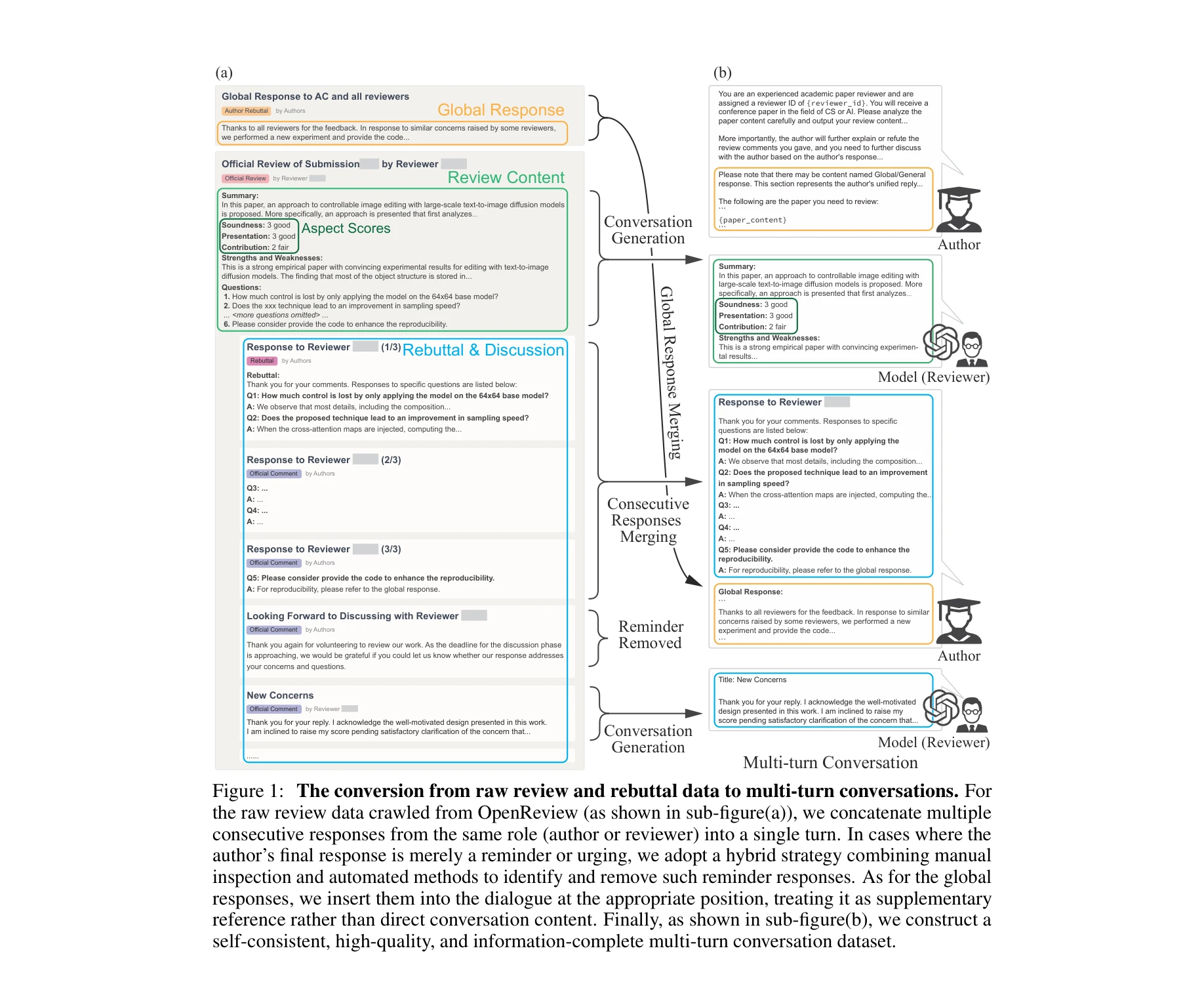

Re 2: A consistency-ensured dataset for full-stage peer review and multi-turn rebuttal discussions

본 논문은 OpenReview에서 수집한 24개 학술회의와 21개 워크숍의 19,926개 논문, 70,668개 리뷰 의견, 53,818개 재반박(rebuttal)으로 구성된 Re2 데이터셋을 제시하며, 일관성이 보장된 피어리뷰 데이터를 통해 대언어모델(LLM)의 리뷰 및 재반박 능력을 향상시키고자 한다.

Re2는 기존 피어리뷰 데이터셋의 다양성, 일관성, 기능성 문제를 체계적으로 해결한 의미 있는 자원 기여이며, 특히 초기 제출 버전 보증과 다중 턴 재반박 구조화는 향후 LLM 기반 리뷰 시스템 개발에 실질적 가치를 제공할 것으로 기대된다.

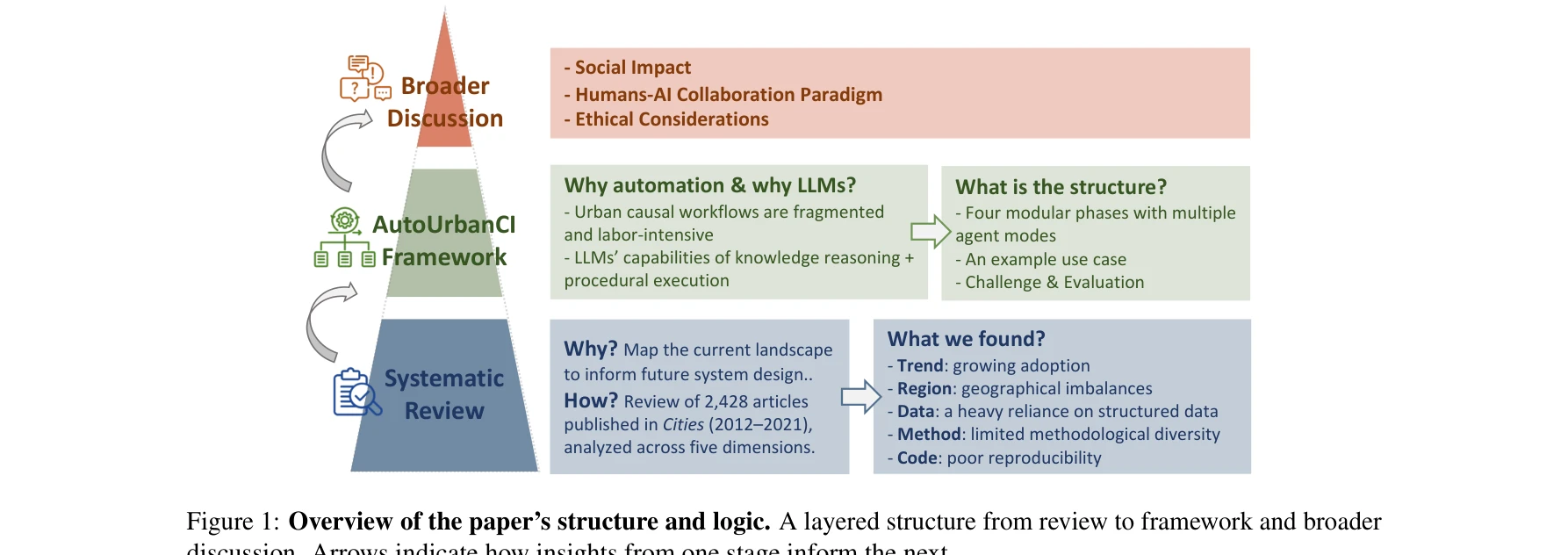

Reimagining urban science: Scaling causal inference with large language models

논문의 구조적 논리: 현황 검토에서 프레임워크, 그리고 광범위한 논의로 진행되는 계층적 구조

*논문의 구조적 논리: 현황 검토에서 프레임워크, 그리고 광범위한 논의로 진행되는 계층적 구조* 본 논문은 대규모 언어모델(LLM)을 활용하여 도시 인과 추론(Urban Causal Inference) 연구의 자동화와 확장성을 달성하는 UrbanCIA 프레임워크를 제시한다. 이를 통해 가설 생성부터 정책 해석까지 전체 도시과학 연구 파이프라인을 지능형 멀티에이전트 시스템으로 재구성하고자 한다.

본 논문은 도시 인과 연구의 현황을 첫 대규모로 진단하고, LLM 기반 멀티에이전트 시스템으로 전체 인과 추론 파이프라인 자동화라는 야심찬 비전을 제시한다는 점에서 매우 의미 있다. 특히 지역 불균형, 구조화 데이터 과의존, 낮은 재현성 등 도시과학의 실제 문제를 정량화하고 기술적 솔루션을 제안한 점이 강점이다. 다만 개념적 프레임워크에 치중되어 있으며, 실제 구현, 실증적 검증, LLM의 환각과 편향 제어 방안이 구체적으로 제시되지 않아 기술적 건전성에서 개선 여지가 있다. 향후 프로토타입 구현과 다양한 도시 사례 검증이 논문의 주장을 강화할 것으로 기대된다.

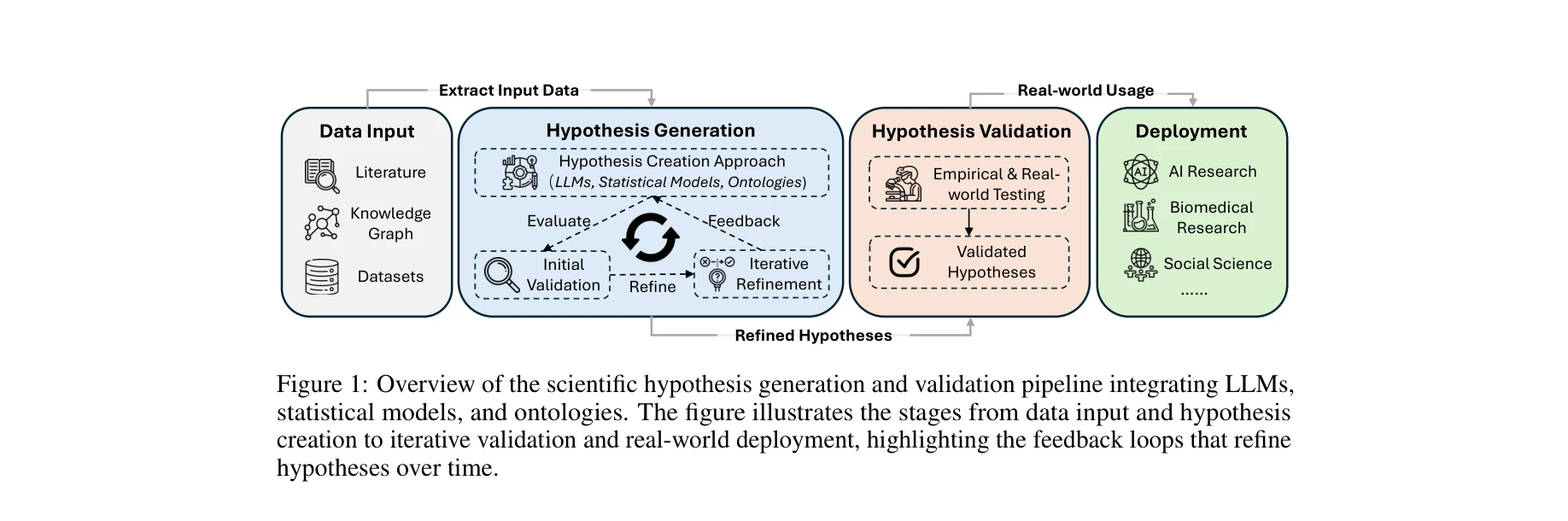

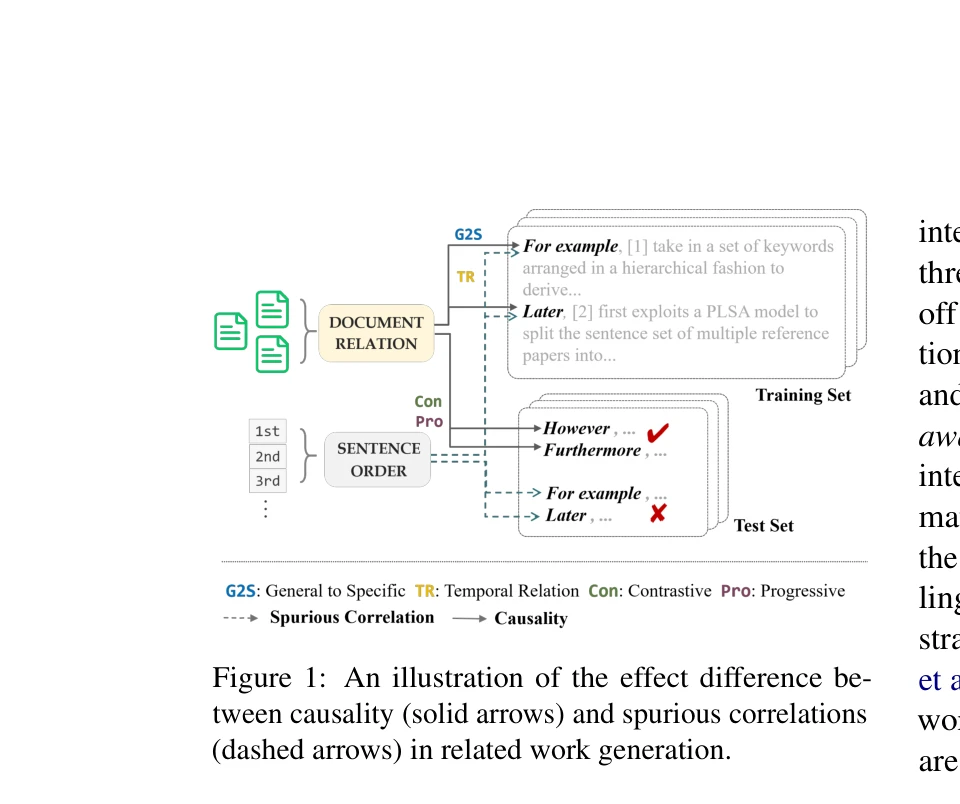

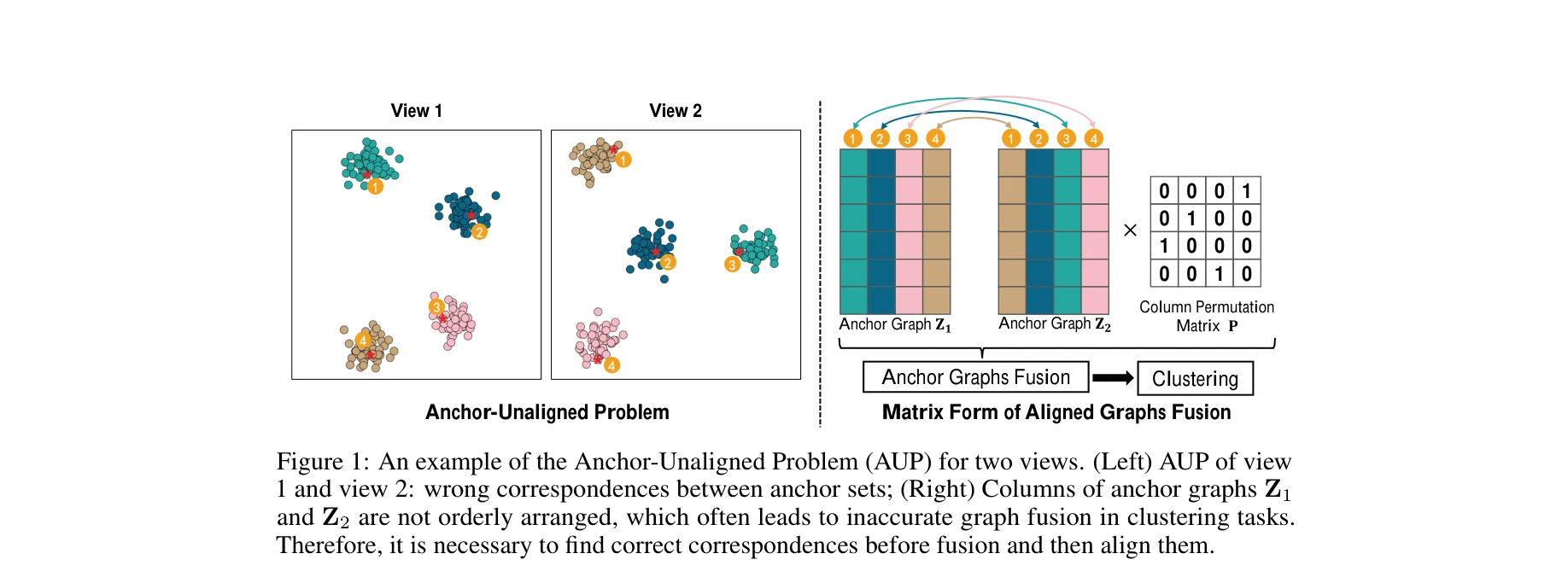

Scientific Hypothesis Generation and Validation: Methods, Datasets, and Future Directions

과학적 가설 생성 및 검증 파이프라인: LLM, 통계 모델, 온톨로지를 통합하는 데이터 입력에서 반복적 검증 및 실제 배포까지의 단계를 보여줌

*과학적 가설 생성 및 검증 파이프라인: LLM, 통계 모델, 온톨로지를 통합하는 데이터 입력에서 반복적 검증 및 실제 배포까지의 단계를 보여줌* 본 논문은 대규모 언어모델(LLM)을 활용한 과학적 가설 생성 및 검증의 체계적 종합 분석을 제시하며, 부호화 프레임워크부터 현대적 LLM 파이프라인까지 진화 과정을 추적하고 생물의학, 재료과학, 환경과학 등 다양한 도메인에서의 적용을 통합적으로 조망한다.

본 논문은 LLM 기반 과학적 가설 생성·검증의 현재 상태를 포괄적으로 정리한 중요한 설문이지만, 참신성 측정, 검증 비용-효과 분석, 윤리 구현의 구체화 측면에서 학문적 깊이를 보강할 필요가 있다. 실무 관점에서는 도메인별 성숙도 격차 완화와 인간-루프 시스템의 인지적 설계 원칙이 향후 연구의 중요한 과제이다.

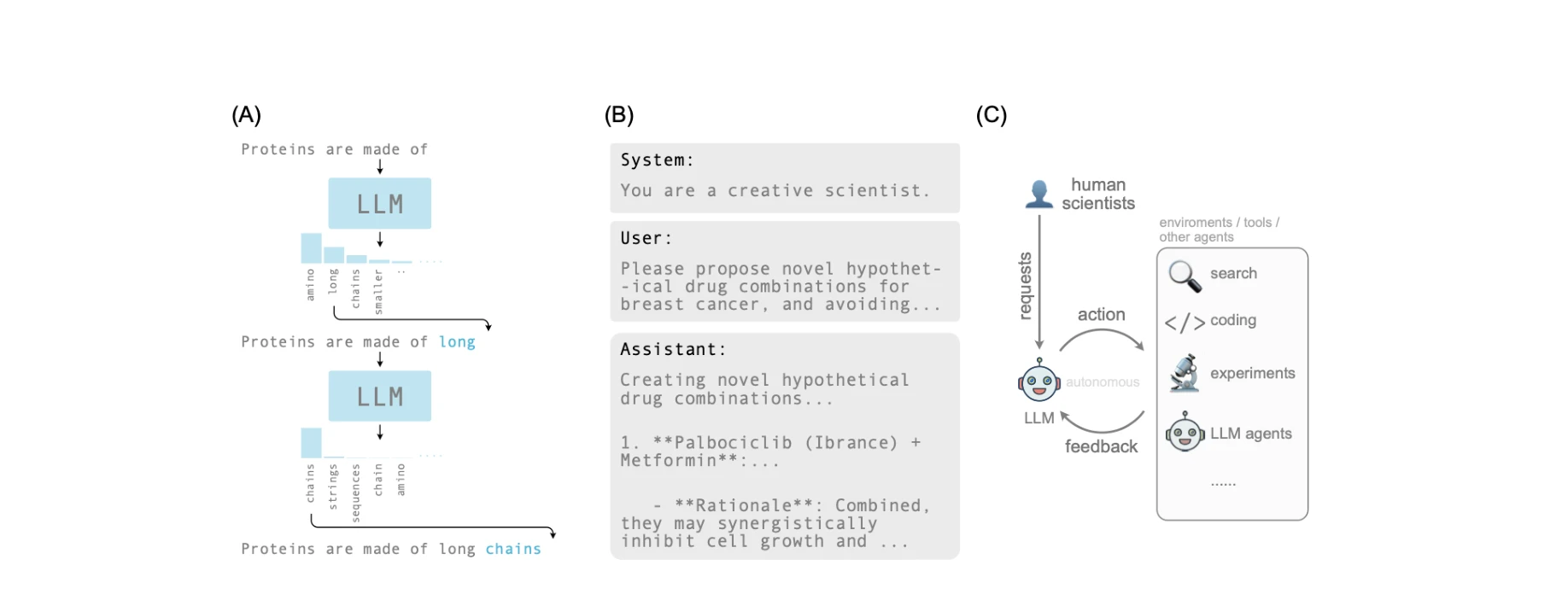

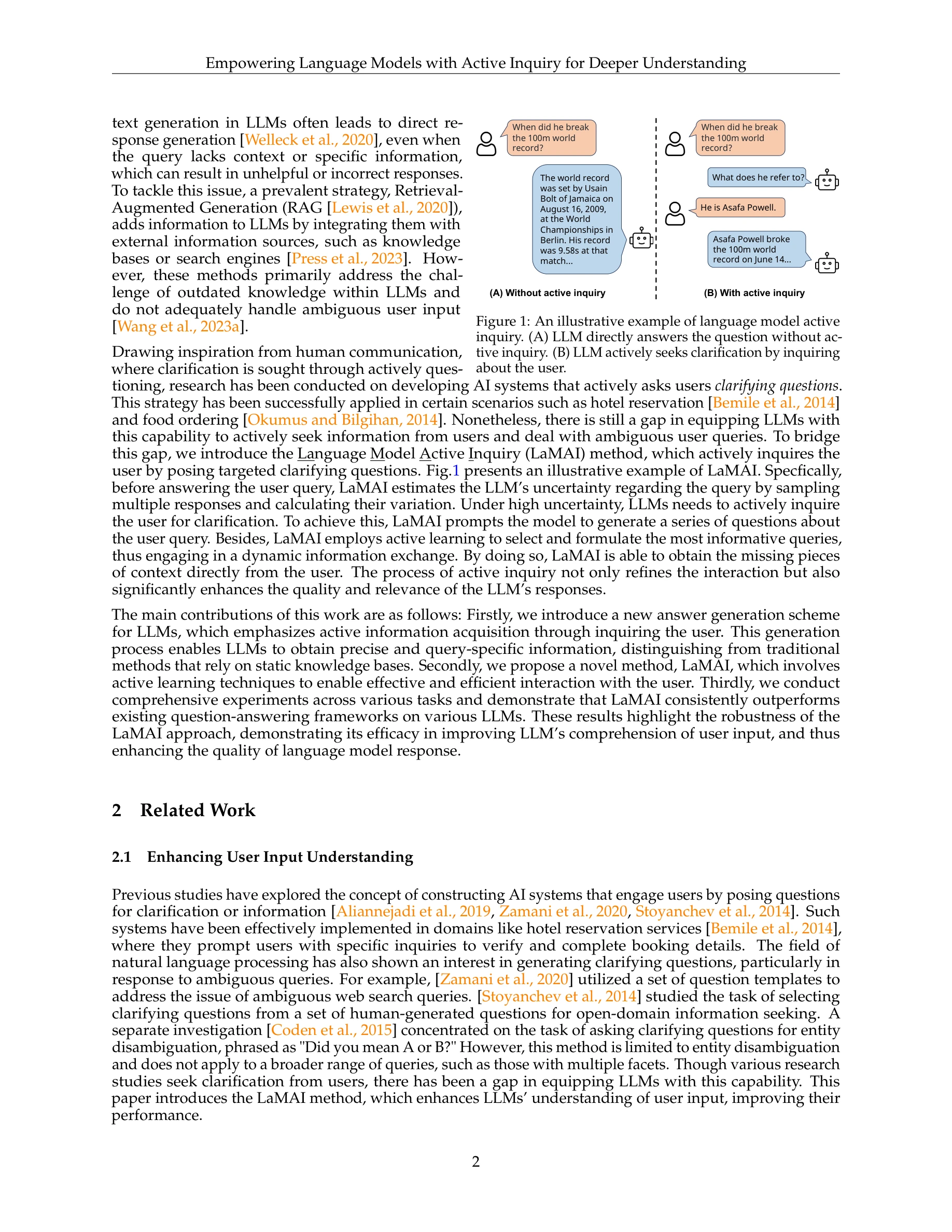

Advancing the scientific method with large language models: From hypothesis to discovery

*LLM의 기본 작동 원리: (A) 토큰의 자동회귀적 생성, (B) 프롬프트 구조, (C) LLM 에이전트 시스템* 대규모 언어모델(LLM)이 과학 연구의 각 단계에서 생산성 향상과 과학적 발견을 지원하는 도구로서 변화하는 과학 방법론을 재정의하고 있으며, 이를 효과적으로 활용하기 위해서는 인간 과학자와의 협력 및 명확한 평가 지표가 필수적이다.

본 논문은 LLM이 과학 연구의 생산성 도구에서 창의적 엔진으로 진화할 수 있는 가능성을 제시하는 중요한 관점을 제공하지만, 현실적 한계(할루시네이션, 기초 과학 기여도 제한)에 대한 구체적 해결책 제시와 실증적 검증이 보강되어야 할 것으로 보인다.

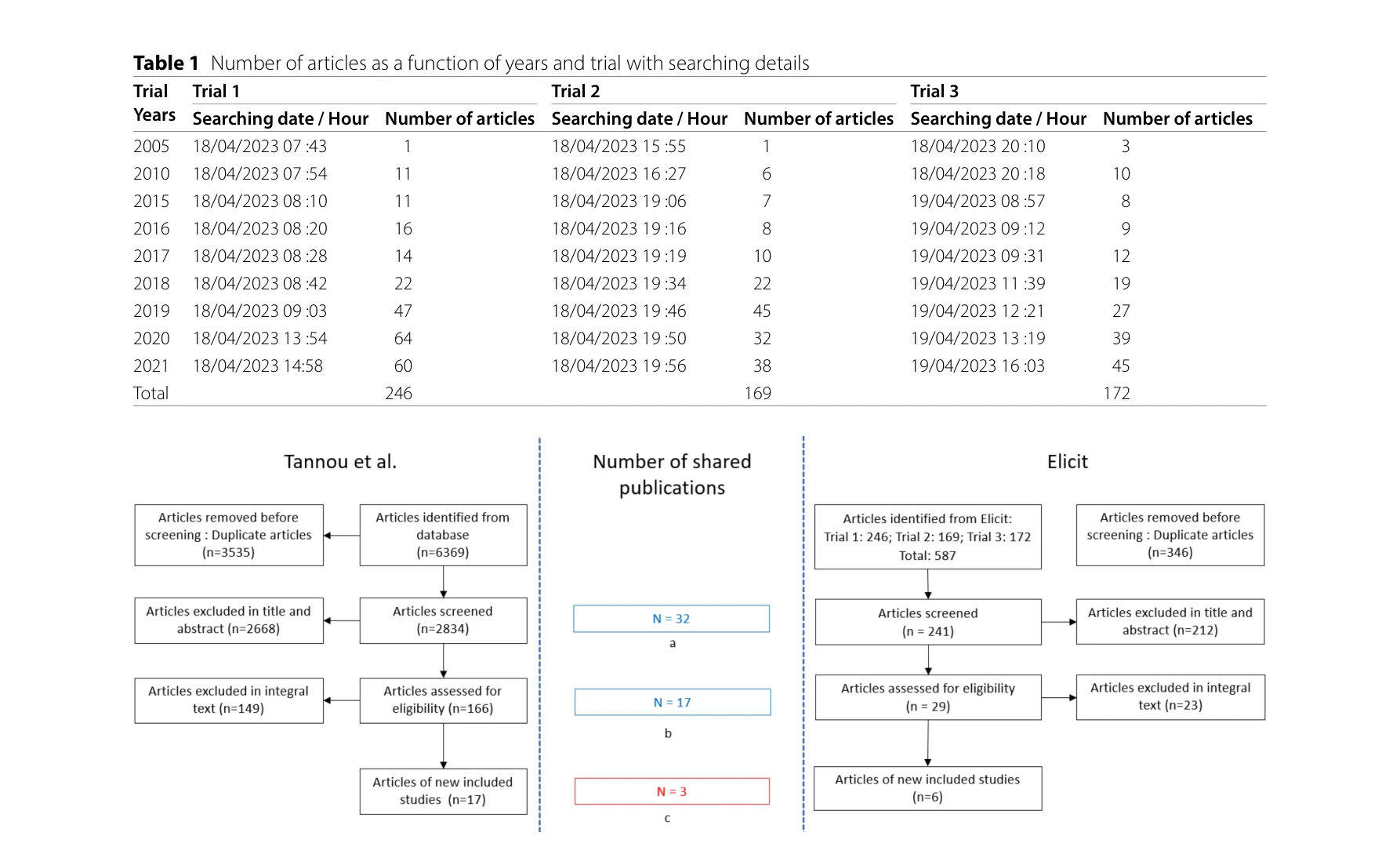

Using artificial intelligence for systematic review: the example of elicit

Elicit는 체계적 문헌고찰(systematic review) 과정에서 보조 도구로 사용될 수 있으나, 아직까지는 전통적 방법을 완전히 대체하지 못하며 신중한 사용과 방법론적 엄격성 유지가 필수적이다.

체계적 문헌고찰에서 AI 도구 Elicit의 실제 성능을 실증적으로 평가한 의미 있는 연구이지만, 방법론적 견고성과 일반화 가능성이 제한적이며, "신중한 보조 도구로 사용하되 완전 대체 불가"라는 예상된 결론을 확인한 수준이다. AI 도구 개발의 빠른 진전을 고려할 때 정기적인 재평가와 더욱 체계적인 벤치마킹 연구가 필요하다.

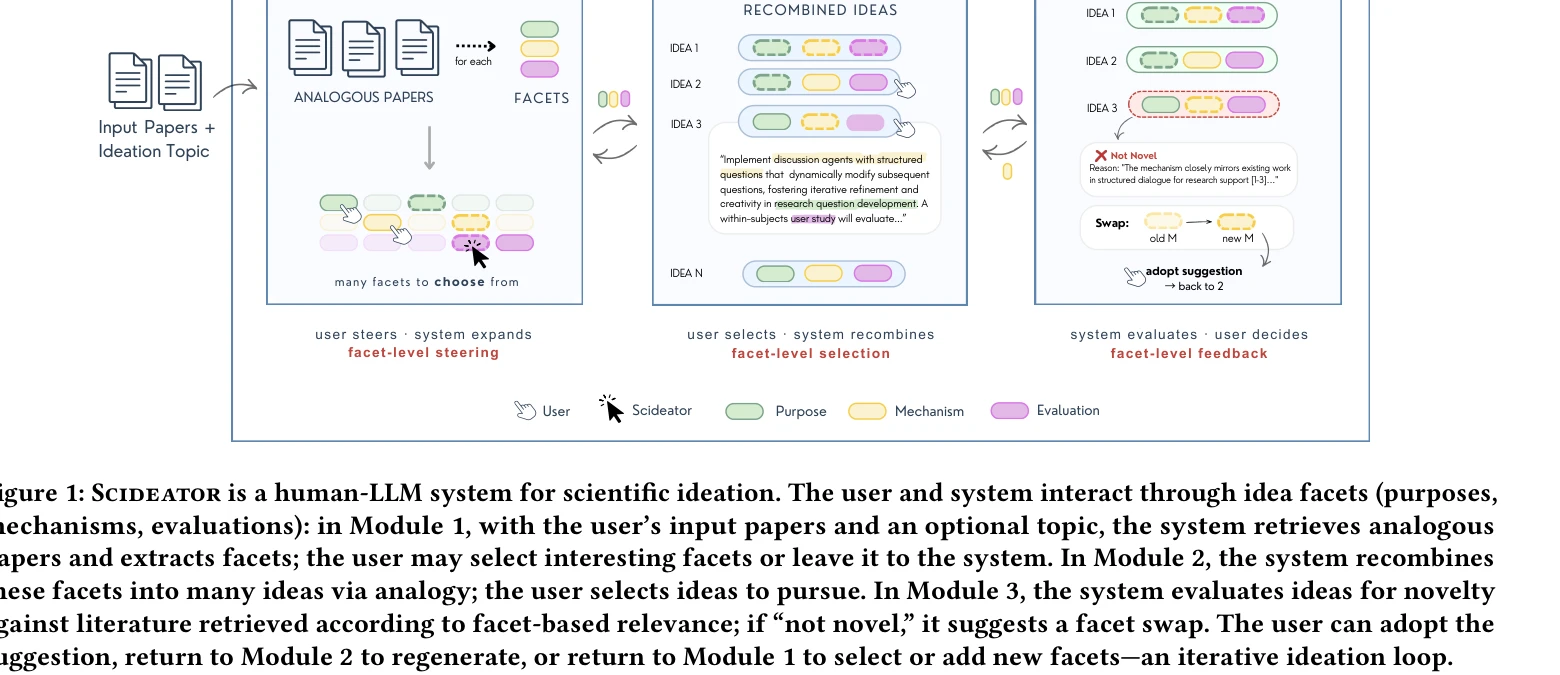

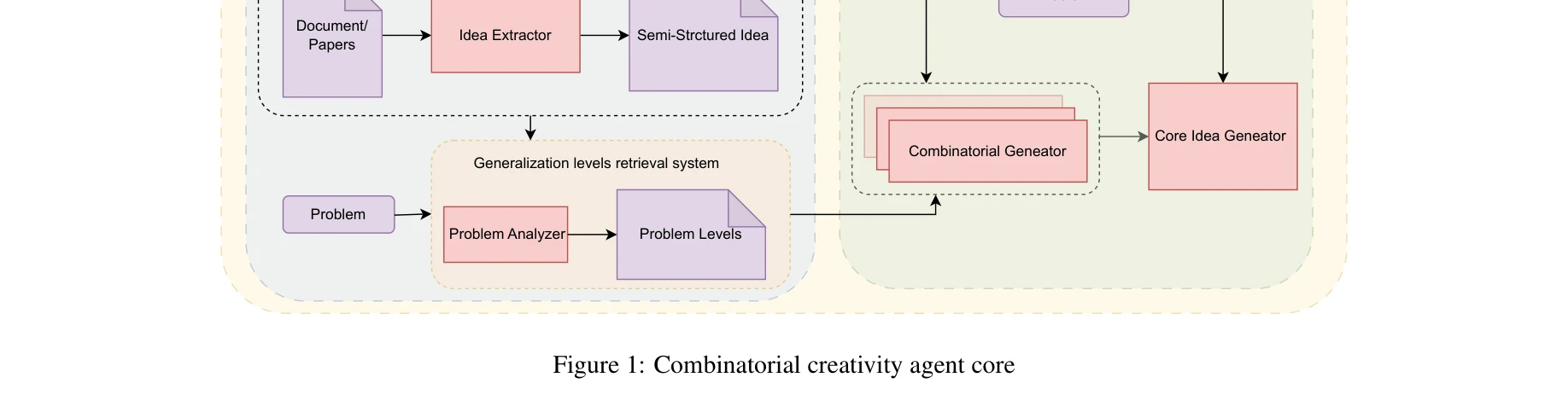

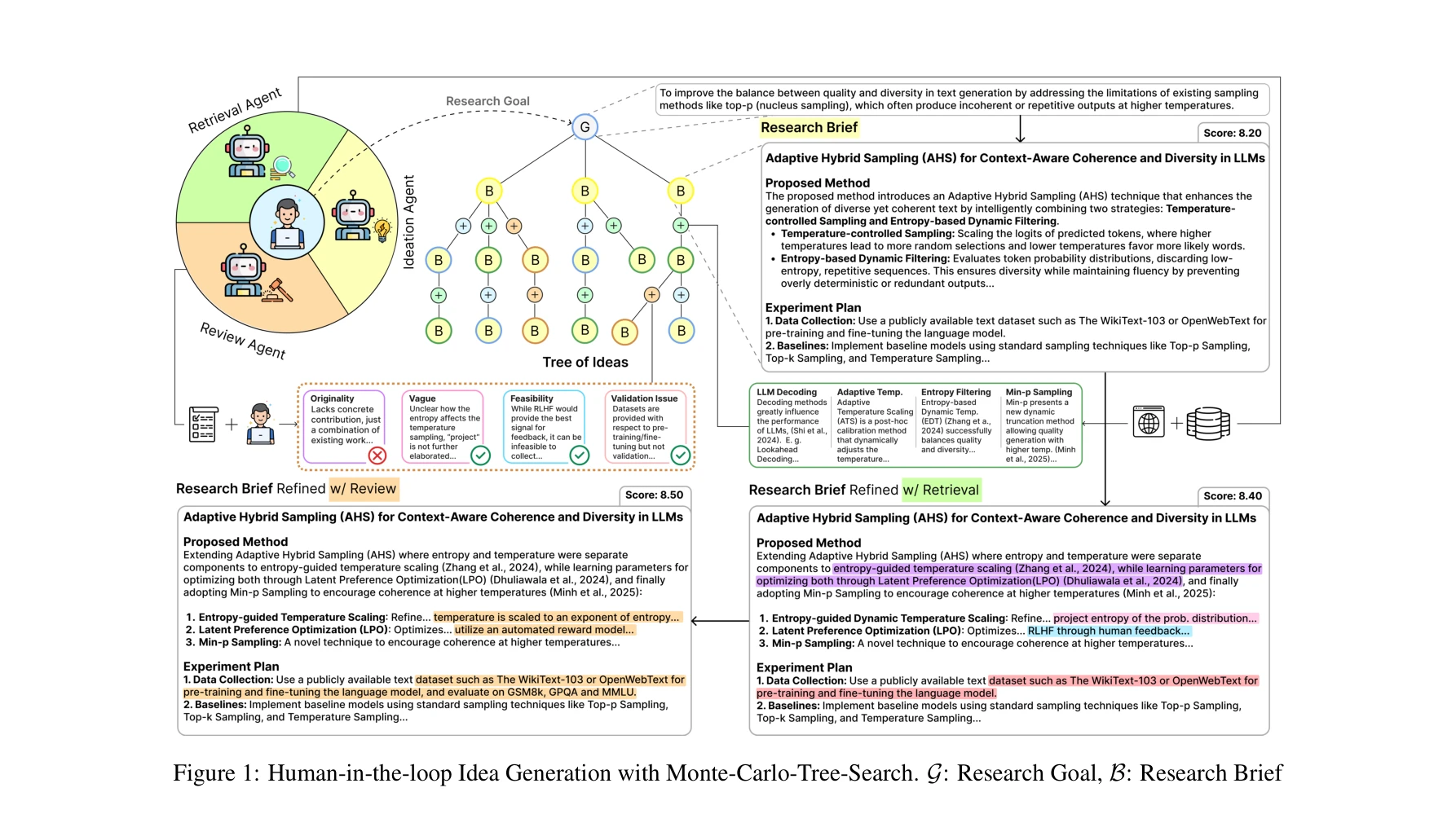

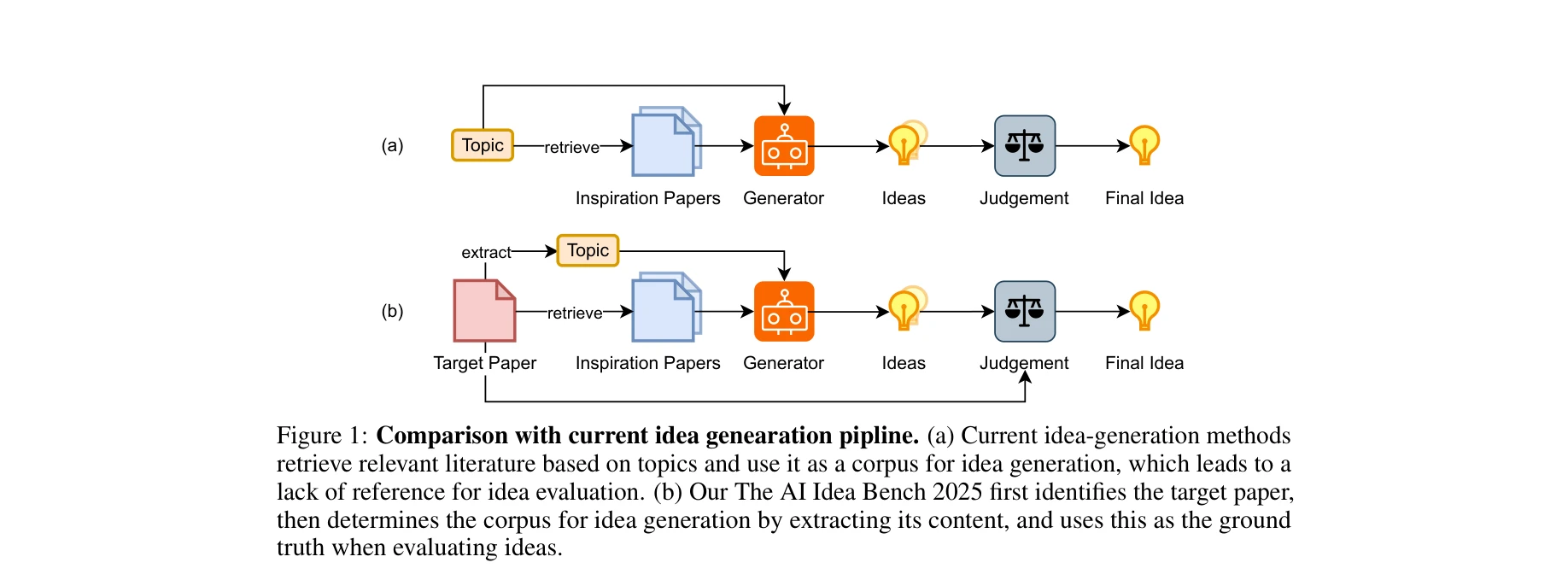

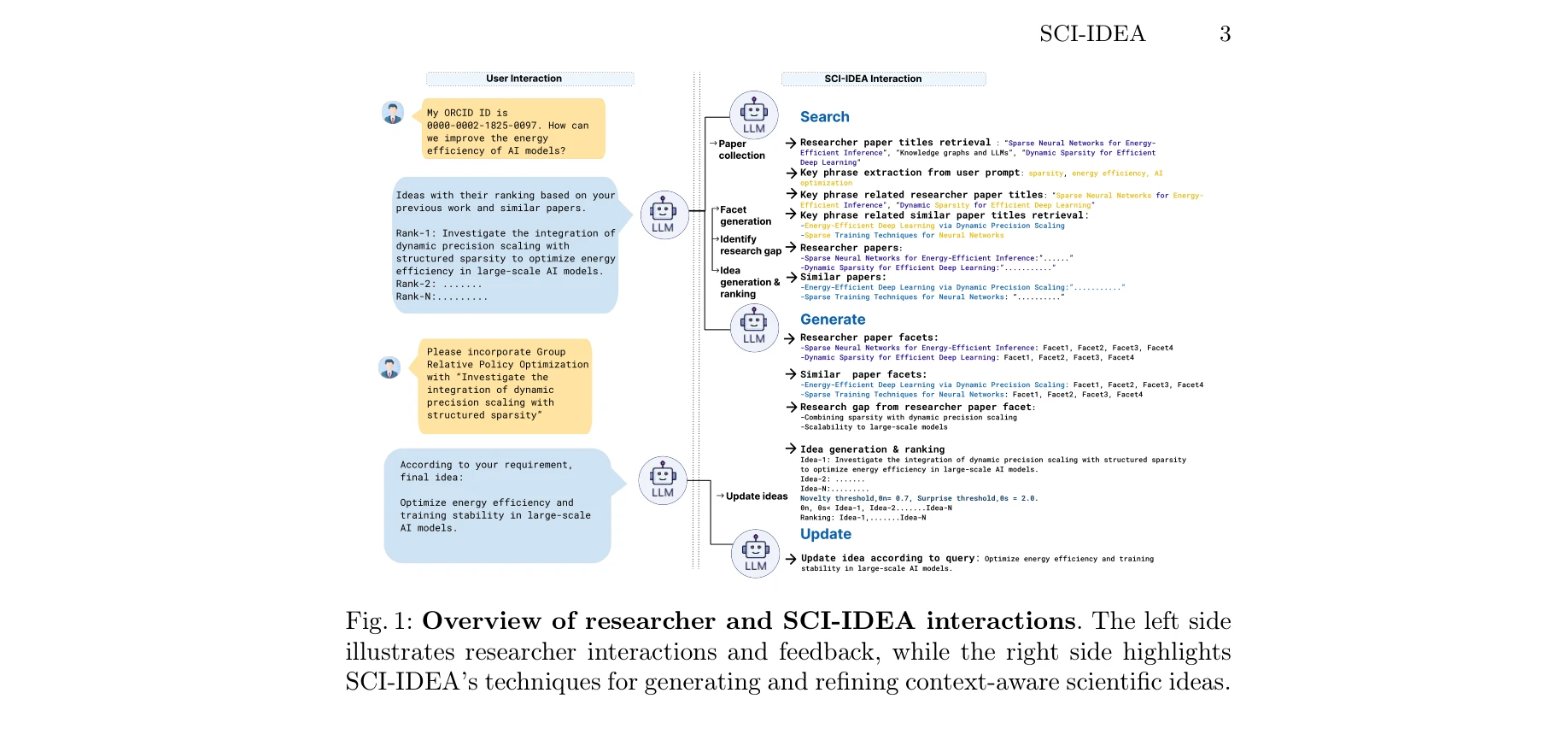

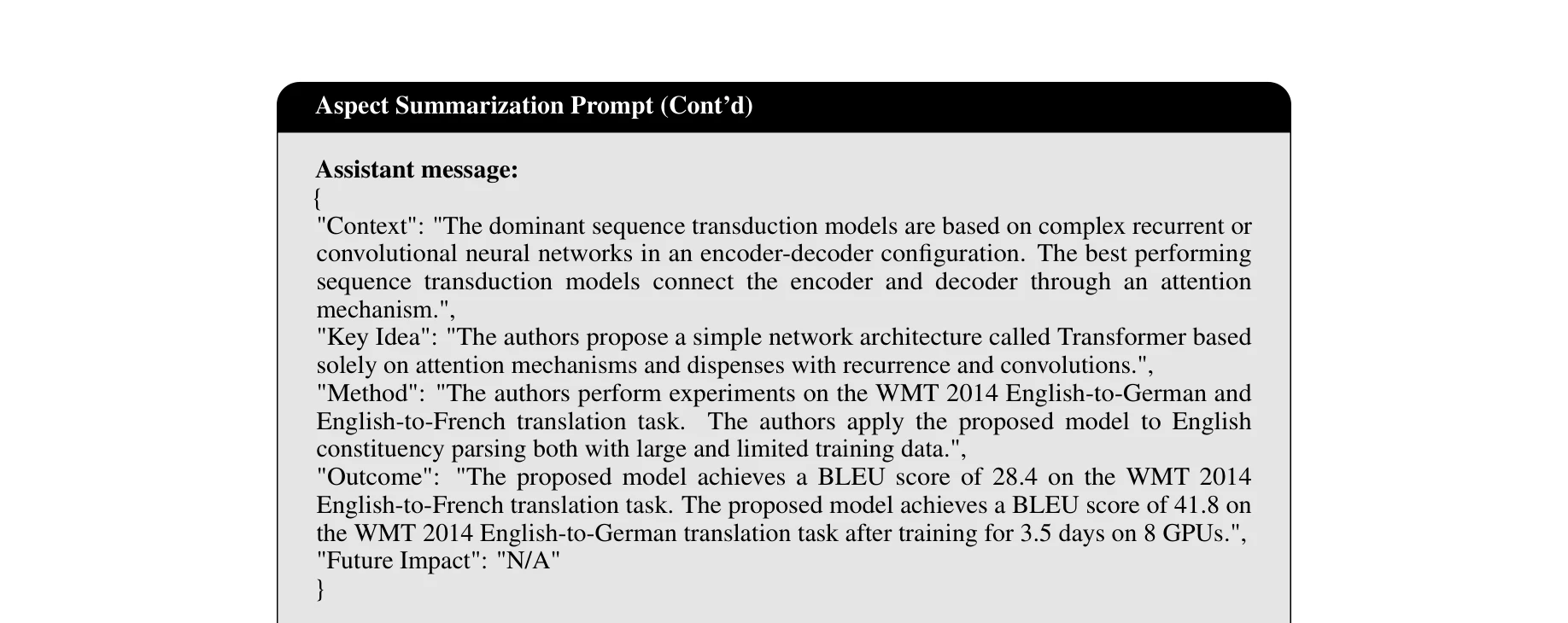

Scideator: Human-LLM scientific idea generation grounded in research-paper facet recombination

Scideator의 인터페이스: 사용자와 시스템이 논문의 핵심 요소(목적, 메커니즘, 평가)를 중심으로 상호작용하며 아이디어를 재조합하는 과정

*Scideator의 인터페이스: 사용자와 시스템이 논문의 핵심 요소(목적, 메커니즘, 평가)를 중심으로 상호작용하며 아이디어를 재조합하는 과정* 과학 논문 작성에서 기존 연구의 핵심 측면들을 새로운 방식으로 결합하여 창의적 아이디어를 생성하는 것을 지원하는 사람-LLM 협력 시스템이다. 사용자가 선택한 논문들로부터 추출된 구조화된 요소(목적·메커니즘·평가)를 대화형으로 재조합하여 새로운 연구 아이디어를 탐색하도록 설계되었다.

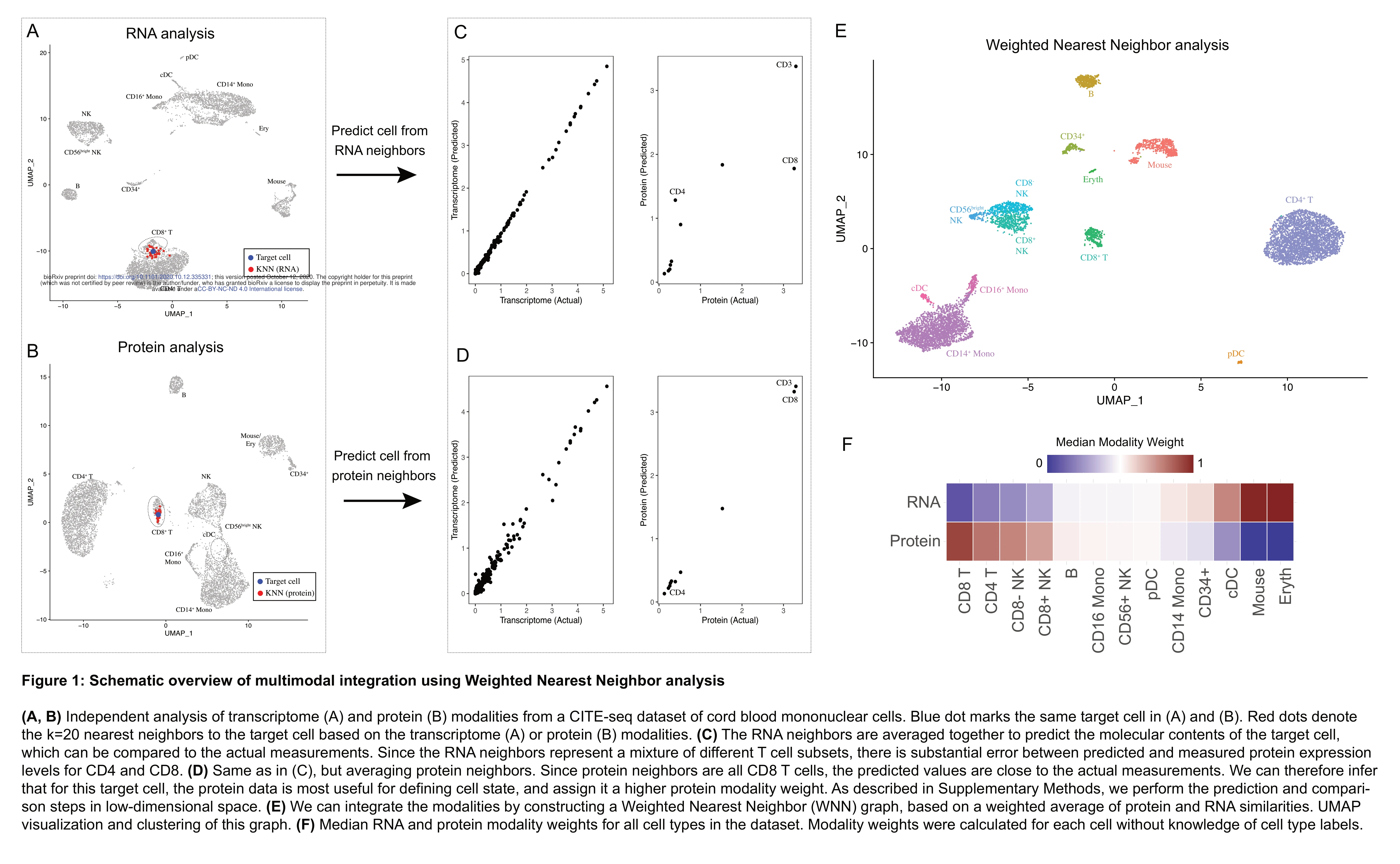

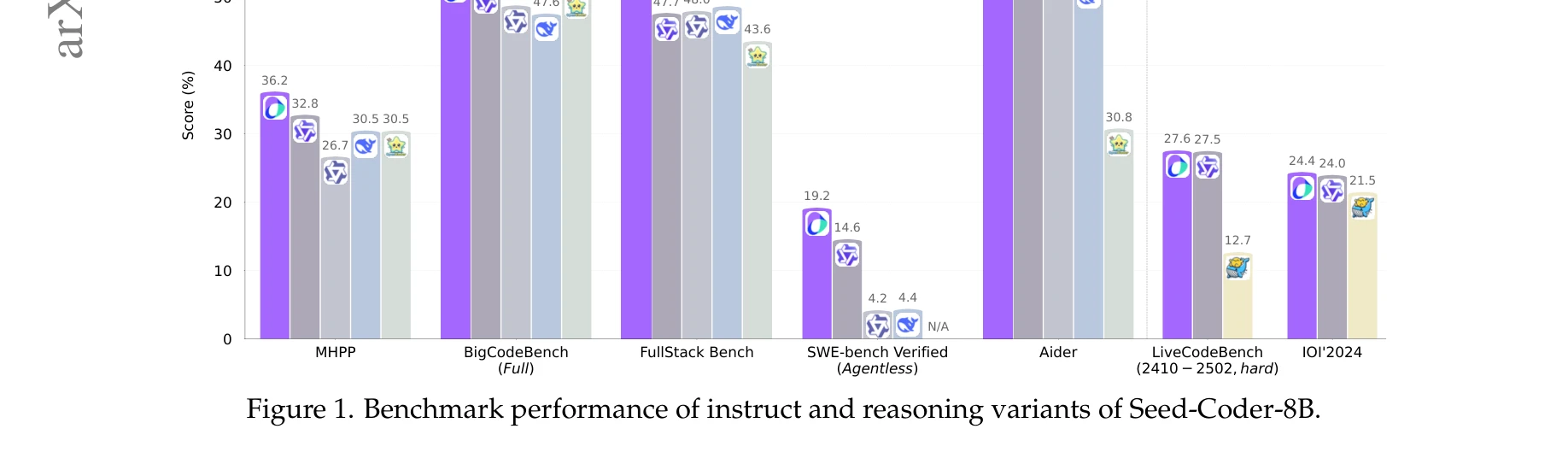

Integrated analysis of multimodal single-cell data

단일세포 수준에서 여러 데이터 유형(RNA, 단백질 등)을 동시에 측정한 멀티모달 데이터를 통합 분석하기 위해 가중 최근접 이웃(Weighted-Nearest Neighbor, WNN) 방법론을 개발했다. 이를 통해 세포 상태를 더욱 정확하게 정의하고 이전에 미발견된 면역세포 아형들을 발견할 수 있음을 보여준다.

WNN 방법론은 멀티모달 단일세포 데이터 분석의 실질적 문제를 우아하게 해결하는 기여이며, 대규모 PBMC 아틀라스 구축과 COVID-19 응용을 통해 임상적 가치까지 입증한 의미있는 연구이다. 다만 파라미터 최적화와 3개 이상 모달리티 확장에 대한 보완이 필요하다.

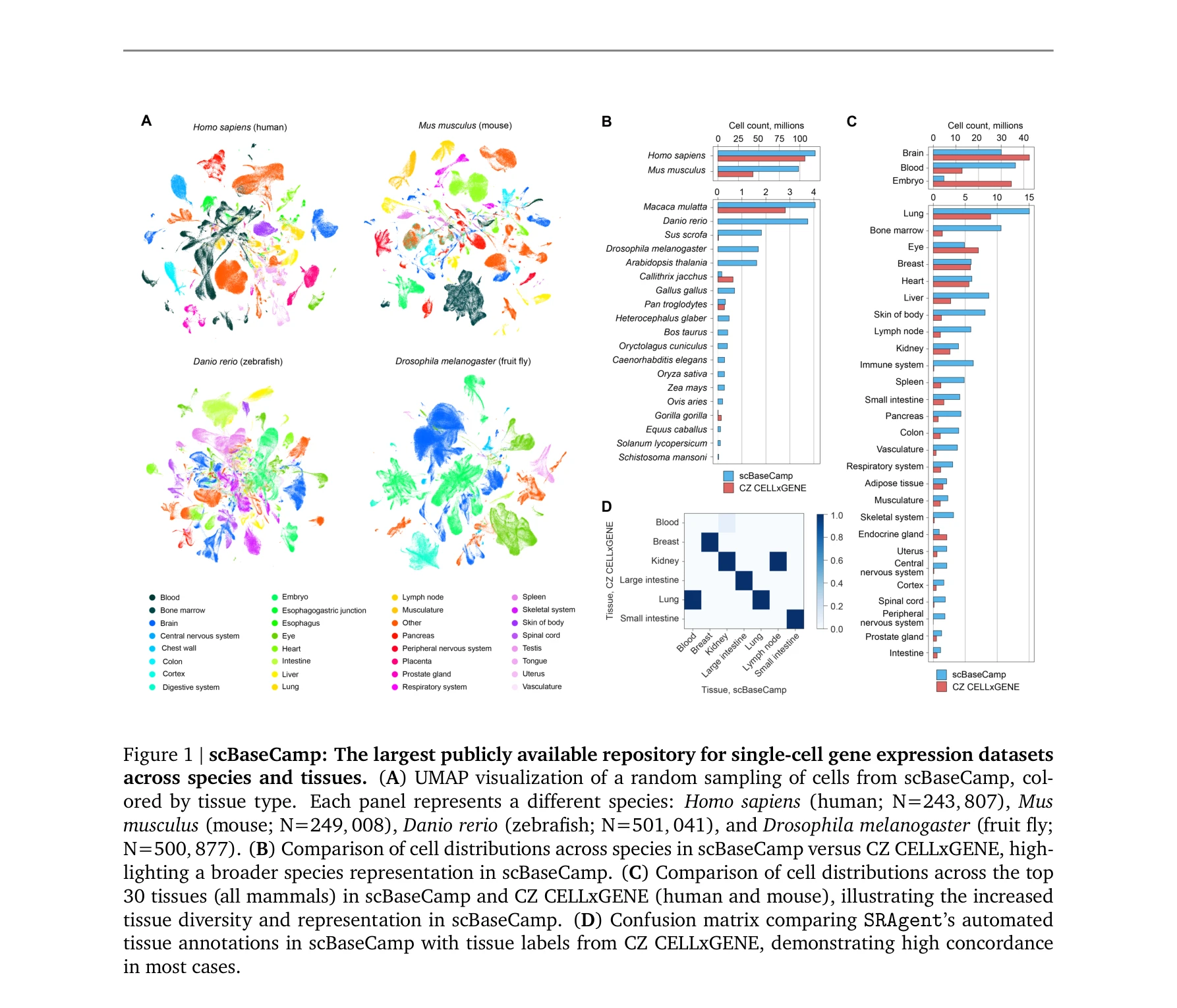

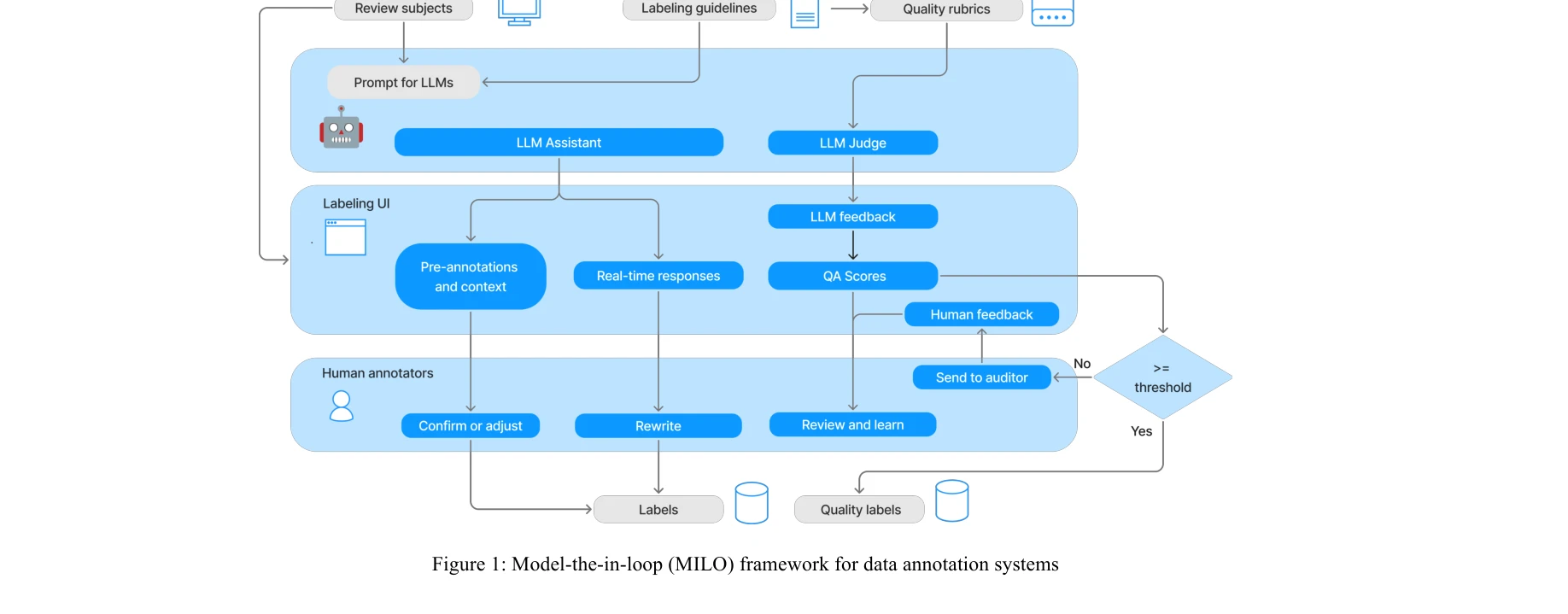

scBaseCamp: an AI agent-curated, uniformly processed, and autonomously updated single cell data repository

scBaseCamp은 종(species)과 조직(tissue)에 걸쳐 2억 3천만 개 이상의 세포를 포함하는 가장 큰 공개 단일 세포 유전자 발현 데이터셋 저장소이다.

*scBaseCamp은 종(species)과 조직(tissue)에 걸쳐 2억 3천만 개 이상의 세포를 포함하는 가장 큰 공개 단일 세포 유전자 발현 데이터셋 저장소이다.* AI 에이전트 기반의 자동화된 워크플로우를 통해 공개 10X Genomics 단일세포 RNA 시퀀싱 데이터를 발굴하고 표준화된 방식으로 처리하여, 가장 규모가 크고 다양한 단일세포 데이터 저장소 scBaseCamp를 구축했다. 이는 AI 기반 가상세포 모델 개발을 위한 훈련 데이터로 활용될 수 있으며, 데이터 처리 파이프라인의 표준화를 통해 분석 아티팩트를 최소화한다.

scBaseCamp는 AI 에이전트 기반 자동화 및 표준화된 대규모 재처리를 통해 단일세포 생물학과 AI 모델 개발을 위한 획기적인 자원을 제공하며, 지속적 확장 메커니즘은 이 분야의 향후 발전을 크게 가속화할 것으로 예상된다. 다만 기술적 세부사항과 정량적 검증 데이터의 보강이 필요하다.

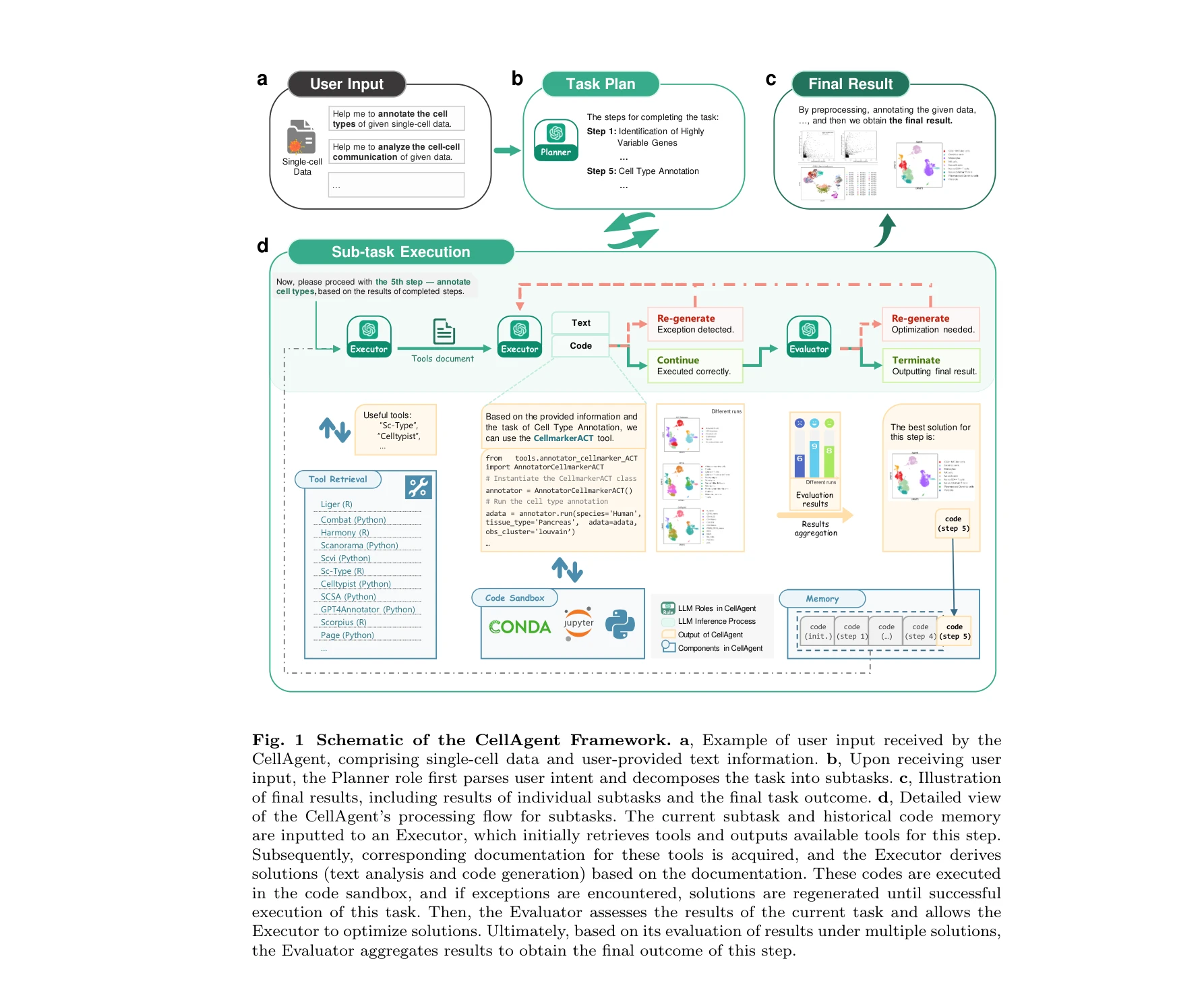

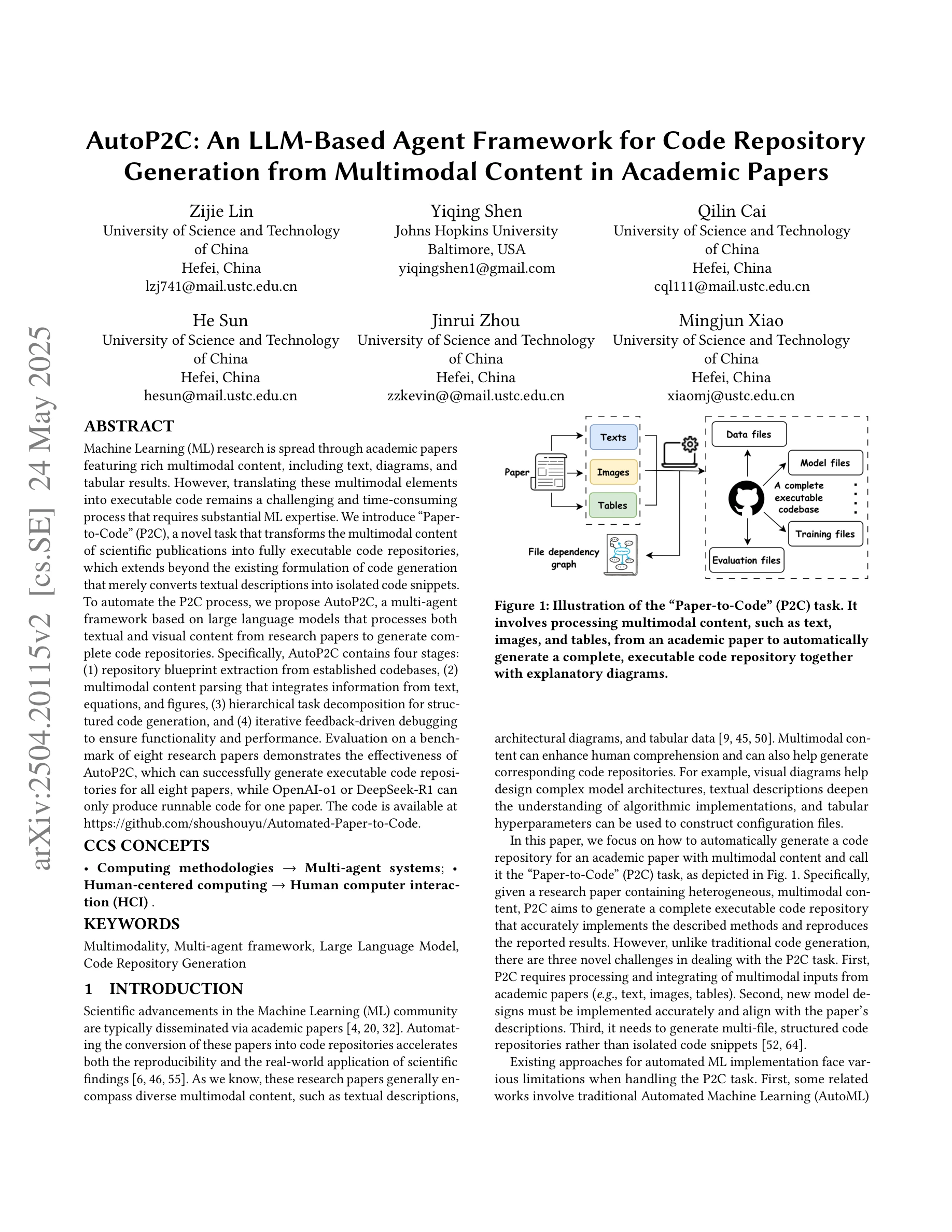

CellAgent: An LLM-driven Multi-Agent Framework for Automated Single-cell Data Analysis

CellAgent의 다중 에이전트 협업 워크플로우: (a) 사용자 입력, (b) 작업 분해, (c) 세부 실행 및 최적화, (d) 최종 결과 생성 과정

대규모 언어모델(LLM)을 기반으로 한 다중 에이전트 프레임워크인 CellAgent를 제안하여, 단일세포 RNA 염기서열 분석(scRNA-seq) 작업을 자동으로 수행하고 인간의 개입 없이 고품질의 분석 결과를 제공한다. 복잡한 생물정보학 분석 워크플로우의 자동화를 통해 생물학 연구자의 기술적 진입장벽을 크게 낮춘다.

CellAgent는 대규모 언어모델을 생물정보학 자동화에 적용한 혁신적 시도로, 계층적 의사결정과 자기반복 최적화 메커니즘을 통해 실제 과학 데이터 분석의 자동화를 가능하게 한다. 다중 에이전트 협업 프레임워크의 설계가 우수하며 종합적인 평가가 이루어졌으나, 도구 확장성과 미세한 오류 처리에서는 개선의 여지가 있다.

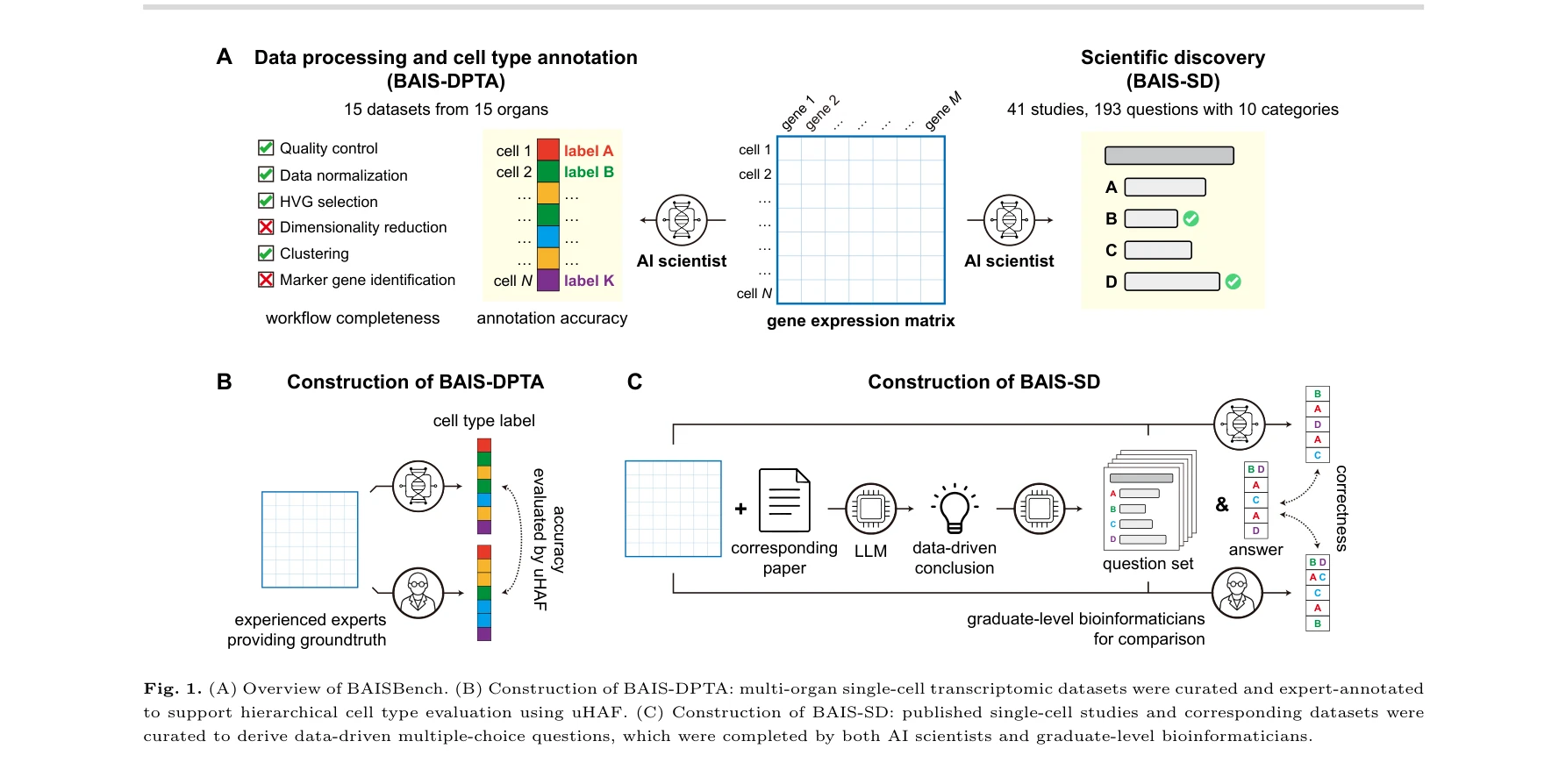

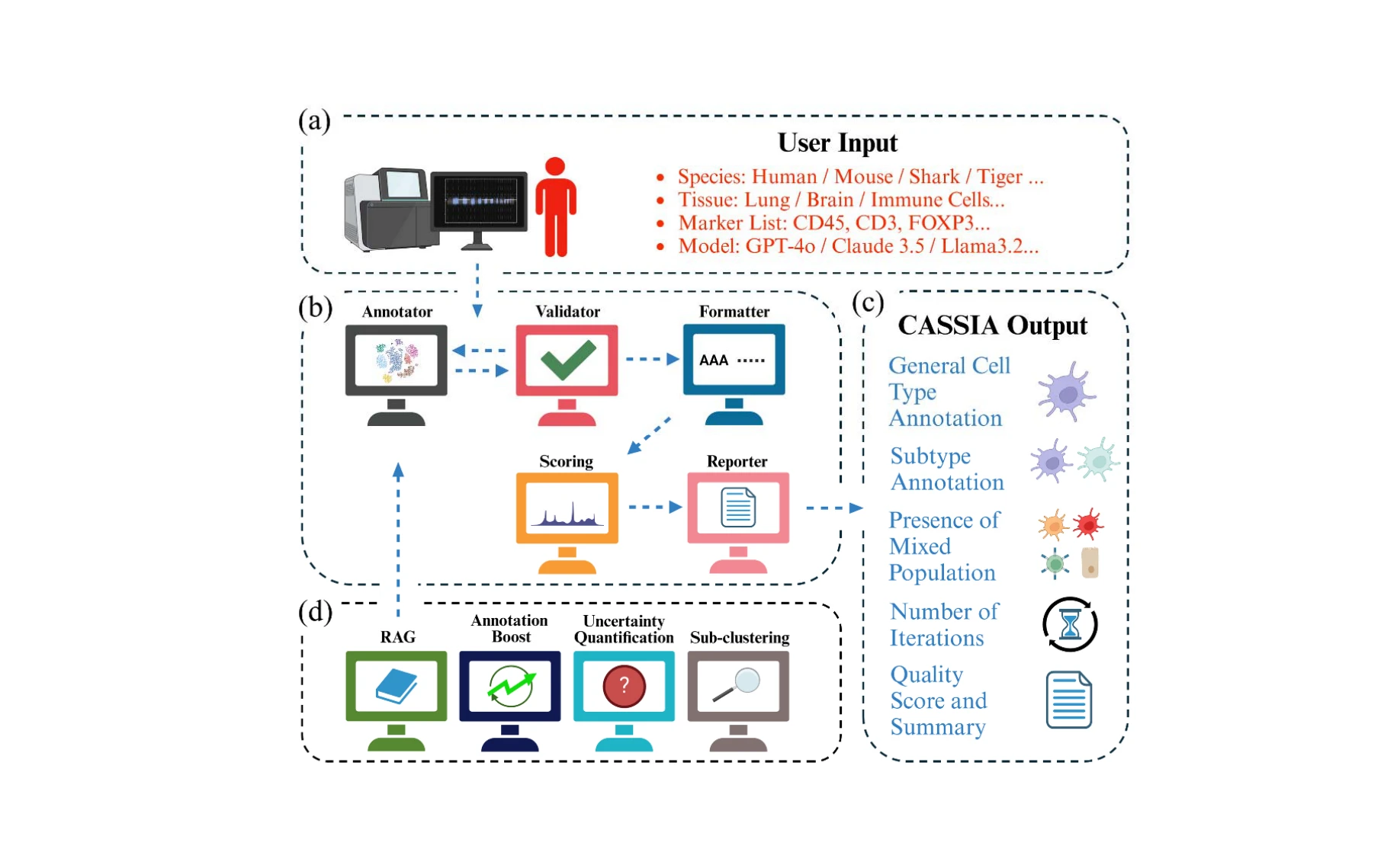

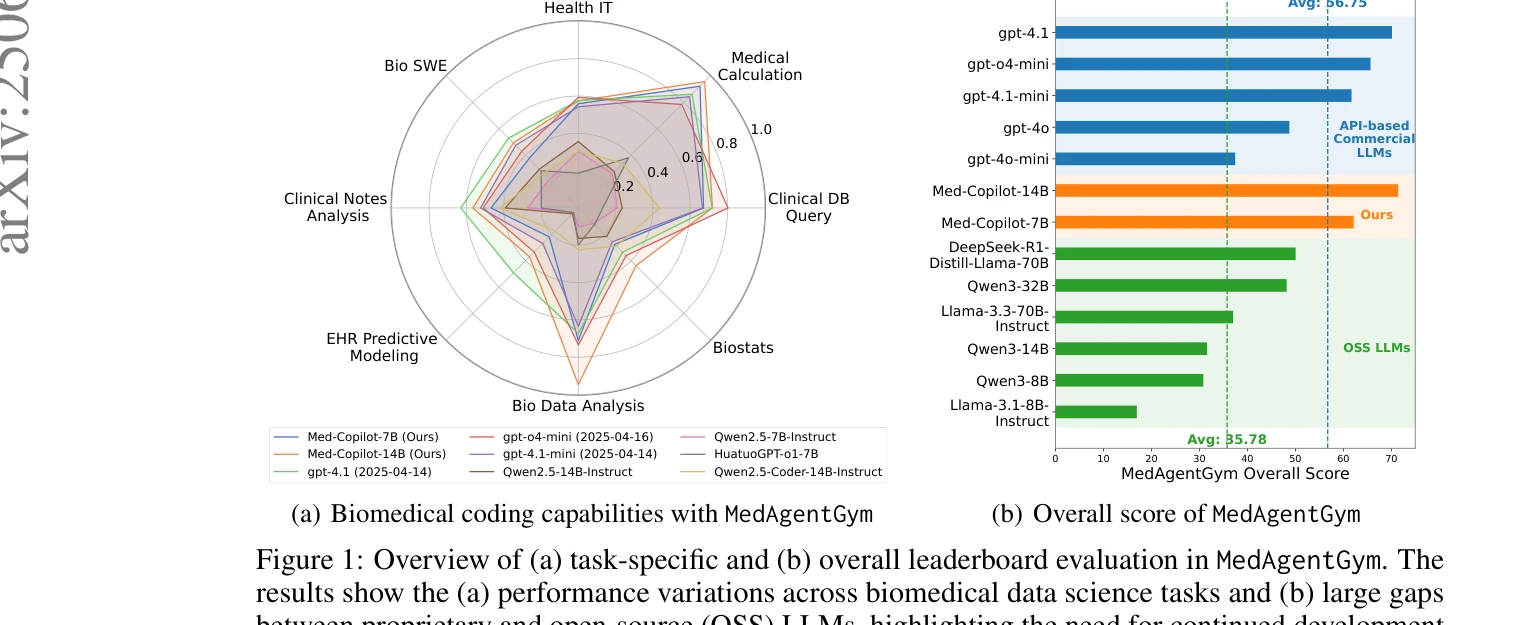

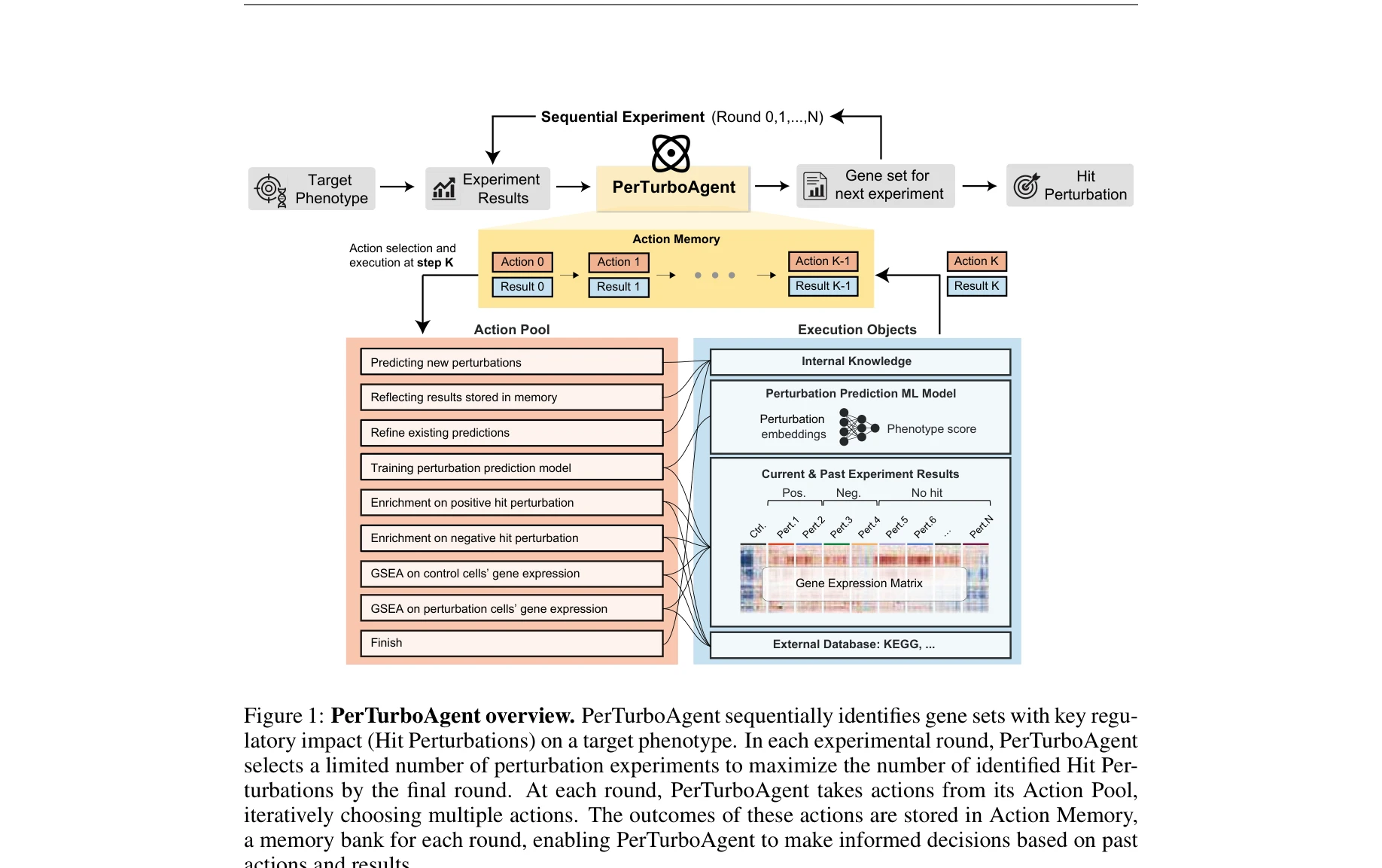

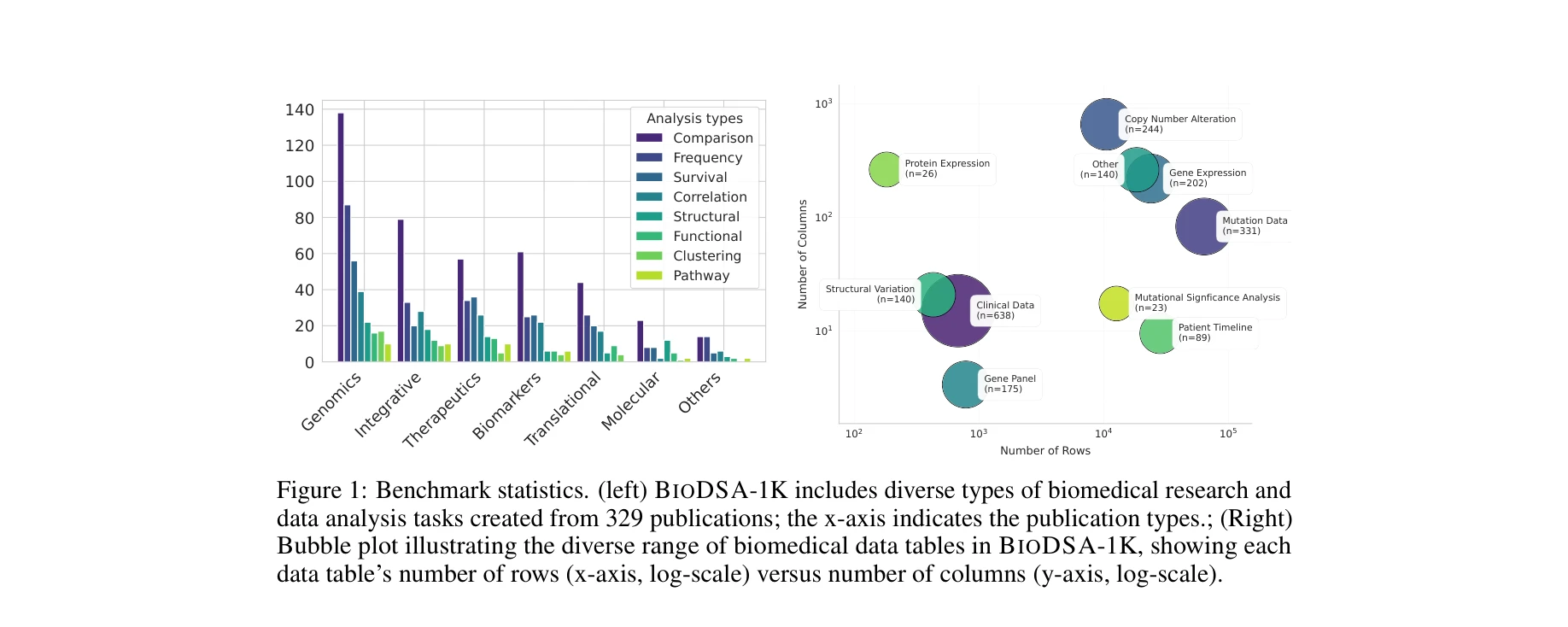

Benchmarking AI Scientists in Omics Data-Driven Biological Research

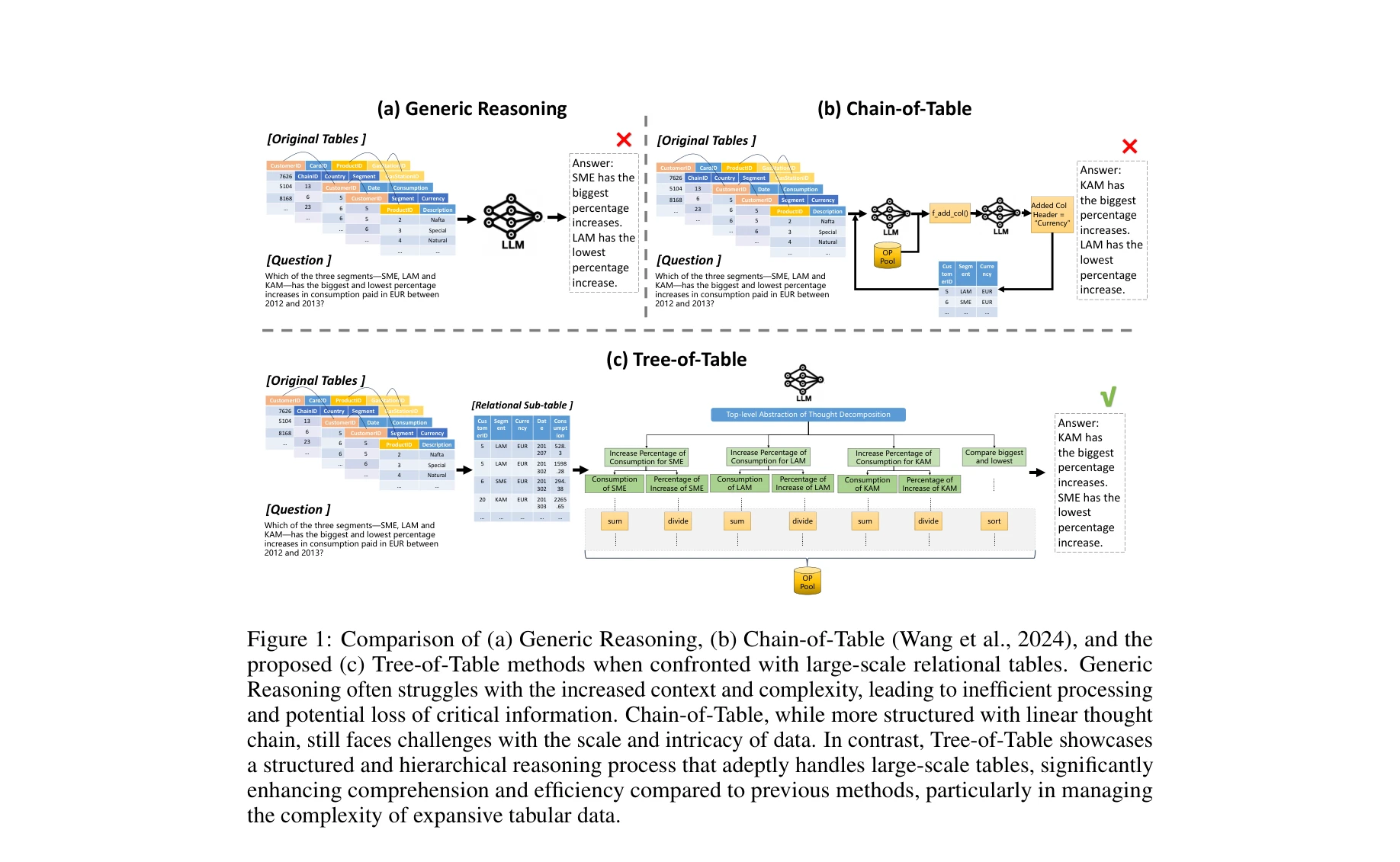

BAISBench의 개요: (A) 두 가지 보완적 태스크 구성, (B) BAIS-DPTA의 구축 방식, (C) BAIS-SD의 구축 방식

*BAISBench의 개요: (A) 두 가지 보완적 태스크 구성, (B) BAIS-DPTA의 구축 방식, (C) BAIS-SD의 구축 방식* 단일세포 전사체(single-cell transcriptomics) 데이터를 활용하여 AI 과학자(AI scientist) 시스템의 생물학적 발견 능력을 평가하는 BAISBench 벤치마크를 제시한다. 현재 AI 과학자들은 완전한 자동화된 생물학적 발견에는 못 미치지만, 데이터 기반 생물학 연구 지원에 상당한 잠재력을 보이고 있음을 실증적으로 보여준다.

이 논문은 단순한 지식 기반 평가를 넘어 실제 생물학 데이터 분석 능력을 평가하는 현실적이고 실용적인 벤치마크를 제시함으로써, 빠르게 발전하는 AI 과학자 분야에 타당성 있는 평가 기준을 마련했다. 계층적 평가 체계와 공개 자원은 학계에 즉각적인 기여를 할 수 있으나, 평가 범위의 다양화와 개방형 발견 능력 평가 추가를 통해 더욱 포괄적인 벤치마크로 발전할 여지가 있다.

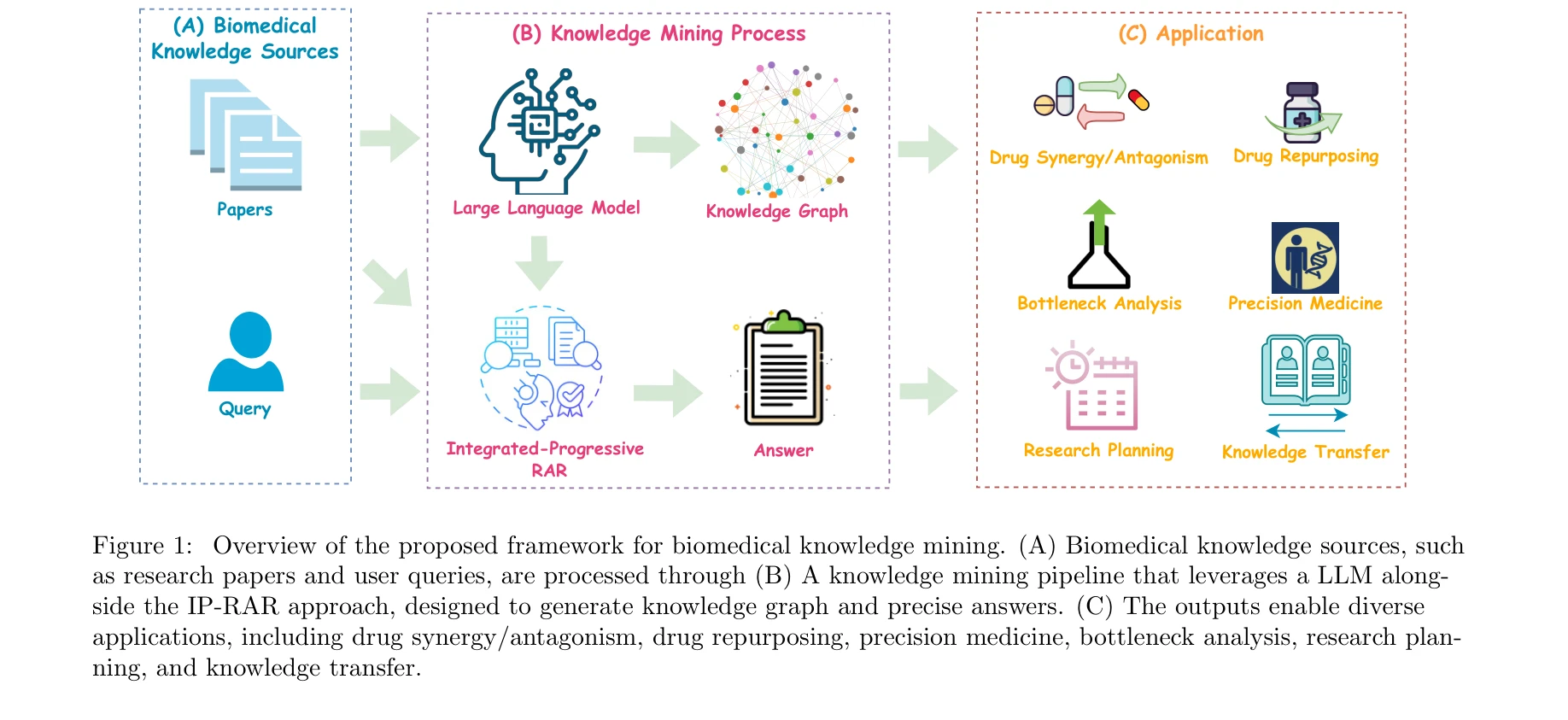

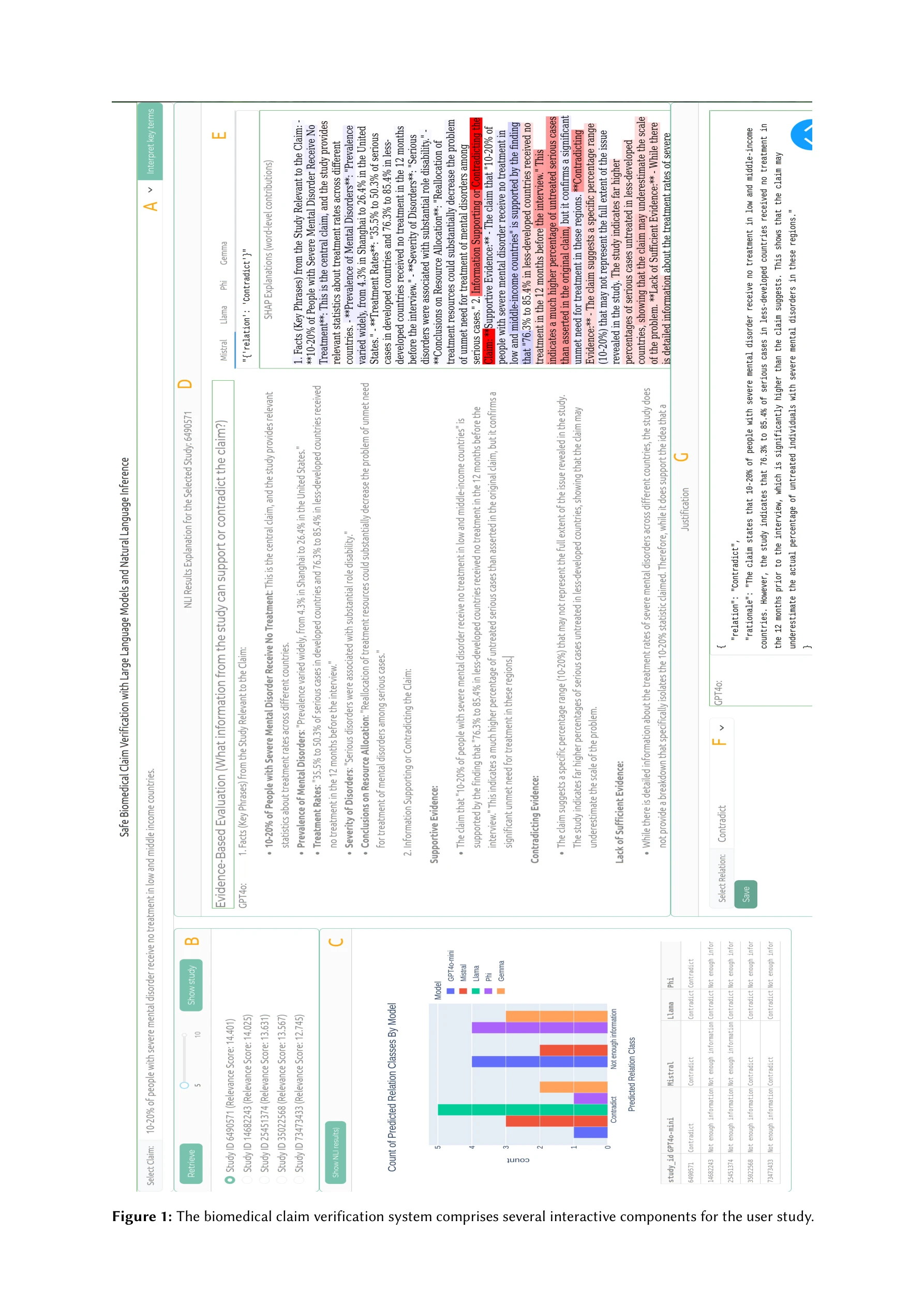

A retrieval-augmented knowledge mining method with deep thinking LLMs for biomedical research and clinical support

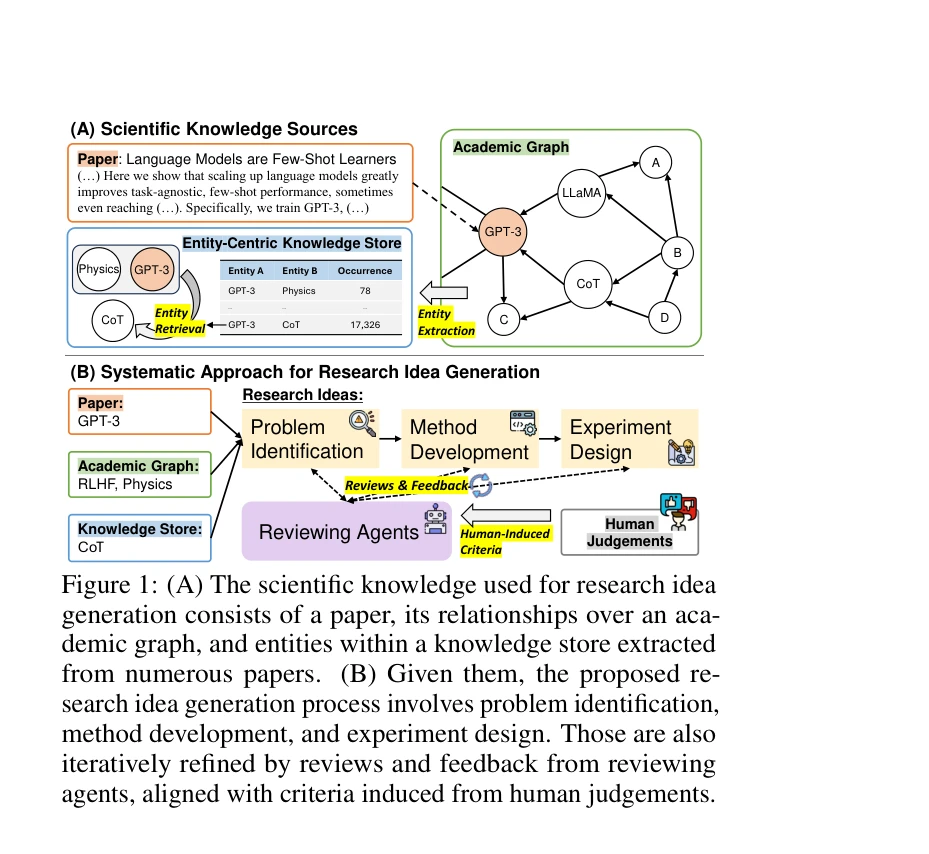

Figure 1: Overview of the proposed framework for biomedical knowledge mining. (A) Biomedical knowledge sources, such

*Figure 1: Overview of the proposed framework for biomedical knowledge mining. (A) Biomedical knowledge sources, such* 생의학 연구를 위해 Deep Thinking LLM과 Retrieval-Augmented Generation(RAG)을 통합한 지식 채굴 방법론을 제안하며, BioStrataKG 지식 그래프와 BioCDQA 데이터셋을 구축하고 IP-RAR 프레임워크로 문서 간 추론 능력을 향상시킨다.

생의학 지식 채굴을 위한 포괄적이고 체계적인 프레임워크를 제시한 우수한 연구이며, LLM의 깊은 추론 능력과 RAG 기법의 효과적인 통합으로 문서 간 추론 능력을 획기적으로 향상시켰다. 실제 임상 의사결정과 연구 전략 수립을 지원할 수 있는 높은 실용성을 갖추고 있다.

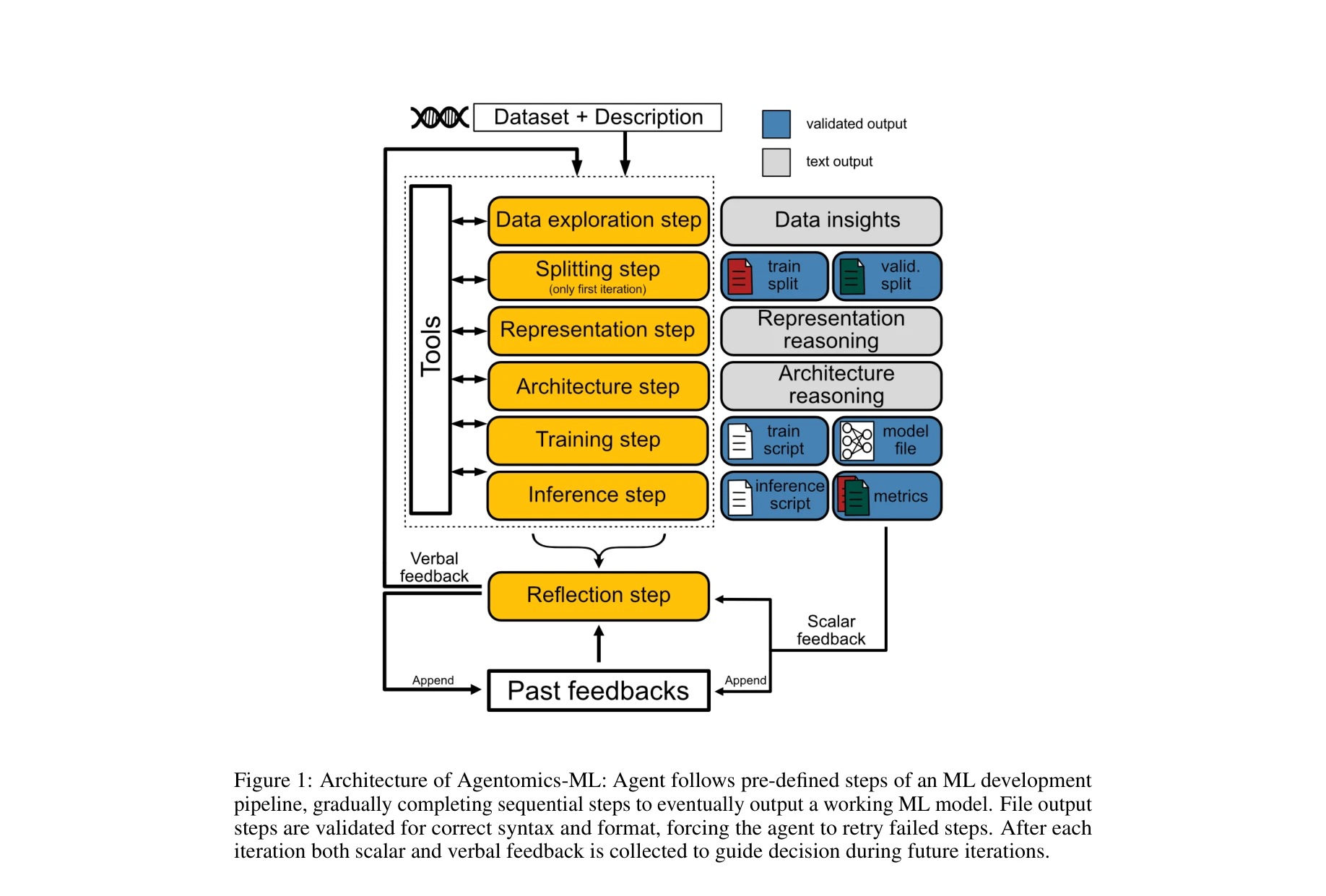

Agentomics-ML: Autonomous Machine Learning Experimentation Agent for Genomic and Transcriptomic Data

Agentomics-ML의 아키텍처: 에이전트가 ML 개발 파이프라인의 사전정의된 단계를 따르면서 순차적으로 단계를 완료하여 최종적으로 작동하는 ML 모델을 출력한다.

*Agentomics-ML의 아키텍처: 에이전트가 ML 개발 파이프라인의 사전정의된 단계를 따르면서 순차적으로 단계를 완료하여 최종적으로 작동하는 ML 모델을 출력한다.* LLM 기반 자율 에이전트를 게노믹 및 트랜스크립토믹 데이터 분류 작업에 특화시킨 시스템으로, 기존 대규모 언어 모델 에이전트 방법론을 초과하는 재현성과 일반화 성능을 달성한다.

Agentomics-ML은 게노믹 및 트랜스크립토믹 데이터의 ML 분석을 자동화하기 위해 도메인 특화 설계와 엄격한 평가 프레임워크를 결합한 의미 있는 기여를 제시하며, 기존 에이전트 기반 방법론을 현저히 초과하는 성능을 달성했으나, 도메인 전문가 모델과의 격차와 작업 범위의 제한성이 실무 활용성을 다소 제약한다.

Deep active learning based experimental design to uncover synergistic genetic interactions for host targeted therapeutics

Deep Active Learning 프레임워크의 전체 흐름: SPOKE 지식 그래프에서 생성된 유전자 임베딩을 초기화하고, 신경망을 통해 상호작용을 예측하며, 획득함수 기반 능동학습 루프로 다음 탐사 대상 유전자 쌍을 선정

*Deep Active Learning 프레임워크의 전체 흐름: SPOKE 지식 그래프에서 생성된 유전자 임베딩을 초기화하고, 신경망을 통해 상호작용을 예측하며, 획득함수 기반 능동학습 루프로 다음 탐사 대상 유전자 쌍을 선정* 본 논문은 HIV 감염에서 숙주 유전자 쌍의 시너지 상호작용을 효율적으로 발견하기 위해 생물학적 지식 그래프(SPOKE)와 딥러닝 기반 능동학습(Deep Active Learning, DeepAL)을 통합한 프레임워크를 제시한다. 356개 유전자의 상호작용 공간(356×356 행렬)에서 실험 비용을 최소화하면서 효과적인 이중 녹다운(double knockdown) 쌍을 발견한다.

본 논문은 생물학적 지식 그래프와 딥러닝 능동학습을 효과적으로 통합하여 대규모 유전자 상호작용 공간을 효율적으로 탐색하는 실용적이고 혁신적인 프레임워크를 제시한다. 특히 356×356 규모의 이중 녹다운 데이터 처리는 이 분야에서 획기적이며, 경로 분석을 통한 생물학적 해석가능성도 강점이다. 다만 실제 실험실 검증, 계산 효율성 분석, 그리고 다양한 질병 시스템에의 일반화 가능성에 대한 추가 연구가 필요하다.

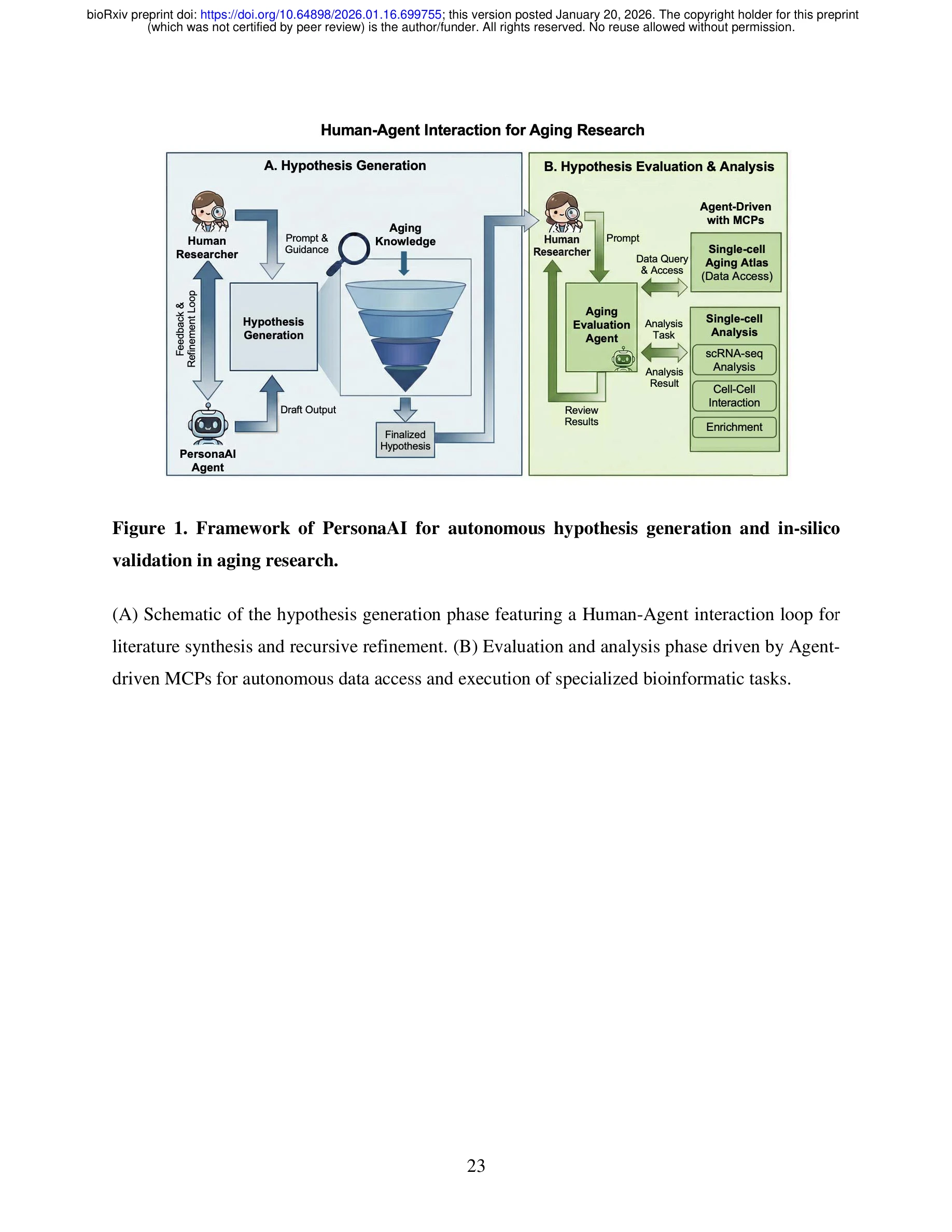

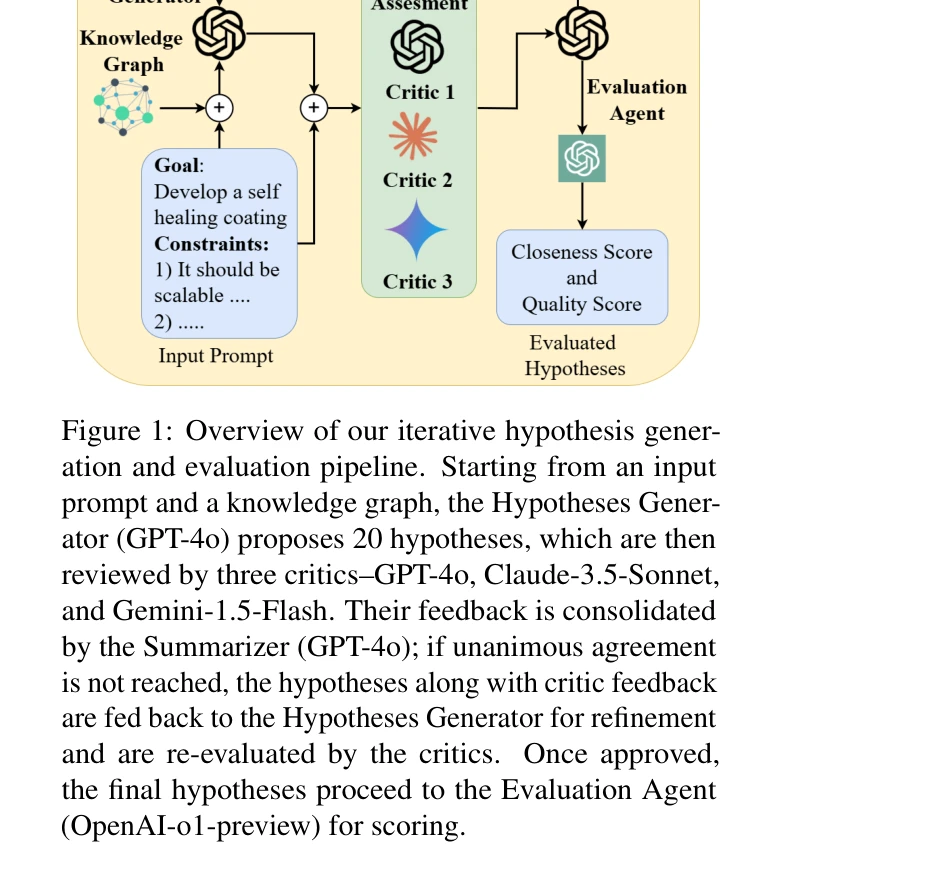

PersonaAI: An Interactive Agentic-AI Framework for Autonomous Hypothesis Generation and Validation in Aging

Figure 1. PersonaAI의 자동 가설 생성 및 실리코 검증 프레임워크

노화 연구의 복잡성(확률적 특성, 세포 이질성, 560,000개 이상의 논문)을 극복하기 위해 인공지능이 인간 과학자의 디지털 동료로서 문헌 기반 추론과 자동화된 실리코 검증(single-cell RNA-seq)을 통합하여 가설을 생성하고 검증하는 프레임워크를 제시한다.

PersonaAI는 LLM 기반 생물학적 발견 가속화의 실질적 사례를 제시하며, 특히 인간 직관과 자동화 검증의 균형 있는 결합으로 신뢰도 높은 가설을 생성한다. 시간 절단 검증은 AI 시스템의 예측력을 입증하는 유효한 전략이나, 현재 preprint 단계로서 생체 내 실험 검증과 방법론의 상세 공개가 필요하다.

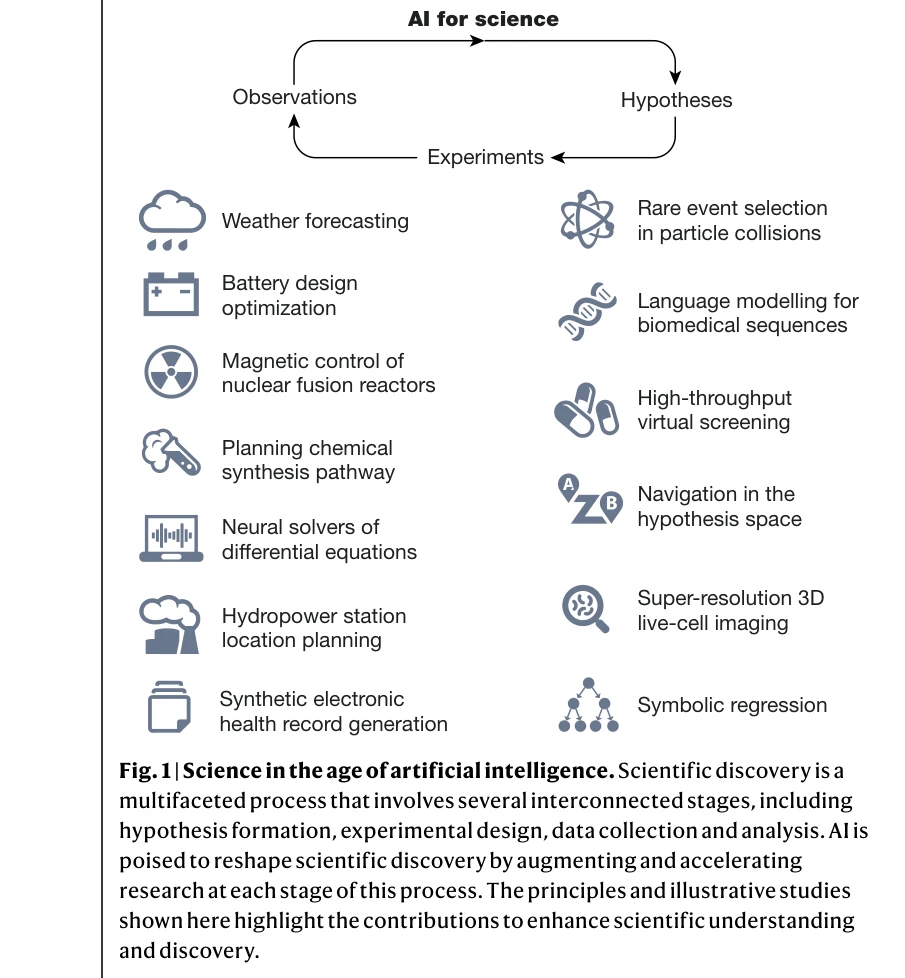

Scientific discovery in the age of artificial intelligence

*과학적 발견의 다단계 프로세스에서 AI의 역할: 가설 형성, 실험 설계, 데이터 수집 및 분석 단계 전반에 걸친 AI 통합* 본 리뷰 논문은 자기지도학습(self-supervised learning), 기하 심층학습(geometric deep learning), 생성형 AI 등 최근 10년간의 주요 AI 기술을 통해 과학적 발견이 어떻게 변모하고 있는지 종합적으로 조망한다. AI는 대규모 데이터셋 통합, 가설 탐색, 실험 설계 자동화 등을 통해 전통적 과학방법론만으로는 불가능한 새로운 과학적 통찰을 제공할 수 있다.

본 논문은 AI와 과학의 융합이라는 시대적 화두를 Nature라는 최고 권위의 플랫폼에서 다학제적 전문가 30여 명이 체계적으로 조망한 획기적 리뷰이다. 기술적 혁신과 함께 현실적 한계와 미해결 과제를 균형있게 제시함으로써 AI4Science 생태계의 건전한 발전을 위한 나침반 역할을 한다.

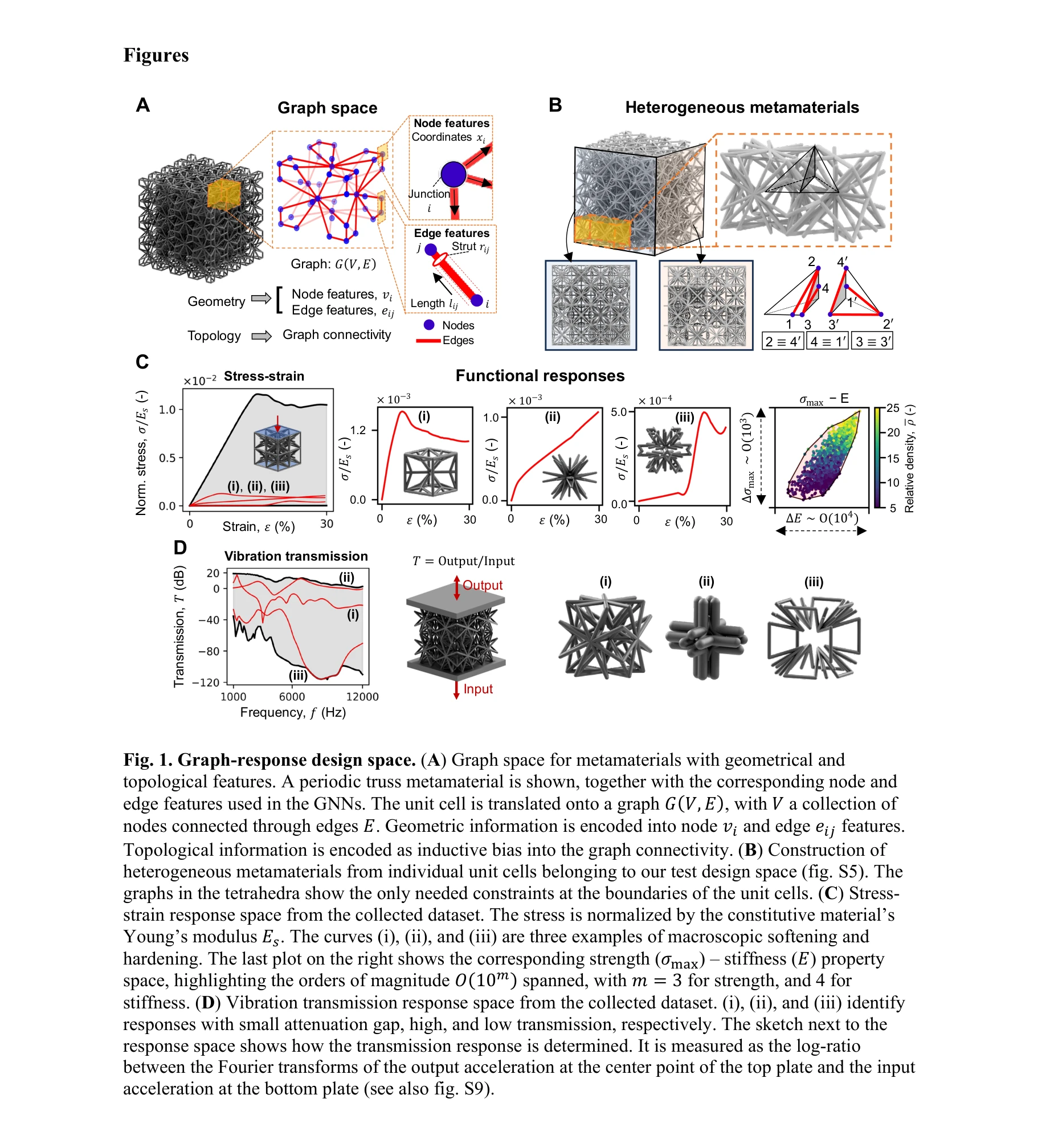

Inverse designing metamaterials with programmable nonlinear functional responses in graph space

그래프 공간에서의 메타머터리얼-응답 설계 공간. (A) 메타머터리얼의 그래프 표현: 연결재(strut)는 간선(edge), 교점은 노드(node)로 인코딩

*그래프 공간에서의 메타머터리얼-응답 설계 공간. (A) 메타머터리얼의 그래프 표현: 연결재(strut)는 간선(edge), 교점은 노드(node)로 인코딩* 본 논문은 그래프 신경망(Graph Neural Networks, GNN), 강화학습(Reinforcement Learning, RL), 그리고 몬테카를로 트리 탐색(Monte Carlo Tree Search, MCTS)을 결합한 GraphMetaMat 프레임워크를 제시하여, 사용자 정의 비선형 기능 반응(응력-변형률 곡선, 파동 전송 응답)을 가진 3D 메타머터리얼을 역설계할 수 있는 방법론을 개발했다.

본 논문은 그래프 신경망과 강화학습을 결합하여 복잡한 비선형 기능 반응을 가진 메타머터리얼의 역설계를 효과적으로 해결한 혁신적인 연구로, 설계 공간의 제약을 제거하고 실제 응용(보호장비, 전기차 진동 제어)까지 검증한 점에서 높은 가치를 지니고 있다. 다만 로딩 조건, 재료 다양성, 시뮬레이션-실제 간극 등의 실용적 한계가 후속 개선의 과제이다.

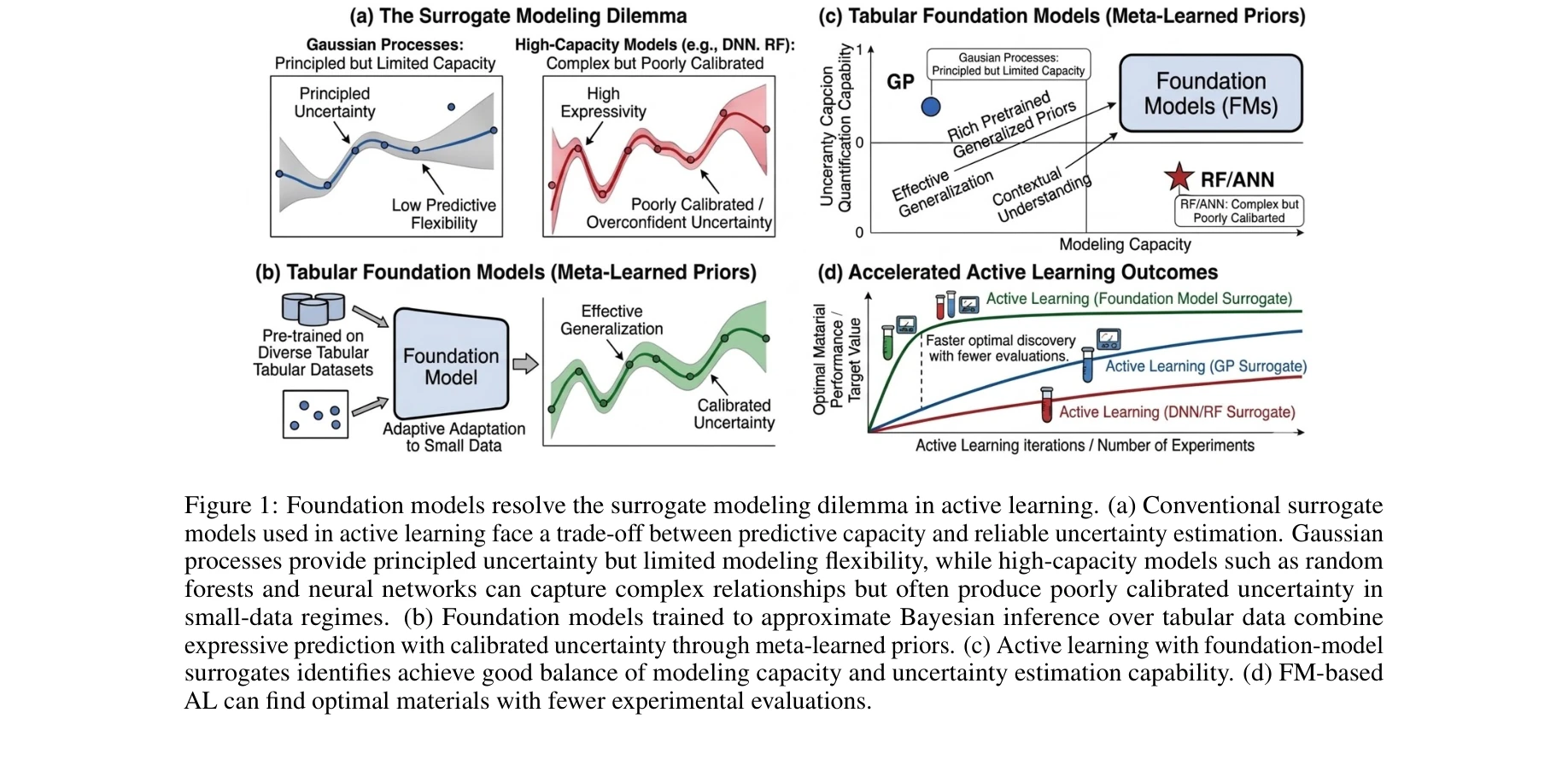

Foundation-Model Surrogates Enable Data-Efficient Active Learning for Materials Discovery

그림 1: 기초 모델이 능동 학습의 서로게이트 모델링 딜레마를 해결함. (a) 기존 모델들은 예측 능력과 불확실성 추정 간의 트레이드오프 직면 (b) 기초 모델은 메타 학습된 사전 정보를 통해 표현력 높은 예측과 보정된 불확실성 결합

*그림 1: 기초 모델이 능동 학습의 서로게이트 모델링 딜레마를 해결함. (a) 기존 모델들은 예측 능력과 불확실성 추정 간의 트레이드오프 직면 (b) 기초 모델은 메타 학습된 사전 정보를 통해 표현력 높은 예측과 보정된 불확실성 결합* 소재 발견을 위한 능동 학습(Active Learning, AL)에서 기존 가우스 프로세스(GP)와 랜덤 포레스트(RF) 서로게이트 모델의 한계를 극복하기 위해, 트랜스포머 기반의 기초 모델(Foundation Model, FM)인 TabPFN을 서로게이트로 도입하는 문맥 내 능동 학습(In-Context Active Learning, ICAL) 프레임워크를 제안한다. TabPFN은 메타 학습을 통해 소량의 실험 데이터에서도 표현력 높은 예측과 보정된 불확실성을 동시에 제공한다.

본 논문은 기초 모델의 메타학습 능력을 소재 발견 능동 학습의 핵심 문제(표현력 vs. 불확실성 트레이드오프)에 창의적으로 적용하였으며, 광범위한 벤치마크로 우월성을 입증했다. 다만 실제 실험 환경 검증과 고차원 특성 공간 확장이 완성되면 임팩트가 더욱 강화될 것으로 예상된다.

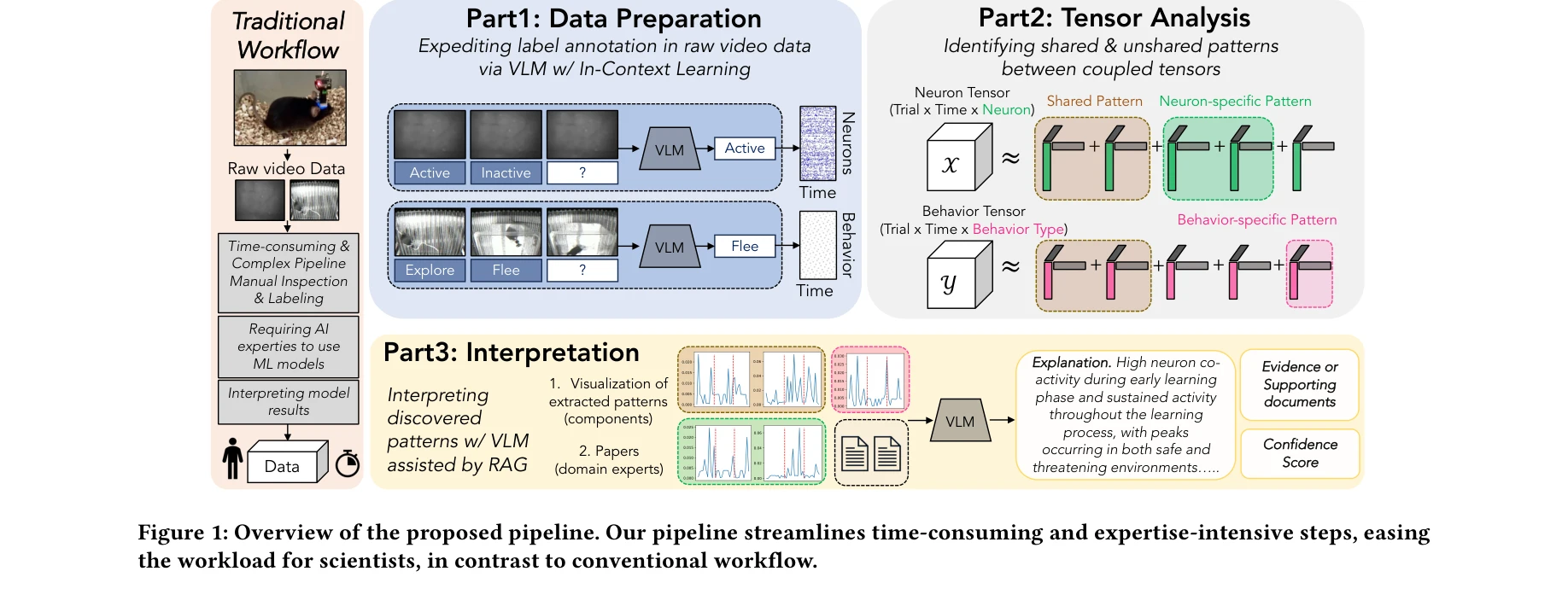

Transforming Behavioral Neuroscience Discovery with In-Context Learning and AI-Enhanced Tensor Methods

*제안된 파이프라인 개요: In-Context 데이터 준비, AI 강화 텐서 분석, AI 기반 패턴 해석의 세 가지 주요 단계* 본 논문은 행동신경과학 연구에서 데이터 준비부터 패턴 해석까지 시간 소비적이고 전문가 의존적인 단계들을 AI로 자동화하는 통합 파이프라인을 제시한다. In-Context Learning(ICL)과 향상된 텐서 분해를 활용하여 도메인 전문가가 프로그래밍 지식 없이도 공포 과일반화(fear generalization) 연구에서 신경 패턴을 발굴할 수 있는 사용자 친화적 인터페이스를 구현했다.

본 논문은 In-Context Learning이라는 접근성 높은 AI 패러다임을 도메인 전문가 중심의 신경과학 분석 파이프라인에 성공적으로 도입한 의미 있는 사례 연구이다. 기술적 엄밀성 향상과 다양한 도메인으로의 일반화 검증이 필요하지만, 실제 협업 경험에 기반한 실용적 기여가 돋보인다.

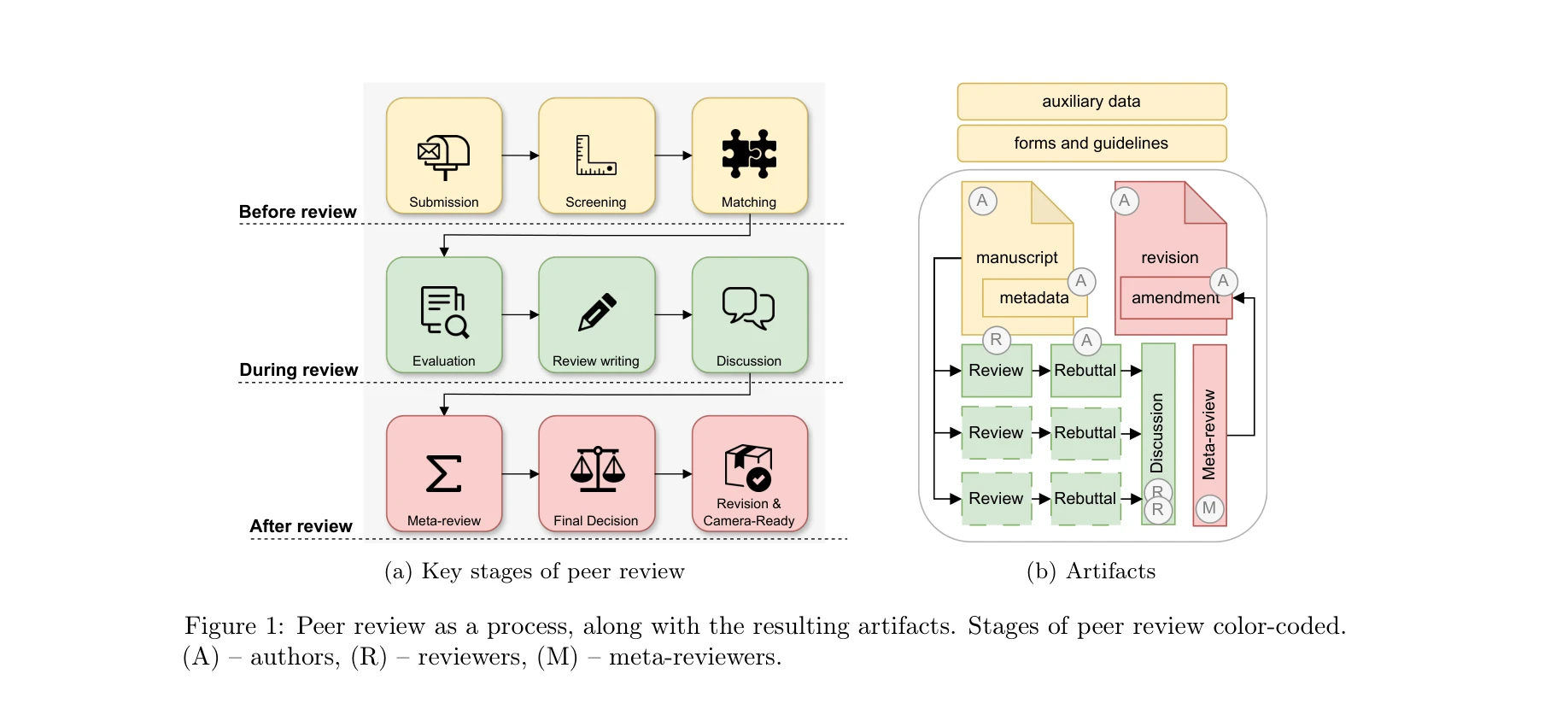

What Can Natural Language Processing Do for Peer Review?

그림 1: 동료 심사(Peer Review)를 하나의 과정으로 보는 관점과 그로 인해 생성되는 산출물들. 각 단계별로 색상 코딩됨.

*그림 1: 동료 심사(Peer Review)를 하나의 과정으로 보는 관점과 그로 인해 생성되는 산출물들. 각 단계별로 색상 코딩됨.* 본 논문은 과학 출판의 핵심 질관리 메커니즘인 동료 심사 과정에서 자연언어처리(NLP)가 구체적으로 어떤 역할을 할 수 있는지를 체계적으로 매핑하고, 실현 가능한 NLP 지원 방안을 제시하는 포괄적인 기초 연구이다. 저자들은 원고 제출부터 최종 출판까지 전체 심사 과정의 각 단계에서의 도전과제와 NLP 적용 기회를 상세히 분석하며, 완전 자동화보다는 리뷰어와 편집자의 효율성을 높이는 지원 도구 개발에 초점을 맞춘다.

본 논문은 NLP가 동료 심사 개선에 기여할 수 있는 영역을 최초로 체계적으로 매핑한 중요한 기초 연구이다. 완전 자동화의 불가능성을 냉철히 인식하면서도 현실적이고 단계적인 개선안을 제시하는 성숙함을 보여주며, 구체적인 call-for-action과 데이터셋 저장소 구축으로 후속 연구의 기반을 마련했다는 점에서 높이 평가할 수 있다. 다만 현재 분석이 AI 학회에 편중되고, 각 단계별 기술적 실현 방안이 개략적 수준에 머물러 있으며, 데이터 부족 및 평가 메트릭 부재 등 구조적 장애물들이 상당히 남아 있다는 점은 향후 극복해야 할 과제이다.

Pre: A peer review based large language model evaluator

학술지의 동료 평가(peer review) 메커니즘에서 영감을 받아, 여러 대규모 언어모델(LLM)을 평가자로 활용하여 다른 LLM들의 성능을 자동으로 평가하는 프레임워크를 제안한다. 자격 시험으로 신뢰할 수 있는 평가자를 선별한 후 이들의 평가 결과를 집계하여 편향 없는 LLM 평가를 실현한다.

본 논문은 학술적 동료 평가 원리를 LLM 자동 평가에 창의적으로 도입하여 비용, 편향, 일반화 문제를 동시에 해결하는 실질적인 해결책을 제시한 의미 있는 연구이다. 다만 평가 과제의 다양화와 메커니즘의 이론적 심화를 통해 주장의 보편성을 더욱 강화할 여지가 있다.

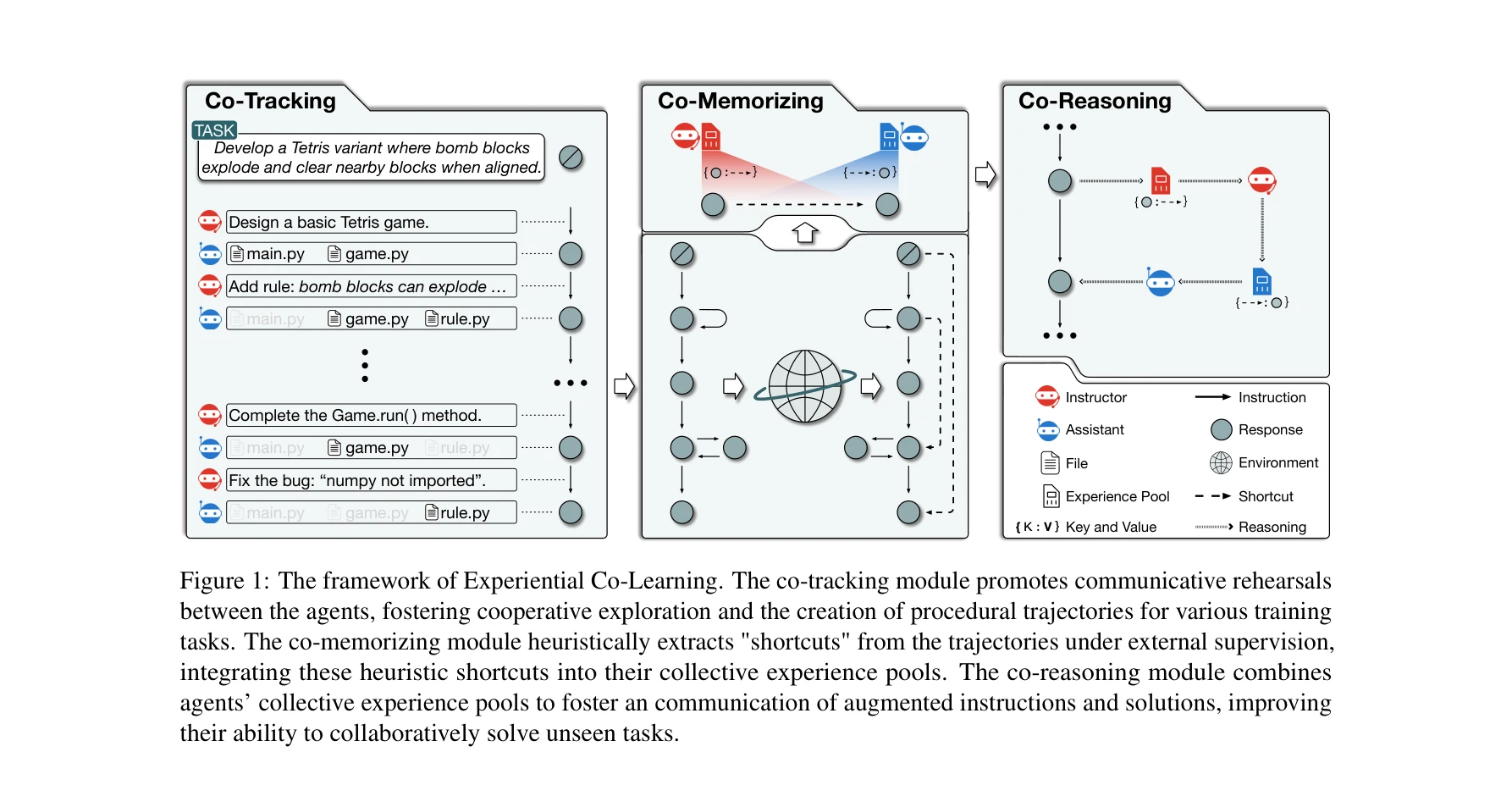

Experiential co-learning of software-developing agents

Experiential Co-Learning 프레임워크: Co-Tracking, Co-Memorizing, Co-Reasoning 세 모듈을 통해 Instructor와 Assistant 에이전트가 과거 경험을 학습하고 활용하여 소프트웨어 개발 작업을 효율적으로 수행

*Experiential Co-Learning 프레임워크: Co-Tracking, Co-Memorizing, Co-Reasoning 세 모듈을 통해 Instructor와 Assistant 에이전트가 과거 경험을 학습하고 활용하여 소프트웨어 개발 작업을 효율적으로 수행* 본 논문은 대규모 언어모델(LLM) 기반 다중 에이전트 시스템이 과거 작업 경험을 축적하고 활용하는 "경험적 협력학습(Experiential Co-Learning)" 프레임워크를 제안한다. 이를 통해 소프트웨어 개발 작업에서 반복적인 오류를 감소시키고 에이전트 간의 협력 효율성을 현저히 향상시킨다.

본 논문은 LLM 기반 다중 에이전트의 협력학습에 경험 축적과 활용이라는 중요한 개념을 처음 도입한 의미 있는 연구이며, 작업 실행 그래프 기반 지름길 추출이라는 창의적인 방법론을 제시한다. 실제 소프트웨어 개발 자동화에서의 효율성 증대를 입증했으나, 도메인 특화성과 경험 표현의 단순성이 향후 개선 과제로 남아있다.

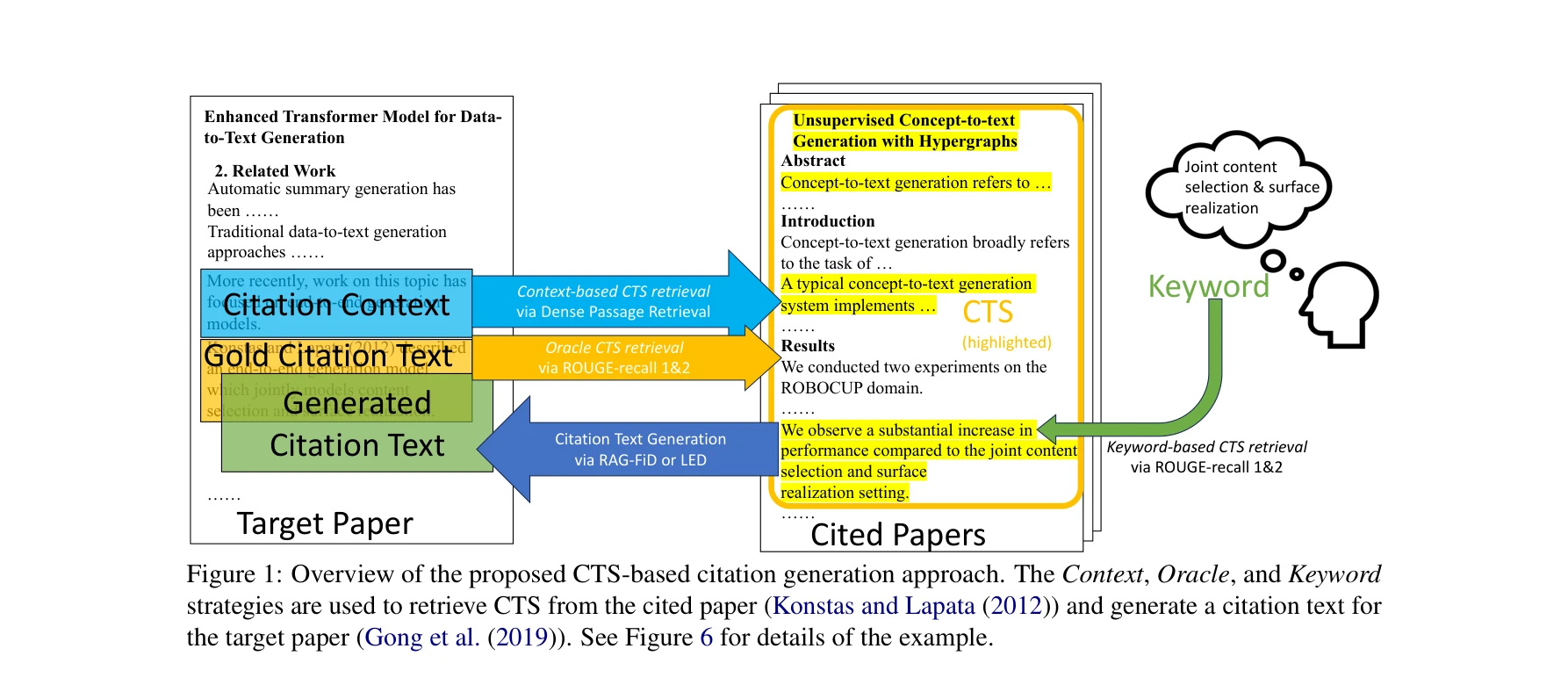

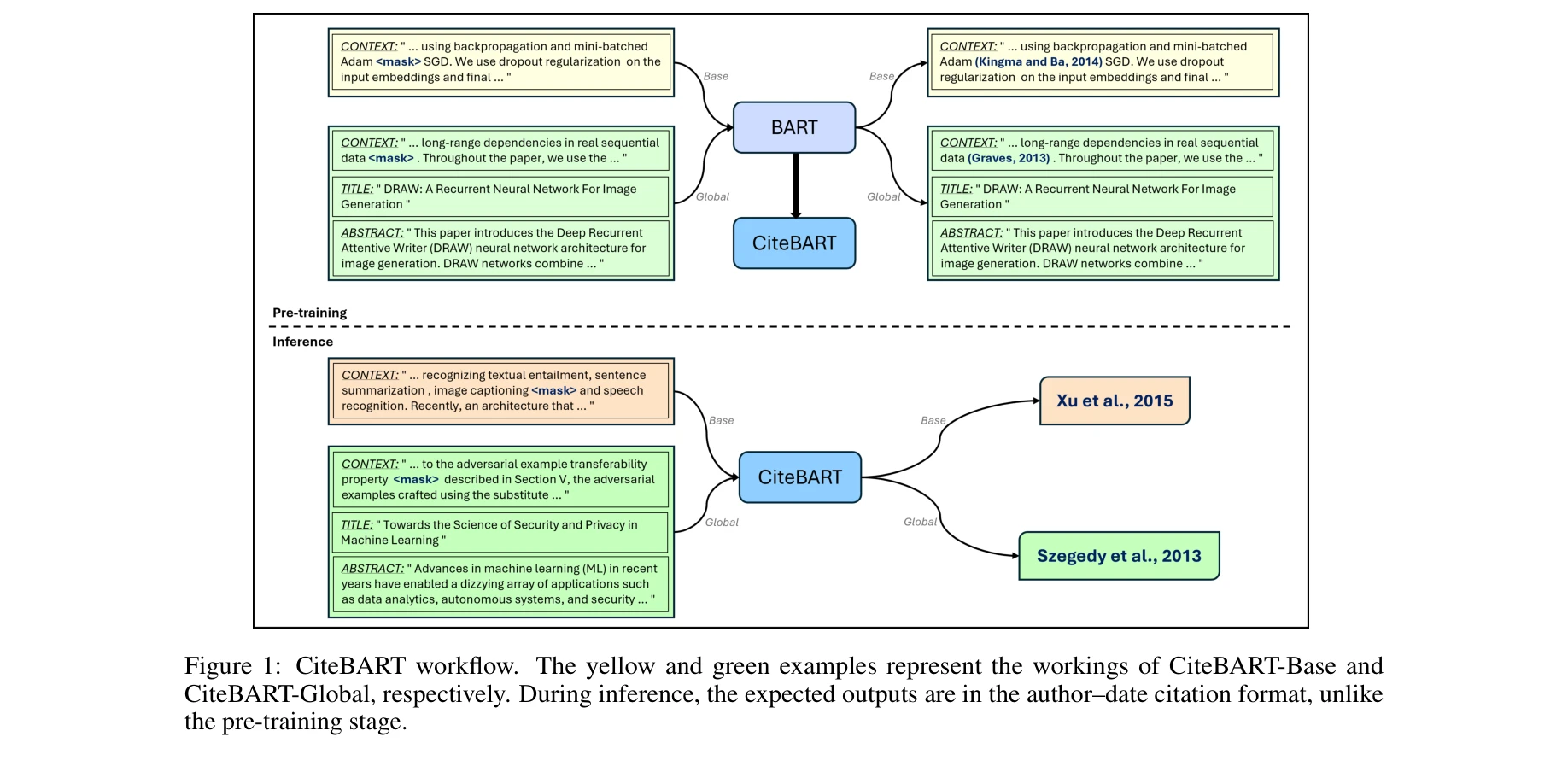

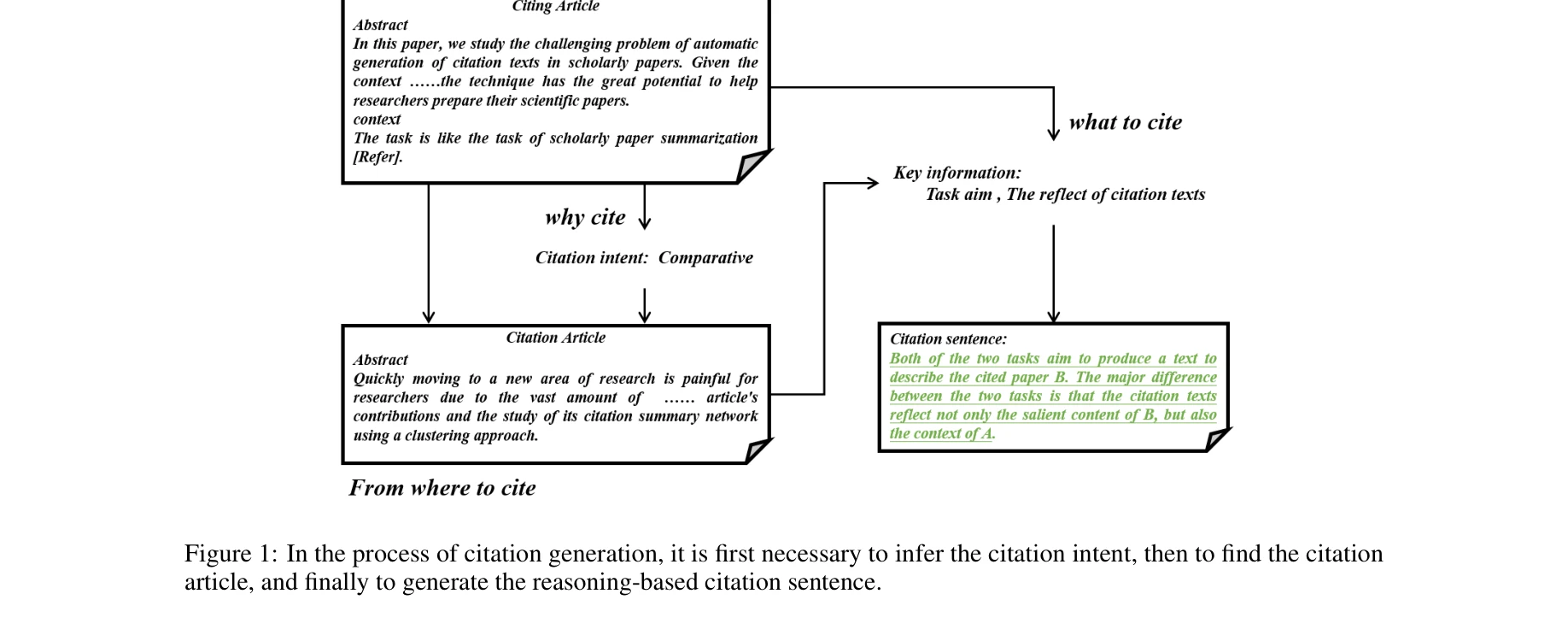

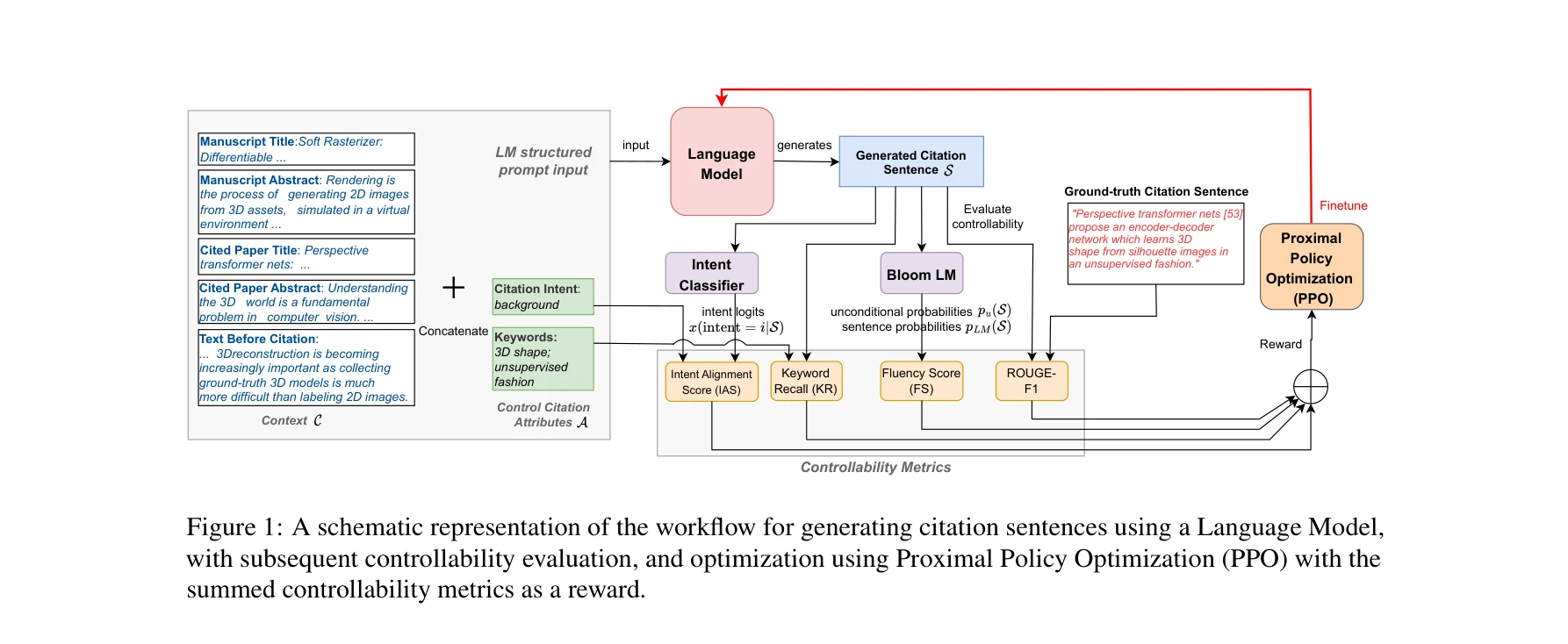

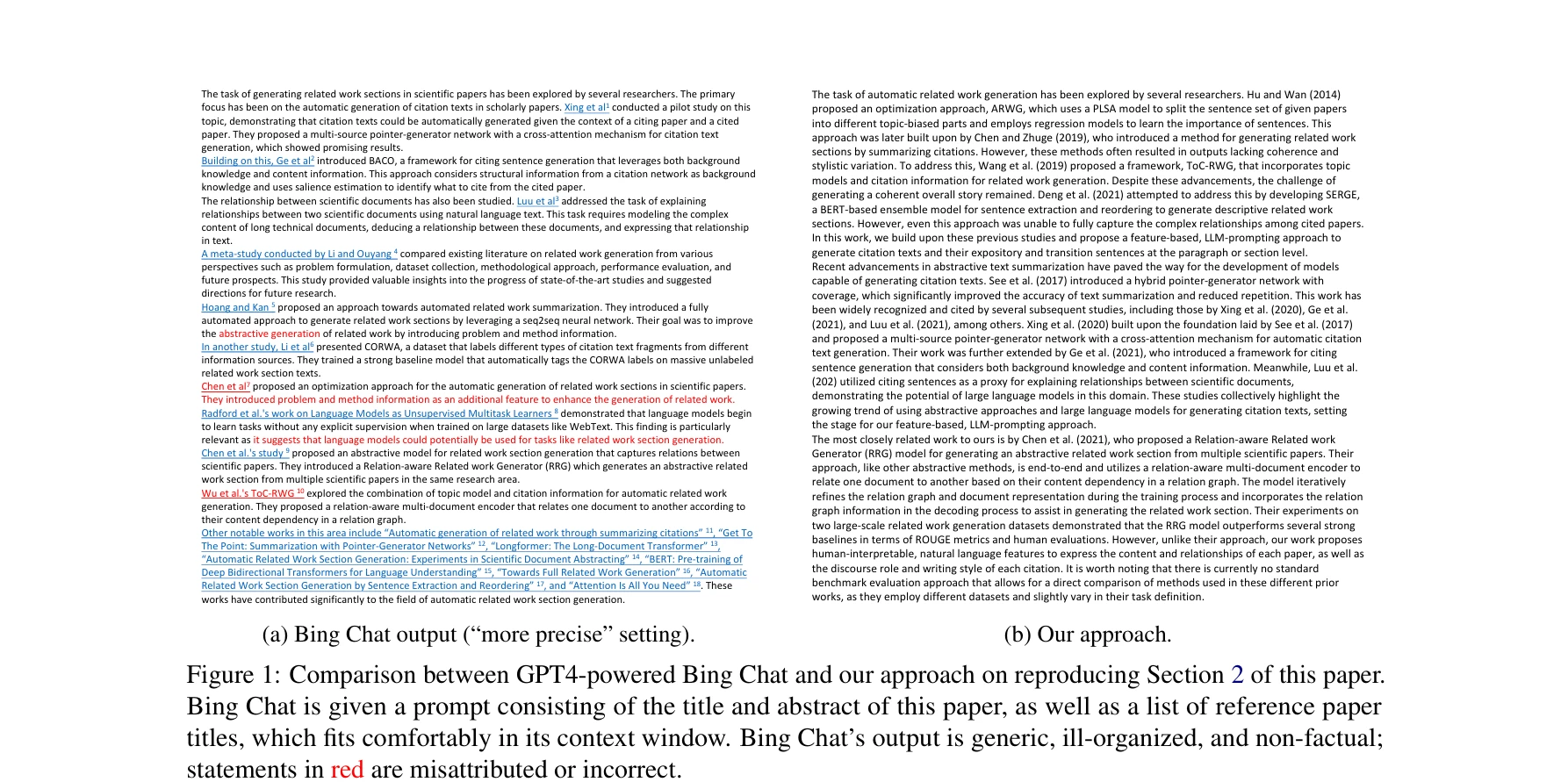

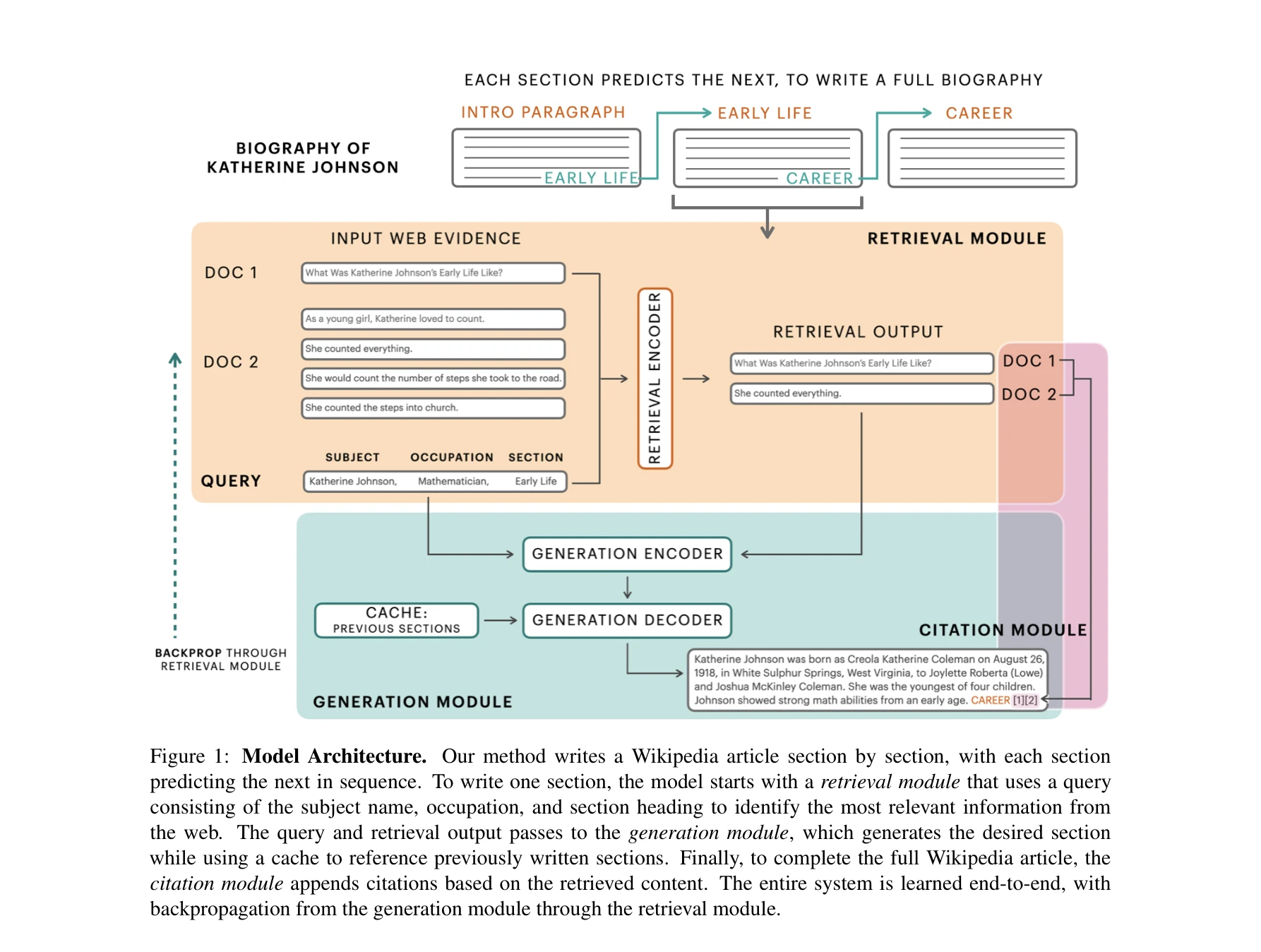

When large language models meet citation: A survey

LLM과 인용 간의 상호 이익적 관계

*LLM과 인용 간의 상호 이익적 관계* 대규모 언어 모델(LLM)과 학술 인용 분석 간의 상호 보완 관계를 체계적으로 정리한 최초의 종합 조사 연구이다. LLM이 인용 분석 작업의 성능을 향상시키고, 역으로 인용 데이터가 LLM의 텍스트 표현을 개선하는 양방향 이익 구조를 제시한다.

본 논문은 LLM과 인용 분석 간의 상호 이익 관계를 최초로 체계적으로 정리한 중요한 조사 연구이며, 향후 학술 정보 처리 및 LLM 개선 분야에 명확한 연구 방향을 제시한다. 다만 실증적 성과와 정량적 비교가 강화되면 더욱 강력한 기여가 될 수 있을 것으로 예상된다.

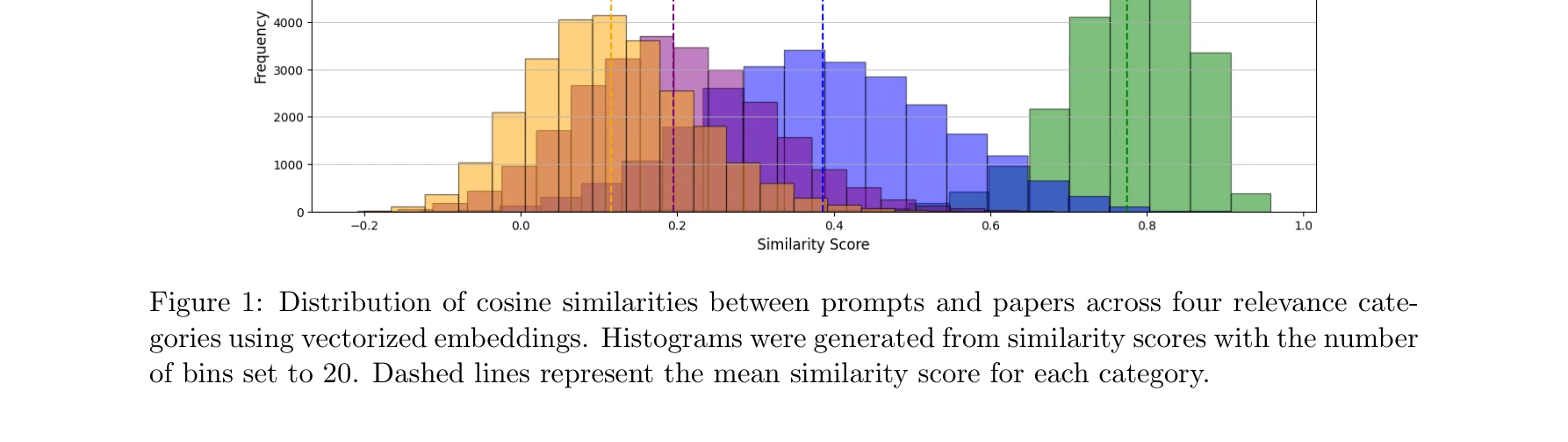

RelevAI-Reviewer: A Benchmark on AI Reviewers for Survey Paper Relevance

*그림 1: 프롬프트와 논문 간 코사인 유사도 분포. 4개의 관련성 범주별로 명확한 구분이 나타남* 본 논문은 대규모 언어 모델(LLM)을 활용하여 학술 논문의 관련성을 자동으로 평가하는 분류 시스템 RelevAI-Reviewer를 제안하고, 25,164개의 인스턴스로 구성된 벤치마크 데이터셋을 공개한다. BERT 기반 종단(end-to-end) 분류기가 기존의 지도학습 방법들을 능가하는 성능을 달성했음을 보였다.

본 논문은 학술 논문 관련성 평가의 자동화를 위한 실용적인 벤치마크를 최초로 제공하며 공개 플랫폼을 통해 커뮤니티 참여를 유도하는 점이 가치있으나, 인공 데이터 생성의 신뢰성 문제와 단일 평가 기준만 다룬 점에서 개선의 여지가 있다.

Through the lens of core competency: Survey on evaluation of large language models

대규모 언어 모델(LLM)의 평가 방법론을 체계화하기 위해 "핵심 역량(Core Competency)" 프레임워크를 제안하는 종합 조사 논문이다. 540개 이상의 평가 과제를 분석하여 LLM의 4가지 핵심 역량(지식, 추론, 신뢰성, 안전성)으로 통합함으로써 산재된 평가 벤치마크를 체계적으로 정리한다.

본 논문은 빠르게 증식하는 LLM 평가 과제를 핵심 역량 중심으로 체계화한 중요한 조사 연구이며, 커뮤니티를 위한 실용적 도구를 제공한다. 다만 부분적 공개와 평가 지표의 정량화 부족으로 완성도에서 아쉬움이 있으며, 추후 완전 버전 공개와 함께 Reliability/Safety 역량에 대한 보다 깊이 있는 논의가 필요하다.

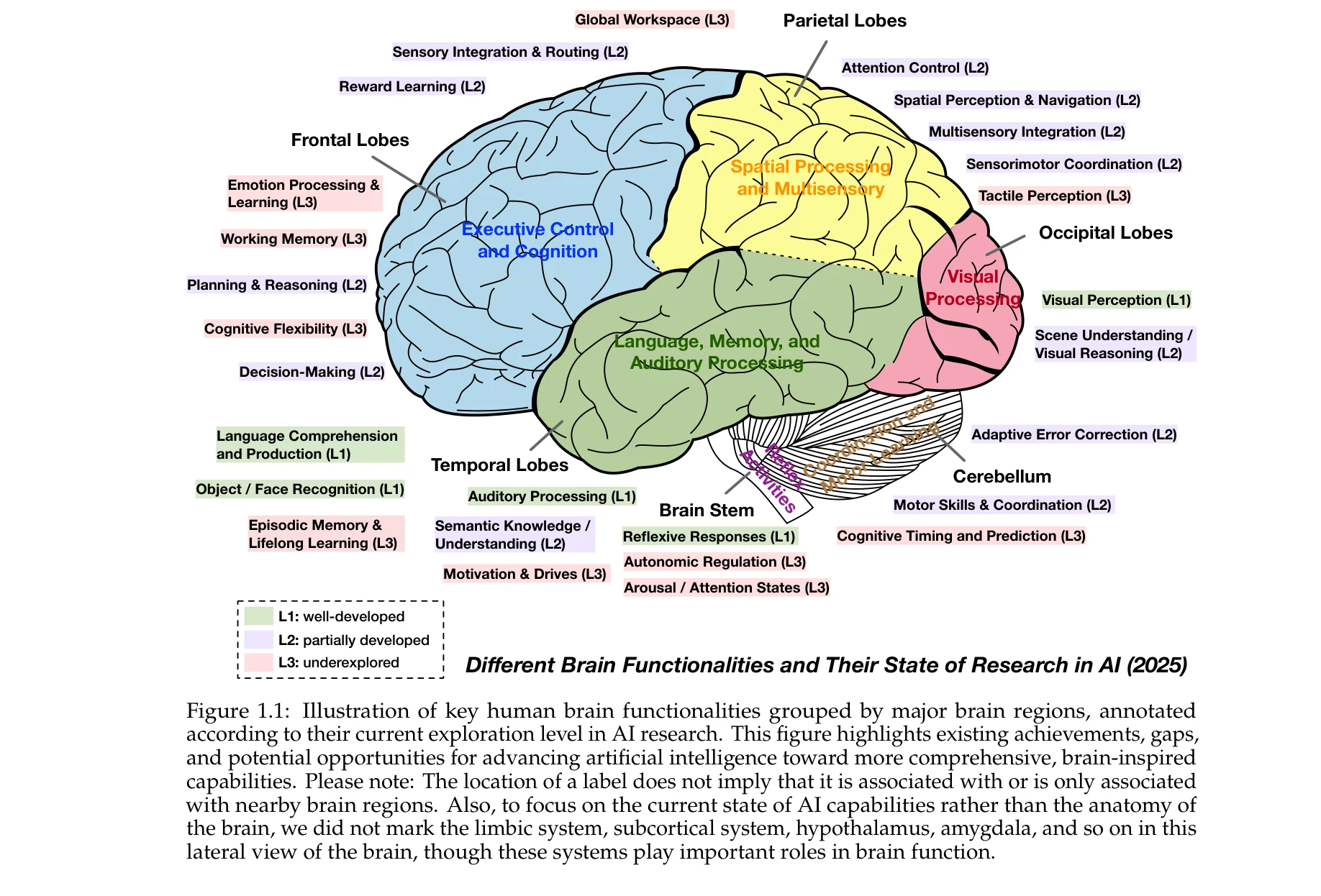

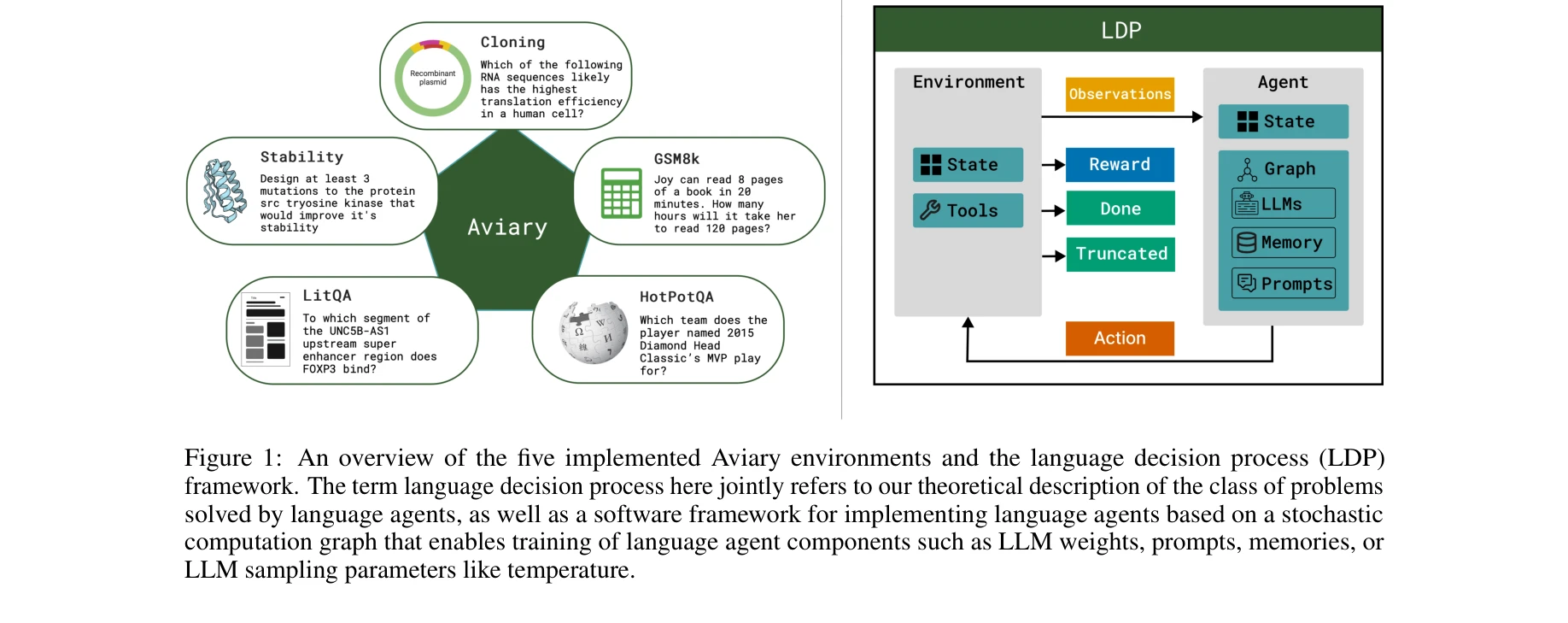

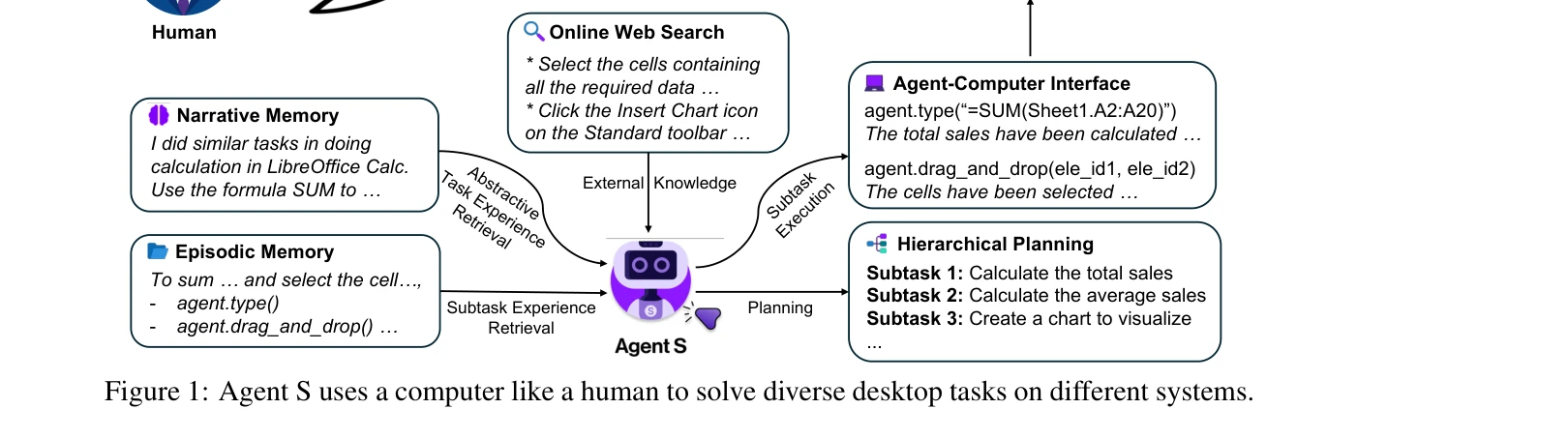

Advances and Challenges in Foundation Agents: From Brain-Inspired Intelligence to Evolutionary, Collaborative, and Safe Systems

본 논문은 대규모 언어모델(LLM) 기반의 지능형 에이전트의 현황을 종합적으로 검토한 대규모 리뷰 논문이다. 뇌 기능에서 영감을 받은 모듈식 아키텍처를 기반으로 에이전트의 설계, 진화, 협력, 안전성 등 다층적 측면을 체계적으로 분석한다.

본 논문은 LLM 시대 지능형 에이전트에 대한 가장 종합적이고 체계적인 리뷰로, 뇌 기능의 계산적 모델링과 에이전트 아키텍처의 통합을 통해 학제적 기여를 제시한다. 다만 구체적인 구현 사례와 실증적 검증이 강화된다면 더욱 영향력 있는 기초 자료가 될 수 있을 것으로 판단된다.

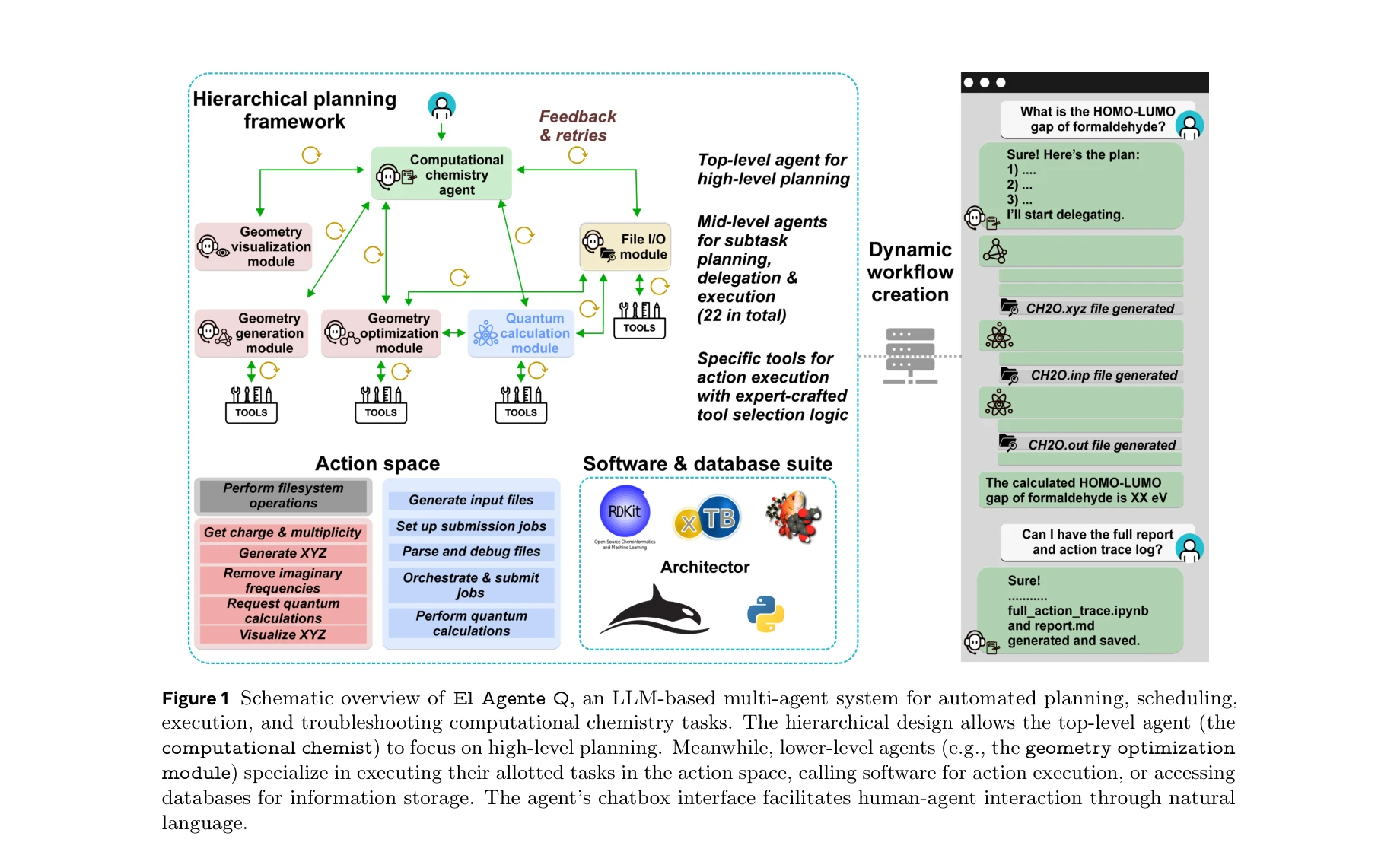

El Agente: An Autonomous Agent for Quantum Chemistry

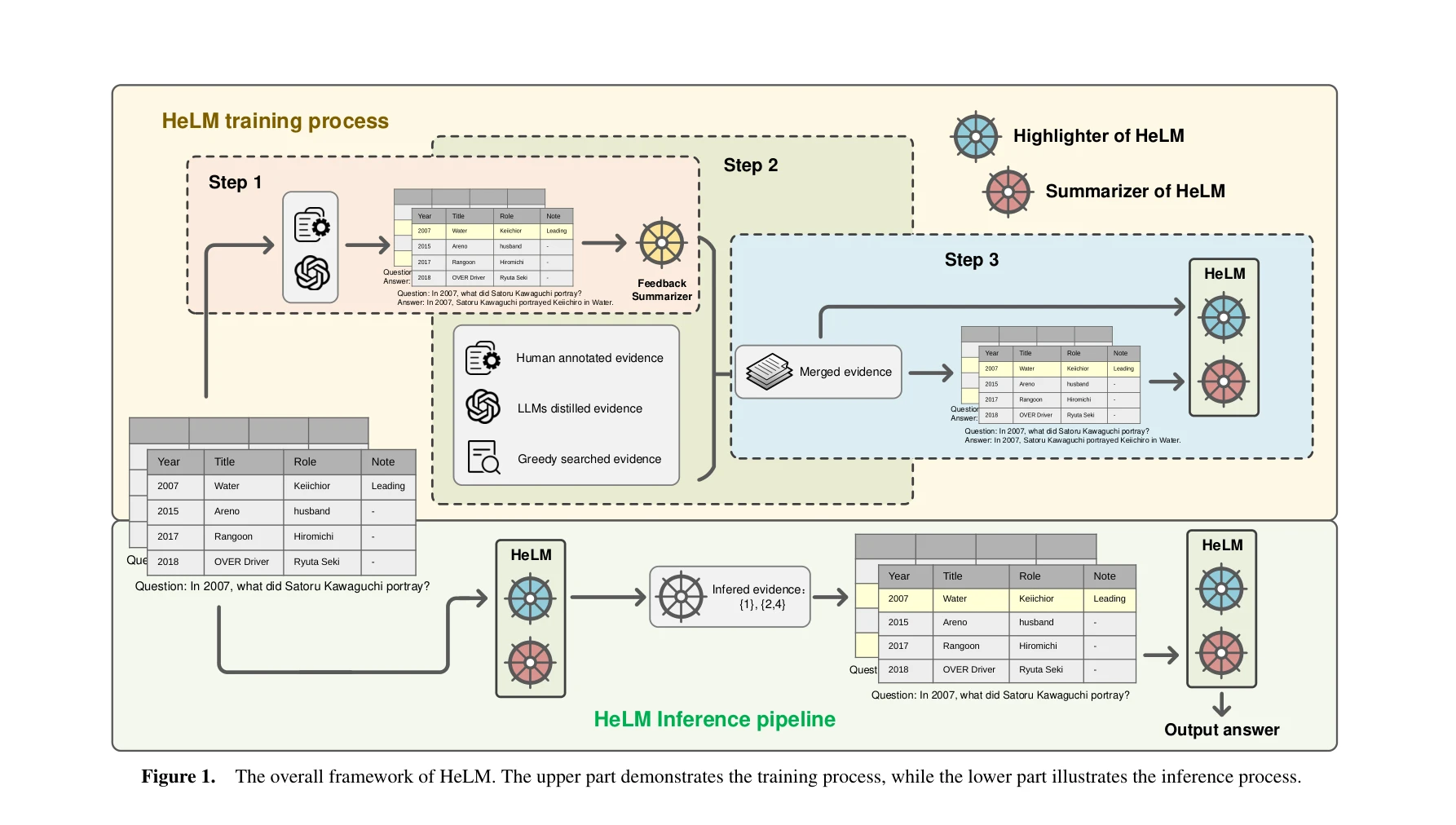

El Agente Q의 개요: LLM 기반 다중 에이전트 시스템으로 자동화된 계획, 일정 조정, 실행 및 문제 해결을 수행

*El Agente Q의 개요: LLM 기반 다중 에이전트 시스템으로 자동화된 계획, 일정 조정, 실행 및 문제 해결을 수행* 본 연구는 LLM 기반 다중 에이전트 시스템(El Agente Q)을 통해 양자화학 워크플로우를 자연언어 프롬프트로부터 동적으로 생성·실행하는 자율 시스템을 제시한다. 계층적 메모리 프레임워크, 적응적 도구 선택, 자동 오류 복구를 특징으로 하며, 대학 수준의 과제에서 >87%의 성공률을 달성한다.

El Agente Q는 LLM 기반 다중 에이전트 시스템을 통해 양자화학 자동화의 접근성과 유연성을 크게 향상시킨 의미 있는 연구로, 계층적 메모리 아키텍처와 적응적 오류 복구 능력이 돋보인다. 다만 episodic memory 미활성화, hallucination 문제 해결, 실제 대규모 계산에서의 효율성 검증 등이 향후 개선 과제이다.

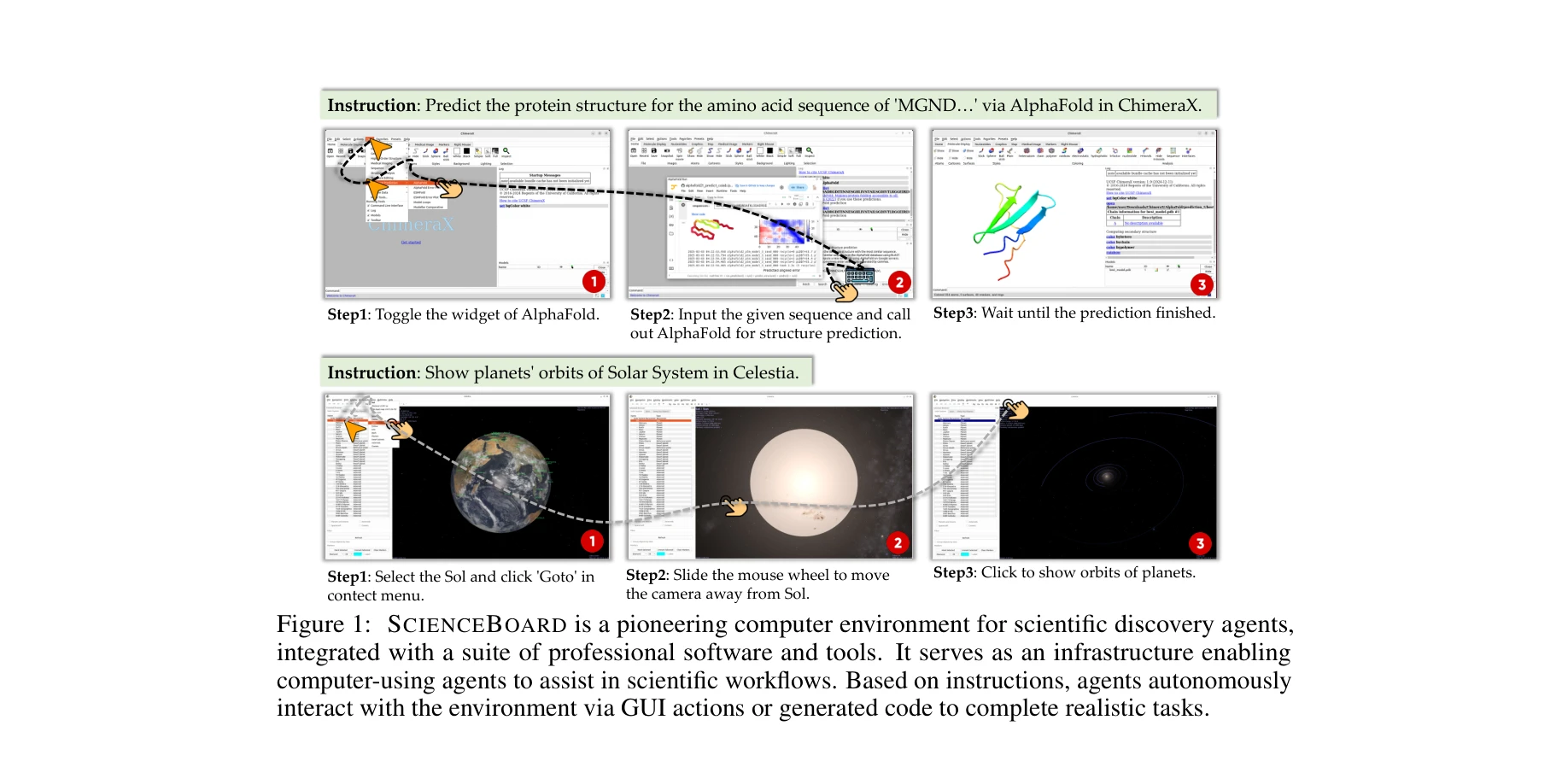

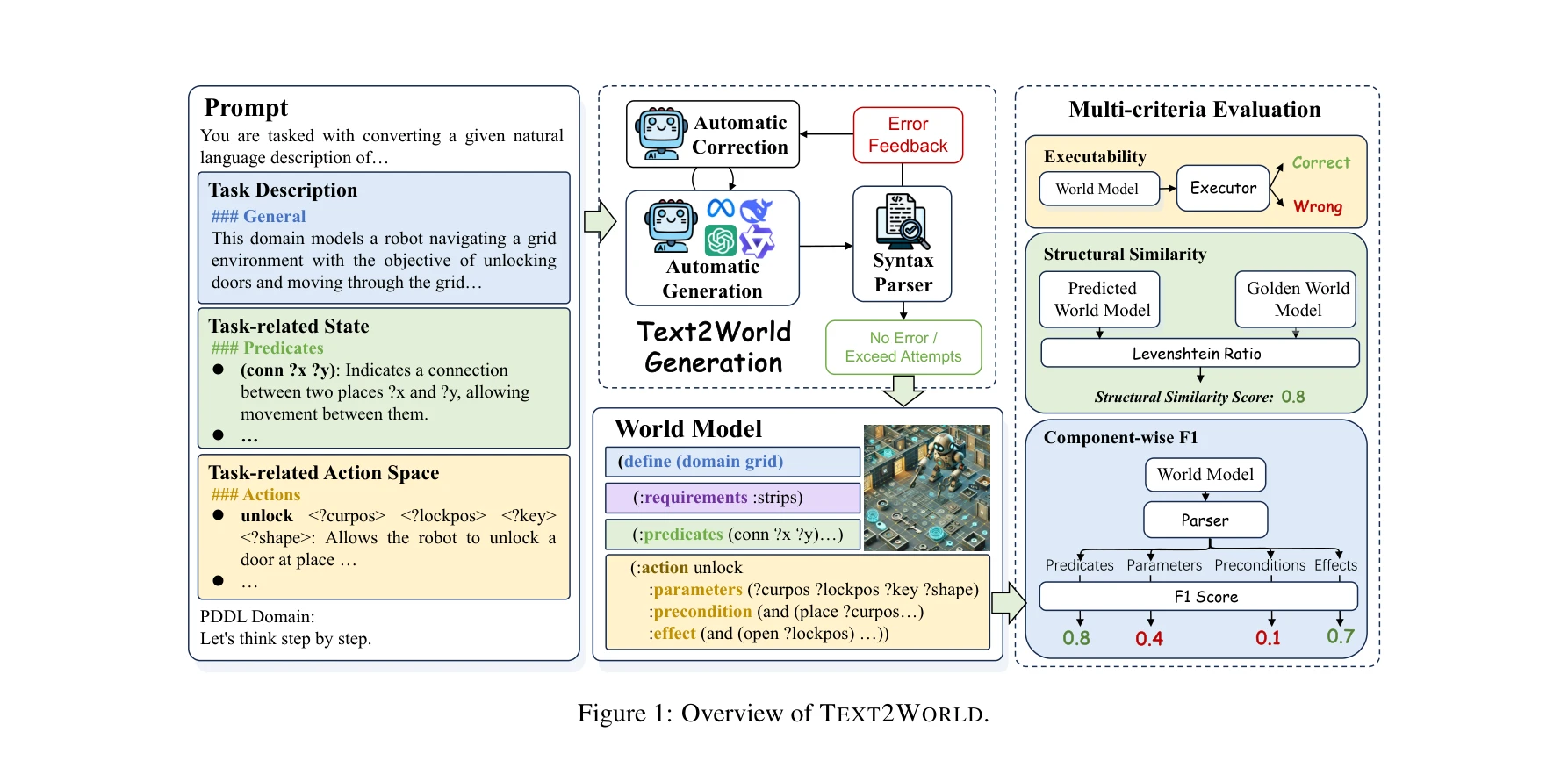

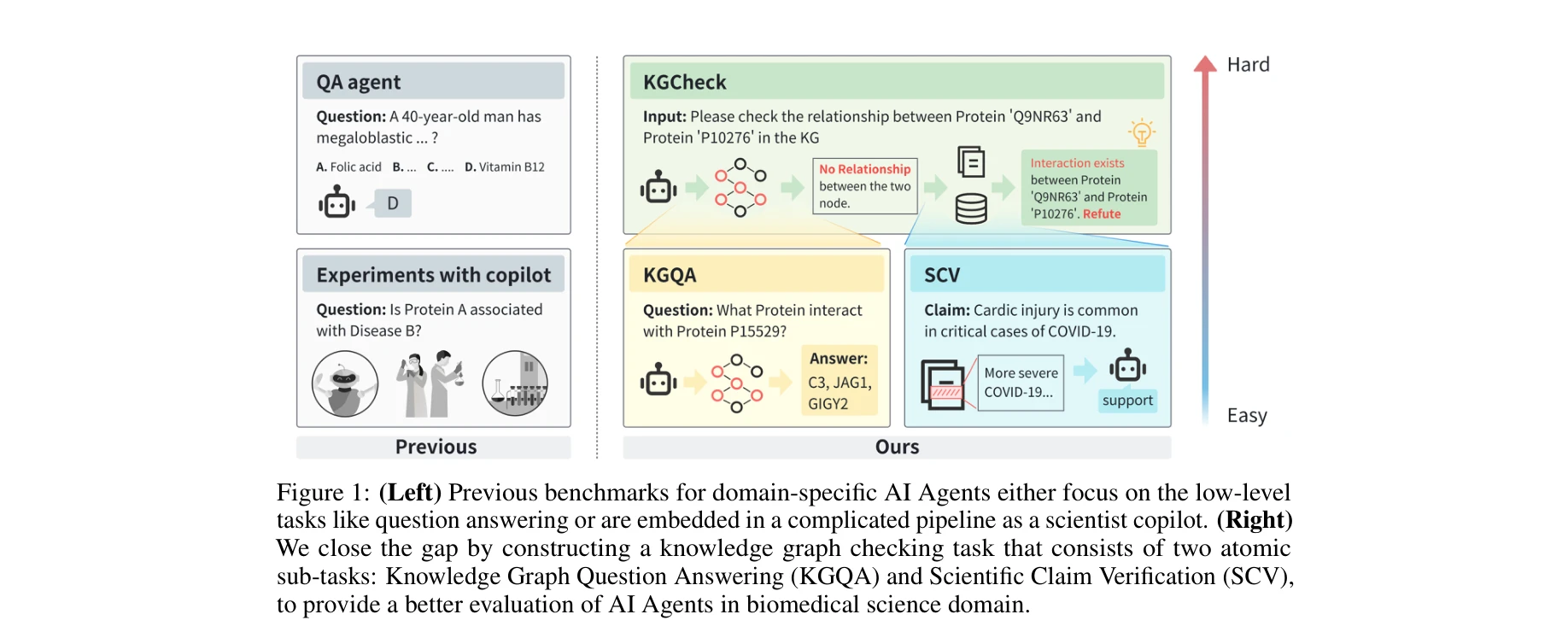

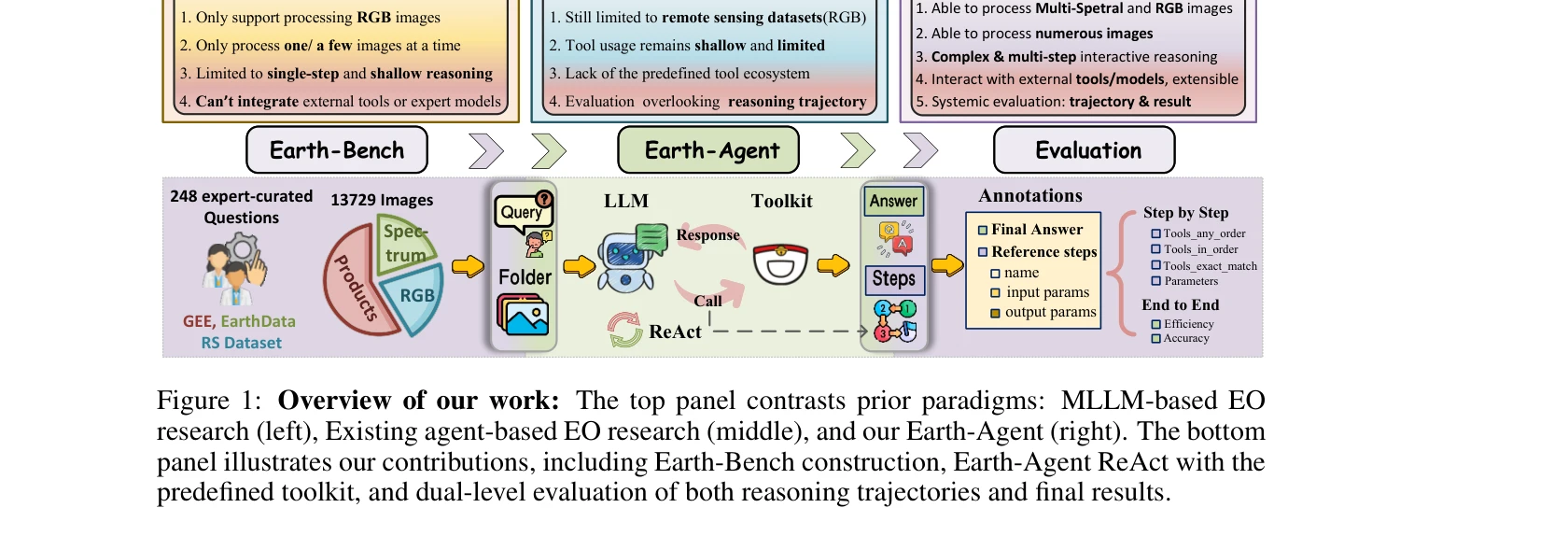

Scienceboard: Evaluating multimodal autonomous agents in realistic scientific workflows

*AlphaFold를 통한 단백질 구조 예측과 Celestia에서 행성 궤도 표시 등 실제 과학 소프트웨어와 상호작용하는 에이전트* 본 논문은 현실적인 과학 워크플로우에서 멀티모달 자율 에이전트를 평가하기 위한 **SCIENCEBOARD** 환경과 벤치마크를 제시한다. 생화학, 천문학, 지정보학 등 6개 과학 도메인에서 169개의 고품질 작업을 통해 최신 LLM/VLM 기반 에이전트들이 15% 이하의 성공률을 보이며, 현재 기술의 한계를 명시적으로 드러낸다.

SCIENCEBOARD는 컴퓨터-사용 에이전트를 현실적인 과학 워크플로우에서 평가하기 위한 획기적인 환경이자 벤치마크로, 현재 기술의 명확한 한계(15% 성공률)를 드러내면서 동시에 AI 기반 과학 자동화 연구의

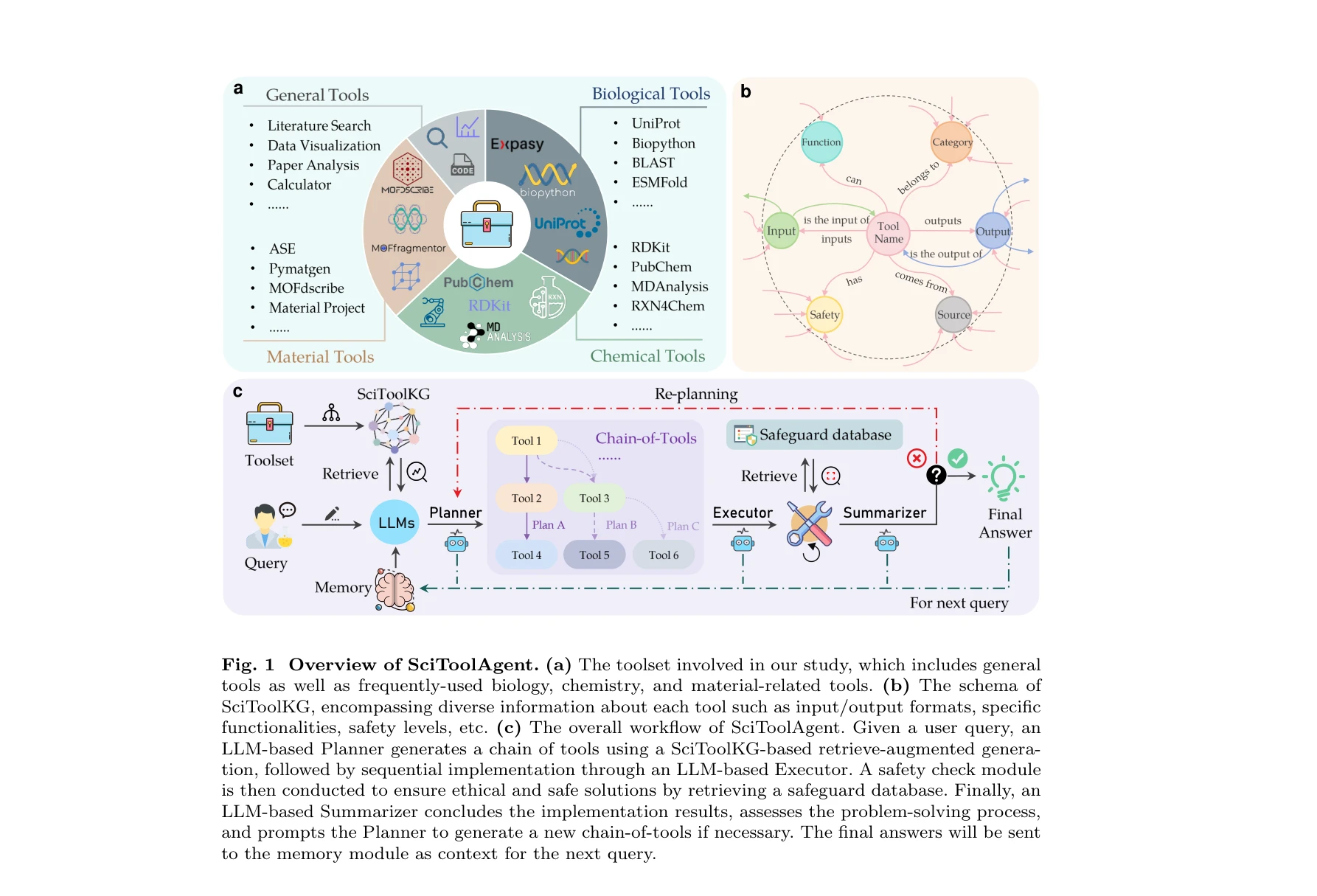

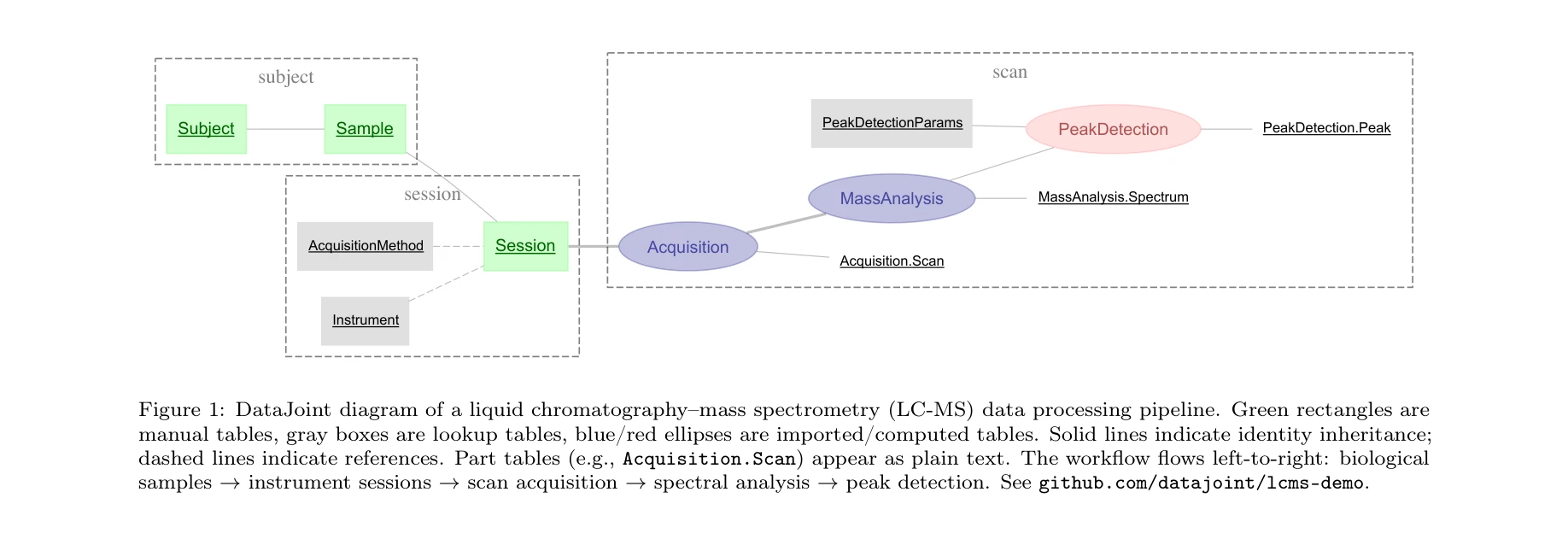

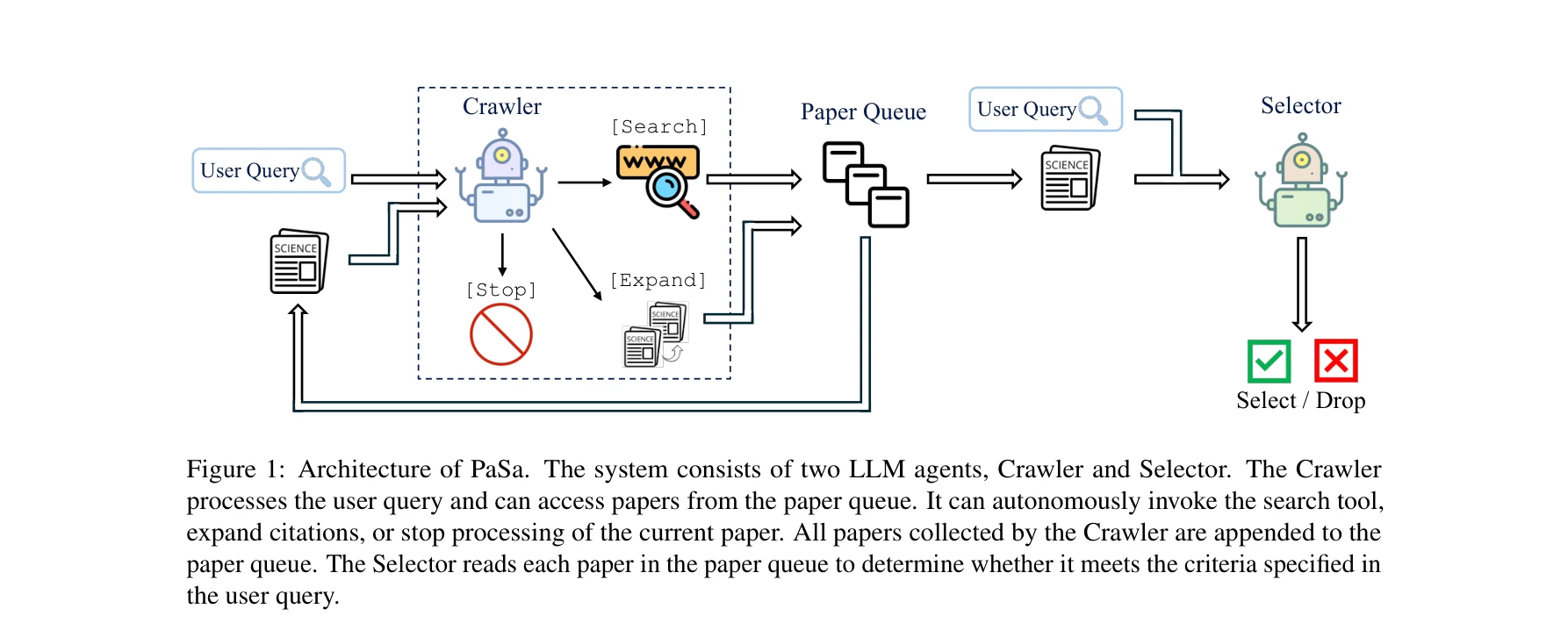

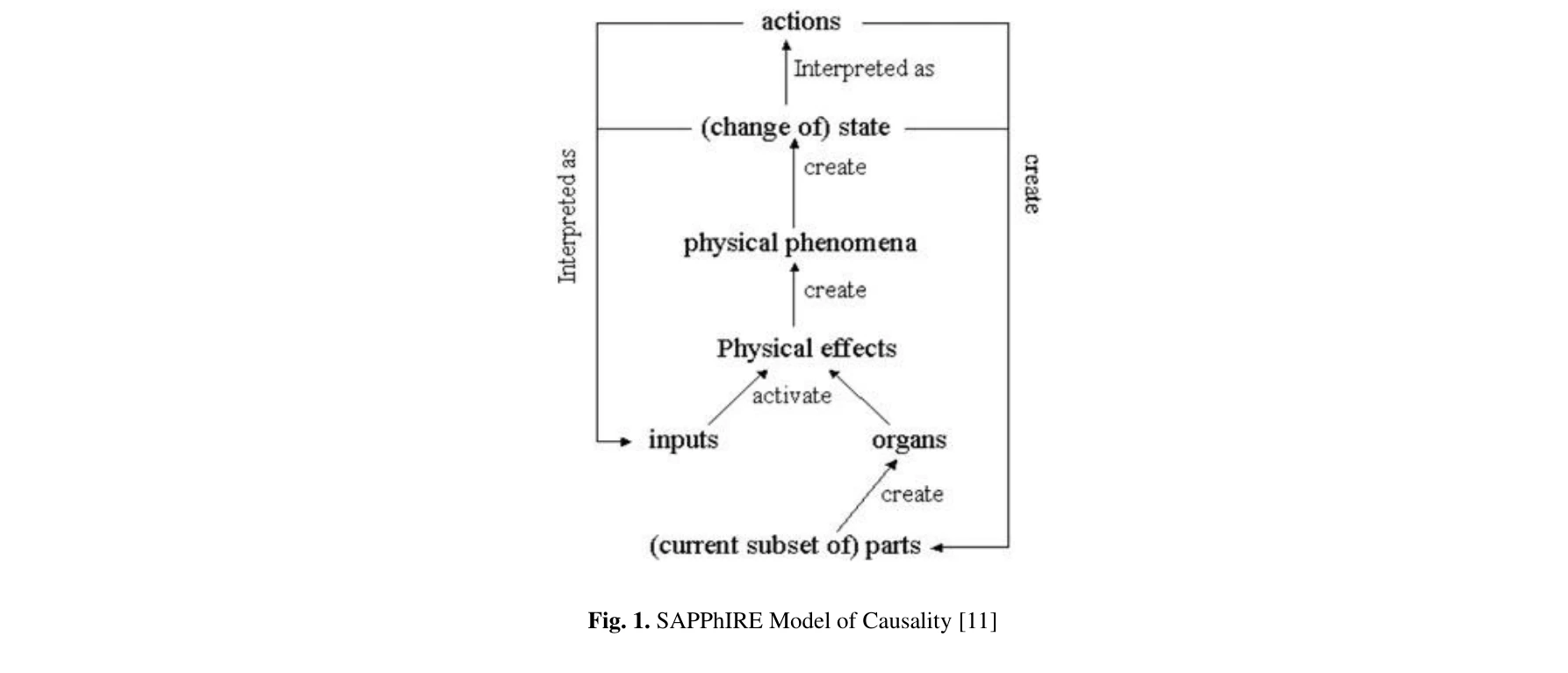

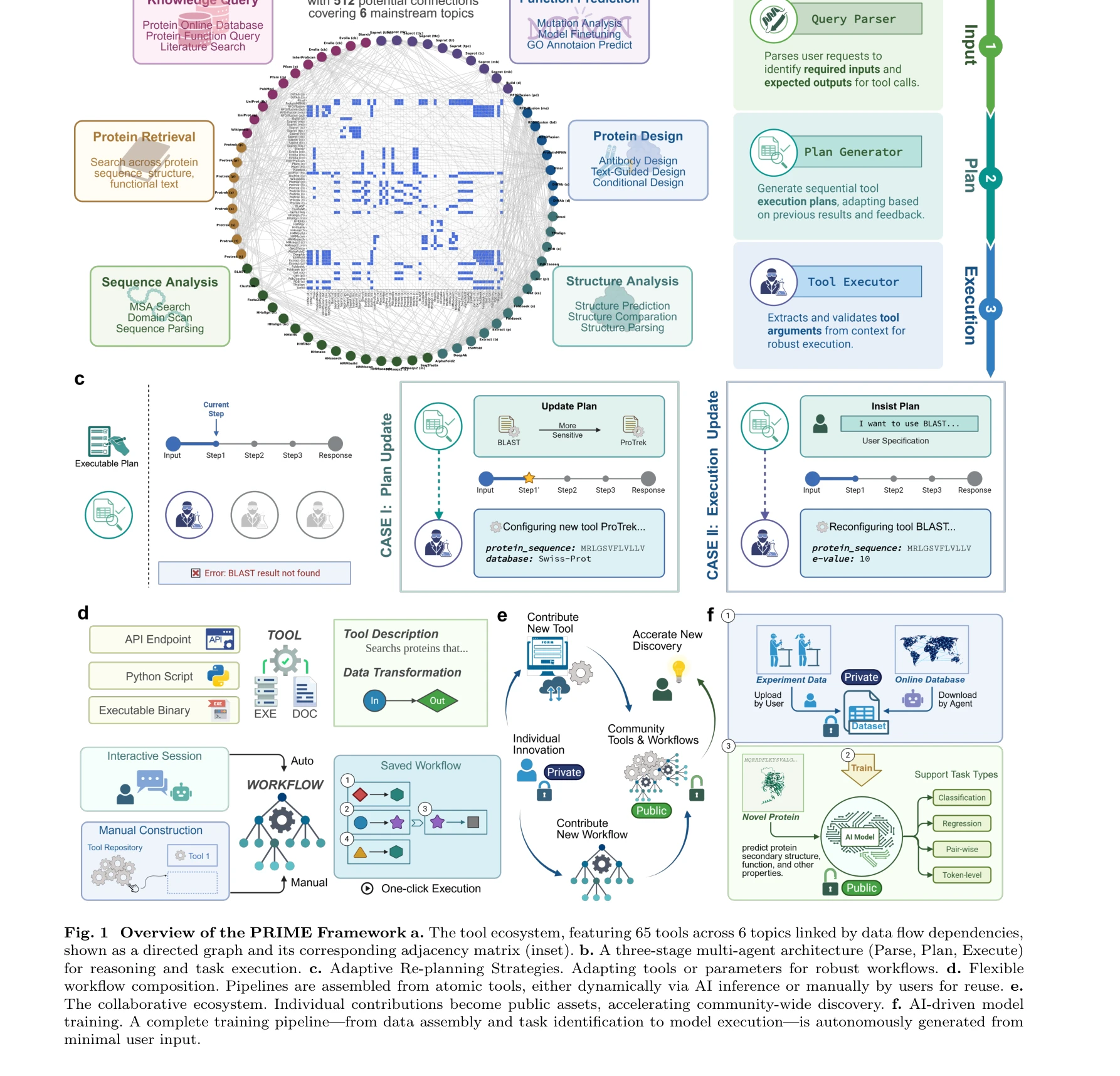

SciToolAgent: a knowledge-graph-driven scientific agent for multitool integration

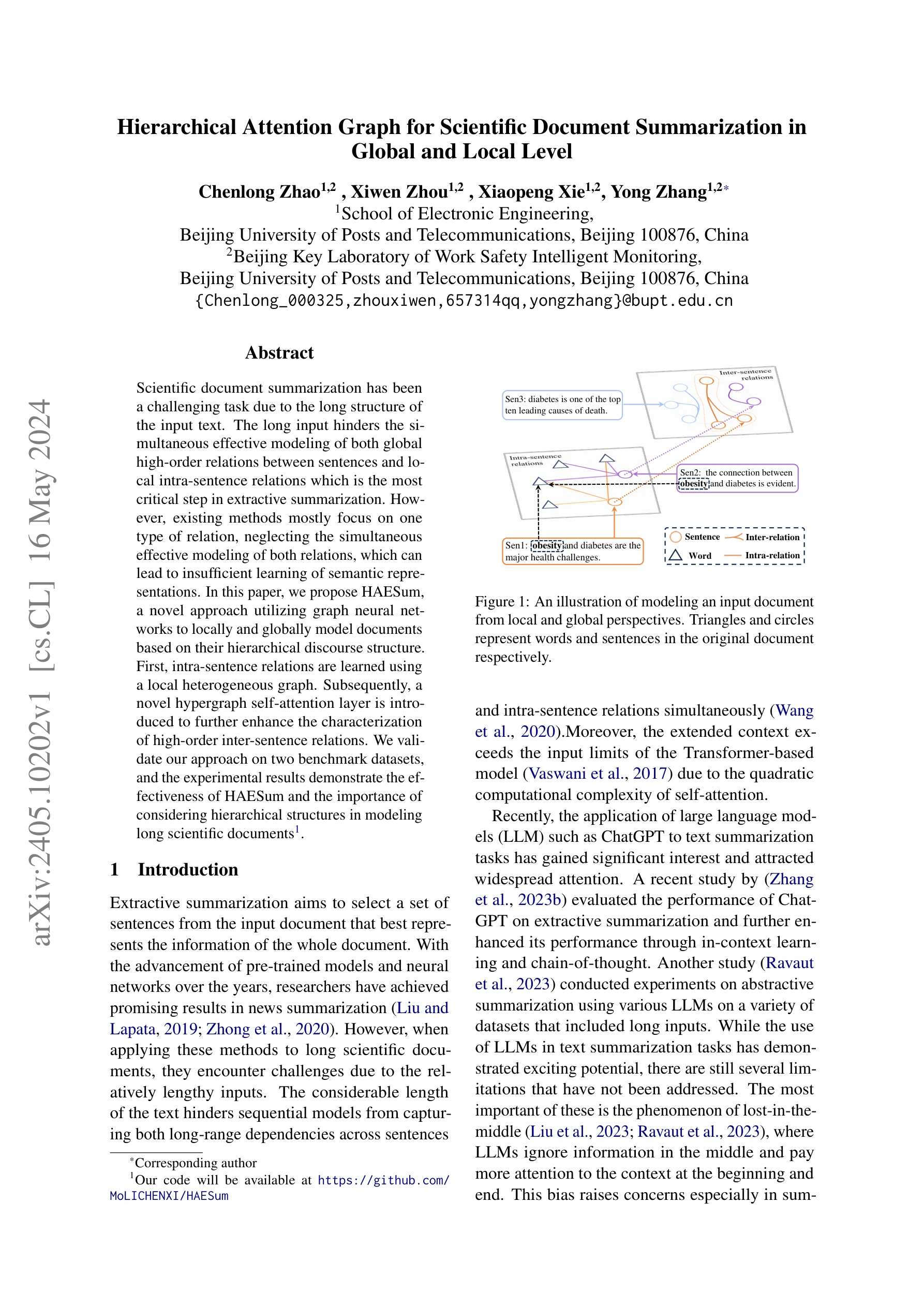

SciToolAgent의 전체 개요: (a) 다양한 생물학, 화학, 재료과학 도구 포함, (b) 도구 간 관계를 인코딩한 SciToolKG, (c) 계획-실행-요약의 LLM 기반 워크플로우

*SciToolAgent의 전체 개요: (a) 다양한 생물학, 화학, 재료과학 도구 포함, (b) 도구 간 관계를 인코딩한 SciToolKG, (c) 계획-실행-요약의 LLM 기반 워크플로우* 본 논문은 대규모 언어 모델(LLM)을 과학 도구 지식 그래프(SciToolKG)와 통합하여 생물학, 화학, 재료과학 등 다양한 분야의 수백 개 과학 도구를 자동으로 활용할 수 있는 지능형 과학 에이전트를 제시한다. 복잡한 다중 도구 과학 워크플로우 자동화에서 기존 방식 대비 10% 이상의 성능 향상을 달성했다.

SciToolAgent는 과학 도구 자동화의 중요한 진전을 보여주는 체계적이고 포괄적인 시스템으로, 지식 그래프 기반 접근과 안전성 고려가 돋보인다. 다만 지식 그래프의 확장성 문제와 더 정교한 오류 처리 메커니즘 개발이 향후 과제이다.

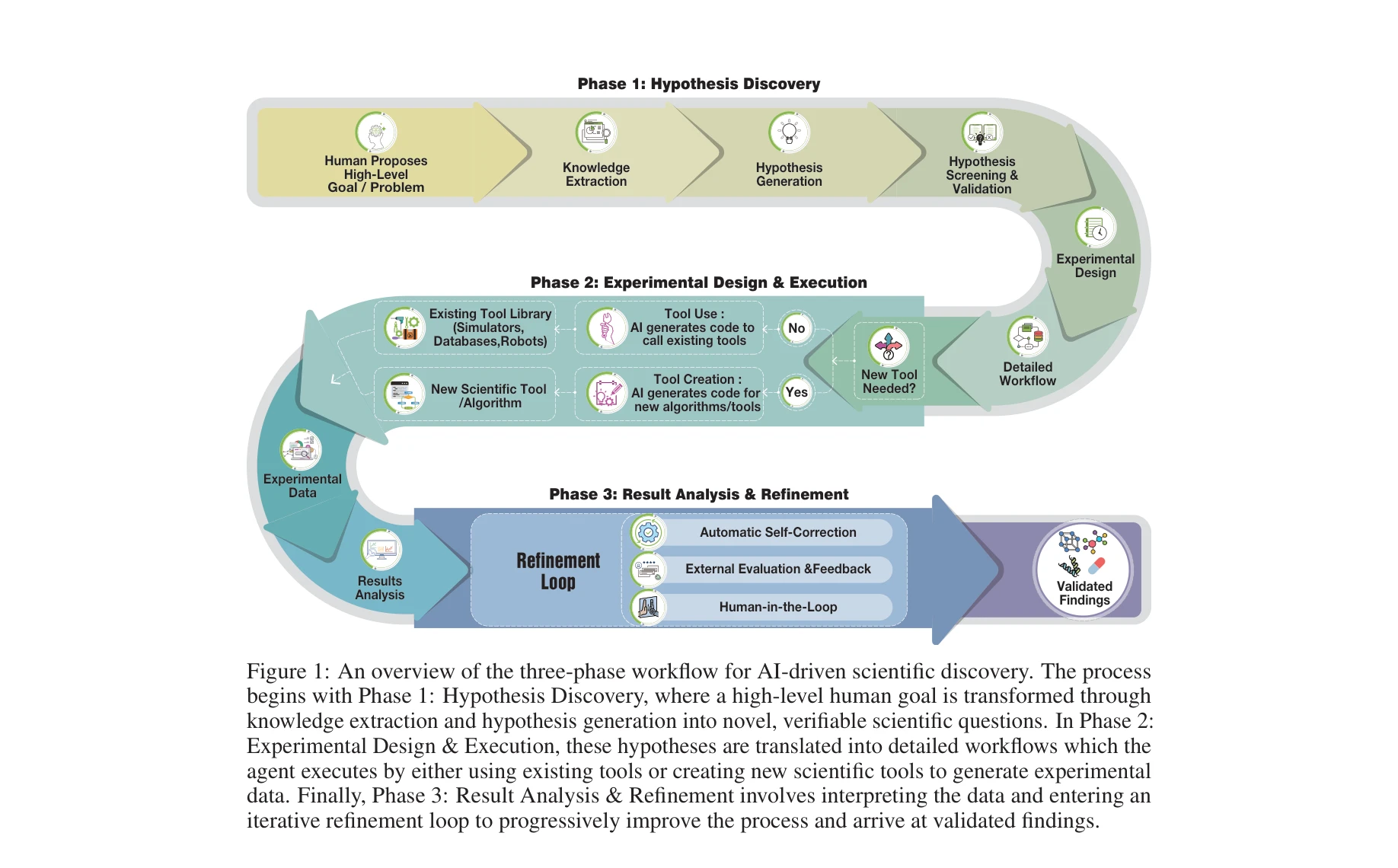

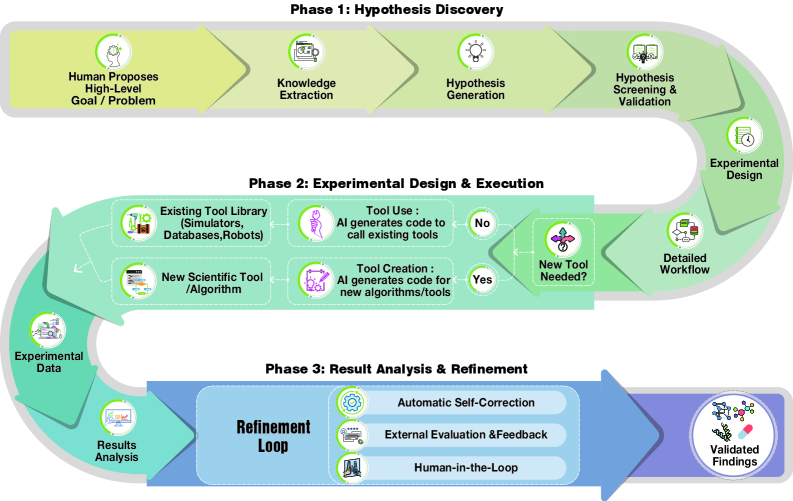

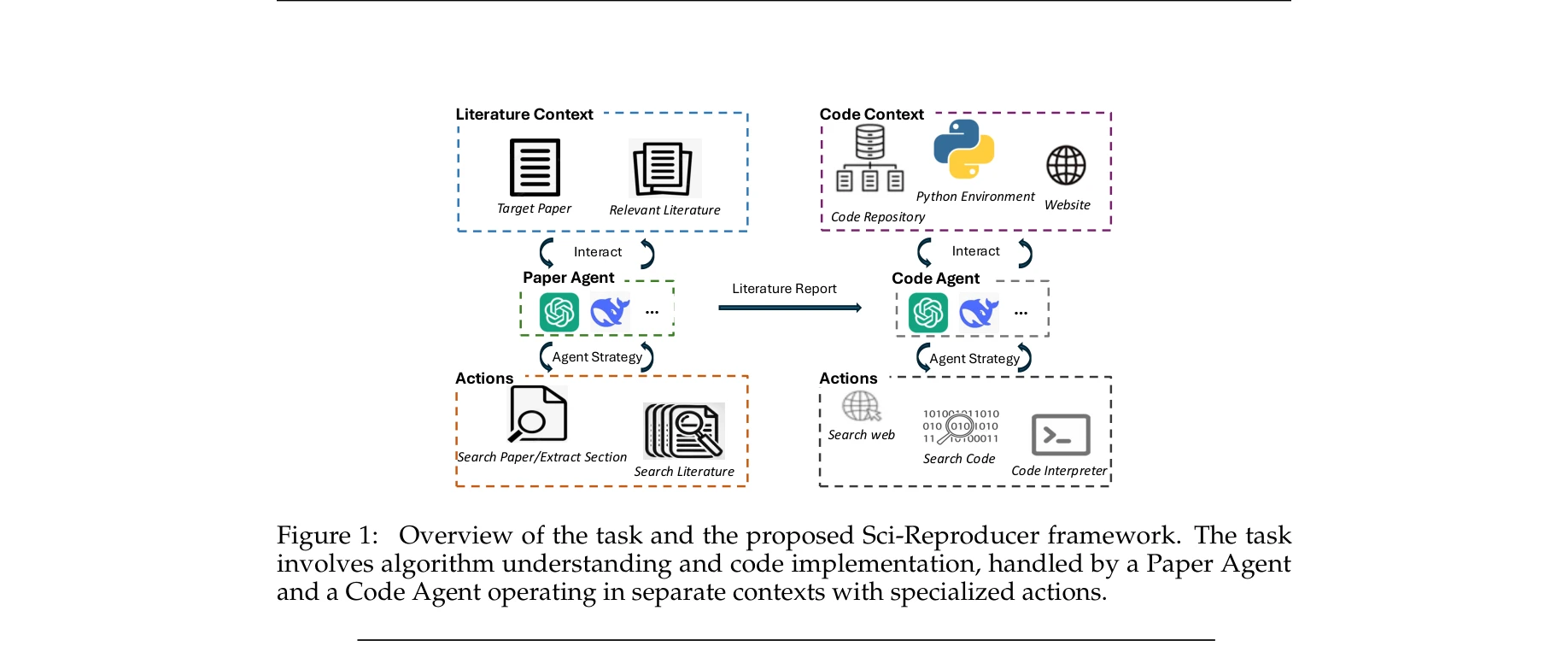

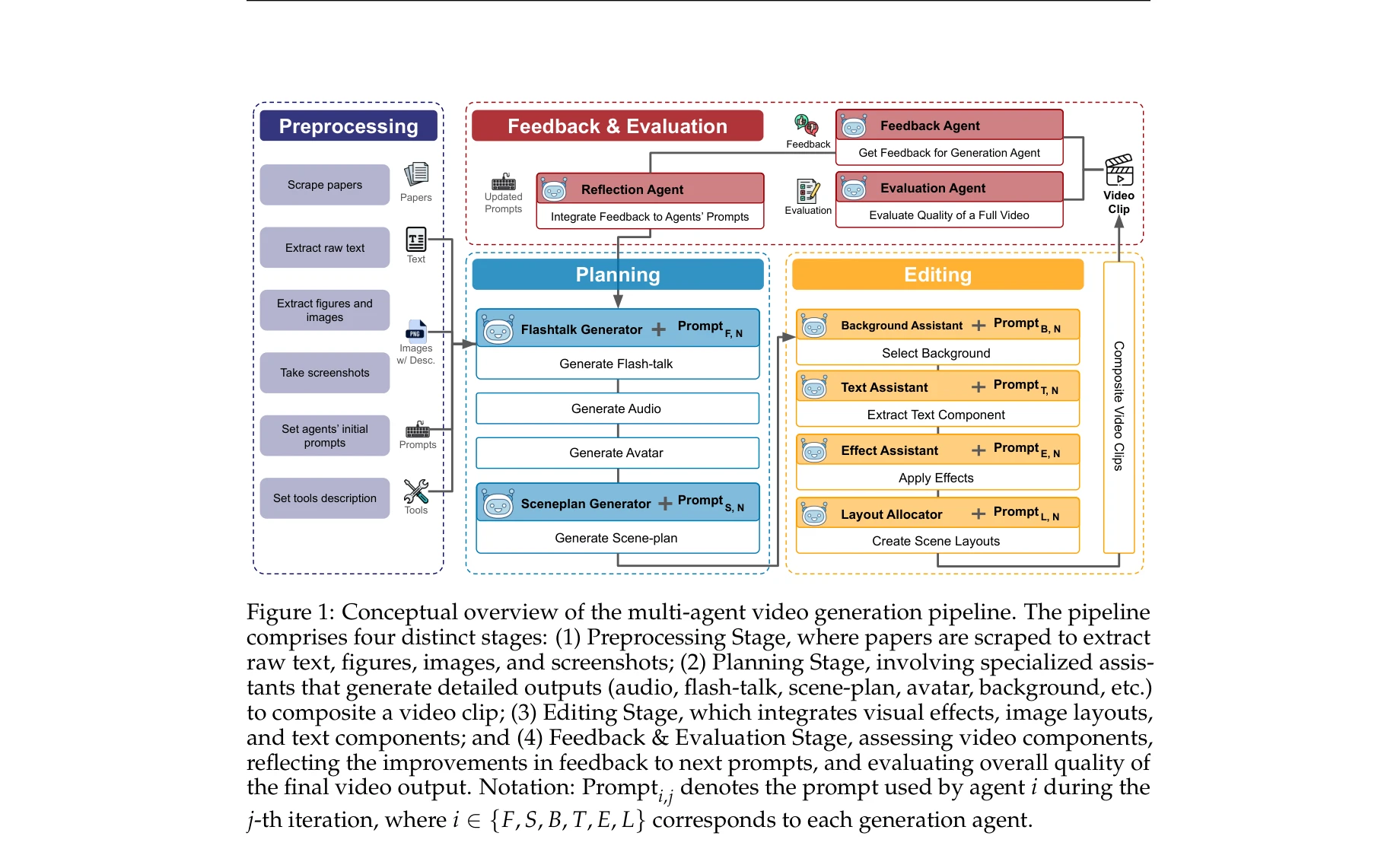

Autonomous Agents for Scientific Discovery: Orchestrating Scientists, Language, Code, and Physics

*그림 1: AI 기반 과학 발견을 위한 3단계 워크플로우 개요. 가설 발견(Phase 1) → 실험 설계 및 실행(Phase 2) → 결과 분석 및 개선(Phase 3)* 대규모 언어 모델(LLM) 기반 자율 에이전트(Scientific Agents)가 과학 발견의 전체 생명주기를 자동화하고 가속화할 수 있는 새로운 패러다임을 제시한다. 이들 에이전트는 자연언어, 프로그래밍 코드, 물리 정보를 통합하여 인간 과학자, 계산 도구, 물리 장비와 유연하게 상호작용한다.

이 논문은 LLM 기반 과학 에이전트의 현황을 가장 포괄적으로 정리한 의미 있는 리뷰 논문으로, 과학 발견의 전체 사이클을 통합하는 프레임워크와 정보이론적 형식화를 제시한 점에서 학술적·실무적 기여가 크다. 다만 상위 아키텍처의 통합보다는 기존 방법들의 조직적 분류에 무게가 있으며, 제시된 한계점들(일반화 능력, 안전성, 실제 효율성)이 실제 응용 단계에서 얼마나 극복되었는지에 대한 심화 분석이 필요하다.

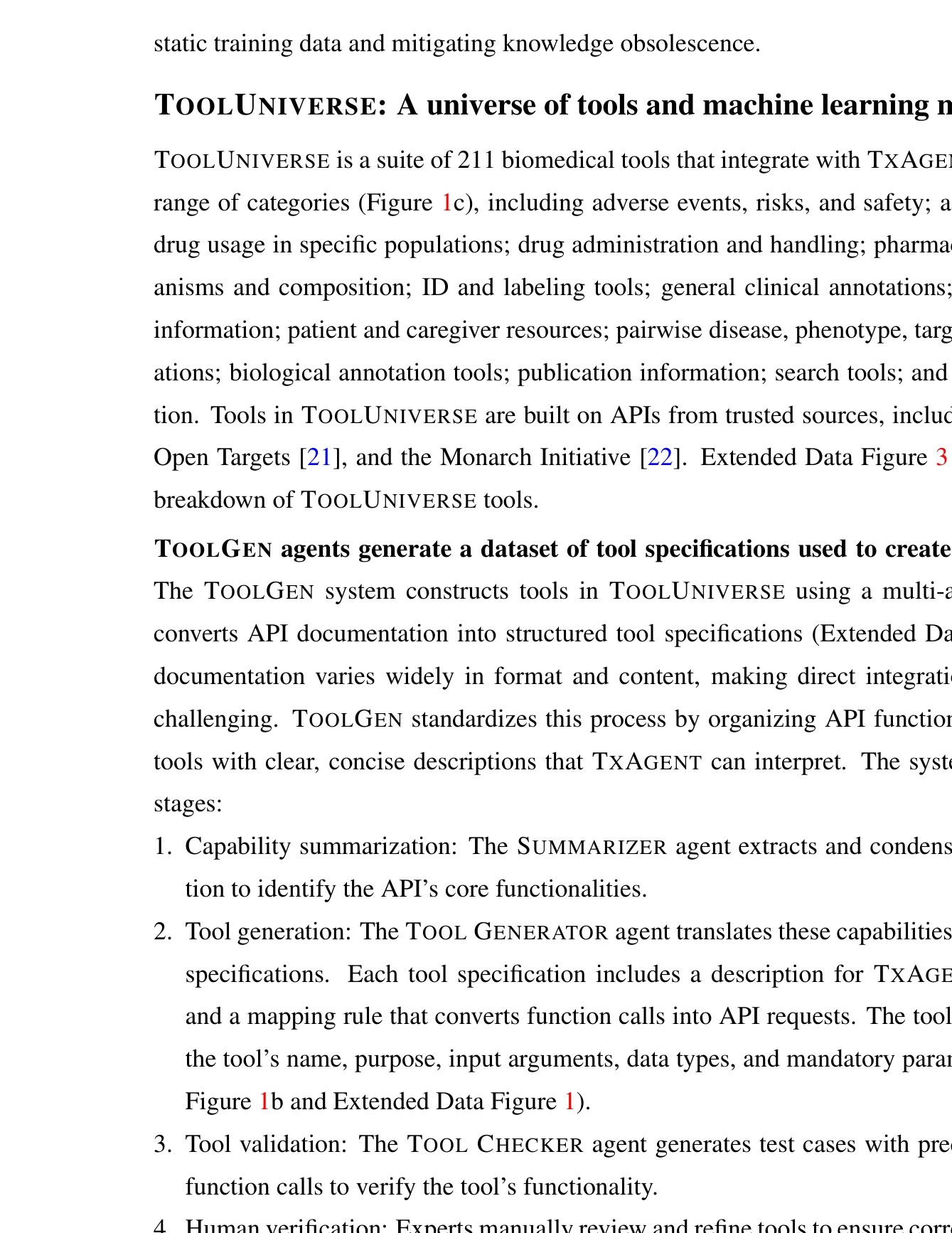

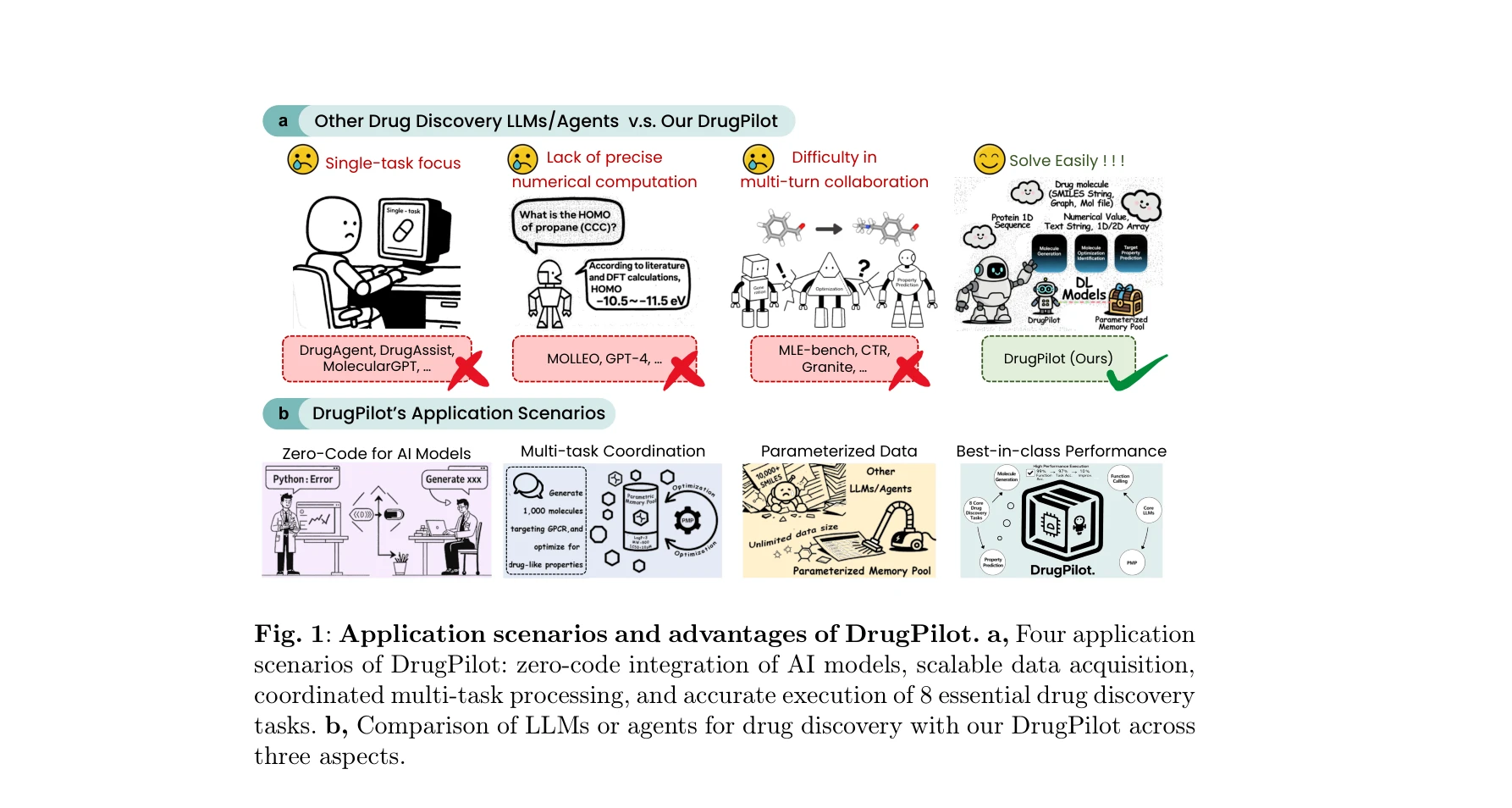

TxAgent: An AI Agent for Therapeutic Reasoning Across a Universe of Tools

정밀 치료(precision therapeutics)를 위해 211개의 생의학 도구(biomedical tools)를 활용한 다단계 추론 AI 에이전트 TxAgent를 제시하며, FDA 승인 약물 정보와 Open Targets 임상 정보를 통합하여 약물 상호작용, 금기사항, 환자별 맞춤 치료 전략을 분석한다.

TxAgent는 대규모 생의학 도구 통합과 다단계 추론 능력으로 약물 치료 추천에서 기존 LLM을 크게 능가하는 의의 있는 성과이며, 정밀 의료 분야에서 즉각적 임상 응용이 가능하나 실제 환자 데이터 기반 임상 검증을 통한 보완이 필수적이다.

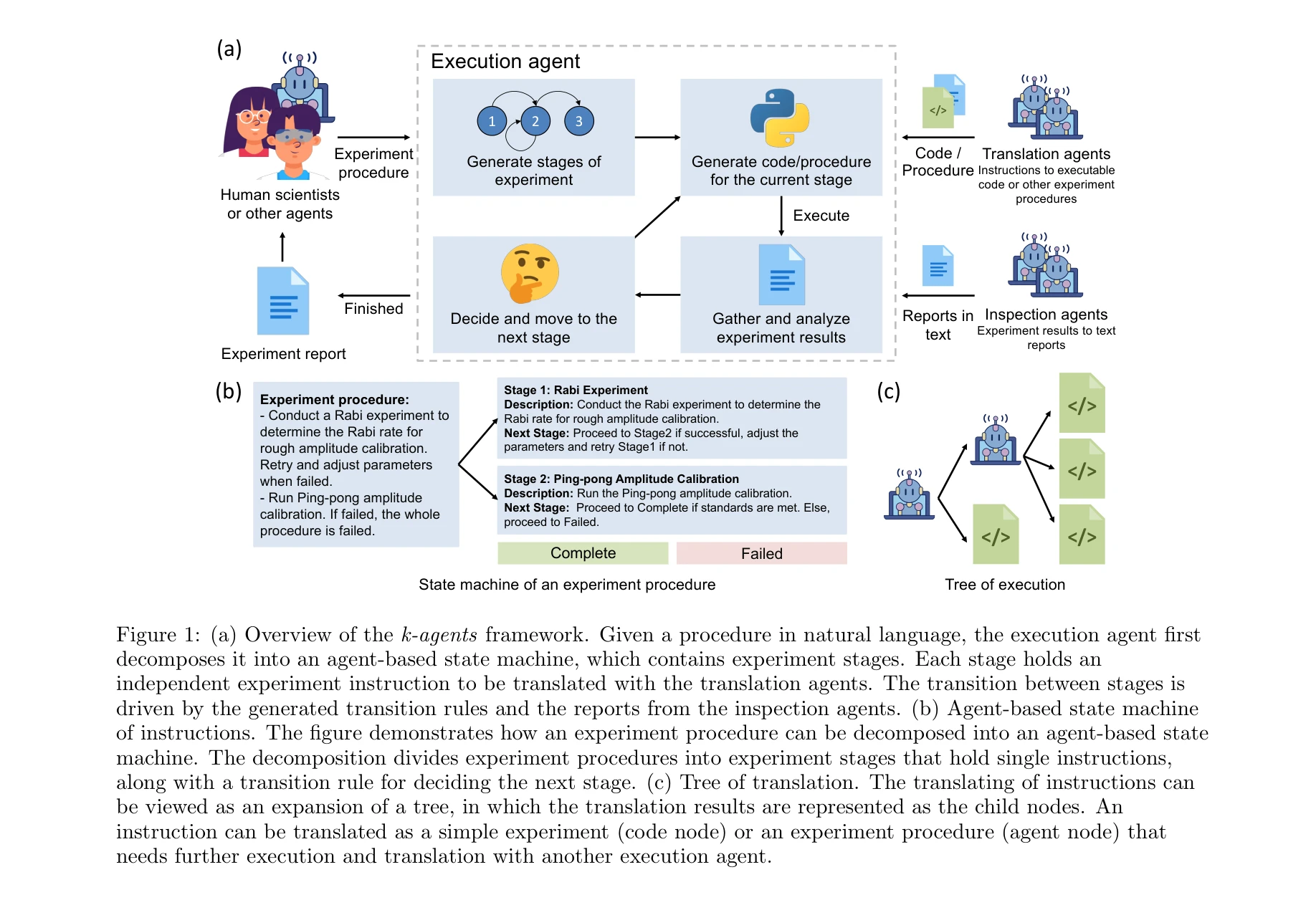

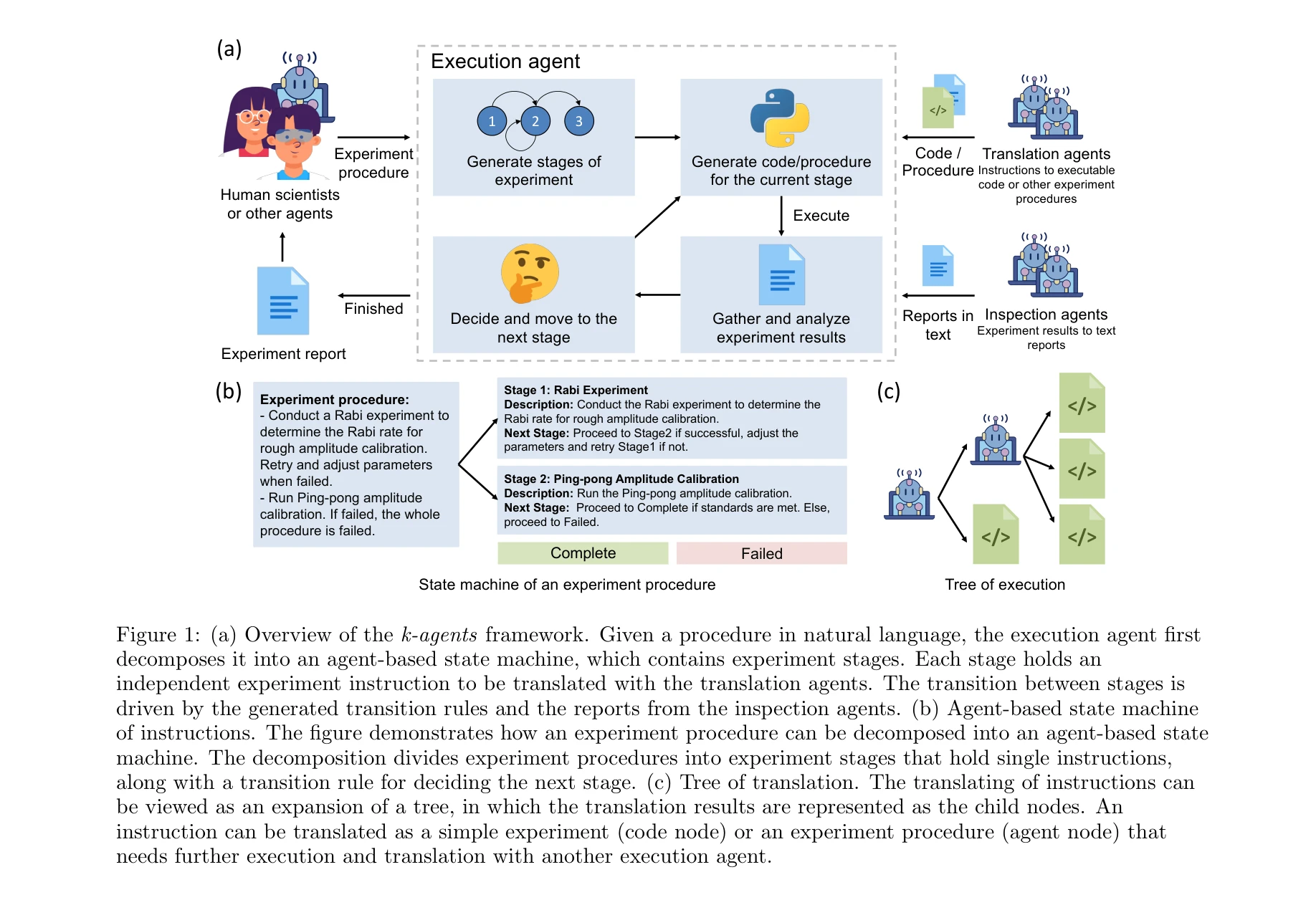

Agents for self-driving laboratories applied to quantum computing

k-agents 프레임워크 개요: 자연언어로 된 절차를 실행 에이전트(execution agent)가 에이전트 기반 상태 머신으로 분해하여 실행

*k-agents 프레임워크 개요: 자연언어로 된 절차를 실행 에이전트(execution agent)가 에이전트 기반 상태 머신으로 분해하여 실행* 본 연구는 대규모 멀티모달 실험실 지식과 복잡한 워크플로우를 자동화하기 위해 LLM 기반 에이전트 시스템인 k-agents를 개발했다. 초전도 양자 프로세서의 캘리브레이션과 얽힌 양자상태 생성을 통해 인간 수준의 자동화 성능을 입증했다.

본 논문은 LLM 기반 에이전트를 실제 양자 실험실 자동화에 성공적으로 적용한 의미 있는 연구로, 에이전트 기반 상태 머신과 선택적 활성화 에이전트 시스템은 기술적 기여도가 높다. 다만 평가 규모 확대 및 타 분야 일반화 검증이 필요하다.

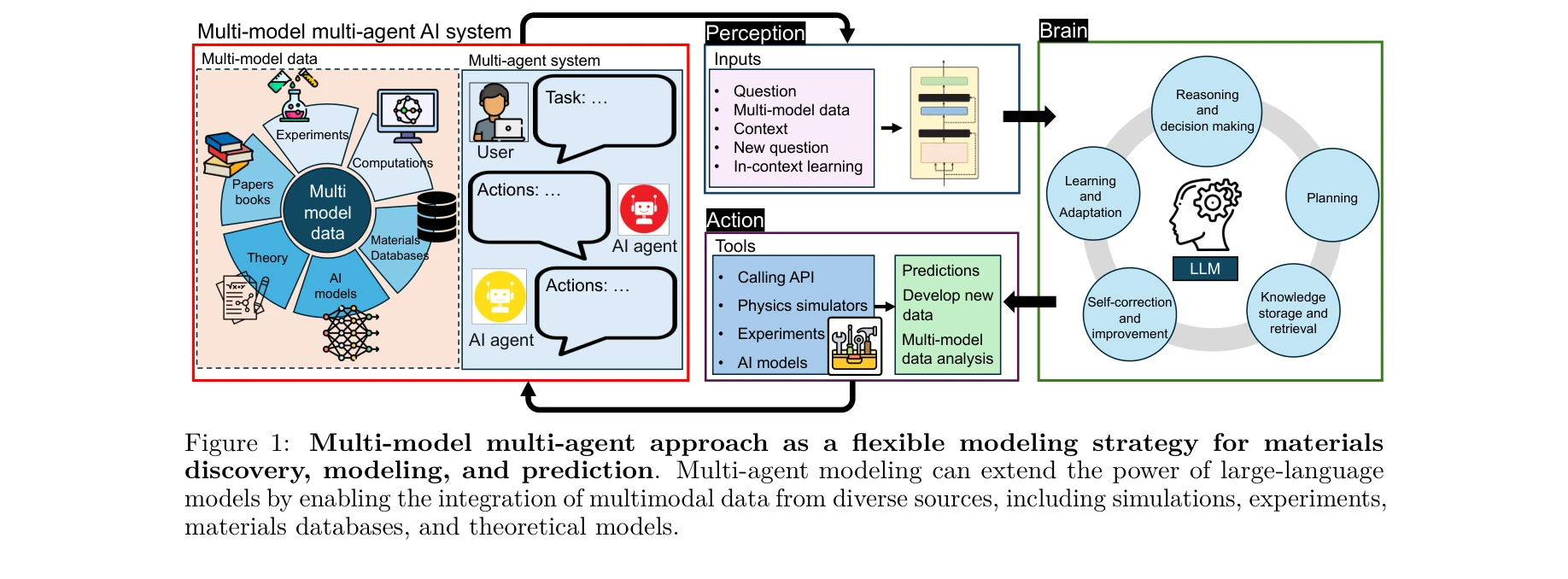

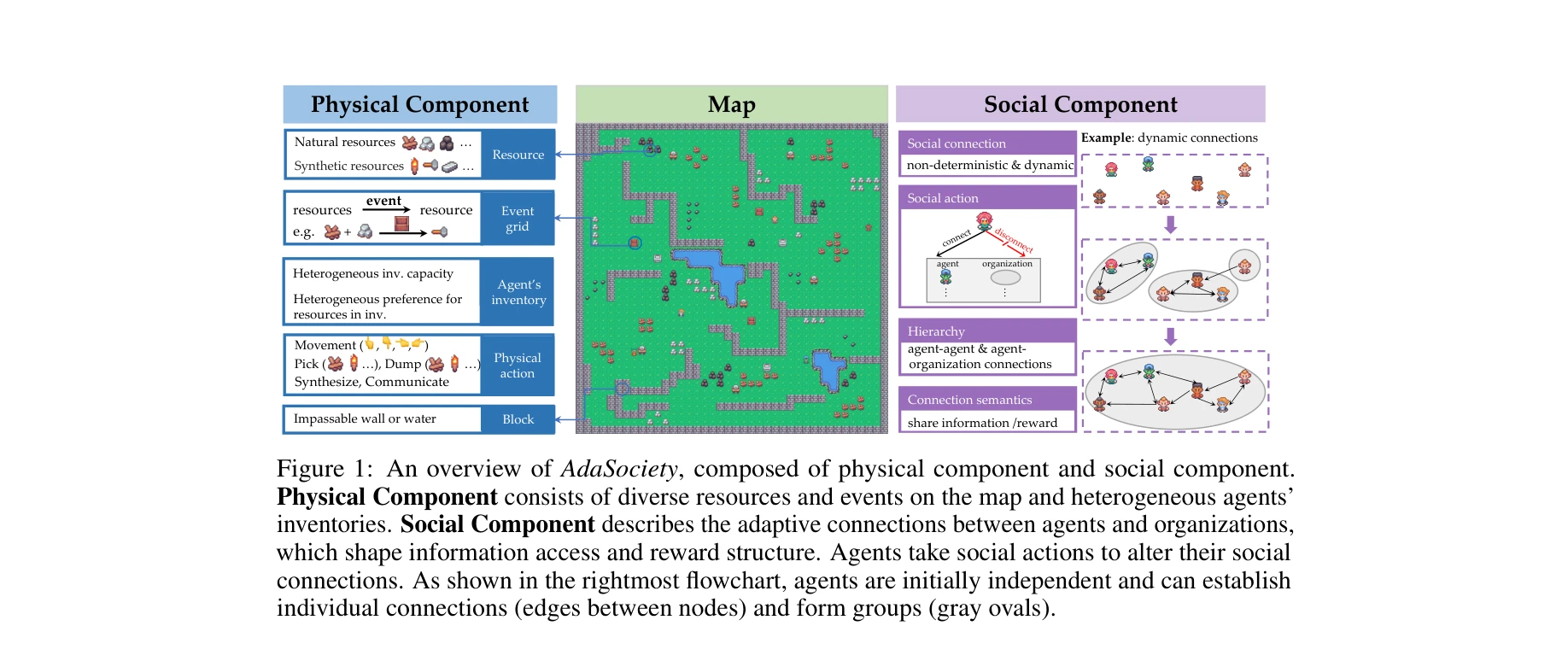

AtomAgents: Alloy design and discovery through physics-aware multi-modal multi-agent artificial intelligence

*다중 모달 다중 에이전트 접근법의 개념도: 시뮬레이션, 실험, 재료 데이터베이스, 이론 모델 등 다양한 소스의 다중 모달 데이터를 통합* 본 논문은 대규모 언어 모델(LLM)과 물리 기반 시뮬레이션을 결합한 다중 에이전트 AI 시스템(AtomAgents)을 제안하여, 합금 설계 및 발견 과정을 자동화하고 인간 개입을 최소화하면서도 물리적 정확성을 유지하는 혁신적인 접근법을 제시한다.

본 논문은 생성형 AI와 물리 기반 과학 계산의 의미 있는 통합을 시도한 중요한 선행 연구로, 재료 과학의 자동화와 대민족 접근성 향상에 실질적 기여를 한다. 다만 대규모 실계(real-world) 검증, 오류 처리 메커니즘 강화, 다양한 재료 시스템으로의 확장성 입증이 추가로 필요하다.

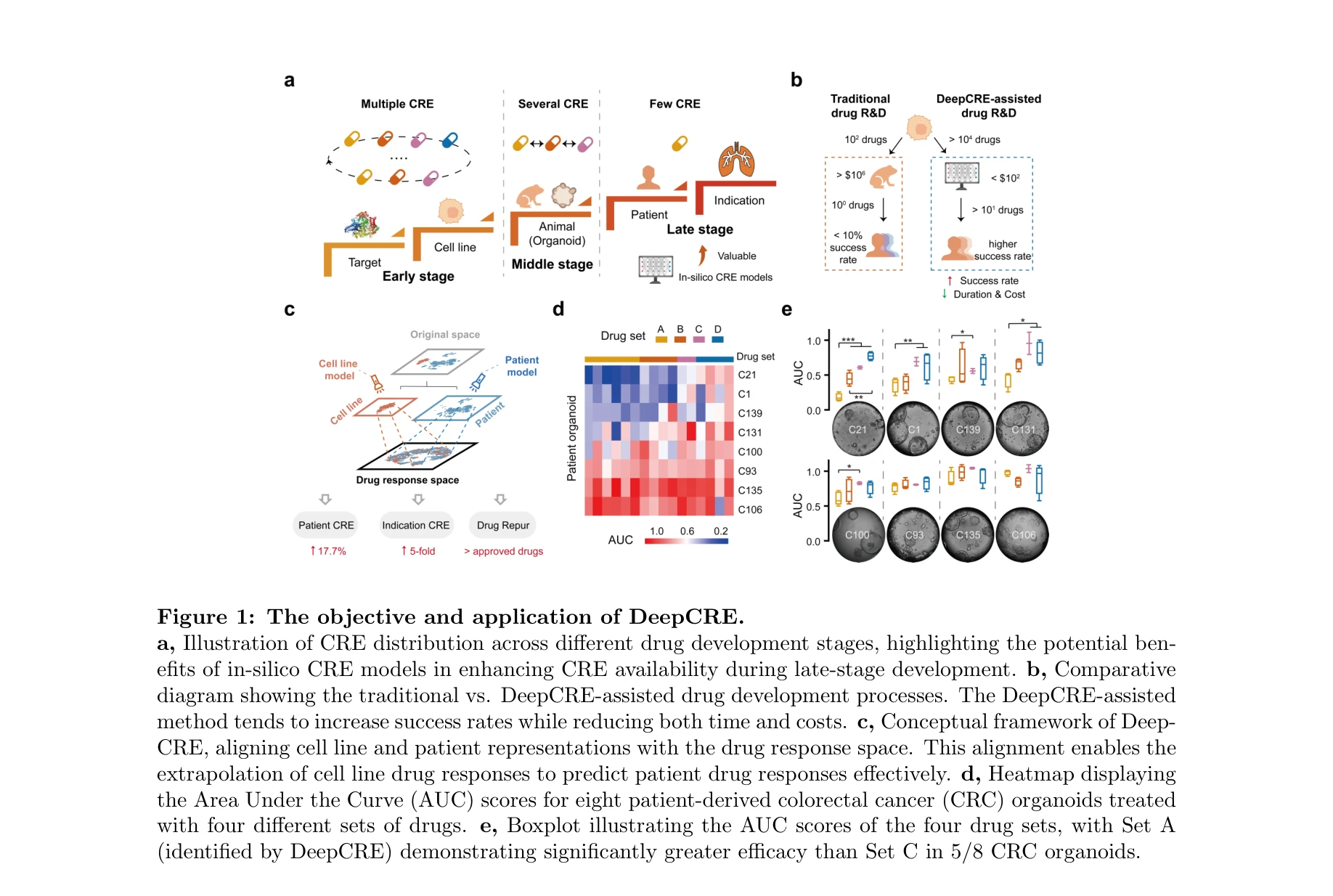

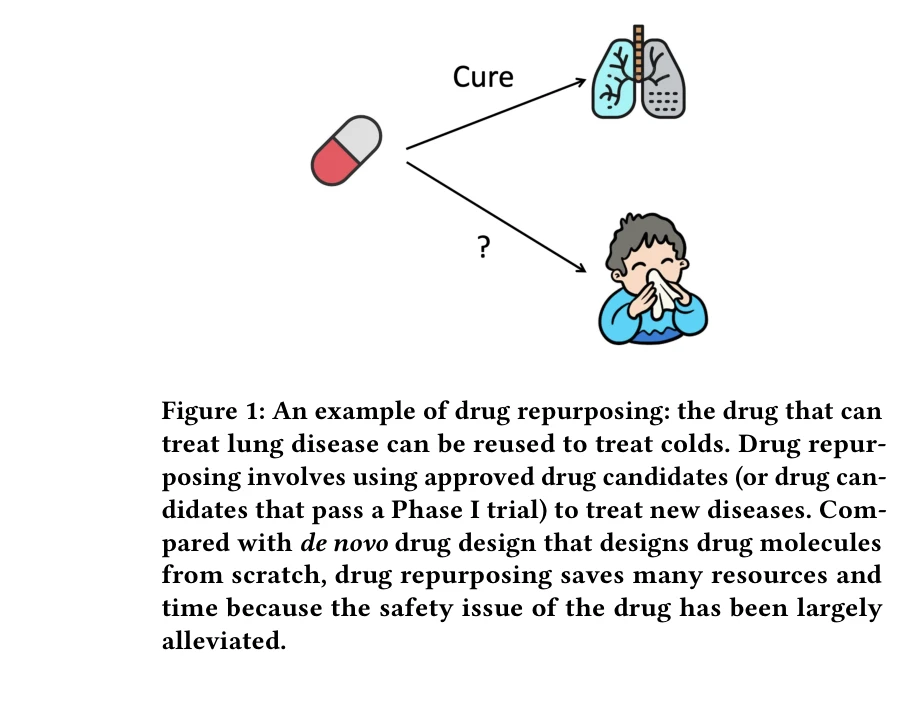

DeepCRE: Transforming Drug R&D via AI-Driven Cross-drug Response Evaluation

*약물 R&D 과정의 다양한 단계에서 교차 약물 반응 평가(CRE)의 역할* DeepCRE는 도메인 분리 네트워크(Domain Separation Network, DSN) 기반의 AI 모델로, 세포주 데이터로 학습하여 환자 수준의 약물 반응을 예측함으로써 신약 개발 후기 단계에서의 약물 효과 비교 평가를 가능하게 한다. 이를 통해 기존 모델 대비 17.7% 성능 향상과 5배의 적응증(indication) 수준 개선을 달성했다.

DeepCRE는 도메인 적응 기반의 효과적인 모델로 환자 수준 약물 반응 예측에서 현저한 성능 향상을 달성했으나, 다양한 암 종류 및 대규모 임상 데이터에 대한 추가 검증과 예측 결과의 생물학적 해석 강화가 신약 개발 분야의 실제 혁신으로 이어지기 위해 필수적이다.

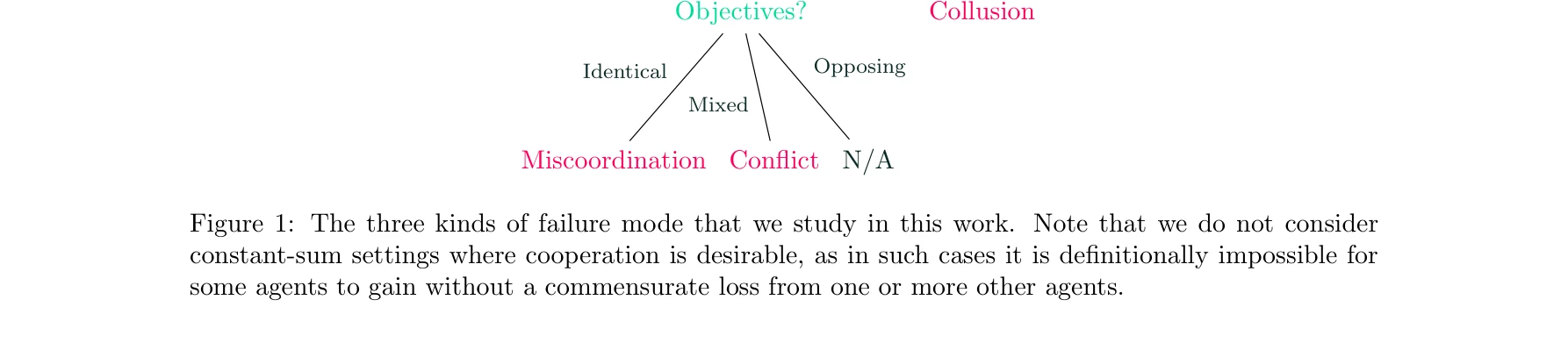

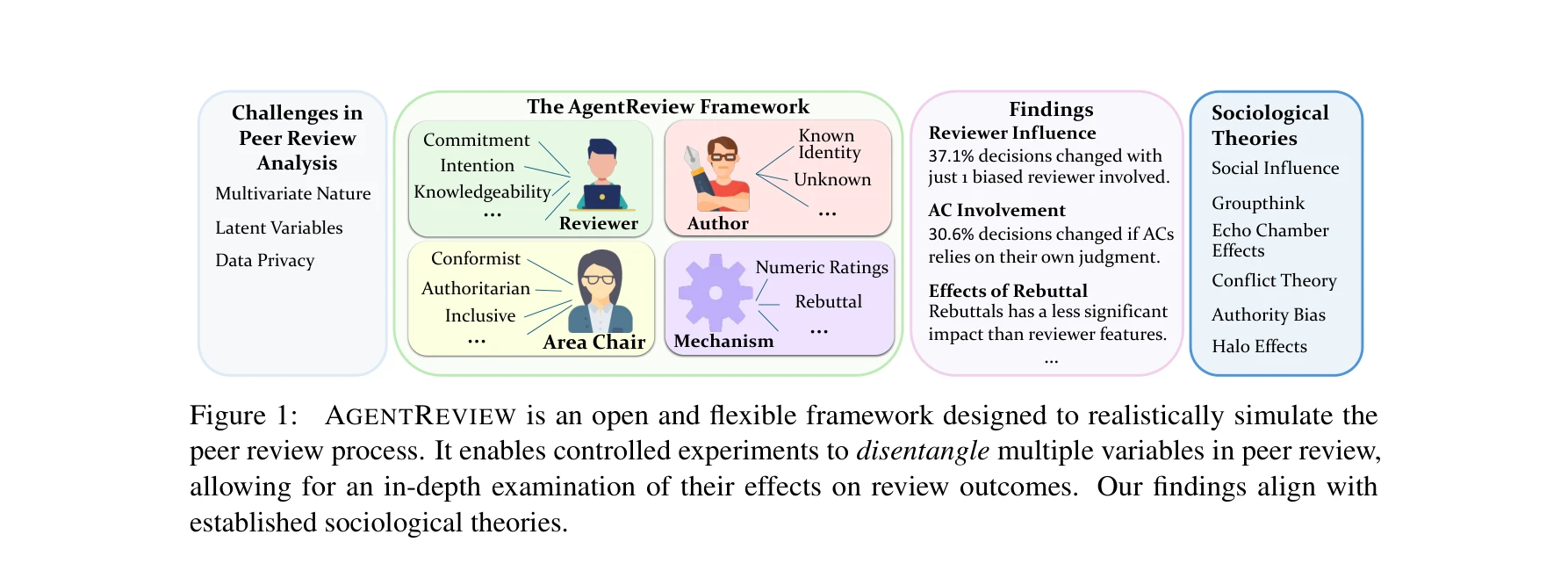

Multi-agent risks from advanced AI

다중 에이전트 AI 시스템의 대규모 배포로 인해 발생하는 새로운 위험들을 체계적으로 분류하고, 3가지 주요 실패 모드(miscoordination, conflict, collusion)와 7가지 위험 요소(information asymmetries, network effects, selection pressures 등)를 제시한 구조화된 분류 체계이다.

본 논문은 급속히 증가하는 다중 에이전트 AI 시스템의 고유한 위험을 처음으로 체계적으로 분류하고, 금융, 군사, 인프라 등 이미 배포 중인 현실 사례를 통해 긴급성을 강조한 중요한 기술 보고서이다. 실증적 기초와 실행 가능한 권장사항을 제시했으나, 정량적 모델링과 구체적 기술적 완화 전략의 깊이는 향후 연구과제로 남아있다.

Polymer Brushes and Grafted Polymers: AI/ML-Driven Synthesis, Simulation, and Characterization towards autonomous SDL

*그래프팅 밀도(grafting density)와 용매 환경에 따른 그래프트 중합체의 구조 변화: 팬케이크(pancake), 버섯(mushroom), 브러시(brush), 고밀도 브러시(high-density brush) 형태* 본 논문은 고밀도 그래프트 중합체(polymer brush)의 합성, 시뮬레이션, 특성분석에 AI/ML 워크플로우를 통합하여, 자율 실험실(self-driving laboratory, SDL)을 통한 고속화 및 최적화를 제안하는 리뷰 논문이다. 인터페이스 화학과 콜로이드 과학의 교집합에서 다양한 응용(마이크로플루이딕스, 센서, 생체 의료용)으로의 전환을 가속화하는 데 중점을 둔다.

본 논문은 고전적인 중합체 과학 분야에 AI/ML과 자율 실험실 개념을 유입하여 패러다임 전환을 제시하는 중요한 리뷰 논문이다. 특히 다중 특성분석 기법의 통합, 데이터-피드백-실험 자동화, 산업 응용의 가속화라는 세 가지 핵심 가치를 명확히 하고 있다. 다만 구체적인 AI/ML 알고리즘 구현 사례, 성능 검증 데이터, 자율 실험실 프로토타입의 세부 사항이 부족하여, 후속 연구에서 이러한 요소들의 구체적 실현이 절실히 요구된다.

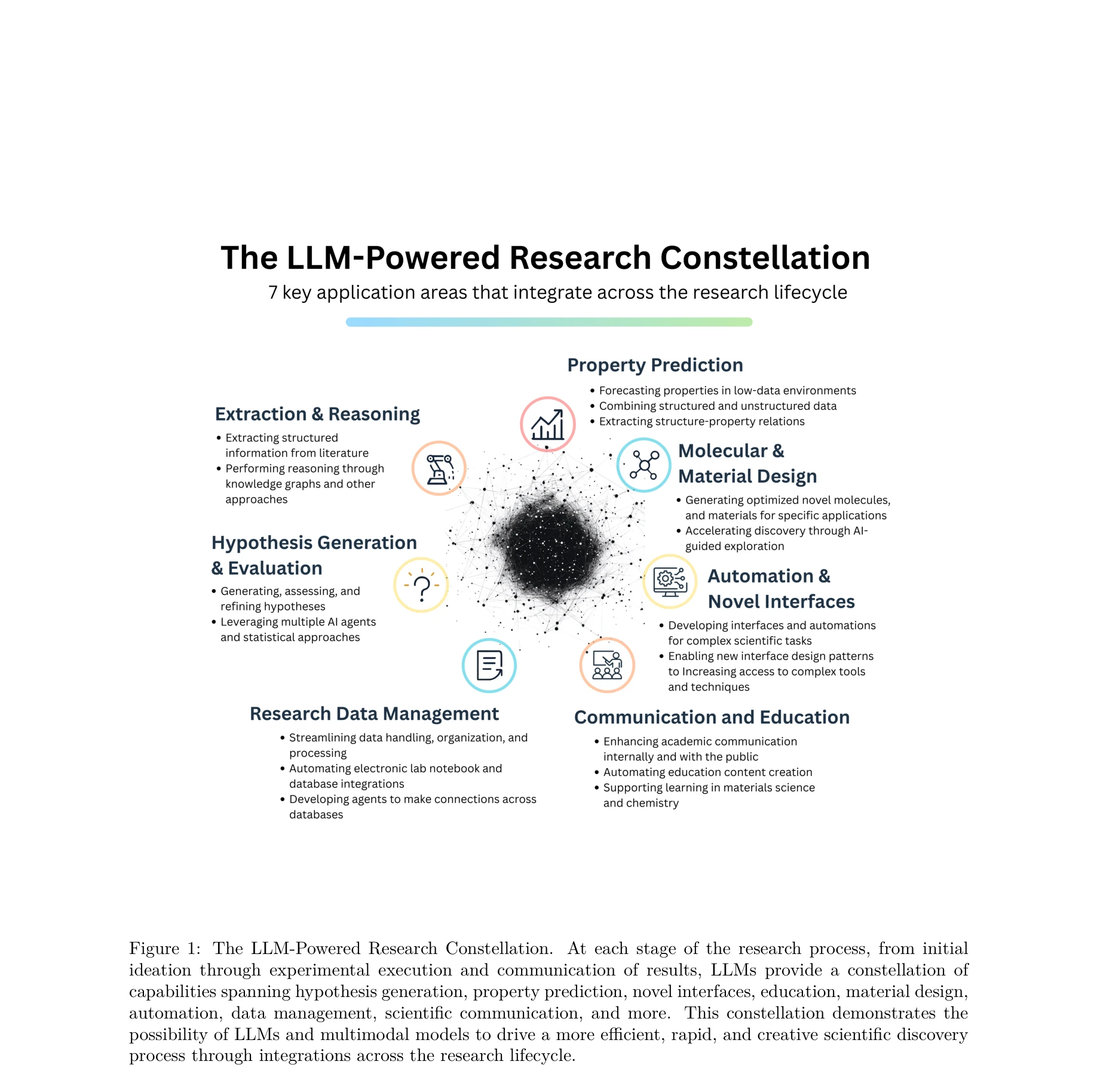

34 examples of llm applications in materials science and chemistry: Towards automation, assistants, agents, and accelerated scientific discovery

Figure 1: The LLM-Powered Research Constellation. At each stage of the research process, from initial

*Figure 1: The LLM-Powered Research Constellation. At each stage of the research process, from initial* 재료과학과 화학 분야에서 대규모 언어모델(LLM)의 34가지 응용 사례를 분석하여 자동화, 어시스턴트, 에이전트 및 가속화된 과학 발견을 위한 LLM의 역할을 제시한다.

본 논문은 재료과학·화학 분야에서 LLM의 광범위한 응용 사례를 체계적으로 분석하여 AI 기반 과학 발견의 가능성을 명확히 보여준다. 다만 신뢰성, 해석가능성, 재현성 등의 근본적 과제 해결이 실제 과학 워크플로우 통합의 선결 조건이다.

Automating quantum computing laboratory experiments with an agent-based AI framework

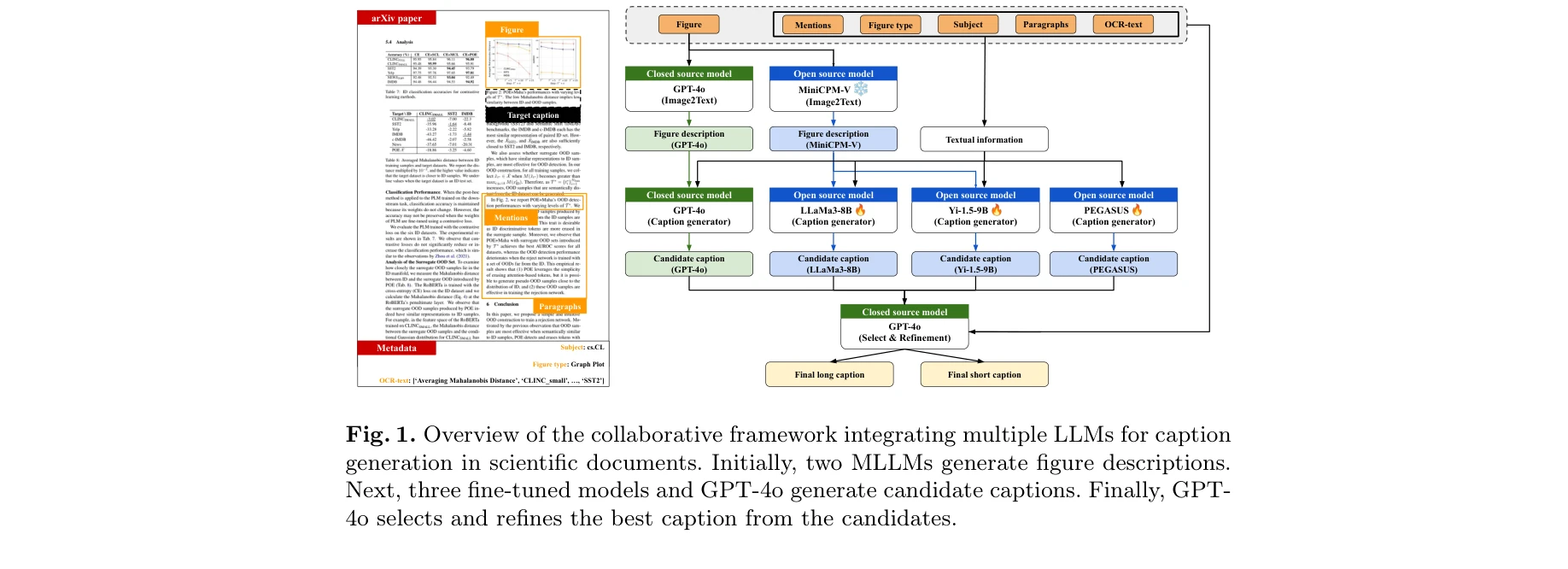

그림 1: k-agents 프레임워크의 개요. 자연언어로 된 절차가 주어지면, 실행 에이전트가 이를 에이전트 기반 상태 머신으로 분해한다.

*그림 1: k-agents 프레임워크의 개요. 자연언어로 된 절차가 주어지면, 실행 에이전트가 이를 에이전트 기반 상태 머신으로 분해한다.* 본 논문은 대규모 언어모델(LLM) 기반 다중 에이전트 시스템인 **k-agents 프레임워크**를 제안하여, 양자 컴퓨팅 실험실의 자동화를 실현한다. 특히 다단계 실험 절차를 상태 머신으로 분해하고 폐루프 피드백 제어를 통해 초전도 양자 프로세서의 캘리브레이션과 얽힌 양자상태 생성을 자동으로 수행한다.

본 논문은 LLM 기반 다중 에이전트 시스템을 양자 실험실 자동화에 창의적으로 적용하여, 인간 수준의 실험 수행 능력을 입증했다는 점에서 높은 가치를 지닌다. 특히 에이전트 기반 상태 머신과 벡터 기반 에이전트 선택은 복잡한 실험실 자동화의 확장성 문제를 해결하는 우수한 접근이다. 다만 타 분야 일반화 검증과 알고리즘의 이론적 근거가 강화된다면 더욱 영향력 있는 작업이 될 것이다.

Hunt Globally: Wide Search AI Agents for Drug Asset Scouting in Investing, Business Development, and Competitive Intelligence

Figure 1: 자산 스카우팅의 품질-시간 트레이드오프. y축: F1-score (높을수록 좋음), x축: 벽시계 시간(로그 척도)

글로벌 제약 산업에서 미국 외 지역(특히 중국)의 신약 자산이 지역 언어, 비영어 채널을 통해 공개됨에 따라, 다국어 멀티에이전트 파이프라인과 완전성(Completeness) 중심의 벤치마크를 구축하고, 이를 기반으로 한 Bioptic Agent를 제안하여 기존 Deep Research AI를 크게 초과하는 성능을 달성했다.

이 논문은 제약 산업의 글로벌화된 현실(비영어권 신약 자산의 증가)을 정확히 포착하여, 역방향 벤치마크 설계와 투자자 행동 기반 쿼리 생성이라는 독창적 방법론으로 완전성 중심의 평가 체계

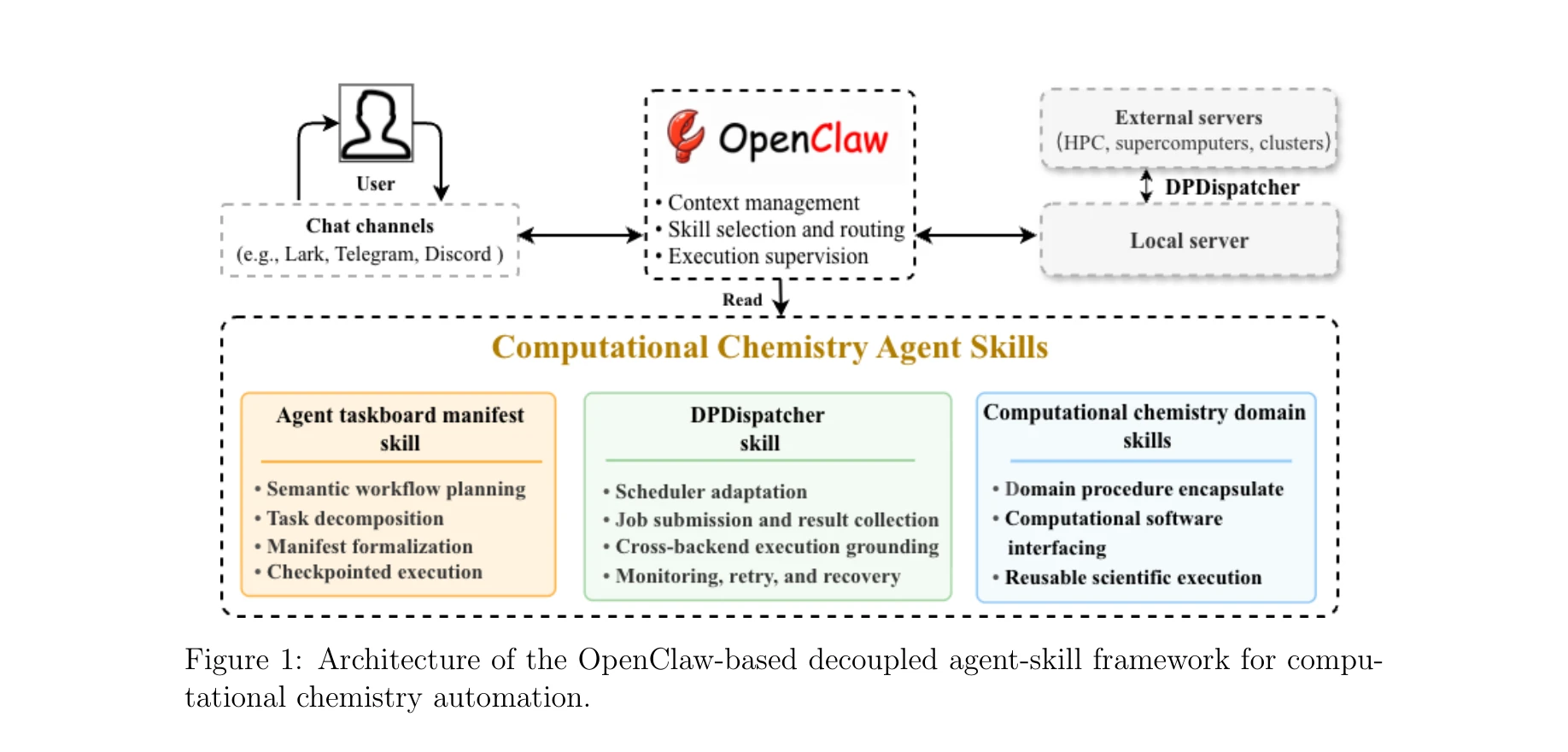

Automating Computational Chemistry Workflows via OpenClaw and Domain-Specific Skills

OpenClaw는 중앙 제어와 감독을 제공하고, 스키마 정의 계획 스킬이 과학적 목표를 실행 가능한 작업 명세로 변환하며, 도메인 스킬이 계산화학 절차를 캡슐화하고, DPDispatcher가 이질적 HPC 환경에서 작업 실행을 관리한다.

본 논문은 **OpenClaw를 기반으로 한 분리된(decoupled) 에이전트-스킬(agent-skill) 설계**를 통해 다단계 계산화학 작업의 자동화를 달성한다. 일반 목적의 대언어모델 기반 에이전트가 추론과 조정을 담당하고, 재사용 가능한 도메인 스킬이 구체적인 화학 계산 절차를 캡슐화하여 확장성과 유지보수성이 높은 시스템을 실현했다.

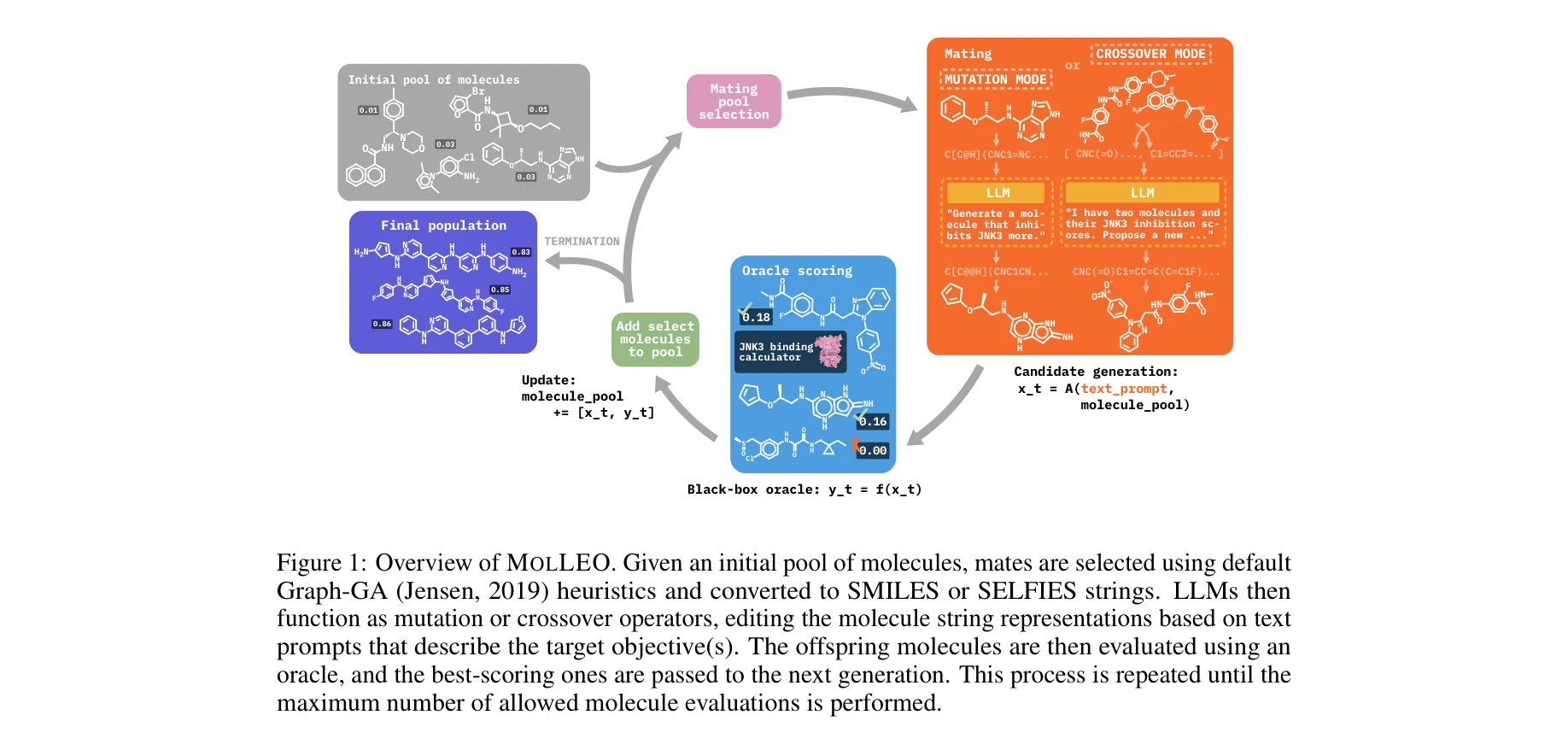

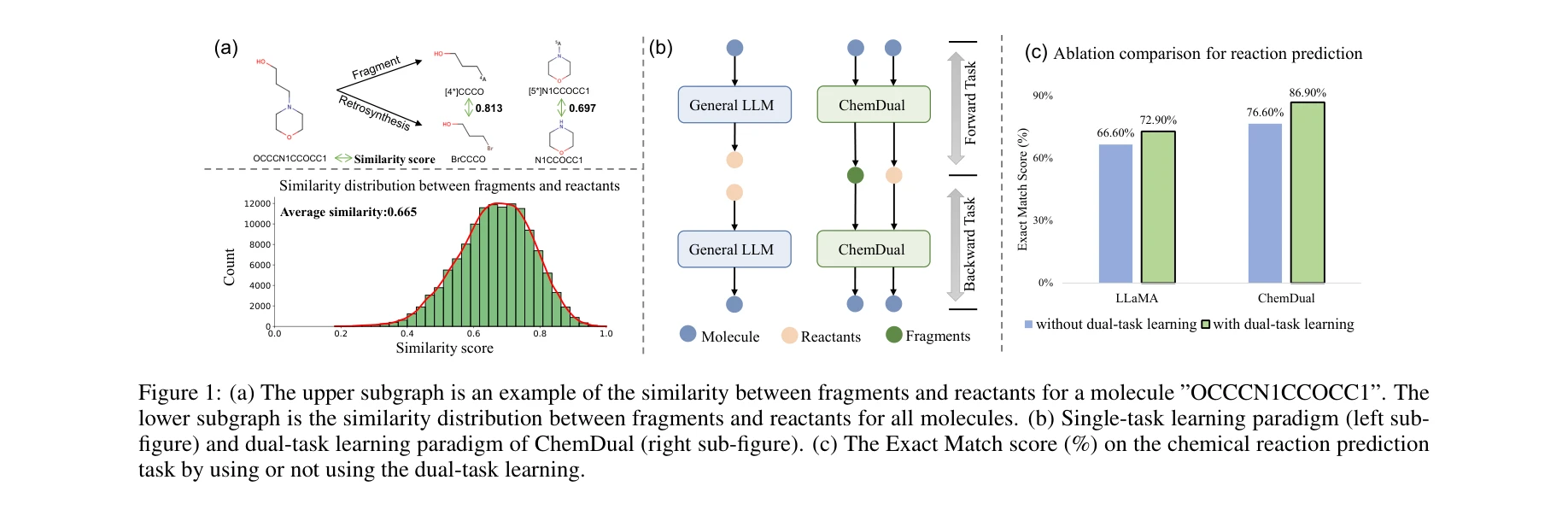

Efficient Evolutionary Search Over Chemical Space with Large Language Models

*MOLLEO 프레임워크 개요: 초기 분자 풀에서 출발하여 LLM을 교차(crossover) 및 돌연변이(mutation) 연산자로 활용하는 진화 알고리즘* 대규모 언어모델(LLM)을 진화 알고리즘(EA)의 유전 연산자로 통합하여 화학 공간 탐색의 효율성을 획기적으로 향상시키는 MOLLEO 프레임워크를 제안한다. 이는 검은 상자 분자 최적화 문제에서 필요한 목적 함수 평가 횟수를 대폭 감소시킨다.

MOLLEO는 LLM과 EA의 시너지를 체계적으로 입증한 혁신적 연구로, 분자 최적화 분야의 샘플 효율성 문제를 실질적으로 해결하며 ICLR 2025 게재 기준의 높은 수준을 충족한다. 다만 실제 산업 적용을 위한 경제성 분석과 프롬프트 최적화 전략의 심화가 후속 과제로 남아있다.

Generative machine learning in adaptive control of dynamic manufacturing processes: A review

동적 제조 프로세스(Dynamic Manufacturing Process)의 적응형 제어를 위해 생성형 머신러닝(Generative Machine Learning)을 통합하는 방법론을 제시하는 종합 리뷰 논문으로, 확률적 이해를 제어 가능한 실행 계획으로 변환하는 제어 지향적 관점을 제공한다.

이 논문은 생성형 머신러닝을 동적 제조 프로세스의 적응형 제어에 통합하는 방법론을 체계적으로 제시하는 중요한 리뷰 논문으로, 제어 지향적 기능 분류 프레임워크와 함께 기존 방식의 한계를 명확히 지적하고 미래 연구 방향을 제안한다. 다만 실증 사례와 구체적 기술 개발 결과를 보강하면 더욱 실용적 가치가 높을 것으로 판단된다.

Fragment and Geometry Aware Tokenization of Molecules for Structure-Based Drug Design Using Language Models

본 논문은 구조 기반 약물 설계(Structure-Based Drug Design, SBDD)를 위해 언어 모델(Language Models, LMs)을 활용하는 새로운 방법인 Frag2Seq를 제시한다. SE(3)-동변(equivariant) 좌표계를 통해 3D 분자 기하학 정보를 보존하면서 프래그먼트 기반 시퀀스로 변환하고, 단백질 포켓 임베딩을 교차 주의(cross-attention)로 통합하여 표적 단백질에 높은 결합 친화도를 가진 약물 유사 리간드를 효율적으로 생성한다.

본 논문은 SE(3)-동변 이론을 기반으로 3D 분자 기하학을 보존하면서 언어 모델을 SBDD에 최초로 프래그먼트 단위로 적용한 창의적인 접근이다. 수학적 근거(Lemma 3.2)와 높은 생성 효율(~300배 속도향상)은 강점이지만, 휴리스틱한 프래그먼트 분해 전략, 단백질 포켓 임베딩의 한계, 그리고 실험 검증의 범위가 제한적인 점은 개선이 필요하다. 향후 더 넓은 스펙트럼의 약물학적 성질 평가와 실험적 검증을 통해 임상 적용 가능성을 입증할 수 있다면 상당한 임팩트를 가질 수 있는 논문이다.

Inference-Time Alignment in Diffusion Models with Reward-Guided Generation: Tutorial and Review

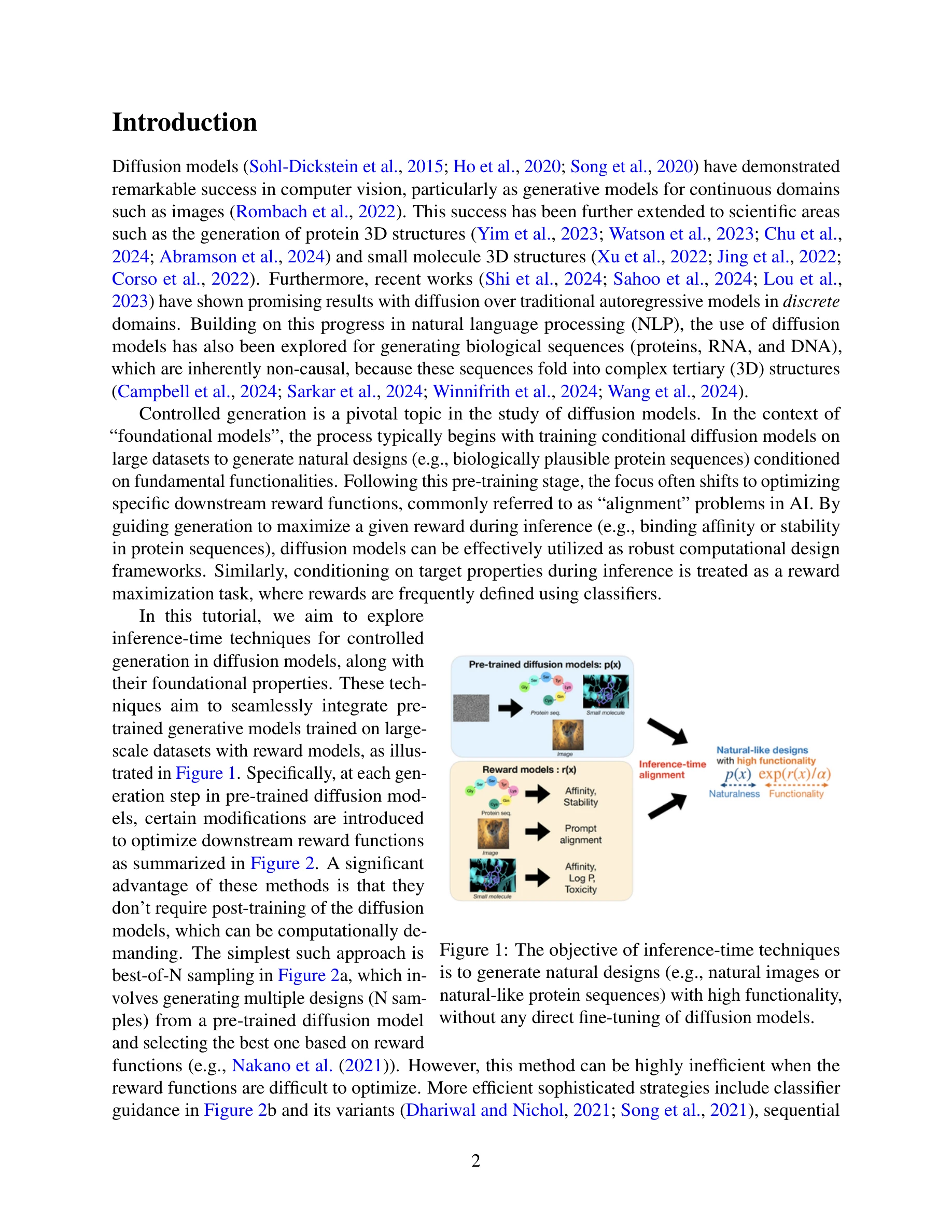

Figure 1: 미세조정 없이 사전학습 생성 모델과 보상 모델을 통합하여 기능성 높은 자연스러운 설계 생성

*Figure 2: 최적화 목표 달성을 위한 다양한 추론 시간 기법들 (Best-of-N, 분류기 가이던스, SMC 기반 가이던스, 값 기반 중요도 샘플링)* 본 튜토리얼은 사전학습된 확산 모델을 미세조정하지 않으면서 추론 시간(inference time)에 보상 함수(reward function)를 최대화하는 정렬(alignment) 기법들을 통일된 관점에서 리뷰하고, 단백질 설계 같은 과학 분야에서 실제로 유용한 비미분 가능한 보상 피드백을 다루는 방법론들을 포괄적으로 다룬다.

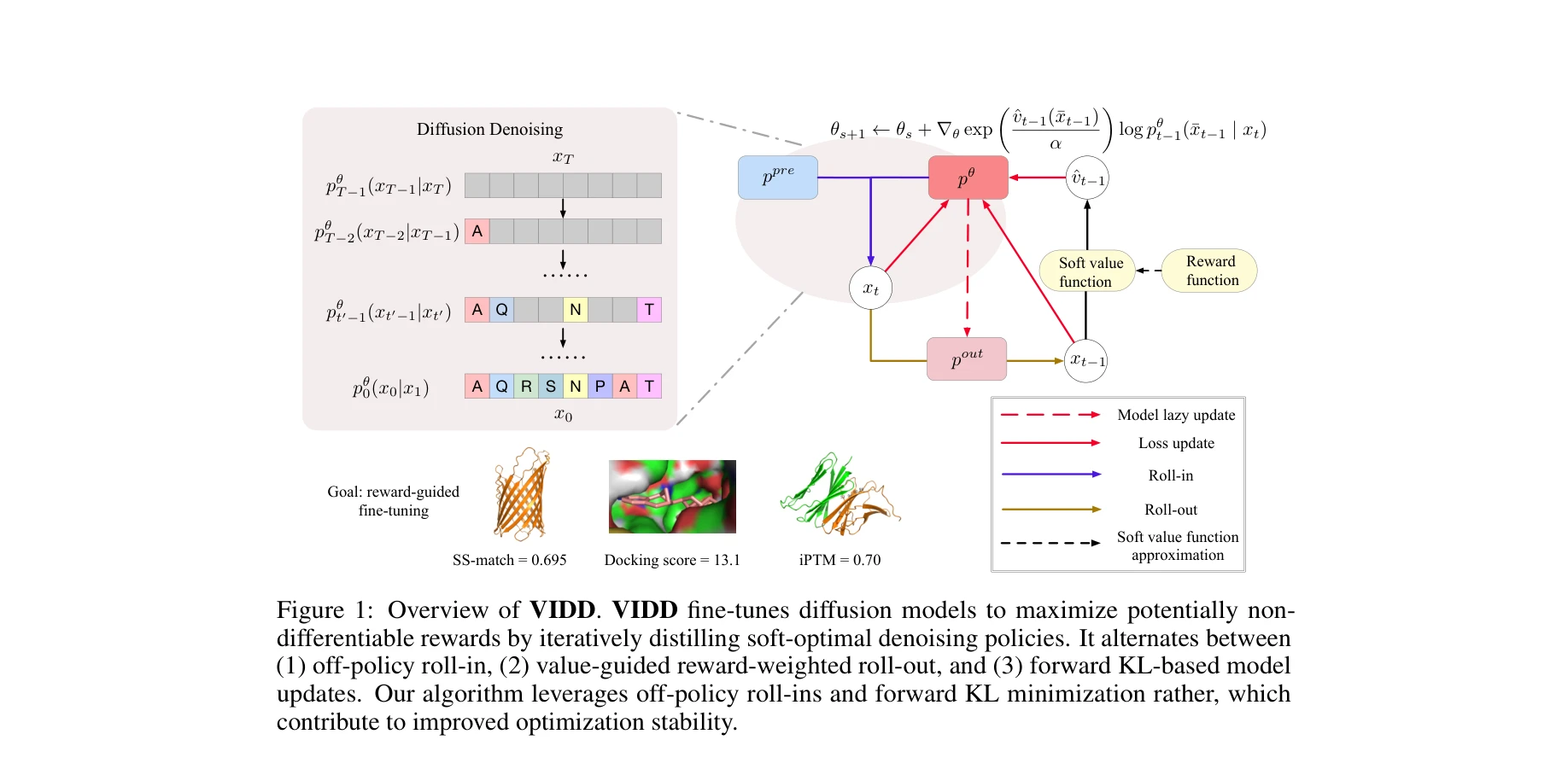

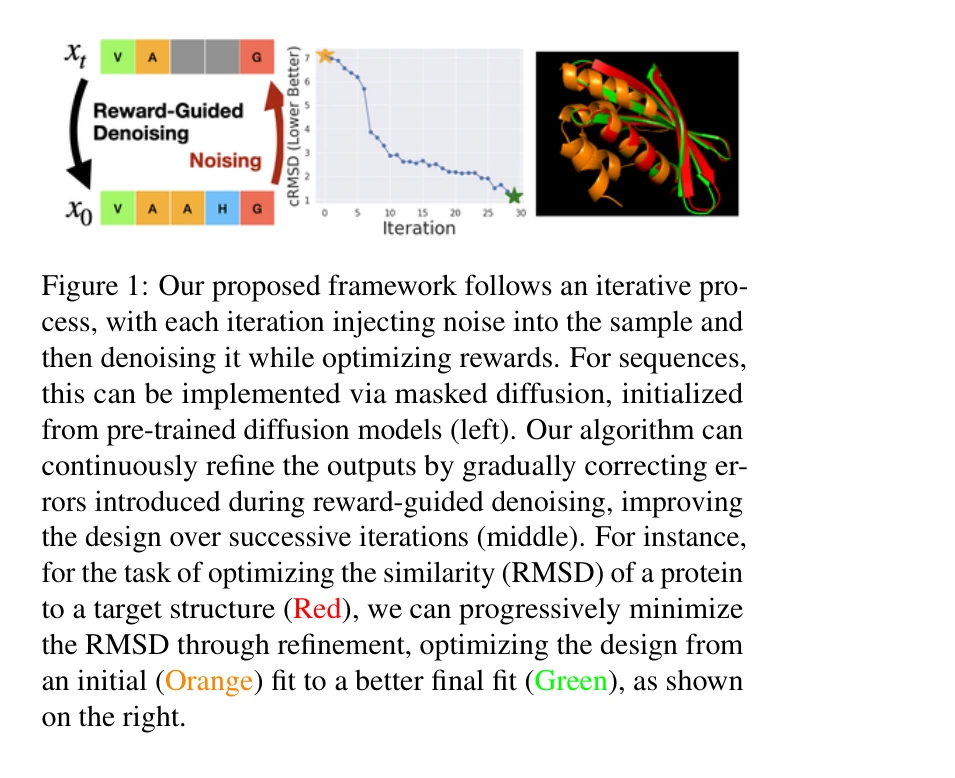

본 튜토리얼은 확산 모델의 추론 시간 정렬 기법들을 처음으로 체계적으로 통합하는 시도로서, 특히 비미분 보상이 실제인 과학 도메인의 관점에서 현실적 가치가 높으며, 제시된 프레임워크는 향후 연구의 이론적 기초가 될 수 있다. 다만 각 기법의 근사 품질, 수렴성, 값 함수 오차의 영향 등에 대한 정량적 이론 분석이 보강된다면 더욱 강력한 참고 자료가 될 것이다.

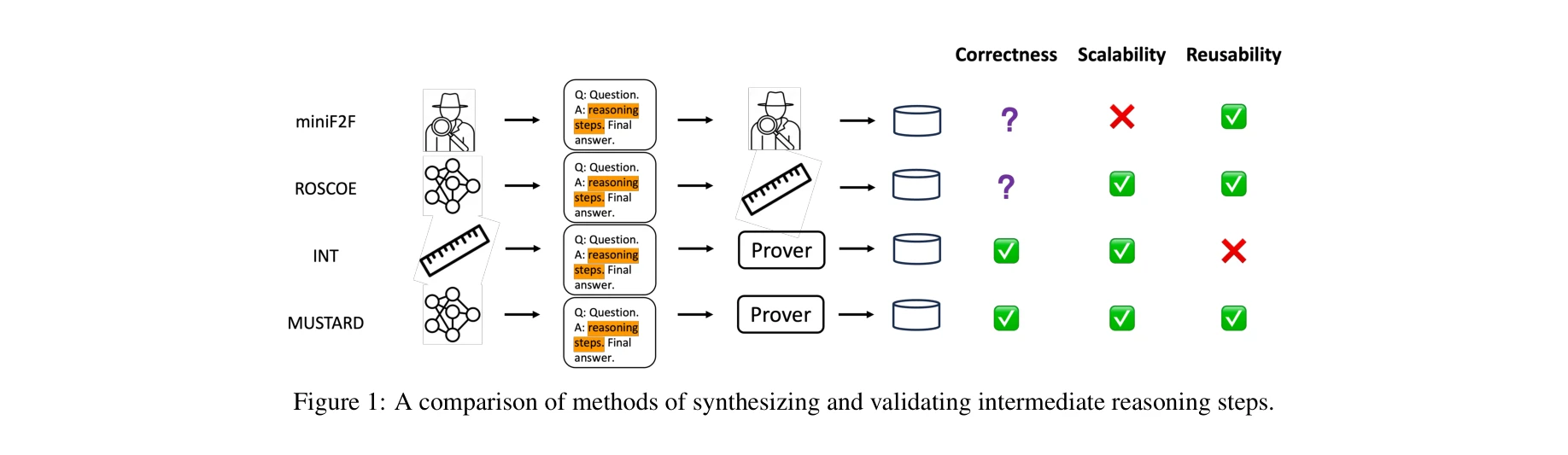

Mustard: Mastering uniform synthesis of theorem and proof data

*다양한 중간 추론 단계 생성 및 검증 방법 비교* 본 논문은 대규모언어모델(LLM)과 형식 정리 증명기(formal theorem prover)의 상호작용을 통해 고품질의 수학 정리와 증명 데이터를 대규모로 생성하는 MUSTARD 프레임워크를 제안한다. 생성된 5,866개의 검증된 데이터로 구성된 MUSTARDSAUCE 벤치마크를 통해 미세조정된 언어모델의 수학적 추론 능력을 평균 15.41% 상대성능 향상으로 입증한다.

MUSTARD는 LLM과 형식 정리 증명기의 상호작용을 통해 대규모 고품질 수학 데이터를 자동 생성하는 효과적인 프레임워크를 제시하며, 공개 벤치마크 MUSTARDSAUCE의 실제 성능 향상으로 실용성을 입증한 우수한 논문이다.

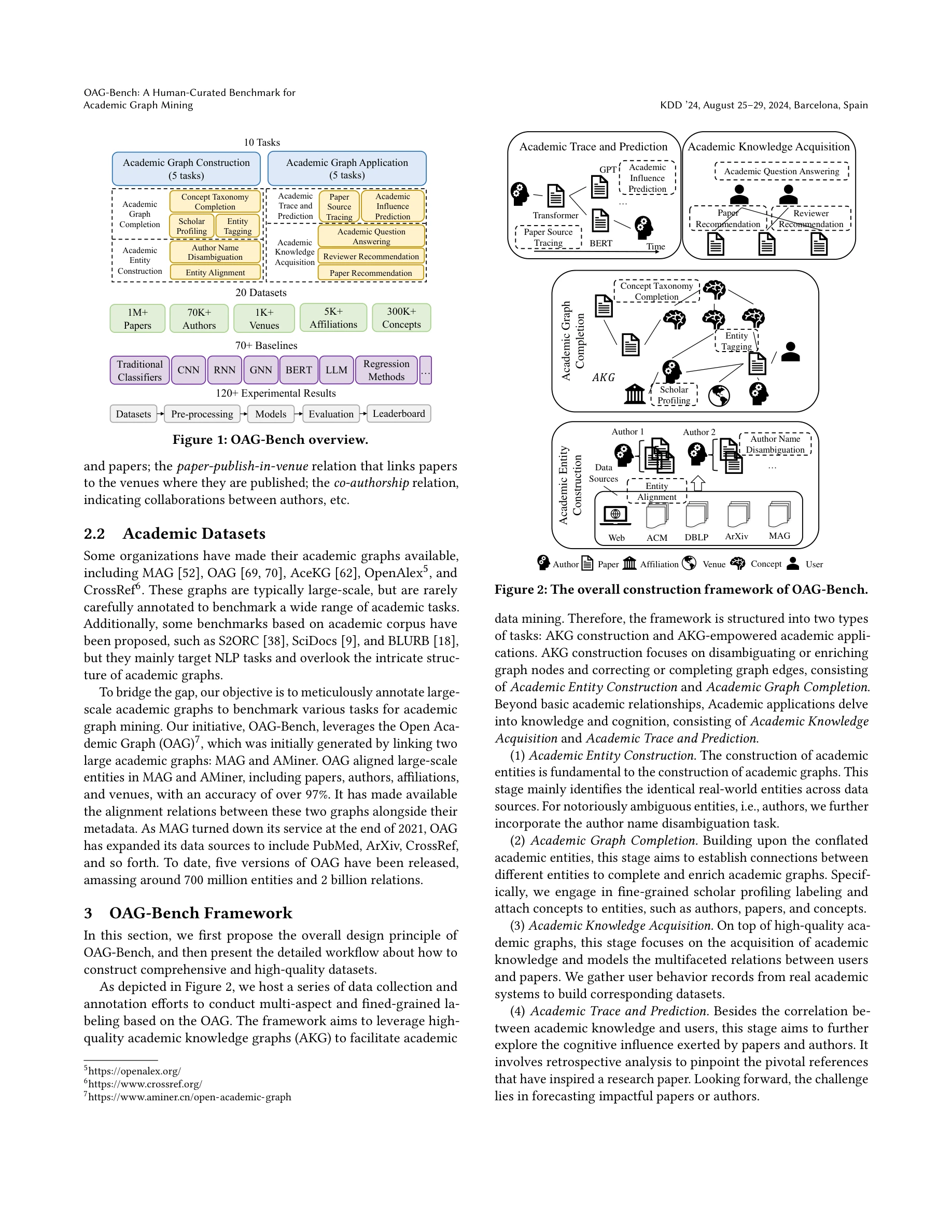

OAG-Bench: A Human-Curated Benchmark for Academic Graph Mining

*그림 1: OAG-Bench의 포괄적 개요 - 10개 과제, 20개 데이터셋, 70+ 베이스라인 방법* 본 논문은 학술 그래프 마이닝(academic graph mining)을 위한 포괄적인 인간-주석(human-curated) 벤치마크인 OAG-Bench를 제시한다. 개방학술그래프(Open Academic Graph, OAG)를 기반으로 저자 이름 중복 제거, 논문 추천, 학자 프로파일링 등 10개의 다양한 과제를 포함하며, 세밀한 다중 관점 주석과 표준화된 평가 프로토콜을 제공한다.

OAG-Bench는 학술 그래프 마이닝 분야에 필요한 포괄적이고 고품질의 벤치마크를 제시하며, 70+ 베이스라인과 LLM 성능 분석을 통해 현재 알고리즘의 한계를 명확히 드러낸다. 개방성과 확장성으로 인해 학술 그래프 관련 연구의 중요한 참조점이 될 것으로 예상되나, 주석 프로토콜의 세부 기술화와 도메인 편향성 분석이 보완되면 더욱 견고한 자원이 될 것이다.

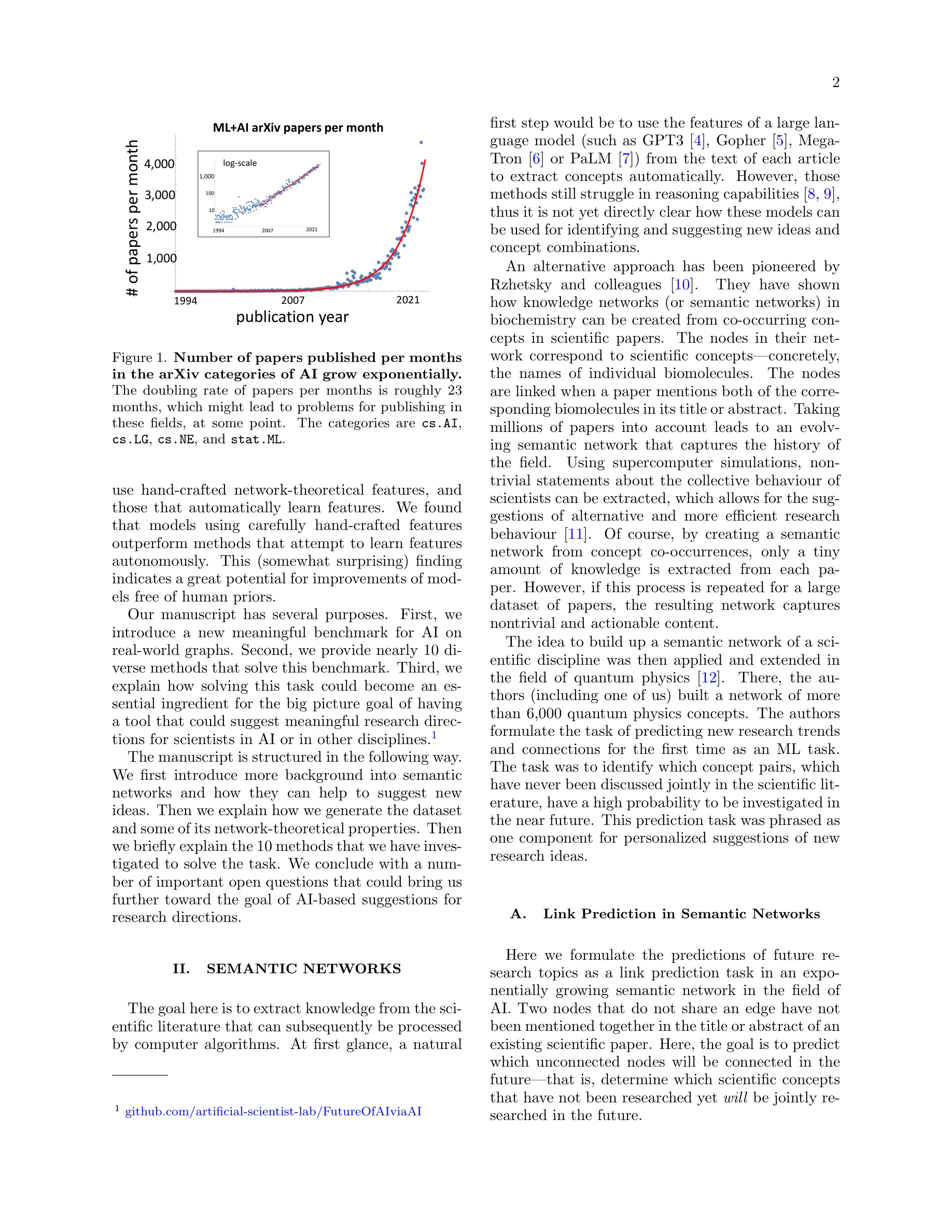

Predicting the future of ai with ai: High-quality link prediction in an exponentially growing knowledge network

*Figure 2: arXiv에서 Science4Cast로의 변환 과정. 143,000개의 AI/ML 논문으로부터 64,000개의 개념 노드와 1,800만 개의 엣지를 가진 의미적 네트워크 구축* 본 논문은 AI 연구의 지수적 성장에 대응하기 위해 의미적 네트워크(semantic network)에서의 링크 예측(link prediction) 문제를 통해 미래의 AI 연구 방향을 예측한다. 143,000개의 arXiv 논문으로부터 구축된 64,000개 개념 노드의 네트워크에서 향후 함께 연구될 개념 쌍을 예측하는 것을 목표로 한다.

본 논문은 급증하는 AI 학술 문헌에서 미래 연구 방향을 예측하는 혁신적인 접근법을 제시하며, 대규모 실제 데이터 기반의 벤치마크와 다양한 방법론 비교를 통해 학문적 가치가 높다. 다만 개념 추출의 정확성 개선과 예측 결과의 과학적 임팩트 검증이 필요하다.

Lego-prover: Neural theorem proving with growing libraries

LEGO-Prover의 구조: (a) Plain prover와의 비교 - LEGO-Prover는 모듈식 증명 구성, (b) 프로버(Prover)와 에볼버(Evolver)로 이루어진 전체 프레임워크

*LEGO-Prover의 구조: (a) Plain prover와의 비교 - LEGO-Prover는 모듈식 증명 구성, (b) 프로버(Prover)와 에볼버(Evolver)로 이루어진 전체 프레임워크* 대규모 언어모델(LLM)을 이용한 신경 정리 증명(Neural Theorem Proving)에서 검증된 보조정리(lemma)를 재사용 가능한 기술(skill)로 활용하는 성장 가능한 라이브러리를 도입함으로써, 모듈식 증명 구성을 통해 증명 능력을 대폭 향상시킨다. 이를 통해 miniF2F 벤치마크에서 최첨단 성능을 달성하고 22,532개의 검증된 기술을 자동 생성한다.

LEGO-Prover는 신경 정리 증명에 성장 가능한 검증된 보조정리 라이브러리를 도입하는 창의적 접근으로 명확한 성능 향상을 달성하였으며, 생성된 대규모 기술 라이브러리의 실용적 가치를 입증했다. 다만 더 복잡한 수학 문제로의 확장성과 계산 비용 효율성에 대한 추가 검증이 필요하다.

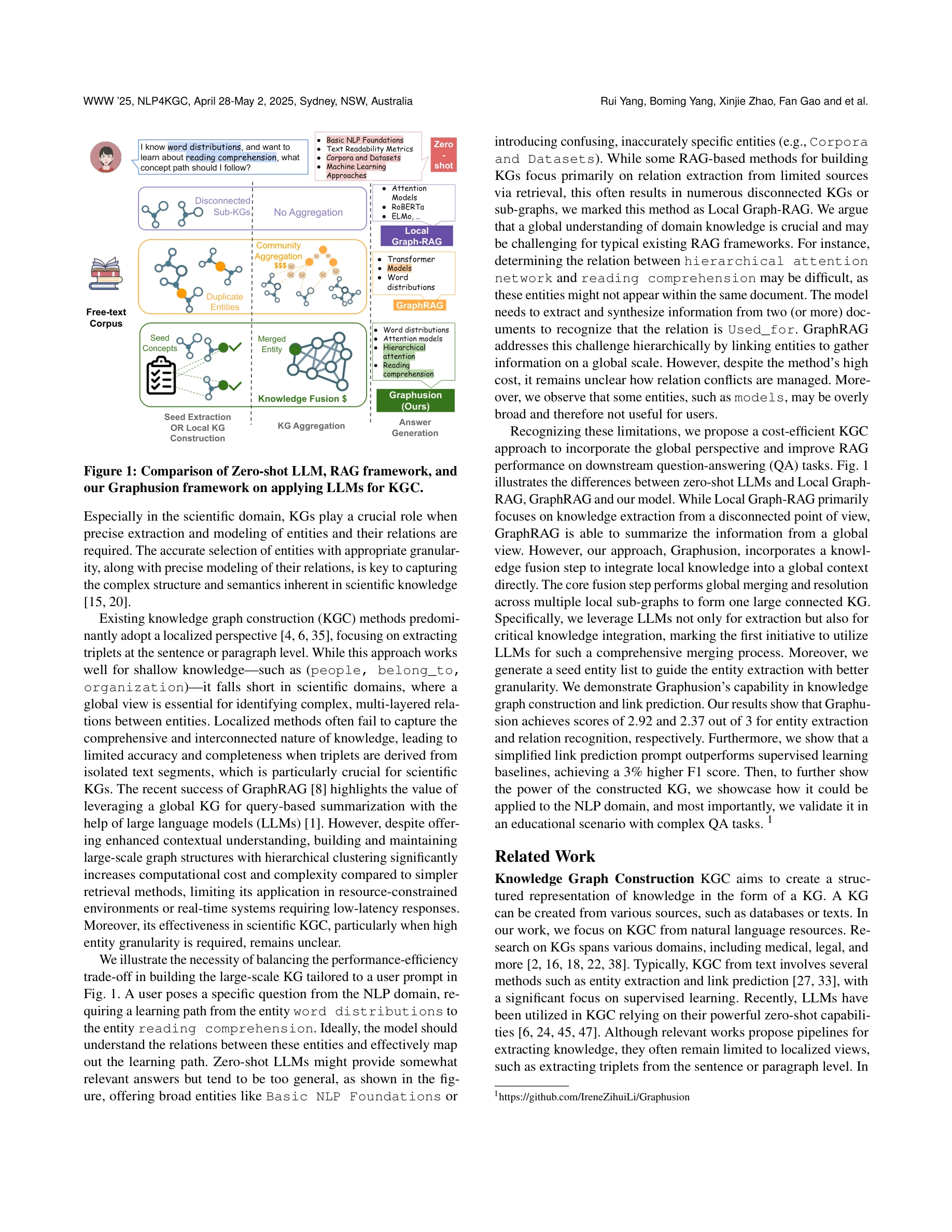

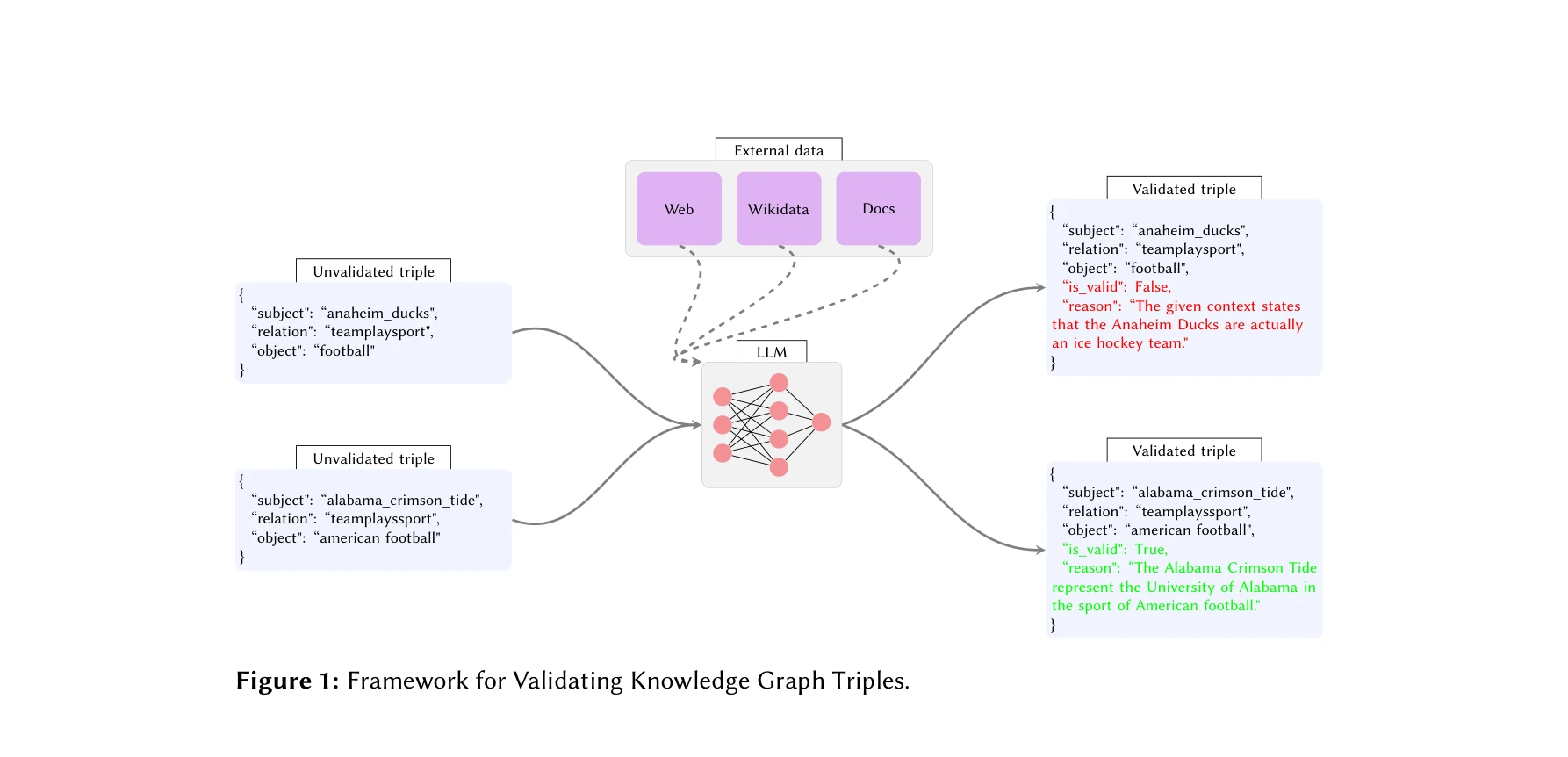

Graphusion: a rag framework for knowledge graph construction with a global perspective

Figure 1: Zero-shot LLM, RAG 프레임워크, Graphusion의 지식그래프 구축 방식 비교

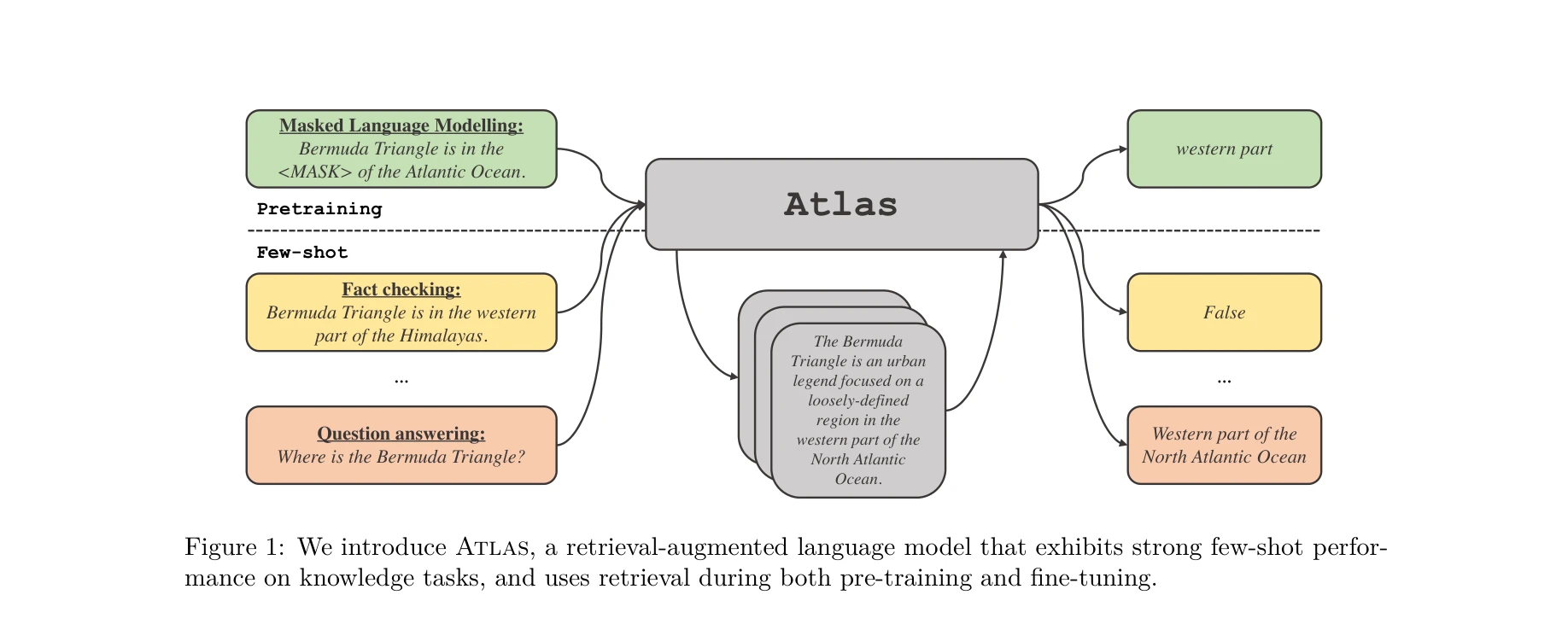

*Figure 1: Zero-shot LLM, RAG 프레임워크, Graphusion의 지식그래프 구축 방식 비교* 본 논문은 대규모언어모델(LLM)을 활용하여 자유로운 텍스트에서 **전역적 관점(global perspective)**을 고려한 과학 분야의 지식그래프(Knowledge Graph, KG)를 구축하는 새로운 프레임워크 Graphusion을 제안한다. 기존 로컬 중심의 방법을 넘어 엔티티 병합, 충돌 해결, 신규 관계 발견을 통해 통합된 지식그래프를 생성한다.