Essence

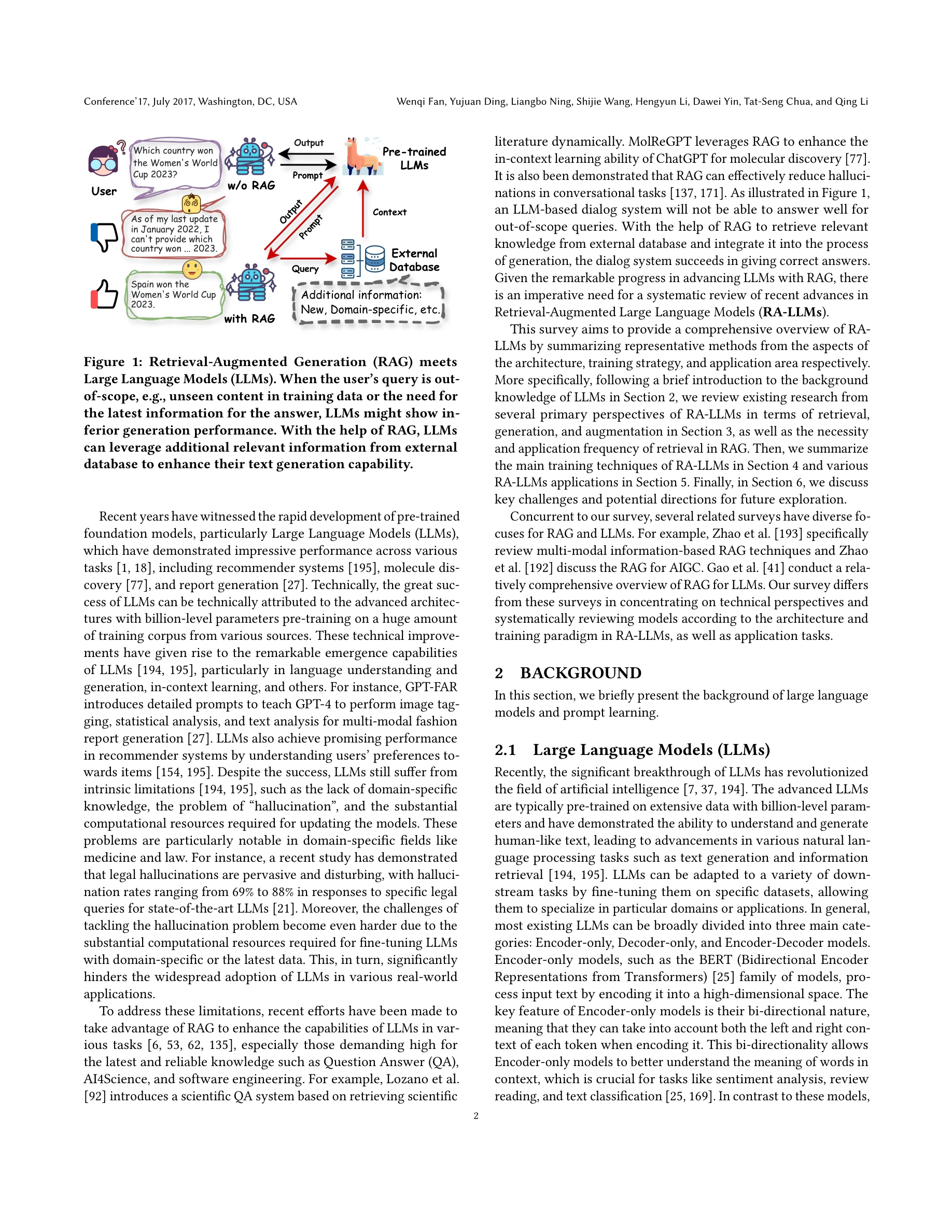

Figure 1: Retrieval-Augmented Generation (RAG) meets

본 논문은 Retrieval-Augmented Generation (RAG)과 Large Language Models (LLMs)의 통합인 RA-LLMs에 대한 종합적인 설문조사로, 아키텍처, 훈련 전략, 응용 분야의 세 가지 기술적 관점에서 기존 연구를 체계적으로 리뷰한다.

저자: Wenqi Fan, Yujuan Ding, Liang-bo Ning, Shijie Wang, Hengyun Li | 날짜: 2024 | DOI: 10.1145/3637528.3671470

Figure 1: Retrieval-Augmented Generation (RAG) meets

본 논문은 Retrieval-Augmented Generation (RAG)과 Large Language Models (LLMs)의 통합인 RA-LLMs에 대한 종합적인 설문조사로, 아키텍처, 훈련 전략, 응용 분야의 세 가지 기술적 관점에서 기존 연구를 체계적으로 리뷰한다.

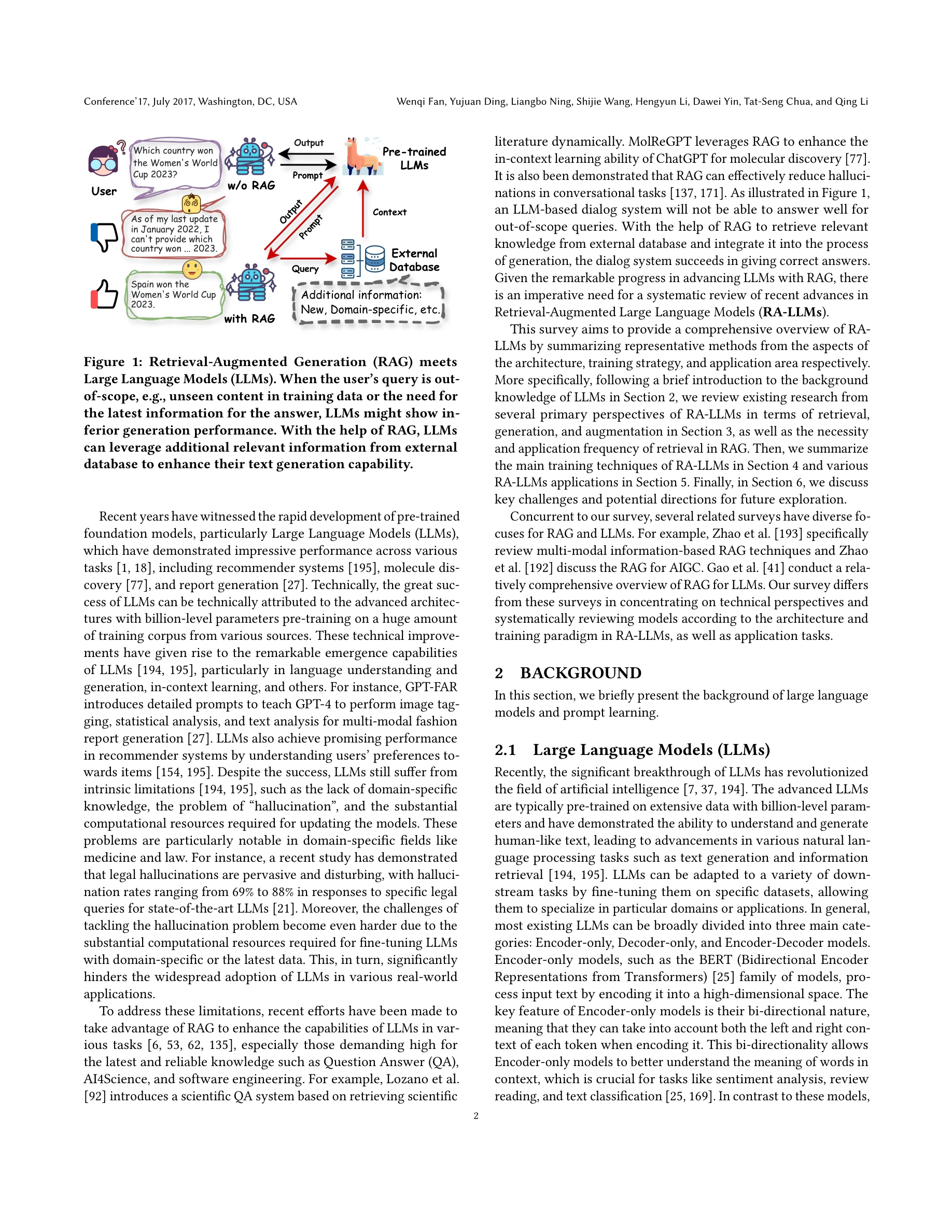

Figure 2: Representing RAG and RA-LLMs methods organized by their main design focus, proposed time and impact (shown by

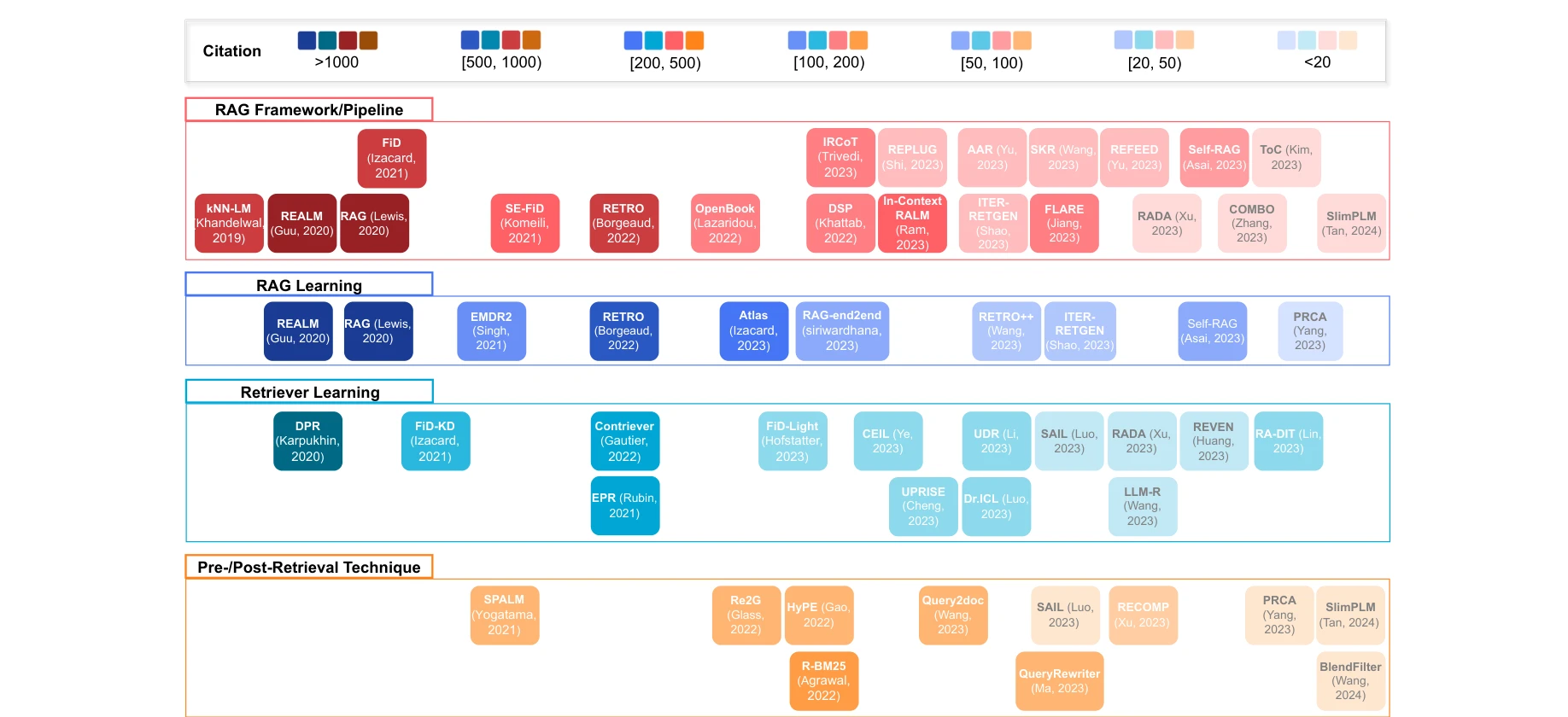

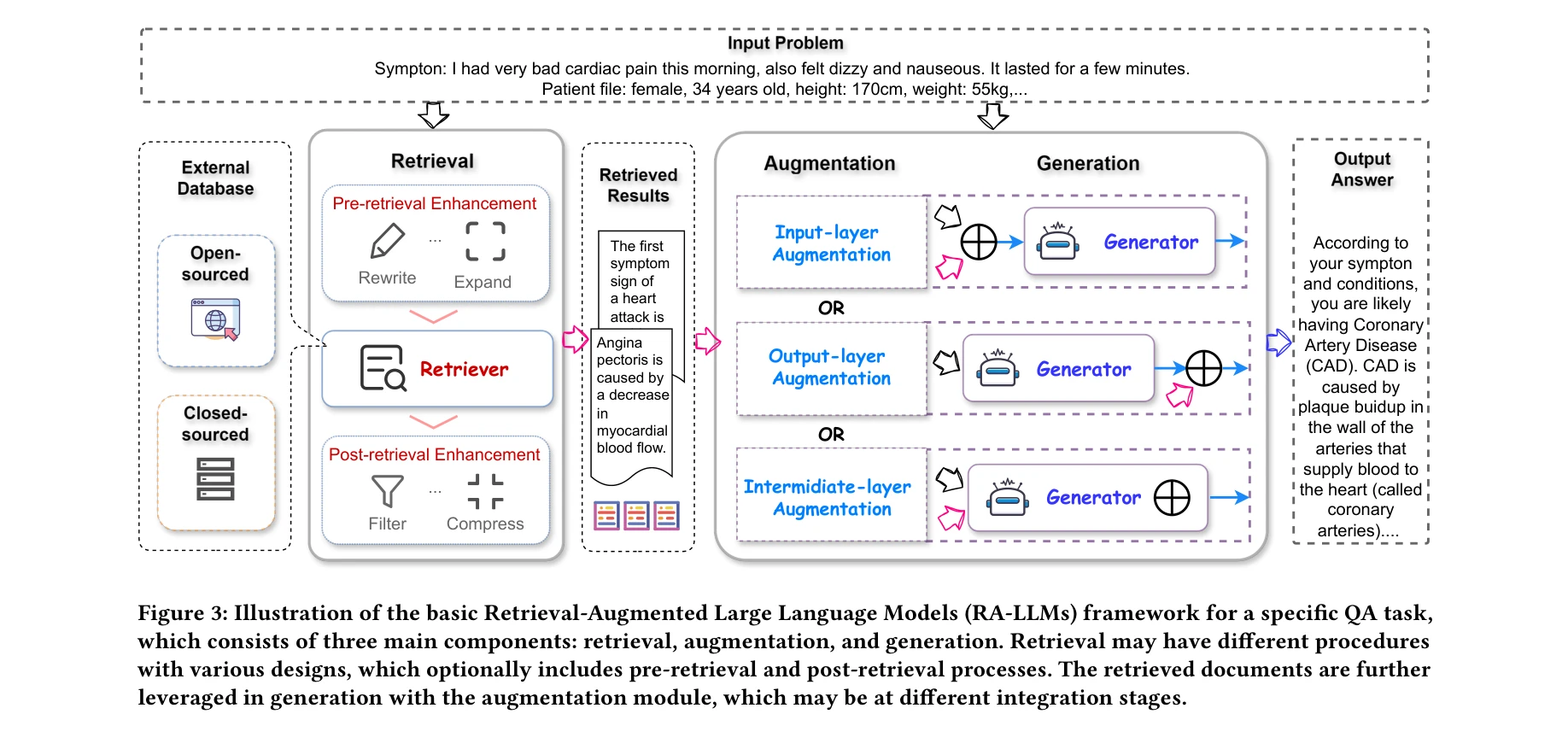

Figure 3: Illustration of the basic Retrieval-Augmented Large Language Models (RA-LLMs) framework for a specific QA task

총평: 본 논문은 RAG와 LLMs의 통합이라는 시대적 요구에 부응하여, 기술적 관점에서 가장 체계적이고 포괄적인 설문조사를 제공한다. Hallucination 문제 해결, 최신 정보 활용, 도메인 특화 응용 등의 실제 가치와 함께 아키텍처-훈련-응용이라는 명확한 분류 체계를 제시함으로써 RA-LLMs 연구 분야의 중요한 기준점이 될 것으로 기대된다.