Essence

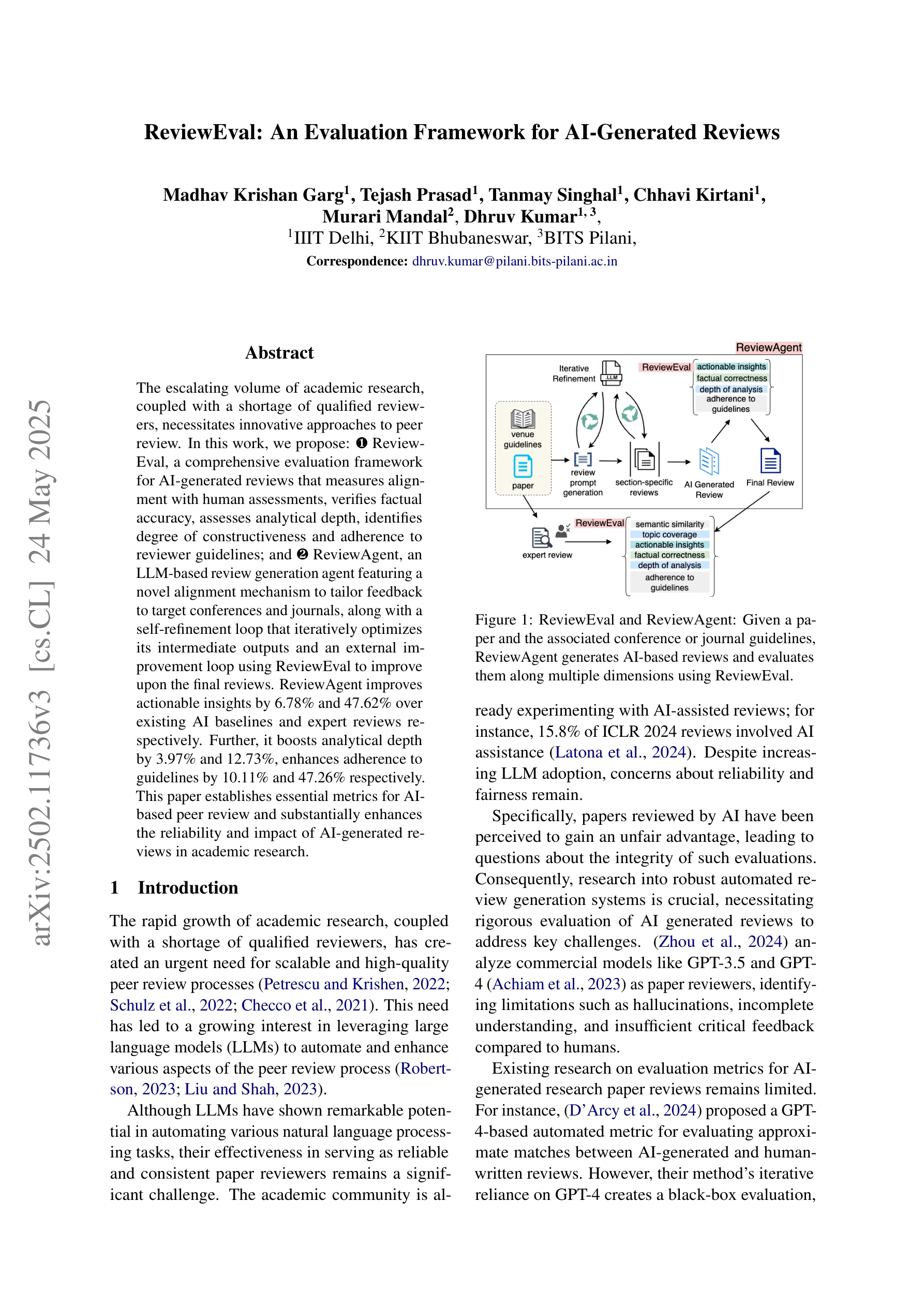

ReviewEval과 ReviewAgent: 논문과 학회/저널 가이드라인이 주어졌을 때, ReviewAgent가 AI 기반 리뷰를 생성하고 ReviewEval을 통해 다양한 차원에서 평가

학술 논문 동료 평가(peer review) 부족 문제를 해결하기 위해 LLM 기반 리뷰 시스템의 신뢰성을 평가하는 종합 프레임워크 ReviewEval과 자체 개선 루프를 갖춘 AI 리뷰어 ReviewAgent를 제안한다.

저자: Madhav Krishan Garg, Tejash Prasad, Tanmay Singhal, Chhavi Kirtani, Murari Mandal, Dhruv Kumar (IIIT Delhi, KIIT Bhubaneswar, BITS Pilani) | 날짜: 2025 | DOI: N/A

ReviewEval과 ReviewAgent: 논문과 학회/저널 가이드라인이 주어졌을 때, ReviewAgent가 AI 기반 리뷰를 생성하고 ReviewEval을 통해 다양한 차원에서 평가

학술 논문 동료 평가(peer review) 부족 문제를 해결하기 위해 LLM 기반 리뷰 시스템의 신뢰성을 평가하는 종합 프레임워크 ReviewEval과 자체 개선 루프를 갖춘 AI 리뷰어 ReviewAgent를 제안한다.

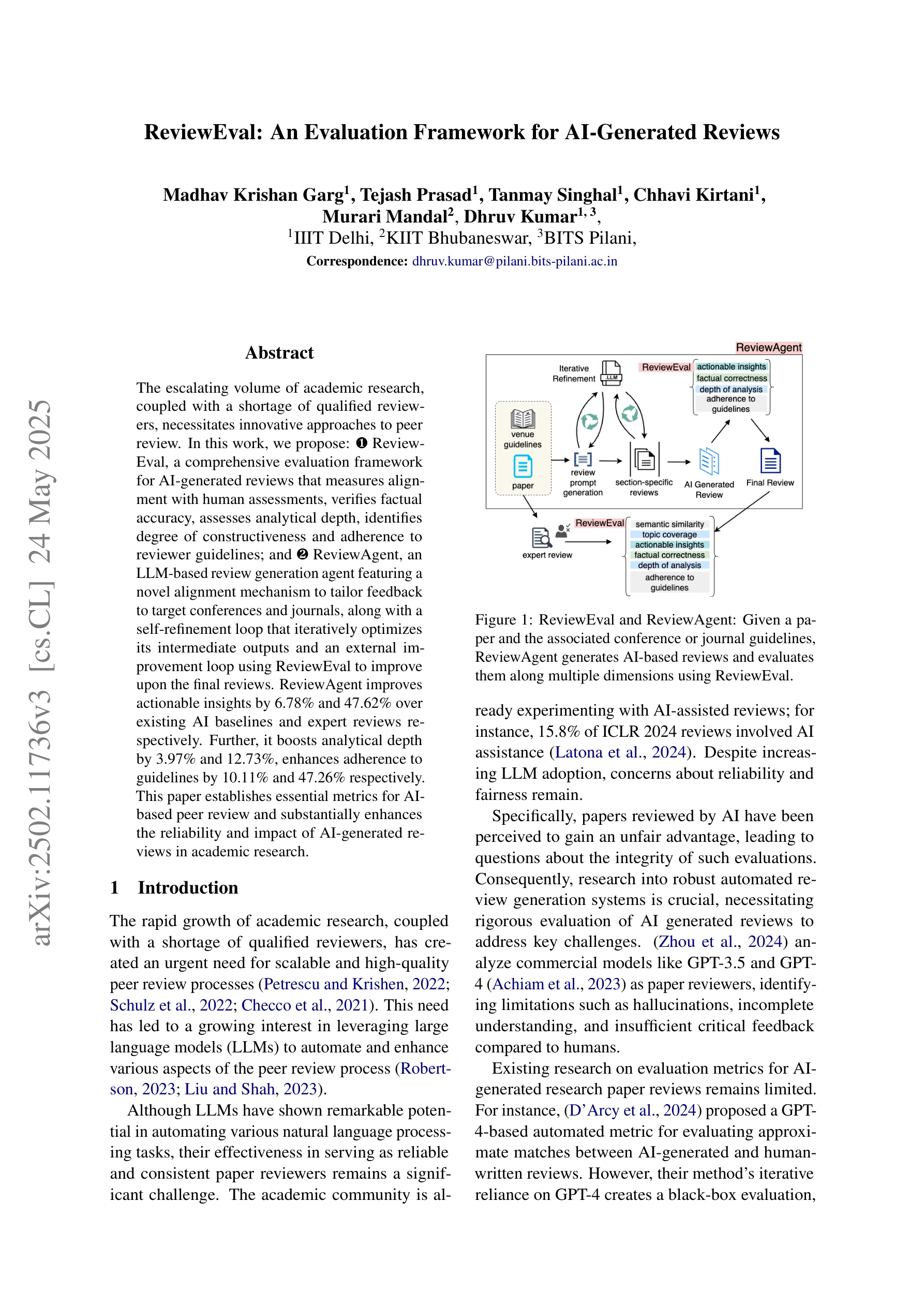

AI 생성 리뷰의 주요 문제점: (좌측부터) 인간 리뷰와의 의미적/주제적 차이, 사실적 부정확성 및 환각, 제한된 분석적 추론, 구체적 개선 제안 부족

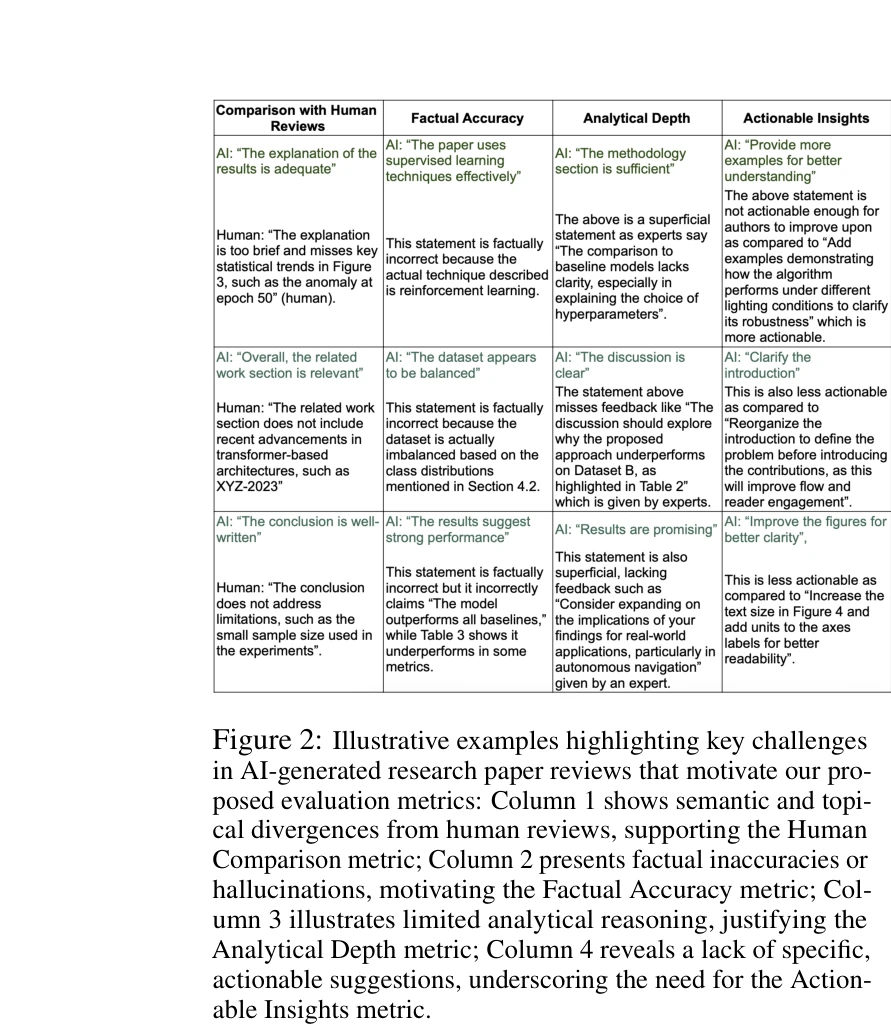

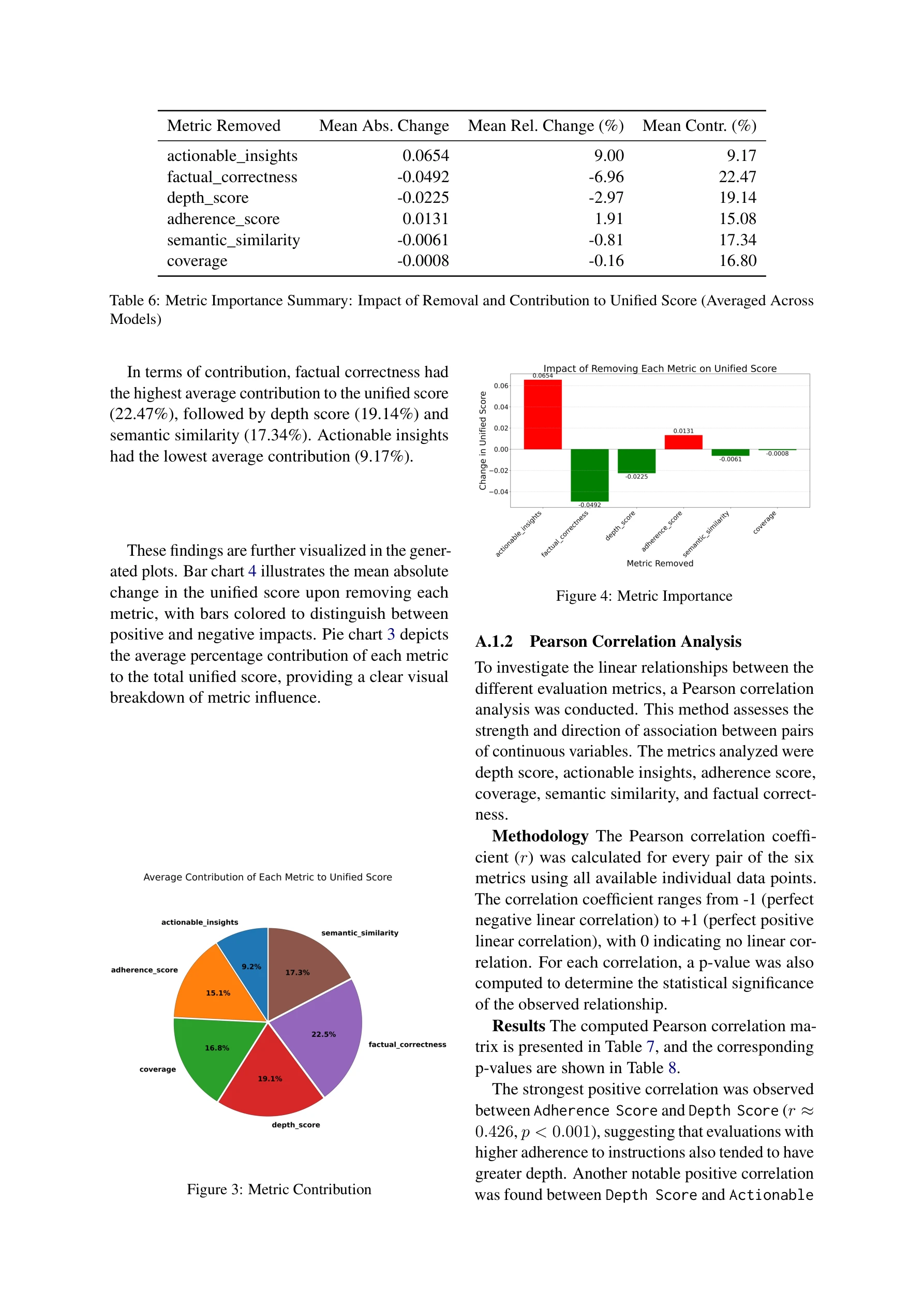

메트릭 기여도 분석

총평: 이 논문은 AI 생성 학술 리뷰의 품질을 다각적으로 평가하는 포괄적 프레임워크를 제시하여 이 분야의 중요한 공백을 메우고 있다. 특히 사실성, 분석 깊이, 실행 가능성과 같은 새로운 평가 차원과 자동화된 사실 검증 파이프라인이 가치있는 기여이나, 제한된 데이터셋 규모와 실제 학회 적용 검증을 통해 실무적 영향력을 더욱 강화할 필요가 있다.