Achievement

- 정량적 성능 개선:

- Rating MSE: CycleReviewer-70B 대비 44.80% 향상

- Ranking (Spearman 상관계수): 6.04% 향상

- Selection (정확도): 1.80% 향상

- LLM-as-a-judge 평가에서 GPT-o1 및 DeepSeek-R1 대비 각각 88.21%, 80.20%의 승률 달성

- 안정성 강화: 명시적 견고성(robustness) 훈련 없이도 적대적 공격(adversarial attack)에 대한 높은 저항성 입증

- 효율성: 14B 모델이 70B 모델(CycleReviewer)을 능가하며, 더 적은 토큰 소비로 성능 개선

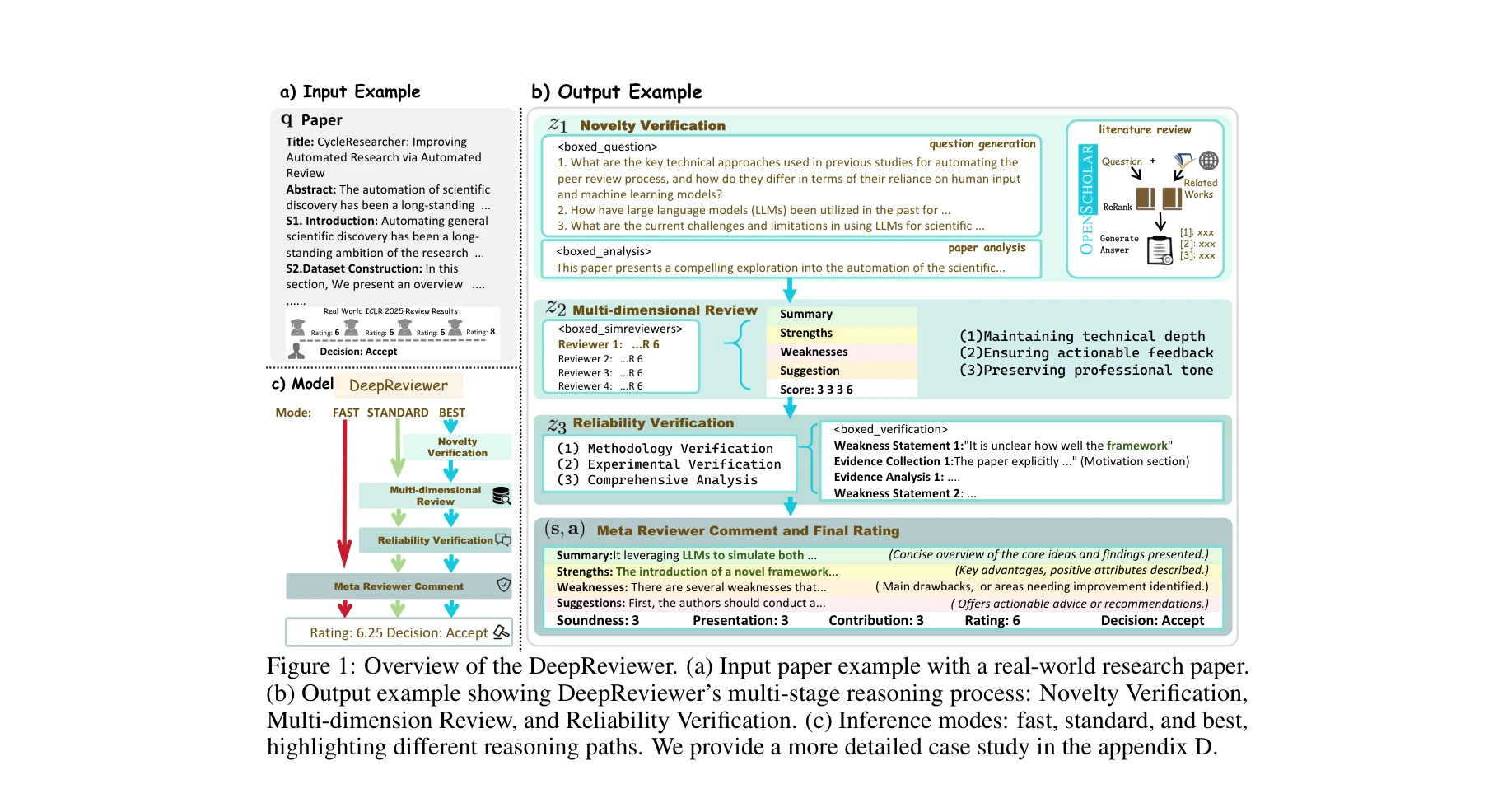

- Test-Time Scaling: 추론 경로(reasoning path)와 응답 길이 조정을 통해 성능 향상 가능성 입증