Essence

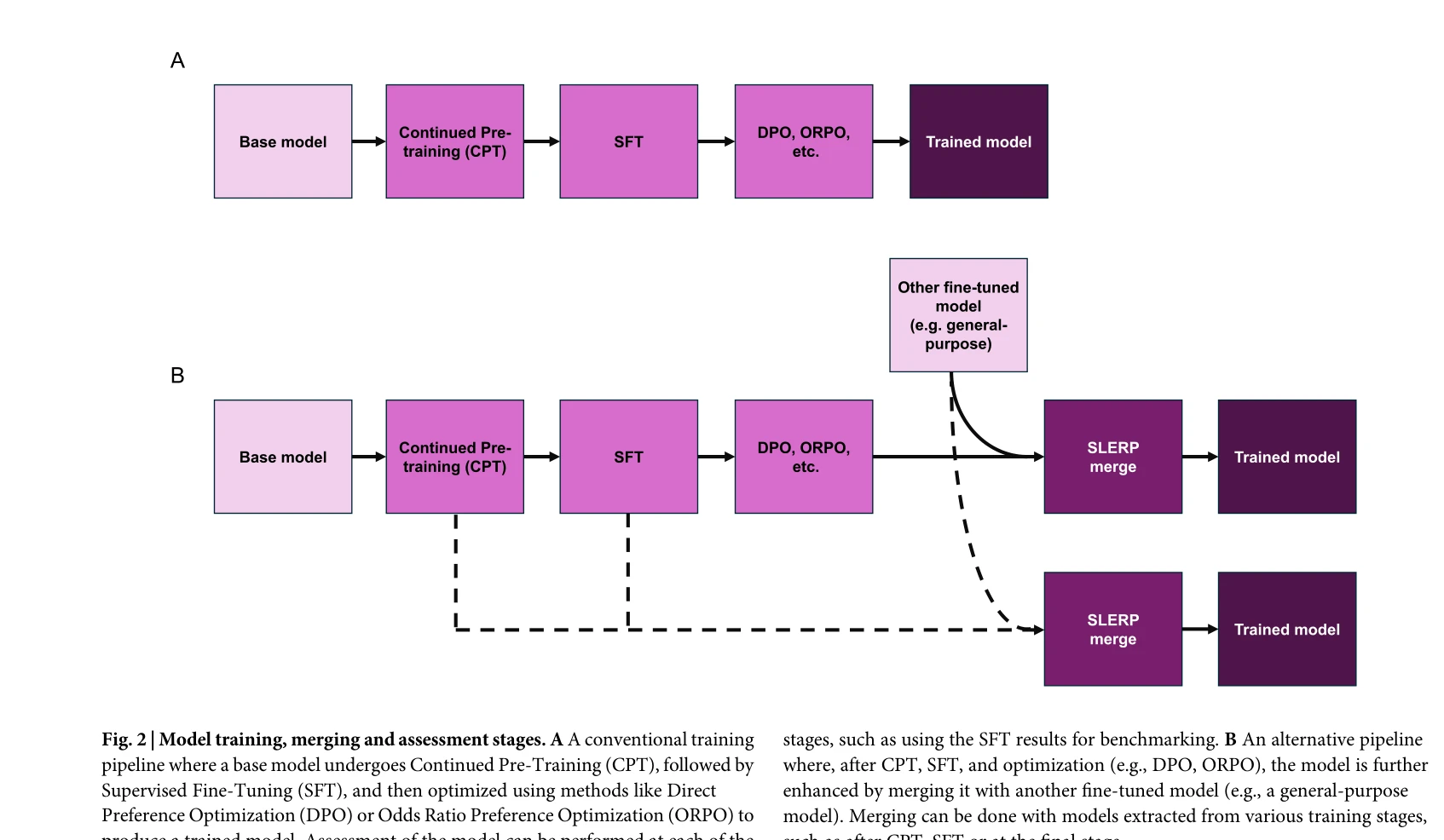

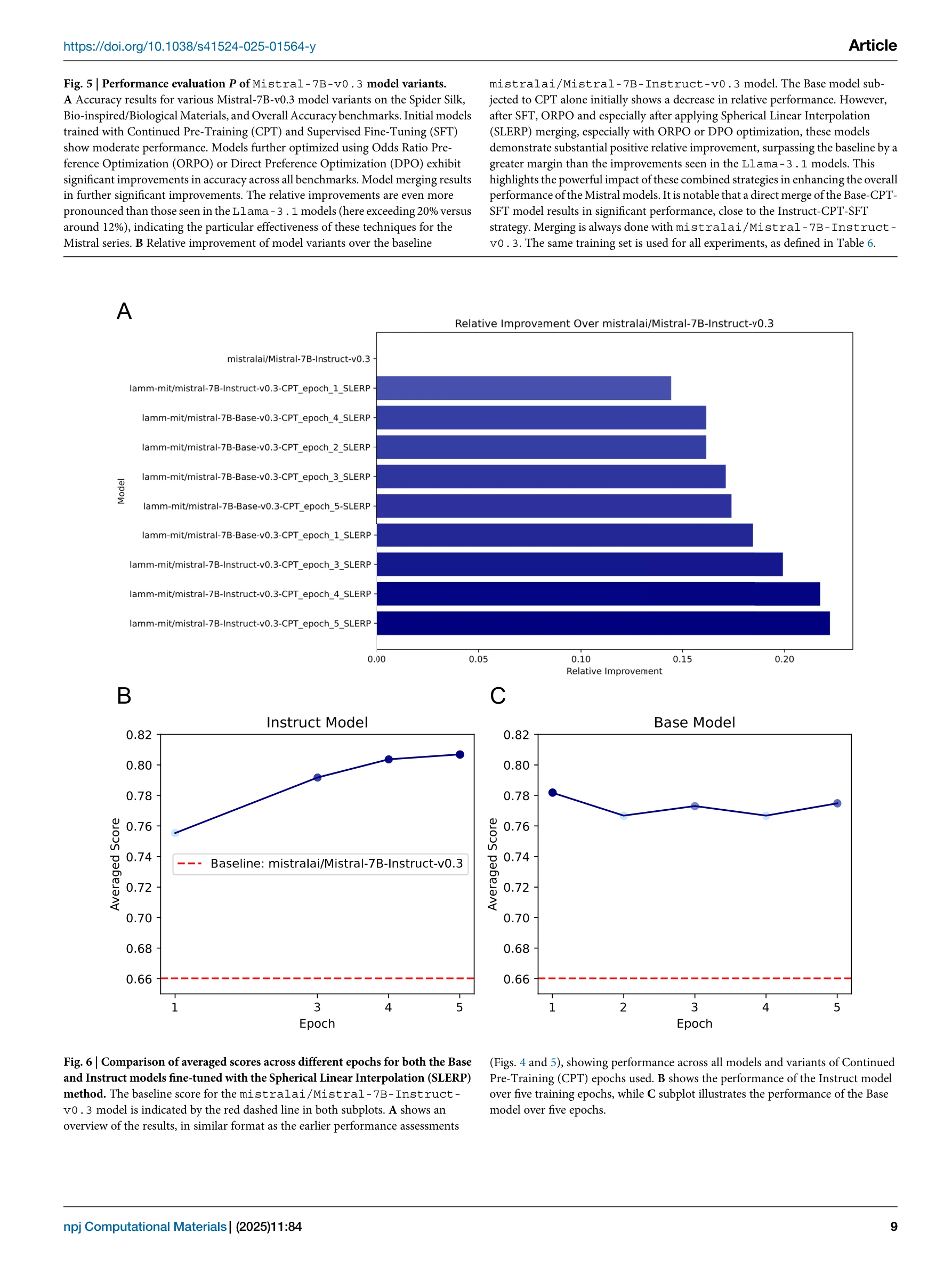

모델 훈련, 병합 및 평가 단계. A: 기존의 선형 훈련 파이프라인(CPT→SFT→DPO/ORPO). B: 모델 병합을 포함한 대안적 파이프라인

본 논문은 재료과학 등 전문 도메인에 대응하는 대형언어모델(LLM)의 파인튜닝 전략을 체계적으로 탐구하며, 특히 여러 미세조정 모델의 병합(model merging)이 개별 모델의 능력을 초월하는 창발적 기능(emergent capabilities)을 생성할 수 있음을 실증한다.

저자: Wei Lu, Rachel K. Luu, Markus J. Buehler | 날짜: 2025-03-28 | DOI: 10.1038/s41524-025-01564-y

모델 훈련, 병합 및 평가 단계. A: 기존의 선형 훈련 파이프라인(CPT→SFT→DPO/ORPO). B: 모델 병합을 포함한 대안적 파이프라인

본 논문은 재료과학 등 전문 도메인에 대응하는 대형언어모델(LLM)의 파인튜닝 전략을 체계적으로 탐구하며, 특히 여러 미세조정 모델의 병합(model merging)이 개별 모델의 능력을 초월하는 창발적 기능(emergent capabilities)을 생성할 수 있음을 실증한다.

Llama-3.1 모델 변형체의 성능 평가

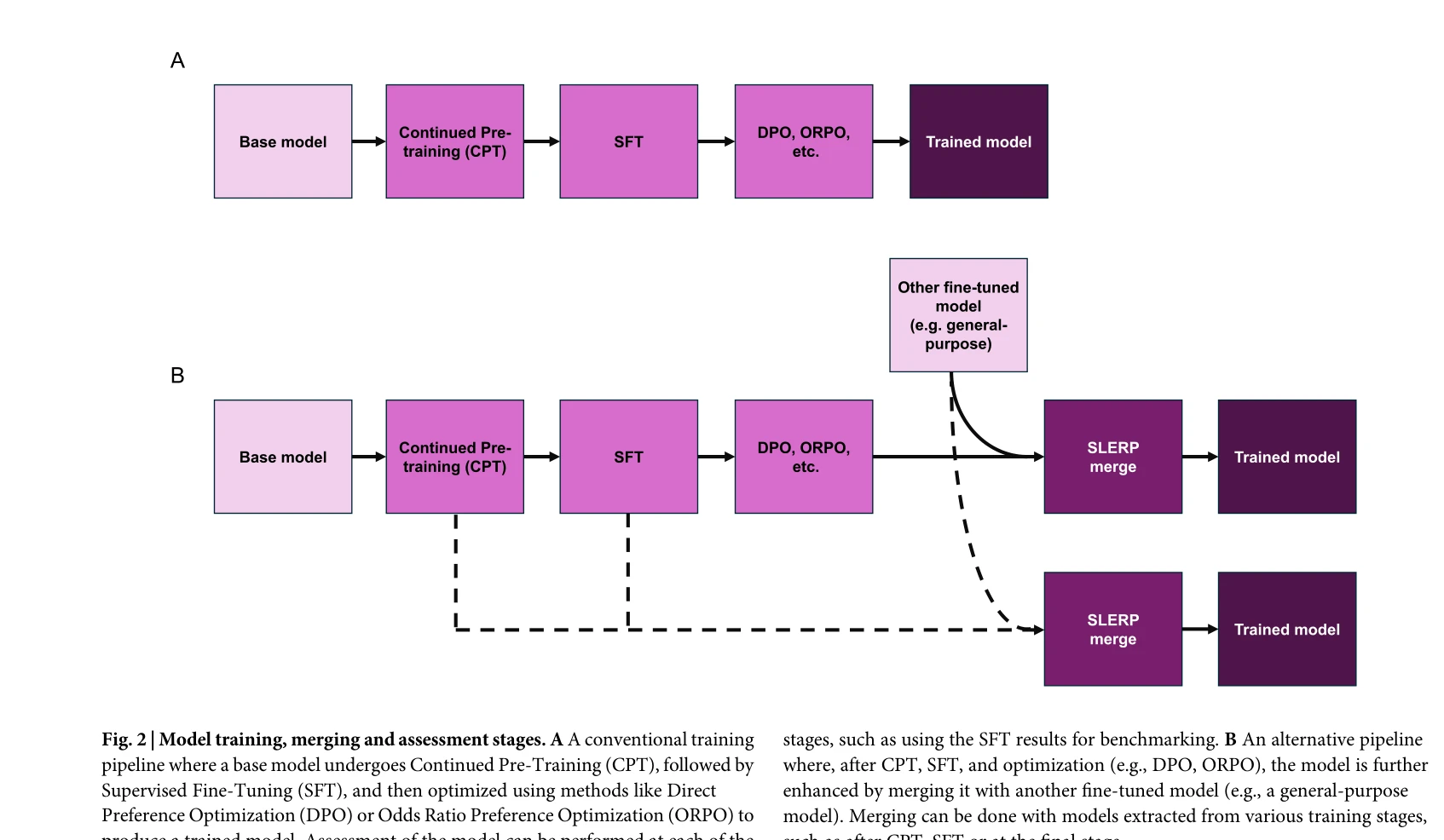

Mistral-7B-v0.3 모델 변형체의 성능 평가

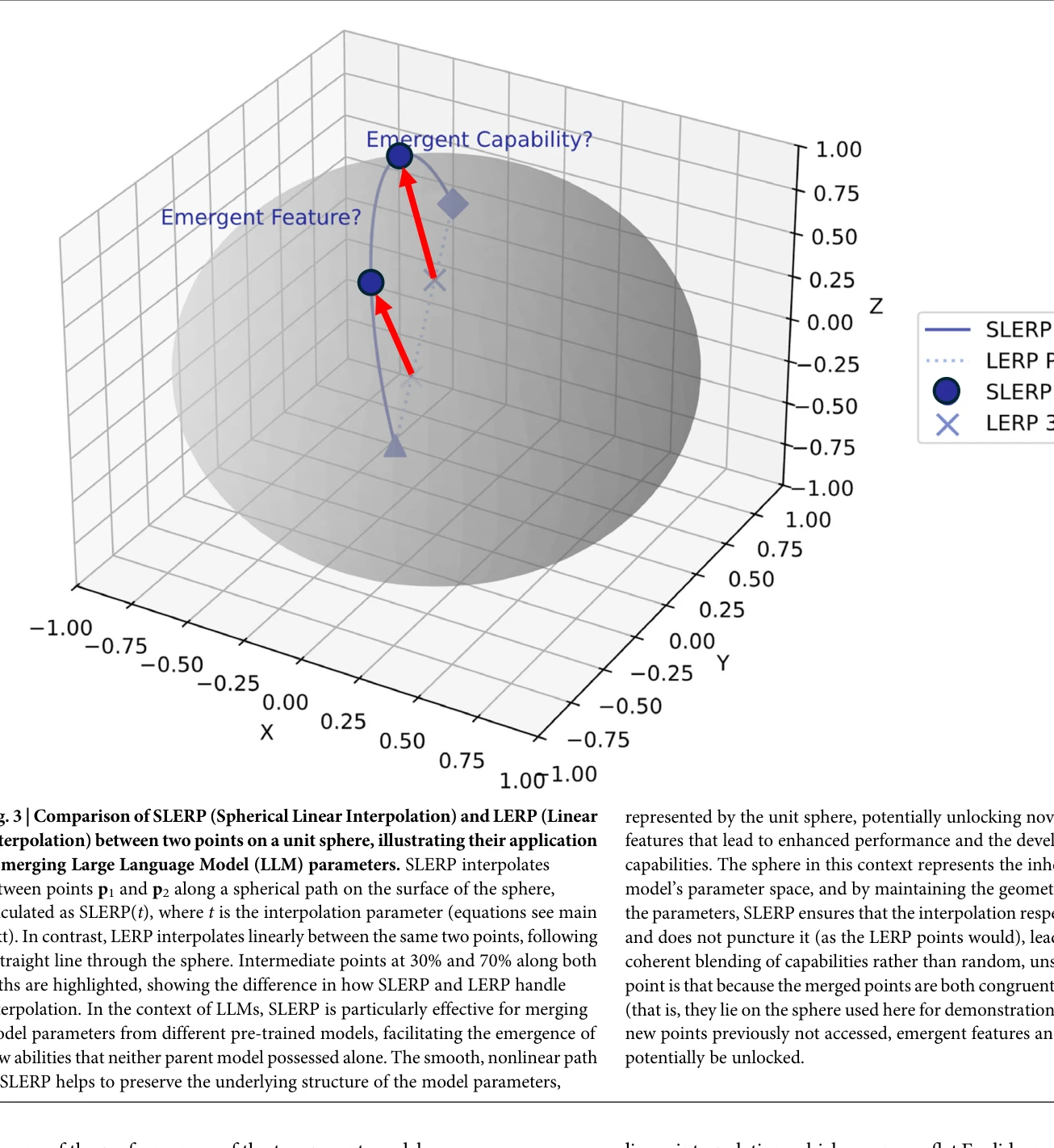

SLERP(구면 선형 보간법)와 LERP(선형 보간법)의 비교. SLERP는 모델 매개변수 공간의 기하학적 구조를 보존하여 의미 있는 능력 혼합을 가능하게 함

총평: 본 논문은 모델 병합을 통한 창발적 기능의 실증과 도메인 특화 파인튜닝 전략의 체계적 비교를 제시하여 LLM 활용의 새로운 가능성을 제시하는 가치 있는 연구이나, 창발성의 근본 메커니즘 분석과 이론적 기초가 강화되면 더욱 영향력 있는 기여가 될 수 있다.