Essence

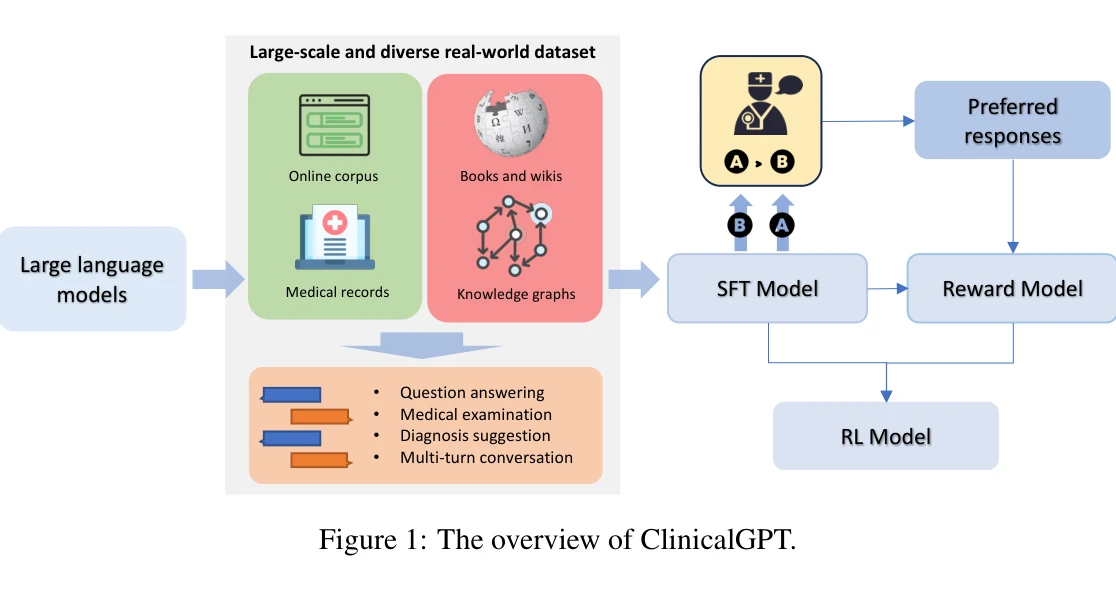

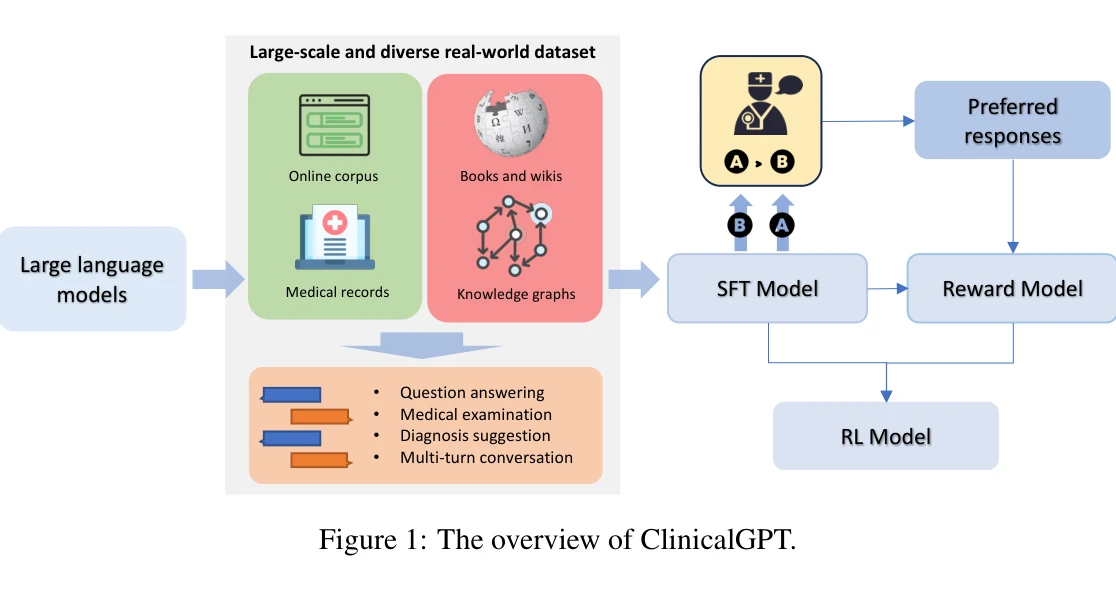

ClinicalGPT의 전체 구조: 다양한 의료 데이터와 감독 미세조정(SFT), 보상 모델(Reward Model), 강화학습(RL) 파이프라인을 통합

본 논문은 의료 도메인에 특화된 대규모 언어 모델 ClinicalGPT를 제시한다. 다양한 임상 데이터와 포괄적 평가 프레임워크를 활용하여 의료 분야의 고정확도, 해석성, 안전성 요구사항을 충족하도록 설계되었다.

저자: Guangyu Wang, Guoxing Yang, Zongxin Du, Longjun Fan, Xiaohu Li | 날짜: 2023 | DOI: 10.48550/arXiv.2306.09968

ClinicalGPT의 전체 구조: 다양한 의료 데이터와 감독 미세조정(SFT), 보상 모델(Reward Model), 강화학습(RL) 파이프라인을 통합

본 논문은 의료 도메인에 특화된 대규모 언어 모델 ClinicalGPT를 제시한다. 다양한 임상 데이터와 포괄적 평가 프레임워크를 활용하여 의료 분야의 고정확도, 해석성, 안전성 요구사항을 충족하도록 설계되었다.

총평: ClinicalGPT는 의료 도메인에 특화된 LLM 개발의 실용적 접근을 보여주며 다양한 임상 데이터 통합과 포괄적 평가 프레임워크가 주요 기여이나, 기술적 혁신성이 제한적이고 실제 임상 성능 검증 및 실무 적용 경로에 대한 논의가 부족하다.