How

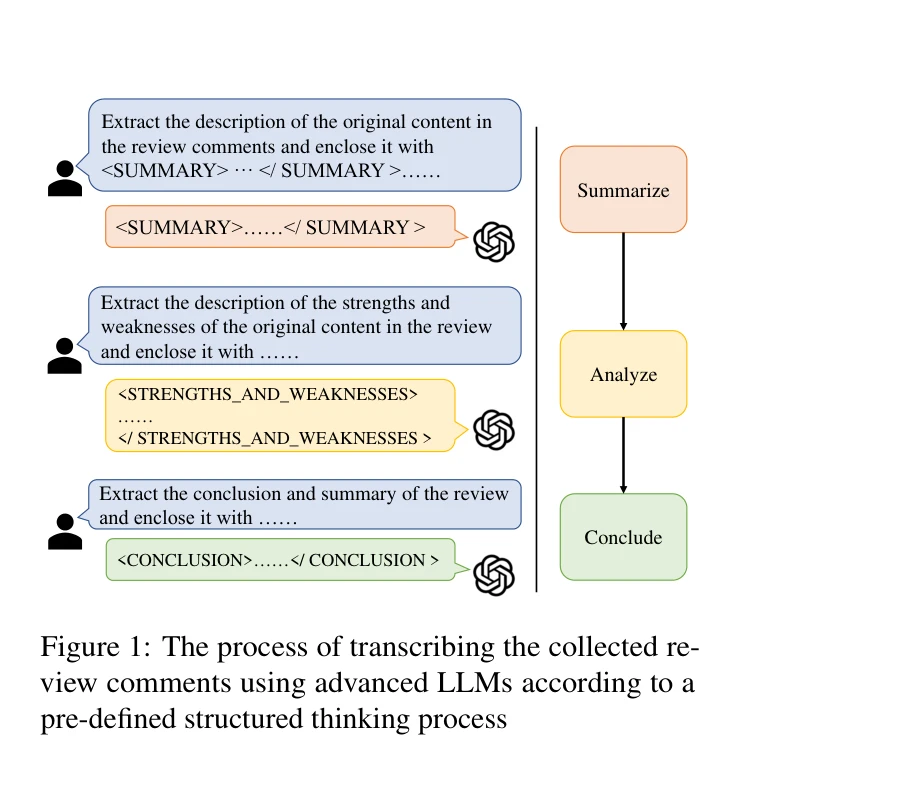

Figure 1: 사전 정의된 구조화 사고 과정에 따른 심사 의견 변환 프로세스 (요약→분석→결론)

데이터셋 구축

- 메타데이터 수집: OpenReview, NeurIPS Proceedings에서 논문 전문, 심사 의견, 메타리뷰, 채택 여부 등 원본 정보 수집

- 구조화 변환(Transcription): 고급 LLM을 이용해 기존 심사 의견을 세 단계로 재구성

- 원본 의미 보존하면서 명시적 구조 부가

- 관련 논문 검색: Semantic Scholar API를 통해 제출 시점까지의 관련 논문 검색, 유사도 기반으로 상위 2개 논문 추출. 인간 심사자의 신규성(novelty) 평가 과정 모방

ReviewAgents 프레임워크

- 심사자 에이전트(Reviewer Agent): 구조화된 3단계 추론을 수행하여 개별 심사 의견 생성

- 영역 의장 에이전트(Area Chair Agent): 다수 심사자의 의견을 종합하여 메타리뷰 작성

- 다중 심사자 통합: 여러 심사자 에이전트의 독립적 평가 후 영역 의장이 종합, 개별 심사자 편향(bias) 완화

학습 및 평가 방법

- 관련-논문-인식 학습(Relevant-Paper-Aware Training): 논문 본문 + 관련 논문 정보를 입력으로 하여 모델 학습. 시간 변화에 따른 신규성 판단의 일관성 향상

- ReviewBench 평가: 자동생성 심사의 품질을 인간 심사와 비교하는 다차원 평가 체계