Essence

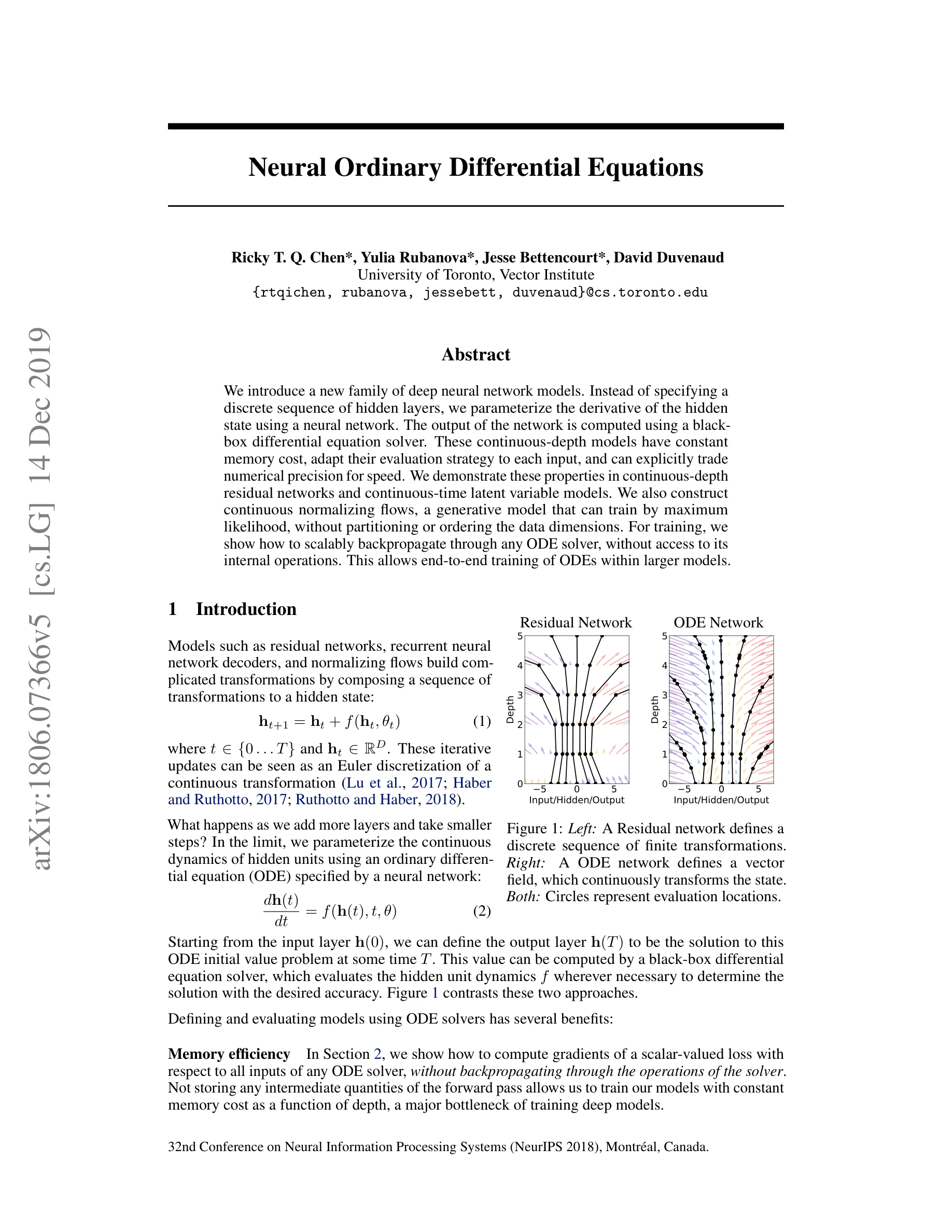

좌측: 잔차 네트워크는 이산적 유한 변환 시퀀스 정의 / 우측: ODE 네트워크는 연속적으로 상태를 변환하는 벡터장 정의

기존의 이산 깊이(discrete depth) 신경망 대신 숨겨진 상태의 도함수를 신경망으로 매개변수화하고, 이를 상미분방정식(ODE) 초기값 문제로 정의하여 블랙박스 ODE 솔버로 계산하는 혁신적 연속깊이(continuous-depth) 신경망 모델을 제안한다.

저자: Ricky T. Q. Chen, Yulia Rubanova, Jesse Bettencourt, David Duvenaud | 날짜: 2018-06-19 | DOI: 10.48550/arXiv.1806.07366

좌측: 잔차 네트워크는 이산적 유한 변환 시퀀스 정의 / 우측: ODE 네트워크는 연속적으로 상태를 변환하는 벡터장 정의

기존의 이산 깊이(discrete depth) 신경망 대신 숨겨진 상태의 도함수를 신경망으로 매개변수화하고, 이를 상미분방정식(ODE) 초기값 문제로 정의하여 블랙박스 ODE 솔버로 계산하는 혁신적 연속깊이(continuous-depth) 신경망 모델을 제안한다.

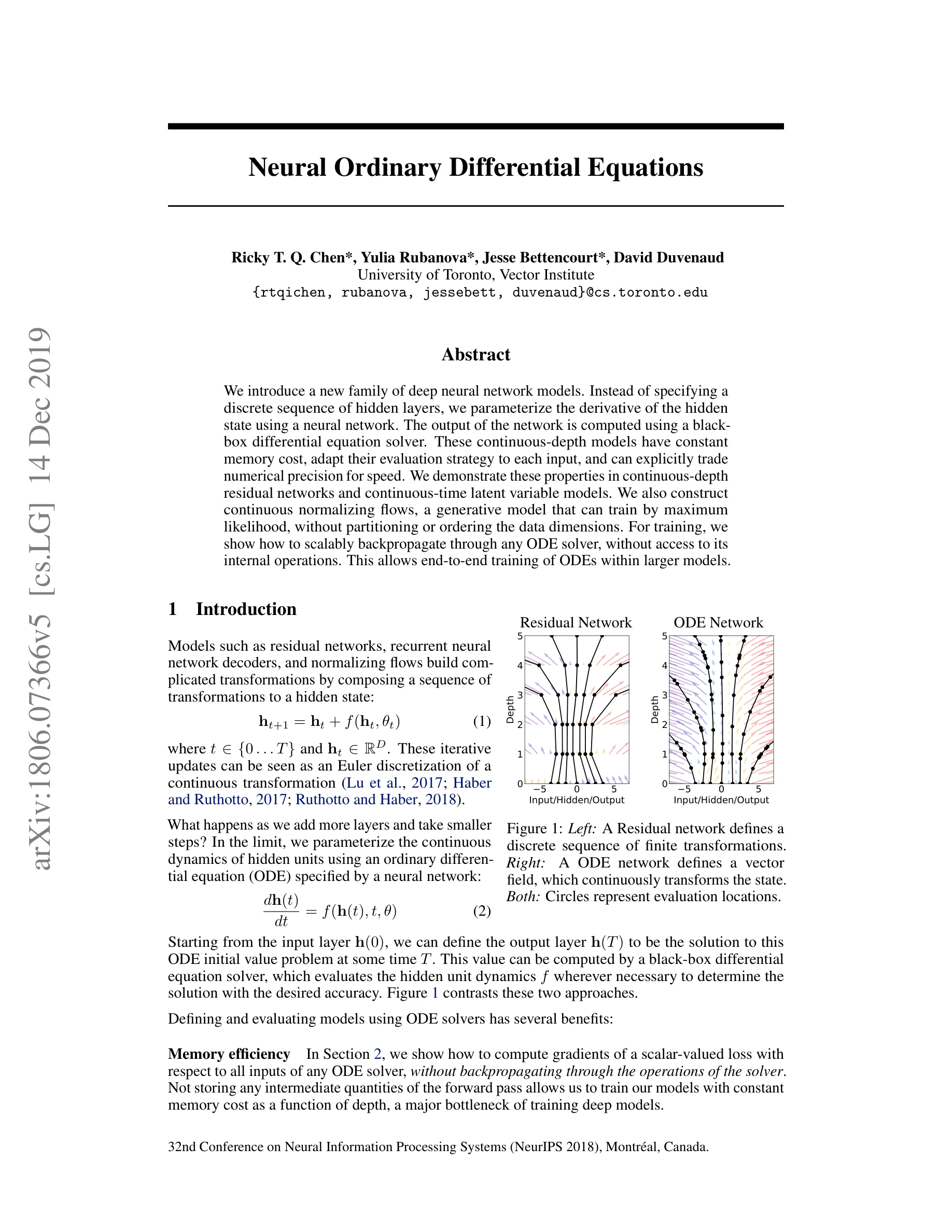

역모드 미분(adjoint sensitivity method)을 통한 ODE 솔버의 블랙박스 기울기 계산. 증강 ODE를 역시간으로 해결하여 원래 상태와 손실에 대한 민감도 동시 계산

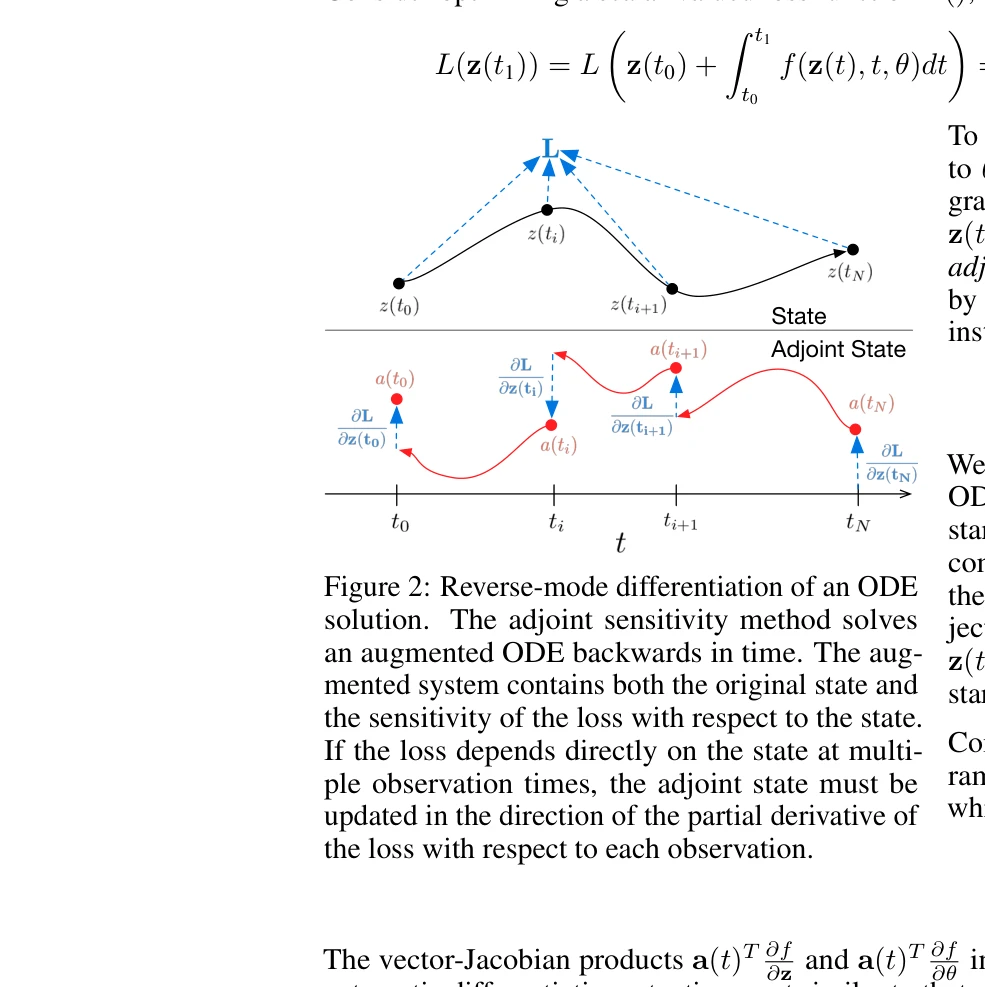

학습된 ODE-Net의 통계: (a) 오차 제어 가능성 (b) 함수 평가 횟수와 계산 시간 선형 관계 (c) 역전파 시 평가 횟수가 정방향의 약 절반 (d) 학습 진행에 따른 함수 평가 횟수 증가

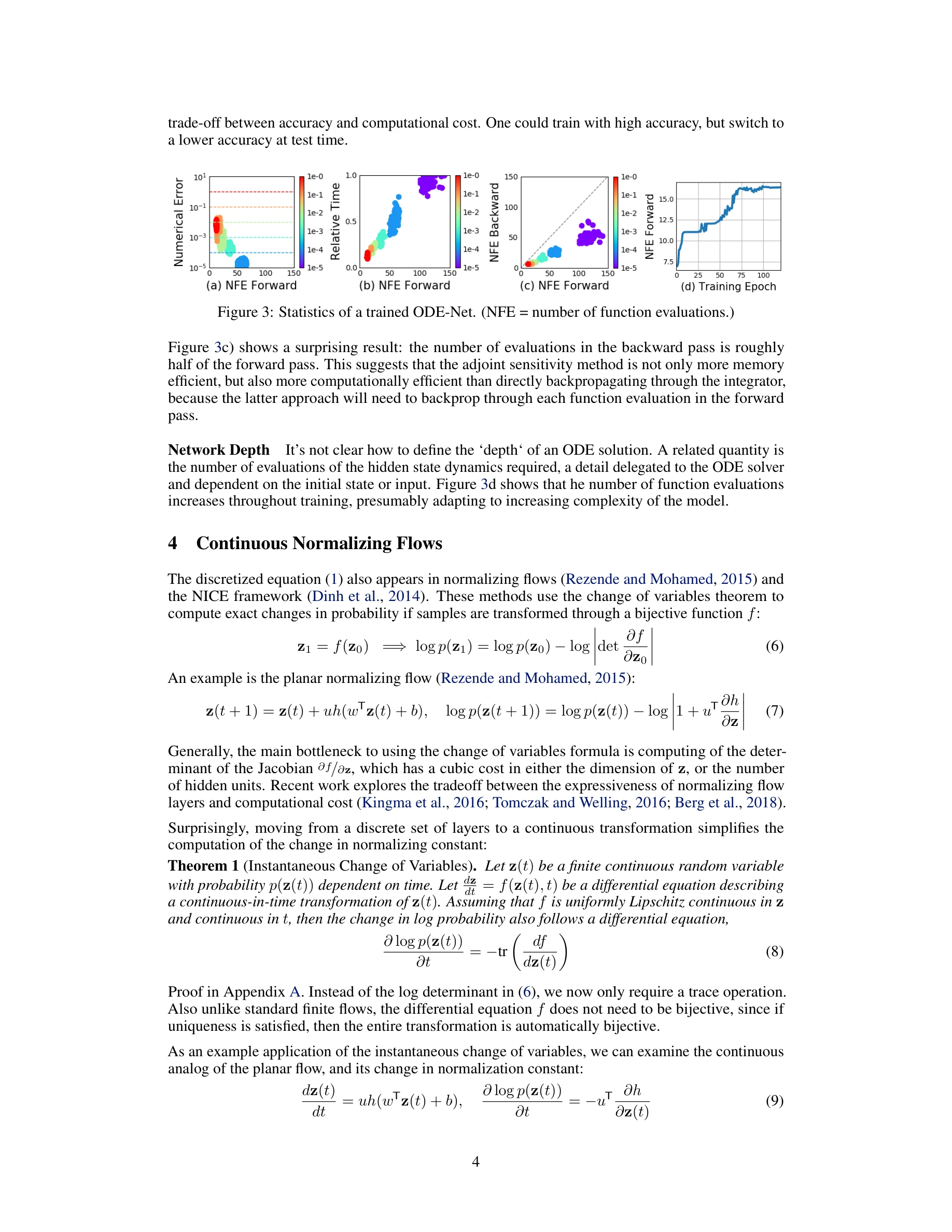

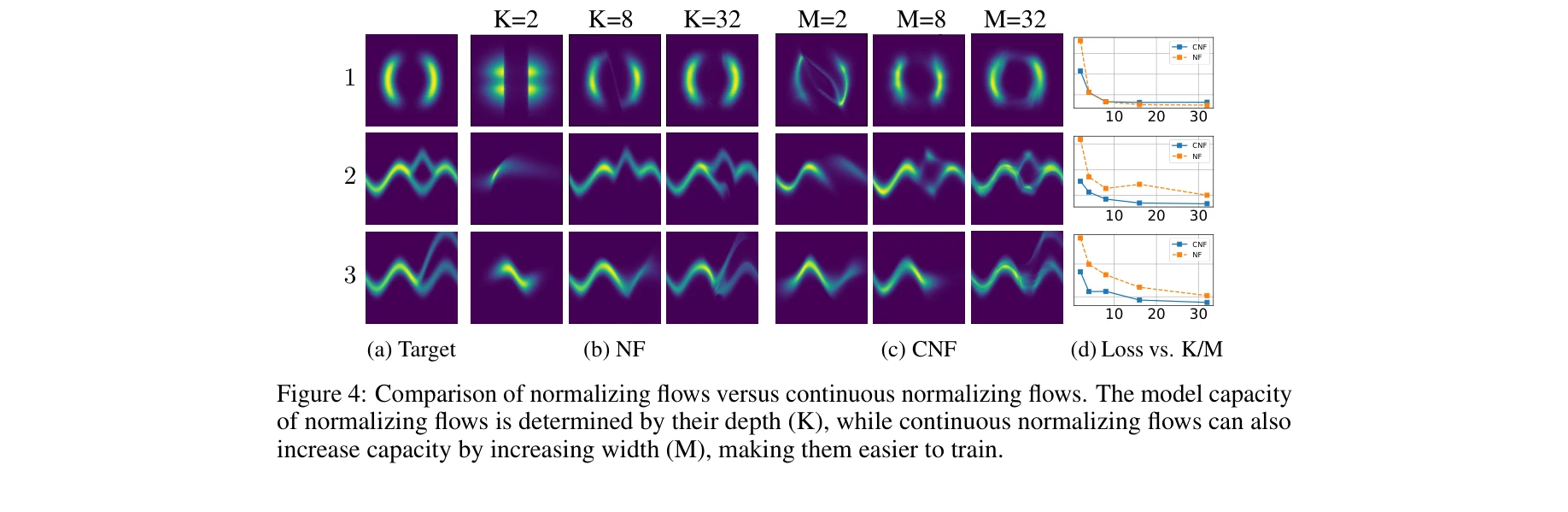

인스턴트 변수변환 정리: 연속 변환에서 로그 확률 변화가 야코비안 대각합의 음수로 표현되어 정규화 흐름의 계산 비용 급격히 감소

핵심 기술:

총평: 이 논문은 신경망을 연속 동역학 시스템으로 재개념화하여 메모리 효율성, 적응형 계산, 선형 복잡도 정규화 흐름이라는 혁신적 이점을 제시한 획기적 작업이다. 수반민감도 방법의 우아한 적용과 인스턴트 변수변환 정리의 수학적 발견은 진정한 원창성을 보여준다. 다만 실제 벽시계 시간 성능, 극단 케이스에서의 수치 안정성, 더 복잡한 데이터셋에서의 검증 등이 미흡하여, 개념적으로는 5점에 가깝지만 현실적 구현과 검증에서 4점 수준의 한계가 있다. 이론의 우아함과 잠재력만큼은 매우 높으며, 이후 학계의 광범위한 응용과 확장으로 이어진 점에서 그 영향력은 측정 불가능할 정도로 크다.