Essence

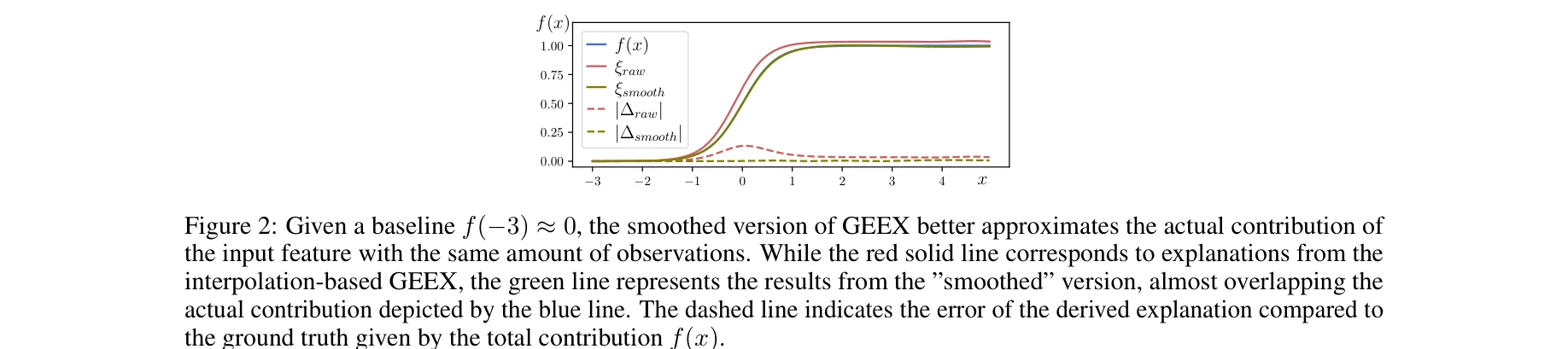

기준선 f(-3) ≈ 0이 주어질 때, GEEX의 평활화된 버전이 실제 기여도를 더 잘 근사함

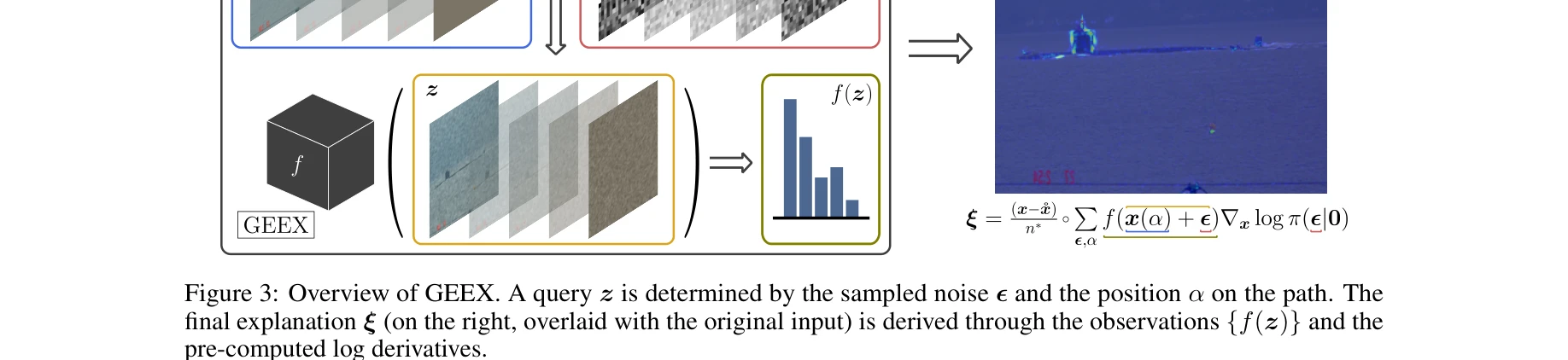

본 논문은 GEEX (Gradient-Estimation-based EXplanation)를 제안하여 블랙박스 설정에서도 화이트박스 수준의 그래디언트 유사 설명을 생성할 수 있음을 보인다. 쿼리 레벨 접근만으로 정밀한 특성 귀속(feature attribution)을 제공하면서도 완전성(Completeness), 민감도(Sensitivity) 등 기본 공리를 엄밀히 만족한다.