How

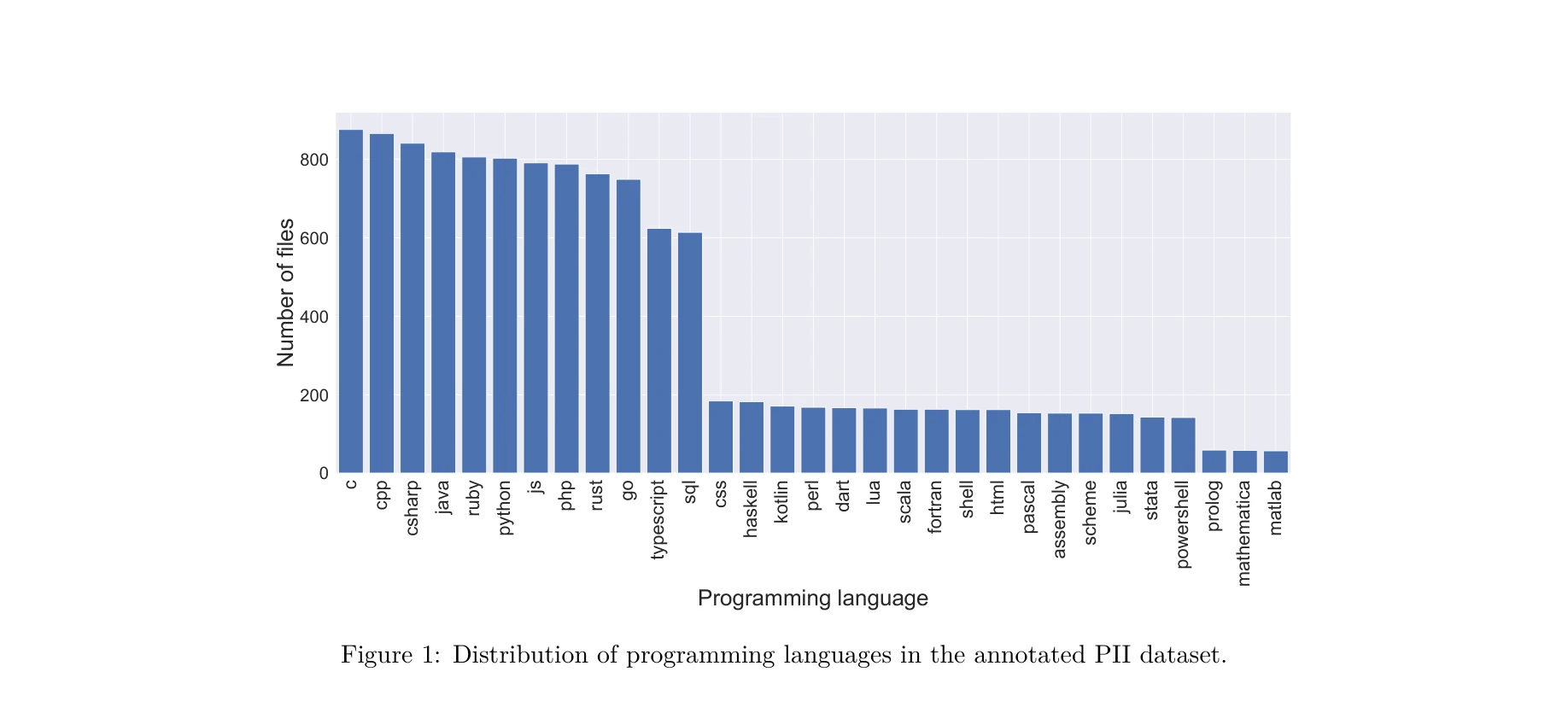

PII 주석 데이터셋의 프로그래밍 언어 분포

- 훈련 데이터: The Stack v1.2에서 80+ 프로그래밍 언어, GitHub 이슈, Git 커밋, Jupyter 노트북 포함 (6.4TB, 퍼미시브 라이선스)

- 데이터 거버넌스: "Am I in The Stack" 도구로 개발자의 코드 포함 여부 확인 및 옵트아웃 메커니즘 제공

- PII 제거: StarEncoder 기반 강화된 NER(Named Entity Recognition) 모델로 자동 감지 후 제거

- 속성 추적: 경량 멤버십 검사(Membership Inference) + BM25 검색으로 생성 결과의 훈련 데이터 유사도 판정

- 아키텍처: Transformer 기반 디코더 전용 구조에 MQA 적용으로 메모리 효율성 및 추론 속도 개선