Essence

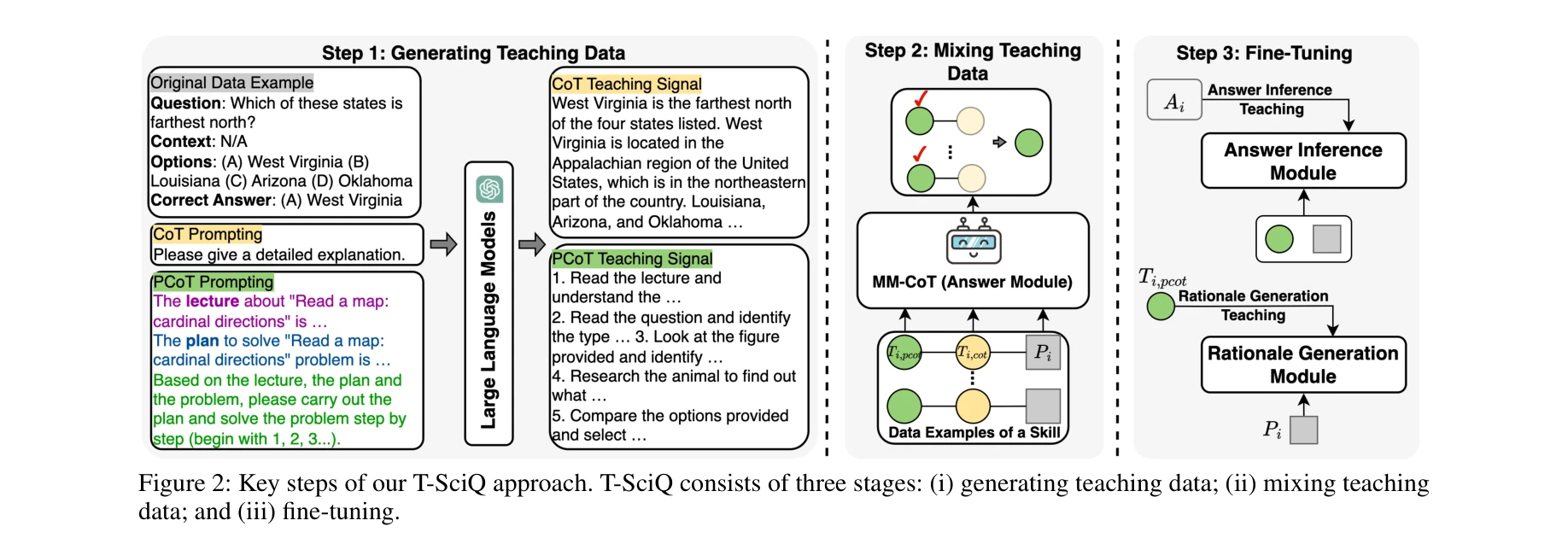

ScienceQA 데이터 예시: 인간 주석 CoT와 LLM 생성 CoT 비교. LLM 생성 CoT가 더 많은 외부 지식을 포함함

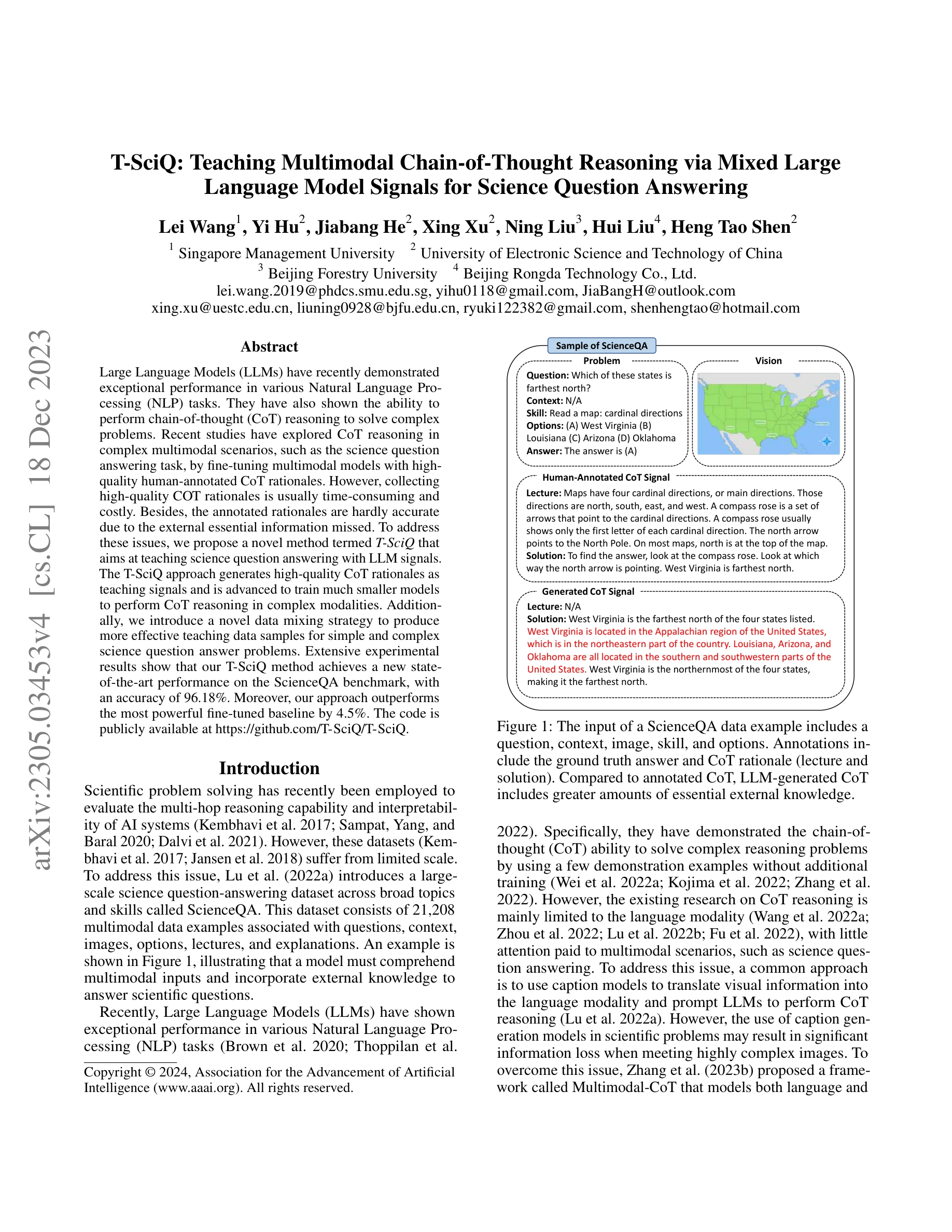

본 논문은 대형 언어 모델(LLM)이 생성한 연쇄적 사고(Chain-of-Thought, CoT) 신호를 혼합하여 과학 문제 해결 능력을 갖춘 소규모 학생 모델을 학습하는 T-SciQ 프레임워크를 제안한다. 인간 주석의 비용 문제와 정보 손실을 극복하기 위해 두 가지 유형의 자동 생성 교수 신호를 결합하는 혁신적인 데이터 혼합 전략을 도입한다.