Achievement

다양한 모델의 도구 사용 평가 결과: Pass Rate와 Win Rate (ChatGPT-ReACT 대비)

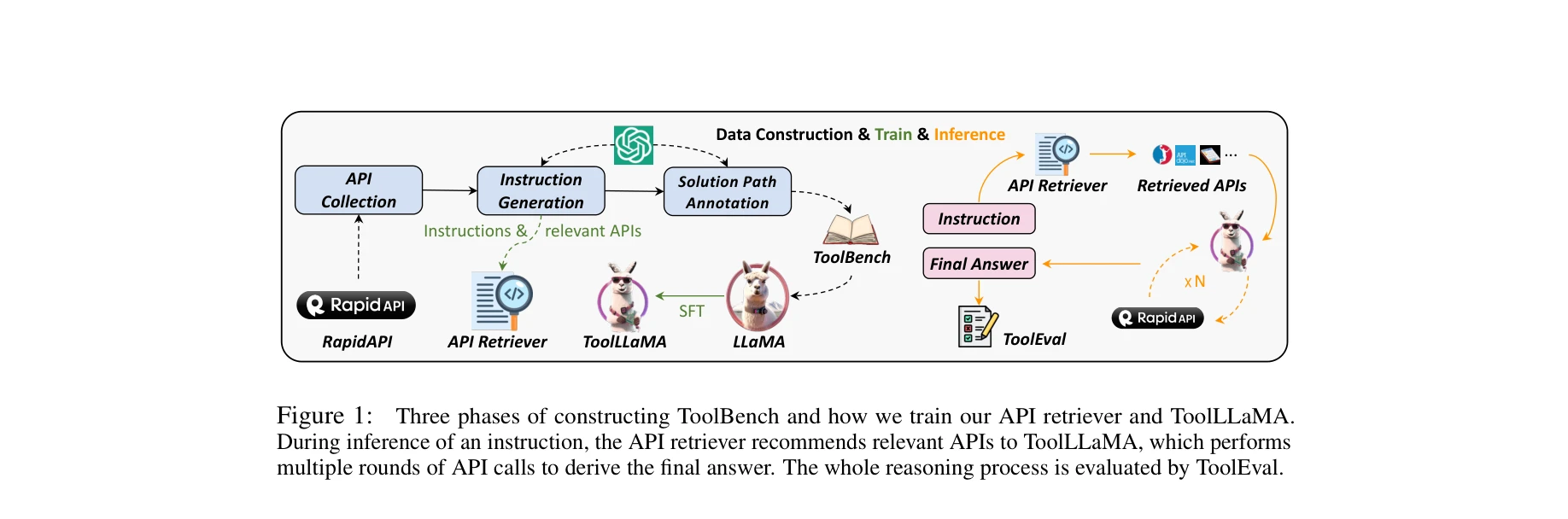

- 포괄적 데이터셋 구성: RapidAPI에서 49개 카테고리, 3,451개 도구(Tool), 16,464개 API로 이루어진 ToolBench 구축 (126,486개 지시문, 469,585개 실제 API 호출 포함)

- 우수한 모델 성능: ToolLLaMA는 Text-Davinci-003과 Claude-2를 능가하고 ChatGPT와 견줄 만한 성능 달성, GPT-4에만 약간 밀림

- 다중 도구 처리 능력: 단일 도구 및 복합 다중 도구 시나리오 모두 처리 가능

- 강력한 일반화: 훈련에 미포함된 APIBench 데이터셋에서 Gorilla와 동등한 성능 시연