저자: Timo Schick, Jane Dwivedi-Yu, Roberto Dessì, Roberta Raileanu, Maria Lomeli, Luke Zettlemoyer, Nicola Cancedda, Thomas Scialom | 날짜: 2023-02-09 | DOI: 10.48550/arXiv.2302.04761

Essence

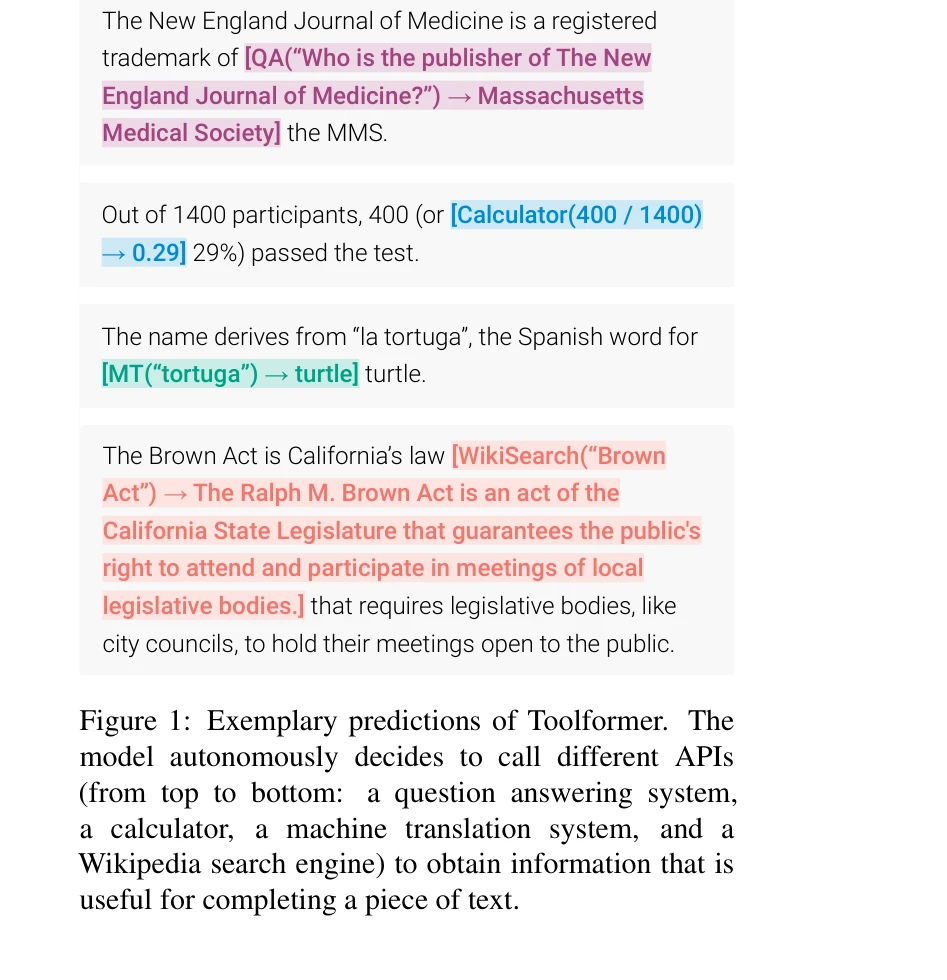

Figure 1: Toolformer의 예시적 예측. 모델이 자율적으로 다양한 API(위에서부터: 질의응답 시스템, 계산기, 기계번역 시스템, Wikipedia 검색 엔진)를 호출하여 텍스트 완성에 필요한 정보를 획득한다.

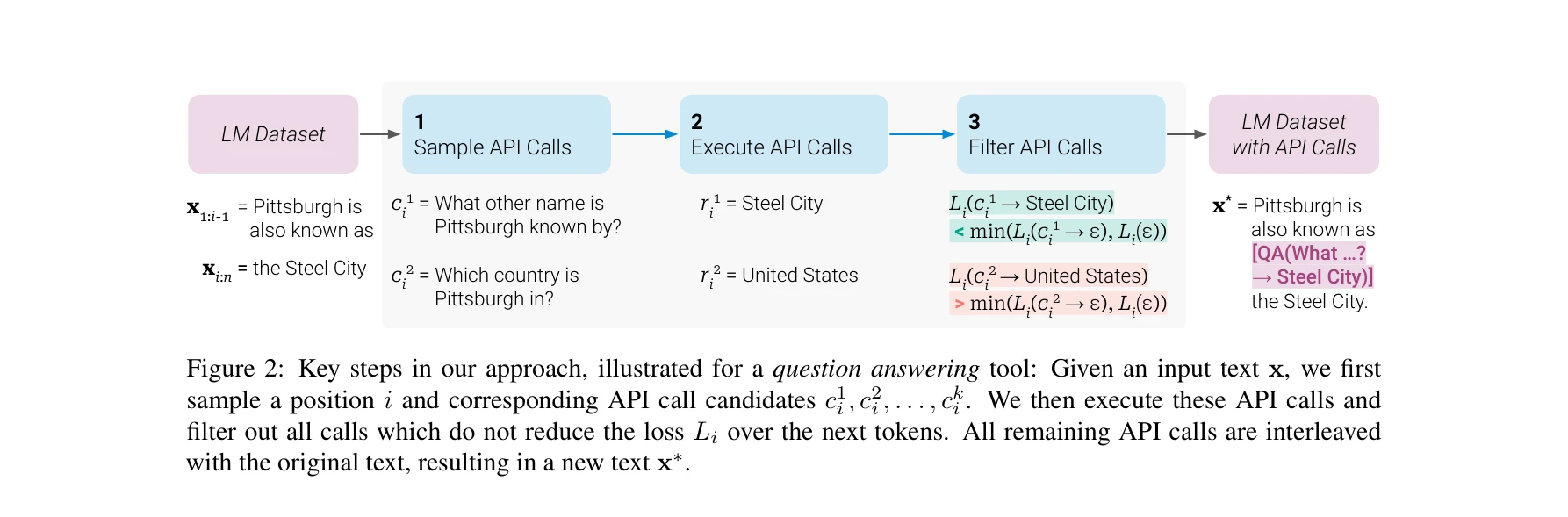

언어 모델이 자기 자신의 피드백만을 이용하여 계산기, 검색 엔진, 질의응답 시스템 등의 외부 도구를 언제 어떻게 사용할지 자동으로 학습할 수 있는 Toolformer 모델을 제안한다. 인간의 주석 없이 자가감독(self-supervised) 방식으로 학습되며, 6.7B 매개변수의 소규모 모델이 GPT-3보다 나은 성능을 달성한다.

Evaluation

총평: Toolformer는 인간 주석 없이 모델 자신의 피드백으로부터 도구 사용을 학습하는 획기적인 접근법을 제시함으로써, 언어 모델의 근본적 한계를 극복하는 실질적이고 일반적인 해결책을 제공한다. 비록 기술적으로는 기존 개념들의 신중한 조합이지만, 자동화된 데이터셋 생성과 효율적인 필터링을 통해 실용적 가치가 높으며, 소규모 모델의 대규모 모델 능가라는 임팩트있는 결과를 달성했다는 점에서 높이 평가된다.