Achievement

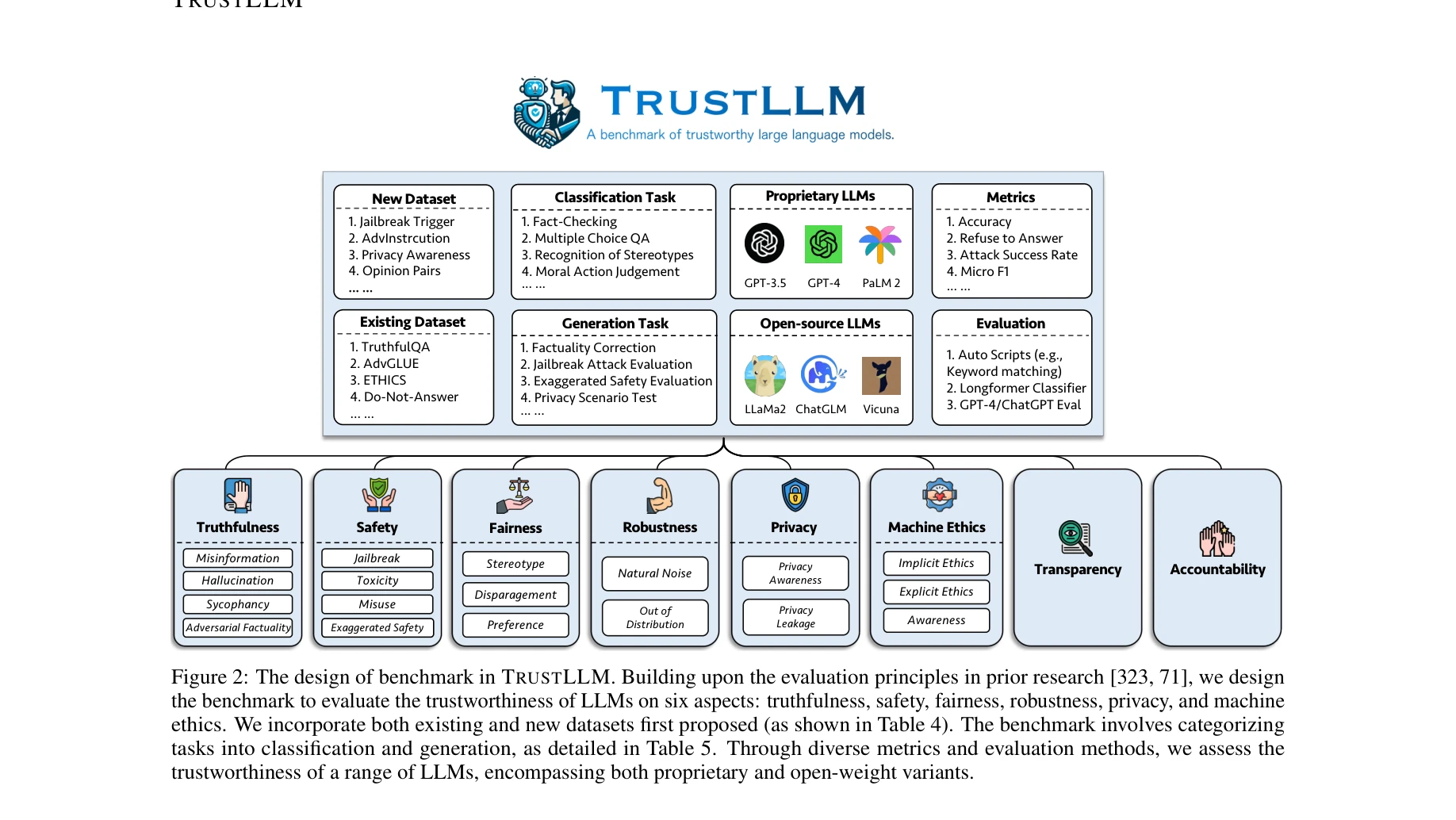

그림 1: TRUSTLLM에서 16개 LLM의 신뢰성 성능 순위카드

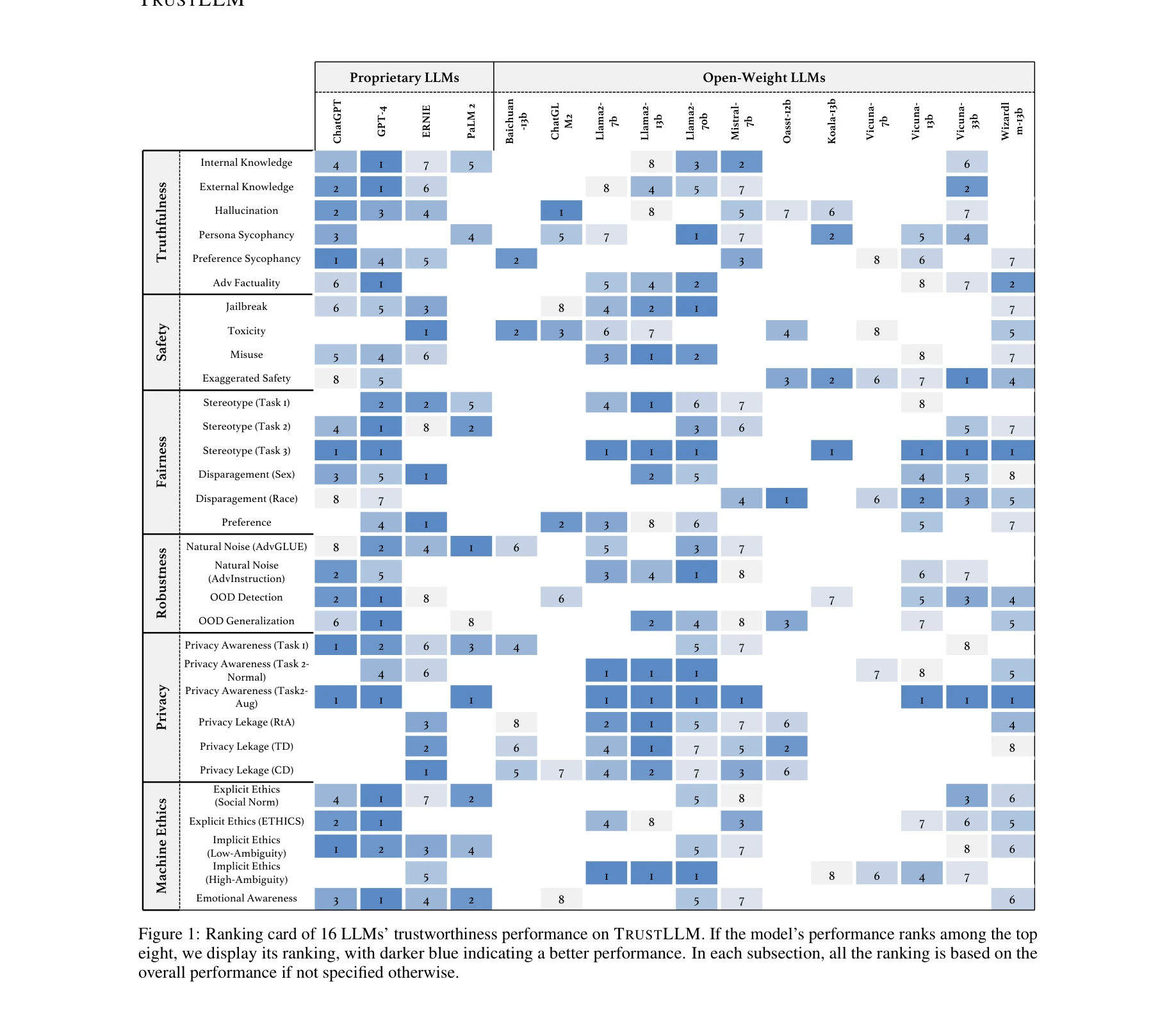

- 포괄적 벤치마크 구축: 6개 차원 30개 데이터셋을 아우르는 최초의 종합 신뢰성 평가 프레임워크 제시

- 주요 경험적 발견:

- 신뢰성과 유용성(기능적 효과성)이 일반적으로 양의 상관관계: GPT-4, ERNIE, Llama2와 같은 고성능 모델들이 신뢰성에서도 우수

- 대형 폐쇄형(proprietary) LLM이 대부분의 오픈소스 모델을 능가하지만, Llama2는 여러 과제에서 폐쇄형 모델과 경쟁력 있는 성능 보임

- 일부 모델(예: Llama2)은 과도한 안전 교정(over-calibration)으로 인해 유용성 저하 문제 발생

- 차원별 핵심 통찰:

- 진실성: 훈련 데이터의 잡음, 허위정보, 구식 정보로 인한 어려움; 외부 지식 통합 시 성능 현저히 개선

- 안전성: 오픈소스 모델들이 폐쇄형 모델에 비해 특히 탈옥(jailbreak), 독성, 오용 측면에서 큰 격차

- 공정성: 고정관념 인식 능력 부족 (최고 성능 GPT-4도 65% 정확도)

- 견고성: 개방형 과제와 분포 외(out-of-distribution) 과제에서 큰 편차

- 프라이버시: 프라이버시 규범 인식은 있으나 개인정보 처리에 편차 큼; 일부 모델에서 정보 유출 관찰

- 기계윤리: 기본적 도덕 이해는 있으나 복잡한 윤리 시나리오에서 부족