Essence

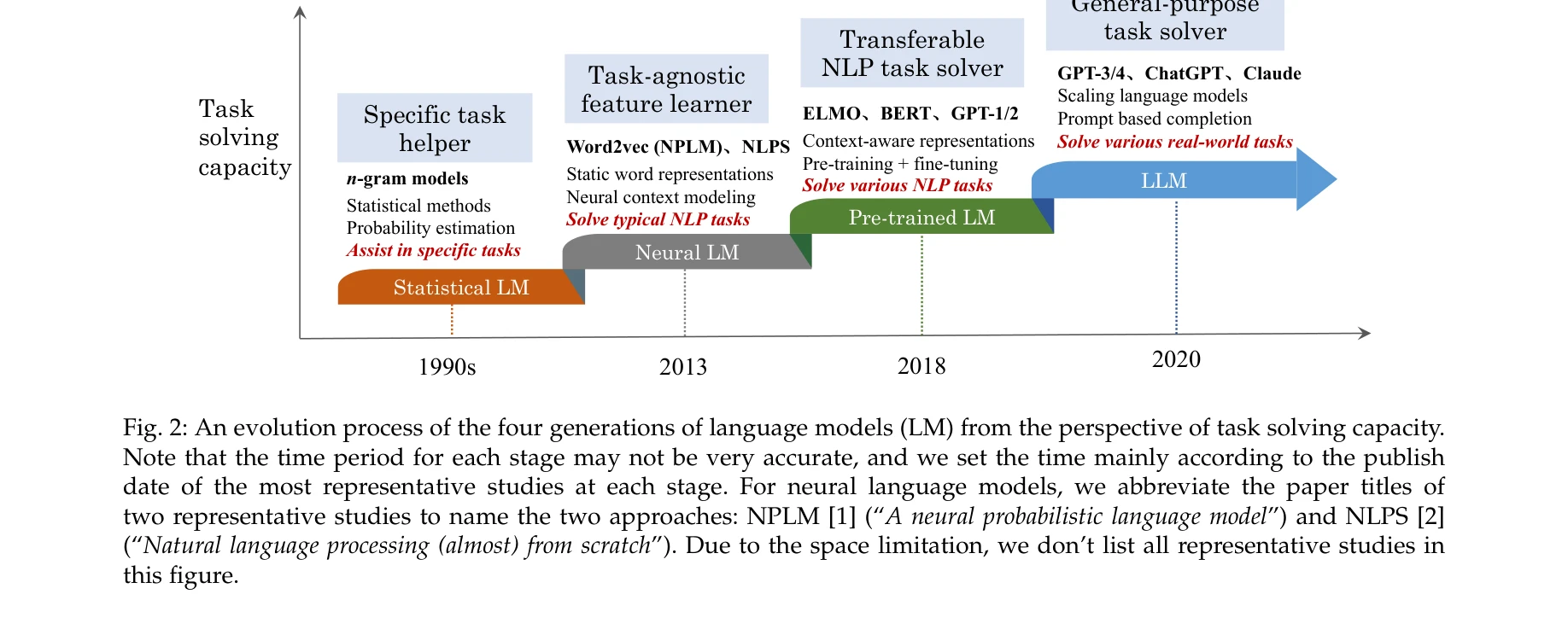

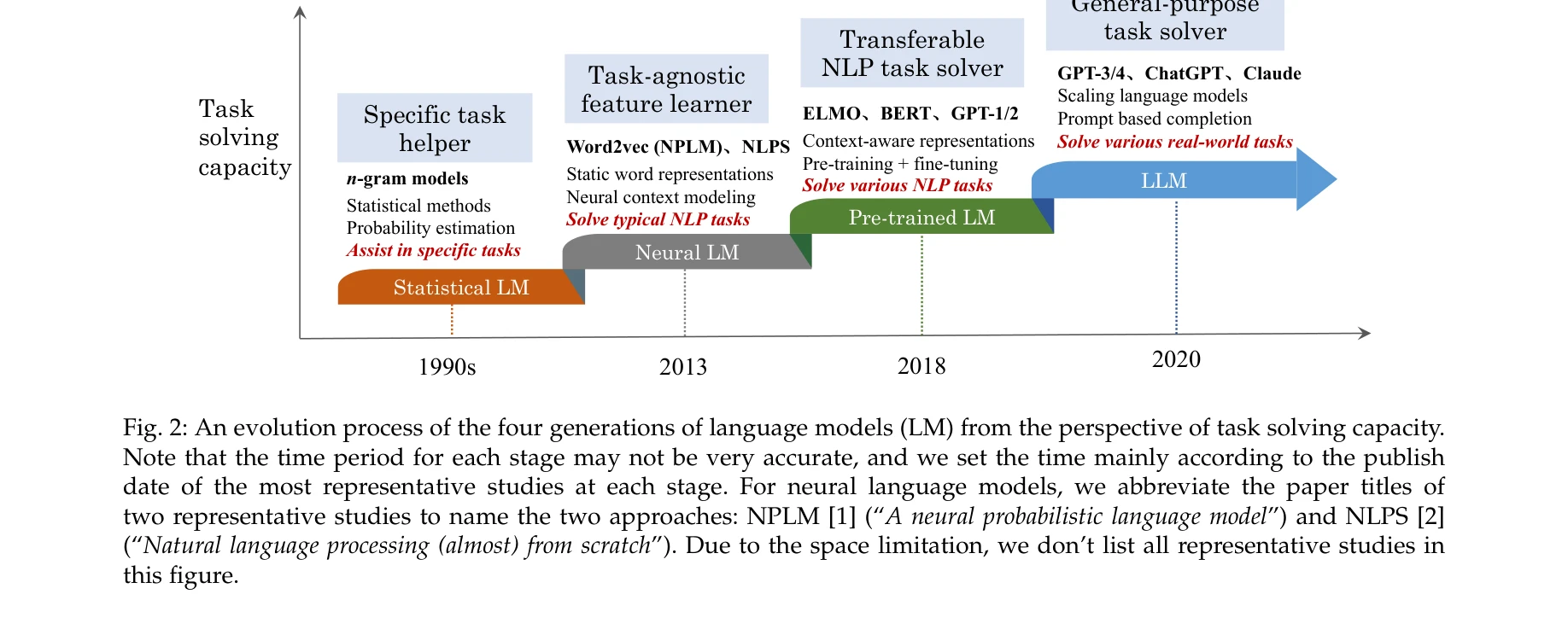

Fig. 2: An evolution process of the four generations of language models (LM) from the perspective of task solving capaci

대규모 언어모델(LLM)의 발전 과정을 통계적 언어모델부터 신경망 언어모델, 사전학습 언어모델을 거쳐 현재의 생성형 대규모 모델까지 체계적으로 조사한 종합 서베이 논문이다.

저자: Wayne Xin Zhao, Kun Zhou, Junyi Li, Tianyi Tang, Xiaolei Wang, Yupeng Hou, Yingqian Min, Beichen Zhang, Junjie Zhang, Zican Dong, Yifan Du, Yang Chen, Yushuo Chen, Zhipeng Chen, Jinhao Jiang, Ruiyang Ren, Yifan Li, Xinyu Tang, Zikang Liu, Peiyu Liu | 날짜: 2023 | URL: https://arxiv.org/abs/2303.18223

Fig. 2: An evolution process of the four generations of language models (LM) from the perspective of task solving capaci

대규모 언어모델(LLM)의 발전 과정을 통계적 언어모델부터 신경망 언어모델, 사전학습 언어모델을 거쳐 현재의 생성형 대규모 모델까지 체계적으로 조사한 종합 서베이 논문이다.

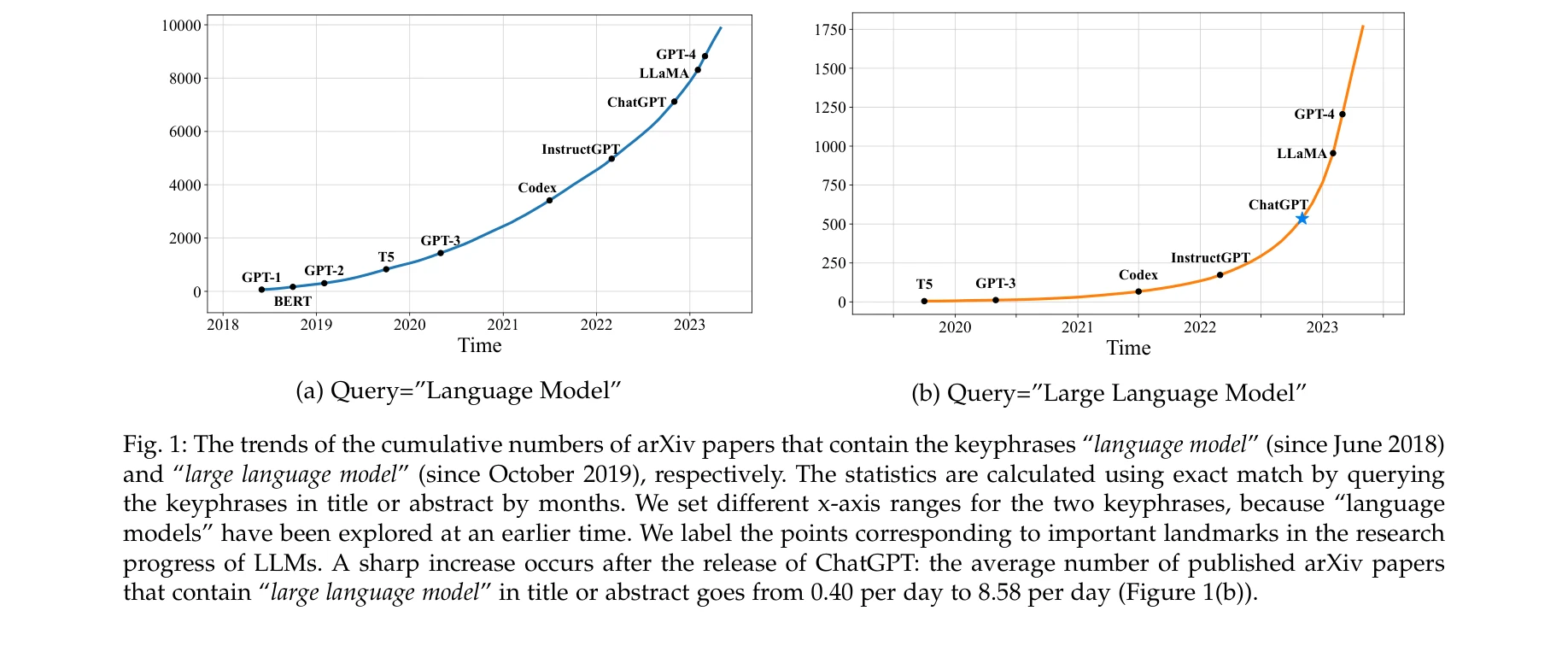

Fig. 1: The trends of the cumulative numbers of arXiv papers that contain the keyphrases “language model” (since June 20

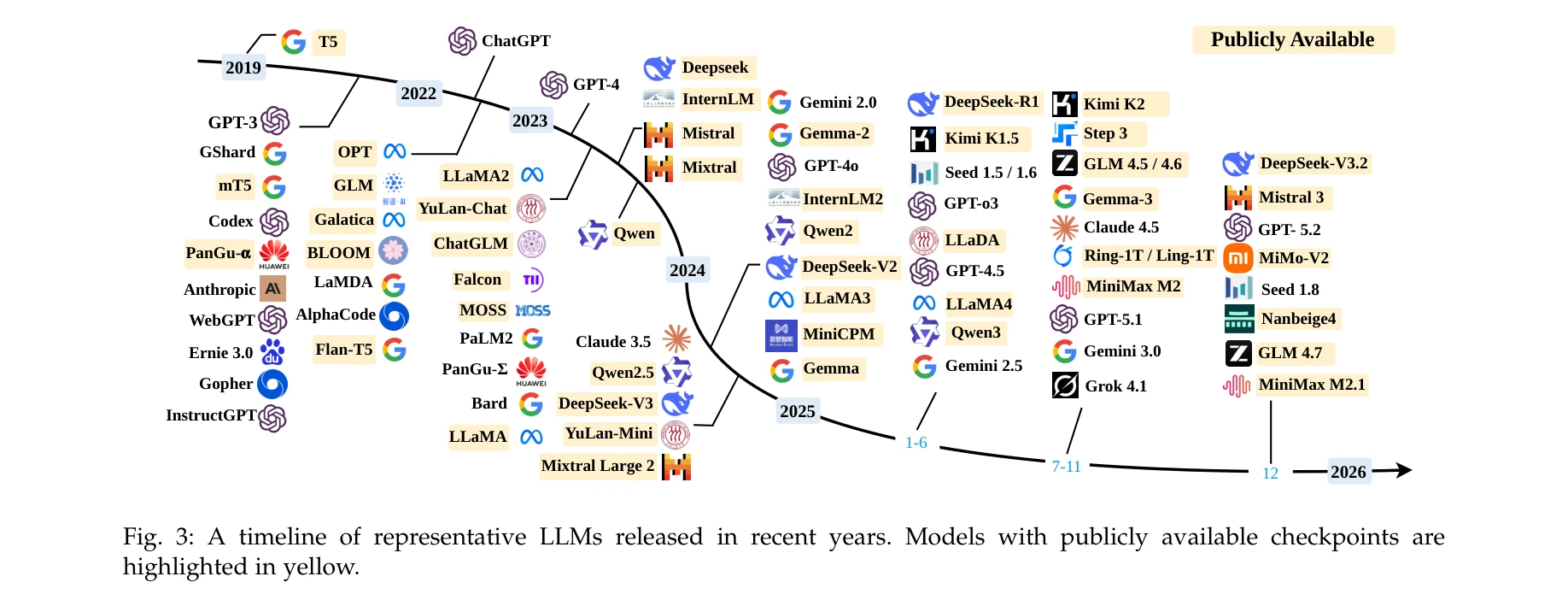

Fig. 3: A timeline of representative LLMs released in recent years. Models with publicly available checkpoints are

총평: 이 서베이는 대규모 언어모델의 발전 역사와 핵심 기술을 체계적으로 정리한 매우 시의적절한 종합 자료로, 연구자와 실무자 모두에게 LLM의 현황을 이해하는 데 필수적인 참고자료이다.