Essence

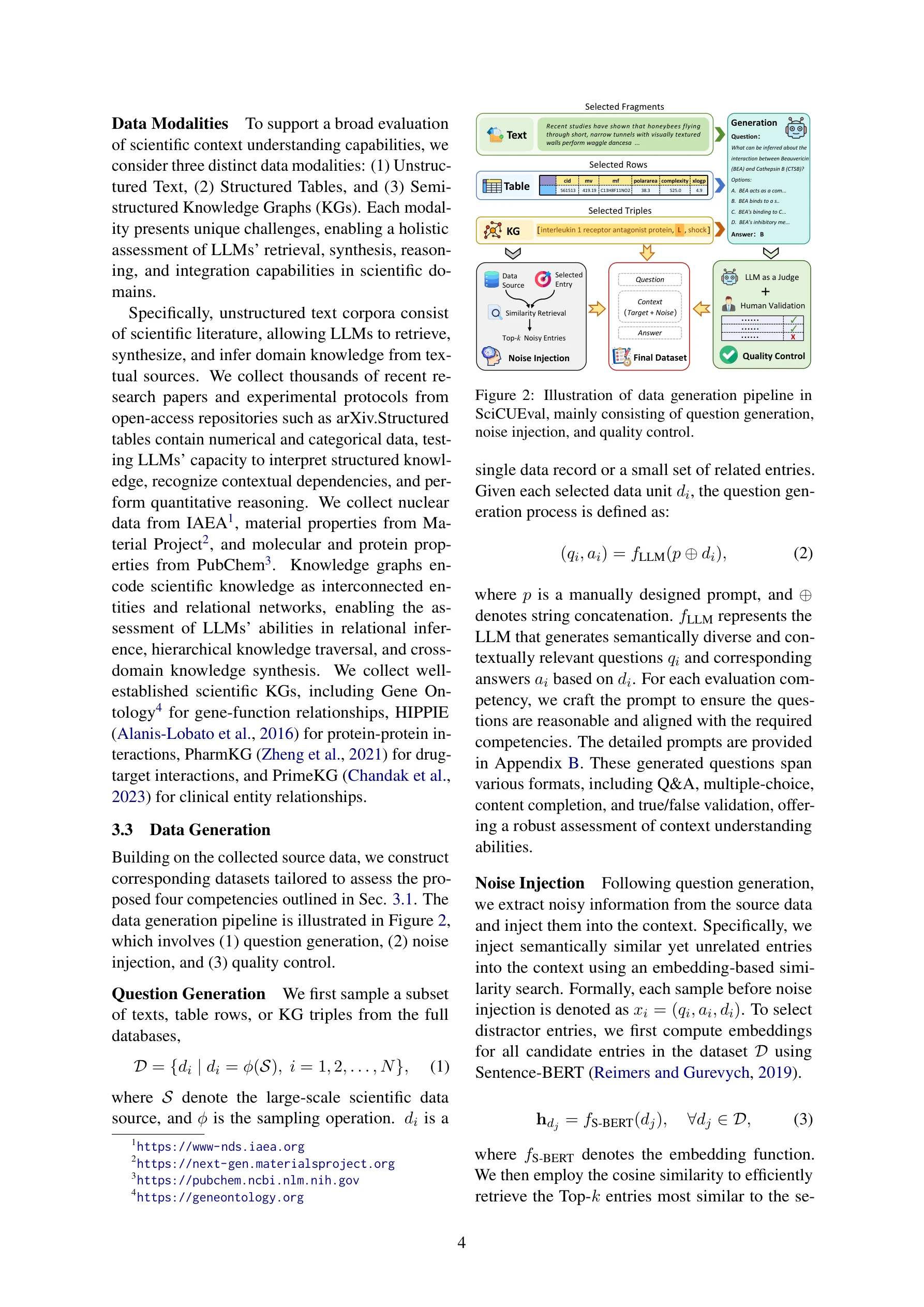

SciCUEval은 5개 과학 도메인, 3가지 데이터 모달리티, 4가지 질문 유형을 포함하는 포괄적 벤치마크

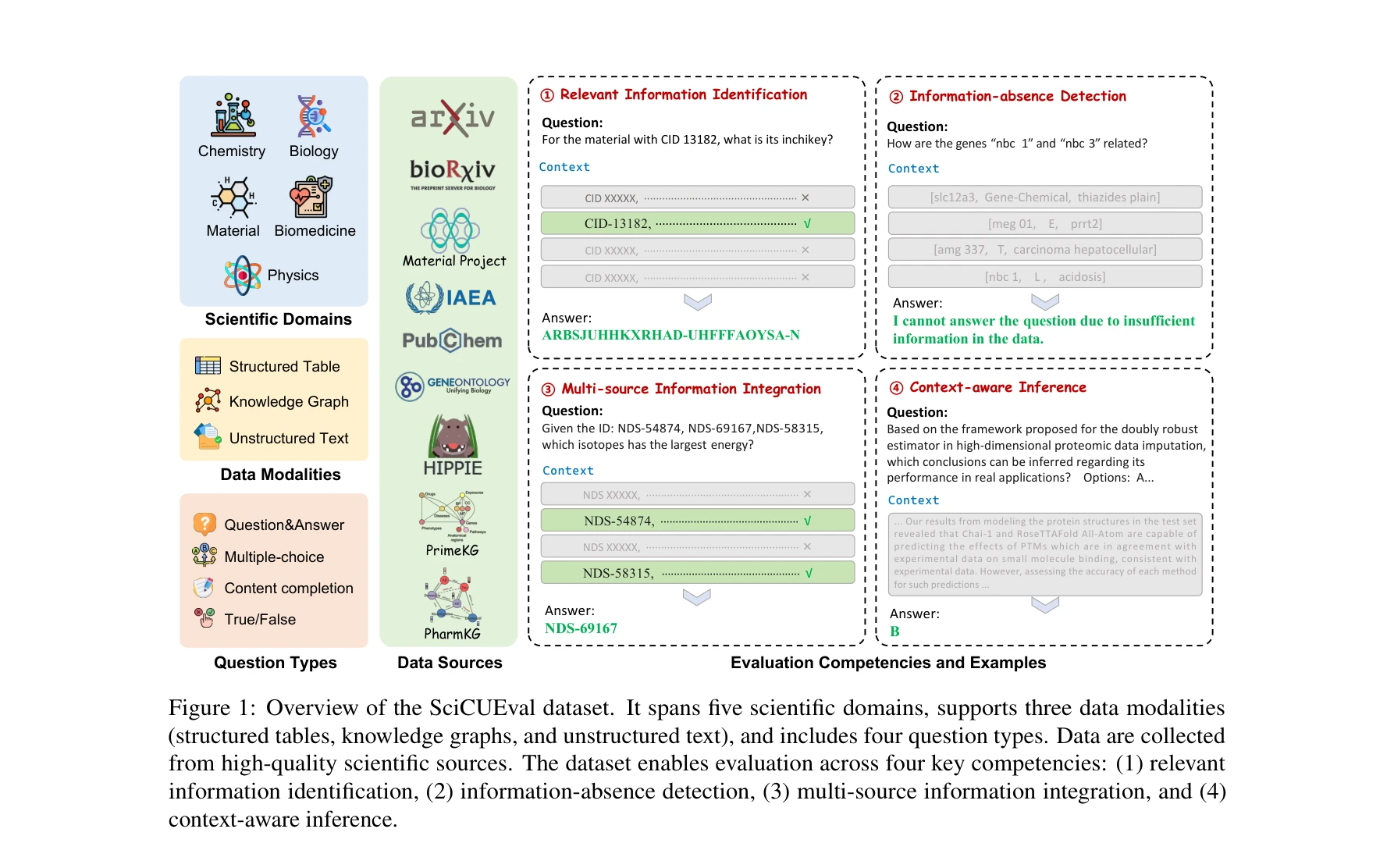

본 논문은 대규모 언어모델(LLM)의 과학적 맥락 이해 능력을 평가하기 위한 포괄적 벤치마크 데이터셋 SciCUEval을 제안한다. 생물학, 화학, 물리학, 생의학, 재료과학 등 5개 도메인에 걸친 10개의 부분 데이터셋으로 구성되며, 비정형 텍스트, 구조화된 표, 지식 그래프 등 다양한 데이터 모달리티를 통합하여 LLM의 과학적 맥락 이해 능력을 체계적으로 평가한다.