저자: Xiaoxuan Wang, Ziniu Hu, Pan Lu, Yanqiao Zhu, Jieyu Zhang, Satyen Subramaniam, Arjun R. Loomba, Shichang Zhang, Yizhou Sun, Wei Wang | 날짜: 2023-07-20 | DOI: N/A

Essence

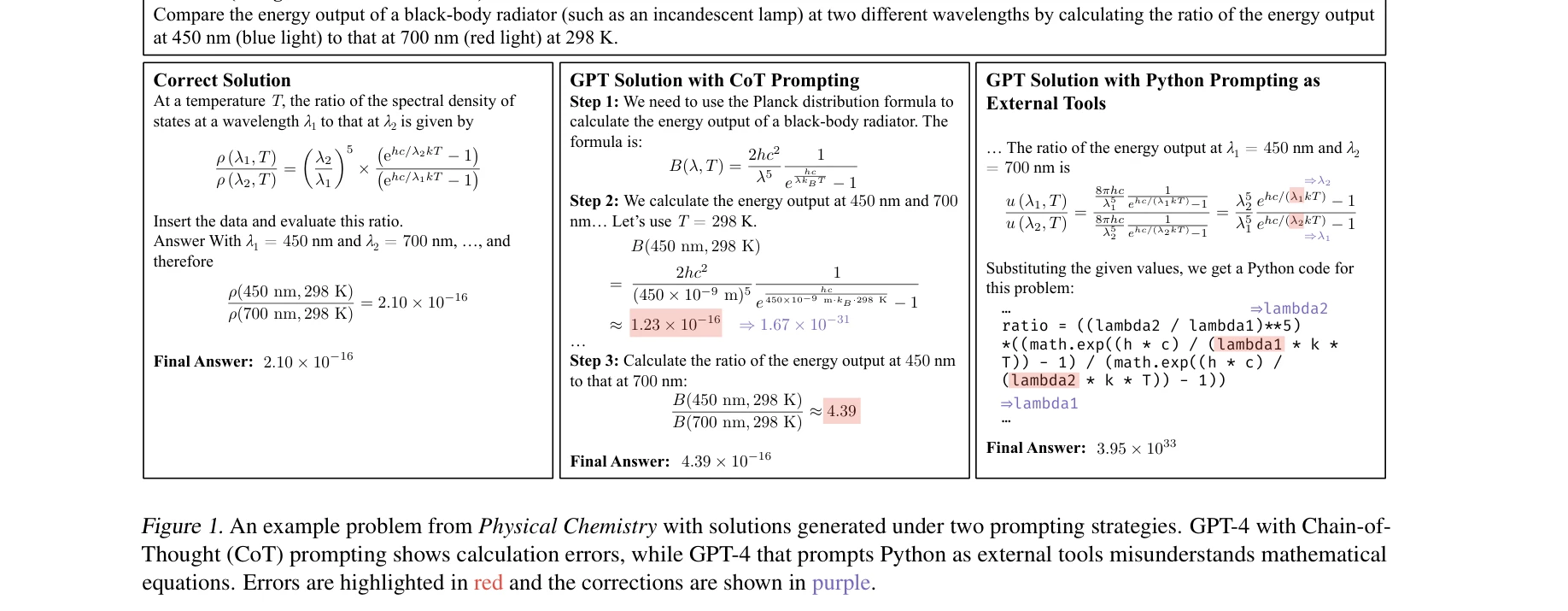

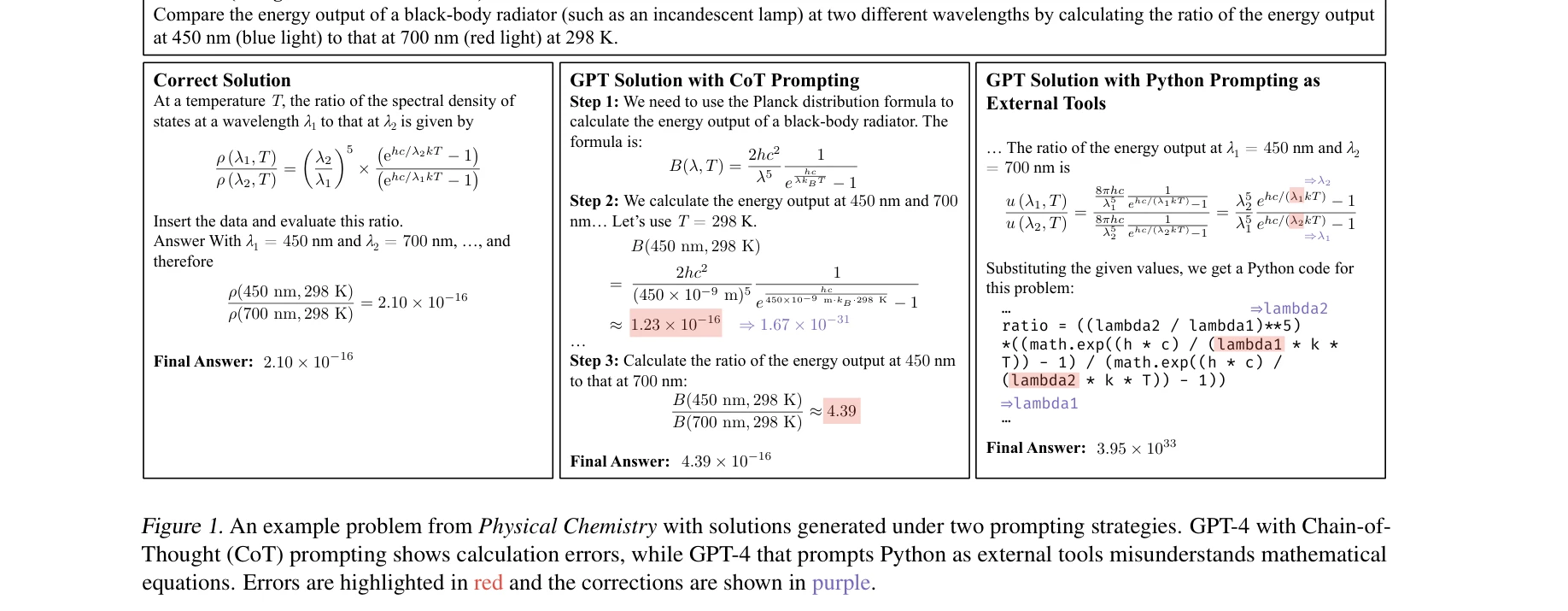

Figure 1: Physical Chemistry 문제의 두 가지 프롬프팅 전략에 따른 GPT-4의 해결 시도. CoT 프롬프팅에서는 공식은 맞지만 계산 오류가 발생하고, Python 외부 도구 사용 시에는 수학적 관계 오해로 인한 오류 발생

본 논문은 대학 수준의 과학 문제 해결 능력을 평가하기 위한 포괄적 벤치마크인 SciBench를 제시한다. 기존 벤치마크의 고등학교 수준 문제 중심 한계를 극복하기 위해 869개의 대학 수준 수학, 화학, 물리 문제와 177개의 멀티모달 문제를 포함한 데이터셋을 구축했다.

Evaluation

총평: SciBench는 LLM의 과학적 추론 능력을 평가하기 위한 매우 중요한 벤치마크로, 기존 고등학교 수준의 단순 산술 중심 평가를 넘어 대학 수준의 복합 과학 문제로 확장했다는 점에서 큰 의의가 있다. 특히 10가지 세분화된 문제 해결 능력 분류와 프롬프팅 전략의 trade-off 분석은 향후 LLM 개선의 명확한 방향을 제시한다. 멀티모달 평가의 포함, 폐쇄 데이터셋을 통한 평가 무결성 보장, 다양한 LLM에 대한 포괄적 벤치마킹은 충분히 견고한 기초를 마련했다. 다만 자동 채점의 한계와 도메인별 세부 분석의 부족은 향후 개선 과제이며, 부분 점수 체계의 도입이나 논리적 타당성 평가 프레임워크의 개발이 필요하다. 전반적으로 과학 AI 분야의 발전에 중요한 표준이 될 수 있는 견고하고 영향력 있는 연구이다.