Essence

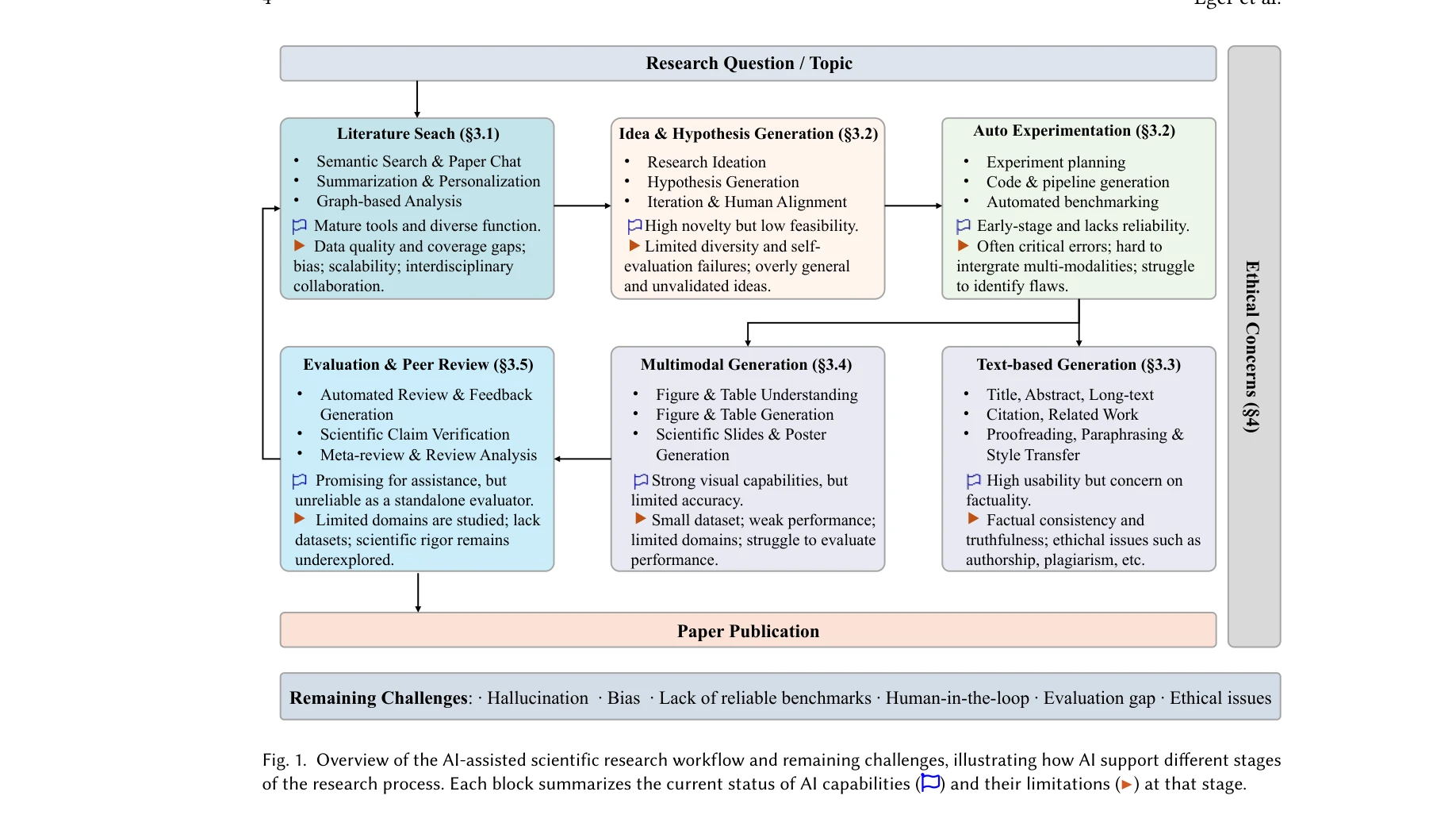

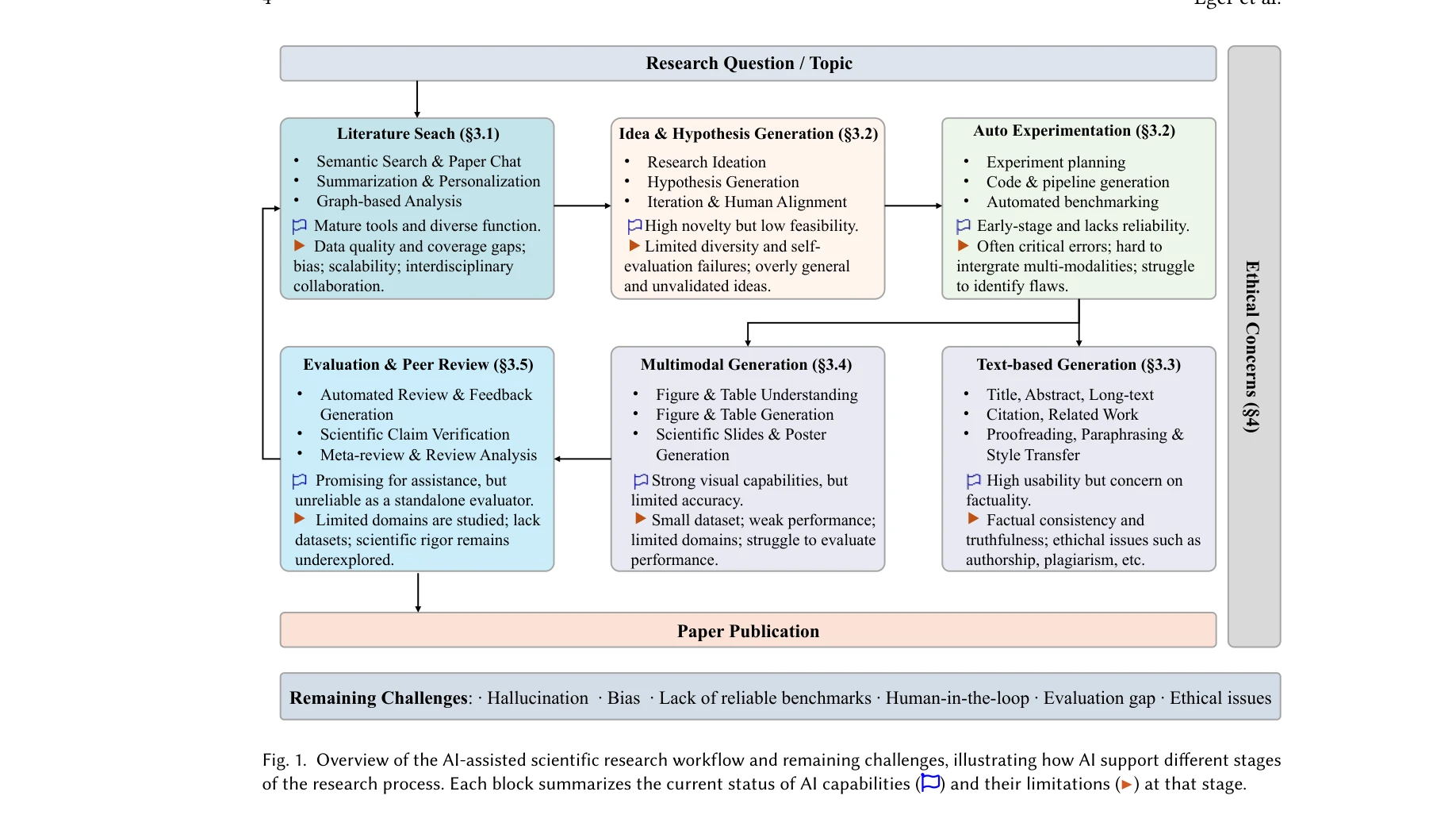

Figure 1: AI 보조 과학 연구 워크플로우 및 남은 과제들의 개요. 문헌 검색부터 동료 평가까지 각 단계에서 AI 지원의 현황과 한계를 보여줌.

대규모 다중모드 언어 모델(LLM)의 등장으로 과학 연구가 AI 기반의 기술적 변환의 임계점에 도달했으며, 본 논문은 문헌 검색, 실험 설계, 콘텐츠 생성, 동료 평가에 이르는 전체 연구 생명주기에서 AI의 역할을 체계적으로 검토하는 종합 서베이이다.

저자: Steffen Eger, Yong Cao, Jennifer D'Souza, Andreas Geiger, Christian Greisinger, Stephanie Gross, Yufang Hou, Brigitte Krenn, Anne Lauscher, Yizhi Li, Chenghua Lin, Nafise Sadat Moosavi, Wei Zhao, Tristan Miller | 날짜: 2025-02-07 | DOI: N/A

Figure 1: AI 보조 과학 연구 워크플로우 및 남은 과제들의 개요. 문헌 검색부터 동료 평가까지 각 단계에서 AI 지원의 현황과 한계를 보여줌.

대규모 다중모드 언어 모델(LLM)의 등장으로 과학 연구가 AI 기반의 기술적 변환의 임계점에 도달했으며, 본 논문은 문헌 검색, 실험 설계, 콘텐츠 생성, 동료 평가에 이르는 전체 연구 생명주기에서 AI의 역할을 체계적으로 검토하는 종합 서베이이다.

총평: 이 논문은 급속히 발전하는 AI4Science 분야에 대한 종합적이고 구조화된 첫 번째 가이드로서, 신입 연구자부터 정책결정자까지 폭넓은 대상에게 높은 참고가치를 제공한다. 특히 윤리 및 연구 무결성 논의의 통합은 기술 발전을 넘어선 책임 있는 과학 지원 시스템 구축에 중요한 기초를 마련한다. 다만 내러티브 접근법의 한계로 인한 완전성 부족과 빠르게 변화하는 분야에서의 시간성 격차 극복이 과제이다.