Essence

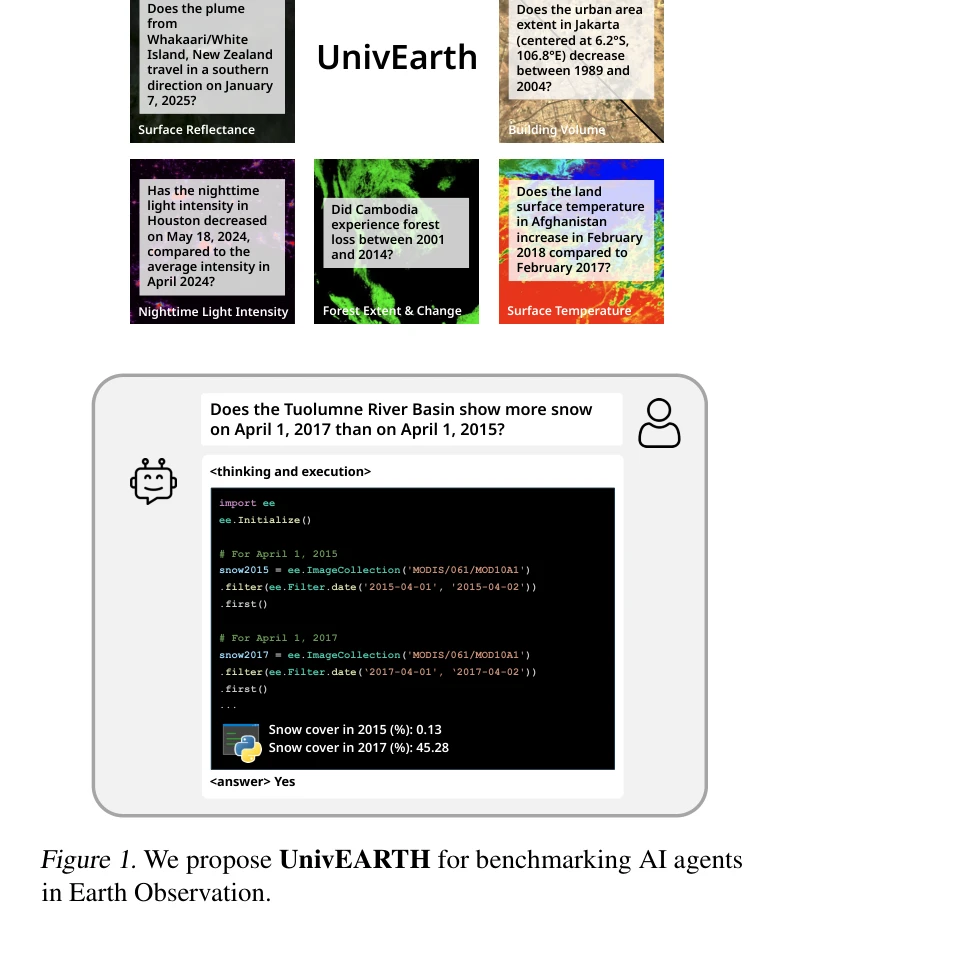

UnivEARTH 벤치마크는 NASA Earth Observatory 기사에서 추출한 140개의 지구 관측 관련 예/아니오 질문으로 구성되며, Google Earth Engine API를 활용하여 LLM 에이전트를 평가한다.

본 논문은 지구 관측(Earth Observation, EO) 작업을 자동화하기 위한 LLM 에이전트의 준비도를 평가하기 위해 UnivEARTH 벤치마크를 제시하고, 현재 최첨단 모델들이 코드 실행 실패(58%)로 인해 33% 수준의 낮은 정확도만 달성함을 보여준다.