Achievement

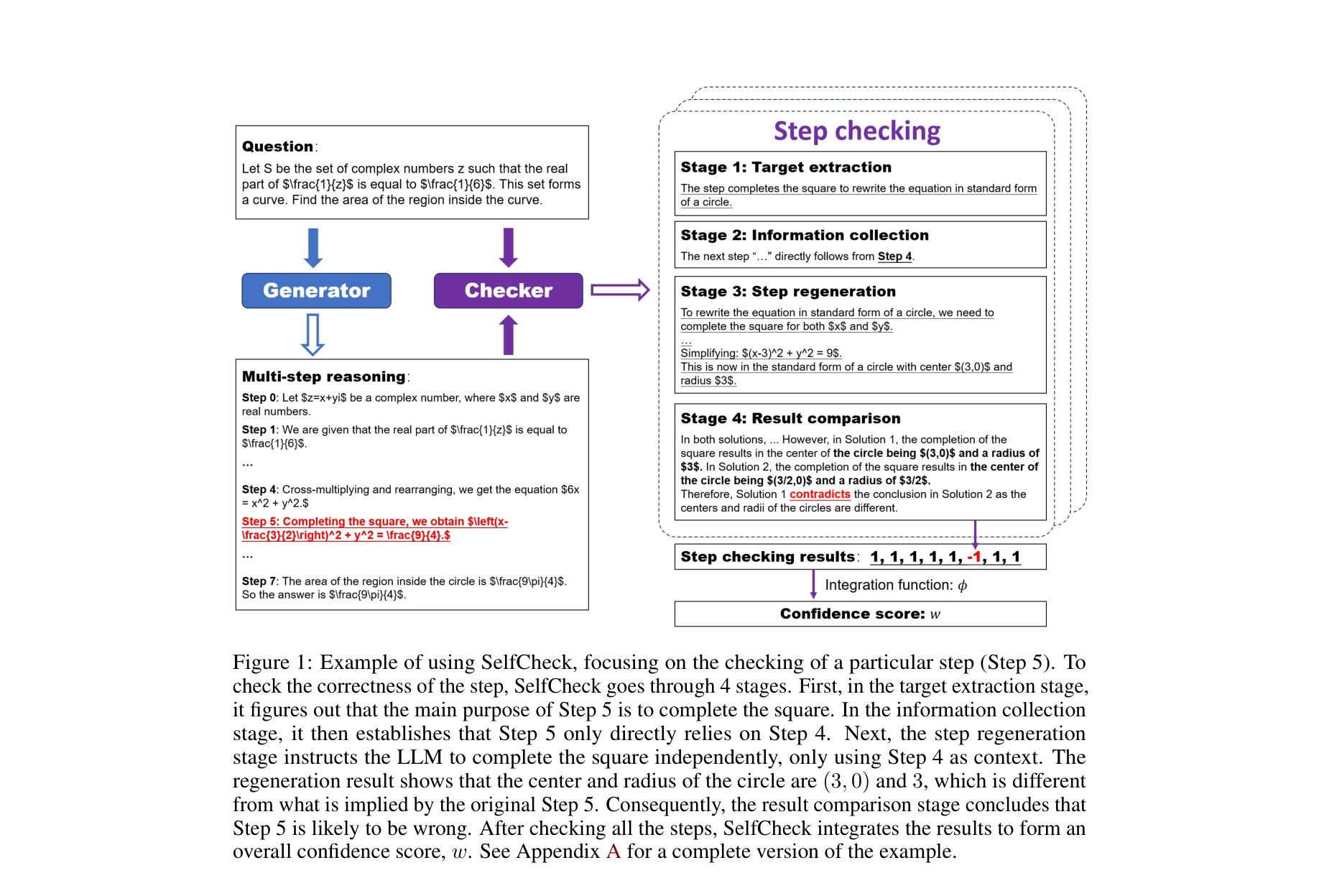

SelfCheck의 구체적 실행 예시: 5번 단계의 정사각형 완성(completing the square) 검증 과정을 4단계로 분해하여 수행

- 오류 인식 성능: GSM8K, MathQA, MATH 데이터셋의 세 수학 과제 모두에서 단순 다수결 투표(majority voting) 대비 최종 정답 정확도 대폭 상승. 낮은 신뢰도 솔루션 필터링 시 부정답 비율을 9%, 22.8%, 16.2% 감소.

- 신뢰도 점수의 유효성: SelfCheck가 제공하는 신뢰도 점수를 가중치로 사용한 가중 투표(weighted voting)를 통해 정답 정확도 향상. 신뢰도 점수가 실제 정답 여부와 의미 있는 상관관계 보유.