Essence

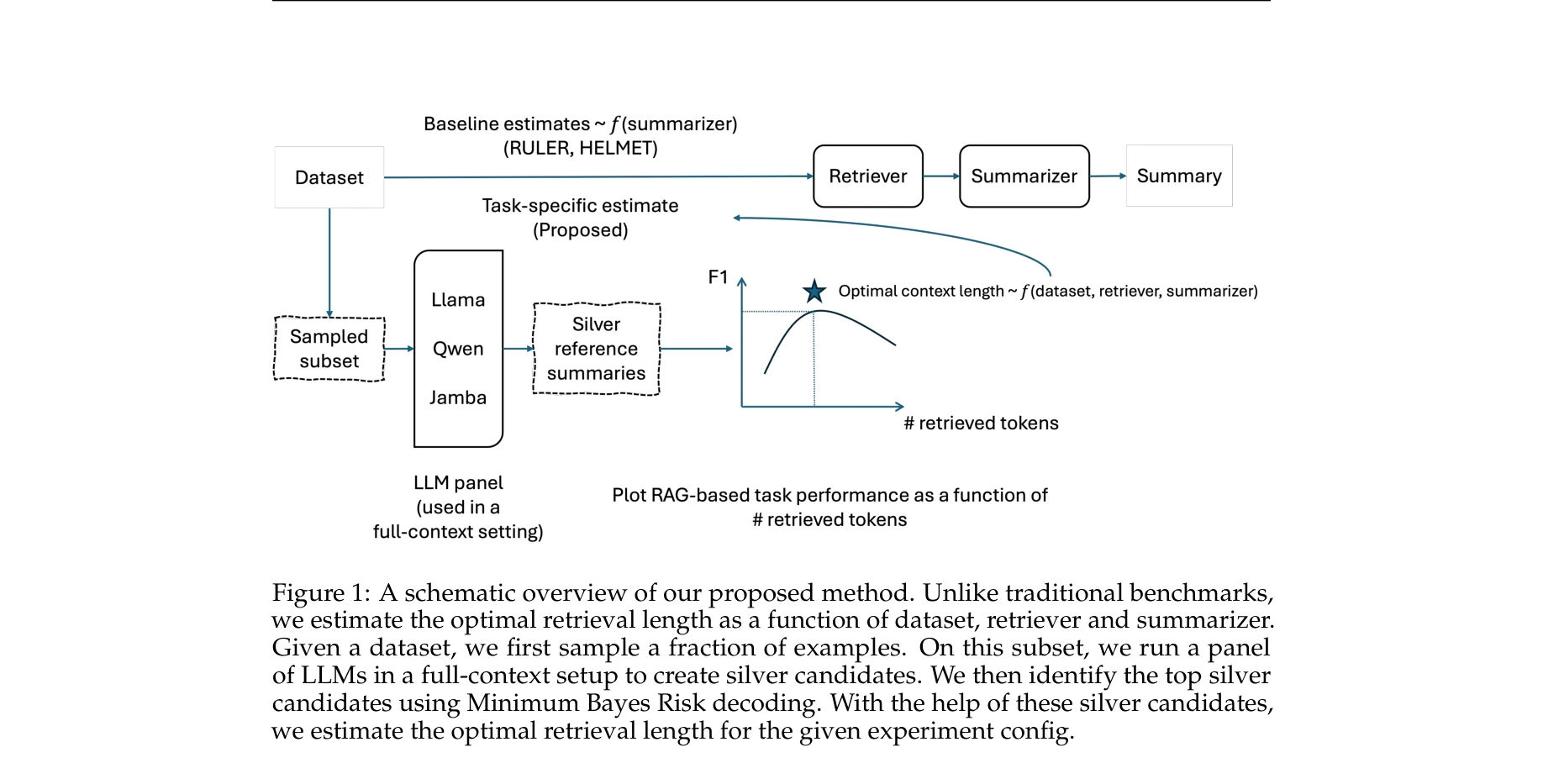

최근 대형 언어모델(LLM)의 장문맥 처리 능력 향상에도 불구하고, 실제로는 선언된 문맥 길이에서 효과적이지 못한 한계가 있다. 본 논문은 검색증강생성(RAG)과 장문맥 모델을 결합하되, 다중문서 요약 작업에 최적화된 검색 문맥 길이를 체계적으로 추정하는 방법을 제안한다.

Evaluation

총평: 본 논문은 RAG 기반 다중문서 요약에서 검색 문맥 길이 최적화의 실무적 문제를 타당한 방법으로 해결한다. 다만 단일 데이터셋 평가, 제한적 계산 오버헤드 분석, 설계 선택의 정당성 부족 등으로 인해 학술적 기여도는 중간 수준이다.

같이 보면 좋은 논문

기반 연구

다중문서 요약에 최적화된 문맥 길이 추정을 위해 S2ORC의 대규모 학술논문 데이터를 실험 데이터셋으로 활용할 수 있다.

기반 연구

인용 관계 예측을 위한 그래프 신경망 기술을 검색증강생성의 최적 문맥 길이 추정에 활용하여 관련 문서 검색 성능을 개선할 수 있다.

다른 접근

정보 병목 기반 테스트 타임 스케일링과 최적 컨텍스트 길이 추정이 서로 다른 긴 입력 처리 접근법을 제시한다.

후속 연구

의료 및 생물학 분야 QA에서 검색증강생성과 장문맥 모델을 결합할 때 최적 문맥 길이를 체계적으로 결정하여 성능을 극대화할 수 있다.

응용 사례

다중문서 요약을 위한 최적 문맥 길이 추정 연구에서 S2ORC의 대규모 학술논문 데이터를 검증 데이터셋으로 활용할 수 있다.

응용 사례

학술 지식 그래프 질의응답의 성능 향상을 위해 검색증강생성에서 최적 문맥 길이를 체계적으로 추정하는 방법을 적용할 수 있다.

응용 사례

질의응답 성능 향상을 위해 검색증강생성에서 최적 문맥 길이를 체계적으로 추정하는 방법을 적용할 수 있다.

응용 사례

의료 과학 분야 지식 추출에서 대규모 문헌 처리 시 최적 문맥 길이를 체계적으로 추정하여 LLM의 효율성과 정확성을 동시에 향상시킬 수 있다.

응용 사례

의료 문헌의 대용량 처리에서 최적 문맥 길이를 체계적으로 추정하여 LLM 기반 지식 추출의 효율성과 정확성을 향상시킬 수 있다.

응용 사례

하이브리드 검색 증강 생성에서 최적 컨텍스트 길이 추정이 장문맥 모델링의 실용적 적용을 보여준다.

응용 사례

Transformer 컨텍스트 확장 기법을 검색-증강 생성의 최적 컨텍스트 길이 결정에 적용

응용 사례

의료 생물학 QA에서 검색증강생성 활용 시 최적 문맥 길이를 체계적으로 추정하여 사실적 정확성과 신뢰성을 동시에 극대화할 수 있다.