Essence

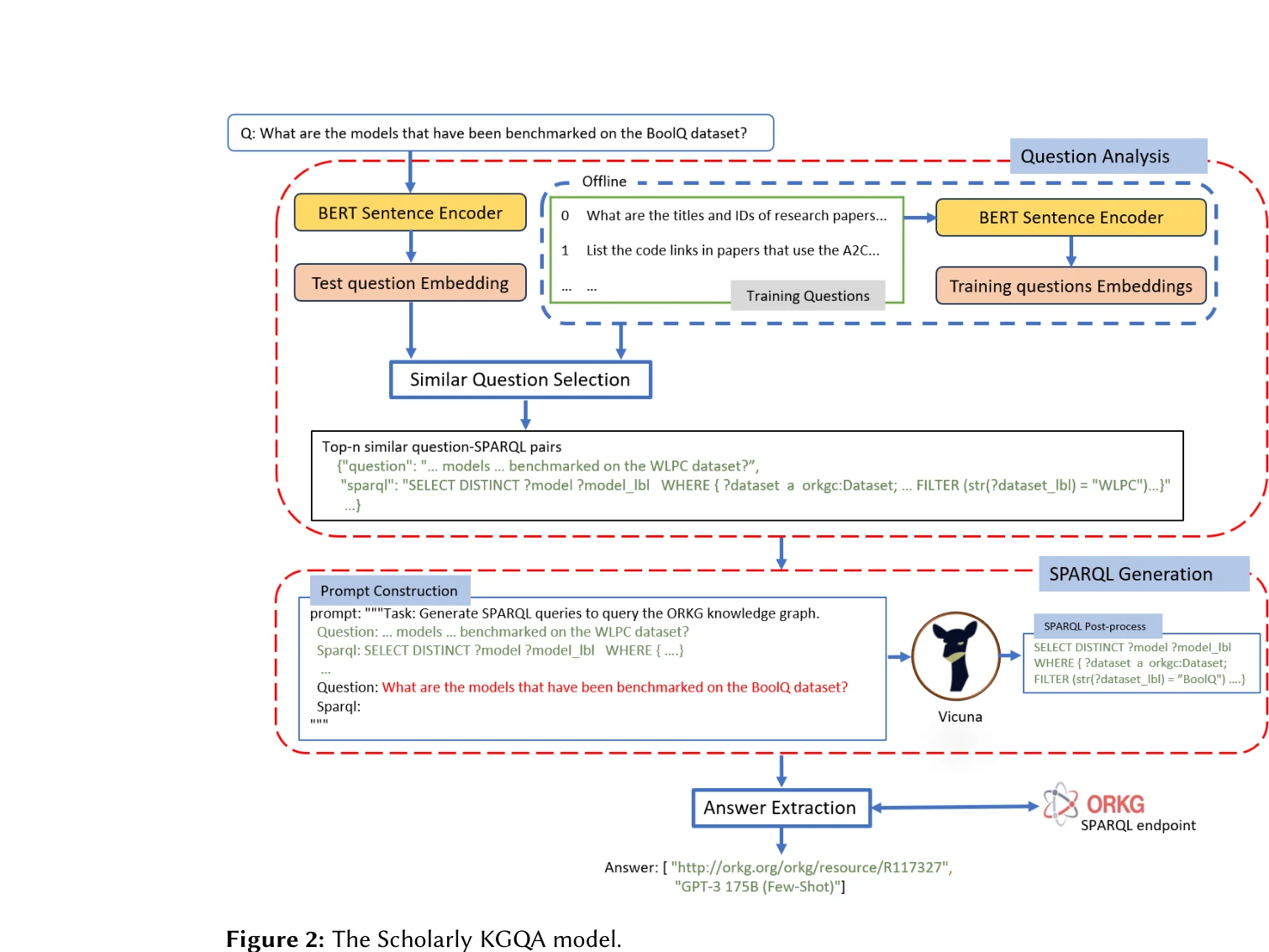

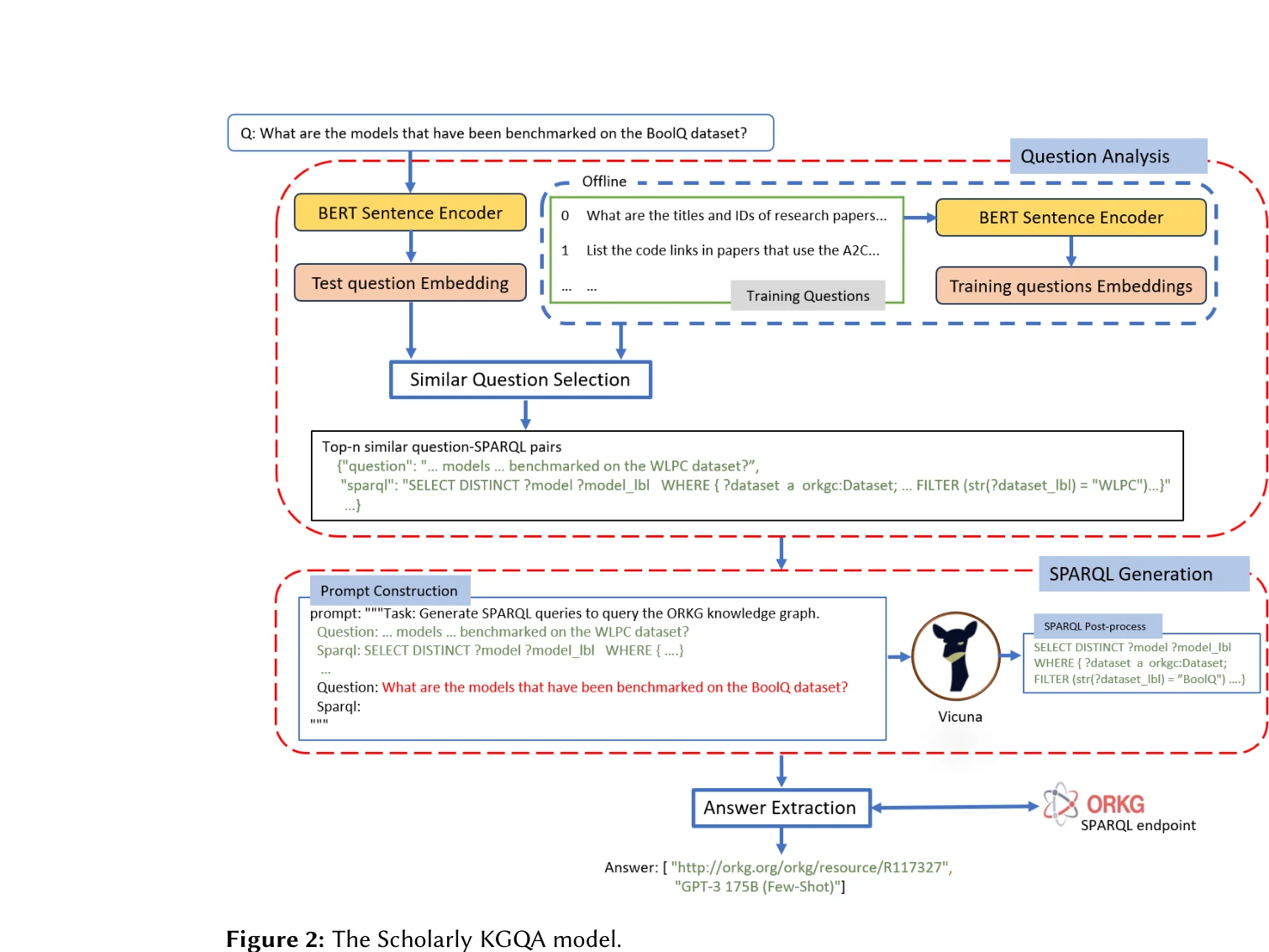

학술 KGQA 모델의 전체 파이프라인

본 논문은 대규모 언어모델(LLM)을 활용하여 학술 지식 그래프에 대한 자연어 질문을 SPARQL 쿼리로 변환하는 few-shot 기반 접근법을 제시하며, SciQA 벤치마크에서 F1 스코어 0.99를 달성했다.

저자: Tilahun Abedissa Taffa, Ricardo Usbeck | 날짜: 2023-11-16 | DOI: 미공개

학술 KGQA 모델의 전체 파이프라인

본 논문은 대규모 언어모델(LLM)을 활용하여 학술 지식 그래프에 대한 자연어 질문을 SPARQL 쿼리로 변환하는 few-shot 기반 접근법을 제시하며, SciQA 벤치마크에서 F1 스코어 0.99를 달성했다.

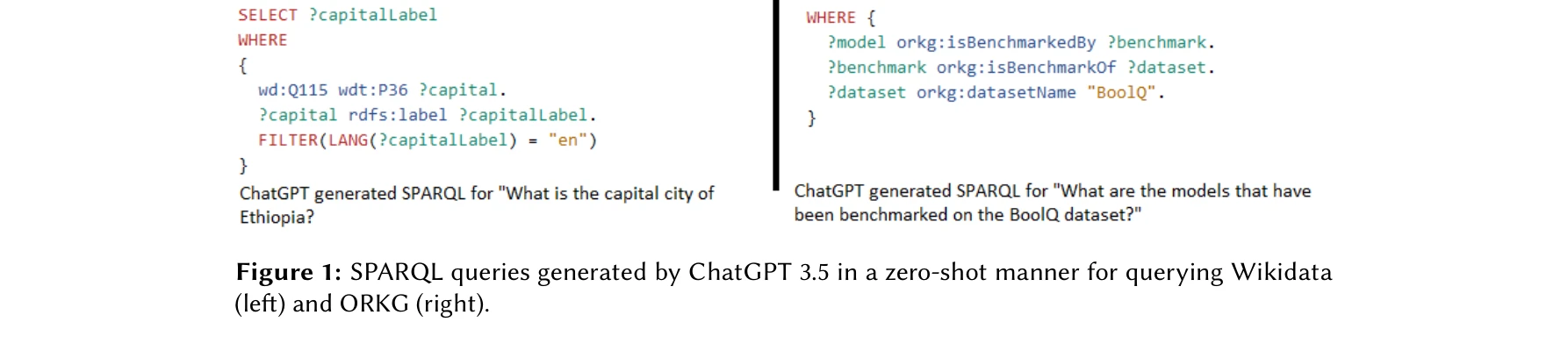

ChatGPT 3.5의 zero-shot SPARQL 생성: Wikidata(좌)에서는 성공, ORKG(우)에서는 실패

총평: 본 논문은 LLM의 few-shot 능력을 학술 KGQA에 효과적으로 적용하여 우수한 성능을 달성했으나, 템플릿 기반 데이터셋의 특수성과 제한된 도메인으로 인해 실제 학술 검색 시스템으로의 배포 가능성에는 추가 검증이 필요하다.