Essence

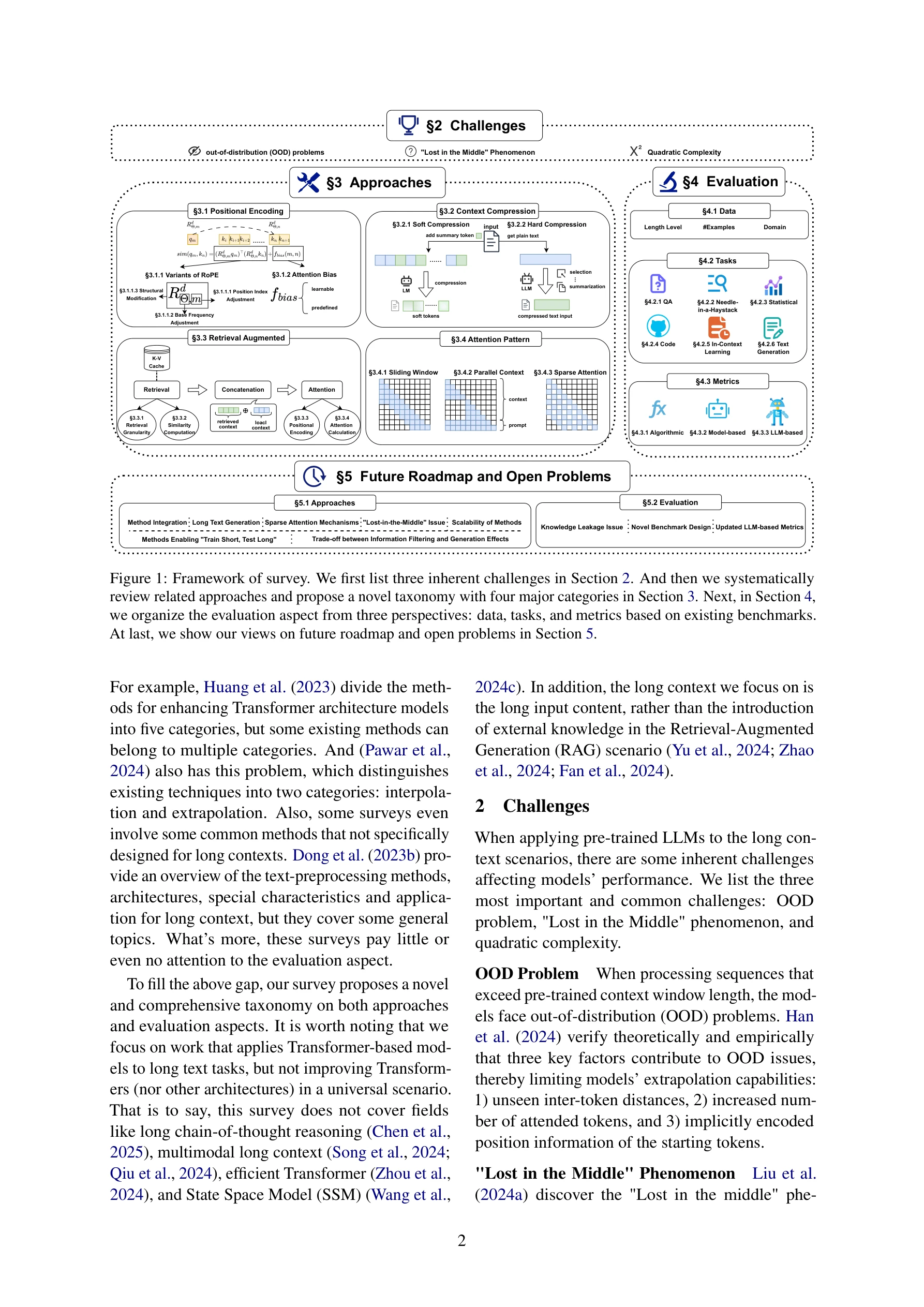

Transformer 기반 대규모 언어 모델(LLM)은 사전 학습된 컨텍스트 길이를 초과하는 장문(long context)에서 성능 저하를 보이는데, 본 논문은 이를 해결하기 위한 접근 방식(위치 인코딩, 컨텍스트 압축, 검색 증강, 주의 패턴)과 평가 방법을 체계적으로 분류한 종합 서베이이다.

How

핵심 도전 과제 (Challenges)

- OOD 문제: 사전 학습 컨텍스트 창을 초과한 시퀀스 처리 시 세 가지 요인 (미해결 토큰 거리, 증가된 attended 토큰 수, 시작 토큰의 암시적 위치 인코딩)으로 인한 외삽 능력 제한

- "Lost in the Middle" 현상: LLM이 입력 시퀀스의 시작과 끝 정보에 집중하고 중간 내용을 간과

- 이차 복잡도: Self-attention의 O(n²) 복잡도로 인한 장문 처리의 시간/자원 소비

접근 방식 상세 분류

1. 위치 인코딩 (Positional Encoding)

- RoPE 변형:

- 위치 인덱스 조정 (Position Index Adjustment): 토큰 할당 수정, 스케일링, 재할당 조합

- 기본 주파수 조정 (Base Frequency Adjustment): NTK 이론 기반 θᵢ 수정, 지수항 기반 b 변경, θᵢ 직접 스케일링

- 구조 수정 (Structural Modification): RoPE 공식 자체 최적화

- Attention Bias: 쿼리-키 유사도 계산 시 상대 거리 정보 추가

```

sim(qₘ, kₙ) = qₘᵀkₙ + f_bias(m, n)

```

2. 컨텍스트 압축 (Context Compression)

- 소프트 압축 (Soft Compression): 요약 토큰 추가 등 간접적 방법

- 하드 압축 (Hard Compression): 텍스트 요약, 선택 등 직접적 방법

3. 검색 증강 (Retrieval Augmented)

- 검색 세분화 (Retrieval Granularity): 어느 단위로 검색할 것인가

- 유사도 계산 (Similarity Computation): 관련성 평가 방식

- 위치 인코딩: 검색된 컨텍스트의 위치 처리

- 주의 계산 (Attention Calculation): 검색된 내용의 주의 적용

4. 주의 패턴 (Attention Pattern)

- Sliding Window: 이전 토큰만 참조

- Parallel Context: 프롬프트와 컨텍스트 병렬 처리

- Sparse Attention: 선택적 토큰 참조

평가 방법론

데이터: 길이 수준별(짧음/중간/긴), 도메인별, 예제 수 등으로 분류

작업:

- QA: 질의응답 능력 평가

- Needle-in-a-Haystack: 큰 텍스트에서 특정 정보 찾기

- 코드: 코드 이해 및 생성

- 통계: 문서 통계 정보 추출

- In-Context Learning: 장문 few-shot 학습

- 텍스트 생성: 장문 생성 능력

메트릭:

- 알고리즘 기반: 정확도, F1 스코어 등

- 모델 기반: BERTScore 등 임베딩 유사도

- LLM 기반: GPT-4 등으로 평가

Evaluation

총평: 본 논문은 Transformer 기반 장문 처리를 위한 첫 번째 포괄적이고 체계적인 서베이로서, 새로운 분류 체계와 평가 프레임워크를 통해 빠르게 성장하는 이 분야에 명확한 구조를 제공한다. 특히 방법론뿐 아니라 평가 측면을 동등하게 다룬 것과 미해결 문제를 명시한 점이 차별적이나, 기초 이론(OOD 등)과 실제 방법들 간의 더 명확한 인과 연결이 이루어진다면 더욱 통찰력 있는 가이드가 될 것이다.