Essence

ToolBench에서 보고된 성능과 재현된 성능의 비교: 몇 개월 후 동일한 설정에서 재현했을 때 상당한 성능 저하 발생

대규모 언어 모델(LLM)이 도구를 활용하는 능력을 평가하기 위해 안정적인 벤치마크가 필수적인데, 기존 ToolBench는 실시간 API의 불안정성으로 인해 결과 재현성이 떨어진다. 본 논문은 가상 API 서버와 안정적인 평가 시스템을 통해 이 문제를 해결한 StableToolBench를 제안한다.

저자: Zhicheng Guo, Sijie Cheng, Hao Wang, Shihao Liang, Yujia Qin, Peng Li, Zhiyuan Liu, Maosong Sun, Yang Liu | 날짜: 2025-03-05 | DOI: 10.48550/arXiv.2403.07714

ToolBench에서 보고된 성능과 재현된 성능의 비교: 몇 개월 후 동일한 설정에서 재현했을 때 상당한 성능 저하 발생

대규모 언어 모델(LLM)이 도구를 활용하는 능력을 평가하기 위해 안정적인 벤치마크가 필수적인데, 기존 ToolBench는 실시간 API의 불안정성으로 인해 결과 재현성이 떨어진다. 본 논문은 가상 API 서버와 안정적인 평가 시스템을 통해 이 문제를 해결한 StableToolBench를 제안한다.

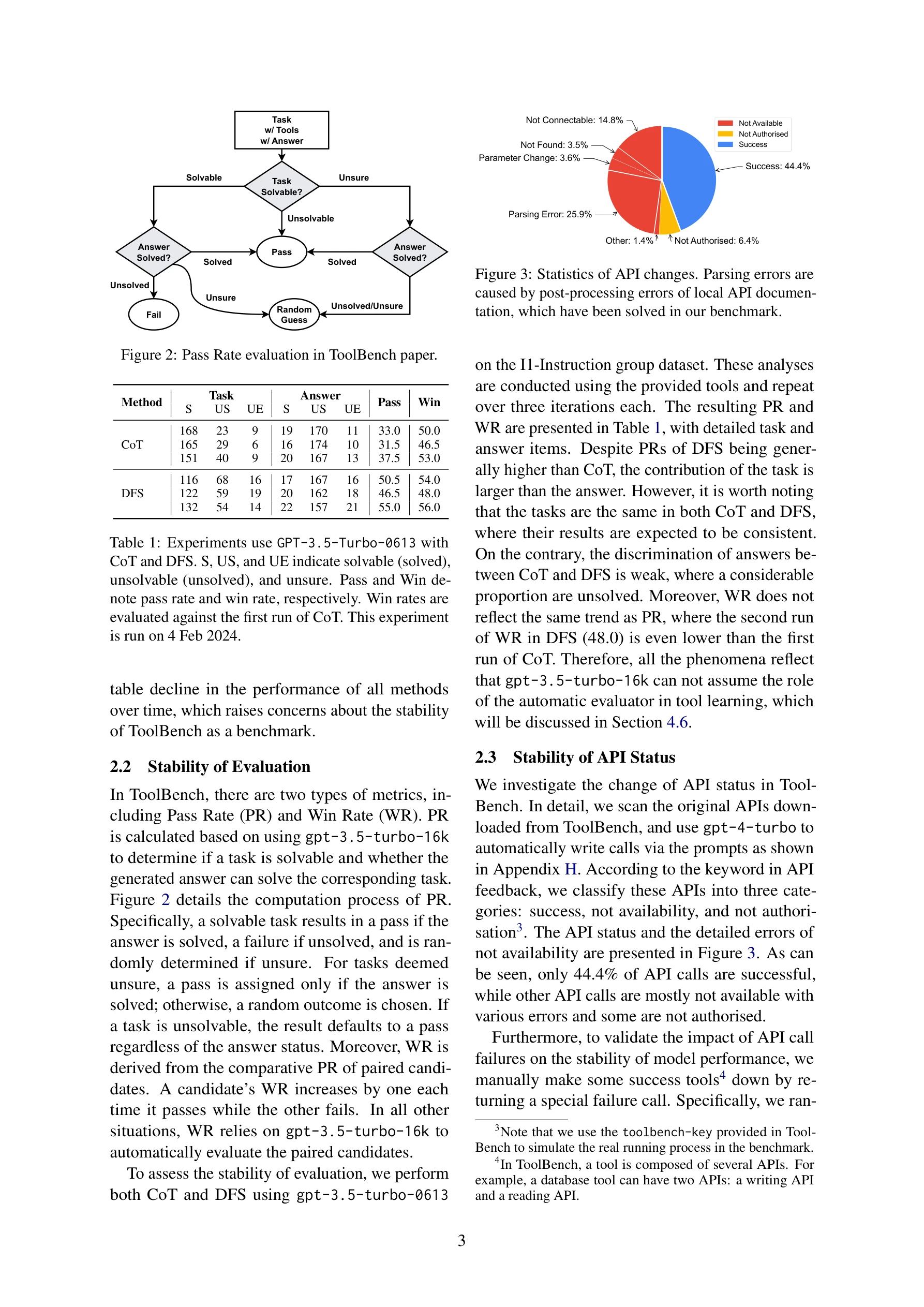

ToolBench의 API 상태 변화: 성공 44.4%, 연결 불가 14.8%, 파싱 오류 25.9% 등

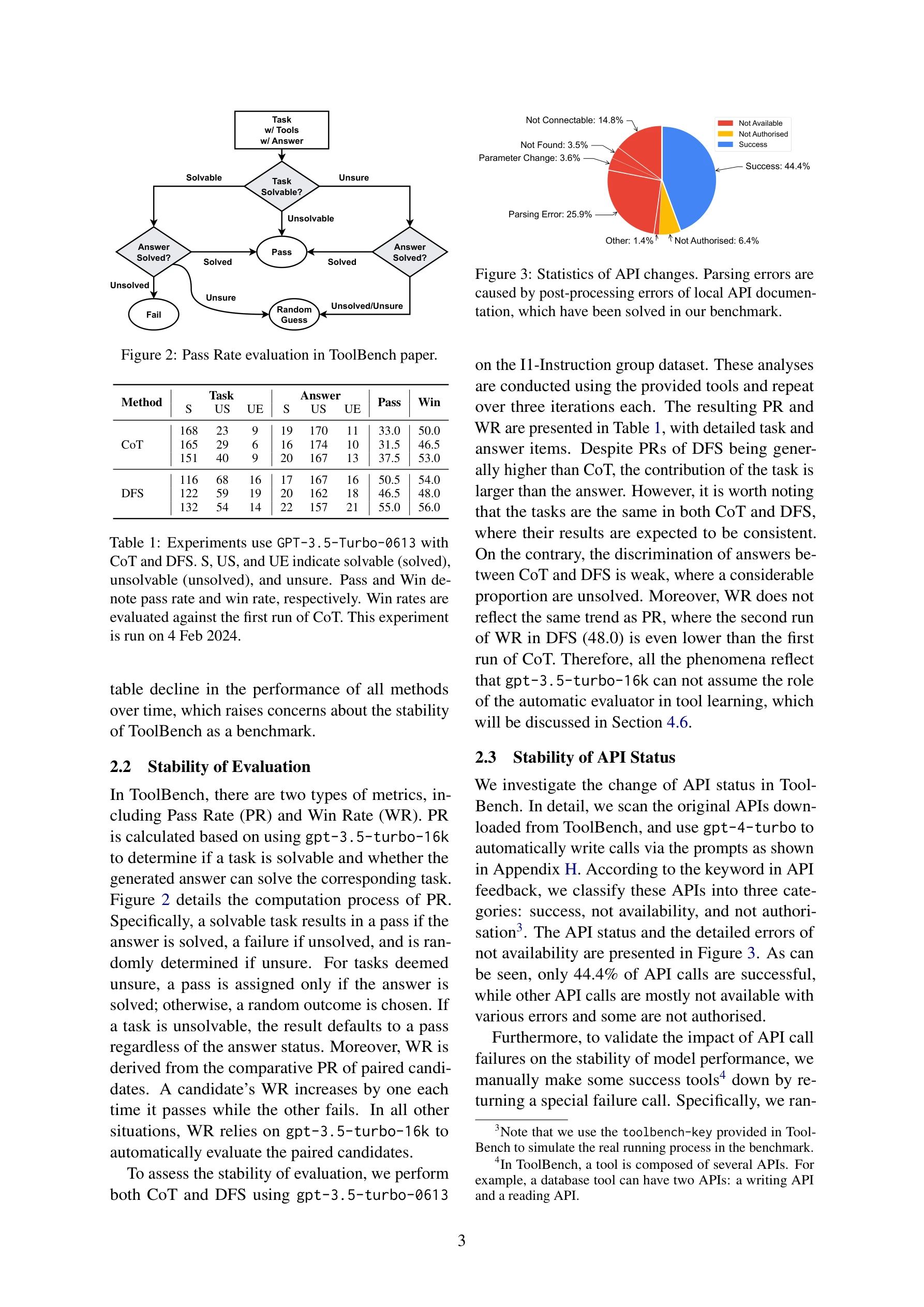

ToolBench의 Pass Rate 평가 방식: "Unsure" 상태에서 임의 결정으로 인한 불안정성

가상 API 서버 (Virtual API Server)

안정적 평가 시스템 (Stable Evaluation System)

총평: StableToolBench는 기존 대규모 도구 학습 벤치마크의 재현성 위기에 대한 실질적이고 효과적인 해결책을 제시한다. 특히 API 불안정성과 평가 시스템의 약점을 동시에 해결한 점이 가치 있으나, LLM 기반 시뮬레이터의 신뢰성 검증과 장기 안정성 보장 측면에서 보완이 필요하다.