Essence

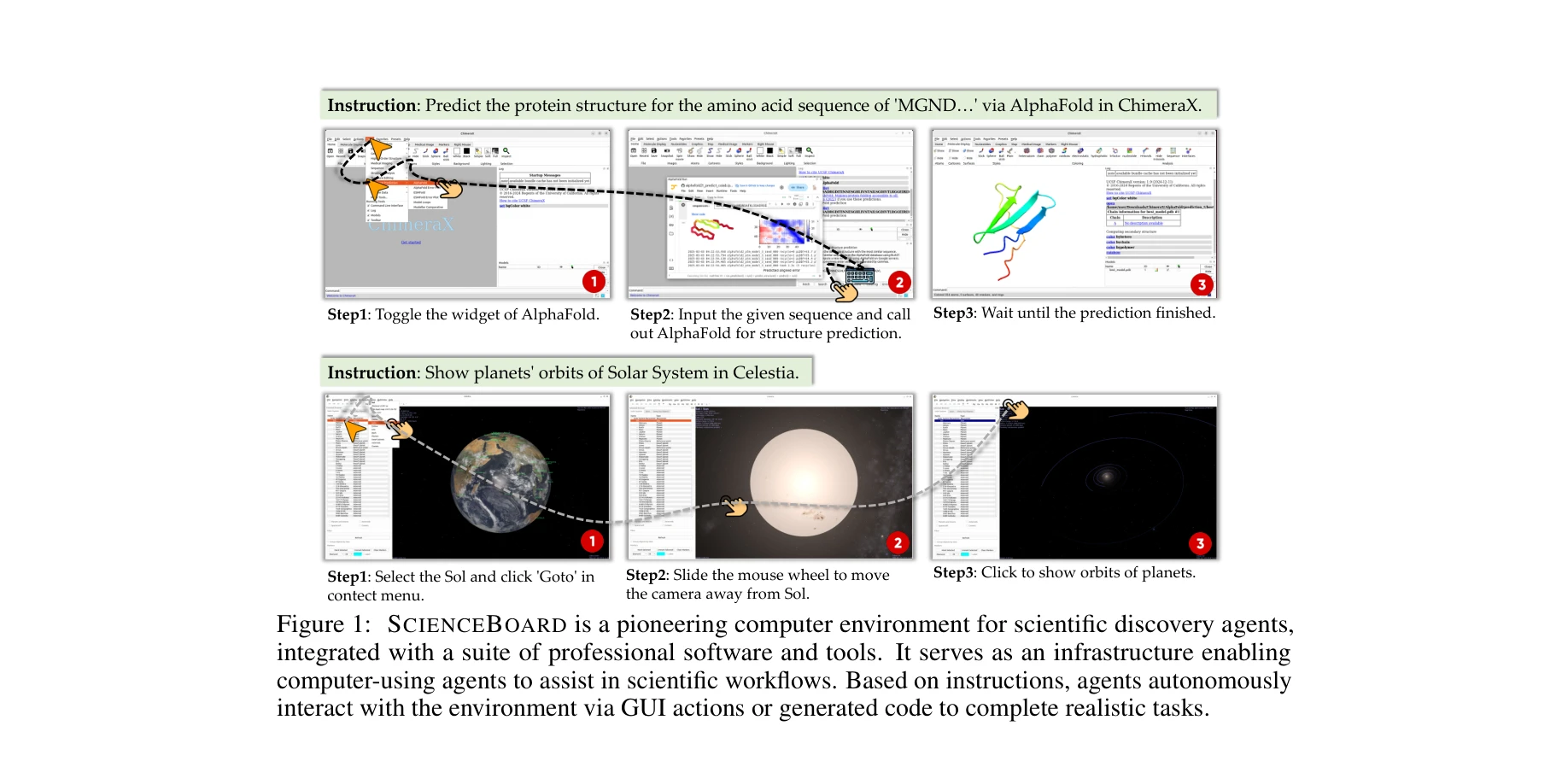

AlphaFold를 통한 단백질 구조 예측과 Celestia에서 행성 궤도 표시 등 실제 과학 소프트웨어와 상호작용하는 에이전트

본 논문은 현실적인 과학 워크플로우에서 멀티모달 자율 에이전트를 평가하기 위한 SCIENCEBOARD 환경과 벤치마크를 제시한다. 생화학, 천문학, 지정보학 등 6개 과학 도메인에서 169개의 고품질 작업을 통해 최신 LLM/VLM 기반 에이전트들이 15% 이하의 성공률을 보이며, 현재 기술의 한계를 명시적으로 드러낸다.