Essence

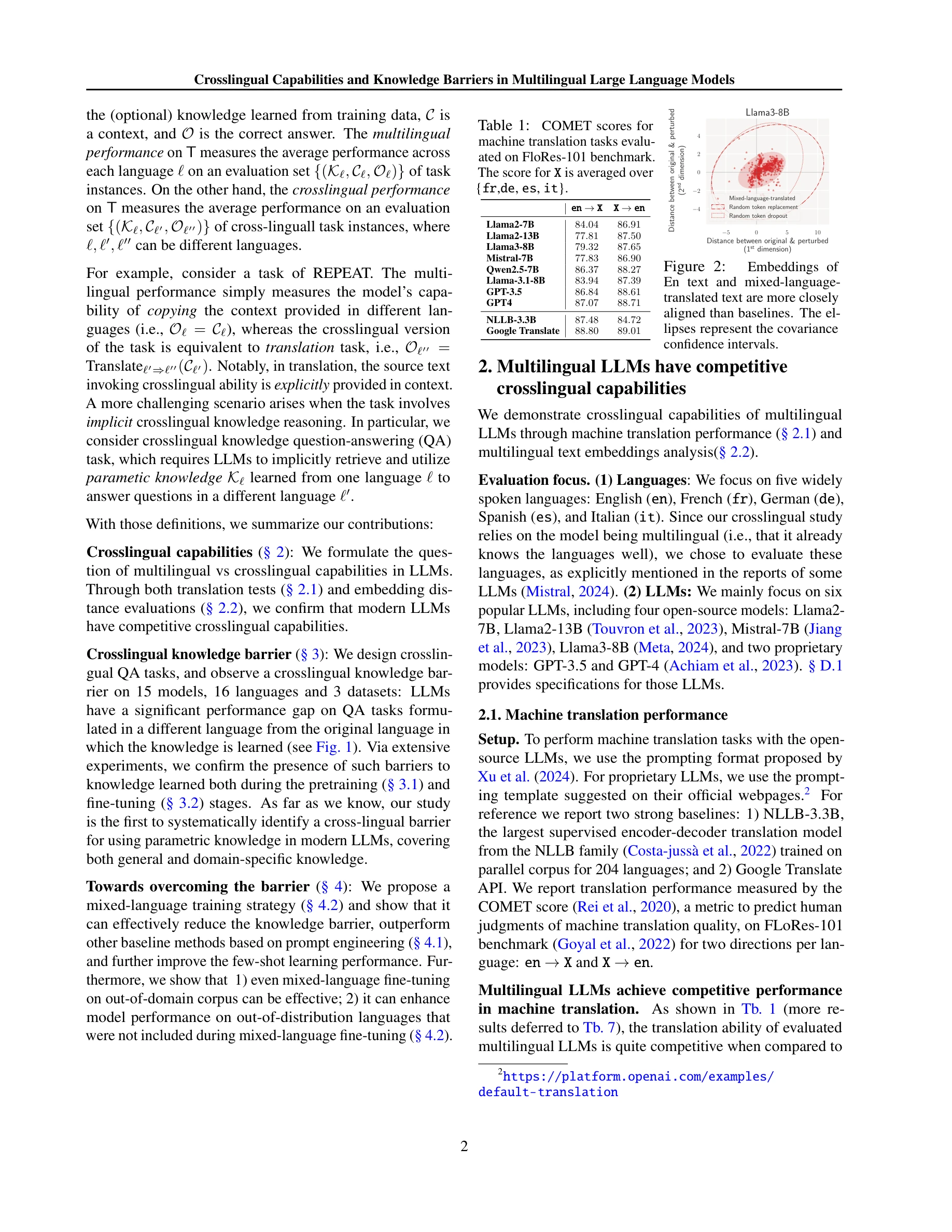

그림 1: 다국어 LLM은 기계번역과 같은 명시적 작업에서는 강한 교차언어 능력을 보이나, 모델 가중치에 암묵적으로 저장된 지식을 활용하는 지식 집약적 작업에서는 언어 간 격차를 해소하지 못함을 보여줌.

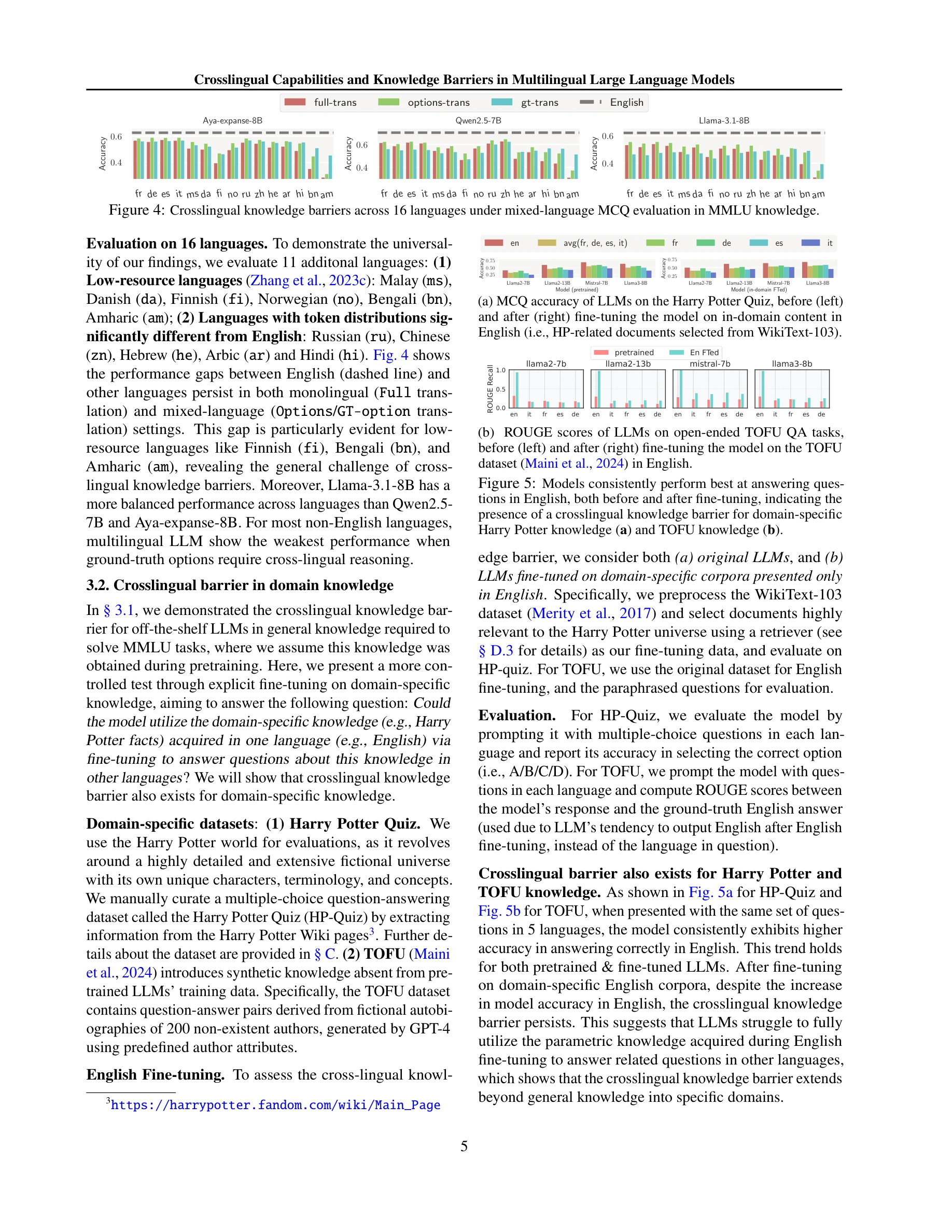

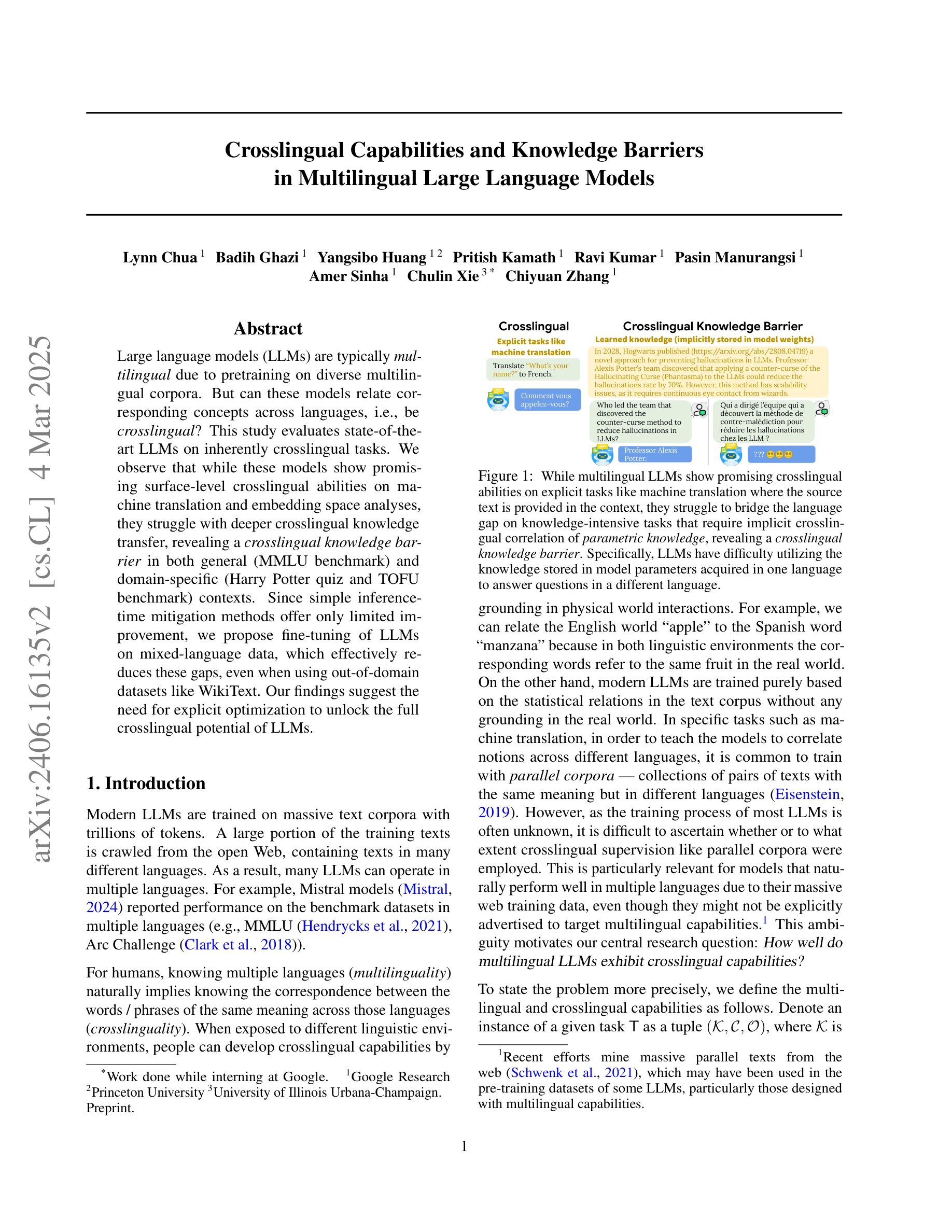

본 논문은 다국어 대규모 언어 모델(LLM)이 명시적 교차언어 작업(기계번역)에서는 우수한 성능을 보이나, 매개변수 지식의 암묵적 교차언어 활용에서는 심각한 성능 저하를 경험하는 '교차언어 지식 장벽(crosslingual knowledge barrier)'을 처음으로 체계적으로 규명하는 연구이다.