Achievement

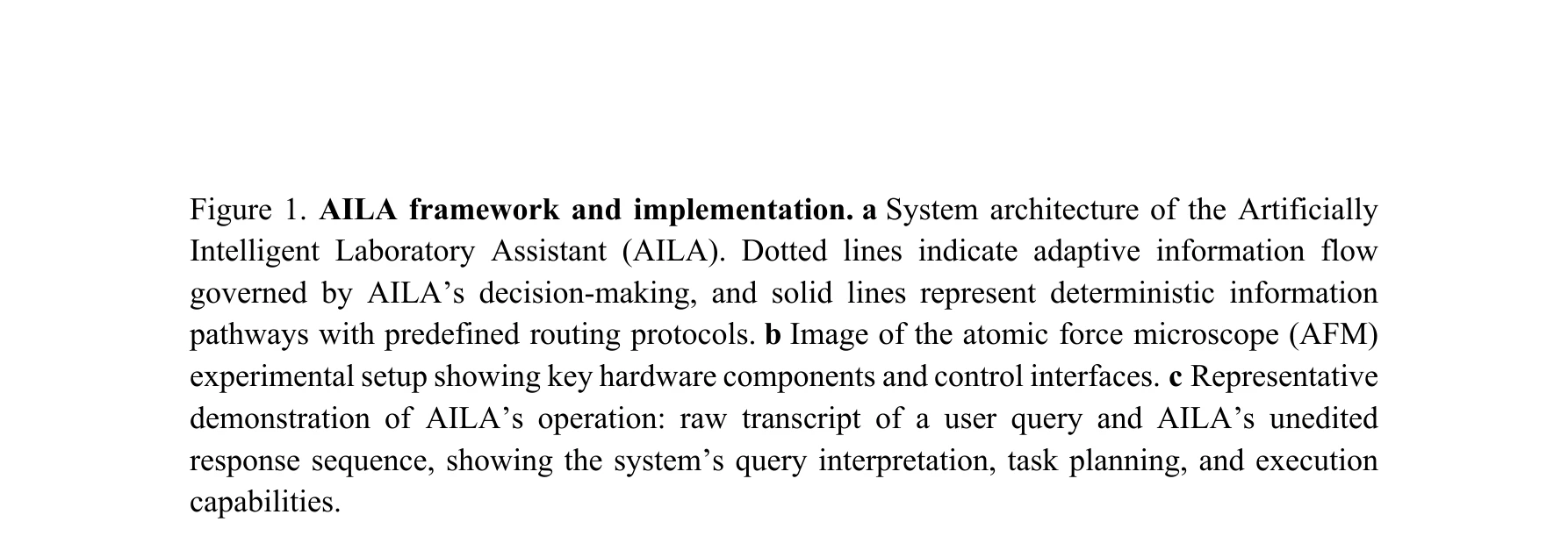

그림 1: AILA 프레임워크 및 구현. (a) 시스템 아키텍처 (b) AFM 실험 설정 (c) 사용자 쿼리 해석에서 실행까지의 대표적 동작 예시

- AILA 프레임워크 개발: LLM 기반 플래너가 AFM Handler Agent(AFM-HA)와 Data Handler Agent(DHA)를 동적으로 조율하여 실험 제어와 데이터 분석을 자동화. 문서 검색, 코드 실행, 이미지 분석 등 특화된 도구 통합

- AFMBench 구축: 기본 작업(56%)과 고급 작업(44%)을 포함한 100개 과제로 구성. 도구 조율(69% 다중 도구), 에이전트 조율(17% 다중 에이전트) 요구사항을 반영하여 현실적 복잡도 재현

- 성능 평가의 역설적 발견:

- GPT-4o: 문서 기반 작업 88.3% 성공률 달성

- Claude-3.5-sonnet: 재료과학 도메인 QA 벤치마크에서 우수하나 실제 에이전트 작업에서는 예상 외로 저조

- 핵심 통찰: 도메인 특화 QA 능력이 실무적 에이전트 역량으로 전환되지 않음

- 실제 실험 성공: AFM 캘리브레이션, 흑연 층 개수 계산, 그래핀 스텝 엣지 고해상도 이미징, HOPG 부하-의존적 거칠기 특성화 등 5개 실제 실험 수행