Essence

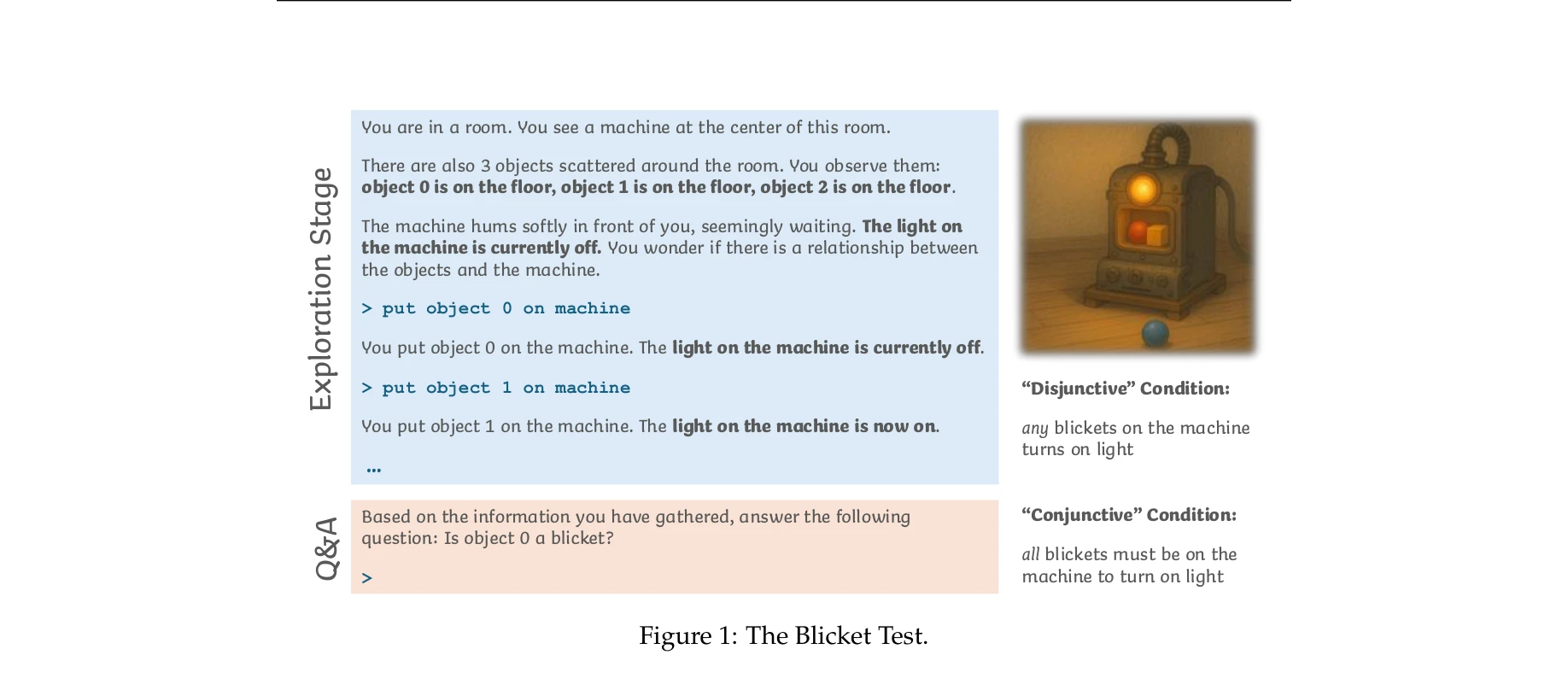

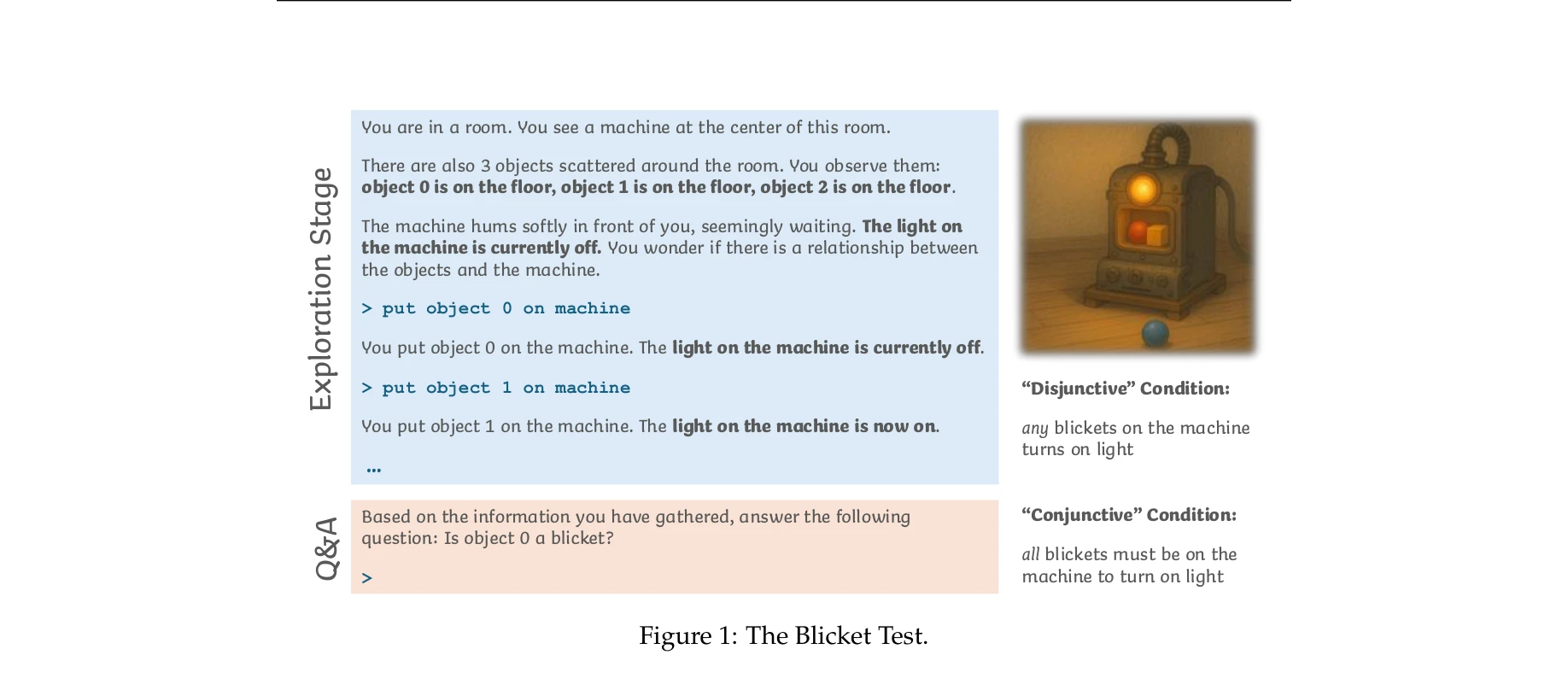

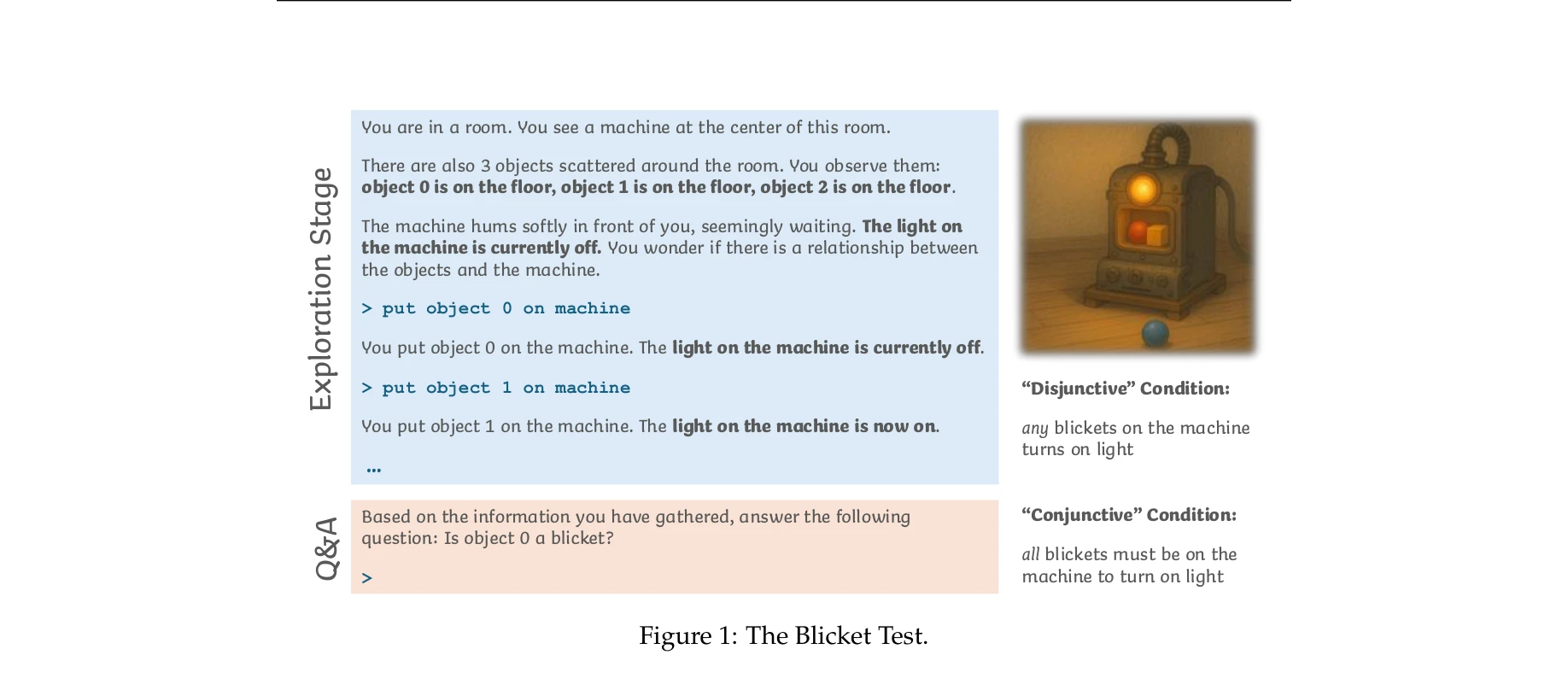

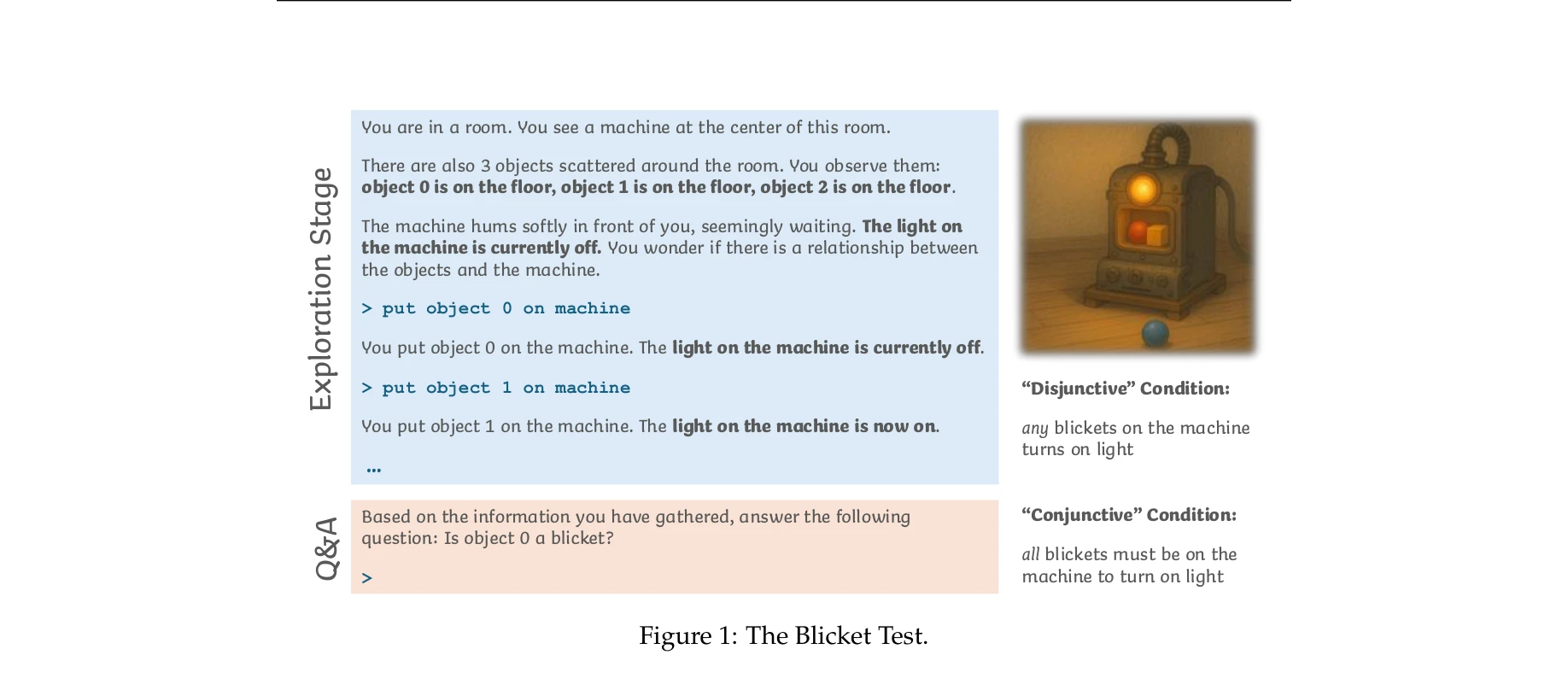

언어 모델이 객체를 기계에 올려놓는 상호작용을 통해 인과관계를 파악해야 하는 블리켓 테스트

언어 모델(LM) 에이전트는 인과관계 추론에서 선언적(disjunctive, OR) 규칙에는 능하지만 결합적(conjunctive, AND) 규칙에서 체계적으로 편향되어 있으며, 이러한 편향이 인간 성인의 인지 편향과 유사함을 보여주는 연구이다.

저자: Anthony GX-Chen, Dongyan Lin, Mandana Samiei, Doina Precup, Blake A. Richards, Rob Fergus, Kenneth Marino | 날짜: 2025 | DOI: arXiv:2505.09614

언어 모델이 객체를 기계에 올려놓는 상호작용을 통해 인과관계를 파악해야 하는 블리켓 테스트

언어 모델(LM) 에이전트는 인과관계 추론에서 선언적(disjunctive, OR) 규칙에는 능하지만 결합적(conjunctive, AND) 규칙에서 체계적으로 편향되어 있으며, 이러한 편향이 인간 성인의 인지 편향과 유사함을 보여주는 연구이다.

다양한 언어 모델들의 선언적/결합적 규칙에서의 정확도: 모든 모델이 결합적 규칙에서 체계적으로 낮은 성능 보임

모델 성능에 영향을 미치는 요소들: 정보 이득이 가장 강한 양의 상관(ρ=0.76), 탐색 단계 수는 음의 상관(ρ=-0.35)

총평: 본 논문은 언어 모델의 인과추론 편향을 심리학 패러다임과 연계하여 처음으로 체계적으로 규명하였으며, 인간 행동과의 정량적 비교를 통해 모델이 훈련 데이터의 인지 편향을 상속함을 실증했다. 제안된 가설 제거 방법은 이론적 근거가 명확하고 성능 개선이 유의미하나, 더 복잡한 인과 구조와 다양한 추론 시나리오로의 확장 가능성 검증이 필요하다. 자율 에이전트의 과학적 추론 능력 강화라는 중요한 문제를 다루는 높은 수준의 연구이다.