Essence

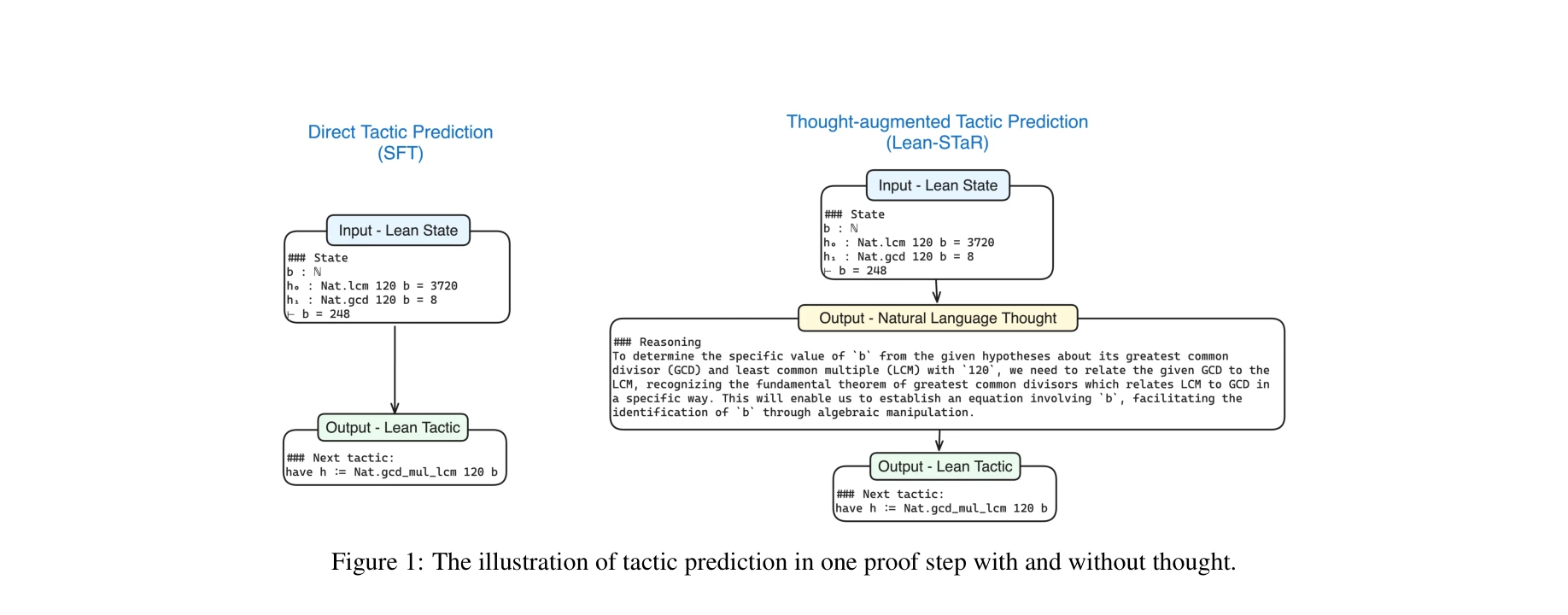

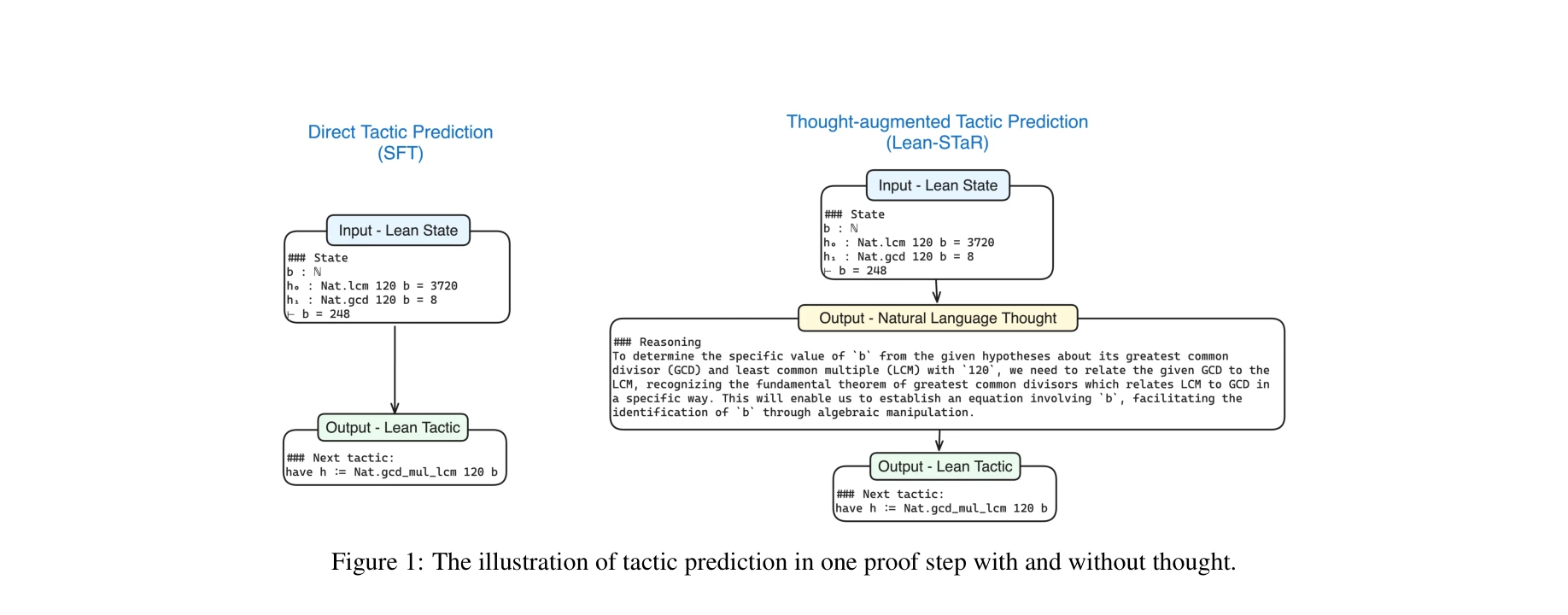

그림 1: 사고(thought) 유무에 따른 한 증명 단계에서의 전술 예측 비교

언어 모델이 형식 수학 증명을 수행할 때, 인간의 사고 과정을 나타내는 자연언어 생각(informal thought)을 각 증명 단계 전에 생성하도록 학습시켜 정리 증명 능력을 향상시키는 프레임워크를 제시한다. 이를 통해 형식 증명에 내재된 정보만으로는 부족한 추론 과정을 보완한다.

저자: H. Lin, Zhiqing Sun, Sean Welleck, Yiming Yang | 날짜: 2024 | DOI: N/A

그림 1: 사고(thought) 유무에 따른 한 증명 단계에서의 전술 예측 비교

언어 모델이 형식 수학 증명을 수행할 때, 인간의 사고 과정을 나타내는 자연언어 생각(informal thought)을 각 증명 단계 전에 생성하도록 학습시켜 정리 증명 능력을 향상시키는 프레임워크를 제시한다. 이를 통해 형식 증명에 내재된 정보만으로는 부족한 추론 과정을 보완한다.

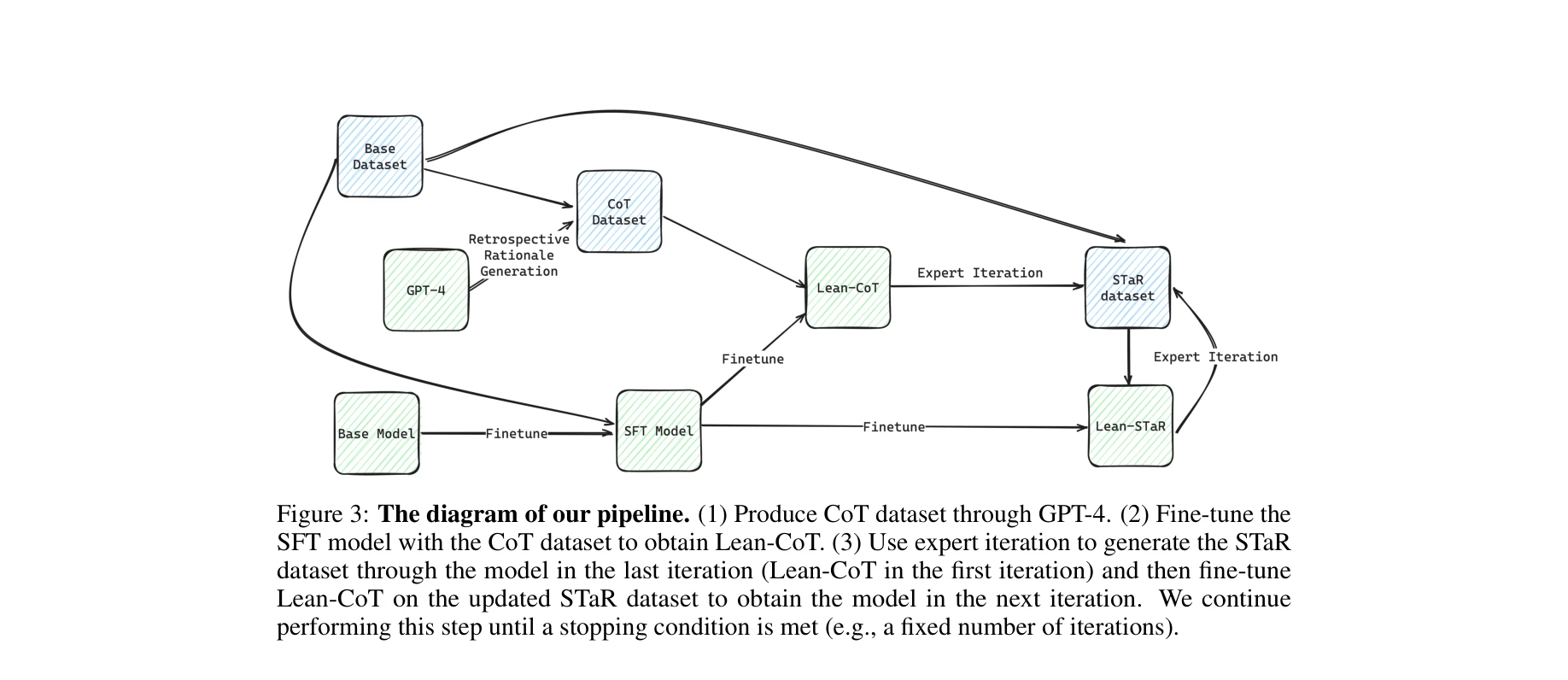

그림 3: Lean-STaR 전체 파이프라인 - (1) GPT-4로 CoT 데이터셋 생성 (2) SFT 모델을 CoT로 미세 조정하여 Lean-CoT 획득 (3) 전문가 반복으로 STaR 데이터셋 생성 및 반복 미세 조정

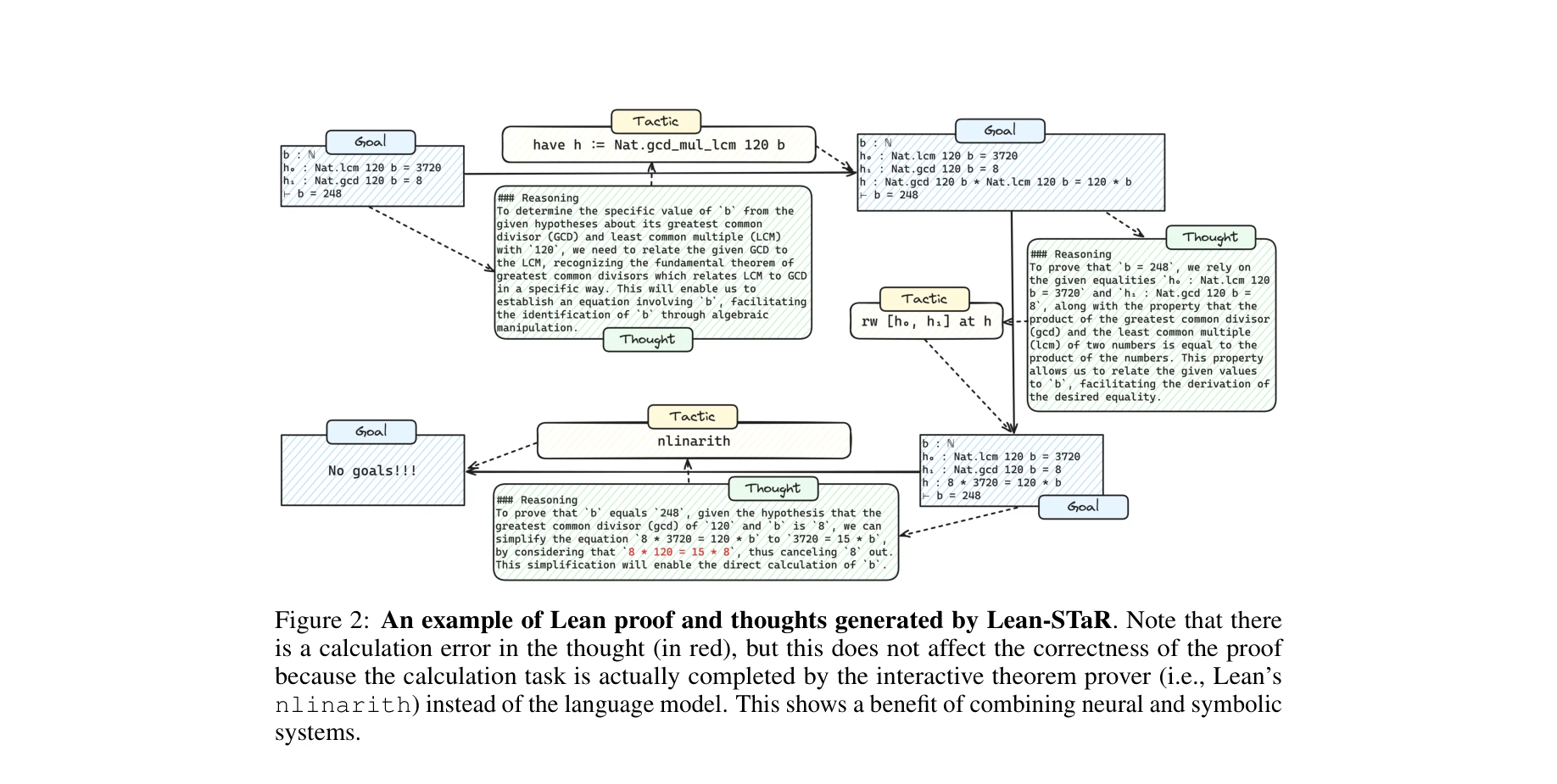

그림 2: Lean-STaR이 생성한 증명과 생각의 예시 - 생각에 계산 오류가 있어도(빨간색) Lean의 nlinarith 전술이 실제 계산을 수행하므로 증명의 정확성에 영향 없음

총평: Lean-STaR은 형식 수학 증명에 자연언어 사고 과정을 체계적으로 통합한 창의적 연구로, 역방향 생성이라는 실용적 해법을 통해 데이터 부족 문제를 해결했다. 일관된 성능 개선과 신경-기호 시스템의 강점을 보여주는 점에서 의의가 있으나, 오라클 모델 의존성과 절대 성능 수준 개선폭의 측면에서 추가 발전 여지가 있다.