Essence

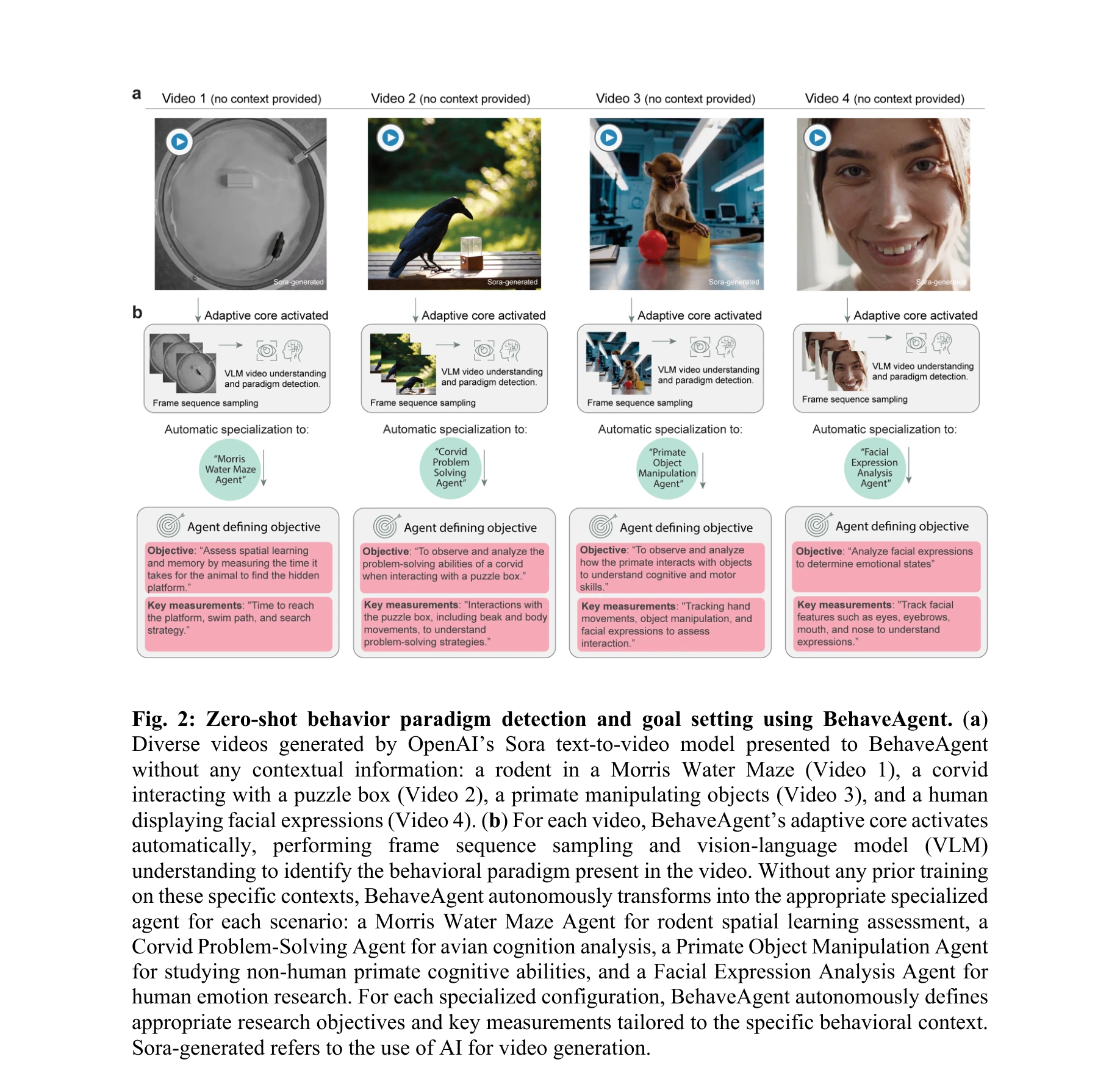

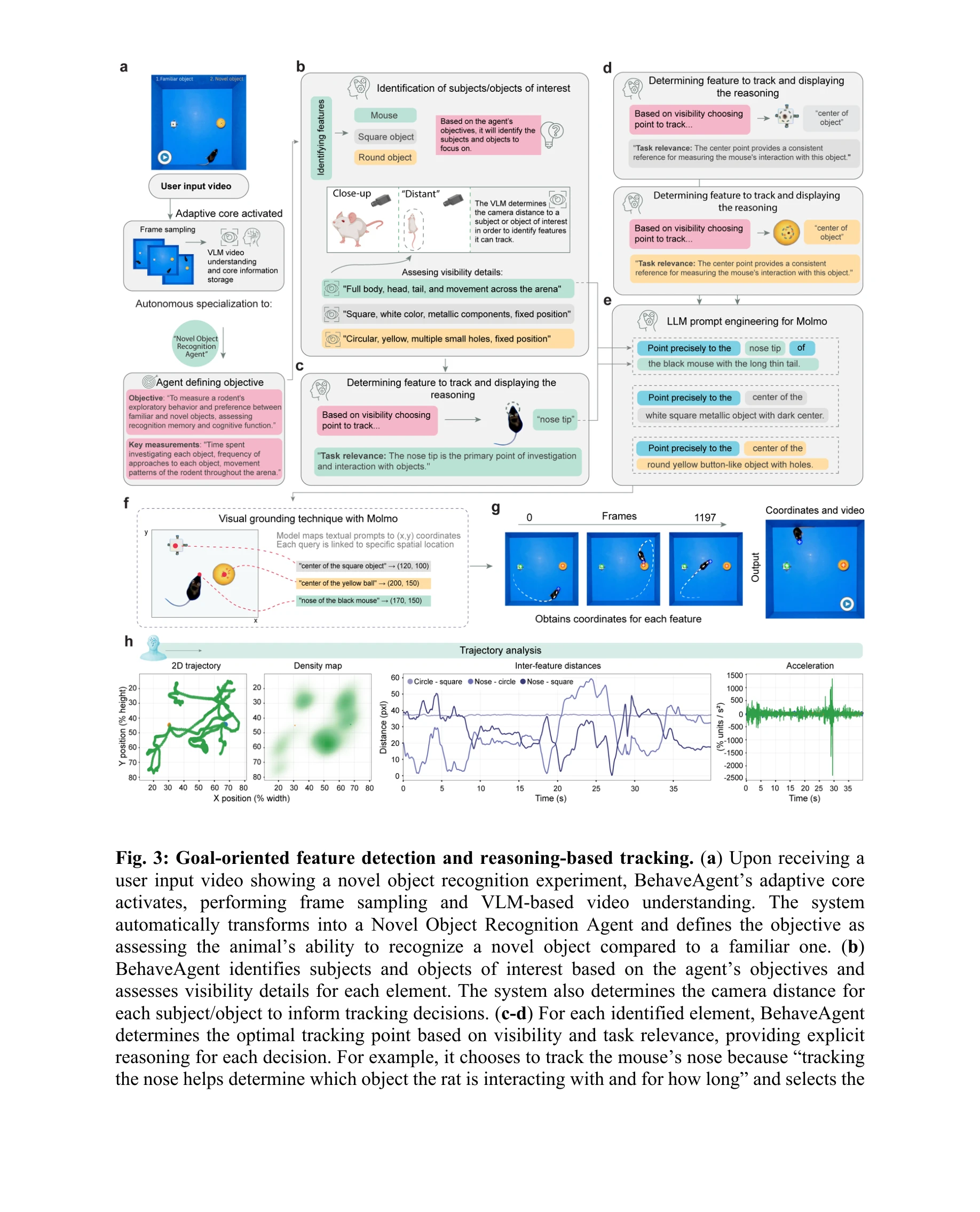

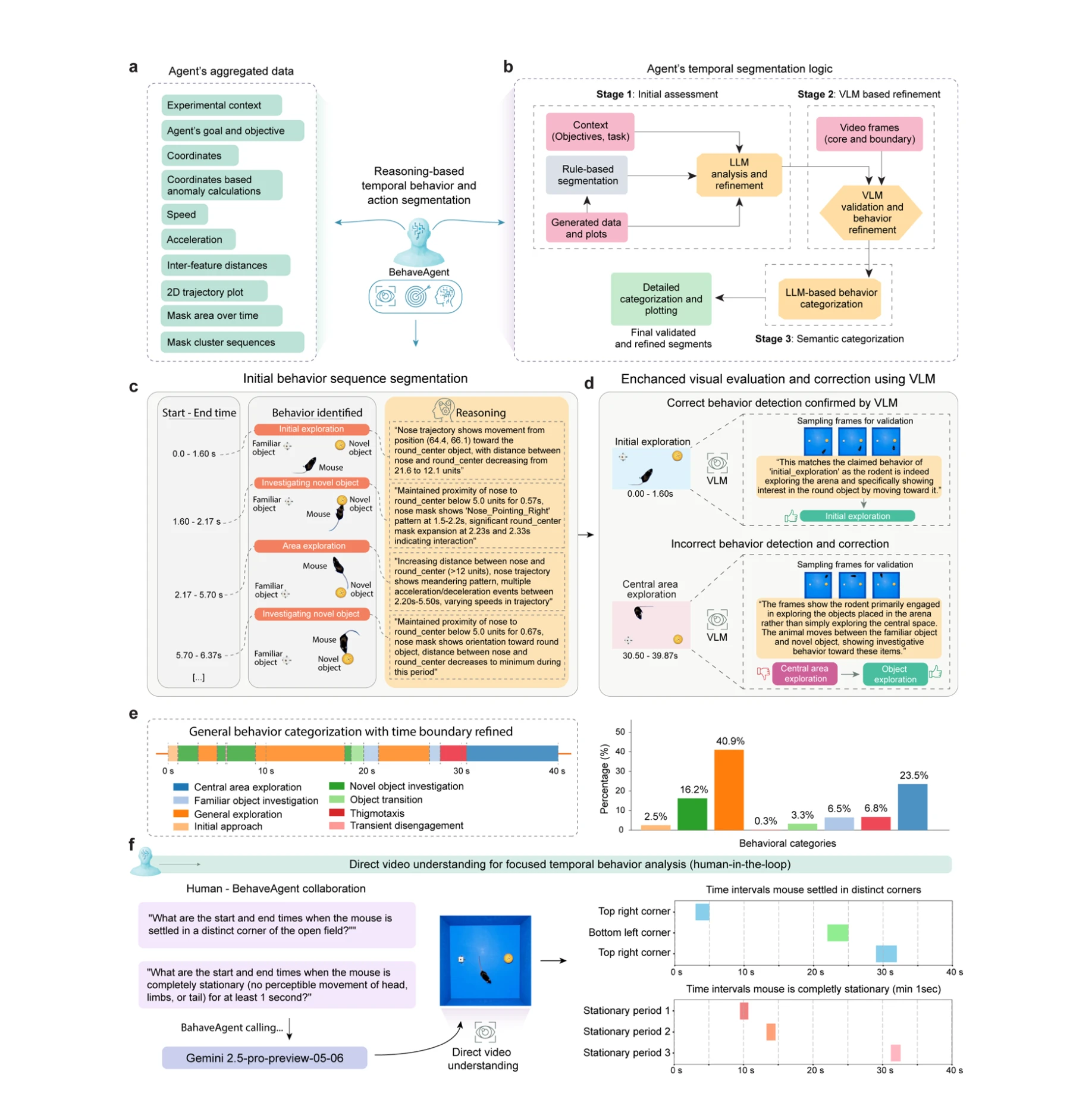

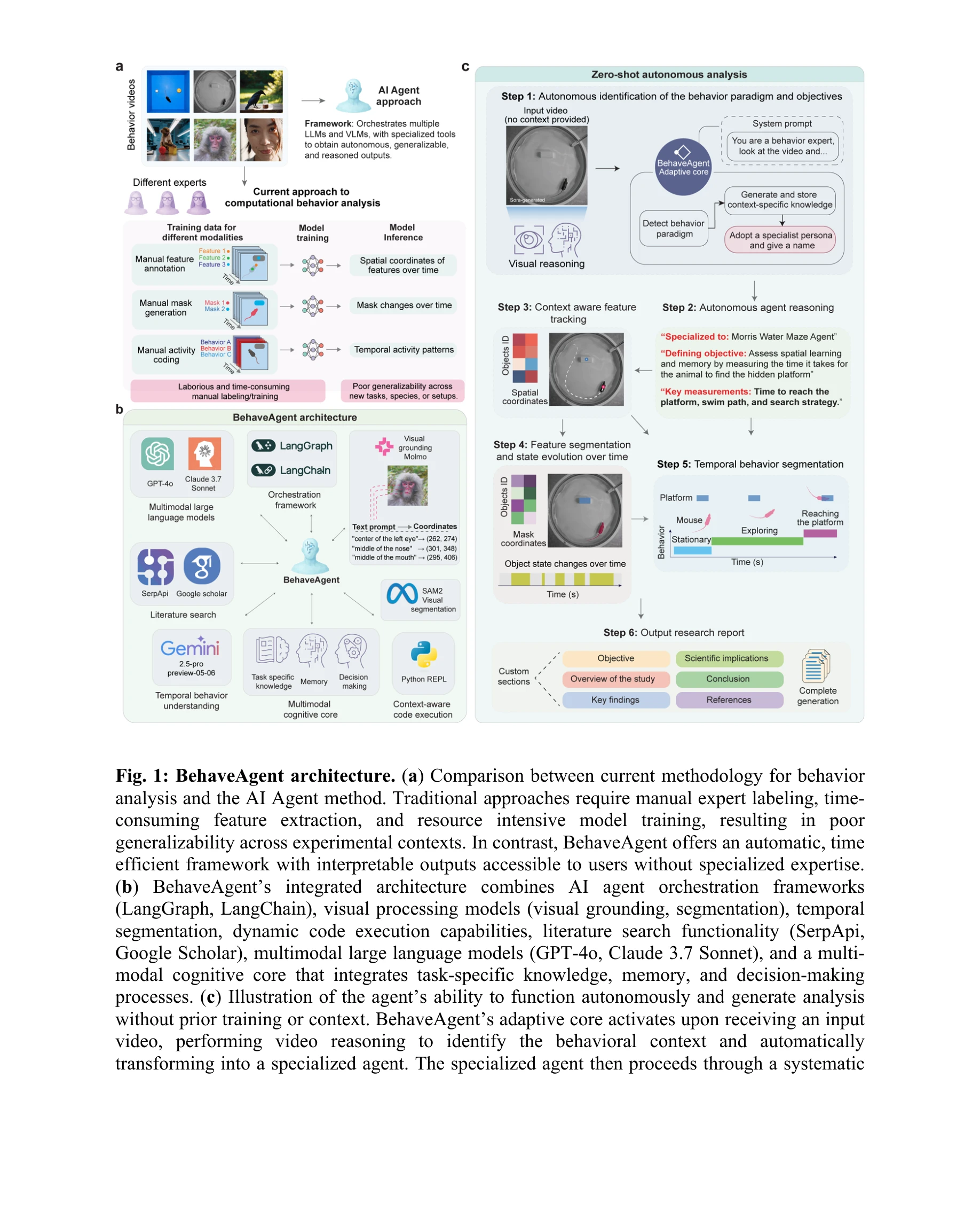

그림 1: BehaveAgent 아키텍처. (a) 현재 행동 분석 방법론과 (b) BehaveAgent의 자동화된 워크플로우 비교

멀티모달 대규모 언어 모델(LLM)과 비전-언어 모델(VLM)을 통합한 자율 AI 에이전트 BehaveAgent는 재학습이나 수동 개입 없이 비디오에서 동물 행동을 보편적으로 분석할 수 있다. 식물부터 인간까지 다양한 종과 실험 패러다임에서 제로샷(zero-shot) 시각 추론을 통해 행동 분석을 자동화한다.