Achievement

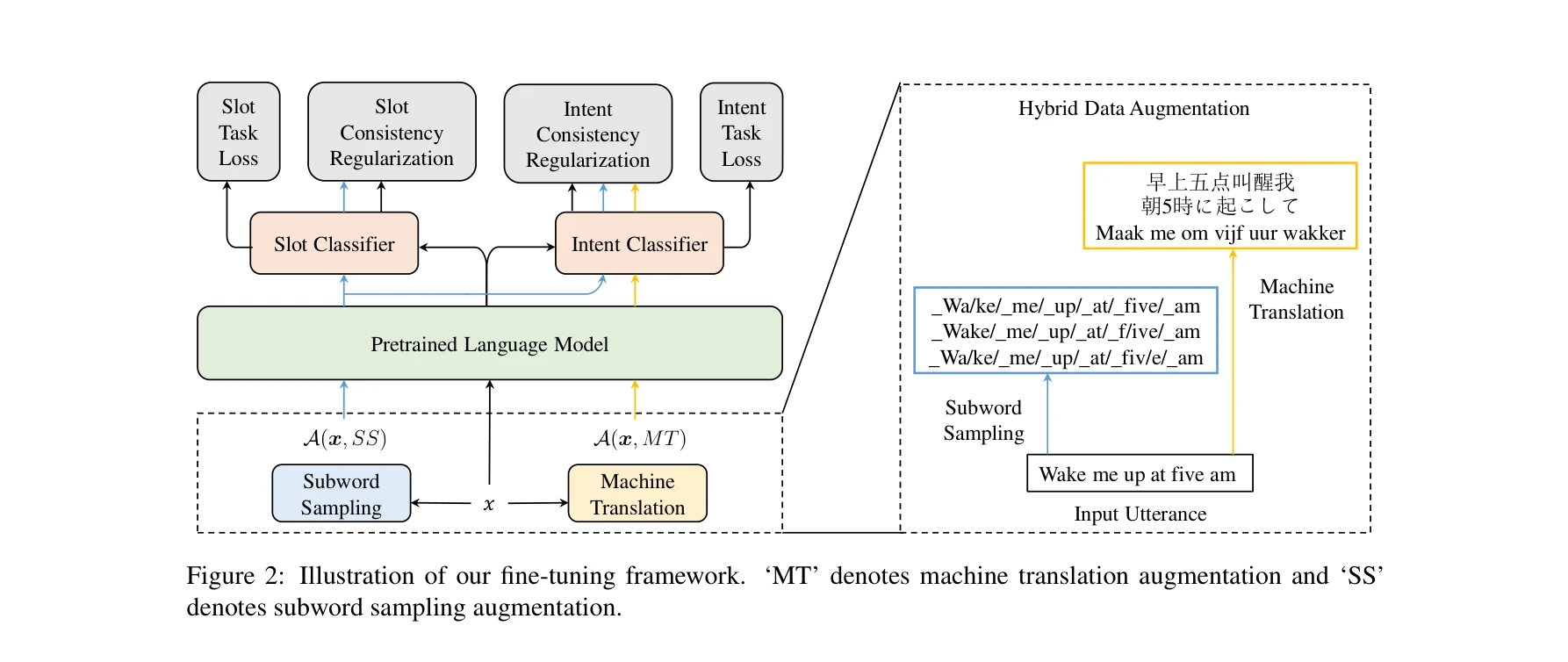

일관성 정규화 기반 미세조정 프레임워크. 하이브리드 데이터 증강으로 기계 번역(MT)과 부분단어 샘플링(SS)을 활용

- 경쟁 우위: MMNLU-22 경쟁에서 전체 데이터셋 설정 하에 1위 달성 (정확 매칭 정확도 49.65점, 2위보다 1.02점 우수)

- 성능 향상:

- XLM-Align Base: 의도 정확도 86.16% → 87.12%, 슬롯 F1 76.36 → 77.99

- mT5 Base: 의도 정확도 85.33% → 87.60%, 슬롯 F1 76.77 → 78.22

- 포괄적 효과: 전체 데이터셋 설정과 제로샷(zero-shot) 설정 모두에서 지속적인 성능 개선 달성