Essence

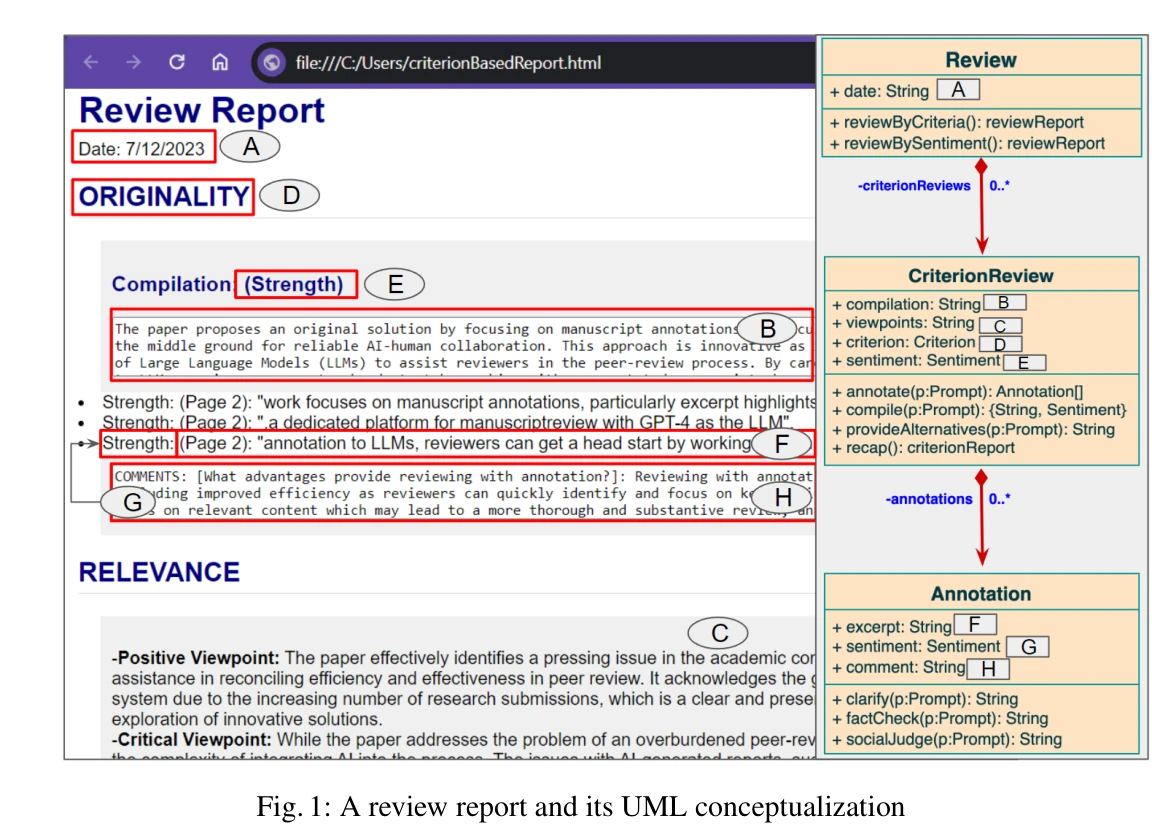

Fig. 1: 리뷰 보고서 및 그 UML 개념화

본 논문은 대규모 언어모델(LLM)을 학술 논문 심사 과정에 통합하되, AI가 전체 심사를 대체하는 것이 아니라 manuscript annotation(원고 주석 달기)이라는 특정 작업을 지원하는 방식을 제안한다. AnnotateGPT 플랫폼을 통해 AI와 인간 심사자의 협력을 위한 중간지점으로서 annotation의 역할을 검증한다.

저자: Óscar Díaz, Xabier Garmendia, Juanan Pereira | 날짜: 2024 | DOI: DOI 미제공

Fig. 1: 리뷰 보고서 및 그 UML 개념화

본 논문은 대규모 언어모델(LLM)을 학술 논문 심사 과정에 통합하되, AI가 전체 심사를 대체하는 것이 아니라 manuscript annotation(원고 주석 달기)이라는 특정 작업을 지원하는 방식을 제안한다. AnnotateGPT 플랫폼을 통해 AI와 인간 심사자의 협력을 위한 중간지점으로서 annotation의 역할을 검증한다.

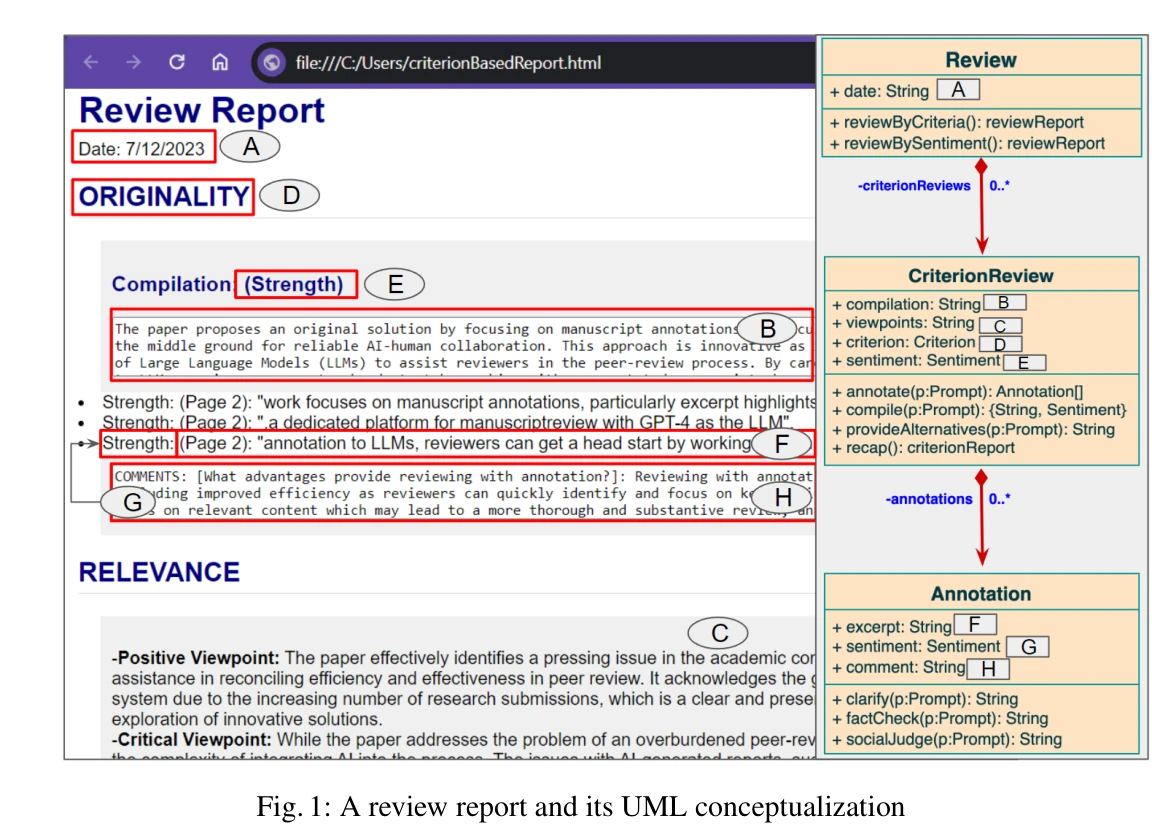

Fig. 2: Annotation 생성 프로세스

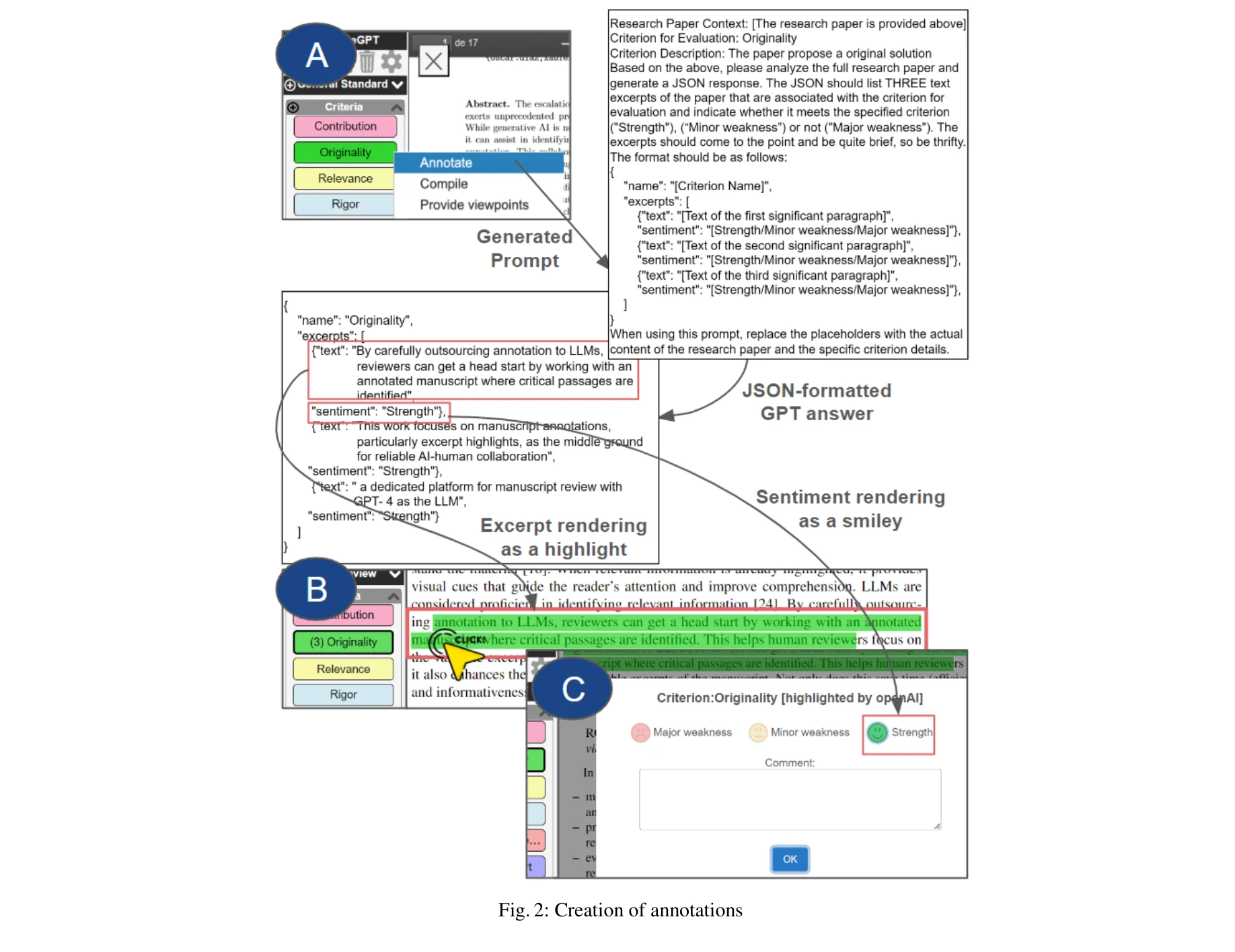

Fig. 3: Annotation 중심 프롬프팅

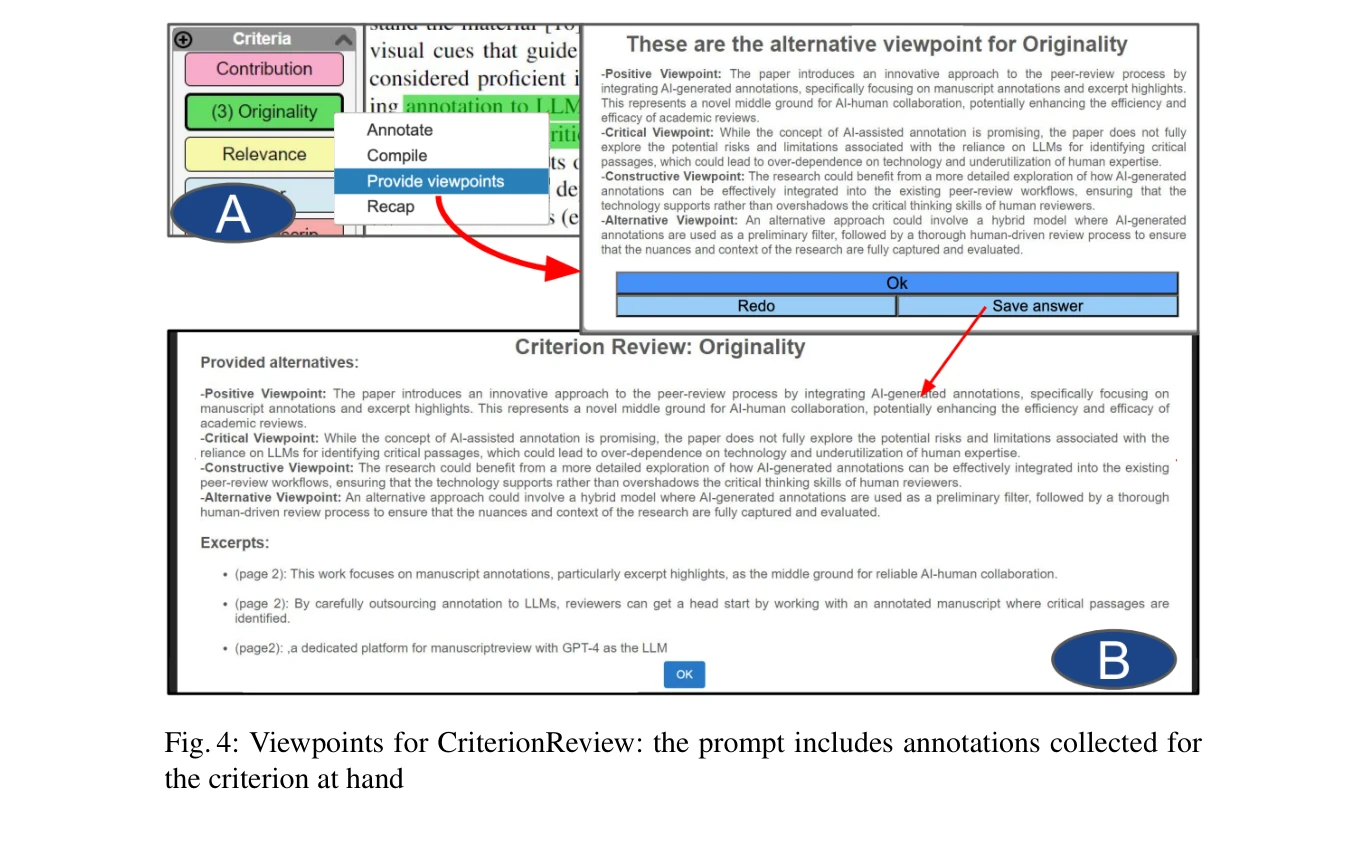

Fig. 4: CriterionReview를 위한 다양한 관점

총평: 학술 심사에서 LLM을 보강(augmentation) 도구로 활용하는 새로운 패러다임을 제시하고, annotation을 중심으로 AI-인간 협력의 설계를 체계화한 점은 의미 있으나, 소규모 사용자 평가(n=9)와 제한된 기술 검증으로 인해 학술적 임팩트와 실용성 입증이 미흡한 상태.