Achievement

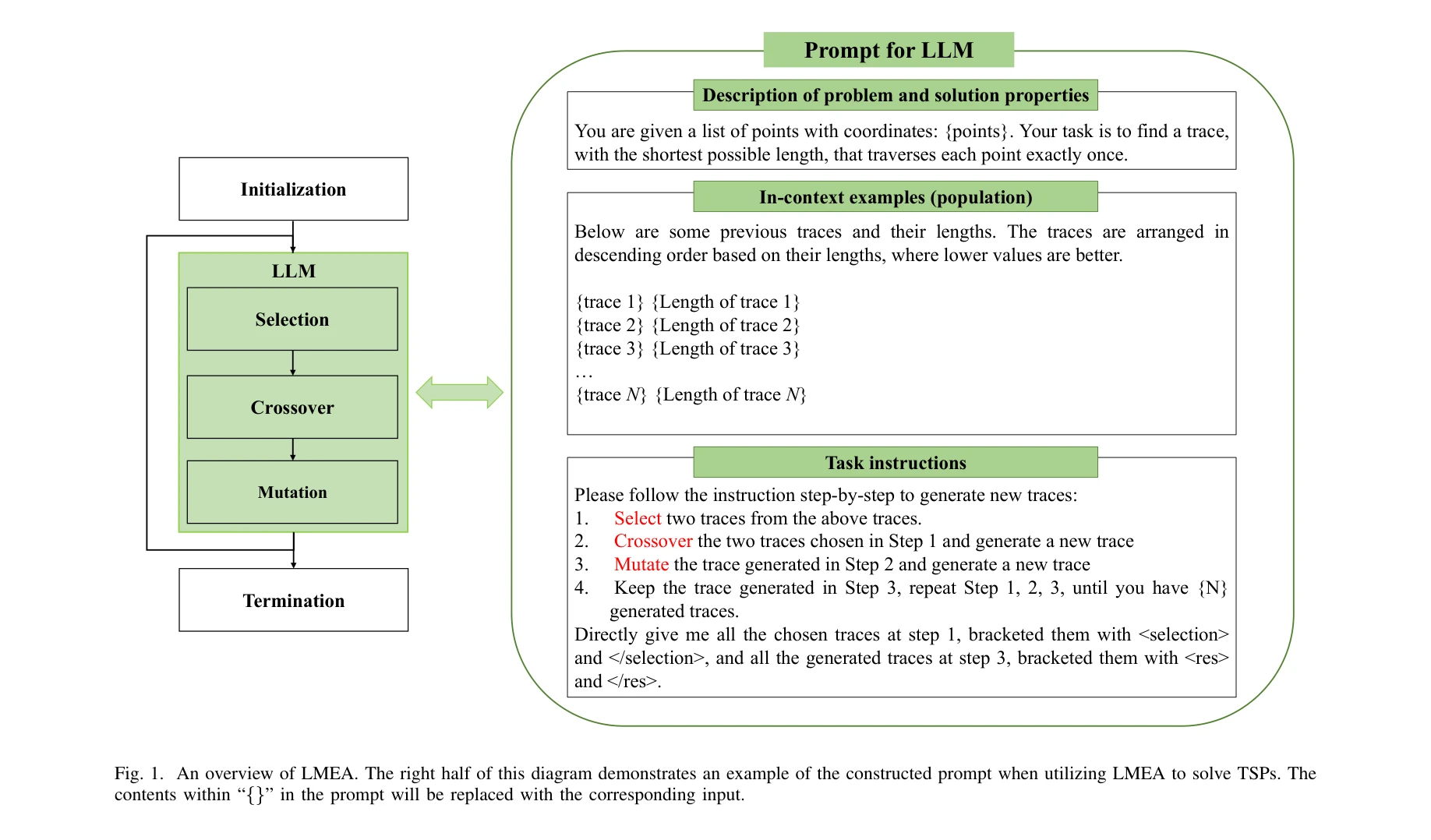

LMEA의 개요 및 프롬프트 구성 예시

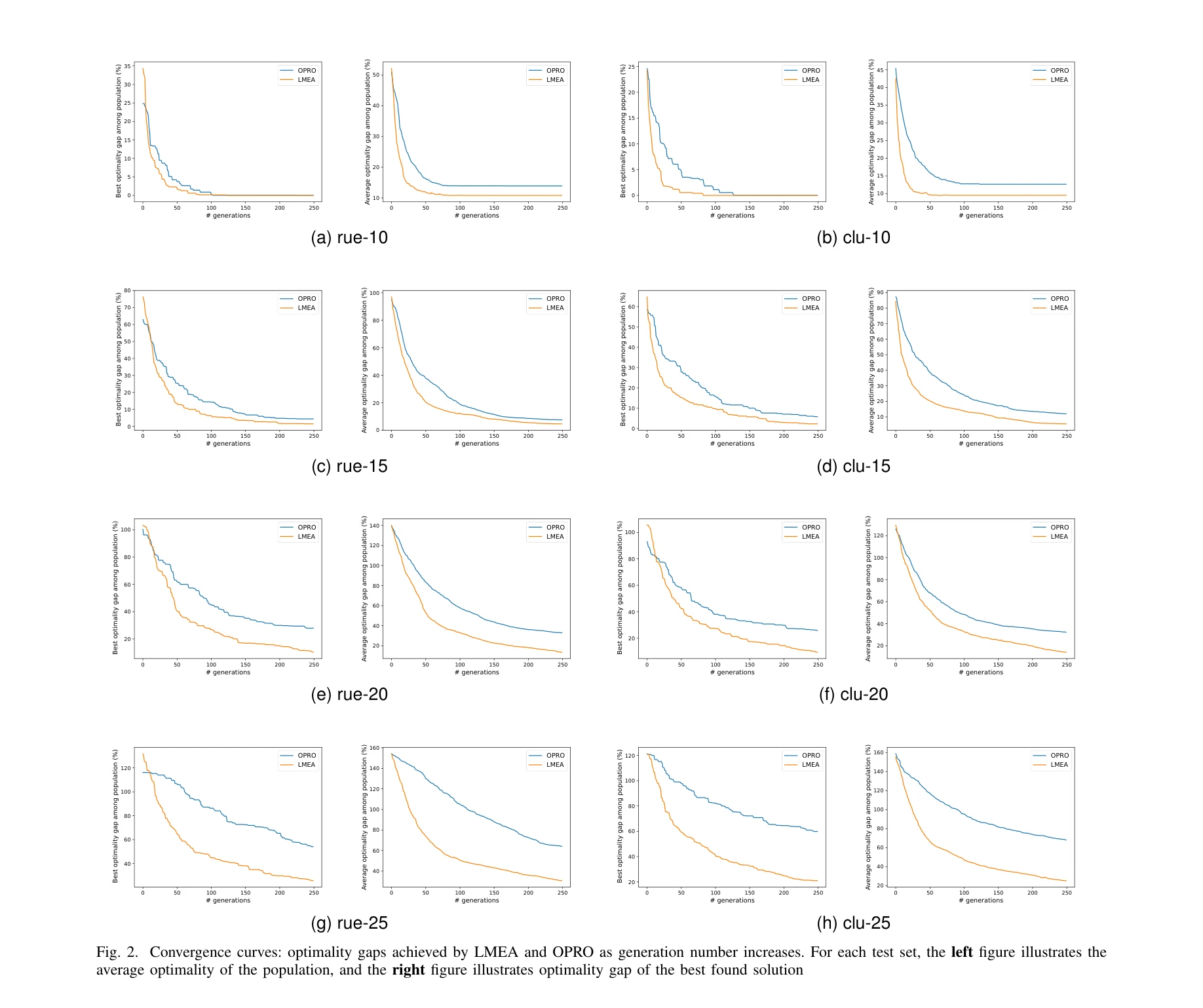

- 경쟁력 있는 성능: LMEA는 20개 노드 규모의 TSP(Traveling Salesman Problem) 인스턴스에서 전통적 휴리스틱과 견줄 만한 성능을 달성하며, 특히 10개 및 15개 노드 규모에서는 최적해를 일관되게 발견.

- 최소한의 설계 노력: 추가 모델 훈련이나 광범위한 도메인 전문 지식 없이 자연어 프롬프트 변경만으로 다양한 최적화 문제에 적응 가능.

- 자동 적응 메커니즘의 효과성: 온도 자동 조절 메커니즘이 지역 최적해 함정을 회피하고 탐색 성능을 향상시킴을 실증.