Achievement

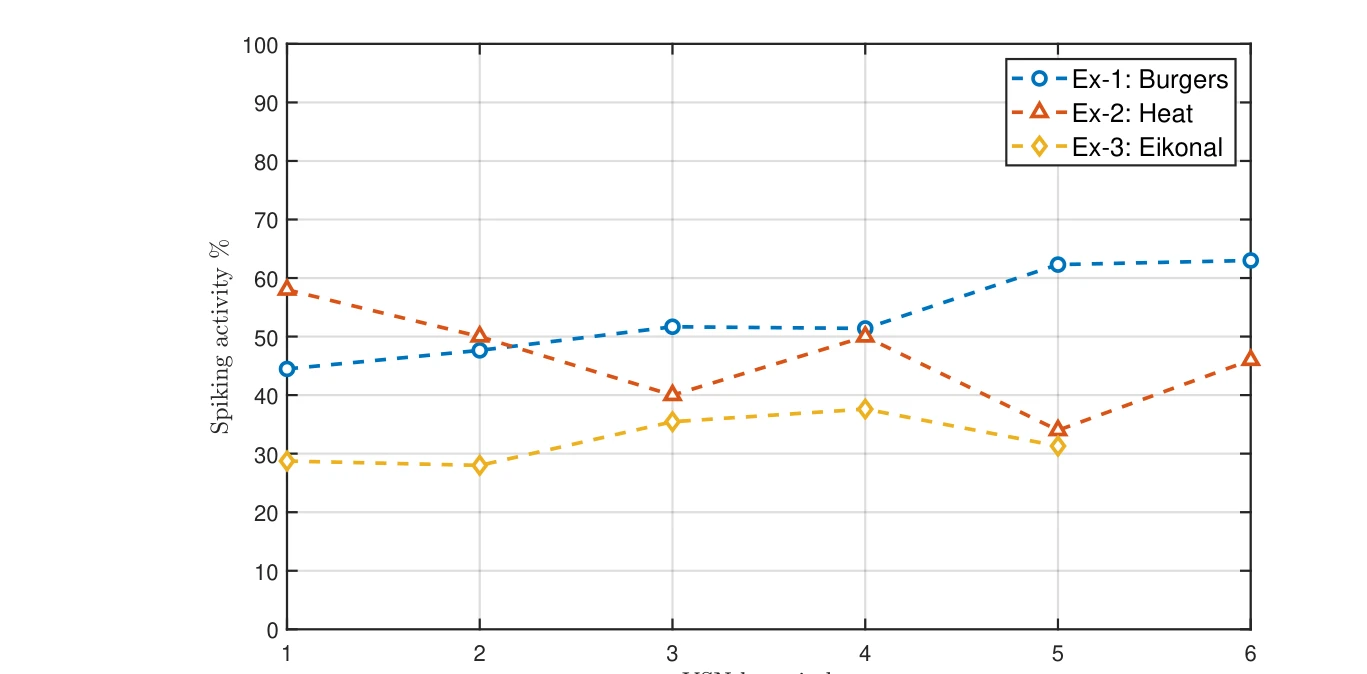

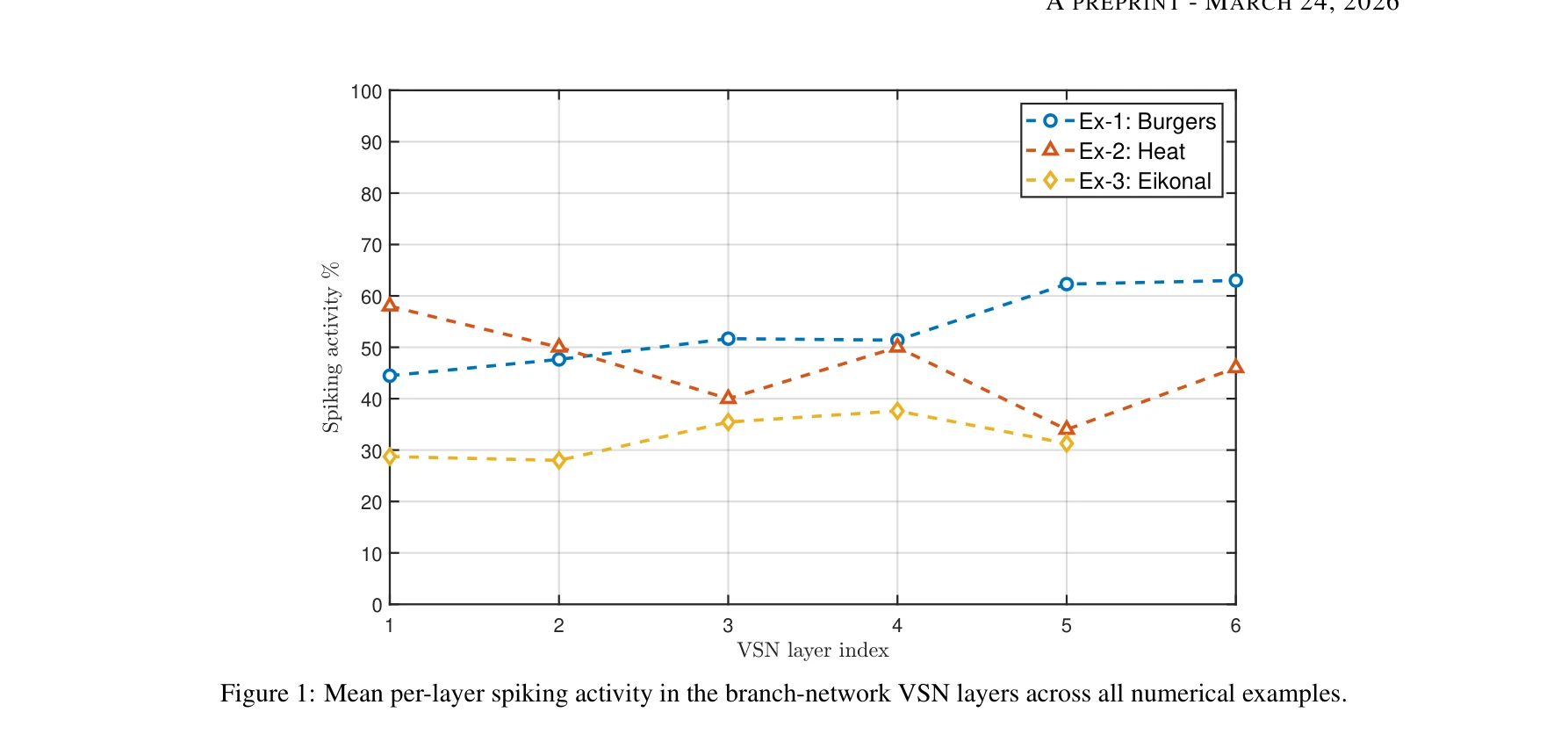

모든 수치 예제에서 branch 네트워크 VSN 레이어의 계층별 평균 스파이킹 활동도

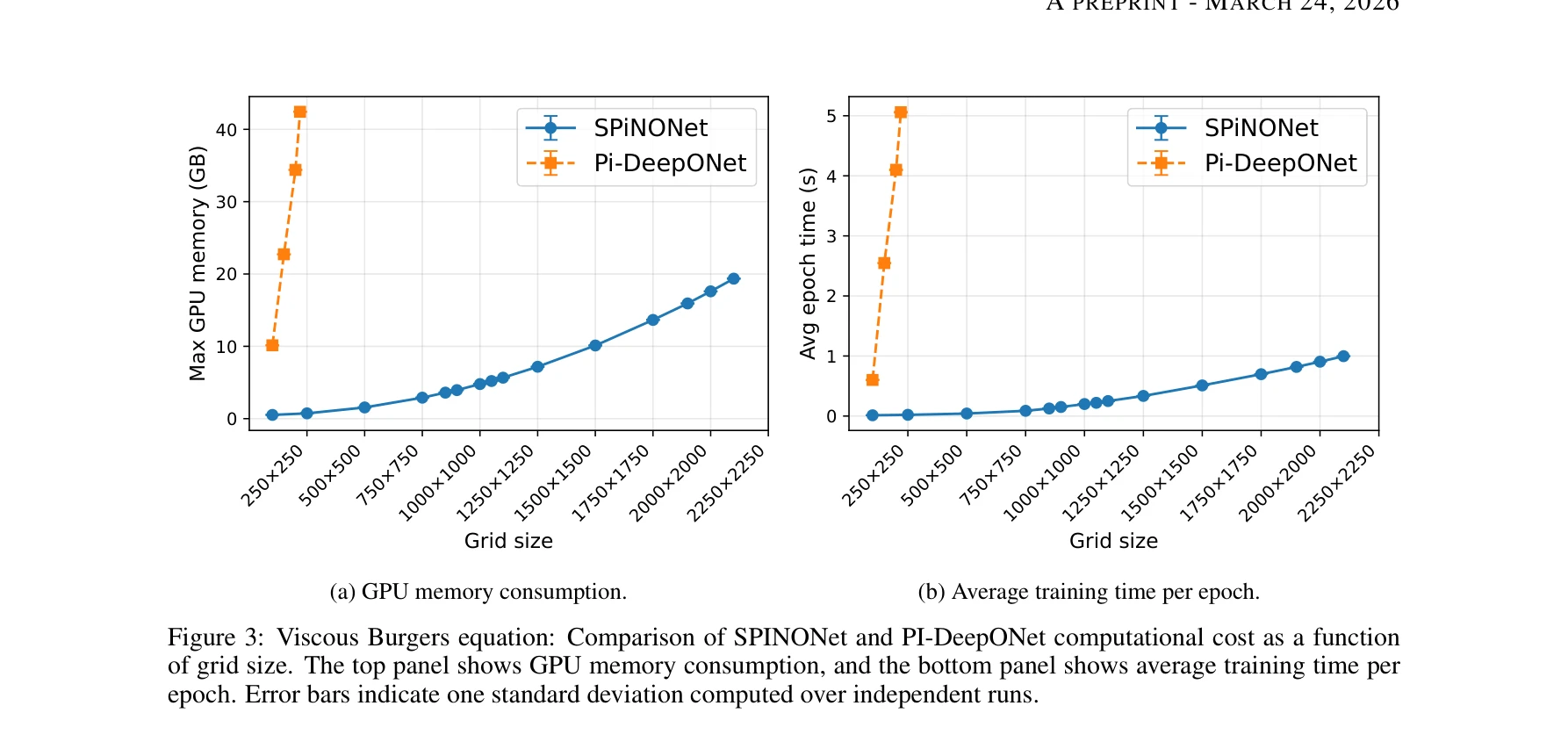

- 아키텍처적 분리를 통한 물리정보 스파이킹 연산자 학습: SPINONet은 입력 함수 인코딩 경로에 Variable Spiking Neuron(VSN)을 도입하여 희소 이벤트 기반 연산을 가능하게 하면서, 좌표 종속 trunk 네트워크를 연속 미분 가능하게 유지함으로써 PDE 잔차 계산(residual computation)에 필요한 공간-시간 편미분을 정확히 계산할 수 있다. 좌표별 인수분해(coordinate-wise factorization)로 명시적 전체 메시 평가를 제거하여 해상도 증가에 따른 계산 비용이 선형적으로 증가한다.

- 정확도 유지와 안정성 향상: 시간 종속 및 정상 상태 PDE, 고차원 공간-시간-매개변수 설정을 포함한 다양한 벤치마크에서 SPINONet은 기존 물리정보 연산자 학습 기법(PI-DeepONet)과 비교하여 희소 통신으로 인한 성능 저하 없이 유사한 예측 정확도를 달성한다. 순수 물리정보 학습이 퇴화 해(spurious solution)로 수렴할 수 있는 어려운 영역에서, 소량의 감독 데이터(limited data supervision)를 하이브리드 방식으로 추가하면 근본적 물리정보 손실 함수 공식을 수정하지 않으면서도 성능과 안정성이 개선된다.