Essence

신경 연산자의 발전 역사

편미분방정식(PDE) 해법으로 전통 수치해석 방법을 대체할 수 있는 신경 연산자(Neural Operators, NOs)의 아키텍처, 변형, 성능을 종합적으로 비교 분석한 체계적 리뷰 논문이다. DeepONet, 적분 커널 연산자, 트랜스포머 기반 신경 연산자의 세 가지 주요 아키텍처와 이들의 물리정보 통합 변형, 복잡계 응용을 다룬다.

저자: Shengjun Liu, Yu Yu, Ting Zhang, Hanchao Liu, Xinru Liu, Deyu Meng | 날짜: 2025-10-01 | DOI: 10.1016/j.neucom.2025.130518

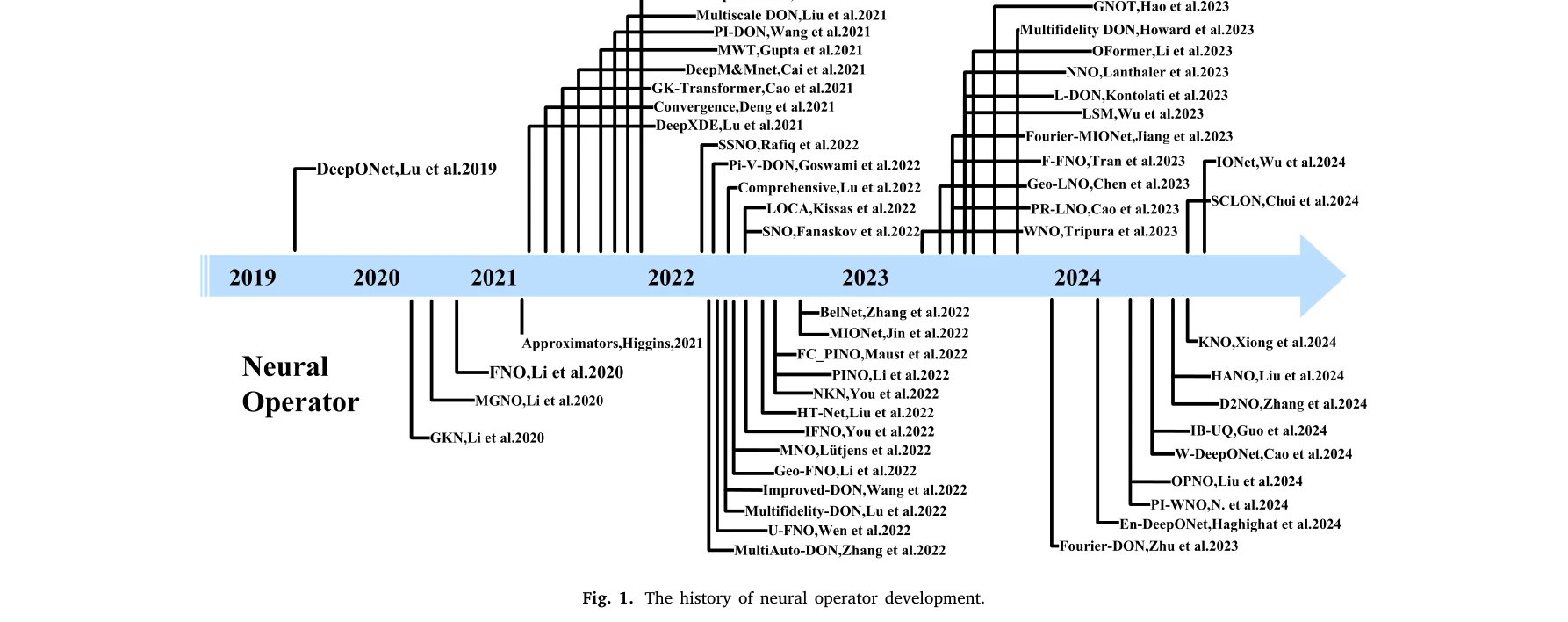

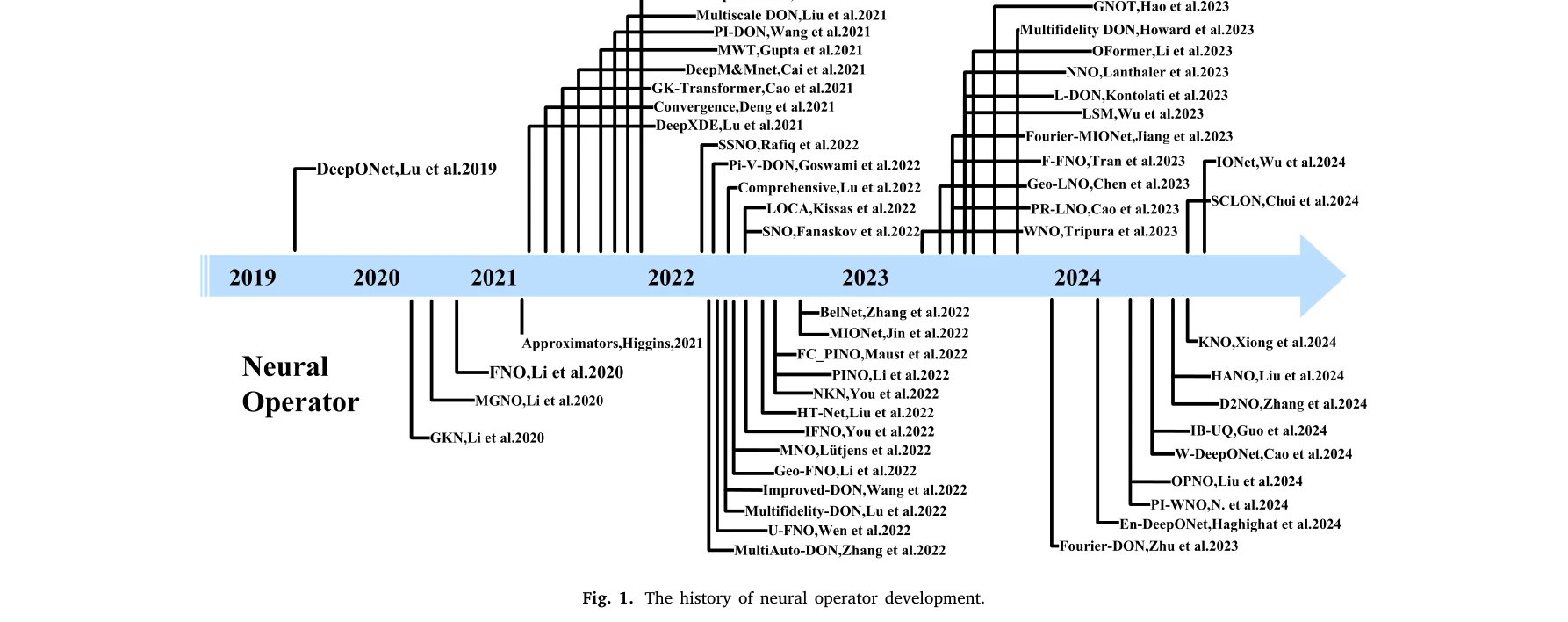

신경 연산자의 발전 역사

편미분방정식(PDE) 해법으로 전통 수치해석 방법을 대체할 수 있는 신경 연산자(Neural Operators, NOs)의 아키텍처, 변형, 성능을 종합적으로 비교 분석한 체계적 리뷰 논문이다. DeepONet, 적분 커널 연산자, 트랜스포머 기반 신경 연산자의 세 가지 주요 아키텍처와 이들의 물리정보 통합 변형, 복잡계 응용을 다룬다.

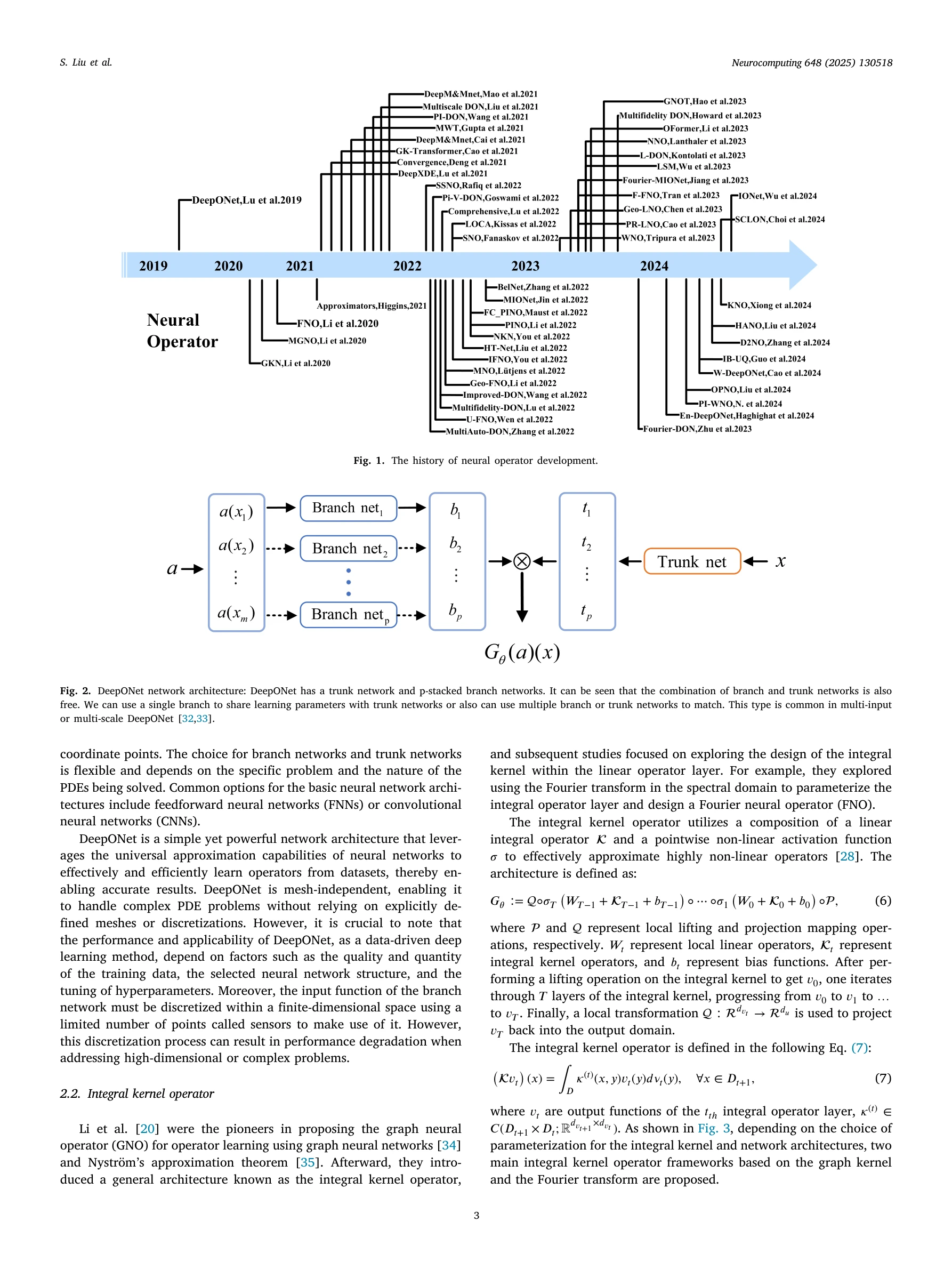

DeepONet 네트워크 아키텍처: 트렁크 네트워크(trunk network)와 p개의 브랜치 네트워크(branch network)로 구성

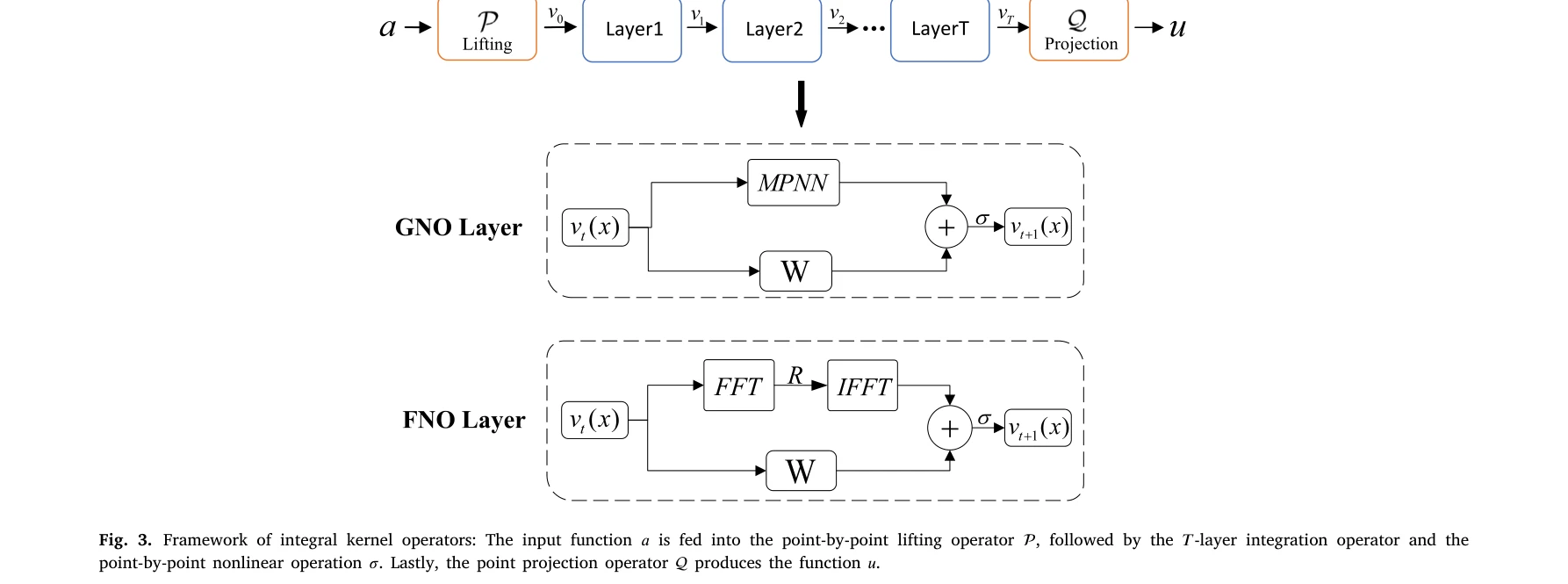

적분 커널 연산자 프레임워크: 입력 함수 a가 점별 리프팅 연산자를 통해 고차원 공간으로 변환

DeepONet 방식:

적분 커널 연산자 방식:

트랜스포머 기반 방식:

물리정보 통합:

총평: 신경 연산자의 주요 아키텍처와 변형을 체계적으로 정리하고 성능을 실증적으로 비교한 가치 있는 종합 리뷰로, PDE 해법 분야에서 신경 연산자 적용을 추진하는 연구자와 실무자에게 실질적 가이드라인을 제공한다. 다만 이론적 수렴성 분석이 부족하고 고차원 문제에서의 근본적 한계가 여전히 미해결 상태인 점이 한계이다.