Achievement

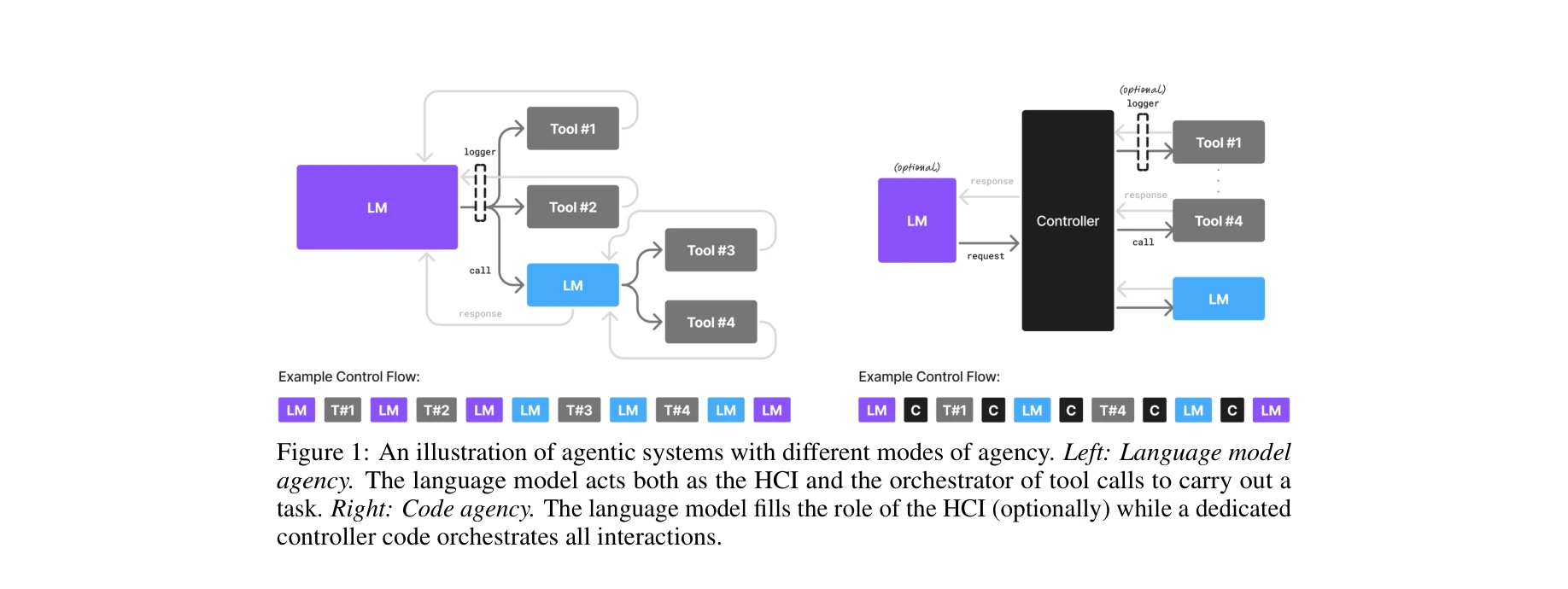

에이전트 시스템의 두 가지 운영 방식: 좌측은 언어모델이 인터페이스와 도구 호출을 모두 조율하는 방식, 우측은 코드 기반 컨트롤러가 상호작용을 조율하는 방식

- SLM의 충분한 성능 입증:

- Phi-2 (2.7B): 30B 모델 수준의 상식추론, ~15배 빠른 속도

- Phi-3 Small (7B): 70B 모델 수준의 코드생성 성능

- Nemotron-H (2-9B): 30B LLM 수준의 명령어 따르기, 한 자리 수 추론 비용

- xLAM-2-8B: GPT-4o와 Claude 3.5를 능가하는 도구 호출 성능

- DeepSeek-R1-Distill-7B: Claude-3.5-Sonnet 및 GPT-4o 초과 성능

- 경제성 우월성:

- 추론 효율성: 7B SLM은 70-175B LLM 대비 10-30배 저렴

- 미세조정(Fine-tuning) 민첩성: GPU 몇 시간으로 완료 (LLM은 주 단위)

- 엣지 배포: 소비자 GPU에서 로컬 실행 가능

- 인프라 운영: GPU/노드 간 병렬화 필요성 감소로 유지보수 비용 절감

- 이질형 에이전트 시스템 제안:

- SLM을 기본 모델로 사용하고 필요시에만 선택적으로 LLM 호출

- 특화된 SLM 조합으로 모듈식 아키텍처 구성