Essence

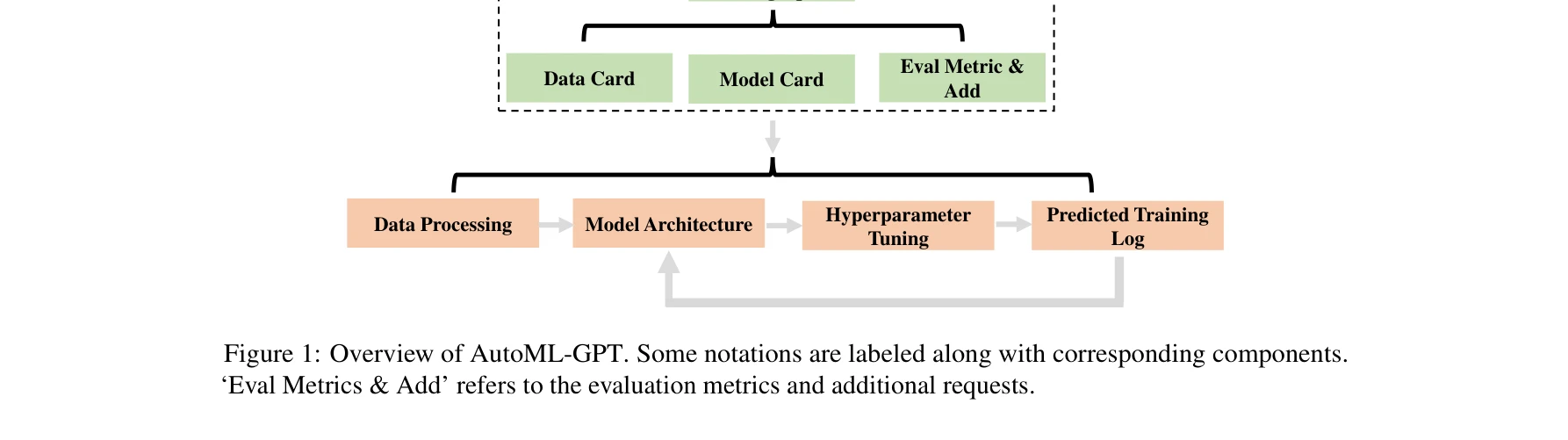

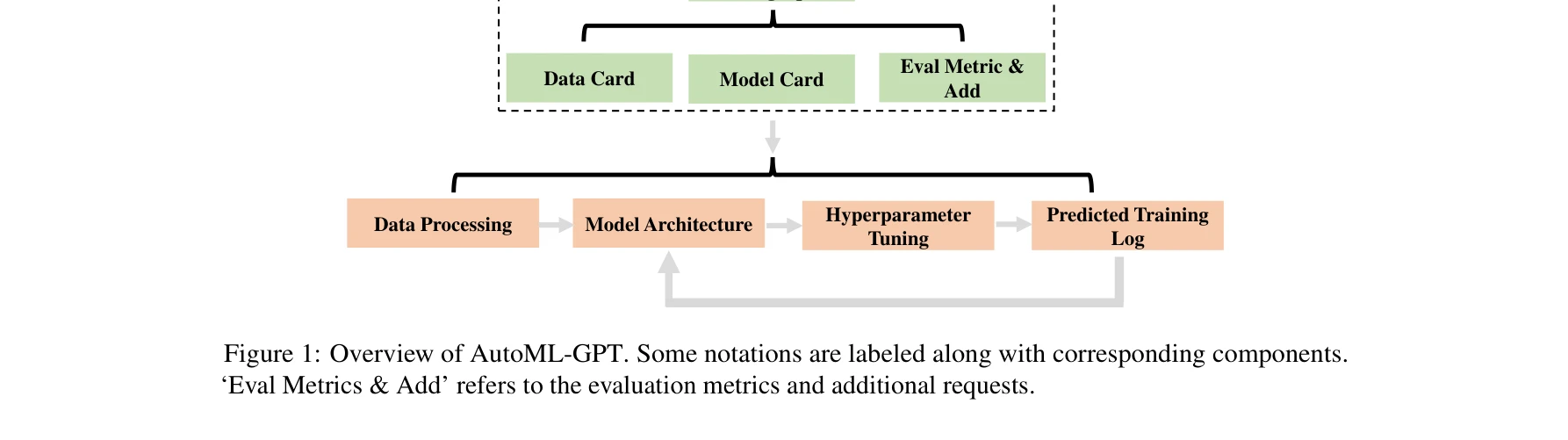

그림 1: AutoML-GPT의 개요. 데이터 처리부터 모델 아키텍처, 하이퍼파라미터 튜닝, 예측 훈련 로그 생성까지의 전체 파이프라인을 보여줌

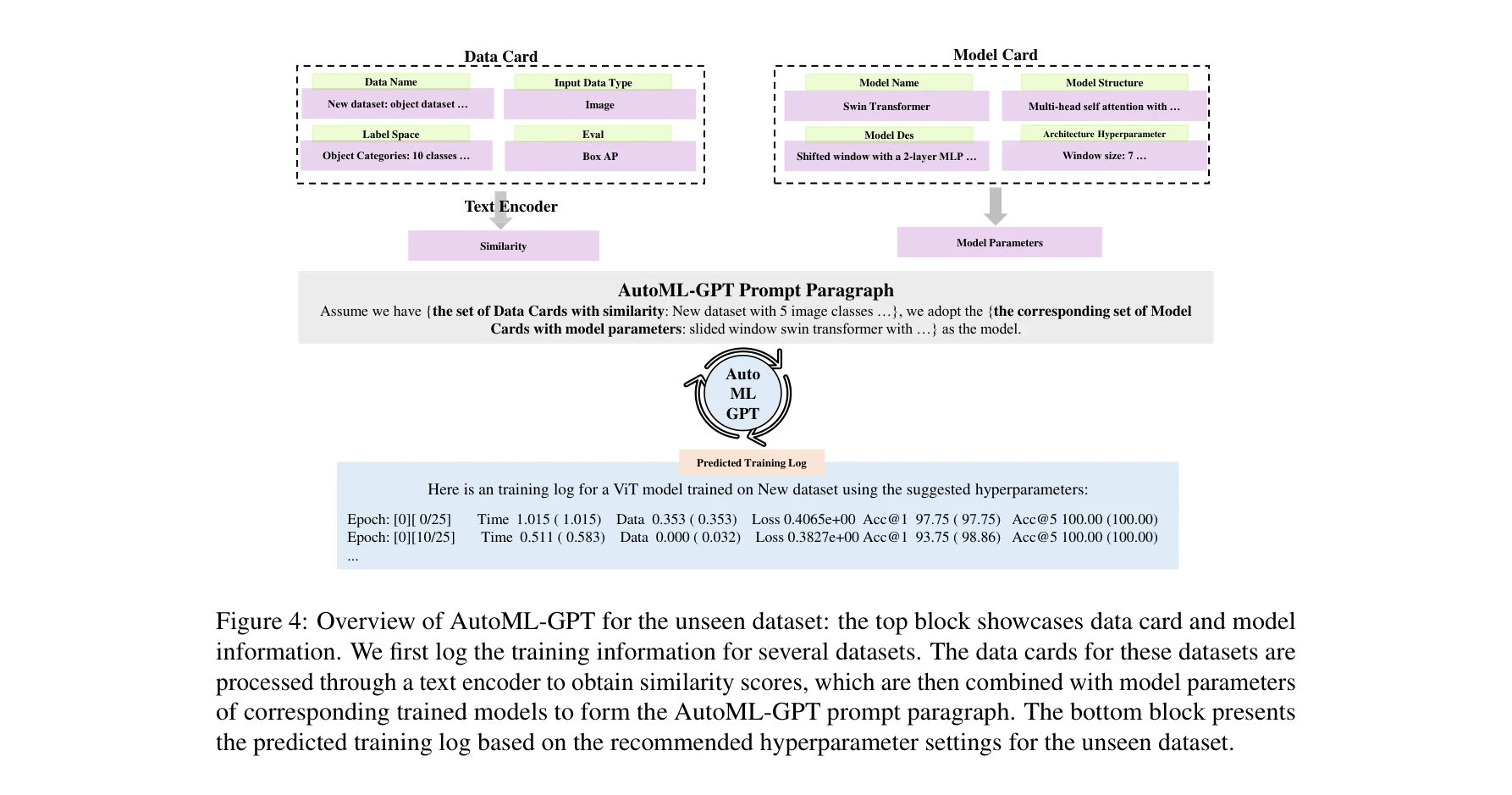

본 논문은 GPT와 같은 대규모 언어모델(LLM)을 자동 머신러닝(AutoML) 시스템의 컨트롤러로 활용하여, 데이터 처리부터 모델 아키텍처 설계, 하이퍼파라미터 튜닝까지 전체 머신러닝 파이프라인을 자동화하는 AutoML-GPT 시스템을 제안한다. 모델 카드(Model Card)와 데이터 카드(Data Card)를 활용한 구조화된 프롬프트를 통해 LLM이 다양한 AI 작업을 자동으로 최적화할 수 있게 한다.

How

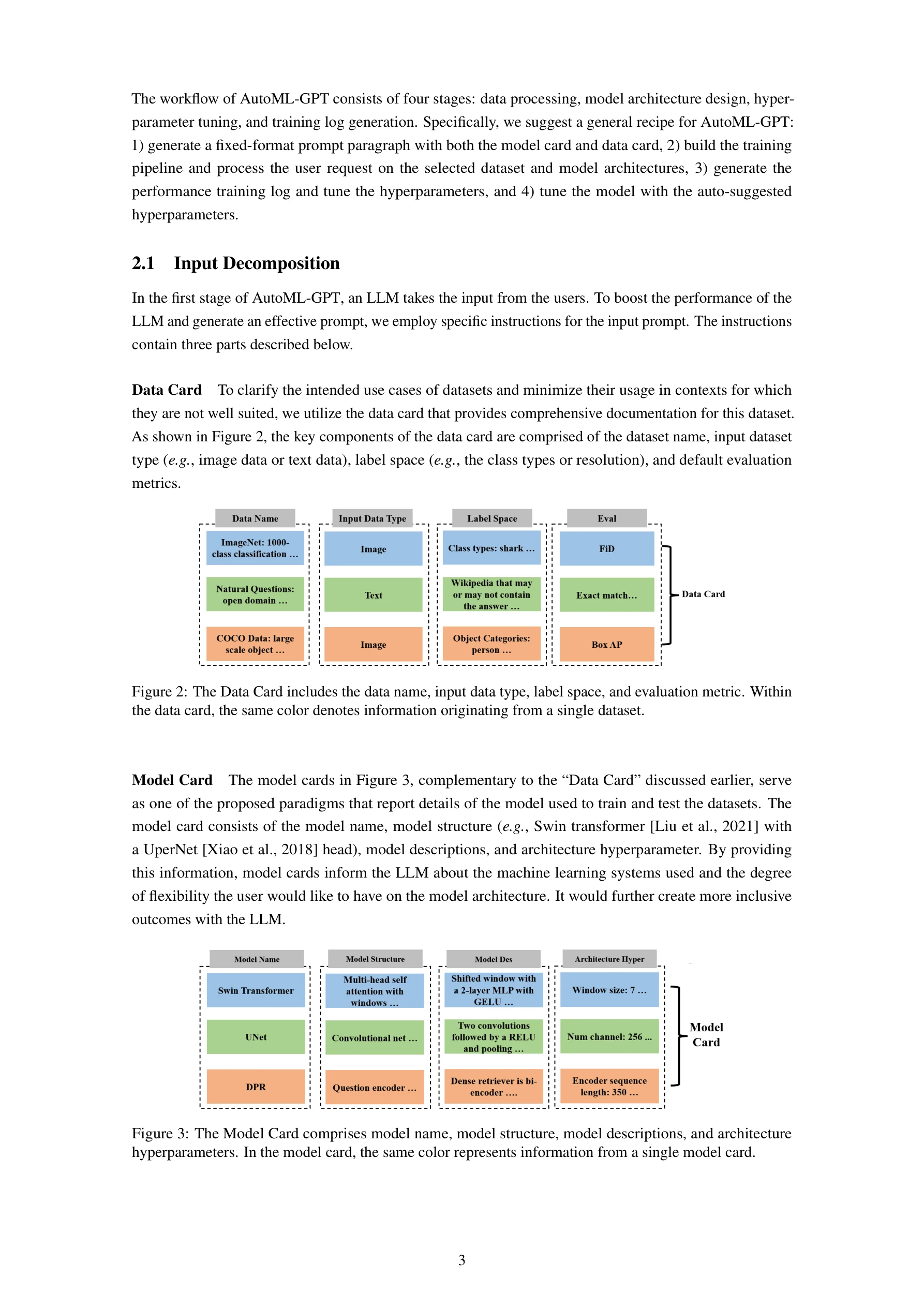

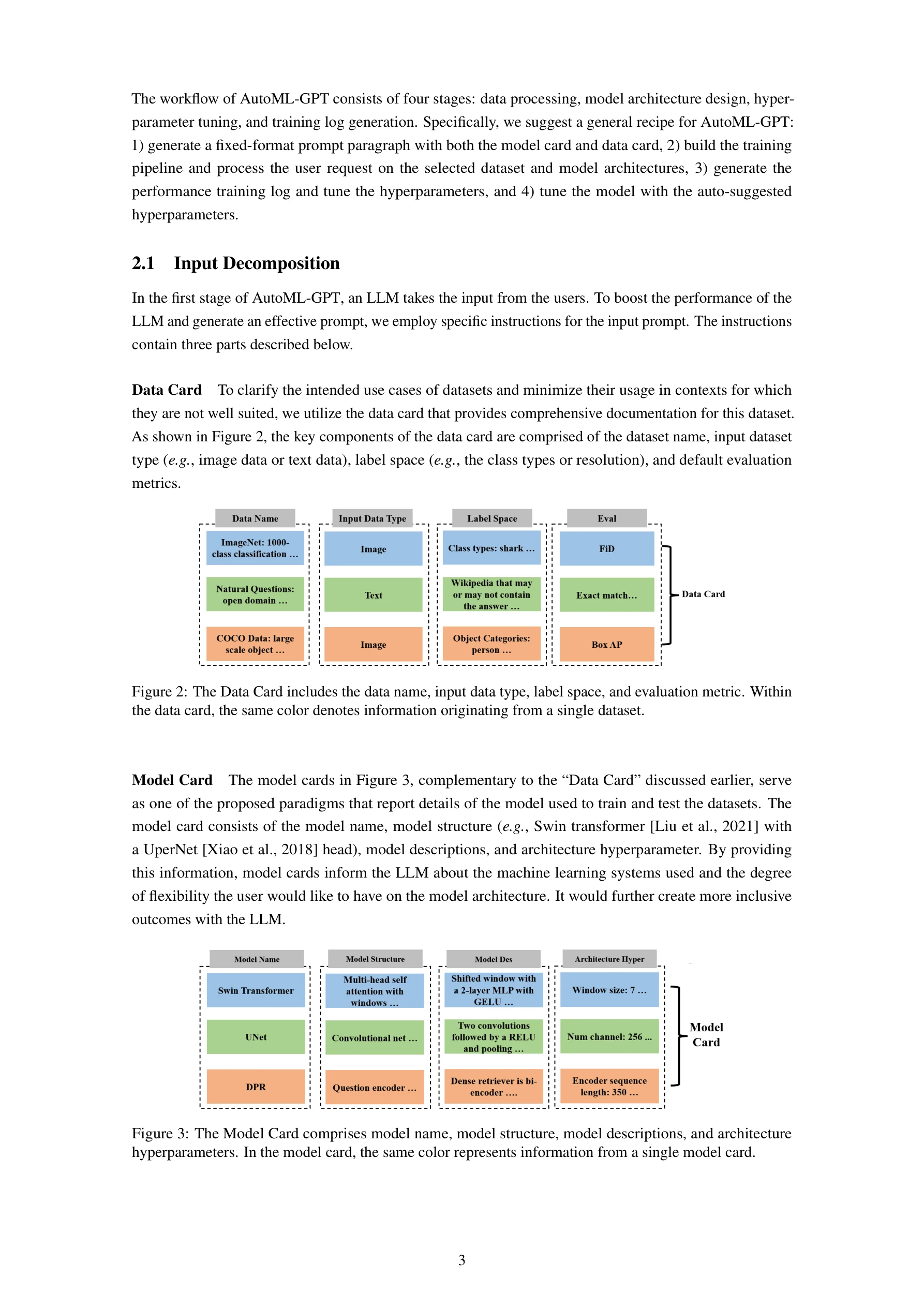

그림 2: 데이터 카드는 데이터 이름, 입력 데이터 타입, 레이블 공간, 평가 지표로 구성

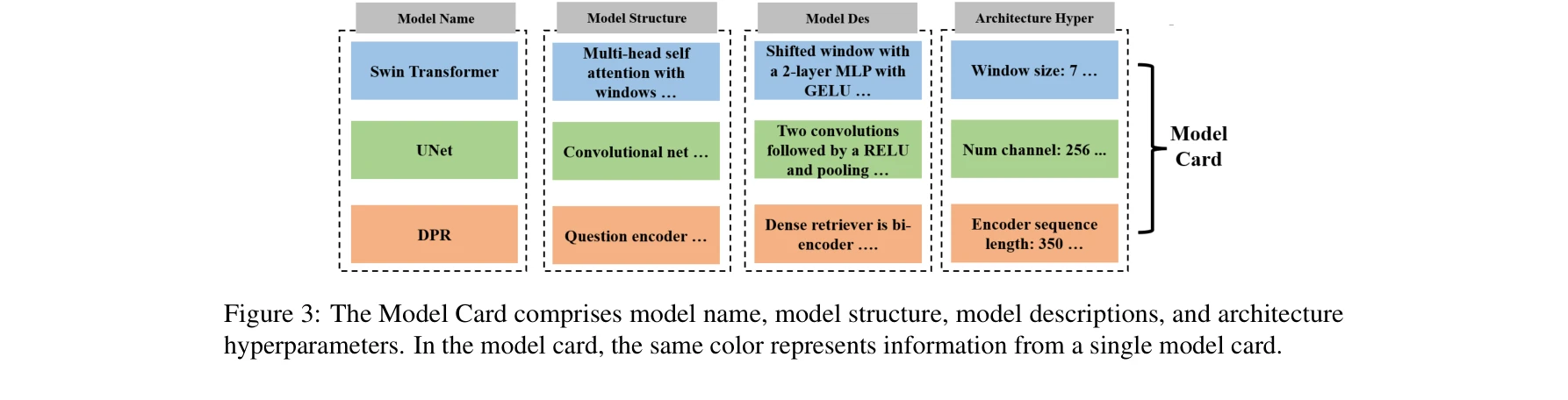

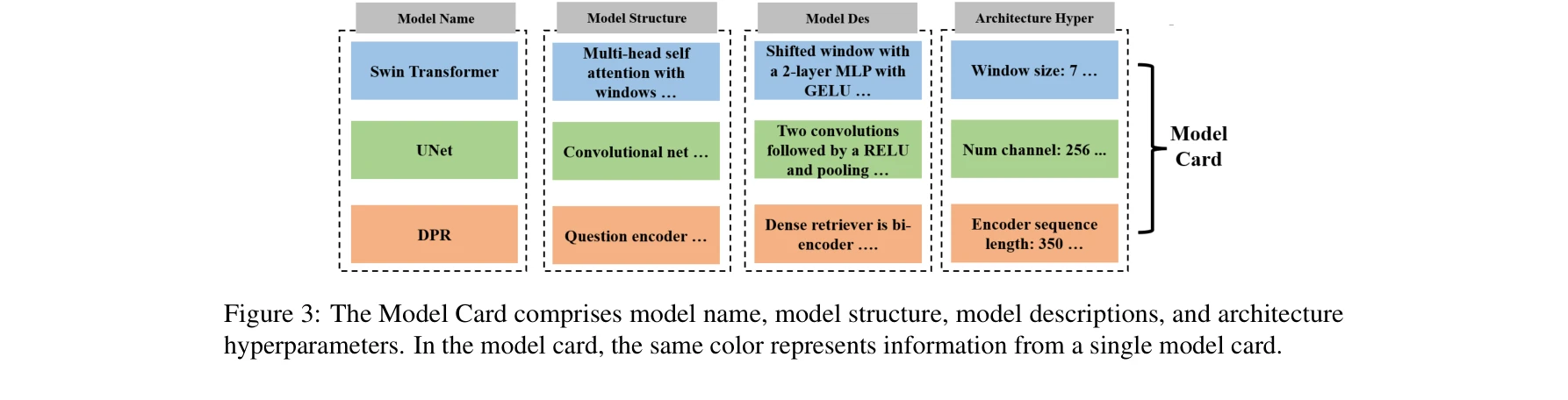

그림 3: 모델 카드는 모델 이름, 모델 구조, 모델 설명, 아키텍처 하이퍼파라미터로 구성

AutoML-GPT의 작동 방식:

- 입력 분해(Input Decomposition): 사용자의 요청을 데이터 카드, 모델 카드, 평가 지표 및 추가 요청사항으로 구조화

- 데이터 처리(Data Processing): 컴퓨터 비전의 경우 이미지 리사이징, 정규화, 증강(Augmentation), 필터링 등을 적용하고, NLP의 경우 토크나이제이션(Tokenization), 불용어 제거, 소문자 변환 등을 수행

- 모델 아키텍처 선택: In-context 작업-모델 할당 메커니즘으로 주어진 작업에 적합한 모델을 동적으로 선택

- 예측 훈련 로그 기반 하이퍼파라미터 튜닝: 실제 학습 없이 LLM이 생성한 예측 훈련 로그(Epoch, Loss, Accuracy 등)를 기반으로 최적 하이퍼파라미터 제시

- 인간 피드백 루프: 생성된 훈련 로그에 대해 사용자 피드백을 받아 추가 튜닝 반복