How

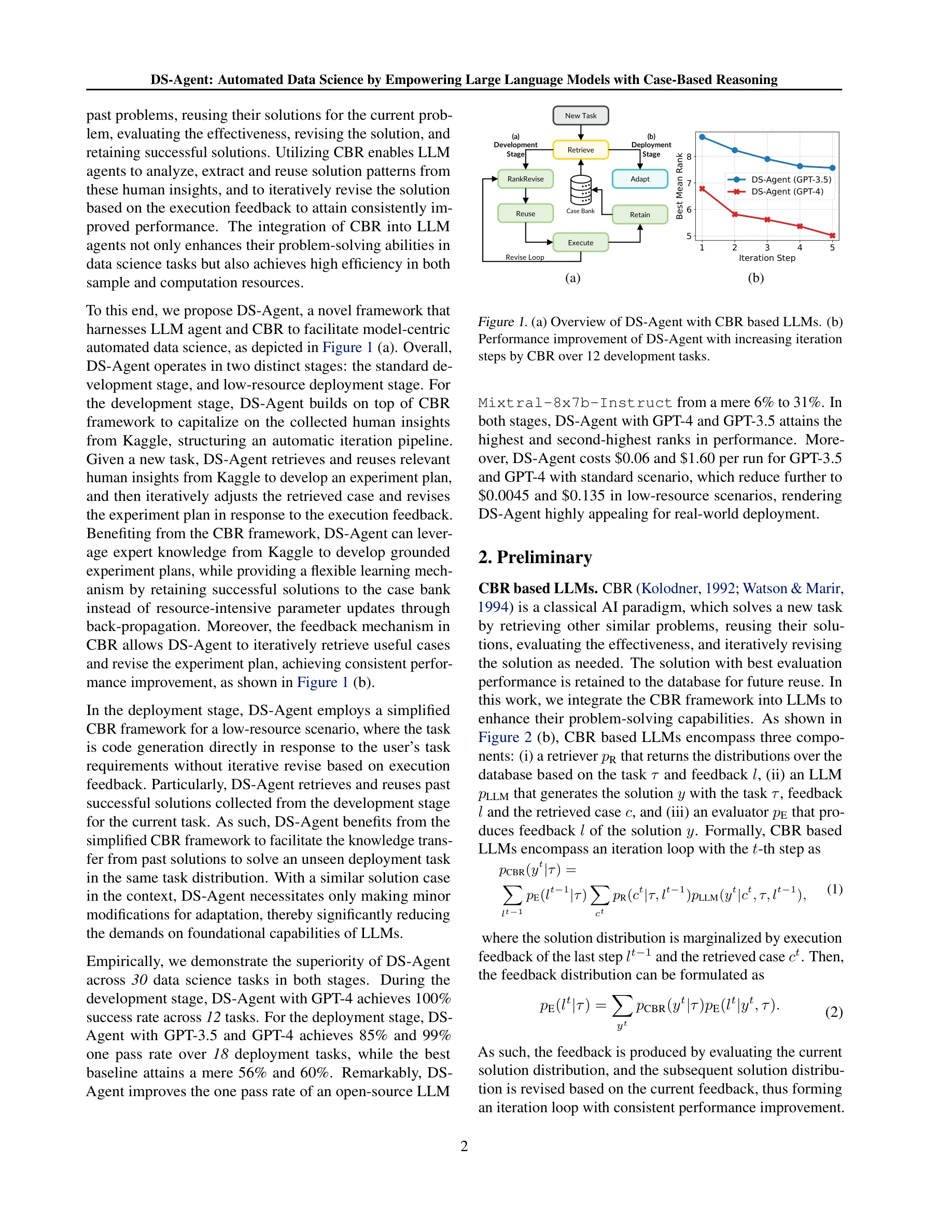

Figure 1: DS-Agent의 개요 (a) 및 반복 단계에 따른 성능 개선 곡선 (b)

개발 단계 (Development Stage)

- 인간 전문가 지식 수집: Kaggle에서 최근 완료된 경쟁 대회의 기술 보고서와 상위 순위 코드를 크롤링하여 정제·요약하여 사례 뱅크 구성

- Step 1 - 검색 (Retrieve): 사전학습 임베딩 모델을 이용한 코사인 유사도로 작업 설명과 유사한 상위-k개 사례 검색

sim(τ, c) = cos(E(τ), E(c))

- Step 2 - 순위 재조정 (ReviseRank): 이전 반복의 실행 피드백을 LLM이 분석하여 검색된 사례의 유용성을 평가하고 순위 재조정 (검색 모델 재학습 없이 LLM의 능력 활용으로 비용 절감)

- Step 3 - 재사용 (Reuse): 재순위 지정된 상위 사례들을 컨텍스트로 LLM에 제공

- Step 4 - 실행 (Execute): LLM이 생성한 Python 코드 실행 및 검증 데이터셋에서 성능 평가

- Step 5 - 유지 (Retain): 최고 성능 달성 솔루션을 사례 뱅크에 추가

배포 단계 (Deployment Stage)

- 단순화된 CBR: 개발 단계에서 수집한 성공한 해결책을 직접 재사용하여 코드 생성, 반복적 수정 제거

- 적응 (Adapt): 유사 사례를 컨텍스트에 제공함으로써 LLM의 기초 능력 요구 대폭 감소

기술적 형식화

CBR 기반 LLM의 반복 루프:

$$p_{CBR}(y_t|\tau) = \sum_{l_{t-1}} p_E(l_{t-1}|\tau) \sum_{c_t} p_R(c_t|\tau, l_{t-1}) p_{LLM}(y_t|c_t, \tau, l_{t-1})$$

RAG와의 차별점: CBR은 피드백 기반 동적 조정과 성공한 솔루션의 유지를 통해 반복적 학습 가능 vs. RAG는 단일 검색만 수행