Achievement

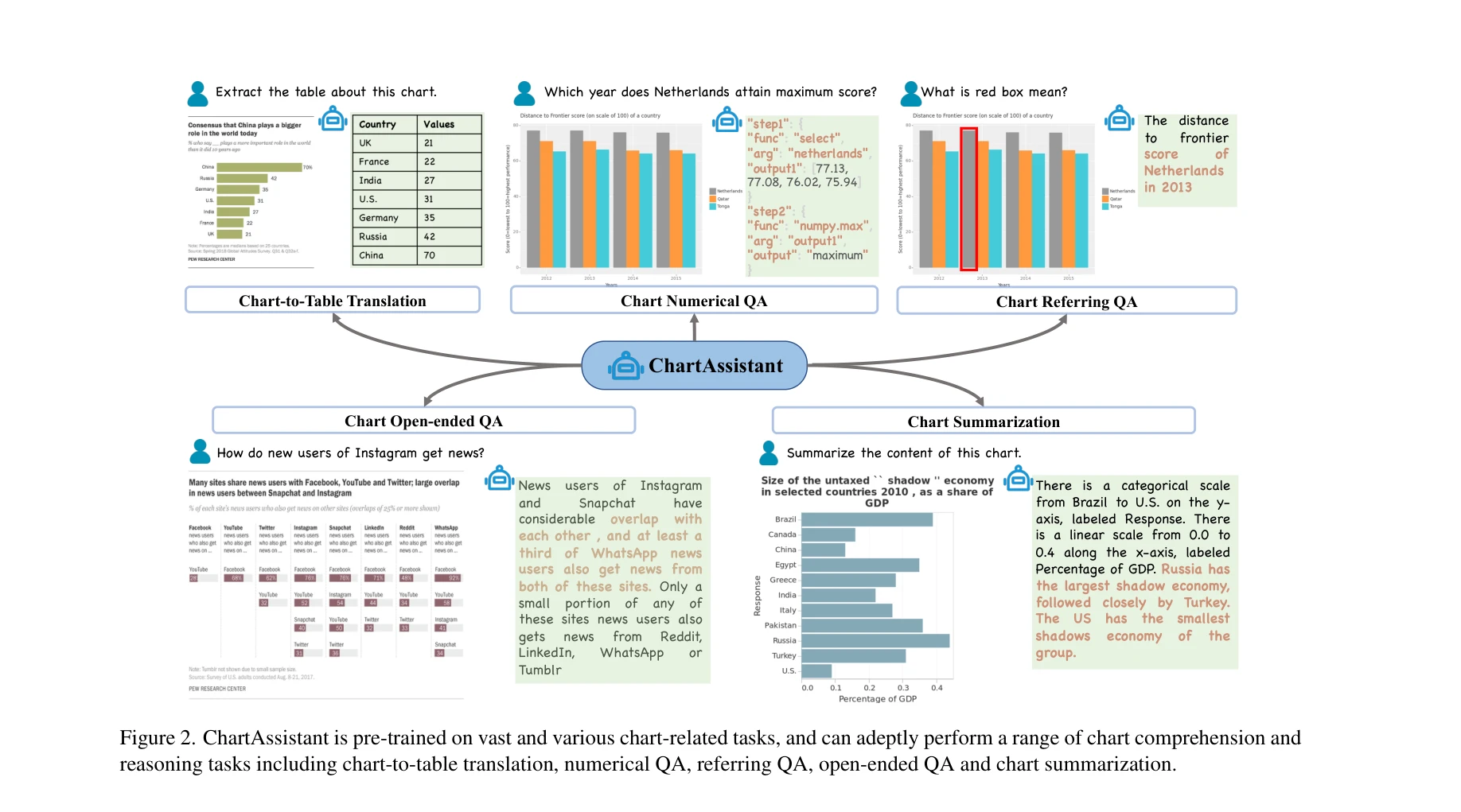

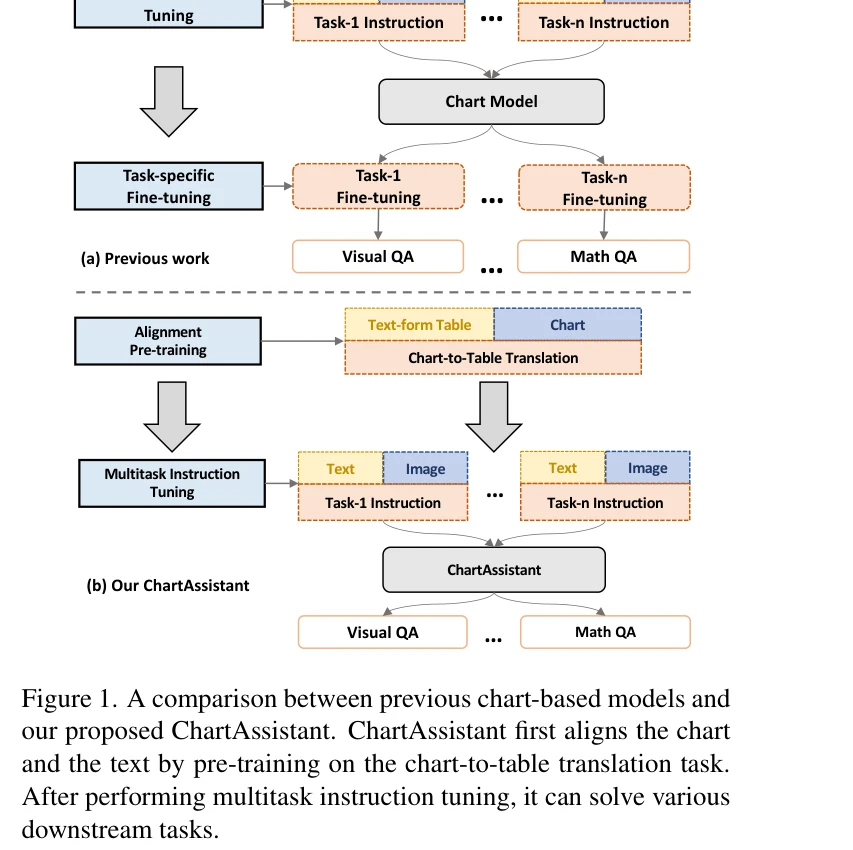

기존 차트 모델과 ChartAssistant의 학습 파이프라인 비교

- 성능 향상: UniChart 대비 수치 QA에서 50.0%, ChartQA에서 28.1% 성능 향상. 영점학습(zero-shot) 설정에서 RealCQA 데이터셋에서 29.5%, ChartLLM에서 23.6% 성능 향상 달성.

- 데이터셋 규모: MatCha 대비 4.75배, UniChart 대비 5.62배 큰 39M 규모의 ChartSFT 데이터셋 구축으로 더 나은 일반화 가능성 제공.

- 모델 다양성: 경량 모델(ChartAst-D, 260M 파라미터)과 고성능 모델(ChartAst-S, 13B 파라미터) 두 가지 변형 제공으로 다양한 응용 시나리오 지원.

- 포괄적 차트 커버리지: 기본 차트(막대, 선, 산점선, 원형)와 특화된 차트(레이더, 박스플롯 등) 포함으로 더 넓은 차트 유형 대응.