Essence

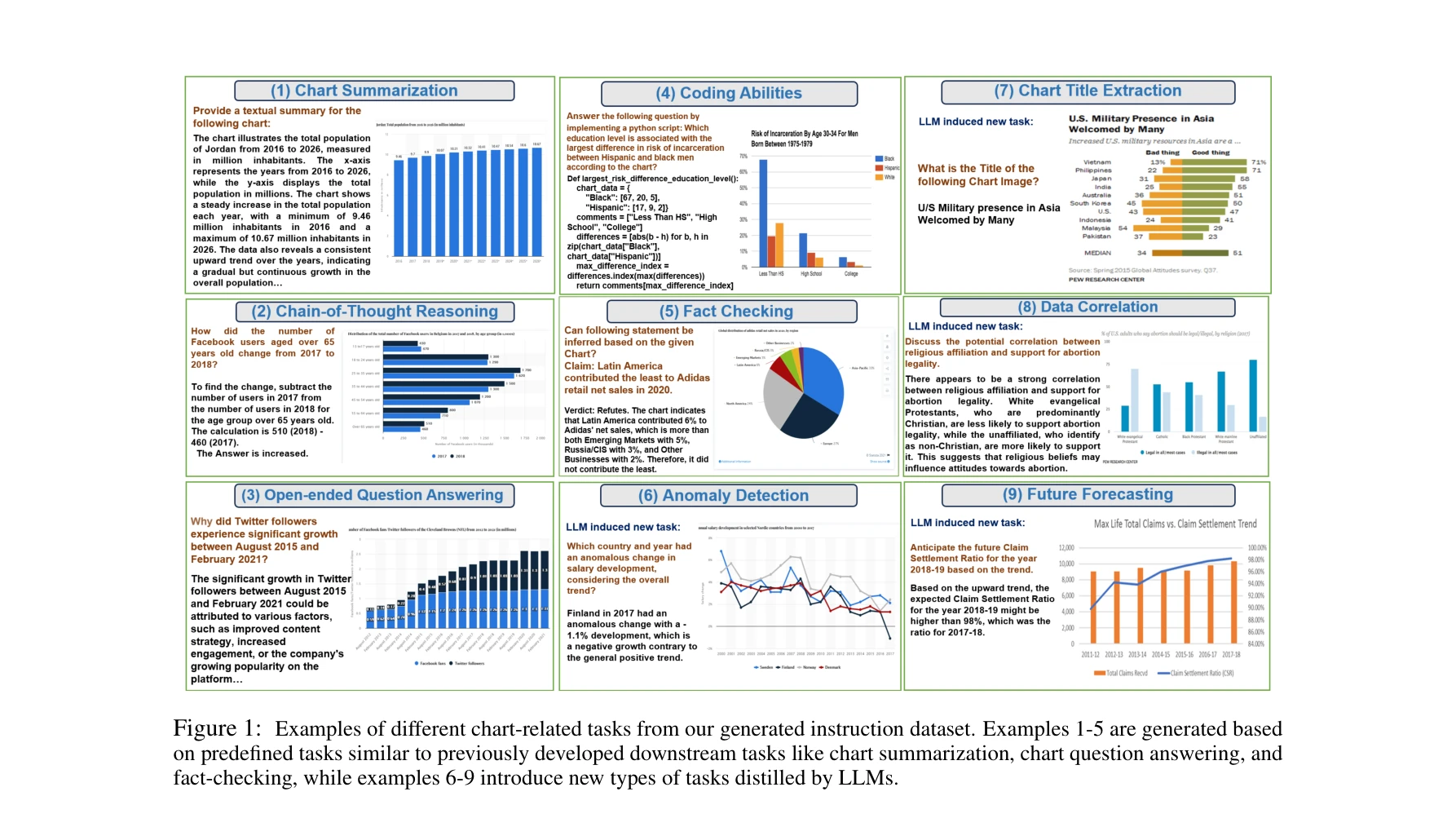

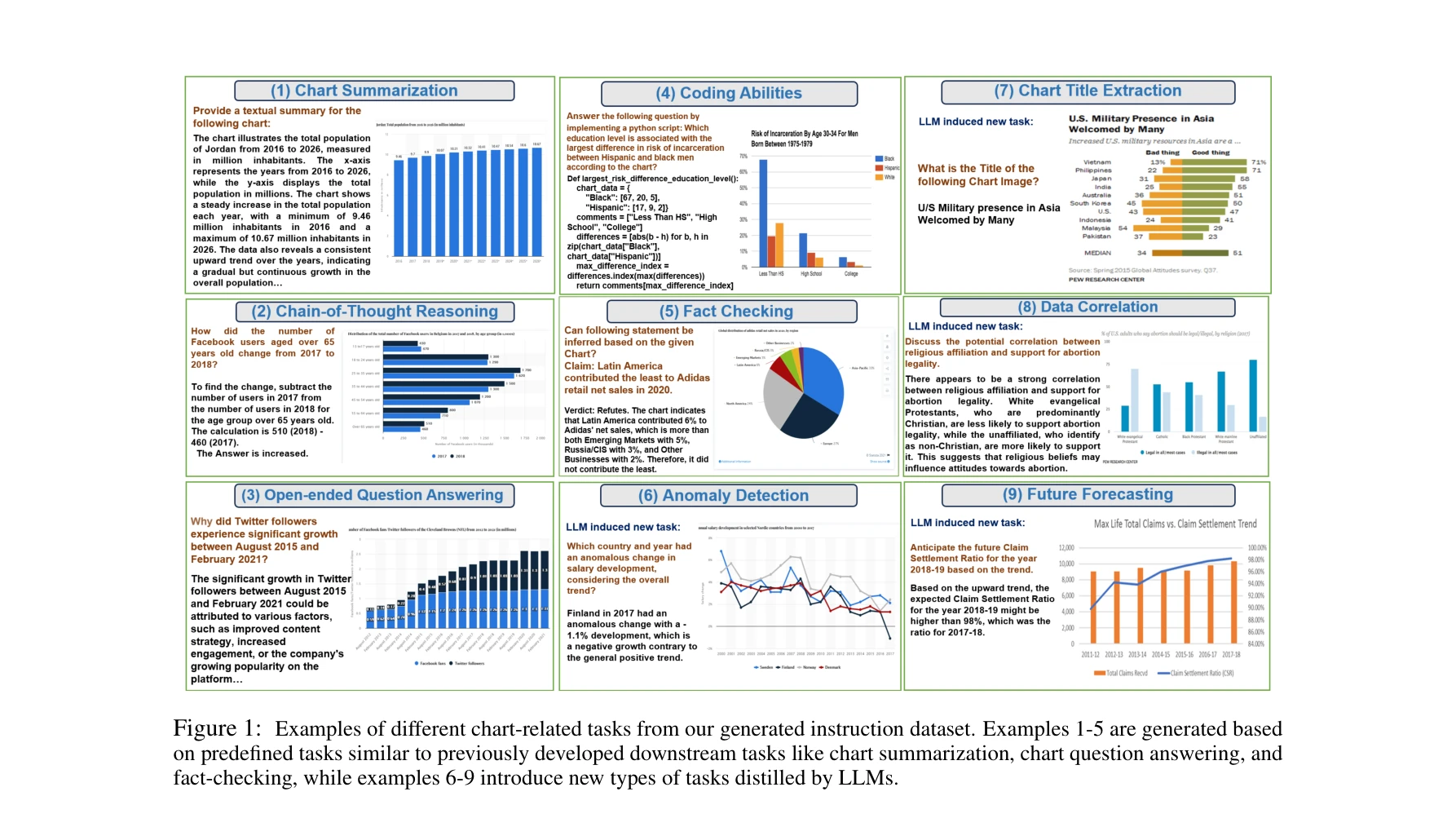

다양한 차트 관련 작업 예시: 요약, 질문-답변, 팩트 체킹, 추론, 코딩 능력 등을 포함한 8가지 유형의 지시문 튜닝 작업

본 논문은 차트 이해와 추론을 위한 대규모 지시문 튜닝 데이터셋(191K 지시문, 71K 차트)을 제시하고, 차트 특화 비전-언어 모델(VLM)의 일반화 능력을 대폭 향상시키는 두 가지 시스템을 제안한다.

저자: Ahmed Masry, Mehrad Shahmohammadi, Md Rizwan Parvez, Enamul Hoque, Shafiq Joty | 날짜: 2024-03-14 | DOI: 10.48550/arXiv.2403.09028

다양한 차트 관련 작업 예시: 요약, 질문-답변, 팩트 체킹, 추론, 코딩 능력 등을 포함한 8가지 유형의 지시문 튜닝 작업

본 논문은 차트 이해와 추론을 위한 대규모 지시문 튜닝 데이터셋(191K 지시문, 71K 차트)을 제시하고, 차트 특화 비전-언어 모델(VLM)의 일반화 능력을 대폭 향상시키는 두 가지 시스템을 제안한다.

지시문 튜닝 파이프라인: WebCharts 수집, 자동 데이터 테이블 추출, 다양한 작업별 지시문 생성 과정

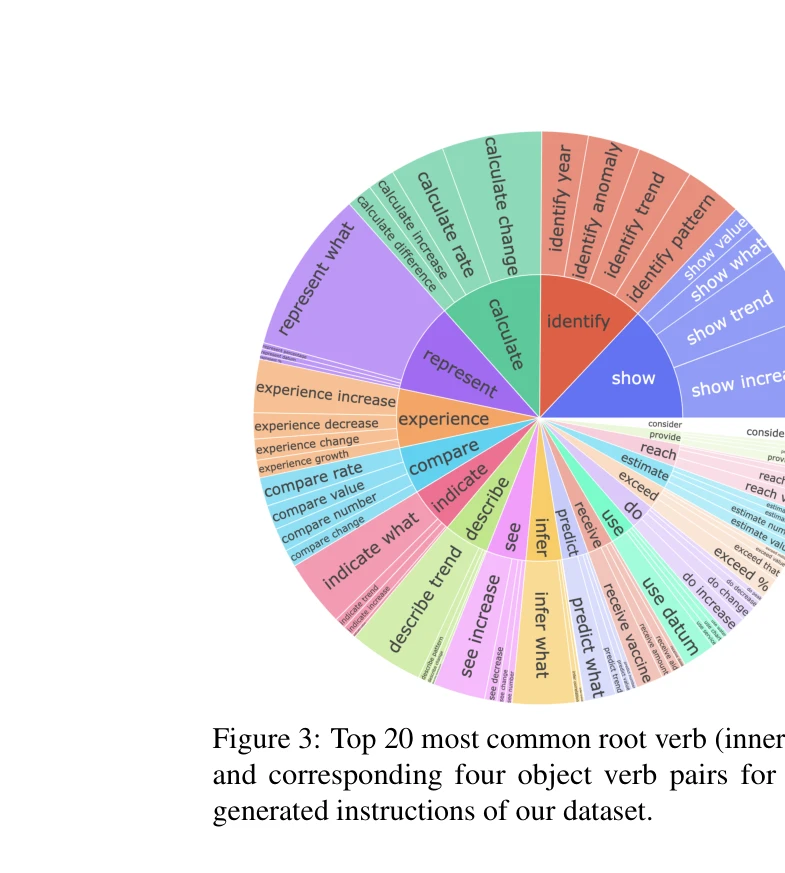

지시문의 주요 동사(Root Verb) 분포: 다양한 작업 유형을 반영하는 언어적 다양성

데이터 구성:

지시문 생성 전략:

평가:

후속 연구 방향:

총평: 본 논문은 차트 도메인에서 처음으로 대규모 지시문 튜닝 데이터셋을 구축하고 차트 특화 VLM을 개발하여 차트 이해의 일반화 능력을 획기적으로 향상시켰다는 점에서 중요한 기여를 하였으나, 자동 데이터 추출 오류, 제한된 모델 크기, 신규 작업 타당성 검증 부족 등이 개선할 점으로 남아 있다.