How

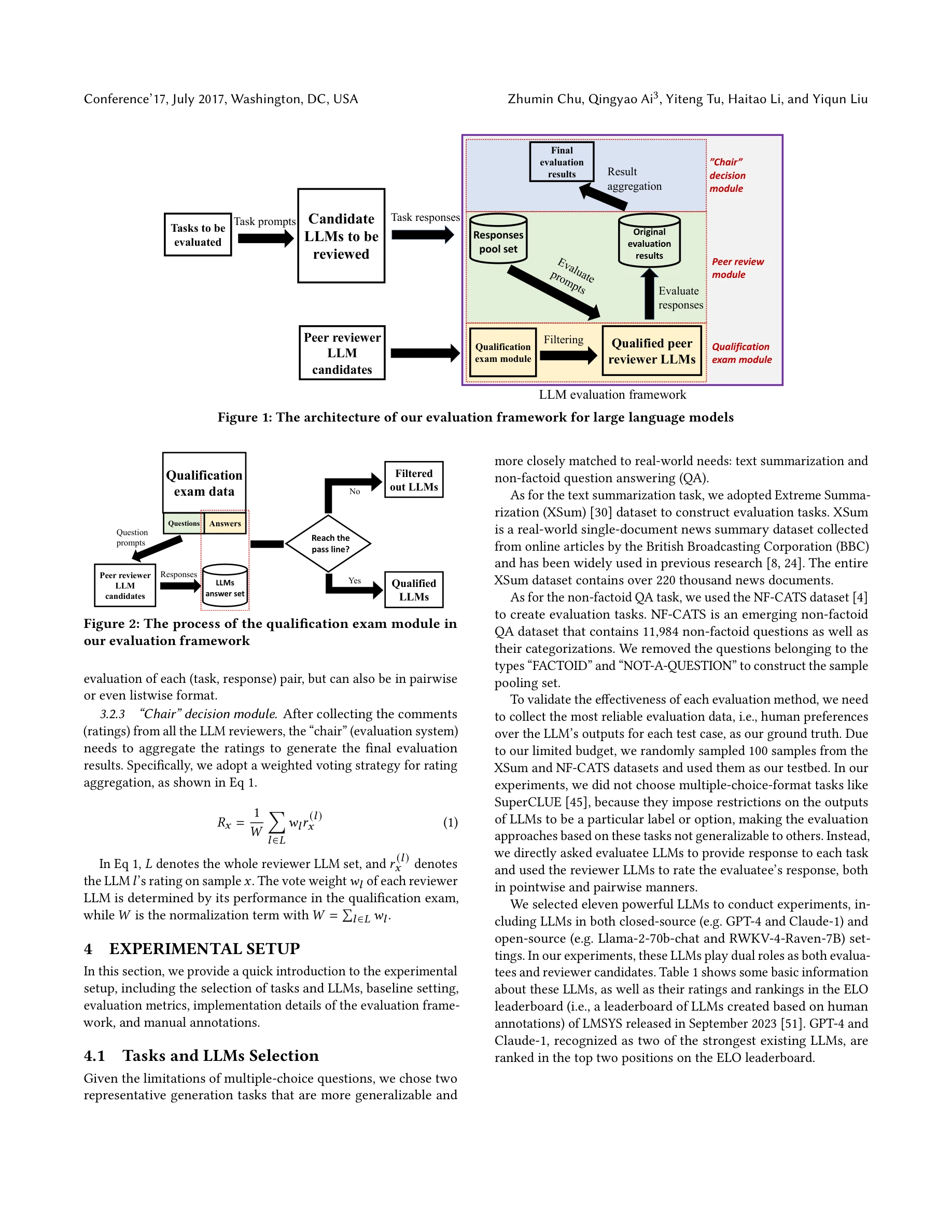

PRE의 전체 아키텍처: 자격 시험 모듈, 평가 모듈, 결과 집계 모듈로 구성

자격 시험 모듈의 과정: 평가 후보자 LLM들의 신뢰성을 사전에 검증

- 자격 시험 모듈:

- 각 평가 과제에 대해 작은 규모의 자격 시험 데이터셋 구성

- 후보 LLM들이 시험 응답 생성 및 인간 판정 결과와 비교

- 신뢰도 임계값 이상의 LJM만 최종 평가자로 선정

- 평가 모듈:

- 선별된 평가자 LLM들이 후보 LLM들의 응답에 대해 점수 부여 또는 쌍별 비교(pairwise comparison) 수행

- 평가자별 평가 결과는 정형화된 프롬프트를 통해 수집

- 결과 집계 모듈:

- 모든 평가자의 점수 또는 선호도 결과를 집계

- ELO 레이팅 시스템 등의 방법으로 최종 순위 도출

- 개별 평가자의 편향이 상쇄되도록 설계

- 다양한 PRE 변형: Figure 4에서 여러 집계 전략(평균, 중앙값, 투표 등)의 성능 비교