Essence

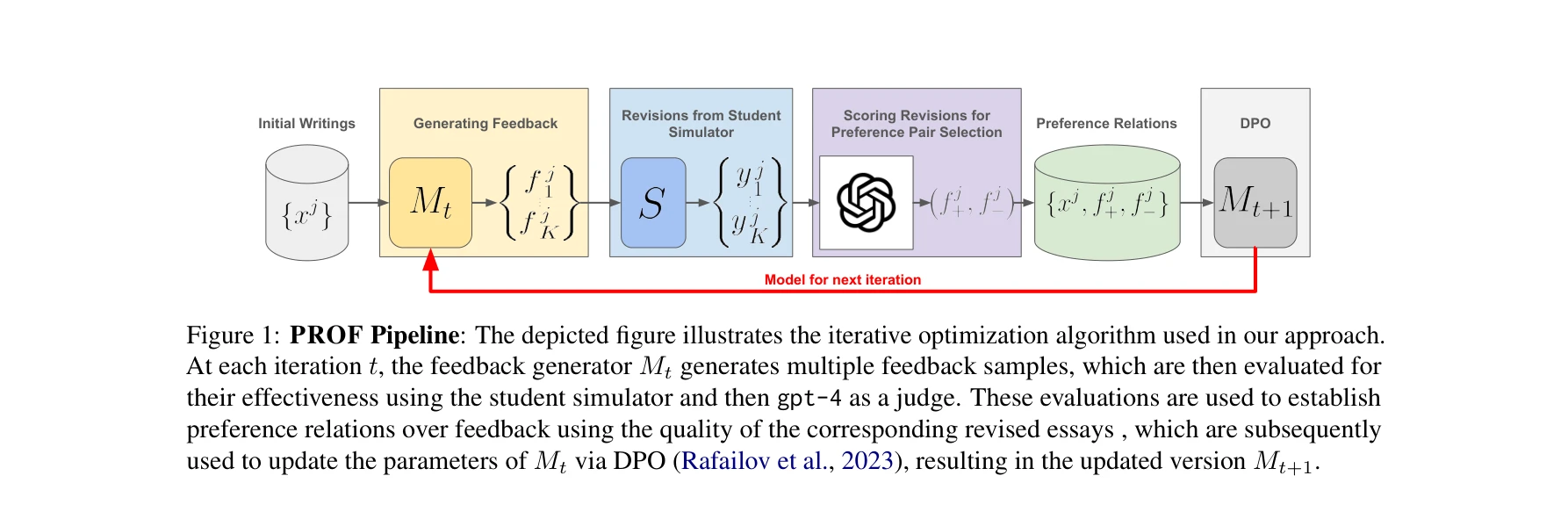

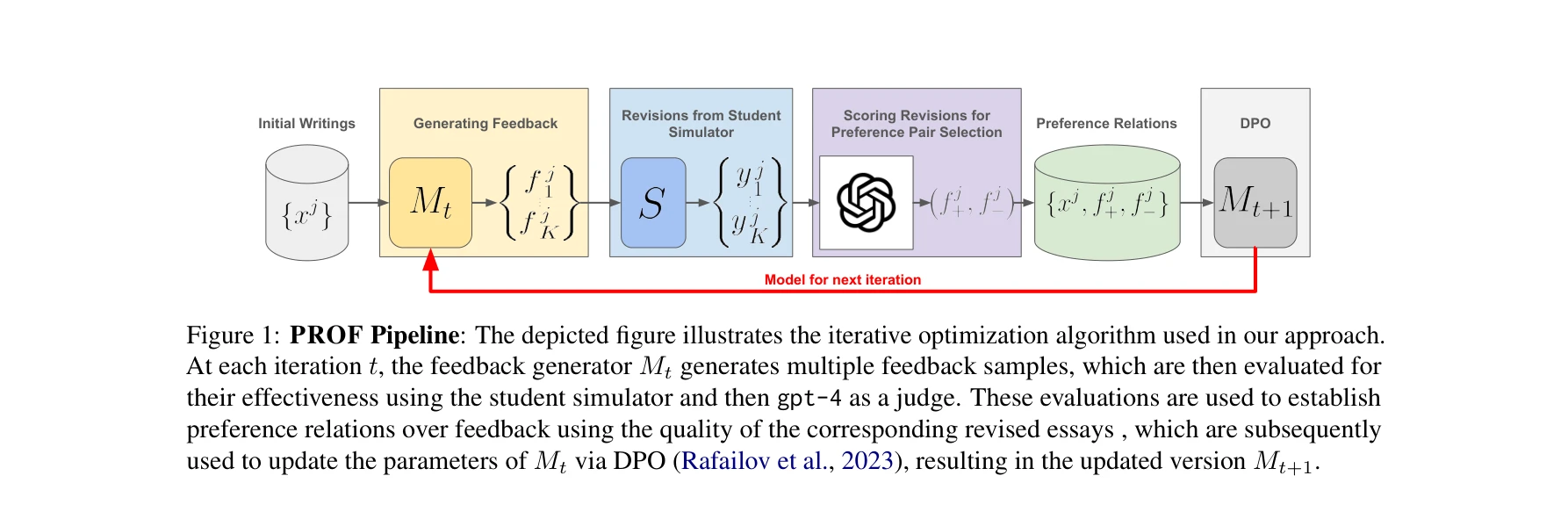

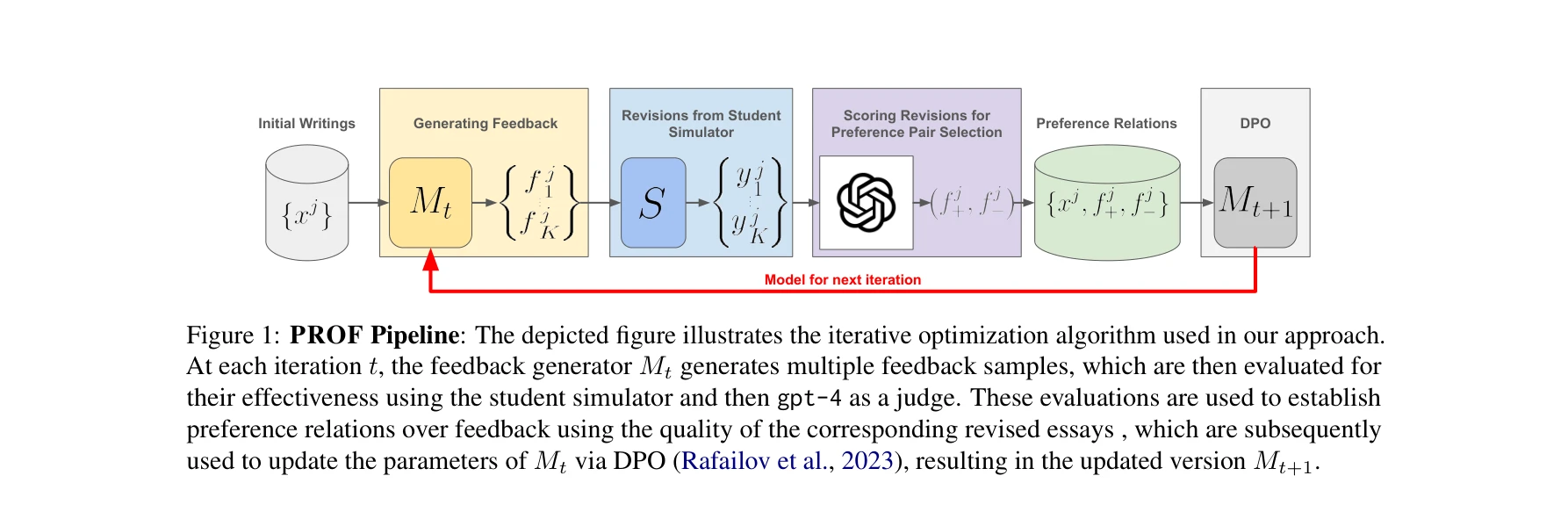

PROF 파이프라인: 피드백 생성기가 여러 피드백을 샘플링하고, 학생 시뮬레이터를 통해 수정 결과를 평가하며, 선호도 관계를 기반으로 DPO를 통해 반복적으로 최적화되는 과정

본 논문은 언어 모델 기반 학생 시뮬레이터를 활용하여 작문 피드백 생성 모델(PROF)을 반복적으로 최적화하는 방법을 제안한다. 실제 학생 참여 없이 피드백의 실효성을 직접 측정하고 개선할 수 있는 자동화된 시스템을 구축한다.

저자: Inderjeet Nair, Jiaye Tan, Xiaotian Su, Anne Gere, Xu Wang, Lu Wang | 날짜: 2024 | DOI: arXiv:2410.08058

PROF 파이프라인: 피드백 생성기가 여러 피드백을 샘플링하고, 학생 시뮬레이터를 통해 수정 결과를 평가하며, 선호도 관계를 기반으로 DPO를 통해 반복적으로 최적화되는 과정

본 논문은 언어 모델 기반 학생 시뮬레이터를 활용하여 작문 피드백 생성 모델(PROF)을 반복적으로 최적화하는 방법을 제안한다. 실제 학생 참여 없이 피드백의 실효성을 직접 측정하고 개선할 수 있는 자동화된 시스템을 구축한다.

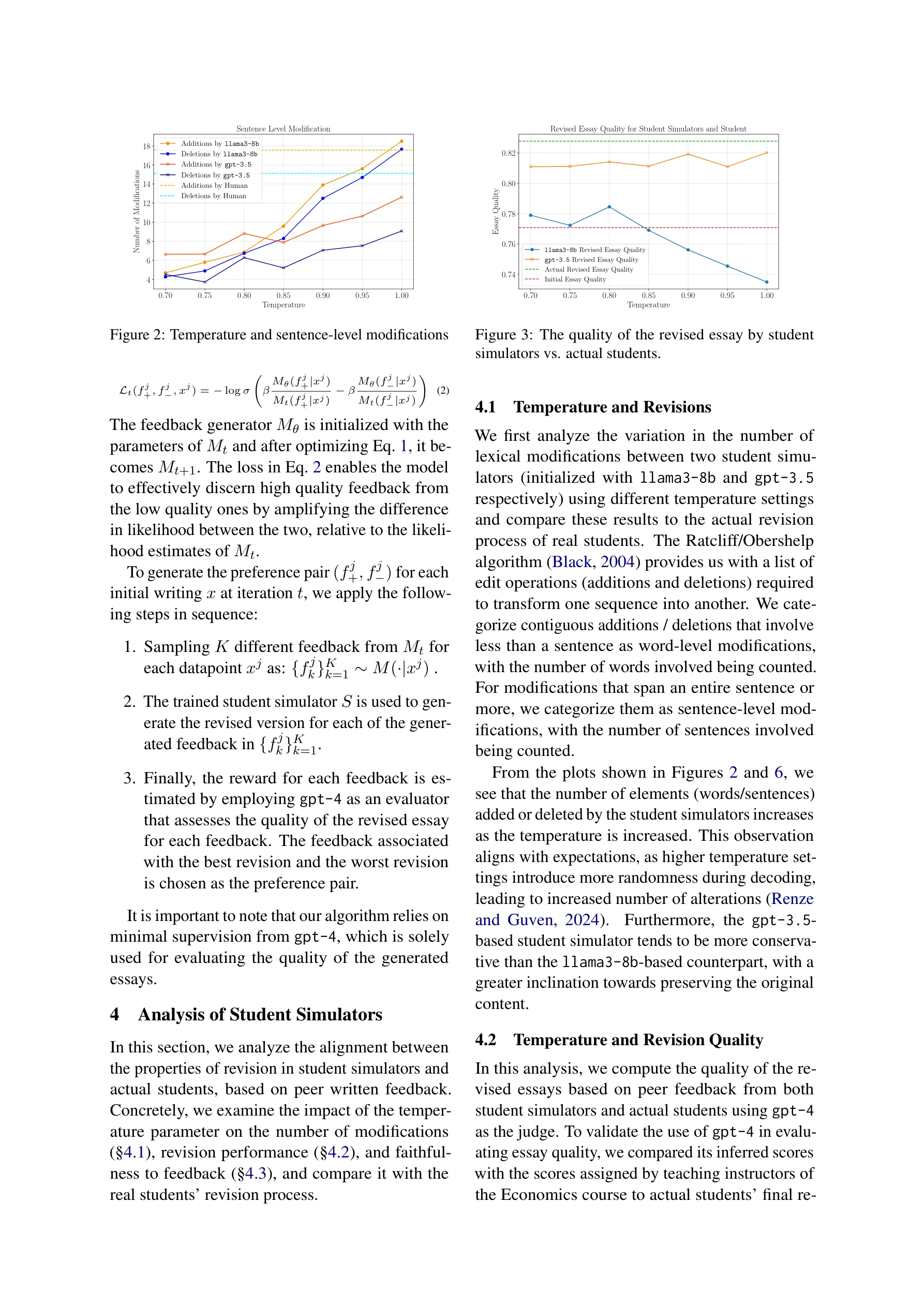

온도 변화에 따른 문장 수준의 수정 수 변화: llama3-8b와 gpt-3.5 모두 온도가 증가할수록 추가와 삭제가 증가하며, 실제 학생과 유사한 패턴을 보임

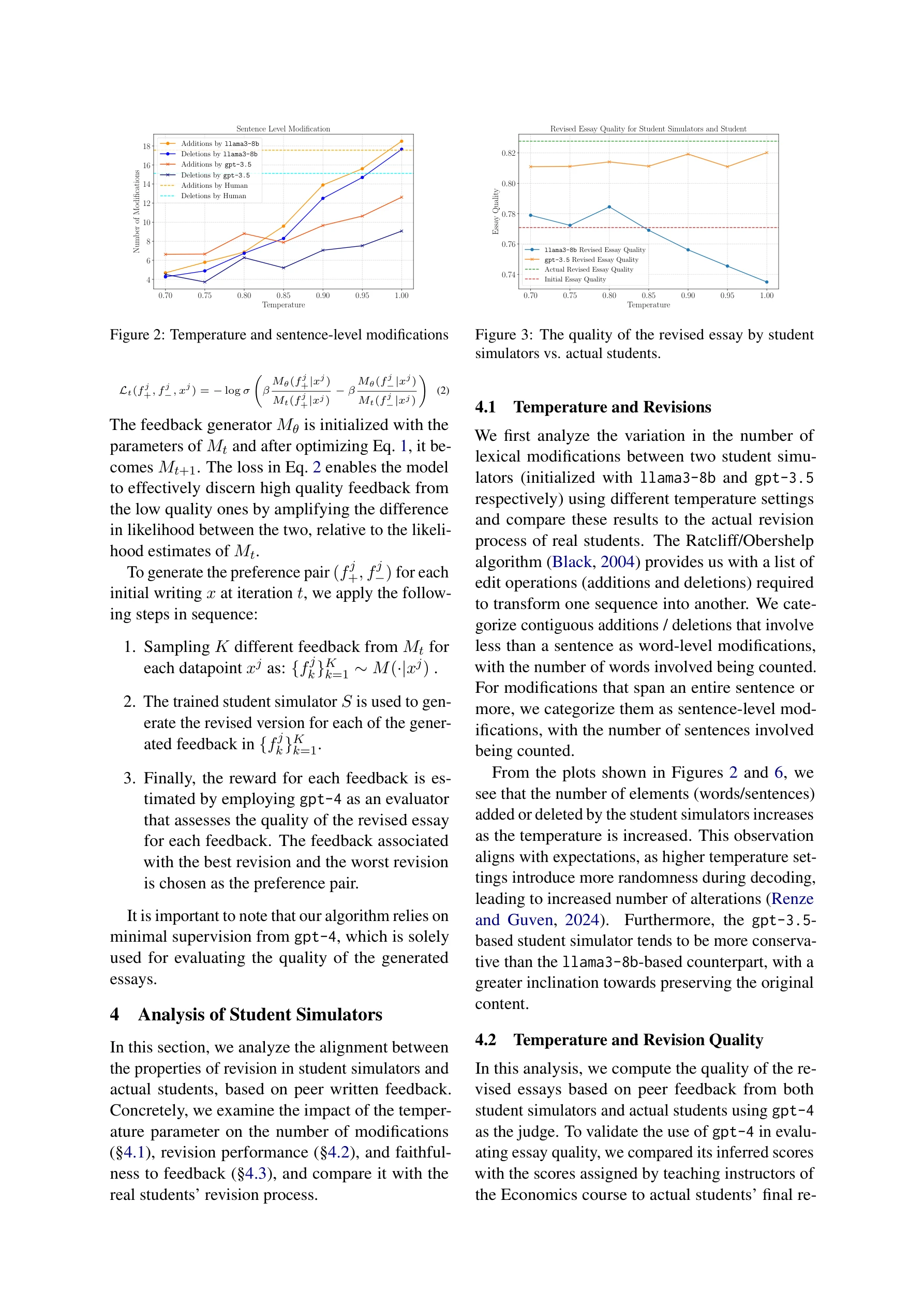

수정된 에세이 품질 비교: 학생 시뮬레이터들의 성능이 실제 학생과 유사한 궤적을 따르며, 초기 에세이 품질 대비 개선도를 확인

반복적 최적화 파이프라인의 상세 프로세스

총평: 본 논문은 LM 시뮬레이터를 활용하여 피드백 생성을 반복적으로 최적화하는 창의적 방법론을 제시하며, 기존 대형 모델을 능가하는 효율적이고 효과적인 시스템을 구현했다. 다만 단일 과제 검증과 실제 학생 참여 평가 부재가 실제 교육 현장으로의 전환 가능성을 제한한다.