Essence

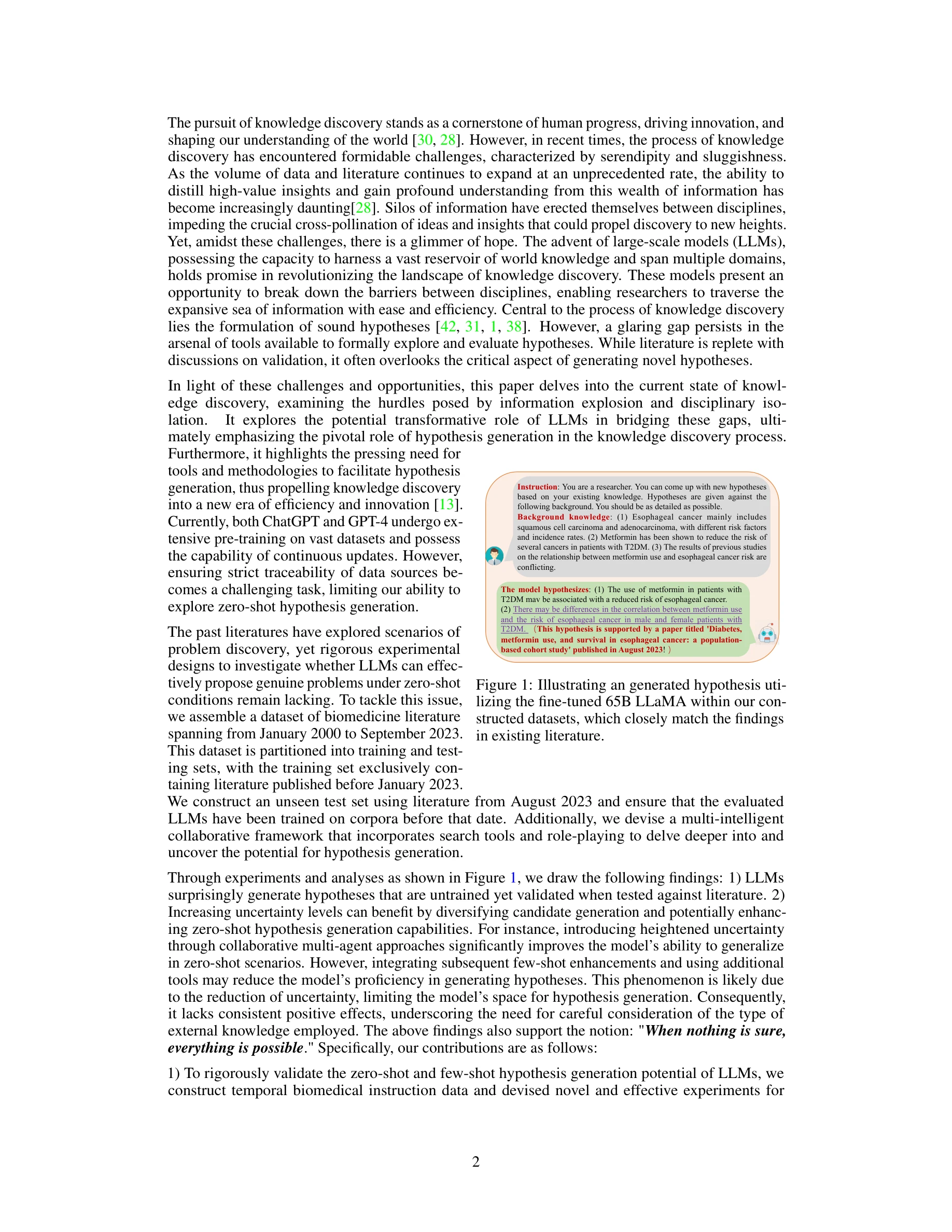

그림 1: 미세조정된 65B LLaMA 모델이 생성한 가설의 예시로, 기존 문헌의 발견과 유사한 결과를 도출함

대규모언어모델(LLM)이 학습되지 않은 과학 가설을 제시할 수 있으며, 생성된 가설이 실제 출판된 문헌과 일치하는 검증 가능한 내용임을 입증하는 연구이다. 특히 불확실성 증가가 영점 학습(zero-shot) 가설 생성 능력을 향상시킨다는 발견을 제시한다.

저자: Biqing Qi, Kaiyan Zhang, Haoxiang Li, Kai Tian, Sihang Zeng | 날짜: 2023 | DOI: 10.48550/arXiv.2311.05965

그림 1: 미세조정된 65B LLaMA 모델이 생성한 가설의 예시로, 기존 문헌의 발견과 유사한 결과를 도출함

대규모언어모델(LLM)이 학습되지 않은 과학 가설을 제시할 수 있으며, 생성된 가설이 실제 출판된 문헌과 일치하는 검증 가능한 내용임을 입증하는 연구이다. 특히 불확실성 증가가 영점 학습(zero-shot) 가설 생성 능력을 향상시킨다는 발견을 제시한다.

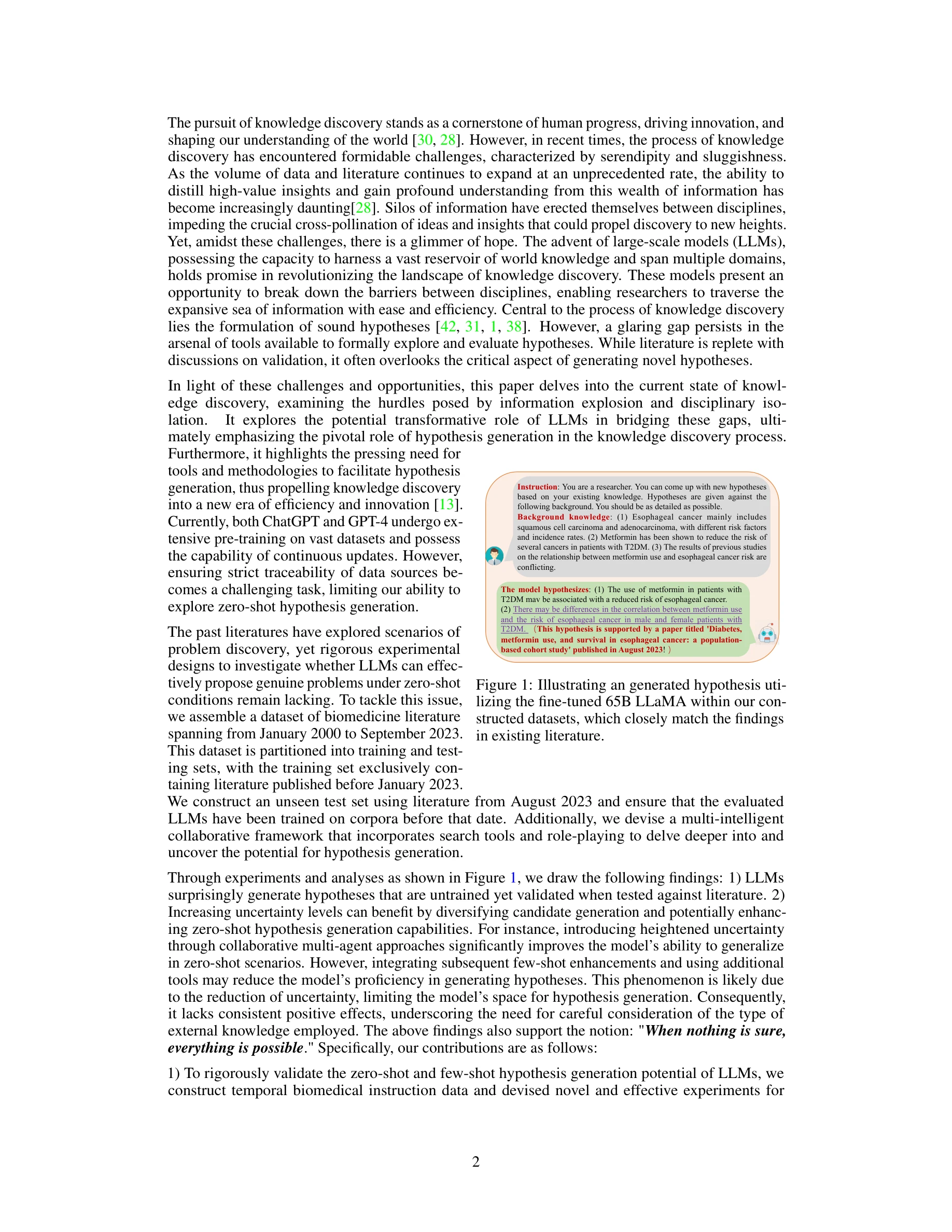

그림 2: 과학 발견의 반복적 순환 고리 - 데이터 분석, 가설 생성, 실험 설계, 실행, 관찰 축적

그림 3: 데이터 분할 파이프라인 - 2023년 1월 기준으로 훈련/테스트 데이터 분리

총평: 본 논문은 LLM의 과학적 가설 생성 능력을 형식적으로 검증하는 선구적 연구로, 시간 기반 데이터셋 분할과 불확실성의 긍정적 역할이라는 흥미로운 발견을 제시한다. 그러나 평가 메트릭의 정의 부족, 생의학 도메인 한정, 그리고 실제 과학적 유효성 검증의 미흡함으로 인해 기술적 완성도가 다소 낮으며, 추가적인 실험과 엄밀한 분석이 필요하다.