Essence

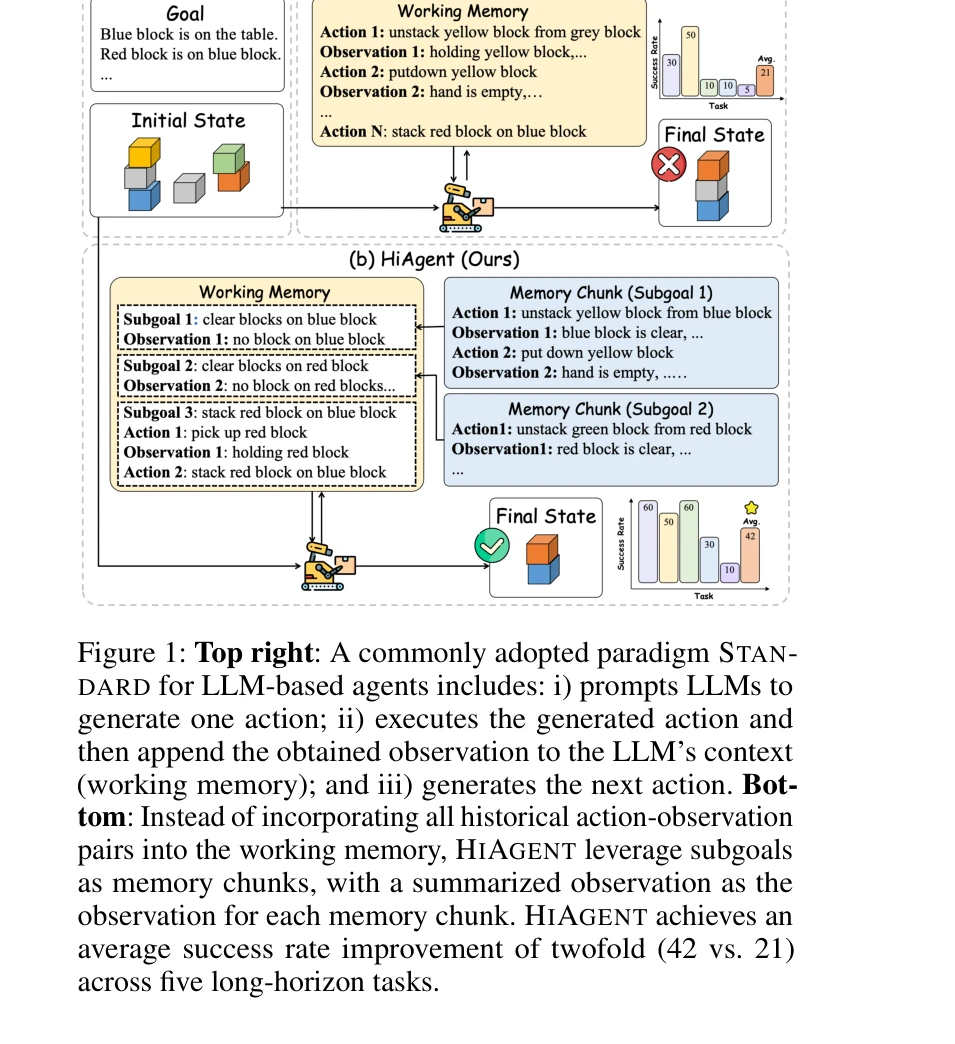

STANDARD 패러다임과 HiAgent의 작업 메모리 관리 비교

대규모 언어 모델(LLM) 기반 에이전트의 장기 작업 수행을 위해, 인지과학의 청킹(chunking) 원리에 영감을 받아 부분목표(subgoal)를 메모리 청크로 활용한 계층적 작업 메모리 관리 프레임워크를 제시한다. 기존 방식의 모든 행동-관찰 쌍을 컨텍스트에 포함하는 방식을 개선하여 작업 메모리 중복성을 제거한다.

저자: Mengkang Hu, Tianxing Chen, Qiguang Chen, Yao Mu, Wenqi Shao, Ping Luo | 날짜: 2024 | DOI: arXiv:2408.09559

STANDARD 패러다임과 HiAgent의 작업 메모리 관리 비교

대규모 언어 모델(LLM) 기반 에이전트의 장기 작업 수행을 위해, 인지과학의 청킹(chunking) 원리에 영감을 받아 부분목표(subgoal)를 메모리 청크로 활용한 계층적 작업 메모리 관리 프레임워크를 제시한다. 기존 방식의 모든 행동-관찰 쌍을 컨텍스트에 포함하는 방식을 개선하여 작업 메모리 중복성을 제거한다.

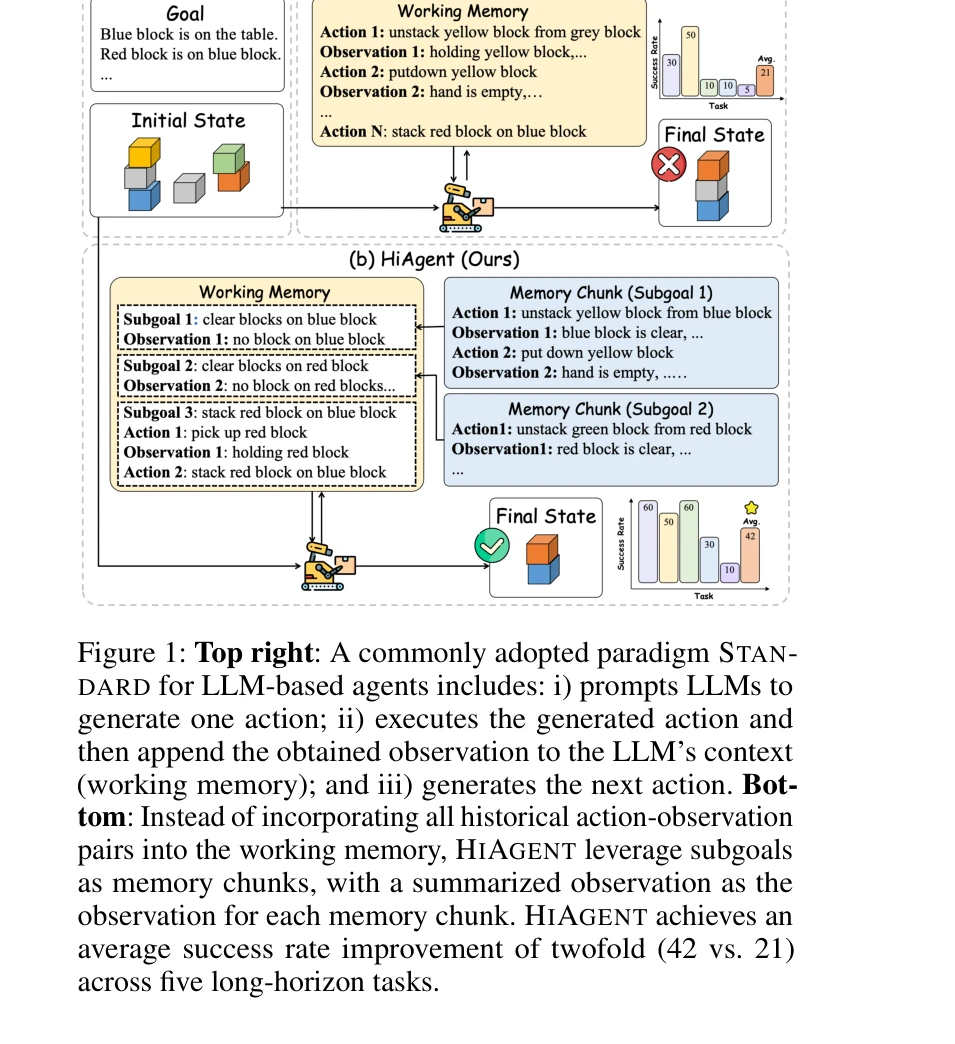

HiAgent의 계층적 작업 메모리 관리 프로세스

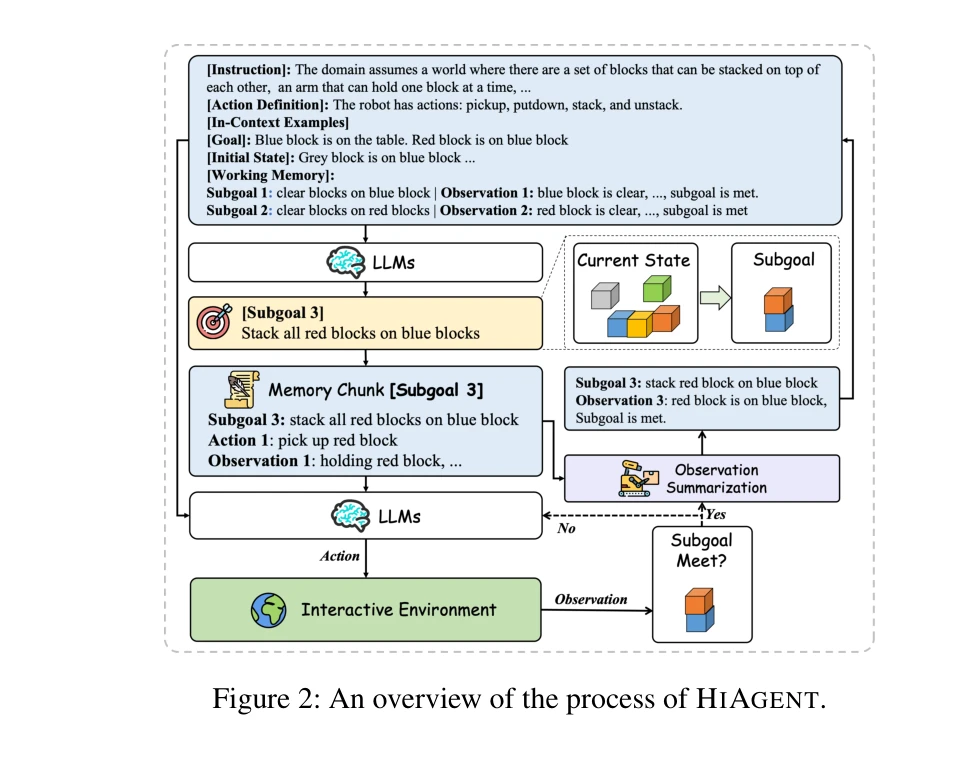

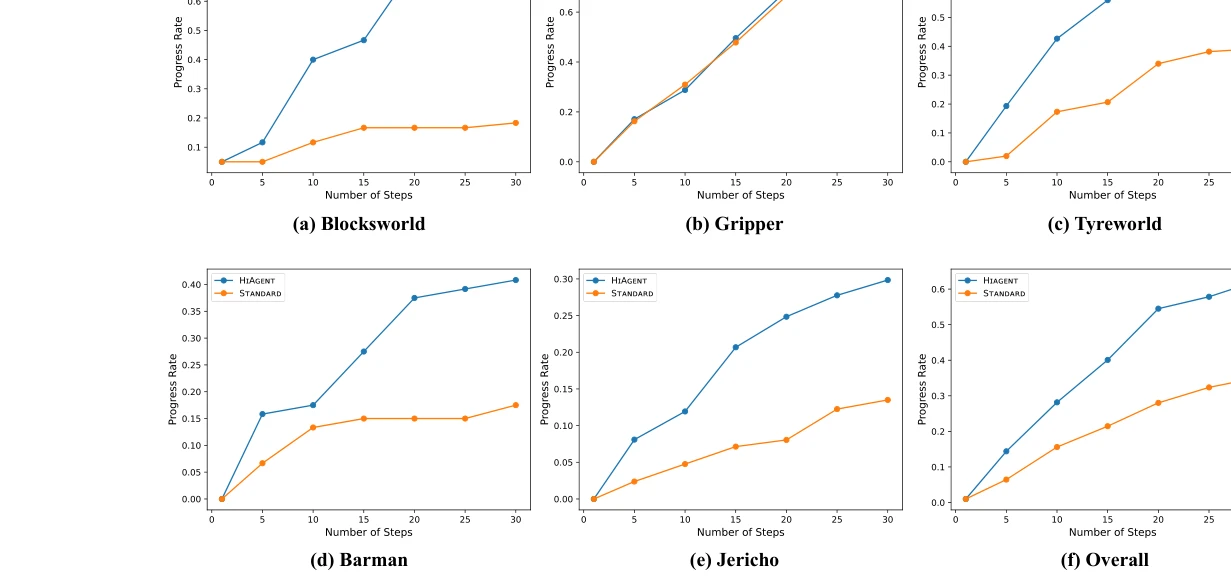

서로 다른 단계에서의 진행률 비교

총평: 인간의 인지 메커니즘에 영감을 받아 계층적 작업 메모리 관리로 LLM 에이전트의 장기 작업 성능을 실질적으로 향상시킨 실용적이고 효과적인 연구이다. 다만 부분목표 자동 생성과 요약 전략의 상세 기술화 및 더 광범위한 평가 확대가 필요하다.