Achievement

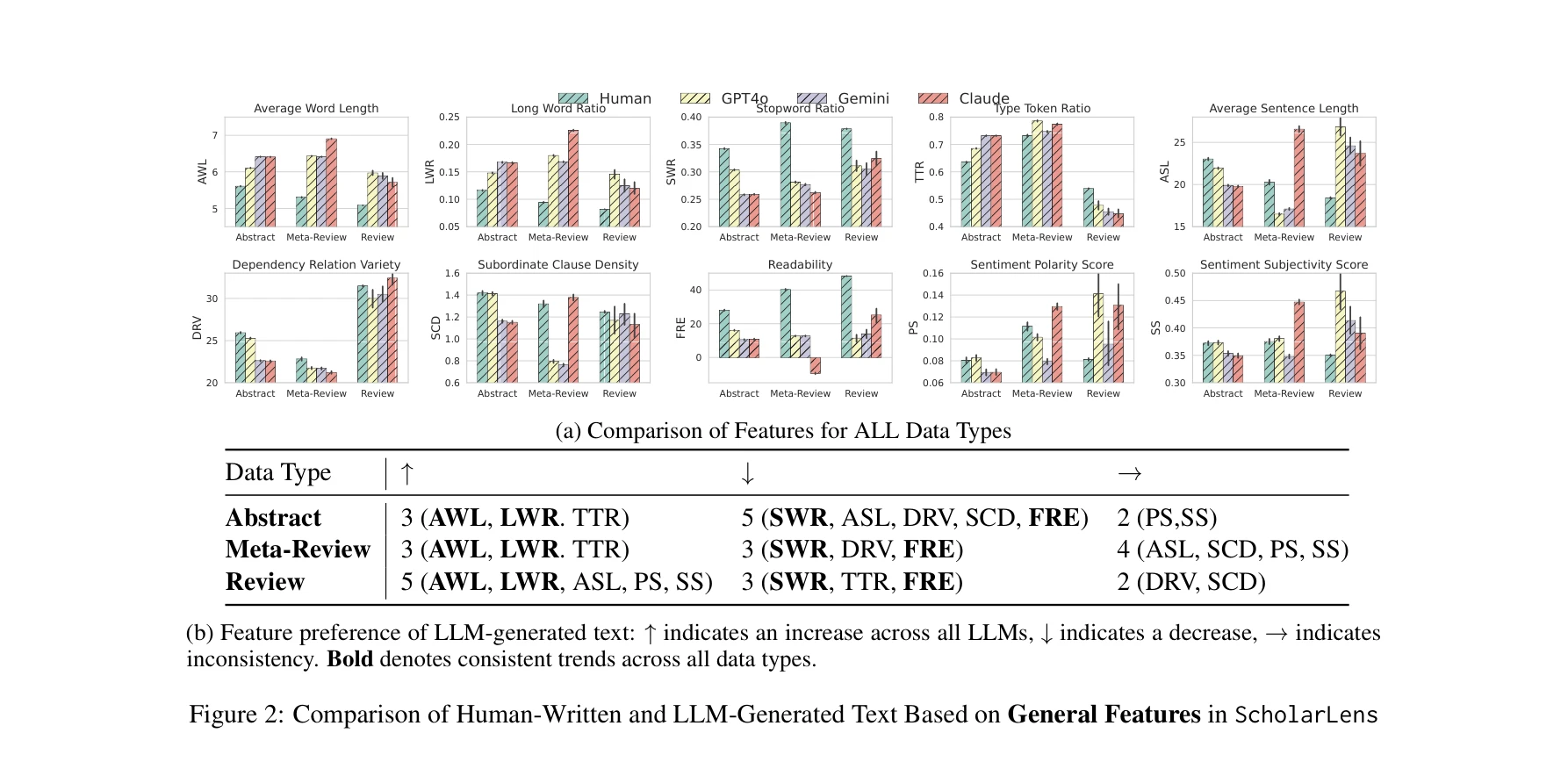

파이프라인 개요: (1) ScholarLens 큐레이션, (2) LLMetrica 프레임워크, (3) 학술 저술 및 피어 프로세스의 LLM 침투율 평가

- ScholarLens 데이터셋 구축: ICLR 2019년 이전 2,831개 논문의 초록, 리뷰, 메타-리뷰로 구성된 큐레이션 데이터셋 개발. GPT-4o, Gemini-1.5, Claude-3 Opus 등 3개의 최신 LLM으로 생성된 대응 텍스트 포함.

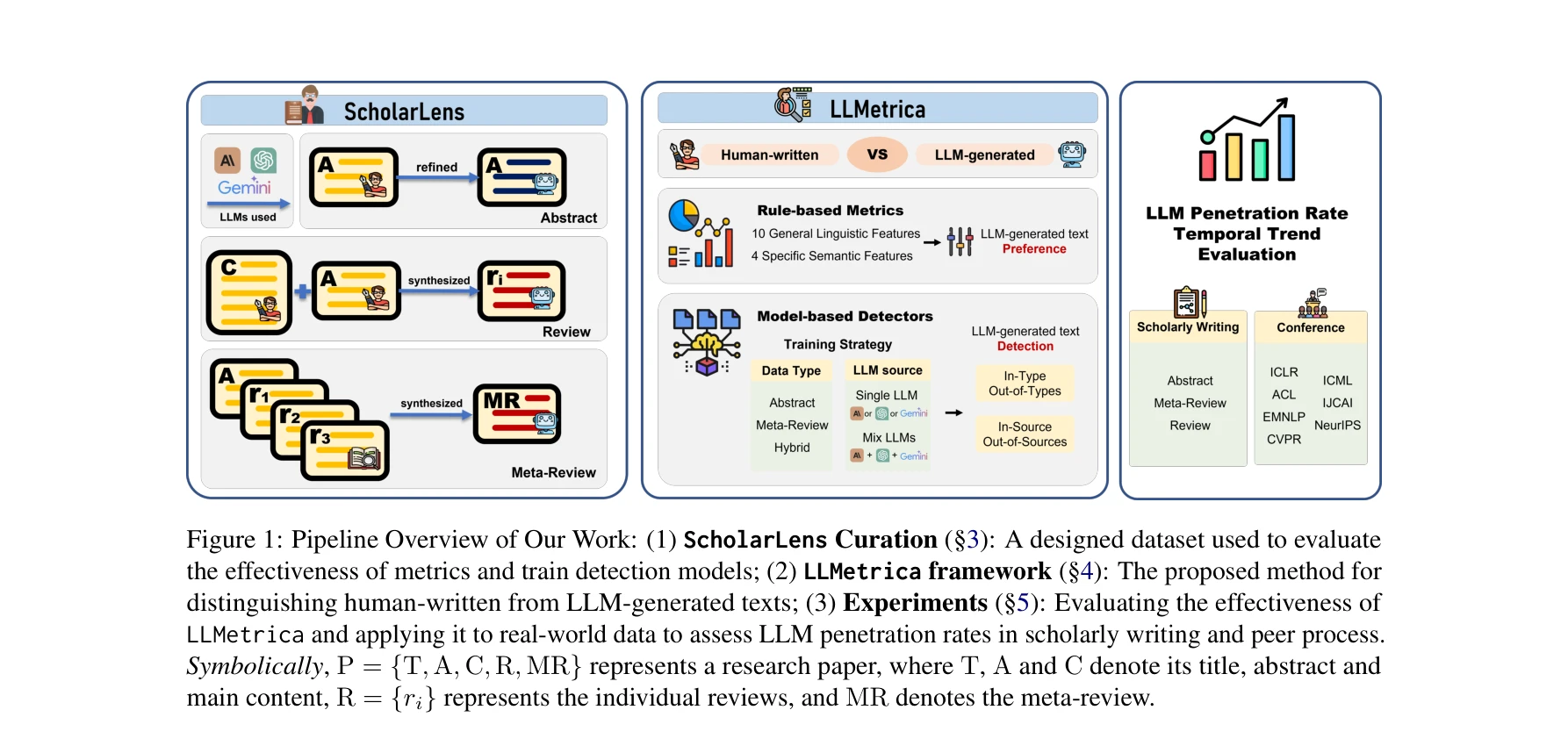

- LLMetrica 프레임워크 개발: 10개의 일반 언어학적 특성 지표(어휘 길이, 문장 복잡도, 가독성 등)와 4개의 전문 의미론적 특성 지표(의미적 유사성, 문장 수준 특수성)를 통합한 종합 평가 도구 개발.

- ScholarDetect 탐지기: ScholarLens를 기반으로 학술 영역 특화 LLM 탐지 모델 개발로 높은 정확도의 LLM 생성 콘텐츠 식별 달성.