Essence

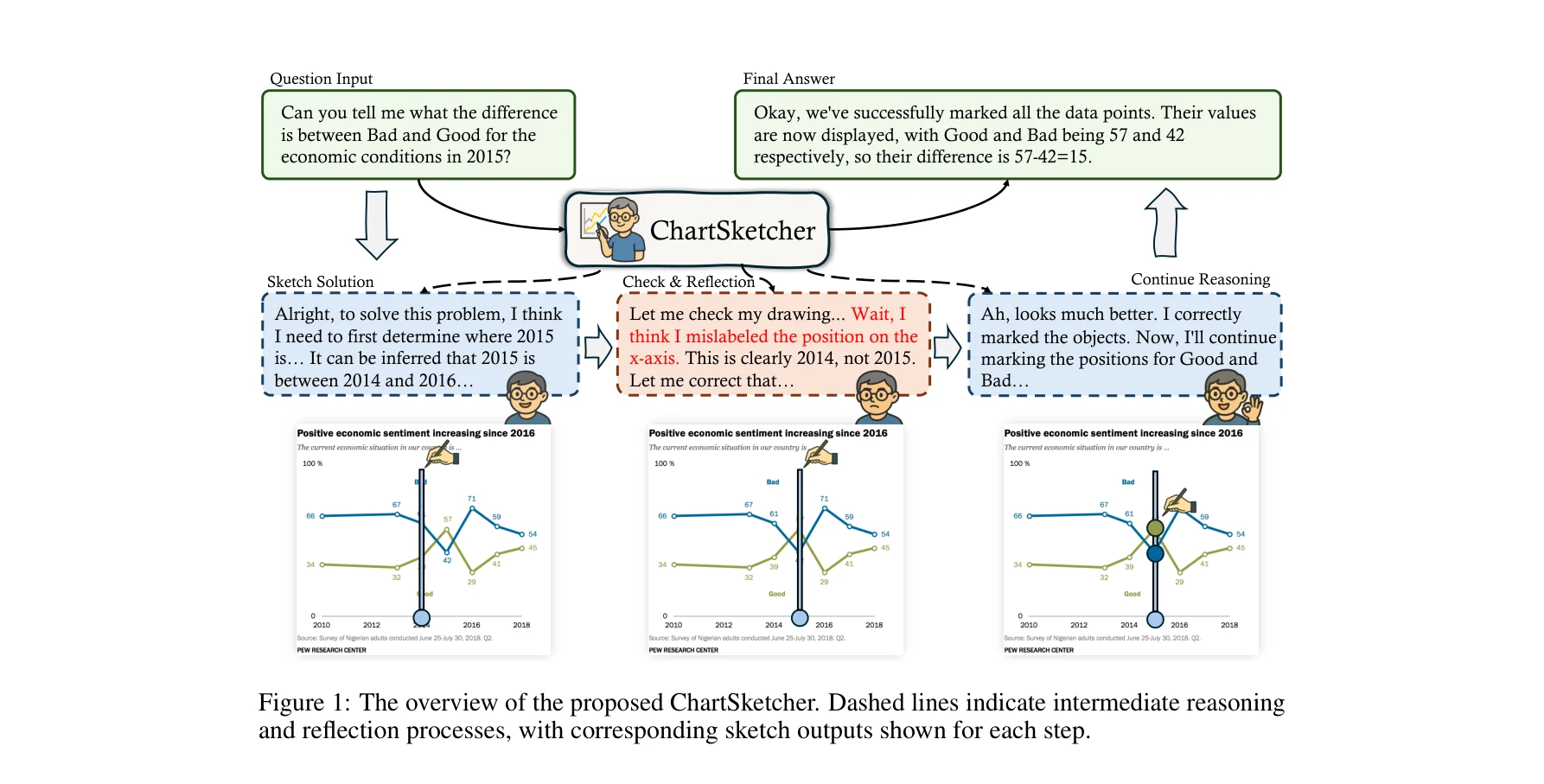

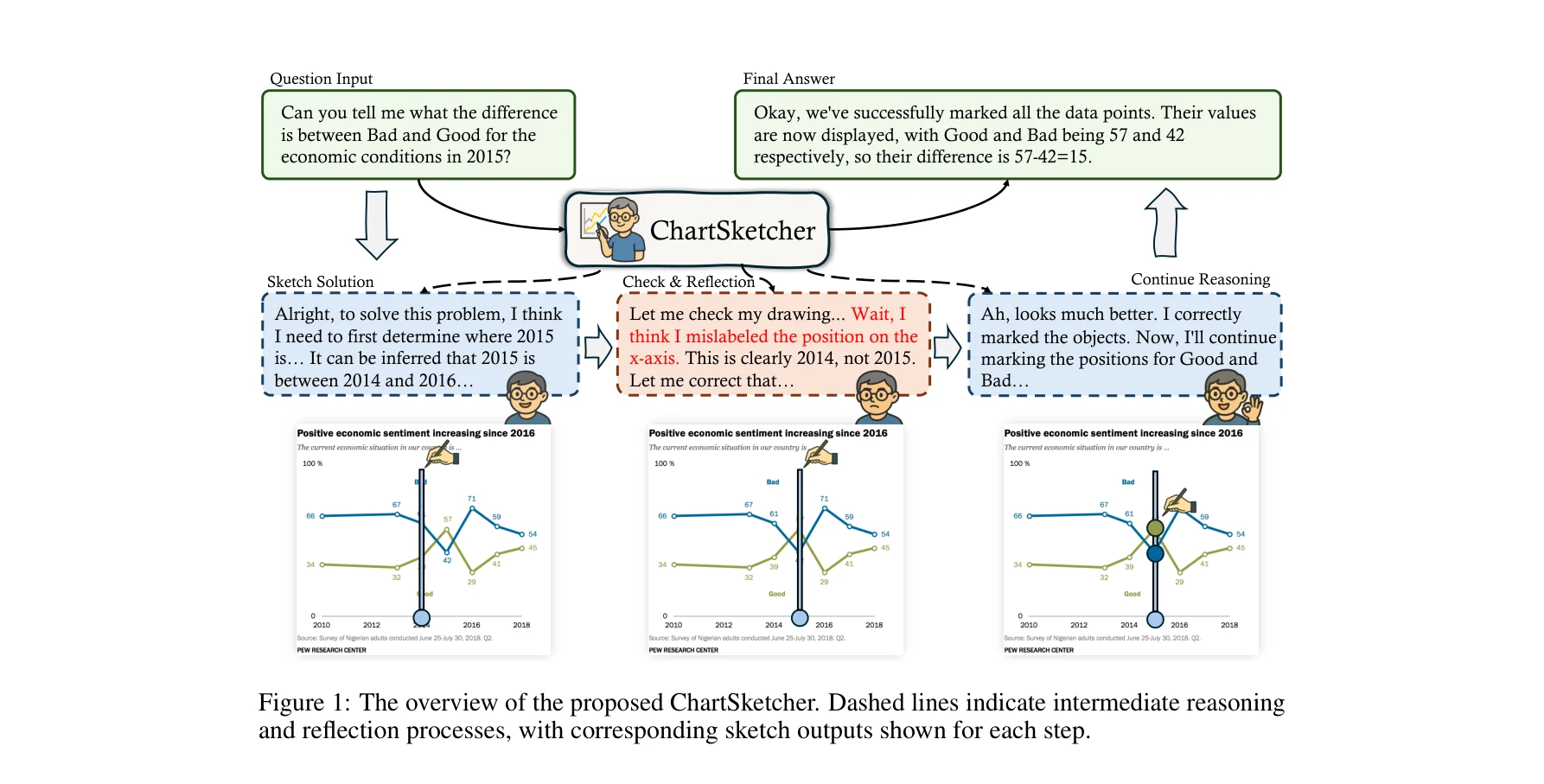

ChartSketcher의 개요: 중간 추론 및 반성 과정(점선)과 각 단계의 스케치 출력

본 논문은 멀티모달 대규모 언어 모델(MLLM)이 차트를 이해할 때 시각적 피드백을 통한 반복적 스케칭(Sketch-CoT)으로 추론 과정을 개선하는 방법을 제안한다. 인간의 인지 행동에서 영감을 받아, 모델이 중간 추론 단계를 차트에 직접 주석 처리하고 이를 다시 입력으로 제공하여 멀티모달 상호작용을 통한 깊이 있는 이해를 실현한다.

저자: Muye Huang, Lingling Zhang, Jie Ma, Han Lai, Fangzhi Xu, Yifei Li, Wenjun Wu, Yaqiang Wu, Jun Liu | 날짜: 2025 | DOI: arXiv:2505.19076

ChartSketcher의 개요: 중간 추론 및 반성 과정(점선)과 각 단계의 스케치 출력

본 논문은 멀티모달 대규모 언어 모델(MLLM)이 차트를 이해할 때 시각적 피드백을 통한 반복적 스케칭(Sketch-CoT)으로 추론 과정을 개선하는 방법을 제안한다. 인간의 인지 행동에서 영감을 받아, 모델이 중간 추론 단계를 차트에 직접 주석 처리하고 이를 다시 입력으로 제공하여 멀티모달 상호작용을 통한 깊이 있는 이해를 실현한다.

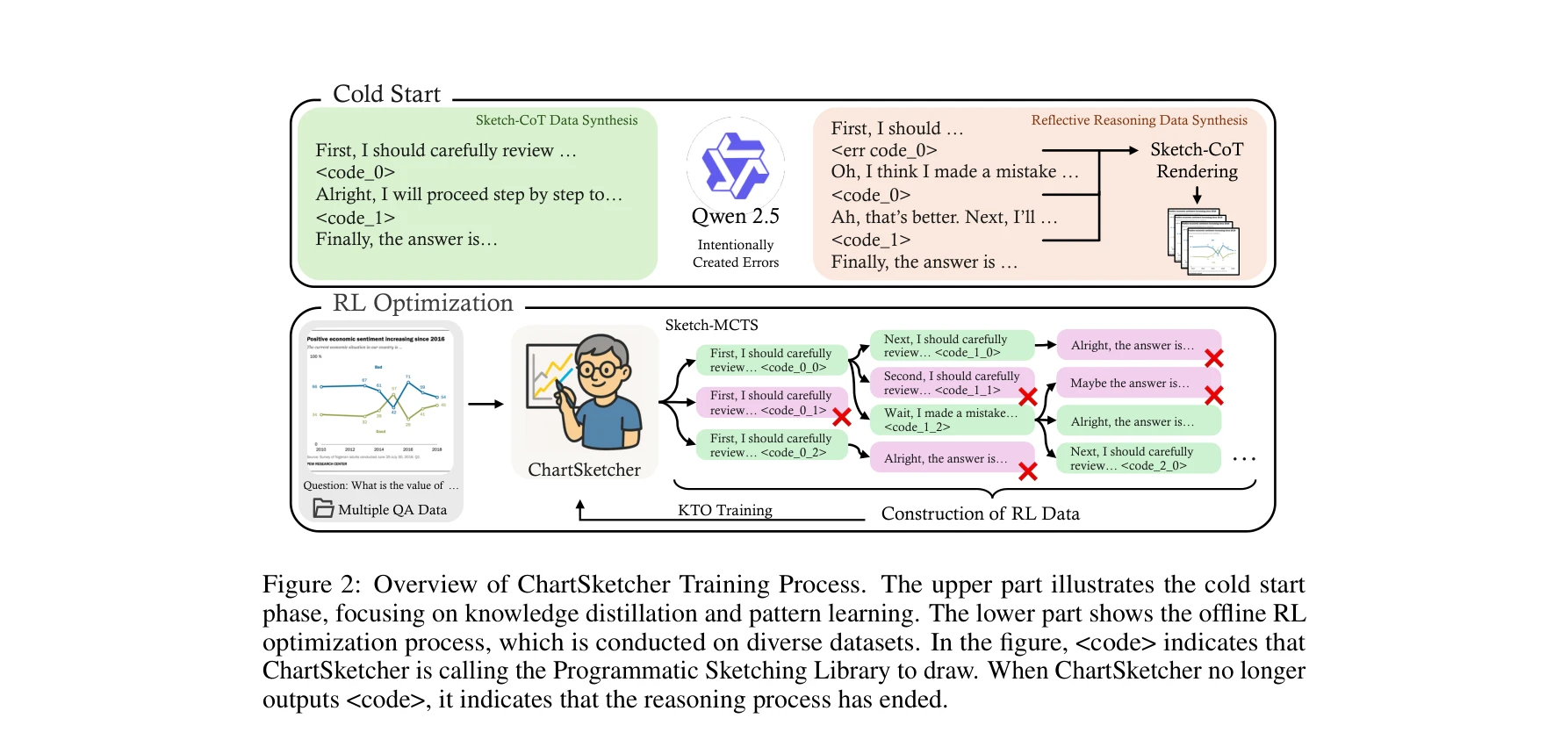

ChartSketcher 훈련 과정: 상단은 콜드 스타트 단계(지식 증류), 하단은 오프라인 강화학습 최적화

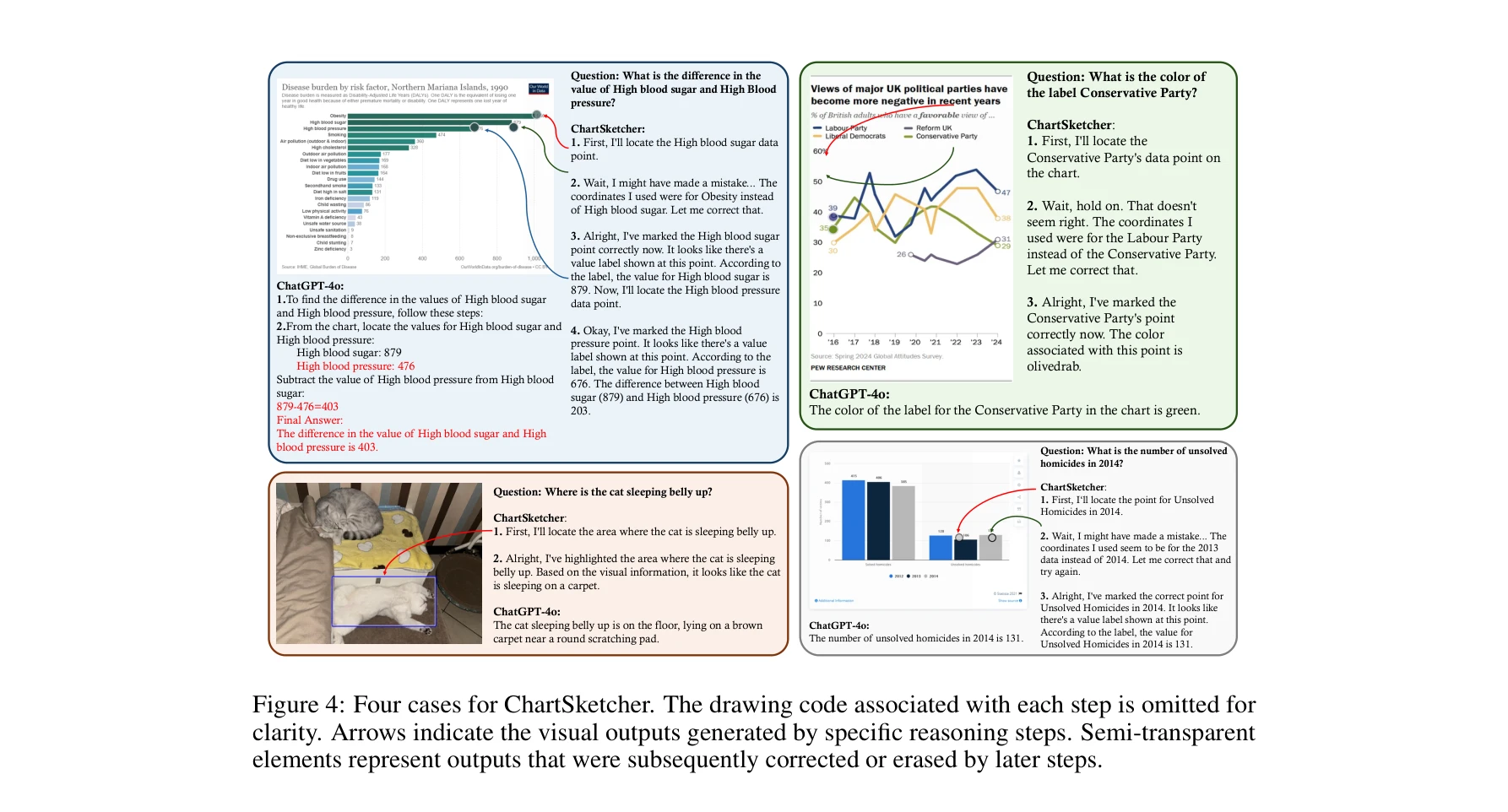

ChartSketcher의 네 가지 사례: 각 단계의 드로잉 코드는 생략

아키텍처 설계:

훈련 방식:

총평: ChartSketcher는 인간의 시각적 추론 행동에서 영감을 받아 MLLM의 차트 이해 능력을 향상시키는 혁신적 방법론을 제시하며, 체계적인 데이터 구축과 두 단계 훈련 전략으로 실증적 효과를 입증했으나, 계산 효율성과 프로그래밍 오버헤드 문제에 대한 충분한 분석이 필요하다.