Achievement

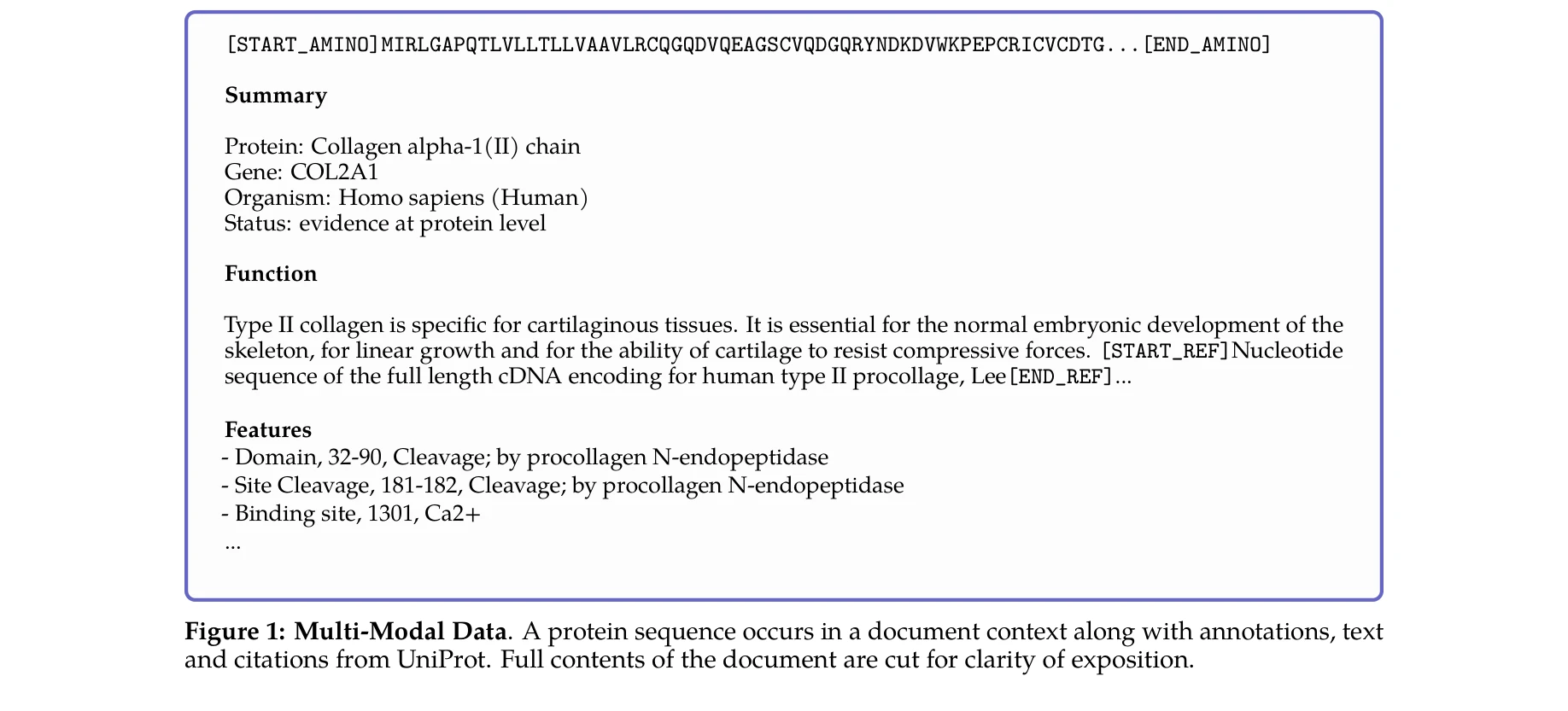

표 1: 과학 데이터의 토큰화 - 텍스트, LaTeX, 코드, SMILES, 아미노산 서열, DNA 서열 등을 통합

- 기술 지식 작업 우수성

- LaTeX 방정식: 68.2% (vs GPT-3 49.0%)

- 화학 반응 및 IUPAC 이름 예측 우수

- 추론 작업 성능

- 수학 MMLU: 41.3% (vs Chinchilla 35.7%)

- MATH: 20.4% (120B 모델, vs PaLM 540B 8.8%, 매개변수 18배 적음)

- 하위 작업(downstream task) 최신 기술(SOTA)

- PubMedQA: 77.6%

- MedMCQA dev: 52.9%

- BIG-bench: 일반 코퍼스 미학습에도 BLOOM, OPT-175B 초과

- 새로운 능력 시연

- 인용 예측이 스케일에 따라 매끄럽게 증가, 희소/밀집 검색 방식 초과

- 약감시 학습(weakly-supervised)으로 약물 발견 작업 수행

- 자감시 학습으로 기능 그룹(functional groups) 같은 해석 가능한 속성 학습