Essence

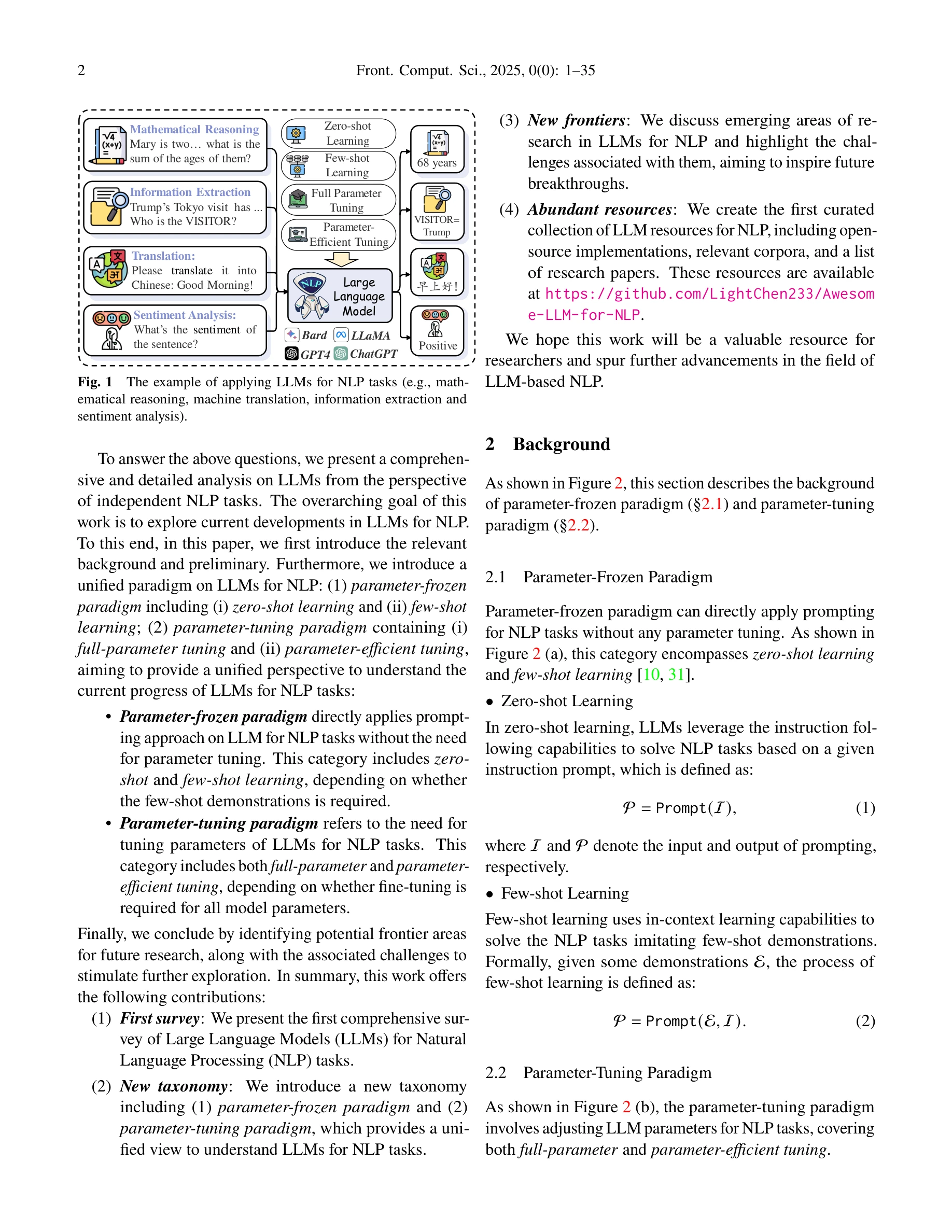

다양한 NLP 작업에 LLM 적용 예시 (수학적 추론, 기계 번역, 정보 추출, 감정 분석)

본 논문은 ChatGPT와 같은 대규모 언어모델(LLM)의 자연언어처리(NLP) 분야 응용을 체계적으로 조사한 첫 종합 서베이로, LLM이 기존 NLP 작업을 어떻게 해결하고 있으며 앞으로의 전망은 무엇인지를 다룬다.

저자: Libo Qin, Qiguang Chen, Xiachong Feng, Yang Wu, Yongheng Zhang, Yinghui Li, Min Li, Wanxiang Che, Philip S. Yu | 날짜: 2025 | DOI: https://doi.org/10.1007/sxxxxx-yyy-zzzz-1

다양한 NLP 작업에 LLM 적용 예시 (수학적 추론, 기계 번역, 정보 추출, 감정 분석)

본 논문은 ChatGPT와 같은 대규모 언어모델(LLM)의 자연언어처리(NLP) 분야 응용을 체계적으로 조사한 첫 종합 서베이로, LLM이 기존 NLP 작업을 어떻게 해결하고 있으며 앞으로의 전망은 무엇인지를 다룬다.

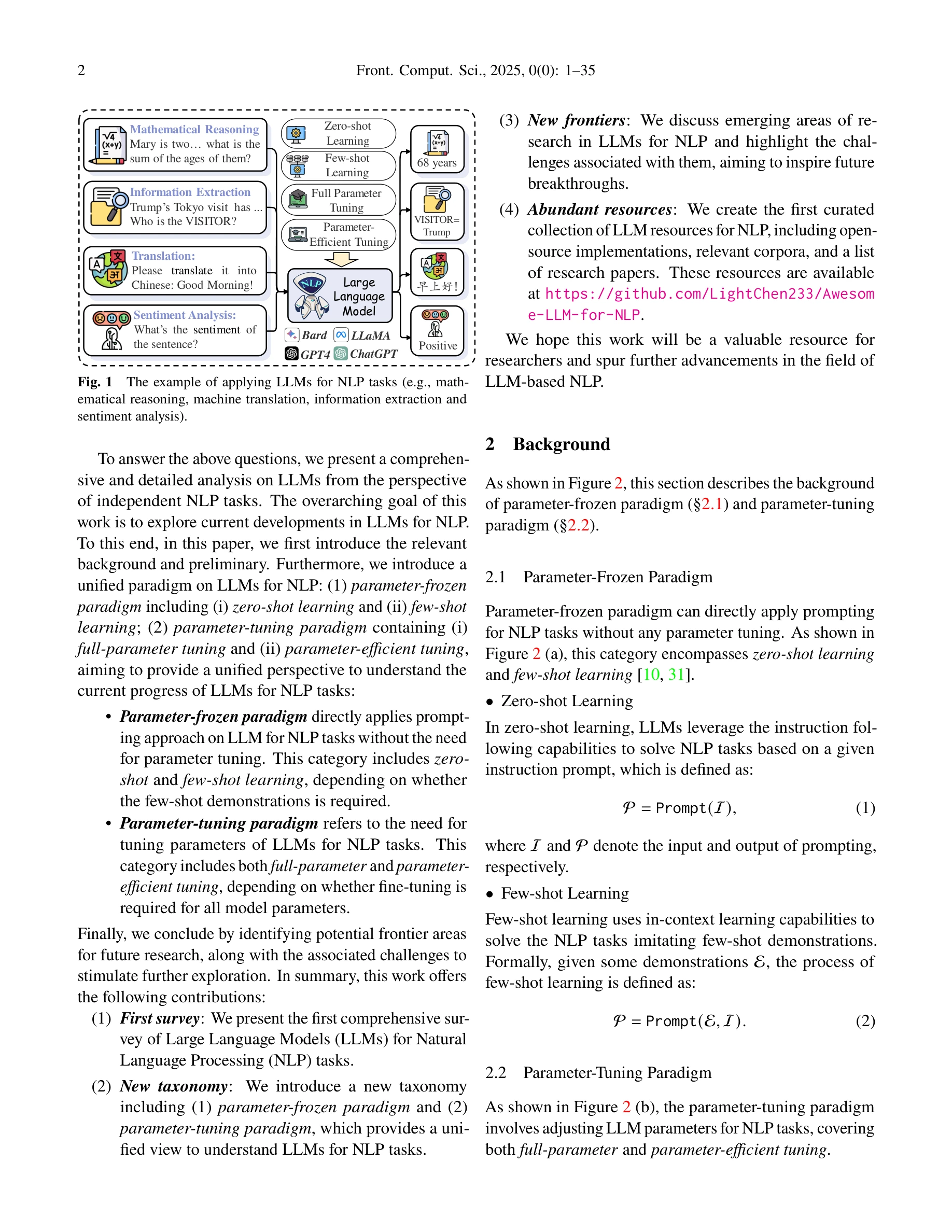

파라미터 동결(a) 및 파라미터 튜닝(b) 패러다임의 분류체계

파라미터 동결 학습은 최저 비용과 최고의 도메인 외 일반화 성능, 전체 파라미터 튜닝은 최고 정확도 달성

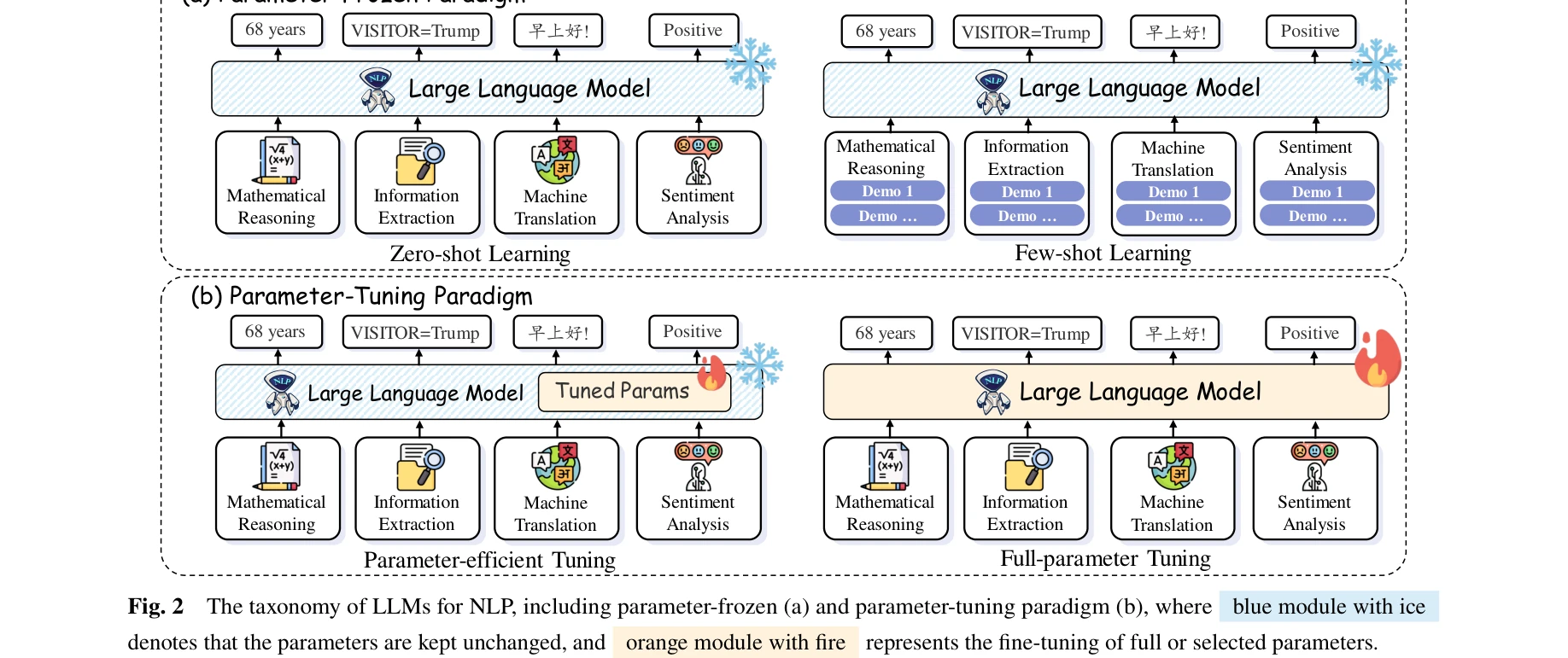

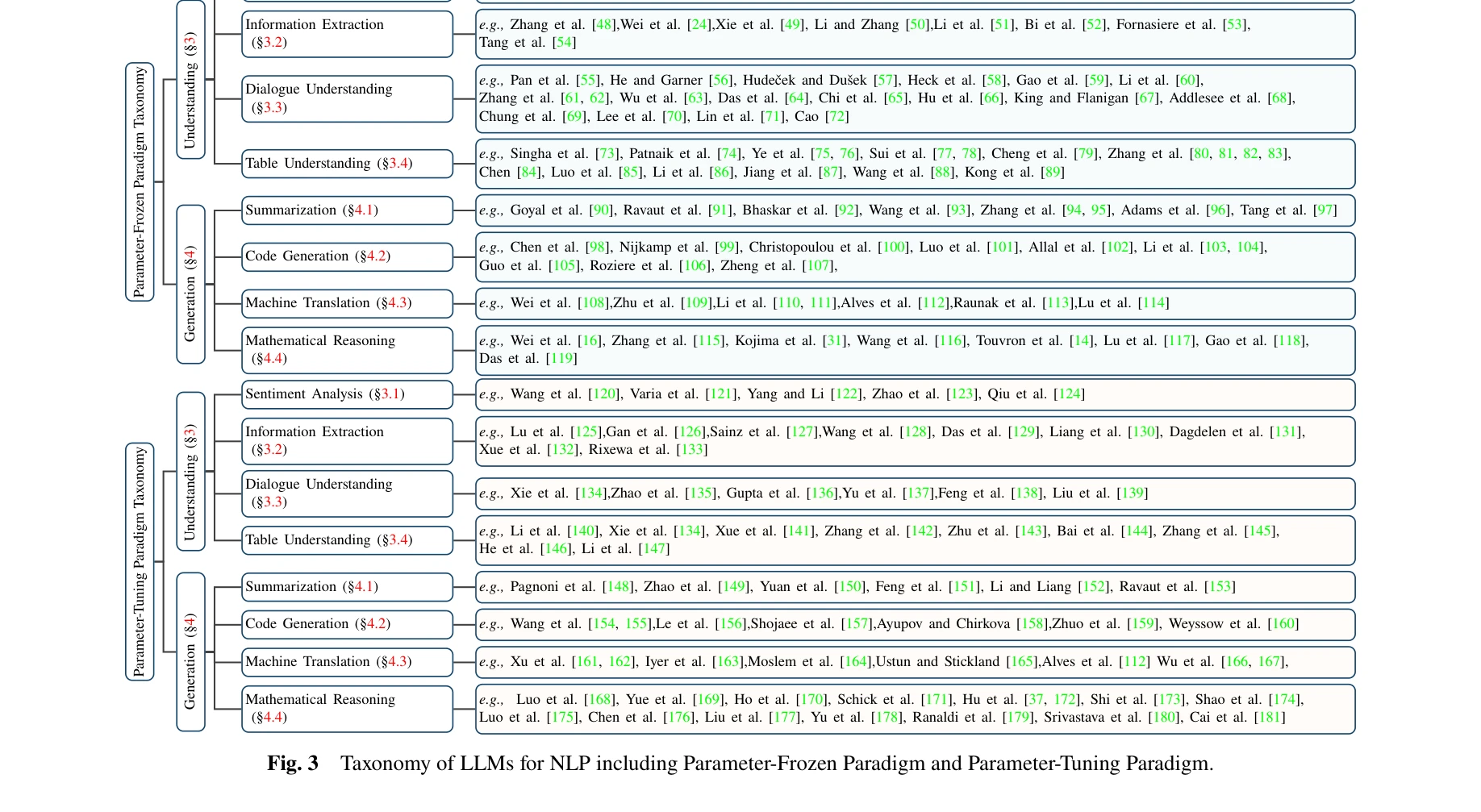

자연언어 이해(NLU) 작업: 감정 분석, 정보 추출, 대화 이해, 표 이해

파라미터 동결 패러다임:

파라미터 튜닝 패러다임:

NLP 작업별 적용:

총평: 본 논문은 LLM 시대 NLP 분야의 현황을 최초로 체계적으로 정리한 중요한 서베이로, 파라미터 동결/튜닝 이분법적 분류는 실무자들에게 명확한 의사결정 기준을 제공한다. 다만 제공된 본문이 제한적이어서 각 NLP 작업별 LLM의 실제 성능 한계 및 도전 과제에 대한 심화 논의가 추가된다면 더욱 완성도 높은 자료가 될 것으로 기대된다.