Achievement

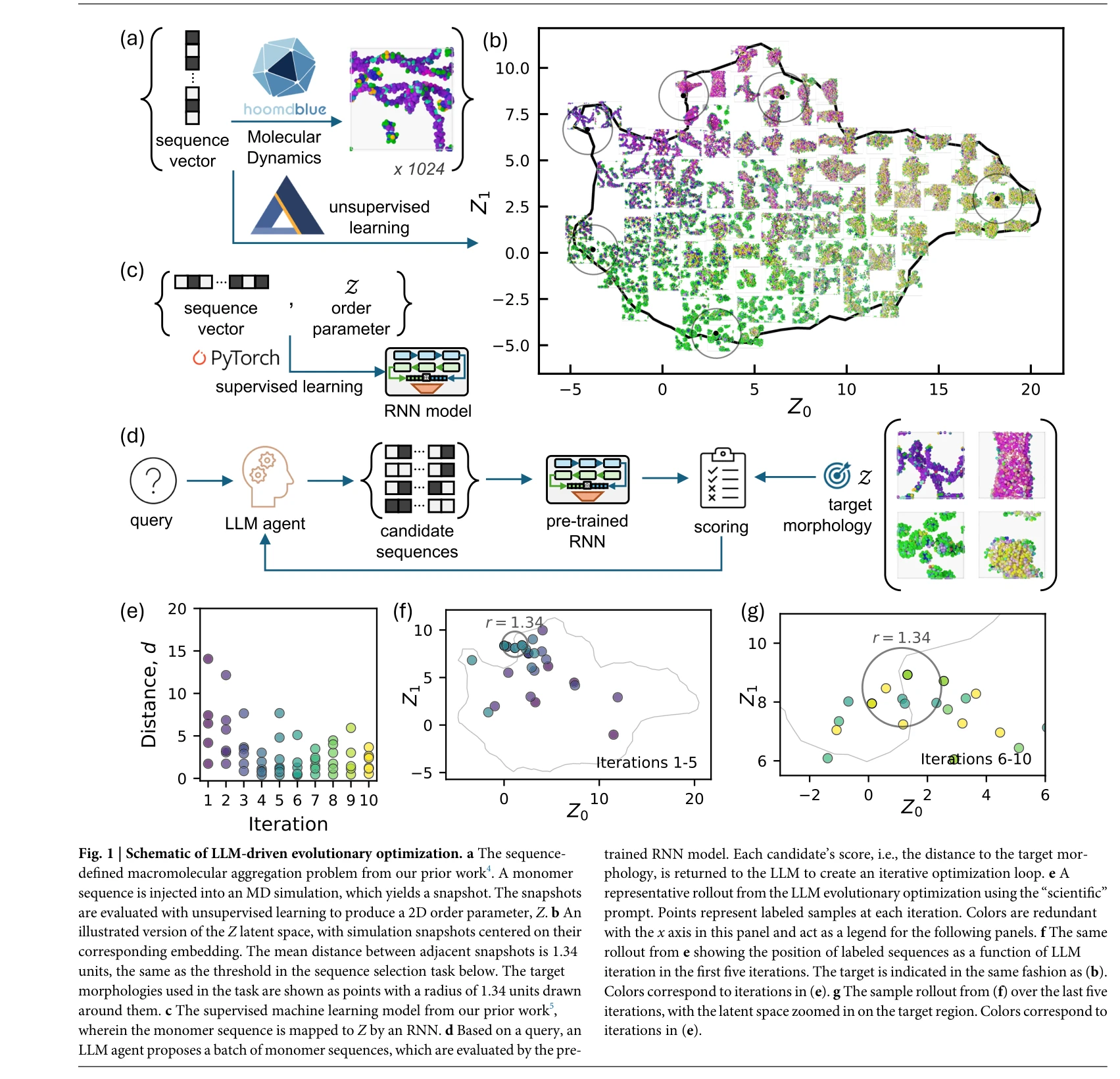

Fig. 1: LLM 기반 진화 최적화의 개념도. (a) 단량체 서열→MD 시뮬레이션→2D 순서 매개변수 Z 추출 파이프라인, (d) LLM 에이전트가 서열을 제안하면 RNN 모델로 평가하는 반복 루프

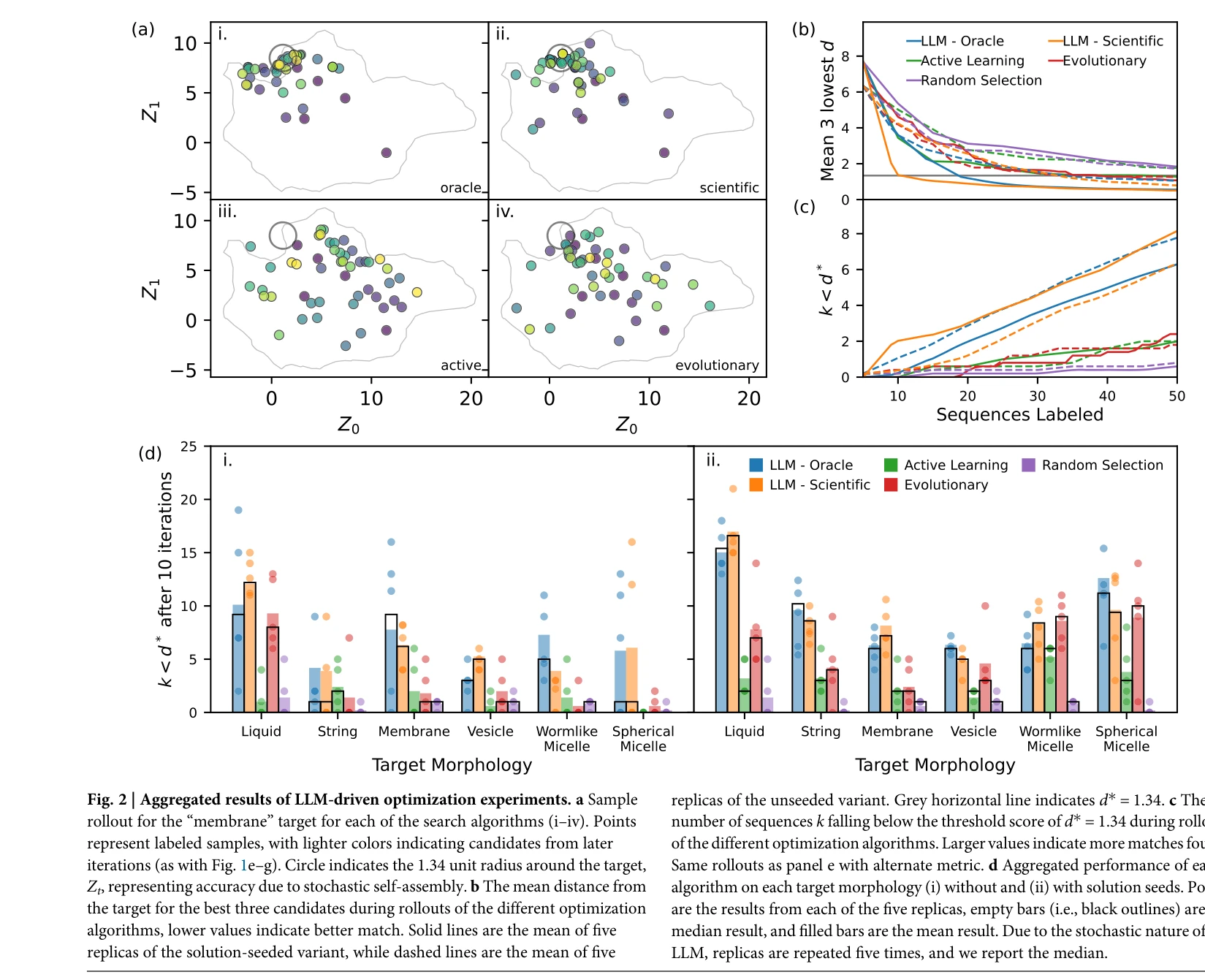

Fig. 2: 최적화 알고리즘 성능 비교. (b) 최고 3개 후보의 평균 거리, (c) 역치값 이하의 서열 개수, (d) 6가지 목표 형태에 대한 종합 성과 (씨앗 없음/있음)

- LLM의 우수한 수렴성: LLM 기반 최적화기는 활동적 학습과 진화 알고리즘보다 빠르게 목표 영역에 수렴하며, 탐색(exploration)과 착취(exploitation) 사이의 균형을 효과적으로 유지했다. 초기 5회 반복에서 올바른 영역을 찾고, 마지막 5회에서 다양한 우수 해를 발견했다.

- 일관된 우수 성능: 12개 테스트 케이스(6가지 목표 형태 × 씨앗 있음/없음) 중 11개에서 LLM 기반 방법이 최고 평균 성능을 기록했다. 씨앗 지원 시 중앙값 성능이 특히 향상되었으며, 모든 형태에서 중앙값 k=0인 경우가 사라졌다.

- 문맥 무시 상황에서의 자동 추론: 문맥 정보를 제공하지 않은 "oracle" 프롬프트에서도 LLM은 단백질 폴딩 문제로 자동 추론하면서 효과적으로 수행했다. 이는 LLM이 암묵적 도메인 지식을 활용하고 있음을 시사한다.