Essence

SciQAG 프레임워크: 과학 문헌으로부터 QA 생성 (점선은 선택적 미세조정)

대규모 언어모델(LLM)을 활용하여 과학 논문으로부터 자동으로 고품질의 개방형 질의응답 쌍(188,042개 QA 쌍, 24개 과학 분야)을 생성하고, 세밀한 평가 지표(RACAR)로 품질을 필터링하는 SciQAG 프레임워크를 제안한다.

저자: Yuwei Wan, Yixuan Liu, Aswathy Ajith, Clara Grazian, Bram Hoex, Wenjie Zhang, Chunyu Kit, Tong Xie, Ian Foster | 날짜: 2024 | DOI: arXiv:2405.09939

SciQAG 프레임워크: 과학 문헌으로부터 QA 생성 (점선은 선택적 미세조정)

대규모 언어모델(LLM)을 활용하여 과학 논문으로부터 자동으로 고품질의 개방형 질의응답 쌍(188,042개 QA 쌍, 24개 과학 분야)을 생성하고, 세밀한 평가 지표(RACAR)로 품질을 필터링하는 SciQAG 프레임워크를 제안한다.

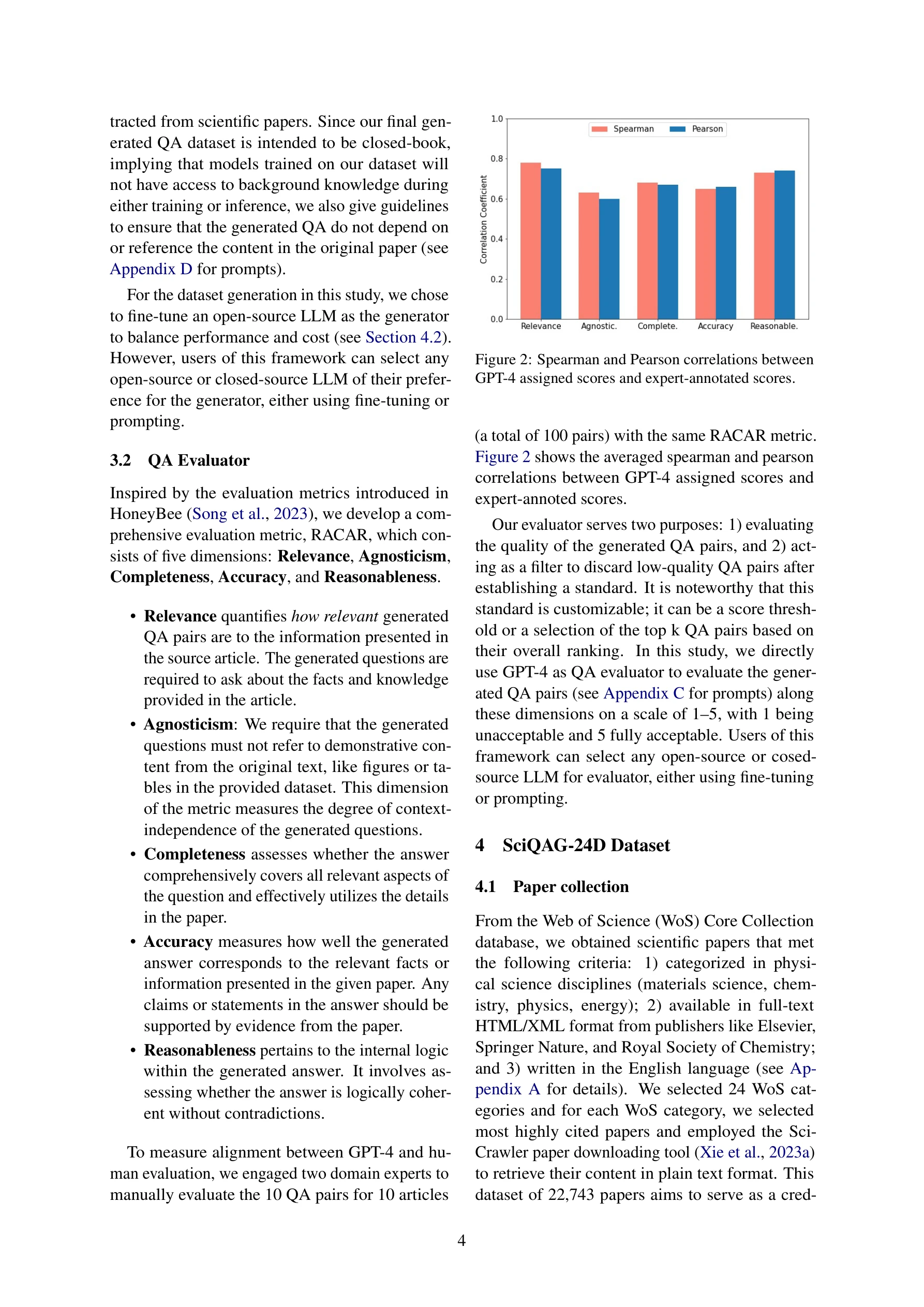

GPT-4 점수와 전문가 주석 점수 간의 Spearman/Pearson 상관계수

총평: SciQAG는 폐쇄형 개방형 과학 QA 자동 생성의 실질적 해결책을 제시하며, 188K 규모의 다학제 데이터셋과 신뢰성 있는 평가 프레임워크를 제공하는 점에서 가치 있는 기여이다. 다만 생성 품질 보증의 근본적 한계와 평가 지표의 LLM 의존성에 대한 추가 검증이 필요하다.